利用 Python 爬虫获取按关键字搜索淘宝商品的完整指南

在电商数据分析和市场研究中,获取商品的详细信息是至关重要的一步。淘宝作为中国最大的电商平台之一,提供了丰富的商品数据。通过 Python 爬虫技术,我们可以高效地获取按关键字搜索的淘宝商品信息。本文将详细介绍如何利用 Python 爬虫技术获取淘宝商品信息,并提供详细的代码示例。

一、项目背景与目标

淘宝平台上的商品信息对于商家、市场研究人员以及消费者都具有重要价值。通过分析这些数据,可以了解市场趋势、消费者需求以及竞争对手情况。本项目的目标是利用 Python 爬虫技术,自动化地获取按关键字搜索的淘宝商品信息,并将其存储到本地文件或数据库中,以便进行后续的数据分析和挖掘。

二、技术选型与开发环境搭建

(一)技术选型

-

Python 语言:Python 语言具有简洁易读、丰富的库支持和强大的社区资源,是编写爬虫程序的首选语言之一。

-

requests 库:

requests是一个简洁易用的 HTTP 库,支持多种 HTTP 方法,能够模拟浏览器行为,实现与网页服务器的通信。 -

BeautifulSoup 库:

BeautifulSoup是一个用于解析 HTML 和 XML 文档的库,适用于从网页中提取和操作数据。 -

pandas 库:

pandas是一个强大的数据处理库,适用于数据清洗、转换和存储。 -

selenium 库:

selenium是一个用于自动化测试的工具,可以模拟用户在浏览器中的操作,适用于动态网页的爬取。

(二)开发环境搭建

-

Python 开发工具:安装并配置 Python,确保 Python 环境变量正确设置。推荐使用 PyCharm 或 Visual Studio Code 等集成开发环境(IDE),它们提供了代码编辑、调试、项目管理等便捷功能。

-

安装第三方库:通过 pip 安装

requests、BeautifulSoup、pandas和selenium等第三方库。pip install requests beautifulsoup4 pandas selenium

三、爬虫程序设计与实现

(一)分析网页结构

在编写爬虫程序之前,我们需要对淘宝商品搜索结果页面的 HTML 结构进行深入分析。通过浏览器的开发者工具(如 Chrome 的开发者工具),查看搜索结果页面的 HTML 源代码,了解各个关键信息(如商品标题、价格、销量等)所在的 HTML 元素及其对应的 CSS 类名、ID 等属性。

(二)编写爬虫程序

1. 使用 selenium 模拟搜索

由于淘宝的商品搜索结果页面是动态加载的,因此需要使用 selenium 来模拟用户在浏览器中的搜索操作。

Python复制

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

import time# 启动 Chrome 浏览器

options = webdriver.ChromeOptions()

options.add_experimental_option("excludeSwitches", ['enable-automation'])

driver = webdriver.Chrome(options=options)

driver.get('https://www.taobao.com')

driver.maximize_window()# 等待用户手动登录

input('请手动登录淘宝,登录完成后按回车键继续...')# 搜索关键字

def search_keyword(keyword):input_element = WebDriverWait(driver, 10).until(EC.presence_of_element_located((By.CSS_SELECTOR, "#q")))input_element.clear()input_element.send_keys(keyword)search_button = WebDriverWait(driver, 10).until(EC.element_to_be_clickable((By.CSS_SELECTOR, "#J_SearchForm button")))search_button.click()time.sleep(5) # 等待搜索结果加载完成# 示例:搜索关键字

search_keyword('苹果手机')2. 解析搜索结果页面

使用 BeautifulSoup 解析搜索结果页面,提取商品的关键信息。

from bs4 import BeautifulSoup

import pandas as pddef parse_search_results():html = driver.page_sourcesoup = BeautifulSoup(html, 'html.parser')items = soup.select('.m-itemlist .items .item')data = []for item in items:title = item.select_one('.title').text.strip()price = item.select_one('.price').text.strip()deal = item.select_one('.deal-cnt').text.strip()shop = item.select_one('.shop').text.strip()location = item.select_one('.location').text.strip()data.append({'title': title,'price': price,'deal': deal,'shop': shop,'location': location})return data# 示例:解析搜索结果

results = parse_search_results()

df = pd.DataFrame(results)

df.to_csv('taobao_search_results.csv', index=False, encoding='utf-8-sig')3. 翻页操作

通过 selenium 实现自动翻页,获取更多商品信息。

def turn_page(page_number):try:print(f"正在翻页到第 {page_number} 页")page_input = WebDriverWait(driver, 10).until(EC.presence_of_element_located((By.CSS_SELECTOR, "#mainsrp-pager .input.J_Input")))page_input.clear()page_input.send_keys(page_number)go_button = WebDriverWait(driver, 10).until(EC.element_to_be_clickable((By.CSS_SELECTOR, "#mainsrp-pager .btn.J_Btn")))go_button.click()time.sleep(5) # 等待页面加载完成except Exception as e:print(f"翻页失败:{e}")# 示例:翻页操作

for page in range(2, 6): # 翻到第 2 到 5 页turn_page(page)results = parse_search_results()df = pd.DataFrame(results)df.to_csv(f'taobao_search_results_page_{page}.csv', index=False, encoding='utf-8-sig')(三)异常处理与重试机制

在爬虫程序运行过程中,可能会遇到各种异常情况,如网络请求超时、HTML 解析错误等。为了提高程序的稳定性和可靠性,我们需要在代码中添加异常处理逻辑,并实现重试机制。

from selenium.common.exceptions import TimeoutExceptiondef safe_parse_search_results():try:return parse_search_results()except TimeoutException:print("页面加载超时,正在重试...")time.sleep(5)return safe_parse_search_results()except Exception as e:print(f"解析搜索结果失败:{e}")return []四、爬虫程序优化与性能提升

(一)合理设置请求间隔

在爬取数据时,需要合理设置请求间隔,避免对淘宝服务器造成过大压力,同时也降低被网站封禁 IP 的风险。可以在每次翻页或请求之间设置适当的等待时间,如等待 1 - 3 秒。

time.sleep(random.randint(1, 3)) # 随机等待 1 - 3 秒(二)使用代理 IP

为了进一步降低被封禁 IP 的风险,可以使用代理 IP 服务器。通过代理 IP 发送请求,可以隐藏真实的 IP 地址,使爬虫程序更加稳定地运行。

from selenium.webdriver.common.proxy import Proxy, ProxyTypeproxy = Proxy()

proxy.proxy_type = ProxyType.MANUAL

proxy.http_proxy = "代理 IP 地址:代理端口号"

proxy.ssl_proxy = "代理 IP 地址:代理端口号"capabilities = webdriver.DesiredCapabilities.CHROME

proxy.add_to_capabilities(capabilities)driver = webdriver.Chrome(desired_capabilities=capabilities)五、实践案例与数据分析

(一)实践案例

在实际应用中,我们利用上述 Python 爬虫程序对淘宝平台上按关键字搜索的商品进行了信息爬取。通过模拟用户搜索操作、解析搜索结果页面和自动翻页,成功获取了商品标题、价格、销量、店铺名称等详细信息。这些数据被存储到本地的 CSV 文件中,为后续的数据分析和市场研究提供了有力支持。

(二)数据分析

基于爬取到的商品数据,我们进行了多维度的数据分析。通过对商品价格的统计分析,了解了市场定价情况;分析商品销量分布,识别了热门商品;统计店铺分布情况,了解了市场格局。这些分析结果为商家优化产品策略、制定营销计划提供了有力依据,同时也为市场研究人员提供了宝贵的市场洞察。

六、总结与展望

通过 Python 爬虫技术,我们成功实现了对淘宝商品信息的自动化爬取,并进行了有效的数据分析。这一实践不仅展示了 Python 爬虫的强大功能,也为电商领域的数据挖掘提供了新的思路和方法。未来,我们可以进一步优化爬虫程序,提高数据爬取的效率和准确性;同时,结合更先进的数据分析技术,如机器学习和数据挖掘算法,深入挖掘商品数据中的潜在价值,为电商行业的决策提供更有力的支持。

希望本文能帮助读者快速上手并实现淘宝商品信息的爬取和分析。如果有任何问题或建议,欢迎随时交流。

相关文章:

利用 Python 爬虫获取按关键字搜索淘宝商品的完整指南

在电商数据分析和市场研究中,获取商品的详细信息是至关重要的一步。淘宝作为中国最大的电商平台之一,提供了丰富的商品数据。通过 Python 爬虫技术,我们可以高效地获取按关键字搜索的淘宝商品信息。本文将详细介绍如何利用 Python 爬虫技术获…...

LeetCode 0080.删除有序数组中的重复项 II:双指针 - C++/Java5 行版

【LetMeFly】80.删除有序数组中的重复项 II:双指针 - C/Java5 行版 力扣题目链接:https://leetcode.cn/problems/remove-duplicates-from-sorted-array-ii/ 给你一个有序数组 nums ,请你 原地 删除重复出现的元素,使得出现次数超…...

【C++高并发服务器WebServer】-15:poll、epoll详解及实现

本文目录 一、poll二、epoll2.1 相对poll和select的优点2.2 epoll的api2.3 epoll的demo实现2.5 epoll的工作模式 一、poll poll是对select的一个改进,我们先来看看select的缺点。 我们来看看poll的实现。 struct pollfd {int fd; /* 委托内核检测的文件描述符 */s…...

MapReduce是什么?

MapReduce 是一种编程模型,最初由 Google 提出,旨在处理大规模数据集。它是分布式计算的一个重要概念,通常用于处理海量数据并进行并行计算。MapReduce的基本思想是将计算任务分解为两个阶段:Map 阶段和 Reduce 阶段。 Map 阶段&a…...

git提交到GitHub问题汇总

1.main->master git默认主分支是maser,如果是按照这个分支名push,GitHub会出现两个branch,与预期不符 解决方案:更改原始主分支名为main git config --global init.defaultBranch main2.git:OpenSSL SSL_read: SS…...

CNN-GRU卷积神经网络门控循环单元多变量多步预测,光伏功率预测(Matlab完整源码和数据)

代码地址:CNN-GRU卷积神经网络门控循环单元多变量多步预测,光伏功率预测(Matlab完整源码和数据) CNN-GRU卷积神经网络门控循环单元多变量多步预测,光伏功率预测 一、引言 1.1、研究背景和意义 随着全球能源危机和环境问题的日…...

编译原理面试问答

编译原理面试拷打 1.编译原理的基本概念 编译原理是研究如何将高级程序语言转换为计算机可执行代码的理论与技术,其核心目标是实现高效、正确的代码翻译。 **编译器:**将源代码转化为目标代码(机器码、字节码等)。一次翻译整个程…...

LIMO:上海交大的工作 “少即是多” LLM 推理

25年2月来自上海交大、SII 和 GAIR 的论文“LIMO: Less is More for Reasoning”。 一个挑战是在大语言模型(LLM)中的复杂推理。虽然传统观点认为复杂的推理任务需要大量的训练数据(通常超过 100,000 个示例),但本文展…...

Java 魔法:精准掌控 PDF 合同模板,指定页码与关键字替换签章日期

朋友们!在实际业务场景中,经常会碰到处理 PDF 合同模板的需求,要在几十页的合同里对指定页面替换公章、签名和日期,还涉及多人签名以及多个公司盖公章。下面就给大家分享两种用 Java 处理这类问题的方法,一种是通过指定…...

Ollama 部署本地大语言模型

一、下载安装ollama 1.百度 ollama Ollama 2.点击下载 可以复制下载链接,使用下载器下载。 3.双击安装 默认安装目录:C:\Users\用户名\AppData\Local\Programs\Ollama 二、更改模型下载目录 0.默认下载目录 (跳过) 之前没下载过模型,不…...

Jackson扁平化处理对象

POJO对象 Data public class People {private PeopleInfo peopleInfo;private List<String> peopleIds;private Map<String, String> peopleMap;Datapublic static class PeopleInfo {private String name;private String address;} }JSON序列化处理 直接将对象进…...

在 Ubuntu 上安装 MySQL 的详细指南

在Ubuntu环境中安装 mysql-server 以及 MySQL 开发包(包括头文件和动态库文件),并处理最新版本MySQL初始自动生成的用户名和密码,可以通过官方的APT包管理器轻松完成。以下是详细的步骤指南,包括从官方仓库和MySQL官方…...

pytest-xdist 进行多进程并发测试!

在软件开发过程中,测试是确保代码质量和可靠性的关键步骤。随着项目规模的扩大和复杂性的增加,测试用例的执行效率变得尤为重要。为了加速测试过程,特别是对于一些可以并行执行的测试用 例,pytest-xdist 提供了一种强大的工具&…...

24.ppt:小李-图书策划方案【1】

目录 NO1234 NO5678 NO1234 新建PPT两种方式👇docx中视图→导航窗格→标题1/2/3ppt新建幻灯片→从大纲→重置开始→版式设计→主题插入→表格 NO5678 SmartArt演示方案:幻灯片放映→自定义幻灯片放映→新建→选中添加...

模型 替身决策

系列文章分享模型,了解更多👉 模型_思维模型目录。替身决策,换位思考,多角度决策。 1 替身决策模型的应用 1.1 替身决策模型在面试中的应用-小李的求职面试 小李是一名应届毕业生,正在积极寻找工作机会。在面试过程中…...

ESP32S3读取数字麦克风INMP441的音频数据

ESP32S3 与 INMP441 麦克风模块的集成通常涉及使用 I2S 接口进行数字音频数据的传输。INMP441 是一款高性能的数字麦克风,它通过 I2S 接口输出音频数据。在 Arduino 环境中,ESP32S3 的开发通常使用 ESP-IDF(Espressif IoT Development Framew…...

docker环境下部署face-search开源人脸识别模型

由于我们是直接将face-search部署在docker容器中的,所以,在部署之前一定要检查一下自己的docker环境,要不然部署过程中会出现各种各样的问题 我这里的docker环境是 一、安装docker环境 如果docker版本比较低或者docker-compose的版本比较低的情况下,部署的时候docker的yml…...

301.华为交换机堆叠技术基础

华为交换机堆叠技术基础 一、概念及原理部分1.堆叠简介1.1 什么是堆叠1.2 可靠性网络架构1.3 华为堆叠设备1.4 其他厂商的堆叠2.堆叠的示意图3.堆叠的应用3.1 中小企业3.2 园区网4.堆叠的原理4.1基本的概念4.2 堆叠建立4.3 角色选举4.4 版本同步4.5 配置同步4.6 堆叠系统的登录…...

【数据库创建】用ij工具部署Derby数据库并验证

Java有一个内置的Derby数据库,是一个完全用Java语言编写的、功能强大的微型数据库,其基础引擎和内嵌的JDBC驱动总共大约2MB大小。Derby为用户提供了轻量的标准数据库引擎,它可以紧密地嵌入到任何基于Java的解决方案中。 Derby的特性令人惊奇&…...

飞牛fnOS安装了Airplay没有声音找不到声卡的问题

主要问题描述:我在飞牛的Docker里安装了 Airplay, 这样把NAS接一个外接音箱,就可以当成无线音箱来用,直接把手机的音乐播放投到上面来播放。 (文章底部有写我是怎么安装Airplay的) 我的报错如下࿱…...

netcore openTelemetry+prometheus+grafana

一、netcore项目 二、openTelemetry 三、prometheus 四、grafana添加Dashborad aspire/src/Grafana/dashboards at main dotnet/aspire GitHub 导入:aspnetcore.json和aspnetcore-endpoint.json 效果:...

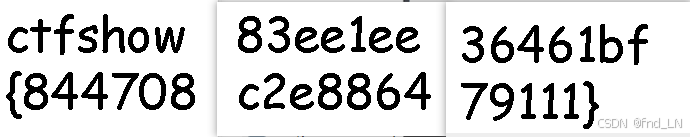

全程Kali linux---CTFshow misc入门(38-50)

第三十八题: ctfshow{48b722b570c603ef58cc0b83bbf7680d} 第三十九题: 37换成1,36换成0,就得到长度为287的二进制字符串,因为不能被8整除所以,考虑每7位转换一个字符,得到flag。 ctfshow{5281…...

DeepSeek与人工智能的结合:探索搜索技术的未来

云边有个稻草人-CSDN博客 目录 引言 一、DeepSeek的技术背景 1.1 传统搜索引擎的局限性 1.2 深度学习在搜索中的优势 二、DeepSeek与人工智能的结合 2.1 自然语言处理(NLP) 示例代码:基于BERT的语义搜索 2.2 多模态搜索 示例代码&…...

用 DeepSeek + Kimi 自动做 PPT,效率起飞

以下是使用 DeepSeek Kimi 自动做 PPT 的详细操作步骤: 利用 DeepSeek 生成 PPT 内容: 访问 DeepSeek 官网,完成注册/登录后进入对话界面。输入指令,例如“请用 Markdown 格式生成一份关于[具体主题]的 PPT 大纲,需包…...

LeetCode 每日一题 2025/2/3-2025/2/9

记录了初步解题思路 以及本地实现代码;并不一定为最优 也希望大家能一起探讨 一起进步 目录 2/3 680. 验证回文串 II2/4 922. 按奇偶排序数组 II2/5 90. 子集 II2/6 47. 全排列 II2/7 59. 螺旋矩阵 II2/8 63. 不同路径 II2/9 80. 删除有序数组中的重复项 II 2/3 680…...

自动驾驶数据集三剑客:nuScenes、nuImages 与 nuPlan 的技术矩阵与生态协同

目录 1、引言 2、主要内容 2.1、定位对比:感知与规划的全维覆盖 2.2、数据与技术特性对比 2.3、技术协同:构建全栈研发生态 2.4、应用场景与评估体系 2.5、总结与展望 3、参考文献 1、引言 随着自动驾驶技术向全栈化迈进,Motional 团…...

)

设计模式 ->模板方法模式(Template Method Pattern)

模板方法模式 模板方法模式是一种行为设计模式,它在一个方法中定义一个操作的算法骨架,而将一些步骤延迟到子类中实现。它允许子类在不改变算法结构的情况下重新定义算法中的某些步骤 特点 算法骨架: 在基类中定义算法的框架延迟实现&…...

DeepSeekMoE 论文解读:混合专家架构的效能革新者

论文链接:DeepSeekMoE: Towards Ultimate Expert Specialization in Mixture-of-Experts Language Models 目录 一、引言二、背景知识(一)MoE架构概述(二)现有MoE架构的问题 三、DeepSeekMoE架构详解(一&a…...

机器学习之心的创作纪念日

机缘 今天,是我成为创作者的第1460天。 在这段时间里,获得了很大的成长。 虽然日常忙碌但还在坚持创作、初心还在。 日常 创作已经成为我生活的一部分,尤其是在我的工作中,创作是不可或缺的,创作都是核心能力之一。…...

【python】简单的flask做页面。一组字母组成的所有单词。这里的输入是一组字母,而输出是所有可能得字母组成的单词列表

目录结构如下: https://github.com/kaede316/Pythons_pj.git 效果: 后续可扩展为工具网站: 更新 2025.02.09 1、增加等间距制作人 时间信息 2、增加判断润年的功能...