K8S内容分发网络之集群,nginx,负载均衡,防火墙

K8S内容分发网络之集群,nginx,负载均衡,防火墙

- 一、Kubernetes 区域可采用 Kubeadm 方式进行安装。

- 1.所有节点,关闭防火墙规则,关闭selinux,关闭swap交换

- 2.修改主机名

- 3.所有节点修改hosts文件

- 4.调整内核参数

- 5.生效参数

- 6.安装软件

- 7.部署K8S集群

- 8.查看 kubeadm-init 日志

- 9.设定kubectl

- 10.所有节点部署网络插件flannel

- 11.在 node 节点上执行 kubeadm join 命令加入群集

- 12.在master节点查看节点状态

- 二、创建两个自主式Pod资源

- 1.生成nginx的pod模板文件

- 2.修改模板文件

- 3.两个node节点的存储卷,写入不同的html文件内容,验证访问网页

- 三、创建service资源

- 1.编写service对应的yaml文件

- 2.查看service资源

- 3.测试使用nodeIP:nodePort访问nginx网页

- 四、搭建负载均衡层

- 1.两台负载均衡器配置nginx

- 2.两台负载均衡器配置keepalived

- 3.关闭主调度器的nginx服务,模拟故障,测试keepalived

- 五、配置防火墙服务器

- 1.关闭防火墙和selinux

- 2.开启路由转发功能

- 3.配置iptables策略

- 4.新增一台客户机(192.168.174.12)

- 5.测试

| 节点 | IP | 安装组件 |

|---|---|---|

| master(2C/4G,cpu核心数要求大于2) | 192.168.174.15 | docker、kubeadm、kubelet、kubectl、flannel |

| node01(2C/2G) | 192.168.174.18 | docker、kubeadm、kubelet、kubectl、flannel |

| node02(2C/2G) | 192.168.174.19 | docker、kubeadm、kubelet、kubectl、flannel |

| lb01 | 192.168.174.18 | nginx,keepalived |

| lb02 | 192.168.174.19 | nginx,keepalived |

| 网关服务器 | 内网网卡ens33:192.168.174.12,外网网卡ens37:12.0.0.1 | iptables |

| 客户端 | 12.0.0.12 |

一、Kubernetes 区域可采用 Kubeadm 方式进行安装。

1.所有节点,关闭防火墙规则,关闭selinux,关闭swap交换

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X

swapoff -a #交换分区必须要关闭

sed -ri 's/.*swap.*/#&/' /etc/fstab #永久关闭swap分区,&符号在sed命令中代表上次匹配的结果

#加载 ip_vs 模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

2.修改主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

3.所有节点修改hosts文件

vim /etc/hosts

192.168.174.15 master01

192.168.174.18 node01

192.168.174.19 node02

4.调整内核参数

cat > /etc/sysctl.d/kubernetes.conf << EOF

#开启网桥模式,可将网桥的流量传递给iptables链

net.bridge.bridge-nf-call-ip6tables=1

net.bridge.bridge-nf-call-iptables=1

#关闭ipv6协议

net.ipv6.conf.all.disable_ipv6=1

net.ipv4.ip_forward=1

EOF

5.生效参数

sysctl --system

6.安装软件

(1)所有节点安装docker

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io

cat > /etc/docker/daemon.json <<EOF

{"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],"exec-opts": ["native.cgroupdriver=systemd"],"log-driver": "json-file","log-opts": {"max-size": "100m"}

}

EOF

#使用Systemd管理的Cgroup来进行资源控制与管理,因为相对Cgroupfs而言,Systemd限制CPU、内存等资源更加简单和成熟稳定。

#日志使用json-file格式类型存储,大小为100M,保存在/var/log/containers目录下,方便ELK等日志系统收集和管理日志。

systemctl daemon-reload

systemctl restart docker.service

systemctl enable docker.service docker info | grep "Cgroup Driver"

(2)所有节点安装kubeadm,kubelet和kubectl

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOFyum install -y kubelet-1.20.11 kubeadm-1.20.11 kubectl-1.20.11

systemctl enable kubelet.service

#K8S通过kubeadm安装出来以后都是以Pod方式存在,即底层是以容器方式运行,所以kubelet必须设置开机自启

7.部署K8S集群

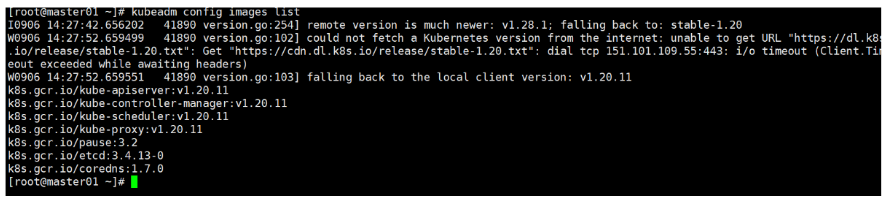

(1)查看初始化需要的镜像

kubeadm config images list

(2)在 master 节点上传 v1.20.11.zip压缩包至 /opt 目录

unzip v1.20.11.zip -d /opt/k8s

cd /opt/k8s/v1.20.11

for i in $(ls *.tar); do docker load -i $i; done

(3)复制镜像和脚本到 node 节点,并在 node 节点上执行脚本加载镜像文件

scp -r /opt/k8s root@192.168.174.18:/opt

scp -r /opt/k8s root@192.168.174.19:/opt

cd /opt/k8s/v1.20.11

for i in $(ls *.tar); do docker load -i $i; done

(3)初始化kubeadm

方法一:

kubeadm config print init-defaults > /opt/kubeadm-config.yamlcd /opt/

vim kubeadm-config.yaml

......

11 localAPIEndpoint:

12 advertiseAddress: 192.168.174.15 #指定master节点的IP地址

13 bindPort: 6443

......

34 kubernetesVersion: v1.20.11 #指定kubernetes版本号

35 networking:

36 dnsDomain: cluster.local

37 podSubnet: "10.244.0.0/16" #指定pod网段,10.244.0.0/16用于匹配flannel默认网段

38 serviceSubnet: 10.96.0.0/16 #指定service网段

39 scheduler: {}#末尾再添加以下内容

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

mode: ipvs #把默认的kube-proxy调度方式改为ipvs模式kubeadm init --config=kubeadm-config.yaml --upload-certs | tee kubeadm-init.log

#--experimental-upload-certs 参数可以在后续执行加入节点时自动分发证书文件,K8S V1.16版本开始替换为 --upload-certs

#tee kubeadm-init.log 用以输出日志

8.查看 kubeadm-init 日志

less kubeadm-init.logkubernetes配置文件目录

ls /etc/kubernetes///存放ca等证书和密码的目录

ls /etc/kubernetes/pki

方法二:

kubeadm init \

--apiserver-advertise-address=192.168.174.15 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version=v1.20.11 \

--service-cidr=10.96.0.0/16 \

--pod-network-cidr=10.244.0.0/16 \--token-ttl=0初始化集群需使用kubeadm init命令,可以指定具体参数初始化,也可以指定配置文件初始化。

可选参数:

--apiserver-advertise-address:apiserver通告给其他组件的IP地址,一般应该为Master节点的用于集群内部通信的IP地址,0.0.0.0表示节点上所有可用地址

--apiserver-bind-port:apiserver的监听端口,默认是6443

--cert-dir:通讯的ssl证书文件,默认/etc/kubernetes/pki

--control-plane-endpoint:控制台平面的共享终端,可以是负载均衡的ip地址或者dns域名,高可用集群时需要添加

--image-repository:拉取镜像的镜像仓库,默认是k8s.gcr.io

--kubernetes-version:指定kubernetes版本

--pod-network-cidr:pod资源的网段,需与pod网络插件的值设置一致。Flannel网络插件的默认为10.244.0.0/16,Calico插件的默认值为192.168.0.0/16;

--service-cidr:service资源的网段

--service-dns-domain:service全域名的后缀,默认是cluster.local--token-ttl:默认token的有效期为24小时,如果不想过期,可以加上 --token-ttl=0 这个参数方法二初始化后需要修改 kube-proxy 的 configmap,开启 ipvs

kubectl edit cm kube-proxy -n=kube-system

修改mode: ipvs

9.设定kubectl

kubectl需经由API server认证及授权后方能执行相应的管理操作,kubeadm 部署的集群为其生成了一个具有管理员权限的认证配置文件 /etc/kubernetes/admin.conf,它可由 kubectl 通过默认的 “$HOME/.kube/config” 的路径进行加载。

mkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config

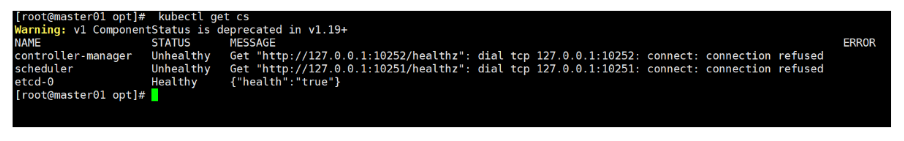

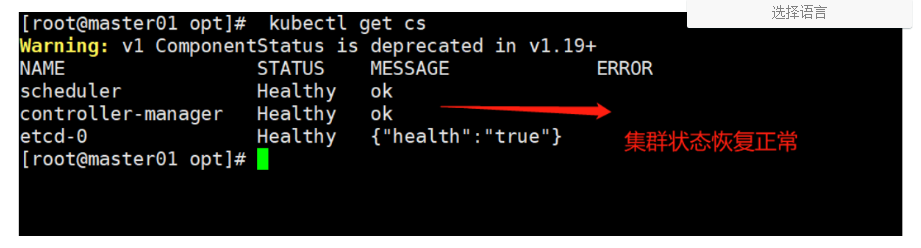

(1)如果 kubectl get cs 发现集群不健康,更改以下两个文件

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml修改如下内容把--bind-address=127.0.0.1变成--bind-address=192.168.174.15 #修改成k8s的控制节点master01的ip

把httpGet:字段下的hosts由127.0.0.1变成192.168.174.15(有两处)

#- --port=0 # 搜索port=0,把这一行注释掉systemctl restart kubelet

10.所有节点部署网络插件flannel

方法一:

(1)所有节点上传flannel镜像 flannel.tar 到 /opt 目录,master节点上传 kube-flannel.yml 文件

cd /opt

unzip kuadmin-flannel.zip

docker load -i flannel-cni-v1.2.0.tar

docker load -i flannel-v0.22.2.tar

mv cni cni_bak

mkdir cni/bin -p

tar zxvf cni-plugins-linux-amd64-v1.2.0.tgz -C cni/bin

ll cni/bin

(2)在 master 节点创建 flannel 资源

kubectl apply -f kube-flannel.yml

方法二:

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.ymlkubectl apply -f https://github.com/flannel-io/flannel/releases/latest/download/kube-flannel.yml

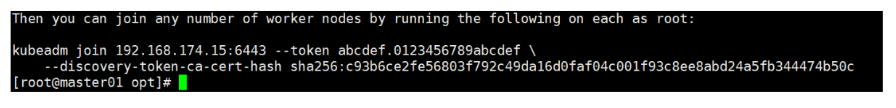

11.在 node 节点上执行 kubeadm join 命令加入群集

kubeadm join 192.168.174.15:6443 --token abcdef.0123456789abcdef \--discovery-token-ca-cert-hash sha256:c93b6ce2fe56803f792c49da16d0faf04c001f93c8ee8abd24a5fb344474b50c

12.在master节点查看节点状态

kubectl get nodeskubectl get pods -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-bccdc95cf-c9w6l 1/1 Running 0 71m

coredns-bccdc95cf-nql5j 1/1 Running 0 71m

etcd-master 1/1 Running 0 71m

kube-apiserver-master 1/1 Running 0 70m

kube-controller-manager-master 1/1 Running 0 70m

kube-flannel-ds-amd64-kfhwf 1/1 Running 0 2m53s

kube-flannel-ds-amd64-qkdfh 1/1 Running 0 46m

kube-flannel-ds-amd64-vffxv 1/1 Running 0 2m56s

kube-proxy-558p8 1/1 Running 0 2m53s

kube-proxy-nwd7g 1/1 Running 0 2m56s

kube-proxy-qpz8t 1/1 Running 0 71m

kube-scheduler-master 1/1 Running 0 70m

二、创建两个自主式Pod资源

要求在 Kubernetes 环境中,通过yaml文件的方式,创建2个Nginx Pod分别放置在两个不同的节点上,Pod使用hostPath类型的存储卷挂载,节点本地目录共享使用 /data,2个Pod副本测试页面二者要不同,以做区分

1.生成nginx的pod模板文件

kubectl run mynginx --image=nginx:1.14 --port=80 --dry-run=client -o yaml > mynginx.yaml

2.修改模板文件

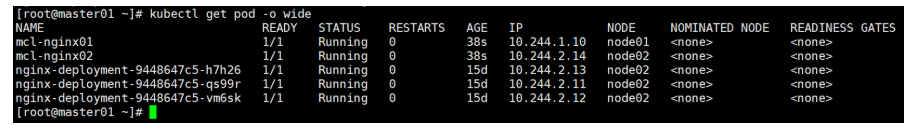

vim mynginx.yaml---apiVersion: v1kind: Podmetadata:labels:app: mcl-nginx #pod的标签name: mcl-nginx01spec:nodeName: node01 #指定该pod调度到node01节点containers:- image: nginx:1.14name: mynginxports:- containerPort: 80 #定义容器的端口volumeMounts: #挂载存储卷- name: page01 #名称需要与下方定义的存储卷的名称一致mountPath: /usr/share/nginx/html #容器中的挂载点,设置为nginx服务的网页根目录readOnly: false #可读可写volumes: #定义一个存储卷- name: page01 #存储卷的名称hostPath: #存储卷的类型为 hostPath path: /data #node节点的共享目录type: DirectoryOrCreate #该类型表示如果共享目录不存在,则系统会自动创建该目录---apiVersion: v1kind: Podmetadata:labels:app: mcl-nginx #pod的标签name: mcl-nginx02spec:nodeName: node02 #指定该pod调度到node02节点containers:- name: mynginximage: nginx:1.14ports:- containerPort: 80 #定义容器的端口volumeMounts: #挂载存储卷- name: page02 #名称需要与下方定义的存储卷的名称一致mountPath: /usr/share/nginx/html #容器中的挂载点readOnly: falsevolumes: #定义一个存储卷- name: page02 #存储卷的名称hostPath: #存储卷类型为 hostPathpath: /data #node节点的共享目录type: DirectoryOrCreate #该类型表示如果共享目录不存在,则系统会自动创建该目录#使用yaml文件创建自主式Pod资源kubectl apply -f mynginx.yaml#查看创建的两个pod,被调度到了不同的node节点[root@master ~]# kubectl get pods -o wideNAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

mcl-nginx01 1/1 Running 0 38s 10.244.1.10 node01 <none> <none>

mcl-nginx02 1/1 Running 0 38s 10.244.2.14 node02 <none> <none>

nginx-deployment-9448647c5-h7h26 1/1 Running 0 15d 10.244.2.13 node02 <none> <none>

nginx-deployment-9448647c5-qs99r 1/1 Running 0 15d 10.244.2.11 node02 <none> <none>

nginx-deployment-9448647c5-vm6sk 1/1 Running 0 15d 10.244.2.12 node02 <none> <none>

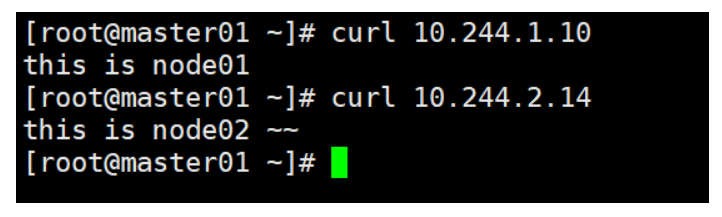

3.两个node节点的存储卷,写入不同的html文件内容,验证访问网页

#node01节点echo "this is node01" > /data/index.html#node02节点echo "this is node02 ~~" > /data/index.htmlcurl 10.244.1.10 #访问Node01节点的Pod的IPcurl 10.244.2.14 #访问Node02节点的Pod的IP

三、创建service资源

编写service对应的yaml文件,使用NodePort类型和TCP 30000端口将Nginx服务发布出去。

1.编写service对应的yaml文件

vim myservice.yamlapiVersion: v1kind: Servicemetadata: name: mcl-nginx-svcnamespace: default spec:type: NodePort #service类型设置为NodePortports: - port: 80 #service使用的端口号,ClusterIP后面跟的端口号。targetPort: 80 #需要转发到的后端Pod的端口号nodePort: 30000 #指定映射到物理机的端口号,k8s集群外部可以使用nodeIP:nodePort访问serviceselector: app: mcl-nginx #标签选择器要和上一步创建的pod的标签保持一致#创建service资源 kubectl apply -f myservice.yaml

2.查看service资源

kubectl get svcNAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 16d

mcl-nginx-svc NodePort 10.96.152.69 <none> 80:30000/TCP 12s

nginx NodePort 10.96.173.35 <none> 80:30291/TCP 15d

nginx-deployment NodePort 10.96.134.133 <none> 30000:32070/TCP 15d#查看service资源的详细信息kubectl describe svc mcl-nginx-svc

Name: mcl-nginx-svc

Namespace: default

Labels: <none>

Annotations: <none>

Selector: app=mcl-nginx

Type: NodePort

IP Families: <none>

IP: 10.96.152.69

IPs: 10.96.152.69

Port: <unset> 80/TCP

TargetPort: 80/TCP

NodePort: <unset> 30000/TCP

Endpoints: 10.244.1.10:80,10.244.2.14:80

Session Affinity: None

External Traffic Policy: Cluster

Events: <none>

3.测试使用nodeIP:nodePort访问nginx网页

curl 192.168.174.18:30000 #node01curl 192.168.174.19:30000 #node02

四、搭建负载均衡层

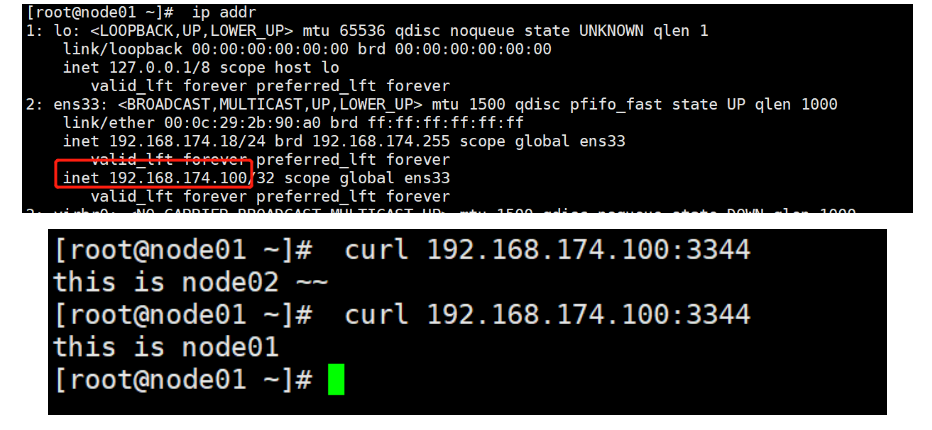

负载均衡区域配置Keepalived+Nginx,实现负载均衡高可用,通过VIP 192.168.174.100和自定义的端口号即可访问K8S发布出来的服务。

- lb01:192.168.174.18

- lb02:192.168.174.19

- VIP:192.168.174.100

1.两台负载均衡器配置nginx

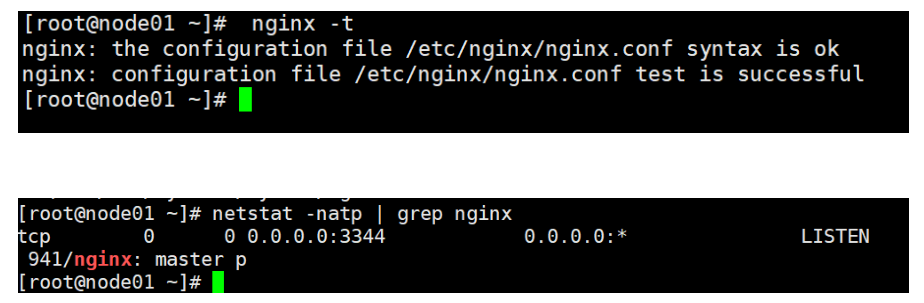

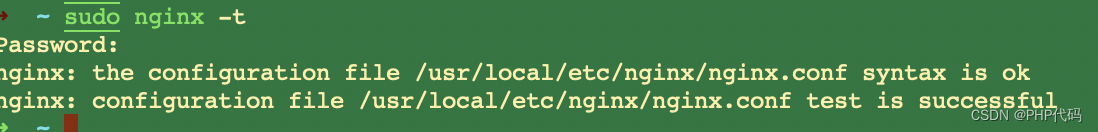

#关闭防火墙和selinuxsystemctl stop firewalldsystemctl disable firewalldsetenforce 0sed -i 's/enforcing/disabled/' /etc/selinux/config#设置主机名hostnamectl set-hostname lb01suhostnamectl set-hostname lb02su#配置nginx的官方在线yum源cat > /etc/yum.repos.d/nginx.repo << 'EOF'[nginx]name=nginx repobaseurl=http://nginx.org/packages/centos/7/$basearch/gpgcheck=0EOFyum install nginx -y#修改nginx配置文件,配置四层反向代理负载均衡,指定k8s群集2台node的节点ip和30000端口vim /etc/nginx/nginx.confevents {worker_connections 1024;}#在http块上方,添加stream块

stream {upstream k8s-nodes {server 192.168.174.18:30000; #node01IP:nodePortserver 192.168.174.19:30000; #node02IP:nodePort}server {listen 3344; #自定义监听端口proxy_pass k8s-nodes;}

}http {......#include /etc/nginx/conf.d/*.conf; #建议将这一行注释掉,否则会同时加载/etc/nginx/conf.d/default.conf文件中的内容,nginx会同时监听80端口。}#检查配置文件语法是否正确nginx -t #启动nginx服务,查看到已监听3344端口systemctl start nginxsystemctl enable nginxnetstat -natp | grep nginx

tcp 0 0 0.0.0.0:3344 0.0.0.0:* LISTEN 941/nginx: master p

2.两台负载均衡器配置keepalived

#安装keepalived服务yum install keepalived -y#修改keepalived配置文件vim /etc/keepalived/keepalived.conf! Configuration File for keepalivedglobal_defs {# 接收邮件地址notification_email {acassen@firewall.locfailover@firewall.locsysadmin@firewall.loc}# 邮件发送地址notification_email_from Alexandre.Cassen@firewall.locsmtp_server 127.0.0.1 #修改为本机回环地址smtp_connect_timeout 30router_id node01 #lb01节点的为node01,lb02节点的为node02}#添加一个周期性执行的脚本vrrp_script check_nginx {script "/etc/nginx/check_nginx.sh" #指定检查nginx存活的脚本路径}vrrp_instance VI_1 {state MASTER #lb01节点的为 MASTER,lb02节点的为 BACKUPinterface ens33 #指定网卡名称 ens33virtual_router_id 51 #指定组ID,两个节点要一致priority 100 #设置优先级,lb01节点设置为 100,lb02节点设置为 90advert_int 1authentication {auth_type PASSauth_pass 1111}virtual_ipaddress {192.168.174.100 #指定VIP地址}track_script { #追踪脚本check_nginx #指定vrrp_script配置的脚本}}#将配置文件中剩余的内容全都删除#主调度器lb01创建nginx状态检查脚本 vim /etc/nginx/check_nginx.sh#!/bin/bash#egrep -cv "grep|$$" 用于过滤掉包含grep 或者 $$ 表示的当前Shell进程IDcount=$(ps -ef | grep nginx | egrep -cv "grep|$$")if [ "$count" -eq 0 ];thensystemctl stop keepalivedfichmod +x /etc/nginx/check_nginx.sh #为脚本增加执行权限#启动keepalived服务(一定要先启动了nginx服务,再启动keepalived服务,否则keepalived检测到nginx没有启动,会杀死自己)systemctl start keepalivedsystemctl enable keepalivedip addr #查看主节点的VIP是否生成#测试使用VIP:3344访问web网页curl 192.168.174.100:3344

3.关闭主调度器的nginx服务,模拟故障,测试keepalived

#关闭主调度器lb01的Nginx服务,模拟宕机,观察VIP是否漂移到备节点systemctl stop nginxip addrsystemctl status keepalived #此时keepalived被脚本杀掉了 #备节点查看是否生成了VIPip addr #此时VIP漂移到备节点lb02#恢复主节点systemctl start nginx #先启动nginxsystemctl start keepalived #再启动keepalivedip addr

五、配置防火墙服务器

iptables防火墙服务器,设置双网卡,并且配置SNAT和DNAT转换实现外网客户端可以通过12.0.0.1访问内网的Web服务。

- 内网网卡ens33:192.168.174.16

- 外网网卡ens37:12.0.0.1

##两台负载均衡器,将网关地址修改为防火墙服务器的内网IP地址vim /etc/sysconfig/network-scripts/ifcfg-ens33GATEWAY="192.168.174.16"systemctl restart network #重启网络systemctl restart keepalived #如果VIP丢失,需要重启一下keepalived##配置防火墙服务器

1.关闭防火墙和selinux

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

2.开启路由转发功能

vim /etc/sysctl.confnet.ipv4.ip_forward = 1 //在文件中增加这一行,开启路由转发功能sysctl -p //加载修改后的配置

3.配置iptables策略

#先将原有的规则清除iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X#设置SNAT服务,解析源地址。修改nat表中的POSTROUTING链。#将源地址192.168.174.100转换为为12.0.0.1iptables -t nat -A POSTROUTING -s 192.168.174.100/24 -j SNAT --to 12.0.0.1#-t nat //指定nat表#-A POSTROUTING //在POSTROUTING链中添加规则 #-s 192.168.174.100/24 //数据包的源地址#-o ens36 //出站网卡#-j SNAT --to 12.0.0.1 //使用SNAT服务,将源地址转换成公网IP地址。#设置DNAT服务,解析目的地址。修改nat表中的PRETROUTING链。#将目的地址12.0.0.1:3344 转换成 192.168.174.100:3344iptables -t nat -A PREROUTING -i ens37 -d 12.0.0.1 -p tcp --dport 3344 -j DNAT --to 192.168.174.100:3344#-A PREROUTING //在PREROUTING链中添加规则 #-i ens36 //入站网卡#-d 12.0.0.254 //数据包的目的地址#-p tcp --dport 3344 //数据包的目的端口#-j DNAT --to 192.168.174.100:3344 //使用DNAT功能,将目的地址和端口转换成192.168.174.100:3344iptables -t nat -nL #查看策略

Chain PREROUTING (policy ACCEPT)

target prot opt source destination

DNAT tcp -- 0.0.0.0/0 12.0.0.1 tcp dpt:3344 to:192.168.174.100:3344Chain INPUT (policy ACCEPT)

target prot opt source destination Chain OUTPUT (policy ACCEPT)

target prot opt source destination Chain POSTROUTING (policy ACCEPT)

target prot opt source destination

SNAT all -- 192.168.174.0/24 0.0.0.0/0 to:12.0.0.1

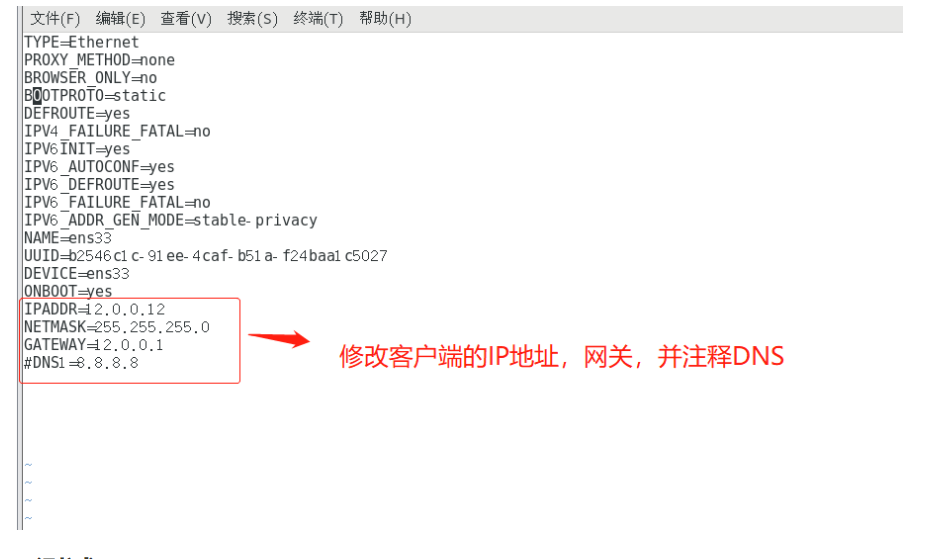

4.新增一台客户机(192.168.174.12)

systemctl stop firewalld.service #关闭防火墙安全机制

setenforce 0

vim /etc/sysconfig/network-scripts/ifcfg-ens33

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

BOOTPROTO=static

DEFROUTE=yes

IPV4_FAILURE_FATAL=no

IPV6INIT=yes

IPV6_AUTOCONF=yes

IPV6_DEFROUTE=yes

IPV6_FAILURE_FATAL=no

IPV6_ADDR_GEN_MODE=stable-privacy

NAME=ens33

UUID=b2546c1c-91ee-4caf-b51a-f24baa1c5027

DEVICE=ens33

ONBOOT=yes

IPADDR=12.0.0.12

NETMASK=255.255.255.0

GATEWAY=12.0.0.1

#DNS1=8.8.8.8

systemctl restart network #重启网卡

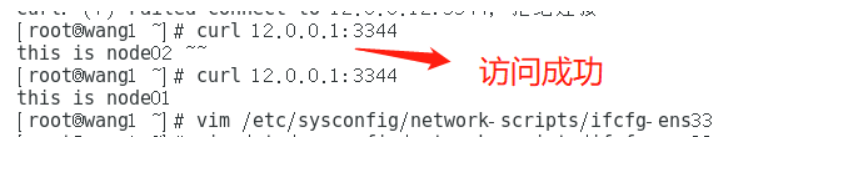

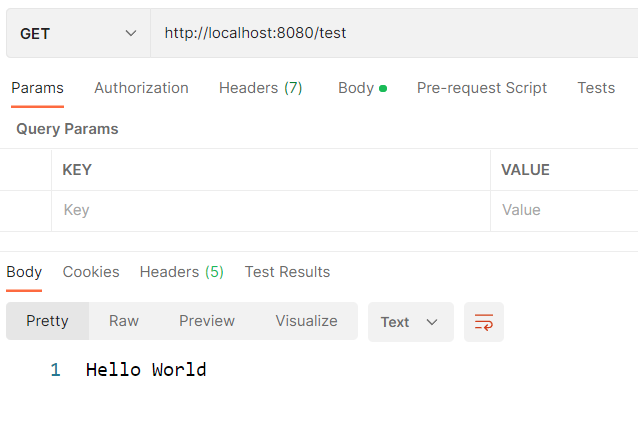

5.测试

curl 12.0.0.1:3344

相关文章:

K8S内容分发网络之集群,nginx,负载均衡,防火墙

K8S内容分发网络之集群,nginx,负载均衡,防火墙 一、Kubernetes 区域可采用 Kubeadm 方式进行安装。1.所有节点,关闭防火墙规则,关闭selinux,关闭swap交换2.修改主机名3.所有节点修改hosts文件4.调整内核参数…...

不愧是疑问解决神器!你强任你强

不愧是疑问解决神器!你强任你强👍👍👍 在过去,我习惯用这种方式来阅读书籍或文章:先快速浏览一遍,然后再进行复读,并最终总结所学的知识点。然而,长期以来,我…...

盛最多水的容器 接雨水【基础算法精讲 02】

盛雨水最多的容器 链接 : 11 盛最多水的容器 思路 : 双指针 : 1.对于两条确定的边界,l和r,取中间的线m与r组成容器,如果m的高度>l的高度,那么整个容器的长度会减小,如果低于l的高度,那么不仅高度可…...

之—— 主题的functions.php)

WordPress主题开发( 十二)之—— 主题的functions.php

WordPress主题开发( 十)之—— 主题的functions.php 介绍使用functions.php vs. 插件创建和使用functions.php在functions.php中的常见用途1. 使用WordPress钩子2. 启用WordPress功能3. 定义可重用的函数4. 添加自动Feed链接5. 自定义导航菜单6. 文本域加…...

代码的工厂模式

概念: 代码的工厂模式是一种设计模式,用于创建对象实例而无需直接调用构造函数。它提供了一种更加灵活和可维护的方式来创建对象,尤其是在需要根据不同情况创建不同类型的对象时非常有用。工厂模式隐藏了对象的创建细节,使代码更…...

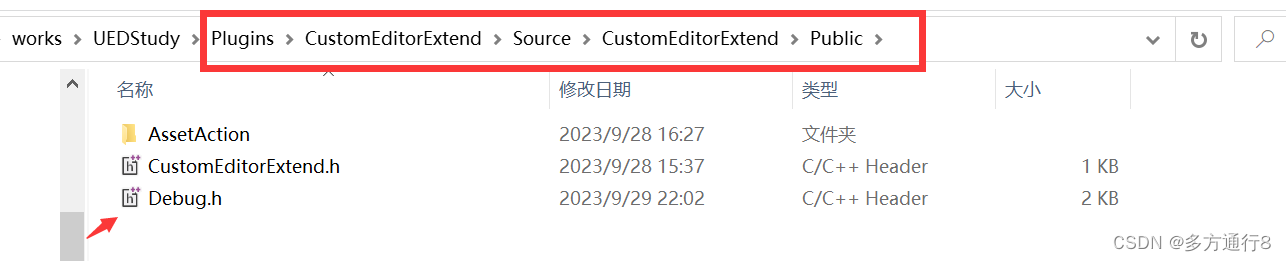

UE5.1编辑器拓展【一、脚本化资产行为,通知,弹窗,高效复制多个同样的资产】

目录 插件制作 添加新的类:AssetActionUtility 添加新的模块:EditorScriptingUtilities 路径了解 添加debug的头文件 代码【debug.h】内涵注释: 写函数 .h文件 .cpp文件 插件制作 首先第一步是做一个插件:…...

mac openssl 版本到底怎么回事 已解决

在mac 安装node多版本的时候,有可能把原有的 openssl1.1 版本 直接要再一次升级了,无奈的 php环境 编译器是 openssl 1.1 还是 3.0 ,今天来个底朝天的找问题。 brew search openssl 有安装 三个版本。 但是错误提示 是第二个版本。 brew …...

AWS】在EC2上创建root用户,并使用root用户登录

最近有项目需要使用AWS的EC2服务器; 在创建服务器实例之后发现,没有root用户,仔细阅读AWS EC2文档,发现默认是ec2-user用户; 那我们需要创建一个root用户 1.创建 root 用户 注意:必须要要在ec2-user用户下…...

9月24日回顾

1.微程序控制器的组成:指令译码器、微地址寄存器(输出和暂存控制信息),时序电路、最核心的部件是控制存储器(只读ROM组成)—用来存储微指令 2.突发读写:比如说突发地址为8,那么只需…...

Spring注册Bean系列--方法1:@Component

原文网址:Spring注册Bean系列--方法1:Component_IT利刃出鞘的博客-CSDN博客 简介 本文介绍Spring注册Bean的方法:Component。 注册Bean的方法我写了一个系列,见:Spring注册Bean(提供Bean)系列--方法大全_IT利刃出鞘…...

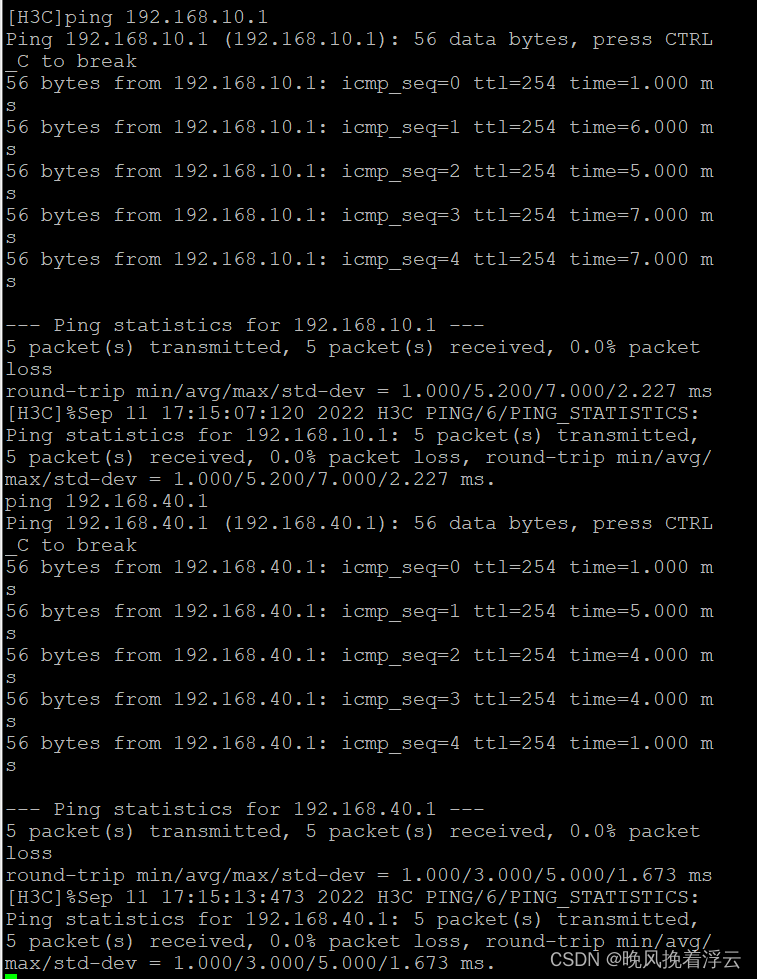

防火墙基础之H3C防火墙和三层交换机链路聚合的配置

H3C防火墙和三层交换机链路聚合的配置 原理概述: 防火墙(英语:Firewall)技术是通过有机结合各类用于安全管理与筛选的软件和硬件设备,帮助计算机网络于其内、外网之间构建一道相对隔绝的保护屏障,以保…...

管理类联考——数学——汇总篇——知识点突破——算数——记忆

文章目录 整体利用目录大纲/记忆宫殿目录大纲记忆宫殿 局部用各种方法数字编码法常见整除特点 歌决记忆法谐音记忆法理解记忆法比较记忆法转图像记忆法可视化法 整体利用目录大纲/记忆宫殿 目录大纲 记忆宫殿 局部用各种方法 学习记忆——数学篇——汇总——顺口溜记忆法谐…...

leetCode 455.分发饼干 贪心算法

455. 分发饼干 - 力扣(LeetCode) 假设你是一位很棒的家长,想要给你的孩子们一些小饼干。但是,每个孩子最多只能给一块饼干。 对每个孩子 i,都有一个胃口值 g[i],这是能让孩子们满足胃口的饼干的最小尺寸&…...

vue3简易文字验证码

大神勿喷,简易版本,demo中可以用一下。 需要几个文字自己codelen 赋值 灵活点直接父组件传过去,可以自己改造 首先创建一个生成数字的js **mathcode.js**function MathCode(num){let str "寻寻觅觅冷冷清清凄凄惨惨戚戚乍暖还寒时候…...

Java 23种设计模式分类概括以及应用介绍

话不多说进入正题~ 创建型模式:5种 单例模式(Singleton Pattern) 确保一个类只有一个实例,并提供全局访问点,它的主要目的是限制类的实例化并确保所有代码都共享相同的实例。 – 应用:Runtime类、数据库连…...

运筹优化算法常用求解器汇总

运筹学从形成到发展,在此过程中积累的大量理论和方法在国防、能源、制造、交通、金融、通信等各个领域发挥着越来越重要的作用。我们在生产生活中遇到的很多实际问题,都可以通过运筹学所涉及的优化方法对其进行数学建模,表示为数学问题&#…...

字符串函数(一)

✨博客主页:小钱编程成长记 🎈博客专栏:进阶C语言 字符串函数(一) 0.前言1.求字符串长度的函数1.1 strlen(字符串长度) 2.长度不受限制的字符串函数2.1 strcpy(字符串拷贝࿰…...

Ubuntu 安装 Docker 的详细步骤

文章目录 简介1.更新2.安装必要的软件包2.1 基于阿里源 3.验证 Docker 安装是否成功4.安装后的一些常规设置及常用的命令4.1 启动 Docker4.2 Docker 在系统启动时自动运行4.3 运行一个 Hello World 镜像4.4 查看docker运行状态 欢迎来到这篇关于在 Ubuntu 上安装 Docker 的教程…...

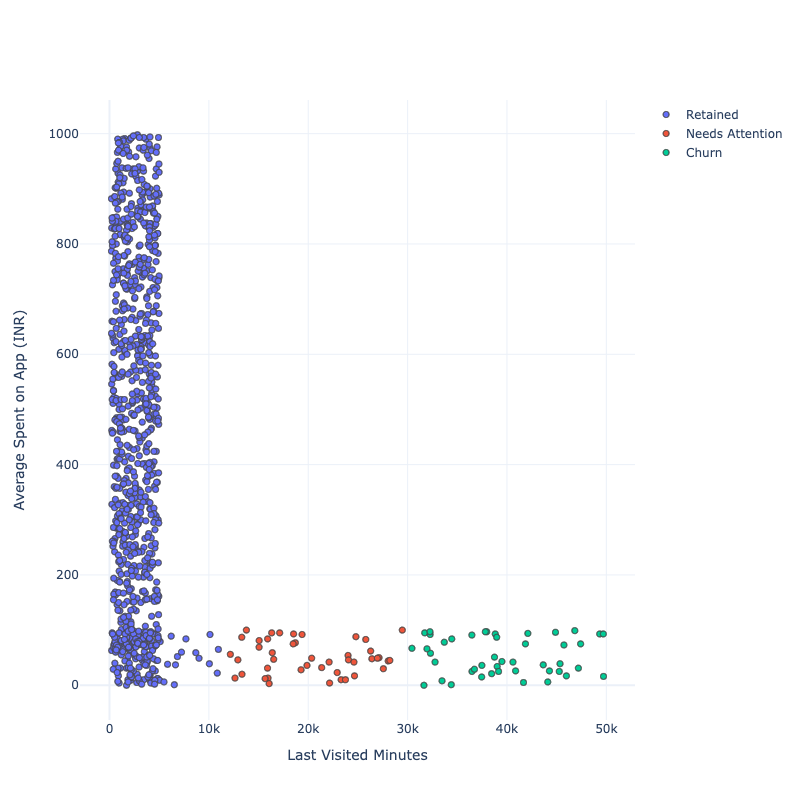

使用Python进行App用户细分

App用户细分是根据用户与App的互动方式对用户进行分组的任务。它有助于找到保留用户,找到营销活动的用户群,并解决许多其他需要基于相似特征搜索用户的业务问题。这篇文章中,将带你完成使用Python进行机器学习的App用户细分任务。 App用户细…...

)

博弈论——伯特兰德寡头模型(Bertrand Model)

伯特兰德寡头模型(Bertrand Model) 0 引言 在前面几篇文章中,我们介绍了古诺模型(Cournot duopoly model)和斯塔克尔伯格模型(Stackelberg model) 博弈论——连续产量古诺模型(Cournot duopoly model) 博弈论——斯塔克尔伯格模型(Stackelberg model) 这两个模型…...

)

从STM32迁移到普冉PY32F003:UART代码移植保姆级教程(附HAL库对比)

从STM32到普冉PY32F003的UART代码迁移实战指南 1. 国产MCU替代浪潮下的技术选择 近年来,半导体行业的供应链波动促使更多工程师将目光投向国产MCU解决方案。普冉PY32F003系列作为Cortex-M0内核的代表产品,以48MHz主频、64KB Flash和8KB RAM的配置&#x…...

2026年,本地精准营销高性价比服务商来袭,你还不了解一下?

在本地商业竞争日益激烈的2026年,实体店面临着诸多挑战,引流难、成本高、复购率低等问题困扰着众多商家。而中粤(广州)信息科技有限公司作为本地精准营销的高性价比服务商,正以其独特的优势和卓越的服务,为…...

重构)

嘈杂工业场景下的自适应VAD与双码本声纹识别鉴权系统:基于端侧轻量化神经网络与向量量化(VQ)重构

在大型化工车间、能源集控中心以及金融极密隔离库房中,离线声纹识别是物理访问控制和身份安全核验的重要生物特征屏障。然而,在环境本底噪声高达80dB以上的恶劣工业场景下,常规的语音活动检测(VAD)会频繁误触ÿ…...

基于ESP32与MQTT的家庭环境监测系统:从传感器选型到数据可视化实战

1. 项目概述与核心价值最近几年,我身边越来越多的朋友开始关注家里的空气质量、温湿度这些看不见摸不着,但又实实在在影响生活舒适度和健康的环境指标。从新装修的房子担心甲醛,到有老人小孩的家庭在意PM2.5和二氧化碳浓度,再到南…...

网络配置工具类详解

CNet 网络配置工具类详解平台:仅支持 Linux,大量使用 ioctl 系统调用一、概述 CNet 是一个 纯静态方法的网络配置工具类,封装了 Linux 下常用的网络操作:功能类别涵盖内容IP 地址读取/设置本机 IP、子网掩码网关读取/添加/删除/设…...

3大实战秘籍:揭秘raylib如何让游戏开发像搭积木一样简单

3大实战秘籍:揭秘raylib如何让游戏开发像搭积木一样简单 【免费下载链接】raylib A simple and easy-to-use library to enjoy videogames programming 项目地址: https://gitcode.com/GitHub_Trending/ra/raylib 你是否曾经被复杂的游戏引擎配置搞得焦头烂额…...

Taotoken如何帮助教育科技产品实现个性化学习辅导

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 Taotoken如何帮助教育科技产品实现个性化学习辅导 1. 场景与挑战 教育科技公司在开发个性化学习助手时,常常面临一个核…...

HoRain云--CLAUDE.md 使用指南

🎬 HoRain云小助手:个人主页 🔥 个人专栏: 《Linux 系列教程》《c语言教程》 ⛺️生活的理想,就是为了理想的生活! ⛳️ 推荐 前些天发现了一个超棒的服务器购买网站,性价比超高,大内存超划算!…...

如何优化 MySQL 千万级数据分页查询的性能?

它的本质是:**传统 LIMIT offset, size 在大数据量下性能急剧下降,是因为 MySQL 必须 扫描并丢弃 前 offset 行数据。当 offset 很大时(如 LIMIT 1000000, 10),MySQL 需要读取 1,000,010 行记录,执行 1,000…...

USB数据隔离器DIY:物理切断数据线,防范充电攻击

1. 移动设备充电安全:一个被忽视的“物理后门”你可能每天都在做这件事:手机或平板电脑电量告急,随手拿起一根数据线,插在办公室的公共电脑、机场的充电站,甚至是朋友提供的充电宝上。这看起来再平常不过了,…...