【自注意力与Transformer架构在自然语言处理中的演变与应用】

背景介绍

-

在自然语言处理(NLP)领域,序列到序列(seq2seq)模型和Transformer架构的出现,极大地推动了机器翻译、文本生成和其他语言任务的进展。传统的seq2seq模型通常依赖于循环神经网络(RNN)来处理输入序列,并通过编码器-解码器结构进行信息传递。然而,这种方法在处理长序列时存在一定的局限性,主要体现在信息的丢失和长距离依赖的建模能力不足。

-

为了解决这些问题,Transformer模型于2017年被提出。它引入了自注意力机制(Self-Attention),使得模型能够在处理每个单词时,考虑到句子中所有其他单词的上下文信息。这种机制不仅提高了模型对长距离依赖的捕捉能力,还显著提升了并行计算的效率,从而加快了训练速度。

-

自注意力机制的核心在于通过计算查询(Query)、键(Key)和值(Value)向量之间的相关性,来动态调整每个单词在上下文中的重要性。这种方法使得模型能够灵活地关注句子中不同位置的词,从而更好地理解和生成语言。

-

此外,Transformer模型的多头注意力机制进一步增强了模型的表达能力。通过将注意力机制分成多个头,模型能够在不同的子空间中学习到多种不同的表示,从而捕捉到更丰富的语义信息。

-

近年来,基于Transformer的模型,如BERT、GPT和CLIP等,已经在多个NLP任务中取得了显著的成果。这些模型不仅在文本处理上表现出色,还扩展到了图像处理和多模态学习等领域,展示了Transformer架构的广泛适用性和强大能力。

-

综上所述,seq2seq模型和Transformer架构的演变,标志着自然语言处理技术的重大进步,为实现更智能的语言理解和生成奠定了基础。

seq2seq原理

- 参考:https://blog.csdn.net/zhuge2017302307/article/details/119979892

- 对比作用

Transformer原理

Self-Attention 过程

如上一节所讲,Self Attention 在处理某个词之前,通过对句子片段中每个词的相关性进行打分,并将这些词的表示向量加权求和。

Self-Attention 沿着句子中每个 token 的路径进行处理,主要组成部分包括 3 个向量:

- Query:Query 向量是当前单词的表示,用于对其他所有单词(使用这些单词的 key 向量)进行评分。我们只关注当前正在处理的 token 的 query 向量。

- Key:Key 向量就像句子中所有单词的标签。它们就是我们在搜索单词时所要匹配的。

- Value:Value 向量是实际的单词表示,一旦我们对每个词的相关性进行了评分,我们需要对这些向量进行加权求和,从而表示当前的词。

- 以下是计算it时的评分

- 这些加权的 Value 向量会得到一个向量,它将 50% 的注意力放到单词robot 上,将 30% 的注意力放到单词 a,将 19% 的注意力放到单词 it。最终一个具有高分数的 Value 向量会占据结果向量的很大一部分

- 上面都是展示大量的单个向量,是想把重点放在词汇层面上。而实际的代码实现,是通过巨大的矩阵相乘来完成的

MultiheadAttention

- 多头注意力模型中,head数是一个超参数,语料大,电脑性能好就可以设置的高一点

torch实现

torch.nn.MultiheadAttention(embed_dim, num_heads, dropout=0.0, bias=True, add_bias_kv=False, add_zero_attn=False, kdim=None, vdim=None)

1.embed_dim:最终输出的 K、Q、V 矩阵的维度,这个维度需要和词向量的维度一样

2.num_heads:设置多头注意力的数量。要求embed_dim%num_heads==0,即要能被embed_dim整除。这是为了把词的隐向量长度平分到每一组,这样多组注意力也能够放到一个矩阵里,从而并行计算多头注意力。

3.dropout:这个 dropout 加在 attention score 后面

例如,我们前面说到,8 组注意力可以得到 8 组 Z 矩阵,然后把这些矩阵拼接起来,得到最终的输出。

如果最终输出的每个词的向量维度是 512,那么每组注意力的向量维度应该是512/8=64 如果不能够整除,那么这些向量的长度就无法平均分配。

Self-Attention 和经典的(seq2seq)模型的区别

一个注意力模型不同于经典的(seq2seq)模型,主要体现在 3 个方面:

- 编码器把所有时间步的 hidden state(隐藏层状态)传递给解码器,而非只传递最后一个 hidden state。即编码器会把更多的数据传递给解码器。

- 对于 Self Attention 机制,会把其他单词的理解融入处理当前的单词。使得模型不仅能够关注这个位置的词,而且能够关注句子中其他位置的词,作为辅助线索,进而可以更好地编码当前位置的词。

- 解码器输出之前,计算了注意力。让模型找到此时刻最该注意的词。

对于第二点举例如下:

机器人第二定律

机器人必须服从人给予它的命令,当该命令与第一定律冲突时例外。

句子中高亮的 3 个部分,用于指代其他的词。如果不结合它们所指的上下文,就无法理解或者处理这些词。当一个模型要处理好这个句子,它必须能够知道:

- 它 指的是机器人

- 该命令 指的是这个定律的前面部分,也就是人给予它的命令

- 第一定律 指的是机器人第一定律

Self Attention 能做到这一点。它在处理某个词之前,将模型中这个词的相关词和关联词的理解融合起来(并输入到一个神经网络)。它通过对句子片段中每个词的相关性打分(attention score),并将这些词向量加权求和。

下图顶部模块中的 Self Attention 层在处理单词 it 的时候关注到 a robot。它最终传递给神经网络的向量,是这 3 个单词的词向量加权求和的结果。

QKV计算过程

为什么求内积之后除以 d \sqrt{d} d

在计算相似度 s = ⟨ q , k ⟩ s = \langle q, k \rangle s=⟨q,k⟩ 时, s s s 要除以 d k e y \sqrt{d_{key}} dkey(Key 向量的长度)。原因是词向量 embedding 维度过高时, s s s 过大,softmax 函数会进入饱和区。例如:

对于两个 d d d 维向量 q , k q, k q,k,假设它们都采样自“均值为 0、方差为 1”的分布。Attention 是内积后 softmax,主要设计的运算是 e q ⋅ k e^{q \cdot k} eq⋅k,我们可以大致认为内积之后、softmax 之前的数值在 − 3 d -3\sqrt{d} −3d 到 3 d 3\sqrt{d} 3d 这个范围内,由于 d d d 通常都至少是 64,所以 e 3 d e^{3\sqrt{d}} e3d 比较大而 e − 3 d e^{-3\sqrt{d}} e−3d 比较小,softmax 函数进入饱和区。这样会有两个影响:

- 带来严重的梯度消失问题,导致训练效果差。

- softmax 之后,归一化后计算出来的结果 a a a 要么趋近于 1 要么趋近于 0,Attention 的分布非常接近一个 one hot 分布了,加权求和退化成胜者全拿,则解码时只关注注意力最高的(attention 模型还是希望别的词也有权重)。

相应地,解决方法有两个(参考苏剑林《浅谈 Transformer 的初始化、参数化与标准化》):

-

像 NTK 参数化那样,在内积之后除以 d \sqrt{d} d,使 q ⋅ k q \cdot k q⋅k 的方差变为 1,对应 e 3 e^{3} e3, e − 3 e^{-3} e−3 都不至于过大过小,这也是常规的 Transformer 如 BERT 里边的 Self Attention 的做法。对公式 s = ⟨ q , k ⟩ s = \langle q, k \rangle s=⟨q,k⟩ 进行优化:( q q q 和 k k k 求内积,所以其实 key 和 q q q 的向量长度一样。)

s = ⟨ q , k ⟩ d k e y s = \frac{\langle q, k \rangle}{\sqrt{d_{key}}} s=dkey⟨q,k⟩

-

另外就是不除以 d \sqrt{d} d,但是初始化 q , k q, k q,k 的全连接层的时候,其初始化方差要多除以一个 d d d,这同样能使得 q ⋅ k q \cdot k q⋅k 的初始方差变为 1,T5 采用了这样的做法。

参考

- https://blog.csdn.net/qq_56591814/article/details/119759105

- https://blog.csdn.net/weixin_38252409/article/details/133828294

相关文章:

【自注意力与Transformer架构在自然语言处理中的演变与应用】

背景介绍 在自然语言处理(NLP)领域,序列到序列(seq2seq)模型和Transformer架构的出现,极大地推动了机器翻译、文本生成和其他语言任务的进展。传统的seq2seq模型通常依赖于循环神经网络(RNN&…...

LabVIEW交直流接触器动态检测系统

LabVIEW软件与霍尔传感器技术结合的交直流接触器动态检测系统通过实时数据采集和处理技术,有效地测量并分析交直流接触器在吸合及吸持阶段的电流和电压变化,以及相应的功率消耗,从而优化电力和配电系统的性能和可靠性。 项目背景 交直流接触…...

Unity3D中基于四叉树的范围检测算法详解

在游戏开发中,碰撞检测和范围检测是常见的需求,尤其是在处理大量物体时,传统的暴力检测法(即每个物体与其他所有物体进行碰撞检测)会消耗大量的计算资源,导致性能下降。为了优化这一过程,四叉树…...

k8s网络通信

k8s通信整体架构 k8s通过CNI接口接入其他插件来实现网络通讯。目前比较流行的插件有flannel,calico等 CNI插件存放位置:# cat /etc/cni/net.d/10-flannel.conflist 插件使用的解决方案如下 虚拟网桥,虚拟网卡,多个容器共用一个虚…...

07 欢乐的跳

题目: 代码: #include<bits/stdc.h> using namespace std; #define M 1000005int main() {int n;cin>>n;int a[M]{0};for(int i0;i<n;i){cin>>a[i];}int c[M]{0};for(int i1;i<n;i){c[i]abs(a[i]a[i1]);}sort(c1,cn); // 注意f…...

【韩顺平Java笔记】第8章:面向对象编程(中级部分)【262-271】

文章目录 262. 回顾上一章内容263. IDEA介绍263.1 IDEA 介绍263.2 Eclipse 介绍 264. IDEA下载265. IDEA使用1257. IDEA使用2268. IDEA使用3268. 269. 270. IDEA快捷键1,2,3271. IDEA模板 262. 回顾上一章内容 看视频 263. IDEA介绍 263.1 IDEA 介绍 IDEA 全称 IntelliJ ID…...

:输入分区的垃圾回收及保护处理(KEEP命令)介绍)

GNU链接器(LD):输入分区的垃圾回收及保护处理(KEEP命令)介绍

0 参考资料 GNU-LD-v2.30-中文手册.pdf GNU linker.pdf1 前言 一个完整的编译工具链应该包含以下4个部分: (1)编译器 (2)汇编器 (3)链接器 (4)lib库 在GNU工具链中&…...

论文翻译 | Fairness-guided Few-shot Prompting for LargeLanguage Models

摘要 大型语言模型已经显示出令人惊讶的执行上下文学习的能力,也就是说,这些模型可以通过对由几个输入输出示例构建的提示进行条件反射,直接应用于解决大量下游任务。然而,先前的研究表明,由于训练示例、示例顺序和提示…...

【分布式微服务云原生】战胜Redis脑裂:深入解析与解决方案

战胜Redis脑裂:深入解析与解决方案 摘要: Redis脑裂问题(Split Brain Syndrome)是分布式系统中的一个常见且复杂的问题,通常发生在网络分区或主节点出现问题时。本文将详细探讨脑裂的主要原因、导致的问题以及有效的解…...

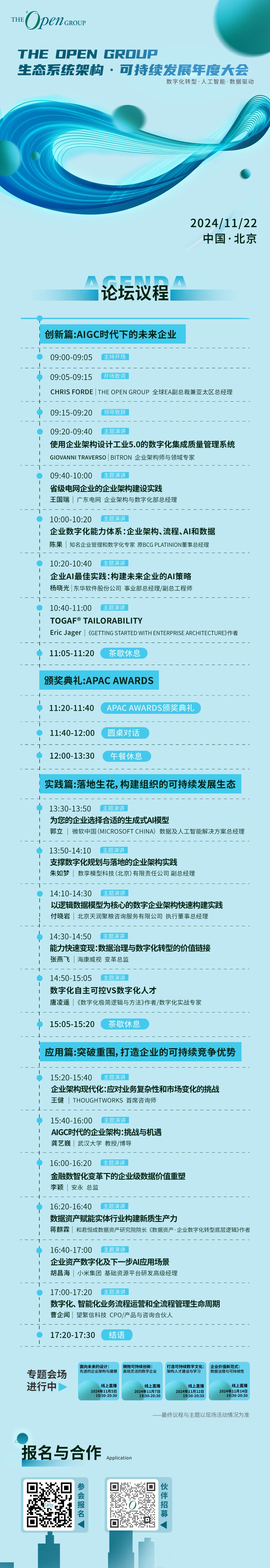

数据治理与可持续发展:开启企业价值新模式——The Open Group 2024生态系统架构·可持续发展年度大会邀您共襄盛举

在当今数字化转型的浪潮中,企业正面临着前所未有的机遇和挑战。当数据治理遇上可持续发展,企业价值的新模式应运而生。那么,如何在数字化时代实现数据治理与可持续发展的融合,推动企业价值的飞跃? The Open Group 202…...

数据库的分类及主流数据库

一、数据库的分类 (一)关系型数据库(RDBMS) 定义与原理 关系型数据库是基于关系模型建立的数据库。它以表格(关系)的形式组织数据,每个表格包含行(记录)和列࿰…...

Qt C++设计模式->备忘录模式

备忘录模式(Memento Pattern)是一种行为型设计模式,用于在不破坏封装性的前提下,捕获并保存对象的内部状态,以便在将来的某个时刻可以恢复到之前的状态。备忘录模式的核心是状态的保存和恢复,常用于实现撤销…...

Vue使用@别名替换后端ip地址

1. 安装 types/node types/node 包允许您在TypeScript项目中使用Node.js的核心模块和API,并提供了对它们的类型检查和智能提示的支持。 npm install types/node --save-dev 比如安装之后,就可以导入nodejs的 path模块,在下面代码 import path…...

强大的PDF到Word转换工具

Solid Converter:强大的PDF到Word转换工具推荐 在日常工作和学习中,PDF是最常用的文件格式之一。然而,编辑PDF文档并不总是那么方便,尤其是当你需要将PDF文件转换为Word文档时。Solid Converter 是一款强大的工具,专为…...

js进阶——深入解析JavaScript中的URLSearchParams

深入解析 JavaScript 中的 URLSearchParams 在现代Web开发中,我们经常需要处理URL中的查询参数,尤其是在构建动态Web应用时。这些查询参数(query parameters)通常以 ?keyvalue&key2value2 的形式存在。JavaScript 提供了一个…...

如何利用wsl-Ubuntu里conda用来给Windows的PyCharm开发

前提:咱们在wsl-Ubuntu上,有conda的虚拟环境 咱们直接打开PyCharm,打开Settings 更换Python Interpreter即可 当然一开始可能没有下面的选项,需要我们点击右边的Add Interpreter 这里选择wsl 点击next 将这两步进行修改 可以看出来࿰…...

操作系统的了解及安装

一、linux系统认识 linux是指操作系统的内核,ubuntu是指基于这种内核的操作系统,Ubuntu属于Linux的一个发行版本,有简易的用户界面,完善的包管理系统,Ubuntu还对大多数硬件有着良好的兼容性,包含最新的图形…...

【C++篇】虚境探微:多态的流动诗篇,解锁动态的艺术密码

文章目录 C 多态详解(进阶篇)前言第一章:多态的原理1.1 虚函数表的概念1.1.1 虚函数表的生成过程 1.2 虚表的存储位置 第二章:动态绑定与静态绑定2.1 静态绑定2.1.1 静态绑定的实现机制:2.1.2 示例代码: 2.…...

)

uniapp的相关知识(1)

1、hover-class:当有鼠标按下时,会切换对应的样式;也可以设置对应的变色时间。 2、selectable:设置text组件的文本是否可以进行复制。 3、with:当设置为80%时,表示宽占整个屏幕的80%。 4、border&#x…...

uniapp生成随机数

推荐学习文档 golang应用级os框架,欢迎stargolang应用级os框架使用案例,欢迎star案例:基于golang开发的一款超有个性的旅游计划app经历golang实战大纲golang优秀开发常用开源库汇总想学习更多golang知识,这里有免费的golang学习笔…...

告别手改脚本!用CANoe Panel面板做个变量控制台,测试效率翻倍

告别手改脚本!用CANoe Panel面板打造智能变量控制台 在车载网络测试领域,效率提升往往隐藏在那些被忽视的日常操作细节中。当测试工程师频繁打开CAPL脚本修改超时阈值、调整诊断ID或切换测试模式时,不仅打断了工作流,更在团队协作…...

Simple Runtime Window Editor:突破游戏窗口限制的终极解决方案

Simple Runtime Window Editor:突破游戏窗口限制的终极解决方案 【免费下载链接】SRWE Simple Runtime Window Editor 项目地址: https://gitcode.com/gh_mirrors/sr/SRWE 你是否曾为游戏内置分辨率选项太少而烦恼?是否想在窗口模式下获得全屏游戏…...

Performance-Fish:深度解析《环世界》400%性能优化核心技术

Performance-Fish:深度解析《环世界》400%性能优化核心技术 【免费下载链接】Performance-Fish Performance Mod for RimWorld 项目地址: https://gitcode.com/gh_mirrors/pe/Performance-Fish Performance-Fish 是专为《环世界》(RimWorld&#…...

如何用nmrpflash拯救你的Netgear路由器:从“变砖“到重生的完整指南

如何用nmrpflash拯救你的Netgear路由器:从"变砖"到重生的完整指南 【免费下载链接】nmrpflash Netgear Unbrick Utility 项目地址: https://gitcode.com/gh_mirrors/nmr/nmrpflash 当你的Netgear路由器固件升级失败、意外断电或系统崩溃后无法启动…...

ADXL335模拟传感器读数不稳?手把手教你用Arduino进行软件滤波与校准

ADXL335模拟传感器读数不稳?手把手教你用Arduino进行软件滤波与校准 当你把ADXL335加速度计接入Arduino,兴奋地跑起第一个测试程序时,那些跳动的数字可能很快会浇灭你的热情。原始读数像得了疟疾般颤抖,静止时本该稳定的1g重力加速…...

终极FGO自动化助手:告别枯燥刷本,每天节省3小时游戏时间

终极FGO自动化助手:告别枯燥刷本,每天节省3小时游戏时间 【免费下载链接】FGA Auto-battle app for F/GO Android 项目地址: https://gitcode.com/gh_mirrors/fg/FGA Fate/Grand Automata(简称FGA)是一款专为Fate/Grand Or…...

怎样免费让老Mac重获新生:OpenCore Legacy Patcher专业教程

怎样免费让老Mac重获新生:OpenCore Legacy Patcher专业教程 【免费下载链接】OpenCore-Legacy-Patcher Experience macOS just like before 项目地址: https://gitcode.com/GitHub_Trending/op/OpenCore-Legacy-Patcher 想让你的旧Mac重新焕发活力吗…...

VectorDBBench:向量数据库性能基准测试工具详解与实战

1. 项目概述:向量数据库性能测试的“瑞士军刀”如果你正在评估或使用向量数据库,那么你一定遇到过这个灵魂拷问:“这么多产品,到底哪个最适合我的场景?”是选名声在外的老牌劲旅,还是选后起之秀的专精选手&…...

Blitz.js全栈开发框架:零API理念与Next.js深度集成实战

1. 项目概述:一个颠覆性的全栈开发框架如果你和我一样,在过去的几年里,一直在React生态圈里打转,从Create React App到Next.js,再到尝试自己搭建一套包含身份验证、数据层、API路由的完整应用,那你一定对那…...

基于MCP协议构建AI金融数据可视化服务器:从原理到实战部署

1. 项目概述:一个为AI智能体提供实时金融数据可视化的MCP服务器最近在折腾AI智能体(Agent)的生态,发现一个挺有意思的痛点:当你想让AI帮你分析股票、基金或者加密货币时,它往往只能给你干巴巴的数字和文字描…...