使用一个大语言模型对另一个大语言模型进行“调教”

使用一个大语言模型对另一个大语言模型进行“调教”(通常称为微调或适配),是一种常见的技术手段,用于让目标模型更好地适应特定的任务、领域或风格。以下是基于搜索结果整理的详细步骤和方法:

1.准备工作

安装必要的库

• Transformers:用于加载和训练模型。

• Datasets:用于处理数据集。

• PEFT:用于微调,特别是LoRA(Low-Rank Adaptation)等技术。

• Accelerate:用于优化训练过程。

• ModelScope:用于下载和加载模型(国内用户)。

• SwanLab:用于可视化训练过程。

pip install transformers datasets peft accelerate modelscope swanlab

2.数据准备

下载数据集

使用datasets库下载或加载数据集。如果数据集较大或需要本地存储,可以手动下载并加载。

from datasets import load_dataset# 如果数据集在 Hugging Face 上

dataset = load_dataset("your_dataset_name", split="train")# 如果数据集在本地

dataset = load_dataset("json", data_files="path/to/your/dataset.json", split="train")

数据预处理

将数据集转换为适合模型输入的格式。通常需要对文本进行分词,并将标签转换为模型可理解的格式。

from transformers import AutoTokenizertokenizer = AutoTokenizer.from_pretrained("base_model_name")

MAX_LENGTH = 512 # 根据显存调整def preprocess_function(examples):inputs = tokenizer(examples["text"], truncation=True, max_length=MAX_LENGTH)labels = tokenizer(examples["label"], truncation=True, max_length=MAX_LENGTH)return {"input_ids": inputs["input_ids"],"attention_mask": inputs["attention_mask"],"labels": labels["input_ids"]}tokenized_dataset = dataset.map(preprocess_function, batched=True)

3.模型准备

下载并加载基础模型

使用transformers库加载基础模型。如果使用国内模型,可以通过ModelScope下载。

from transformers import AutoModelForCausalLM, AutoTokenizerbase_model = "base_model_name" # 替换为实际模型名称

tokenizer = AutoTokenizer.from_pretrained(base_model)

model = AutoModelForCausalLM.from_pretrained(base_model)

设置量化配置

如果需要在低显存设备上运行,可以对模型进行量化。

from transformers import BitsAndBytesConfigquant_config = BitsAndBytesConfig(load_in_4bit=True,bnb_4bit_quant_type="nf4",bnb_4bit_compute_dtype=torch.float16,bnb_4bit_use_double_quant=False,

)

model = AutoModelForCausalLM.from_pretrained(base_model, quantization_config=quant_config)

应用LoRA配置

LoRA 是一种高效的微调方法,适用于大模型。

from peft import LoraConfig, TaskType, get_peft_modellora_config = LoraConfig(task_type=TaskType.CAUSAL_LM,target_modules=["q_proj", "k_proj", "v_proj", "o_proj", "gate_proj", "up_proj", "down_proj"],inference_mode=False,r=8, # LoRA 的秩lora_alpha=32,lora_dropout=0.1

)

model = get_peft_model(model, lora_config)

4.训练模型

设置训练参数

使用transformers的TrainingArguments设置训练参数。

from transformers import TrainingArgumentstraining_args = TrainingArguments(output_dir="./results",num_train_epochs=3,per_device_train_batch_size=4,gradient_accumulation_steps=4,learning_rate=2e-4,save_steps=500,logging_steps=500,evaluation_strategy="steps",eval_steps=500,save_total_limit=2,load_best_model_at_end=True,metric_for_best_model="accuracy",greater_is_better=True,save_on_each_node=True,bf16=True, # 如果使用 Ampere 架构以下的显卡,可以使用 fp16

)

创建训练器

使用transformers的Trainer或SFTTrainer进行训练。

from transformers import Trainertrainer = Trainer(model=model,args=training_args,train_dataset=tokenized_dataset,tokenizer=tokenizer,

)

trainer.train()

5.保存和加载模型

保存模型

训练完成后,保存模型和分词器。

model.save_pretrained("path/to/save/model")

tokenizer.save_pretrained("path/to/save/tokenizer")

加载模型

加载保存的模型进行推理。

from transformers import AutoModelForCausalLM, AutoTokenizermodel = AutoModelForCausalLM.from_pretrained("path/to/save/model")

tokenizer = AutoTokenizer.from_pretrained("path/to/save/tokenizer")# 进行推理

prompt = "Who is Leonardo Da Vinci?"

input_ids = tokenizer(prompt, return_tensors="pt").input_ids

output = model.generate(input_ids)

print(tokenizer.decode(output[0], skip_special_tokens=True))

6.使用 LangChain 进行 Prompt 工程

如果需要进一步优化模型的输出,可以使用 LangChain 框架进行 Prompt 工程。通过设计合适的提示词模板和输入输出接口,可以显著提升模型的性能。

from langchain.prompts import PromptTemplate

from langchain.llms import LLM# 创建提示词模板

template = """你是一个专业的{domain}专家,回答以下问题:

{question}

"""

prompt = PromptTemplate(input_variables=["domain", "question"], template=template)# 使用模型进行推理

llm = LLM(model=model, tokenizer=tokenizer)

response = llm(prompt.format(domain="历史", question="谁是达芬奇?"))

print(response)

7.可视化训练过程

使用 SwanLab 记录训练过程并可视化。

from swanlab.integration.huggingface import SwanLabCallbacktrainer = Trainer(model=model,args=training_args,train_dataset=tokenized_dataset,tokenizer=tokenizer,callbacks=[SwanLabCallback()],

)

trainer.train()

总结

通过上述步骤,你可以使用一个大语言模型对另一个大语言模型进行微调,使其更好地适应特定的任务或领域。微调的关键在于数据准备、模型选择、量化配置、LoRA 应用以及训练参数的设置。此外,LangChain 框架可以进一步优化模型的输出,提升其在实际应用中的表现。

相关文章:

使用一个大语言模型对另一个大语言模型进行“调教”

使用一个大语言模型对另一个大语言模型进行“调教”(通常称为微调或适配),是一种常见的技术手段,用于让目标模型更好地适应特定的任务、领域或风格。以下是基于搜索结果整理的详细步骤和方法: 1.准备工作 安装必要的…...

golang使用sqlite3,开启wal模式,并发读写

因为sqlite是基于文件的,所以默认情况下,sqlite是不支持并发读写的,即写操作会阻塞其他操作,同时sqlite也很容易就产生死锁。 但是作为一个使用广泛的离线数据库,从sqlite3.7.0版本开始(SQLite Release 3.…...

如何利用maven更优雅的打包

最近在客户现场部署项目,有两套环境,无法连接互联网,两套环境之间也是完全隔离,于是问题就来了,每次都要远程到公司电脑改完代码,打包,通过网盘(如果没有会员,上传下载慢…...

音频进阶学习十二——Z变换一(Z变换、收敛域、性质与定理)

文章目录 前言一、Z变换1.Z变换的作用2.Z变换公式3.Z的状态表示1) r 1 r1 r12) 0 < r < 1 0<r<1 0<r<13) r > 1 r>1 r>1 4.关于Z的解释 二、收敛域1.收敛域的定义2.收敛域的表示方式3.ROC的分析1)当 …...

cursor指令工具

Cursor 工具使用指南与实例 工具概览 Cursor 提供了一系列强大的工具来帮助开发者提高工作效率。本指南将通过具体实例来展示这些工具的使用方法。 1. 目录文件操作 1.1 查看目录内容 (list_dir) 使用 list_dir 命令可以查看指定目录下的文件结构: 示例: list_dir log…...

MySQL 主从读写分离实现方案(一)—MariaDB MaxScale实现mysql8读写分离

一:MaxScale 是干什么的?? MaxScale是maridb开发的一个mysql数据中间件,其配置简单,能够实现读写分离,并且可以根据主从状态实现写库的自动切换,对多个从服务器能实现负载均衡。 二:MaxScale …...

阿里云 | DeepSeek人工智能大模型安装部署

ModelScope是阿里云人工智能大模型开源社区 ModelScope网络链接地址 https://www.modelscope.cn DeepSeek模型库网络链接地址 https://www.modelscope.cn/organization/deepseek-ai 如上所示,在阿里云人工智能大模型开源社区ModelScope中,使用阿里云…...

LLAMA-Factory安装教程(解决报错cannot allocate memory in static TLS block的问题)

步骤一: 下载基础镜像 # 配置docker DNS vi /etc/docker/daemon.json # daemon.json文件中 { "insecure-registries": ["https://swr.cn-east-317.qdrgznjszx.com"], "registry-mirrors": ["https://docker.mirrors.ustc.edu.c…...

STM32 CUBE Can调试

STM32 CUBE Can调试 1、CAN配置2、时钟配置3、手动添加4、回调函数5、启动函数和发送函数6、使用方法(采用消息队列来做缓存)7、数据不多在发送函数中获取空邮箱发送,否则循环等待空邮箱 1、CAN配置 2、时钟配置 3、手动添加 需要注意的是STM32CUBE配置的代码需要再…...

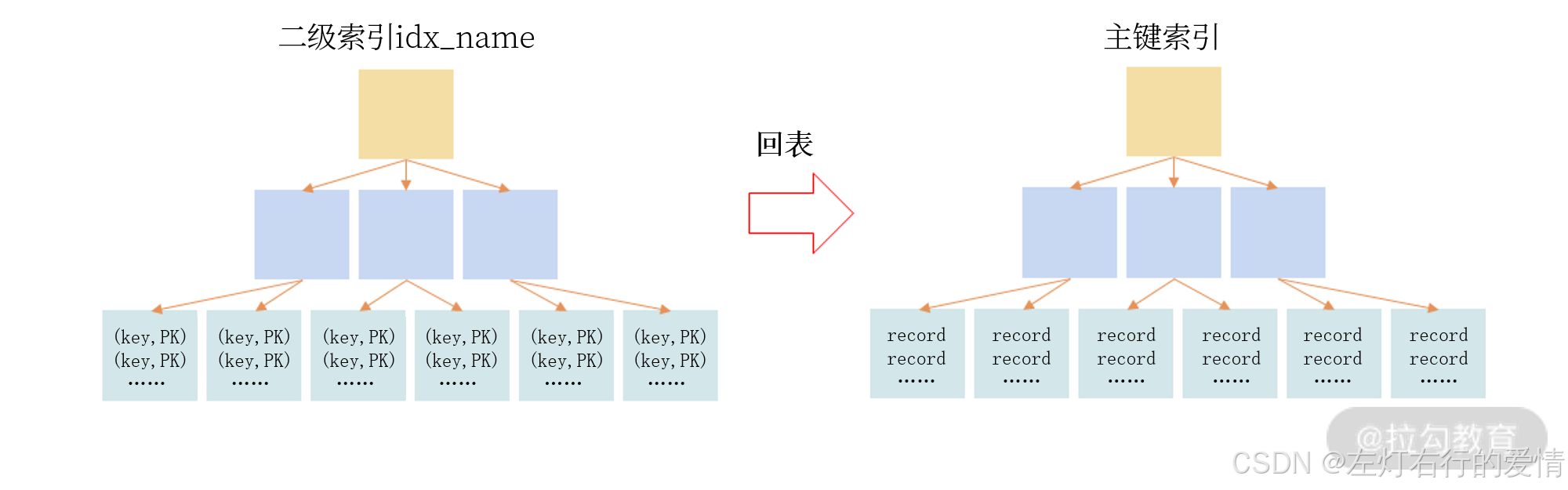

MySQL数据存储- 索引组织表

索引组织表 前言数据存储堆表索引组织表 二级索引二级索引的性能评估🔹为什么 idx_name 的性能开销最大?🔹 为什么 idx_last_modify_date 更新频繁会影响性能?分析二级索引性能表格为什么主键应该“紧凑且顺序”?二级索…...

基于STM32设计的仓库环境监测与预警系统

目录 项目开发背景设计实现的功能项目硬件模块组成设计思路系统功能总结使用的模块的技术详情介绍总结 1. 项目开发背景 随着工业化和现代化的进程,尤其是在制造业、食品业、医药业等行业,仓库环境的监控和管理成为了至关重要的一环。尤其是在存储易腐…...

VSCode便捷开发

一、常用插件 Vue 3 Snippets、Vetur、Vue - Official 二、常用开发者工具 三、Vue中使用Element-UI 安装步骤: 1、在VSCode的终端执行如下指令: npm i element-ui -S 2、在main.js中全局引入: import Vue from vue; import ElementUI from …...

理解 Maven 的 pom.xml 文件

pom.xml 是 Maven 项目的核心文件,它是项目构建、依赖管理、插件配置和项目元数据的主要地方。通过 pom.xml 文件,Maven 知道如何构建项目、下载依赖库、执行测试等任务。每个 Maven 项目都必须包含一个 pom.xml 文件。本文将详细讲解 pom.xml 文件的结构…...

docker数据持久化的意义

Docker 数据持久化是指在 Docker 容器中保存的数据不会因为容器的停止、删除或重启而丢失。Docker 容器本身是临时性的,默认情况下,容器内的文件系统是临时的,容器停止或删除后,其中的数据也会随之丢失。为了确保重要数据…...

opentelemetry-collector 配置elasticsearch

一、修改otelcol-config.yaml receivers:otlp:protocols:grpc:endpoint: 0.0.0.0:4317http:endpoint: 0.0.0.0:4318 exporters:debug:verbosity: detailedotlp/jaeger: # Jaeger supports OTLP directlyendpoint: 192.168.31.161:4317tls:insecure: trueotlphttp/prometheus: …...

ASP.NET Core JWT Version

目录 JWT缺点 方案 实现 Program.cs IdentityHelper.cs Controller NotCheckJWTVersionAttribute.cs JWTVersionCheckkFilter.cs 优化 JWT缺点 到期前,令牌无法被提前撤回。什么情况下需要撤回?用户被删除了、禁用了;令牌被盗用了&…...

【ArcGIS】R语言空间分析、模拟预测与可视化技术

R语言在空间数据挖掘中具有广泛的应用,以下是一些关键内容和常用包的介绍: R语言空间数据挖掘的关键技术 空间数据类型 矢量数据:包括点(Point)、线(Line)、面(Polygon)等…...

日常知识点之面试后反思遗留问题汇总

梳理一下最近接触到的几个知识点: 1:突然问到端口复用 (SO_REUSEADDR) 端口复用一般用在服务端重启时,套接字处于time_wait状态时,无法绑定该端口,导致无法启动问题。 设置端口复用ÿ…...

链表(LinkedList) 1

上期内容我们讲述了顺序表,知道了顺序表的底层是一段连续的空间进行存储(数组),在插入元素或者删除元素需要将顺序表中的元素整体移动,时间复杂度是O(n),效率比较低。因此,在Java的集合结构中又引入了链表来解决这一问…...

Qt:Qt Creator项目创建

目录 认识Qt Creator Qt Creator概览 使用Qt Creator新建项目 选择项目模板 选择项目路径 选择构建系统 填写类信息设置界面 选择语言和翻译文件 选择Qt套件 选择版本控制系统 最终效果 认识Qt Creator Qt Creator概览 从开始菜单或者快捷方式打开Qt Creator集成开…...

基于WLED分段功能与激光切割的多层智能艺术灯板制作全攻略

1. 项目概述与核心价值如果你和我一样,对那种能随着音乐呼吸、或者能独立变换不同区域色彩的智能灯光装置着迷,那么你一定会喜欢这个项目。它远不止是把LED灯条粘在板子后面那么简单,而是将激光切割的精密工艺、分层的艺术设计,与…...

Pro Trinket:Arduino UNO的紧凑型替代方案与双模编程实战

1. Pro Trinket:当Arduino遇上“口袋工程学”如果你和我一样,在创客圈子里摸爬滚打多年,肯定经历过这样的场景:一个基于Arduino UNO的酷炫原型在面包板上运行得风生水起,但当你试图把它塞进一个精致的3D打印外壳&#…...

手把手教你用SystemVerilog Interface搭建一个可复用的DMA寄存器验证环境

基于SystemVerilog Interface构建模块化DMA验证环境的工程实践 在数字IC验证领域,DMA(直接内存访问)控制器作为关键IP核,其寄存器验证环境的搭建效率直接影响项目进度。传统验证方法中信号连接冗长、时序控制分散的问题ÿ…...

VR头显立体视觉姿态估计技术解析

1. 自我中心姿态估计的技术挑战与创新思路在虚拟现实和增强现实应用中,准确估计用户在三维空间中的身体姿态是实现自然交互的基础。传统基于外部摄像头的动作捕捉系统虽然精度较高,但存在设备复杂、使用场景受限等问题。相比之下,基于头戴设备…...

)

Midjourney Ash印相参数白皮书(含Adobe RGB/ProPhoto RGB双色域适配矩阵及ICC Profile嵌入规范)

更多请点击: https://intelliparadigm.com 第一章:Midjourney Ash印相技术演进与核心定位 Midjourney Ash印相(Ash Toning)并非传统暗房化学工艺的简单复刻,而是基于生成式AI图像合成模型的一套语义化风格映射机制。它…...

ARM ETMv4跟踪单元架构与寄存器详解

1. ARM ETMv4跟踪单元架构概述在嵌入式系统开发领域,指令跟踪技术是调试复杂软件问题的关键工具。ARM架构中的嵌入式跟踪宏单元(Embedded Trace Macrocell, ETM)作为处理器核心的实时跟踪组件,能够非侵入式地记录程序执行流程。ETMv4作为当前主流版本&am…...

如何用FanControl快速解决电脑风扇噪音问题:完整免费指南

如何用FanControl快速解决电脑风扇噪音问题:完整免费指南 【免费下载链接】FanControl.Releases This is the release repository for Fan Control, a highly customizable fan controlling software for Windows. 项目地址: https://gitcode.com/GitHub_Trending…...

Midjourney概念艺术风格≠调参!20年CG总监拆解:风格生成本质是跨模态语义压缩,3个关键损失函数阈值决定成败

更多请点击: https://intelliparadigm.com 第一章:Midjourney概念艺术风格≠调参!20年CG总监的范式颠覆 风格不是参数堆砌,而是语义锚点重构 传统AI绘画工作流常将“风格”等同于反复调整 --s、--style raw 或后缀词如 trending…...

14502黄大年茶思屋145期难题 第二题 QLC盘多namespace并发备电量优化问题 标准化解题框架

总标题:黄大年茶思屋145期难题第二题 AI无偏差版脱敏题目标准化解题详细写作框架 子标题:QLC盘多namespace并发备电量优化问题 标准化解题框架 摘要 本文严格遵循AI无偏差脱敏标准化写作范式,完整复刻本期第二道脱敏原题全文,逐项…...

Promises/A+完全指南:深入理解JavaScript异步编程标准规范

Promises/A完全指南:深入理解JavaScript异步编程标准规范 【免费下载链接】promises-spec An open standard for sound, interoperable JavaScript promises—by implementers, for implementers. 项目地址: https://gitcode.com/gh_mirrors/pr/promises-spec …...