消息队列kafka及zookeeper机制

目录

一、zookeeper

1、zookeeper简介

2、zookeeper特点

3、zookeeper工作模式及机制

4、zookeeper应用场景及选举机制

5、zookeeper集群部署

①实验环境

②安装zookeeper

二、消息队列kafka

1、为什么要有消息队列

2、使用消息队列的好处

3、kafka简介

4、kafka特点

5、kafka系统架构名词介绍

6、Kafka架构及流程

7、kafka集群部署

8、kafka报错分析

一、zookeeper

1、zookeeper简介

Zookeeper:开源分布式的服务,为分布式框架提供协调服务的apache项目

2、zookeeper特点

①、zookper是一个领导者,多个跟随着组成

②、集群中有半数以上节点存活,集群正常服务,奇数台最小3台

③、全局数据一致,每个server保存一份相同的数据副本,client无论连接到那台server,数据都一样

④、更新请求顺序执行,来自同一个client更新请求按照其发送顺序一次执行,先进先出

⑤、原子性,要么成功要么失败

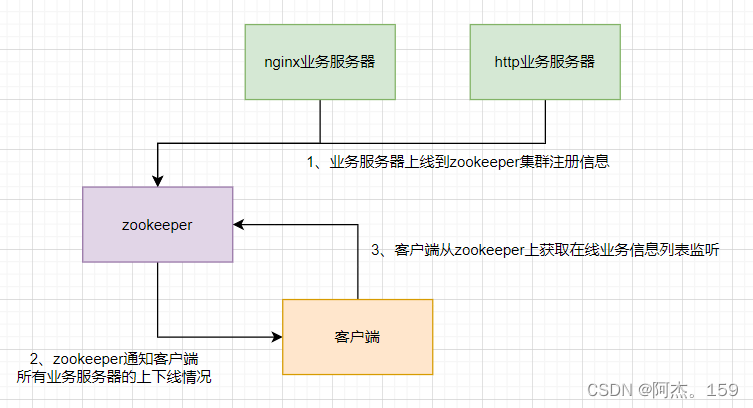

3、zookeeper工作模式及机制

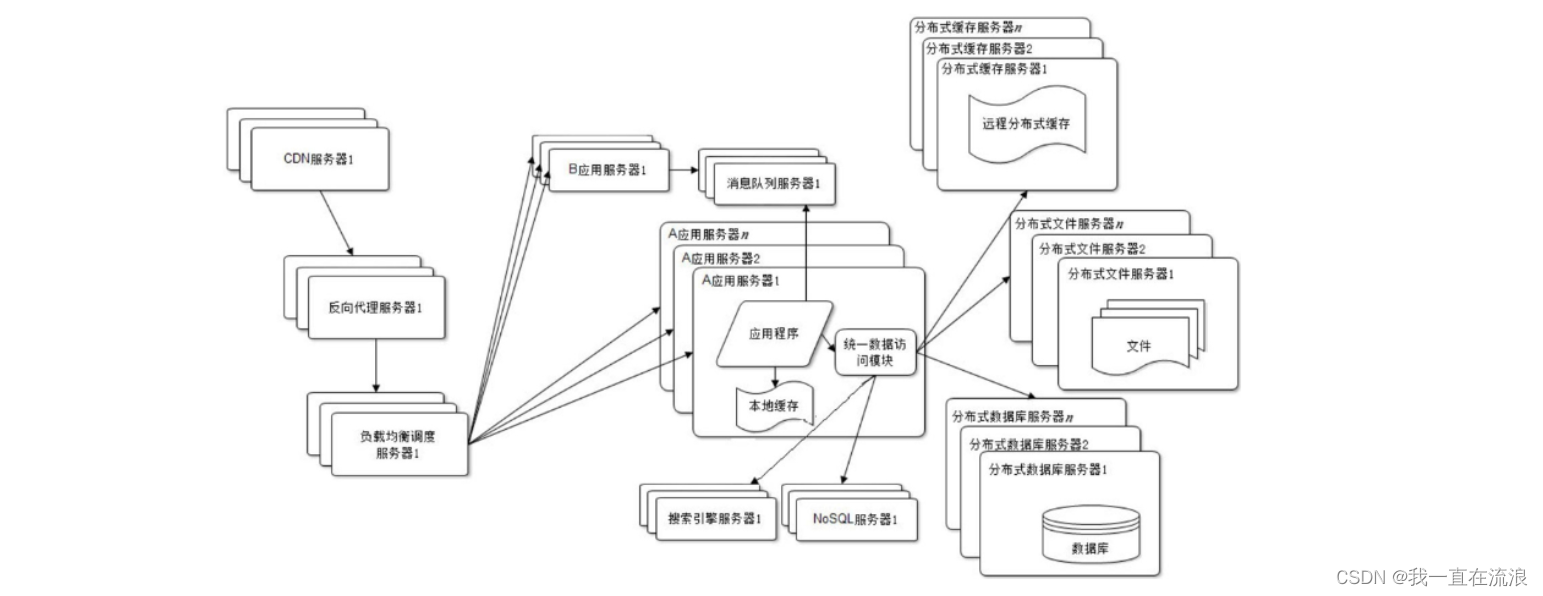

Zookeeper工作模式:文件系统+通知机制

工作机制:

1、每个服务端上线时需要到zookeeper集群注册信息

2、客户端从zookeeper集群获取在线服务端信息列表并监听

3、服务端上线下线时,zookeeper需要更新列表信息并通知客户端

4、客户端接收到通知重新获取zookeeper在线服务器列表

4、zookeeper应用场景及选举机制

应用场景:

统一命名服务、统一配置管理、统一集群管理、服务节点动态上下线、软负载均衡

选举机制:

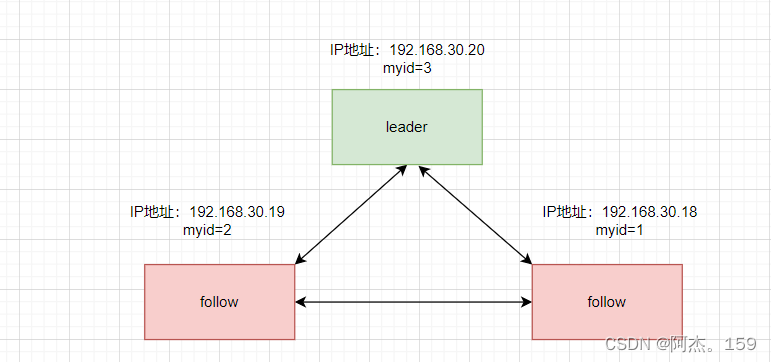

第一次启动选举机制:

服务器1启动,自己投自己一票myid(可以自己设置集群中不能重复)为1,没有明确的leader处于locking状态

服务器2启动,自己投自己一票myid为2,服务器1因为2的myid大于1则投2一票,处于locking状态

服务器3启动,自己投自己一票myid为3,服务器1和2myid小则投服务器3,服务器3成为leader

服务器4启动,已经有leader则加入leader中成为从follower。

非第一次启动选举机制:

SID:服务器id,用来表示一台zookeeper集群汇总的机器,每台机器不能重复和myid一致

ZXID:事务id,ZXID是一个事务id,用来标识服务器状态的变更。与服务器对客户端更新请求处理逻辑速度有关

Epoch:每个leader任期的代号,没有leader时同一轮投票过程中的值是一样的,每投票一次这个数据增加

①、Epoch值大的直接胜出成为leader

②、epoch值相同事务id大的胜出

③、事务id相同则服务器id大的胜出

5、zookeeper集群部署

①实验环境

②安装zookeeper

三台机器执行:

systemctl stop firewalld.service

setenforce 0

#关闭防火墙和selinux

cd /opt

tar -zxvf apache-zookeeper-3.5.7-bin.tar.gz

mv apache-zookeeper-3.5.7-bin /usr/local/zookeeper-3.5.7

#将zookeeper压缩包放入/opt目录并解压,解压后的文件移动到/usr/local下改名为zookeeper-3.5.7

cd /usr/local/zookeeper-3.5.7/conf/

cp zoo_sample.cfg zoo.cfg

vim zoo.cfg

#进入配置文件路径备份配置文件然后修改配置文件,内容如下

tickTime=2000

#通信心跳时间,Zookeeper服务器与客户端心跳时间,单位毫秒

initLimit=10

#Leader和Follower初始连接时能容忍的最多心跳数(tickTime的数量),这里表示为10*2s

syncLimit=5

#Leader和Follower之间同步通信的超时时间,这里表示如果超过5*2s,Leader认为Follwer死掉,并从服务器列表中删除Follwer

dataDir=/usr/local/zookeeper-3.5.7/data

#修改,指定保存Zookeeper中的数据的目录,目录需要单独创建

dataLogDir=/usr/local/zookeeper-3.5.7/logs

#添加,指定存放日志的目录,目录需要单独创建

clientPort=2181

#客户端连接端口

server.1=192.168.30.18:3188:3288

server.2=192.168.30.19:3188:3288

server.3=192.168.30.20:3188:3288

#添加集群信息

erver.A=B:C:D

#A是一个数字,表示这个是第几号服务器。集群模式下需要在zoo.cfg中dataDir指定的目录下创建一个文件myid,这个文件里面有一个数据就是A的值,Zookeeper启动时读取此文件,拿到里面的数据与zoo.cfg里面的配置信息比较从而判断到底是哪个server。

#B是这个服务器的地址。

#C是这个服务器Follower与集群中的Leader服务器交换信息的端口。

#D是万一集群中的Leader服务器挂了,需要一个端口来重新进行选举,选出一个新的Leader,而这个端口就是用来执行选举时服务器相互通信的端口。

mkdir /usr/local/zookeeper-3.5.7/data

mkdir /usr/local/zookeeper-3.5.7/logs

#创建指定的数据存放位置和日志存放位置

echo 1 > /usr/local/zookeeper-3.5.7/data/myid

#192.168.30.18上执行此命令,规划时此机器的myid为1

echo 2 > /usr/local/zookeeper-3.5.7/data/myid

#192.168.30.19上执行此命令,规划时此机器的myid为2

echo 3 > /usr/local/zookeeper-3.5.7/data/myid

#192.168.30.20上执行此命令,规划时此机器的myid为3

vim /etc/init.d/zookeeper

#!/bin/bash

#chkconfig:2345 20 90

#description:Zookeeper Service Control Script

ZK_HOME='/usr/local/zookeeper-3.5.7'

case $1 in

start)echo "---------- zookeeper 启动 ------------"$ZK_HOME/bin/zkServer.sh start

;;

stop)echo "---------- zookeeper 停止 ------------"$ZK_HOME/bin/zkServer.sh stop

;;

restart)echo "---------- zookeeper 重启 ------------"$ZK_HOME/bin/zkServer.sh restart

;;

status)echo "---------- zookeeper 状态 ------------"$ZK_HOME/bin/zkServer.sh status

;;

*)echo "Usage: $0 {start|stop|restart|status}"

esac

#三台机器配置开启zookeeper脚本,#脚本内容为当执行脚本位置变量1为star,stop,restart,status,*时执行对应的服务管理脚本(安装时自带管理服务的脚本)

chmod +x /etc/init.d/zookeeper

chkconfig --add zookeeper

#设置开机自启并使用service管理服务

service zookeeper start

service zookeeper status

#开启并查看服务状态二、消息队列kafka

1、为什么要有消息队列

高并发环境下,同步请求来不及处理,请求往往会发生阻塞,比如大量请求并发访问数据库,导致行锁表,最后请求线程堆积过多,引发雪崩。

雪崩:高并发情况下redis服务器无法同时处理大量请求,导致rdis崩溃直接查询数据库。

2、使用消息队列的好处

1)解耦

允许独立的扩展或修改两边的处理过程,只有确保他们遵守同样的接口约束

2)可恢复性

系统一部分组件失效不会影响整个系统,消息队列降低了过程的耦合度,即使一个处理消息的进程挂掉了,加入队列中的消息仍然可以在系统恢复后被处理。

3)缓存

有助于控制和优化数据流经过的速度,解决生成消费信息的处理速度不一致的情况

4)灵活性&峰值处理能力

能够使关键组件顶住突发的访问压力,而不会因为突发的超负荷的请求而完全崩溃

5)异步通信

允许用户把一个消息加入队列,但并不立即处理它。想向队列中放多少消息就放多少,在需要的时候去处理他们

3、消息队列的2种模式

点对点(一对一):消费者主动拉取数据,消费者将生产者生成的数据拉取完成则消费者将消息删除。

发布/订阅模式(一对多也称为观察者模式):消费者消费数据之后不会清除消息

1)、生产者发布消息到topic,同时有多个消费者

2)、观察者(实时观察消费者消费能力即处理数据能力)观察整个消息队列,根据消费者的能力配置,发送数据给消费者

3、kafka简介

kafka:是一个分布式的,支持分区的,多副本基于发布/订阅模式的消息队列(MQ message quene),主要用于日志和大数据实时处理

4、kafka特点

1)高吞吐量每秒钟可以处理几十万消息,延迟最低只是几毫秒。

2)持久性、可靠性,完善的消息存储机制存储到磁盘,保证数据的高效和持久化

3)分布式,生产者数据会存放在所有机器上,挂一台数据不会丢失。

4)容错性,允许集群中节点失败,允许副本-1个节点失败

5)高并发,支持千个客户端同时读写

5、kafka系统架构名词介绍

①broker:一台kafka服务器就是一个broker。一个集群由多个broker组成,一个broker可以容纳多个topic

②Produer:生产者。也就是写入消息的一方,将消息写入broker中

③Consumer:消费者。也就是读取消息的一方,从broker中读取消息

④Zookeeper:kafka使用zookeeper来管理集群的元数据,以及控制器的选举等操作。

⑤topic:主题。每一个消息都属于某个主题,kafka通过主题来划分消息,是一个逻辑上的分类

⑥partition:即分区

同一个主题下的消息还可以继续分成多个分区,一个分区只属于一个主题,kafka只保证partition中的数据是有序的,不保证topic中的不通partition数据是有序的,每个topic至少有一个partition,每个 partition 中的数据使用多个 segment 文件存储。

partition数据路由规则:

1.指定partition,则直接使用、 2.未指定partition但指定了key,根据key取模选择partition、3.都未指定则轮询选择partition

分区的原因:为什么在topic下有多个partition?

1.方便集群中扩展,每个partition可以通过调整以适应它所在的机器,而一个topic又可以有多个Partition组成,因此整个集群就可以适应任意大小的数据了;

2.可以提高并发,因为可以以Partition为单位读写了;

⑦Replica:副本。一个分区可以有多个副本来提高容灾性,一般是设置一个分区2个副本

⑧Offset:偏移量。消费者存在zookeeper上的记录自己访问到什么地方

⑨leader负责读写,follow只负责复制和备份

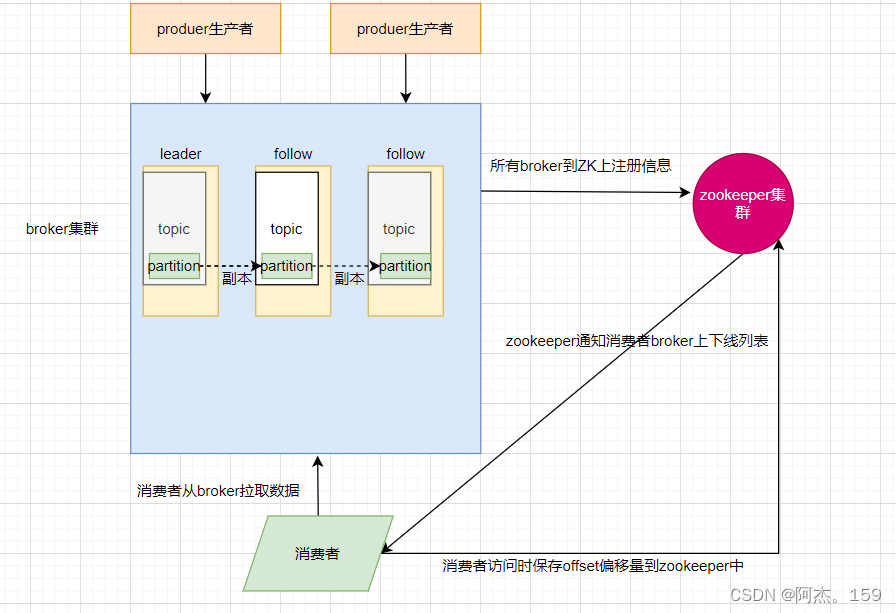

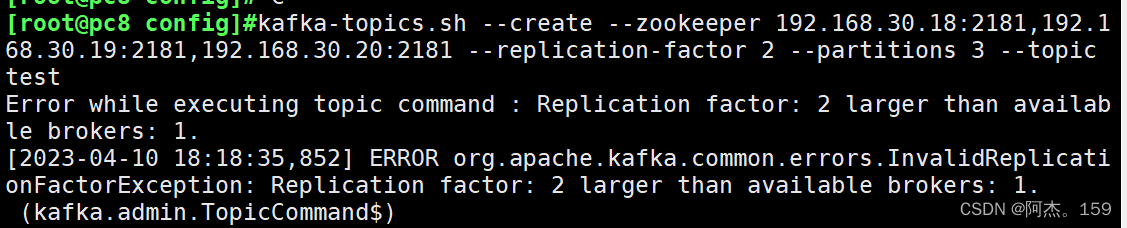

6、Kafka架构及流程

1)、生产者生产数据传给broker即kafka服务器集群

2)、kafka集群将数据存储在topic主题中,每个topic主题中有多个分片(分片做了备份在其他topic)

3)、分片中存储数据,kafka集群注册在zookeeper中,zookeeper通知消费者kafka服务器在线列表

4)、消费者收到zookeeper通知的在线列表,从broker中拉取数据

5)、消费者保存偏移量到zookeeper中,以便记录自己宕机消费到什么地方

7、kafka集群部署

基于zookeeper的三台机器操作:

cd /opt/

tar zxvf kafka_2.13-2.7.1.tgz

mv kafka_2.13-2.7.1 /usr/local/kafka

#kafka安装包上传到/opt解压并移动到/usr/local中改名为kafka

#下载地址wget https://mirrors.tuna.tsinghua.edu.cn/apache/kafka/2.7.1/kafka_2.13-2.7.1.tgz

cd /usr/local/kafka/config/

cp server.properties server.properties.bak

vim server.properties

#kafka主配置文件备份并编辑,内容如下

broker.id=0

#21行,broker的全局唯一编号,每个broker不能重复,因此要在其他机器上配置 broker.id=1、broker.id=2

listeners=PLAINTEXT://192.168.10.17:9092

#31行,指定监听的IP和端口,如果修改每个broker的IP需区分开来,也可保持默认配置不用修改

num.network.threads=3

#42行,broker 处理网络请求的线程数量,一般情况下不需要去修改

num.io.threads=8

#45行,用来处理磁盘IO的线程数量,数值应该大于硬盘数

socket.send.buffer.bytes=102400

#48行,发送套接字的缓冲区大小

socket.receive.buffer.bytes=102400

#51行,接收套接字的缓冲区大小

socket.request.max.bytes=104857600

#54行,请求套接字的缓冲区大小

log.dirs=/usr/local/kafka/logs

#60行,kafka运行日志存放的路径,也是数据存放的路径

num.partitions=1

#65行,topic在当前broker上的默认分区个数,会被topic创建时的指定参数覆盖

num.recovery.threads.per.data.dir=1

#69行,用来恢复和清理data下数据的线程数量

log.retention.hours=168

#103行,segment文件(数据文件)保留的最长时间,单位为小时,默认为7天,超时将被删除

log.segment.bytes=1073741824

#110行,一个segment文件最大的大小,默认为 1G,超出将新建一个新的segment文件

zookeeper.connect=192.168.30.18:2181,192.168.30.19:2181,192.168.30.20:2181

#123行,配置连接Zookeeper集群地址,保存后退出

vim /etc/profile

#编辑全局变量文件,添加kafka全局环境变量,内容如下

export KAFKA_HOME=/usr/local/kafka

export PATH=$PATH:$KAFKA_HOME/bin

#export全局生效,修改完后保存退出

source /etc/profile

#刷新全局配置变量文件

#编写管理kafka服务的脚本

vim /etc/init.d/kafka

#!/bin/bash

#chkconfig:2345 22 88

#description:Kafka Service Control Script

KAFKA_HOME='/usr/local/kafka'

case $1 in

start)echo "---------- Kafka 启动 ------------"${KAFKA_HOME}/bin/kafka-server-start.sh -daemon ${KAFKA_HOME}/config/server.properties

;;

stop)echo "---------- Kafka 停止 ------------"${KAFKA_HOME}/bin/kafka-server-stop.sh

;;

restart)$0 stop$0 start

;;

status)echo "---------- Kafka 状态 ------------"count=$(ps -ef | grep kafka | egrep -cv "grep|$$")if [ "$count" -eq 0 ];thenecho "kafka is not running"elseecho "kafka is running"fi

;;

*)echo "Usage: $0 {start|stop|restart|status}"

esac

脚本内容为当执行脚本位置变量1为star,stop,restart,status,*时执行对应的服务管理脚本(安装时自带管理服务的脚本)

chkconfig --add kafka

#设置开机自启并使用service管理服务

service kafka start

service kafka status

#开启并查看服务状态###随便一台机器执行:

kafka-topics.sh --create --zookeeper 192.168.30.18:2181,192.168.30.19:2181,192.168.30.20:2181 --replication-factor 2 --partitions 3 --topic test

#kafka创建topic即主题test

#--zookeeper:定义 zookeeper 集群服务器地址,如果有多个 IP 地址使用逗号分割,一般使用一个 IP 即可

#--replication-factor:定义分区副本数,1 代表单副本,建议为 2

#--partitions:定义分区数

#--topic:定义 topic 名称

kafka-topics.sh --list --zookeeper 192.168.30.18:2181,192.168.30.19:2181,192.168.30.20:2181

#查看当前服务器中的所有 topic

kafka-topics.sh --describe --zookeeper 192.168.30.18:2181,192.168.30.19:2181,192.168.30.20:2181

#查看某个 topic 的详情

kafka-console-producer.sh --broker-list 192.168.30.18:9092,192.168.30.19:9092,192.168.30.20:9092 --topic test

#进入test的topic主机发布消息,输入完命令后输入123456

kafka-console-consumer.sh --bootstrap-server 192.168.30.18:9092,192.168.30.19:9092,192.168.30.20:9092 --topic test --from-beginning

#在另外一台主机输入消费信息的命令,查看是否可以收到发布的消息

#--from-beginning:会把主题中以往所有的数据都读取出来,即从最开始读取

kafka-topics.sh --zookeeper 192.168.30.18:2181,192.168.30.19:2181,192.168.30.20:2181 --alter --topic test --partitions 6

#修改名为test的topic主题的分区数

kafka-topics.sh --delete --zookeeper 192.168.30.18:2181,192.168.30.19:2181,192.168.30.20:2181 --topic test

#删除名为test的topic

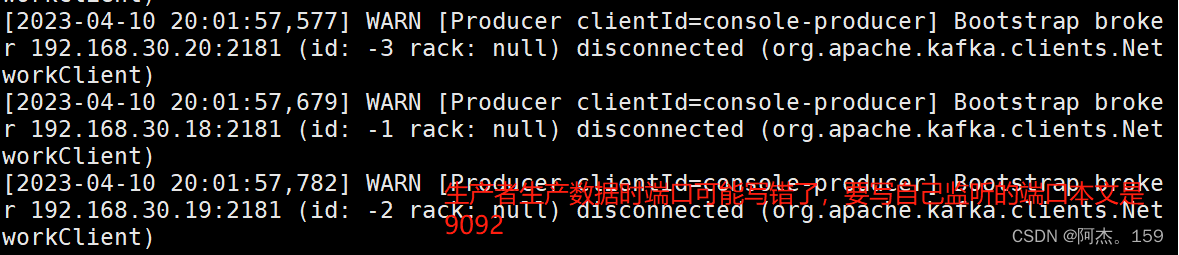

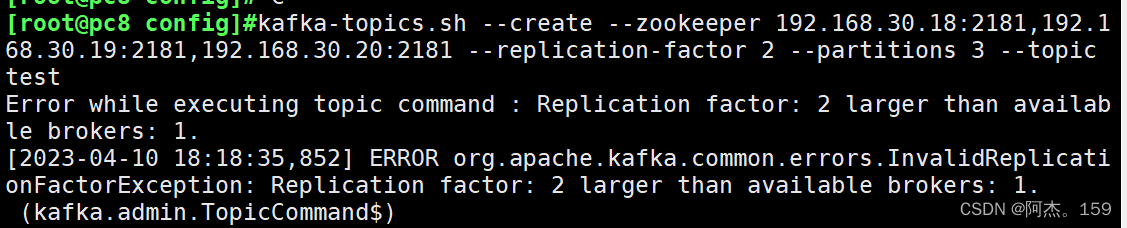

8、kafka报错分析

[2023-04-10 20:01:57,373] WARN [Producer clientId=console-producer] Bootstrap broker 192.168.30.18:2181 (id: -1 rack: null) disconnected (org.apache.kafka.clients.NetworkClient)

[2023-04-10 20:01:57,475] WARN [Producer clientId=console-producer] Bootstrap broker 192.168.30.19:2181 (id: -2 rack: null) disconnected (org.apache.kafka.clients.NetworkClient)

[2023-04-10 20:01:57,577] WARN [Producer clientId=console-producer] Bootstrap broker 192.168.30.20:2181 (id: -3 rack: null) disconnected (org.apache.kafka.clients.NetworkClient)

[2023-04-10 20:01:57,679] WARN [Producer clientId=console-producer] Bootstrap broker 192.168.30.18:2181 (id: -1 rack: null) disconnected (org.apache.kafka.clients.NetworkClient)

[2023-04-10 20:01:57,782] WARN [Producer clientId=console-producer] Bootstrap broker 192.168.30.19:2181 (id: -2 rack: null) disconnected (org.apache.kafka.clients.NetworkClient)###报错信息

ERROR org.apache.kafka.common.errors.InvalidReplicationFactorException: Replication factor: 2 larger than available brokers: 1(kafka.admin.TopicCommand$)##三台kafka只起来一台,查看是否配置文件中的broker.id相同了,或者其他俩台防火墙启动错误

安装zookeeper和kafka后启动报错,查看日志显示有no route host 没有路由等信息,则表示是三台中有防火墙未关闭相关文章:

消息队列kafka及zookeeper机制

目录 一、zookeeper 1、zookeeper简介 2、zookeeper特点 3、zookeeper工作模式及机制 4、zookeeper应用场景及选举机制 5、zookeeper集群部署 ①实验环境 ②安装zookeeper 二、消息队列kafka 1、为什么要有消息队列 2、使用消息队列的好处 3、kafka简介 4、kafka…...

分布式 - 分布式体系架构:IT架构的演进过程

文章目录01. 应用与数据一体模式02. 应用服务和数据服务的分离03. 缓存与性能的提升04. 服务器集群处理并发05. 数据库读写分离06. 反向代理和 CDN07. 分布式文件系统和分布式数据库系统08. NoSQL和搜索引擎09. 业务拆分10. Redis缓存在应用服务器上是进程内缓存还是进程外缓存…...

CSDN 周赛42期

CSDN 周赛42期1、题目名称:鬼画符门之宗门大比2、题目名称:K皇把妹3、题目名称:影分身4、题目名称:开心的金明小结1、题目名称:鬼画符门之宗门大比 给定整数序列A。 求在整数序列A中连续权值最大的子序列的权值。 &…...

Vue:初识Vue

1、首先要导入vue.js <!-- 当你使用script标签安装vue之后,上下文就注册了一个全局变量vue --><script src"../1.Vue/js/vue.js"></script> 不能直接调用vue(),需要new vue(),否则会报错。 2、关于vue构造函数的参数opti…...

linux语言学习记录

文章目录前言一、linux文件结构二、指令三、Gvim编辑器1、命令模式2、底行命令四、正则表达式1、表达式匹配举例2、对文件里面内容进行操作3、使用 \( 和 )\ 符号括起正规表达式,即可在后面使用\1和\2等变量来访问和中的内容前言 记录自己学习linux的笔记ÿ…...

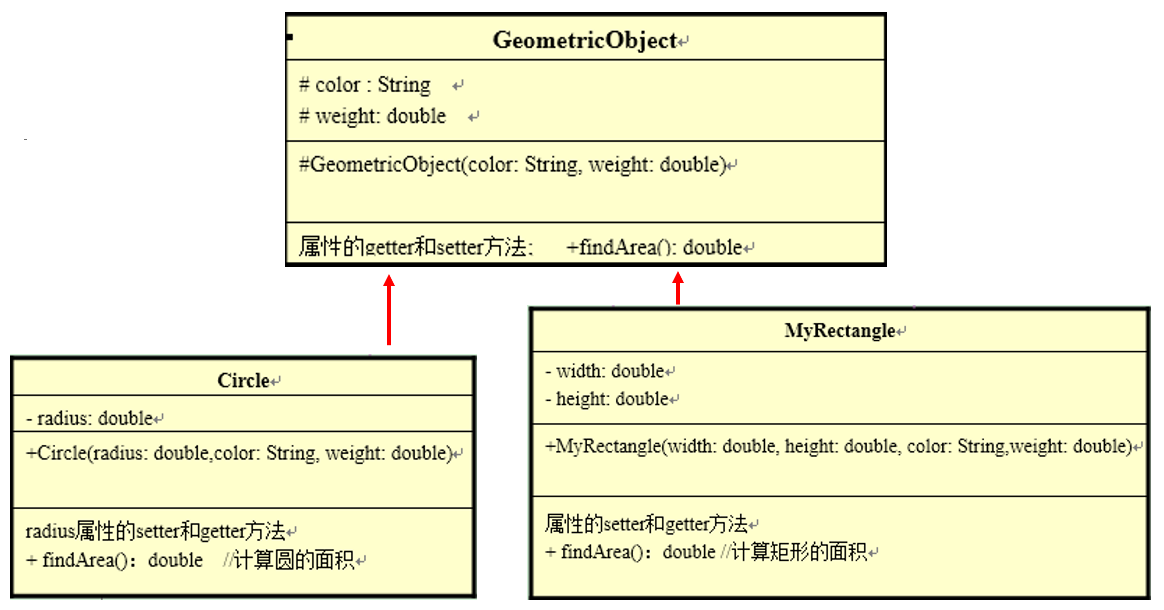

面向对象编程(进阶)7:面向对象特征三:多态性

一千个读者眼中有一千个哈姆雷特。 目录 7.1 多态的形式和体现 7.1.1 对象的多态性 举例: 7.1.2 多态的理解 7.1.3 举例 1、方法内局部变量的赋值体现多态 2、方法的形参声明体现多态 3、方法返回值类型体现多态 7.2 为什么需要多态性(polymorphism)&#x…...

vue尚品汇商城项目-day04【29.加入购物车操作(难点)】

文章目录29.加入购物车操作(难点)29.1加入购物车按钮29.2addCartSuce29.3购物车29.3.1 向服务器发送ajax请求,获取购物车数据29.3.2UUID临时游客身份29.3.3动态展示购物车29.4修改购物车产品的数量(需要发请求:参数理解…...

KubeSphere 社区双周报 | 4.8 深圳站 Meetup 火热报名中 | 2023.3.17-3.30

KubeSphere 社区双周报主要整理展示新增的贡献者名单和证书、新增的讲师证书以及两周内提交过 commit 的贡献者,并对近期重要的 PR 进行解析,同时还包含了线上/线下活动和布道推广等一系列社区动态。 本次双周报涵盖时间为:2023.03.17-2023.…...

ChatGPT热炒之前 搜索引擎SEO算法已经悄然改变

2022年4月起,某度算法有了新的调整,这对于靠SEO获得流量的公司简直可以说是灭顶之灾。原本SEO从业者还指望跟之前一样,等算法调整稳定后,网站的自然排名还会再回来,但等到了10月份,仍然没有回暖的迹象&…...

【Linux】Mysql之视图的基本操作

一、什么是视图 MySQL 视图(View)是一种虚拟存在的表,同真实表一样,视图也由列和行构成, 但视图并不实际存在于数据库中。行和列的数据来自于定义视图的查询中所使用的 表,并且还是在使用视图时动态生成的。…...

《扬帆优配》西藏地震!美史上最严排放新规将出台,美股收涨

当地时间周四,美股遍及收高,科技股领涨。因耶稣受难日,美股4月7日(周五)休市,周四为美股本周最终一个买卖日,从本周状况来看,纳指与标普500指数均录得跌幅,别离跌1.1%和0…...

Python 小型项目大全 66~70

六十六、简单替换密码 原文:http://inventwithpython.com/bigbookpython/project66.html 简单替换密码用一个字母代替另一个字母。由于字母A有 26 种可能的替换,B有 25 种可能的替换,C有 24 种可能的替换,等等,所以可能…...

Barra模型因子的构建及应用系列八之Earning_Yeild因子

一、摘要 在前期的Barra模型系列文章中,我们构建了Size因子、Beta因子、Momentum因子、Residual Volatility因子、NonLinear Size因子、Book-to-Price因子和Liquidity因子,并分别创建了对应的单因子策略,其中Size因子和NonLinear Siz因子具有…...

2022蓝桥杯省赛——卡片

问题描述 小蓝有 k 种卡片, 一个班有 n 位同学, 小蓝给每位同学发了两张卡片, 一位同学的两张卡片可能是同一种, 也可能是不同种, 两张卡片没有顺序。没有两位同学的卡片都是一样的。 给定 n, 请问小蓝的卡片至少有多少种? 输入格式 输入一行包含一个正整数表示 n 。 输出…...

数据结构-快速排序

一.概要 快速排序是一种基于分治思想的排序算法,其基本思路是选取一个基准值(pivot),通过一趟排序将待排序列分成两个部分,其中左半部分都小于基准值,右半部分都大于基准值,然后对左右两部分分…...

WuThreat身份安全云-TVD每日漏洞情报-2023-04-10

漏洞名称:Apple iOS/iPadOS 越界写入 漏洞级别:高危 漏洞编号:CVE-2023-28206 相关涉及:Apple iOS <16.4.0 漏洞状态:在野 参考链接:https://tvd.wuthreat.com/#/listDetail?TVD_IDTVD-2023-08810 漏洞名称:PHPGurukul Bank Locker Management System SQL 注入 漏洞级别:高…...

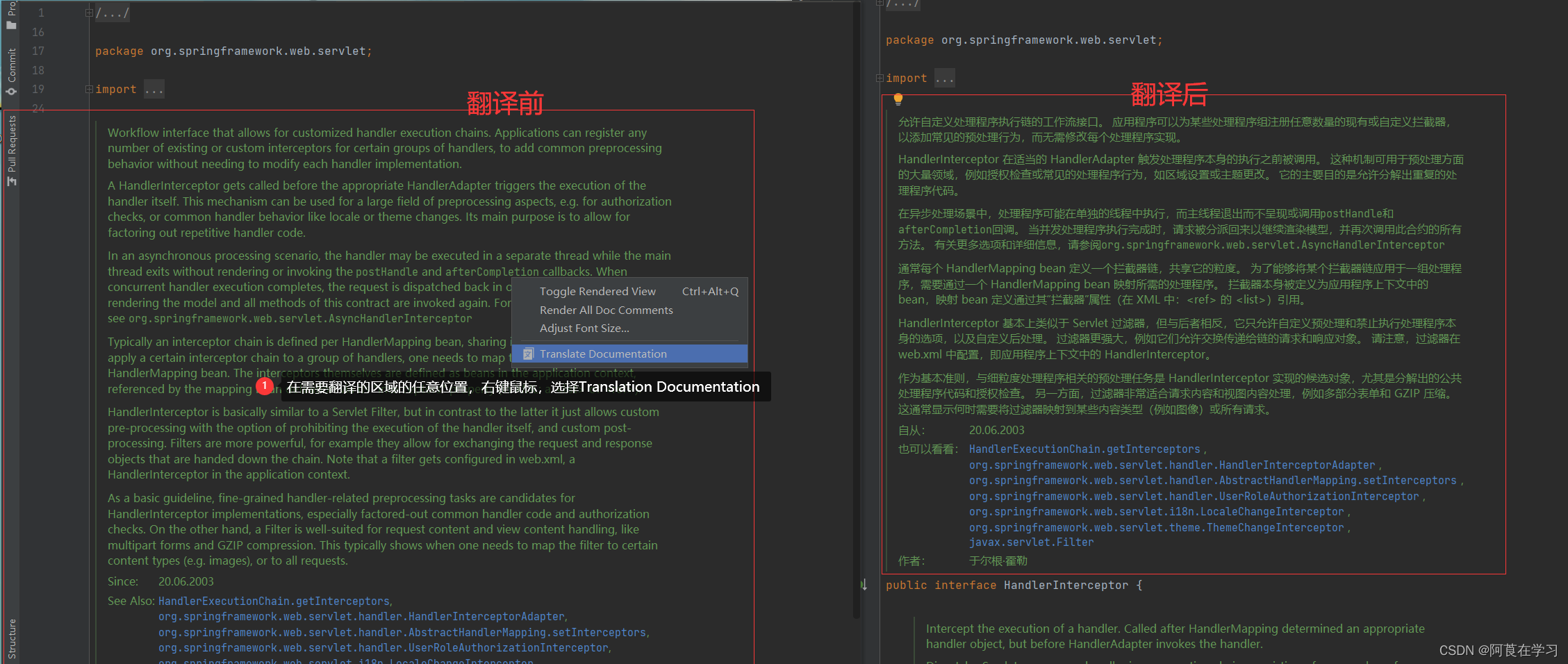

IDEA中查看源码点击Download Sources时出现Cannot download sources的问题复现及解决

IDEA中查看源码点击Download Sources时出现Cannot download sources的问题复现及解决 注意:实验环境的IDEA版本:2021.3.1 1、问题描述 1.1、当想看源码时,点击Download Sources 1.2、此时出现了Cannot download sources 2、解决办法 2.1、…...

R+VIC模型融合实践技术应用及未来气候变化模型预测/SWAT/HSPF/HEC-HMS

在气候变化问题日益严重的今天,水文模型在防洪规划,未来预测等方面发挥着不可替代的重要作用。目前,无论是工程实践或是科学研究中都存在很多著名的水文模型如SWAT/HSPF/HEC-HMS等。虽然,这些软件有各自的优点;但是&am…...

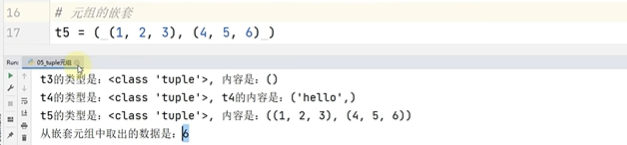

Python 02 数据类型(04元组)

一、元组 元组和列表的唯一不同:不能直接对元组的元素进行修改,删除,添加。 不能修改 1.1 创建元组 1.1.1 创建一个空元组 touple1() # ‘() 里面没有元素,表示为空元组 1.1.2 元组可以容纳任意数据类型的数据的有序集合&…...

WMS:入库库作业流程状态定位

系列文章目录 例如:第一章 WMS:入库库作业流程状态定位 目录 系列文章目录 文章目录 前言 一、入库订单作业状态 二、入库任务级作业状态 1.收货作业 2.验收作业 总结 前言 WMS系统在仓储作业的管理中发挥着至关重要的作用,其核心优势在于强大…...

Docker化部署KingbaseES V9:从镜像导入到开发版License激活实战

1. 为什么选择Docker部署KingbaseES V9? 在开发测试环境中,传统数据库安装方式往往需要耗费大量时间在环境配置和依赖解决上。我去年参与的一个政务云项目就遇到过这种情况:团队花了三天时间在不同操作系统的测试机上反复折腾依赖库ÿ…...

)

ElevenLabs语音克隆效果翻倍秘技(实测SSML+声纹嵌入+噪声抑制三重优化)

更多请点击: https://intelliparadigm.com 第一章:ElevenLabs语音克隆效果翻倍秘技(实测SSML声纹嵌入噪声抑制三重优化) ElevenLabs 的语音克隆能力虽强,但原始 API 调用常因语调扁平、背景干扰与韵律失真导致真实感不…...

ElementPlus el-tabs样式踩坑全记录:从‘这怎么改’到‘原来如此’的心路历程

ElementPlus el-tabs样式深度定制实战:从困惑到精通的全过程解析 第一次在产品需求文档里看到"标签页要设计得与众不同"时,我完全没意识到这个看似简单的需求会让我在ElementPlus的样式迷宫里转了三天的圈。作为团队里负责后台管理系统重构的前…...

iPhone/iPad移动端CircuitPython嵌入式开发实战指南

1. 项目概述:当嵌入式开发遇上移动生产力作为一名在嵌入式硬件和创客领域折腾了十多年的老玩家,我经历过各种开发环境的变迁。从早年抱着一台厚重的笔记本电脑在实验室里调试,到后来用树莓派做便携式开发机,我一直希望能有一种更轻…...

SAP 实战篇:Script脚本进阶,从录制到智能循环批量处理

1. SAP脚本自动化:从入门到进阶 刚接触SAP脚本时,我和大多数新手一样,以为它只是个简单的"动作录制器"。直到有次需要处理500多条订单修改,我才发现这个被低估的工具能带来多大改变。SAP Script脚本本质上是通过VBScrip…...

数据血缘是什么?怎么建设数据血缘?

今年跟十几个企业老板聊AI落地,发现大家都有一个共识:不上AI是等死,乱上AI是找死。为什么?因为AI这玩意儿就像顶级厨师,食材不新鲜、来历不明,做出来的菜照样能毒倒一片。这里的食材,就是数据。…...

DIY USB-C扩展坞:从引脚连接到3D打印,打造开发板专属工作站

1. 项目概述与核心价值如果你和我一样,桌上常年堆着各种开发板,从Arduino Uno到最新的ESP32-S3,每次想插拔USB线调试或者充电,都得在一堆线缆里翻找,板子还容易滑来滑去,那这个项目就是为你准备的。今天我们…...

从10G到40G/50G:UltraScale+以太网IP核升级实战与GT资源规划

1. 从10G到40G/50G的升级挑战 当你第一次把项目从10G升级到40G/50G以太网时,最直观的感受就是"资源突然不够用了"。我去年接手一个视频处理项目时就深有体会——原本在10G环境下游刃有余的FPGA设计,切换到40G后GT资源立刻捉襟见肘。这里说的GT…...

【GPT-4V全面评估】:大语言多模态模型的黎明时代

多模态大模型时代的黎明:GPT-4V(ision)全面能力深度测评 当AI还在为"看图说话"磕磕绊绊时,GPT-4V已经悄悄解锁了"看懂世界"的超能力。它不仅能识别图片里的物体,还能理解梗图的笑点、解数学题、读X光片、甚至帮你操作电脑…...

出库篇:仓库里的货往哪去?——WMS出库方式全解析,物流新人必读

仓库里的货往哪去?——WMS出库方式全解析,物流新人必读 摘要:货品有进必有出。上一期我们聊了WMS中货品的四大来源(采购、生产、退货、调拨入库),这一期我们来看看货品是怎么“出”去的——销售出库、采购退…...