Ceph应用

//存储类型

块存储

一对一,只能被一个主机挂载使用,数据以块为单位进行存储,典型代表: 硬盘

文件存储

一对多,能被多个主机同时挂载使用,数据以文件的形式存储的(元数据和实际数据是分开存储的),并且有目录的层级 关系,典型代表:NFS

对象存储

一对多,能被多个主机通过API接口访问使用,数据以文件进行存储,一个文件即一个对象,无数据和实际数据是存储 在一起的,文件是扁平化的存储,没有目录的层级关系典型代表: OSS、S3

//Ceph架构

客户端(APP/VM/HOST)

三个默认接口 (块存储RBD,文件存储cephES,对象存储RGW)

LibRADOS对象访问接口

RADOS基础存储系统(统一存储池)

//Ceph组件

OSD

负责存储数据,般一个磁盘对应一个OSD,响应客广端的读气请求

Monitor(mon)

负责保存OSD的元数据,维护Ceph集群状态的MAP映射视图,管理客户端的认证与授权

Manager(mgr)

负责跟踪集群状态和监控指标,暴露接口给监控软件获取监控指标数据

MDS

负责保存 CephFS 文件系统的元数据,仅在使用 CephFS 接口功能时使用

PG

可以理解成保存OSD位置的索引,一个PG里包含多个数据对象,一个对象只能属于一个PG

Pool

数据池,可以理解成一个命名空间,一个Pool里有多个PG

//Ceph的存储过程

1)文件 默认会被按照4M大小进行分片成一个或多个数据对象(obiect)

2)每人object都有一个 oid(由文件ID ino 和 分片编号 ono 组成),通过对oid使用bash算法得到一个16进制的数值,再与 Pool里的PG总数取余,得到object的PGID(PoodID+PGID)

3)通过对PGID使用crush算法得到PG对应的OSD的ID(如有多副本,则是主从OSD)

4) 将object的数据存储到对应的OSD节点上

#ceph适合存储几个G的大文件或者海量小文件。

下载ceph加速,替换源地址为阿里云或者清华大学源

sed -i '/s#download.ceph.com#mirrors.aliyun.com#' ceph.rep

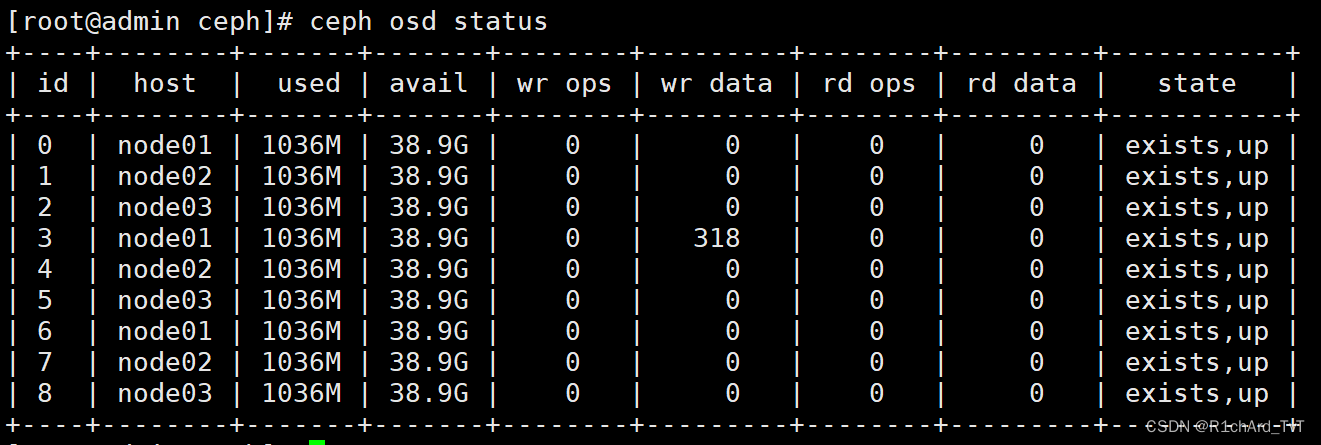

ceph osd tree 简单查看osd的状态

cd /etc/ceph

ceph-deploy mgr create node01 node02 node03

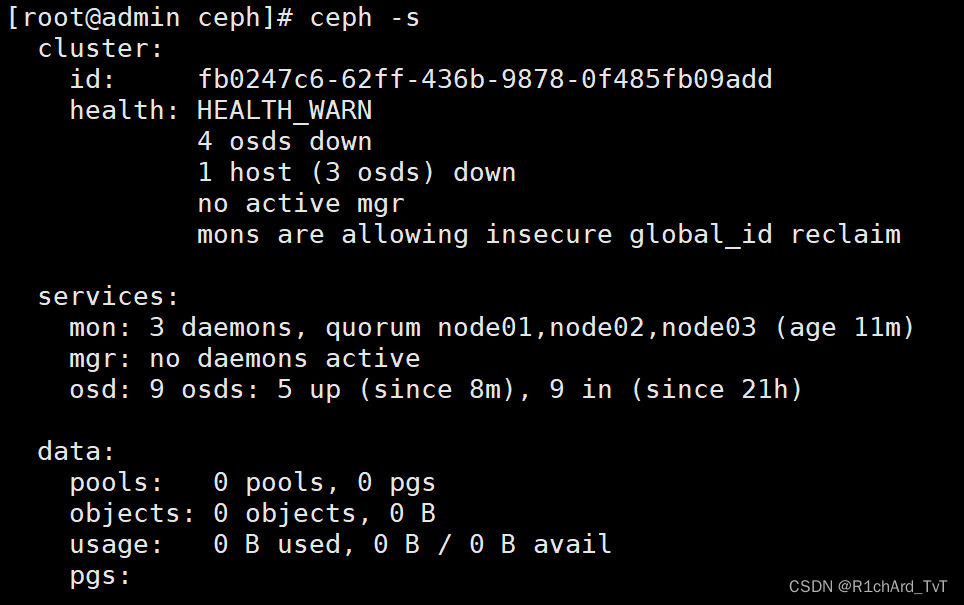

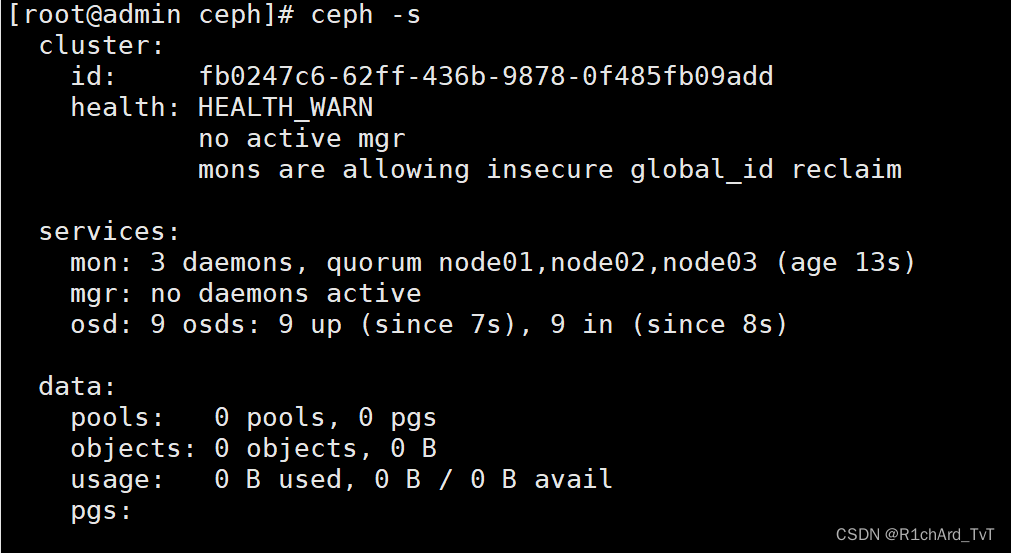

ceph -s 查看状态

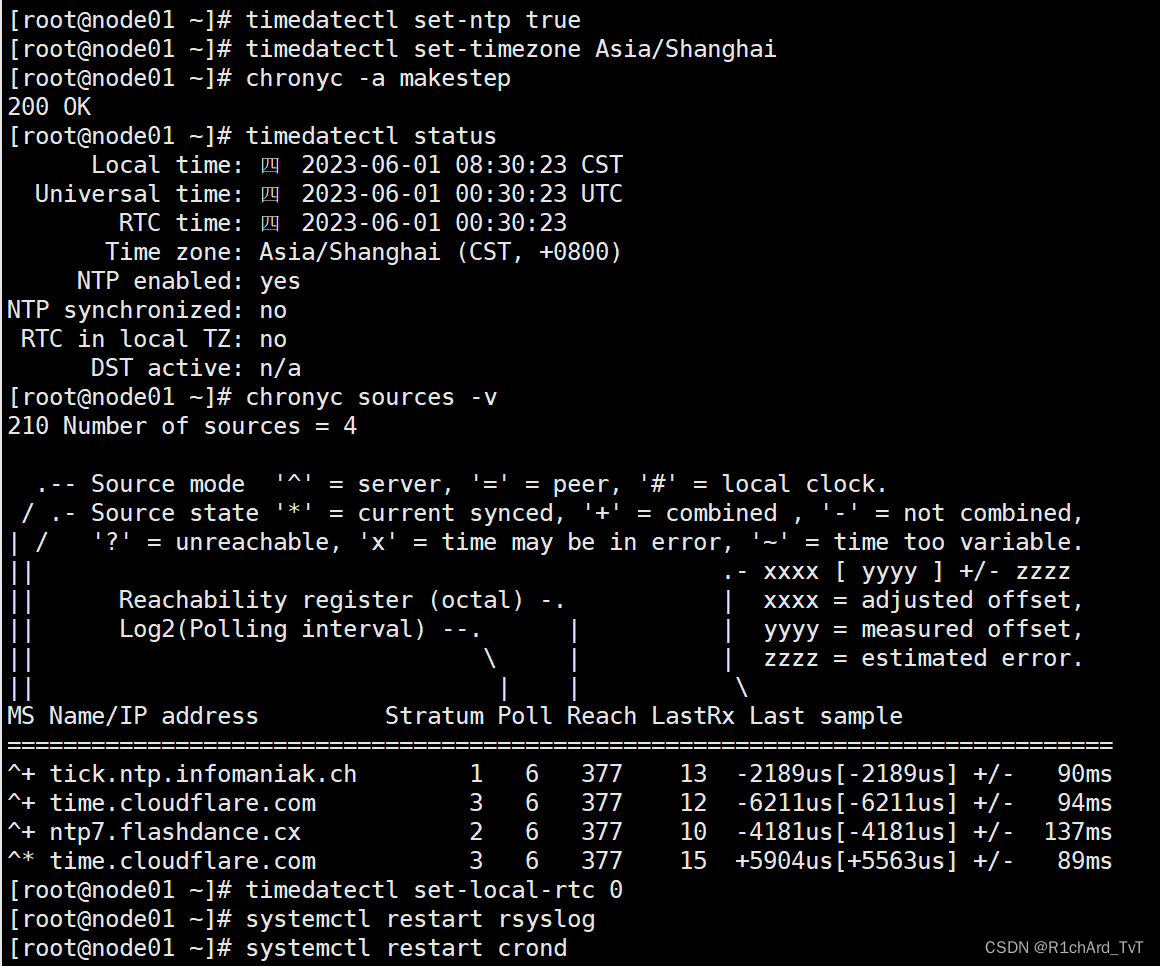

再做一次时间同步

chronyc -a makestep

timedatectl set-local-rtc 0

timedatectl status

systemctl restart ceph-mon@node01.service #解除延迟告警

ceph config set mon auth_allow_insecure_global_id_reclaim false #禁用不安全模式

还有告警就重启

只有五个起来

只有五个起来

重新进行时间校准,然后重启节点ceph.target和mon ceph.target

九个全起来了

-------------------- 创建 CephFS 文件系统 MDS 接口 --------------------

//服务端操作

1)在管理节点创建 mds 服务

cd /etc/ceph

ceph-deploy mds create node01 node02 node03

2)查看各个节点的 mds 服务

ssh root@node01 systemctl status ceph-mds@node01

ssh root@node02 systemctl status ceph-mds@node02

ssh root@node03 systemctl status ceph-mds@node03

3)创建存储池,启用 ceph 文件系统

ceph 文件系统至少需要两个 rados 池,一个用于存储数据,一个用于存储元数据。此时数据池就类似于文件系统的共享目录。

ceph osd pool create cephfs_data 128 #创建数据Pool

ceph osd pool create cephfs_metadata 128 #创建元数据Pool

#创建 cephfs,命令格式:ceph fs new <FS_NAME> <CEPHFS_METADATA_NAME> <CEPHFS_DATA_NAME>

ceph fs new mycephfs cephfs_metadata cephfs_data #启用ceph,元数据Pool在前,数据Pool在后

ceph fs ls #查看cephfs

4)查看mds状态,一个up,其余两个待命,目前的工作的是node01上的mds服务

ceph -s

mds: mycephfs:1 {0=node01=up:active} 2 up:standby

ceph mds stat

mycephfs:1 {0=node01=up:active} 2 up:standby

5)创建用户

语法格式:ceph fs authorize <fs_name> client.<client_id> <path-in-cephfs> rw

#账户为 client.zhangsan,用户 name 为 zhangsan,zhangsan 对ceph文件系统的 / 根目录(注意不是操作系统的根目录)有读写权限

ceph fs authorize mycephfs client.zhangsan / rw | tee /etc/ceph/zhangsan.keyring

# 账户为 client.lisi,用户 name 为 lisi,lisi 对文件系统的 / 根目录只有读权限,对文件系统的根目录的子目录 /test 有读写权限

ceph fs authorize mycephfs client.lisi / r /test rw | tee /etc/ceph/lisi.keyring

//客户端操作

1)客户端要在 public 网络内

2)在客户端创建工作目录

mkdir /etc/ceph

3)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

scp ceph.conf zhangsan.keyring lisi.keyring root@client:/etc/ceph

4)在客户端安装 ceph 软件包

cd /opt

wget https://download.ceph.com/rpm-nautilus/el7/noarch/ceph-release-1-1.el7.noarch.rpm --no-check-certificate

rpm -ivh ceph-release-1-1.el7.noarch.rpm

yum install -y ceph

5)在客户端制作秘钥文件

cd /etc/ceph

ceph-authtool -n client.zhangsan -p zhangsan.keyring > zhangsan.key #把 zhangsan 用户的秘钥导出到 zhangsan.keyl

ceph-authtool -n client.lisi -p lisi.keyring > lisi.key #把 lisi 用户的秘钥导出到 lisi.key

6)客户端挂载

●方式一:基于内核

语法格式:

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secret=<秘钥>

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secretfile=<秘钥文件>

示例一:

mkdir -p /data/zhangsan

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/zhangsan -o name=zhangsan,secretfile=/etc/ceph/zhangsan.key

示例二:

mkdir -p /data/lisi

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/lisi -o name=lisi,secretfile=/etc/ceph/lisi.key

客户端在/data/zhangsan目录下面创建文件 a b c,实际是写在ceph中

在admin查看:

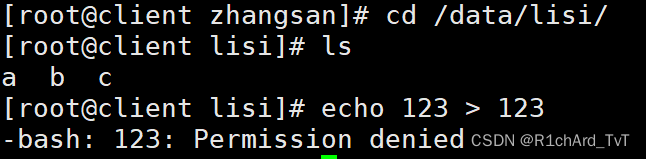

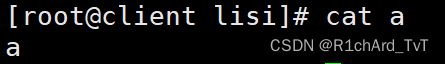

#验证用户权限

cd /data/lisi

echo 123 > 2.txt

-bash:2.txt:权限不够

echo 123 > test/2.txt

cat test/2.txt

123

lisi只可读

用zhangsan创建test目录,然后用lisi进行操作

原因在于:ceph fs authorize mycephfs client.zhangsan / rw | tee /etc/ceph/zhangsan.keyring

ceph fs authorize mycephfs client.lisi / r /test rw | tee /etc/ceph/lisi.keyring

账户为 client.zhangsan,用户 name 为 zhangsan,zhangsan 对ceph文件系统的 / 根目录(注意不是操作系统的根目录)有读写权限

账户为 client.lisi,用户 name 为 lisi,lisi 对文件系统的 / 根目录只有读权限,对文件系统的根目录的子目录 /test 有读写权限

示例三:

#停掉 node02 上的 mds 服务

ssh root@node02 "systemctl stop ceph-mds@node02"

ceph -s

#测试客户端的挂载点仍然是可以用的,如果停掉所有的 mds,客户端就不能用了

●方式二:基于 fuse 工具

1)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

scp ceph.client.admin.keyring root@client:/etc/ceph

2)在客户端安装 ceph-fuse

yum install -y ceph-fuse

3)客户端挂载

cd /data/aa

ceph-fuse -m node01:6789,node02:6789,node03:6789 /data/aa [-o nonempty] #挂载时,如果挂载点不为空会挂载失败,指定 -o nonempty 可以忽略

-------------------- 创建 Ceph 块存储系统 RBD 接口 --------------------

1、创建一个名为 rbd-demo 的专门用于 RBD 的存储池

ceph osd pool create rbd-demo 64 64

2、将存储池转换为 RBD 模式

ceph osd pool application enable rbd-demo rbd

3、初始化存储池

rbd pool init -p rbd-demo # -p 等同于 --pool

4、创建镜像

rbd create -p rbd-demo --image rbd-demo1.img --size 10G

可简写为:

rbd create rbd-demo/rbd-demo2.img --size 10G

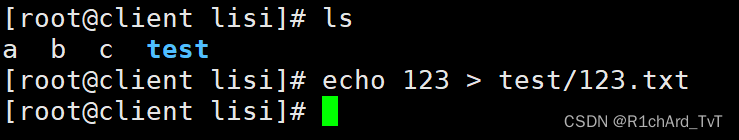

5、镜像管理

//查看存储池下存在哪些镜像

rbd ls -l -p rbd-demo

NAME SIZE PARENT FMT PROT LOCK

rbd-demo1.img 10 GiB 2 //查看镜像的详细信息

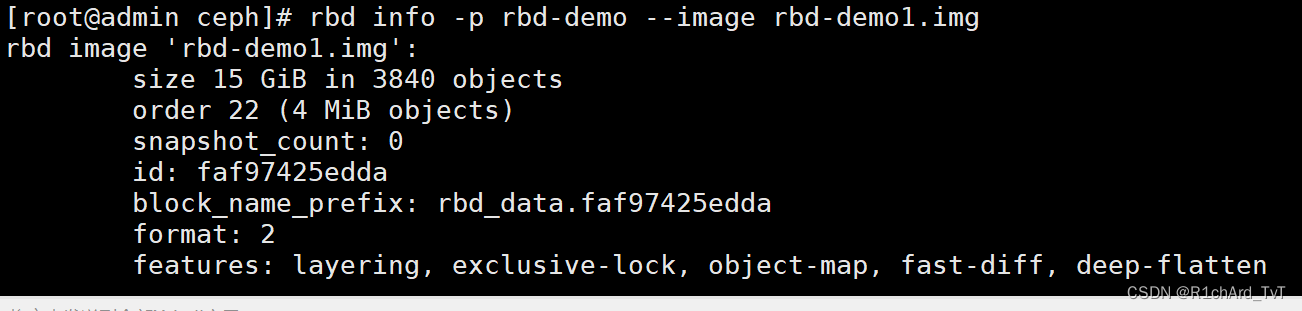

rbd info -p rbd-demo --image rbd-demo1.img

rbd image 'rbd-demo.img':size 10 GiB in 2560 objects #镜像的大小与被分割成的条带数order 22 (4 MiB objects) #条带的编号,有效范围是12到25,对应4K到32M,而22代表2的22次方,这样刚好是4Msnapshot_count: 0id: 5fc98fe1f304 #镜像的ID标识block_name_prefix: rbd_data.5fc98fe1f304 #名称前缀format: 2 #使用的镜像格式,默认为2features: layering, exclusive-lock, object-map, fast-diff, deep-flatten #当前镜像的功能特性op_features: #可选的功能特性flags:

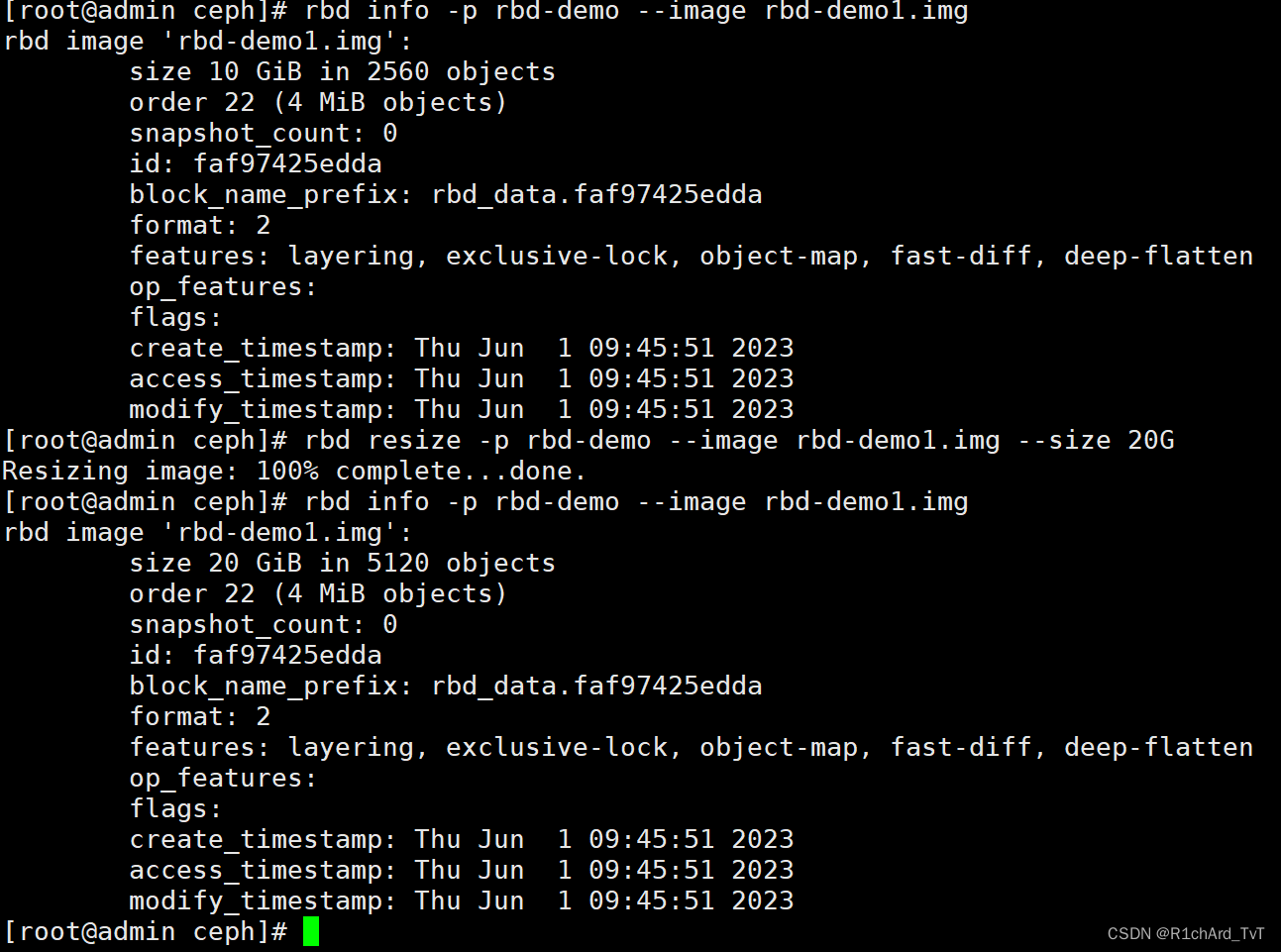

//修改镜像大小

rbd resize -p rbd-demo --image rbd-demo1.img --size 20G

rbd info -p rbd-demo --image rbd-demo1.img

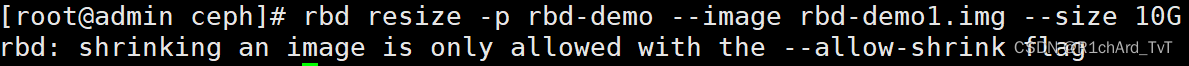

#使用 resize 调整镜像大小,一般建议只增不减,如果是减少的话需要加选项 --allow-shrink

rbd resize -p rbd-demo --image rbd-demo1.img --size 5G --allow-shrink

//删除镜像

#直接删除镜像

rbd rm -p rbd-demo --image rbd-demo2.img

rbd remove rbd-demo/rbd-demo2.img

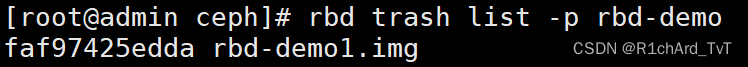

#推荐使用 trash 命令,这个命令删除是将镜像移动至回收站,如果想找回还可以恢复

rbd trash move rbd-demo/rbd-demo1.img

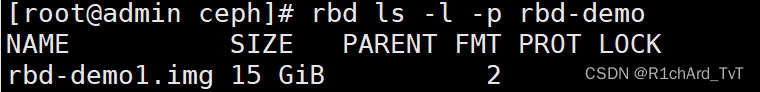

rbd ls -l -p rbd-demo

rbd trash list -p rbd-demo

#还原镜像

rbd trash restore rbd-demo/5fc98fe1f304

rbd ls -l -p rbd-demo

6、Linux客户端使用

客户端使用 RBD 有两种方式:

●通过内核模块KRBD将镜像映射为系统本地块设备,通常设置文件一般为:/dev/rbd*

●另一种是通过librbd接口,通常KVM虚拟机使用这种接口。

本例主要是使用Linux客户端挂载RBD镜像为本地磁盘使用。开始之前需要在所需要客户端节点上面安装ceph-common软件包,因为客户端需要调用rbd命令将RBD镜像映射到本地当作一块普通硬盘使用。并还需要把ceph.conf配置文件和授权keyring文件复制到对应的节点。

//在管理节点创建并授权一个用户可访问指定的 RBD 存储池

#示例,指定用户标识为client.osd-mount,对另对OSD有所有的权限,对Mon有只读的权限

ceph auth get-or-create client.osd-mount osd "allow * pool=rbd-demo" mon "allow r" > /etc/ceph/ceph.client.osd-mount.keyring

//修改RBD镜像特性,CentOS7默认情况下只支持layering和striping特性,需要将其它的特性关闭

rbd feature disable rbd-demo/rbd-demo1.img object-map,fast-diff,deep-flatten

//将用户的keyring文件和ceph.conf文件发送到客户端的/etc/ceph目录下

cd /etc/ceph

scp ceph.client.osd-mount.keyring ceph.conf root@client:/etc/ceph

//linux客户端操作

#安装 ceph-common 软件包

yum install -y ceph-common

#执行客户端映射

cd /etc/ceph

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

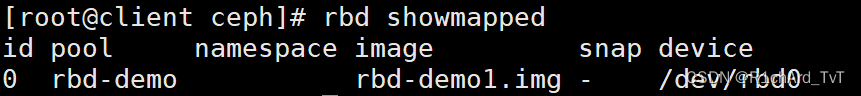

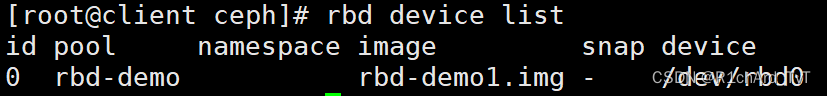

#查看映射

rbd showmapped

rbd device list

#断开映射

rbd unmap rbd-demo/rbd-demo1.img

#格式化并挂载

mkfs.xfs /dev/rbd0

mkdir -p /data/bb

mount /dev/rbd0 /data/bb

#在线扩容

在管理节点调整镜像的大小

rbd resize rbd-demo/rbd-demo1.img --size 30G

在客户端刷新设备文件

xfs_growfs /dev/rbd0 #刷新xfs文件系统容量

resize2fs /dev/rbd0 #刷新ext4类型文件系统容量

7、快照管理

对 rbd 镜像进行快照,可以保留镜像的状态历史,另外还可以利用快照的分层技术,通过将快照克隆为新的镜像使用。

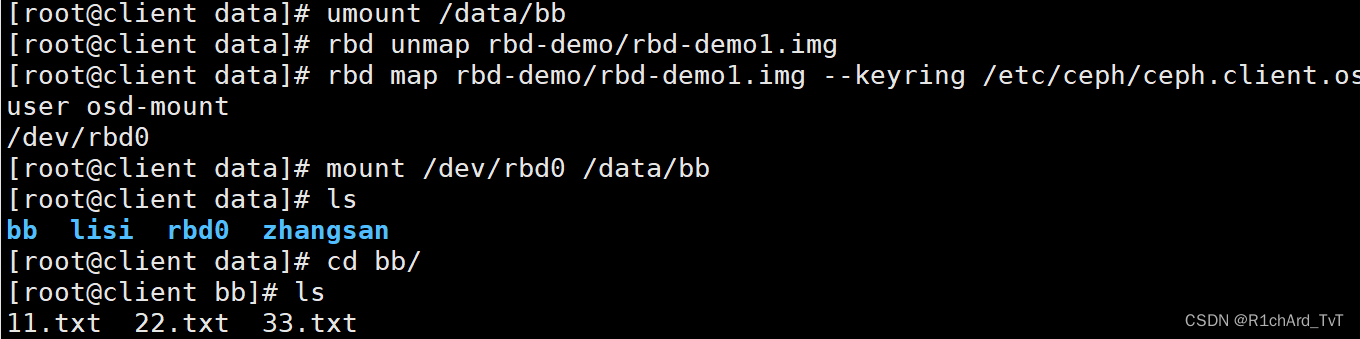

//在客户端写入文件

echo 1111 > /data/bb/11.txt

echo 2222 > /data/bb/22.txt

echo 3333 > /data/bb/33.txt

//在管理节点对镜像创建快照

rbd snap create --pool rbd-demo --image rbd-demo1.img --snap demo1_snap1

可简写为:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap1

//列出指定镜像所有快照

rbd snap list rbd-demo/rbd-demo1.img

#用json格式输出:

rbd snap list rbd-demo/rbd-demo1.img --format json --pretty-format

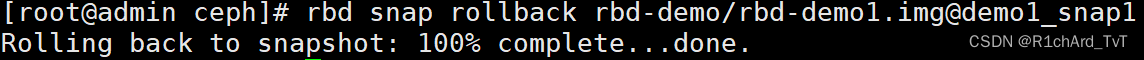

//回滚镜像到指定

在回滚快照之前,需要将镜像取消镜像的映射,然后再回滚。

#在客户端操作

rm -rf /data/bb/*

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

#在管理节点操作

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1

#在客户端重新映射并挂载

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

mount /dev/rbd0 /data/bb

ls /data/bb #发现数据还原回来了

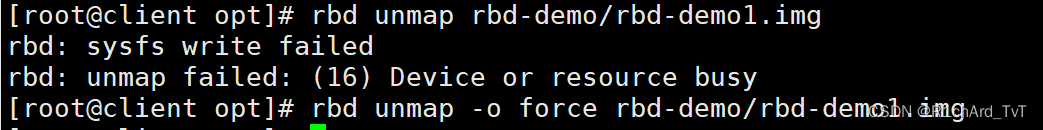

如果遇到设备繁忙,mount繁忙可以 -l 懒解挂,rbd unmap繁忙可以 -o force 取消映射

//限制镜像可创建快照数

rbd snap limit set rbd-demo/rbd-demo1.img --limit 3

#解除限制:

rbd snap limit clear rbd-demo/rbd-demo1.img

//删除快照

#删除指定快照:

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap1

#删除所有快照:

rbd snap purge rbd-demo/rbd-demo1.img

//快照分层

快照分层支持用快照的克隆生成新镜像,这种镜像与直接创建的镜像几乎完全一样,支持镜像的所有操作。唯一不同的是克隆镜像引用了一个只读的上游快照,而且此快照必须要设置保护模式。

#快照克隆

1)将上游快照设置为保护模式:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap666

rbd snap protect rbd-demo/rbd-demo1.img@demo1_snap666

2)克隆快照为新的镜像

rbd clone rbd-demo/rbd-demo1.img@demo1_snap666 --dest rbd-demo/rbd-demo666.img

rbd ls -p rbd-demo

3)命令查看克隆完成后快照的子镜像

rbd children rbd-demo/rbd-demo1.img@demo1_snap666

//快照展平

通常情况下通过快照克隆而得到的镜像会保留对父快照的引用,这时候不可以删除该父快照,否则会有影响。

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

#报错 snapshot 'demo1_snap666' is protected from removal.

如果要删除快照但想保留其子镜像,必须先展平其子镜像,展平的时间取决于镜像的大小

1) 展平子镜像

rbd flatten rbd-demo/rbd-demo666.img

2)取消快照保护

rbd snap unprotect rbd-demo/rbd-demo1.img@demo1_snap666

3)删除快照

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

rbd ls -l -p rbd-demo #在删除掉快照后,查看子镜像依然存在

8、镜像的导出导入

//导出镜像

rbd export rbd-demo/rbd-demo1.img /opt/rbd-demo1.img

//导入镜像

#卸载客户端挂载,并取消映射

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

#清除镜像下的所有快照,并删除镜像

rbd snap purge rbd-demo/rbd-demo1.img

rbd rm rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

#导入镜像

rbd import /opt/rbd-demo1.img rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

-------------------- 创建 Ceph 对象存储系统 RGW 接口 --------------------

1、对象存储概念

对象存储(object storage)是非结构数据的存储方法,对象存储中每一条数据都作为单独的对象存储,拥有唯一的地址来识别数据对象,通常用于云计算环境中。

不同于其他数据存储方法,基于对象的存储不使用目录树。

虽然在设计与实现上有所区别,但大多数对象存储系统对外呈现的核心资源类型大同小异。从客户端的角度来看,分为以下几个逻辑单位:

●Amazon S3:

提供了

1、用户(User)

2、存储桶(Bucket)

3、对象(Object)

三者的关系是:

1、User将Object存储到系统上的Bucket

2、存储桶属于某个用户并可以容纳对象,一个存储桶用于存储多个对象

3、同一个用户可以拥有多个存储桶,不同用户允许使用相同名称的Bucket,因此User名称即可做为Bucket的名称空间

●OpenStack Swift:

提供了user、container和object分别对应于用户、存储桶和对象,不过它还额外为user提供了父级组件account,用于表示一个项目或用户,因此一个account中可以包含一到多个user,它们可共享使用同一组container,并为container提供名称空间

●RadosGW:

提供了user、subuser、bucket和object,其中的user对应于S3的user,而subuser则对应于Swift的user,不过user和subuser都不支持为bucket提供名称空间,因此不同用户的存储桶不允许同名;不过,自jewel版本起,RadosGW引入了tenant(租户)用于为user和bucket提供名称空间,但他是个可选组件

从上可以看出大多数对象存储的核心资源类型大同小异,如 Amazon S3、OpenStack Swift 与 RadosGw。其中 S3 与 Swift 互不兼容,RadosGw 为了兼容 S3 与 Swift, Ceph 在 RadosGW 集群的基础上提供了 RGW(RadosGateway)数据抽象层和管理层,它可以原生兼容 S3 和 Swift 的 API。

S3和Swift它们可基于http或https完成数据交换,由RadosGW内建的Civetweb提供服务,它还可以支持代理服务器包括nginx、haproxy等以代理的形式接收用户请求,再转发至RadosGW进程。

RGW 的功能依赖于对象网关守护进程实现,负责向客户端提供 REST API 接口。出于冗余负载均衡的需求,一个 Ceph 集群上通常不止一个 RadosGW 守护进程。

2、创建 RGW 接口

如果需要使用到类似 S3 或者 Swift 接口时候才需要部署/创建 RadosGW 接口,RadosGW 通常作为对象存储(Object Storage)使用,类于阿里云OSS。

//在管理节点创建一个 RGW 守护进程(生产环境下此进程一般需要高可用,后续介绍)

cd /etc/ceph

ceph-deploy rgw create node01

ceph -s

services:

mon: 3 daemons, quorum node01,node02,node03 (age 3h)

mgr: node01(active, since 12h), standbys: node02

mds: mycephfs:1 {0=node02=up:active} 2 up:standby

osd: 6 osds: 6 up (since 12h), 6 in (since 25h)

rgw: 1 daemon active (node01)

#创建成功后默认情况下会自动创建一系列用于 RGW 的存储池

ceph osd pool ls

rgw.root

default.rgw.control #控制器信息

default.rgw.meta #记录元数据

default.rgw.log #日志信息

default.rgw.buckets.index #为 rgw 的 bucket 信息,写入数据后生成

default.rgw.buckets.data #是实际存储的数据信息,写入数据后生成

#默认情况下 RGW 监听 7480 号端口

ssh root@node01 netstat -lntp | grep 7480

curl node01:7480

<?xml version="1.0" encoding="UTF-8"?><ListAllMyBucketsResult xmlns="http://s3.amazonaws.com/doc/2006-03-01/">

<ListAllMyBucketsResult xmlns="http://s3.amazonaws.com/doc/2006-03-01/">

<Owner>

<ID>anonymous</ID>

<DisplayName/>

</Owner>

<Buckets/>

</ListAllMyBucketsResult>

//开启 http+https ,更改监听端口

RadosGW 守护进程内部由 Civetweb 实现,通过对 Civetweb 的配置可以完成对 RadosGW 的基本管理。

#要在 Civetweb 上启用SSL,首先需要一个证书,在 rgw 节点生成证书

1)生成CA证书私钥:

openssl genrsa -out civetweb.key 2048

2)生成CA证书公钥:

openssl req -new -x509 -key civetweb.key -out civetweb.crt -days 3650 -subj "/CN=192.168.80.11"

#3、将生成的证书合并为pem

cat civetweb.key civetweb.crt > /etc/ceph/civetweb.pem

#更改监听端口

Civetweb 默认监听在 7480 端口并提供 http 协议,如果需要修改配置需要在管理节点编辑 ceph.conf 配置文件

cd /etc/ceph

vim ceph.conf

......

[client.rgw.node01]

rgw_host = node01

rgw_frontends = "civetweb port=80+443s ssl_certificate=/etc/ceph/civetweb.pem num_threads=500 request_timeout_ms=60000"

------------------------------------------------------------

●rgw_host:对应的RadosGW名称或者IP地址

●rgw_frontends:这里配置监听的端口,是否使用https,以及一些常用配置:

•port:如果是https端口,需要在端口后面加一个s。

•ssl_certificate:指定证书的路径。

•num_threads:最大并发连接数,默认为50,根据需求调整,通常在生产集群环境中此值应该更大

•request_timeout_ms:发送与接收超时时长,以ms为单位,默认为30000

•access_log_file:访问日志路径,默认为空

•error_log_file:错误日志路径,默认为空

------------------------------------------------------------

#修改完 ceph.conf 配置文件后需要重启对应的 RadosGW 服务,再推送配置文件

ceph-deploy --overwrite-conf config push node0{1..3}

ssh root@node01 systemctl restart ceph-radosgw.target

#在 rgw 节点上查看端口

netstat -lntp | grep -w 80

netstat -lntp | grep 443

#在客户端访问验证

curl http://192.168.80.11:80

curl -k https://192.168.80.11:443

//创建 RadosGW 账户

在管理节点使用 radosgw-admin 命令创建 RadosGW 账户

radosgw-admin user create --uid="rgwuser" --display-name="rgw test user"

......

"keys": [

{

"user": "rgwuser",

"access_key": "ER0SCVRJWNRIKFGQD31H",

"secret_key": "YKYjk7L4FfAu8GHeQarIlXodjtj1BXVaxpKv2Nna"

}

],

#创建成功后将输出用户的基本信息,其中最重要的两项信息为 access_key 和 secret_key 。用户创建成后功,如果忘记用户信息可以使用下面的命令查看

radosgw-admin user info --uid="rgwuser"

//S3 接口访问测试

1)在客户端安装 python3、python3-pip

yum install -y python3 python3-pip

python3 -V

Python 3.6.8

pip3 -V

pip 9.0.3 from /usr/lib/python3.6/site-packages (python 3.6)

2)安装 boto 模块,用于测试连接 S3

pip3 install boto

3)测试访问 S3 接口

echo 123123 > /opt/123.txt

vim test.py

#coding:utf-8

import ssl

import boto.s3.connection

from boto.s3.key import Key

try:

_create_unverified_https_context = ssl._create_unverified_context

except AttributeError:

pass

else:

ssl._create_default_https_context = _create_unverified_https_context

#test用户的keys信息

access_key = "ER0SCVRJWNRIKFGQD31H" #输入 RadosGW 账户的 access_key

secret_key = "YKYjk7L4FfAu8GHeQarIlXodjtj1BXVaxpKv2Nna" #输入 RadosGW 账户的 secret_key

#rgw的ip与端口

host = "192.168.80.11" #输入 RGW 接口的 public 网络地址

#如果使用443端口,下述链接应设置is_secure=True

port = 443

#如果使用80端口,下述链接应设置is_secure=False

#port = 80

conn = boto.connect_s3(

aws_access_key_id=access_key,

aws_secret_access_key=secret_key,

host=host,

port=port,

is_secure=True,

validate_certs=False,

calling_format=boto.s3.connection.OrdinaryCallingFormat()

)

#一:创建存储桶

#conn.create_bucket(bucket_name='bucket01')

#conn.create_bucket(bucket_name='bucket02')

#二:判断是否存在,不存在返回None

exists = conn.lookup('bucket01')

print(exists)

#exists = conn.lookup('bucket02')

#print(exists)

#三:获得一个存储桶

#bucket1 = conn.get_bucket('bucket01')

#bucket2 = conn.get_bucket('bucket02')

#四:查看一个bucket下的文件

#print(list(bucket1.list()))

#print(list(bucket2.list()))

#五:向s3上存储数据,数据来源可以是file、stream、or string

#5.1、上传文件

#bucket1 = conn.get_bucket('bucket01')

# name的值是数据的key

#key = Key(bucket=bucket1, name='myfile')

#key.set_contents_from_filename('/opt/123.txt')

# 读取 s3 中文件的内容,返回 string 即文件 123.txt 的内容

#print(key.get_contents_as_string())

#5.2、上传字符串

#如果之前已经获取过对象,此处不需要重复获取

bucket2 = conn.get_bucket('bucket02')

key = Key(bucket=bucket2, name='mystr')

key.set_contents_from_string('hello world')

print(key.get_contents_as_string())

#六:删除一个存储桶,在删除存储桶本身时必须删除该存储桶内的所有key

bucket1 = conn.get_bucket('bucket01')

for key in bucket1:

key.delete()

bucket1.delete()

4)按照以上步骤执行 python 脚本测试

python3 test.py

-------------------- OSD 故障模拟与恢复 --------------------

1、模拟 OSD 故障

如果 ceph 集群有上千个 osd,每天坏 2~3 个太正常了,我们可以模拟 down 掉一个 osd

#如果 osd 守护进程正常运行,down 的 osd 会很快自恢复正常,所以需要先关闭守护进程

ssh root@node01 systemctl stop ceph-osd@0

#down 掉 osd

ceph osd down 0

ceph osd tree

2、将坏掉的 osd 踢出集群

//方法一:

#将 osd.0 移出集群,集群会开始自动同步数据

ceph osd out osd.0

#将 osd.0 移除 crushmap

ceph osd crush remove osd.0

#删除守护进程对应的账户信息

ceph auth rm osd.0

ceph auth list

#删掉 osd.0

ceph osd rm osd.0

ceph osd stat

ceph -s

//方法二:

ceph osd out osd.0

#使用综合步骤,删除配置文件中针对坏掉的 osd 的配置

ceph osd purge osd.0 --yes-i-really-mean-it

3、把原来坏掉的 osd 修复后重新加入集群

#在 osd 节点创建 osd,无需指定名,会按序号自动生成

cd /etc/ceph

ceph osd create

#创建账户

ceph-authtool --create-keyring /etc/ceph/ceph.osd.0.keyring --gen-key -n osd.0 --cap mon 'allow profile osd' --cap mgr 'allow profile osd' --cap osd 'allow *'

#导入新的账户秘钥

ceph auth import -i /etc/ceph/ceph.osd.0.keyring

ceph auth list

#更新对应的 osd 文件夹中的密钥环文件

ceph auth get-or-create osd.0 -o /var/lib/ceph/osd/ceph-0/keyring

#加入 crushmap

ceph osd crush add osd.0 1.000 host=node01 #1.000 代表权重

#加入集群

ceph osd in osd.0

ceph osd tree

#重启 osd 守护进程

systemctl restart ceph-osd@0

ceph osd tree #稍等片刻后 osd 状态为 up

//如果重启失败

报错:

Job for ceph-osd@0.service failed because start of the service was attempted too often. See "systemctl status ceph-osd@0.service" and "journalctl -xe" for details.

To force a start use "systemctl reset-failed ceph-osd@0.service" followed by "systemctl start ceph-osd@0.service" again.

#运行

systemctl reset-failed ceph-osd@0.service && systemctl restart ceph-osd@0.service

相关文章:

Ceph应用

//存储类型 块存储 一对一,只能被一个主机挂载使用,数据以块为单位进行存储,典型代表: 硬盘 文件存储 一对多,能被多个主机同时挂载使用,数据以文件的形式存储的(元数据和实际数据是分开存储的),并且有…...

Oxford online English-Chair a Meeting 05/29

Part1-Welcoming attendees and starting the meeting Getting people’s attention If I could have your attention, please. Could I have your attention, please? Good afternoon, everyone. -> Good afternoon, everyone, could I have your attention, please?…...

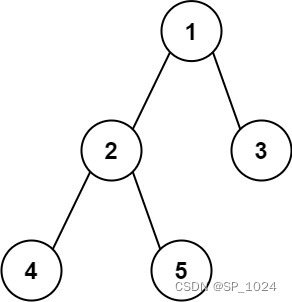

LeetCode: 二叉树的直径(java)

二叉树的直径 leetcode 543题。原题链接题目描述解题代码二叉树专题 leetcode 543题。原题链接 543题:二叉树的直径 题目描述 给你一棵二叉树的根节点,返回该树的 直径 。 二叉树的 直径 是指树中任意两个节点之间最长路径的 长度 。这条路径可能经过也…...

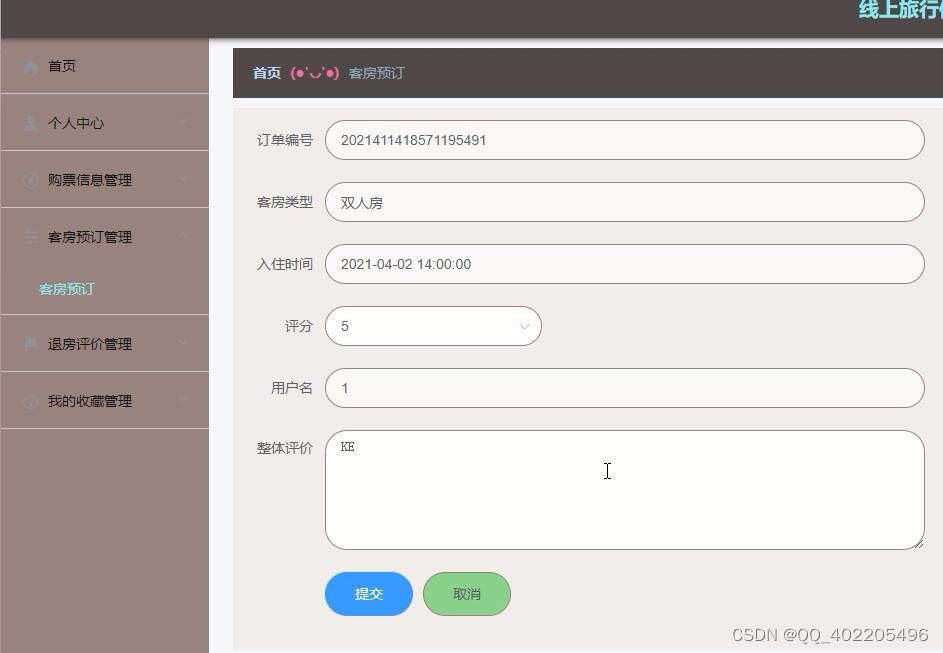

springboot+vue+java旅行旅游景点酒店预订出行订票系统eaog5

线上旅行信息管理系统要求实现以下功能: a.景点管理,展示景点的基础信息,介绍等信息。 b.酒店管理,展示酒店的基础信息,介绍等信息。 c.评价管理,可以查看景点或酒店的相关评价信息,客户消费完,…...

Linux :: 【基础指令篇 :: 用户管理:(2)】::设置用户密码(及本地Xshell 登录云服务器操作演示) :: passwd

前言:本篇是 Linux 基本操作篇章的内容! 笔者使用的环境是基于腾讯云服务器:CentOS 7.6 64bit。 学习集: C 入门到入土!!!学习合集Linux 从命令到网络再到内核!学习合集 目录索引&am…...

img[:, :, ::-1] 通俗理解

👨💻个人简介: 深度学习图像领域工作者 🎉工作总结链接:https://blog.csdn.net/qq_28949847/article/details/128552785 链接中主要是个人工作的总结,每个链接都是一些常用demo,…...

基于springboot+vue+elementui的健身房会员管理系统的

为了帮助用户更好的了解和理解程序的开发流程与相关内容,本文将通过六个章节进行内容阐述。 第一章:描述了程序的开发背景,程序运用于现实生活的目的与意义,以及程序文档的结构安排信息; 第二章:描述了程序…...

在酒店房间中的数据库索引

如果你经常去酒店,你会看到一块类似下面的标牌,指引你到达房间。这能够帮助你方便快速地找到房间,特别是当酒店拥有许多房间时。 以一个有9层的酒店为例。你的房间号是917。第一步是找到你的房间在哪一层,通常第一个数字表示楼层…...

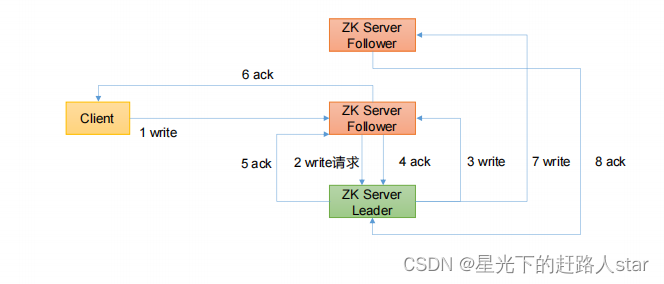

Zookeeper学习---2、客户端API操作、客户端向服务端写数据流程

1、客户端API操作 1.1 IDEA 环境搭建 前提:保证 hadoop102、hadoop103、hadoop104 服务器上 Zookeeper 集群服务端启动。 1、创建一个工程:Zookeeper 2、添加pom文件 <?xml version"1.0" encoding"UTF-8"?> <project …...

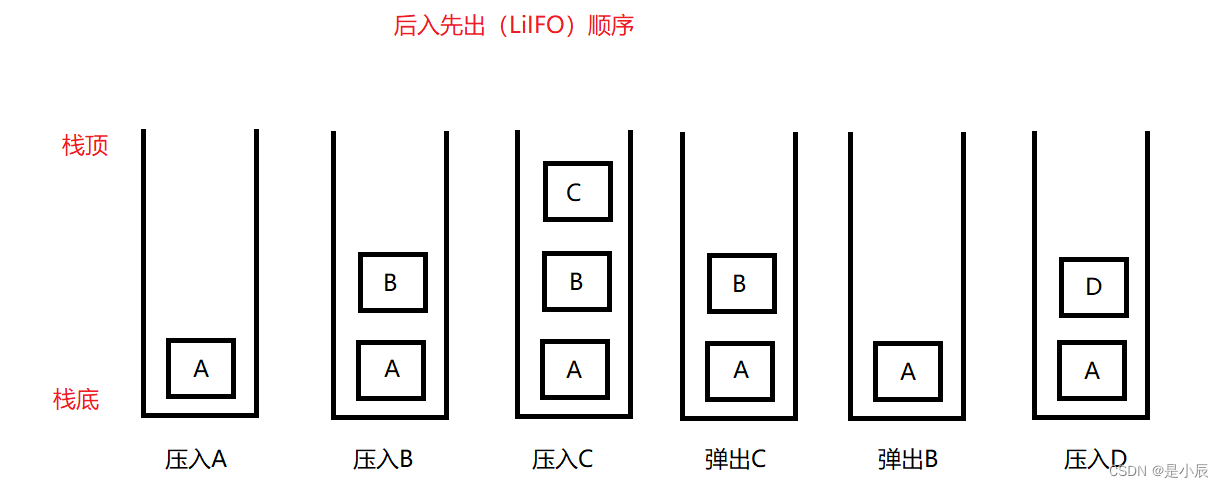

Stack 栈的实现与应用

目录 1. 概念 2. 常用的栈的方法 2.1 方法 2.2 代码 3. 自己实现栈 3.1 构造MyStack 3.2 push() 3.3 ensureCapacity() 3.4 pop() 3.5 peek() 3.6 empty() 3.7 szie() 4. 栈的应用 1. 概念 栈(Stack)是一种数据结构&…...

CSDN中如何获得铁粉(用心篇)

✅作者简介:2022年博客新星 第八。热爱国学的Java后端开发者,修心和技术同步精进。 🍎个人主页:Java Fans的博客 🍊个人信条:不迁怒,不贰过。小知识,大智慧。 💞当前专栏…...

es 三 安装 es 安装kibana

目录 安装7.3.0 版本 下载地址 一个比一个快 页面测试访问 安装kibana 下载 Config/kibana.yml 配置修改开启中文 页面访问 安装7.3.0 版本 下载地址 一个比一个快 Index of /elasticsearch/ 下载中心 - Elastic 中文社区 下载中心 - Elastic 中文社区 官网下载 开箱…...

牛客HJ43迷宫问题 - 创建智能体通过策略自己找路

文章目录 问题描述思路代码C 问题描述 描述 定义一个二维数组 N*M ,如 5 5 数组下所示: int maze[5][5] { 0, 1, 0, 0, 0, 0, 1, 1, 1, 0, 0, 0, 0, 0, 0, 0, 1, 1, 1, 0, 0, 0, 0, 1, 0, }; 它表示一个迷宫,其中的1表示墙壁࿰…...

测试报告模板一

XX测试报告 文档作者: 编写日期: 项目经理: 批准日期: 文档修改纪录表 日期 制修人 修改内容描述 1. 测试项目描述 1.1 测试描述 项目名称...

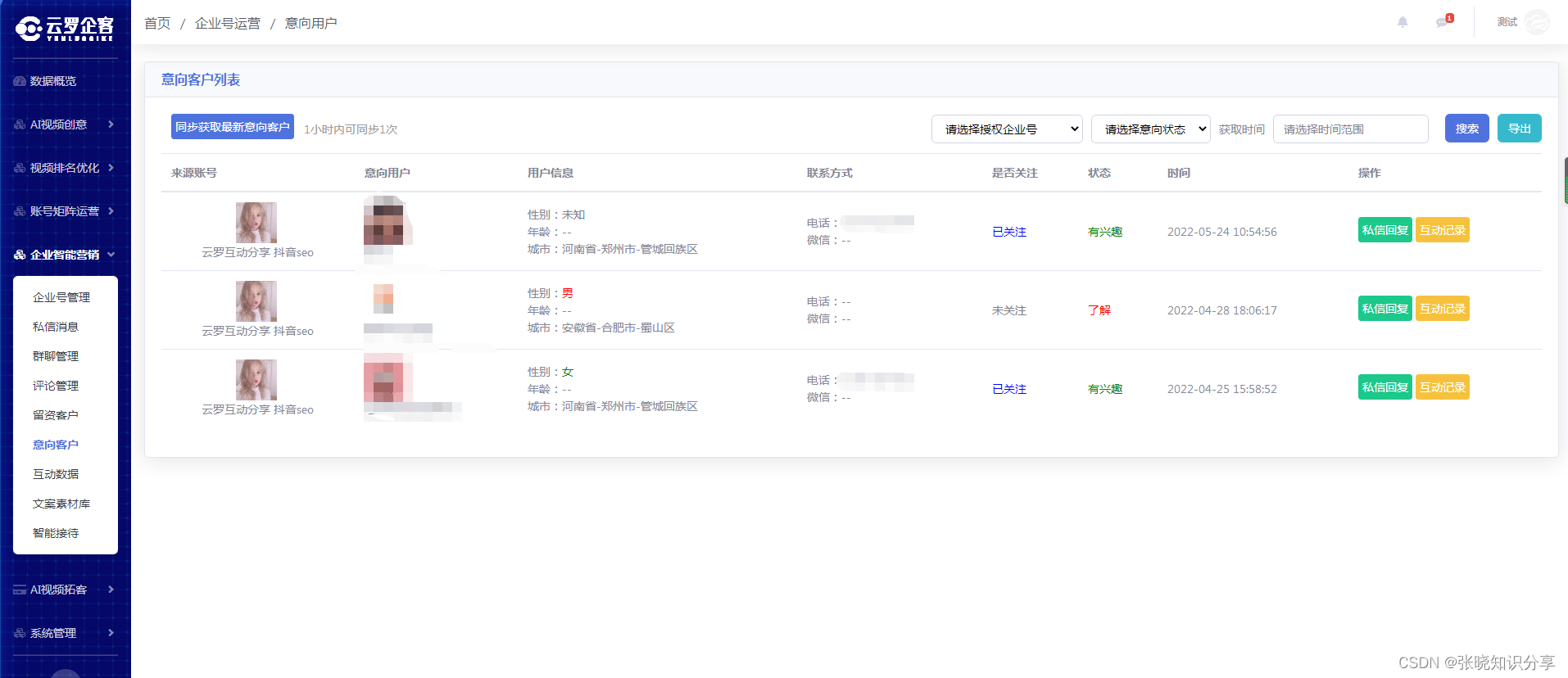

抖音账号矩阵系统源码/技术开发搭建私有化部署开源

抖音SEO矩阵系统是基于抖音平台的搜索引擎优化技术的一种系统,其主要作用是通过一系列的技术手段,提高抖音视频的曝光和排名,使其获得更多的流量和粉丝。在本文中,我们将介绍抖音SEO矩阵系统的开发技术,包括系统设计、…...

OpenSSL加密解密文件

OpenSSL是一个开源的用以实现SSL协议的产品,它主要包括了三个部分:密码算法库、应用程序、SSL协议库。Openssl实现了SSL协议所需要的大多数算法。 下面介绍使用Openssl进行文件的对称加密操作。 一、Openssl支持的加密算法有: -aes-128-cbc…...

PAT A1070 Mooncake

1070 Mooncake 分数 25 作者 CHEN, Yue 单位 浙江大学 Mooncake is a Chinese bakery product traditionally eaten during the Mid-Autumn Festival. Many types of fillings and crusts can be found in traditional mooncakes according to the regions culture. Now gi…...

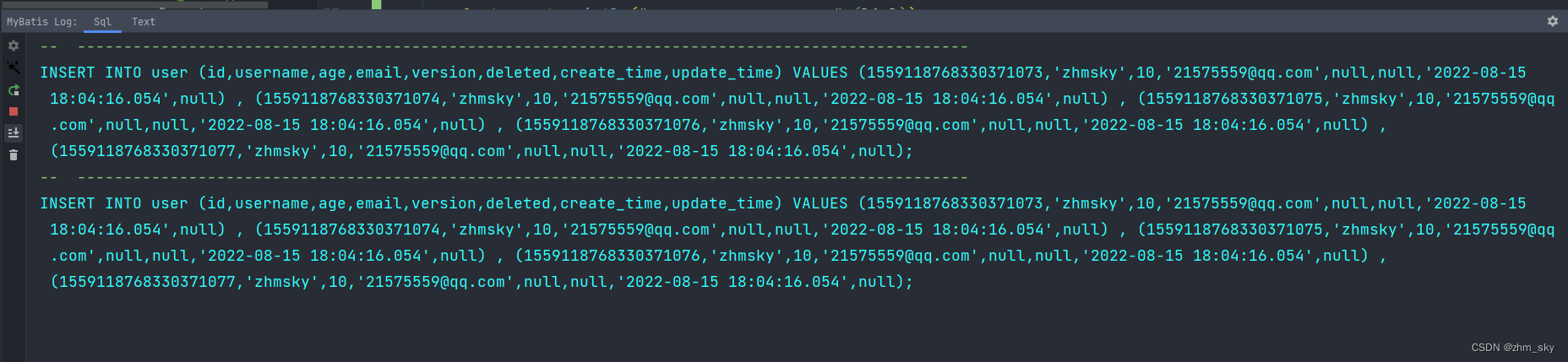

MyBatis- plus

实战总结 1.批量插入性能 1.批量插入性能差的原因 使用saveBatch()方法时, MySQL JDBC驱动在默认情况下会无视executeBatch()语句,把我们期望批量执行的一组sql语句拆散,一条一条地发给MySQL数据库,批量插入实际上是单条插入&a…...

Java --- 期末复习卷

一、单选题 1.所有Java应用程序主类必须有一个名叫( )的方法。[ ] A.method B.main() C.java() D.hello 2.编写并保存了一个Java程序文件之后,( )它。[ …...

)

File类与IO流相关面试知识(一)

一.java.io.File类 作用:它的作用是用来表示某个文件或文件夹(文件夹又称为目录) 如何用File类的对象表示一个文件或目录的呢? API文档中描述:文件和目录路径名的抽象表示形式 解释:如果要表示一个文件…...

企业团队如何利用Taotoken CLI工具统一配置开发环境与API密钥

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 企业团队如何利用Taotoken CLI工具统一配置开发环境与API密钥 在团队协作开发中,一个常见的问题是API密钥的管理与开发…...

2026年一键生成论文工具实测精选:5款神器从构思到提交全流程护航

写论文的焦虑,是每个科研人和学生都无法回避的日常。选题无从下手,文献检索耗时费力,格式排版反复调整,查重降重更是让人抓耳挠腮。到了2026年,AI工具早已不再只是“敲字机器”,而是进化成了能陪你从构思到…...

:麦克风/剪贴板/位置数据采集路径全曝光,3步彻底锁死敏感权限)

ChatGPT移动端隐私红线报告(2024Q2):麦克风/剪贴板/位置数据采集路径全曝光,3步彻底锁死敏感权限

更多请点击: https://intelliparadigm.com 第一章:ChatGPT移动端隐私红线报告(2024Q2)核心发现与风险定级 高危数据外泄通道实证 本季度对iOS与Android平台主流ChatGPT客户端(含官方App v6.12.1及第三方封装SDK集成应…...

AI检测率太高论文过不了?这4个降AI率平台让你2026年顺利毕业!

降AI率工具已成为学术写作中不可或缺的辅助手段。随着高校对AI检测标准的不断升级,越来越多学生开始关注专业、高效的降AIGC平台。基于知网、维普、Turnitin等权威检测系统的数据支持,结合全国多所高校师生的实际使用反馈,以下几款平台在降低…...

基于个性化机器学习与智能穿戴数据的痴呆症行为预测系统

1. 项目概述:当智能手表学会“预见”痴呆症患者的情绪风暴在痴呆症照护的漫长征途中,照护者最棘手的挑战往往不是记忆的衰退,而是那些突如其来、难以捉摸的行为与心理症状。想象一下,你照顾的长辈平时温和安静,却在某个…...

微信小程序数据可视化:为什么ECharts组件是你的最佳选择?

微信小程序数据可视化:为什么ECharts组件是你的最佳选择? 【免费下载链接】echarts-for-weixin 基于 Apache ECharts 的微信小程序图表库 项目地址: https://gitcode.com/gh_mirrors/ec/echarts-for-weixin 当我们开发微信小程序时,数…...

JMeter接口测试进阶:从功能验证到生产级性能工程

1. 这不是“点点点就能跑通”的接口测试,而是你真正能扛住压测的底气很多人第一次打开 JMeter,以为它只是个“图形化 Postman”——填 URL、选方法、点执行,看到绿色 Success 就觉得“接口测完了”。我带过三届测试团队,几乎每届都…...

027、原理图绘制进阶:总线、网络标号、层次图

027 原理图绘制进阶:总线、网络标号、层次图 从一块烧掉的板子说起 去年接手一个同事离职留下的项目,一块四层板,MCU挂了三片ADC、两片DAC、一个FPGA,外加一堆传感器。原理图打开那一刻,我差点把咖啡喷屏幕上——整张图就一张Sheet,密密麻麻的飞线像蜘蛛网,网络标号全…...

如何快速实现Windows硬件ID伪装:EASY-HWID-SPOOFER终极指南

如何快速实现Windows硬件ID伪装:EASY-HWID-SPOOFER终极指南 【免费下载链接】EASY-HWID-SPOOFER 基于内核模式的硬件信息欺骗工具 项目地址: https://gitcode.com/gh_mirrors/ea/EASY-HWID-SPOOFER 在当今数字隐私日益重要的时代,硬件指纹追踪已成…...

Node.js 服务如何无缝接入 Taotoken 并管理多个模型的 API 调用

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 Node.js 服务如何无缝接入 Taotoken 并管理多个模型的 API 调用 在构建现代 Node.js 后端服务时,集成多种大语言模型能…...