Mac 部署Ollama + OpenWebUI完全指南

文章目录

- 💻 环境说明

- 🛠️ Ollama安装配置

- 1. 安装[Ollama](https://github.com/ollama/ollama)

- 2. 启动Ollama

- 3. 模型存储位置

- 4. 配置 Ollama

- 🌐 OpenWebUI部署

- 1. 安装Docker

- 2. 部署[OpenWebUI](https://www.openwebui.com/)(可视化大模型对话界面)

- 🔒 离线部署方案

- ⚡ 性能优化建议

- ❓ 常见问题

- 🎉 结语

想拥有一个完全属于自己的AI助手,还不依赖互联网?本教程带你从零开始搭建本地AI环境!(Apple Silicon架构)

💻 环境说明

| 配置项 | Mac | Windows |

|---|---|---|

| 操作系统 | macOS Sonoma | Windows 10/11 |

| CPU | M4 | 12核或以上 |

| 内存 | 16GB | 32GB或以上 |

| 硬盘空间 | 20GB | 20GB或以上 |

🛠️ Ollama安装配置

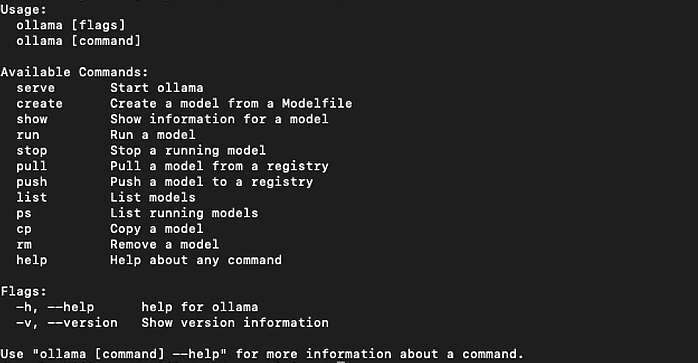

1. 安装Ollama

# 使用Homebrew安装

brew install ollama# 或直接下载安装包

curl https://ollama.ai/download/Ollama-darwin.zip -o Ollama.zip

unzip Ollama.zip# 输入`ollama`或 `ollama -v`验证安装

ollama

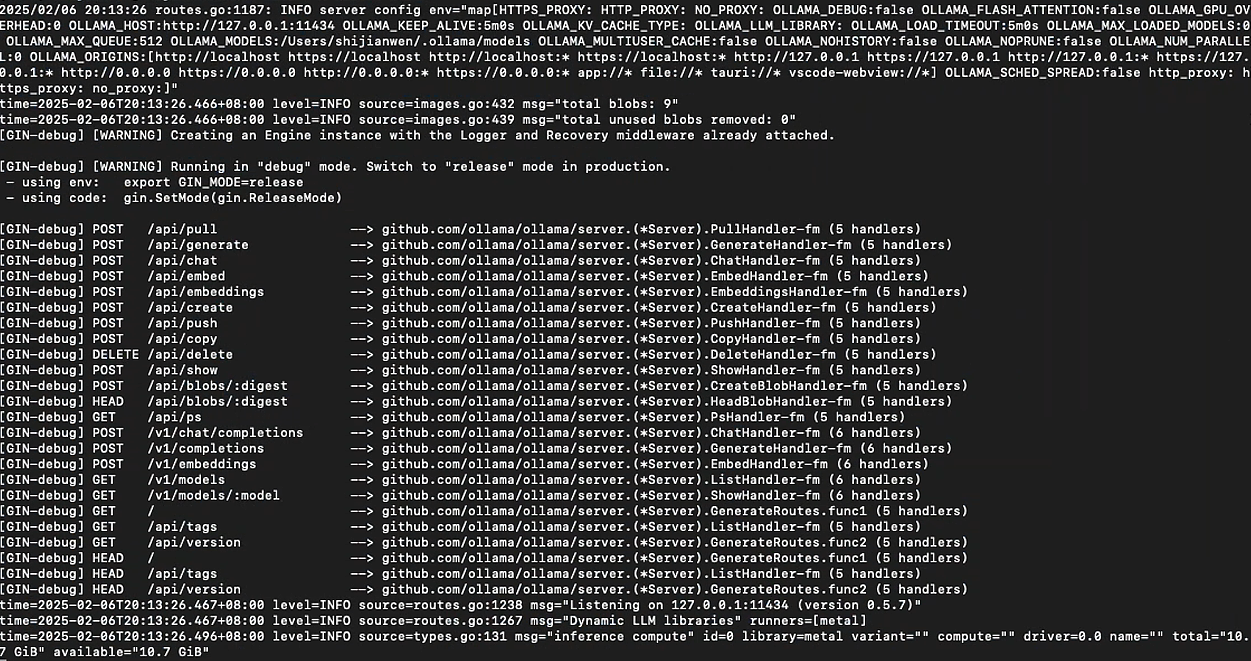

2. 启动Ollama

# 启动Ollama服务

ollama serve

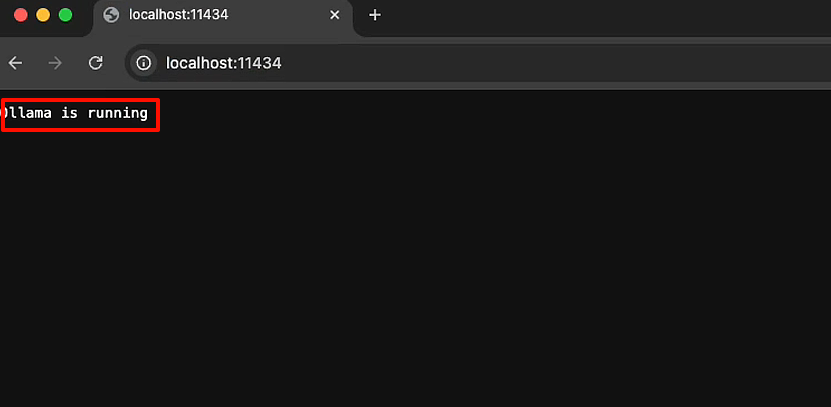

# 或点击浏览器访问:http://localhost:11434

显示Ollama is running代表已经运行起来了!

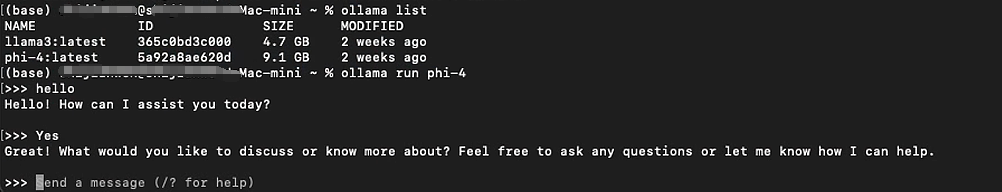

# 下载Llama3 8B模型

ollama run llama3:8b # 建议先尝试小模型

💡 小贴士:你应该至少有 8 GB 的 RAM 来运行 7B 模型,16 GB 的 RAM 来运行 13B 模型,以及 32 GB 的 RAM 来运行 33B 模型。

3. 模型存储位置

Mac下,Ollama的默认存储位置:

- 模型文件:

~/.ollama/models - 配置文件:

~/Library/Application Support/Ollama

Windows下,Ollama的默认存储位置:

- 程序目录:

C:\Users\<用户名>\AppData\Local\Programs\Ollama - 模型目录:

C:\Users\<用户名>\.ollamamodels - 配置文件:

C:\Users\<用户名>\AppData\Local\Ollama

💡 小贴士:建议通过环境变量OLLAMA_MODELS自定义模型存储路径,避免占用系统盘空间。

4. 配置 Ollama

Ollama 提供了多种环境变量以供配置:

- OLLAMA_DEBUG:是否开启调试模式,默认为 false。

- OLLAMA_FLASH_ATTENTION:是否闪烁注意力,默认为 true。

- OLLAMA_HOST:Ollama 服务器的主机地址,默认为空。

- OLLAMA_KEEP_ALIVE:保持连接的时间,默认为 5m。

- OLLAMA_LLM_LIBRARY:LLM 库,默认为空。

- OLLAMA_MAX_LOADED_MODELS:最大加载模型数,默认为 1。

- OLLAMA_MAX_QUEUE:最大队列数,默认为空。

- OLLAMA_MAX_VRAM:最大虚拟内存,默认为空。

- OLLAMA_MODELS:模型目录,默认为空。

- OLLAMA_NOHISTORY:是否保存历史记录,默认为 false。

- OLLAMA_NOPRUNE:是否启用剪枝,默认为 false。

- OLLAMA_NUM_PARALLEL:并行数,默认为 1。

- OLLAMA_ORIGINS:允许的来源,默认为空。

- OLLAMA_RUNNERS_DIR:运行器目录,默认为空。

- OLLAMA_SCHED_SPREAD:调度分布,默认为空。

- OLLAMA_TMPDIR:临时文件目录,默认为空。

- OLLAMA_DEBUG:是否开启调试模式,默认为 false。

- OLLAMA_FLASH_ATTENTION:是否闪烁注意力,默认为 true。

- OLLAMA_HOST:Ollama 服务器的主机地址,默认为空。

- OLLAMA_KEEP_ALIVE:保持连接的时间,默认为 5m。

- OLLAMA_LLM_LIBRARY:LLM 库,默认为空。

- OLLAMA_MAX_LOADED_MODELS:最大加载模型数,默认为 1。

- OLLAMA_MAX_QUEUE:最大队列数,默认为空。

- OLLAMA_MAX_VRAM:最大虚拟内存,默认为空。

- OLLAMA_MODELS:模型目录,默认为空。

- OLLAMA_NOHISTORY:是否保存历史记录,默认为 false。

- OLLAMA_NOPRUNE:是否启用剪枝,默认为 false。

- OLLAMA_NUM_PARALLEL:并行数,默认为 1。

- OLLAMA_ORIGINS:允许的来源,默认为空。

- OLLAMA_RUNNERS_DIR:运行器目录,默认为空。

- OLLAMA_SCHED_SPREAD:调度分布,默认为空。

- OLLAMA_TMPDIR:临时文件目录,默认为空。

🌐 OpenWebUI部署

1. 安装Docker

- 访问 Docker官网 下载Mac版本(Apple Silicon)

- 安装并启动Docker Desktop

- 配置国内镜像源加速下载(我这里

科学上网不需要)

💡 小贴士:Windows 安装 Docker 需要开启 Hyper-V(Windows专业版必需)

2. 部署OpenWebUI(可视化大模型对话界面)

# 拉取镜像 (直接run默认会拉取 latest 标签的镜像)

docker pull ghcr.io/open-webui/open-webui:main#(官方文档)以上是从 GitHub Container Registry (GHCR) 上拉取镜像,而不是从 Docker Hub。

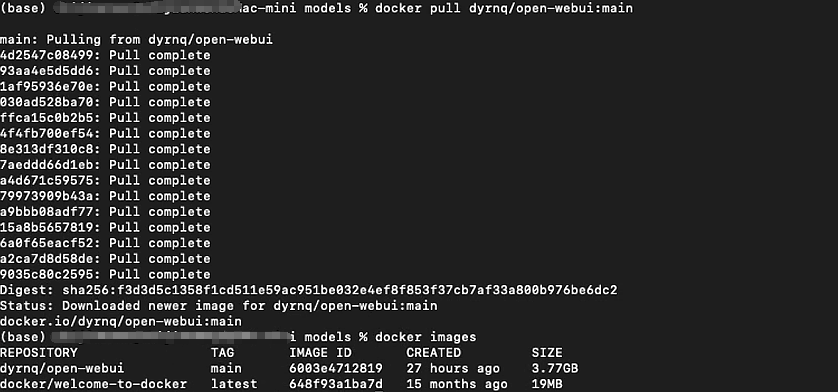

# 也可以docker hub 拉取 open-webui镜像

docker pull dyrnq/open-webui:main

# 启动容器

docker run -d -p 3000:8080 \--add-host=host.docker.internal:host-gateway \-v open-webui:/app/backend/data \--name open-webui \--restart always \ghcr.io/open-webui/open-webui:main

访问 http://localhost:3000 即可使用Web界面。

创建账号,这个是本地账号,随便添加账号信息即可

创建账号,这个是本地账号,随便添加账号信息即可

选择ollama中的模型,聊天测试

也可以在这里直接拉取模型

与下载的新模型进行对话

💡 小贴士:

- 注册时邮箱可以随便填写,设置密码后注意保存!

- ollama后台一定要运行着模型,如:ollama run phi-4

🔒 离线部署方案

如果需要在无网环境下部署,可以按照以下步骤操作:

-

在有网环境下准备资源:

- 下载Ollama安装包

- 导出模型文件

- 导出Docker镜像

-

离线环境部署:

- 安装Ollama

- 复制模型文件到指定目录

- 导入Docker镜像

- 启动OpenWebUI

⚡ 性能优化建议

-

内存管理

- 关闭不必要的后台应用

- 使用Activity Monitor监控内存使用

-

模型选择

- 建议从小模型开始测试

- 推荐模型大小顺序:

- qwen2:0.5b (最轻量)

- llama2:7b (平衡型)

- codellama:7b (代码专用)

-

温度控制

- 保持Mac Mini通风良好

- 可使用监控工具观察CPU温度

❓ 常见问题

-

Q: M4芯片能跑多大的模型?

A: 16GB内存的M4可以流畅运行8B参数的模型,更大的模型可能会影响性能。 -

Q: Llama中文支持不好怎么办?

A: 可以使用Llama-Chinese等经过中文优化的模型。 -

Q: OpenWebUI打不开怎么办?

A: 检查Docker状态:docker ps # 查看容器状态 docker logs open-webui # 查看日志

🎉 结语

通过本教程的配置,你已经拥有了一个完全本地化的AI助手!有任何问题欢迎在评论区讨论,让我们一起探索AI的无限可能!

如果觉得这篇文章对你有帮助,别忘了点赞转发哦~ 👍

你用Mac Mini跑过哪些AI模型?欢迎分享你的使用体验!💭

相关文章:

Mac 部署Ollama + OpenWebUI完全指南

文章目录 💻 环境说明🛠️ Ollama安装配置1. 安装[Ollama](https://github.com/ollama/ollama)2. 启动Ollama3. 模型存储位置4. 配置 Ollama 🌐 OpenWebUI部署1. 安装Docker2. 部署[OpenWebUI](https://www.openwebui.com/)(可视化…...

工业物联网平台-视频识别视频报警新功能正式上线

前言 视频监控作为中服云工业物联网平台4.0的功能已经上线运行。已为客户服务2年有余,为客户提供多路视频、实时在线监视和控制能力。服务客户实时发现现场、产线、设备出现随机故障、事故等,及时到场处理维修。 视频识别&视频报警新功能当前正式上…...

面试题 17.19. 消失的两个数字

文章目录 1.题目2.思路3.代码 1.题目 面试题 17.19. 消失的两个数字 给定一个数组,包含从 1 到 N 所有的整数,但其中缺了两个数字。你能在 O(N) 时间内只用 O(1) 的空间找到它们吗? 以任意顺序返回这两个数字均可。 示例 1: **输入:** […...

Licode简介及与SRS对比

Licode 是一个开源的 WebRTC 通信框架,专注于多人实时音视频互动(如视频会议),而 SRS 是一个通用的 流媒体服务器,支持直播、低延迟流分发等场景。以下是两者的详细对比和 Licode 的核心解析: 一、Licode 核心解析 1. 定位与设计目标 核心功能:基于 WebRTC 的多人实时音…...

mysql的cpu使用率100%问题排查

背景 线上mysql服务器经常性出现cpu使用率100%的告警, 因此整理一下排查该问题的常规流程。 1. 确认CPU占用来源 检查系统进程 使用 top 或 htop 命令,确认是否是 mysqld 进程导致CPU满载:top -c -p $(pgrep mysqld)2. 实时分析MySQL活动 …...

Debian 安装 Nextcloud 使用 MariaDB 数据库 + Caddy + PHP-FPM

前言 之前通过 docker在ubuntu上安装Nextcloud,但是现在我使用PVE安装Debian虚拟机,不想通过docker安装了。下面开始折腾。 安装过程 步骤 1:更新系统并安装必要的软件 sudo apt update && sudo apt upgrade -y sudo apt install…...

qt6.8安装mysql8.0驱动

qt6.8安装mysql8.0驱动 qt6.8本身是不带mysql驱动。想要在qt里面使用mysql,还是比较麻烦的。需要自己编译驱动 首先下载qt源码,链接Index of /archive/qt/6.8/6.8.1/single 下载mysql对于驱动文件,链接是MySQL :: Download MySQL Connector/C (Archiv…...

π0开源了且推出自回归版π0-FAST——打造机器人动作专用的高效Tokenizer:比扩散π0的训练速度快5倍但效果相当

前言 过去的半个多月 对于大模型 deepseek火爆全球,我对其的解读也写成了整整一个系列 详见《火爆全球的DeepSeek系列模型》,涉及对GRPO、MLA、V3、R1的详尽细致深入的解读 某种意义来讲,deepseek 相当于把大模型的热度 又直接拉起来了——…...

)

今日AI和商界事件(2025-02-07)

今日AI领域的相关事件包括但不限于以下几个方面: 一、政策与监管 美国众议员推动禁止政府设备使用中国AI应用DeepSeek:美国众议院两名来自两党的议员提议立法,禁止联邦政府设备使用中国人工智能应用DeepSeek,理由是中国政府可能…...

【算法篇】贪心算法

目录 贪心算法 贪心算法实际应用 一,零钱找回问题 二,活动选择问题 三,分数背包问题 将数组和减半的最小操作次数 最大数 贪心算法 贪心算法,是一种在每一步选择中都采取当前状态下的最优策略,期望得到全局最优…...

《金字塔原理》笔记

金字塔原理一书的原理是关于结构化写作的,里面提出一个MECE法则:各个分论点之间要“相互独立、完全穷尽”。 我的总结 写作思路都是总分总。 要凝练最顶部的信息,然后按照三叉树(最多四叉树)一直分下去。 书中优雅的…...

蓝桥杯准备 【入门3】循环结构

素数小算法(埃氏筛&&欧拉筛) 以下四段代码都是求20以内的所有素数 1.0版求素数 #include<iostream> using namespace std;int main() {int n 20;for(int i2;i<n;i){int j0;for(j2;j<i;j)//遍历i{if(i%j0){break;}}if(ij){cout&l…...

MySQL三大日志——binlog、redoLog、undoLog详解

日志是mysql数据库的重要组成部分,记录着数据库运行期间各种状态信息,能帮助我们进行很多容错及分析工作,其中有三大日志与我们这些开发者息息相关,本文将介绍binlog、redoLog、undoLog三种日志: 1. redoLog 1.1 为什么…...

IDEA中Resolving Maven dependencies卡着不动解决方案

一、修改settings.xml Maven配置阿里云仓库主要通过修改Maven的settings.xml文件来实现。以下是具体步骤: 1、找到settings.xml文件: 通常位于Maven安装目录下的conf文件夹中,或者在用户目录下的.m2文件夹中(如果用户自定义了settings.xml的位置)。 2、编辑se…...

)

组合(力扣77)

从这道题开始,我们正式进入回溯算法的学习。之前在二叉树中只是接触到了一丢丢,而这里我们将使用回溯算法解决很多经典问题。 那么这道题是如何使用回溯算法的呢?在讲回溯之前,先说明一下此题是如何递归的。毕竟回溯递归不分家&a…...

X86中的常用寄存器

通用寄存器16个 RAX, RBX, RCX, RDX, RSI, RDI, RSP, RBP, R8, R9, R10, R11, R12, R13, R14, R15 其中: RAX:调用程序时,用于存储返回值。RCX:在字符串处理指令中,常用做计数器。RSI:在字符串处理指令中…...

SpringAI系列 - 使用LangGPT编写高质量的Prompt

目录 一、LangGPT —— 人人都可编写高质量 Prompt二、快速上手2.1 诗人 三、Role 模板3.1 Role 模板3.2 Role 模板使用步骤3.3 更多例子 四、高级用法4.1 变量4.2 命令4.3 Reminder4.4 条件语句4.5 Json or Yaml 方便程序开发 一、LangGPT —— 人人都可编写高质量 Prompt La…...

git撤销上一次的提交

1、撤销提交 如果需要撤销上一次的提交,只是提交到了本地,可以通过命令: // 撤销最近的提交(保留修改) git reset --soft HEAD~1 这个操作可以保留之前的提交和当前的修改。最近一次的提交到本地的修改的提交会回到…...

springboot+vue导入ruoyi项目的框架

一、介绍 RuoYi-Vue版本,采用了前后端分离的单体架构设计软件环境:JDK、Mysql、Redis、Maven、Node技术选型: Spring Boot、Spring Security、MyBatis、Jwt、Vue3、Element-Plus官方地址: https://gitee.com/y_project/RuoYi-Vue 官方推荐的版本如下&a…...

Conmi的正确答案——Rider中添加icon作为exe的图标

C#版本:.net 8.0 Rider版本:#RD-243.22562.250(非商业使用版) 1、添加图标到解决方案下: 2、打开“App.xaml”配置文件,添加配置: <Applicationx:Class"ComTransmit.App"xmlns&q…...

360手机刷机 360手机解Bootloader 360手机ROOT

360手机刷机 360手机解Bootloader 360手机ROOT 问:360手机已停产,现在和以后,能刷机吗? 答:360手机,是肯定能刷机的 360手机资源下载网站 360手机-360手机刷机RootTwrp 360os.top 360rom.github.io 一、…...

电风扇各国检测认证详细介绍美国FCC+UL欧盟CE+ROHS日本PSE+METI备案+英国UKCA

美国 : FCC认证 :产品进入美洲市场的通行证,需通过FCC SDOC认证。 FCC第15部分B: 该标准适用于非故意辐射设备,如家用电器、电脑设备等。它规定了这些设备在电磁环境中不会产生过多的辐射。 射频标准: FCC第15部分C:该标准适…...

实验3 词法分析(二)

实验3 词法分析(二) [实验目的]: 1 . 熟悉给定的词法分析程序; 2 . 改进词法分析程序。 [实验内容]: 1.尝试多方面改进TEST语言的文法,参考教材附录B词法分析程序TESTscan.c,在此词法分析程序的基础上改进程序&#x…...

VsCode创建VUE项目

1. 首先安装Node.js和npm 通过网盘分享的文件:vsCode和Node(本人电脑Win11安装) 链接: https://pan.baidu.com/s/151gBWTFZh9qIDS9XWMJVUA 提取码: 1234 它们是运行和构建Vue.js应用程序所必需的。 1.1 Node安装,点击下一步即可 …...

【自开发工具介绍】SQLSERVER的ImpDp和ExpDp工具04

SQLSERVER的ImpDp和ExpDp工具演示 1、指定某些表作为导出对象外 (-exclude_table) 验证用:导出的表,导入到新的数据库 2、指定某些表作为导出对象外 (-exclude_table) 支持模糊检索,可以使用星号 以s开头的表作为导出对象外,…...

国内知名Deepseek培训师培训讲师唐兴通老师讲授AI人工智能大模型实践应用

课程名称 《Deepseek人工智能大模型实践应用》 课程目标 全面了解Deepseek人工智能大模型的技术原理、功能特点及应用场景。 熟练掌握Deepseek大模型的提示词工程技巧,能够编写高质量的提示词。 掌握Deepseek大模型在办公、营销等领域的应用方法,提升…...

、列表的循环遍历、列表的增删改查、列表的嵌套、列表的切片)

4.Python字符串和列表:字符串输入、字符串输出、下标和切片、字符串常见函数、列表(list)、列表的循环遍历、列表的增删改查、列表的嵌套、列表的切片

1. Python 字符串 1.1 字符串输入 input() 函数用于从用户获取字符串输入。它总是返回一个字符串类型的值。 # 从用户输入字符串 name input("请输入你的名字:") print(f"你好, {name}")1.2 字符串输出 字符串的输出通常使用 print() 函数…...

【C语言标准库函数】指数与对数函数:exp(), log(), log10()

目录 一、头文件 二、函数简介 2.1. exp(double x) 2.2. log(double x) 2.3. log10(double x) 三、函数实现(概念性) 3.1. exp(double x) 的模拟实现 3.2. log(double x) 和 log10(double x) 的模拟实现 四、注意事项 4.1. exp(double x) 的注…...

小白系列:数据库基础知识解析

前言 今天,我打算用简单明了的语言来讲解一下数据库的基本概念。总体上,这些内容与我在视频中讲解的基本一致。如果你发现视频的讲解有些难以理解,不妨看看这篇文字版的解释,希望能够更快速地帮助你掌握数据库的相关知识。需要注…...

【AIGC魔童】DeepSeek核心创新技术(二):MLA

【AIGC魔童】DeepSeek核心创新技术(二):MLA 1. MLA框架的定义与背景2. MLA框架的技术原理(1)低秩联合压缩(2)查询的低秩压缩(3)旋转位置嵌入(RoPE)…...