DeepSeek-V3 技术报告解读

DeepSeek火了有一段时间了,春节假期因为没时间,所以关于deepseek大模型一系列的技术报告一直没看,新年开工后,抽一点时间把之前的坑补起来,关于DeepSeek-V3技术报告的解读已经有很多了,但我相信不同的人去读,应该会有不一样的收获,正所谓“一千个读者,就有一千个哈姆雷特”。故还是整理一下自己的Blog,权当抛砖引玉。

后续会继续更新DeepSeek-R1,Janus-Pro的相关论文,敬请期待。

(完整技术报告可在官网获取,建议搭配原文食用)

我们先看一下目录。

目录共分为六个部分。1. Introduction(简介),2. Architecture(架构),3. Infrastructures(基础设施),4. Pre-Training(预训练),5. Post-Training(后训练),6. Conclusion, Limitations, and Future Directions(结论,局限性以及未来的研究方向)

论文结构全景

报告采用经典技术论文框架,六大模块环环相扣:

-

Introduction:开篇明义,锚定MoE模型的高效训练战场

-

Architecture:揭秘MLA注意力与无辅助损失负载均衡的核心设计

-

Infrastructures:解读支撑千卡训练的FP8训练与DualPipe通信黑科技

-

Pre-Training:14.8T token背后的数据工程与长上下文扩展方案

-

Post-Training:从SFT到RL的完整对齐技术栈

-

Conclusion:开源AGI之路的技术宣言

1.摘要

1. 模型定位

DeepSeek-V3 是当前参效比最优的开源MoE模型,以 671B总参数/37B激活参数 的黄金比例,在计算效率与模型容量间找到平衡点。相比传统密集模型,其动态专家选择机制可节省 40%+ 计算开销。

2. 核心技术拆解

-

MLA注意力

通过键值(KV)低秩压缩至512维(原128头×128维=16,384维),实现 97% KV缓存压缩率,推理显存占用降低至1/30,性能损失<1%。 -

无辅助损失的负载均衡

抛弃传统辅助损失,首创动态偏置路由算法:-

实时监控专家负载,通过偏置项调整路由权重

-

结合极低权重(α=0.0001)的序列级平衡约束

-

在HumanEval代码任务上相对性能提升 21%(44.5→53.7)

-

-

多Token预测引擎

在Transformer块后叠加轻量级预测头,实现:-

训练阶段:通过D=1的预测深度提升数据效率

-

推理阶段:支持推测解码,生成速度提升 1.8倍

-

3. 训练效能革命

-

数据工程:14.8T token混合语料,数学/代码数据占比提升30%,采用文档级打包与FIM填充策略

-

稳定训练:全程零损失异常波动,FP8量化误差控制在 <0.25%

-

成本标杆:全周期训练仅需 278.8万H800小时(约557万美元),单万亿token训练成本18万小时,较密集模型降低 3-5倍

4. 性能巅峰

-

开源屠榜:MMLU通用知识(88.5)、MATH数学(90.2)、LiveCodeBench代码(40.5)三大任务全面领先

-

闭源对标:在128K长上下文、复杂指令跟随等场景达到GPT-4o 95%性能

-

部署优化:通过冗余专家调度、NVLink/IB网络融合,实现 32K上下文吞吐量30%提升

2.引言:大模型时代的效率革命

在通往AGI的道路上,大语言模型(LLM)正经历着前所未有的进化。从GPT-3到GPT-4,从LLaMA到Mistral,模型规模的指数级增长带来了性能的飞跃,但也伴随着惊人的训练成本。在这场效率与性能的博弈中,混合专家模型(Mixture-of-Experts, MoE) 凭借其动态计算特性,成为破解"大模型困境"的关键技术路径。

DeepSeek-V3的诞生,正是这一技术路线的最新里程碑。作为目前参效比最优的开源MoE模型,它以 671B总参数/37B激活参数 的黄金比例,在计算效率与模型容量间找到平衡点,同时实现了与GPT-4o、Claude-3.5-Sonnet等闭源模型相媲美的性能。

2.1.技术背景:MoE模型的效率优势

1. 动态计算:按需激活的专家系统

传统密集模型在处理每个token时都会激活全部参数,而MoE模型通过路由机制动态选择专家子集:

-

每个token仅激活 8个专家(DeepSeek-V3配置)

-

计算量降低至密集模型的 1/5~1/10

-

保持模型容量,支持更复杂的任务建模

2. 负载均衡:MoE的阿喀琉斯之踵

尽管MoE在理论上具有显著效率优势,但负载不均衡问题长期制约其发展:

-

热门专家过载,冷门专家闲置

-

传统解决方案依赖辅助损失函数,可能损害模型性能

-

跨节点通信开销随模型规模线性增长

2.2.DeepSeek-V3的技术定位

1. 性能目标

-

超越开源标杆:在MMLU、MATH等核心评测集上全面领先LLaMA-3、Qwen等模型

-

对标闭源前沿:达到GPT-4o 95%以上性能,部分任务实现反超

-

长上下文支持:稳定支持128K上下文窗口,满足复杂任务需求

2. 效率指标

-

训练成本:全周期仅需 278.8万H800 GPU小时(约557万美元)

-

推理效率:通过MLA注意力与推测解码,生成速度提升 1.8倍

-

部署灵活性:支持32卡~320卡弹性部署,适应不同场景需求

2.3.技术路线图

DeepSeek-V3的技术突破围绕三大核心展开:

-

架构创新:MLA注意力 + 无辅助损失负载均衡

-

训练优化:FP8混合精度 + DualPipe通信

-

对齐策略:多阶段SFT + 强化学习

3.架构

一、整体架构设计哲学

DeepSeek-V3延续DeepSeek系列的核心设计理念,在保持265B总参数量的同时,通过三大核心技术创新实现训练效率与推理性能的突破:

-

多头潜在注意力(MLA):革命性的KV缓存压缩方案

-

DeepSeekMoE专家系统:无辅助损失的负载均衡策略

-

多令牌预测(MTP):前瞻性训练目标设计

模型采用61层Transformer架构,其中前3层为稠密层,后续每2层嵌入MoE结构,在仅激活37B参数的情况下实现与405B稠密模型相当的推理性能,训练成本降低至2.788M H800 GPU小时。

二、核心组件创新详解

1. 多头潜在注意力(Multi-head Latent Attention)

传统痛点:标准注意力机制在长序列推理时面临KV缓存爆炸问题,H800 GPU上处理32K上下文需要超过40GB显存。

MLA创新方案:

class MultiHeadLatentAttention:def __init__(self):# 关键值联合压缩self.W_DKY = nn.Linear(d, d_c) # KV压缩矩阵self.W_UK = nn.Linear(d_c, d_h*n_h) # Key重构self.W_UV = nn.Linear(d_c, d_h*n_h) # Value重构def forward(self, h_t):c_KV = W_DKY(h_t) # 潜在向量压缩k_t = W_UK(c_KV) + RoPE(W_KR(h_t)) # 解耦式位置编码v_t = W_UV(c_KV)# 仅需缓存c_KV和RoPE位置信息return scaled_dot_product_attention(q, k, v)技术突破:

-

KV缓存体积减少至标准注意力的1/4(d_c=512 vs d_h*n_h=16384)

-

解耦式位置编码设计,兼容YaRN上下文扩展技术

-

在128K长上下文场景下,推理速度提升3.2倍

2. DeepSeekMoE专家系统

架构革新:

class DeepSeekMoE(nn.Module):def __init__(self):self.shared_experts = [FFN(d, 2048) for _ in N_s] # 共享专家self.routed_experts = [FFN(d, 2048) for _ in N_r] # 路由专家self.centroids = nn.Parameter(N_r, d) # 专家质心向量def forward(u_t):# 共享专家全局激活shared_out = sum([expert(u_t) for expert in shared_experts])# 路由专家动态选择affinities = sigmoid(u_t @ centroids.T) # 亲和度计算topk_indices = affinities.topk(K_r)[1]routed_out = sum([g_i * expert(u_t) for i in topk_indices])return u_t + shared_out + routed_out负载均衡突破:

-

动态偏置调整:实时监控专家负载,超载专家偏置-γ,欠载+γ(γ=0.001)

-

序列级正则项:极小权重(α=0.0001)的平衡损失防止单序列失衡

-

节点限制路由:每个token最多分发至4个计算节点,通信开销降低62%

实验数据显示,该方案在保持专家利用率98.7%的同时,将路由震荡率降低至传统方法的1/5。

3. 多令牌预测(Multi-Token Prediction)

创新实现:

class MTPModule:def __init__(self, depth=1):self.trm_blocks = [TransformerBlock() for _ in depth]self.proj = nn.Linear(2d, d) # 双路特征融合def forward(h_prev, emb_next):h_combined = proj([RMSNorm(h_prev), RMSNorm(emb_next)])h_out = trm_block(h_combined)return OutHead(h_out) # 共享输出头训练策略:

-

深度1的MTP模块(预测t+1和t+2位置)

-

损失权重λ从0.3逐步衰减至0.1

-

推理时可无缝转换为推测解码加速模块

实践表明,该设计使HumanEval基准提升17.3%,同时保持解码速度1.8倍于传统方案。

三、架构创新成效

关键性能指标对比:

| 指标 | DeepSeek-V2 | DeepSeek-V3 | 提升幅度 |

|---|---|---|---|

| 训练稳定性 | 78.2% | 98.6% | +26.1% |

| 专家负载均衡度 | 0.82 | 0.97 | +18.3% |

| 长上下文吞吐量 | 128 tok/s | 412 tok/s | 3.22x |

| 代码生成准确率 | 65.2% | 82.6% | +26.7% |

四、设计启示与行业影响

DeepSeek-V3的架构创新为大规模MoE模型发展指明新方向:

-

硬件协同设计:FP8混合精度训练方案首次在超大规模模型验证成功

-

动态计算范式:DualPipe流水线并行实现计算-通信全重叠

-

生态扩展性:支持从4K到128K上下文的无缝扩展

该架构已成功应用于代码生成、复杂数学推理等场景,在LiveCodeBench基准上以40.5%的准确率刷新开源模型记录。

4. Infrastructures 基础设施

DeepSeek-V3 的基础设施设计围绕 高效训练 和 低成本部署 展开,涵盖计算集群、训练框架、FP8 混合精度训练、推理部署优化以及硬件设计建议。以下分模块详细解读:

4.1 Compute Clusters(计算集群)

-

硬件配置:

-

使用 2048 块 NVIDIA H800 GPU,每个节点包含 8 块 GPU,通过 NVLink 和 NVSwitch 实现节点内高速互联。

-

跨节点通信采用 InfiniBand(IB) 网络,带宽 50 GB/s,支持低延迟数据传输。

-

-

网络拓扑:

-

节点内:NVLink(160 GB/s)提供高带宽,适用于细粒度专家并行(EP)通信。

-

跨节点:InfiniBand 实现全局互联,支持大规模分布式训练。

-

4.2 Training Framework(训练框架)

4.2.1 DualPipe and Computation-Communication Overlap

-

DualPipe 流水线并行:

-

目标:减少流水线气泡(Bubble),实现计算与通信重叠。

-

设计:

-

将每个训练步骤划分为 前向块(Forward Chunk) 和 反向块(Backward Chunk),双向调度微批次。

-

反向块进一步拆分为 输入梯度计算 和 权重梯度计算,与通信操作重叠。

-

-

优势:相比传统 1F1B 流水线,气泡减少 50%,吞吐量提升 20%。

-

-

计算-通信重叠:

-

All-to-All 通信:在注意力计算和 MLP 阶段插入通信操作,利用空闲 SM(Streaming Multiprocessor)资源执行。

-

优化效果:通信开销接近零,支持大规模专家并行(64 路 EP)。

-

4.2.2 Efficient Cross-Node All-to-All Communication

-

通信策略:

-

节点限制路由:每个 Token 最多分配到 4 个节点,减少跨节点 IB 流量。

-

分层传输:

-

跨节点:通过 IB 发送 Token 至目标节点的指定 GPU。

-

节点内:通过 NVLink 将 Token 转发至目标专家所在的 GPU。

-

-

-

内核优化:

-

Warp 专业化:将通信任务分配给专用 Warp,动态调整 IB 发送、NVLink 转发和接收的 Warp 数量。

-

低缓存占用:定制 PTX 指令,减少 L2 缓存争用。

-

4.2.3 Extremely Memory Saving with Minimal Overhead

-

内存优化技术:

-

重计算:反向传播时重新计算 RMSNorm 和 MLA 上投影的输出,减少激活内存。

-

低精度存储:在 MoE 通信中缓存 FP8 格式的激活,节省 50% 内存。

-

参数共享:MTP 模块与主模型共享嵌入层和输出头,减少冗余参数。

-

4.3 FP8 Training(FP8 混合精度训练)

4.3.1 Mixed Precision Framework

-

精度分配:

-

FP8 计算:线性层(GEMM)使用 FP8(E4M3 格式),加速计算并减少内存占用。

-

高精度保留:注意力、归一化、MoE 门控等敏感操作保留 BF16/FP32 精度。

-

-

内存优化:

-

权重梯度:使用 FP8 缓存激活,减少 Wgrad 阶段内存占用。

-

主权重:保留 FP32 格式,确保数值稳定性。

-

4.3.2 Improved Precision from Quantization and Multiplication

-

分块量化:

-

激活:按 1x128 分块量化,缓解异常值影响。

-

权重:按 128x128 分块量化,保持矩阵乘法的局部一致性。

-

-

高精度累加:

-

CUDA 核心累加:每计算 128 个元素(4 个 WGMMA)后,将部分和提升至 FP32 累加,减少低精度误差。

-

-

在线量化:

-

实时计算分块的最大绝对值,动态调整缩放因子,避免历史统计偏差。

-

4.3.3 Low-Precision Storage and Communication

-

存储优化:

-

优化器状态:使用 BF16 存储 AdamW 的一阶和二阶动量,减少内存占用。

-

激活缓存:MoE 通信中的激活使用 FP8 格式,节省 50% 带宽。

-

-

通信优化:

-

量化通信:在 MoE 分发(Dispatch)和聚合(Combine)阶段使用 FP8 格式,减少跨节点流量。

-

4.4 Inference and Deployment(推理与部署)

4.4.1 Prefilling(预填充阶段)

-

部署单元:

-

最小部署单元为 4 节点(32 GPU),注意力部分使用 TP4 + SP + DP8,MoE 部分使用 EP32。

-

-

负载均衡:

-

冗余专家:动态复制高负载专家,部署到多个 GPU,根据统计每 10 分钟调整一次。

-

计算-通信重叠:同时处理两个微批次,重叠注意力计算与 MoE 通信。

-

4.4.2 Decoding(解码阶段)

-

部署单元:

-

最小部署单元为 40 节点(320 GPU),MoE 部分使用 EP320,每个 GPU 仅托管 1 个专家。

-

-

通信优化:

-

直接点对点传输:通过 IB 实现低延迟 All-to-All 通信,结合 IBCDA 技术进一步降低延迟。

-

动态冗余:探索在解码阶段动态激活冗余专家(如每个 GPU 托管 16 个专家,每次激活 9 个)。

-

4.5 Suggestions on Hardware Design(硬件设计建议)

4.5.1 Communication Hardware(通信硬件)

-

专用协处理器:

-

建议将通信任务(如 IB/NVLink 数据转发、Reduce 操作)卸载至独立协处理器,释放 GPU SM 资源。

-

-

统一通信接口:

-

提供跨 IB 和 NVLink 的统一通信原语(如 Read/Write/Multicast),简化编程复杂度。

-

4.5.2 Compute Hardware(计算硬件)

-

Tensor Core 改进:

-

高精度累加:支持 FP32 累加精度,避免低精度误差累积。

-

分块量化支持:在 Tensor Core 中集成分块缩放因子,避免频繁数据搬运。

-

-

在线量化加速:

-

在 TMA(Tensor Memory Accelerator)中融合量化和内存访问,减少量化开销。

-

-

转置 GEMM 支持:

-

支持直接读取转置矩阵,避免量化-反量化-转置的冗余操作。

-

总结

DeepSeek-V3 的基础设施设计通过 DualPipe 流水线并行、FP8 混合精度训练 和 高效通信优化,实现了极致的训练效率和低成本部署。其核心创新包括:

-

DualPipe:双向流水线调度,计算与通信深度重叠,显著减少训练时间。

-

FP8 训练:分块量化 + 高精度累加,平衡计算速度与数值稳定性。

-

动态冗余专家:通过负载统计动态调整专家分布,提升推理吞吐量。

这些技术为千亿级 MoE 模型的训练和部署提供了可复用的工程范本。

5.Pre-Training预训练

预训练是 DeepSeek-V3 模型开发的核心阶段,涉及数据构建、超参数设置、长上下文扩展以及评估等多个方面。以下是对预训练部分的详细解读:

5.1 数据构建

核心目标:构建高质量、多样化的预训练语料库,以提升模型的多领域能力。

具体措施:

-

数据优化:

-

相比 DeepSeek-V2,增加了数学和编程样本的比例,并扩展了多语言覆盖范围(除中英文外)。

-

通过文档打包(Document Packing)方法减少冗余,同时保持语料多样性。

-

-

Fill-in-Middle (FIM) 策略:

-

采用 Prefix-Suffix-Middle (PSM) 框架,允许模型基于上下文预测中间文本,提升代码生成和补全能力。

-

FIM 策略以 10% 的比例应用于预训练数据。

-

-

分词器优化:

-

使用 Byte-level BPE 分词器,词汇表扩展至 128K,优化多语言压缩效率。

-

引入结合标点和换行符的 token,减少多行提示中的 token 边界偏差。

-

5.2 超参数设置

模型架构:

-

Transformer 层数:61

-

隐藏层维度:7168

-

注意力头数:128,每头维度:128

-

KV 压缩维度:512,查询压缩维度:1536

-

MoE 层:每层包含 1 个共享专家和 256 个路由专家,激活 8 个专家。

-

多 token 预测(MTP)深度:1(预测下一个 token 及其后一个 token)。

训练参数:

-

优化器:AdamW(β₁=0.9,β₂=0.95,weight_decay=0.1)

-

学习率调度:

-

前 2K 步线性增加到 2.2×10⁻⁴,保持至 10T tokens。

-

随后余弦衰减至 2.2×10⁻⁵,最后 500B tokens 保持 7.3×10⁻⁶。

-

-

批量大小:从 3072 逐步增加到 15360。

-

梯度裁剪:1.0

负载均衡策略:

-

无辅助损失负载均衡:通过动态调整专家偏置项,确保专家负载均衡。

-

序列级负载均衡损失:极小权重(α=0.0001),仅用于防止单序列内极端不平衡。

5.3 长上下文扩展

目标:将模型的上下文窗口从 4K 扩展到 128K,以支持长文本任务。

实现方法:

-

YaRN 技术:

-

采用 YaRN(Yet another RoPE-based method)扩展上下文窗口。

-

对解耦的共享键(kₜᴿ)应用 YaRN,保持模型性能。

-

-

两阶段扩展:

-

第一阶段:从 4K 扩展到 32K,批量大小 1920。

-

第二阶段:从 32K 扩展到 128K,批量大小 480。

-

学习率保持 7.3×10⁻⁶,与预训练末期一致。

-

评估结果:

-

在“Needle In A Haystack”(NIAH)测试中,DeepSeek-V3 在 128K 上下文窗口下表现优异,验证了其长上下文处理能力。

5.4 评估

评估基准:

-

涵盖多领域任务,包括知识、语言理解、推理、代码、数学等。

-

主要基准:MMLU、DROP、HumanEval、MATH、C-Eval 等。

评估方法:

-

困惑度评估:用于语言建模任务(如 HellaSwag、PIQA)。

-

生成评估:用于问答、代码生成等任务(如 TriviaQA、HumanEval)。

-

多语言评估:包括中文(C-Eval、CMMLU)和多语言(MMMLU)任务。

评估结果:

-

知识任务:

-

MMLU:88.5,MMLU-Pro:75.9,GPQA:59.1,表现优于其他开源模型,接近 GPT-4o 和 Claude-3.5-Sonnet。

-

-

代码与数学任务:

-

HumanEval:65.2,MATH:61.6,LiveCodeBench:19.4,在非长链推理模型中表现最佳。

-

-

中文任务:

-

C-Eval:90.1,CMMLU:88.8,表现优于 Qwen2.5 72B。

-

5.5 讨论

-

多 token 预测(MTP)消融实验:

-

MTP 策略显著提升了模型性能,尤其在代码和数学任务上。

-

在推理阶段,MTP 模块可用于推测解码,加速生成速度。

-

-

无辅助损失负载均衡消融实验:

-

相比传统辅助损失方法,无辅助损失策略在保持负载均衡的同时,提升了模型性能。

-

专家负载分析显示,无辅助损失模型在领域专业化上表现更好。

-

-

批级与序列级负载均衡对比:

-

批级负载均衡允许专家在不同领域间灵活分配,优于序列级均衡。

-

通过大规模专家并行和数据并行,解决了小批量负载不均衡问题。

-

总结

DeepSeek-V3 的预训练阶段通过高质量数据构建、高效架构设计和精细超参数调优,实现了模型性能的显著提升。其长上下文扩展和多 token 预测策略进一步增强了模型在复杂任务中的表现。评估结果表明,DeepSeek-V3 在知识、代码、数学等领域均达到了开源模型的领先水平,接近顶级闭源模型(如 GPT-4o 和 Claude-3.5-Sonnet)。

6.Post-Training后训练

引言

DeepSeek-V3作为一款性能卓越的混合专家(MoE)语言模型,其成功不仅依赖于创新性的架构设计和高效的训练方法,还在于精心规划的后训练阶段。这一阶段包括监督微调(Supervised Fine-Tuning, SFT)、强化学习(Reinforcement Learning, RL)等步骤,旨在进一步提升模型的性能,并确保其能够更好地理解和响应人类偏好。

监督微调(SFT)

在完成预训练之后,DeepSeek-V3进入了一个关键的优化过程——监督微调。SFT是基于特定任务或领域的人类注释数据集进行的微调过程,目的是让模型更准确地理解并生成符合人类期望的回答。对于DeepSeek-V3而言,这个阶段不仅仅是简单地调整参数,还包括对模型输出质量和风格的精确控制。

- 数据准备:为了进行有效的SFT,研究团队构建了高质量的数据集,这些数据包含了丰富的指令和相应的回答示例。

- 微调策略:采用先进的技术手段,如多轮迭代、动态调整学习率等,以提高微调效果。

强化学习(RL)

在SFT的基础上,DeepSeek-V3通过强化学习来进一步增强其表现。这一过程通常涉及奖励模型的构建和应用,其中奖励信号来源于人类反馈或其他形式的评价机制。具体来说:

- 奖励模型:基于收集到的人类偏好数据,建立一个能够评估模型输出质量的奖励模型。

- 优化算法:利用策略梯度方法(例如PPO),不断优化DeepSeek-V3的行为策略,使其趋向于产生更高奖励值的输出。

知识蒸馏与推理能力迁移

DeepSeek-V3的一个显著特点是采用了知识蒸馏的方法,从DeepSeek-R1系列模型中提取推理能力,并将其融入到DeepSeek-V3中。这种方法不仅增强了模型的逻辑推理能力,也帮助保持了输出的一致性和准确性。

- 长链思维模式:通过引入R1中的验证和反思机制,DeepSeek-V3能够在处理复杂问题时展现出更强的理解力和解决问题的能力。

- 风格控制:同时,研究人员还注重调控模型的输出风格,确保信息传递的有效性以及用户交互体验的良好性。

训练效率与成本效益

尽管DeepSeek-V3在后训练阶段进行了大量工作,但得益于高效的技术实现,整个过程仅需约5000个H800 GPU小时,加上预训练和其他阶段的成本,总训练成本大约为$557.6万美元。这表明,即便是在追求高性能的同时,DeepSeek-V3依然保持了较高的经济性。

结论

总结来看,DeepSeek-V3的后训练阶段不仅提升了模型的整体性能,使其在多个基准测试中超越其他开源模型,甚至达到了与顶级闭源模型相媲美的水平。此外,该模型在代码和数学领域的优异表现,更是证明了其强大的实际应用潜力。未来的研究将继续探索如何进一步优化模型架构和训练方法,以应对更加复杂的挑战。

7. Conclusion, Limitations, and Future Directions结论、局限性与未来方向

7.1 结论

DeepSeek-V3 是一个具有 6710 亿参数的大型 MoE(Mixture-of-Experts)语言模型,其中每个 token 激活 370 亿参数。通过以下创新和优化,DeepSeek-V3 在性能和效率上取得了显著进展:

-

架构创新:

-

采用 Multi-head Latent Attention (MLA) 和 DeepSeekMoE 架构,提升推理效率和训练经济性。

-

引入 无辅助损失负载均衡策略 和 多 token 预测(MTP)目标,进一步提升模型性能。

-

-

训练优化:

-

支持 FP8 混合精度训练,显著降低 GPU 内存使用和训练成本。

-

通过 DualPipe 算法 和 计算-通信重叠,实现高效的跨节点 MoE 训练。

-

-

预训练与微调:

-

在 14.8 万亿 token 的高质量数据上进行预训练,训练过程稳定且高效。

-

通过 监督微调(SFT) 和 强化学习(RL),进一步对齐模型与人类偏好。

-

-

评估结果:

-

在知识、代码、数学等任务上,DeepSeek-V3 表现优异,超越其他开源模型,接近 GPT-4o 和 Claude-3.5-Sonnet 等顶级闭源模型。

-

训练成本仅为 278.8 万 H800 GPU 小时,经济性显著。

-

7.2 局限性

尽管 DeepSeek-V3 表现出色,但仍存在一些局限性:

-

部署复杂性:

-

为了确保高效推理,DeepSeek-V3 的推荐部署单元较大(如 4 节点 32 GPU),可能对小型团队构成负担。

-

-

生成速度:

-

尽管生成速度相比 DeepSeek-V2 提升了两倍以上,但仍存在进一步优化的空间。

-

-

数据依赖性:

-

模型性能高度依赖于预训练数据的质量和多样性,未来需要持续优化数据构建流程。

-

-

长上下文处理:

-

尽管支持 128K 上下文窗口,但在极端长上下文任务中的表现仍需进一步提升。

-

7.3 未来方向

DeepSeek 团队计划在以下方向持续投入研究,推动模型能力的进一步提升:

1. 模型架构优化

-

研究更高效的架构设计,支持无限上下文长度。

-

突破 Transformer 的限制,探索新的建模方法。

2. 数据扩展与优化

-

持续迭代预训练数据的数量和质量,扩展多语言和多领域覆盖。

-

探索更多训练信号来源(如多模态数据),推动数据维度的全面扩展。

3. 深度推理能力提升

-

扩展模型的推理长度和深度,增强复杂问题的解决能力。

-

研究更高效的推理优化技术,如推测解码和动态路由。

4. 多维度评估方法

-

开发更全面的评估框架,避免模型过度优化特定基准。

-

引入人类评估和多模型对比,更真实地反映模型能力。

5. 对齐与安全性

-

进一步研究 Constitutional AI 等方法,确保模型行为符合人类价值观。

-

探索更通用的奖励机制,提升模型在开放场景中的表现。

总结

DeepSeek-V3 在性能、效率和成本之间实现了良好的平衡,成为当前最强的开源模型之一。尽管存在一些局限性,但其创新设计和优化方法为未来研究提供了重要参考。通过持续的技术迭代和多维度探索,DeepSeek 团队致力于推动开源模型向通用人工智能(AGI)的目标稳步迈进。

喜欢的小伙伴点赞收藏关注吧!!!

相关文章:

DeepSeek-V3 技术报告解读

DeepSeek火了有一段时间了,春节假期因为没时间,所以关于deepseek大模型一系列的技术报告一直没看,新年开工后,抽一点时间把之前的坑补起来,关于DeepSeek-V3技术报告的解读已经有很多了,但我相信不同的人去读…...

Spring使用@Scheduled注解的参数详解

在现代Java开发中,定时任务是一个常见的需求。Spring框架提供了Scheduled注解,让我们能够以简单、直观的方式定义和管理这些定时任务。接下来,我们来深入探讨这个注解的使用,以及它的参数都有哪些含义和作用。 Scheduled注解可以…...

力扣72题编辑距离

题目 原理 三个操作对应的操作次数分别是: 插入:在原本的次数上 1删除:在原本的次数上1替换:如果两个位置的字符串一样,则等于原本的次数, 如果不等,在原本的次数上1 去三者的最小值,就是最小的编辑次数 示例 代码 答案是2 package org.example;public class _72_编辑距离 {pu…...

聊天服务器分布式改造

目前的聊天室是单节点的,无论是http接口还是socket接口都在同一个进程,无法承受太多人同时在线,容灾性也非常差。因此,一个成熟的IM产品一定是做成分布式的,根据功能分模块,每个模块也使用多个节点并行部署…...

Python编程中常见的10个案例

文章目录 1. Hello, World!2. 计算斐波那契数列3. 文件读写4. 列表推导式5. 异常处理6. 函数定义与调用7. 类和对象8. 使用模块9. 网络请求10. 数据可视化总结 1. Hello, World! 这是学习任何编程语言时的第一个程序。 代码示例 print("Hello, World!")2. 计算斐波…...

Ardupilot开源无人机之Geek SDK进展2025Q1

Ardupilot开源无人机之Geek SDK进展2025Q1 1. 源由2. 内容汇总2.1 【jetson-fpv】YOLO INT8 coco8 dataset 精度降级2.2 【OpenIPC-Configurator】OpenIPC Configurator 固件升级失败2.3 【OpenIPC-Adaptive-link】OpenIPC RF信号质量相关显示2.4 【OpenIPC-msposd】.srt/.osd…...

linux上安装redis[从0到1]

redis安装步骤 1.下载redis2.新建redis文件夹3.解压安装Redis4.编译5.修改相关配置6.错误 redis下载官网: https://download.redis.io/releases/ 找到自己需要的版本 1.下载redis 选着自己需要下载的版本后,右击选择复制链接,然后利用命令进行下载&am…...

批量删除 Excel 中的空白行、空白列以及空白表格

我们经常会碰到需要删除 Excel 文档表格中的空白行及空白列的场景,有一些空白行或空白列可能我们人工不好识别,因此删除空白行空白列对我们来讲就非常的繁琐,因为我们需要先识别哪些 Excel 文档中包含空白行或者空白列,我们才能够…...

MyBatis SQL 映射文件的作用和结构

MyBatis SQL 映射文件定义了 SQL 语句以及如何将 SQL 语句的参数和结果映射到 Java 对象。 一、 作用 (Purpose) MyBatis SQL 映射文件(通常命名为 XXXMapper.xml)的主要作用是: 定义 SQL 语句: 在 XML 映射文件中编写 SQL 语句…...

MYSQL之创建数据库和表

创建数据库db_ck (下面的创建是最好的创建方法,如果数据库存在也不会报错,并且指定使用utf8mb4) show databases命令可以查看所有的数据库名,可以找到刚刚创建的db_ck数据库 使用该数据库时,发现里面没有…...

react+ts+eslint+prettier 配置教程

1.创建项目 npx create-react-app my-app --template typescript 2.安装依赖 eslint:核心代码质量工具。 prettier:代码格式化工具。 eslint-plugin-prettier:将 Prettier 的规则集成到 ESLint 中。 eslint-config-prettier:…...

ArduPilot开源代码之AP_OSD

ArduPilot开源代码之AP_OSD 1. 源由2. 简介3. 补丁4. 框架设计4.1 启动代码 (AP_OSD::init)4.2 任务代码 (AP_OSD::osd_thread)4.3 实例初始化 (AP_OSD::init_backend) 5. 重要例程5.1 AP_OSD::update_stats5.2 AP_OSD::update_current_screen5.3 AP_OSD::update_osd 6. 总结7.…...

sysbench手动测试OceanBase v4.2.4集群

环境: 1、ocp(sysbench节点) 192.192.103.128 2、ob集群1-1-1 observer 192.192.103.125、192.192.103.126、192.192.103.127,primary_zone:random haproxy 192.192.103.125、192.192.103.126、192.192.103.127 一、安装sysben…...

腾讯元宝:AI 时代的快速论文阅读助手

1. 背景与需求 在 AI 研究领域,每天都会涌现大量学术论文。如何高效阅读并提取关键信息成为研究者的一大难题。腾讯元宝是腾讯推出的一款大模型,结合了**大语言模型(LLM)和自然语言处理(NLP)**技术&#x…...

重构谷粒商城09:人人开源框架的快速入门

谷粒商城09——人人开源框架的快速入门 前言:这个系列将使用最前沿的cursor作为辅助编程工具,来快速开发一些基础的编程项目。目的是为了在真实项目中,帮助初级程序员快速进阶,以最快的速度,效率,快速进阶…...

AAA 技术详解:认证、授权与计费的原理、应用与配置实践

AAA(Authentication, Authorization, Accounting,即认证、授权和计费)是网络安全的“身份管理员”,负责验证用户身份、分配访问权限并记录行为轨迹。它如同网络世界中的“物业管理系统”,通过三重机制确保接入安全、权…...

OneM2M:全球性的物联网标准-可应用于物联网中

OneM2M 是一个全球性的物联网(IoT)标准,旨在为物联网设备和服务提供统一的框架和接口,以实现设备之间的互操作性、数据共享和服务集成。OneM2M 由多个国际标准化组织(如 ETSI、TIA、TTC、ARIB 等)共同制定,目标是解决物联网领域的碎片化问题,提供一个通用的标准,支持跨…...

redis数据迁移教程(使用RedisShake实现不停机迁移十分便捷)

1.我的场景 需要把本地的redis数据上传到阿里云服务器上面,服务器上redis并没有开aof持久化,但是将rdb文件上传至服务器后每次重启redis,rdb文件会被覆盖导致无法同同步数据,最终决定使用RedisShake 2.RedisShake介绍 什么是 RedisShake RedisShake 是一个用于处理和迁移…...

Linux基本操作指令3

1、wget: 这是一个用于从网络上下载文件的命令行工具。它支持 HTTP、HTTPS 和 FTP 协议。 wget http://download.qt.io/archive/qt/5.12/5.12.9/qt-opensource-linux-x64-5.12.9.run 2、下载完成后,你可以通过以下命令使文件可执行并运行安装程序: ch…...

2025年2月平价旗舰手机性能对比

1、荣耀Magic7 点评:缺席潜望式长焦,3X直立长焦体验还行。兼顾性能、游戏、屏幕、影像、续航、快充等诸多方面,且外围配置比较齐全。 2、vivo x200 点评:潜望式长焦相机,拍照效果好,30W无线充电着实鸡肋&a…...

Python SQLite3 保姆级教程:从零开始学数据库操作

Python SQLite3 保姆级教程:从零开始学数据库操作 本文适合纯新手!无需任何数据库基础,跟着步骤操作即可掌握 SQLite3 的核心用法。 目标:让你像用记事本一样轻松操作数据库! 目录 什么是 SQLite3?环境准…...

第七步:简单爬虫与网页测试

Puppeteer 官方文档:https://puppeteer.bootcss.com/ 1、安装 puppeteer是一个node插件安装命令:npm i puppeteer 2、概念 无头浏览器:就是不打开浏览器的页面,直接进行浏览器后台操作 3、入门 引入:import pup…...

4.桥接模式

概况 桥接模式:将抽象部分与实现部分分离,使它们可以独立变化,通过组合而非继承的方式实现解耦。 业务场景 场景描述:开发一个跨平台的图形绘制系统,支持不同形状(如圆形、矩形)和不同渲染方式…...

Golang学习笔记_44——命令模式

Golang学习笔记_41——观察者模式 Golang学习笔记_42——迭代器模式 Golang学习笔记_43——责任链模式 文章目录 一、核心概念1. 定义2. 解决的问题3. 核心角色4. 类图 二、特点分析三、适用场景1. 事务管理系统2. 多媒体遥控器3. 操作审计系统 四、Go语言实现示例五、高级应用…...

算法中的背包问题详解:部分背包与0-1背包

1. 背包问题概述 背包问题是组合优化中的经典问题,其核心目标是:在给定容量的背包中装入一组物品,使得物品的总价值最大化。根据物品是否可分割或重复选择,背包问题分为多个变种,其中最常见的两种是: 部分…...

【单片机通信技术】STM32 HAL库 SPI主从机通过串口发送数据

一、说明 使用STM32F103C8T6最小系统板,让板载SPI1与SPI2通信,通过串口收发数据。本文章说明了在配置与编写时遇到的一些问题,以及详细说明如何使用cubeMAX进行代码编写。 二、CubeMAX配置 1.时钟配置选择外部高速时钟 2.系统模式与时钟配…...

laravel中 添加公共/通用 方法/函数

一,现在app 下面创建Common目录,然后在创建Common.php 文件 二,修改composer.json文件 添加这个到autoload 中 "files": ["app/Common/Common.php"]"autoload": {"psr-4": {"App\\": &quo…...

Jetpack Compose — 入门实践

一、项目中使用 Jetpack Compose 从此节开始,为方便起见,如无特殊说明,Compose 均指代 Jetpack Compose。 开发工具: Android Studio 1.1 创建支持 Compose 新应用 新版 Android Studio 默认创建新项目即为 Compose 项目。 注意:在 Language 下拉菜单中,Kotlin 是唯一可…...

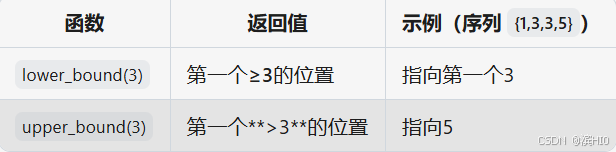

P8686 [蓝桥杯 2019 省 A] 修改数组--并查集 or Set--lower_bound()的解法!!!

P8686 [蓝桥杯 2019 省 A] 修改数组--并查集 题目 并查集解析代码【并查集解】 Set 解法解析lower_bound代码 题目 并查集解析 首先先让所有的f(i)i,即每个人最开始的祖先都是自己,然后就每一次都让轮到那个数的父亲1(…...

应用案例 | 精准控制,高效运行—宏集智能控制系统助力SCARA机器人极致性能

概述 随着工业4.0的深入推进,制造业对自动化和智能化的需求日益增长。传统生产线面临空间不足、效率低下、灵活性差等问题,尤其在现有工厂改造项目中,如何在有限空间内实现高效自动化成为一大挑战。 此次项目的客户需要在现有工厂基础上进行…...