李沐-动手学深度学习:RNN

1.RNN从零开始实现

import math

import torch

from torch import nn

from torch.nn import functional as F

from d2l import torch as d2l#8.3.4节

#batch_size:每个小批量中子序列样本的数目,num_steps:每个子序列中预定义的时间步数

#load_data_time_machine函数:返回数据迭代器和词表

batch_size,num_steps = 32,35

train_iter,vocab = d2l.load_data_time_machine(batch_size,num_steps)#此向量是原始词元的一个独热向量。 索引为0和2的独热向量如下所示:

F.one_hot(torch.tensor([0,2]),len(vocab))#8.5.1独热编码

#one_hot函数将这样一个小批量数据转换成三维张量, 张量的最后一个维度等于词表大小(len(vocab))。

#经常转换输入的维度,以便获得形状为 (时间步数,批量大小,词表大小)的输出

X = torch.arange(10).reshape((2,5))

F.one_hot(X.T,28).shape#8.5.2初始化循环神经网络模型的模型参数。

# 隐藏单元数num_hiddens是一个可调的超参数。

#当训练语言模型时,输入和输出来自相同的词表。因此,它们具有相同的维度,即词表的大小。

def get_params(vocab_size,num_hiddens,device):num_inputs = num_outputs = vocab_sizedef normal(shape):return torch.randn(size=shape,device=device)*0.01#隐藏层参数W_xh = normal((num_inputs,num_hiddens))W_hh = normal((num_hiddens,num_hiddens))b_h = torch.zeros(num_hiddens,device=device)#输出层参数W_hq = normal((num_hiddens,num_outputs))b_q = torch.zeros(num_outputs,device=device)#附加梯度params = [W_xh,W_hh,b_h,W_hq,b_q]for param in params:param.requires_grad_(True)return params#8.5.3循环神经网络模型

#init_rnn_state函数在初始化时返回隐状态,返回一个张量,全用0填充,形状为(批量大小,隐藏单元数)

def init_rnn_state(batch_size,num_hiddens,device):return (torch.zeros((batch_size,num_hiddens),device),)

#rnn函数定义了如何在一个时间步内计算隐状态和输出。

#循环神经网络模型通过inputs最外层的维度实现循环,以便逐时间步更新小批量数据的隐状态.

def rnn(inputs,state,params):#input的形状:(时间步数量,批量大小,词表大小)W_xh,W_hh,b_h,W_hq,b_q = paramsH,=stateoutputs = []#X的形状:(批量大小,词表大小)for X in inputs:H = torch.tanh(torch.mm(X,W_xh)+torch.mm(H,W_hh)+b_h)Y = torch.mm(H,W_hq) + b_qoutputs.append(Y)return torch.cat(outputs,dim=0),(H,)

#定义了所有需要的函数之后,创建类来包装这些函数,并存储从零开始实现的循环神经网络模型的参数。

class RNNModelScratch:#@save"""从零开始实现的循环神经网络模型"""def __init__(self,vocab_size,num_hiddens,device,get_params,init_state,forward_fn):self.vocab_size,self.num_hiddens = vocab_size,num_hiddensself.params = get_params(vocab_size,num_hiddens,device)self.init_state,self.forward_fn = init_state,forward_fndef __call__(self, X, state):X = F.one_hot(X.T,self.vocab_size).type(torch.float32)return self.forward_fn(X,state,self.params)def begin_state(self,batch_size,device):return self.init_state(batch_size,self.num_hiddens,device)#检查输出是否具有正确的形状。例如,隐状态的维数是否保持不变。

num_hiddens = 512

net = RNNModelScratch(len(vocab),num_hiddens,d2l.try_gpu(),get_params,init_rnn_state,rnn)

state = net.begin_state(X.shape[0],d2l.try_gpu())

Y, new_state = net(X.to(d2l.try_gpu()),state)

Y.shape,len(new_state),new_state[0].shape

#输出形状是(时间步数times,批量大小,词表大小),而隐状态形状保持不变,即(批量大小,隐藏单元数)#8.5.4.预测

#首先定义预测函数来生成prefix之后的新字符,其中的prefix是一个用户提供的包含多个字符的字符串

#循环遍历prefix中的开始字符时,不断将隐状态传递到下一个时间步,但不生成任何输出(预热(warm-up)期)

def predict_ch8(prefix,num_preds,net,vocab,device):#@save"""在prefix后面生成新字符"""state = net.begin_state(batch_size=1,device=device)outputs = [vocab[prefix[0]]]get_input = lambda : torch.tensor([outputs[-1]],device=device).reshape((1,1))for y in prefix[1:]: #预热期_,state = net(get_input(),state)outputs.append(vocab[y])for _ in range(num_preds): #预测num_preds步y,state = net(get_input(),state)outputs.append(int(y.argmax(dim=1).reshape(1)))return ''.join([vocab.idx_to_token[i] for i in outputs])

#测试predict_ch8函数。将前缀指定为time traveller,并生成10个后续字符。鉴于还没训练网络,会生成荒谬的预测结果。

predict_ch8('time traveller',10,net,vocab,d2l.try_gpu())#8.5.5. 梯度截断

def grad_clipping(net,theta): #@save"""梯度截断"""if isinstance(net,nn.Module):params = [p for p in net.parameters() if p.requires_grad]else:params = net.paramsnorm = torch.sqrt(sum(torch.sum((p.grad ** 2)) for p in params))if norm > theta:for param in params:param.grad[:] *= theta / norm#8.5.6.训练

#@save

def train_epoch_ch8(net, train_iter, loss, updater, device, use_random_iter):"""训练网络一个迭代周期(定义见第8章)"""state, timer = None, d2l.Timer()metric = d2l.Accumulator(2) # 训练损失之和,词元数量for X, Y in train_iter:if state is None or use_random_iter:# 在第一次迭代或使用随机抽样时初始化statestate = net.begin_state(batch_size=X.shape[0], device=device)else:if isinstance(net, nn.Module) and not isinstance(state, tuple):# state对于nn.GRU是个张量state.detach_()else:# state对于nn.LSTM或对于我们从零开始实现的模型是个张量for s in state:s.detach_()y = Y.T.reshape(-1)X, y = X.to(device), y.to(device)y_hat, state = net(X, state)l = loss(y_hat, y.long()).mean()if isinstance(updater, torch.optim.Optimizer):updater.zero_grad()l.backward()grad_clipping(net, 1)updater.step()else:l.backward()grad_clipping(net, 1)# 因为已经调用了mean函数updater(batch_size=1)metric.add(l * y.numel(), y.numel())return math.exp(metric[0] / metric[1]), metric[1] / timer.stop()#@save

def train_ch8(net, train_iter, vocab, lr, num_epochs, device,use_random_iter=False):"""训练模型(定义见第8章)"""loss = nn.CrossEntropyLoss()animator = d2l.Animator(xlabel='epoch', ylabel='perplexity',legend=['train'], xlim=[10, num_epochs])# 初始化if isinstance(net, nn.Module):updater = torch.optim.SGD(net.parameters(), lr)else:updater = lambda batch_size: d2l.sgd(net.params, lr, batch_size)predict = lambda prefix: predict_ch8(prefix, 50, net, vocab, device)# 训练和预测for epoch in range(num_epochs):ppl, speed = train_epoch_ch8(net, train_iter, loss, updater, device, use_random_iter)if (epoch + 1) % 10 == 0:print(predict('time traveller'))animator.add(epoch + 1, [ppl])print(f'困惑度 {ppl:.1f}, {speed:.1f} 词元/秒 {str(device)}')print(predict('time traveller'))print(predict('traveller'))#因为数据集中只使用了10000个词元,所以模型需要更多的迭代周期来更好地收敛。

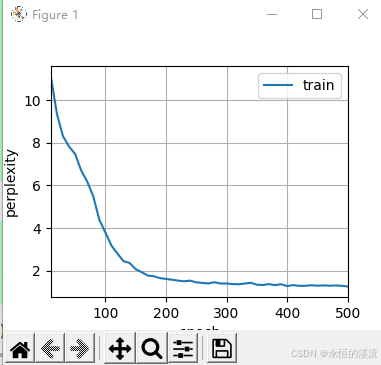

num_epochs,lr = 500,1

train_ch8(net,train_iter,vocab,lr,num_epochs,d2l.try_gpu())#检查一下使用随机抽样方法的结果

net = RNNModelScratch(len(vocab),num_hiddens,d2l.try_gpu(),get_params,init_rnn_state,rnn)

train_ch8(net,train_iter,vocab,lr,num_epochs,d2l.try_gpu(),use_random_iter=True)

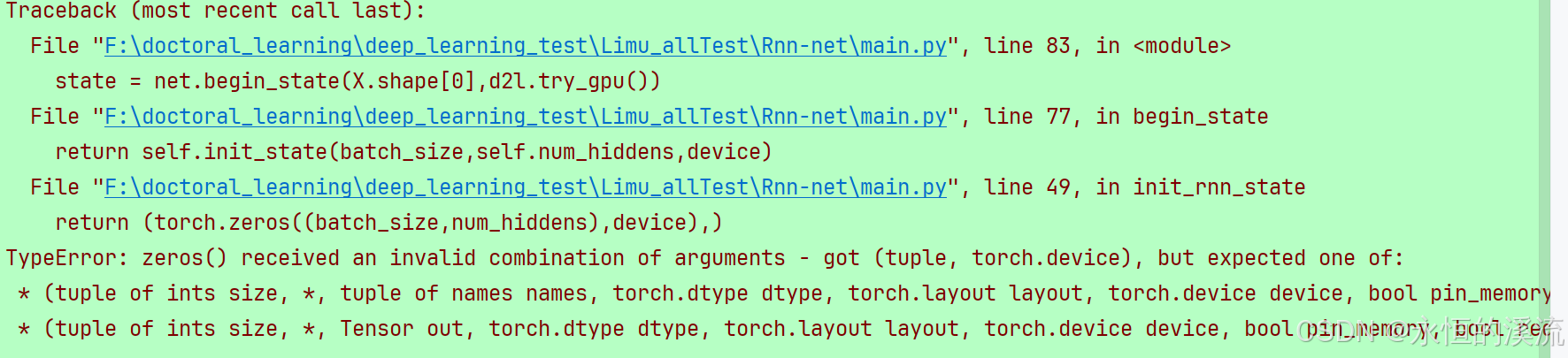

Traceback (most recent call last):

File "F:\doctoral_learning\deep_learning_test\Limu_allTest\Rnn-net\main.py", line 83, in <module>

state = net.begin_state(X.shape[0],d2l.try_gpu())

File "F:\doctoral_learning\deep_learning_test\Limu_allTest\Rnn-net\main.py", line 77, in begin_state

return self.init_state(batch_size,self.num_hiddens,device)

File "F:\doctoral_learning\deep_learning_test\Limu_allTest\Rnn-net\main.py", line 49, in init_rnn_state

return (torch.zeros((batch_size,num_hiddens),device),)

TypeError: zeros() received an invalid combination of arguments - got (tuple, torch.device), but expected one of:

* (tuple of ints size, *, tuple of names names, torch.dtype dtype, torch.layout layout, torch.device device, bool pin_memory, bool requires_grad)

* (tuple of ints size, *, Tensor out, torch.dtype dtype, torch.layout layout, torch.device device, bool pin_memory, bool requires_grad)

太麻烦了,不改了。

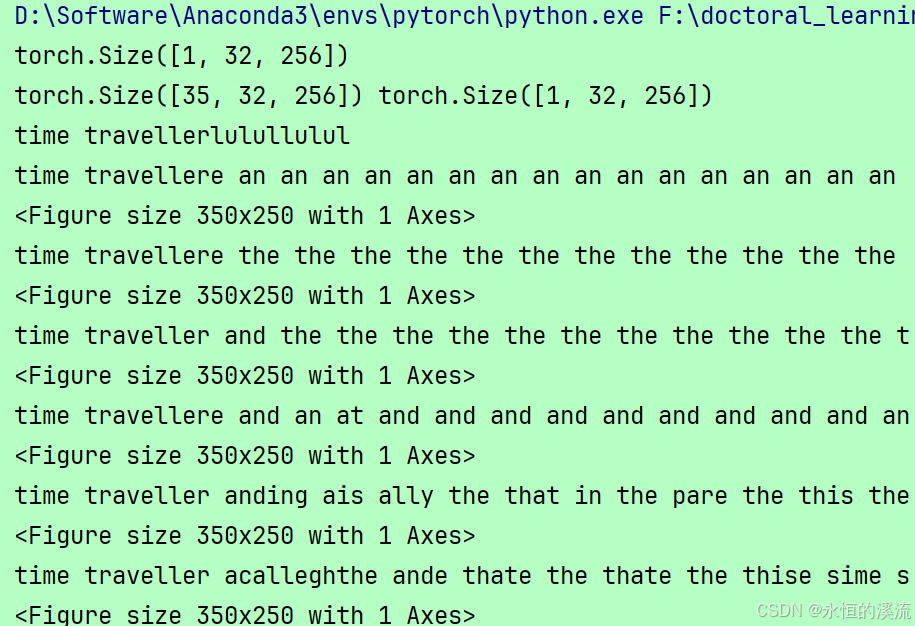

2.RNN的简洁实现

#8.6.循环神经网络的简洁实现

import torch

from torch import nn

from torch.nn import functional as F

from d2l import torch as d2lbatch_size,num_steps = 32,35

train_iter,vocab = d2l.load_data_time_machine(batch_size,num_steps)#构造一个具有256个隐藏单元的单隐藏层的循环神经网络层rnn_layer

num_hiddens = 256

rnn_layer = nn.RNN(len(vocab),num_hiddens)

#使用张量来初始化隐状态,它的形状是(隐藏层数,批量大小,隐藏单元数)。

state = torch.zeros((1,batch_size,num_hiddens))

print(state.shape)

#通过一个隐状态和一个输入,我们就可以用更新后的隐状态计算输出。

#rnn_layer的“输出”(Y)不涉及输出层的计算:指每个时间步的隐状态,这些隐状态可以用作后续输出层的输入。

X = torch.rand(size=(num_steps,batch_size,len(vocab)))

Y,state_new = rnn_layer(X,state)

print(Y.shape,state_new.shape)

#与 8.5节类似,为一个完整的循环神经网络模型定义了一个RNNModel类。

#注意,rnn_layer只包含隐藏的循环层,还需要创建一个单独的输出层。

class RNNModel(nn.Module):"""循环神经网络模型"""def __init__(self,run_layer,vocab_size,**kwargs):super(RNNModel,self).__init__(**kwargs)self.rnn = rnn_layerself.vocab_size = vocab_sizeself.num_hiddens = self.rnn.hidden_size#如果RNN是双向的(之后将介绍),num_directions应该是2,否则应该是1if not self.rnn.bidirectional:self.num_directions = 1self.linear = nn.Linear(self.num_hiddens ,self.vocab_size)else:self.num_directions = 2self.linear = nn.Linear(self.num_hiddens * 2, self.vocab_size)def forward(self,inputs,state):X = F.one_hot(inputs.T.long(),self.vocab_size)X = X.to(torch.float32)Y,state = self.rnn(X,state)#全连接层首先将Y的形状改为(时间步数*批量大小,隐藏单元数)output = self.linear(Y.reshape((-1,Y.shape[-1])))return output,statedef begin_state(self,device,batch_size=1):if not isinstance(self.rnn,nn.LSTM):#nn.GRU以张量作为隐状态return torch.zeros((self.num_directions * self.rnn.num_layers,batch_size,self.num_hiddens),device = device)else:#nn.LSTM以元组作为隐状态return (torch.zeros((self.num_directions * self.rnn.num_layers,batch_size,self.num_hiddens),device = device),torch.zeros((self.num_directions * self.rnn.num_layers,batch_size,self.num_hiddens),device = device))

#在训练模型之前,基于一个具有随机权重的模型进行预测。

device = d2l.try_gpu()

net = RNNModel(rnn_layer, vocab_size=len(vocab))

net = net.to(device)

print(d2l.predict_ch8('time traveller',10,net,vocab,device))

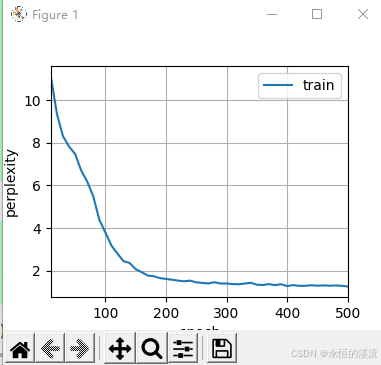

#这种模型根本不能输出好的结果。接下来,使用 8.5节定义的超参数调用train_ch8,并且使用高级API训练模型。

num_epochs,lr = 500,1

print(d2l.train_ch8(net,train_iter,vocab,lr,num_epochs,device))

d2l.plt.show()

相关文章:

李沐-动手学深度学习:RNN

1.RNN从零开始实现 import math import torch from torch import nn from torch.nn import functional as F from d2l import torch as d2l#8.3.4节 #batch_size:每个小批量中子序列样本的数目,num_steps:每个子序列中预定义的时间步数 #loa…...

Windows系统下npm报错node-gyp configure got “gyp ERR“解决方法

感谢原博主,此文参考网址:https://zhuanlan.zhihu.com/p/398279220 确保已经安装node.js (官方网址:https://nodejs.org/zh-cn/download) 首先在命令窗口执行命令安装windows-build-tools: npm install -…...

介绍)

Elasticsearch中的文档(Document)介绍

在Elasticsearch(ES)中,文档(Document)是最基本的数据单元,类似于关系型数据库中的“行”。它以JSON格式存储,包含多个字段(Field),每个字段可以是不同类型(如文本、数值、日期等)。文档是索引(Index)的组成部分,通过唯一ID标识,并支持动态映射(Dynamic Mappi…...

15个基于场景的 DevOps 面试问题及答案

第一部分:持续集成和部署 (CI/CD) 场景 1:构建中断 “您的 CI 流水线突然出现‘找不到依赖项’的错误。您会如何处理这个问题?” 回答:首先,我会检查是否有新的依赖项被添加到需求文件中,但这些依赖项并未包含在需求文件中。我还会验证构建服务器是否可以访问互联网来下…...

)

今日主题二分查找(寻找峰值 力扣162)

峰值元素是指其值严格大于左右相邻值的元素。 给你一个整数数组 nums,找到峰值元素并返回其索引。数组可能包含多个峰值,在这种情况下,返回 任何一个峰值 所在位置即可。 你可以假设 nums[-1] nums[n] -∞ 。 你必须实现时间复杂度为 O(…...

【教学类-36-10】20250531蝴蝶图案描边,最适合大小(一页1图1图、2图图案不同、2图图案相同对称)

背景说明: 之前做了动物头像扇子(描边20),并制作成一页一套图案对称两张 【教学类-36-09】20250526动物头像扇子的描边(通义万相)对称图40张,根据图片长宽,自动旋转图片,最大化图片-CSDN博客文章浏览阅读1k次,点赞37次,收藏6次。【教学类-36-09】20250526动物头像…...

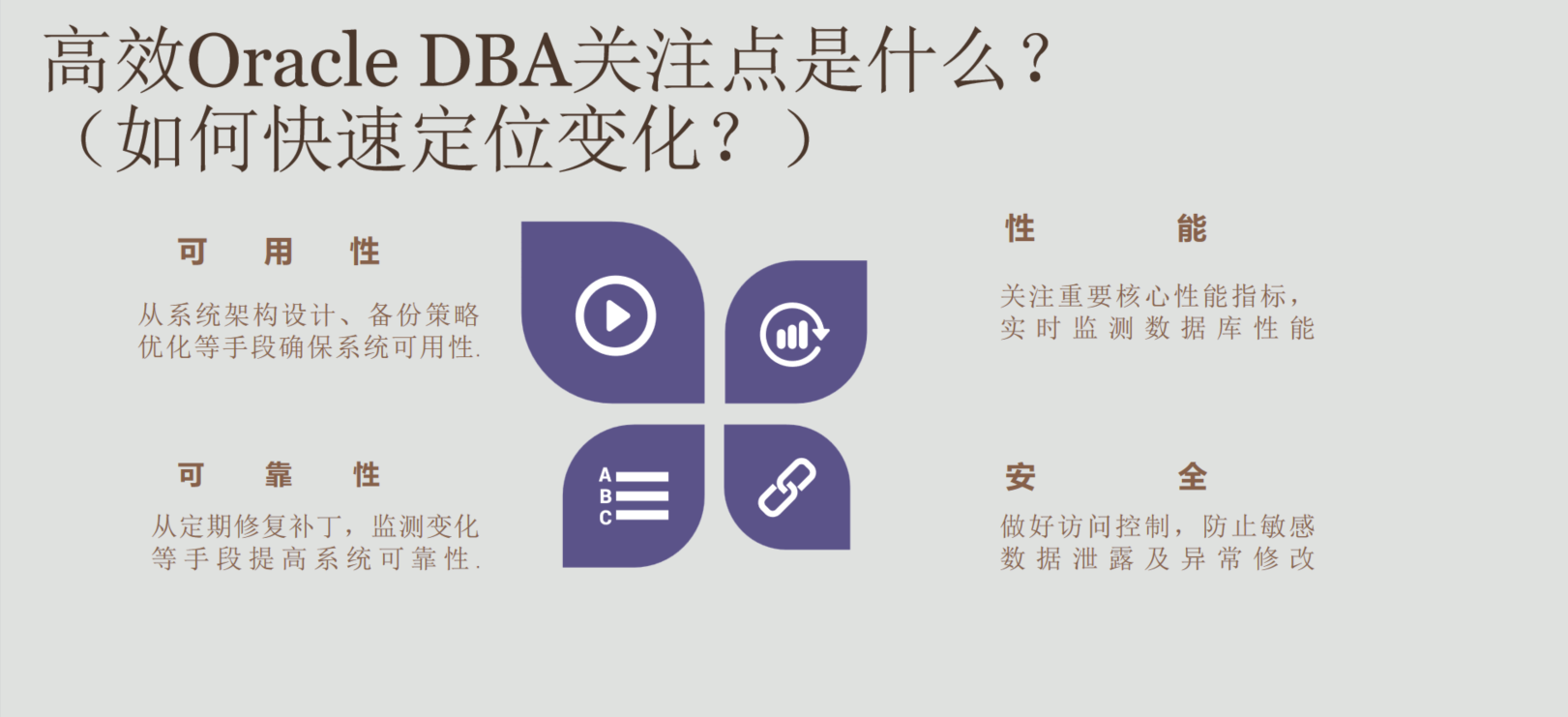

高效DBA的日常运维主题沙龙

2024年11月10日,在宁波组织了高效DBA的日常运维沙龙活动,大概有20人左右现场参加。会议的主题为: 目标: 1、识别高频低效操作并制定自动化方案 2、建立关键运维指标健康度体系 3、输出可立即落地的优化清单 会议议程 一、效能瓶…...

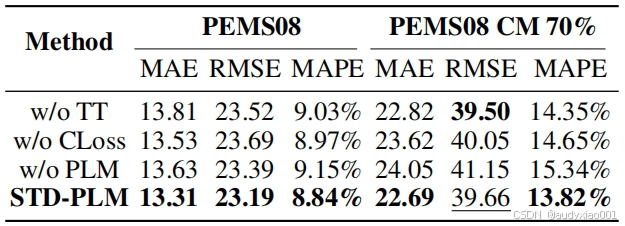

AAAI 2025论文分享│STD-PLM:基于预训练语言模型的时空数据预测与补全方法

本文详细介绍了一篇发表于人工智能顶级会议AAAI 2025的论文《STD-PLM: Understanding Both Spatial and Temporal Properties of Spatial-Temporal Data with PLM》。该论文提出了一种基于预训练语言模型(Pre-trained Language Model,PLM)的…...

Ethernet/IP转DeviceNet网关:驱动大型矿山自动化升级的核心纽带

在大型矿山自动化系统中,如何高效整合新老设备、打通数据孤岛、实现统一控制,是提升效率与安全的关键挑战。JH-EIP-DVN疆鸿智能EtherNet/IP转DeviceNet网关,正是解决这一难题的核心桥梁,为矿山各环节注入强劲连接力: …...

Android 11以上App主动连接WIFI的完整方案

早期Android版本App内连接指定的WIFI还是比较简单的,但是随着Android版本的提升,限制也越来越多。以下是一套完整的Android 11以上的WIFI应用内主动连接方案。 第一步:添加到建议连接: val wifiManager getSystemService(WIFI_…...

[蓝桥杯]模型染色

模型染色 题目描述 在电影《超能陆战队》中,小宏可以使用他的微型机器人组合成各种各样的形状。 现在他用他的微型机器人拼成了一个大玩具给小朋友们玩。为了更加美观,他决定给玩具染色。 小宏的玩具由 nn 个球型的端点和 mm 段连接这些端点之间的边…...

力扣上C语言编程题

一. 简介 本文简单记录一下力扣上 C语言编程题。作为自己做题笔记。 二. 力扣上 C 语言编程题 1. 从数组中找到两个元素之和,等于一个 target目标值 具体题目说明:给定一个整数数组 nums 和一个整数目标值 target,请你在该数组中找出 和为…...

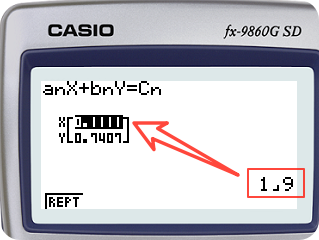

卡西欧模拟器:Windows端功能强大的计算器

引言 大家还记得初中高中时期用的计算器吗?今天给大家分享的就是一款windows端的卡西欧计算器。 软件介绍 大家好,我是逍遥小欢。 CASIO fx-9860G是一款功能强大的图形计算器,适用于数学、科学和工程计算。以下是其主要功能和特点的详细介…...

鸿蒙OSUniApp结合机器学习打造智能图像分类应用:HarmonyOS实践指南#三方框架 #Uniapp

UniApp结合机器学习打造智能图像分类应用:HarmonyOS实践指南 引言 在移动应用开发领域,图像分类是一个既经典又充满挑战的任务。随着机器学习技术的发展,我们现在可以在移动端实现高效的图像分类功能。本文将详细介绍如何使用UniApp结合Ten…...

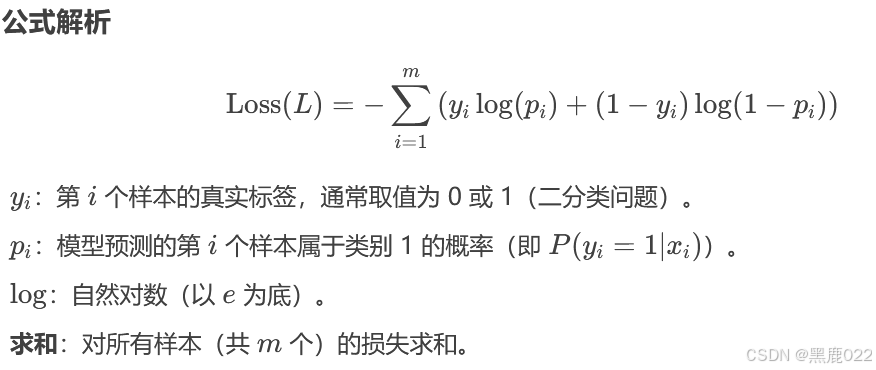

机器学习基础(三) 逻辑回归

目录 逻辑回归的概念核心思想 Sigmoid 函数 逻辑回归的原理和底层优化手段伯努利分布最大似然估计 Maximum Likelihood Estimation (MLE)伯努利分布的似然函数交叉熵损失函数(Cross-Entropy Loss),也称为 对数损失&…...

系统调试——ADB 工具

ADB 工具 1.1 概述 ADB(Android Debug Bridge) 是 Android SDK 里的一个工具, 用这个工具可以操作管理Android 模拟器或真实的 Android 设备。 主要功能有: 运行设备的 shell(命令行)管理模拟器或设备的端…...

Qwen-3 微调实战:用 Python 和 Unsloth 打造专属 AI 模型

虽然大家都忙着在 DeepSeek 上构建应用,但那些聪明的开发者们却悄悄发现了 Qwen-3 的微调功能,这可是一个隐藏的宝藏,能把通用型 AI 变成你的专属数字专家。 通过这篇文章,你将学到如何针对特定用途微调最新的 Qwen-3 模型。无论…...

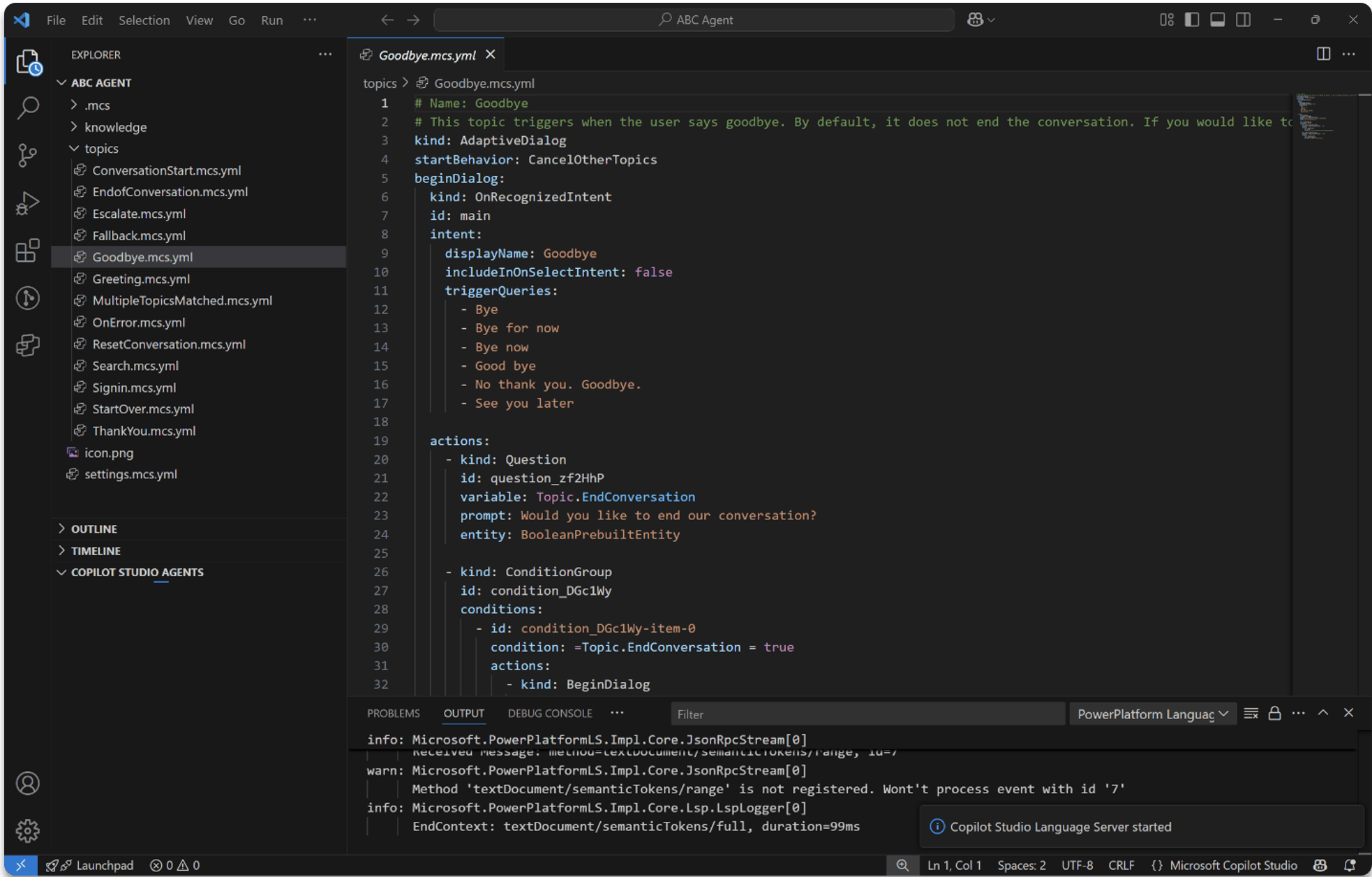

微软Build 2025:Copilot Studio升级,解锁多智能体协作未来

微软Build 2025大会圆满落幕,作为年度科技盛会,它一直是开发与AI技术突破性创新的重要展示平台。对于工程师、创作者和领域专家来说,这是了解微软生态未来动向的关键时刻。今年,Microsoft Copilot Studio推出了一系列新功能&#…...

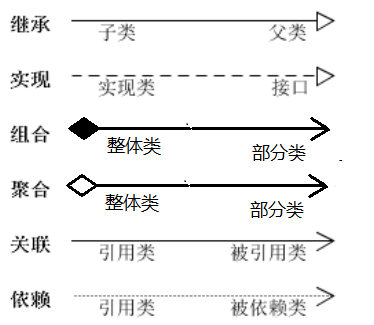

设计模式——系统数据建模设计

摘要 本文主要介绍了UML在软件系统分析和设计中的应用,详细阐述了六大类关系(泛化、实现、依赖、关联、聚合、组合)及其在UML类图中的表示方法,并通过具体例子说明了这些关系在实际编程中的应用。同时,文章还概述了UM…...

解决docker运行zentao 报错:ln: failed to create symbolic link ‘/opt/zbox/tmp/mysq

1 背景描述 禅道使用docker部署运行过一段,服务正常。 后因服务器断电重启,禅道服务也随docker一起启动,但是服务却无法访问。如下如: 2 查看日志,定位原因 查看禅道日志: # docker logs zentao容器di…...

Spring Boot MVC自动配置与Web应用开发详解

Spring Boot MVC自动配置机制 Spring Boot通过自动配置功能为MVC应用提供了开箱即用的默认配置,开发者无需手动配置即可获得完整的Web支持。以下是核心功能的实现原理: 静态资源支持 默认情况下,Spring Boot会自动从以下classpath目录提供…...

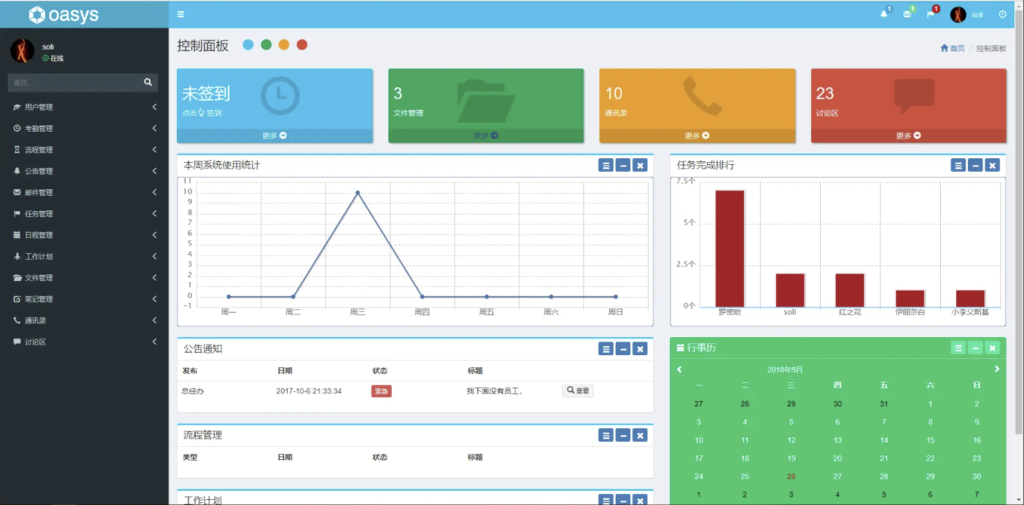

OA工程自动化办公系统 – 免费Java源码

概述 功能完备的OA工程自动化办公系统Java源码,采用主流技术栈开发,无论是学习SpringBoot框架还是开发企业级应用,都是不可多得的优质资源。 主要内容 技术架构 后端技术栈: 核心框架:SpringBoot 2.xORM框…...

Apache IoTDB V2.0.3 发布|新增元数据导入导出脚本适配表模型功能

Release Announcement Version 2.0.3 Apache IoTDB V2.0.3 已经发布! V2.0.3 作为树表双模型正式版本,主要新增元数据导入导出脚本适配表模型、Spark 生态集成(表模型)、AINode 返回结果新增时间戳,表模型新增部分聚…...

某校体育场馆结构自动化监测

1. 项目简介 某小学学校成立于2020年,是一所公办小学,以高起点定位为该区优质教育新增长极,依托当地学院及教师进修学院附属小学资源,注重学生综合素质培养,近年来,该小学聚焦“五育” 领域,不…...

MySQL 9.0 相较于 MySQL 8.0 引入了多项重要改进和新特性

MySQL 9.0 相较于 MySQL 8.0 引入了多项重要改进和新特性,以下是两者的主要区别及其详细说明: 1. 认证机制 MySQL 8.0 支持 mysql_native_password 和 caching_sha2_password 认证插件。默认使用 caching_sha2_password,但未完全移除 mysql_native_password。MySQL 9.0 完全…...

Android 3D球形水平圆形旋转,旋转动态更换图片

看效果图 1、事件监听类 OnItemClickListener:3D旋转视图项点击监听器接口 public interface OnItemClickListener {/*** 当旋转视图中的项被点击时调用** param view 被点击的视图对象* param position 被点击项在旋转视图中的位置索引(从0开始&a…...

数据结构与算法学习笔记(Acwing 提高课)----动态规划·树形DP

数据结构与算法学习笔记----动态规划树形DP author: 明月清了个风 first publish time: 2025.6.4 ps⭐️树形动态规划(树形DP)是处理树结构问题的一种动态规划方法,特征也很明显,会有一个树形结构,其实是DFS的优化。…...

FTP 和 SFTP 介绍及 C/C++ 实现分析

1. FTP 协议概述 FTP(File Transfer Protocol)是一种用于在网络上进行文件传输的标准协议,诞生于 1971 年,是互联网上最早的应用层协议之一。它基于客户端 - 服务器模型,使用 TCP 作为传输层协议,默认通过 …...

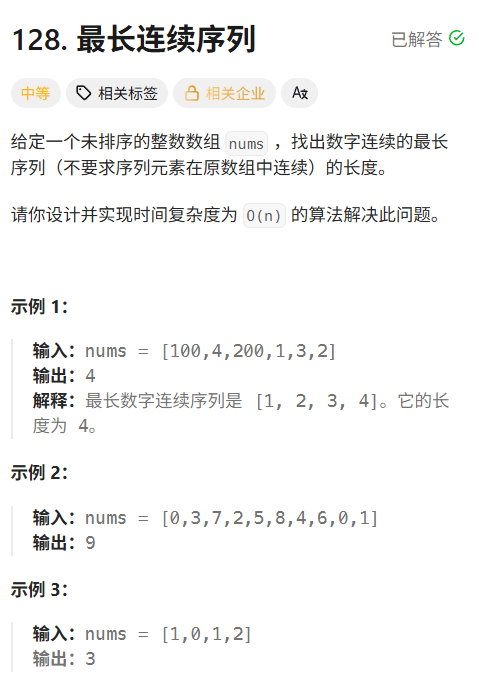

leetcode hot100刷题日记——36.最长连续序列

解答: 实际上在哈希表中存储不重复的数字。 然后遍历哈希表,找间隔,更新最大间隔。 class Solution { public:int longestConsecutive(vector<int>& nums) {unordered_set<int>hash;for(int num:nums){hash.insert(num);}in…...

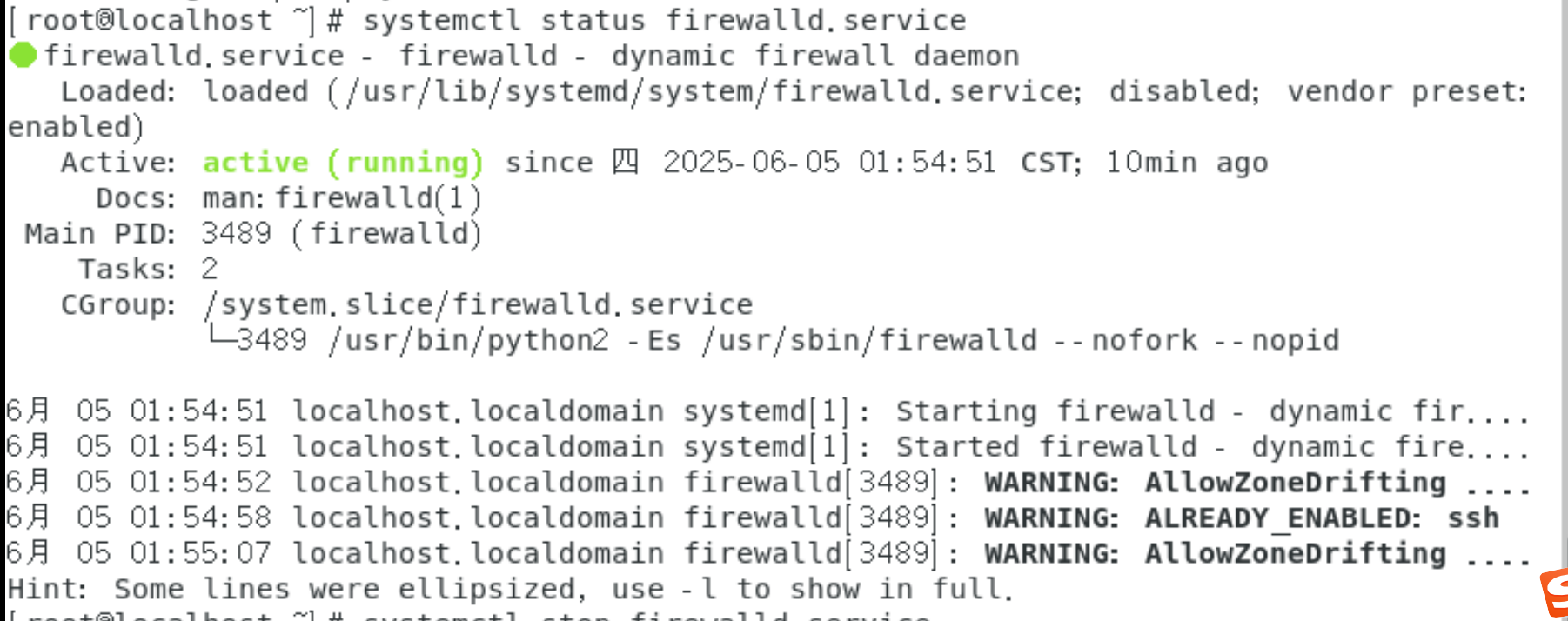

CentOS7关闭防火墙、Linux开启关闭防火墙

文章目录 一、firewalld开启、关闭防火墙1、查看防火墙状态 一、firewalld开启、关闭防火墙 以下命令在linux系统CentOS7中操作开启关闭防火墙 # 查询防火墙状态 systemctl status firewalld.service # 开启防火墙 systemctl start firewalld.service # 开机自启动防火墙 syste…...