日志分析系统——ELK

目录

一、ELK概述

ELK的组成

1、ElasticSearch

2、Logstash

3、Kiabana

完整日志采集系统基本特征

ELK的工作原理

二、ELK的部署

1、环境准备

2、部署ElasticSearch软件

3、安装Elasticsearch-head插件

4、Logstash部署

5、Kibana部署

三、Filebeat+ELK部署

1、安装Filebeat

2、设置 filebeat 的主配置文件

3、启动 filebeat

4、在 Logstash 组件所在节点上新建一个 Logstash 配置文件

一、ELK概述

ELK的组成

ELK是由 ElasticSearch、Logstash 和 Kiabana 三个开源工具所组成, 完成更强大的用户对日志的查询、排序、统计需求。

1、ElasticSearch

作用:存储日志数据,创建索引,方便全文检索

elasticsearch是基于Lucene(一个全文检索引擎的架构)开发的分布式存储检索引擎,用来存储各类日志。

ElasticSearch是使用java开发的,可通过RESTful Web接口,让用户可以通过浏览器与ElasticSearch通信

Elasticsearch是一个实时的、分布式的可扩展的搜索引擎,允许进行全文、结构化搜索,它通常用于索引和搜索大容量的日志数据,也可用于搜索许多不同类型的文档。

2、Logstash

作用:负责收集日志数据,通过模块对数据进行过滤、格式化处理,再输出

logstash作为数据收集引擎。它支持动态的从各种数据源搜集数据,并对数据进行过滤、分析、丰富、统一格式等操作,然后存储到用户指定的位置,一般会发送给 Elasticsearch。

Logstash 由 Ruby 语言编写,运行在 Java 虚拟机(JVM)上,是一款强大的数据处理工具, 可以实现数据传输、格式处理、格式化输出。Logstash 具有强大的插件功能,常用于日志处理。

可以添加的其它组件:

Filebeat:轻量级的开源日志文件数据搜集器。通常在需要采集数据的客户端安装 Filebeat,并指定目录与日志格式,Filebeat 就能快速收集数据,并发送给 logstash 进行解析,或是直接发给 Elasticsearch 存储,性能上相比运行于 JVM 上的 logstash 优势明显,是对它的替代。常应用于 EFLK 架构当中。

filebeat 结合 logstash 带来好处:

1)通过 Logstash 具有基于磁盘的自适应缓冲系统,该系统将吸收传入的吞吐量,从而减轻 Elasticsearch 持续写入数据的压力

2)从其他数据源(例如数据库,S3对象存储或消息传递队列)中提取

3)将数据发送到多个目的地,例如S3,HDFS(Hadoop分布式文件系统)或写入文件

4)使用条件数据流逻辑组成更复杂的处理管道

缓存/消息队列(redis、kafka、RabbitMQ等):可以对高并发日志数据进行流量削峰和缓冲,这样的缓冲可以一定程度的保护数据不丢失,还可以对整个架构进行应用解耦。

Fluentd:是一个流行的开源数据收集器。由于 logstash 太重量级的缺点,Logstash 性能低、资源消耗比较多等问题,随后就有 Fluentd 的出现。相比较 logstash,Fluentd 更易用、资源消耗更少、性能更高,在数据处理上更高效可靠,受到企业欢迎,成为 logstash 的一种替代方案,常应用于 EFK 架构当中。在 Kubernetes 集群中也常使用 EFK 作为日志数据收集的方案。

在 Kubernetes 集群中一般是通过 DaemonSet 来运行 Fluentd,以便它在每个 Kubernetes 工作节点上都可以运行一个 Pod。 它通过获取容器日志文件、过滤和转换日志数据,然后将数据传递到 Elasticsearch 集群,在该集群中对其进行索引和存储。

Logstash配置文件由三部分组成

1)input:表示从数据源采集数据,常见的数据源如Kafka、日志文件等 (file beats kafka redis stdin)

格式如下:

input { #指定两个日志来源

file { path =>"/var/log/messages" type =>"syslog"} #日志来源为syslog

file { path =>"/var/log/httpd/access.log" type =>"apache"} #日志来源apache服务

}

2)filter:表示数据处理层,包括对数据进行格式化处理、数据类型转换、数据过滤等,支持正则表达式。(可选,根据需要选择使用)

filter中的插件有:grok、date、mutate、mutiline

- grok:对若干个大文本字段进行再分割成一些小字段

(?<字段名>正则表达式) 字段名: 正则表达式匹配到的内容 - mutate:对一些无用的字段进行剔除,或增加字段

- mutiline:对多行数据进行统一编排,多行合并或拆分(将多行数据合并在一行显示)

- data:对数据中的事件格式化进行统一和格式化

3)output:表示将logstash收集的数据经由过滤器处理之后输出道ElasticSearch。

3、Kiabana

作用:负责从elasticsearch中提取数据,并在web页面进行数据展示

Kibana 通常与 Elasticsearch 一起部署,Kibana 是 Elasticsearch 的一个功能强大的数据可视化 Dashboard,Kibana 提供图形化的 web 界面来浏览 Elasticsearch 日志数据,可以用来汇总、分析和搜索重要数据。

完整日志采集系统基本特征

收集:能够采集多种来源的日志数据

传输:能够稳定的把日志数据解析过滤并传输到存储系统

存储:存储日志数据

分析:支持 UI 分析

警告:能够提供错误报告,监控机制

ELK的工作原理

(1)在所有需要收集日志的服务器上部署Logstash;或者先将日志进行集中化管理在日志服务器上,在日志服务器上部署 Logstash。

(2)Logstash 收集日志,将日志格式化并输出到 Elasticsearch 群集中。

(3)Elasticsearch 对格式化后的数据进行索引和存储。

(4)Kibana 从 ES 群集中查询数据生成图表,并进行前端数据的展示。

二、ELK的部署

| 主机名 | IP地址 | 部署的应用 |

| node01 | 192.168.3.101 | ElasticSearch、kibana |

| node02 | 192.168.3.102 | ElasticSearch |

| apache | 192.168.3.100 | Logstash、Apache |

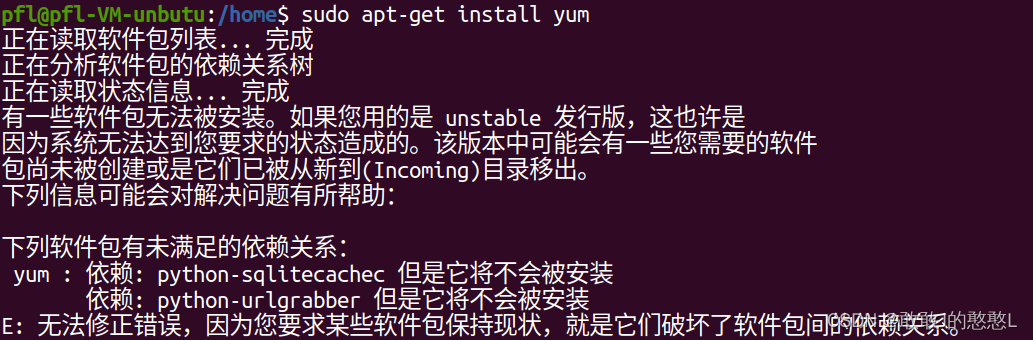

1、环境准备

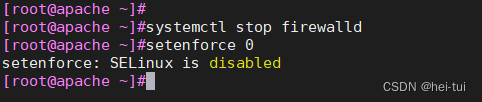

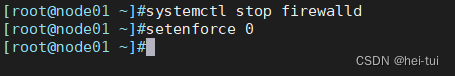

关闭防火墙和selinux,安装java环境(所有节点上都要做)

systemctl stop firewalld #关闭防火墙

setenforce 0 #关闭selinuxjava -version #查看java的版本

yum install -y java #若没有安装,安装java就好

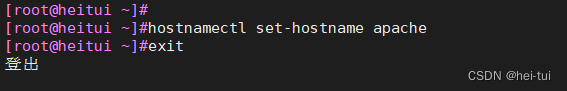

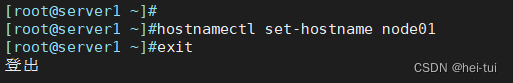

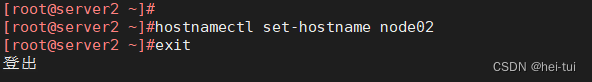

#apache节点修改主机名hostnamectl set-hostname apache

#node01节点修改主机名

hostnamectl set-hostname node01

#node02节点修改主机名

hostnamectl set-hostname node02

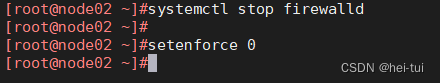

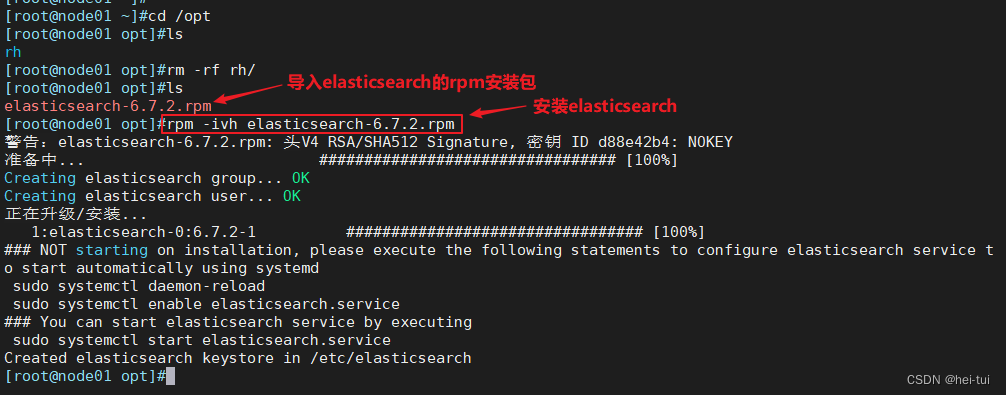

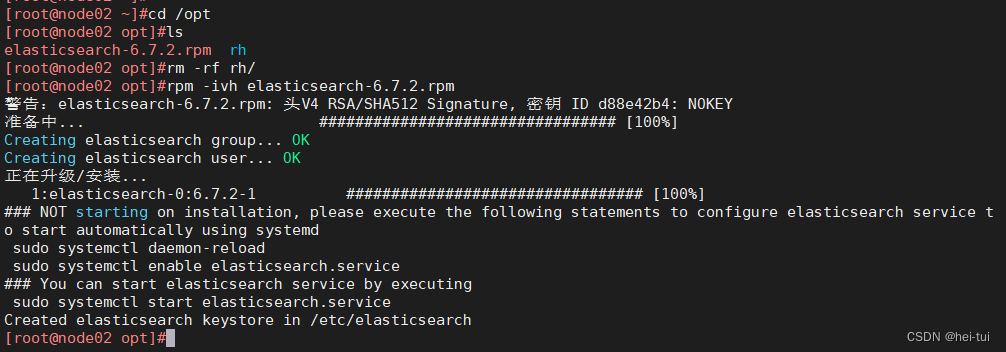

2、部署ElasticSearch软件

1)安装ElasticSearch软件(node01,node02节点上安装)

#首先传入rpm安装包到节点上的opt目录下

cd /opt

rpm -ivh elasticsearch-6.7.2.rpm #安装elasticsearch

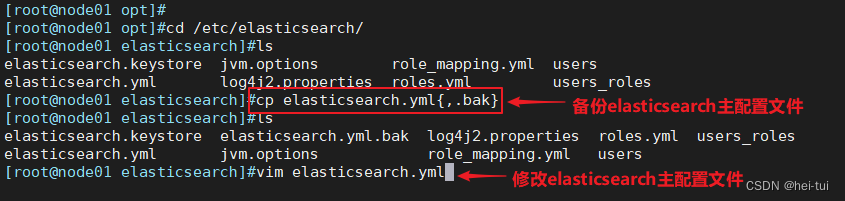

2)修改es的主配置文件

修改elasticsearch主配置文件,以下是node01节点上的配置,node02上的配置与node01上的配置几乎一样,只有23行的node.name的值与57行监听的地址可以都写0.0.0.0,也可以写本机的地址

#修改elasticsearch主配置文件

cp /etc/elasticsearch/elasticsearch.yml{,.bak} #先将原来的配置文件备份一份

vim /etc/elasticsearch/elasticsearch.yml #修改配置文件

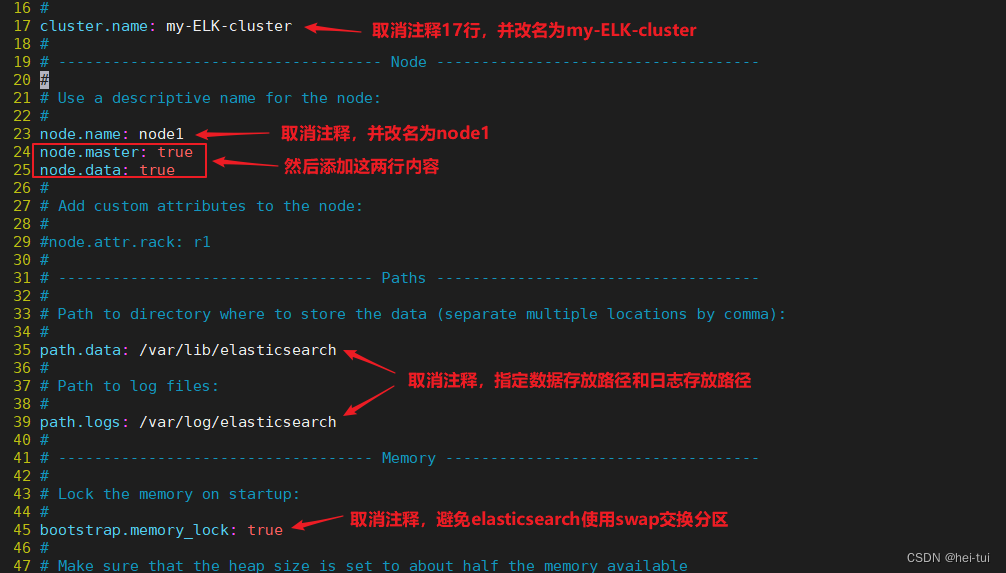

--17--取消注释,指定集群名字

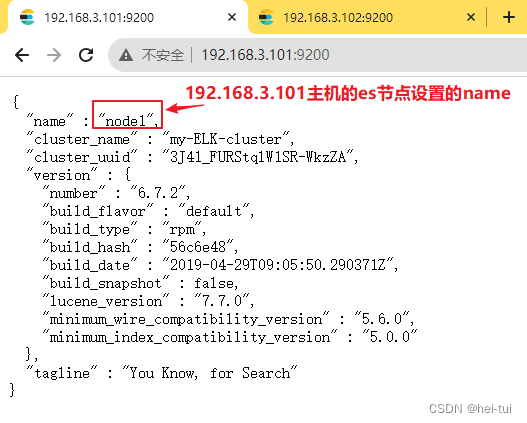

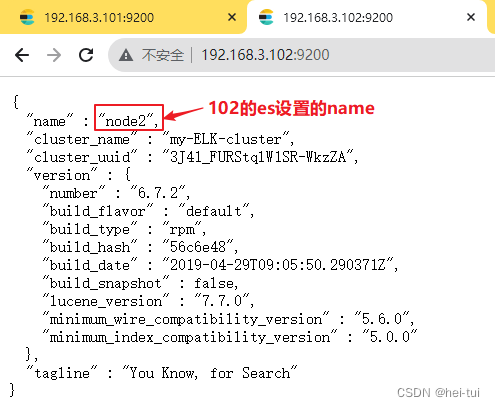

cluster.name: my-elk-cluster

--23--取消注释,指定节点名字:Node1节点为node1,Node2节点为node2

node.name: node1

node.master: true #是否master节点,false为否

node.data: true #是否数据节点,false为否

--35--取消注释,指定数据存放路径

path.data: /var/lib/elasticsearch

--39--取消注释,指定日志存放路径

path.logs: /var/log/elasticsearch

--45--取消注释,避免es使用swap交换分区

bootstrap.memory_lock: true

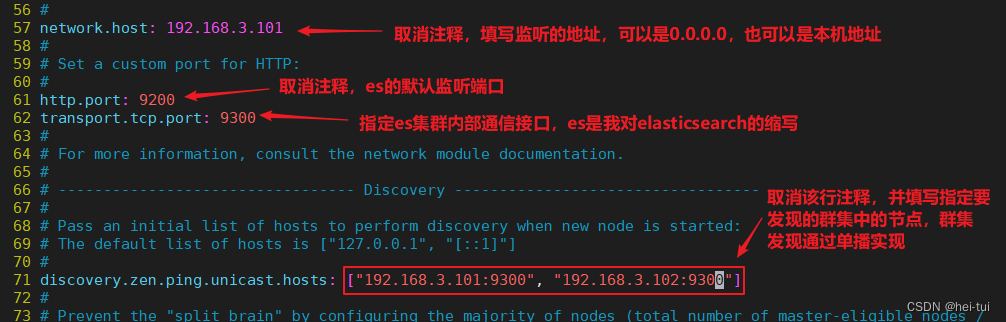

--57--取消注释,设置监听地址,0.0.0.0代表所有地址,也可以写本机地址

network.host: 0.0.0.0

--61--取消注释,ES 服务的默认监听端口为9200

http.port: 9200 #指定es集群提供外部访问的接口

transport.tcp.port: 9300 #指定es集群内部通信接口

--70--取消注释,集群发现通过单播实现,指定要发现的节点

discovery.zen.ping.unicast.hosts: ["192.168.3.101:9300", "192.168.3.102:9300"]

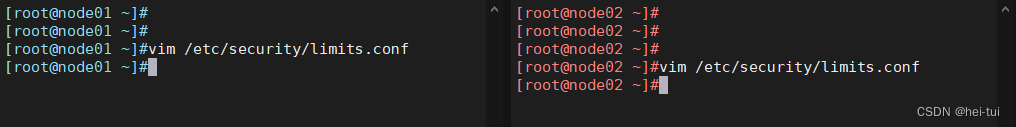

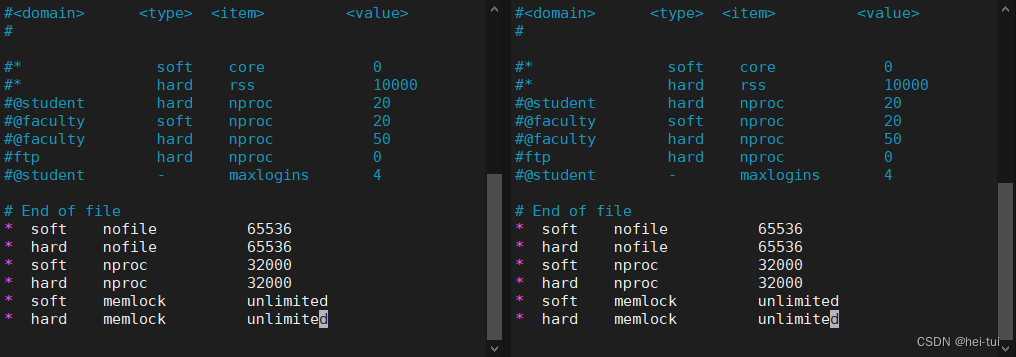

3)es性能调优

vim /etc/security/limits.conf

......

* soft nofile 65536

* hard nofile 65536

* soft nproc 32000

* hard nproc 32000

* soft memlock unlimited

* hard memlock unlimited

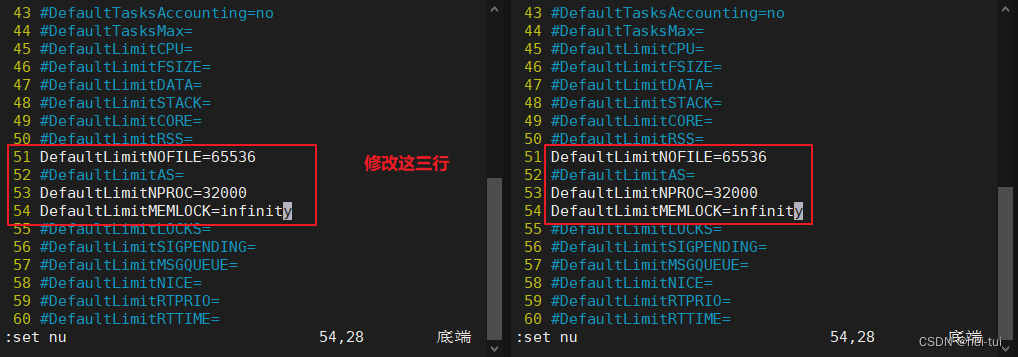

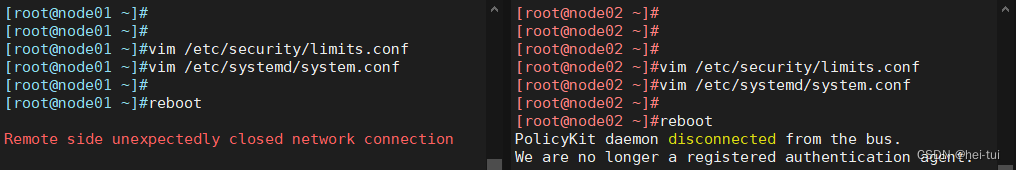

vim /etc/systemd/system.conf

DefaultLimitNOFILE=65536

DefaultLimitNPROC=32000

DefaultLimitMEMLOCK=infinity然后需重启生效

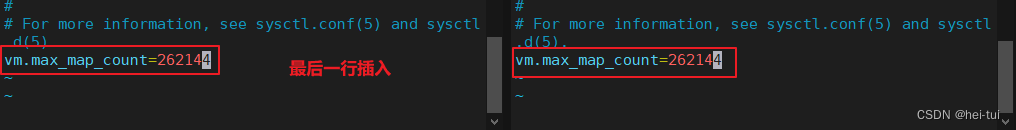

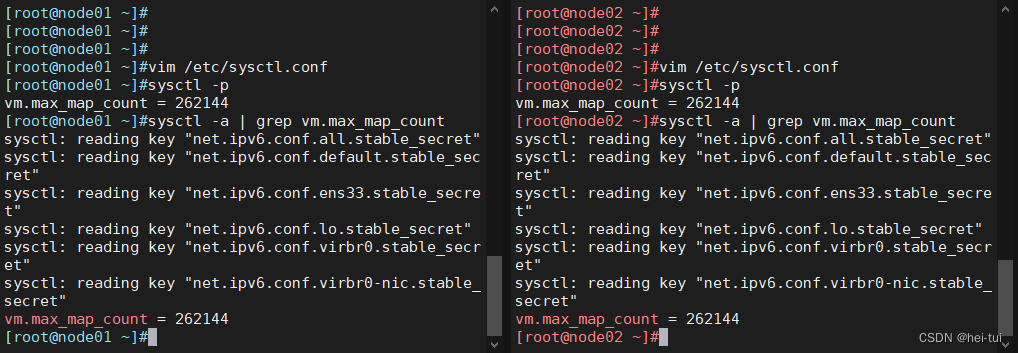

vim /etc/sysctl.conf

#一个进程可以拥有的最大内存映射区域数,参考数据(分配 2g/262144,4g/4194304,8g/8388608)

vm.max_map_count=262144sysctl -p

sysctl -a | grep vm.max_map_count

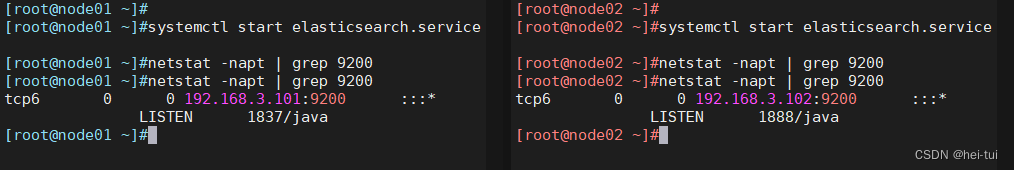

4)启动elasticsearch是否启动成功

systemctl start elasticsearch.service #启动es

systemctl enable elasticsearch.service #设置开机自启

netstat -antp | grep 9200 #查看es的默认端口,判断是否启动es成功

5)查看节点信息

浏览器访问http://192.168.3.101:9200、http://192.168.3.102:9200

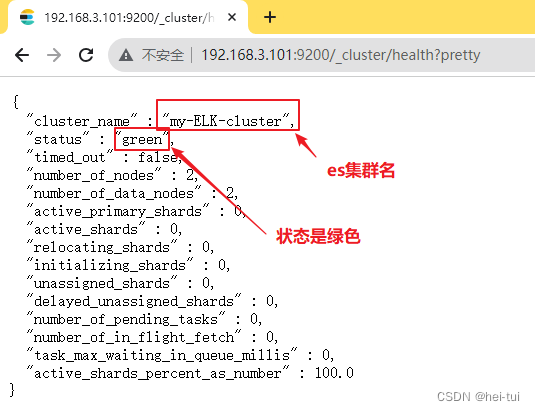

浏览器访问 http://192.168.3.101:9200/_cluster/health?pretty 、 http://192.168.3.102:9200/_cluster/health?pretty查看群集的健康情况,可以看到 status 值为 green(绿色), 表示节点健康运行。

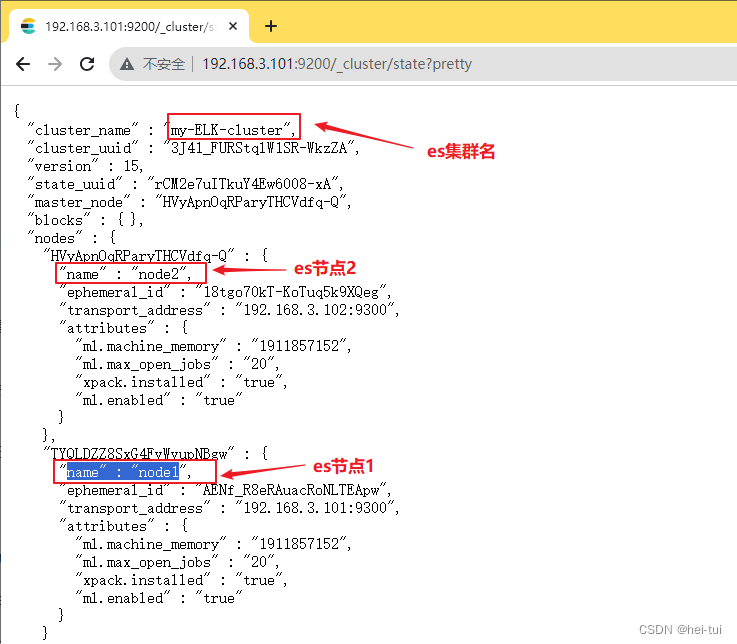

浏览器访问 http://192.168.3.101:9200/_cluster/state?pretty 检查群集状态信息。

3、安装Elasticsearch-head插件

ElasticSearch-head插件部署在node01节点或node02节点任意一个节点上即可

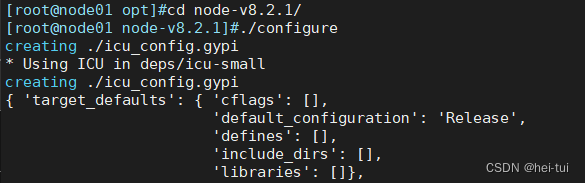

1)编译安装node

#上传软件包 node-v8.2.1.tar.gz 到/opt

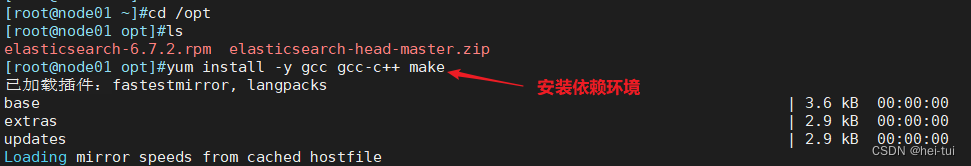

yum install gcc gcc-c++ make -y #安装依赖环境cd /opt

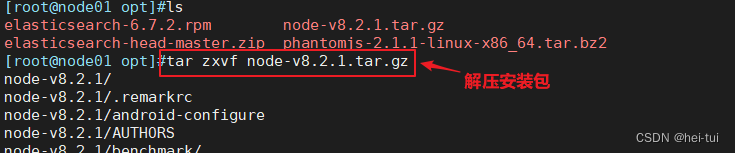

tar zxvf node-v8.2.1.tar.gz #解压安装包cd node-v8.2.1/

./configure

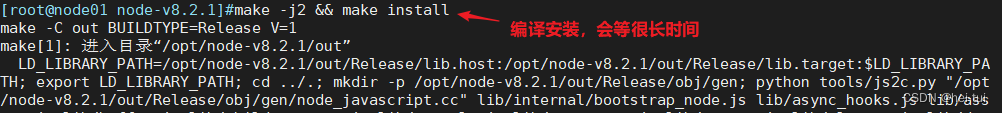

make -j2 && make install #编译安装

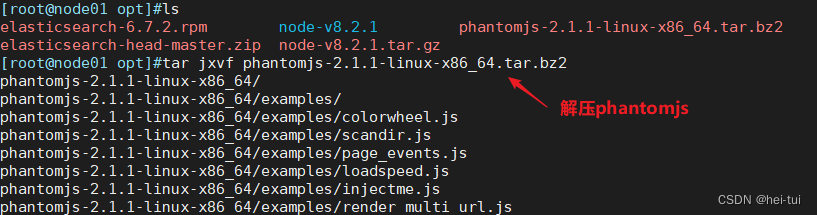

2)安装 phantomjs

#上传软件包 phantomjs-2.1.1-linux-x86_64.tar.bz2 到

cd /opt

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2

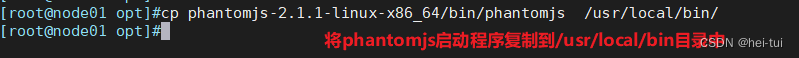

cd /opt/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin

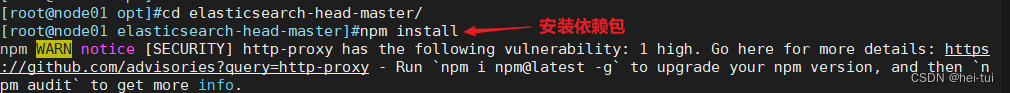

3)安装 Elasticsearch-head 数据可视化工具

#上传软件包 elasticsearch-head-master.zip 到/opt

cd /opt

unzip elasticsearch-head-master.zip

cd /opt/elasticsearch-head/

npm install //安装依赖包

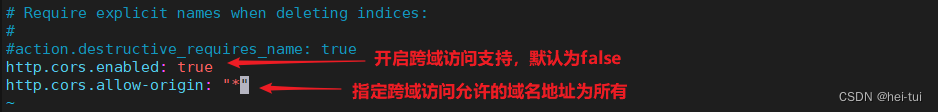

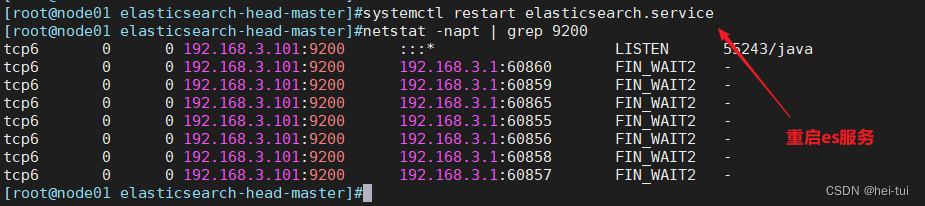

4)修改 Elasticsearch 主配置文件并重启elasticsearch服务

vim /etc/elasticsearch/elasticsearch.yml

......

--末尾添加以下内容--

http.cors.enabled: true #开启跨域访问支持,默认为 false

http.cors.allow-origin: "*" #指定跨域访问允许的域名地址为所有systemctl restart elasticsearch

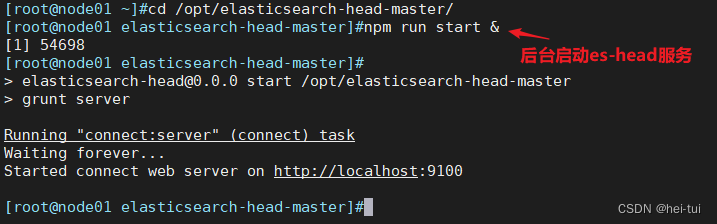

5)启动 elasticsearch-head 服务

#必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

cd /opt/elasticsearch-head-master/

npm run start &

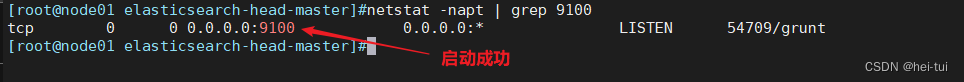

#elasticsearch-head 监听的端口是 9100

netstat -natp |grep 9100

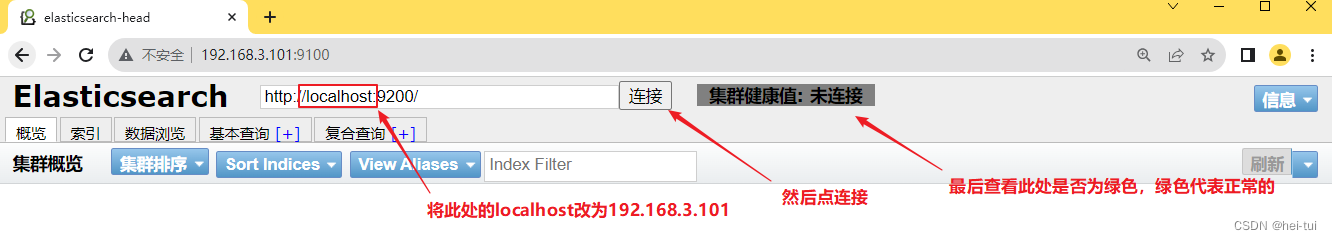

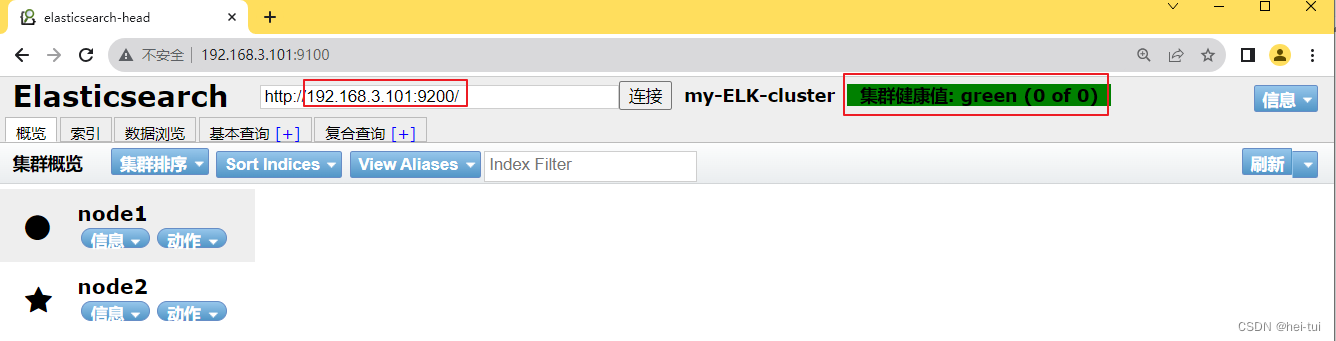

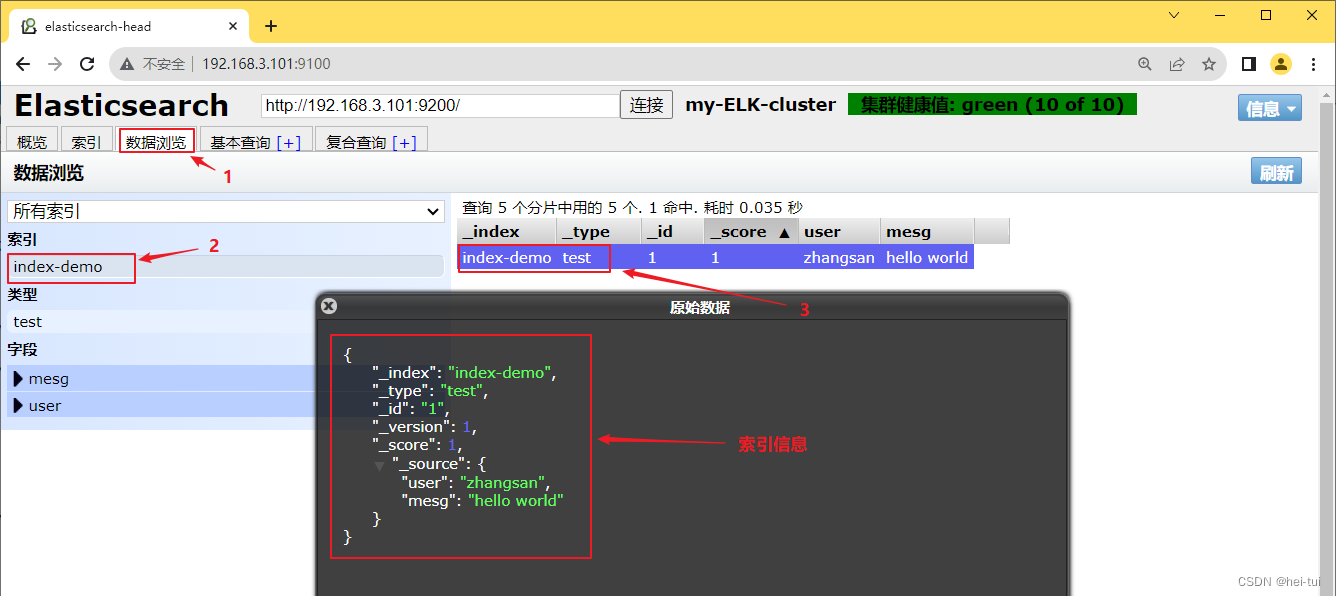

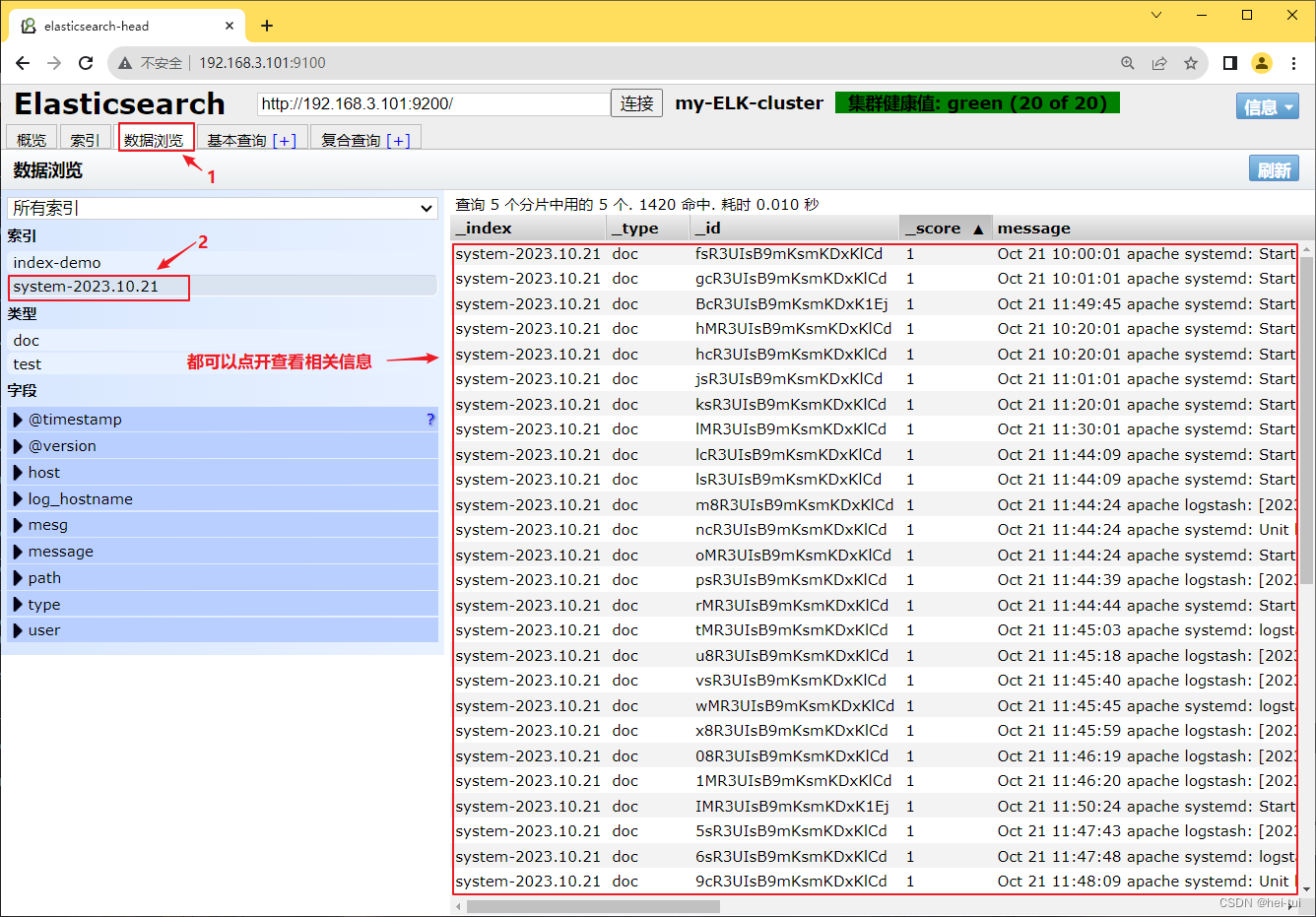

6)通过 Elasticsearch-head 查看 Elasticsearch 信息

通过浏览器访问 http://192.168.3.101:9100/ 地址并连接群集。如果看到群集健康值为 green 绿色,代表群集很健康。

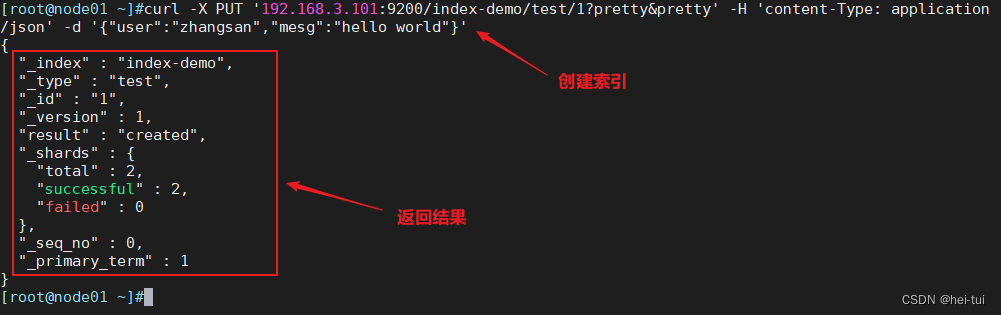

7)插入索引,并在浏览器访问查看

curl -X PUT '192.168.3.101:9200/index-demo/test/1?pretty&pretty' -H 'content-Type: application/json' -d '{"user":"zhangsan","mesg":"hello world"}'

4、Logstash部署

在apache节点安装logstash

1)安装apache服务httpd

yum -y install httpd

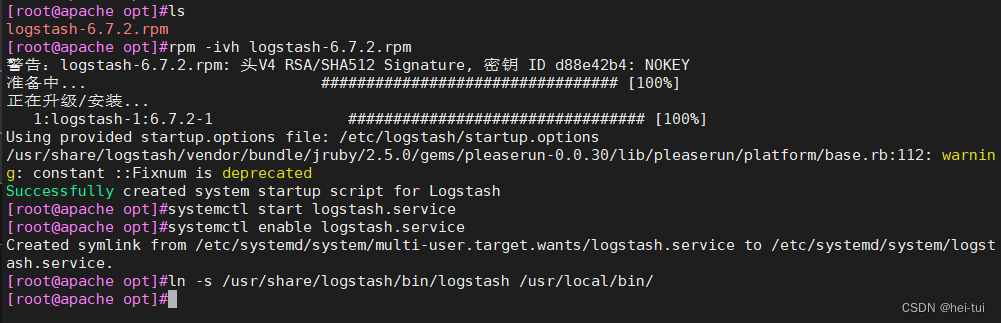

systemctl start httpd2)安装logstash

#上传软件包 logstash-6.7.2.rpm 到/opt目录下

cd /opt

rpm -ivh logstash-6.7.2.rpm

systemctl start logstash.service

systemctl enable logstash.serviceln -s /usr/share/logstash/bin/logstash /usr/local/bin/

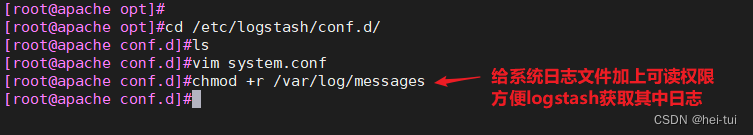

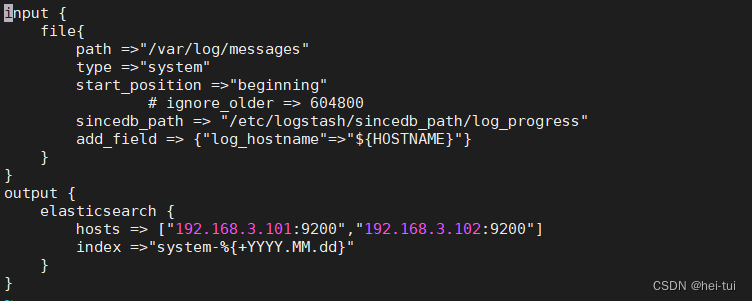

3)配置logstash配置文件

让其收集系统日志/var/log/messages,并将其输出到 elasticsearch群集。

chmod +r /var/log/messages #让 Logstash 可以读取日志cd /etc/logstash/conf.d/

vim system.conf

input {file{path =>"/var/log/messages"type =>"system"start_position =>"beginning"# ignore_older => 604800sincedb_path => "/etc/logstash/sincedb_path/log_progress"add_field => {"log_hostname"=>"${HOSTNAME}"}}

}

output {elasticsearch { #输出到 elasticsearchhosts => ["192.168.3.101:9200","192.168.3.102:9200"] #指定 elasticsearch 服务器的地址和端口index =>"system-%{+YYYY.MM.dd}" #指定输出到 elasticsearch 的索引格式}

}

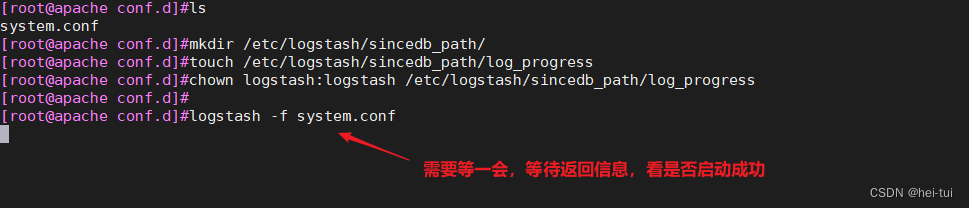

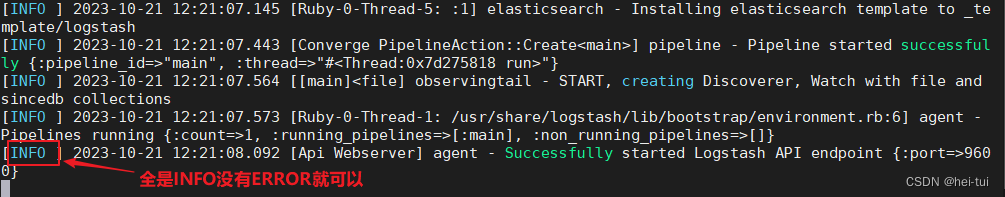

4)启动logstash,并在浏览器查看

创建并设置属主和属组,为logstash采集日志数据做准备

mkdir /etc/logstash/sincedb_path/

touch /etc/logstash/sincedb_path/log_progress

chown logstash:logstash /etc/logstash/sincedb_path/log_progresslogstash -f /etc/logstash/conf.d/system.conf #启动logstash根据配置文件采集相关日志数据

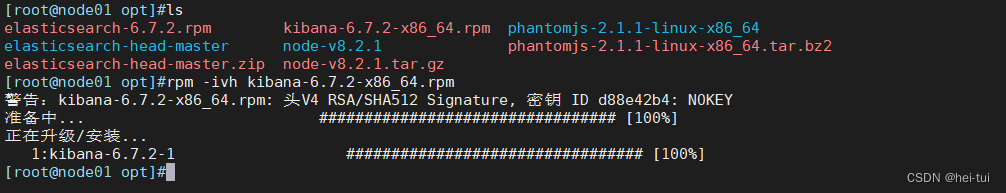

5、Kibana部署

在node01上部署

1)安装Kibana

# 上传软件包到/opt目录

cd /opt

rpm -ivh kibana-6.7.2-x86_64.rpm

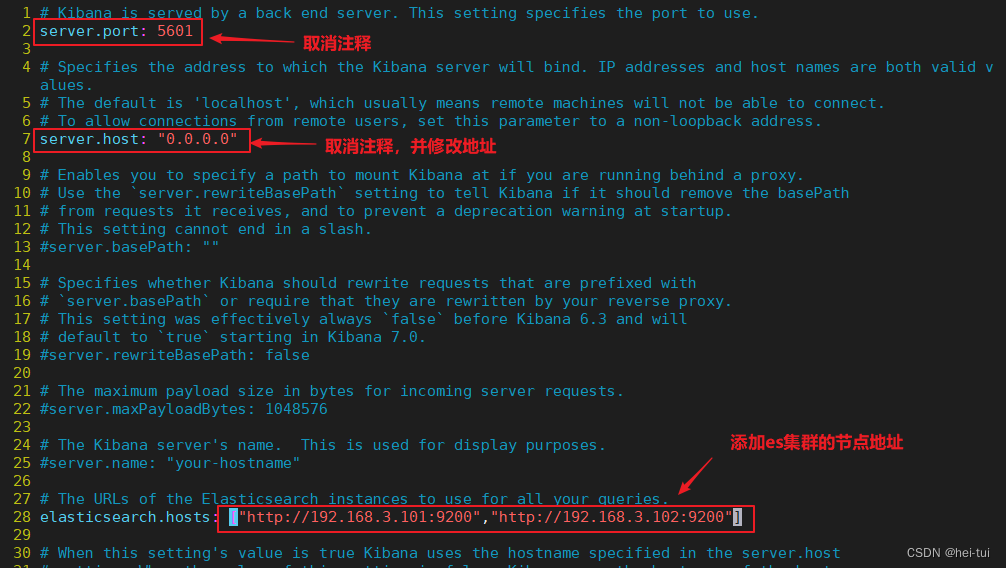

2)修改Kibana的配置文件

vim /etc/kibana/kibana.yml

--2--取消注释,Kiabana 服务的默认监听端口为5601

server.port: 5601

--7--取消注释,设置 Kiabana 的监听地址,0.0.0.0代表所有地址

server.host: "0.0.0.0"

--28--取消注释,配置es服务器的ip,如果是集群则配置该集群中master节点的ip

elasticsearch.url: ["http://192.168.3.101:9200","http://192.168.3.102:9200"]

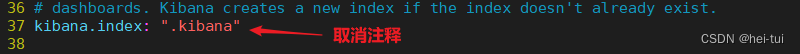

--37--取消注释,设置在 elasticsearch 中添加.kibana索引

kibana.index: ".kibana"

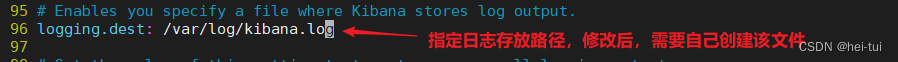

--96--取消注释,配置kibana的日志文件路径(需手动创建),不然默认是messages里记录日志

logging.dest: /var/log/kibana.log

3)创建日志文件,启动 Kibana 服务

touch /var/log/kibana.log

chown kibana:kibana /var/log/kibana.logsystemctl start kibana.service

systemctl enable kibana.servicenetstat -natp | grep 5601

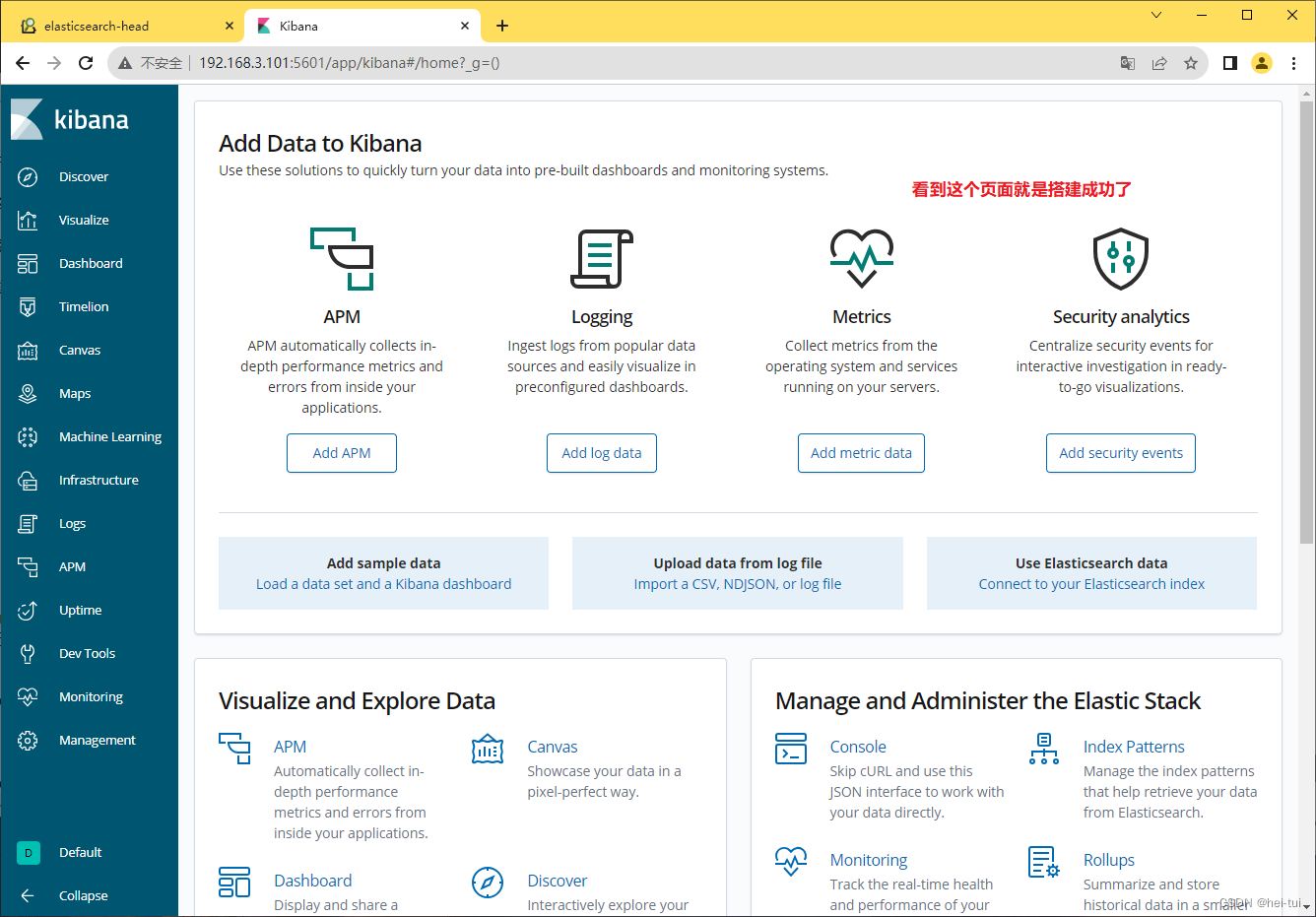

4)在浏览器访问http://192.168.3.101:5601

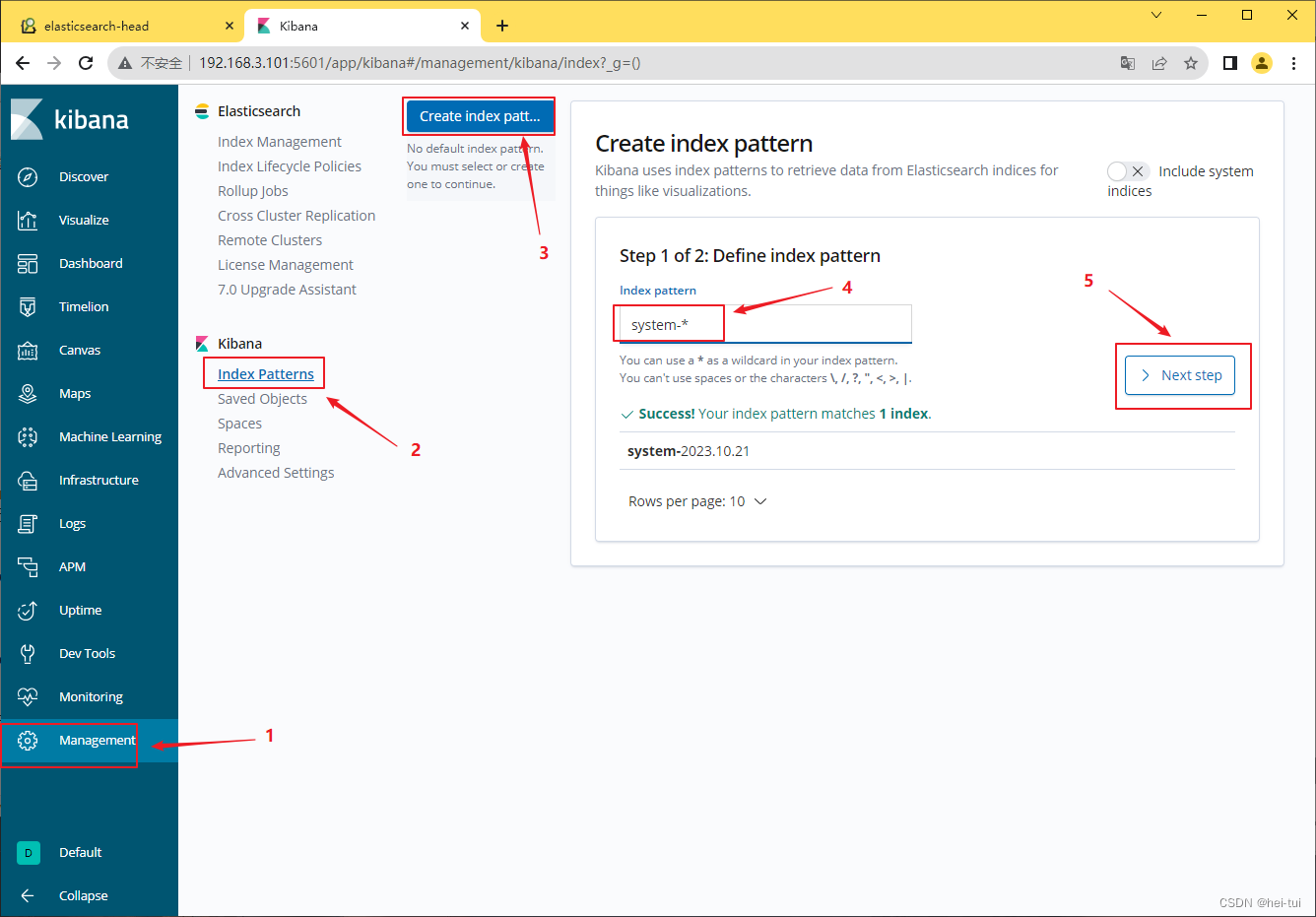

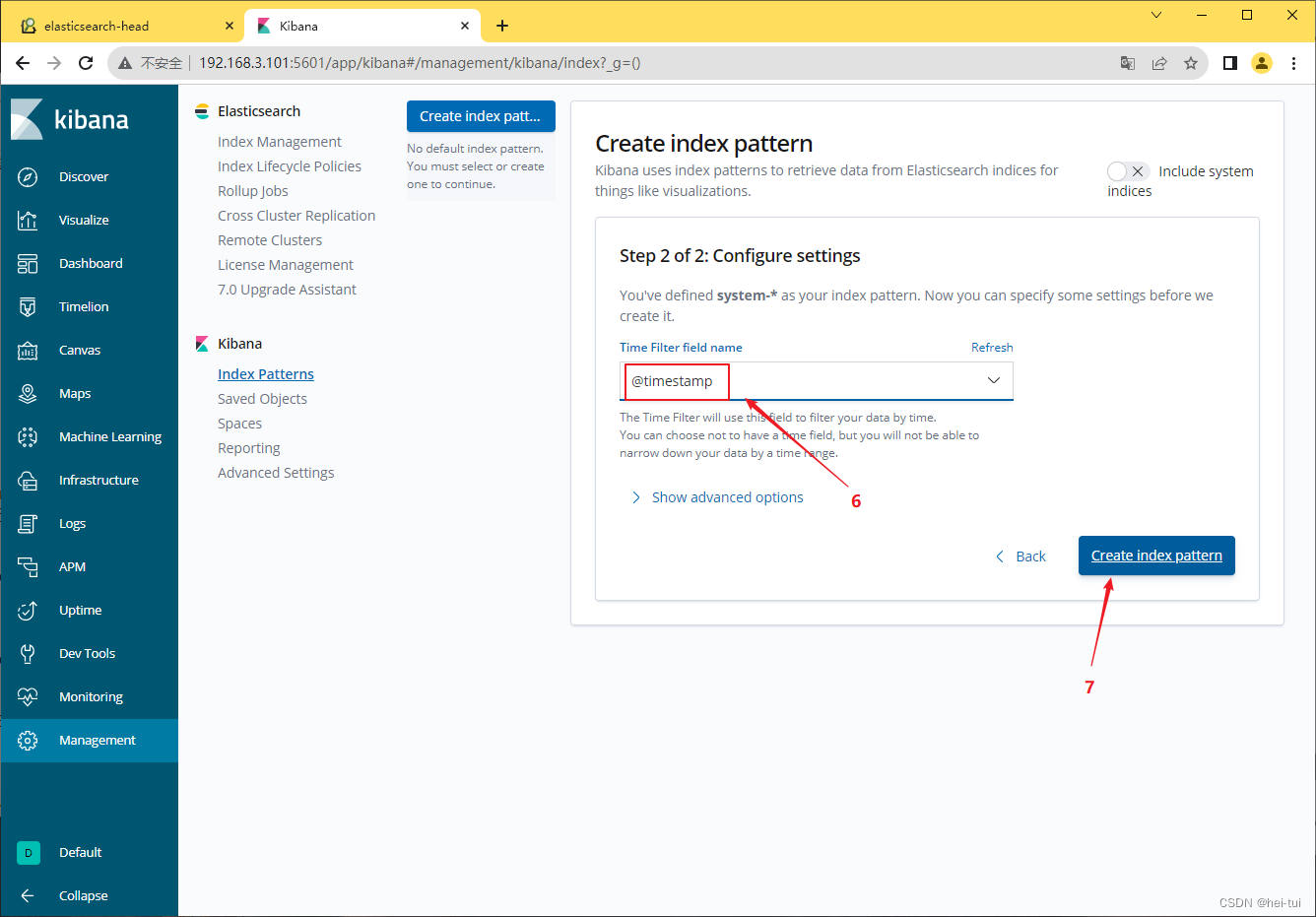

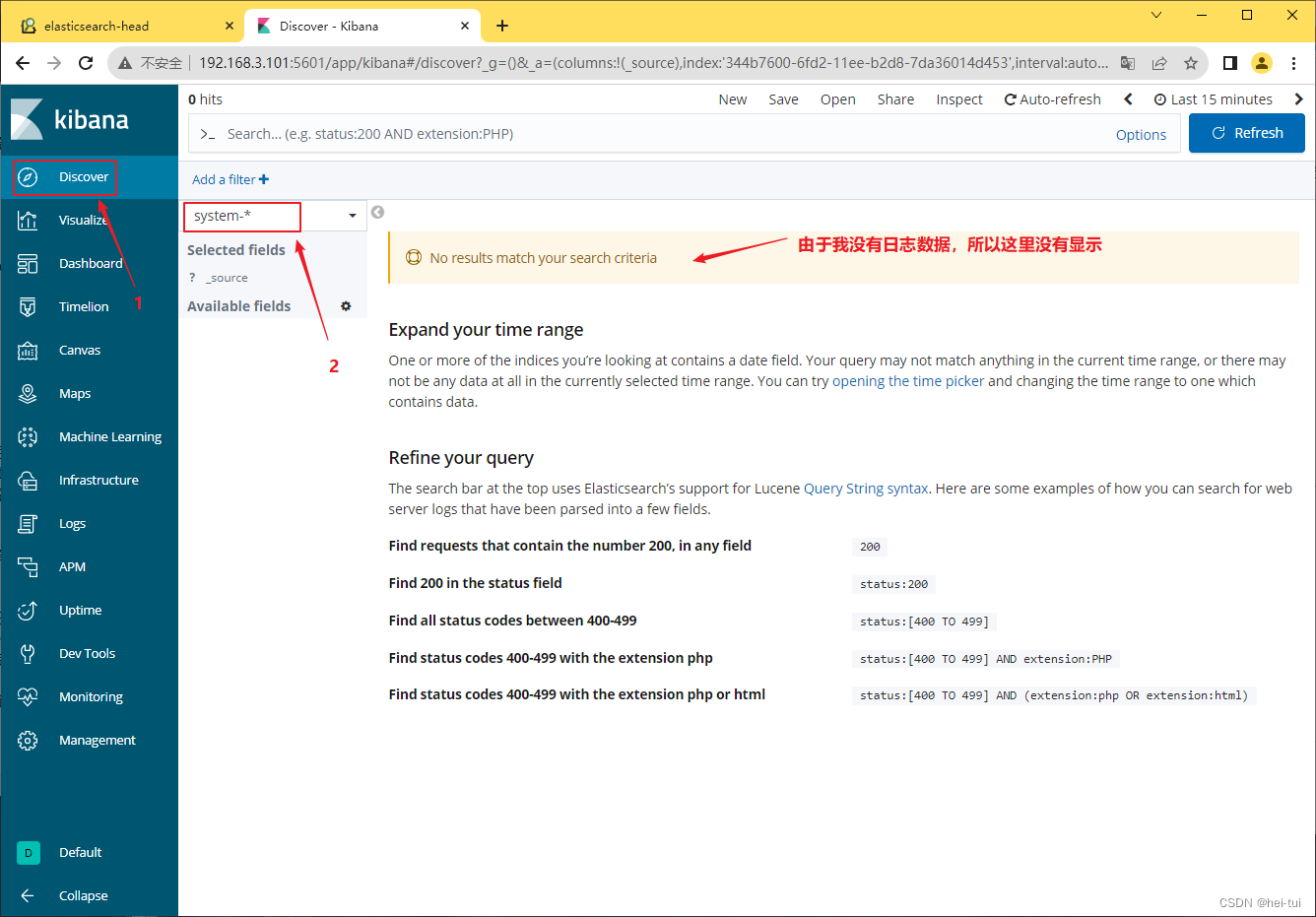

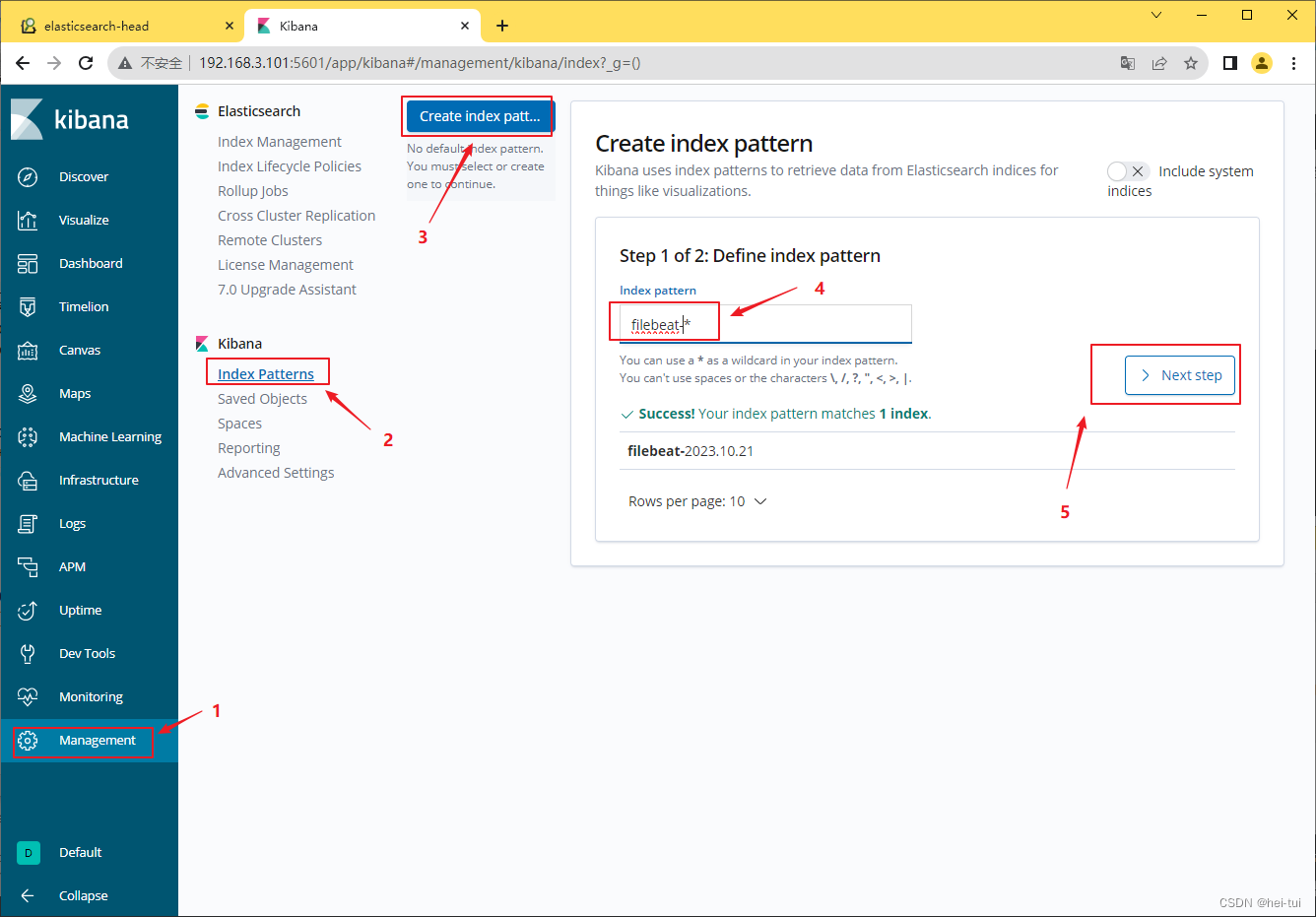

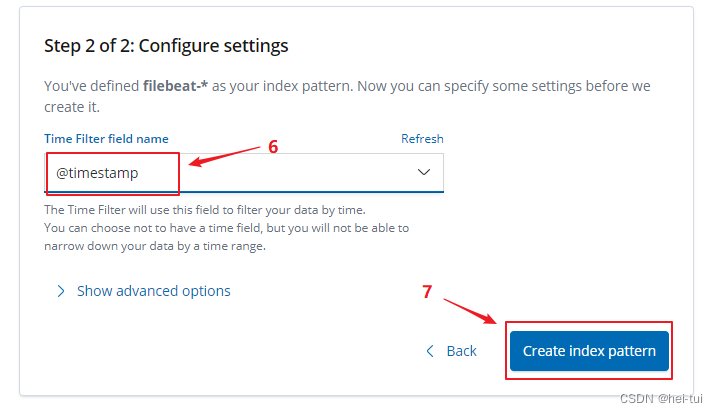

5)添加索引

Management -> Index Pattern -> Create index pattern

Index pattern 输入:system-* #在索引名中输入之前配置的 Output 前缀“system”Next step -> Time Filter field name 选择 @timestamp -> Create index pattern单击 “Discover” 按钮可查看图表信息及日志信息。

数据展示可以分类显示,在“Available Fields”中的“host”,然后单击 “add”按钮,可以看到按照“host”筛选后的结果

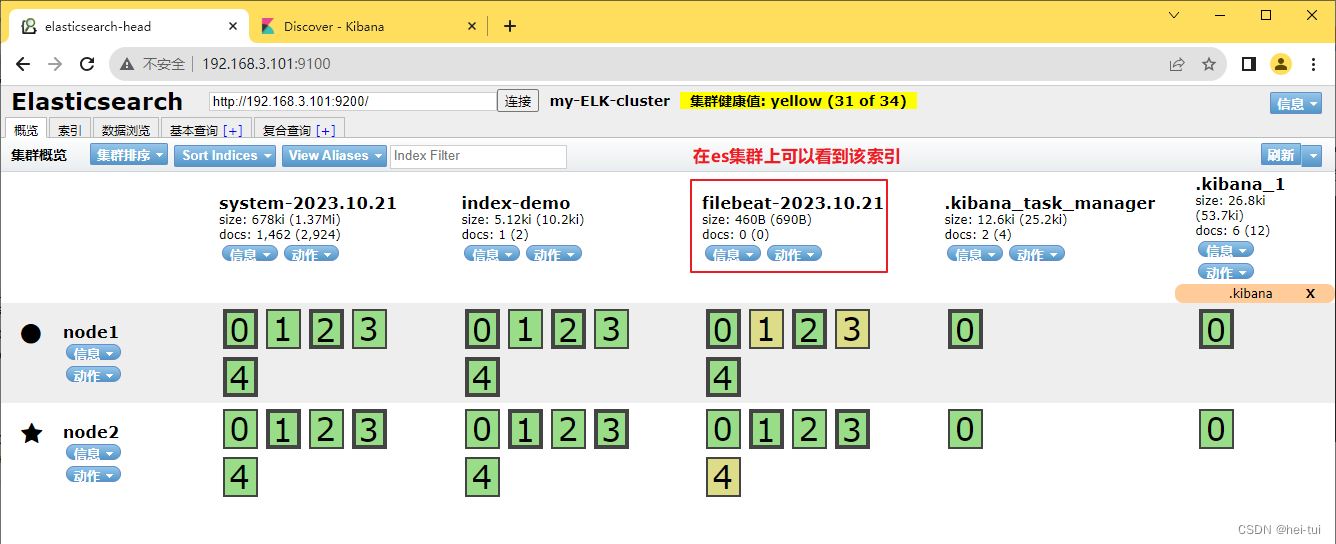

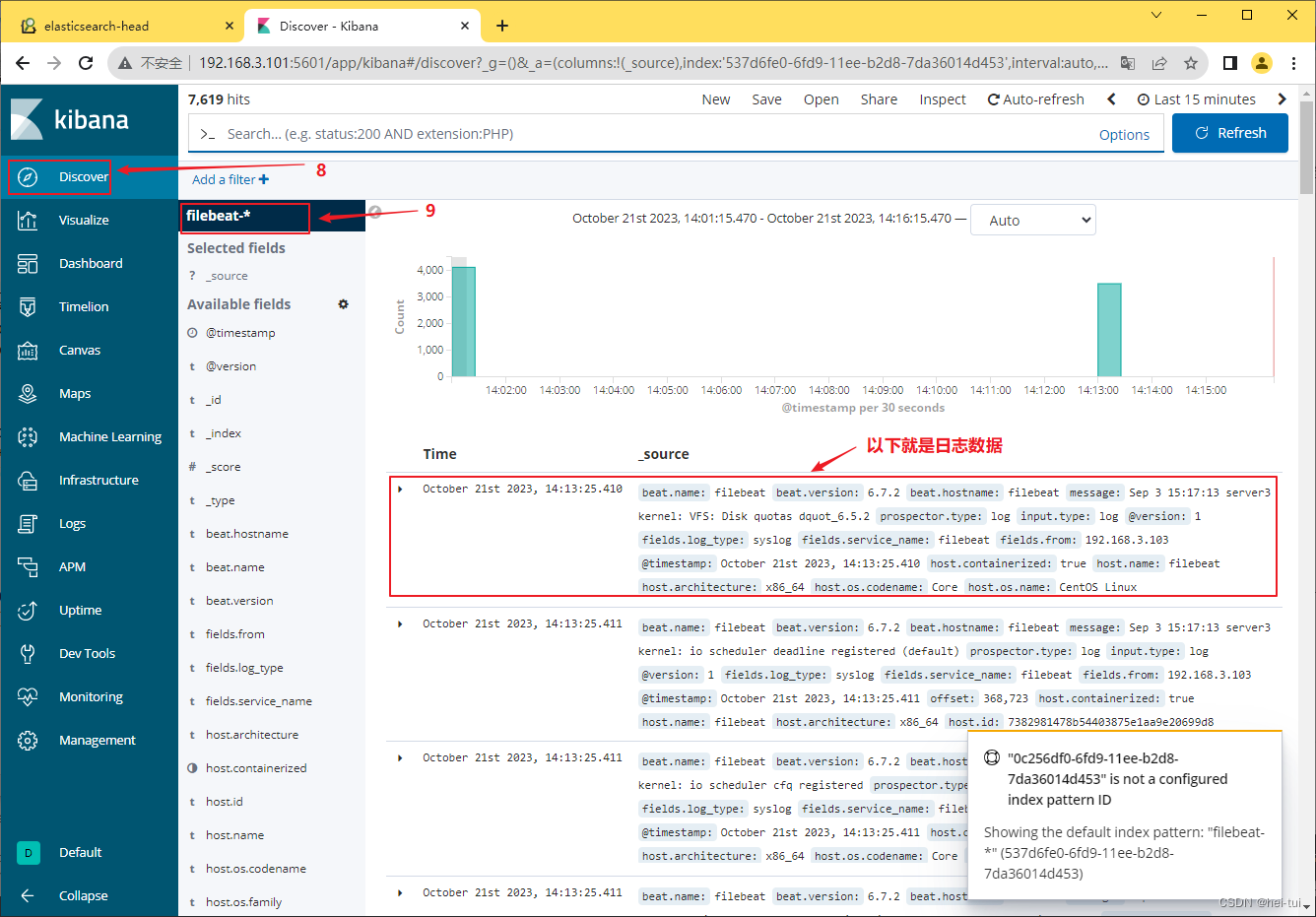

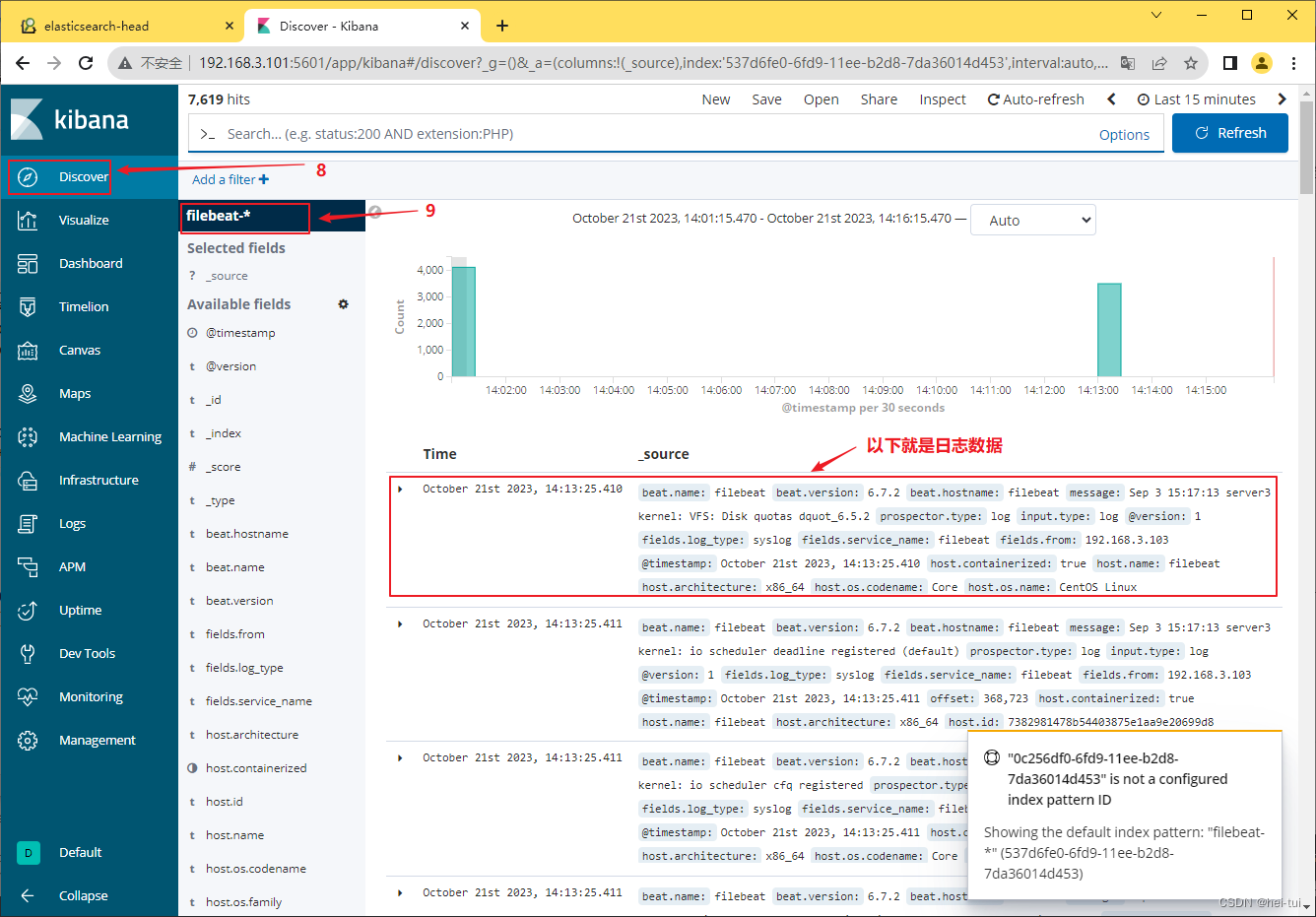

三、Filebeat+ELK部署

基于上方的ELK的部署,另起一台部署Filebeat

Filebeat节点IP:192.168.3.103

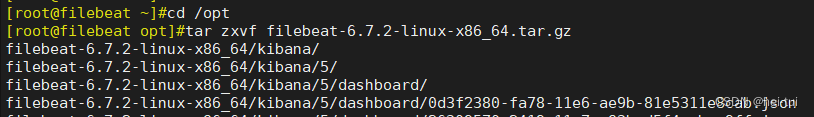

1、安装Filebeat

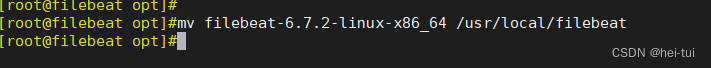

#上传软件包 filebeat-6.7.2-linux-x86_64.tar.gz 到/opt目录

tar zxvf filebeat-6.7.2-linux-x86_64.tar.gz

mv filebeat-6.7.2-linux-x86_64/ /usr/local/filebeat

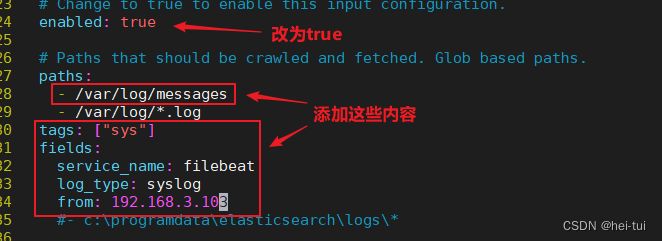

2、设置 filebeat 的主配置文件

cd /usr/local/filebeat

vim filebeat.yml

filebeat.inputs:

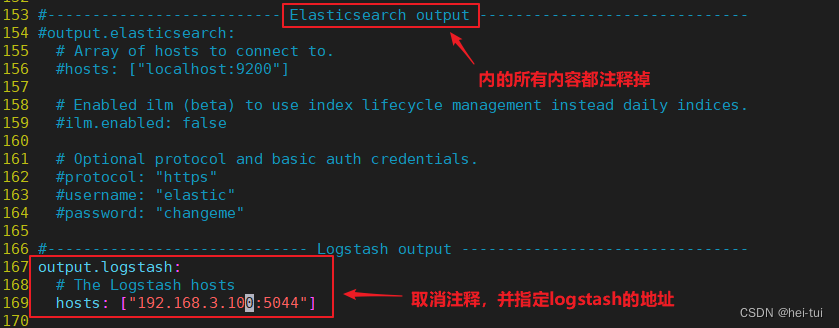

- type: log #指定 log 类型,从日志文件中读取消息enabled: truepaths:- /var/log/messages #指定监控的日志文件- /var/log/*.logtags: ["sys"] #设置索引标签fields: #可以使用 fields 配置选项设置一些参数字段添加到 output 中service_name: filebeatlog_type: syslogfrom: 192.168.80.13--------------Elasticsearch output-------------------

(全部注释掉)----------------Logstash output---------------------

output.logstash:hosts: ["192.168.80.12:5044"] #指定 logstash 的 IP 和端口

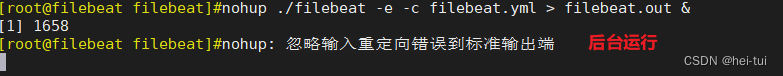

3、启动 filebeat

nohup ./filebeat -e -c filebeat.yml > filebeat.out &

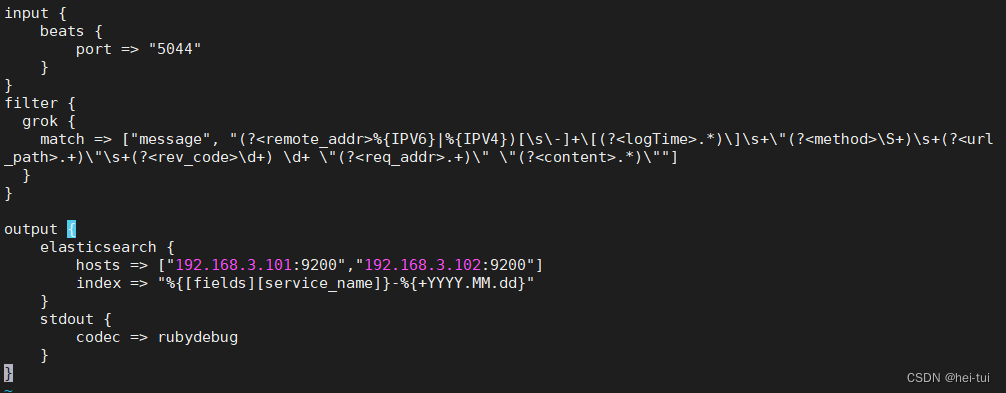

4、在 Logstash 组件所在节点上新建一个 Logstash 配置文件

cd /etc/logstash/conf.dvim filebeat.conf

input {beats {port => "5044"}

}

filter {grok {match => ["message", "(?<remote_addr>%{IPV6}|%{IPV4})[\s\-]+\[(?<logTime>.*)\]\s+\"(?<method>\S+)\s+(?<url_path>.+)\"\s+(?<rev_code>\d+) \d+ \"(?<req_addr>.+)\" \"(?<content>.*)\""]}

}output {elasticsearch {hosts => ["192.168.3.101:9200","192.168.3.102:9200"]index => "%{[fields][service_name]}-%{+YYYY.MM.dd}"}stdout {codec => rubydebug}

}

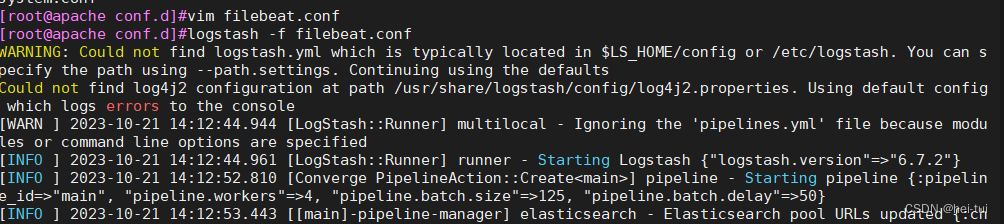

5、启动logstash,并在浏览器查看

logstash -f filebeat.conf

相关文章:

日志分析系统——ELK

目录 一、ELK概述 ELK的组成 1、ElasticSearch 2、Logstash 3、Kiabana 完整日志采集系统基本特征 ELK的工作原理 二、ELK的部署 1、环境准备 2、部署ElasticSearch软件 3、安装Elasticsearch-head插件 4、Logstash部署 5、Kibana部署 三、FilebeatELK部署 1、安…...

Ubuntu小知识总结

Ubuntu相关的小知识总结 一、Ubuntu系统下修改用户开机密码二、Vmware虚拟机和主机之间复制、粘贴内容、拖拽文件的详细方法问题描述Vmware tools灰色不能安装解决方法小知识点:MarkDown的空格 三、Ubuntu虚拟机网络无法连接的几种解决方法1.重启网络编辑器2. 重启虚…...

2023年全球市场新能源汽车车载充电器总体规模、主要生产商、主要地区、产品和应用细分研究报告

按收入计,2022年全球新能源汽车车载充电器收入大约 百万美元,预计2029年达到 百万美元,2023至2029期间,年复合增长率CAGR为 %。同时2022年全球新能源汽车车载充电器销量大约 ,预计2029年将达到 。2022年中国市场规模大…...

基于stm32控制的ESP8266在设备模式下通讯

一、文章中要用的指令 指令作用ATUART115200,8,1,0,0之前的51通讯是9600,这里的321用的是115200,需要改一下波特率ATCWMODEXX是1代表station(设备)模式 ,X是2代表AP(路由)模式 ,X是…...

用PHP组合数组,生成笛卡尔积。写几个例子

#创作灵感# [红色,白色,黄色,蓝色] [128G,256G,512G] [国行,港版,美版,韩版] 用PHP组合数组,生成笛卡尔积。写几个例子 你可以使用嵌套的循环来生成这些数组的笛卡尔积。以下是一些示例代码: // 示例…...

软设上午题错题知识点7

软设上午题错题知识点7 1、数据流图摆脱系统的物理内容,在逻辑上描述系统的功能、输入、输出和数据存储等,是系统逻辑模型的重要组成部分。 2、HTTPS(Secure Hypertext Transfer Protocol)安全超文本传输协议。 它是一个安全通信…...

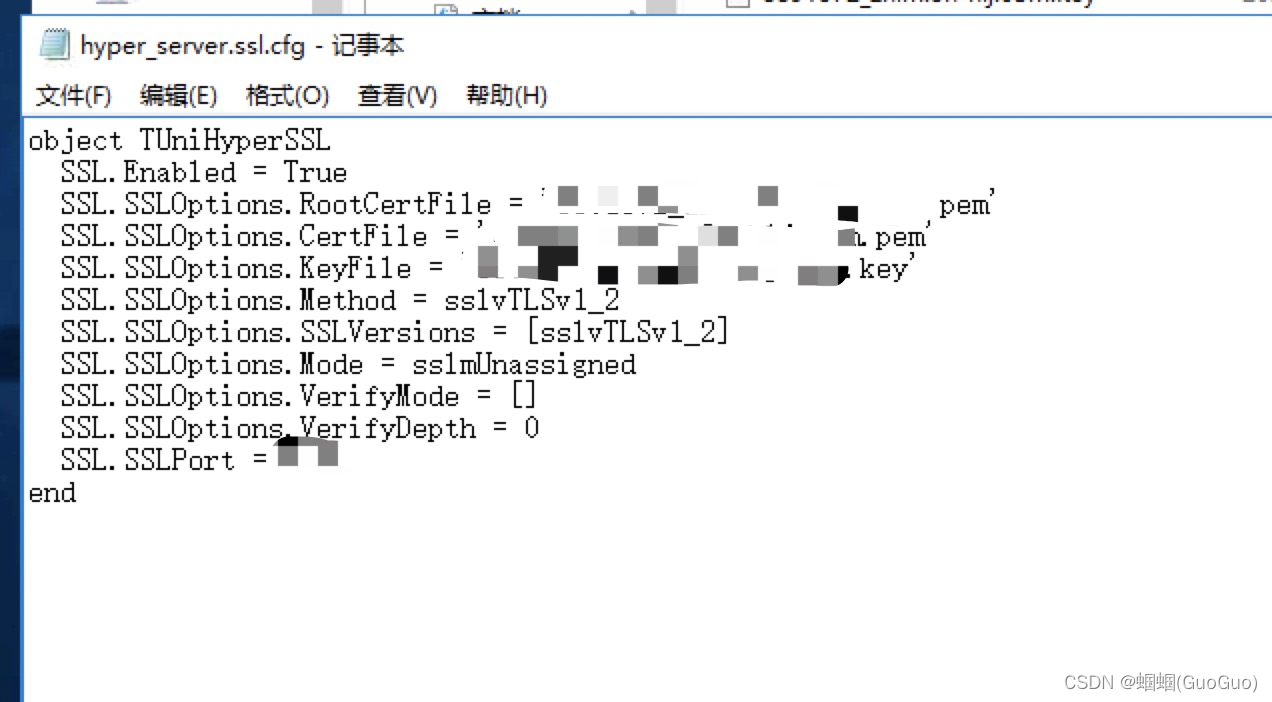

让uniGUI支持https

今天在专家的帮助下,成功的让uniGUI支持https了。 首先,去申请个**的证书。我同事去阿里申请的,申请回是一个zip文件,里面有两个文件,一个扩展是per,一个key 然后,把这两个证书文件放到uniGUI…...

iPhone怎么导出微信聊天记录?3个值得收藏的方法

随着时间的推移,微信占用的内存空间会“膨胀”得越来越大。当手机内存不足时,清理微信中的聊天记录是一个可行的方法。但是很多小伙伴觉得有些重要的聊天记录还有用,可能以后需要进行查看。 因此,他们想将一些聊天记录进行导出或…...

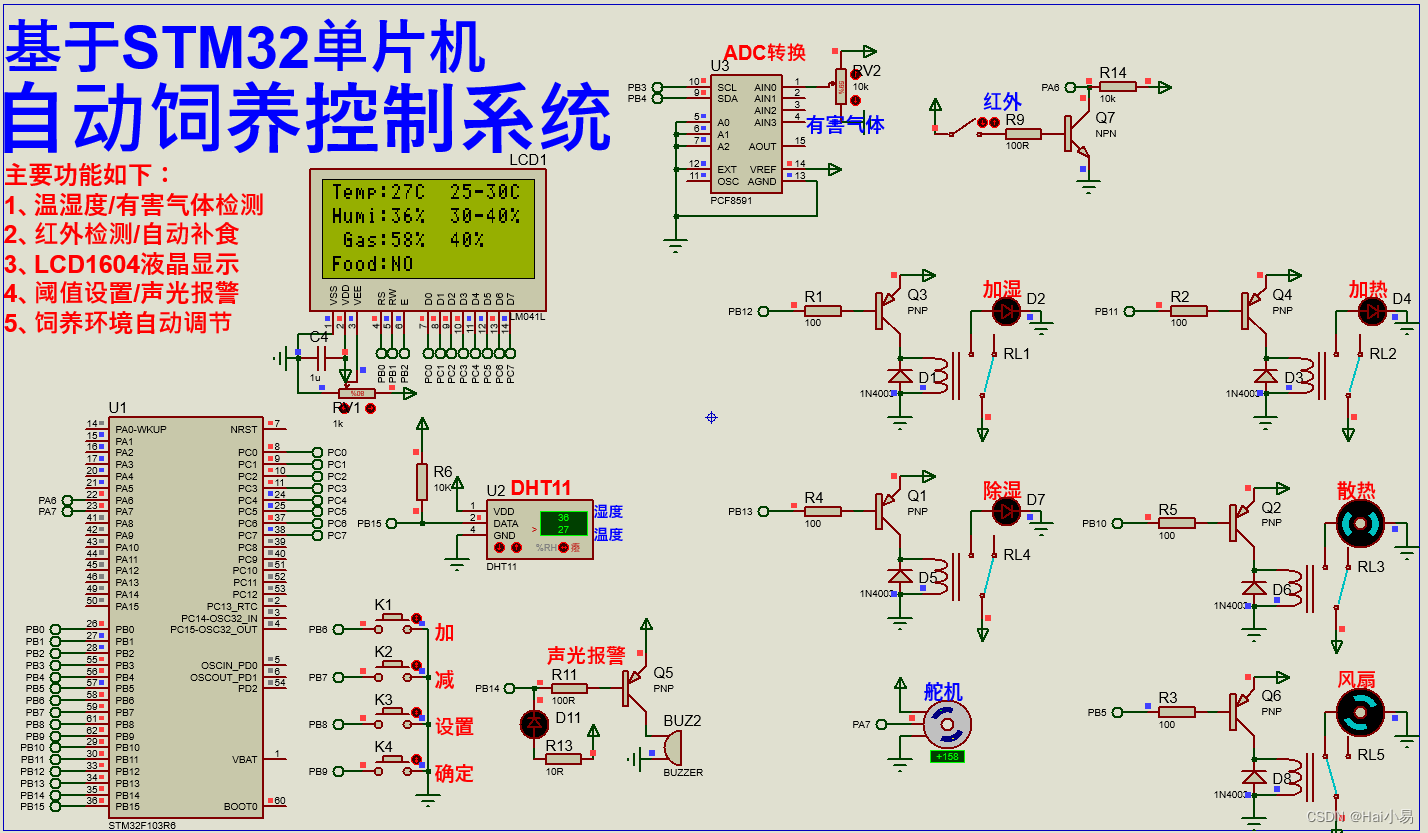

【Proteus仿真】【STM32单片机】自动饲养控制系统

文章目录 一、功能简介二、软件设计三、实验现象联系作者 一、功能简介 本项目使用Proteus8仿真STM32单片机控制器,使用LCD1604显示模块、红外传感器、有害气体检测模块、PCF8591 ADC模块,蜂鸣器、DHT11温湿度、SG90舵机、风扇加热加湿等。 主要功能&a…...

【设计模式】模板方法模式

模板方法模式 1. 什么是模板方法 模板方法模式:定义一个操作中的算法骨架(父类),而将一些步骤延迟到子类中。 模板方法使得子类可以不改变一个算法的结构来重定义该算法的 2. 什么时候使用模板方法 实现一些操作时,…...

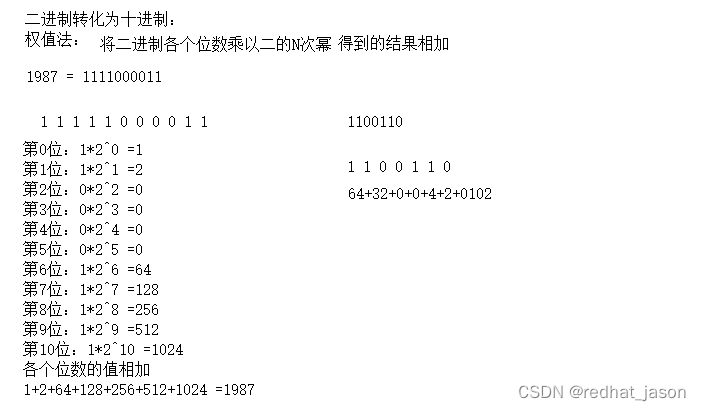

c语言进制的转换二进制转换10进制

c语言进制的转换之二进制转换10进制 c语言的进制的转换 c语言进制的转换之二进制转换10进制一、二进制转换10进制的方法二、10进制程序打印 一、二进制转换10进制的方法 二进制: 二进制逢二进一,所有的数组是0、1组成 十进制转二进制: 除二反…...

C++ 纠错题总结2

1、for循环中的判断语句: 要注意初始赋值、< 还是 < for(int i 0; i < n; i) 2、cin.getline(char[], int, char) 注意:第二个参数为不是char[]的有效元素个数,因为最后一个元素位置要用来存储 \0 3、函数形参有默认值的,有默认…...

Jmeter性能 —— 事务控制器

统计性能测试结果一定会关注TPS,TPS表示:每秒处理事务数,JMeter默认每个事务对应一个请求。我们可以用逻辑控制器中的事务控制器将多个请求统计为一个事务。 1、添加事务控制器 2、事务控制器参数说明 Generate parent sample:如…...

Android C/C++ native编程NDK开发中logcat的使用

Android C/C native编程NDK开发中logcat的使用 前言具体用法 前言 在NDK开发过程中,C/C层,需要对代码进行一些调试,日志打印是我们解决异常或崩溃的重要手段,这里我就简单介绍下日志打印三步走。 首先我们先看下官方文档关于日志…...

什么是美颜SDK?深入了解直播实时美颜SDK

美颜已经成为了现代社交媒体和直播应用中的重要元素,它使用户能够在拍摄自拍照片或进行直播时改善其外貌特征。美颜技术的普及离不开美颜SDK(软件开发工具包),特别是在直播应用中,直播实时美颜SDK正变得越来越流行。在…...

TensorFlow2从磁盘读取图片数据集的示例(tf.data.Dataset.list_files)

import os import warnings warnings.filterwarnings("ignore") import tensorflow as tf from tensorflow.keras.optimizers import Adam from tensorflow.keras.applications.resnet import ResNet50 from pathlib import Path import numpy as np#数据所在文件夹 …...

Jmeter(九):jmeter_逻辑控制器与HTTP Cookie管理器详解

Jmeter:jmeter_逻辑控制器_事务控制器 事务 性能测试中,事务指的是从端到端,一个完整的操作过程,比如一次登录、一次 筛选条件查询,一次支付等;技术上讲:事务就是由1个或多个请求组成的 事务…...

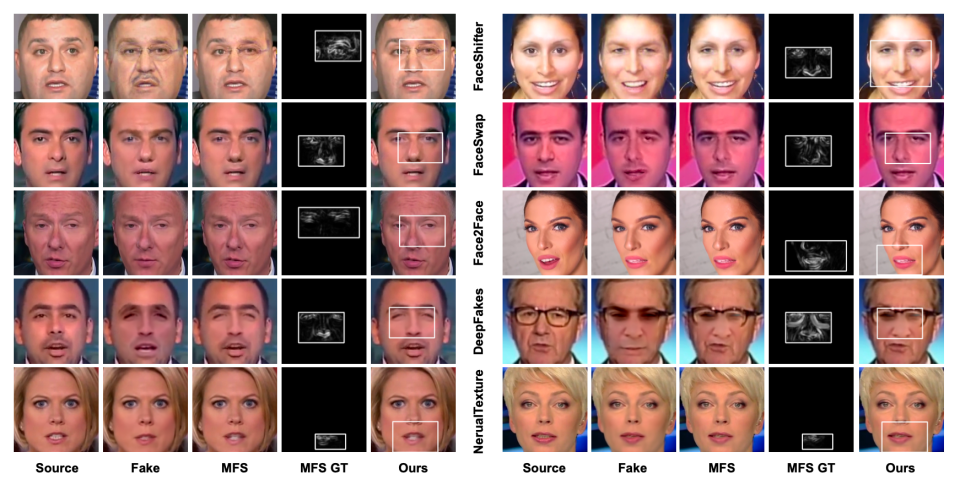

CVPR2023优秀论文 | AIGC伪造图像鉴别算法泛化性缺失问题分析

作者 | 搜索内容技术部 导读 深度伪造检测算法无法检出未知伪造算法生成的攻击数据。以往算法采取手动建模伪造特征的方式提升模型泛化性,然而这种方式限制了算法可行域,影响了模型泛化性进一步提升,同时这类方法参数量巨大,无法满…...

ISP Pipeline典型场景要点SAT、Bokeh、MFNR、HDR

目录 一、概述 二、通用流程 三、典型场景 1. SAT 2. Bokeh背景虚化 MFNR 3. HDR(DOL、DCG等) 一、概述 本文解释isp pipeline的一些非常典型的场景,不同厂商对pipeline的连接及node的port口设计可能不同,但核心的思想相同…...

技术)

计算机视觉(CV)技术

是一种将数字图像或视频进行处理和分析的技术,旨在使计算机能够模拟人类视觉系统。该领域涉及到图像处理、模式识别、机器学习等多个领域,主要涵盖以下几方面: 图像处理:对图像进行去噪、增强、分割、特征提取等处理。图像分类&a…...

彻底告别OpenClaw使用焦虑:我给他装上了“透视眼”和“批量克隆模组贾

指令替换 项目需求:将加法指令替换为减法 项目目录如下 /MyProject ├── CMakeLists.txt # CMake 配置文件 ├── build/ #构建目录 │ └── test.c #测试编译代码 └── mypass2.cpp # pass 项目代码 一,测试代码示例 test.c // test.c #includ…...

;)

车辆三自由度运动学模型; Carsim_Simulink联合仿真; 无人驾驶车辆模型预测控制(2.1);

车辆三自由度运动学模型; Carsim/Simulink联合仿真; 无人驾驶车辆模型预测控制(2.1); 包括Carsim的设置、控制信号数据、PPT文件、cpar件、车辆运动分析图(适用于word两栏布局);Simu…...

WiFiPixels:ESP32上轻量级Wi-Fi控制NeoPixel的固件框架

1. 项目概述WiFiPixels 是一个面向嵌入式 LED 控制场景的轻量级网络化固件框架,其核心设计目标是将 NeoPixel(WS2812B 类型)LED 阵列通过 Wi-Fi 接口暴露为可远程寻址、实时更新的像素资源。项目名称 “NeoPixel Wifi WifiPixels” 并非营销…...

)

从编译到实战:用MRtrix3处理你的第一份DWI数据(附macOS Ventura适配指南)

从编译到实战:用MRtrix3处理你的第一份DWI数据(附macOS Ventura适配指南) 第一次打开MRtrix3的命令行界面时,那种面对未知领域的兴奋与忐忑,相信每位神经影像研究者都深有体会。这个开源的弥散磁共振成像处理工具&…...

SITS2026图谱深度解读:从LlamaFactory到vLLM再到Prometheus-Metrics,谁才是真正可规模化的工程底座?

第一章:SITS2026发布:大模型工程化工具链图谱 2026奇点智能技术大会(https://ml-summit.org) SITS2026(Scalable Intelligent Toolchain Summit 2026)正式发布面向生产级大模型开发的全栈工程化工具链图谱,聚焦模型训…...

三步开启AI音乐创作:AICoverGen零基础制作专业级翻唱指南

三步开启AI音乐创作:AICoverGen零基础制作专业级翻唱指南 【免费下载链接】AICoverGen A WebUI to create song covers with any RVC v2 trained AI voice from YouTube videos or audio files. 项目地址: https://gitcode.com/gh_mirrors/ai/AICoverGen 想要…...

时变分位数ΔCoVaR模型代码功能说明

时变动态分位数CoVaR、delta-CoVaR,分位数回归 △CoVaR测度 溢出效应 动态 Adrian2016基于分位数回归方法计算动态条件在险价值。 R语言代码,代码更换数据就能用,需要修改的地方都已标明,并且举例怎么修改 每一行代码都有注释&am…...

Dify 1.3.1离线部署保姆级教程:手把手解决Docker镜像拉取失败问题

Dify 1.3.1离线部署全攻略:从镜像获取到故障排查的完整解决方案 在当今AI应用开发领域,Dify作为一款开源的LLM应用程序开发平台,正受到越来越多开发者的青睐。然而,在实际部署过程中,网络环境限制往往成为阻碍开发者快…...

)

大模型端侧部署必读:6类硬件约束下压缩算法适配矩阵(含INT4/FP8/FP16混合精度吞吐实测数据)

第一章:大模型工程化中的模型压缩算法对比 2026奇点智能技术大会(https://ml-summit.org) 模型压缩是实现大语言模型在边缘设备、低延迟服务及成本敏感场景中落地的关键工程环节。不同压缩路径在精度保留、推理加速比、部署兼容性与训练资源消耗上呈现显著差异&…...

【技术解析】llama.cpp中的量化计算与RVV加速实现

1. llama.cpp中的量化计算机制剖析 在边缘计算设备上运行大语言模型时,量化技术就像给模型"瘦身"的魔法。llama.cpp作为轻量级推理框架,其量化实现堪称教科书级别的优化案例。我曾在树莓派上实测过量化效果,Q4_0模型体积只有原版的…...