大模型安全相关论文

LLM对于安全的优势

“Generating secure hardware using chatgpt resistant to cwes,” Cryptology ePrint Archive, Paper 2023/212, 2023评估了ChatGPT平台上代码生成过程的安全性,特别是在硬件领域。探索了设计者可以采用的策略,使ChatGPT能够提供安全的硬件代码生成

“Fixing hardware security bugs with large language models,” arXiv preprint arXiv:2302.01215, 2023. 将关注点转移到硬件安全上。研究了LLMs,特别是OpenAI的Codex,在自动识别和修复硬件设计中与安全相关的bug方面的使用。

“Novel approach to cryptography implementation using chatgpt,” 使用ChatGPT实现密码学,最终保护数据机密性。尽管缺乏广泛的编码技巧或编程知识,但作者能够通过ChatGPT成功地实现密码算法。这凸显了个体利用ChatGPT进行密码学任务的潜力。

“Agentsca: Advanced physical side channel analysis agent with llms.” 2023.探索了应用LLM技术来开发侧信道分析方法。该研究包括3种不同的方法:提示工程、微调LLM和基于人类反馈强化学习的微调LLM

LLM的隐私保护

通过最先进的隐私增强技术(例如,零知识证明 ,差分隐私[ 233,175,159 ]和联邦学习[ 140,117,77 ] )来增强LLM

- “Privacy and data protection in chatgpt and other ai chatbots: Strategies for securing user information,”

- “Differentially private decoding in large language models,”

- “Privacy-preserving prompt tuning for large language model services,”

- “Federatedscope-llm: A comprehensive package for fine-tuning large language models in federated learning,”

- “Chatgpt passing usmle shines a spotlight on the flaws of medical education,”

- “Fate-llm: A industrial grade federated learning framework for large language models,”

对LLM的攻击

侧信道攻击

“Privacy side channels in machine learning systems,”引入了隐私侧信道攻击,这是一种利用系统级组件(例如,数据过滤、输出监控等)以远高于单机模型所能实现的速度提取隐私信息的攻击。提出了覆盖整个ML生命周期的4类侧信道,实现了增强型成员推断攻击和新型威胁(例如,提取用户的测试查询)

数据中毒攻击

- “Universal jailbreak backdoors from poisoned human feedback,”

- “On the exploitability of instruction tuning,”

- “Promptspecific poisoning attacks on text-to-image generative models,”

- “Poisoning language models during instruction tuning,”

后门攻击

- “Chatgpt as an attack tool: Stealthy textual backdoor attack via blackbox generative model trigger,”

- “Large language models are better adversaries: Exploring generative clean-label backdoor attacks against text classifiers,”

- “Poisonprompt: Backdoor attack on prompt-based large language models,”

属性推断攻击

- “Beyond memorization: Violating privacy via inference with large language models,”首次全面考察了预训练的LLMs从文本中推断个人信息的能力

提取训练数据

- “Ethicist: Targeted training data extraction through loss smoothed soft prompting and calibrated confidence estimation,”

- “Canary extraction in natural language understanding models,”

- “What do code models memorize? an empirical study on large language models of code,”

- “Are large pre-trained language models leaking your personal information?”

- “Text revealer: Private text reconstruction via model inversion attacks against transformers,”

提取模型

- “Data-free model extraction,”

对LLM的防御

模型架构防御

- “Large language models can be strong differentially private learners,”具有较大参数规模的语言模型可以更有效地以差分隐私的方式进行训练。

- “Promptbench: Towards evaluating the robustness of large language models on adversarial prompts,”

- “Evaluating the instructionfollowing robustness of large language models to prompt injection,”更广泛的参数规模的LLMs,通常表现出对对抗攻击更高的鲁棒性。

- “Revisiting out-of-distribution robustness in nlp: Benchmark, analysis, and llms evaluations,”在Out - of - distribution ( OOD )鲁棒性场景中也验证了这一点

- “Synergistic integration of large language models and cognitive architectures for robust ai: An exploratory analysis,”通过将多种认知架构融入LLM来提高人工智能的鲁棒性。

- “Building trust in conversational ai: A comprehensive review and solution architecture for explainable, privacy-aware systems using llms and knowledge graph,”与外部模块(知识图谱)相结合来提高LLM的安全性

LLM训练的防御:对抗训练

- “Adversarial training for large neural language models,”

- “Improving neural language modeling via adversarial training,”

- “Freelb: Enhanced adversarial training for natural language understanding,”

- “Towards improving adversarial training of nlp models,”

- “Token-aware virtual adversarial training in natural language understanding,”

- “Towards deep learning models resistant to adversarial attacks,”

- “Achieving model robustness through discrete adversarial training,”

- “Towards improving adversarial training of nlp models,”

- “Improving neural language modeling via adversarial training,”

- “Adversarial training for large neural language models,”

- “Freelb: Enhanced adversarial training for natural language understanding,”

- “Token-aware virtual adversarial training in natural language understanding,”

LLM训练的防御:鲁棒微调

- “How should pretrained language models be fine-tuned towards adversarial robustness?”

- “Smart: Robust and efficient fine-tuning for pre-trained natural language models through principled regularized optimization,”

- “Safety-tuned llamas: Lessons from improving the safety of large language models that follow instructions,”

LLM推理的防御:指令预处理

- “Baseline defenses for adversarial attacks against aligned language models,”评估了多种针对越狱攻击的基线预处理方法,包括重令牌化和复述。

- “On the reliability of watermarks for large language models,”评估了多种针对越狱攻击的基线预处理方法,包括重令牌化和复述

- “Text adversarial purification as defense against adversarial attacks,”通过先对输入令牌进行掩码,然后与其他LLMs一起预测被掩码的令牌来净化指令。

- “Jailbreak and guard aligned language models with only few in-context demonstrations,”证明了在指令中插入预定义的防御性证明可以有效地防御LLMs的越狱攻击。

- “Testtime backdoor mitigation for black-box large language models with defensive demonstrations,”证明了在指令中插入预定义的防御性证明可以有效地防御LLMs的越狱攻击。

LLM推理的防御:恶意检测

提供了对LLM中间结果的深度检查,如神经元激活

- “Defending against backdoor attacks in natural language generation,”提出用后向概率检测后门指令。

- “A survey on evaluation of large language models,”从掩蔽敏感性的角度区分了正常指令和中毒指令。

- “Bddr: An effective defense against textual backdoor attacks,”根据可疑词的文本相关性来识别可疑词。

- “Rmlm: A flexible defense framework for proactively mitigating word-level adversarial attacks,”根据多代之间的语义一致性来检测对抗样本

- “Shifting attention to relevance: Towards the uncertainty estimation of large language models,”在LLMs的不确定性量化中对此进行了探索

- “Onion: A simple and effective defense against textual backdoor attacks,”利用了语言统计特性,例如检测孤立词。

LLM推理的防御:生成后处理

- “Jailbreaker in jail: Moving target defense for large language models,”通过与多个模型候选物比较来减轻生成的毒性。

- “Llm self defense: By self examination, llms know they are being tricked,”

相关文章:

大模型安全相关论文

LLM对于安全的优势 “Generating secure hardware using chatgpt resistant to cwes,” Cryptology ePrint Archive, Paper 2023/212, 2023评估了ChatGPT平台上代码生成过程的安全性,特别是在硬件领域。探索了设计者可以采用的策略,使ChatGPT能够提供安…...

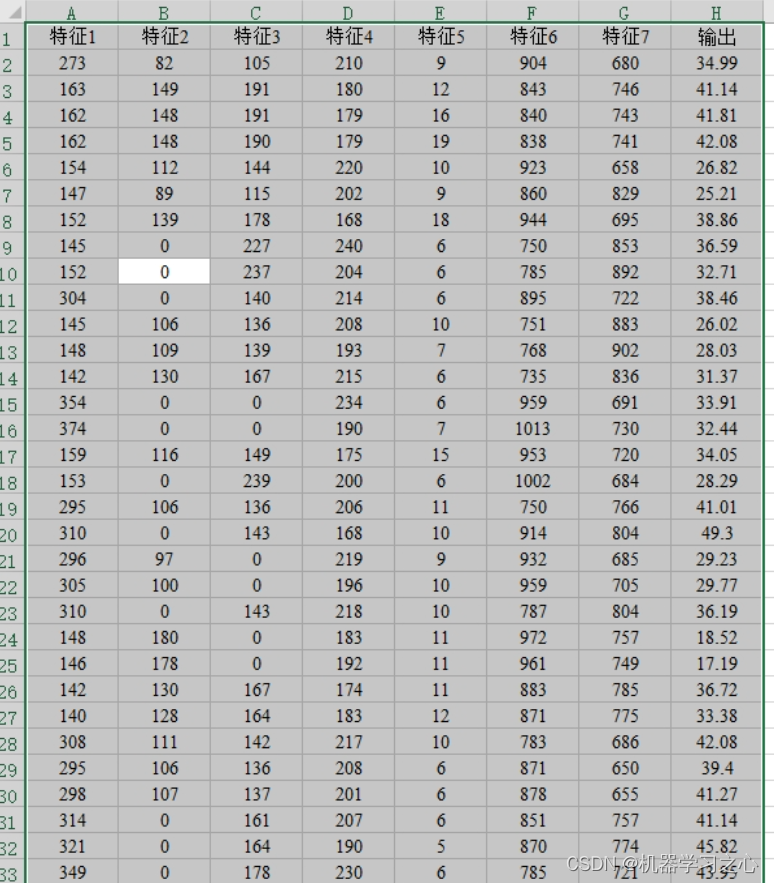

回归预测 | Matlab实现PSO-BiLSTM-Attention粒子群算法优化双向长短期记忆神经网络融合注意力机制多变量回归预测

回归预测 | Matlab实现PSO-BiLSTM-Attention粒子群算法优化双向长短期记忆神经网络融合注意力机制多变量回归预测 目录 回归预测 | Matlab实现PSO-BiLSTM-Attention粒子群算法优化双向长短期记忆神经网络融合注意力机制多变量回归预测预测效果基本描述程序设计参考资料 预测效果…...

[算法沉淀记录] 排序算法 —— 堆排序

排序算法 —— 堆排序 算法基础介绍 堆排序(Heap Sort)是一种基于比较的排序算法,它利用堆这种数据结构来实现排序。堆是一种特殊的完全二叉树,其中每个节点的值都必须大于或等于(最大堆)或小于或等于&am…...

C++ //练习 9.33 在本节最后一个例子中,如果不将insert的结果赋予begin,将会发生什么?编写程序,去掉此赋值语句,验证你的答案。

C Primer(第5版) 练习 9.33 练习 9.33 在本节最后一个例子中,如果不将insert的结果赋予begin,将会发生什么?编写程序,去掉此赋值语句,验证你的答案。 环境:Linux Ubuntu࿰…...

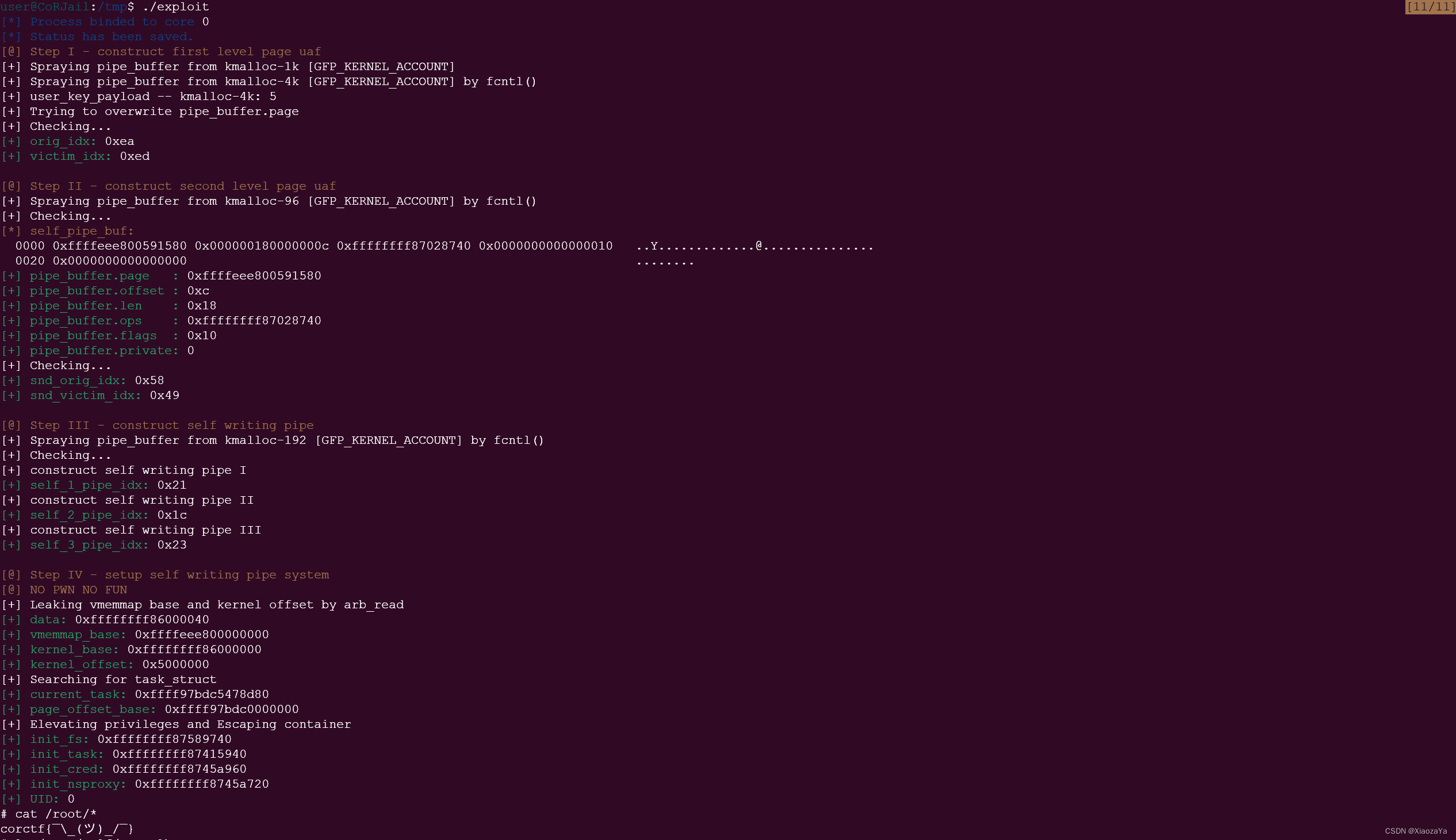

[corCTF 2022] CoRJail: From Null Byte Overflow To Docker Escape

前言 题目来源:竞赛官网 – 建议这里下载,文件系统/带符号的 vmlinux 给了 参考 [corCTF 2022] CoRJail: From Null Byte Overflow To Docker Escape Exploiting poll_list Objects In The Linux Kernel – 原作者文章,poll_list 利用方式…...

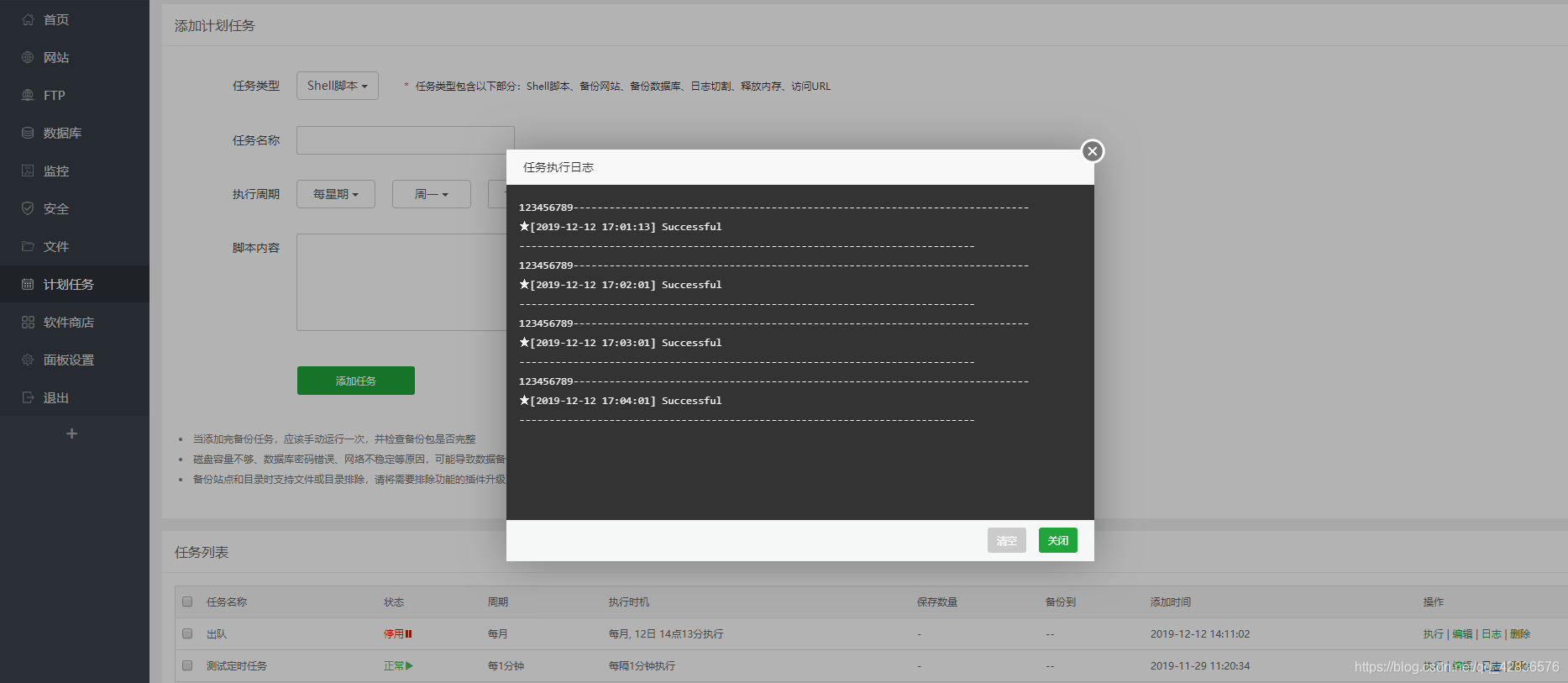

thinkphp6定时任务

这里主要是教没有用过定时任务没有头绪的朋友, 定时任务可以处理一些定时备份数据库等一系列操作, 具体根据自己的业务逻辑进行更改 直接上代码 首先, 是先在 tp 中的 command 方法中声明, 如果没有就自己新建一个, 代码如下 然后就是写你的业务逻辑 执行定时任务 方法写好了…...

)

支持国密ssl的curl编译和测试验证(上)

目录 1. 编译铜锁ssl库2. 编译nghttp2库3. 编译curl4. 验证4.1 查看版本信息4.2 验证国密ssl握手功能4.3 验证http2协议功能 以下以ubuntu 22.04环境为例进行编译 本次编译采用铜锁sslnghttp2curl,使得编译出来的curl可以支持国密ssl,并且可以支持http2…...

包装类详解

概述 Java提供了两个类型系统,基本类型与引用类型,使用基本类型在于效率,然而很多情况,会创建对象使用,因为对象可以做更多的功能,如果想要我们的基本类型像对象一样操作,就可以使用基本类型对…...

vue3与vue2的区别

Vue 3和Vue 2在以下几个方面有一些区别: 性能提升:Vue 3对渲染性能和内存占用进行了优化,使用了Proxy代理对象,比Vue 2的Object.defineProperty更高效。此外,Vue 3还引入了静态树提升(Static Tree Hoisting…...

SSL OV证书和DV、EV证书的区别

在网站搭建的过程中和小程序开发过程中,很难免会有需要用到SSL证书的地方,但是目前数字证书种类繁多,该选择什么类型的证书成为了一个令人纠结的问题。 目前在市场上较为常见的证书分为三种:DV域名验证型证书;OV组织验…...

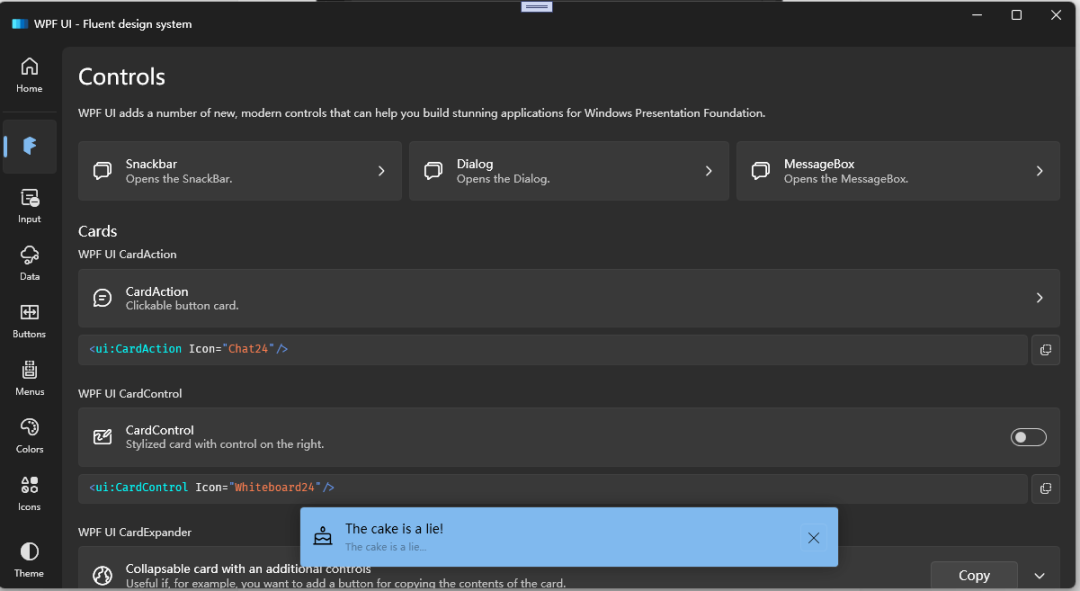

一款.NET下 WPF UI框架介绍

WPF开源的UI框架有很多,如HandyControl、MahApps.Metro、Xceed Extended WPF Toolkit™、Modern UI for WPF (MUI)、Layui-WPF、MaterialDesignInXamlToolkit、等等,今天小编带大家认识一款比较常用的kaiyuanUI---WPF UI,这款ui框架美观现代化,用起来也超级方便, 界面展示…...

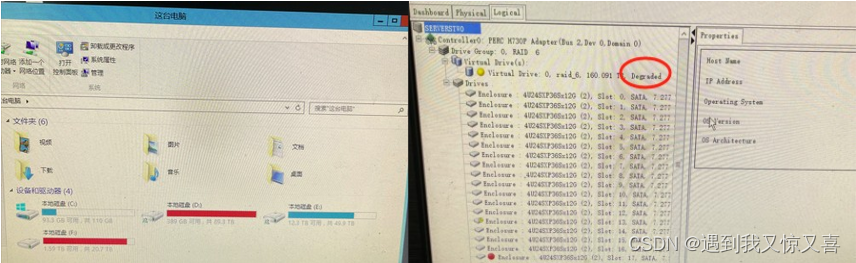

东莞IBM服务器维修之IBM x3630 M4阵列恢复

记录东莞某抖音电商公司送修一台IBM SYSTEM X3630 M4文档服务器RAID6故障导致数据丢失的恢复案例 时间:2024年02月20日, 服务器品牌:IBM System x3630 M4,阵列卡用的是DELL PERC H730P 服务器用途和用户位置:某抖音电…...

Flask基础学习4

19-【实战】问答平台项目结构搭建_剪_哔哩哔哩_bilibili 参考如上大佬的视频教程,本博客仅当学习笔记,侵权请联系删除 问答发布的web前端页面实现 register.html {% extends base.html %}{% block head %}<link rel"stylesheet" href&q…...

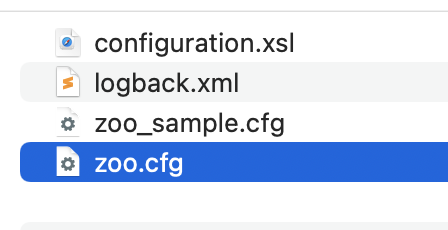

mac安装zookeeper

下载地址: http://archive.apache.org/dist/zookeeper/ 注意:由于Zookeeper从3.5.5版本开始,带有bin名称的包才是我们想要的下载可以直接使用的里面有编译后的二进制的包,而之前的普通的tar.gz的包里面是只是源码的包无法直接使…...

IT资讯——全速推进“AI+鸿蒙”战略布局!

文章目录 每日一句正能量前言坚持长期研发投入全速推进“AI鸿蒙”战略 人才战略新章落地持续加码核心技术生态建设 后记 每日一句正能量 人总要咽下一些委屈,然后一字不提的擦干眼泪往前走,没有人能像白纸一样没有故事,成长的代价就是失去原来…...

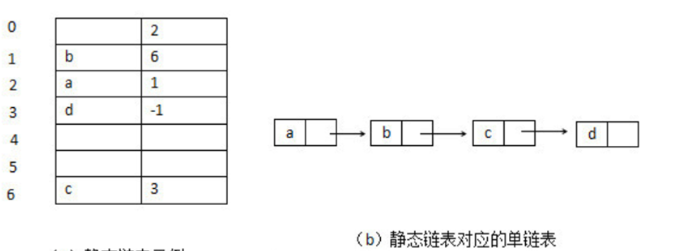

数据结构知识点总结-线性表(3)-双向链表定义、循环单链表、、循环双向链表、静态链表、顺序表与链表的比较

双向链表定义 单链表结点中只有一个指向其后继的指针,这使得单链表只能从头结点依次顺序地向后遍历。若要访问某个结点的前驱结点(插入、删除操作时),只能从头开始遍历,访问后继结点的时间复杂度为 O(1) , …...

JAVA学习-控制执行流程.for

在Java中,for循环是一种常用的控制执行流程的循环语句。它允许我们重复执行一段代码,直到满足指定的循环条件。 一、for循环的基本语法如下: for (初始化语句; 循环条件; 循环后操作) {// 循环体,要执行的代码} 其中,…...

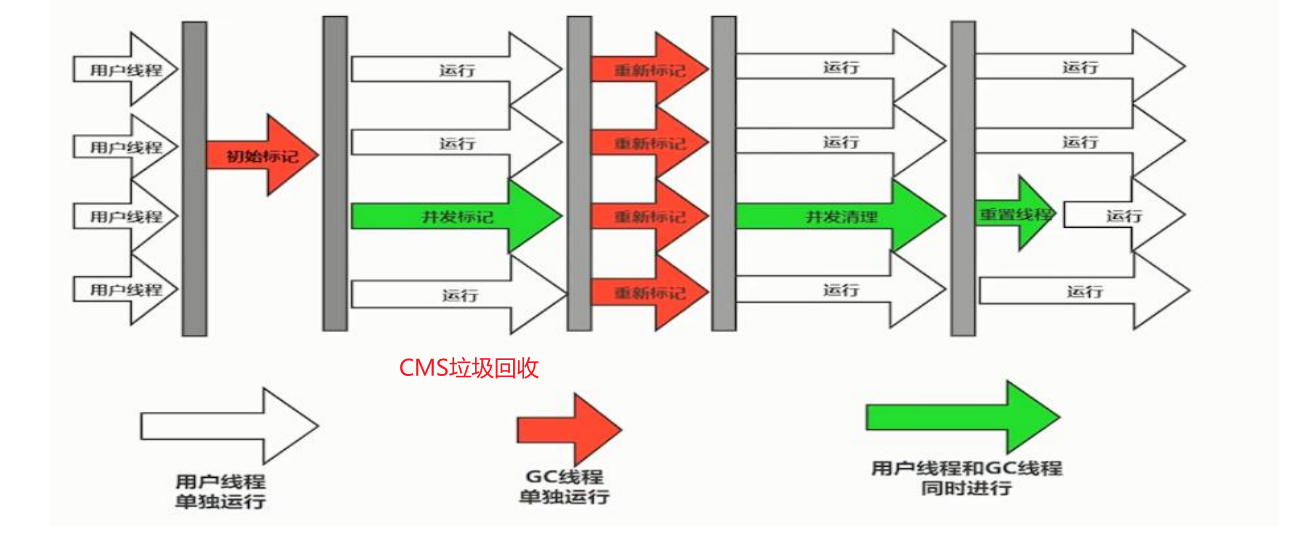

面试总结之JVM入门

文章目录 🐒个人主页🏅JavaEE系列专栏📖前言:🎀你为什么要学习JVM?🎀JVM的作用 🎀JVM的构成(5大类)🏨1.类加载系统🐕类什么时候会被加…...

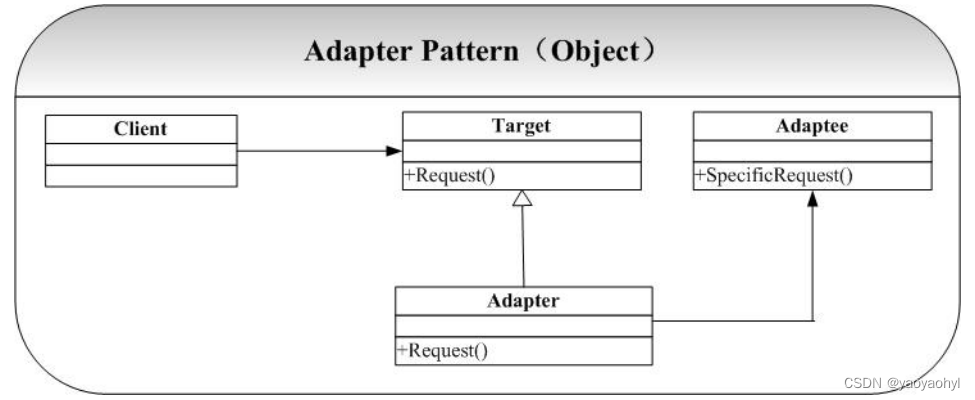

适配器模式(Adapter Pattern) C++

上一节:原型模式(Prototype Pattern) C 文章目录 0.理论1.组件2.类型3.什么时候使用 1.实践1.基础接口和类2.类适配器实现3.对象适配器实现 0.理论 适配器模式(Adapter Pattern)是一种结构型设计模式,它允…...

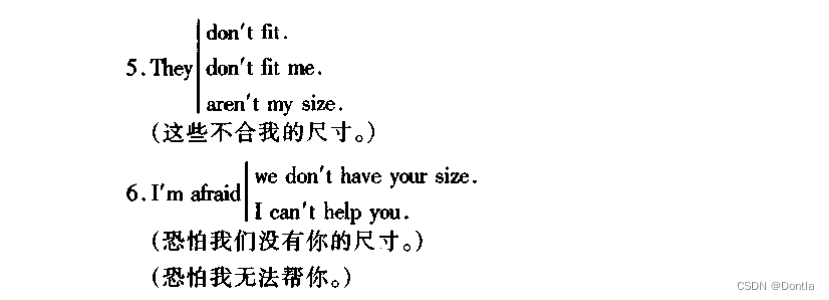

【程序员英语】【美语从头学】初级篇(入门)(笔记)Lesson 16 At the Shoe Store 在鞋店

《美语从头学初级入门篇》 注意:被 删除线 划掉的不一定不正确,只是不是标准答案。 文章目录 Lesson 16 At the Shoe Store 在鞋店对话A对话B笔记会话A会话B替换 Lesson 16 At the Shoe Store 在鞋店 对话A A: Do you have these shoes in size 8? B:…...

FPGA时序约束实战:input delay约束的5个常见坑点及解决方法

FPGA时序约束实战:input delay约束的5个常见坑点及解决方法 在FPGA开发中,时序约束的正确设置往往是项目成败的关键。我曾在一个高速数据采集项目中,因为input delay约束设置不当,导致系统在高温环境下出现偶发性数据错误…...

从‘它好慢’到‘真香’:Vite + Vue 3项目实战中那些让你开发效率翻倍的配置技巧

从‘它好慢’到‘真香’:Vite Vue 3项目实战中那些让你开发效率翻倍的配置技巧 如果你正在使用Vite和Vue 3进行开发,却总觉得构建速度不够快、开发体验不够流畅,或者在某些特定功能配置上卡壳,那么这篇文章就是为你准备的。我们将…...

1999-2025.4汽车之家、懂车帝汽车配置信息数据库

汽车配置信息数据是连接汽车生产、销售、使用及后市场服务的核心纽带,对不同主体均具有不可替代的价值。对消费者可辅助决策,规避风险,对车企可指导研发,优化生产,对经销商可精准销售,提升转化,…...

大模型Transformer架构学习

基础知识: 损失函数:梯度下降单次训练过程过拟合数据增强:增加训练数据,对原始数据加噪,翻转,旋转 正则化:防止该函数过分变化,让损失函数加上该参数,调整损失函数时会抑…...

大多数开发者还以为2026年AI编码拼的是模型,其实竞争早已转向系统架构

最近刷到Qoder和几个大厂的分享,我瞬间意识到:AI编码的战场已经彻底变天了。 很多人还在卷模型参数、卷上下文长度,以为下一个SOTA模型出来就能让Agent“起飞”。但真实情况是——Stripe每周合并1300个完全由Agent写的PR,Ramp有30…...

Python项目依赖管理:pipreqs vs pip freeze,哪个更适合你的项目?

Python项目依赖管理:pipreqs vs pip freeze,哪个更适合你的项目? 在Python开发中,依赖管理是项目维护的重要环节。一个清晰、准确的依赖清单不仅能确保项目在不同环境中稳定运行,还能简化团队协作和部署流程。面对pip…...

Pixel Fashion Atelier新手教程:非对称RPG布局下各模块功能与协作逻辑详解

Pixel Fashion Atelier新手教程:非对称RPG布局下各模块功能与协作逻辑详解 1. 认识像素时装锻造坊 Pixel Fashion Atelier(像素时装锻造坊)是一款基于Stable Diffusion与Anything-v5的图像生成工具,它通过独特的RPG游戏界面设计…...

Debian/Ubuntu 上 KVM 虚拟化环境搭建全攻略:从源码到实战

Debian/Ubuntu 上 KVM 虚拟化环境搭建全攻略:从源码到实战 在当今云计算和容器化技术蓬勃发展的时代,虚拟化技术依然是基础设施领域不可或缺的基石。KVM(Kernel-based Virtual Machine)作为Linux内核原生支持的虚拟化解决方案&…...

终极scan4all安全扫描工具:如何生成专业日志分析与安全评估报告

终极scan4all安全扫描工具:如何生成专业日志分析与安全评估报告 【免费下载链接】scan4all 项目地址: https://gitcode.com/gh_mirrors/sc/scan4all scan4all是一款功能强大的自动化安全扫描工具,它集成了vscan、nuclei、ksubdomain、subfinder等…...

跨平台实战:Windows与macOS下OpenClaw对接nanobot的差异详解

跨平台实战:Windows与macOS下OpenClaw对接nanobot的差异详解 1. 为什么需要关注跨平台差异 上周我在团队内部推广OpenClaw时,遇到了一个典型问题:同样的nanobot对接流程,在Windows和macOS上执行时出现了完全不同的行为。这让我意…...