基于Kafka的日志采集

目录

前言

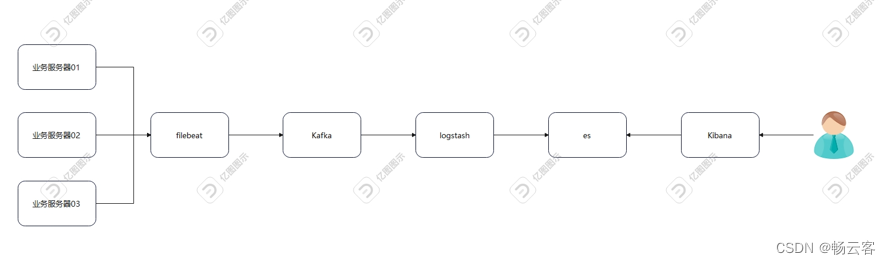

架构图

资源列表

基础环境

关闭防护墙

关闭内核安全机制

修改主机名

添加hosts映射

一、部署elasticsearch

修改limit限制

部署elasticsearch

修改配置文件

启动

二、部署filebeat

部署filebeat

添加配置文件

启动

三、部署kibana

部署kibana

修改配置文件

启动

四、部署Kafka

安装java

安装kafka

配置环境变量

创建数据存储目录和日志存储目录

修改zk配置文件

修改Kafka配置文件

启动zk

启动Kafka

测试

五、部署logstash

部署logstash

添加配置文件

启动

前言

当日志量变得非常大时,传统的日志收集平台可能会遇到性能瓶颈、单点故障或扩展性问题。在这种情况下,引入消息队列(如Kafka)可以显著增强日志收集系统的健壮性、可扩展性和实时性。

以下是当在日志收集平台中加入Kafka时,可以带来的优势和改进:

-

缓冲和异步处理:

Kafka作为一个消息队列,可以充当Filebeat(或其他日志收集器)和Logstash(或其他日志处理组件)之间的缓冲层。Filebeat可以将日志数据异步地发送到Kafka,而不需要等待Logstash的即时响应。这样,即使Logstash暂时无法处理数据,Kafka也可以暂时存储数据,直到Logstash恢复处理能力。 -

水平扩展:

随着日志量的增长,Kafka可以通过添加更多的节点(brokers)来实现水平扩展。这种扩展方式使得Kafka能够处理更多的并发写入和读取操作,而不会遇到单点故障或性能瓶颈。此外,Kafka的分布式架构还允许数据在多个节点之间进行复制,以提高数据的可靠性和容错性。 -

实时数据处理:

Kafka支持实时数据流处理,使得日志数据可以立即被消费和处理。这意味着一旦日志数据被写入Kafka,就可以立即被Logstash(或其他流处理工具)读取和处理,以满足实时分析、监控和告警的需求。 -

数据持久化:

Kafka将数据持久化到磁盘上,以确保即使在系统崩溃或重启的情况下,数据也不会丢失。这种持久化机制使得Kafka成为了一个可靠的数据传输和存储平台,特别适用于对日志数据进行长期存储和分析的场景。 -

多消费者支持:

Kafka允许多个消费者(如Logstash、其他数据分析工具或应用)从同一个主题(topic)中消费数据。这意味着您可以同时运行多个消费者来处理和分析日志数据,以满足不同的业务需求和数据使用场景。 -

可定制性和灵活性:

Kafka提供了丰富的API和工具,使得您可以轻松地定制和扩展日志收集系统。例如,您可以编写自定义的Kafka生产者来收集特定格式的日志数据,或者编写自定义的Kafka消费者来处理和分析日志数据。 -

与其他系统的集成:

Kafka是一个广泛使用的消息队列系统,它支持与其他各种系统和工具进行集成。这意味着您可以将Kafka轻松地集成到现有的日志收集、处理、存储和分析系统中,以构建一个更加健壮、可扩展和灵活的日志收集平台。

综上所述,当日志量变得非常大时,在日志收集平台中加入Kafka可以显著提高系统的性能、可靠性和可扩展性。通过利用Kafka的缓冲、异步处理、水平扩展、实时数据处理、数据持久化、多消费者支持、可定制性和与其他系统的集成能力,您可以构建一个更加健壮、高效和灵活的日志收集系统。

有需要本次实验软件包的评论区可以找我要,无偿提供。

架构图

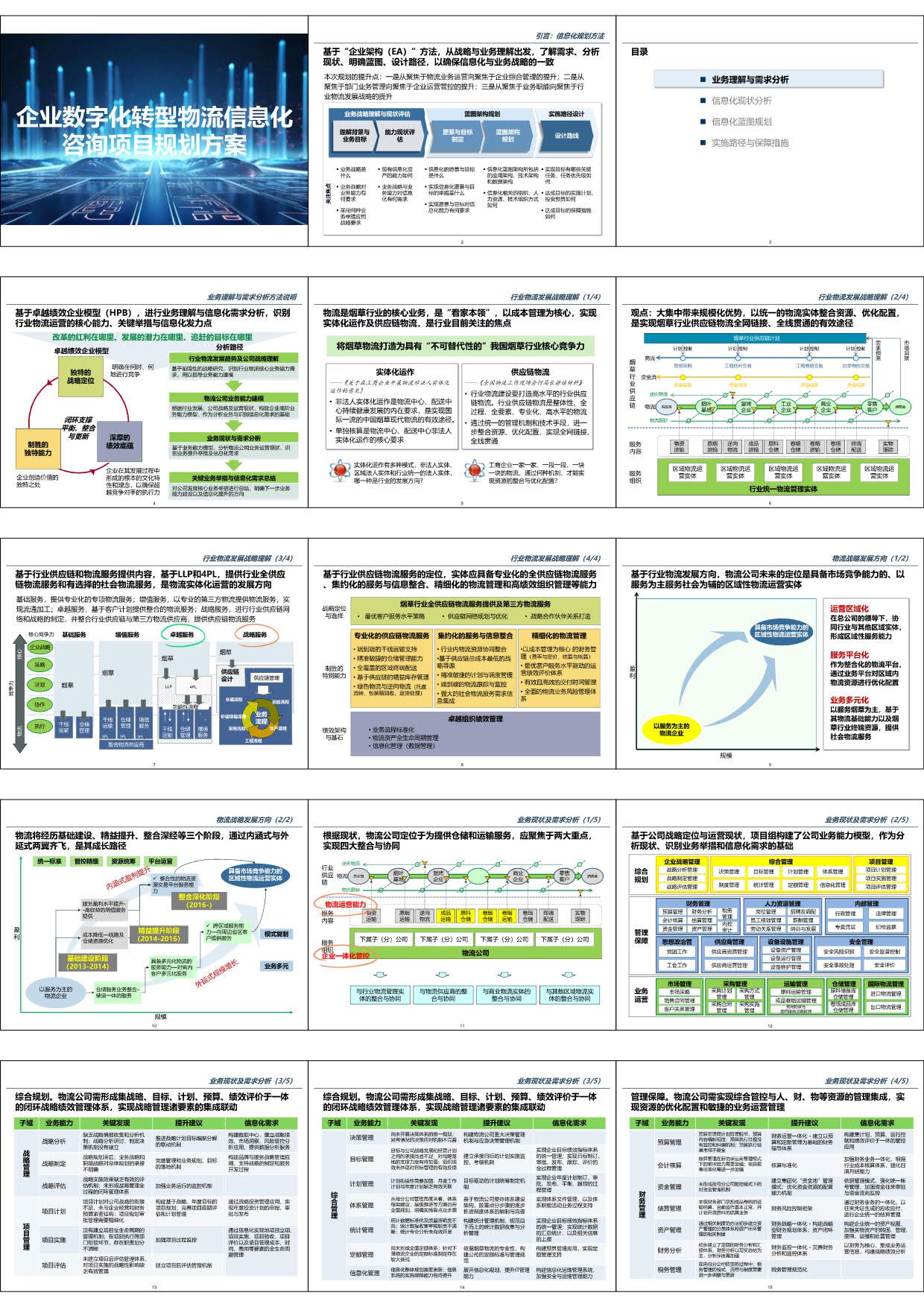

资源列表

| 操作系统 | 配置 | 主机名 | IP |

|---|---|---|---|

| CentOS7.3.1611 | 2C4G | es01 | 192.168.207.131 |

| CentOS7.3.1611 | 2C4G | kibana | 192.168.207.165 |

| CentOS7.3.1611 | 2C4G | filebeat | 192.168.207.166 |

| CentOS7.3.1611 | 2C4G | kafka | 192.168.207.167 |

| CentOS7.3.1611 | 2C4G | logstash | 192.168.207.168 |

基础环境

关闭防护墙

systemctl stop firewalld

systemctl disable firewalld关闭内核安全机制

sed -i "s/.*SELINUX=.*/SELINUX=disabled/g" /etc/selinux/config

reboot修改主机名

hostnamectl set-hostname es01

hostnamectl set-hostname kibana

hostnamectl set-hostname filebeat

hostnamectl set-hostname kafka

hostnamectl set-hostname logstash添加hosts映射

cat >> /etc/hosts << EOF

192.168.207.131 es01

192.168.207.165 kibana

192.168.207.166 filebeat

192.168.207.167 kafka

192.168.207.168 logstash

EOF一、部署elasticsearch

修改limit限制

cat > /etc/security/limits.d/es.conf << EOF

* soft nproc 655360

* hard nproc 655360

* soft nofile 655360

* hard nofile 655360

EOF

cat >> /etc/sysctl.conf << EOF

vm.max_map_count=655360

EOF

sysctl -p部署elasticsearch

mkdir -p /data/elasticsearch

tar zxvf elasticsearch-7.14.0-linux-x86_64.tar.gz -C /data/elasticsearch修改配置文件

mkdir /data/elasticsearch/{data,logs}[root@es01 elasticsearch-7.14.0]# grep -v "^#" /data/elasticsearch/elasticsearch-7.14.0/config/elasticsearch.yml

cluster.name: my-application

node.name: es01

path.data: /data/elasticsearch/data

path.logs: /data/elasticsearch/logs

bootstrap.memory_lock: false

network.host: 0.0.0.0

http.port: 9200

cluster.initial_master_nodes: ["es01"]启动

useradd es

chown -R es:es /data/

su - es

/data/elasticsearch/elasticsearch-7.14.0/bin/elasticsearch -d二、部署filebeat

部署filebeat

mkdir -p /data/filebeat

tar zxvf filebeat-7.14.0-linux-x86_64.tar.gz -C /data/filebeat/添加配置文件

这里提供了两份filebeat配置文件的参考

[root@filebeat filebeat-7.14.0-linux-x86_64]# cat filebeat.yml

filebeat.inputs:

- type: logenabled: truepaths:- /var/log/messages ###要监控的日志文件

setup.template.settings:index.number_of_shards: 3

output.kafka:#version:0.10.2 ### 根据不同 CKafka 实例开源版本配置hosts: ["192.168.207.167:9092"] ###接入方式所用的IP和端口topic: 'topic_test1' ###topic实例名partition.round_robin:reachable_only: falserequired_acks: 1compression: nonemax_message_bytes: 10000000[root@filebeat filebeat-7.14.0-linux-x86_64]# cat filebeat.yml

filebeat.inputs:

- type: logenabled: truepaths:- /var/log/httpd/access_log ###要监控的日志文件fields:kafka_topic: httpd_access

- type: logenabled: truepaths:- /var/log/httpd/error_log ###要监控的日志文件fields:kafka_topic: httpd_error

setup.template.settings:index.number_of_shards: 3

output.kafka:#version:0.10.2 ### 根据不同 CKafka 实例开源版本配置hosts: ["192.168.207.167:9092"] ###接入方式所用的IP和端口topic: '%{[fields.kafka_topic]}' ###topic实例名partition.round_robin:reachable_only: falserequired_acks: 1compression: nonemax_message_bytes: 10000000启动

/data/filebeat/filebeat-7.14.0-linux-x86_64/filebeat -e -c filebeat.yml三、部署kibana

部署kibana

mkdir -p /data/kibana

tar zxvf kibana-7.14.0-linux-x86_64.tar.gz -C /data/kibana/修改配置文件

grep -v "^#" /data/kibana/kibana-7.14.0-linux-x86_64/config/kibana.yml | grep -v "^$"

server.port: 5601

server.host: "0.0.0.0"

elasticsearch.hosts: ["http://192.168.207.131:9200"]

kibana.index: ".kibana"启动

useradd kibana

chown -R kibana:kibana /data

su - kibana

/data/kibana/kibana-7.14.0-linux-x86_64/bin/kibana四、部署Kafka

安装java

# 安装java环境

yum -y install java-1.8.0-openjdk安装kafka

tar zxvf kafka_2.12-3.0.0.tgz

mv kafka_2.12-3.0.0 /usr/local/kafka配置环境变量

# 配置环境变量

cat > /etc/profile.d/zookeeper.sh << 'EOF'

export ZOOKEEPER_HOME=/usr/local/kafka

export PATH=$ZOOKEEPER_HOME/bin:$PATH

EOFcat > /etc/profile.d/kafka.sh << 'EOF'

export KAFKA_HOME=/usr/local/kafka

export PATH=$KAFKA_HOME/bin:$PATH

EOFsource /etc/profile创建数据存储目录和日志存储目录

mkdir -p /usr/local/kafka/zookeeper

mkdir -p /usr/local/kafka/log/zookeeper

mkdir -p /usr/local/kafka/log/kafka# 创建zk需要的myid文件

echo 0 > /usr/local/kafka/zookeeper/myid修改zk配置文件

# 注意Kafka安装目录下的config目录里

server.properties #是Kafka的配置文件

zookeeper.properties #是zookeeper的配置文件

cat >> /usr/local/kafka/config/zookeeper.properties << EOF

dataLogDir=/usr/local/kafka/log/zookeeper

tickTime=2000

initLimit=10

syncLimit=5

server.0=192.168.207.167:2888:3888

EOFsed -i "s/dataDir\=\/tmp\/zookeeper/dataDir\=\/usr\/local\/kafka\/zookeeper/g" /usr/local/kafka/config/zookeeper.properties修改Kafka配置文件

# /usr/local/kafka/config/server.properties修改listeners=PLAINTEXT://192.168.207.167:9092

advertised.listeners=PLAINTEXT://192.168.207.167:9092

log.dirs=/usr/local/kafka/log/kafka

delete.topic.enable=true

zookeeper.connect=192.168.207.167:2181启动zk

/usr/local/kafka/bin/zookeeper-server-start.sh -daemon /usr/local/kafka/config/zookeeper.properties启动Kafka

/usr/local/kafka/bin/kafka-server-start.sh -daemon /usr/local/kafka/config/server.properties测试

# 创建一个topic

[root@kafka kafka]# bin/kafka-topics.sh --create --bootstrap-server 192.168.207.167:9092 --replication-factor 1 --partitions 1 --topic Hello-Kafka

Created topic Hello-Kafka.# 往topic里面输入消息

[root@kafka kafka]# /usr/local/kafka/bin/kafka-console-producer.sh --broker-list 192.168.207.167:9092 --topic Hello-Kafka# 从topic里面消费消息

[root@kafka ~]# /usr/local/kafka/bin/kafka-console-consumer.sh --bootstrap-server 192.168.207.167:9092 --topic Hello-Kafka --from-beginning# 查看topic列表

[root@kafka kafka]# /usr/local/kafka/bin/kafka-topics.sh --bootstrap-server 192.168.207.167:9092 --list

Hello-Kafka# 删除topic

[root@kafka kafka]# bin/kafka-topics.sh --delete --bootstrap-server 192.168.207.167:9092 --topic Hello-Kafka五、部署logstash

部署logstash

mkdir -p /data/logstash

tar zxvf logstash-7.14.0-linux-x86_64.tar.gz -C /data/logstash/添加配置文件

mkdir /data/logstash/logstash-7.14.0/conf.dcat > /data/logstash/logstash-7.14.0/conf.d/system.conf << 'EOF'

input { kafka{ bootstrap_servers =>"192.168.207.167:9092" topics =>"topic_test1" type =>"topic_test1"codec =>"json" }

}

output { if [type] == "topic_test1" {elasticsearch { hosts => ["192.168.207.131:9200"] index =>"kafka-system-%{+YYYY.MM.dd}" } }

}EOF

cat > /data/logstash/logstash-7.14.0/conf.d/httpd.conf << 'EOF'

input { kafka{ bootstrap_servers =>"192.168.207.167:9092" topics =>"httpd_access" type =>"httpd_access"codec =>"json" } kafka{ bootstrap_servers =>"192.168.207.167:9092" topics =>"httpd_error" type =>"httpd_error"codec =>"json" }

}

output { if [type] == "httpd_access" {elasticsearch { hosts => ["192.168.207.131:9200"] index =>"httpd-access-%{+YYYY.MM.dd}" } }if [type] == "httpd_error" {elasticsearch { hosts => ["192.168.207.131:9200"] index =>"httpd-error-%{+YYYY.MM.dd}" } }

}EOF启动

/data/logstash/logstash-7.14.0/bin/logstash -f /data/logstash/logstash-7.14.0/conf.d/相关文章:

基于Kafka的日志采集

目录 前言 架构图 资源列表 基础环境 关闭防护墙 关闭内核安全机制 修改主机名 添加hosts映射 一、部署elasticsearch 修改limit限制 部署elasticsearch 修改配置文件 启动 二、部署filebeat 部署filebeat 添加配置文件 启动 三、部署kibana 部署kibana 修…...

某烟草企业数字化转型物流信息化咨询项目规划方案(117页PPT)

方案介绍: 烟草企业数字化转型物流信息化咨询项目规划方案将为企业带来多方面的价值,包括提升物流运营效率、降低物流成本、优化供应链管理、增强企业竞争力和促进可持续发展等。这些价值的实现将有助于企业在激烈的市场竞争中保持领先地位并实现可持续…...

失落的方舟 命运方舟台服封号严重 游戏封IP怎么办

步入《失落的方舟》(Lost Ark),这款由Smilegate精心打造的宏大规模在线角色扮演游戏(MMORPG),您将启程前往阿克拉西亚这片饱经沧桑的奇幻大陆,展开一场穿越时空的壮阔探索。在这里,一…...

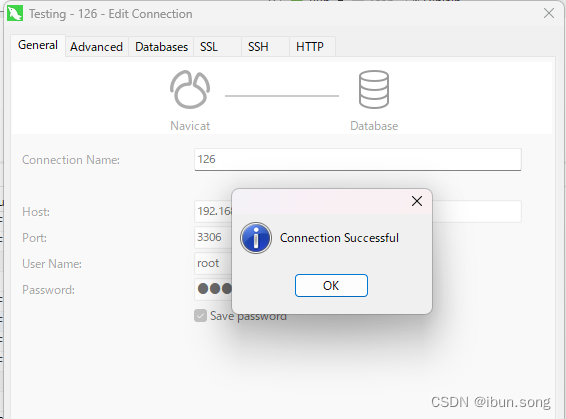

2.10 mysql设置远程访问权限

2.10 mysql设置远程访问权限 目录1. 管理员运行mysql命令窗口2. 使用 root 用户重新登录 MySQL3. 修改用户权限4. 修改mysql安装目录下的my.ini 目录 说明: Mysql8.0 设置远程访问权限 一、Mysql8.0 设置远程访问权限 1. 管理员运行mysql命令窗口 2. 使用 root 用…...

C# 证件照替换底色与设置背景图---PaddleSegSharp

PaddleSegSharp 是一个基于百度飞桨PaddleSeg项目的人像分割模块而开发的.NET的工具类库。 PaddleSegSharp 中PaddleSeg.dll文件是基于开源项目最新发布版本PaddleSeg PaddleSeg的版本修改而成的C动态库,基于opencv的x64编译而成的。 PaddleSeg是基于飞桨PaddlePa…...

HCIA-HarmonyOS Device Developer 课程大纲

一:OpenHarmony 介绍 - ( 3 课时) - OpenHarmony 简介;OpenHarmony 设计理念;OpenHarmony 设计理念概述; - OpenHarmony 试图解决的问题;应用生态割裂问题;用户数据割裂问题&#…...

洗地机哪个牌子最好用?十大名牌洗地机排行榜

作为一种新兴的智能家居产品,洗地机的市场规模已经突破了百亿大关。如此庞大的市场自然吸引了大量资本的涌入,许多品牌纷纷推出自己的洗地机产品,试图在这个竞争激烈的市场中占据一席之地。然而,面对如此多的品牌和型号࿰…...

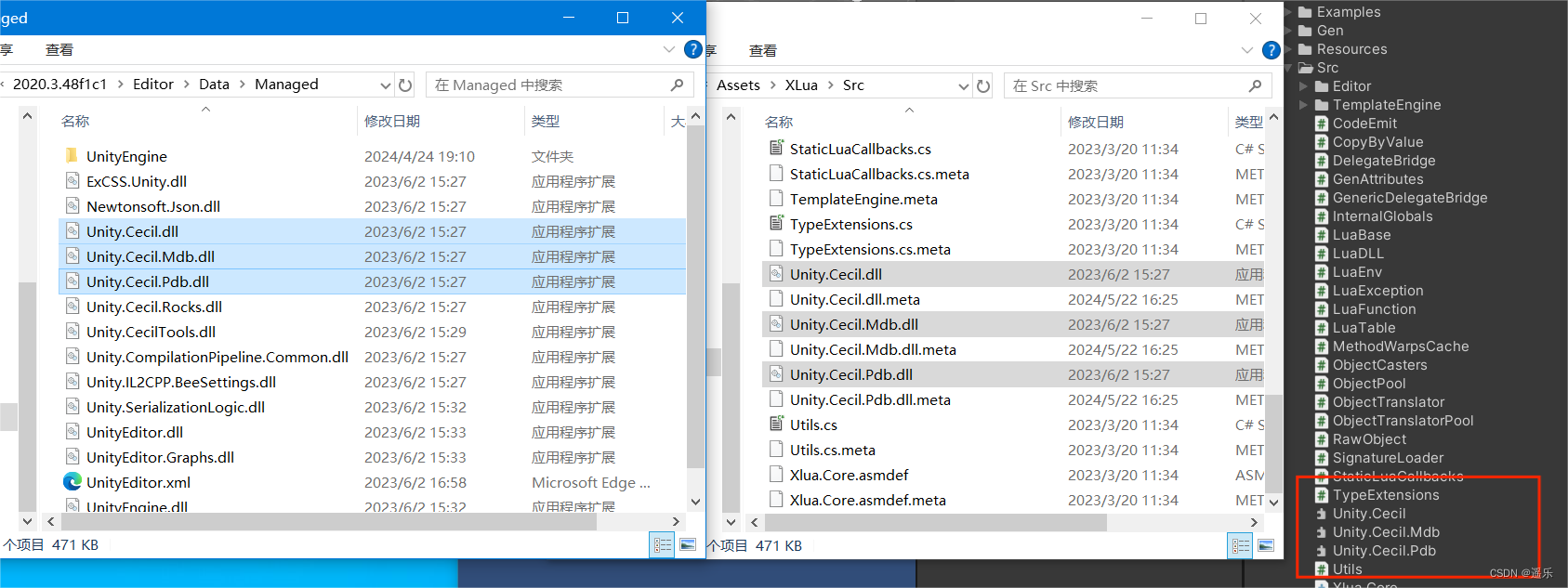

Unity开发——XLua热更新之Hotfix配置(包含xlua获取与导入)

一、Git上获取xlua 最新的xlua包,下载地址链接:https://github.com/Tencent/xLua 二、Unity添加xlua 解压xlua压缩包后,将xlua里的Assets里的文件直接复制进Unity的Assets文件夹下。 成功导入后,unity工具栏会出现xlua选项。 …...

Qt 基于FFmpeg的视频转换器 - 转GIF动图

Qt 基于FFmpeg的视频转换器 - 转GIF动图 引言一、设计思路二、核心源码三、参考链接 引言 gif格式的动图可以通过连续播放一系列图像或视频片段来展示动态效果,使信息更加生动形象,可以很方便的嵌入到网页或者ppt中。上图展示了视频的前几帧转为gif动图的…...

HTML新春烟花盛宴

目录 写在前面 烟花盛宴 完整代码 修改文字...

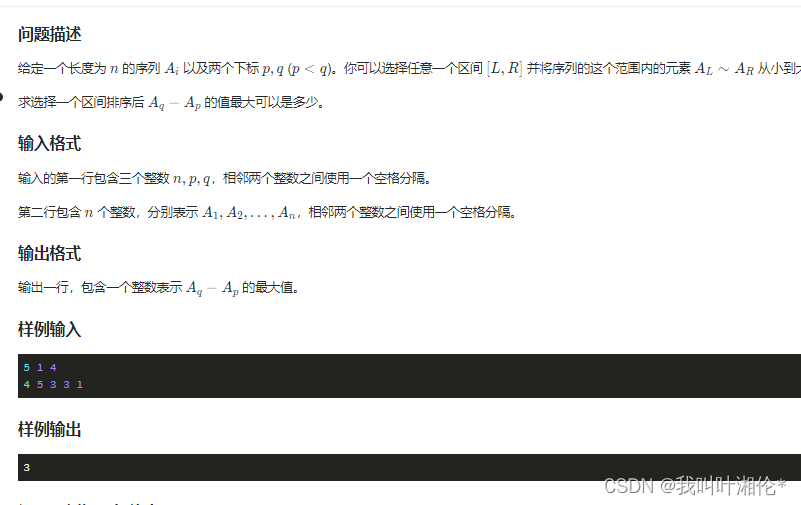

第十四届蓝桥杯c++研究生组

A 混乘数字 关键思路是求每个十进制数的数字以及怎么在一个数组中让判断所有的数字次数相等。 求每个十进制的数字 while(n!0){int x n%10;//x获取了n的每一个位数字n/10;}扩展:求二进制的每位数字 (注意:进制转换、1的个数、位运算&#…...

KDD 2024|基于隐空间因果推断的微服务系统根因定位

简介:本文介绍了由清华大学、南开大学、eBay、微软、中国科学院计算机网络信息中心等单位共同合作的论文《基于隐空间因果推断的受限可观测性场景的微服务系统根因定位》。该论文已被KDD 2024会议录用。 论文标题:Microservice Root Cause Analysis Wit…...

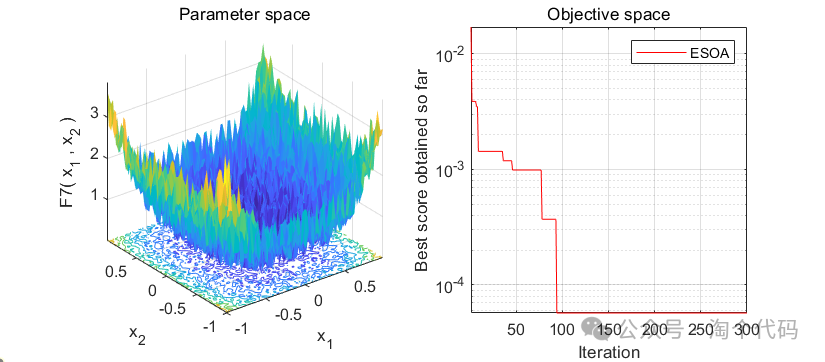

白鹭群优化算法,原理详解,MATLAB代码免费获取

白鹭群优化算法(Egret Swarm Optimization Algorithm,ESOA)是一种受自然启发的群智能优化算法。该算法从白鹭和白鹭的捕食行为出发,由三个主要部分组成:坐等策略、主动策略和判别条件。将ESOA算法与粒子群算法(PSO)、遗传算法(GA)…...

【源码】2024完美运营版商城/拼团/团购/秒杀/积分/砍价/实物商品/虚拟商品等全功能商城

后台可以自由拖曳修改前端UI页面 还支持虚拟商品自动发货等功能 前端UNIAPP 后端PHP 一键部署版本 获取方式: 微:uucodes...

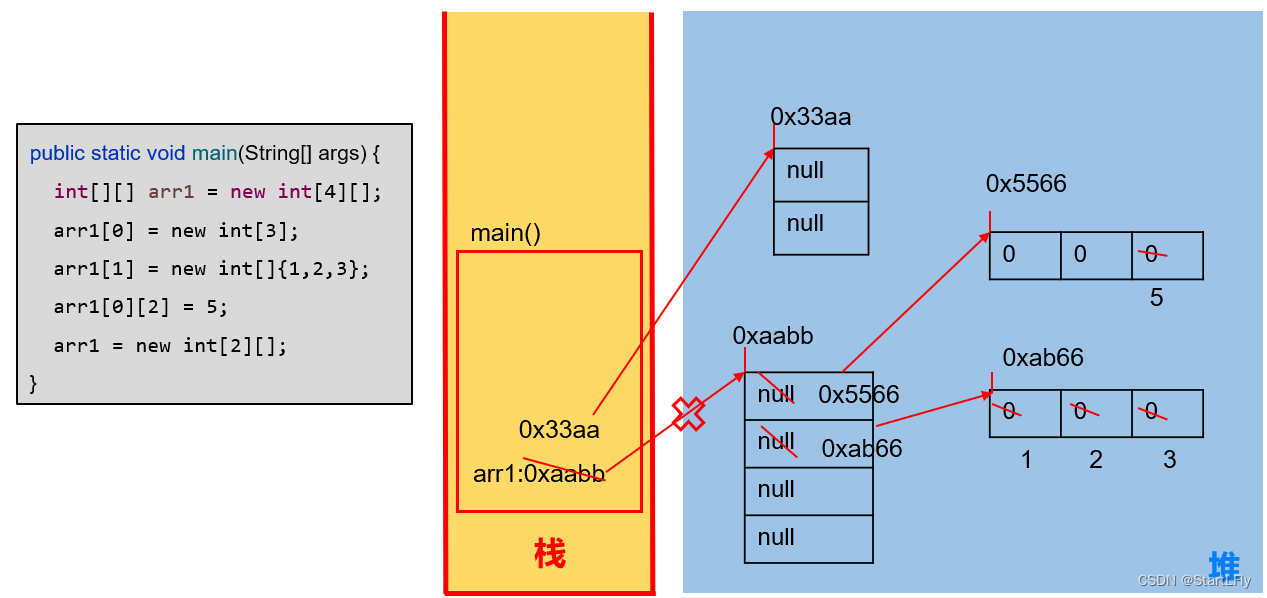

Java-数组内存解析

文章目录 1.内存的主要结构:栈、堆2.一维数组的内存解析3.二维数组的内存解析 1.内存的主要结构:栈、堆 2.一维数组的内存解析 举例1:基本使用 举例2:两个变量指向一个数组 3.二维数组的内存解析 举例1: 举例2&am…...

Spring Cache --学习笔记

一、概述 Spring Cache 是一个框架,实现了基于注解的缓存功能,只需要简单地加一个注解,就能实现缓存功能。 Spring Cache 提供了一层抽象,底层可以切换不同的缓存实现,例如: EHCache Caffeine Redis(常…...

NTP服务的DDoS攻击:原理和防御

NTP协议作为一种关键的互联网基础设施组件,旨在确保全球网络设备间的时钟同步,对于维护数据一致性和安全性至关重要。然而,其设计上的某些特性也为恶意行为者提供了发动大规模分布式拒绝服务(DDoS)攻击的机会。以下是NTP服务DDoS攻击及其防御…...

【面试干货】事务的并发问题(脏读、不可重复读、幻读)与解决策略

【面试干货】事务的并发问题(脏读、不可重复读、幻读)与解决策略 一、脏读(Dirty Read)二、不可重复读(Non-repeatable Read)三、幻读(Phantom Read)四、总结 💖The Begi…...

函数式接口:现代编程的利器

1. 引言 在软件开发的演进过程中,函数式编程(Functional Programming, FP)逐渐显露头角,成为解决复杂问题的有效工具之一。函数式接口作为函数式编程的核心概念之一,其重要性不言而喻。本文将深入探讨函数式接口的概念…...

2022职称继续教育--深入实施新时代人才强国战略 加快建设世界重要人才中心和创新高地

单选题(共7题,每题5分) 1、()实行职位职级制工资为主。 D、中长线科研重要岗位人员 2、建设世界重要人才中心和创新高地有()个阶段目标。 B、三 3、综合国力竞争说到底是(…...

投资组合优化中的常见陷阱:如何用LINGO和MATLAB避免风险计算错误

投资组合优化中的常见陷阱:如何用LINGO和MATLAB避免风险计算错误 在金融投资领域,优化投资组合是实现收益最大化和风险最小化的关键手段。然而,许多金融分析师和量化投资爱好者在实际操作中常常陷入各种计算陷阱,导致结果偏离预期…...

COMSOL数据可视化避坑指南:如何用SciPy的griddata处理不规则网格数据?

COMSOL数据可视化避坑指南:如何用SciPy的griddata处理不规则网格数据? 当你从COMSOL导出电场、温度场或其他物理场数据时,是否遇到过这样的困扰:明明在COMSOL中看起来光滑连续的场分布,导出到MATLAB或Python中绘制时却…...

OpenHD图传实战:如何为你的树莓派3B天空端配置720P 60帧,实现低延迟流畅回传

OpenHD图传实战:树莓派3B天空端720P 60帧低延迟优化指南 当你已经完成OpenHD图传系统的基础搭建,却发现默认配置下的画面卡顿、延迟明显时,这篇文章将带你深入系统核心,通过精准调参实现从"勉强能用"到"专业级流畅…...

Phi-3-mini-4k-instruct-gguf入门必看:q4-GGUF量化对中文语义保留的影响实测

Phi-3-mini-4k-instruct-gguf入门必看:q4-GGUF量化对中文语义保留的影响实测 1. 模型简介 Phi-3-mini-4k-instruct-gguf是微软Phi-3系列中的轻量级文本生成模型GGUF版本,特别适合中文场景下的问答、文本改写、摘要生成等任务。这个经过量化的模型版本在…...

全民养虾潮背后:智能体产业的产业化困局

2026年3月,如果你在科技园区看到有人抱着电脑排长队,或者听到“养虾了吗”的问候,不必感到奇怪。这只“虾”正是开源AI智能体——OpenClaw。从社交平台刷屏的“养龙虾”攻略到GitHub星标数突破27万,超越Linux登顶全球开源项目榜首…...

)

从零搭建到百万QPS:Python MCP服务器模板实战对比(含Docker镜像体积、CI/CD兼容性、调试友好度全维度打分)

第一章:从零搭建到百万QPS:Python MCP服务器模板实战对比总览在构建高并发、低延迟的MCP(Model Control Protocol)服务时,Python凭借其生态丰富性与开发效率成为主流选型之一,但原生GIL限制与异步模型差异常…...

Qwen3-14B项目管理助手:需求文档生成、甘特图描述、风险点预判

Qwen3-14B项目管理助手:需求文档生成、甘特图描述、风险点预判 1. 项目管理的AI革命 项目管理是一项复杂的工作,涉及需求分析、进度规划、资源调配和风险控制等多个环节。传统方式下,项目经理需要花费大量时间编写文档、绘制甘特图和评估风…...

告别‘塑料感’渲染:IBGS如何用‘颜色残差’让3D高斯重建的物体更真实?

告别‘塑料感’渲染:IBGS如何用‘颜色残差’让3D高斯重建的物体更真实? 当你在虚拟场景中看到一个金属茶壶时,是否总觉得它像玩具一样缺乏真实感?这就是当前3D高斯溅射(3DGS)技术面临的"塑料感"困…...

Kindle Comic Converter:漫画电子书制作的专业工具

Kindle Comic Converter:漫画电子书制作的专业工具 【免费下载链接】kcc KCC (a.k.a. Kindle Comic Converter) is a comic and manga converter for ebook readers. 项目地址: https://gitcode.com/gh_mirrors/kc/kcc Kindle Comic Converter(简…...

终极指南:用OpenCore Legacy Patcher让旧Mac焕发新生的5个简单步骤

终极指南:用OpenCore Legacy Patcher让旧Mac焕发新生的5个简单步骤 【免费下载链接】OpenCore-Legacy-Patcher Experience macOS just like before 项目地址: https://gitcode.com/GitHub_Trending/op/OpenCore-Legacy-Patcher 你是否还在为手中的旧款Mac无法…...