一文者懂LLaMA 2(原理、模型、训练)

引言

LLaMA(Large Language Model Meta AI)是Meta(前身为Facebook)开发的自然语言处理模型家族之一,LLaMA 2作为其最新版本,展示了在语言理解和生成方面的显著进步。本文将详细解读LLaMA 2的基本原理、模型结构和训练方法,帮助读者深入了解这一先进的语言模型。

一、LLaMA 2的基本原理

1.1 Transformer架构

LLaMA 2基于Transformer架构,这是一种在处理序列数据时非常高效的神经网络模型。Transformer架构由编码器(encoder)和解码器(decoder)组成,分别负责处理输入和生成输出。核心机制包括自注意力(self-attention)和前馈神经网络(feed-forward neural network)。

自注意力机制

自注意力机制允许模型在处理每个输入元素时,同时关注序列中的其他所有元素。这种机制通过计算查询(query)、键(key)和值(value)向量之间的点积,实现对序列中相关信息的加权求和,从而捕捉长距离依赖关系。

多头注意力

Transformer模型采用多头注意力(multi-head attention),即在不同的子空间中并行执行多次注意力计算。每个注意力头关注不同的信息,最终将结果合并,增强模型的表达能力。

1.2 预训练与微调

LLaMA 2采用预训练和微调相结合的策略。预训练阶段,模型在大规模无监督文本数据上进行训练,以学习语言的基础结构和模式。微调阶段,模型在特定任务的数据集上进行有监督学习,以优化其在特定应用上的表现。

预训练目标

LLaMA 2的预训练目标是通过最大化条件概率来预测下一个词。模型通过不断调整参数,使其能够生成自然语言文本。这一过程使模型学习到广泛的语言知识和模式。

微调过程

在微调阶段,LLaMA 2在相对较小但更具针对性的任务数据集上进行训练。例如,对于问答任务,模型会在大量的问答对数据上进行微调,使其生成更加准确和相关的回答。

二、LLaMA 2的模型结构

2.1 模型参数

LLaMA 2相比前代模型具有更多的参数,这使得其在语言生成和理解方面表现更加出色。参数的增加使模型能够学习和记忆更多的语言模式和知识。

参数规模

LLaMA 2有多个版本,参数规模从数亿到数百亿不等。不同版本适用于不同的应用场景,小规模模型适合资源受限的环境,大规模模型则在高性能计算平台上表现更佳。

2.2 编码器和解码器

LLaMA 2的核心组件是编码器和解码器,它们共同负责处理输入和生成输出。

编码器

编码器负责将输入序列转换为隐藏表示。每个编码器层包含多头自注意力机制和前馈神经网络。通过多层堆叠,编码器能够逐步提取输入序列的高层次特征。

解码器

解码器根据编码器的输出和先前生成的词,逐步生成输出序列。解码器也包含多头自注意力机制和前馈神经网络。此外,解码器还包含一个额外的注意力机制,用于关注编码器的输出。

2.3 残差连接和层归一化

Transformer模型中的残差连接和层归一化(Layer Normalization)是两个关键的技术细节。残差连接允许梯度在深层网络中更好地传播,避免梯度消失问题。层归一化则有助于加速训练收敛,并提高模型的稳定性。

三、LLaMA 2的训练方法

3.1 数据准备

数据是训练LLaMA 2的基础。训练数据通常包含海量的文本语料,涵盖广泛的主题和领域。数据质量和多样性直接影响模型的性能。

数据收集

训练数据主要来源于互联网,包括新闻文章、博客、社交媒体帖子、维基百科等。为了确保数据的多样性,收集过程会尽量覆盖不同的语言和话题。

数据清洗

数据收集后需要进行清洗和预处理。清洗过程包括去除噪音、过滤低质量文本和处理重复内容。预处理步骤包括分词、去停用词和构建词典等。

3.2 预训练过程

预训练是LLaMA 2学习语言基础结构的关键阶段。通过在大规模无监督文本数据上训练,模型能够捕捉广泛的语言模式和知识。

训练策略

预训练采用自监督学习策略,目标是通过最大化条件概率来预测下一个词。模型在训练过程中不断调整参数,使其生成的文本更加自然和连贯。

计算资源

预训练需要大量计算资源,通常在高性能计算平台上进行。分布式训练和并行计算技术是提升训练效率的关键。模型的参数规模越大,训练所需的计算资源也越多。

3.3 微调过程

微调是优化LLaMA 2在特定任务上表现的重要阶段。通过在有监督的数据集上进行训练,模型能够更好地适应具体应用场景。

任务定义

微调阶段的任务定义取决于具体应用。例如,在问答任务中,输入是问题,输出是答案;在文本生成任务中,输入是提示词,输出是生成的文本。

数据集选择

选择合适的数据集进行微调是确保模型性能的关键。数据集应尽量覆盖目标任务的多样性和复杂性。常用的数据集包括SQuAD(问答)、GLUE(文本分类)和OpenAI的GPT-3 benchmark(文本生成)等。

超参数调整

微调过程中,超参数的选择和调整对模型性能有重要影响。常见的超参数包括学习率、批量大小、优化器等。通过实验和验证,选择最优的超参数配置,以获得最佳的微调效果。

四、LLaMA 2的应用场景

4.1 对话系统

LLaMA 2在对话系统中表现出色。通过预训练和微调,模型能够生成连贯、自然的对话回复,应用于客服、虚拟助手等场景。

4.2 内容生成

LLaMA 2可以用于自动生成高质量的文本内容,包括新闻报道、博客文章、产品描述等。通过提供合适的提示词和主题,模型能够快速生成连贯的文本。

4.3 翻译与语言学习

LLaMA 2支持多语言处理,能够在翻译和语言学习中发挥重要作用。模型能够提供高质量的翻译服务,并用于语言学习的辅助工具,如生成练习题和测试题。

4.4 数据分析与信息提取

LLaMA 2在数据分析和信息提取方面也具有广泛应用。通过自然语言处理技术,模型能够从海量文本中提取关键信息,辅助数据分析和决策。

五、LLaMA 2的优势与挑战

5.1 优势

- 高质量文本生成:LLaMA 2能够生成连贯、自然的文本,适用于多种应用场景。

- 强大的上下文理解:通过Transformer架构和自注意力机制,LLaMA 2能够理解复杂的上下文关系。

- 多语言支持:LLaMA 2支持多种语言的处理和生成,适应全球用户的需求。

- 灵活的应用场景:LLaMA 2可以应用于对话系统、内容生成、翻译、数据分析等多个领域,具有广泛的实用性。

5.2 挑战

- 计算资源需求高:大规模模型的训练和推理需要大量计算资源,带来高昂的成本。

- 数据偏见与伦理问题:模型训练依赖于大量文本数据,可能包含偏见和错误信息,导致生成的文本存在潜在问题。

- 安全与隐私:在处理用户数据时,需要确保数据的安全性和隐私保护,防止数据泄露和滥用。

结论

LLaMA 2作为Meta开发的先进语言模型,展示了在语言理解和生成方面的强大能力。通过深入理解其基本原理、模型结构和训练方法,用户可以更好地利用这一工具,实现高效、智能的文本处理。尽管面临计算资源、数据偏见和伦理等方面的挑战,LLaMA 2的应用前景依然广阔。未来的研究和应用需要在提高模型性能的同时,解决这些问题,推动自然语言处理技术发展。

相关文章:

)

一文者懂LLaMA 2(原理、模型、训练)

引言 LLaMA(Large Language Model Meta AI)是Meta(前身为Facebook)开发的自然语言处理模型家族之一,LLaMA 2作为其最新版本,展示了在语言理解和生成方面的显著进步。本文将详细解读LLaMA 2的基本原理、模型…...

MySQL 存储函数及调用

1.mysql 存储函数及调用 在MySQL中,存储函数(Stored Function)是一种在数据库中定义的特殊类型的函数,它可以从一个或多个参数返回一个值。存储函数在数据库层面上封装了复杂的SQL逻辑,使得在应用程序中调用时更加简单…...

设计模式七大原则-单一职责原则SingleResponsibility

七大原则是在设计“设计模式”的时候需要用到的原则,它们的存在是为了保证设计模式达到以下几种目的: 1.代码重用性 2.可读性 3.可拓展性 4.可靠性(增加新的功能后,对原来的功能没有影响) 5.使程序呈现高内聚、低耦合的…...

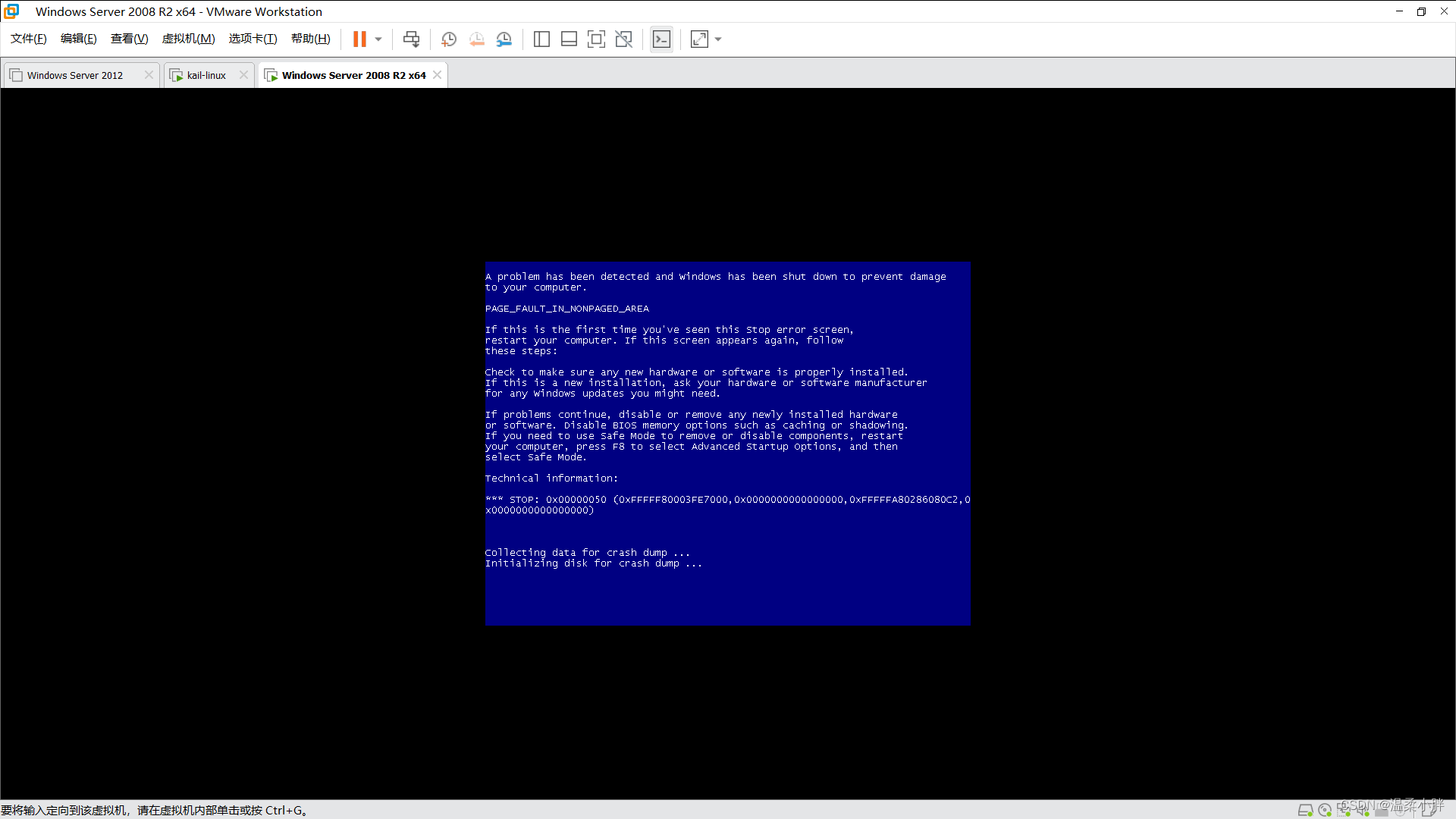

msfconsole利用Windows server2008cve-2019-0708漏洞入侵

一、环境搭建 Windows系列cve-2019-0708漏洞存在于Windows系统的Remote Desktop Services(远程桌面服务)(端口3389)中,未经身份验证的攻击者可以通过发送特殊构造的数据包触发漏洞,可能导致远程无需用户验…...

)

Reinforcement Learning学习(三)

前言 最近在学习Mujoco环境,学习了一些官方的Tutorials以及开源的Demo,对SB3库的强化学习标准库有了一定的了解,尝试搭建了自己的环境,基于UR5E机械臂,进行了一个避障的任务,同时尝试接入了图像大模型API,做了一些有趣的应用,参考资料如下: https://mujoco.readthedo…...

hw meta10 adb back up DCIM

1. centos install adb 2. HW enable devlepment mode & enalbe adb debug 3. add shell root/zt/adb-sync python3 ./adb-sync --reverse /sdcard/DCIM/Camera /root/zt/meta10...

Unity2D游戏制作入门 | 12(之人物受伤和死亡的逻辑动画)

上期链接:Unity2D游戏制作入门 | 11(之人物属性及伤害计算)-CSDN博客 上期我们聊到了人物的自身属性和受伤时的计算,我们先给人物和野猪挂上属性和攻击属性的代码,然后通过触发器触发受伤的事件。物体(人物也好敌人也行ÿ…...

从河流到空气,BL340工控机助力全面环保监测网络构建

在环保监测领域,智能化、高效率的监测手段正逐步成为守护绿水青山的新常态。其中,ARMxy工业计算机BL340凭借其强大的处理能力、高度的灵活性以及广泛的兼容性,在水质监测站、空气质量检测、噪音污染监控等多个环保应用场景中脱颖而出…...

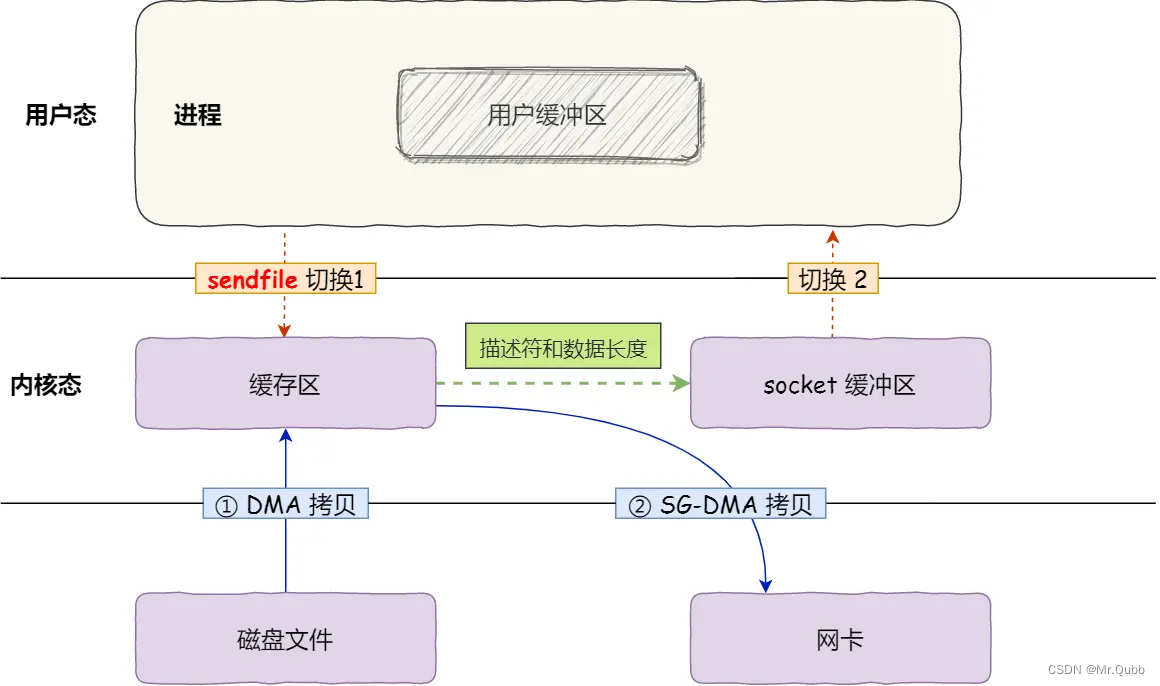

零拷贝技术

背景 磁盘可以说是计算机系统重最慢的硬件之一,读写速度相对内存10以上,所以针对优化磁盘的技术非常的多,比如:零拷贝、直接I/O、异步I/O等等,这些优化的目的就是为了提高系统的吞吐量,另外操作系统内核中的…...

Flutter_Android上架GooglePlay_问题

上架GooglePlay权限问题 问题描述 REQUEST_INSTALL_PACKAGES 权限问题解决方式 方式1 找到所有使用该权限的库修改删除该权限引用 方式2 打开项目 ~/andoird/app/src/main/AndroidMainfest.xml 添加文本<uses-permission android:name"android.permission.REQUES…...

【Java】解决Java报错:NumberFormatException

文章目录 引言1. 错误详解2. 常见的出错场景2.1 字符串包含非数字字符2.2 空字符串或 null 字符串2.3 数值超出范围 3. 解决方案3.1 验证字符串格式3.2 使用异常处理3.3 处理空字符串和 null 4. 预防措施4.1 数据验证4.2 编写防御性代码4.3 单元测试 结语 引言 在Java编程中&a…...

视觉大模型(VLLM)学习笔记

视觉多模态大模型(VLLM) InternVL 1.5 近日,上海人工智能实验室 OpenGVLab 团队、清华大学、商汤科技合作推出了开源多模态大语言模型项目InternVL 1.5,它不仅挑战了商业模型巨头例如 GPT-4V 的霸主地位,还让我们不禁…...

【软考的系统分析师的考题考点解析2025】

2024-2025系统分析师考试(简称软考)是计算机技术与软件专业技术资格(水平)考试中的高级资格考试,主要考察考生在系统分析、系统设计、项目管理等方面的知识和技能。以下是软考系统分析师的常见考点、考题和重点&#x…...

JavaScript前端技术入门教程

引言 在前端开发的广阔天地中,JavaScript无疑是最耀眼的一颗明星。它赋予了网页动态交互的能力,让网页从静态的文本和图片展示,进化为可以与用户进行实时交互的丰富应用。本文将带您走进JavaScript的世界,为您提供一个入门级的教…...

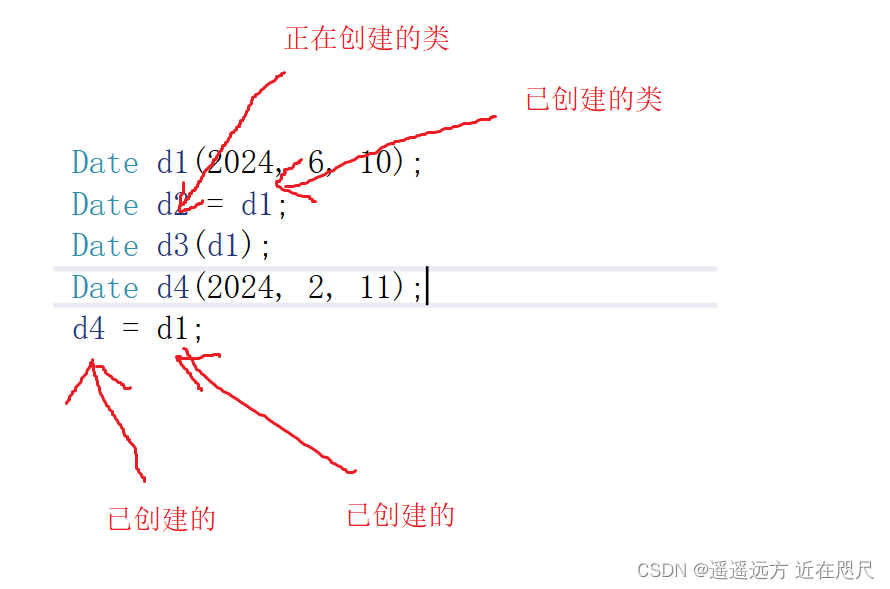

类和对象(上续)

前言:本文介绍类和对象中的一些比较重要的知识点,为以后的继续学习打好基础。 目录 拷贝构造 拷贝构造的特征: 自定义类型的传值传参 自定义类型在函数中的传值返回 如果返回值时自定义的引用呢? 在什么情况下使用呢&#…...

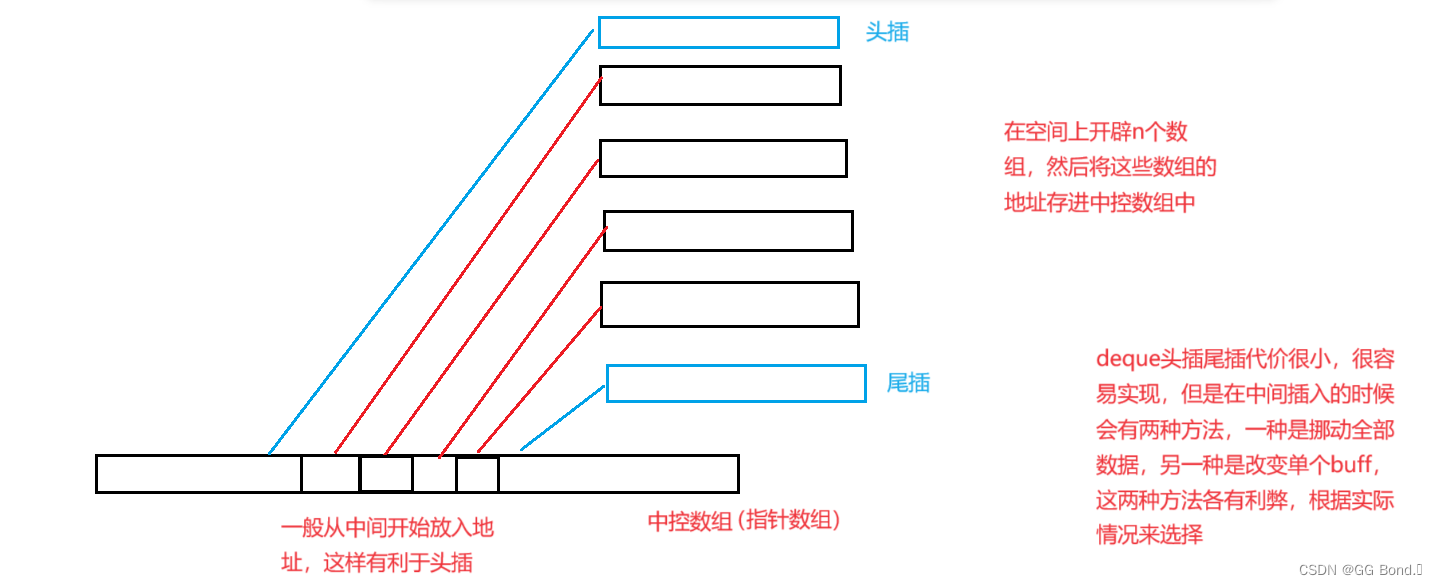

【C++初阶学习】第十三弹——优先级队列及容器适配器

C语言栈:数据结构——栈(C语言版)-CSDN博客 C语言队列:数据结构——队列(C语言版)-CSDN博客 C栈与队列:【C初阶学习】第十二弹——stack和queue的介绍和使用-CSDN博客 前言: 在前面,我们已经…...

Java(十七)---ArrayList的使用

文章目录 前言1.ArrayList的简介2. ArrayList使用2.1.ArrayList的构造2.2.ArrayList的扩容机制(JDK17) 3.ArrayList的常见操作4. ArrayList的具体使用4.1.[杨辉三角](https://leetcode.cn/problems/pascals-triangle/description/)4.2.简单的洗牌游戏 5.ArrayList的问题及思考 …...

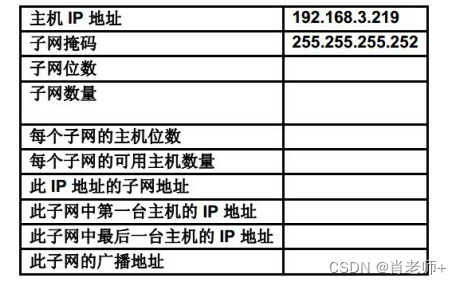

实验六、IPv4 地址的子网划分,第 2 部分《计算机网络》

你有没有发现,困的时候真的清醒不了。 目录 一、实验目的 二、实验内容 三、实验小结 一、实验目的 完成本练习之后,您应该能够确定给定 IP 地址和子网掩码的子网信息。 知道 IP 地址、网络掩码和子网掩码后,您应该能够确定有关该 IP 地…...

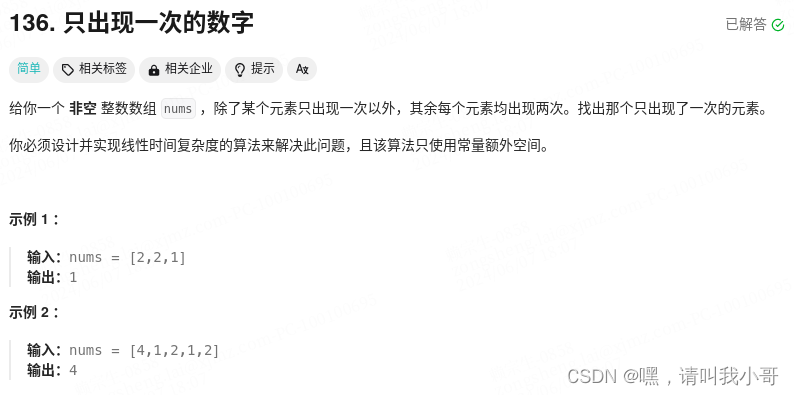

定个小目标之刷LeetCode热题(12)

这是一道简单题,使用位运算中的异或运算即可,异或运算有以下性质: 1、任何数异或 0 结果仍然是原来的数,即 a⊕0a 2、任何数和其自身做异或运算,结果是 0 所以我们只需要让数组里的所有元素进行异或运算得到的结果就…...

MYSQL内存占用查询语句

可以通过以下 SQL 语句查询相关配置参数的当前值: InnoDB 缓冲池大小 (innodb_buffer_pool_size): SHOW VARIABLES LIKE innodb_buffer_pool_size;最大连接数 (max_connections): SHOW VARIABLES LIKE max_connections;临时表大小 (tmp_table…...

AI编程工具全景指南:从CLI到智能体,构建高效开发工作流

1. 项目概述:一份为“氛围编码”时代量身定制的开发者地图如果你是一名开发者,最近几个月一定被“氛围编码”这个词刷屏了。从Cursor、Claude Code到各种AI原生IDE和代理工具,我们仿佛一夜之间进入了一个新的编程范式。但问题也随之而来&…...

Arm架构DCU寄存器解析与安全调试实践

1. Arm生命周期管理器DCU寄存器深度解析 在Arm架构的嵌入式系统开发中,生命周期管理器(Lifecycle Manager, LCM)扮演着关键角色,而其中的调试控制单元(Debug Control Unit, DCU)寄存器组则是开发人员必须掌…...

Cursor AI编程规则深度解析:从项目规范到团队协同的实战指南

1. 项目概述:从“Cursor Rules”看现代开发者的效率革命如果你是一名开发者,最近可能频繁听到一个词:Cursor。它不仅仅是一个编辑器,更是一个集成了AI能力的开发环境,正在悄然改变我们写代码的方式。而今天要聊的这个项…...

【SITS大会技术社区交流活动深度复盘】:20年一线专家亲述3大未公开的破圈协作模型与落地工具包

更多请点击: https://intelliparadigm.com 第一章:【SITS大会技术社区交流活动深度复盘】:20年一线专家亲述3大未公开的破圈协作模型与落地工具包 模型一:异构角色动态配对机制 传统技术沙龙常陷入“讲师单向输出、听众被动接收…...

2025届毕业生推荐的五大AI辅助写作网站实际效果

Ai论文网站排名(开题报告、文献综述、降aigc率、降重综合对比) TOP1. 千笔AI TOP2. aipasspaper TOP3. 清北论文 TOP4. 豆包 TOP5. kimi TOP6. deepseek 眼下,在学术以及职场文本生成这个范畴里,AI检测率过高这样的问题越发…...

)

企业微信打卡数据拉取实战:Spring Boot + FastJSON 完整配置流程(含AccessToken获取避坑指南)

企业微信打卡数据集成实战:Spring Boot工程化解决方案 最近两年,越来越多的企业开始将考勤管理从传统硬件设备迁移到企业微信这样的数字化平台。但真正把打卡数据用起来,往往需要与企业内部系统深度集成。上周刚帮一家零售企业解决了这个问题…...

Logseq AI助手插件:在知识管理笔记中集成ChatGPT智能写作与编辑

1. 项目概述:在Logseq中引入你的AI副驾驶 如果你和我一样,是个重度依赖Logseq来构建个人知识库的笔记爱好者,同时又对AI辅助写作和思考的潜力充满好奇,那么你肯定不止一次想过:要是能把ChatGPT的能力无缝集成到Logseq…...

Ubuntu 18.04上Qt程序报‘xcb’插件错误?别急着重装,试试这个ldd排查法

Ubuntu 18.04 Qt程序xcb插件错误排查指南:从日志分析到依赖修复 当你满怀期待地在Ubuntu 18.04上启动精心开发的Qt应用程序时,屏幕上突然跳出"Could not load the Qt platform plugin xcb"的错误提示,这种挫败感开发者都深有体会。…...

从SELinux到AppArmor:聊聊Linux内核安全模块LSM的实战选择与避坑指南

从SELinux到AppArmor:Linux内核安全模块实战选择与避坑指南 在当今云计算和容器化技术蓬勃发展的背景下,Linux系统的安全性变得前所未有的重要。作为系统管理员或DevOps工程师,我们常常需要在安全性和易用性之间寻找平衡点。Linux内核安全模块…...

SpliceAI深度解析:用深度学习精准预测基因剪接变异的终极指南

SpliceAI深度解析:用深度学习精准预测基因剪接变异的终极指南 【免费下载链接】SpliceAI A deep learning-based tool to identify splice variants 项目地址: https://gitcode.com/gh_mirrors/sp/SpliceAI 想要知道你的基因变异会不会影响RNA剪接吗…...