【论文阅读 WWW‘23】Zero-shot Clarifying Question Generation for Conversational Search

文章目录

- 前言

- Motivation

- Contributions

- Method

- Facet-constrained Question Generation

- Multiform Question Prompting and Ranking

- Experiments

- Dataset

- Result

- Auto-metric evaluation

- Human evaluation

- Knowledge

前言

- 最近对一些之前的文章进行了重读,因此整理了之前的笔记

- 理解不当之处,请多多指导

- 概括:本文利用facet word,基于

GPT-2进行了 zero-shot 的限制生成,使生成的问题更容易包含facet word。同时利用了prompt,使用8种模板,对每个模板都生成一个结果,然后使用一些排序算法自动挑选出一个最终结果。 - 更多论文可见:ShiyuNee/Awesome-Conversation-Clarifying-Questions-for-Information-Retrieval: Papers about Conversation and Clarifying Questions (github.com)

Motivation

Generate clarifying questions in a zero-shot setting to overcome the cold start problem and data bias.

cold start problem: 缺少数据导致难应用,难应用导致缺少数据

data bias: 获得包括所有可能topic的监督数据不现实,在这些数据上训练也会有 bias

Contributions

- the first to propose a zero-shot clarifying question generation system, which attempts to address the cold-start challenge of asking clarifying questions in conversational search.

- the first to cast clarifying question generation as a constrained language generation task and show the advantage of this configuration.

- We propose an auxiliary evaluation strategy for clarifying question generations, which removes the information-scarce question templates from both generations and references.

Method

Backbone: a checkpoint of GPT-2

- original inference objective is to predict the next token given all previous texts

Directly append the query qqq and facet fff as input and let GPT-2 generate cq will cause two challenges:

- it does not necessarily cover facets in the generation.

- the generated sentences are not necessarily in the tone of clarifying questions

We divide our system into two parts:

- facet-constrained question generation(tackle the first challenge)

- multi-form question prompting and ranking(tackle the second challenge, rank different clarifying questions generated by different templates)

Facet-constrained Question Generation

Our model utilizes the facet words not as input but as constraints. We employ an algorithm called Neurologic Decoding. Neurologic Decoding is based on beam search.

-

in ttt step, assuming the already generated candidates in the beam are 𝐶={𝑐1:𝑘}𝐶 = \{𝑐_{1:𝑘} \}C={c1:k}, kkk is the beam size, ci=x1:(t−1)ic_i=x^i_{1:(t-1)}ci=x1:(t−1)i is the iii th candidate, x1:(t−1)ix^i_{1:(t-1)}x1:(t−1)i are tokens generated from decoding step 1 to (t−1)(t-1)(t−1)

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-98Ld4wAG-1678024307327)

- explain about why this method could better constrain the decoder to generate facet-related questions:

- (2)top−β(2)top- \beta(2)top−β is the main reason for promoting facet words in generations. Because of this filtering, Neurologic Decoding tends to discard generations with fewer facet words regardless of their generation probability

- (3)(3)(3) the group is the key for Neurologic Decoding to explore as many branches as possible. Because this grouping method keeps the most cases $(2^{| 𝑓 |} ) $of facet word inclusions, allowing the decoder to cover the most possibilities of ordering constraints in generation

- because if we choose top K candidates directly, there may be some candidates containing same facets, this results in less situation containing diverse facets. Towards choosing the best candidate in each group and then choose top K candidates, every candidate will contain different facets.

- explain about why this method could better constrain the decoder to generate facet-related questions:

Multiform Question Prompting and Ranking

Use clarifying question templates as the starting text of the generation and let the decoder generate the rest of question body.

- if the qqq is “I am looking for information about South Africa.” Then we give the decoder “I am looking for information about South Africa. [SEP] would you like to know” as input and let it generate the rest.

- we use multiple prompts(templates) to both cover more ways of clarification and avoid making users bored

For each query, we will append these eight prompts to the query and form eight input and generate eight questions.

- use ranking methods to choose the best one as the returned question

Experiments

Zero-shot clarifying question generation with existing baselines

- Q-GPT-0:

- input: query

- QF-GPT-0:

- input: facet + query

- Prompt-based GPT-0: includes a special instructional prompt as input

- input: q “Ask a question that contains words in the list [f]”

- Template-0: a template-guided approach using GPT-2

- input: add the eight question templates during decoding and generate the rest of the question

Existing facet-driven baselines(finetuned):

- Template-facet: append the facet word right after the question template

- QF-GPT: a GPT-2 finetuning version of QF-GPT-0.

- finetunes on a set of tuples in the form as f [SEP] q [BOS] cq [EOS]

- Prompt-based finetuned GPT: a finetuning version of Prompt-based GPT-0

- finetune GPT-2 with the structure: 𝑞 “Ask a question that contains words in the list [𝑓 ].” 𝑐𝑞

Note: simple facets-input finetuning is highly inefficient in informing the decoder to generate facet-related questions by observing a facet coverage rate of only 20%

Dataset

ClariQ-FKw: has rows of (q,f,cq) tuples.

qis an open-domain search query,fis a search facet,cqis a human-generated clarifying question- The facet in

ClariQis in the form of a faceted search query.ClariQ-FKwextracts the keyword of the faceted query as its facet column and samples a dataset with 1756 training examples and 425 evaluation examples

Our proposed system does not access the training set while the other supervised learning systems can access the training set for finetuning.

Result

Auto-metric evaluation

RQ1: How well can we do in zero-shot clarifying question generation with existing baselines

- all these baselines(the first four rows) struggle to produce any reasonable generations except for Template-0(but it’s question body is not good)

- we find existing zero-shot GPT-2-based approaches cannot solve the clarifying question generation task effectively.

RQ2: the effectiveness of facet information for facet-specific clarifying question generation

- compare our proposed zero-shot facet constrained (ZSFC) methods with a facet-free variation of ZSFC named Subject-constrained which uses subject of the query as constraints.

- our study show that adequate use of facet information can significantly improve clarifying question generation quality

RQ3: whether our proposed zeroshot approach can perform the same or even better than existing facet-driven baselines

- We see that from both tables, our zero-shot facet-driven approaches are always better than the finetuning baselines

Note: Template-facet rewriting is a simple yet strong baseline that both finetuning-based methods are actually worse than it.

Human evaluation

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-5eC8PWul-1678024307328)

Knowledge

Approaches to clarifying query ambiguity can be roughly divided into three categories:

- Query Reformulation: iteratively refine the query

- is more efficient in context-rich situations

- Query Suggestion: offer related queries to the user

- is good for leading search topics, discovering user needs

- Asking Clarifying Questions: proactively engages users to provide additional context.

- could be exclusively helpful to clarify ambiguous queries without context.

相关文章:

【论文阅读 WWW‘23】Zero-shot Clarifying Question Generation for Conversational Search

文章目录前言MotivationContributionsMethodFacet-constrained Question GenerationMultiform Question Prompting and RankingExperimentsDatasetResultAuto-metric evaluationHuman evaluationKnowledge前言 最近对一些之前的文章进行了重读,因此整理了之前的笔记…...

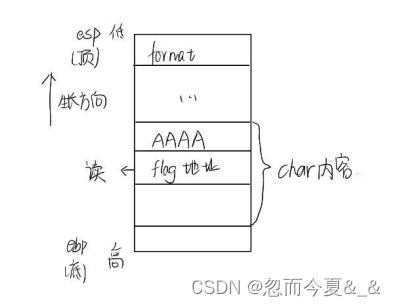

ouc 网络安全实验 格式化字符串漏洞

文章目录要求lab1lab2lab3lab4结语因为当时自己做实验的时候出现了很多疑问不会解决,在网上看到了一位大佬 王森ouc 的专栏文章解决了很多问题,也学到了很多知识和解决问题的方法,现在把我的实验解决方法也发上来,希望有不会的同…...

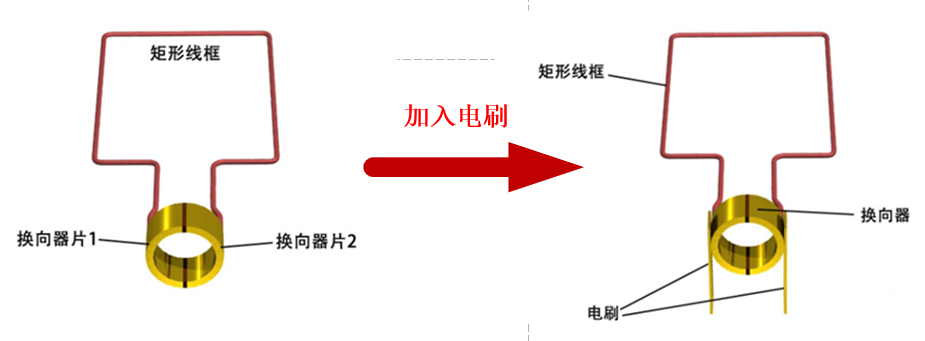

PMSM矢量控制笔记(1.1)——电机的机械结构与运行原理

前言:重新整理以前的知识和文章发现,仍然有许多地方没有学得明白,懵懵懂懂含含糊糊的地方多如牛毛,尤其是到了真正实际写东西或者做项目时,如果不是系统的学习了知识,很容易遇到问题就卡壳,也想…...

网络安全竞赛试题——中间人攻击渗透测试解析(详细))

2022年全国职业院校技能大赛(中职组)网络安全竞赛试题——中间人攻击渗透测试解析(详细)

B-4任务四:中间人攻击渗透测试 *任务说明:仅能获取Server4的IP地址 *任务说明:仅能获取Server11的IP地址 1.通过上题渗透后得到控制权限的服务器场景Server4进行查看本地的arp缓存表的操作,并将该操作所使用的命令作为Flag值提交; 2.通过上题渗透后得到控制权限的服务…...

MySQL必知必会 | 安全、维护、性能

全球化和本地化 关于MySQL处理不同字符集和语言 字符集和校对顺序 数据库被用来存储和检索数据,不同的语言和字符集需要以不同的方式存储和检索,因此,MySQL需要适应不同的字符集,适应不同的排序方式 一些术语: 字符…...

MaaS Model as a Service 模型即服务

大模型是人工智能的发展趋势和未来。大模型是“大算力强算法” 结合的产物。目前,大模型生态已初具规模。大模型能够实现 AI 从“手工作坊”到“工厂模式”的转变,大模型通常是在大规模无标注 数据上进行训练,学习出一种特征和规则…...

)

【编程基础】027.C语言中函数在解题中的应用(三)

文章目录C语言中函数的应用1、自定义函数实现二维数组的转置2、自定义函数之整数处理3、自定义函数之数字后移4、自定义函数之字符串拷贝C语言中函数的应用 1、自定义函数实现二维数组的转置 题目描述 写一个函数,使给定的一个二维数组(3&a…...

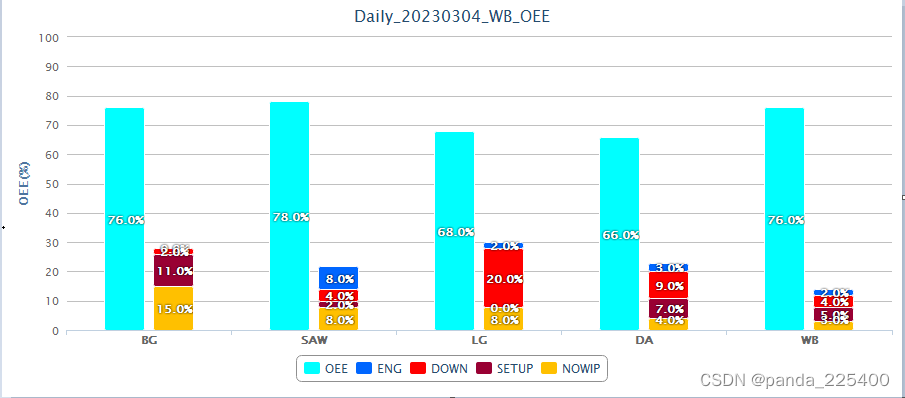

echart图表之highcharts

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档 文章目录前言一、HighCharts是什么?二、使用步骤1.引入库2.前端代码3.展现结果4.后台自动截图总结前言 提示:这里可以添加本文要记录的大概内容&…...

关于.Net和Java的看法——我见过最牛的一个小实习生经历

1、背景 笔者(小方同学在学习)是一个专科院校的一名普通学生,目前就职于某三线城市的WEB方面.Net开发实习生,在找实习期间和就业期间的一些看法,发表此文,纯个人想法,欢迎讨论,指正…...

基于springboot+vue的“智慧食堂”程序设计实现【毕业论文,源码】

系统登录界面系统架构开发语言:Java框架:springbootJDK版本:JDK1.8服务器:tomcat7数据库:mysql 5.7数据库工具:Navicat开发软件:eclipse/myeclipse/ideaMaven包:Maven浏览器…...

学计算机选择什么编程语言好一些?

工资水平的话,目前人工智能、大数据和云计算等领域的工资相对较高,但是要求也高,学历,学习能力什么的。然后是后端开发,Python、Java、C等编程语言的工资普遍较高。 不用开发语言的优势 Java:Java是一种…...

持续集成 在 Linux 上搭建 Jenkins,自动构建接口测试

本篇把从 0 开始搭建 Jenkins 的过程分享给大家,希望对小伙伴们有所帮助。 文章目录 在 Linux 上安装 Jenkins在 Linux 上安装 Git在 Linux 上安装 Python在 Linux 上安装 Allure配置 Jenkinsjenkins 赋能 - 使用邮箱发送测试报告jenkins 赋能 - 优化测试报告内容…...

)

MySQL学习笔记(总结)

1. 数据库服务器操作命令 启动数据库:net start mysql80 (注释:windows命令) 停止数据库:net stop mysql80 (注释:windows命令) 重启数据库:systemctl restart mysql;…...

Android开发 Layout布局 ScrollView

1.LinearLayout 属性 orientation:内部组件排列方式,可选vertical、horizontal,默认horizontal layout_weight: 与平级组件长宽比例,需要将layout_width、layout_height其中一个设置为0dp,表明长或宽与平级组件的长…...

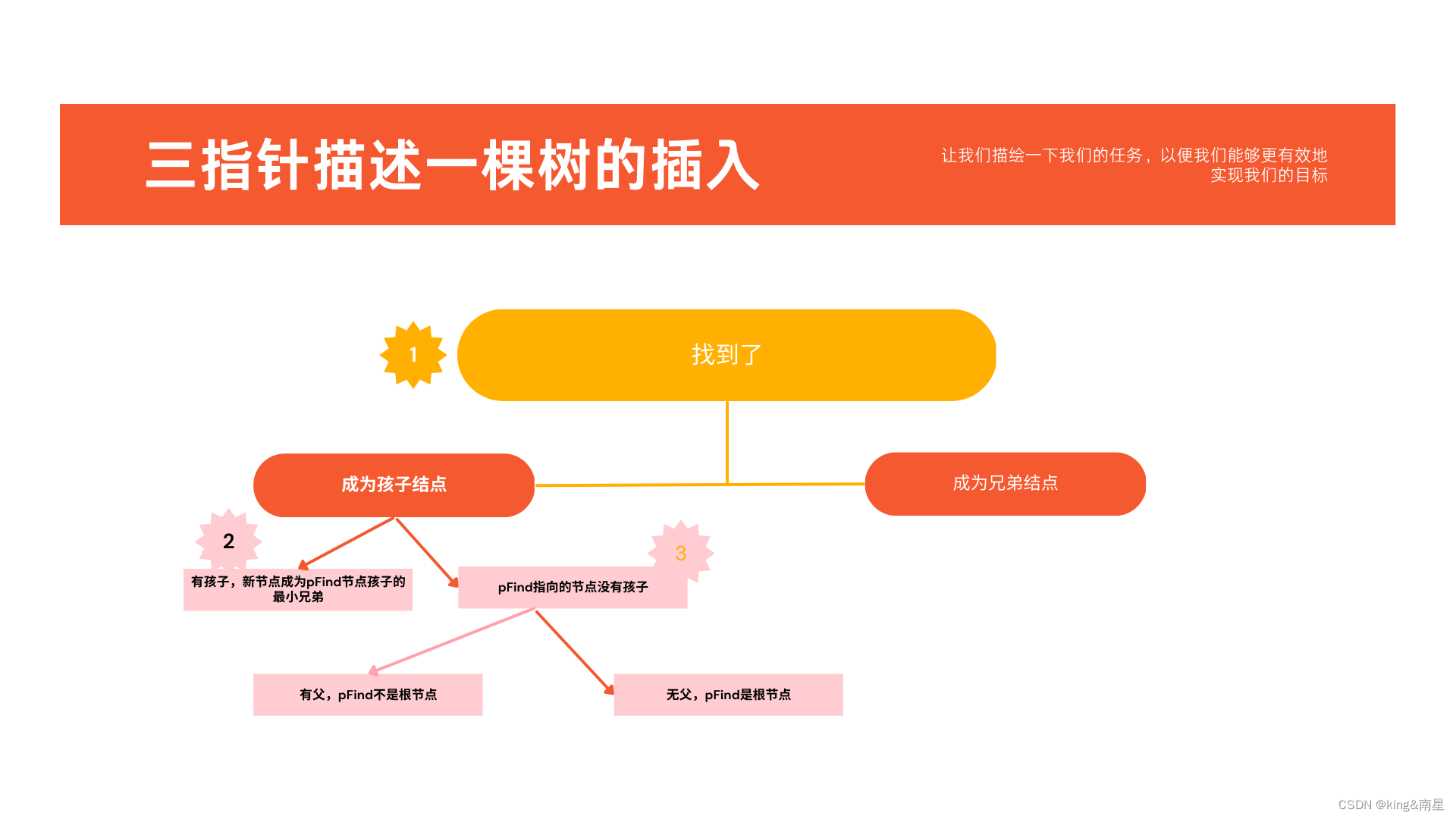

手撕数据结构与算法——树(三指针描述一棵树)

🏆作者主页:king&南星 🎄专栏链接:数据结构 🏅文章目录🌱树一、🌲概念与定义二、🌳定义与预备三、🌴创建结点函数四、🍀查找五、🍁插入六、&a…...

字节跳动Java后端开发实习面经

最近在和同学一起找实习,投了b站、字节和miHoYo的后端开发。b站二月底就投了,但现在也还没回复;miHoYo也还没回复,估计是只面向24届了;感谢字节,给了我面试的机会。字节真的处理好快,不到一周官…...

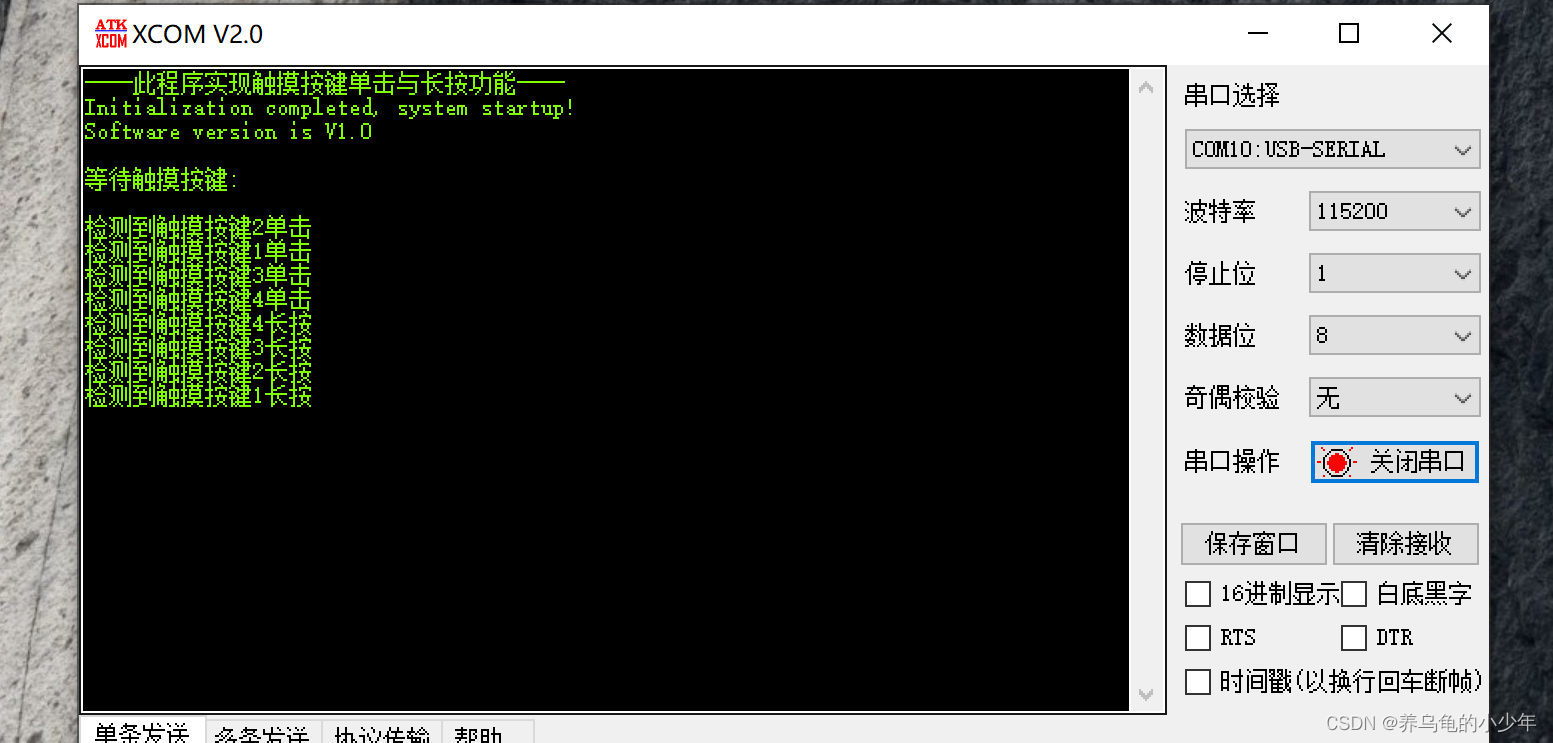

STM32实战项目-触摸按键

前言: 通过触摸按键控制LED灯以及继电器,具体实现功能如下: 1、触摸按键1单击与长按,控制LED1; 2、触摸按键2单击与长按,控制LED2; 3、触摸按键3单击与长按,控制LED3; 4、触摸按键4单击与长…...

)

安全行业-术语(万字)

肉鸡 所谓“肉鸡”说一种很形象的比喻,比喻那些可以任意被我们控制的电脑,对方可以是Windows系统,也可以说UNIX/linux系统,可以说普通的个人电脑,也可以是大型的服务器,我们可以像操作自己的电脑那样来操控…...

)

P1113 杂务(拓扑排序 or 记忆回溯)

题目描述 John的农场在给奶牛挤奶前有很多杂务要完成,每一项杂务都需要一定的时间来完成它。比如:他们要将奶牛集合起来,将他们赶进牛棚,为奶牛清洗乳房以及一些其它工作。尽早将所有杂务完成是必要的,因为这样才有更…...

Web3中文|政策影响下的新加坡Web3步伐喜忧参半

如果说“亚洲四小龙”是新加坡曾经的荣耀,那么当时代进入21世纪的第二个十年,用新加坡经济协会(SEE)副主席、新加坡新跃社科大学教授李国权的话来说,新加坡现在的“荣耀”是全球金融的主要“节点”或区块链行业发展的关…...

OpenClaw工作空间管理工具:自动化文件治理与优化实践

1. 项目概述:一个专为OpenClaw设计的本地化工作空间管理工具如果你和我一样,深度使用过OpenClaw这套开源AI智能体框架,那你一定对那几个核心的Markdown配置文件又爱又恨。AGENTS.md里定义着你的数字员工,SOUL.md是它们的“灵魂”与…...

AI 基本面量化:从理论到可部署 MVP-1.学习目标与工具链

AI 基本面量化实战:从理论到可部署 MVP 的完整学习路径1. 核心目标与 MVP 定义1.1 学习目标定位1.1.1 掌握 AI 技术与基本面分析深度融合的方法论体系AI 基本面量化的本质并非用复杂模型替代经典金融理论,而是以经济学逻辑为锚、以数据驱动为翼ÿ…...

如何用nmrpflash拯救你的Netgear路由器:终极免费救援指南

如何用nmrpflash拯救你的Netgear路由器:终极免费救援指南 【免费下载链接】nmrpflash Netgear Unbrick Utility 项目地址: https://gitcode.com/gh_mirrors/nmr/nmrpflash 你的Netgear路由器突然变成"砖头"了吗?固件升级失败、系统崩溃…...

)

打车VS地铁VS共享单车?成本/时间/可靠性三维测评(实测17次,误差±12秒)

更多请点击: https://intelliparadigm.com 第一章:奇点智能技术大会公共交通路线 前往奇点智能技术大会主会场(上海张江科学会堂)的公共交通方案已全面优化,支持实时路径规划与多模态换乘。推荐使用「MetroBus步行」组…...

Windows Cleaner:专业级Windows系统优化终极指南

Windows Cleaner:专业级Windows系统优化终极指南 【免费下载链接】WindowsCleaner Windows Cleaner——专治C盘爆红及各种不服! 项目地址: https://gitcode.com/gh_mirrors/wi/WindowsCleaner Windows Cleaner是一款专为Windows系统设计的开源系统…...

WPS-Zotero插件终极指南:5步实现科研写作效率翻倍的完整教程

WPS-Zotero插件终极指南:5步实现科研写作效率翻倍的完整教程 【免费下载链接】WPS-Zotero An add-on for WPS Writer to integrate with Zotero. 项目地址: https://gitcode.com/gh_mirrors/wp/WPS-Zotero 还在为学术论文的文献管理而烦恼吗?每次…...

TikTok评论采集终极指南:5分钟学会免费批量提取用户评论

TikTok评论采集终极指南:5分钟学会免费批量提取用户评论 【免费下载链接】TikTokCommentScraper 项目地址: https://gitcode.com/gh_mirrors/ti/TikTokCommentScraper 想要快速获取TikTok视频下的所有用户评论进行数据分析?TikTokCommentScraper…...

PyWxDump微信数据解析工具:3步快速备份聊天记录的完整指南

PyWxDump微信数据解析工具:3步快速备份聊天记录的完整指南 【免费下载链接】PyWxDump 删库 项目地址: https://gitcode.com/GitHub_Trending/py/PyWxDump 想要安全备份微信聊天记录却不知从何下手?PyWxDump微信数据解析工具为你提供了简单高效的解…...

高效解决抖音内容批量下载的技术方案实战指南

高效解决抖音内容批量下载的技术方案实战指南 【免费下载链接】douyin-downloader A practical Douyin downloader for both single-item and profile batch downloads, with progress display, retries, SQLite deduplication, and browser fallback support. 抖音批量下载工具…...

2026 Agent 记忆系统横评——10 种方案、LoCoMo benchmark、谁才是真王者?

2026 年 5 月,mem0.ai 发布了一份《State of AI Agent Memory 2026》报告,用 LoCoMo 这个公认最难的长对话 benchmark,把市面上 10 种 Agent 记忆方案做了一次系统横评。读完之后我做了一件事——把"AI Agent 应该用哪种记忆"这个问…...