GlusterFS 分布式文件系统

一、GlusterFS 概述

1.1 什么是GlusterFS

GlusterFS 是一个开源的分布式文件系统,它可以将多个存储服务器结合在一起,创建一个大的存储池,供客户端使用。它不需要单独的元数据服务器,这样可以提高系统的性能和可靠性。由于没有单点故障,系统更加稳定。

1.2 GlusterFS 主要特点

- 高扩展性和高性能:通过增加存储节点,容量和性能都可以轻松扩展。系统可以处理大量并发操作,支持高速网络如 10GbE 和 InfiniBand。

- 高可用性:GlusterFS 可以自动复制文件,确保数据在硬件故障时依然可用。系统有自我修复功能,后台自动修复数据问题。

- 全局统一命名空间:系统将所有存储节点的容量整合在一起,通过一个虚拟存储池对外提供服务。

- 弹性卷管理:系统可以在线增加或减少存储容量,不会中断业务。根据需要调整性能,支持负载均衡。

- 标准协议兼容:支持多种协议如 NFS、CIFS、HTTP、FTP、SMB 等,完全兼容 POSIX 标准,应用程序无需修改即可使用。

1.3 GlusterFS 工作流程

- 客户端读取或写入数据:应用程序或用户通过 GlusterFS 的挂载点访问文件,像操作本地文件一样简单。

- 系统接收请求:操作系统接收到这个文件操作请求,并开始处理。

- FUSE 做中介:操作系统通过 FUSE 这个“中间人”把数据传给 GlusterFS 客户端。FUSE 相当于帮系统和 GlusterFS 之间搭了一座桥。

- GlusterFS 客户端处理数据:客户端根据设置好的规则处理文件,比如决定如何把文件分成多个部分存储,或者如何备份数据。

- 数据发送到服务器:处理完的数据通过网络传输到 GlusterFS 服务器,并保存到远程存储设备上。

1.4 Gluster 七种卷类型

分布式卷(Distribute Volume)

- 特点:文件通过 HASH 算法分布到所有 Brick Server 上,扩展磁盘空间但不具备容错性(类似 RAID0)。

- 应用:适合磁盘空间扩展,不适合需要数据冗余的场景。

- 示例:

gluster volume create dis-volume server1:/dir1 server2:/dir2 server3:/dir3

条带卷(Stripe Volume)

- 特点:文件被分块轮询存储在多个服务器上,适合大文件处理,但不具备冗余性(类似 RAID0)。

- 应用:适合大文件存储,但不适合需要数据冗余的场景。

- 示例:

gluster volume create stripe-volume stripe 2 transport tcp server1:/dir1 server2:/dir2

复制卷(Replica Volume)

- 特点:文件同时存在于多个服务器上,具备冗余性(类似 RAID1),读性能提升,但写性能较低。

- 应用:适合需要数据冗余和高可用性的场景。

- 示例:

gluster volume create rep-volume replica 2 transport tcp server1:/dir1 server2:/dir2

分布式条带卷(Distribute Stripe Volume)

- 特点:结合分布式卷和条带卷,适合大文件处理,要求 Brick Server 数量是条带数的倍数。

- 应用:适合大文件处理的同时需要分布式存储。

- 示例:

gluster volume create dis-stripe stripe 2 transport tcp server1:/dir1 server2:/dir2 server3:/dir3 server4:/dir4

分布式复制卷(Distribute Replica Volume)

- 特点:结合分布式卷和复制卷,具备冗余性,要求 Brick Server 数量是副本数的倍数。

- 应用:适合需要数据冗余和扩展性的场景。

- 示例:

gluster volume create dis-rep replica 2 transport tcp server1:/dir1 server2:/dir2 server3:/dir3 server4:/dir4

条带复制卷(Stripe Replica Volume)

- 特点:结合条带卷和复制卷,文件分块存储并具备冗余性。

- 应用:适合需要大文件处理和冗余的场景。

- 示例:条带与复制卷的结合,命令类似条带卷和复制卷的组合。

分布式条带复制卷(Distribute Stripe Replica Volume)

- 特点:结合分布式卷、条带卷和复制卷,具备冗余性和扩展性。

- 应用:适合大文件处理、扩展性和数据冗余场景。

- 示例:与分布式条带和复制卷结合,命令类似于两者的组合。

1.4.1 弹性hash算法原理

哈希环: 想象一个钟表的圆形表盘,上面标记了从0到最大值的数字(比如

0到2^32-1),形成一个圆环。节点的映射: 每台服务器(节点)根据它的名字或IP地址生成一个哈希值,然后把这个哈希值放在表盘的某个位置上。这些位置就是服务器存放数据的“地址”。

数据的映射: 每个数据也会通过哈希函数生成一个哈希值,然后这个哈希值也映射到表盘上。顺时针方向第一个遇到的服务器负责存储这个数据。

节点增减时的数据迁移:

如果新增了一台服务器,它会从附近的服务器接管一部分数据,只需要搬动一小部分数据。

如果有服务器退出,剩下的服务器会接管它的那部分数据,数据迁移量很小

二、 部署Gluster 群集

Node1节点:node1/192.168.10.13 磁盘:/dev/sdb1 挂载点:/data/sdb1

/dev/sdc1 /data/sdc1

/dev/sdd1 /data/sdd1

/dev/sde1 /data/sde1Node2节点:node2/192.168.10.14 磁盘:/dev/sdb1 挂载点:/data/sdb1

/dev/sdc1 /data/sdc1

/dev/sdd1 /data/sdd1

/dev/sde1 /data/sde1Node3节点:node3/192.168.10.15 磁盘:/dev/sdb1 挂载点:/data/sdb1

/dev/sdc1 /data/sdc1

/dev/sdd1 /data/sdd1

/dev/sde1 /data/sde1Node4节点:node4/192.168.10.16 磁盘:/dev/sdb1 挂载点:/data/sdb1

/dev/sdc1 /data/sdc1

/dev/sdd1 /data/sdd1

/dev/sde1 /data/sde1客户端节点:192.168.10.2

-----------准备环境(所有node节点上操作)------------

①关闭防火墙

systemctl stop firewalld

setenforce 0

②磁盘分区,并挂载

(可编写脚本半自动化创建)

vim /opt/fdisk.sh

#!/bin/bash

NEWDEV=`ls /dev/sd* | grep -o 'sd[b-z]' | uniq`

for VAR in $NEWDEV

doecho -e "n\np\n\n\n\nw\n" | fdisk /dev/$VAR &> /dev/nullmkfs.xfs /dev/${VAR}"1" &> /dev/nullmkdir -p /data/${VAR}"1" &> /dev/nullecho "/dev/${VAR}"1" /data/${VAR}"1" xfs defaults 0 0" >> /etc/fstab

done

mount -a &> /dev/null

chmod +x /opt/fdisk.sh

cd /opt/

./fdisk.sh

③修改主机名,配置/etc/hosts文件

#以Node1节点为例:

hostnamectl set-hostname node1

echo "192.168.10.13 node1" >> /etc/hosts

echo "192.168.10.14 node2" >> /etc/hosts

echo "192.168.10.15 node3" >> /etc/hosts

echo "192.168.10.16 node4" >> /etc/hosts

---------- 安装、启动GlusterFS(所有node节点上操作) -----------

#将gfsrepo 软件上传到/opt目录下

cd /etc/yum.repos.d/

mkdir repo.bak

mv *.repo repo.bakvim glfs.repo

[glfs] name=glfs baseurl=file:///opt/gfsrepo gpgcheck=0 enabled=1yum clean all && yum makecache

yum -y install glusterfs glusterfs-server glusterfs-fuse glusterfs-rdmasystemctl start glusterd.service

systemctl enable glusterd.service

systemctl status glusterd.service(故障原因是版本过高导致)

yum remove glusterfs-api.x86_64 glusterfs-cli.x86_64 glusterfs.x86_64 glusterfs-libs.x86_64 glusterfs-client-xlators.x86_64 glusterfs-fuse.x86_64 -y

---------- 添加节点到存储信任池中(在 node1 节点上操作) -----------

#只要在一台Node节点上添加其它节点即可

gluster peer probe node1

gluster peer probe node2

gluster peer probe node3

gluster peer probe node4

#在每个Node节点上查看群集状态

gluster peer status

#根据规划创建如下卷:

卷名称 卷类型 Brick

dis-volume 分布式卷 node1(/data/sdb1)、node2(/data/sdb1)

stripe-volume 条带卷 node1(/data/sdc1)、node2(/data/sdc1)

rep-volume 复制卷 node3(/data/sdb1)、node4(/data/sdb1)

dis-stripe 分布式条带卷 node1(/data/sdd1)、node2(/data/sdd1)、node3(/data/sdd1)、node4(/data/sdd1)

dis-rep 分布式复制卷 node1(/data/sde1)、node2(/data/sde1)、node3(/data/sde1)、node4(/data/sde1)

2.1 分布式卷

gluster volume create dis-volume node1:/data/sdb1 node2:/data/sdb1 force

gluster volume start dis-volume

gluster volume info dis-volume2.2 条带卷

gluster volume create stripe-volume stripe 2 node1:/data/sdc1 node2:/data/sdc1 force

gluster volume start stripe-volume

gluster volume info stripe-volume2.3 复制卷

gluster volume create rep-volume replica 2 node3:/data/sdb1 node4:/data/sdb1 force

gluster volume start rep-volume

gluster volume info rep-volume2.4 分布式条带卷

gluster volume create dis-stripe stripe 2 node1:/data/sdd1 node2:/data/sdd1 node3:/data/sdd1 node4:/data/sdd1 force

gluster volume start dis-stripe

gluster volume info dis-stripe2.5 分布式复制卷

gluster volume create dis-rep replica 2 node1:/data/sde1 node2:/data/sde1 node3:/data/sde1 node4:/data/sde1 force

gluster volume start dis-rep

gluster volume info dis-rep查看所有卷的列表

gluster volume list-------- 部署 Gluster 客户端 --------

①安装客户端软件

#将gfsrepo 软件上传到/opt目下

cd /etc/yum.repos.d/

mkdir repo.bak

mv *.repo repo.bakvim glfs.repo

[glfs]

name=glfs

baseurl=file:///opt/gfsrepo

gpgcheck=0

enabled=1yum clean all && yum makecache

yum -y install glusterfs glusterfs-fuse

②创建挂载目录

mkdir -p /test/{dis,stripe,rep,dis_stripe,dis_rep}

ls /test

③配置 /etc/hosts 文件

echo "192.168.10.13 node1" >> /etc/hosts

echo "192.168.10.14 node2" >> /etc/hosts

echo "192.168.10.15 node3" >> /etc/hosts

echo "192.168.10.16 node4" >> /etc/hosts

④挂载 Gluster 文件系统

#临时挂载

mount.glusterfs node1:dis-volume /test/dis

mount.glusterfs node1:stripe-volume /test/stripe

mount.glusterfs node1:rep-volume /test/rep

mount.glusterfs node1:dis-stripe /test/dis_stripe

mount.glusterfs node1:dis-rep /test/dis_repdf -Th

#永久挂载

vim /etc/fstab

node1:dis-volume /test/dis glusterfs defaults,_netdev 0 0

node1:stripe-volume /test/stripe glusterfs defaults,_netdev 0 0

node1:rep-volume /test/rep glusterfs defaults,_netdev 0 0

node1:dis-stripe /test/dis_stripe glusterfs defaults,_netdev 0 0

node1:dis-rep /test/dis_rep glusterfs defaults,_netdev 0 0

--------- 测试 Gluster 文件系统 ---------

①卷中写入文件,客户端操作

cd /opt

dd if=/dev/zero of=/opt/demo1.log bs=1M count=40

dd if=/dev/zero of=/opt/demo2.log bs=1M count=40

dd if=/dev/zero of=/opt/demo3.log bs=1M count=40

dd if=/dev/zero of=/opt/demo4.log bs=1M count=40

dd if=/dev/zero of=/opt/demo5.log bs=1M count=40ls -lh /opt

cp /opt/demo* /test/dis

cp /opt/demo* /test/stripe/

cp /opt/demo* /test/rep/

cp /opt/demo* /test/dis_stripe/

cp /opt/demo* /test/dis_rep/

②查看文件分布

分布式文件分布:

#查看分布式文件分布

[root@node1 ~]# ls -lh /data/sdb1 #数据没有被分片

总用量 160M

-rw-r--r-- 2 root root 40M 12月 18 14:50 demo1.log

-rw-r--r-- 2 root root 40M 12月 18 14:50 demo2.log

-rw-r--r-- 2 root root 40M 12月 18 14:50 demo3.log

-rw-r--r-- 2 root root 40M 12月 18 14:50 demo4.log[root@node2 ~]# ll -h /data/sdb1

总用量 40M

-rw-r--r-- 2 root root 40M 12月 18 14:50 demo5.log条带卷文件分布:

#查看条带卷文件分布

[root@node1 ~]# ls -lh /data/sdc1 #数据被分片50% 没副本 没冗余

总用量 101M

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo1.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo2.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo3.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo4.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo5.log[root@node2 ~]# ll -h /data/sdc1 #数据被分片50% 没副本 没冗余

总用量 101M

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo1.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo2.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo3.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo4.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo5.log

复制卷分布:

#查看复制卷分布

[root@node3 ~]# ll -h /data/sdb1 #数据没有被分片 有副本 有冗余

总用量 201M

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo1.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo2.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo3.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo4.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo5.log[root@node4 ~]# ll -h /data/sdb1 #数据没有被分片 有副本 有冗余

总用量 201M

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo1.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo2.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo3.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo4.log

-rw-r--r-- 2 root root 40M 12月 18 14:51 demo5.log分布式条带卷分布:

#查看分布式条带卷分布

[root@node1 ~]# ll -h /data/sdd1 #数据被分片50% 没副本 没冗余

总用量 81M

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo1.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo2.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo3.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo4.log[root@node2 ~]# ll -h /data/sdd1

总用量 81M

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo1.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo2.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo3.log

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo4.log[root@node3 ~]# ll -h /data/sdd1

总用量 21M

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo5.log[root@node4 ~]# ll -h /data/sdd1

总用量 21M

-rw-r--r-- 2 root root 20M 12月 18 14:51 demo5.log

分布式复制卷分布:

#查看分布式复制卷分布 #数据没有被分片 有副本 有冗余

[root@node1 ~]# ll -h /data/sde1

总用量 161M

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo1.log

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo2.log

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo3.log

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo4.log[root@node2 ~]# ll -h /data/sde1

总用量 161M

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo1.log

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo2.log

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo3.log

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo4.log[root@node3 ~]# ll -h /data/sde1

总用量 41M

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo5.log

[root@node3 ~]# [root@node4 ~]# ll -h /data/sde1

总用量 41M

-rw-r--r-- 2 root root 40M 12月 18 14:52 demo5.log

---------- 破坏性测试 -----------

#挂起 node2 节点或者关闭glusterd服务来模拟故障

[root@node2 ~]# systemctl stop glusterd.service#在客户端上查看文件是否正常

分布式卷数据查看:

#分布式卷数据查看

[root@localhost test]# ll /test/dis/ #在客户机上发现少了demo5.log文件,这个是在node2上的

总用量 163840

-rw-r--r-- 1 root root 41943040 12月 18 14:50 demo1.log

-rw-r--r-- 1 root root 41943040 12月 18 14:50 demo2.log

-rw-r--r-- 1 root root 41943040 12月 18 14:50 demo3.log

-rw-r--r-- 1 root root 41943040 12月 18 14:50 demo4.log

条带卷:

#条带卷

[root@localhost test]# cd /test/stripe/ #无法访问,条带卷不具备冗余性

[root@localhost stripe]# ll

总用量 0

分布式条带卷:

#分布式条带卷

[root@localhost test]# ll /test/dis_stripe/ #无法访问,分布条带卷不具备冗余性

总用量 40960

-rw-r--r-- 1 root root 41943040 12月 18 14:51 demo5.log

分布式复制卷:

#分布式复制卷

[root@localhost test]# ll /test/dis_rep/ #可以访问,分布式复制卷具备冗余性

总用量 204800

-rw-r--r-- 1 root root 41943040 12月 18 14:52 demo1.log

-rw-r--r-- 1 root root 41943040 12月 18 14:52 demo2.log

-rw-r--r-- 1 root root 41943040 12月 18 14:52 demo3.log

-rw-r--r-- 1 root root 41943040 12月 18 14:52 demo4.log

-rw-r--r-- 1 root root 41943040 12月 18 14:52 demo5.log凡是带复制数据,相比而言,数据比较安全

-------扩展其他的维护命令-------

1.查看GlusterFS卷

gluster volume list 2.查看所有卷的信息

gluster volume info

3.查看所有卷的状态

gluster volume status

4.停止一个卷

gluster volume stop dis-stripe

5.删除一个卷,注意:删除卷时,需要先停止卷,且信任池中不能有主机处于宕机状态,否则删除不成功

gluster volume delete dis-stripe

6.设置卷的访问控制

#仅拒绝

gluster volume set dis-rep auth.deny 192.168.80.100#仅允许

gluster volume set dis-rep auth.allow 192.168.80.* #设置192.168.80.0网段的所有IP地址都能访问dis-rep卷(分布式复制卷)相关文章:

GlusterFS 分布式文件系统

一、GlusterFS 概述 1.1 什么是GlusterFS GlusterFS 是一个开源的分布式文件系统,它可以将多个存储服务器结合在一起,创建一个大的存储池,供客户端使用。它不需要单独的元数据服务器,这样可以提高系统的性能和可靠性。由于没有…...

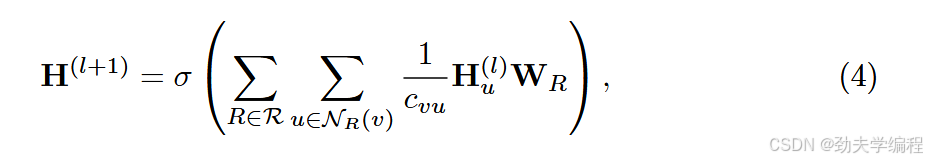

论文学习笔记6:Relation-Aware Heterogeneous Graph Neural Network for Fraud Detection

文章目录 Abstract一、Introduction二、Preliminaries2.1Problem Definition2.2Related Works 三、Proposed Method3.1Model Architecture3.2Computation Graph Pre-process3.3Heterogeneous Propagation Abstract 欺诈检测是金融和社交媒体领域的一项重要数据挖掘任务。传统的…...

无人机光电吊舱的技术!!

1. 成像技术 可见光成像:通过高分辨率相机捕捉地面或空中目标的清晰图像,提供直观的视觉信息。 红外热成像:利用红外辐射探测目标的温度分布,实现夜间或恶劣天气条件下的隐蔽目标发现。 多光谱成像:通过不同波段的光…...

C++——判断year是不是闰年。

没注释的源代码 #include <iostream> using namespace std; void Y(int y); int main() { int year; cout<<"请输入一个年份:"; cin>>year; Y(year); return 0; } void Y(int y) { if(((y%40)&&(y%100!0))||(y%…...

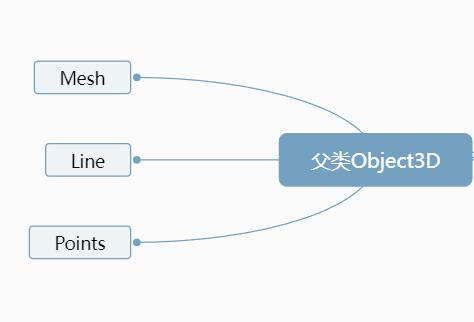

31. 三维向量Vector3与模型位置

点模型Points、线模型Line、网格网格模型Mesh等模型对象的父类都是Object3D (opens new window),如果想对这些模型进行旋转、缩放、平移等操作,如何实现,可以查询Threejs文档Object3D (opens new window)对相关属性和方法的介绍。 三维向量Ve…...

C# Action和delegate区别及示例代码

Action和delegate类似但没有返回值 Action和delegate在C#编程语言中有明显的区别,主要体现在它们的定义、用途和特性上。 1. 定义 Delegate:Delegate是C#中用于定义方法签名的类型,它允许将方法作为参数传递,或者将方法赋值给变…...

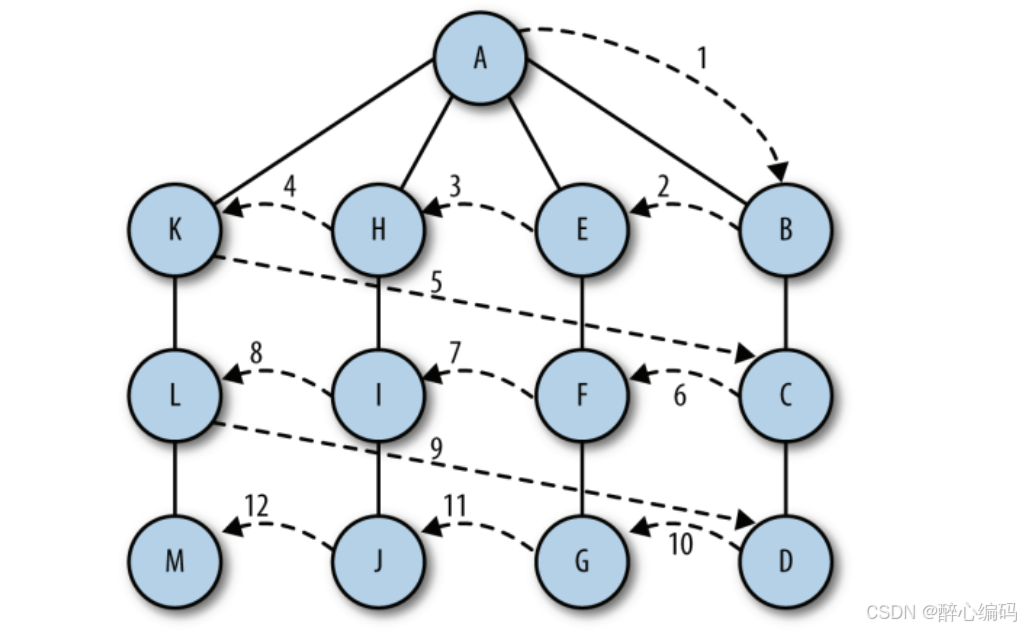

深度优先搜索: 探索图结构的括号化旅程

深度优先搜索: 探索图结构的括号化旅程 图的括号化结构示例图深度优先搜索的伪代码C语言实现解释运行结果总结在解决图相关问题时,深度优先搜索(DFS)是一种非常有用的算法。DFS 通过递归或使用栈的方式遍历图的节点,尽可能深地搜索每一个分支,然后回溯以搜索其他未访问的节…...

LINUX网络编程:传输层

目录 1.端口号 1.1知名端口号 1.2注意 2.UDP协议 2.1UDP报头的格式 2.2UDP的特点 2.3UDP的缓冲区 1.端口号 端口号的作用标识一个网络中主机的一个进程。 网络之间通信无非就是,发送端和接受端进程之间的通信,所以通过ip地址找到目标主机之后&am…...

PyTorch框架

PyTorch是一个开源的深度学习框架,由Facebook AI Research(FAIR)团队开发,自2017年发布以来,凭借其出色的灵活性、易用性和强大的功能,在深度学习和机器学习领域得到了广泛的应用和认可。以下是对PyTorch框…...

分布式系统实战经验

分布式系统是现代软件架构的核心部分,它通过多个计算节点协同工作来处理大规模数据和请求,提供高可用性、可扩展性和容错能力。在实际开发和运维中,构建分布式系统需要考虑多方面的挑战。以下是一些在分布式系统中的实战经验: 1.…...

软考(中级-软件设计师)(0919)

软考 一、软件设计师-历年考试考点分布情况-上午-计算机与软件工程知识 知识点分数说明比例软件工程基础知识11开发模型、设计原则、测试方法、质量特性、CMM、Pert图、风险管理14.67%面向对象12面向对象基本概念、面向对象分析与设计、UML、常见算法16.00%数据结构与算法10…...

WhaleStudio 与飞腾 S5000C 处理器完成产品兼容测试!

中秋佳节后喜讯传来!经过飞腾信息技术有限公司和北京白鲸开源科技有限公司的联合严格测试,白鲸开源 WhaleStudio 套件 V2.6 版本已在飞腾信息技术有限公司的腾云 S5000C 处理器平台上成功安装并稳定运行。 这标志着白鲸开源商业与飞腾的合作进入了一个新…...

【Arduino】Arduino使用USB-TTL无法下载程序问题

问题描述 自己绘制了一套基于Arduino MEGA的电路,没有在板子上面绘制CH340的标准下载电路,只保留了UART0的插针用于调试和下载程序。 使用ISP烧录完bootloader后,发现无法使用USB-TTL工具烧录程序 问题解决过程 在网上搜索了相关资料&…...

使用源代码编译R包的过程

R包的安装方式可以归纳为 源代码安装 和 二进制文件安装 两类: 源代码安装 是指从包的源代码进行编译安装。包括:① 通过CRAN安装源代码版本的包(如果没有二进制版本,或者指定了安装源代码)。② 从GitHub、Bioconducto…...

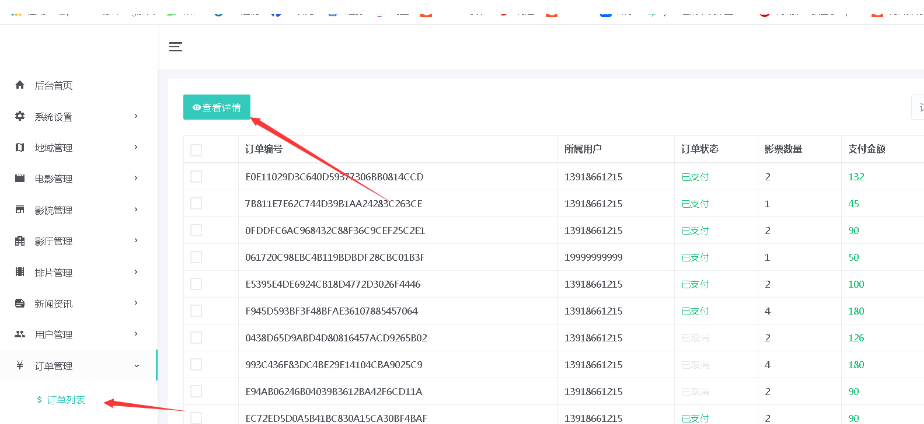

基于JavaWeb开发的java springboot+mybatis电影售票网站管理系统前台+后台设计和实现

基于JavaWeb开发的java springbootmybatis电影售票网站管理系统前台后台设计和实现 🍅 作者主页 网顺技术团队 🍅 欢迎点赞 👍 收藏 ⭐留言 📝 🍅 文末获取源码联系方式 📝 🍅 查看下方微信号获…...

【论文阅读】Face2Diffusion for Fast and Editable Face Personalization

code:mapooon/Face2Diffusion: [CVPR 2024] Face2Diffusion for Fast and Editable Face Personalization https://arxiv.org/abs/2403.05094 (github.com) 论文 介绍 目标:向 T2I 模型不知道的图像中插入特定概念(例如某人的脸ÿ…...

金钥匙系列:Kubernetes (K8s) 服务集群技术栈学习路线

维护Kubernetes (K8s) 服务集群是一个复杂且多层次的技术任务,涉及容器化技术、集群管理、网络、安全、监控等多个领域。为了成为一名优秀的K8s集群维护工程师,技术栈需要广泛且深入。本文将为你详细介绍从零开始到深入掌握K8s集群维护的职业技术栈学习路…...

centos远程桌面连接windows

CentOS是一款广泛使用的Linux发行版,特别是在服务器领域。很多企业和个人用户会选择远程连接到CentOS进行操作和维护。虽然CentOS自带了一些远程桌面解决方案,但它们在使用上存在一些局限性。接下来,我将介绍如何实现CentOS的远程桌面连接&am…...

Android 系统下:普通应用无缝安装,Launcher 应用安装遭遇罕见障碍解析

目录 一、场景 1.1 错误分析 1.2 解决方法尝试 1.2.1 检查应用的安装位置 1.2.2 使用ADB安装 1.2.3 检查APK的签名 1.2.4 检查可用的内部存储空间 1.2.5 将应用程序安装到设备的内部存储空间 1.2.6 重置设备(谨慎使用) 1.2.7 获取Root权限&…...

VMware vCenter Server 8.0U3b 发布下载,新增功能概览

VMware vCenter Server 8.0U3b 发布下载,新增功能概览 Server Management Software | vCenter 请访问原文链接:https://sysin.org/blog/vmware-vcenter-8-u3/,查看最新版。原创作品,转载请保留出处。 作者主页:sysi…...

深圳实体门店有必要做GEO AI代运营吗

深圳实体门店有必要做GEO AI代运营吗一、开篇引言2026年深圳本地实体商业竞争进入白热化阶段,全城数百万家线下实体门店涵盖本地生活、家装工装、汽车服务、餐饮娱乐、教育培训等全品类,传统线下地推、门店自然客流、传统团购平台引流效果持续下滑&#…...

DIY复刻经典:Texar Audio Prism动态处理器克隆套件全攻略

1. 项目概述:Texar Audio Prism 克隆套件如果你在专业音频圈子里混过一段时间,尤其是对上世纪八九十年代那些经典的、带点“魔法”色彩的外置动态处理器感兴趣,那么“Texar Audio Prism”这个名字你大概率不会陌生。它不是最常见的1176或者LA…...

Redis分布式锁进阶第二十篇

一、本篇前置衔接 第二十篇我们完成了全系列终局复盘,整理了故障排查SOP与企业级落地铁律。常规单资源锁、热点分片锁、隔离锁全部讲透,但真实复杂业务永远不是单一资源:下单要扣库存、扣优惠券、扣积分、冻结余额,多资源并行争抢…...

使用TaotokenCLI工具一键配置开发环境中的API密钥

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 使用Taotoken CLI工具一键配置开发环境中的API密钥 在团队协作或个人开发中,为每个项目或成员手动配置大模型API密钥和…...

LVGL多页面开发避坑:用内部Timer替代轮询,解决页面切换时的内存踩踏问题

LVGL多页面开发中的内存安全实践:用Timer机制替代轮询的工程解决方案 在嵌入式UI开发中,LVGL因其轻量级和跨平台特性成为热门选择。但当项目复杂度提升到多页面交互时,开发者往往会遇到一个棘手问题:如何在频繁切换页面的同时保证…...

为什么你的Midjourney雾效总像“水汽”而非“山岚”?——资深CG总监拆解大气散射物理模型在--v 6.1中的3层映射偏差

更多请点击: https://kaifayun.com 第一章:为什么你的Midjourney雾效总像“水汽”而非“山岚”? Midjourney 生成的雾气常呈现为均匀、半透明、边界模糊的“水汽感”——厚重、潮湿、缺乏层次与呼吸感。这并非模型能力不足,而是提…...

终极指南:用AlwaysOnTop免费开源工具彻底改变你的Windows工作方式

终极指南:用AlwaysOnTop免费开源工具彻底改变你的Windows工作方式 【免费下载链接】AlwaysOnTop Make a Windows application always run on top 项目地址: https://gitcode.com/gh_mirrors/al/AlwaysOnTop 你是否经常在多个窗口间来回切换,浪费宝…...

让B站缓存视频重获自由:一个简单实用的格式转换工具

让B站缓存视频重获自由:一个简单实用的格式转换工具 【免费下载链接】m4s-converter 一个跨平台小工具,将bilibili缓存的m4s格式音视频文件合并成mp4 项目地址: https://gitcode.com/gh_mirrors/m4/m4s-converter 还记得那个周末的下午吗…...

Windows 11终极优化指南:Win11Debloat一键清理系统提升51%性能

Windows 11终极优化指南:Win11Debloat一键清理系统提升51%性能 【免费下载链接】Win11Debloat A simple, lightweight PowerShell script that allows you to remove pre-installed apps, disable telemetry, as well as perform various other changes to declutte…...

终极跨平台空洞骑士模组管理器:Lumafly如何让模组管理变得简单高效

终极跨平台空洞骑士模组管理器:Lumafly如何让模组管理变得简单高效 【免费下载链接】Lumafly A cross platform mod manager for Hollow Knight written in Avalonia. 项目地址: https://gitcode.com/gh_mirrors/lu/Lumafly 你是否曾经因为空洞骑士模组安装…...