word2vec--CBOW与Skip-Gram 两种模型

Word2Vec 是一种流行的用于生成词嵌入(Word Embeddings)的无监督学习模型,它由 Google 的一个团队在 2013 年提出。它的主要目的是将单词映射到一个连续的向量空间,使得语义相似的单词在这个空间中靠得更近。

Word2Vec 有两种主要的模型架构:Skip-Gram 和 Continuous Bag of Words (CBOW)。两者使用不同的策略来预测单词的上下文。

一.Skip-Gram:中心词来预测周围词

Skip-Gram模型是 Word2Vec 中的一种重要架构,其主要目的是通过已知的单词(中心词)预测其上下文中的其他单词。Skip-Gram 模型的设计初衷是捕捉单词之间的语义关系和上下文信息,使得相似语义的单词在向量空间中距离更近。

模型原理

Skip-Gram 模型的核心思想是利用一个中心词来预测其周围的上下文词。给定一个单词序列 ( w_1, w_2, , w_T ),中心词 ( w_t ) 的任务是根据其上下文 ( w_(t-j) 到 ( w_(t+j)(这里 ( j ) 是一个窗口大小参数)来预测上下文中的单词。

目标函数

Skip-Gram 模型的目标是最大化给定中心词 ( w_t ) 时预测上下文词 ( w_{t+j} ) 的概率。具体来说,模型的目标函数可以表示为:

∏ t = 1 T ∏ j = − c c P ( w t + j ∣ w t ) \prod_{t=1}^{T} \prod_{j=-c}^{c} P(w_{t+j} | w_t) t=1∏Tj=−c∏cP(wt+j∣wt)

其中:

- ( T ) 是整个文本中的单词数。

- ( c ) 是上下文窗口的大小(即有多少个单词被视为上下文)。

- ( P(w_(t+j) | w_t) ) 是在给定中心词 ( w_t ) 下预测上下文词 ( w_(t+j) ) 的概率。

训练过程

Skip-Gram 模型的训练过程通常涉及以下步骤:

-

数据预处理:

- 将文本转换为单词序列。

- 创建中心词和上下文词的对(例如,若窗口大小为 2,并且中心词为 “machine”,则上下文可能是 “I” 和 “learning”)。

-

初始化参数:

- 为每个单词初始化输入和输出嵌入向量。输入向量用于表示中心词,输出向量用于表示上下文词。

-

训练:

- 对于每对中心词和其上下文词,利用负采样(Negative Sampling)或层次 Softmax(Hierarchical Softmax)来计算概率。

- 更新参数以最大化正确上下文词的概率,最小化错误上下文词的概率。通过反向传播算法计算梯度并更新嵌入向量。

负采样

由于输出层的计算涉及大量的单词,Skip-Gram 模型通常使用负采样来提高计算效率。负采样选择一些“负样本”来训练,通常是随机选择词汇表中的单词,但与中心词不同。例如,假设我们需要预测上下文单词 “learning”,会将其作为正样本,同时随机选择几个不相关的单词作为负样本。

模型架构

Skip-Gram 模型的简单架构包含两层神经网络:

- 输入层:接收一个单词的独热编码表示。

- 隐藏层:没有激活函数,直接将输入词的嵌入向量通过权重矩阵得到隐藏层输出。

- 输出层:经过 Softmax 层,`计算中心词 ( w_t ) 对于每个上下文词 ( w_(t+j)的条件概率。

示例

给定一句话:“I love natural language processing”,若选择"natural"为中心词,窗口大小为 1,模型将训练以下样本对:

- 中心词: “natural”,上下文词: “love”

- 中心词: “natural”,上下文词: “language”

代码示例

以下是使用 Python 的 Gensim 库实现 Skip-Gram 模型的示例:

from gensim.models import Word2Vec# 示例语料

sentences = [['i', 'love', 'natural', 'language', 'processing'],['deep', 'learning', 'is', 'important'],['machine', 'learning', 'is', 'fun'],

]# 训练 Word2Vec 模型(使用 Skip-Gram)

model = Word2Vec(sentences, vector_size=100, window=1, min_count=1, sg=1) # sg=1 表示使用 Skip-Gram# 获取某个词的向量

vector = model.wv['natural']

print("Vector for 'natural':", vector)# 获取与某个词最相似的词

similar_words = model.wv.most_similar('learning', topn=5)

print("Most similar words to 'learning':", similar_words)

优点

- 高效捕捉语义信息:Skip-Gram 模型能够有效捕捉单词的语义和上下文信息,生成能够反映单词关系的向量。

- 灵活性:可以通过调整窗口大小和最小词频等参数对模型表现进行优化。

- 可扩展性:适用于大规模文本数据,能够处理数百万的单词。

二.CBOW根据中心词来预测周围词

CBOW(Continuous Bag of Words)模型是 Word2Vec 中的另一种架构,主要用于通过上下文单词预测中心单词。与 Skip-Gram 模型相反,CBOW 使用多个上下文单词来预测一个单一的目标词。此模型的目标是最大化给定上下文单词时,预测目标词的概率。

模型原理

CBOW 模型的核心思想是将上下文中的多个单词嵌入到一个向量空间,然后通过这些上下文向量预测中心单词。给定上下文 ( w_{t-c}, w_(t-c+1), w_(t+c)(这里 ( c ) 为上下文窗口大小),模型的目标是预测中心词 ( w_t )。

目标函数

CBOW 模型的目标函数可以表示为最大化在给定上下文的情况下预测目标词的概率:

P ( w t ∣ w t − c , w t − c + 1 , … , w t + c ) P(w_t | w_{t-c}, w_{t-c+1}, \ldots, w_{t+c}) P(wt∣wt−c,wt−c+1,…,wt+c)

训练过程

CBOW 模型的训练过程包括以下几个步骤:

-

数据预处理:

- 将文本数据转换为单词序列。

- 根据窗口大小获取上下文词与对应目标词的对。例如,如果选择窗口大小为 2,且目标词是 “language”,上下文将是 [“I”, “love”, “natural”, “processing”]。

-

初始化参数:

- 为每个单词初始化相应的输入和输出嵌入向量,输入向量用于表示上下文词,输出向量用于表示预测的中心词。

-

训练:

- 对于每个上下文词和目标词组合,利用负采样或层次 Softmax来计算概率。

- 更新参数以最大化实际目标词的概率,同时最小化错误输出的概率。可使用反向传播算法进行计算并更新嵌入矩阵。

负采样

CBOW 模型同样使用负采样的方式来提高计算效率。模型会从词汇表中随机选择一些不相关的单词作为负样本,以减少计算量。

模型架构

CBOW 模型包括以下几个部分:

- 输入层:接收多个上下文单词的独热编码表示。

- 隐藏层:无激活函数,将上下文单词的嵌入向量通过权重矩阵相加得到隐藏层的输出。这个输出向量是所有上下文词向量的平均值或总和。

- 输出层:经过 Softmax 层计算每个词的概率,最终输出为预测的中心词。

代码示例

使用 Python 的 Gensim 库实现 CBOW 模型的示例:

from gensim.models import Word2Vec# 示例语料

sentences = [['i', 'love', 'natural', 'language', 'processing'],['deep', 'learning', 'is', 'important'],['machine', 'learning', 'is', 'fun'],

]# 训练 Word2Vec 模型(使用 CBOW)

model = Word2Vec(sentences, vector_size=100, window=2, min_count=1, sg=0) # sg=0 表示使用 CBOW# 获取某个词的向量

vector = model.wv['language']

print("Vector for 'language':", vector)# 获取与某个词最相似的词

similar_words = model.wv.most_similar('learning', topn=5)

print("Most similar words to 'learning':", similar_words)

优点

- 捕捉上下文信息:CBOW 模型通过多个上下文单词来形成更全面的上下文表示,从而有效地捕捉语义信息。

- 计算高效:由于输入是多个上下文词,可以在训练中更好地进行并行计算。

- 适应性强:在各种特定任务中,只需调整窗口大小和其他参数即可优化模型效果。

CBOW 模型通过利用上下文词来预测目标词的机制,在自然语言处理领域表现出色。其灵活的框架和高效的训练方法,使得它成为了许多 NLP 应用的基础,为理解和处理复杂的语言结构提供了强大的支持。

相关文章:

word2vec--CBOW与Skip-Gram 两种模型

Word2Vec 是一种流行的用于生成词嵌入(Word Embeddings)的无监督学习模型,它由 Google 的一个团队在 2013 年提出。它的主要目的是将单词映射到一个连续的向量空间,使得语义相似的单词在这个空间中靠得更近。 Word2Vec 有两种主要…...

iOS六大设计原则设计模式

六大设计原则: 一、单一职责原则 一个类或者模块只负责完成一个职责或者功能。 类似于:UIView 和 CALayer 二、开放封闭原则 对扩展开放,对修改封闭。 我们要尽量通过扩展软件实体来解决需求变化,而不是通过修改已有的代码来…...

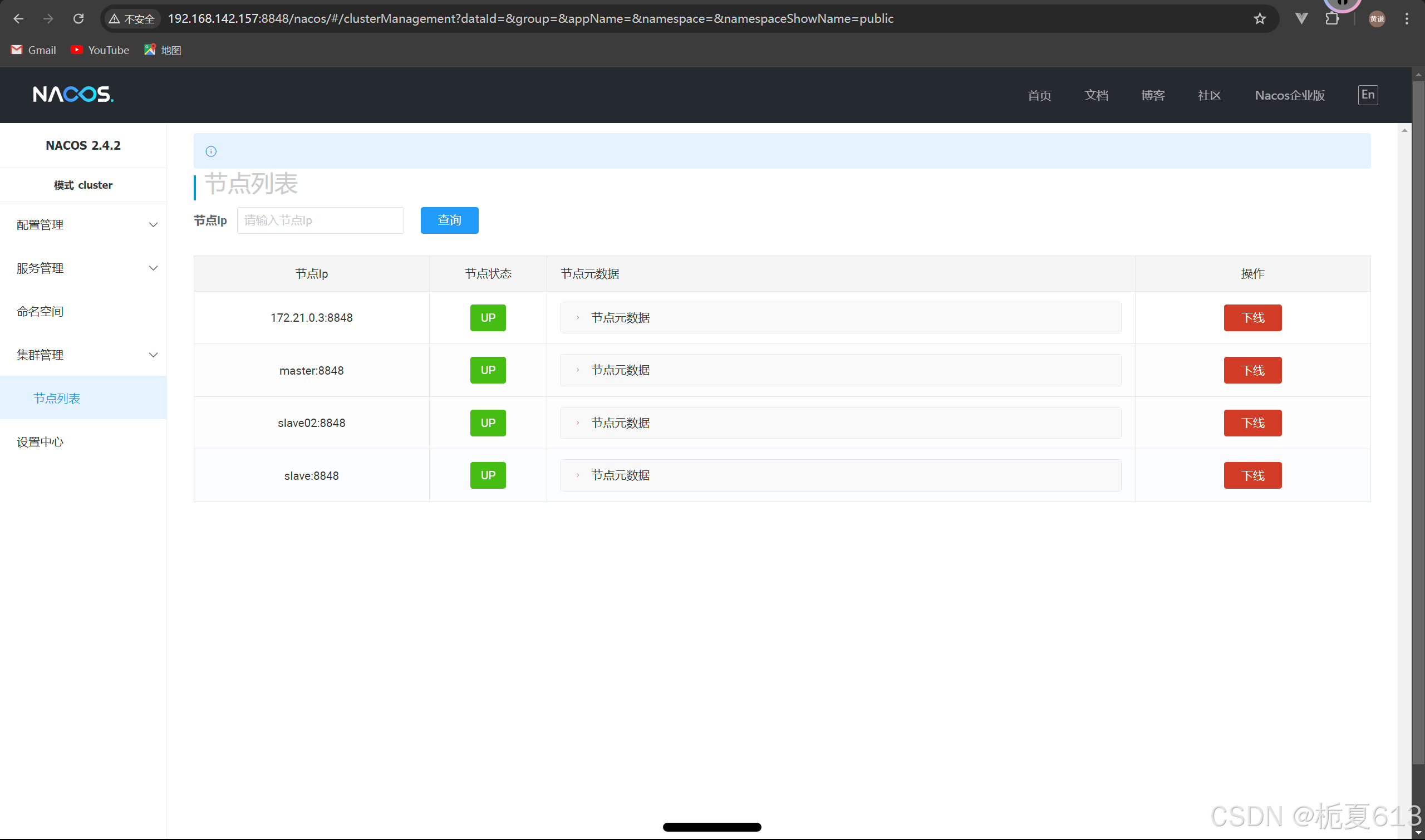

nacos 集群搭建

主机准备 IProle192.168.142.155slave02192.168.142.156slave192.168.142.157master 三台主机上分别构建 mysql 镜像 FROM mysql:8.0.31 ADD https://raw.githubusercontent.com/alibaba/nacos/develop/distribution/conf/mysql-schema.sql /docker-entrypoint-initdb.d/nac…...

STM32快速复习(十二)FLASH闪存的读写

文章目录 一、FLASH是什么?FLASH的结构?二、使用步骤1.标准库函数2.示例函数 总结 一、FLASH是什么?FLASH的结构? 1、FLASH简介 (1)STM32F1系列的FLASH包含程序存储器、系统存储器和选项字节三个部分&…...

漏洞扫描工具使用

首先把补丁的两个文件复制下来替换原文件 找到C:\ProgramData\Acunetix\shared\license然后替换 然后打开漏扫工具并刷新页面 然后添加要扫描的网站 等他扫描完成 扫描完成就可以生成报告了 一共五十多页的报告...

C++ | Leetcode C++题解之第424题替换后的最长重复字符

题目: 题解: class Solution { public:int characterReplacement(string s, int k) {vector<int> num(26);int n s.length();int maxn 0;int left 0, right 0;while (right < n) {num[s[right] - A];maxn max(maxn, num[s[right] - A]);i…...

利士策分享,动摇时刻的自我救赎

利士策分享,动摇时刻的自我救赎 在人生的长河中,我们每个人都会面临各种挑战与抉择, 那些让人心生动摇的瞬间,如同夜空中偶尔掠过的乌云,遮蔽了前行的星光。 但正是这些动摇,构成了我们成长的轨迹&#x…...

动手学深度学习(李沐)PyTorch 第 1 章 引言

在线电子书 深度学习介绍 安装 使用conda环境 conda create -n d2l-zh python3.8 pip安装需要的包 pip install jupyter d2l torch torchvision下载代码并执行 wget https://zh-v2.d2l.ai/d2l-zh.zip unzip d2l-zh.zip jupyter notebookpip install rise如果不想使用jupyt…...

二叉树(二)深度遍历和广度遍历

一、层序遍历 广度优先搜索:使用队列,先进先出 模板: 1、定义返回的result和用于辅助的队列 2、队列初始化: root非空时进队 3、遍历整个队列:大循环while(!que.empty()) 记录每层的size以及装每层结果的变量&a…...

【算法——双指针】

922. 按奇偶排序数组 II 算法讲解050【必备】双指针技巧与相关题目_哔哩哔哩_bilibili main:vector<int>nums { 3,1,2,4 };int i 0, j 1;int n nums.size() - 1;while (j < nums.size() && i < nums.size()) //如果奇偶任一方排好了,另…...

Rocky Linux 9 中添加或删除某个网卡的静态路由的方法

使用ip命令配置临时路由 添加静态路由 ip route add <目的网络> via <下一跳IP> dev <网卡接口名称>例: 给eth0网卡添加一个到达 192.168.2.0/24 网络,下一跳为 192.168.1.254 的路由 ip route add 192.168.2.0/24 via 192.168.1.254 dev eth0…...

网站建设中常见的网站后台开发语言有哪几种,各自优缺点都是什么?

市场上常见的网站后台开发语言有PHP、Python、JavaScript、Ruby、Java和.NET等。这些语言各有其独特的优缺点,适用于不同的开发场景和需求。以下是对这些语言的具体介绍: PHP 优点:PHP是一种广泛用于Web开发的动态脚本语言,特别适…...

【程序大侠传】应用内存缓步攀升,告警如影随形

前序 在武侠编码的江湖中,内存泄漏犹如隐秘杀手,潜伏于应用程序的各个角落,悄无声息地吞噬着系统资源。若不及时发现和解决,必将导致内存枯竭,应用崩溃。 背景:内存泄漏的由来 内存泄漏,乃程序…...

JavaWEB概述

JavaWEB概述 一、什么是JavaWEB 用Java技术解决web互联网领域的技术栈。要学习JavaWEB首先得知道什么是客户端和服务端 客户端:简而言之,这就是使用方,比如我们下载一个软件去使用,里面有很多我们可以使用的功能,那…...

半结构化知识抽取案例

半结构化知识抽取是指从半结构化数据源(如HTML、XML、JSON等)中提取有用的信息,并将其转换为更易于理解和使用的知识形式。半结构化数据通常包含一些结构化的标记或标签,但不像完全结构化的数据那样严格。 比如抽取如下网页到neo …...

Oracle Truncate和delete的区别

DropTruncatedelete语句类型 DDl (数据定义语言 Data Definition Language DDl (数据定义语言 Data Definition Language DML(数据操作语言 Data Manipulation Language 速度 快 删除整个表 快 一次性删除 慢 逐行删除 回滚不可不可可del…...

应用层协议 --- HTTP

序言 在上一篇文章中,我们在应用层实现了一个非常简单的自定义协议,我们在我们报文的首部添加了报文的长度并且使用特定的符号分割。但是想做一个成熟,完善的协议是不简单的,今天我们就一起看看我们每天都会用到的 HTTP协议 。 UR…...

网卡Network Interface Card

文章目录 网卡(Network Interface Card,简称NIC)是一种计算机硬件设备,用于将计算机连接到计算机网络,使计算机能够进行数据通信。它是计算机与外部网络(如局域网、互联网)之间的接口࿰…...

9.1 Linux_I/O_基本知识

文件类型 一切I/O皆文件,文件就是存放在磁盘上面的有序数据的集合。 文件类型: 常规文件 r :就是普通文件目录文件 d :就是目录,是一个索引字符设备文件 c :键盘、鼠标块设备文件 b :U盘、磁…...

[Java]一、面向对象核心编程思想

G:\Java\1.JavaSE 1. 继承 1.1 继承的概述 重点内容:1.知道继承的好处2.会使用继承3.知道继承之后成员变量以及成员方法的访问特点4.会方法的重写,以及知道方法重写的使用场景5.会使用this关键字调用当前对象中的成员6.会使用super关键字调用父类中的成员7.会定义抽象方法以…...

解锁你的音乐宝藏:ncmdump让网易云音乐文件自由播放

解锁你的音乐宝藏:ncmdump让网易云音乐文件自由播放 【免费下载链接】ncmdump 项目地址: https://gitcode.com/gh_mirrors/ncmd/ncmdump 当你精心收藏的网易云音乐只能在特定客户端播放时,那种被束缚的感觉是否让你感到无奈?想象一下…...

Docker容器化Emacs:构建可移植、一致的开发环境解决方案

1. 项目概述:为什么要在Docker里运行Emacs?如果你是一个Emacs的重度用户,或者是一个开发者,你很可能遇到过这样的困境:你精心配置的Emacs环境,在换了一台新电脑、升级了操作系统,或者需要在多台…...

数据中心碳足迹与可靠性优化框架解析

1. 数据中心碳足迹与可靠性优化的挑战 现代数据中心已成为数字经济的动力引擎,但伴随算力需求的爆炸式增长,其能源消耗与碳排放问题日益凸显。根据最新统计,全球数据中心年耗电量已达4600亿度,占全球总用电量的2%。随着大语言模型…...

如何在Windows上无缝安装安卓应用:APK安装器终极指南

如何在Windows上无缝安装安卓应用:APK安装器终极指南 【免费下载链接】APK-Installer An Android Application Installer for Windows 项目地址: https://gitcode.com/GitHub_Trending/ap/APK-Installer 你是否曾在电脑上羡慕安卓应用的便利,却苦…...

大语言模型长上下文建模:从注意力优化到Mamba架构的工程实践

1. 项目概述:为什么长上下文建模是LLM的“圣杯”?如果你在过去一年里深度使用过任何主流的大语言模型,无论是ChatGPT、Claude还是开源的Llama、Qwen,一个共同的痛点一定让你印象深刻:“它好像不记得我们之前聊了什么”…...

小米汽车Q3真车现身:科技巨头跨界造车的技术路径与市场挑战

1. 项目概述:从“Q3真车现身”看小米汽车的阶段性成果最近,小米汽车项目代号“Q3”的测试车辆在公开道路上被频繁捕获,这已经不是简单的谍照,而是接近量产状态的“真车”现身。作为一名长期关注汽车产业变革,特别是科技…...

小智聊天机器人的本地化部署。

前天到了,小智机器人ESP32-S2的套件(非焊接版的那一款),找王同学,学了学怎么焊接。昨天,使用面包板搭建电路,安装元器件,服务器端注册设置,刷程序,很快就完成…...

555定时器深度解析:从RC电路到三种工作模式的原理与应用

1. 项目概述在电子设计的工具箱里,有那么几颗芯片,你几乎可以在任何时代的电路板上找到它们的身影。它们可能不是性能最强的,但一定是应用最广、最经久不衰的。今天要聊的555定时器,就是这样一个“活化石”级别的存在。自上世纪70…...

多脉冲重复频率解速度模糊:原理、仿真与MATLAB实现

1. 脉冲雷达的速度模糊问题 雷达测速的基本原理大家都懂,就是通过多普勒效应计算目标速度。但实际操作中会遇到一个头疼的问题——速度模糊。这就像用卷尺量身高,如果身高超过卷尺长度,就得把几段卷尺接起来量,但接缝处容易出错。…...

)

卷积神经网络在图像分类中的历史(1989 年至今)

原文:towardsdatascience.com/the-history-of-convolutional-neural-networks-for-image-classification-1989-today-5ea8a5c5fe20?sourcecollection_archive---------5-----------------------#2024-06-28 深度学习和计算机视觉领域最伟大创新的视觉之旅。 https…...