AI学习指南深度学习篇-自注意力机制(Self-Attention Mechanism)

AI学习指南深度学习篇—自注意力机制(Self-Attention Mechanism)

在深度学习的研究领域,自注意力机制(Self-Attention Mechanism)作为一种创新的模型结构,已成为了神经网络领域的一个重要组成部分,尤其在处理序列数据上表现出了惊人的效果。本文将详细介绍自注意力机制的原理,包括查询(Query)、键(Key)、值(Value)的计算过程,以及注意力分数的计算方法。同时,我们还将探讨自注意力机制在Transformer模型中的作用及其建模长距离依赖关系的能力。通过示例,我们将为读者提供对自注意力机制的深入理解。

1. 自注意力机制概述

自注意力机制是一种使得模型能够在处理输入序列时,有效地关注到序列中各个元素之间的关系。与传统的卷积和循环神经网络(RNN)不同,自注意力机制能够在单一的计算步骤中捕捉到序列中不同位置之间的相互关系。

1.1 特点

-

并行处理:自注意力机制能够并行处理输入序列的元素,相较于RNN在时间维度上逐步计算的方式,有效提升了计算效率。

-

长距离依赖:自注意力能够直接关注输入序列中所有位置的元素,这使得模型具备了建模长距离依赖关系的能力。

-

动态特征选择:通过注意力得分,模型能够动态地选择关注哪些输入特征,而非固定的卷积核或RNN状态。

2. 基本原理与计算过程

2.1 查询(Query)、键(Key)、值(Value)

在自注意力机制中,输入序列经由线性变换得到三个向量:查询(Query)、键(Key)和值(Value)。对于输入序列的每个元素,我们需要计算这些向量。

设输入序列为 ( X = [ x 1 , x 2 , … , x n ] ) ( X = [x_1, x_2, \ldots, x_n] ) (X=[x1,x2,…,xn]),每个元素 ( x i ) ( x_i ) (xi) 是一个特征向量(如词嵌入)。我们通过三个线性变换分别获得查询、键和值:

[ Q = X W Q , K = X W K , V = X W V ] [ Q = XW^Q, \quad K = XW^K, \quad V = XW^V ] [Q=XWQ,K=XWK,V=XWV]

其中:

- ( W Q , W K , W V ) ( W^Q, W^K, W^V ) (WQ,WK,WV) 为权重矩阵。

- ( Q , K , V ) ( Q, K, V ) (Q,K,V) 分别为查询、键、值矩阵。

2.2 注意力权重计算

接下来,我们计算注意力权重。注意力权重量化了输入中每个元素对其它元素的关注程度。为此,我们首先计算查询与键的点积,然后通过softmax函数归一化得到每个元素的注意力分数。

具体步骤如下:

- 计算注意力分数:

[ Attention_Scores = Q K T d k ] [ \text{Attention\_Scores} = \frac{QK^T}{\sqrt{d_k}} ] [Attention_Scores=dkQKT]

- ( d k ) ( d_k ) (dk) 是键向量的维度,做缩放可以防止点积结果过大引发的梯度消失问题。

- 应用softmax获得注意力权重:

[ Attention_Weights = softmax ( Attention_Scores ) ] [ \text{Attention\_Weights} = \text{softmax}\left(\text{Attention\_Scores}\right) ] [Attention_Weights=softmax(Attention_Scores)]

2.3 加权平均计算输出

最后,注意力权重与值向量相乘以获得最终输出。公式如下:

[ Output = Attention_Weights V ] [ \text{Output} = \text{Attention\_Weights} V ] [Output=Attention_WeightsV]

3. 自注意力机制示例

为了更好地理解自注意力机制的计算过程,下面将通过一个具体的示例来阐释。

示例输入

假设有一个输入序列:

[ X = [ 1 0 0 0 1 0 0 0 1 ] ] [ X = \begin{bmatrix} 1 & 0 & 0 \\ 0 & 1 & 0 \\ 0 & 0 & 1 \end{bmatrix} ] [X= 100010001 ]

假设权重矩阵为:

[ W Q = W K = W V = [ 1 0 0 1 1 1 ] ] [ W^Q = W^K = W^V = \begin{bmatrix} 1 & 0 \\ 0 & 1 \\ 1 & 1 \end{bmatrix} ] [WQ=WK=WV= 101011 ]

3.1 计算查询、键和值

根据前述公式,我们计算得到:

[ Q = X W Q = [ 1 0 0 1 0 0 ] , K = X W K = [ 1 0 0 1 0 0 ] ] [ Q = XW^Q = \begin{bmatrix} 1 & 0 \\ 0 & 1 \\ 0 & 0 \end{bmatrix}, \quad K = XW^K = \begin{bmatrix} 1 & 0 \\ 0 & 1 \\ 0 & 0 \end{bmatrix} ] [Q=XWQ= 100010 ,K=XWK= 100010 ]

[ V = X W V = [ 1 0 0 1 0 0 ] ] [ V = XW^V = \begin{bmatrix} 1 & 0 \\ 0 & 1 \\ 0 & 0 \end{bmatrix} ] [V=XWV= 100010 ]

3.2 计算注意力分数

接着计算注意力分数:

[ Attention_Scores = Q K T d k = 1 2 [ 1 0 0 0 1 0 ] [ 1 0 0 1 0 0 ] = 1 2 [ 1 0 0 0 1 0 ] ] [ \text{Attention\_Scores} = \frac{QK^T}{\sqrt{d_k}} = \frac{1}{\sqrt{2}} \begin{bmatrix} 1 & 0 & 0 \\ 0 & 1 & 0 \end{bmatrix} \begin{bmatrix} 1 & 0 \\ 0 & 1 \\ 0 & 0 \end{bmatrix} = \frac{1}{\sqrt{2}} \begin{bmatrix} 1 & 0 & 0 \\ 0 & 1 & 0 \end{bmatrix} ] [Attention_Scores=dkQKT=21[100100] 100010 =21[100100]]

3.3 应用softmax

接下来对注意力分数进行softmax变换:

[ Attention_Weights = softmax ( Attention_Scores ) = softmax ( [ 1 2 0 0 0 1 2 0 ] ) ] [ \text{Attention\_Weights} = \text{softmax}\left(\text{Attention\_Scores}\right) = \text{softmax}\left(\begin{bmatrix} \frac{1}{\sqrt{2}} & 0 & 0 \\ 0 & \frac{1}{\sqrt{2}} & 0 \end{bmatrix}\right) ] [Attention_Weights=softmax(Attention_Scores)=softmax([21002100])]

经过softmax得到的注意力权重为:

[ Attention_Weights = [ 1 2 1 2 0 0 1 2 1 2 ] ] [ \text{Attention\_Weights} = \begin{bmatrix} \frac{1}{2} & \frac{1}{2} & 0 \\ 0 & \frac{1}{2} & \frac{1}{2} \end{bmatrix} ] [Attention_Weights=[2102121021]]

3.4 计算输出

最后计算输出:

[ Output = Attention_Weights V = [ 1 2 1 2 0 0 1 2 1 2 ] [ 1 0 0 1 0 0 ] = [ 1 2 1 2 0 0 ] ] [ \text{Output} = \text{Attention\_Weights} V = \begin{bmatrix} \frac{1}{2} & \frac{1}{2} & 0 \\ 0 & \frac{1}{2} & \frac{1}{2} \end{bmatrix} \begin{bmatrix} 1 & 0 \\ 0 & 1 \\ 0 & 0 \end{bmatrix} = \begin{bmatrix} \frac{1}{2} & \frac{1}{2} \\ 0 & 0 \end{bmatrix} ] [Output=Attention_WeightsV=[2102121021] 100010 =[210210]]

这就是自注意力机制计算的完整流程,从计算查询、键、值到最终输出。

4. 自注意力机制在Transformer中的应用

自注意力机制的引入,极大地推动了Transformer模型的发展。Transformer模型是由编码器和解码器组成,广泛应用于机器翻译、文本生成等自然语言处理任务。下面我们将分析自注意力机制在Transformer中的具体作用。

4.1 编码器部分

在Transformer的编码器中,输入的每一个词通过自注意力机制与整个输入序列相互动。通过这一方式,模型可以获得每个词在上下文中的含义,从而生成更有信息量的表示。这一过程能够有效地捕获长距离的依赖关系,例如在句子中,当上下文中离当前词很远的成分对其有重要影响时,自注意力机制能够帮助捕获这种关系。

4.2 解码器部分

Transformer的解码器同样使用自注意力机制,但加上了屏蔽机制(Masked Attention)。屏蔽机制确保在生成当前词的过程中,仅依赖于已生成的词,而不会参照未来的信息。这一机制克服了传统RNN在生成过程中需要逐步进行计算的问题,增加了计算的并行性。

4.3 结合位置编码

由于自注意力机制本身缺乏位置感知能力,Transformer使用位置编码(Positional Encoding)为模型提供位置信息。位置编码通过与输入向量相加的方式,帮助模型理解序列中不同元素的相对或绝对位置。

5. 自注意力机制的优势

5.1 高效的长距离依赖建模

自注意力机制的并行计算能力和对任意位置之间关系的关注,使得它能够以较低的计算成本捕捉长距离依赖。尤其在长文本处理时,传统RNN容易面临“记忆丢失”的问题,而自注意力机制则能够长期保持信息。

5.2 灵活的特征选择

通过动态计算的注意力权重,模型可在不同训练阶段自动决定关注那些特征。这种能力使得模型能够在多样化的数据上表现良好,适应性强。

5.3 状态无关性

自注意力机制不依赖于前一状态,其输出仅依赖当前输入,这带来了更好的解释性,同时也使得并行处理成为可能。

6. 自注意力机制的局限性

尽管自注意力机制有诸多优点,但也存在一些局限性:

6.1 计算开销

随着序列长度的增加,自注意力机制的计算量会呈现平方级别的增长,对于非常长的序列,可能导致计算效率下降。因此,在实际应用中,往往需要对序列进行长度控制或处理。

6.2 存储需求

自注意力机制需要存储注意力矩阵及其权重,这在大规模模型中也会导致高额的内存需求。

7. 未来展望

自注意力机制作为深度学习领域的重要组成部分,已得到广泛关注和研究。未来,我们可以期待以下几个发展方向:

-

高效化:研究如何降低自注意力机制的时间复杂度和空间复杂度,从而使其能够处理更长的序列。

-

融合其他机制:尝试将自注意力与其他机制,如卷积或递归网络结合,寻找在某些应用场景下更优的解决方案。

-

应用扩展:自注意力机制不仅限于自然语言处理领域,在计算机视觉、图像生成等领域同样具有巨大潜力。

结论

自注意力机制作为一种强大的建模工具,为处理长序列数据开辟了新的道路。通过动态地捕捉输入数据中各个元素之间的关系,模型得以在较低的成本下取得较好的性能。随着相关技术的不断进步,自注意力机制将在AI的多个领域发挥更大的作用,为未来的研究和应用提供更广阔的平台。希望本文对读者理解自注意力机制有所帮助,并激励读者深入探索这个激动人心的领域。

相关文章:

)

AI学习指南深度学习篇-自注意力机制(Self-Attention Mechanism)

AI学习指南深度学习篇—自注意力机制(Self-Attention Mechanism) 在深度学习的研究领域,自注意力机制(Self-Attention Mechanism)作为一种创新的模型结构,已成为了神经网络领域的一个重要组成部分…...

【JAVA毕业设计】基于Vue和SpringBoot的校园管理系统

本文项目编号 T 026 ,文末自助获取源码 \color{red}{T026,文末自助获取源码} T026,文末自助获取源码 目录 一、系统介绍二、演示录屏三、启动教程四、功能截图五、文案资料5.1 选题背景5.2 国内外研究现状5.3 可行性分析 六、核心代码6.1 管…...

你对MySQL的having关键字了解多少?

在MySQL中,HAVING子句用于在数据分组并计算聚合函数之后,对结果进行进一步的过滤。它通常与GROUP BY子句一起使用,以根据指定的条件过滤分组。HAVING子句的作用类似于WHERE子句,但WHERE子句是在数据被聚合之前进行过滤,…...

【STM32编码器】【STM32】

提示:一般情况下我们会设计一个硬件电路模块来自动完成简单重复而高频的计算 文章目录 一、为什么通常情况下不使用外部中断来对编码器的脉冲进行计数?二、编码器速度测量程序设计思路三、正交编码器四、初始化流程五、STM32正交编码器输入捕获模式配置示…...

Python轴承故障诊断 (13)基于故障信号特征提取的超强机器学习识别模型

往期精彩内容: Python-凯斯西储大学(CWRU)轴承数据解读与分类处理 Pytorch-LSTM轴承故障一维信号分类(一)-CSDN博客 Pytorch-CNN轴承故障一维信号分类(二)-CSDN博客 Pytorch-Transformer轴承故障一维信号分类(三)-CSDN博客 三十多个开源…...

VScode分文件编写C++报错 | 如何进行VScode分文件编写C++ | 不懂也能轻松解决版

分文件编写遇到的问题 分文件编写例子如下所示: 但是直接使用 Run Code 或者 调试C/C文件 会报错如下: 正在执行任务: C/C: g.exe 生成活动文件 正在启动生成… cmd /c chcp 65001>nul && D:\Librarys\mingw64\bin\g.exe -fdiagnostics-col…...

洞察前沿趋势!2024深圳国际金融科技大赛——西丽湖金融科技大学生挑战赛技术公开课指南

在当前信息技术与“互联网”深度融合的背景下,金融行业的转型升级是热门话题,创新与发展成为金融科技主旋律。随着区块链技术、人工智能技术、5G通信技术、大数据技术等前沿科技的飞速发展,它们与金融领域的深度融合,正引领着新型…...

Unity3D学习FPS游戏(4)重力模拟和角色跳跃

前言:前面两篇文章,已经实现了角色的移动和视角转动,但是角色并没有办法跳跃,有时候还会随着视角移动跑到天上。这是因为缺少重力系统,本篇将实现重力和角色跳跃功能。觉得有帮助的话可以点赞收藏支持一下!…...

C#基础知识-枚举

目录 枚举 1.分类 1.1普通枚举 1)默认情况 2)指定起始值 1.2标志枚举(Flag Enum) 位运算符与标志枚举 1)组合标志 2)检查标志 2.枚举与不同类型之间的转换 1)枚举->整型 2&#…...

系统架构设计师教程 第2章 2.1-2计算机系统及硬件 笔记

2.1计算机系统概述 ★☆☆☆☆ 计算机系统 (Computer System) 是指用于数据管理的计算机硬件、软件及网络组成的系统。 一般指由硬件子系统和软件子系统组成的系统,简称为计算机。 将连接多个计算机以实现计算机间数据交换能力的网络设备,称为计算机网…...

通过使用Visual Studio将你的程序一键发布到Docker

通过使用Visual Studio将你的程序一键发布到Docker 代码 阿里云容器镜像服务 https://www.aliyun.com/product/acr 添加Docker CE阿里云镜像仓库 sudo yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo 安装Docker CE、Doc…...

vue2和vue3动态引入路由,权限控制

后端返回的路由结构(具体路由可以本地模拟) // 此路由自己本地模拟即可 const menus [{"title": "动态路由","meta": "{\"title\":\"动态路由\",\"noCache\":true}","component": "/t…...

Spring Boot:植物健康的智能守护者

2相关技术 2.1 MYSQL数据库 MySQL是一个真正的多用户、多线程SQL数据库服务器。 是基于SQL的客户/服务器模式的关系数据库管理系统,它的有点有有功能强大、使用简单、管理方便、安全可靠性高、运行速度快、多线程、跨平台性、完全网络化、稳定性等,非常…...

红黑树 学习笔记

目录 1.红黑树的概念 1.1红黑树的规则 1.2红黑树的效率 2.红黑树的实现 2.1红黑树的大致结构 2.2红黑树的插入 2.2.1红黑树插入的大致过程 2.2.2情况1:变色 2.2.3情况2:单旋+变色 2.2.4情况3:双旋变色 2.3红黑树的查找…...

linux更改系统时间

测试环境和生产环境代码完全一致,但是生产环境代码碰到了问题,报错类似time expired,猜测和系统时间有关系,修改之后确实好了。测试如下: 参考:centos7时间同步教程_centos7 时间同步,如果遇到…...

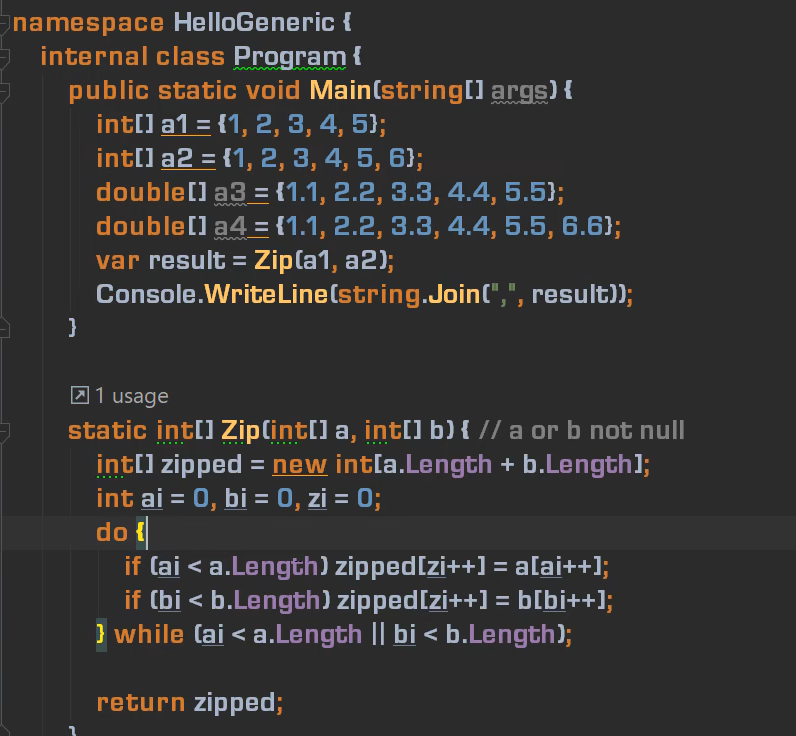

B站C#刘铁猛笔记

C#——刘铁猛笔记 类、名称空间(简述) 类(class)是构成程序的主体 名称空间(namespace)以树形结构组织类(其他类型) 名称空间:名称空间是用来组织和管理类、接口、结构…...

如何使用信号发生器产生正弦波并用数字示波器进行测量

使用信号发生器产生正弦波并用数字示波器进行测量的步骤如下: 1. 准备工作 所需设备 信号发生器数字示波器探头(通常为10X衰减探头)BNC电缆和适配器(如果需要) 2. 设置信号发生器 连接 使用BNC电缆将信号发生器的…...

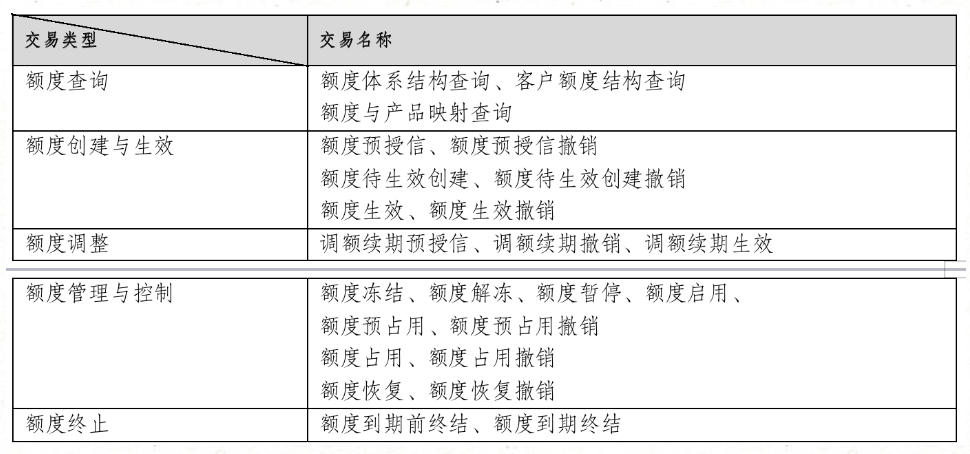

XJ04、消费金融|授信基本概念及其流程设计

银行是经营风险的特殊行业,而银行授信则与银行业务和风险天然相伴。它是银行与客户建立业务关系的起点,也是银行风险管理的关键环节和核心要素。若要了解银行业务,就得先了解银行的授信业务;若要理解银行经营,就得先理…...

儿童预防接种预约微信小程序springboot+论文源码调试讲解

2相关技术 2.1微信小程序 小程序是一种新的开放能力,开发者可以快速地开发一个小程序。小程序可以在微信内被便捷地获取和传播,同时具有出色的使用体验。尤其拥抱微信生态圈,让微信小程序更加的如虎添翼,发展迅猛。 2.2 MYSQL数据…...

nginx 修改配置

如果你的后端服务在不同的端口上运行,但静态资源访问路径相同,你可以使用 Nginx 的 location 配置来将请求转发到不同的后端服务,同时处理静态文件。这里有几种常见的方式: 方案 1: 基于路径的配置 如果所有服务的静态资源路径相…...

在Nodejs后端服务中集成Taotoken实现稳定可靠的大模型调用

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 在Nodejs后端服务中集成Taotoken实现稳定可靠的大模型调用 将大模型能力集成到后端服务是现代应用开发的常见需求。对于Node.js开发…...

3大核心功能,让你的惠普OMEN游戏本性能彻底解放

3大核心功能,让你的惠普OMEN游戏本性能彻底解放 【免费下载链接】OmenSuperHub 使用 WMI BIOS控制性能和风扇速度,自动解除DB功耗限制。 项目地址: https://gitcode.com/gh_mirrors/om/OmenSuperHub 还在为惠普OMEN游戏本官方软件过于臃肿而烦恼吗…...

对比按量计费与Token Plan套餐,哪种方式更适合你的项目

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 对比按量计费与Token Plan套餐,哪种方式更适合你的项目 在接入大模型服务时,成本控制是每个开发者和团队都…...

RedwoodJS熔断器:构建高可用应用的熔断机制与故障隔离终极指南 [特殊字符]

RedwoodJS熔断器:构建高可用应用的熔断机制与故障隔离终极指南 🔧 【免费下载链接】redwood RedwoodGraphQL 项目地址: https://gitcode.com/gh_mirrors/re/redwood 在当今微服务架构盛行的时代,应用的高可用性成为了开发者的首要关注…...

别再死记硬背了!用这5个真实数据处理场景,彻底搞懂Python列表、字典和集合

别再死记硬背了!用这5个真实数据处理场景,彻底搞懂Python列表、字典和集合 当你第一次学习Python时,列表、字典和集合可能只是教科书上的几个定义。但真正掌握它们的关键,在于理解如何将这些数据结构转化为解决实际问题的工具。本…...

从零到一:基于C#与ArcGIS二次开发构建迎风面指数计算插件实战

1. 环境准备与工具搭建 第一次接触ArcGIS二次开发时,我被官方文档里密密麻麻的API吓得不轻。后来发现只要配好环境,开发插件比想象中简单得多。你需要准备三样东西:Visual Studio(建议2019或2022社区版)、ArcGIS Desk…...

从FPGA工程师的视角看AMBA总线:手把手教你用Verilog实现一个简易APB外设

从FPGA工程师的视角看AMBA总线:手把手教你用Verilog实现一个简易APB外设 在FPGA和数字IC设计领域,AMBA总线协议就像城市中的交通网络,负责协调各个功能模块之间的数据流动。而APB(Advanced Peripheral Bus)作为AMBA家族…...

实测Taotoken平台API调用稳定性与延迟体感观察记录

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 实测Taotoken平台API调用稳定性与延迟体感观察记录 在将大模型能力集成到生产应用时,服务的稳定性和响应延迟是开发者关…...

从CANdb++到Matlab:手把手教你读懂DBC文件里的信号映射与物理值转换

从CANdb到Matlab:手把手教你读懂DBC文件里的信号映射与物理值转换 在汽车电子和嵌入式系统开发中,DBC文件作为CAN总线通信的"字典",承载着整车网络通信的核心协议。对于刚接触汽车网络通信的工程师来说,面对DBC文件中密…...

基于VitePress构建开源AI智能体框架深度中文文档站实战指南

1. 项目概述:一个为AI智能体框架量身打造的中文文档站如果你正在寻找一个能帮你把Claude、GPT这些大模型快速接入到微信、Telegram、飞书等聊天软件的开源框架,那你大概率会接触到OpenClaw(原名ClawdBot)。但当你兴冲冲地打开官方…...