矩阵的 正定(Positive Definite)与负定(Negative Definite):从Fisher信息矩阵看“曲率”的秘密

矩阵的正定与负定:从Fisher信息矩阵看“曲率”的秘密

在数学和统计学中,矩阵的“正定性”和“负定性”是一对重要概念,尤其在优化、统计推断和机器学习中频繁出现。比如,Fisher信息矩阵(Fisher Information Matrix, FIM)常被描述为“正定”的,这不仅是个数学性质,还与参数估计的“曲率”密切相关。那么,什么是正定和负定?它们有什么用?今天我们就来聊聊这些问题,以Fisher信息矩阵为例,揭开矩阵性质背后的奥秘。

什么是正定和负定?

矩阵的正定性和负定性是线性代数中的概念,用来描述一个对称矩阵的“方向性”和“形状”。假设 ( A A A ) 是一个 ( n × n n \times n n×n ) 的实对称矩阵(即 ( A = A T A = A^T A=AT )),它的正定性和负定性定义如下:

正定(Positive Definite)

矩阵 ( A A A ) 是正定的,如果对于任意非零向量 ( x ∈ R n x \in \mathbb{R}^n x∈Rn )(( x ≠ 0 x \neq 0 x=0 )):

x T A x > 0 x^T A x > 0 xTAx>0

这意味着 ( A A A ) 的二次型(quadratic form)总是正的。

负定(Negative Definite)

矩阵 ( A A A ) 是负定的,如果:

x T A x < 0 x^T A x < 0 xTAx<0

即二次型总是负的。

其他情况

- 半正定(Positive Semidefinite):( x T A x ≥ 0 x^T A x \geq 0 xTAx≥0 ),允许等于零。

- 半负定(Negative Semidefinite):( x T A x ≤ 0 x^T A x \leq 0 xTAx≤0 )。

通俗比喻

想象 ( A A A ) 是一个“碗”的形状:

- 正定:像一个“正放的碗”,碗底在下,口朝天,无论从哪个方向离开碗底,高度( x T A x x^T A x xTAx)都增加,像一个凸起的谷底。凸函数(想象 x 2 x^2 x2的样子)。

- 负定:像一个“倒扣的碗”,碗底在上,口朝地,所有方向都下降,像一个凹陷的山顶。凹函数(想象 l o g x logx logx的样子)。

- 半正定或半负定:碗可能有平坦的区域,某些方向高度不变。

如何判断正定和负定?

数学上有几种等价方法判断一个对称矩阵的性质:

-

特征值(Eigenvalues):

- 正定:所有特征值 ( λ i > 0 \lambda_i > 0 λi>0 )。

- 负定:所有特征值 ( λ i < 0 \lambda_i < 0 λi<0 )。

- 半正定:所有特征值 ( λ i ≥ 0 \lambda_i \geq 0 λi≥0 )。

-

二次型:

- 检查 ( x T A x x^T A x xTAx ) 在所有非零 ( x x x ) 上的符号。

-

主子式(Leading Principal Minors):

- 正定:所有主子式(从左上角逐步扩大的子矩阵的行列式)都大于零。

- 负定:主子式符号交替(奇数阶负,偶数阶正)。

简单例子

-

( A = [ 2 0 0 2 ] A = \begin{bmatrix} 2 & 0 \\ 0 & 2 \end{bmatrix} A=[2002] ):

- ( x T A x = 2 x 1 2 + 2 x 2 2 > 0 x^T A x = 2x_1^2 + 2x_2^2 > 0 xTAx=2x12+2x22>0 )(除非 ( x = 0 x = 0 x=0 )),正定。

- 特征值:2, 2,皆正。

-

( A = [ − 1 0 0 − 1 ] A = \begin{bmatrix} -1 & 0 \\ 0 & -1 \end{bmatrix} A=[−100−1] ):

- ( x T A x = − x 1 2 − x 2 2 < 0 x^T A x = -x_1^2 - x_2^2 < 0 xTAx=−x12−x22<0 ),负定。

- 特征值:-1, -1,皆负。

Fisher信息矩阵的正定性

Fisher信息矩阵 ( I ( θ ) I(\theta) I(θ) ) 定义为得分函数的协方差:

I ( θ ) i j = E [ ∂ log p ( x ∣ θ ) ∂ θ i ∂ log p ( x ∣ θ ) ∂ θ j ∣ θ ] I(\theta)_{ij} = E\left[ \frac{\partial \log p(x|\theta)}{\partial \theta_i} \frac{\partial \log p(x|\theta)}{\partial \theta_j} \bigg| \theta \right] I(θ)ij=E[∂θi∂logp(x∣θ)∂θj∂logp(x∣θ) θ]

或者等价地:

I ( θ ) i j = − E [ ∂ 2 log p ( x ∣ θ ) ∂ θ i ∂ θ j ∣ θ ] I(\theta)_{ij} = -E\left[ \frac{\partial^2 \log p(x|\theta)}{\partial \theta_i \partial \theta_j} \bigg| \theta \right] I(θ)ij=−E[∂θi∂θj∂2logp(x∣θ) θ]

书中常说:“如果模型是可识别的(即不同参数 ( θ \theta θ ) 对应不同分布 ( p ( x ∣ θ ) p(x|\theta) p(x∣θ) )),Fisher信息矩阵通常是正定的。”为什么?

正定的来源

- 得分函数的协方差:( I ( θ ) I(\theta) I(θ) ) 是协方差矩阵,而协方差矩阵天然是半正定的(( x T I x = E [ ( x T s ) 2 ] ≥ 0 x^T I x = E[(x^T s)^2] \geq 0 xTIx=E[(xTs)2]≥0 ))。

- 可识别性:如果模型可识别,得分函数 ( s ( θ ) = ∇ log p s(\theta) = \nabla \log p s(θ)=∇logp ) 在不同 ( θ \theta θ ) 下变化显著,( I ( θ ) I(\theta) I(θ) ) 没有零特征值(即 ( x T I x = 0 x^T I x = 0 xTIx=0 ) 仅当 ( x = 0 x = 0 x=0 )),从而正定。

正态分布例子

对于 ( x ∼ N ( μ , σ 2 ) x \sim N(\mu, \sigma^2) x∼N(μ,σ2) ):

I ( θ ) = [ 1 σ 2 0 0 1 2 σ 4 ] I(\theta) = \begin{bmatrix} \frac{1}{\sigma^2} & 0 \\ 0 & \frac{1}{2\sigma^4} \end{bmatrix} I(θ)=[σ21002σ41]

- 特征值:( 1 σ 2 , 1 2 σ 4 \frac{1}{\sigma^2}, \frac{1}{2\sigma^4} σ21,2σ41 ),皆正。

- ( x T I x = x 1 2 σ 2 + x 2 2 2 σ 4 > 0 x^T I x = \frac{x_1^2}{\sigma^2} + \frac{x_2^2}{2\sigma^4} > 0 xTIx=σ2x12+2σ4x22>0 ),正定。

正定和负定的用途

正定和负定不仅是数学标签,它们在实际中有重要作用,尤其与“曲率”挂钩。

1. 曲率与优化

- 正定:表示函数(比如负对数似然)在某点是“碗口向上”的凸函数,最优解在底部。Fisher信息矩阵正定说明似然函数局部是凸的,参数估计有唯一解。

- 负定:表示“碗口向下”,如损失函数的最大值。优化时常希望Hessian负定(如最大化似然)。

在牛顿法中,Hessian的正定性保证步长方向正确,而Fisher信息矩阵正定则为自然梯度提供稳定基础。

2. 参数估计精度

Fisher信息矩阵正定意味着它的逆 ( I ( θ ) − 1 I(\theta)^{-1} I(θ)−1 ) 存在且正定,提供了参数估计的协方差下界(Cramér-Rao界):

Cov ( θ ^ ) ≥ I ( θ ) − 1 \text{Cov}(\hat{\theta}) \geq I(\theta)^{-1} Cov(θ^)≥I(θ)−1

正定性保证协方差矩阵有效,估计精度可量化。

3. 稳定性与正交性

- 正定矩阵的特征值全正,保证系统(如优化过程)稳定。

- 如果 ( I i j = 0 I_{ij} = 0 Iij=0 )(参数正交),矩阵接近对角形式,正定性更易满足,简化计算。

正定性与“曲率”的联系

Fisher信息矩阵的正定性为何能衡量“参数估计的曲率”?

- 几何意义:( x T I x x^T I x xTIx ) 是对数似然函数在 ( θ \theta θ ) 附近曲率的期望。正定说明曲率处处向上,似然函数像一个“碗”,参数估计的“底部”清晰。

- 信息含量:曲率越大(特征值越大),似然对参数变化越敏感,数据提供的信息越多。

例如,( I μ μ = 1 σ 2 I_{\mu\mu} = \frac{1}{\sigma^2} Iμμ=σ21 ) 表明,当 ( σ 2 \sigma^2 σ2 ) 小时,曲率大,( μ \mu μ ) 的估计更精确。

总结

矩阵的正定性和负定性描述了二次型的符号和函数的形状:正定是“正放的碗”,负定是“倒扣的碗”。在Fisher信息矩阵中,正定性源于模型的可识别性,保证了似然函数的局部凸性和参数估计的稳定性。它不仅衡量“曲率”,还为优化和推断提供了理论支撑。下次看到正定矩阵,不妨想想:它在告诉你什么形状的故事?

补充

“碗口向上”是什么意思?

在数学和几何中,当我们说一个矩阵 ( A A A ) 是正定的,意味着它的二次型 ( x T A x x^T A x xTAx ) 对于所有非零向量 ( x x x ) 都是正的(( x T A x > 0 x^T A x > 0 xTAx>0 ))。这可以用一个碗的形状来类比,但这里的“碗”是指一个三维空间中的曲面,具体来说是一个抛物面或椭球面。

- “碗口向上”:指的是这个曲面在原点(( x = 0 x = 0 x=0 ))处达到最小值(( x T A x = 0 x^T A x = 0 xTAx=0 )),然后随着 ( x x x ) 远离原点,曲面高度(( x T A x x^T A x xTAx ))逐渐增加。这种形状在数学上对应一个凸函数,底部在最低点,像一个正放的碗。

- 几何图像:想象一个普通的碗,开口朝天,底部在桌子上的形状。无论你从哪个方向(( x x x ) 的任意方向)离开中心,高度(碗的深度,或 ( x T A x x^T A x xTAx ))都上升。

举个例子

考虑正定矩阵 ( A = [ 1 0 0 1 ] A = \begin{bmatrix} 1 & 0 \\ 0 & 1 \end{bmatrix} A=[1001] ):

x T A x = x 1 2 + x 2 2 x^T A x = x_1^2 + x_2^2 xTAx=x12+x22

- 当 ( x = [ 0 , 0 ] x = [0, 0] x=[0,0] ) 时,( x T A x = 0 x^T A x = 0 xTAx=0 )(最低点)。

- 当 ( x = [ 1 , 0 ] x = [1, 0] x=[1,0] ) 时,( x T A x = 1 x^T A x = 1 xTAx=1 );( x = [ 0 , 2 ] x = [0, 2] x=[0,2] ) 时,( x T A x = 4 x^T A x = 4 xTAx=4 )。

- 这是一个碗口向上的抛物面,底部在原点,向上延伸。

“碗倒扣在桌子上”

“碗倒扣在桌子上的形状”,是一个很自然的联想,但它对应的是负定矩阵,而不是正定矩阵。

- “碗口向下”(负定):如果矩阵 ( A A A ) 是负定的,( x T A x < 0 x^T A x < 0 xTAx<0 ) 对所有非零 ( x x x ) 成立。这时,曲面在原点处是最高点(( x T A x = 0 x^T A x = 0 xTAx=0 )),向四周下降,像一个倒扣的碗,或一个“坑”。

- 例子:( A = [ − 1 0 0 − 1 ] A = \begin{bmatrix} -1 & 0 \\ 0 & -1 \end{bmatrix} A=[−100−1] ):

x T A x = − x 1 2 − x 2 2 x^T A x = -x_1^2 - x_2^2 xTAx=−x12−x22- ( x = [ 0 , 0 ] x = [0, 0] x=[0,0] ) 时,( x T A x = 0 x^T A x = 0 xTAx=0 )(最高点)。

- ( x = [ 1 , 0 ] x = [1, 0] x=[1,0] ) 时,( x T A x = − 1 x^T A x = -1 xTAx=−1 );( x = [ 0 , 2 ] x = [0, 2] x=[0,2] ) 时,( x T A x = − 4 x^T A x = -4 xTAx=−4 )。

- 这是一个碗口向下的抛物面,像倒扣的碗。

为什么正定对应“碗口向上”?

在统计和优化中,正定矩阵(如Fisher信息矩阵)常用来描述凸性:

- Fisher信息矩阵 ( I ( θ ) I(\theta) I(θ) ) 正定,表示负对数似然 ( − log p ( x ∣ θ ) -\log p(x|\theta) −logp(x∣θ) ) 在真实参数附近是“碗口向上”的凸函数,存在唯一的最优解。

- “曲率”是指碗的陡峭程度,正定保证曲率正向(向上弯曲),便于优化和估计。

反过来,负定矩阵可能对应最大值问题(如似然函数的最大化),形状是“碗口向下”。

后记

2025年2月25日12点24分于上海,在Grok 3大模型辅助下完成。

相关文章:

与负定(Negative Definite):从Fisher信息矩阵看“曲率”的秘密)

矩阵的 正定(Positive Definite)与负定(Negative Definite):从Fisher信息矩阵看“曲率”的秘密

矩阵的正定与负定:从Fisher信息矩阵看“曲率”的秘密 在数学和统计学中,矩阵的“正定性”和“负定性”是一对重要概念,尤其在优化、统计推断和机器学习中频繁出现。比如,Fisher信息矩阵(Fisher Information Matrix, F…...

被裁20240927 --- WSL-Ubuntu20.04安装cuda、cuDNN、tensorRT

cuda、cuDNN、tensorRT的使用场景 1. CUDA(Compute Unified Device Architecture) 作用: GPU 通用计算:CUDA 是 NVIDIA 的并行计算平台和编程模型,允许开发者直接利用 GPU 的并行计算能力,加速通用计算任…...

uniapp写的h5跳转小程序

使用场景: 我们对接第三方支付的时候,对方只提供了原生小程序id和appid,由我们的app和h5平台跳转至小程序。 遇到的问题: app跳转本地正常,线上报错如下 解决办法: 需要去微信开放平台申请应用appid 易…...

[SWPUCTF 2022 新生赛]ez_rce

打开题目就在线环境,发现只有一句话:真的什么都没有吗 F12查看控制台和源代码也没发现任何信息,然后用虚拟机里面的dirsearch扫一下这个网站就能得到: 然后这里扫出来的结果查看的直接就是robots.txt,然后就能看到: …...

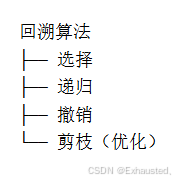

递归、搜索与回溯算法 —— 名词解析

目录 一、递归 1、什么是递归? 2、递归的数学类比 3、为什么要用到递归? 问题具有递归结构: 代码简洁易懂: 解决复杂问题: 处理嵌套结构: 4、如何理解递归? 明确基准条件: …...

【docker】docker swarm lock和unlock的区别,以及旧节点重启的隐患

docker swarm lock/unlock 的作用 Docker Swarm 提供了**加密集群状态(Encrypted Raft logs)**的功能,可以防止 Swarm 集群的管理数据(如任务分配、集群配置等)在磁盘上被未授权访问。 docker swarm lock:…...

Grafana使用日志5--如何重置Grafana密码

背景 有时候当账号太多的时候,根本记不住所有的账号密码,这时候就很容易登录失败,这时候怎么办呢? 接下来就让我来给大家演示一下Grafana的账号如果忘记了的话,该怎么找回自己的账号密码 操作 让我们来看一下具体的…...

ELK搭建初入

ELK搭建: 1、安装ElasticSearch (用于存储收集到的日志信息) 解压安装包 tar -xzvf elasticsearch-8.17.2-linux-x86_64.tar.gz 启动es:bin/elasticsearch –d(默认端口号9200) 浏览器输入es地址。出现…...

JVM 高级面试题及答案整理,最新面试题

JVM中的垃圾收集器有哪些,它们的工作原理是什么? JVM中的垃圾收集器主要包括以下几种: 1、 Serial收集器:它是一个单线程收集器,工作时会暂停所有其他工作线程("Stop-The-World")&a…...

)

第9章:LangChain结构化输出-示例5(基于大模型如何精确匹配POJO的字段)

如何使用LangChain4j框架创建和使用多种AI服务。它通过定义接口和注解,将自然语言处理任务(如情感分析、数字提取、日期提取、POJO提取等)封装为服务,并通过LangChain4j的AiServices动态生成这些服务的实现。 本章主要讲述基于LangChain调用大模型如何进行结构化输出的真实…...

ref和reactive的区别 Vue3

Vue3中ref和reactive的区别 ref 可以定义基本数据类型,也可定义对象类型的响应式数据 reactive 只能定义对象类型的响应式数据 ref和reactive定义对象类型的响应式数据有什么不同 不同点1 ref定义的响应式数据,取值时需要先 .value 不同点2 替换整…...

基于MATLAB的OFDM通信系统仿真设计

下面将为你详细介绍基于MATLAB的OFDM通信系统仿真设计的步骤和示例代码。 1. OFDM系统原理概述 正交频分复用(OFDM)是一种多载波调制技术,它将高速数据流通过串并转换,分配到多个正交的子载波上进行传输,这样可以有效…...

地铁站内导航系统:基于蓝牙Beacon与AR技术的动态路径规划技术深度剖析

本文旨在分享一套地铁站内导航系统技术方案,通过蓝牙Beacon技术与AI算法的结合,解决传统导航定位不准确、路径规划不合理等问题,提升乘客出行体验,同时为地铁运营商提供数据支持与增值服务。 如需获取校地铁站内智能导航系统方案文…...

JS复习练习题目、完整nodejs项目以及Commons、Es

### JS复习练习 -  1. 任务1:创建一个简单的问候函数 - 编写一个函数greet,接受一个名字作为参数,并返回一个问候语,例如:“Hello, [名字]! Welcome to Jav…...

Linux:理解O(1)调度算法的设计精髓

目录 一、从厨房看调度器本质 二、O(1)算法的核心架构 1.时间复杂度的革命 2.动态优先级魔法 三、算法运行的全景图 1.时间片分配策略 2.上下文切换的艺术 前言:前面文章提到关于并发的概念,并发针对的是单核的CPU上同时运行很多情况,…...

[C++][cmake]使用C++部署yolov12目标检测的tensorrt模型支持图片视频推理windows测试通过

最近悄悄出了yolov12框架,标志着目标检测又多了一个检测利器,于是尝试在windows下部署yolov12的tensorrt模型,并最终成功。 重要说明:安装环境视为最基础操作,博文不做环境具体步骤,可以百度查询对应安装步…...

Uppy - 免费开源、功能强大的新一代 web 文件上传组件,支持集成到 Vue 项目

Uppy 这个优质的前端组件,可以解决几乎所有的文件上传问题,最近发布了 TS 重写的 4.0 新版本,实用性更强了。 Uppy 是一个 UI 外观时尚、模块化的 JavaScript 文件上传组件,这个组件可以与任何 web 技术栈集成,不仅轻…...

【游戏——BFS+分层图】

题目 分析 但凡是最优方案可能需要访问同一个点的情况,都需要应用“拆点”,或者说分层图的技巧。多出来的维度主要是区分同一个点的不同状态而用。 对于本题,访问的时机便是一个区分点。 对于类似题“AB路线”,同一个K段的位置是…...

SSL 证书是 SSL 协议实现安全通信的必要组成部分

SSL证书和SSL/TLS协议有着密切的关系,但它们本质上是不同的概念。下面是两者的区别和它们之间的关系的表格: 属性SSL/TLS 协议SSL证书英文全称SSL(Secure Sockets Layer),TLS(Transport Layer Security&am…...

:Spring Boot 与 Spring Cloud 的微服务源码解析)

Spring 源码硬核解析系列专题(七):Spring Boot 与 Spring Cloud 的微服务源码解析

在前几期中,我们从 Spring 核心的 IoC、AOP、事务管理,到 Spring Boot 的自动装配,逐步揭示了 Spring 生态的底层原理。随着微服务架构的流行,Spring Boot 结合 Spring Cloud 成为了构建分布式系统的主流选择。本篇将深入 Spring Cloud 的核心组件,以服务注册与发现(Eure…...

Netrunner 23评测:日常办公、娱乐、游戏一把抓,这款Linux发行版表现如何?

Netrunner 23评测:一款适合日常办公、娱乐和游戏的Linux发行版,表现究竟如何?Netrunner是一款面向大众的Linux发行版,基于Debian,采用经过调整的KDE桌面环境。它或许拿不到设计奖项,但表现相当出色。KDE Pl…...

英雄联盟终极助手:如何用League Akari工具包提升游戏体验

英雄联盟终极助手:如何用League Akari工具包提升游戏体验 【免费下载链接】League-Toolkit An all-in-one toolkit for LeagueClient. Gathering power 🚀. 项目地址: https://gitcode.com/gh_mirrors/le/League-Toolkit League Akari是一款基于L…...

Prompt 到 Context 再到 Harness:AI 工程范式的三次跃迁

在大模型(LLM)应用爆发的这几年里,AI 开发范式经历了一条非常清晰的演进路径:Prompt Engineering → Context Engineering → Harness Engineering这并不是简单的“概念升级”,而是从交互技巧 → 系统工程 → 复杂系统…...

毫米波雷达DOA估计:从基础FFT到超分辨MUSIC,核心算法演进与实战选型指南

1. 毫米波雷达DOA估计基础入门 第一次接触毫米波雷达DOA估计时,我被各种专业术语搞得晕头转向。经过几个实际项目的打磨,我发现理解这个概念其实可以从一个生活场景开始:想象你在一个嘈杂的餐厅里,闭着眼睛也能判断出朋友在哪个方…...

数据结构--基于顺序表实现通讯录项目

欢迎阅读本篇学习笔记。 作为计算机专业的学习记录,本文将系统梳理通讯录项目的相关知识点,从基础概念到代码实现逐步展开,便于后续复习巩固,这里我们会用到上篇的知识,(如果其中有不懂的,大家可…...

Fast SAM C++推理部署实战:onnxruntime静态维度优化与性能调优

1. Fast SAM模型与onnxruntime部署基础 Fast SAM作为计算机视觉领域的高效分割模型,相比原版SAM模型实现了50倍的速度提升。这个提升主要来自两个关键设计:一是采用轻量化的CNN架构替代Transformer,二是仅使用SA-1B数据集的2%进行训练。在实际…...

嵌入式开发常识:电阻触摸屏与电容触摸屏的核心区别

摘要在嵌入式GUI开发中,触摸屏是人机交互的核心部件。电阻屏和电容屏各有优劣,选错方案可能导致项目失败。本文从工作原理、物理结构、用户体验、成本等维度深度剖析两者的区别,帮助开发者做出正确选择。一、引言做嵌入式开发的朋友一定遇到过…...

从AP到STA:深入解析ESP8266热点连接失败的排查与修复

1. 为什么你的ESP8266连不上热点? 刚拿到ESP8266开发板的新手,十有八九会在连接WiFi热点时栽跟头。明明代码照着教程一字不差,串口监视器却始终显示"Connecting to...",最后要么超时失败,要么卡在无限循环。…...

5分钟快速上手:MelonLoader Unity游戏模组加载器终极指南

5分钟快速上手:MelonLoader Unity游戏模组加载器终极指南 【免费下载链接】MelonLoader The Worlds First Universal Mod Loader for Unity Games compatible with both Il2Cpp and Mono 项目地址: https://gitcode.com/gh_mirrors/me/MelonLoader 你是否想为…...

茉莉花插件终极指南:5分钟掌握Zotero中文文献管理

茉莉花插件终极指南:5分钟掌握Zotero中文文献管理 【免费下载链接】jasminum A Zotero add-on to retrive CNKI meta data. 一个简单的Zotero 插件,用于识别中文元数据 项目地址: https://gitcode.com/gh_mirrors/ja/jasminum 茉莉花(Jasminum)插…...