Spark核心之02:RDD、算子分类、常用算子

spark内存计算框架

一、目标

- 深入理解RDD弹性分布式数据集底层原理

- 掌握RDD弹性分布式数据集的常用算子操作

二、要点

⭐️1. RDD是什么

- RDD(Resilient Distributed Dataset)叫做**弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变、可分区、里面的元素可并行计算**的集合.

- Dataset: 就是一个集合,存储很多数据.

- Distributed:它内部的元素进行了分布式存储,方便于后期进行分布式计算.

- Resilient: 表示弹性,rdd的数据是可以保存在内存或者是磁盘中.

⭐️2. RDD的五大属性

- (1)A list of partitions

- 一个分区(Partition)列表,数据集的基本组成单位。

这里表示一个rdd有很多分区,每一个分区内部是包含了该rdd的部分数据,

spark中任务是以task线程的方式运行, 一个分区就对应一个task线程。用户可以在创建RDD时指定RDD的分区个数,如果没有指定,那么就会采用默认值。val rdd=sparkContext.textFile("/words.txt")如果该文件的block块个数小于等于2,这里生产的RDD分区数就为2如果该文件的block块个数大于2,这里生产的RDD分区数就与block块个数保持一致- (2)A function for computing each split

- 一个计算每个分区的函数

Spark中RDD的计算是以分区为单位的,每个RDD都会实现compute计算函数以达到这个目的.

- (3)A list of dependencies on other RDDs

- 一个rdd会依赖于其他多个rdd

这里就涉及到rdd与rdd之间的依赖关系,spark任务的容错机制就是根据这个特性(血统)而来。- (4)Optionally, a Partitioner for key-value RDDs (e.g. to say that the RDD is hash-partitioned)

- 一个Partitioner,即RDD的分区函数(可选项)

当前Spark中实现了两种类型的分区函数,

一个是基于哈希的HashPartitioner,(key.hashcode % 分区数= 分区号)

另外一个是基于范围的RangePartitioner。

只有对于key-value的RDD,并且产生shuffle,才会有Partitioner,非key-value的RDD的Parititioner的值是None。

- (5)Optionally, a list of preferred locations to compute each split on (e.g. block locations for an HDFS file)

- 一个列表,存储每个Partition的优先位置(可选项)

这里涉及到数据的本地性,数据块位置最优。

spark任务在调度的时候会优先考虑存有数据的节点开启计算任务,减少数据的网络传输,提升计算效率。

3. 基于spark的单词统计程序剖析rdd的五大属性

-

需求

HDFS上有一个大小为300M的文件,通过spark实现文件单词统计,最后把结果数据保存到HDFS上 -

代码

sc.textFile("/words.txt").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).saveAsTextFile("/out") -

流程分析

4. RDD的创建方式

-

1、通过已经存在的scala集合去构建

val rdd1=sc.parallelize(List(1,2,3,4,5)) val rdd2=sc.parallelize(Array("hadoop","hive","spark")) val rdd3=sc.makeRDD(List(1,2,3,4)) -

2、加载外部的数据源去构建

val rdd1=sc.textFile("/words.txt") -

3、从已经存在的rdd进行转换生成一个新的rdd

val rdd2=rdd1.flatMap(_.split(" ")) val rdd3=rdd2.map((_,1))

⭐️5. RDD的算子分类

- 1、transformation(转换)

- 根据已经存在的rdd转换生成一个新的rdd, 它是延迟加载,它不会立即执行

- 例如

- map / flatMap / reduceByKey 等

- 2、action (动作)

- 它会真正触发任务的运行

- 将rdd的计算的结果数据返回给Driver端,或者是保存结果数据到外部存储介质中

- 例如

- collect / saveAsTextFile 等

- 它会真正触发任务的运行

6. RDD常见的算子操作说明

6.1 transformation算子

| 转换 | 含义 |

|---|---|

| map(func) | 返回一个新的RDD,该RDD由每一个输入元素经过func函数转换后组成 |

| filter(func) | 返回一个新的RDD,该RDD由经过func函数计算后返回值为true的输入元素组成 |

| flatMap(func) | 类似于map,但是每一个输入元素可以被映射为0或多个输出元素(所以func应该返回一个序列,而不是单一元素) |

| mapPartitions(func) | 类似于map,但独立地在RDD的每一个分片上运行,因此在类型为T的RDD上运行时,func的函数类型必须是Iterator[T] => Iterator[U] |

| mapPartitionsWithIndex(func) | 类似于mapPartitions,但func带有一个整数参数表示分片的索引值,因此在类型为T的RDD上运行时,func的函数类型必须是(Int, Interator[T]) => Iterator[U] |

| union(otherDataset) | 对源RDD和参数RDD求并集后返回一个新的RDD |

| intersection(otherDataset) | 对源RDD和参数RDD求交集后返回一个新的RDD |

| distinct([numTasks])) | 对源RDD进行去重后返回一个新的RDD |

| groupByKey([numTasks]) | 在一个(K,V)的RDD上调用,返回一个(K, Iterator[V])的RDD |

| reduceByKey(func, [numTasks]) | 在一个(K,V)的RDD上调用,返回一个(K,V)的RDD,使用指定的reduce函数,将相同key的值聚合到一起,与groupByKey类似,reduce任务的个数可以通过第二个可选的参数来设置 |

| sortByKey([ascending], [numTasks]) | 在一个(K,V)的RDD上调用,K必须实现Ordered接口,返回一个按照key进行排序的(K,V)的RDD |

| sortBy(func,[ascending], [numTasks]) | 与sortByKey类似,但是更灵活 |

| join(otherDataset, [numTasks]) | 在类型为(K,V)和(K,W)的RDD上调用,返回一个相同key对应的所有元素对在一起的(K,(V,W))的RDD |

| cogroup(otherDataset, [numTasks]) | 在类型为(K,V)和(K,W)的RDD上调用,返回一个(K,(Iterable,Iterable))类型的RDD |

| coalesce(numPartitions) | 减少 RDD 的分区数到指定值。 |

| repartition(numPartitions) | 重新给 RDD 分区 |

| repartitionAndSortWithinPartitions(partitioner) | 重新给 RDD 分区,并且每个分区内以记录的 key 排序 |

6.2 action算子

| 动作 | 含义 |

|---|---|

| reduce(func) | reduce将RDD中元素前两个传给输入函数,产生一个新的return值,新产生的return值与RDD中下一个元素(第三个元素)组成两个元素,再被传给输入函数,直到最后只有一个值为止。 |

| collect() | 在驱动程序中,以数组的形式返回数据集的所有元素 |

| count() | 返回RDD的元素个数 |

| first() | 返回RDD的第一个元素(类似于take(1)) |

| take(n) | 返回一个由数据集的前n个元素组成的数组 |

| takeOrdered(n, [ordering]) | 返回自然顺序或者自定义顺序的前 n 个元素 |

| saveAsTextFile(path) | 将数据集的元素以textfile的形式保存到HDFS文件系统或者其他支持的文件系统,对于每个元素,Spark将会调用toString方法,将它装换为文件中的文本 |

| saveAsSequenceFile(path) | 将数据集中的元素以Hadoop sequencefile的格式保存到指定的目录下,可以使HDFS或者其他Hadoop支持的文件系统。 |

| saveAsObjectFile(path) | 将数据集的元素,以 Java 序列化的方式保存到指定的目录下 |

| countByKey() | 针对(K,V)类型的RDD,返回一个(K,Int)的map,表示每一个key对应的元素个数。 |

| ⭐️foreach(func) | 在数据集的每一个元素上,运行函数func |

| ⭐️foreachPartition(func) | 在数据集的每一个分区上,运行函数func |

7. RDD常用的算子操作演示

-

为了方便前期的测试和学习,可以使用spark-shell进行演示

spark-shell --master local[2]

7.1 map(Trans转换算子)

**map(func)**返回一个新的RDD,该RDD由每一个输入元素经过func函数转换后组成

val rdd1 = sc.parallelize(List(5, 6, 4, 7, 3, 8, 2, 9, 1, 10))//把rdd1中每一个元素乘以10

rdd1.map(_*10).collect

7.2 filter(Trans转换算子)

**filter(func)**返回一个新的RDD,该RDD由经过func函数计算后返回值为true的输入元素组成

val rdd1 = sc.parallelize(List(5, 6, 4, 7, 3, 8, 2, 9, 1, 10))//把rdd1中大于5的元素进行过滤

rdd1.filter(x => x >5).collect

7.3 flatMap(Trans转换算子)

flatMap(func) 类似于map,但是每一个输入元素可以被映射为0或多个输出元素(所以func应该返回一个序列,而不是单一元素)

val rdd1 = sc.parallelize(Array("a b c", "d e f", "h i j"))

//获取rdd1中元素的每一个字母

rdd1.flatMap(_.split(" ")).collect

7.4 intersection、union(Trans转换算子)

union(otherDataset) 对源RDD和参数RDD求并集后返回一个新的RDD

intersection(otherDataset) 对源RDD和参数RDD求交集后返回一个新的RDD

val rdd1 = sc.parallelize(List(5, 6, 4, 3))

val rdd2 = sc.parallelize(List(1, 2, 3, 4))

//求交集

rdd1.intersection(rdd2).collect//求并集

rdd1.union(rdd2).collect

7.5 distinct(Trans转换算子)

distinct([numTasks])) 对源RDD进行去重后返回一个新的RDD

val rdd1 = sc.parallelize(List(1,1,2,3,3,4,5,6,7))

//去重

rdd1.distinct

7.6 join、groupByKey(Trans转换算子)

join(otherDataset, [numTasks]) 在类型为(K,V)和(K,W)的RDD上调用,返回一个相同key对应的所有元素对在一起的(K,(V,W))的RDD

groupByKey([numTasks]) 在一个(K,V)的RDD上调用,返回一个(K, Iterator[V])的RDD

val rdd1 = sc.parallelize(List(("tom", 1), ("jerry", 3), ("kitty", 2)))

val rdd2 = sc.parallelize(List(("jerry", 2), ("tom", 1), ("shuke", 2)))

//求join

val rdd3 = rdd1.join(rdd2)

rdd3.collect

//求并集

val rdd4 = rdd1 union rdd2

rdd4.groupByKey.collect

7.7 cogroup(Trans转换算子)

cogroup(otherDataset, [numTasks]) 在类型为(K,V)和(K,W)的RDD上调用,返回一个(K,(Iterable,Iterable))类型的RDD

collect() 在驱动程序中,以数组的形式返回数据集的所有元素

val rdd1 = sc.parallelize(List(("tom", 1), ("tom", 2), ("jerry", 3), ("kitty", 2)))

val rdd2 = sc.parallelize(List(("jerry", 2), ("tom", 1), ("jim", 2)))

//分组

val rdd3 = rdd1.cogroup(rdd2)

rdd3.collect

//

//res0: Array[(String, (Iterable[Int], Iterable[Int]))] =

//Array(

// (jim,(CompactBuffer(),CompactBuffer(2))),

// (tom,(CompactBuffer(1, 2),CompactBuffer(1))),

// (jerry,(CompactBuffer(3),CompactBuffer(2))),

// (kitty,(CompactBuffer(2),CompactBuffer()))

// )

7.8 reduce (Action动作算子)

reduce(func) reduce将RDD中元素前两个传给输入函数,产生一个新的return值,新产生的return值与RDD中下一个元素(第三个元素)组成两个元素,再被传给输入函数,直到最后只有一个值为止。

val rdd1 = sc.parallelize(List(1, 2, 3, 4, 5))//reduce聚合

val rdd2 = rdd1.reduce(_ + _)

rdd2.collectval rdd3 = sc.parallelize(List("1","2","3","4","5"))

rdd3.reduce(_+_)这里可能会出现多个不同的结果,由于元素在不同的分区中,每一个分区都是一个独立的task线程去运行。这些task运行有先后关系

7.9 reduceByKey、sortByKey(Trans转换算子)

groupByKey([numTasks]) 在一个(K,V)的RDD上调用,返回一个(K, Iterator[V])的RDD

reduceByKey(func, [numTasks]) 在一个(K,V)的RDD上调用,返回一个(K,V)的RDD,使用指定的reduce函数,将相同key的值聚合到一起,与groupByKey类似,reduce任务的个数可以通过第二个可选的参数来设置 ,不同于groupByKey(),reduceByKey会在map端join

sortByKey([ascending], [numTasks]) 在一个(K,V)的RDD上调用,K必须实现Ordered接口,返回一个按照key进行排序的(K,V)的RDD

val rdd1 = sc.parallelize(List(("tom", 1), ("jerry", 3), ("kitty", 2), ("shuke", 1)))

val rdd2 = sc.parallelize(List(("jerry", 2), ("tom", 3), ("shuke", 2), ("kitty", 5)))

val rdd3 = rdd1.union(rdd2)//按key进行聚合

val rdd4 = rdd3.reduceByKey(_ + _)

rdd4.collect//按value的降序排序

val rdd5 = rdd4.map(t => (t._2, t._1)).sortByKey(false).map(t => (t._2, t._1))

rdd5.collect

7.10 repartition、coalesce(Trans转换算子)

coalesce(numPartitions) 减少 RDD 的分区数到指定值,默认不会产生shuffle,传入true开启shuffle

repartition(numPartitions) 重新给 RDD 分区,会产生shuffle 相当于coalesce(numPatitions,true)**

val rdd1 = sc.parallelize(1 to 10,3)

//打印rdd1的分区数

rdd1.partitions.size//利用repartition改变rdd1分区数

//减少分区

rdd1.repartition(2).partitions.size//增加分区

rdd1.repartition(4).partitions.size//利用coalesce改变rdd1分区数

//减少分区

rdd1.coalesce(2).partitions.size//repartition: 重新分区, 有shuffle

//coalesce: 合并分区 / 减少分区 默认不shuffle

//默认 coalesce 不能扩大分区数量。除非添加true的参数,或者使用repartition。//适用场景://1、如果要shuffle,都用 repartition//2、不需要shuffle,仅仅是做分区的合并,coalesce//3、repartition常用于扩大分区。⭐️7.11 map、mapPartitions 、mapPartitionsWithIndex(Trans转换算子)

map(func) 返回一个新的RDD,该RDD由每一个输入元素经过func函数转换后组成

mapPartitions(func) 类似于map,但独立地在RDD的每一个分片上运行,因此在类型为T的RDD上运行时,func的函数类型必须是Iterator[T] => Iterator[U]

mapPartitionsWithIndex(func) 类似于mapPartitions,但func带有一个整数参数表示分片的索引值,因此在类型为T的RDD上运行时,func的函数类型必须是(Int, Interator[T]) => Iterator[U]

val rdd1=sc.parallelize(1 to 10,5)

rdd1.map(x => x*10)).collect

rdd1.mapPartitions(iter => iter.map(x=>x*10)).collect//index表示分区号 可以获取得到每一个元素属于哪一个分区

rdd1.mapPartitionsWithIndex((index,iter)=>iter.map(x=>(index,x)))map:用于遍历RDD,将函数f应用于每一个元素,返回新的RDD(transformation算子)。

mapPartitions:用于遍历操作RDD中的每一个分区,返回生成一个新的RDD(transformation算子)。总结:

如果在映射的过程中需要频繁创建额外的对象,使用mapPartitions要比map高效

比如,将RDD中的所有数据通过JDBC连接写入数据库,如果使用map函数,可能要为每一个元素都创建一个connection,这样开销很大,如果使用mapPartitions,那么只需要针对每一个分区建立一个connection。

⭐️7.12 foreach、foreachPartition (Action动作算子)

foreach(func) 在数据集的每一个元素上,运行函数func

foreachPartition(func) 在数据集的每一个分区上,运行函数func

val rdd1 = sc.parallelize(List(5, 6, 4, 7, 3, 8, 2, 9, 1, 10))//foreach实现对rdd1里的每一个元素乘10然后打印输出

rdd1.foreach(x=>println(x * 10))//foreachPartition实现对rdd1里的每一个元素乘10然后打印输出

rdd1.foreachPartition(iter => iter.foreach(x=>println(x * 10)))foreach:用于遍历RDD,将函数f应用于每一个元素,无返回值(action算子)。

foreachPartition: 用于遍历操作RDD中的每一个分区。无返回值(action算子)。总结:

一般使用mapPartitions或者foreachPartition算子比map和foreach更加高效,推荐使用。

相关文章:

Spark核心之02:RDD、算子分类、常用算子

spark内存计算框架 一、目标 深入理解RDD弹性分布式数据集底层原理掌握RDD弹性分布式数据集的常用算子操作 二、要点 ⭐️1. RDD是什么 RDD(Resilient Distributed Dataset)叫做**弹性分布式数据集,是Spark中最基本的数据抽象,…...

【Resis实战分析】Redis问题导致页面timeout知识点分析

事故现象:前端页面返回timeout 事故回溯总结一句话: (1)因为大KEY调用量,随着白天自然流量趋势增长而增长,最终在业务高峰最高点期占满带宽使用100%。   (2&#x…...

)

单一职责原则(设计模式)

目录 问题: 定义: 解决: 方式 1:使用策略模式 示例:用户管理 方式 2:使用装饰者模式 示例:用户操作 方式 3:使用责任链模式 示例:用户操作链 总结 推荐 问题&a…...

生理信号概念

rPPG 信号(远程光电容积脉搏波信号) 原理: 基于光电容积脉搏波描记法,利用普通摄像头,在一定距离外捕捉人体皮肤表面因心脏泵血导致的血液容积变化引起的细微颜色变化,通过图像处理和信号分析算法提取心率…...

安卓内存泄露之DMA-BUF异常增长:Android Studio镜像引起DMA内存泄露

安卓内存泄露之DMA-BUF异常增长:Android Studio镜像引起DMA内存泄露 - Wesley’s Blog 今天用着安卓 14 的板子的时候突然系统卡死。 查看日志发现launcher都被干掉了 03-04 06:13:35.544 7872 8479 I ActivityManager: vis BFGS 18740: com.android.launcher3 (pid 8407) se…...

android13打基础: 控件checkbox

测试checkbox的activity // todo: 高级控件checkbox public class Ch4_CheckBoxActivity extends AppCompatActivityimplements CompoundButton.OnCheckedChangeListener {Overrideprotected void onCreate(Nullable Bundle savedInstanceState) {super.onCreate(savedInstance…...

AI应用测试:遇到类ChatGPT的流式接口要如何压测?

先说结论: 使用最普遍的JMeter 就能支持类 OpenAI 的流式接口(如 ChatGPT 的流式聊天接口)的测试 总体设置 JMeter 支持测试 OpenAI 的流式接口,但需要额外配置(如启用 KeepAlive 和调整超时)。如果需要实时处理流式响应,使用 Regular Expression Extractor 或自定义脚…...

React面试葵花宝典之二

36.Fiber的更新机制 React Fiber 更新机制详解 React Fiber 是 React 16 引入的核心架构重构,旨在解决可中断渲染和优先级调度问题,提升复杂应用的流畅性。其核心思想是将渲染过程拆分为可控制的工作单元,实现更细粒度的任务管理。以下是其…...

在日常生活、工作中deepseek能帮我们解决哪些问题

在日常生活、工作中deepseek能帮我们解决哪些问题 DeepSeek极大降低了普通人使用AI的门槛,让AI快速渗透到人们的工作和生活中,无论是专业场景提效、教育学术赋能、商业创新甚至日常生活,都变得更加轻松。 当然这篇文章也参考了deepseek的回…...

【Java】IO流

Java IO流是Java中处理输入输出的核心机制,通过不同的流类型实现了对数据的高效读写。 一、IO流的分类 1. 按数据方向 输入流(Input Stream):从数据源(如文件、网络等)读取数据。输出流(Outp…...

HTML第三节

一.初识CSS 1.CSS定义 A.内部样式表 B.外部样式表 <!DOCTYPE html> <html lang"en"> <head><meta charset"UTF-8"><meta name"viewport" content"widthdevice-width, initial-scale1.0"><title&g…...

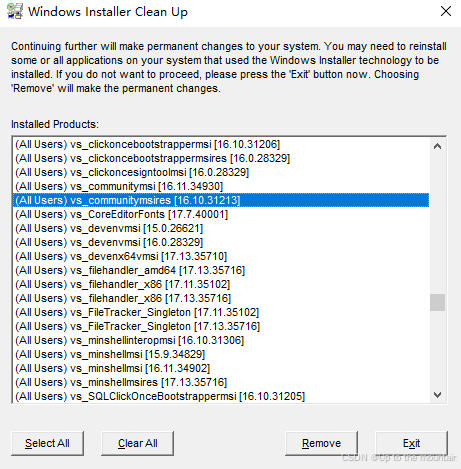

Visual Studio 2022安装问题解决,提示无法安装Microsoft.VisualStudio.Community.Msi

表现现象为:安装完后提示无法安装Microsoft.VisualStudio.Community.Msi,无法正常开发C项目 查看日志,大概显示: xxx ReturnCode1316 xxxxx 消息详细信息: 指定的帐户已存在。 试了网上所有的办法都没用,反复尝试&…...

【代码分享】基于IRM和RRT*的无人机路径规划方法详解与Matlab实现

基于IRM和RRT*的无人机路径规划方法详解与Matlab实现 1. IRM与RRT*的概述及优势 IRM(Influence Region Map)通过建模障碍物的影响区域,量化环境中的安全风险,为RRT算法提供启发式引导。RRT(Rapidly-exploring Random…...

MybatisPlus从入门到精通

一、MyBatis-Plus核心特性 无侵入性 在MyBatis基础上增强,无需修改原有代码即可使用。自动化CRUD 内置通用Mapper和Service,减少80%单表操作代码。Lambda表达式 支持Lambda形式的条件构造,避免字段名硬编码错误。主键策略 支持雪花算法&…...

el-table input textarea 文本域 自适应高度,切换分页滚动失效处理办法

场景: el-table 表格 需要 input类型是 textarea 高度是自适应,第一页数据都是单行数据 不会产生滚动条,但是第二页数据是多行数据 会产生滚动条, bug: 第一页切换到第二页 第二页滚动条无法展示 解决办法:直接修改样…...

基于Windows11的DockerDesktop安装和布署方法简介

基于Windows11的DockerDesktop安装和布署方法简介 一、下载安装Docker docker 下载地址 https://www.docker.com/ Download Docker Desktop 选择Download for Winodws AMD64下载Docker Desktop Installer.exe 双点击 Docker Desktop Installer.exe 进行安装 测试Docker安装是…...

ffmpeg源码编译支持cuda

1.安装cuda CUDA Toolkit 11.3 Downloads | NVIDIA Developer 在选择组件的时候,将CUDA中的Nsight VSE和Visual Studio Integration取消勾选 不然会安装失败 2.编译ffmpeg 把cuda编译宏定义开启,再编译avcodec 3.编译livavutil报错struct "Cuda…...

动漫短剧开发公司,短剧小程序搭建快速上线

在当今快节奏的生活里,人们的娱乐方式愈发多元,而动漫短剧作为新兴娱乐形式,正以独特魅力迅速崛起,成为娱乐市场的耀眼新星。近年来,动漫短剧市场呈爆发式增长,吸引众多创作者与观众目光。 从市场规模来看…...

《2025软件测试工程师面试》接口测试篇

基础概念 什么是接口测试? 接口测试是测试系统组件间接口的一种测试,主要用于检测外部系统和内部系统之间以及各个子系统之间的交互点。测试的重点是检查数据的交换、传递和控制管理的过程,以及系统间的相互逻辑依赖关系等。 接口测试的优势是什么? 接口测试具有规范性与扩…...

嵌入式学习第二十三天--网络及TCP

进程通信的方式: 同一主机 传统 system V 不同主机 网络 --- 解决不同主机间 的进程间通信 网络 (通信) //1.物理层面 --- 联通(通路) //卫星 2G 3G 4G 5G 星链 (千帆) //2.逻辑层面 --- 通路(软件) MAC os LINUX …...

谷歌报告:AI 加速云攻击,企业需自动化防御应对第三方漏洞与身份入侵

AI 加速攻击,云端企业成重灾区 2026 年 3 月,谷歌安全调查人员和工程师团队发布《云威胁展望报告》,基于 2025 年下半年的观察得出结论:AI 正助力攻击者以前所未有的速度利用漏洞,如今大多数云攻击目标是薄弱的第三方软…...

国产MCU生态构建与MM32系列选型开发实战解析

1. 项目概述:一场MCU生态的“集结号”2018年的那个秋天,对于国内嵌入式开发者,尤其是那些常年与ARM Cortex-M内核打交道的工程师们来说,记忆里应该有一场绕不开的盛会——灵动微电子举办的“2018灵动MM32协作大会”。这场大会的核…...

)

3ds Max离线帮助文档还能这么用?打造你的个人3D知识库(含效率翻倍技巧)

3ds Max离线帮助文档的进阶玩法:构建你的私有3D知识引擎 当大多数3D艺术家还在依赖零散的在线教程和碎片化笔记时,一小部分资深用户已经将3ds Max离线帮助文档改造成了私人定制的专业知识库。这不仅仅是一个本地化的文档集合,而是一个可以深度…...

了!用Celery的Canvas原语(Group/Chain/Chord)构建复杂异步工作流)

别再只会用delay()了!用Celery的Canvas原语(Group/Chain/Chord)构建复杂异步工作流

别再只会用delay()了!用Celery的Canvas原语构建复杂异步工作流 在异步任务处理领域,Celery早已成为Python生态中的标配工具。但令人惊讶的是,大多数开发者仅仅停留在task.delay()的基础用法上,就像只学会了加减法却从未接触过微积…...

彻底告别iPhone过热降频!thermalmonitordDisabler让你的设备性能满血释放

彻底告别iPhone过热降频!thermalmonitordDisabler让你的设备性能满血释放 【免费下载链接】thermalmonitordDisabler A tool used to disable iOS daemons. 项目地址: https://gitcode.com/gh_mirrors/th/thermalmonitordDisabler 你是否曾经在游戏激战中突然…...

系统辨识避坑指南:为什么你的最小二乘估计总是不准?从理论到MATLAB仿真的5个常见误区

系统辨识避坑指南:为什么你的最小二乘估计总是不准?从理论到MATLAB仿真的5个常见误区 在系统辨识的实际应用中,许多学习者和初级研发人员都会遇到一个共同的困惑:明明按照教科书上的步骤进行操作,为什么得到的结果却总…...

FreeRDP 终极指南:跨平台远程桌面完全解决方案

FreeRDP 终极指南:跨平台远程桌面完全解决方案 【免费下载链接】FreeRDP FreeRDP is a free remote desktop protocol library and clients 项目地址: https://gitcode.com/gh_mirrors/fr/FreeRDP FreeRDP 是一款功能强大的开源远程桌面协议实现库࿰…...

5步快速上手!罗技鼠标宏终极压枪教程:告别手残轻松吃鸡

5步快速上手!罗技鼠标宏终极压枪教程:告别手残轻松吃鸡 【免费下载链接】logitech-pubg PUBG no recoil script for Logitech gaming mouse / 绝地求生 罗技 鼠标宏 项目地址: https://gitcode.com/gh_mirrors/lo/logitech-pubg 还在为《绝地求生…...

GitHub中文插件终极指南:3分钟让英文GitHub变母语界面

GitHub中文插件终极指南:3分钟让英文GitHub变母语界面 【免费下载链接】github-chinese GitHub 汉化插件,GitHub 中文化界面。 (GitHub Translation To Chinese) 项目地址: https://gitcode.com/gh_mirrors/gi/github-chinese 还在为GitHub的英文…...

HT4182:5V 输入 1.6A 同步升压双节锂电充电器,高集成全保护可 P2P 替代

在便携式音箱、POS 机、电子烟、对讲机等采用双节串联锂电池供电的设备中,5V USB 输入升压充电是最主流的方案,市场对充电效率、集成度和可靠性的要求越来越高。HT4182 作为一款专为 5V 输入优化的同步升压型双节锂电池充电器,凭借高转换效率…...