扩散模型(三)

相关阅读:

-

扩散模型(一)

-

扩散模型(二)

Latent Variable Space

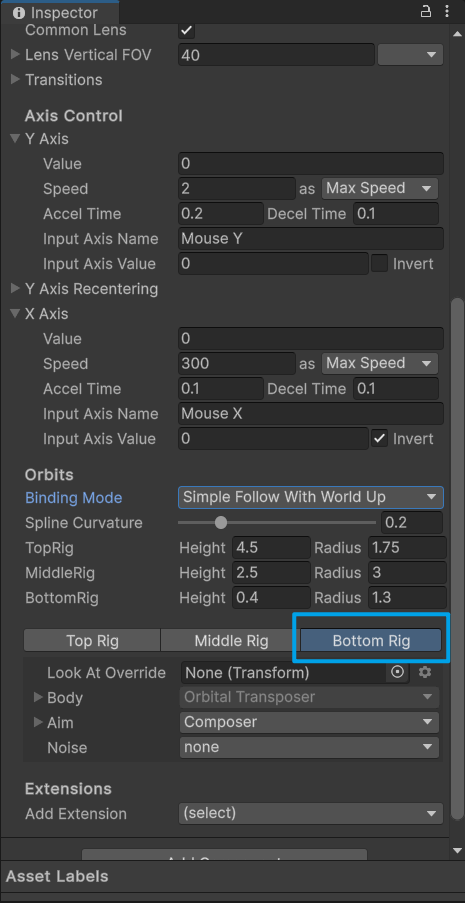

潜在扩散模型(LDM;龙巴赫、布拉特曼等人,2022 年)在潜在空间而非像素空间中运行扩散过程,这使得训练成本更低,推理速度更快。其背后的动机源于这样一个观察结果:图像的大部分信息仅关乎感知细节,而在经过大幅压缩后,语义和概念层面的构图依然保留。LDM 通过生成式建模学习,大致将感知压缩和语义压缩分离开来。首先,利用自动编码器去除像素级冗余,然后在学习到的潜在空间上,通过扩散过程操控 / 生成语义概念。

感知压缩过程依赖于一个自动编码器模型。编码器 E \mathcal{E} E 用于将输入图像 x ∈ R H × W × 3 \mathbf{x} \in \mathbb{R}^{H \times W \times 3} x∈RH×W×3 压缩为一个更小的二维潜在向量: z = E ( x ) ∈ R h × w × c \mathbf{z} = \mathcal{E}(\mathbf{x}) \in \mathbb{R}^{h \times w \times c} z=E(x)∈Rh×w×c,其中,下采样率 f = H / h = W / w = 2 m , m ∈ N f=H/h=W/w=2^m, m \in \mathbb{N} f=H/h=W/w=2m,m∈N。然后,解码器 D \mathcal{D} D 从潜在向量中重建图像,即 x ~ = D ( z ) \tilde{\mathbf{x}} = \mathcal{D}(\mathbf{z}) x~=D(z)。该论文在自动编码器训练中探索了两种正则化方法,以避免潜在空间中出现过高的方差。

- KL 正则化:对学习到的潜在变量施加一个朝向标准正态分布的小 KL 惩罚项,这与变分自编码器(VAE)类似。

- VQ 正则化:在解码器中使用向量量化层,类似于向量量化变分自编码器(VQVAE),但量化层被解码器吸收。

扩散和去噪过程发生在潜在向量 z \mathbf{z} z 上。去噪模型是一个时间条件 U 型网络,通过增加交叉注意力机制来处理图像生成中灵活的条件信息(例如类别标签、语义图、图像的模糊变体)。这种设计等同于通过交叉注意力机制将不同模态的表示融合到模型中。每种类型的条件信息都与一个特定领域的编码器 τ θ \tau_\theta τθ 配对,以将条件输入 y y y 投影到一个中间表示,该中间表示可以映射到交叉注意力组件中,即 τ θ ( y ) ∈ R M × d τ \tau_\theta(y) \in \mathbb{R}^{M \times d_\tau} τθ(y)∈RM×dτ:

Attention ( Q , K , V ) = softmax ( Q K ⊤ d ) ⋅ V where Q = W Q ( i ) ⋅ φ i ( z i ) , K = W K ( i ) ⋅ τ θ ( y ) , V = W V ( i ) ⋅ τ θ ( y ) and W Q ( i ) ∈ R d × d ϵ i , W K ( i ) , W V ( i ) ∈ R d × d τ , φ i ( z i ) ∈ R N × d ϵ i , τ θ ( y ) ∈ R M × d τ \begin{aligned} &\text{Attention}(\mathbf{Q}, \mathbf{K}, \mathbf{V}) = \text{softmax}\Big(\frac{\mathbf{Q}\mathbf{K}^\top}{\sqrt{d}}\Big) \cdot \mathbf{V} \\ &\text{where }\mathbf{Q} = \mathbf{W}^{(i)}_Q \cdot \varphi_i(\mathbf{z}_i),\; \mathbf{K} = \mathbf{W}^{(i)}_K \cdot \tau_\theta(y),\; \mathbf{V} = \mathbf{W}^{(i)}_V \cdot \tau_\theta(y) \\ &\text{and } \mathbf{W}^{(i)}_Q \in \mathbb{R}^{d \times d^i_\epsilon},\; \mathbf{W}^{(i)}_K, \mathbf{W}^{(i)}_V \in \mathbb{R}^{d \times d_\tau},\; \varphi_i(\mathbf{z}_i) \in \mathbb{R}^{N \times d^i_\epsilon},\; \tau_\theta(y) \in \mathbb{R}^{M \times d_\tau} \end{aligned} Attention(Q,K,V)=softmax(dQK⊤)⋅Vwhere Q=WQ(i)⋅φi(zi),K=WK(i)⋅τθ(y),V=WV(i)⋅τθ(y)and WQ(i)∈Rd×dϵi,WK(i),WV(i)∈Rd×dτ,φi(zi)∈RN×dϵi,τθ(y)∈RM×dτ

图 14:The architecture of the latent diffusion model (LDM).

Scale up Generation Resolution and Quality

为了生成高分辨率的高质量图像,霍等人(2021)提议采用由多个扩散模型组成的流水线,这些模型的分辨率逐步提高。流水线模型之间的噪声条件增强对于最终图像质量至关重要,具体做法是对每个超分辨率模型 p θ ( x ∣ z ) p_\theta(\mathbf{x} \vert \mathbf{z}) pθ(x∣z) 的条件输入 z \mathbf{z} z 应用强大的数据增强。条件噪声有助于减少流水线设置中的复合误差。在用于高分辨率图像生成的扩散建模中,U 型网络是模型架构的常见选择。

图 15:A cascaded pipeline of multiple diffusion models at increasing resolutions.

他们发现,最有效的噪声应用方式是在低分辨率时使用高斯噪声,在高分辨率时使用高斯模糊。此外,他们还探索了两种条件增强形式,这些形式只需对训练过程进行小幅修改。需注意的是,条件噪声仅在训练时应用,推理时不使用。

- 截断式条件增强会在低分辨率时,于步骤 t > 0 t > 0 t>0 提前终止扩散过程。

- 非截断式条件增强会在低分辨率时运行完整的反向扩散过程直至步骤 0,然后通过 z t ∼ q ( x t ∣ x 0 ) \mathbf{z}_t \sim q(\mathbf{x}_t \vert \mathbf{x}_0) zt∼q(xt∣x0) 对其进行破坏,再将被破坏的 z t \mathbf{z}_t zt 输入到超分辨率模型中。

两阶段扩散模型 unCLIP(拉梅什等人,2022 年)大量利用 CLIP 文本编码器来高质量地生成文本引导的图像。给定一个预训练的 CLIP 模型 c c c 以及扩散模型的配对训练数据 ( x , y ) (\mathbf{x}, y) (x,y),其中 x x x 是一幅图像, y y y 是相应的图像说明,我们可以分别计算 CLIP 文本嵌入和图像嵌入,即 c t ( y ) \mathbf{c}^t(y) ct(y) 和 c i ( x ) \mathbf{c}^i(\mathbf{x}) ci(x) 。unCLIP 并行学习两个模型:

- 一个先验模型 P ( c i ∣ y ) P(\mathbf{c}^i \vert y) P(ci∣y):给定文本 y y y 时,输出 CLIP 图像嵌入 c i \mathbf{c}^i ci。

- 一个解码器 P ( x ∣ c i , [ y ] ) P(\mathbf{x} \vert \mathbf{c}^i, [y]) P(x∣ci,[y]):给定 CLIP 图像嵌入 c i \mathbf{c}^i ci 以及(可选的)原始文本 y y y 时,生成图像 x \mathbf{x} x。

这两个模型能够实现条件生成,原因是

P ( x ∣ y ) = P ( x , c i ∣ y ) ⏟ c i is deterministic given x = P ( x ∣ c i , y ) P ( c i ∣ y ) \underbrace{P(\mathbf{x} \vert y) = P(\mathbf{x}, \mathbf{c}^i \vert y)}_{\mathbf{c}^i\text{ is deterministic given }\mathbf{x}} = P(\mathbf{x} \vert \mathbf{c}^i, y)P(\mathbf{c}^i \vert y) ci is deterministic given x P(x∣y)=P(x,ci∣y)=P(x∣ci,y)P(ci∣y)

- 图 :The architecture of unCLIP

unCLIP 遵循两阶段图像生成过程:

-

- 给定一段文本 y y y,首先使用 CLIP 模型生成文本嵌入 c t ( y ) \mathbf{c}^t(y) ct(y)。利用 CLIP 潜在空间能够通过文本实现零样本图像操控。

-

- 一个扩散或自回归先验 P ( c i ∣ y ) P(\mathbf{c}^i \vert y) P(ci∣y) 对这个 CLIP 文本嵌入进行处理,构建一个图像先验,然后一个扩散解码器 P ( x ∣ c i , y ) P(\mathbf{x} \vert \mathbf{c}^i, y) P(x∣ci,y) 根据该先验生成一幅图像。这个解码器还能以一幅图像作为输入条件,生成图像变体,同时保留其风格和语义。

与 unCLIP 使用 CLIP 模型不同,Imagen(萨哈里亚等人,2022 年)使用预训练的大型语言模型(即固定的 T5-XXL 文本编码器)对用于图像生成的文本进行编码。总体趋势是,模型规模越大,图像质量和文本与图像的对齐度越高。他们发现,T5 - XXL 和 CLIP 文本编码器在 MS-COCO 数据集上表现相近,但在 DrawBench(涵盖 11 个类别的提示词集合)上,人工评估更倾向于 T5-XXL。

在应用无分类器引导时,增加某个参数(此处你未提及具体参数)可能会使文本与图像的对齐度提高,但图像保真度下降。他们发现这是由于训练 - 测试不匹配导致的,也就是说,因为训练数据 x \mathbf{x} x 处于某个范围 [ − 1 , 1 ] [-1, 1] [−1,1] 内,测试数据也应该在这个范围内。为此引入了两种阈值策略:

- 静态阈值处理:将预测值 x \mathbf{x} x 裁剪到 [ − 1 , 1 ] [-1, 1] [−1,1]。

- 动态阈值处理:在每个采样步骤中,将计算 s s s 为某个百分比的绝对像素值;如果 s > 1 s > 1 s>1,将预测值裁剪到 [ − s , s ] [-s, s] [−s,s] 并除以 s s s。

Imagen 对 U-Net 的一些设计进行了修改,以构建高效的 U-Net。

- 参数调整:通过为较低分辨率添加更多残差连接,将模型参数从高分辨率模块转移到低分辨率模块。

- 跳跃连接缩放:按比例 1 / 2 1/\sqrt{2} 1/2缩放跳跃连接。

- 操作顺序调整:颠倒下采样(将其移到卷积之前)和上采样操作(将其移到卷积之后)的顺序,以提高前向传播的速度。

他们发现,噪声条件增强、动态阈值处理和高效 U-Net 对图像质量至关重要,但扩展文本编码器的大小比扩展 U-Net 的大小更为重要。

Model Architecture

扩散模型有两种常见的骨干网络架构选择:U-Net 和 Transformer。

U-Net(罗内贝格等人,2015 年)由一个下采样堆栈和一个上采样堆栈组成。

- 下采样:每一步都重复应用两个 3×3 卷积(无填充卷积),每个卷积之后接一个 ReLU 激活函数和一个步长为 2 的 2×2 最大池化层。在每个下采样步骤中,特征通道的数量翻倍。

- 上采样:每一步都先对特征图进行上采样,然后接一个 2×2 卷积,每一步都会使特征通道的数量减半。

- 捷径连接(Shortcuts):捷径连接将下采样堆栈中相应层的特征进行拼接,为上采样过程提供必要的高分辨率特征。

为了实现基于诸如 Canny 边缘、霍夫线、用户涂鸦、人体骨骼、分割图、深度和法线等额外图像信息进行图像合成,ControlNet(张等人,2023 年)对架构进行了改动。具体做法是在 U-Net 的每个编码器层中添加 “夹心” 式零卷积层,这些零卷积层使用原始模型权重的可训练副本。确切地说,对于一个神经网络模块 F θ ( . ) \mathcal{F}_\theta(.) Fθ(.),ControlNet 执行以下操作:

- 首先,冻结原始模块的原始参数 θ \theta θ。

- 将其克隆为一个具有可训练参数 θ c \theta_c θc 以及一个额外条件向量 c \mathbf{c} c 的副本。

- 使用两个零卷积层,分别记为 Z θ z 1 ( . ; . ) \mathcal{Z}_{\theta_{z1}}(.;.) Zθz1(.;.) 和 Z θ z 2 ( . ; . ) \mathcal{Z}_{\theta_{z2}}(.;.) Zθz2(.;.),这两个层是 1×1 卷积层,权重和偏置都初始化为零,用于连接这两个模块。零卷积层在初始训练步骤中通过消除作为梯度的随机噪声来保护主干网络。

图:The ControlNet architecture.

最终输出为: y c = F θ ( x ) + Z θ z 2 ( F θ c ( x + Z θ z 1 ( c ) ) ) \mathbf{y}_c = \mathcal{F}_\theta(\mathbf{x}) + \mathcal{Z}_{\theta_{z2}}(\mathcal{F}_{\theta_c}(\mathbf{x} + \mathcal{Z}_{\theta_{z1}}(\mathbf{c}))) yc=Fθ(x)+Zθz2(Fθc(x+Zθz1(c)))

用于扩散建模的扩散变换器(DiT;皮布尔斯和谢,2023 年)在潜在图像块上进行操作,采用与潜在扩散模型(LDM)相同的设计空间。DiT 具有以下设置:

-

- 将输入 z \mathbf{z} z 的潜在表示作为 DiT 的输入。

-

- 将大小为 I × I × C I \times I \times C I×I×C 的噪声潜在表示分割成大小为 p p p 的图像块,并将其转换为大小为 ( I / p ) 2 (I/p)^2 (I/p)2 的图像块序列。

-

- 然后,这个标记序列通过变换器模块。他们探索了三种不同的设计,以确定如何根据诸如时间步 t t t 或类别标签 c c c 等上下文信息进行生成。在这三种设计中,adaLN(自适应层归一化)-Zero 的效果最佳,优于上下文条件和交叉注意力模块。缩放和平移参数 γ \gamma γ 和 β \beta β 由 t t t 和 c c c 的嵌入向量之和回归得到。维度缩放参数 α \alpha α 同样通过回归得到,并在 DiT 模块内的任何残差连接之前立即应用。

-

- 变换器解码器输出噪声预测和输出对角协方差预测。

变换器架构易于扩展,这一点广为人知。根据实验,这是 DiT 的最大优势之一,因为其性能随着计算量的增加而提升,并且更大的 DiT 模型计算效率更高。

图:The Diffusion Transformer (DiT) architecture.

参考:

What are Diffusion Models?

Weng, Lilian. (Jul 2021). What are diffusion models? Lil’Log. https://lilianweng.github.io/posts/2021-07-11-diffusion-models/.

References

[1] Jascha Sohl-Dickstein et al. “Deep Unsupervised Learning using Nonequilibrium Thermodynamics.” ICML 2015.

[2] Max Welling & Yee Whye Teh. “Bayesian learning via stochastic gradient langevin dynamics.” ICML 2011.

[3] Yang Song & Stefano Ermon. “Generative modeling by estimating gradients of the data distribution.” NeurIPS 2019.

[4] Yang Song & Stefano Ermon. “Improved techniques for training score-based generative models.” NeuriPS 2020.

[5] Jonathan Ho et al. “Denoising diffusion probabilistic models.” arxiv Preprint arxiv:2006.11239 (2020). [code]

[6] Jiaming Song et al. “Denoising diffusion implicit models.” arxiv Preprint arxiv:2010.02502 (2020). [code]

[7] Alex Nichol & Prafulla Dhariwal. “Improved denoising diffusion probabilistic models” arxiv Preprint arxiv:2102.09672 (2021). [code]

[8] Prafula Dhariwal & Alex Nichol. “Diffusion Models Beat GANs on Image Synthesis.” arxiv Preprint arxiv:2105.05233 (2021). [code]

[9] Jonathan Ho & Tim Salimans. “Classifier-Free Diffusion Guidance.” NeurIPS 2021 Workshop on Deep Generative Models and Downstream Applications.

[10] Yang Song, et al. “Score-Based Generative Modeling through Stochastic Differential Equations.” ICLR 2021.

[11] Alex Nichol, Prafulla Dhariwal & Aditya Ramesh, et al. “GLIDE: Towards Photorealistic Image Generation and Editing with Text-Guided Diffusion Models.” ICML 2022.

[12] Jonathan Ho, et al. “Cascaded diffusion models for high fidelity image generation.” J. Mach. Learn. Res. 23 (2022): 47-1.

[13] Aditya Ramesh et al. “Hierarchical Text-Conditional Image Generation with CLIP Latents.” arxiv Preprint arxiv:2204.06125 (2022).

[14] Chitwan Saharia & William Chan, et al. “Photorealistic Text-to-Image Diffusion Models with Deep Language Understanding.” arxiv Preprint arxiv:2205.11487 (2022).

[15] Rombach & Blattmann, et al. “High-Resolution Image Synthesis with Latent Diffusion Models.” CVPR 2022.code

[16] Song et al. “Consistency Models” arxiv Preprint arxiv:2303.01469 (2023)

[17] Salimans & Ho. “Progressive Distillation for Fast Sampling of Diffusion Models” ICLR 2022.

[18] Ronneberger, et al. “U-Net: Convolutional Networks for Biomedical Image Segmentation” MICCAI 2015.

[19] Peebles & Xie. “Scalable diffusion models with transformers.” ICCV 2023.

[20] Zhang et al. “Adding Conditional Control to Text-to-Image Diffusion Models.” arxiv Preprint arxiv:2302.05543 (2023).

相关文章:

扩散模型(三)

相关阅读: 扩散模型(一) 扩散模型(二) Latent Variable Space 潜在扩散模型(LDM;龙巴赫、布拉特曼等人,2022 年)在潜在空间而非像素空间中运行扩散过程,这…...

it基础使用--5---git远程仓库

it基础使用–5—git远程仓库 1. 按顺序看 -git基础使用–1–版本控制的基本概念 -git基础使用–2–gti的基本概念 -git基础使用–3—安装和基本使用 -git基础使用–4—git分支和使用 2. 什么是远程仓库 在第一篇文章中,我们已经讲过了远程仓库,每个本…...

Baklib如何改变内容管理平台的未来推动创新与效率提升

内容概要 在信息爆炸的时代,内容管理平台成为了企业和个人不可或缺的工具。它通过高效组织、存储和发布内容,帮助用户有效地管理信息流。随着技术的发展,传统的内容管理平台逐渐暴露出灵活性不足、易用性差等局限性,这促使市场需…...

的计算方法及其在投资组合管理中的应用,并说明其局限性)

100.1 AI量化面试题:解释夏普比率(Sharpe Ratio)的计算方法及其在投资组合管理中的应用,并说明其局限性

目录 0. 承前1. 夏普比率的基本概念1.1 定义与计算方法1.2 实际计算示例 2. 在投资组合管理中的应用2.1 投资组合选择2.2 投资组合优化 3. 夏普比率的局限性3.1 统计假设的限制3.2 实践中的问题 4. 改进方案4.1 替代指标4.2 实践建议 5. 回答话术 0. 承前 如果想更加全面清晰地…...

;)

Ubuntu 下 nginx-1.24.0 源码分析 ngx_debug_init();

目录 ngx_debug_init() 函数: NGX_LINUX 的定义: ngx_debug_init() 函数: ngx_debug_init() 函数定义在 src\os\unix 目录下的 ngx_linux_config.h 中 #define ngx_debug_init() 也就是说这个环境下的 main 函数中的 ngx_debug_init() 这…...

基于人脸识别的课堂考勤系统

该项目是一个基于人脸识别的课堂考勤系统,使用Python开发,结合了多种技术实现考勤功能。要开发类似的基于人脸识别的考勤系统,可参考以下步骤: 环境搭建:利用Anaconda创建虚拟环境,指定Python版本为3.8&am…...

开启 AI 学习之旅:从入门到精通

最近 AI 真的超火,不管是工作还是生活里,到处都能看到它的身影。好多小伙伴都跑来问我,到底该怎么学 AI 呢?今天我就把自己学习 AI 的经验和心得分享出来,希望能帮到想踏入 AI 领域的朋友们! 一、学习内容有哪些 (一)编程语言 Python 绝对是首选!它在 AI 领域的生态…...

)

13 尺寸结构模块(size.rs)

一、size.rs源码 // Copyright 2013 The Servo Project Developers. See the COPYRIGHT // file at the top-level directory of this distribution. // // Licensed under the Apache License, Version 2.0 <LICENSE-APACHE or // http://www.apache.org/licenses/LICENSE…...

16.[前端开发]Day16-HTML+CSS阶段练习(网易云音乐五)

完整代码 网易云-main-left-rank(排行榜) <!DOCTYPE html> <html lang"en"> <head><meta charset"UTF-8"><meta http-equiv"X-UA-Compatible" content"IEedge"><meta name&q…...

ARM嵌入式学习--第十天(UART)

--UART介绍 UART(Universal Asynchonous Receiver and Transmitter)通用异步接收器,是一种通用串行数据总线,用于异步通信。该总线双向通信,可以实现全双工传输和接收。在嵌入式设计中,UART用来与PC进行通信,包括与监控…...

)

MoonBit 编译器(留档学习)

MoonBit 编译器 MoonBit 是一个用户友好,构建快,产出质量高的编程语言。 MoonBit | Documentation | Tour | Core This is the source code repository for MoonBit, a programming language that is user-friendly, builds fast, and produces high q…...

【TypeScript】基础:数据类型

文章目录 TypeScript一、简介二、类型声明三、数据类型anyunknownnervervoidobjecttupleenumType一些特殊情况 TypeScript 是JavaScript的超集,代码量比JavaScript复杂、繁多;但是结构更清晰 一、简介 为什么需要TypeScript? JavaScript的…...

Unity游戏(Assault空对地打击)开发(3) 摄像机的控制

详细步骤 打开My Assets或者Package Manager。 选择Unity Registry。 搜索Cinemachine,找到 Cinemachine包,点击 Install按钮进行安装。 关闭窗口,新建一个FreeLook Camera,如下。 接着新建一个对象Pos,拖到Player下面…...

【HarmonyOS之旅】基于ArkTS开发(三) -> 兼容JS的类Web开发(三)

目录 1 -> 生命周期 1.1 -> 应用生命周期 1.2 -> 页面生命周期 2 -> 资源限定与访问 2.1 -> 资源限定词 2.2 -> 资源限定词的命名要求 2.3 -> 限定词与设备状态的匹配规则 2.4 -> 引用JS模块内resources资源 3 -> 多语言支持 3.1 -> 定…...

小程序-基础加强-自定义组件

前言 这次讲自定义组件 1. 准备今天要用到的项目 2. 初步创建并使用自定义组件 这样就成功在home中引入了test组件 在json中引用了这个组件才能用这个组件 现在我们来实现全局引用组件 在app.json这样使用就可以了 3. 自定义组件的样式 发现页面里面的文本和组件里面的文…...

尝试ai生成figma设计

当听到用ai 自动生成figma设计时,不免好奇这个是如何实现的。在查阅了不少资料后,有了一些想法。参考了:在figma上使用脚本自动生成色谱 这篇文章提供的主要思路是:可以通过脚本的方式构建figma设计。如果我们使用ai 生成figma脚本…...

【周易哲学】生辰八字入门讲解(八)

😊你好,我是小航,一个正在变秃、变强的文艺倾年。 🔔本文讲解【周易哲学】生辰八字入门讲解,期待与你一同探索、学习、进步,一起卷起来叭! 目录 一、六亲女命六亲星六亲宫位相互关系 男命六亲星…...

康德哲学与自组织思想的渊源:从《判断力批判》到系统论的桥梁

康德哲学与自组织思想的渊源:从《判断力批判》到系统论的桥梁 第一节:康德哲学中的自然目的论与自组织思想 核心内容: 康德哲学中的自然目的论和反思判断力概念,为现代系统论中的自组织思想提供了哲学基础,预见了复…...

解决whisper 本地运行时GPU 利用率不高的问题

我在windows 环境下本地运行whisper 模型,使用的是nivdia RTX4070 显卡,结果发现GPU 的利用率只有2% 。使用 import torch print(torch.cuda.is_available()) 返回TRUE。表示我的cuda 是可用的。 最后在github 的下列网页上找到了问题 极低的 GPU 利…...

【自开发工具介绍】SQLSERVER的ImpDp和ExpDp工具02

工具运行前的环境准备 1、登录用户管理员权限确认 工具使用的登录用户(-u后面的用户),必须具有管理员的权限,因为需要读取系统表 例:Export.bat -s 10.48.111.12 -d db1 -u test -p test -schema dbo 2、Powershell的安全策略确认…...

java异常处理——try catch finally

单个异常处理 1.当try里的代码发生了catch里指定类型的异常之后,才会执行catch里的代码,程序正常执行到结尾 2.如果try里的代码发生了非catch指定类型的异常,则会强制停止程序,报错 3.finally修饰的代码一定会执行,除…...

【人工智能】使用Python和Hugging Face构建情感分析应用:从模型训练到Web部署

《Python OpenCV从菜鸟到高手》带你进入图像处理与计算机视觉的大门! 解锁Python编程的无限可能:《奇妙的Python》带你漫游代码世界 情感分析是自然语言处理(NLP)中的重要任务,它通过分析文本来判断情绪或观点的倾向性。近年来,预训练语言模型如BERT、GPT等在情感分析任…...

DeepSeek-R1:通过强化学习激励大型语言模型(LLMs)的推理能力

摘要 我们推出了第一代推理模型:DeepSeek-R1-Zero和DeepSeek-R1。DeepSeek-R1-Zero是一个未经监督微调(SFT)作为初步步骤,而是通过大规模强化学习(RL)训练的模型,展现出卓越的推理能力。通过强…...

算法随笔_37: 交替合并字符串

上一篇:算法随笔_36: 复写零-CSDN博客 题目描述如下: 给你两个字符串 word1 和 word2 。请你从 word1 开始,通过交替添加字母来合并字符串。如果一个字符串比另一个字符串长,就将多出来的字母追加到合并后字符串的末尾。 返回 合并后的字符串 。 示例…...

低成本、高附加值,具有较强的可扩展性和流通便利性的行业

目录 虚拟资源类 1. 网课教程 2. 设计素材 3. 软件工具 服务类 1. 写作服务 2. 咨询顾问 3. 在线教育 4. 社交媒体管理 虚拟资源类 1. 网课教程 特点:高附加值,可复制性强,市场需求大。 执行流程: 选择领域:…...

vue入门到实战 二

目录 2.1 计算属性computed 2.1.1什么是计算属性 2.1.2 只有getter方法的计算属性 2.1.3 定义有getter和setter方法的计算属性 2.1.4 计算属性和methods的对比 2.2 监听器属性watch 2.2.1 watch属性的用法 2.2.2 computed属性和watch属性的对比 2.1 计算属性computed…...

基于FPGA的BT1120编解码

BT1120与BT656 类似 BT1120与BT656同类属于一个视频协议,两者无论从组成、协议、同步码以及传输过程都是十分相似: 1、两者都是以F(场)、V(帧)、H(消隐)、D(有效)来区分数据的内容。 2、两者的传输数据都采用一样的方式,即内同步传输数据。 3、两者都传输的数据都是…...

二叉树-堆(补充)

二叉树-堆 1.二叉树的基本特性2.堆2.1.堆的基本概念2.2.堆的实现2.2.1.基本结构2.2.2.堆的初始化2.2.3.堆的销毁2.2.4.堆的插入2.2.5.取出堆顶的数据2.2.6.堆的删除2.2.7.堆的判空2.2.8.堆的数据个数2.2.9.交换2.2.10.打印堆数据2.2.11.堆的创建2.2.12.堆排序2.2.13.完整代码 3…...

基于springboot私房菜定制上门服务系统设计与实现(源码+数据库+文档)

私房菜定制上门服务系统目录 目录 基于springbootvue私房菜定制上门服务系统设计与实现 一、前言 二、系统功能设计 三、系统实现 1、管理员功能实现 (1)菜品管理 (2)公告管理 (3) 厨师管理 2、用…...

2025开源DouyinLiveRecorder全平台直播间录制工具整合包,多直播同时录制、教学直播录制、教学视频推送、简单易用不占内存

一、DouyinLiveRecorder软件介绍(文末提供下载) 官方地址:GitHub - ihmily/DouyinLiveRecorder 本文信息来源于作者GitHub地址 一款简易的可循环值守的直播录制工具,基于FFmpeg实现多平台直播源录制,支持自定义配置录制…...