kafka配置SASL_PLAINTEXT简单认证

Kafka + ZooKeeper 开启 SASL_PLAINTEXT 认证(PLAIN机制)最全实战教程

💡 本教程将手把手教你如何为 Kafka 配置基于 SASL_PLAINTEXT + PLAIN 的用户名密码认证机制,包含 Kafka 与 ZooKeeper 的全部配置,适合入门。

🎯 教程目标

- Kafka 客户端连接 Kafka Broker 时需要用户名密码验证;

- Kafka 与 ZooKeeper 之间通信也启用 SASL 认证;

- 使用

PLAIN机制,无需 TLS/SSL 证书(比 SASL_SSL 简单); - 可用于本地开发环境或非安全生产环境。

🛠 环境准备

- Kafka:3.6.0

- ZooKeeper:3.6+

- Java 8+

- 操作系统:Linux / WSL / Mac / Windows(推荐用 WSL)

- 镜像:

zookeeperbitnami_zookeeper:3.8.4

kafkabitnami/kafka:3.6.0

1️⃣ 配置 ZooKeeper 认证(Server端)

配置环境变量

env:- name: TZvalue: Asia/Shanghai- name: ALLOW_ANONYMOUS_LOGINvalue: 'no'- name: JVMFLAGSvalue: '-Xmx1g'- name: ZOO_ENABLE_AUTHvalue: 'yes'- name: ZOO_SERVER_USERSvalue: kafka- name: ZOO_SERVER_PASSWORDSvalue: zookeeper@2025- name: ZOO_SERVERSvalue: 'zk-cluster-auth-0.zk-cluster-auth-headless:2888:3888,zk-cluster-auth-1.zk-cluster-auth-headless:2888:3888,zk-cluster-auth-2.zk-cluster-auth-headless:2888:3888'

| 配置项 | 说明 |

|---|---|

TZ=Asia/Shanghai | 设置容器的时区为中国标准时间(CST/UTC+8),方便日志与系统时间保持一致。 |

ALLOW_ANONYMOUS_LOGIN=no | 禁用匿名连接 ZooKeeper,必须通过用户名密码认证。建议生产环境使用。 |

JVMFLAGS='-Xmx1g' | 配置 ZooKeeper JVM 最大内存为 1GB,防止 OOM(默认可能太小)。 |

ZOO_ENABLE_AUTH=yes | 启用 ZooKeeper 身份认证(基于 SASL 的认证机制,如 PLAIN)。必须配合下面的用户密码使用。 |

ZOO_SERVER_USERS=kafka | 设置 ZooKeeper 允许的用户名,多个用户用逗号分隔。这里是 kafka。 |

ZOO_SERVER_PASSWORDS=zookeeper@2025 | 对应上面的用户的密码。如果多个用户,用逗号一一对应写。 |

服务配置

kind: Service

apiVersion: v1

metadata:name: zk-cluster-auth-headlessnamespace: zhubayi-commonlabels:app: kafka-cluster-authannotations:kubesphere.io/alias-name: zk-cluster-authkubesphere.io/creator: adminkubesphere.io/serviceType: statefulservice

spec:ports:- name: clientprotocol: TCPport: 2181targetPort: 2181- name: serverprotocol: TCPport: 2888targetPort: 2888- name: leader-selectprotocol: TCPport: 3888targetPort: 3888- name: adminserverprotocol: TCPport: 8080targetPort: 8080selector:app: zk-cluster-authclusterIP: NoneclusterIPs:- Nonetype: ClusterIPsessionAffinity: NoneipFamilies:- IPv4ipFamilyPolicy: SingleStackinternalTrafficPolicy: Cluster启动脚本

command:- sh- '-c'- >export ZOO_SERVER_ID=$((${HOSTNAME##*-}+1))exec /opt/bitnami/scripts/zookeeper/entrypoint.sh/opt/bitnami/scripts/zookeeper/run.sh

2️⃣ 配置 Kafka(Broker端)

🧩 设置环境变量

env:# 设置容器的时区- name: TZvalue: Asia/Shanghai# 🔗 Kafka 连接的 ZooKeeper 地址(推荐使用 headless 服务)- name: KAFKA_CFG_ZOOKEEPER_CONNECTvalue: 'zk-cluster-auth-headless:2181'# Kafka 内存配置(JVM堆大小)- name: KAFKA_HEAP_OPTSvalue: '-Xmx2g'# offsets topic 的副本数(建议 >=3)- name: KAFKA_CFG_OFFSETS_TOPIC_REPLICATION_FACTORvalue: '3'# 每个 topic 的默认分区数- name: KAFKA_CFG_NUM_PARTITIONSvalue: '5'# Kafka 日志保留时间(单位小时)- name: KAFKA_CFG_LOG_RETENTION_HOURSvalue: '72' # 3天# Kafka 日志切分时间(单位小时)- name: KAFKA_CFG_LOG_ROLL_HOURSvalue: '72'# 单个 segment 的最大大小(1GB)- name: KAFKA_CFG_LOG_SEGMENT_BYTESvalue: '1073741824'# 是否允许自动创建 topic(开发环境可开启)- name: KAFKA_CFG_AUTO_CREATE_TOPICS_ENABLEvalue: 'true'# 允许删除 topic- name: KAFKA_CFG_DELETE_TOPIC_ENABLEvalue: 'true'# 是否允许自动进行 leader 重新平衡(建议关闭以避免扰动)- name: KAFKA_CFG_AUTO_LEADER_REBALANCE_ENABLEvalue: 'false'# Kafka 清理策略(delete / compact)- name: KAFKA_CFG_LOG_CLEANUP_POLICYvalue: delete# 单条消息最大大小(5MB)- name: KAFKA_CFG_MESSAGE_MAX_BYTESvalue: '5242880'# 客户端请求最大大小(4MB)- name: KAFKA_CFG_MAX_REQUEST_SIZEvalue: '4194304'# 批处理大小(生产者用)- name: KAFKA_CFG_BATCH_SIZEvalue: '16384'# 允许使用 PLAINTEXT 明文监听器(非加密,仅适合内网测试)- name: ALLOW_PLAINTEXT_LISTENERvalue: 'true'# broker 间通信监听器名称(INSIDE 表示内网)- name: KAFKA_INTER_BROKER_LISTENER_NAMEvalue: INSIDE# 监听器与协议映射(INSIDE 和 OUTSIDE 都启用 SASL_PLAINTEXT)- name: KAFKA_LISTENER_SECURITY_PROTOCOL_MAPvalue: 'INSIDE:SASL_PLAINTEXT,OUTSIDE:SASL_PLAINTEXT'# 是否允许客户端连接时自动创建 topic- name: KAFKA_AUTO_CREATE_TOPICS_ENABLEvalue: 'true'# 与 SSL 无关,可忽略(如果未使用 TLS)- name: KAFKA_SSL_CLIENT_AUTHvalue: required# Kafka 控制器使用的认证机制(SASL PLAIN)- name: KAFKA_CFG_SASL_MECHANISM_CONTROLLER_PROTOCOLvalue: PLAIN# broker 间通信使用的认证机制(SASL PLAIN)- name: KAFKA_CFG_SASL_MECHANISM_INTER_BROKER_PROTOCOLvalue: PLAIN# SSL 类型(使用 Java KeyStore 格式)(此配置无效,可忽略,未启用 SSL)- name: KAFKA_TLS_TYPEvalue: JKS# 指定 broker 之间用哪个监听器通信(重复定义,建议只保留一次)- name: KAFKA_CFG_INTER_BROKER_LISTENER_NAMEvalue: SASL_PLAINTEXT# 客户端连接使用的监听器(与上面保持一致)- name: KAFKA_CLIENT_LISTENER_NAMEvalue: SASL_PLAINTEXT# Controller 用户名(用于 Kafka 内部通信)- name: KAFKA_CONTROLLER_USERvalue: kafka# Controller 用户密码- name: KAFKA_CONTROLLER_PASSWORDvalue: 123456# Broker 间通信用户名- name: KAFKA_INTER_BROKER_USERvalue: kafka# Broker 间通信密码- name: KAFKA_INTER_BROKER_PASSWORDvalue: 123456# 允许的客户端用户名(支持多个,逗号分隔)- name: KAFKA_CLIENT_USERSvalue: kafka# 客户端密码(顺序与用户一致)- name: KAFKA_CLIENT_PASSWORDSvalue: 123456# 与 ZooKeeper 通信时使用的认证协议(SASL 必须设置)- name: KAFKA_ZOOKEEPER_PROTOCOLvalue: SASL# Kafka 访问 ZooKeeper 时使用的用户名- name: KAFKA_ZOOKEEPER_USERvalue: kafka# Kafka 访问 ZooKeeper 时使用的密码(需与 ZooKeeper 中配置一致)- name: KAFKA_ZOOKEEPER_PASSWORDvalue: zookeeper@2025启动脚本

command:- sh- '-c'- >POD_NAME=$(hostname)echo "POD_NAME:$POD_NAME"REPLICA_INDEX=$(echo $POD_NAME | sed 's/.*-\([0-9]\)$/\1/')echo "REPLICA_INDEX:$REPLICA_INDEX"export KAFKA_CFG_NODE_ID=${POD_NAME##*-}export KAFKA_NODE_ID="$REPLICA_INDEX"PORT=$((REPLICA_INDEX + 30900)) PORT2=$((REPLICA_INDEX + 9093))exportKAFKA_CFG_ADVERTISED_LISTENERS="INSIDE://:9092,OUTSIDE://192.168.1.5:$PORT"export KAFKA_CFG_LISTENERS="INSIDE://:9092,OUTSIDE://:$PORT2"exec /opt/bitnami/scripts/kafka/entrypoint.sh/opt/bitnami/scripts/kafka/run.sh

服务端口配置

spec:ports:- name: tcp-9092protocol: TCPport: 9093targetPort: 9093nodePort: 30900- name: tcp-9093protocol: TCPport: 9094targetPort: 9094nodePort: 30901- name: tcp-9094protocol: TCPport: 9095targetPort: 9095nodePort: 30902

3️⃣ Kafka 客户端配置(示例)

配置文件

spring:kafka:bootstrap-servers: 192.168.1.5:30900 # Kafka 集群地址(多个可逗号分隔)listener:ack-mode: MANUAL_IMMEDIATE # 手动提交 offset(立即确认)consumer:custom-environment: dev # 自定义字段,可用于多环境区分,无实际作用auto-offset-reset: latest # 无 offset 时从最新消息开始消费(避免重复)enable-auto-commit: false # 禁用自动提交,改为手动提交 offset# auto-commit-interval: 2000 # 如果启用自动提交,间隔为 2 秒(此处已注释)key-deserializer: org.apache.kafka.common.serialization.StringDeserializer # key 反序列化方式value-deserializer: org.apache.kafka.common.serialization.StringDeserializer # value 反序列化方式max-poll-records: 50 # 每次 poll 最多拉取 50 条记录max-poll-interval-ms: 600000 # poll 最大间隔 10 分钟producer:retries: 0 # 不重试(生产失败直接报错)batch-size: 16384 # 批量发送最大字节数(默认 16KB)buffer-memory: 33554432 # 发送缓冲区大小(默认 32MB)key-serializer: org.apache.kafka.common.serialization.StringSerializer # key 序列化value-serializer: org.apache.kafka.common.serialization.StringSerializer # value 序列化ssl:trust-store-location: # ⚠ 这里为空,因使用 SASL_PLAINTEXT(非 SSL),可留空或移除trust-store-password:properties:sasl:mechanism: PLAIN # 使用 SASL PLAIN 机制(用户名密码)jaas:config: >-org.apache.kafka.common.security.scram.ScramLoginModule requiredusername="kafka"password="123456";# JAAS 配置:用户名密码认证(注意 password 后有分号)security:protocol: SASL_PLAINTEXT # 使用 SASL_PLAINTEXT 传输协议(非加密)ssl:endpoint:identification:algorithm: "" # 空表示跳过主机名校验(SSL 时才生效,非必须)🚨 注意事项

| 配置项 | 注意点 |

|---|---|

SASL_PLAINTEXT | 明文传输用户名密码,不建议用于公网 |

ScramLoginModule | 表示服务端配置的是 SCRAM(非 PLAIN)时使用,若是 PLAIN,应为 PlainLoginModule |

trust-store-location | 可删除或忽略(仅用于 SASL_SSL 或 SSL 场景) |

bootstrap-servers | 建议配置多个 broker IP,提升可靠性 |

ack-mode: MANUAL_IMMEDIATE | 消费者业务失败时不会提交 offset,可重复消费 |

生产者配置

@Configuration

public class KafkaConfig {@Value("${spring.kafka.bootstrap-servers}")private String bootstrapServers;@Value("${spring.kafka.consumer.auto-offset-reset}")private String autoOffsetReset;@Value("${spring.kafka.consumer.enable-auto-commit}")private String enableAutoCommit;@Value("${spring.kafka.consumer.max-poll-records}")private String maxPollRecords;@Value("${spring.kafka.consumer.max-poll-interval-ms}")private String maxPollIntervalMs;@Value("${spring.profiles.active}")private String activeProfile;@Value("${spring.kafka.properties.security.protocol:SASL_SSL}")private String securityProtocol;@Value("${spring.kafka.properties.sasl.mechanism:PLAIN}")private String salsMechanism;@Value("${spring.kafka.properties.ssl.endpoint.identification.algorithm: \"\"}")private String identificationAlgorithm;@Value("${spring.kafka.properties.sasl.jaas.config: org.apache.kafka.common.security.plain.PlainLoginModule required username=\"kafka\" password=\"123456\";}")private String jaasConfig;@Value("${spring.kafka.ssl.trust-store-password: \"\"}")private String trustStorePassword;@Value("${spring.kafka.ssl.trust-store-location: \"\"}")private String trustStoreLocation;@Beanpublic ConsumerFactory<String, String> daConsumerConfigFactory() {Map<String, Object> props = new HashMap<>();props.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, bootstrapServers);props.put(ConsumerConfig.GROUP_ID_CONFIG, KafkaConsumerComponent.DAGROUP);props.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class);props.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class);props.put(ConsumerConfig.MAX_POLL_RECORDS_CONFIG, maxPollRecords);props.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, autoOffsetReset);props.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, enableAutoCommit);props.put(ConsumerConfig.MAX_POLL_INTERVAL_MS_CONFIG, maxPollIntervalMs);props.put("security.protocol", securityProtocol);props.put("sasl.mechanism", salsMechanism);props.put("ssl.endpoint.identification.algorithm", identificationAlgorithm);props.put("consumer.ssl.endpoint.identification.algorithm", identificationAlgorithm);props.put("sasl.jaas.config", jaasConfig);return new DefaultKafkaConsumerFactory<>(props);}@Beanpublic ConcurrentKafkaListenerContainerFactory<String, String> daConsumerFactory() {ConcurrentKafkaListenerContainerFactory<String, String> factory = new ConcurrentKafkaListenerContainerFactory<>();factory.setConsumerFactory(daConsumerConfigFactory());factory.setBatchListener(true); // 启用批量消费factory.getContainerProperties().setAckMode(ContainerProperties.AckMode.MANUAL_IMMEDIATE);return factory;}

}🚨 常见问题排查

| 错误 | 可能原因 |

|---|---|

No principal | 未正确配置 JAAS 文件或 KAFKA_OPTS 未设置 |

SaslAuthenticationException | 用户名密码不匹配 |

Connection refused | listener 或端口未正确绑定 |

Cluster ID 不匹配 | ZooKeeper 路径配置错误或 meta.properties 被复用 |

✅ 总结

| 项目 | 配置方式 |

|---|---|

| ZooKeeper 启用鉴权 | zookeeper_jaas.conf + zoo.cfg |

| Kafka 启用鉴权 | kafka_server_jaas.conf + server.properties |

| 客户端连接 Kafka | kafka_client_jaas.conf |

📎 参考资料

- 官方文档:https://kafka.apache.org/documentation/

- Kafka 安全机制:https://kafka.apache.org/documentation/#security_sasl

相关文章:

kafka配置SASL_PLAINTEXT简单认证

Kafka ZooKeeper 开启 SASL_PLAINTEXT 认证(PLAIN机制)最全实战教程 💡 本教程将手把手教你如何为 Kafka 配置基于 SASL_PLAINTEXT PLAIN 的用户名密码认证机制,包含 Kafka 与 ZooKeeper 的全部配置,适合入门。 &…...

PostgreSQL简单使用

一、PostgreSQL概念 特点 开源与自由 标准符合性 数据类型丰富 事务与并发 扩展性 安全性 优势 高性能 高可用性 灵活性 社区支持 成本效益 PostgreSQL结构 多层逻辑结构 第一层:实例(xxx.xxx.xxx.xxx…...

【Spring Boot】配置实战指南:Properties与YML的深度对比与最佳实践

目录 1.前言 2.正文 2.1配置文件的格式 2.2properties 2.2.1基础语法 2.2.2value读取配置文件 2.2.3缺点 2.3yml 2.3.1基础语法 2.3.2配置不同数据类型 2.3.3配置读取 2.3.4配置对象和集合 2.3.5优缺点 2.4综合练习:验证码案例 2.4.1分析需求 2.4.2…...

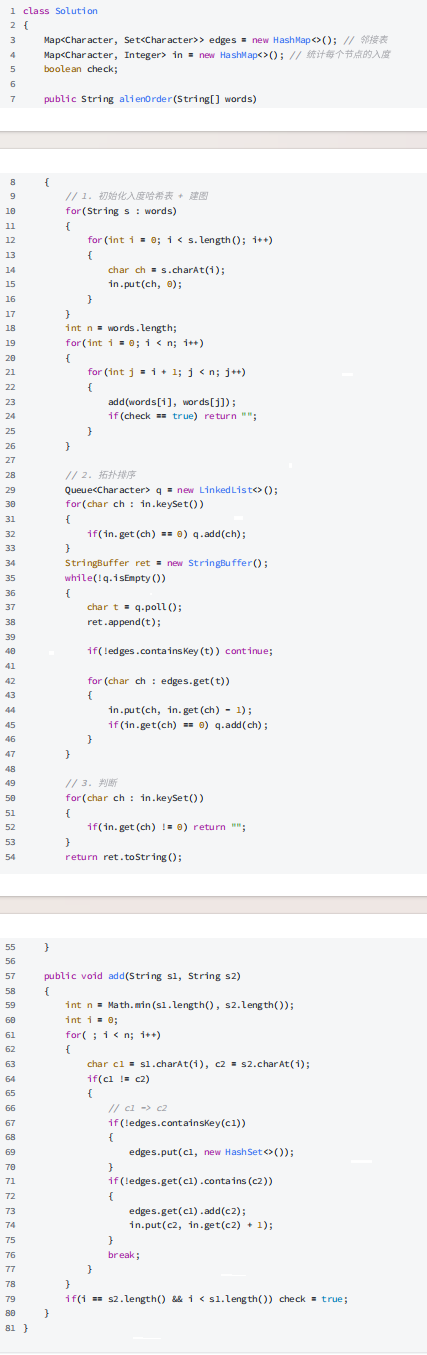

算法优选系列(9.BFS 解决拓扑排序)

目录 拓扑排序简介: 编辑 课程表(medium): 课程表II(medium): 火星词典(hard): 拓扑排序简介: 有向无环图(DAG图) 如上图每条边…...

Java 17/18/19 新特性面试题)

(1)Java 17/18/19 新特性面试题

Java 17/18/19 新特性面试题 🚀 掌握前沿技术,成为顶尖 Java 工程师 1️⃣ Java 17/18/19 新特性价值点 👉 点击展开题目 Java 17/18/19新特性中,你认为最有价值的是哪些?请结合实际场景说明 密封类(Sealed Classes…...

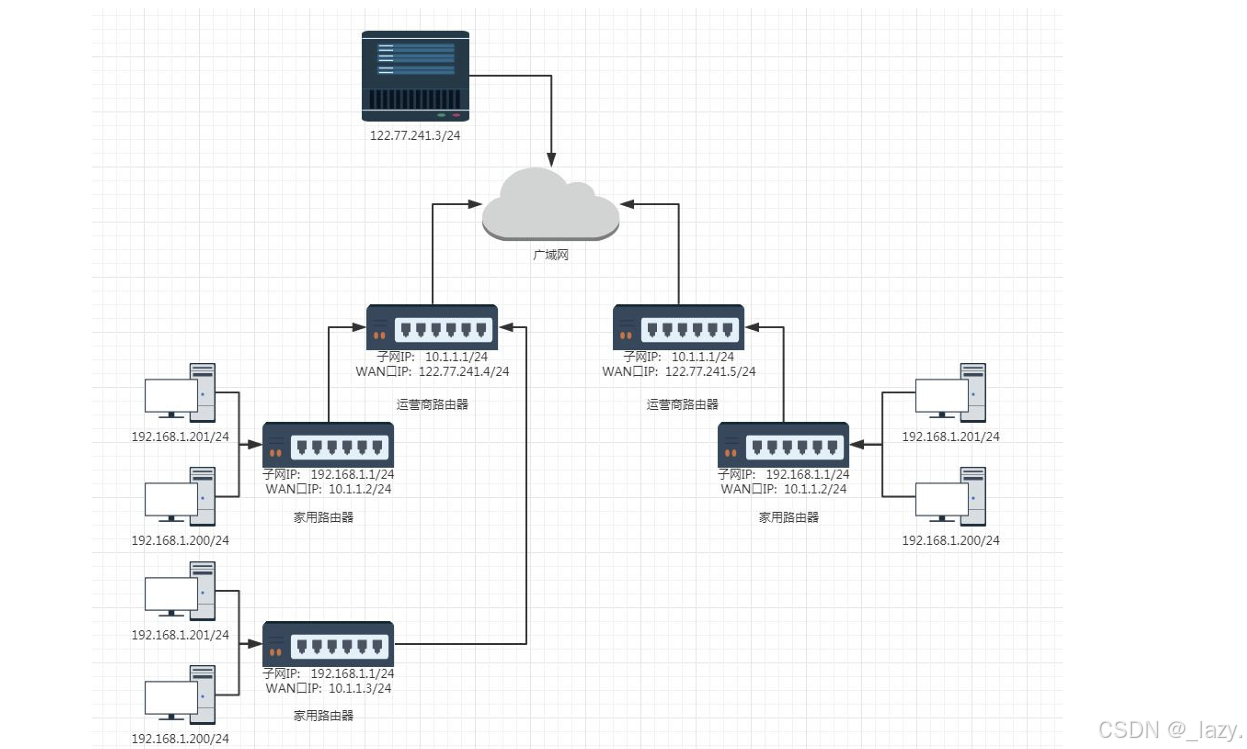

和WAN(广域网))

LAN(局域网)和WAN(广域网)

你的问题非常清晰!我来用一个直观的比喻实际拓扑图帮你彻底理解LAN(局域网)和WAN(广域网)如何协同工作,以及路由器在其中的位置。你可以把整个网络想象成一座城市: 1. 比喻:城市交通…...

【Java高阶面经:微服务篇】7. 1秒响应保障:超时控制如何成为高并发系统的“救火队长”?

一、全链路超时建模:从用户需求到系统分解 1.1 端到端时间预算分配 黄金公式: 用户期望响应时间 = 网络传输时间 + 服务处理时间 + 下游调用时间 + 缓冲时间典型分配策略(以1秒目标为例): 环节时间预算优化目标客户端渲染100ms骨架屏(Skeleton)预渲染边缘节点(CDN)…...

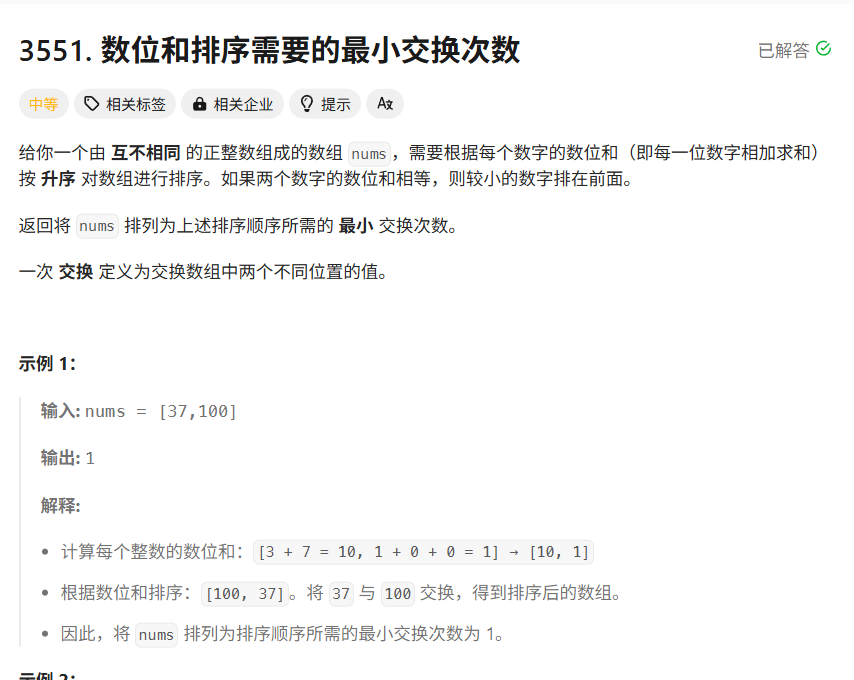

力扣周赛置换环的应用,最少交换次数

置换环的基本概念 置换环是排列组合中的一个概念,用于描述数组元素的重排过程。当我们需要将一个数组转换为另一个数组时,可以把这个转换过程分解为若干个 “环”。每个环代表一组元素的循环交换路径。 举个简单例子 假设原数组 A [3, 2, 1, 4]&…...

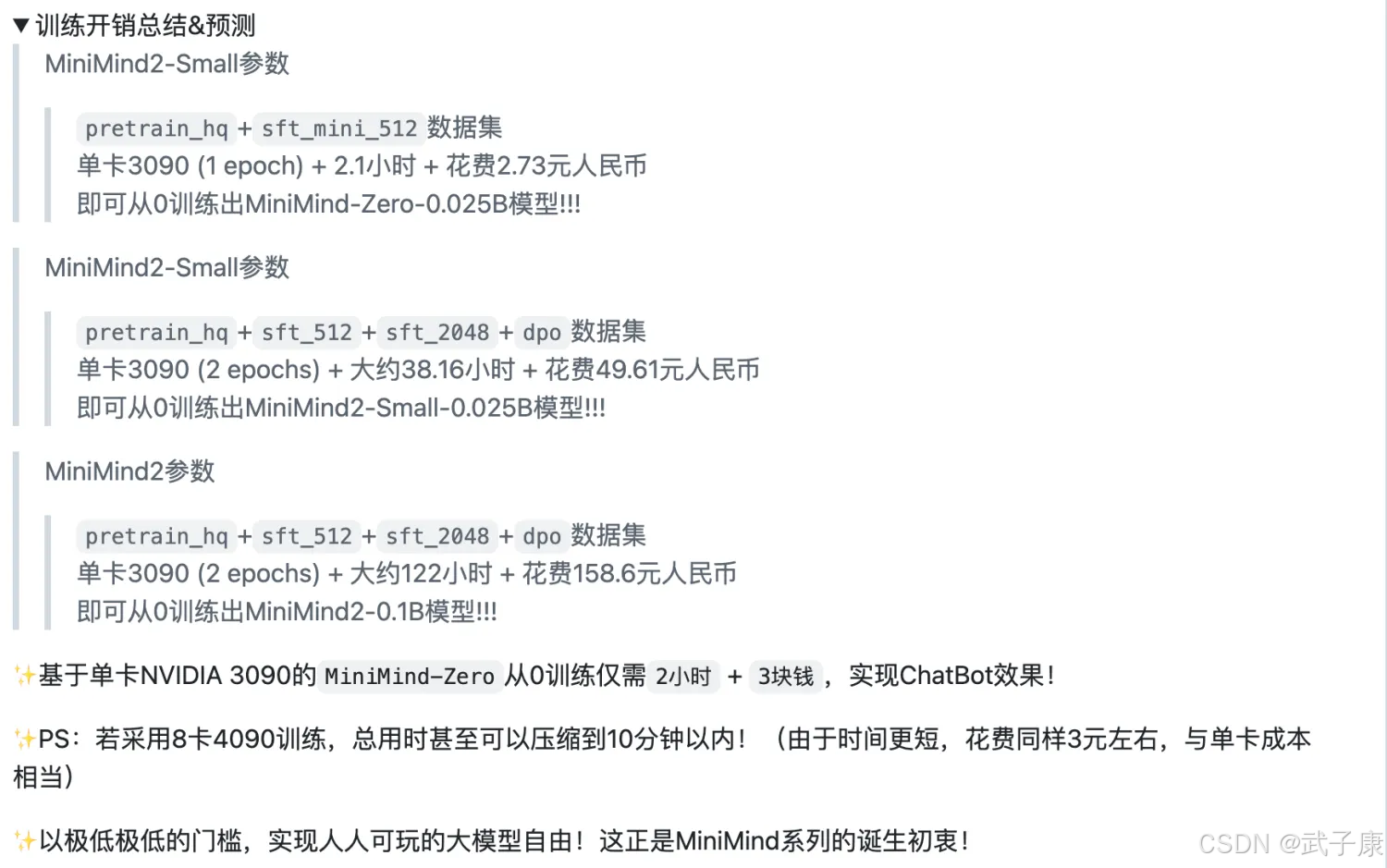

大语言模型 12 - 从0开始训练GPT 0.25B参数量 MiniMind2 补充 训练开销 训练步骤 知识蒸馏 LoRA等

写在前面 GPT(Generative Pre-trained Transformer)是目前最广泛应用的大语言模型架构之一,其强大的自然语言理解与生成能力背后,是一个庞大而精细的训练流程。本文将从宏观到微观,系统讲解GPT的训练过程,…...

hgdbv9创建plpython3u插件后无法使用该插件创建函数

文章目录 环境症状问题原因解决方案 环境 系统平台:银河麒麟 (X86_64) 版本:9.0 症状 此问题在如下版本和安装环境出现: 安装包: hgdb-ee-9.0.1.000-build2401091440-28098d3-linux.x86_64.binOS版本&…...

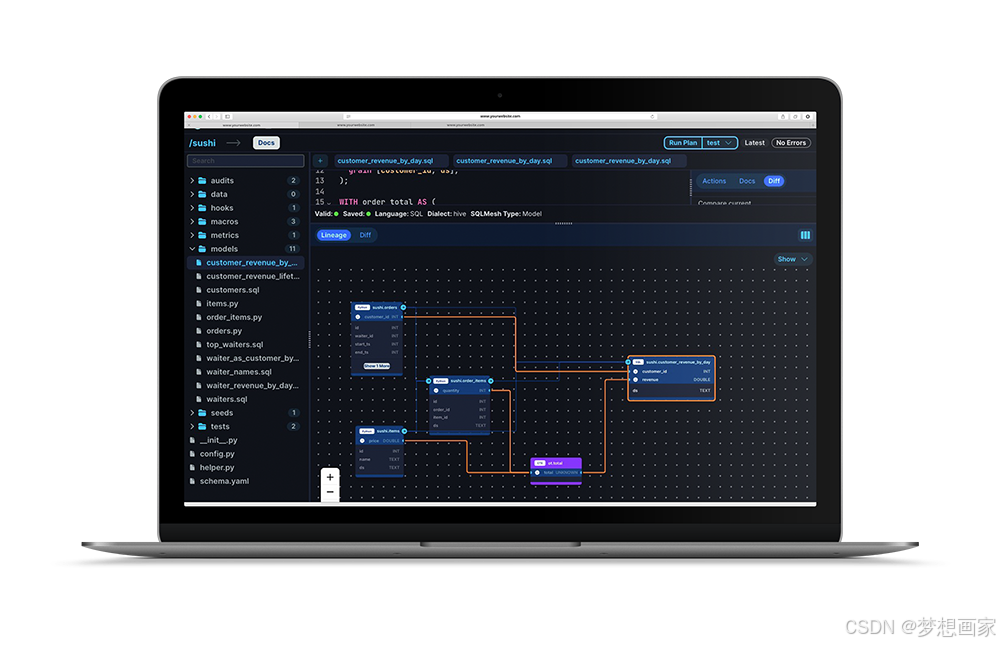

SQLMesh 宏操作符详解:@IF 的条件逻辑与高级应用

SQLMesh 的 IF 宏提供了一种在 SQL 查询中嵌入条件逻辑的方法,允许根据运行时条件动态调整查询结构。本文深入探讨 IF 的语法、使用场景及实际案例,帮助开发者构建更灵活、可维护的 SQL 工作流。 1. IF 宏简介 IF 是 SQLMesh 提供的条件逻辑宏ÿ…...

nt!MiRemovePageByColor函数分析之脱链和刷新颜色表

第0部分:背景 PFN_NUMBER FASTCALL MiRemoveZeroPage ( IN ULONG Color ) { ASSERT (Color < MmSecondaryColors); Page FreePagesByColor[Color].Flink; if (Page ! MM_EMPTY_LIST) { // // Remove the first entry on the zeroe…...

【爬虫】12306自动化购票

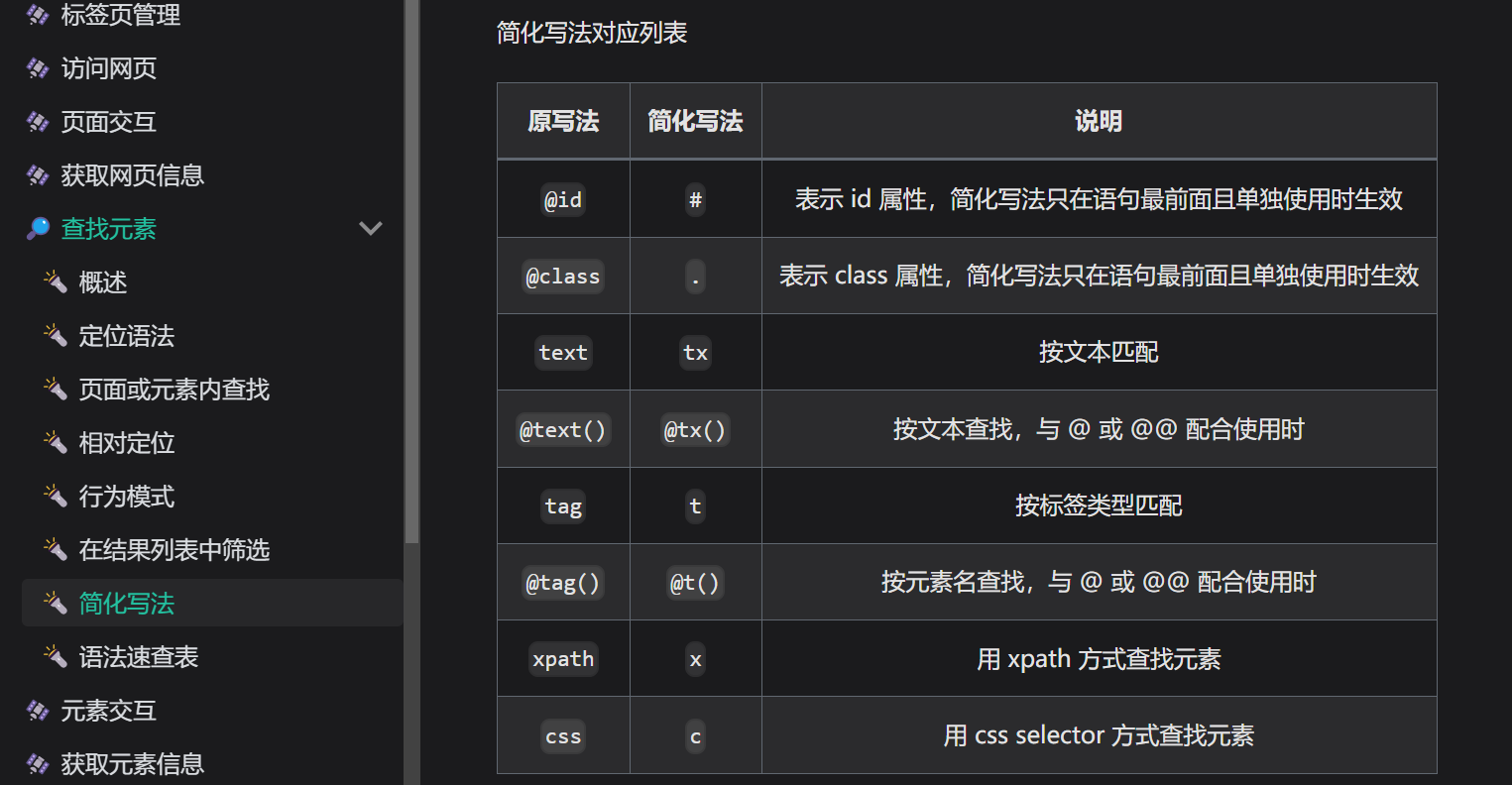

上文: 【爬虫】12306查票-CSDN博客 下面是简单的自动化进行抢票,只写到预定票,没有写完登陆, 跳出登陆后与上述代码同理修改即可。 感觉xpath最简单,复制粘贴: 还有很多写法: 官网地址&#…...

不同消息队列保证高可用实现方案

消息队列的高可用性(High Availability, HA)是分布式系统中的核心需求,不同消息队列通过多种技术手段实现高可用。以下是主流消息队列的高可用实现方案及对比: 一、Apache Kafka 副本机制(Replication) 每个…...

【Django系统】Python+Django携程酒店评论情感分析系统

Python Django携程酒店评论情感分析系统 项目概述 这是一个基于 Django 框架开发的酒店评论情感分析系统。系统使用机器学习技术对酒店评论进行情感分析,帮助酒店管理者了解客户反馈,提升服务质量。 主要功能 评论数据导入:支持导入酒店…...

spring cloud alibaba-Geteway详解

spring cloud alibaba-Gateway详解 Gateway介绍 在 Spring Cloud Alibaba 生态系统中,Gateway 是一个非常重要的组件,用于构建微服务架构中的网关服务。它基于 Spring Cloud Gateway 进行扩展和优化,提供了更强大的功能和更好的性能。 Gat…...

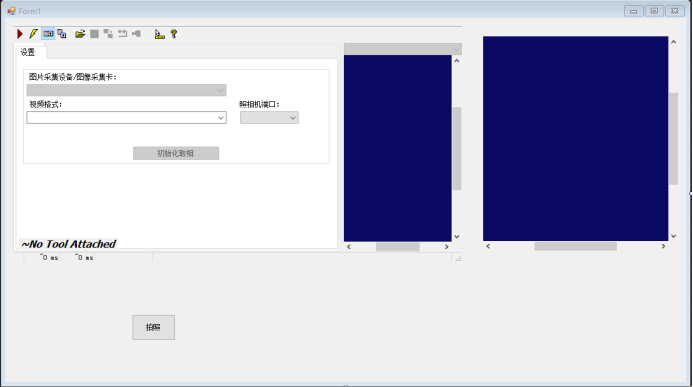

c#中添加visionpro控件(联合编程)

vs添加vp控件 创建窗体应用 右键选择项 点击确定 加载CogAcqfifoTool工具拍照 设置参数保存.vpp 保存为QuickBuild或者job, ToolBlock 加载保存的acq工具 实例化相机工具类 //引入命名空间 using Cognex.VisionPro; //实例化一个相机工具类 CogAcqFifoTool cogAcqFifoTool n…...

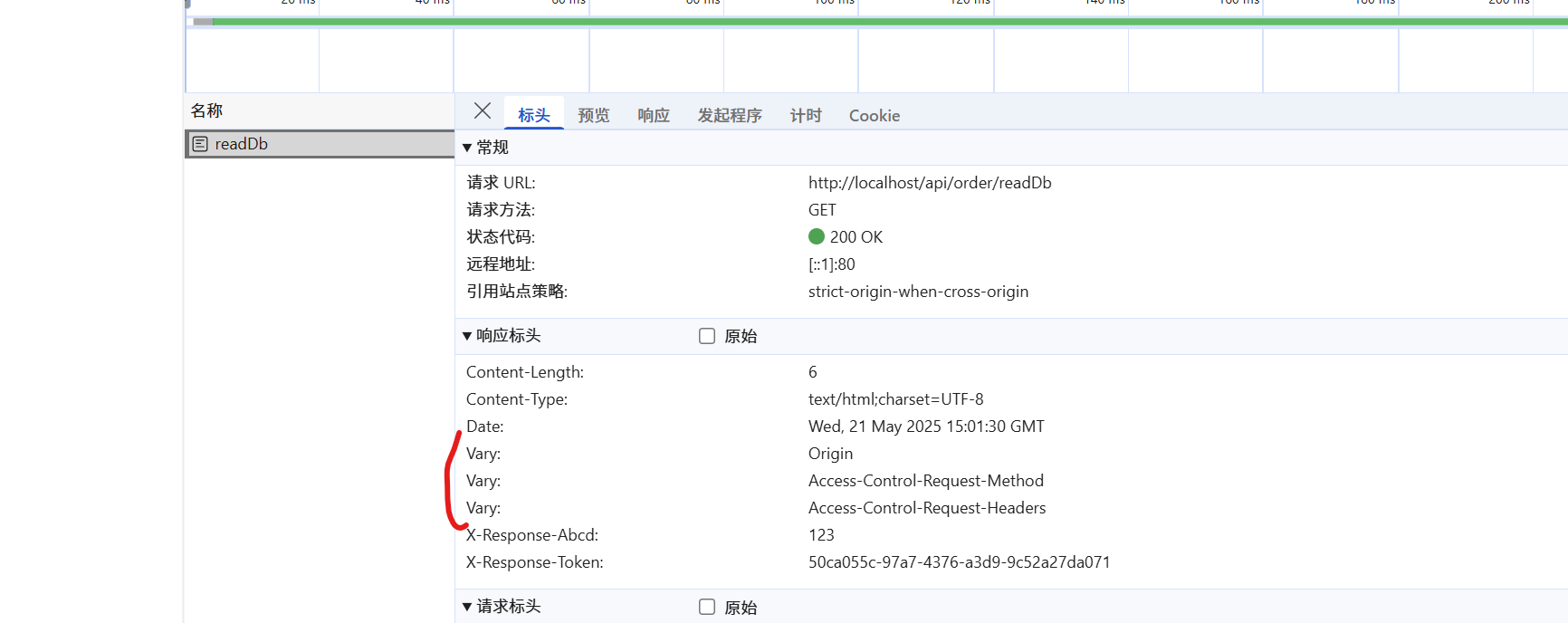

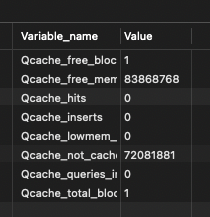

性能测试-mysql监控

mysql常用监控指标 慢查询sql 慢查询:指执行速度低于设置的阀值的sql语句 作用:帮助定位查询速度较慢的sql语句,方便更好的优化数据库系统的性能 开启mysql慢查询日志 参数说明: slow_query_log:慢查询日志开启状态【on…...

游戏引擎学习第301天:使用精灵边界进行排序

回顾并为今天的内容做准备 昨天,我们解决了一些关于排序的问题,这对我们清理长期存在的Z轴排序问题很有帮助。这个问题我们一直想在开始常规游戏代码之前解决。虽然不确定是否完全解决了问题,但我们提出了一个看起来合理的排序标准。 有两点…...

函数详解)

CSS attr() 函数详解

attr() 是 CSS 中的一个函数,用于获取 HTML 元素的属性值并在样式中使用。虽然功能强大,但它的应用有一些限制和注意事项。 基本语法 element::pseudo-element {property: attr(attribute-name); } 可用场景 1. 在伪元素的 content 属性中使用&#…...

【AI生成PPT】使用ChatGPT+Overleaf自动生成学术论文PPT演示文稿

【AI生成PPT】使用ChatGPTOverleaf自动生成学术论文PPT演示文稿 文章摘要:使用ChatGPTBeamer自动生成学术论文PPT演示文稿Beamer是什么Overleaf编辑工具ChatGPT生成Beamer Latex代码论文获取prompt设计 生成结果 文章摘要: 本文介绍了一种高效利…...

流复备机断档处理

文章目录 环境症状问题原因解决方案 环境 系统平台:UOS(海光),UOS (飞腾),UOS(鲲鹏),UOS(龙芯),UOS (申威),银河麒麟svs(X86_64&…...

Linux 安装 pytorch+cuda+gpu 大模型开发环境过程记录

Linux 安装 pytorchcudagpu 大模型开发环境过程记录 2025-05-17 本文可用于生产环境,用于大模型训练开发运行。 1. 确定 OS 架构 # cat /etc/os-release NAME"Ubuntu" VERSION"20.04.6 LTS (Focal Fossa)" # uname -m x86_642. 查看磁盘空间…...

局部放大maya的视图HUD文字大小的方法

一、问题描述: 有网友问:有办法局部放大maya的字体吗比如hud中currenttime打开之后画面右下角有个frame 想放大一下能做到吗? 在 Maya 中,可以通过自定义 HUD(Heads-Up Display)元素的字体大小来局部放大特…...

数学复习笔记 16

前言 例题真是经典。 background music 《青春不一样》 2.28 算一个行列式,算出来行列式不等于零,这表示矩阵式可逆的。但是这个算的秩是复合的,感觉没啥好办法了,我直接硬算了,之后再看解析积累好的方法。算矩阵…...

初识Linux · NAT 内网穿透 内网打洞 代理

目录 前言: 内网穿透和打洞 NAPT表 内网穿透 内网打洞 正向/反向代理 前言: 本文算是网络原理的最后一点补充,为什么说是补充呢,因为我们在前面第一次介绍NAT的时候详细介绍的是报文从子网到公网,却没有介绍报文…...

STM32接收红外遥控器的遥控信号

经过几天早晨的学习,终于把遥控器的红外信号给搞通了,特此记录一下;其实说白了,红外遥控就是高低电平的信号,用时间来区分是二进制的0还是1;然后把这些0或1,在组装成一个32位的数基本就算是完事…...

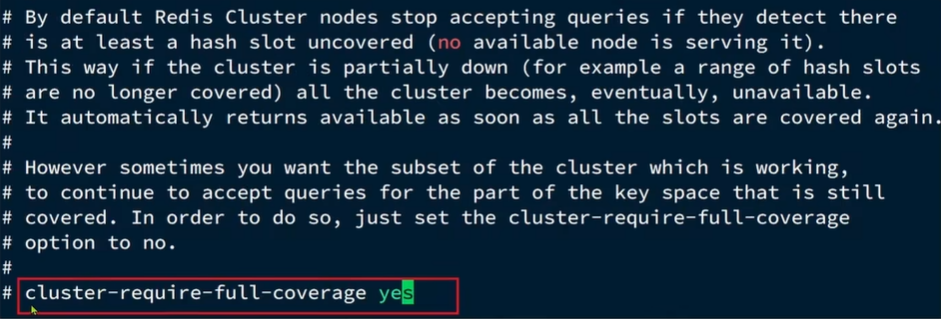

Redis从入门到实战 - 高级篇(下)

一、Redis键值设计 1. 优雅的key结构 Redis的Key虽然可以自定义,但最好遵循下面几个最佳实践约定: 遵循基本格式:[业务名称]:[数据名]:[id]长度不超过44字节不包含特殊字符 例如:我们的登录业务,保存用户信息&…...

NGINX常用功能—笔记

NGINX 是一款高性能的开源 Web 服务器和反向代理服务器,常用于处理高并发场景,其功能丰富且灵活。以下是 NGINX 的常用功能及详细说明: 一、静态资源服务器 功能说明:直接处理 HTML、CSS、JavaScript、图片、视频等静态文件请求&a…...

JVM 性能问题排查实战10连击

🗂️ 目录 前言:理论掌握只是起点,定位能力才是核心全局排查模型:三步法1️⃣Full GC 频繁触发:老年代压力过大2️⃣ OOM 爆炸:元空间泄漏 or 缓存未清理3️⃣ CPU 飙升却不是 GC:线程阻塞或热方…...