kubeadmin安装k8s集群

目录

一 、环境部署

1、服务器规划

2、环境准备

二、所有节点安装docker

1、配置yum源,安装docker

2、配置daemon.json文件

三、所有节点安装kubeadm、kubelet 和kubectl

四、部署k8s集群

1、查看初始化需要的镜像

2、导入镜像

3、初始化kubeadm

3.1 方法一:通过修改配置文件初始化

3.2 方法二:命令行

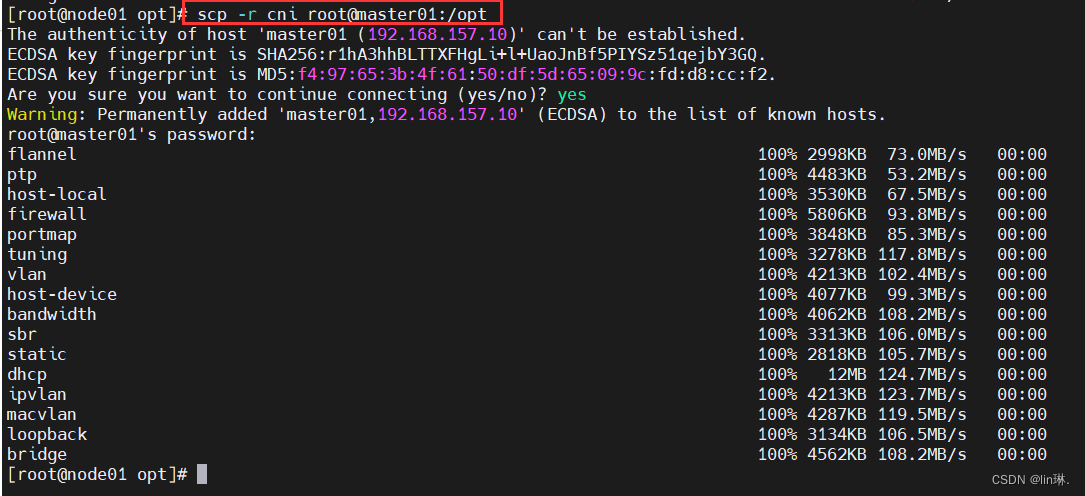

五、所有节点部署网络插件flannel

1、部署flannel

1.1 方法一

1.2 方法二

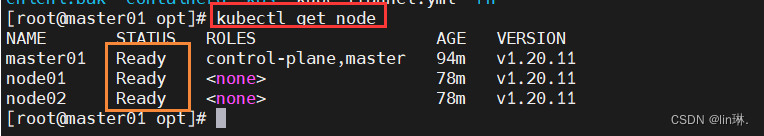

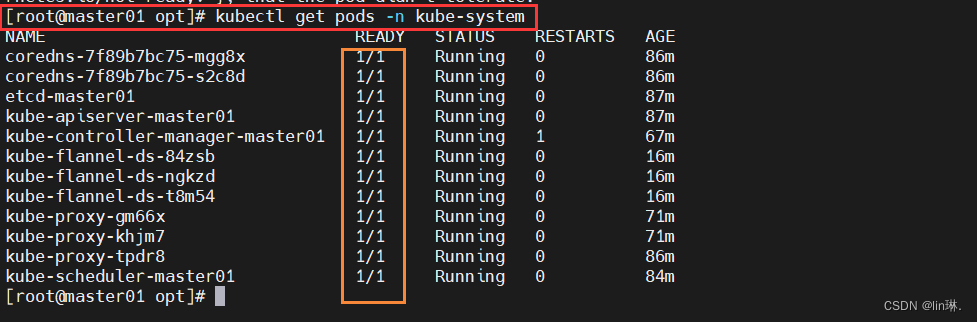

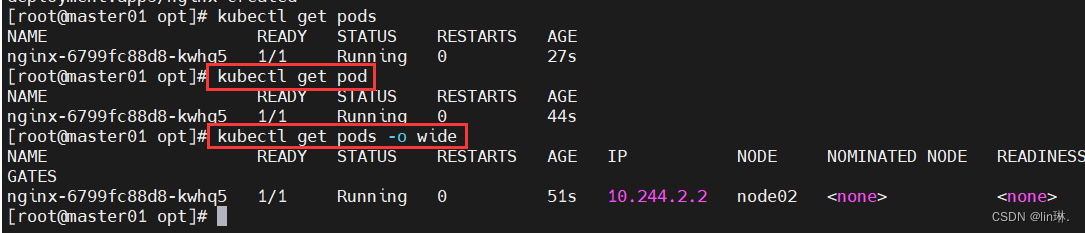

2、测试

六、安装dashboard

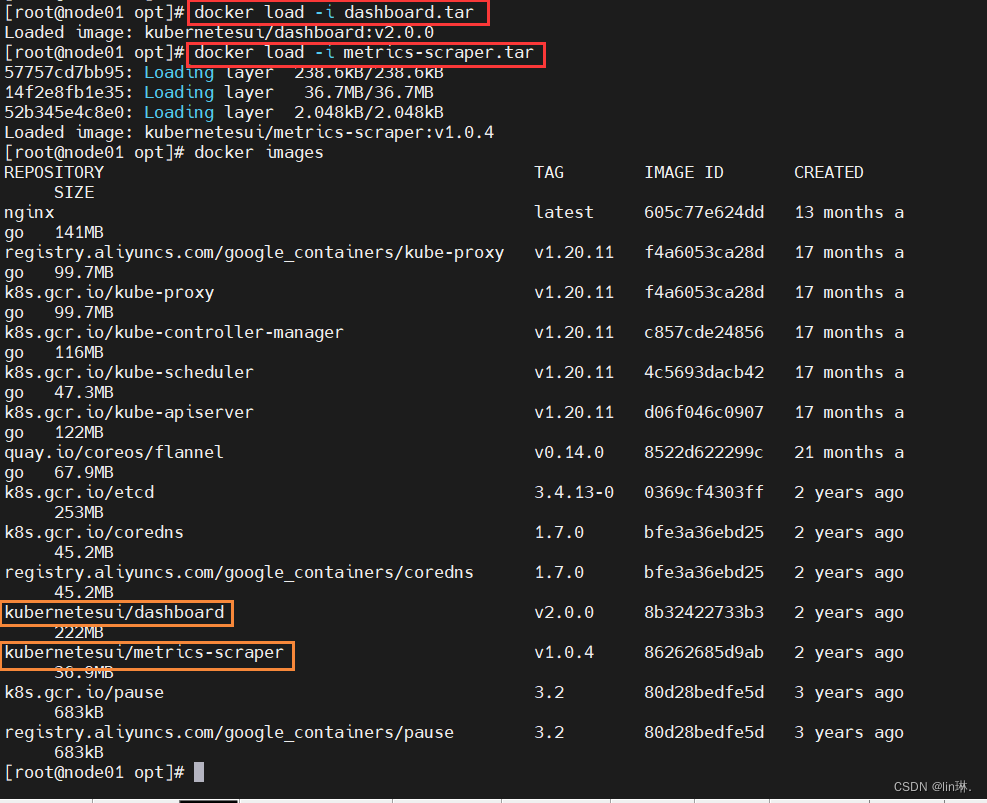

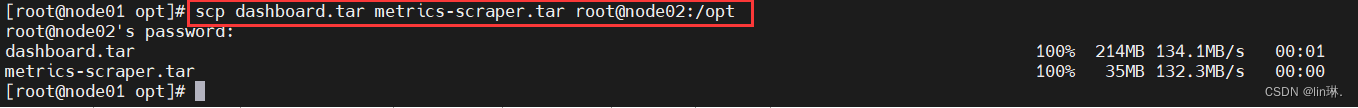

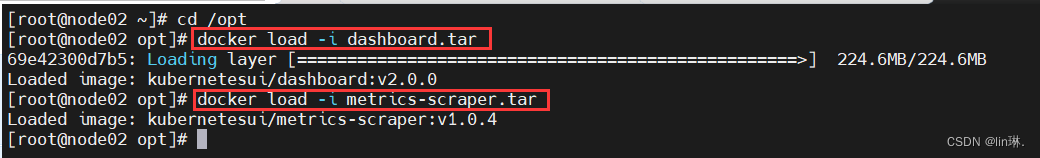

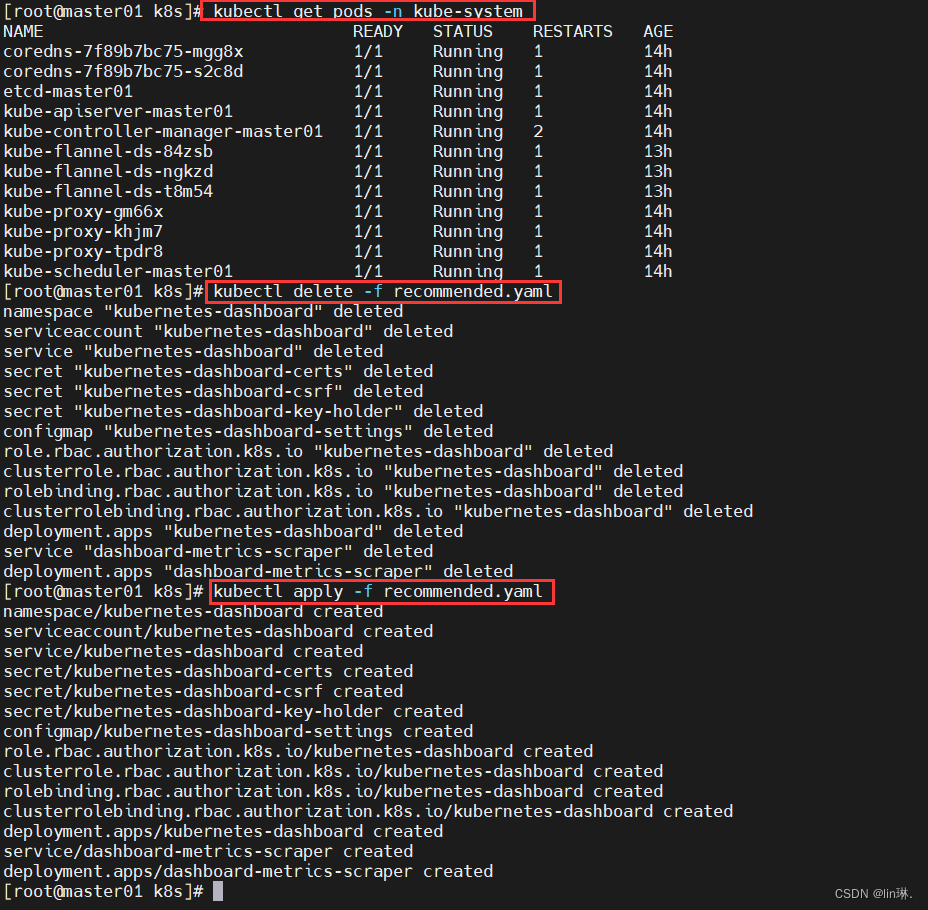

1、所有节点安装dashboard

2、测试

七 安装Harbor私有仓库

1、harbor 节点环境准备

2、安装 Harbor

3、生成证书

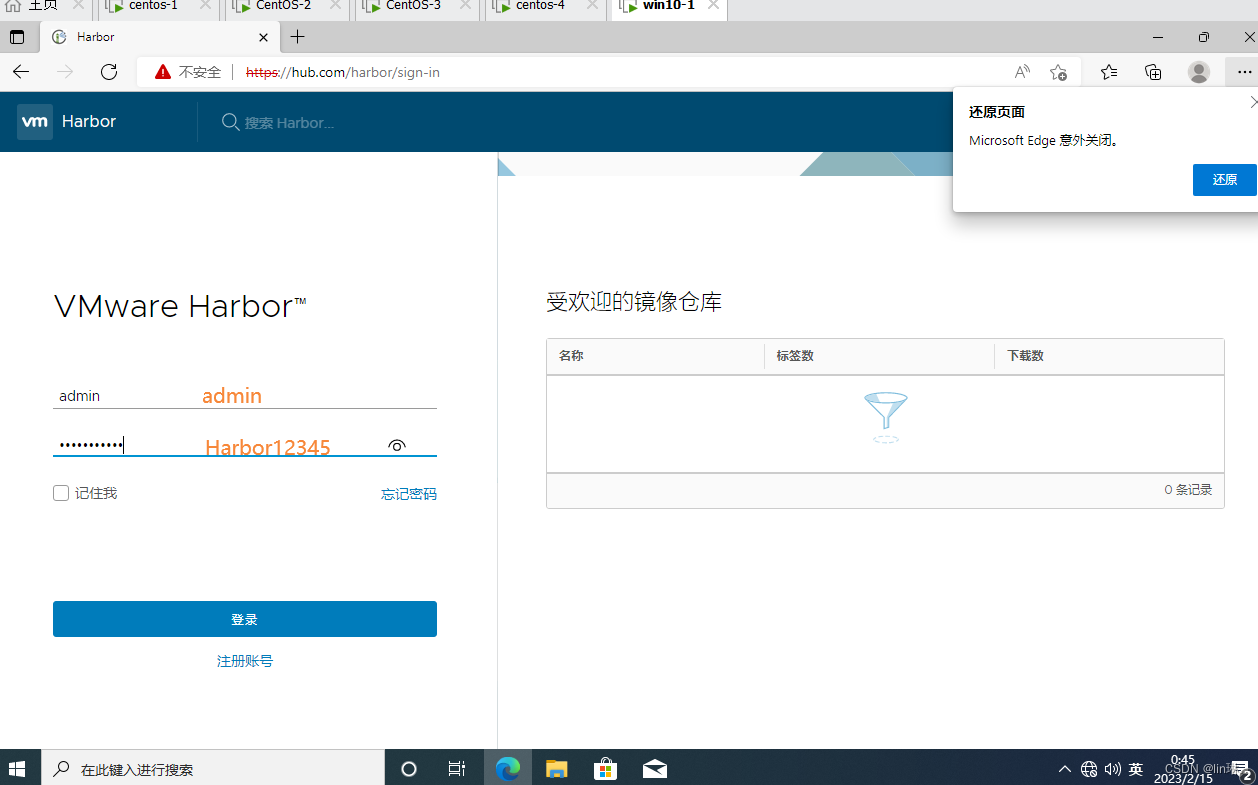

4、登录测试

4.1 浏览器登录

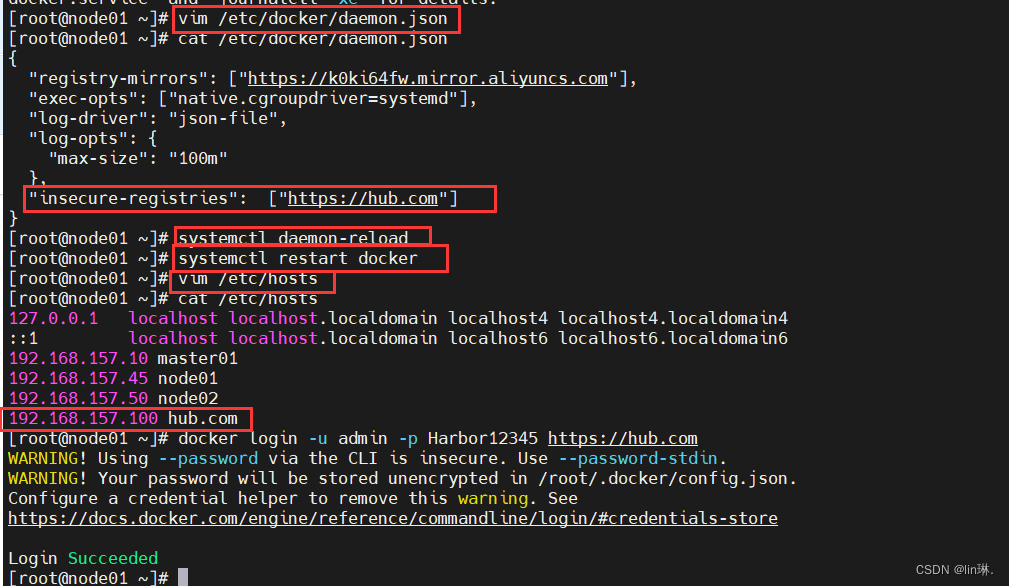

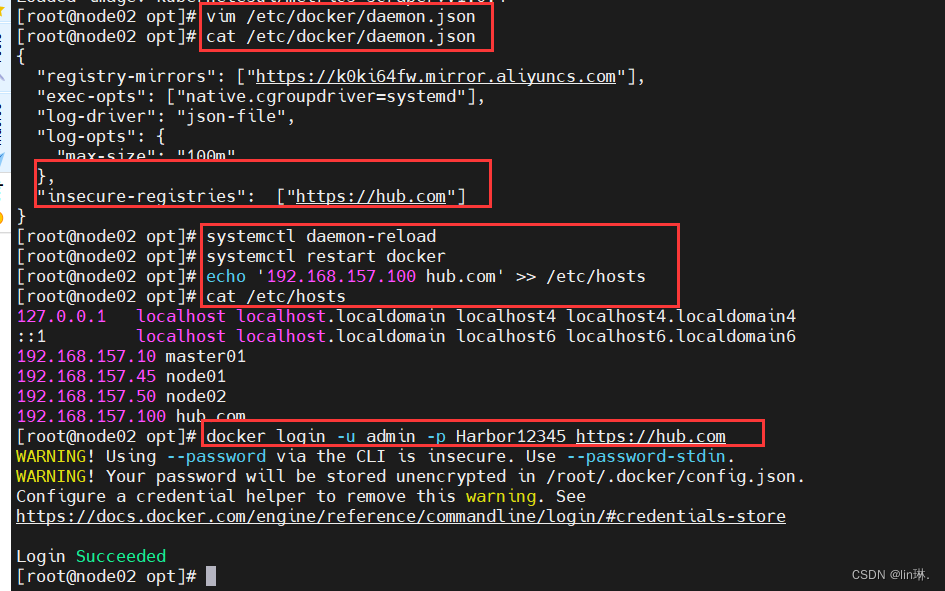

4.2 在任意node接点上登录

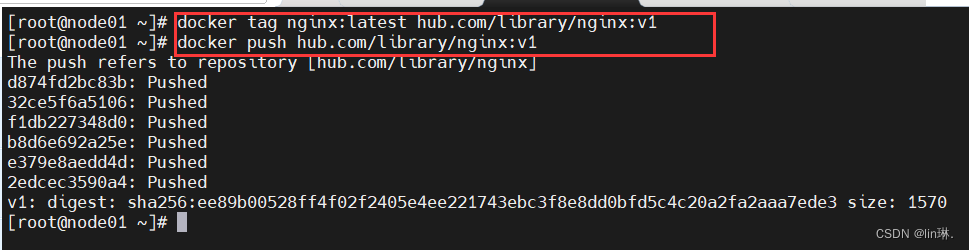

5、上传镜像

6、拉取镜像

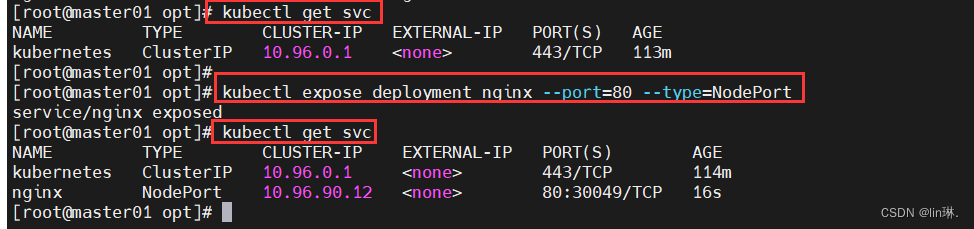

八、发布服务

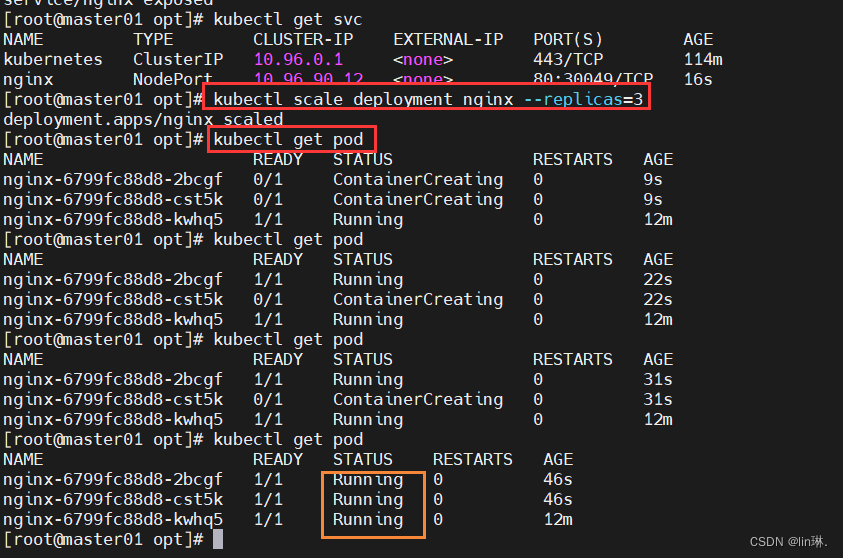

1、发布服务

2、测试

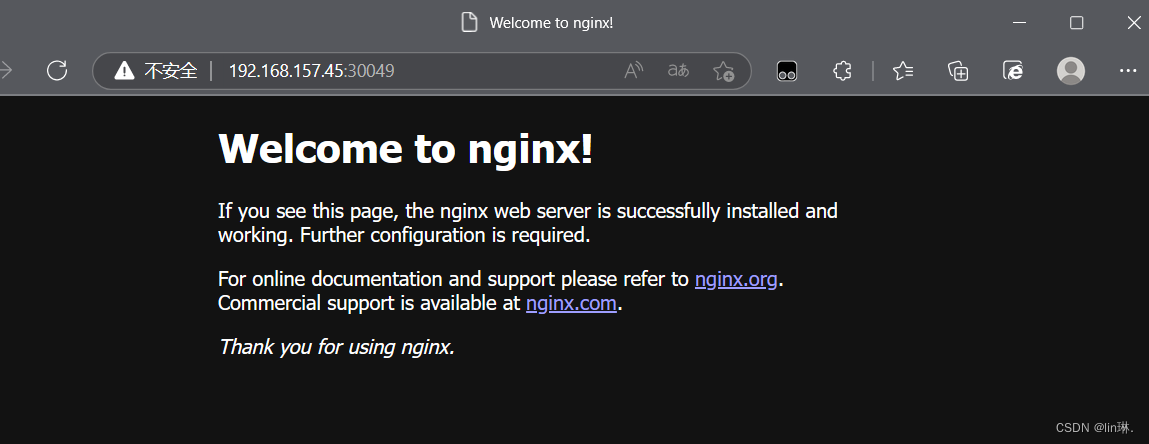

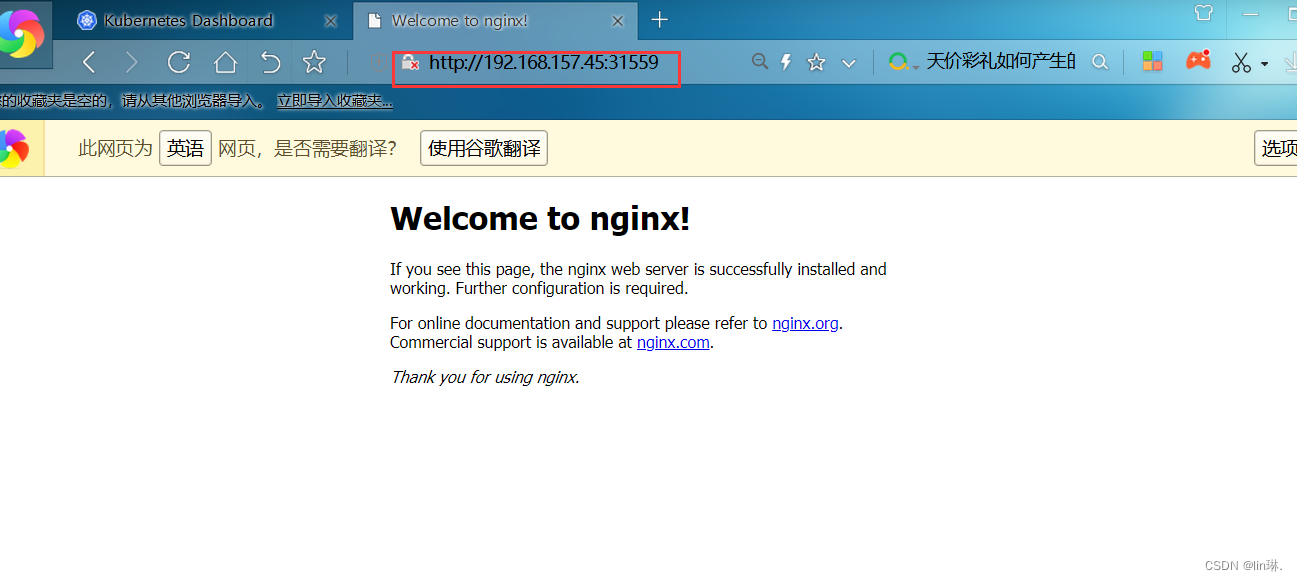

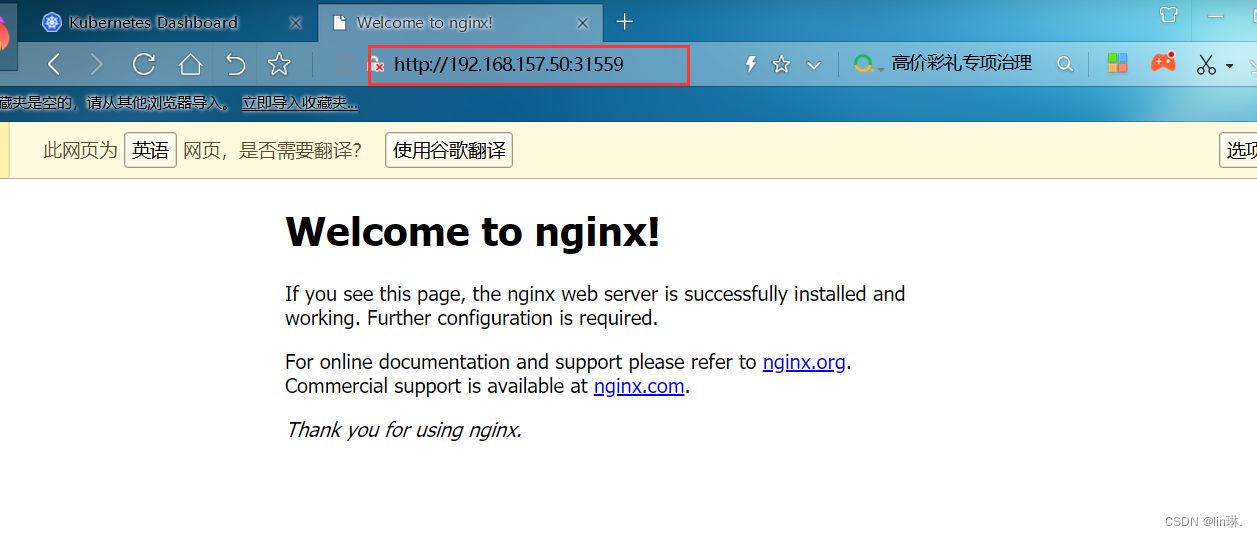

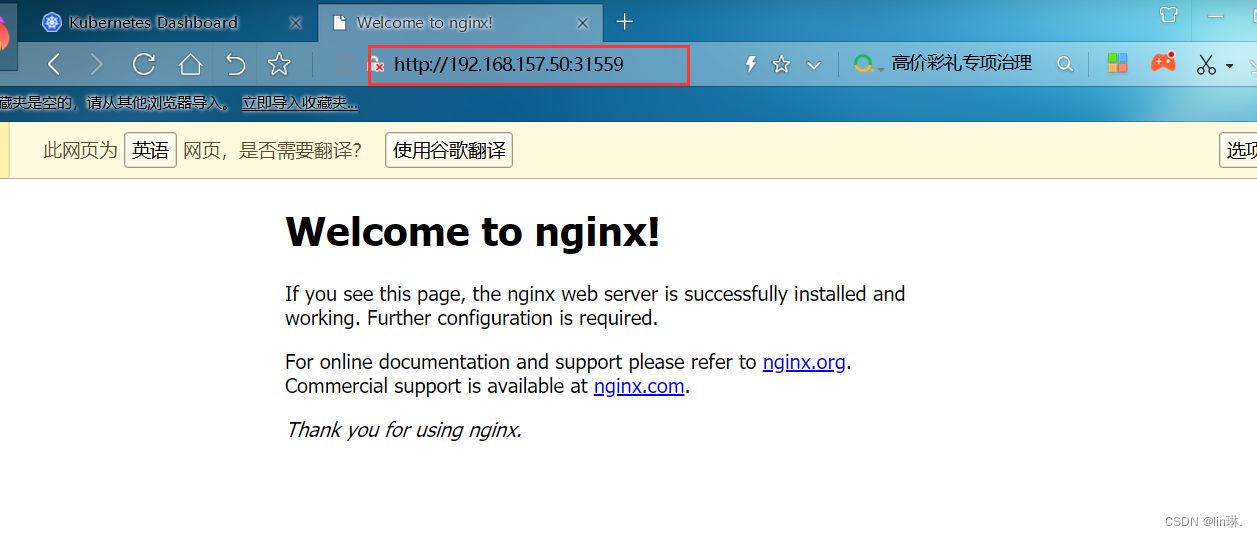

2.1 访问测试

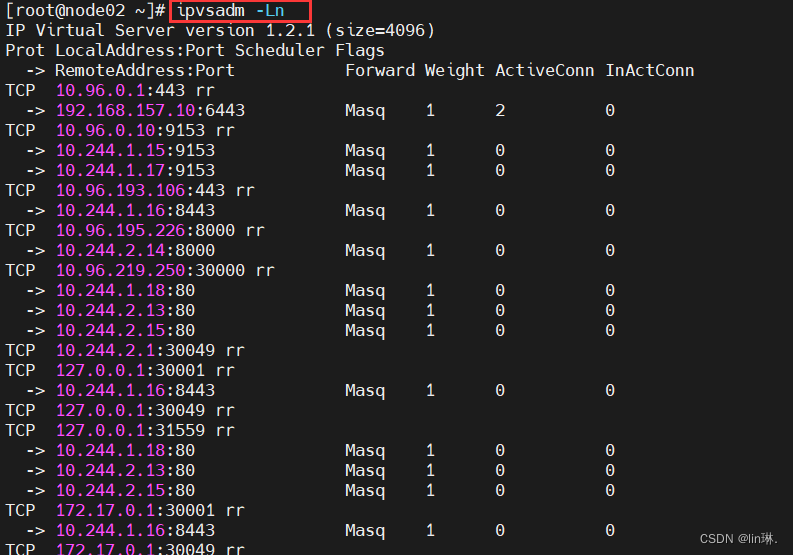

2.2 使用ipvsadm 查看策略

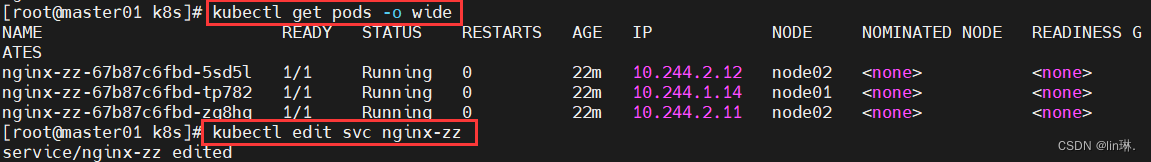

3、在线修改资源配置

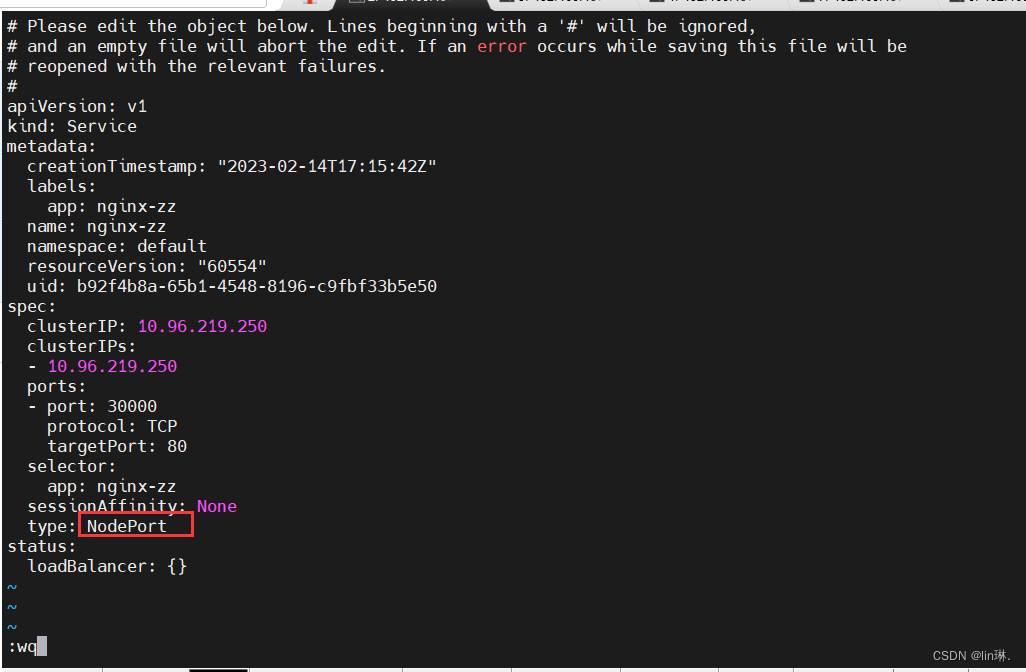

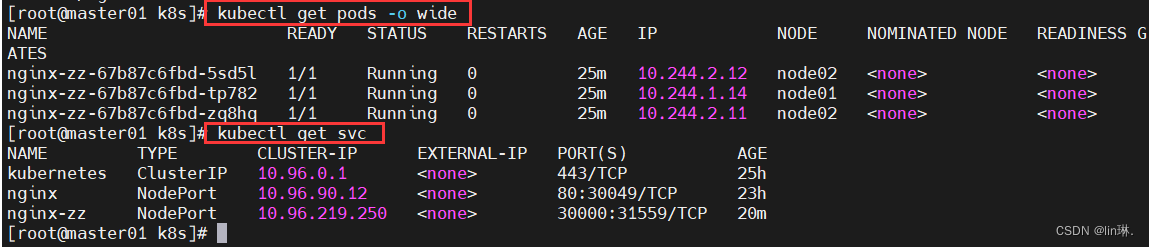

3.1 修改配置

3.2 访问测试

九、内核参数优化

一 、环境部署

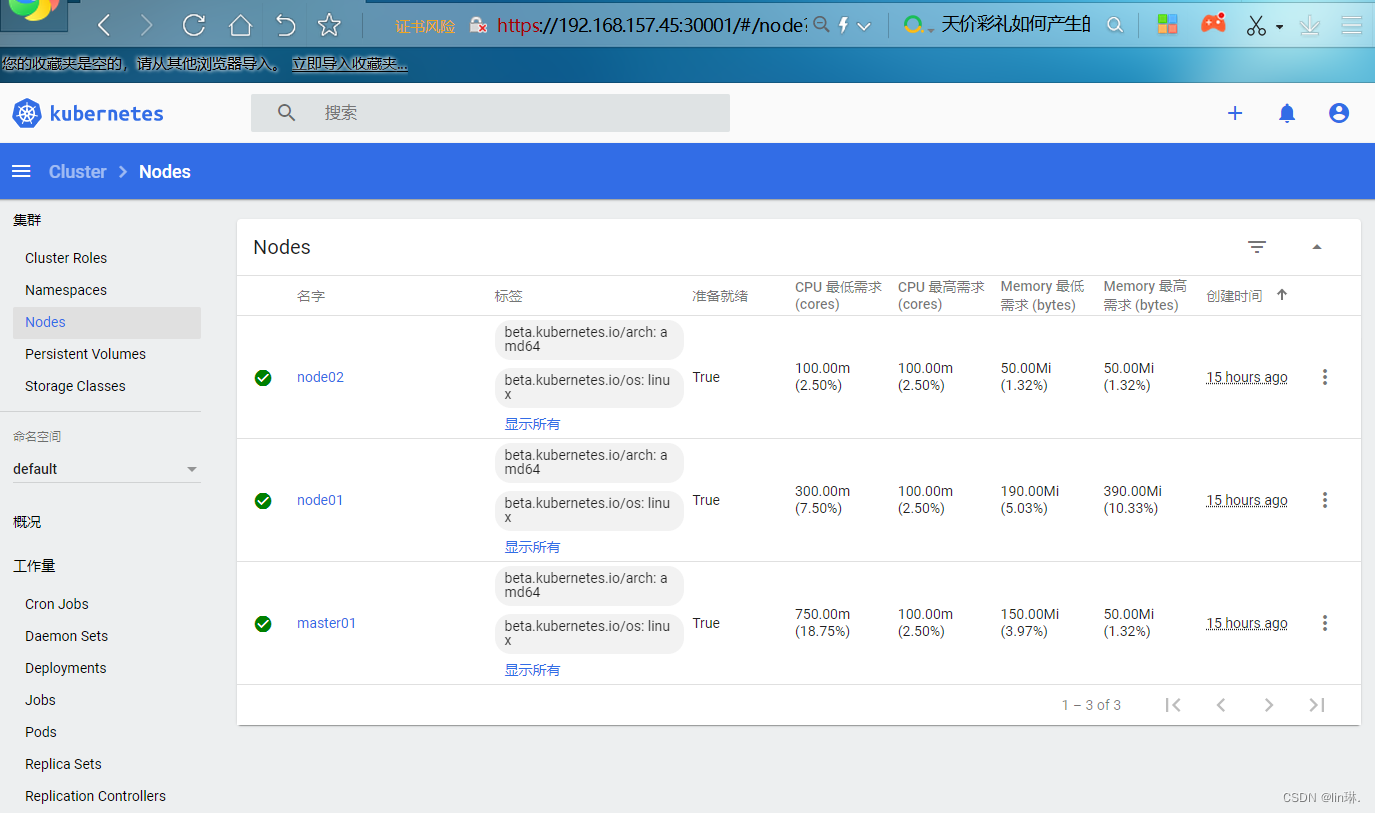

1、服务器规划

| 角色 | ip | 服务 |

|---|---|---|

| master(2c/4G ,cpu核心数要求大于2) | 192.168.157.10 | docker,kubeadm,kubelet,kubectl,flannel |

| node01( 2c /2G) | 192.168.157.45 | docker,kubeadm,kubelet,kubectl,flannel |

| node02 (2c/2G) | 192.168.157.50 | docker,kubeadm,kubelet,kubectl,flannel |

| Harbor 节点(hub.com) | 192.168.157.100 | docker ,docker-Compose,harbor-offline-v1.2.2 |

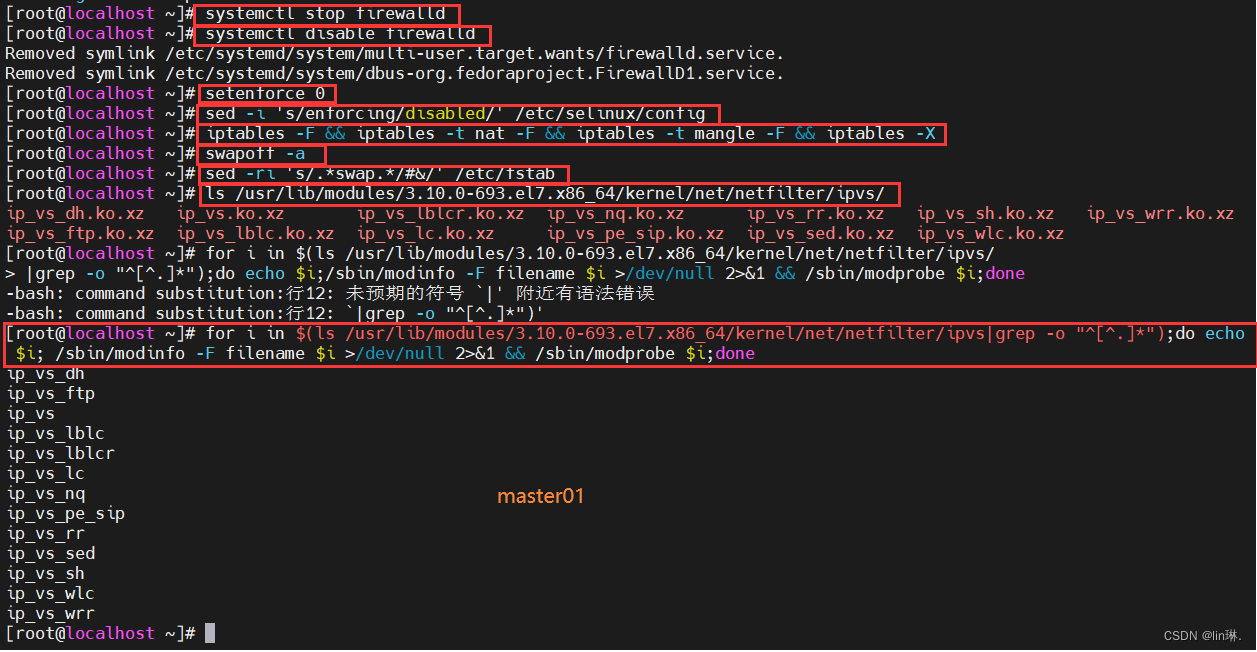

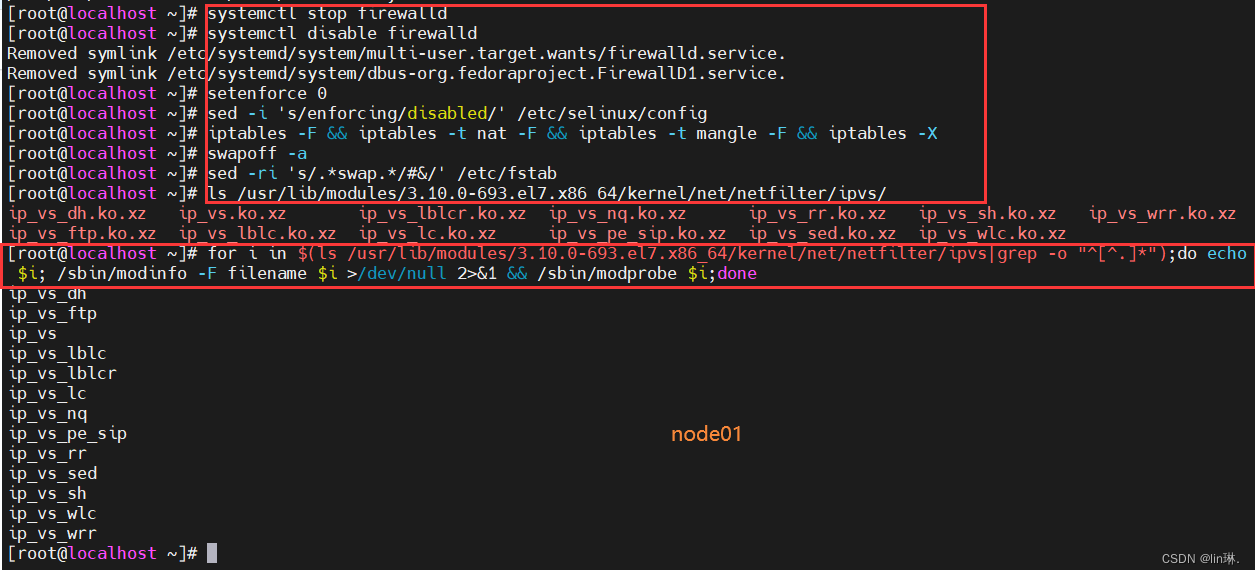

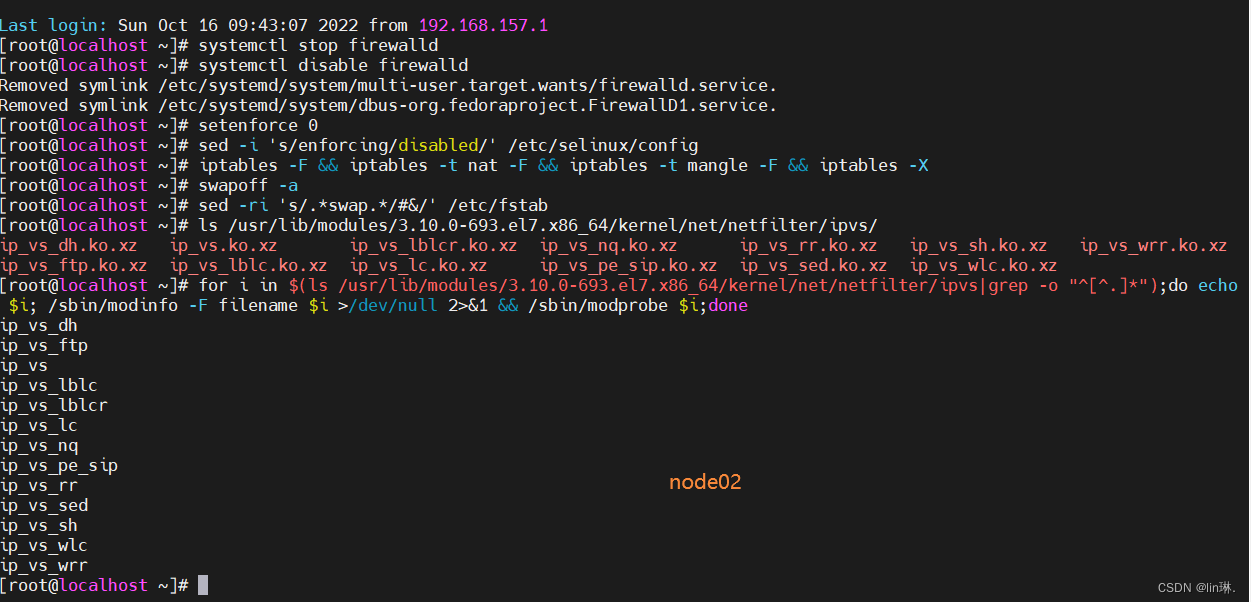

2、环境准备

#关闭firewalld防火墙和selinux

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config#清空iptables 规则(不关闭则报错)

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X#关闭swap分区(不关闭则报错)

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab#加载ip_vs模块(一定要加载,不加载不能进行转发)

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

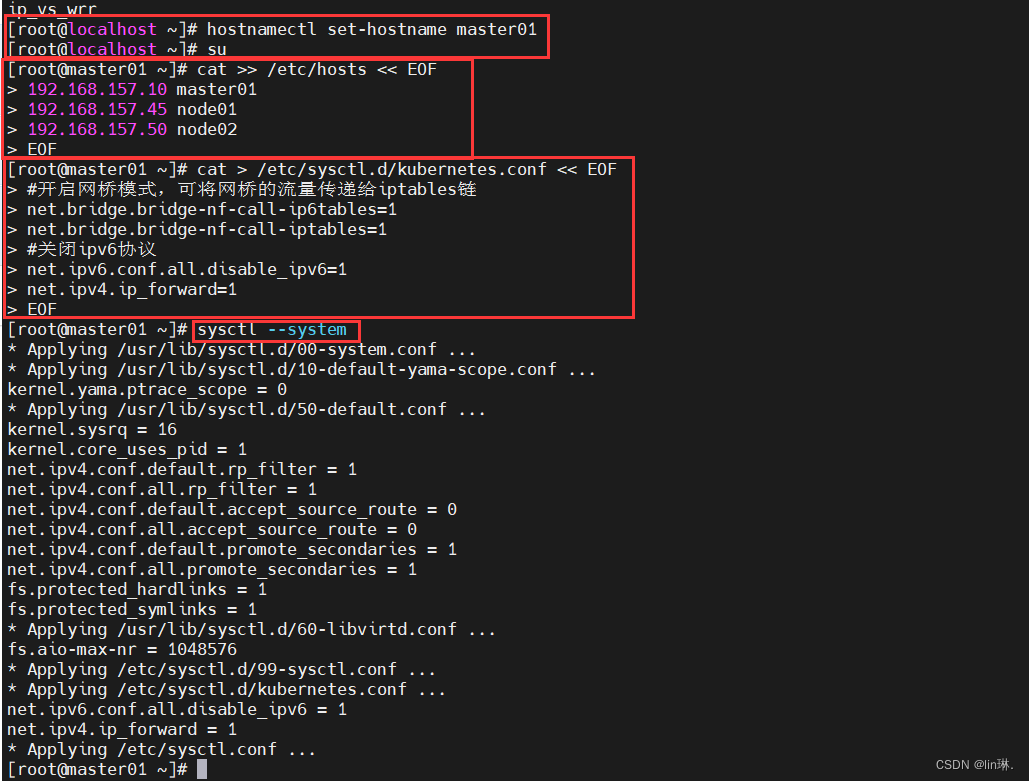

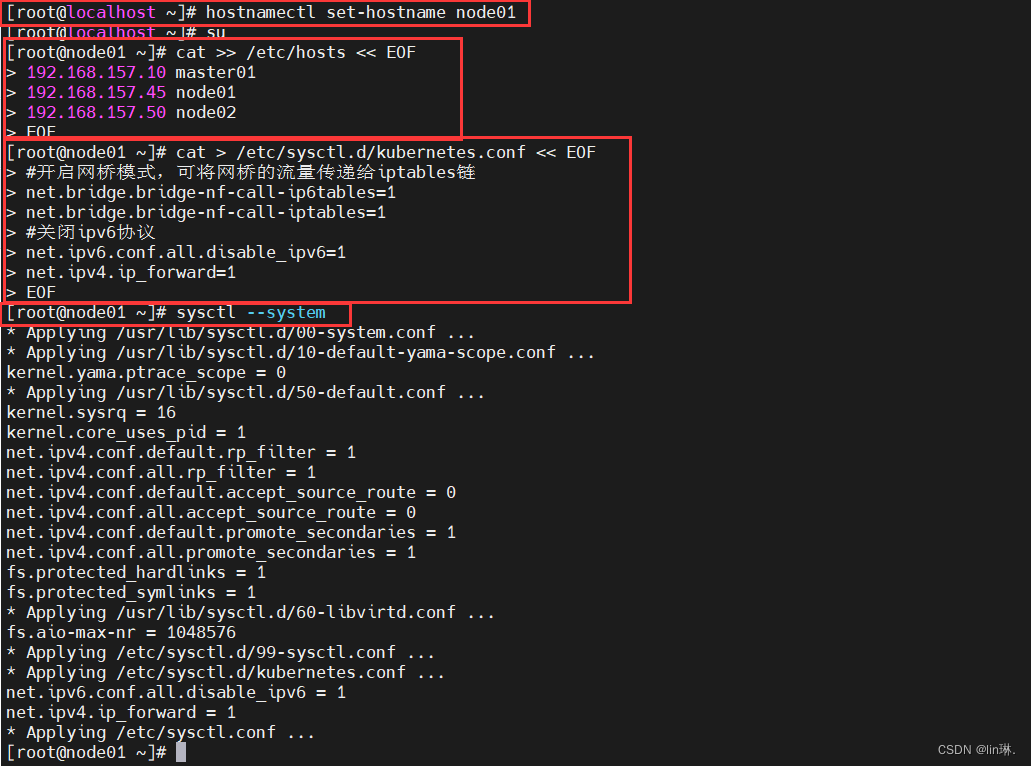

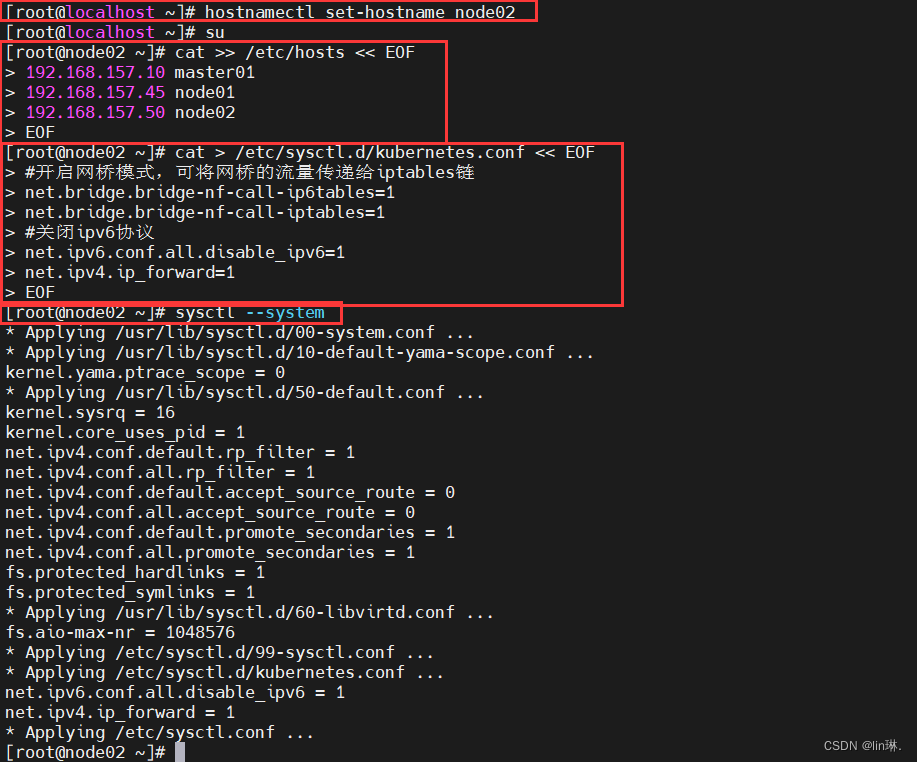

#各自节点修改主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

#所有节点修改/etc/hosts文件

cat >> /etc/hosts << EOF

192.168.157.10 master01

192.168.157.45 node01

192.168.157.50 node02

EOF

#所有节点调整内核参数

cat > /etc/sysctl.d/kubernetes.conf << EOF

#开启网桥模式,可将网桥的流量传递给iptables链

net.bridge.bridge-nf-call-ip6tables=1

net.bridge.bridge-nf-call-iptables=1

#关闭ipv6协议

net.ipv6.conf.all.disable_ipv6=1

net.ipv4.ip_forward=1

EOF#加载参数

sysctl --system

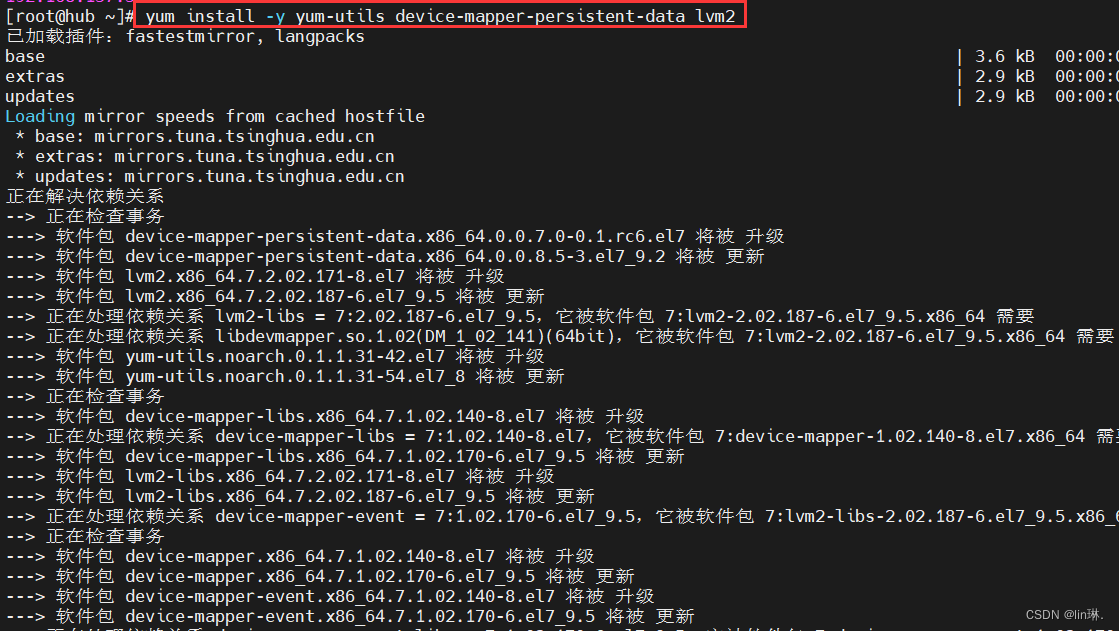

二、所有节点安装docker

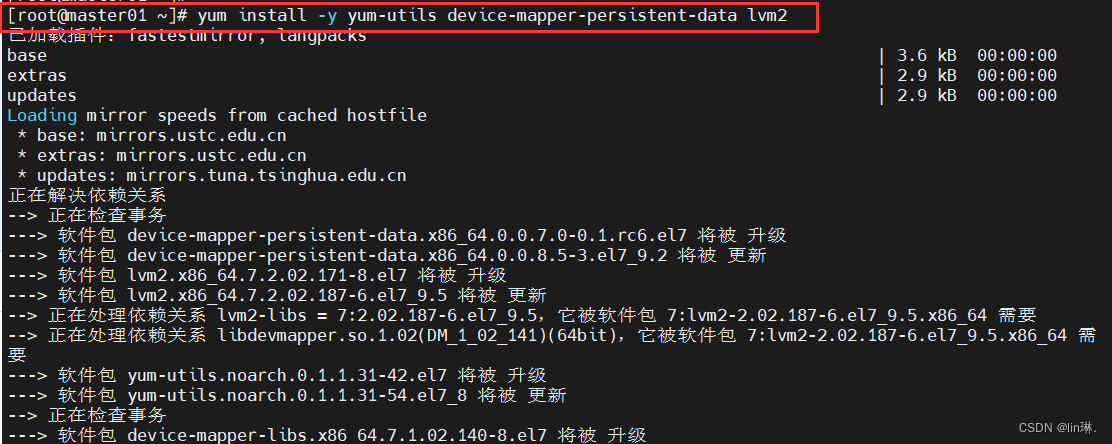

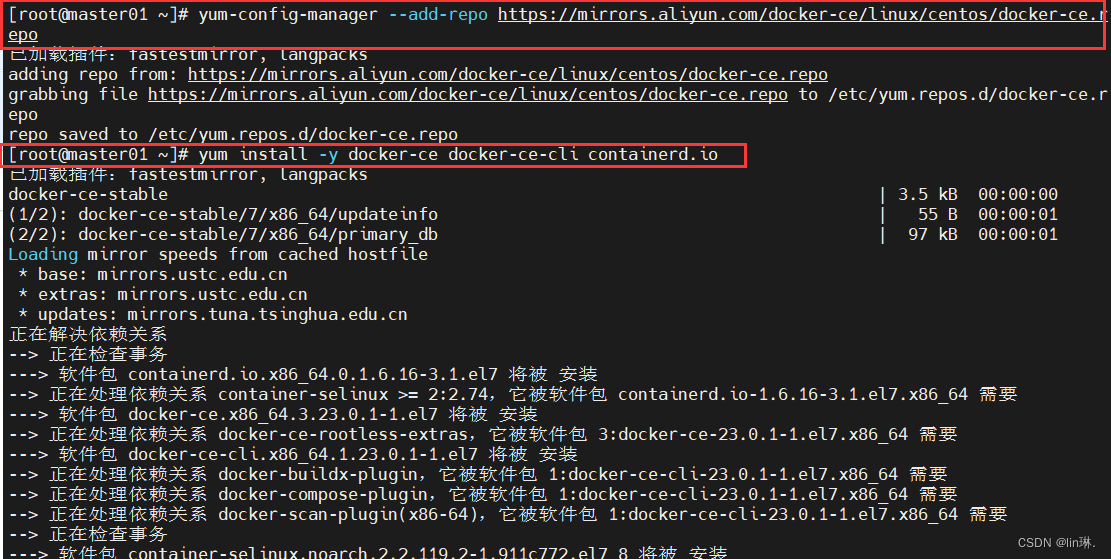

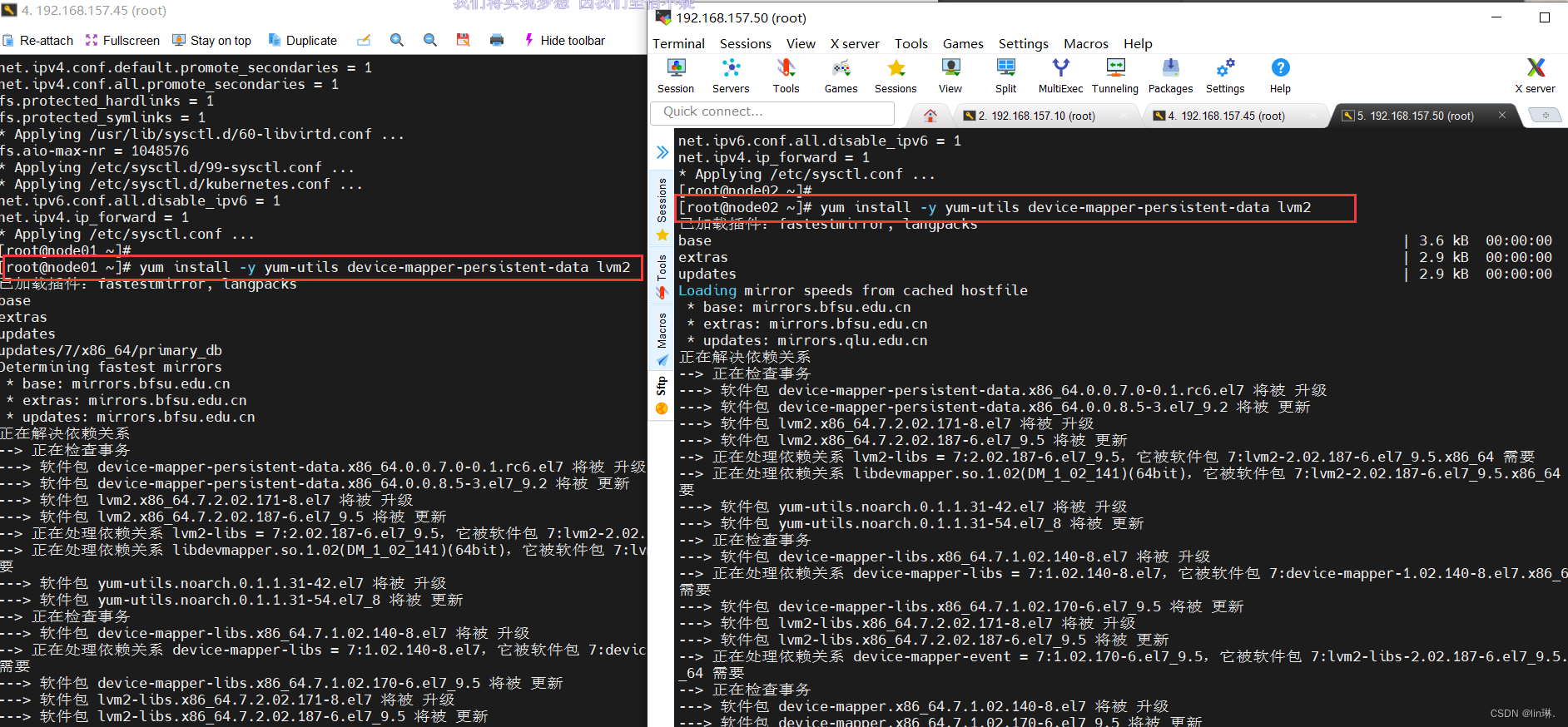

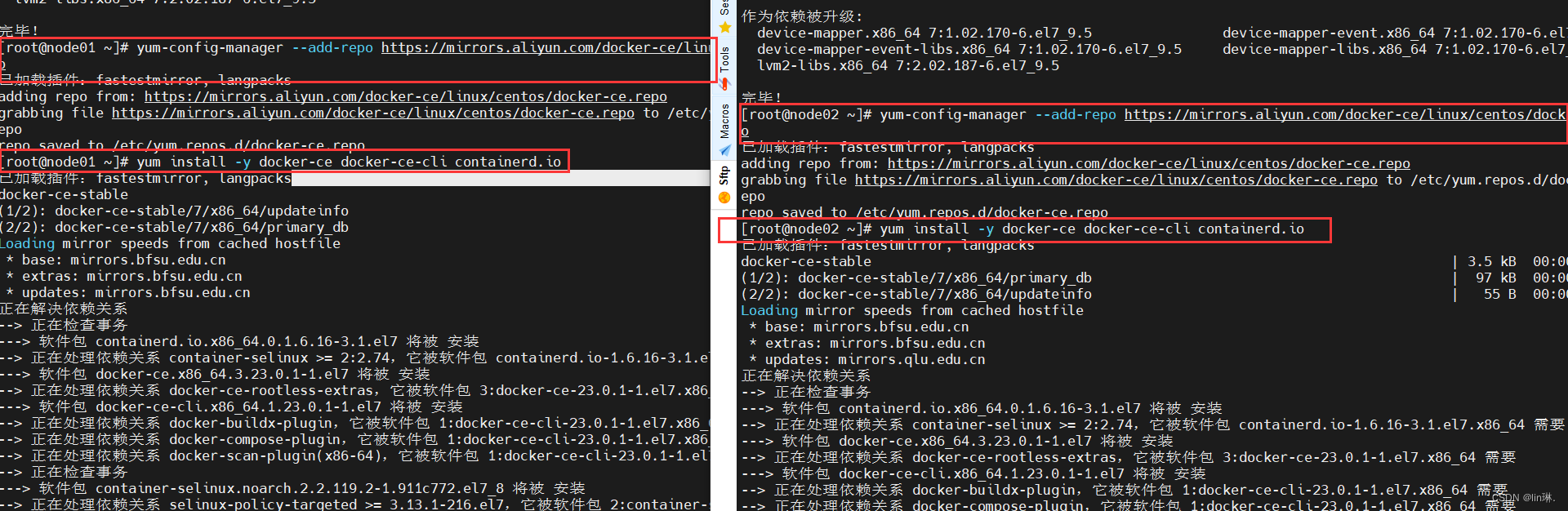

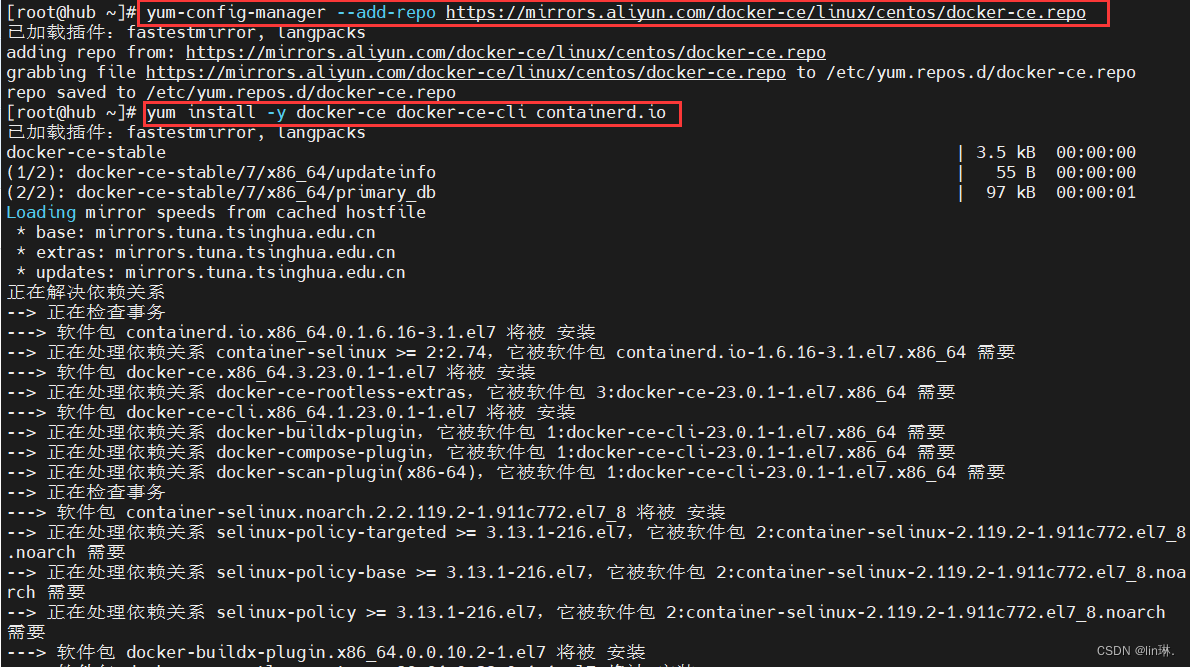

1、配置yum源,安装docker

#安装docker 需要在线源.需要把官方自带的yum 源启用

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io第一个安装的是依赖包

第二个安装的是docker中的源

第三个安装的是社区版的docker

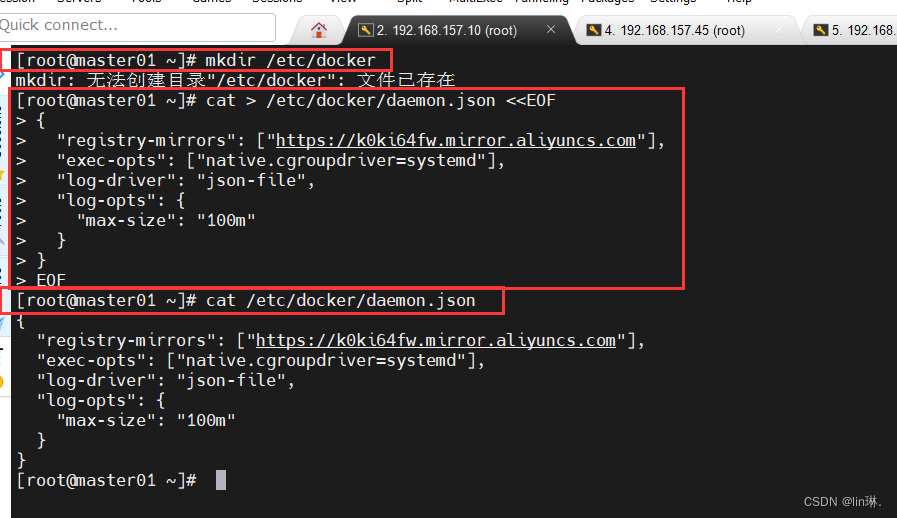

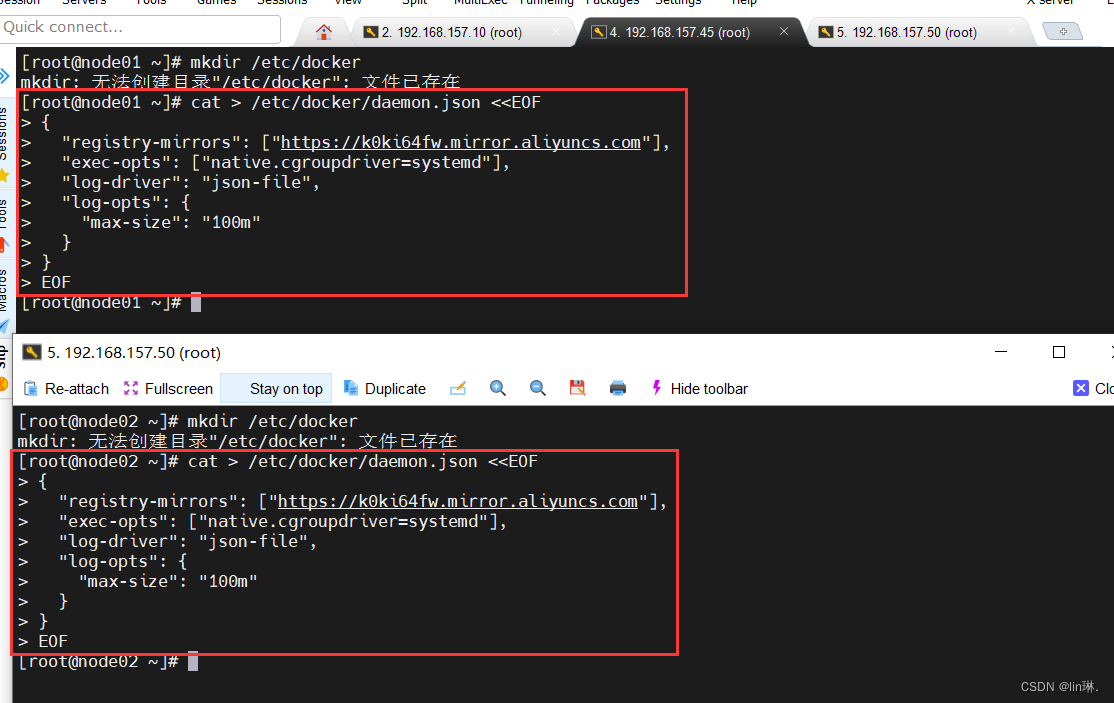

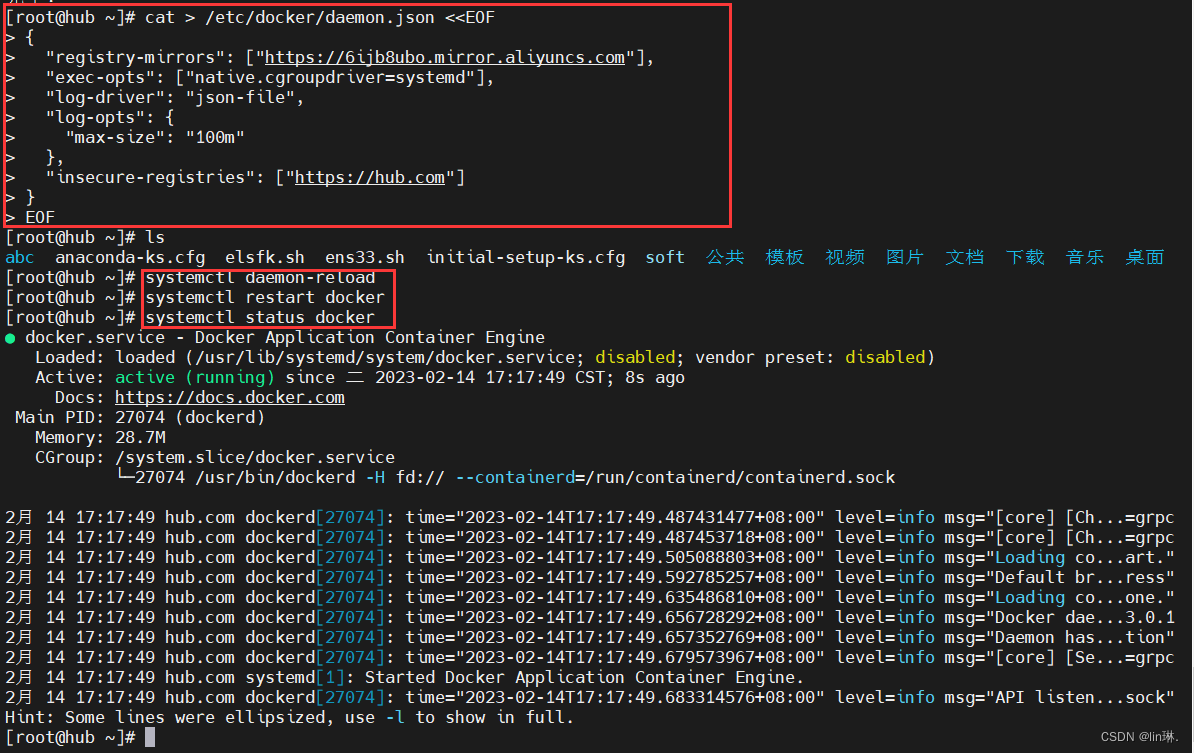

2、配置daemon.json文件

mkdir /etc/docker

cat > /etc/docker/daemon.json <<EOF

{"registry-mirrors": ["https://k0ki64fw.mirror.aliyuncs.com"], #指向阿里源"exec-opts": ["native.cgroupdriver=systemd"],"log-driver": "json-file","log-opts": {"max-size": "100m" #这四行是日志大小}

}

EOFregistry-mirrors:配置镜像加速地址

- 阿里云的镜像加速: 控制台---->在产品与镜像服务搜索容器镜像服务----> 镜像工具------>镜像加速器

exec-opts:

- 使用Systemd管理的Cgroup来进行资源控制与管理,因为相对Cgroupfs而言,Systemd限制CPU、内存等资源更加简单和成熟稳定。

log-driver ; log-opts

- 日志使用json-file格式类型存储,大小为100M,保存在/var/log/containers目录下,方便ELK等日志系统收集和管理日志。

使用systemd管理的Cgroup来进行资源控制与管理,因为相对Cgroupfs而言,Systemd限制CPU、内存等资源更加简单和成熟稳定。

日志使用json-file格式类型存储,大小为100M,保存在/var/log/containers目录下,方便ELK等日志系统收集和管理日志。

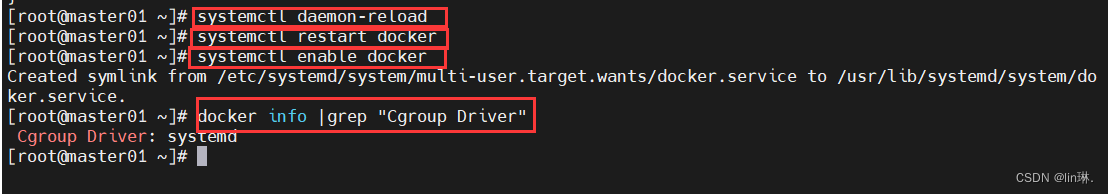

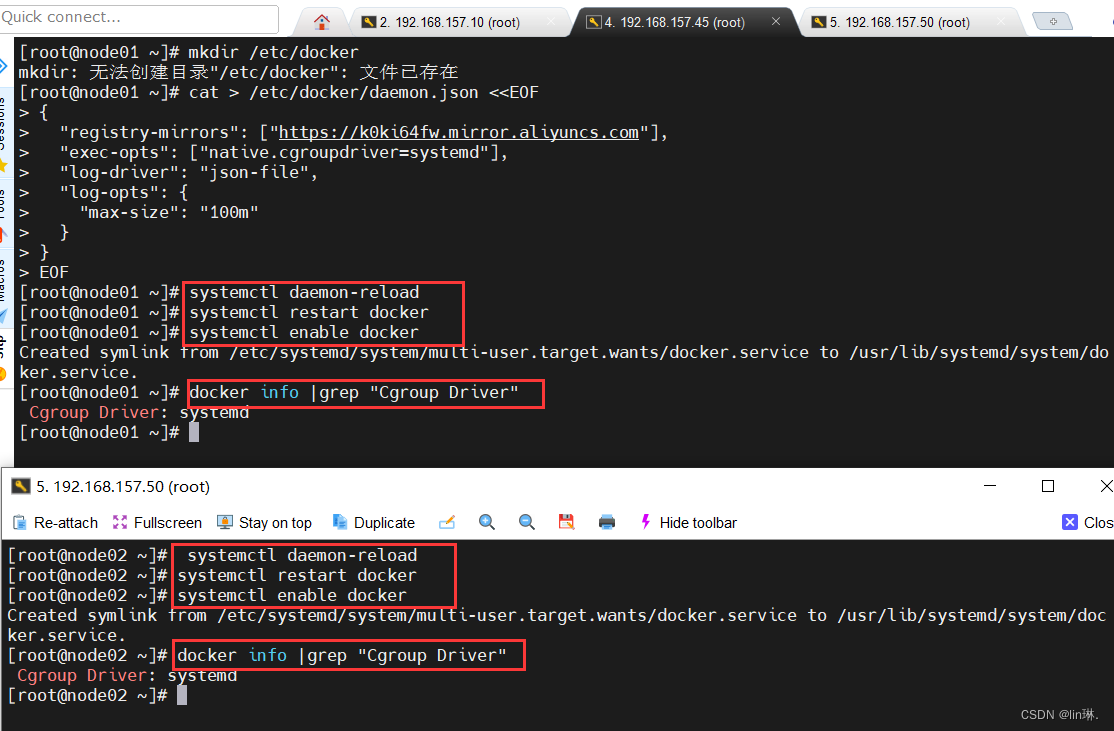

-----------------------------------------------------------------

systemctl daemon-reload

systemctl restart docker.service

systemctl enable docker.service docker info | grep "Cgroup Driver"

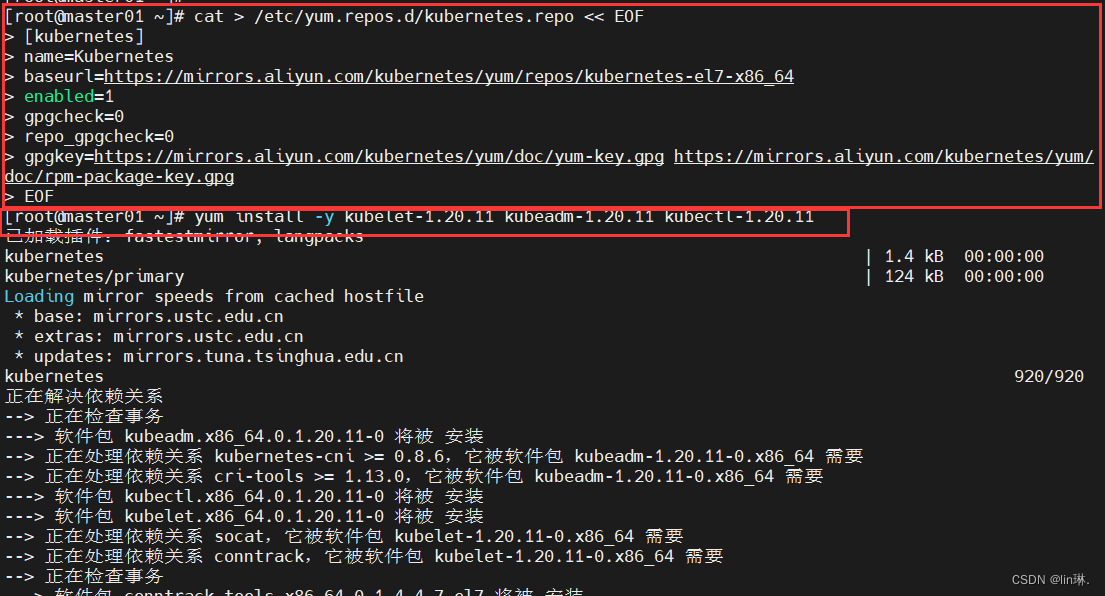

三、所有节点安装kubeadm、kubelet 和kubectl

#配置kubernetes源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

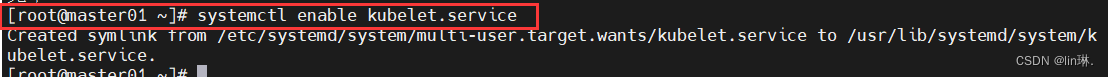

EOF#下载

yum install -y kubelet-1.20.11 kubeadm-1.20.11 kubectl-1.20.11#设置开机自启kubelet

systemctl enable kubelet.service#K8S通过kubeadm安装出来以后都是以Pod方式存在,即底层是以容器方式运行,所以kubelet必须设置开机自启

node01和node02的操作与master01的操作一致

四、部署k8s集群

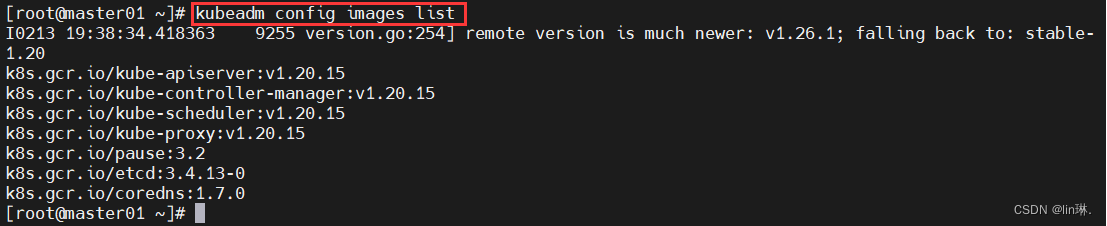

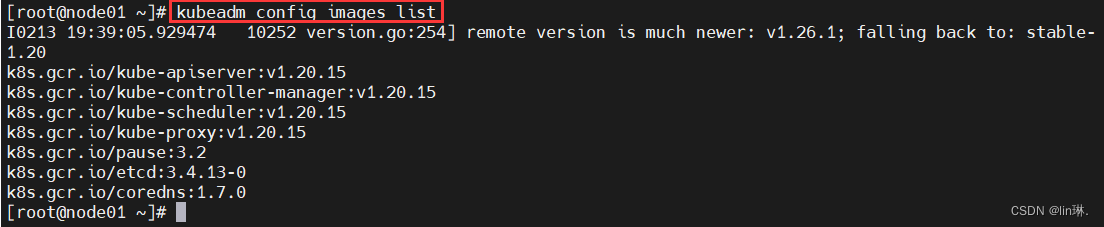

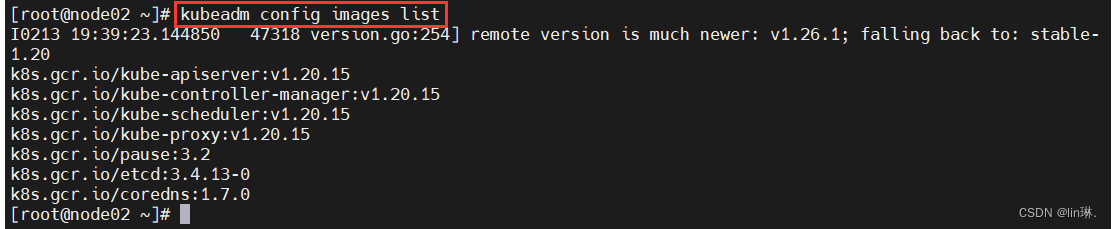

1、查看初始化需要的镜像

#查看初始化需要的镜像

kubeadm config images list

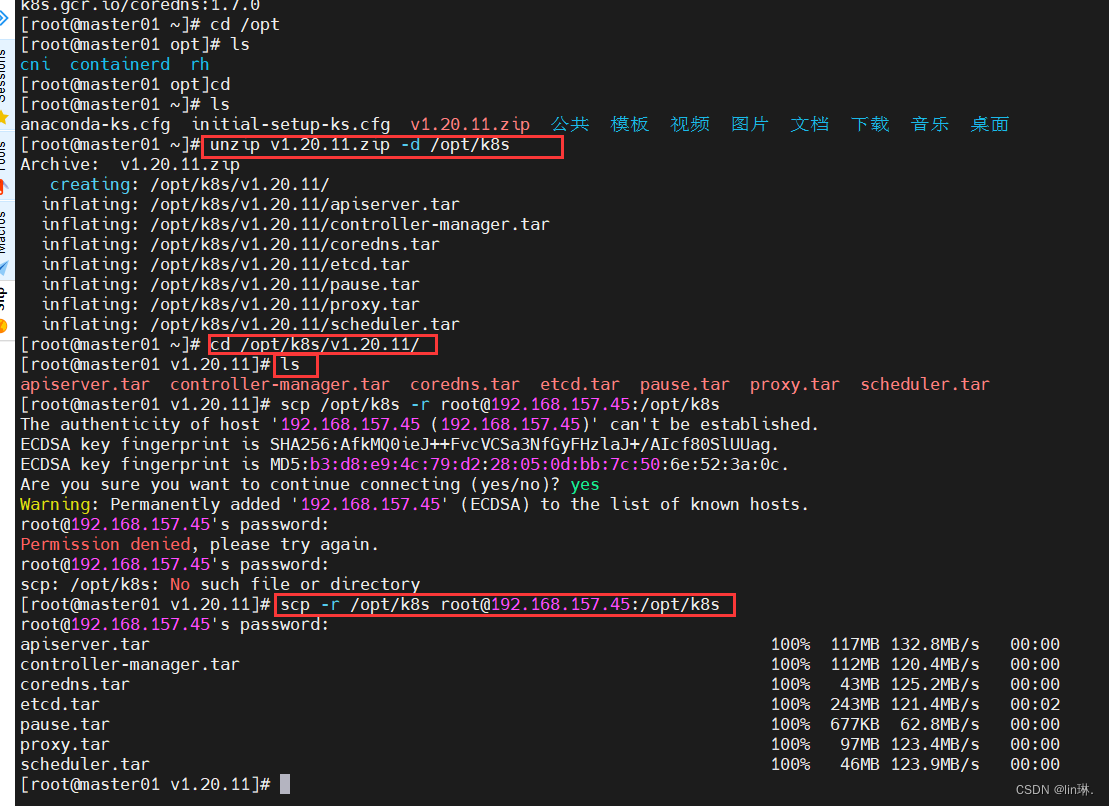

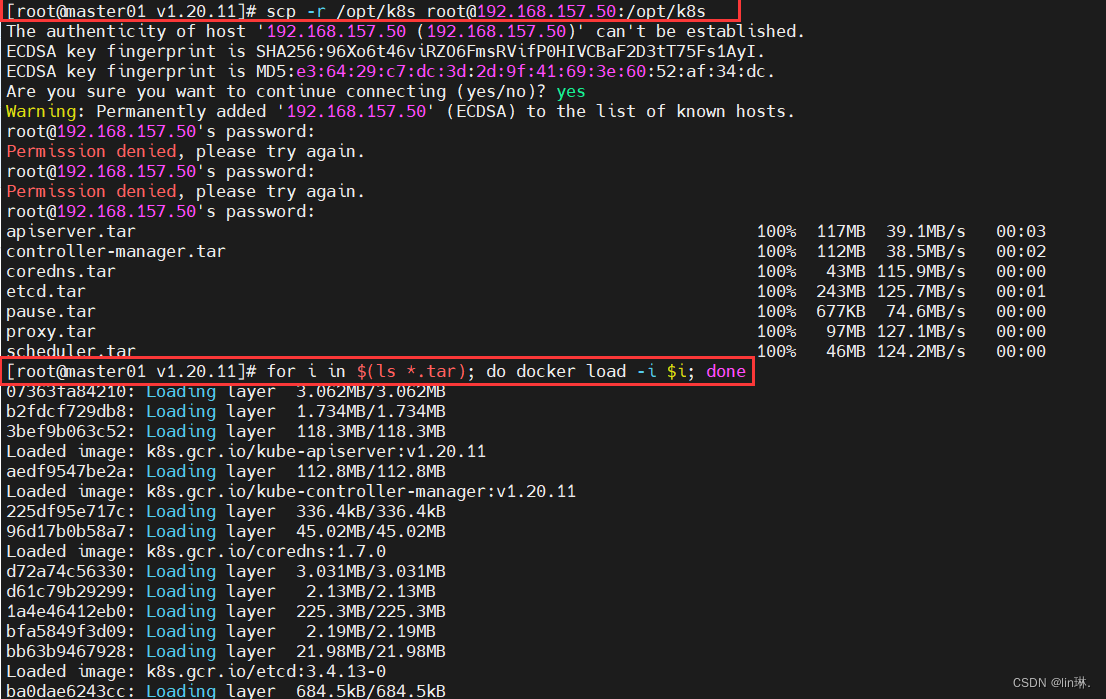

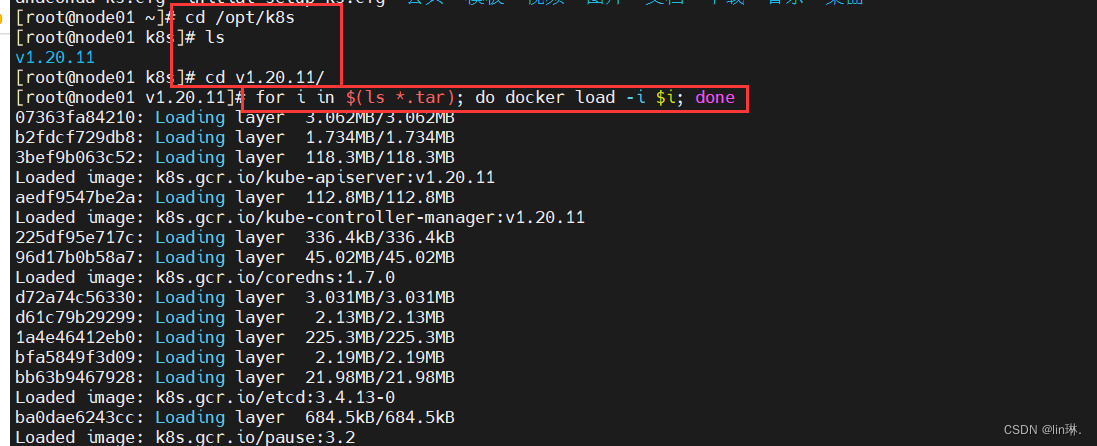

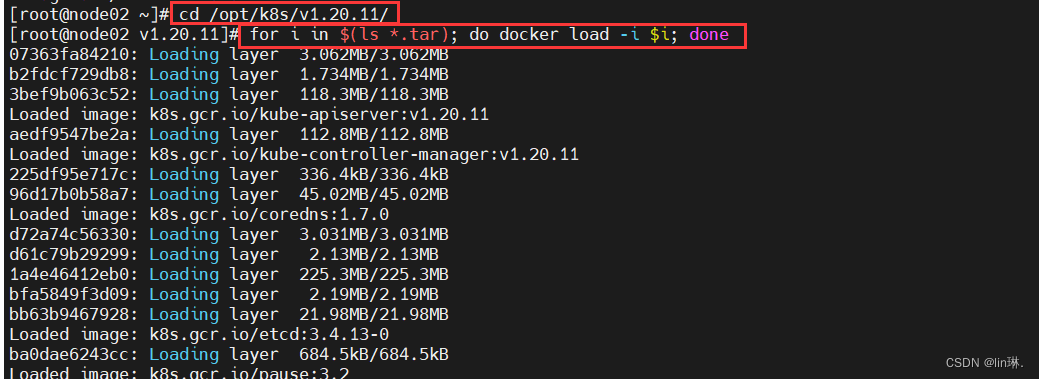

2、导入镜像

#在master节点上传v1.20.11.zip压缩包至/opt目录

unzip v1.20.11.zip -d /opt/k8s

cd /opt/k8s/v1.20.11

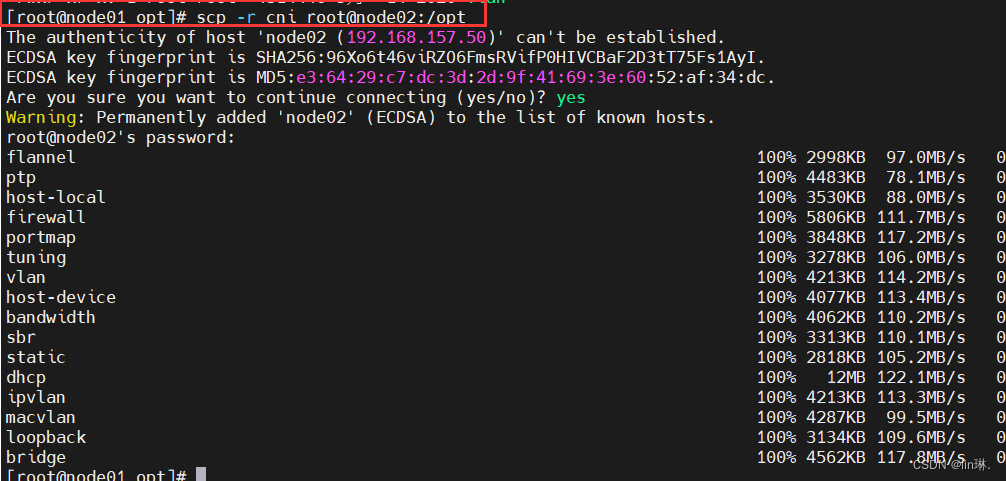

for i in $(ls *.tar); do docker load -i $i; done#复制镜像和脚本到node节点,并在node节点上执行脚本加载镜像文件

scp -r /opt/k8s root@node01:/opt

scp -r /opt/k8s root@node02:/opt

3、初始化kubeadm

3.1 方法一:通过修改配置文件初始化

#master节点上执行#生成kubeadm的配置模板

kubeadm config print init-defaults > /opt/kubeadm-config.yamlcd /opt/vim kubeadm-config.yaml

......

11 localAPIEndpoint:

12 advertiseAddress: 192.168.157.10 #指定master节点的IP地址

13 bindPort: 6443

......

34 kubernetesVersion: v1.20.11 #指定kubernetes版本号

35 networking:

36 dnsDomain: cluster.local

37 podSubnet: "10.244.0.0/16"

#指定pod网段,10.244.0.0/16用于匹配flannel默认网段

38 serviceeSubnet: 10.96.0.0/16 #指定service网段

39 scheduler: {}

#末尾再添加以下内容

---

apiVersion: kubeproxy.config.k8s.io/vlalphal

kind: KubeProxyConfiguration

mode: ipvs #把默认的kube-proxy调度方式改为ipvs模式kubeadm init --config=kubeadm-config.yaml --upload-certs | tee kubeadm-init.log

#--experimental-upload-certs 参数可以在后续执行加入节点时自动分发证书文件,K8S

V1.16版本开始替换为 --upload-certs

#tee kubeadm-init.log 用以输出日志//查看 kubeadm-init 日志

less kubeadm-init.log//kubernetes配置文件目录

ls /etc/kubernetes///存放ca等证书和密码的目录

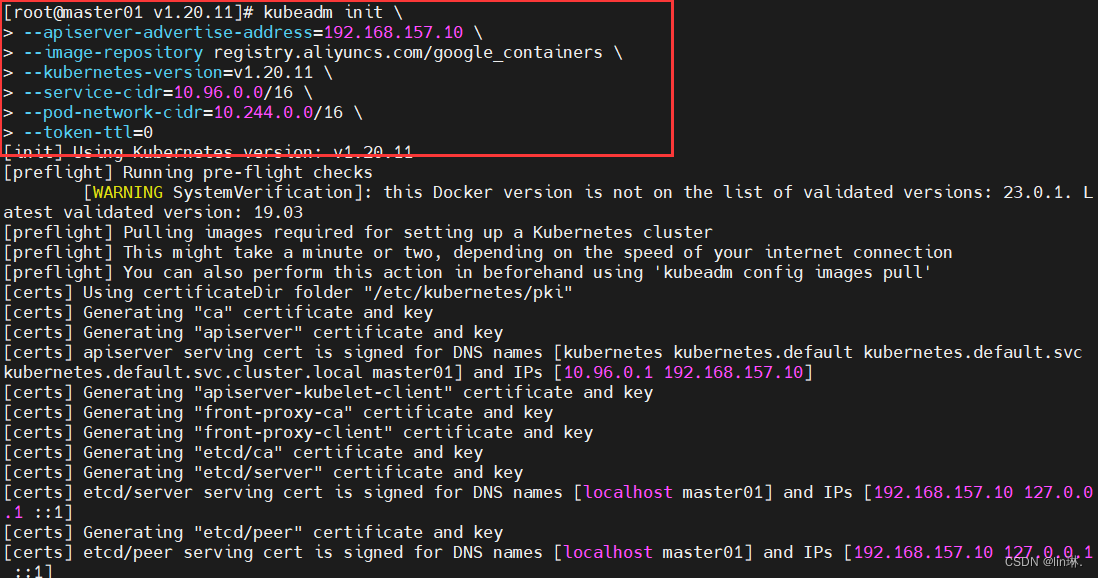

ls /etc/kubernetes/pki3.2 方法二:命令行

kubeadm init \

--apiserver-advertise-address=192.168.157.10 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version=v1.20.11 \

--service-cidr=10.96.0.0/16 \

--pod-network-cidr=10.244.0.0/16

--token-ttl=0

初始化集群需使用kubeadm init命令,可以指定具体参数初始化,也可以指定配置文件初始化。

可选参数:

--apiserver-advertise-address:apiserver通告给其他组件的IP地址,一般应该为Master节点的用于集群内部通信的IP地址,0.0.0.0表示节点上所有可用地址

--apiserver-bind-port:apiserver的监听端口,默认是6443

--cert-dir:通讯的ssl证书文件,默认/etc/kubernetes/pki

--control-plane-endpoint:控制台平面的共享终端,可以是负载均衡的ip地址或者dns域名,高可用集群时需要添加

--image-repository:拉取镜像的镜像仓库,默认是k8s.gcr.io

--kubernetes-version:指定kubernetes版本

--pod-network-cidr:pod资源的网段,需与pod网络插件的值设置一致。通常,Flannel网络插件的默认为10.244.0.0/16,Calico插件的默认值为192.168.0.0/16;

--service-cidr:service资源的网段

--service-dns-domain:service全域名的后缀,默认是cluster.local

--token-ttl: 默认token的有效期为24小时,如果不想过期,可以加上:--token-ttl=0 这个参数

-----------------------------------------------------------------

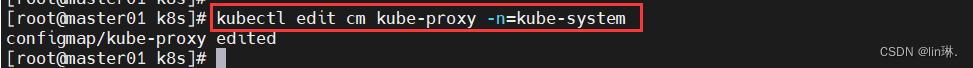

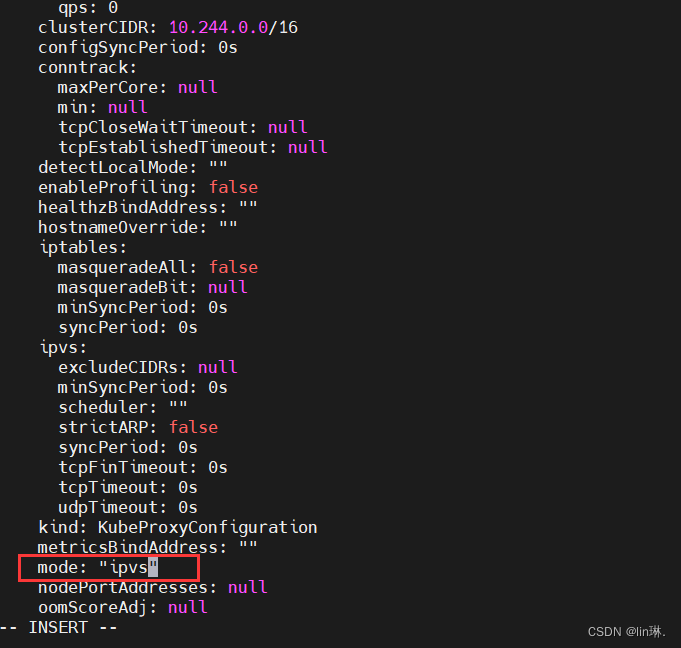

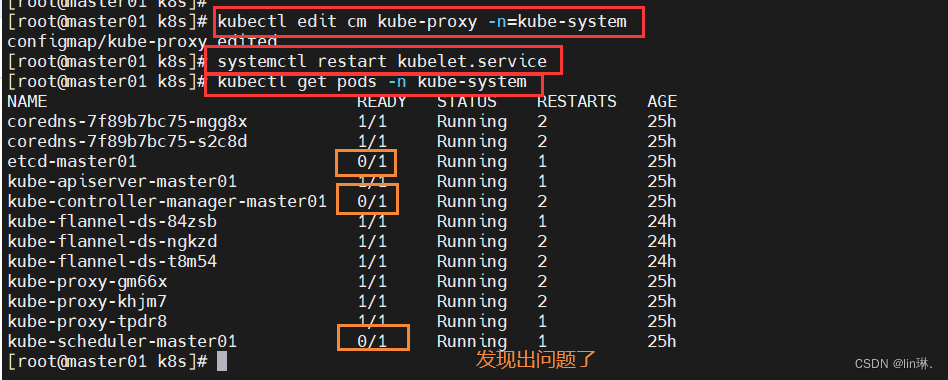

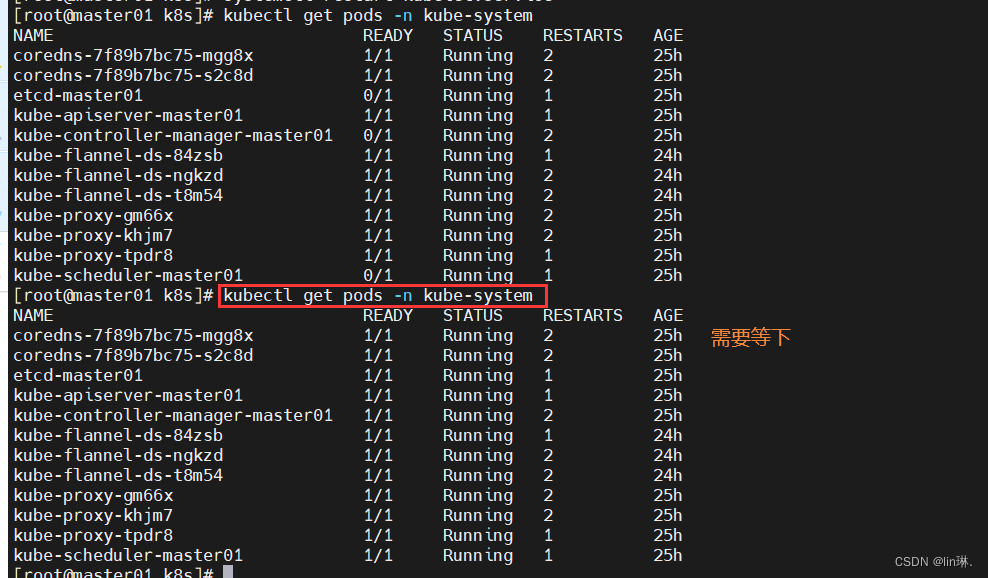

方法二初始化后需要修改kube-proxy的configmap,开启ipvs

kubectl edit cm kube-proxy -n=kube-system

修改mode: ipvs

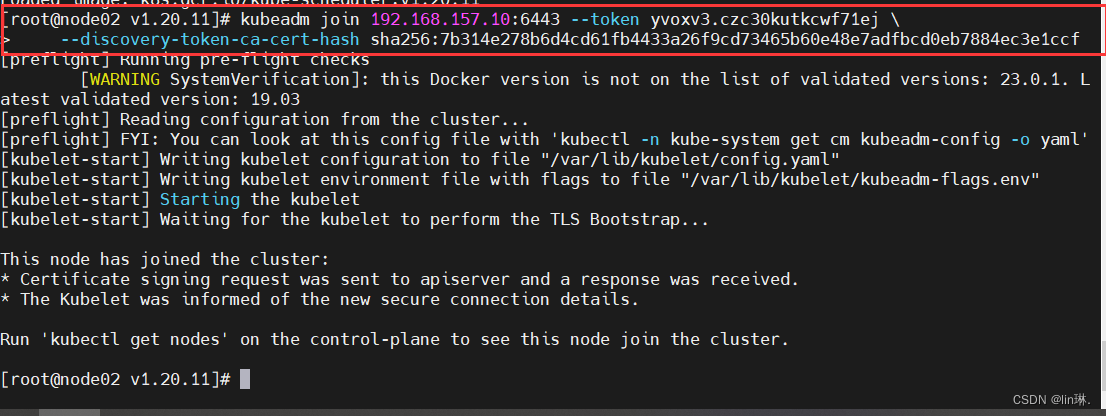

//设定kubect1kubectl需经山API server认证及授权后方能执行相应的管理操作,kubeadm部署的集群为其生成了一个具有管理员权限的认证配置文件 /etc/kubernetes/admin,conf,它可由kubectl 通过默认的“SHOME/.kube/config”的路径进行加载。

mkdir-p SHOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config#需要修改 kube-proxy 的 configmap,开启 ipvs

kubectl edit cm kube-proxy -n=kube-system

修改mode: ipvs--------------------------------------------------

提示:

......

Your Kubernetes control-plane has initialized successfully!

To start using your cluster, you need to run the following as a regular user:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

Alternatively, if you are the root user, you can run:

export KUBECONFIG=/etc/kubernetes/admin.conf

You should now deploy a pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:

https://kubernetes.io/docs/concepts/cluster-administration/addons/

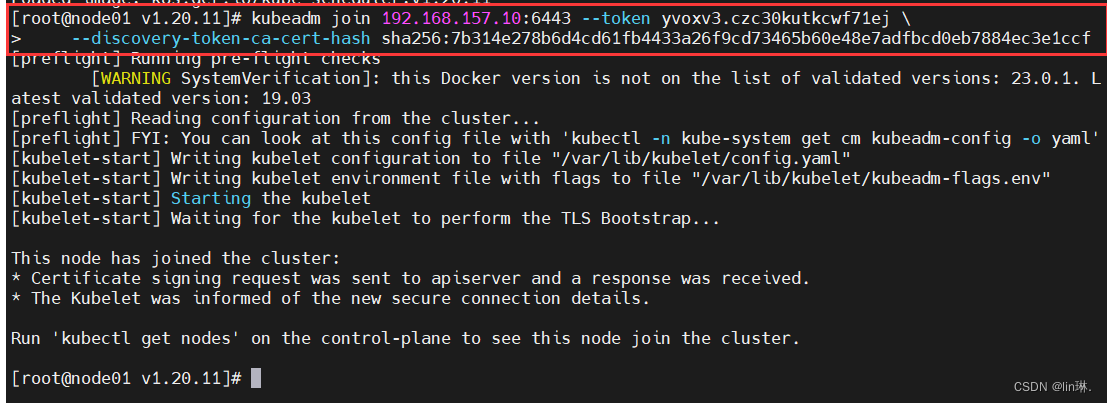

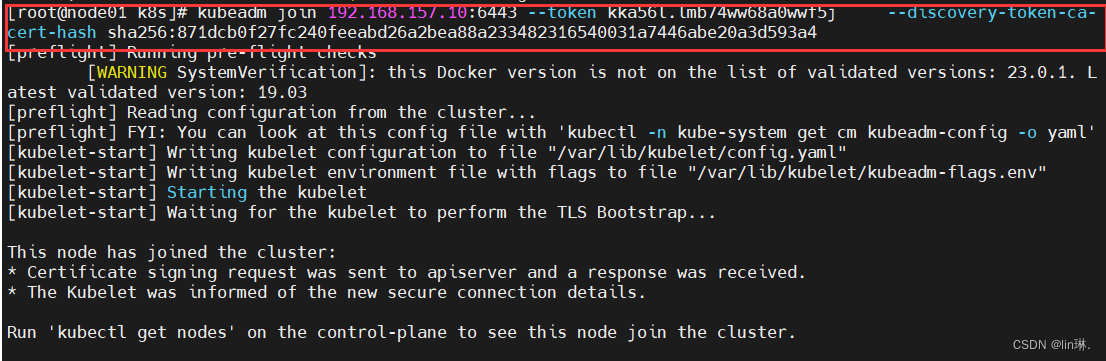

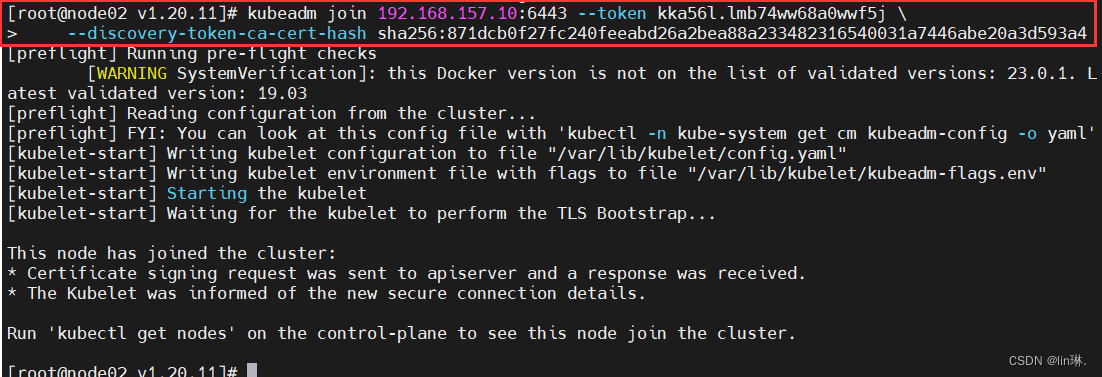

Then you can join any number of worker nodes by running the following on each as root:

kubeadm join 192.168.10.19:6443 --token wfjo7j.baa0aheyw39w3m7h \

--discovery-token-ca-cert-hash sha256:77100ff66b20100cbd9f1c289788e43aee69c5b4e24cc2c74c2e5d634a074fdc

----------------------------------------------------------

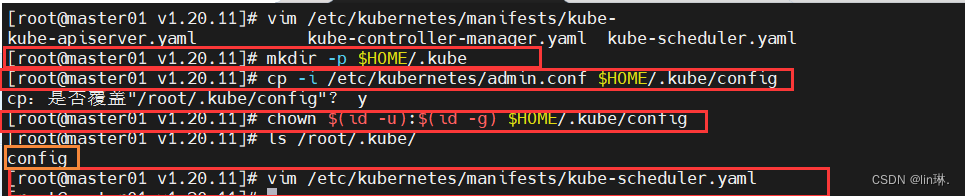

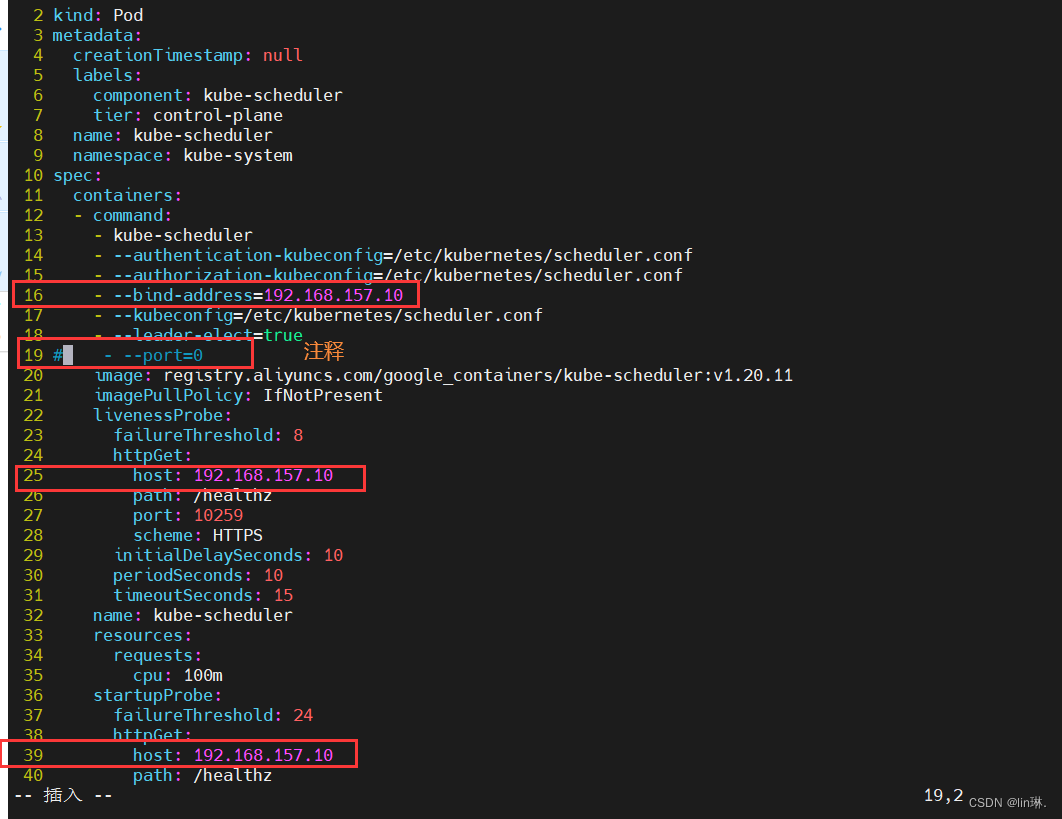

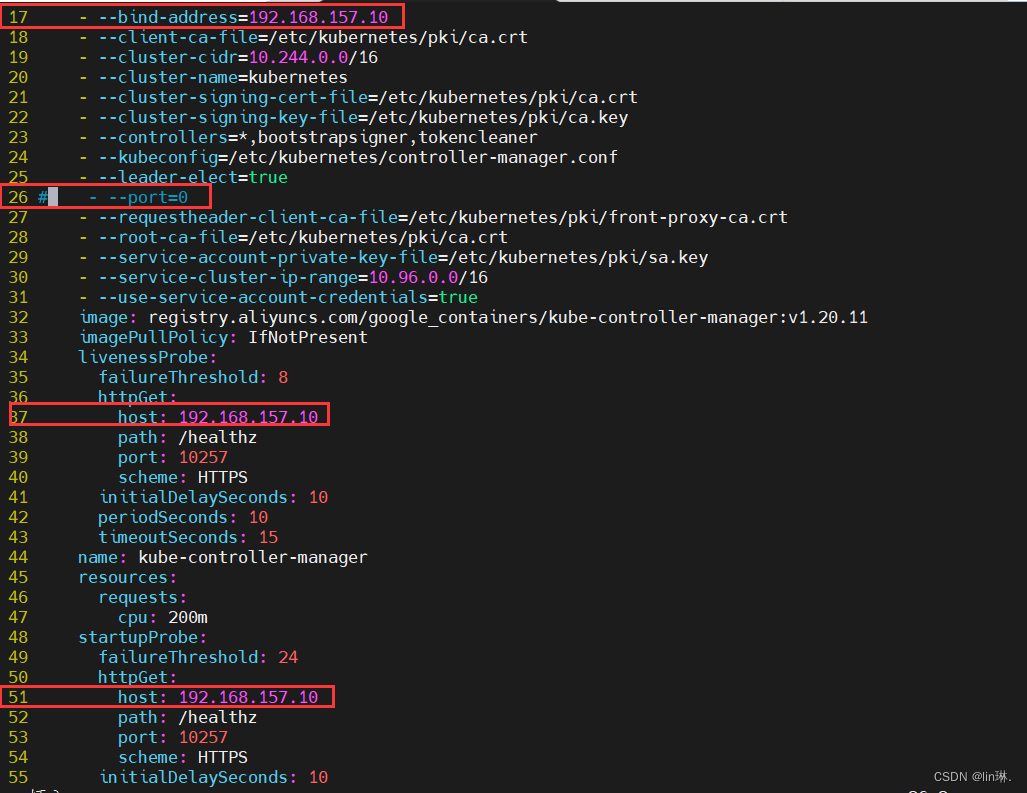

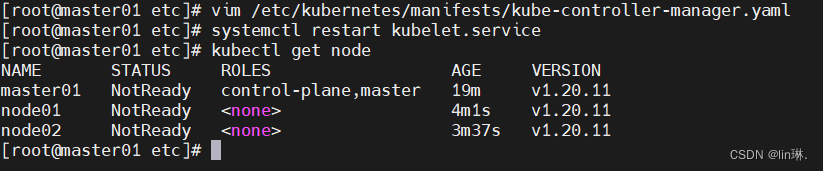

//如果 kubectl get cs 发现集群不健康,更改以下两个文件

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

#修改如下内容

把--bind-address=127.0.0.1变成--bind-address=192.168.157.10

#修改成k8s的控制节点master01的ip

把httpGet:字段下的hosts由127.0.0.1变成192.168.157.10 (有两处)

#- --port=0 # 搜索port=0,把这一行注释掉

systemctl restart kubelet

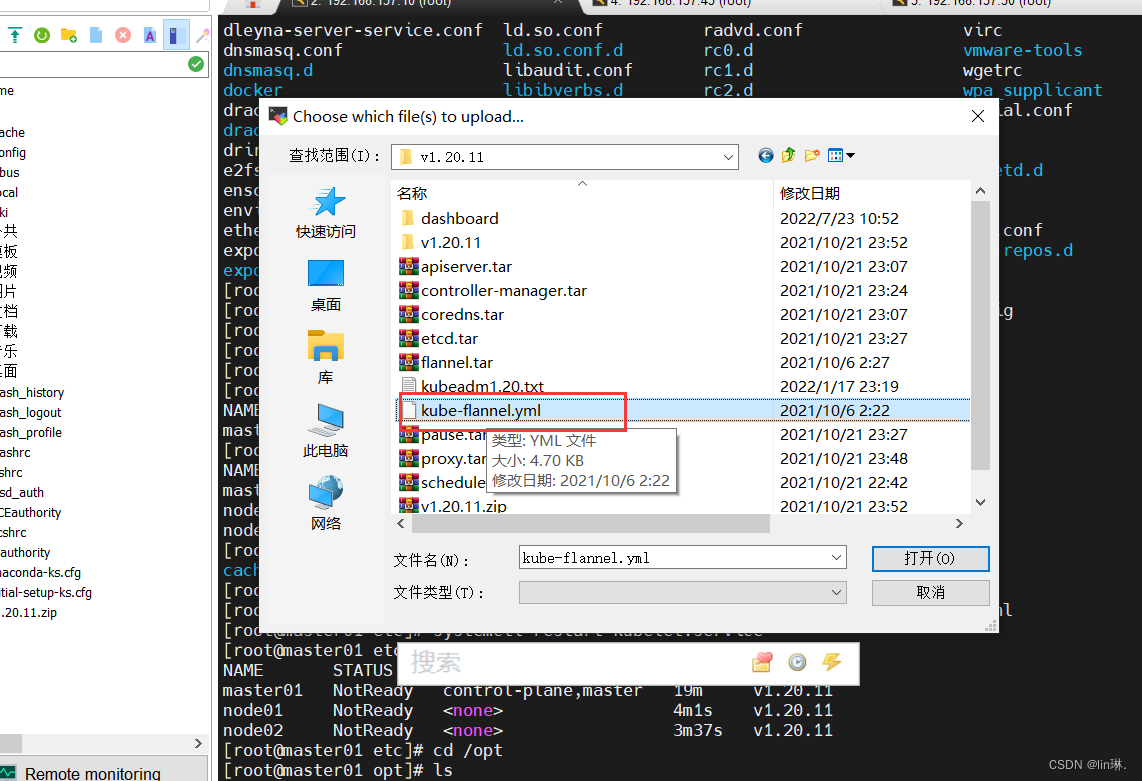

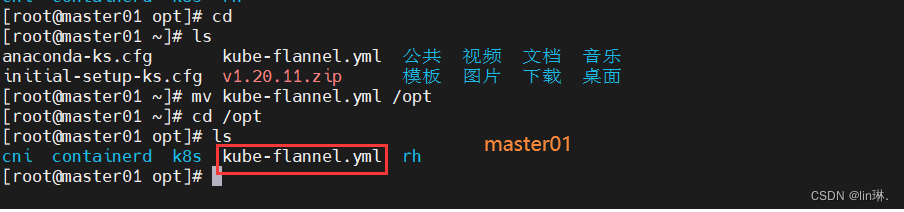

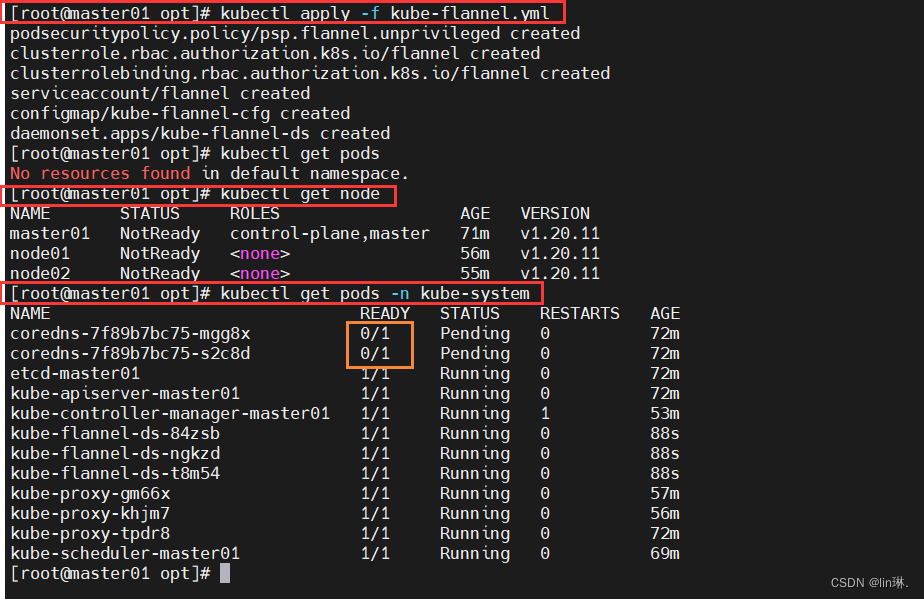

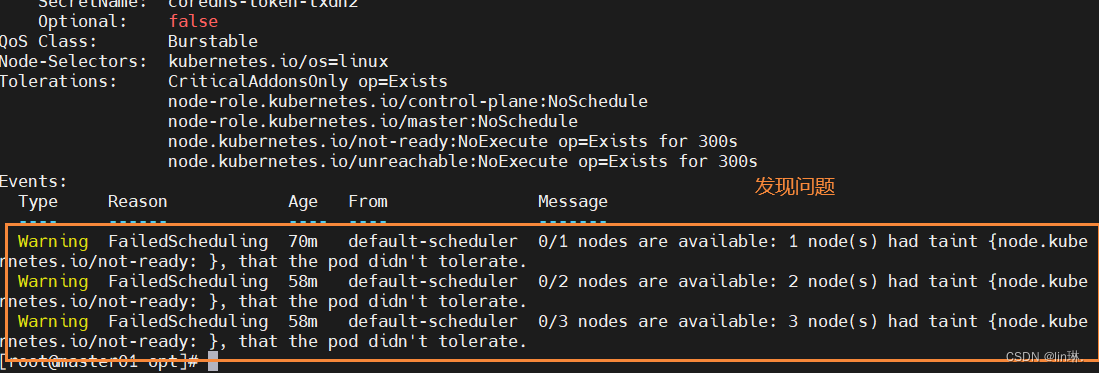

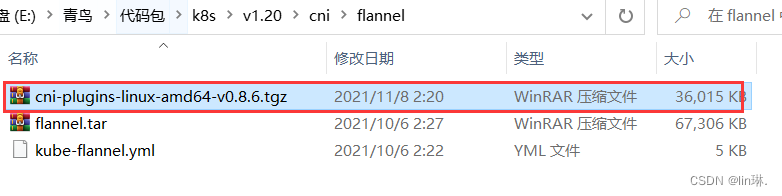

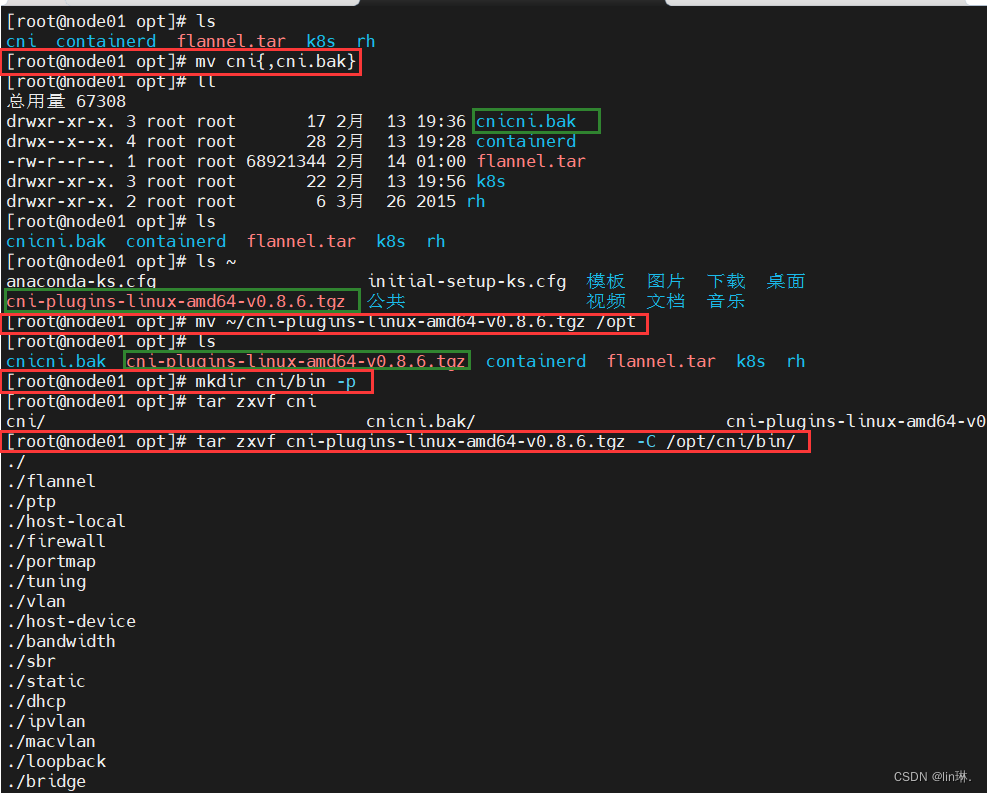

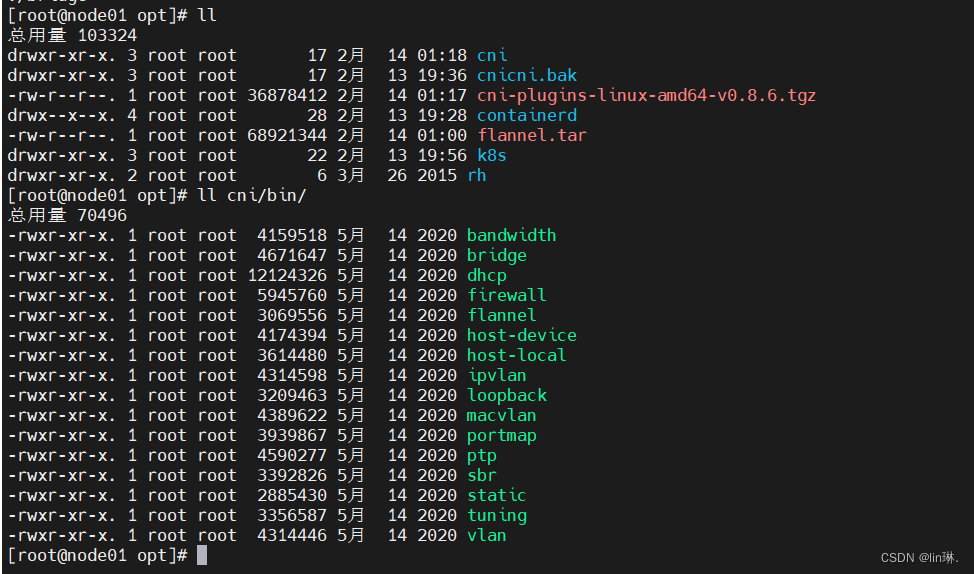

五、所有节点部署网络插件flannel

1、部署flannel

1.1 方法一

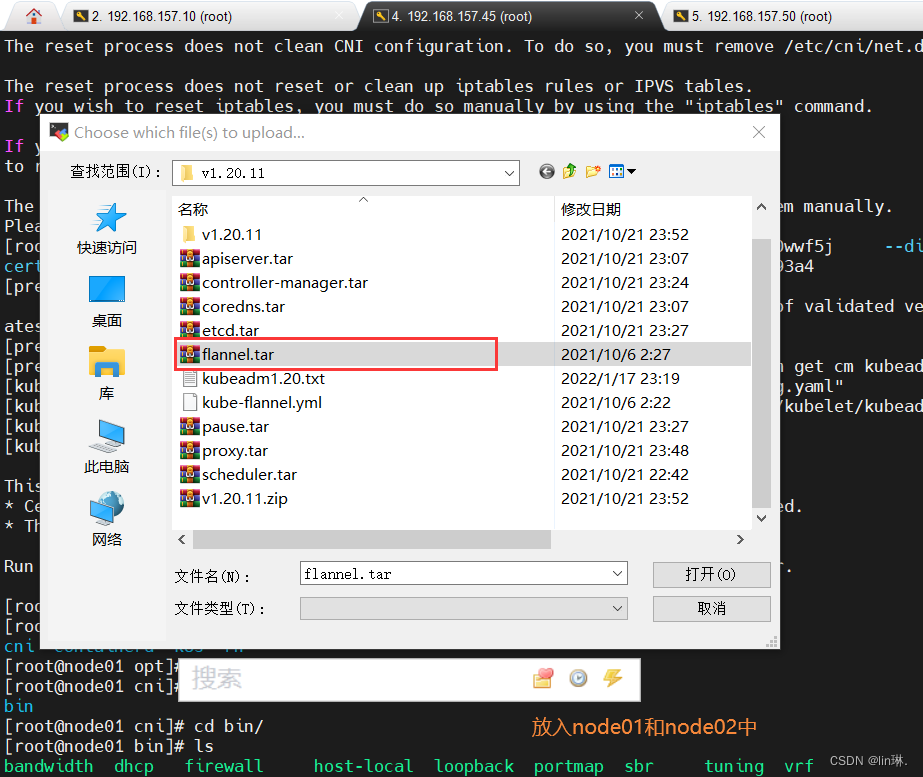

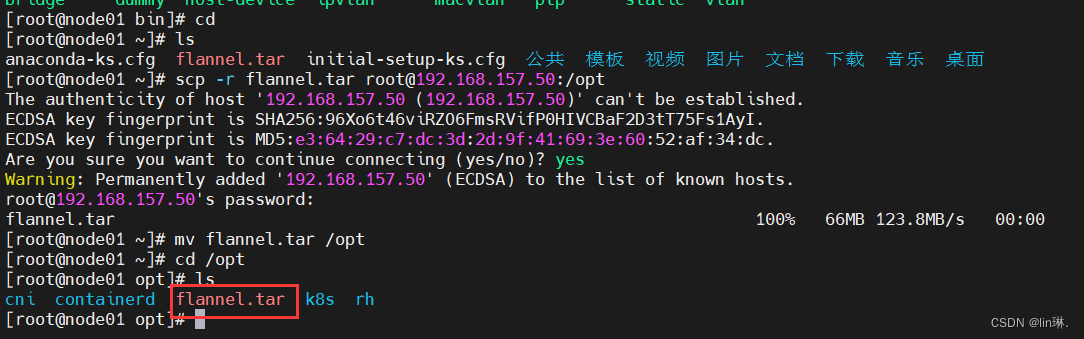

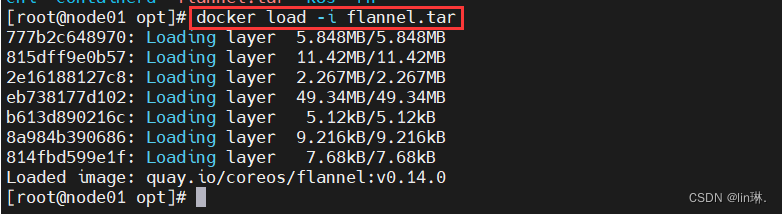

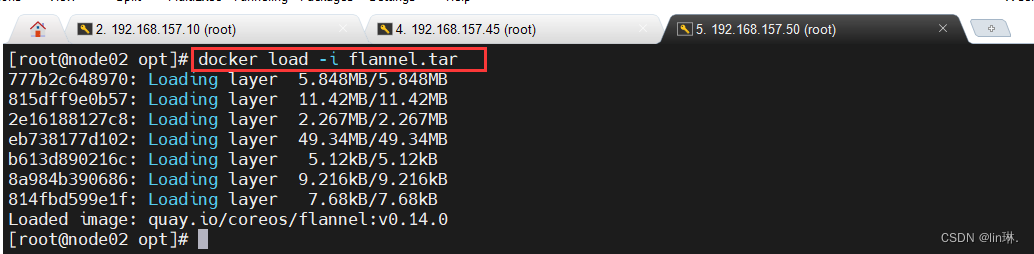

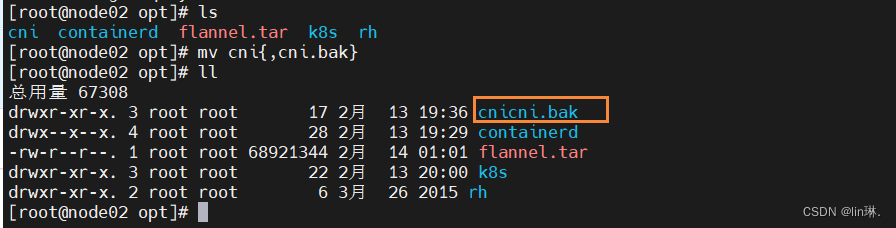

#所有节点上传flannel镜像 flannel.tar 到 /opt 目录,master节点上传 kube-flannel.yml 文件

ls /opt/flannel.tar

cd /opt

docker load < flannel.tar#在 master 节点创建 flannel 资源

kubectl apply -f kube-flannel.yml

1.2 方法二

#master 执行

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

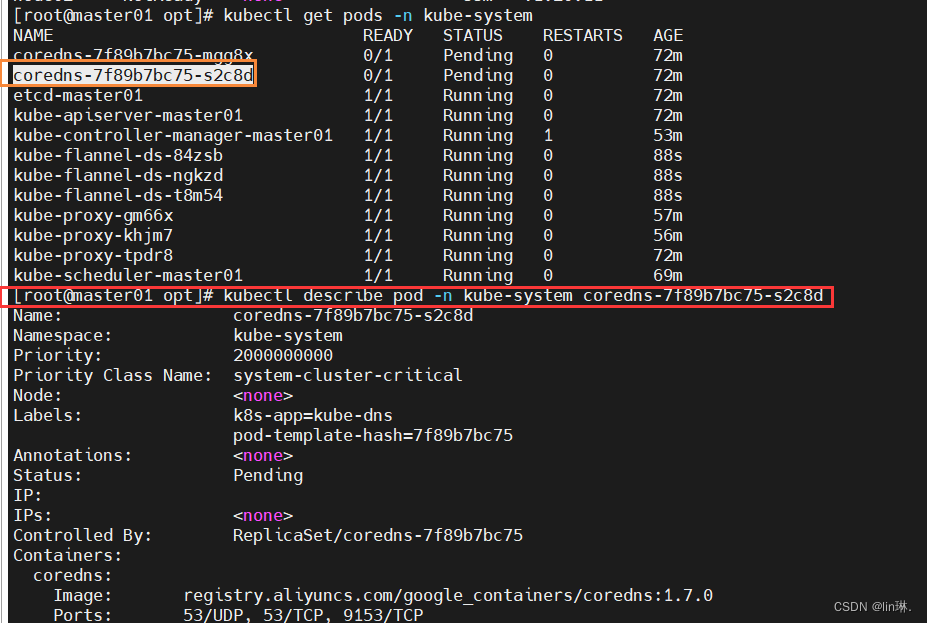

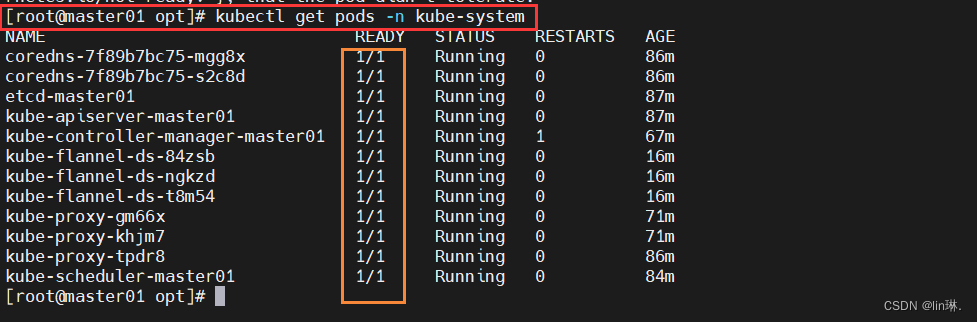

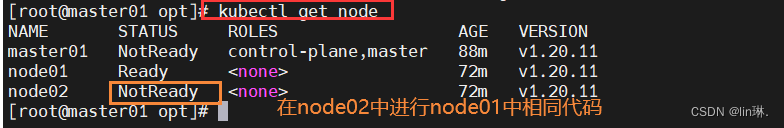

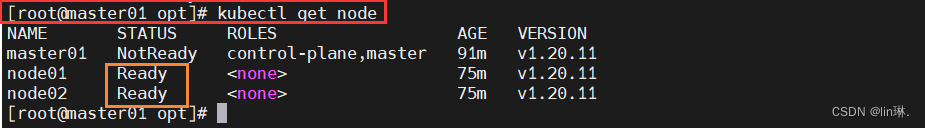

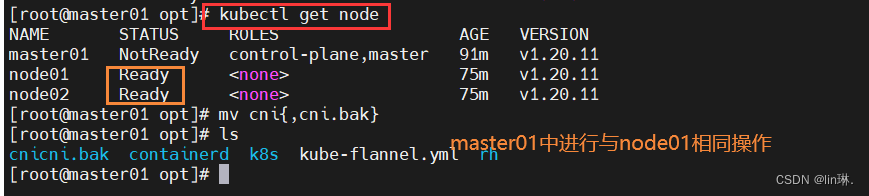

2、测试

#在master节点查看节点状态(需要等几分钟)

kubectl get nodes

#master节点上

kubectl get pods -n kube-system

#测试 pod 资源创建

kubectl create deployment nginx --image=nginx

#查看资源

kubectl get pods -o wide

#暴露端口提供服务

kubectl expose deployment nginx --port=80 --type=NodePortkubectl get svc

//测试访问

curl http://node01:32404

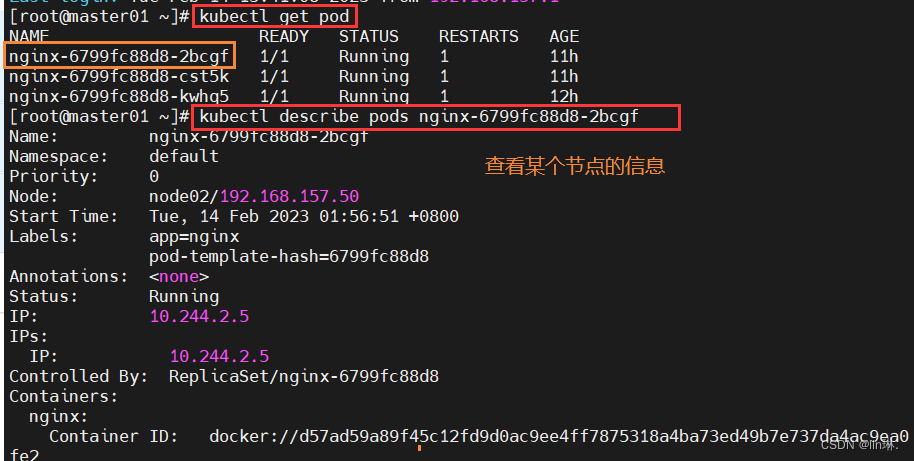

查看某个节点信息

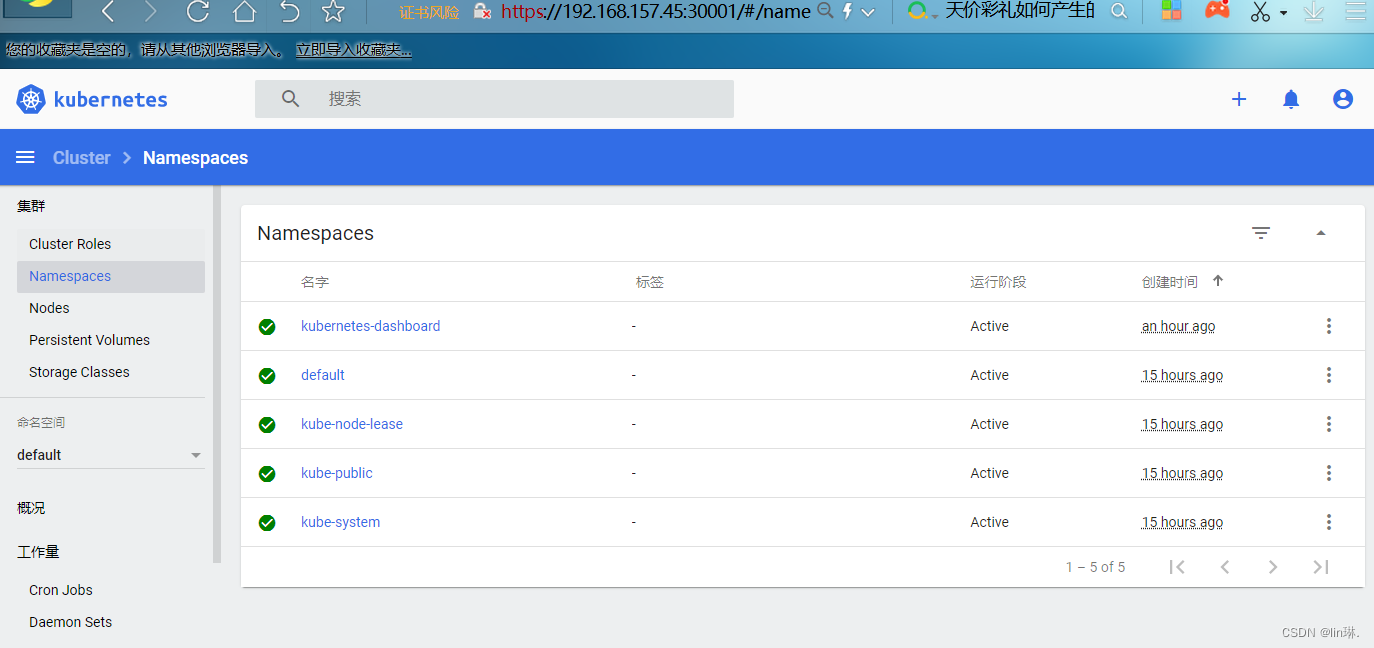

六、安装dashboard

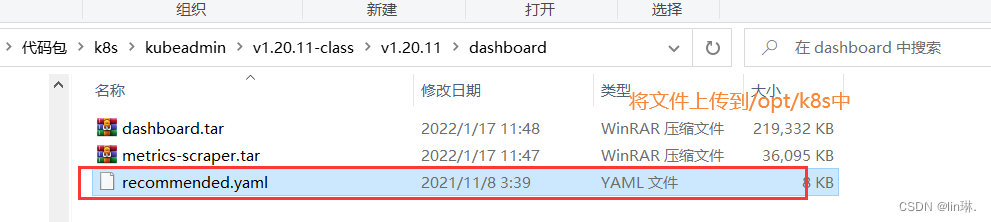

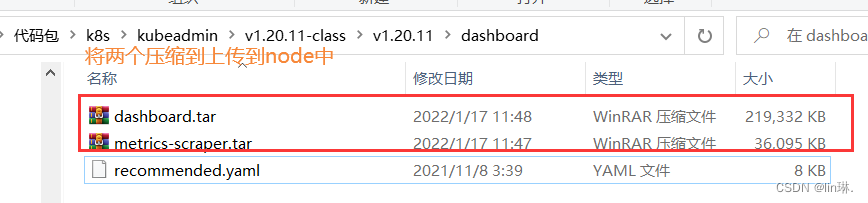

1、所有节点安装dashboard

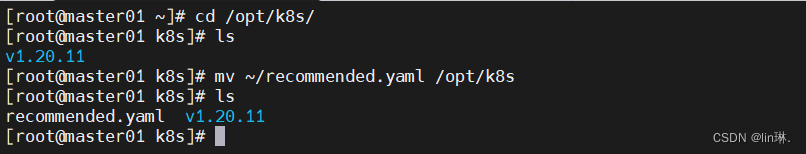

//在 master01 节点上操作

#上传 recommended.yaml 文件到 /opt/k8s 目录中

cd /opt/k8s

vim recommended.yaml

#默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部:

kind: Service

apiVersion: v1

metadata:labels:k8s-app: kubernetes-dashboardname: kubernetes-dashboardnamespace: kubernetes-dashboard

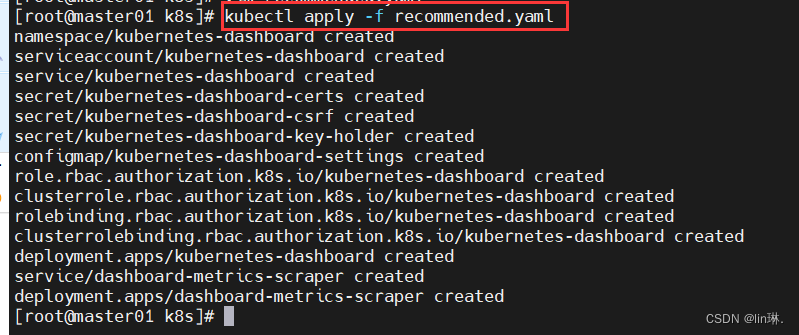

spec:ports:- port: 443targetPort: 8443nodePort: 30001 #添加type: NodePort #添加selector:k8s-app: kubernetes-dashboardkubectl apply -f recommended.yaml

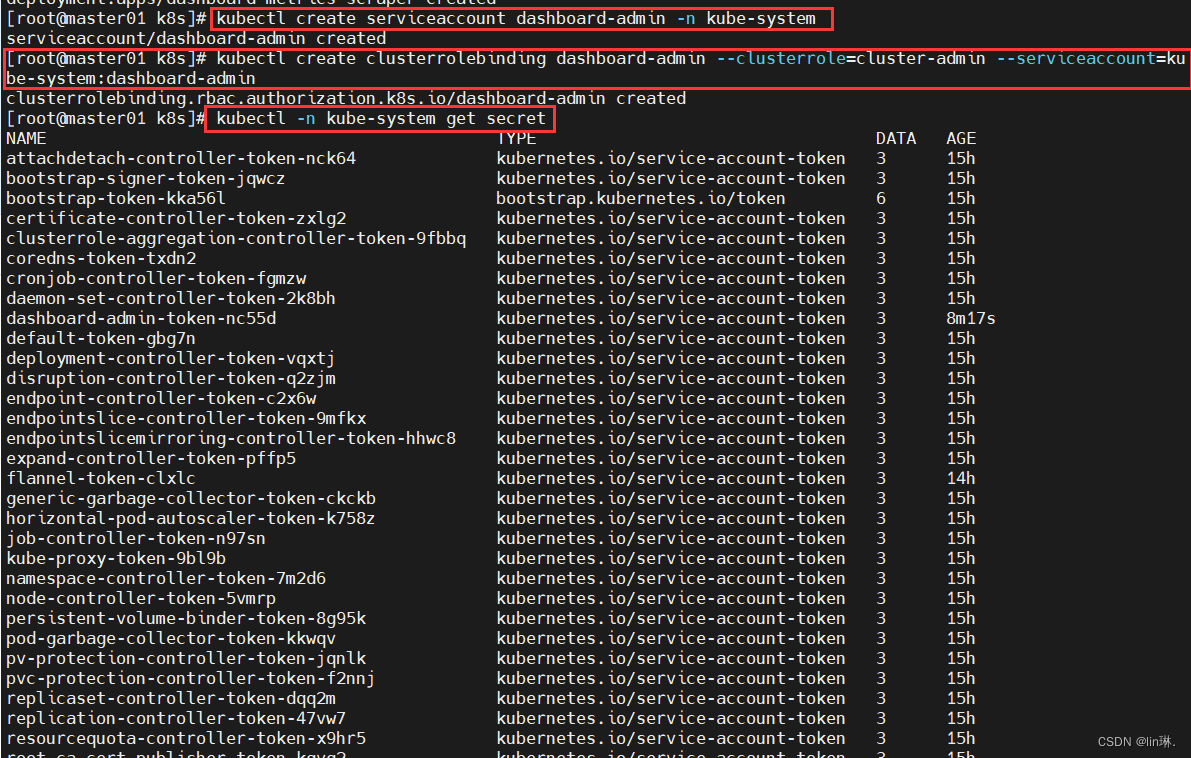

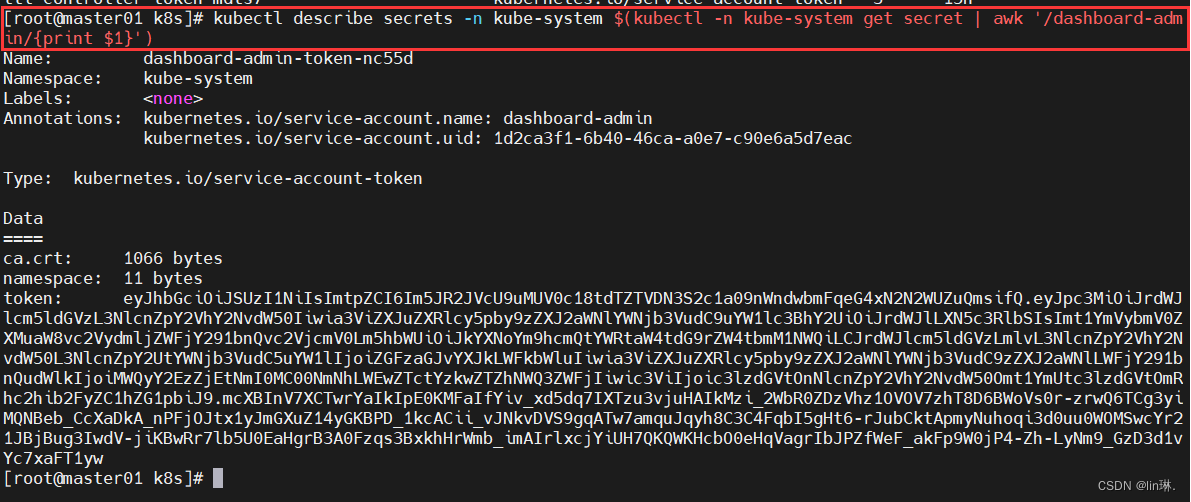

#创建service account并绑定默认cluster-admin管理员集群角色

kubectl create serviceaccount dashboard-admin -n kube-system

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}')#使用输出的token登录Dashboard

https://NodeIP:30001

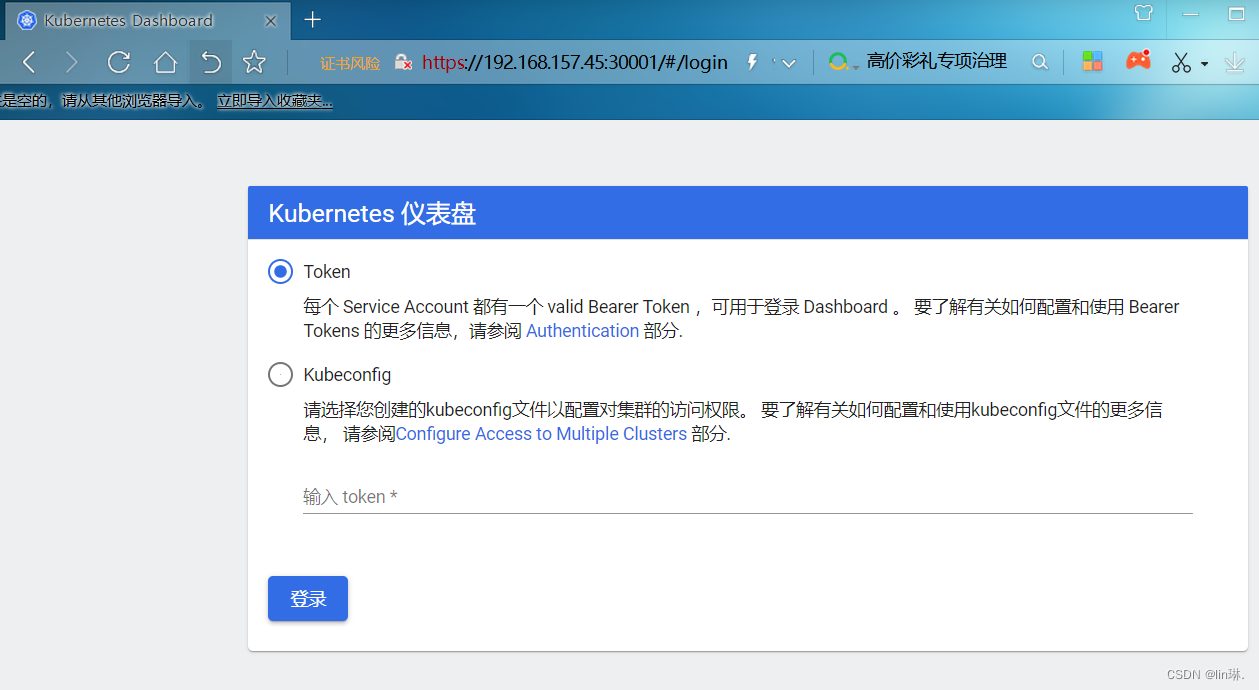

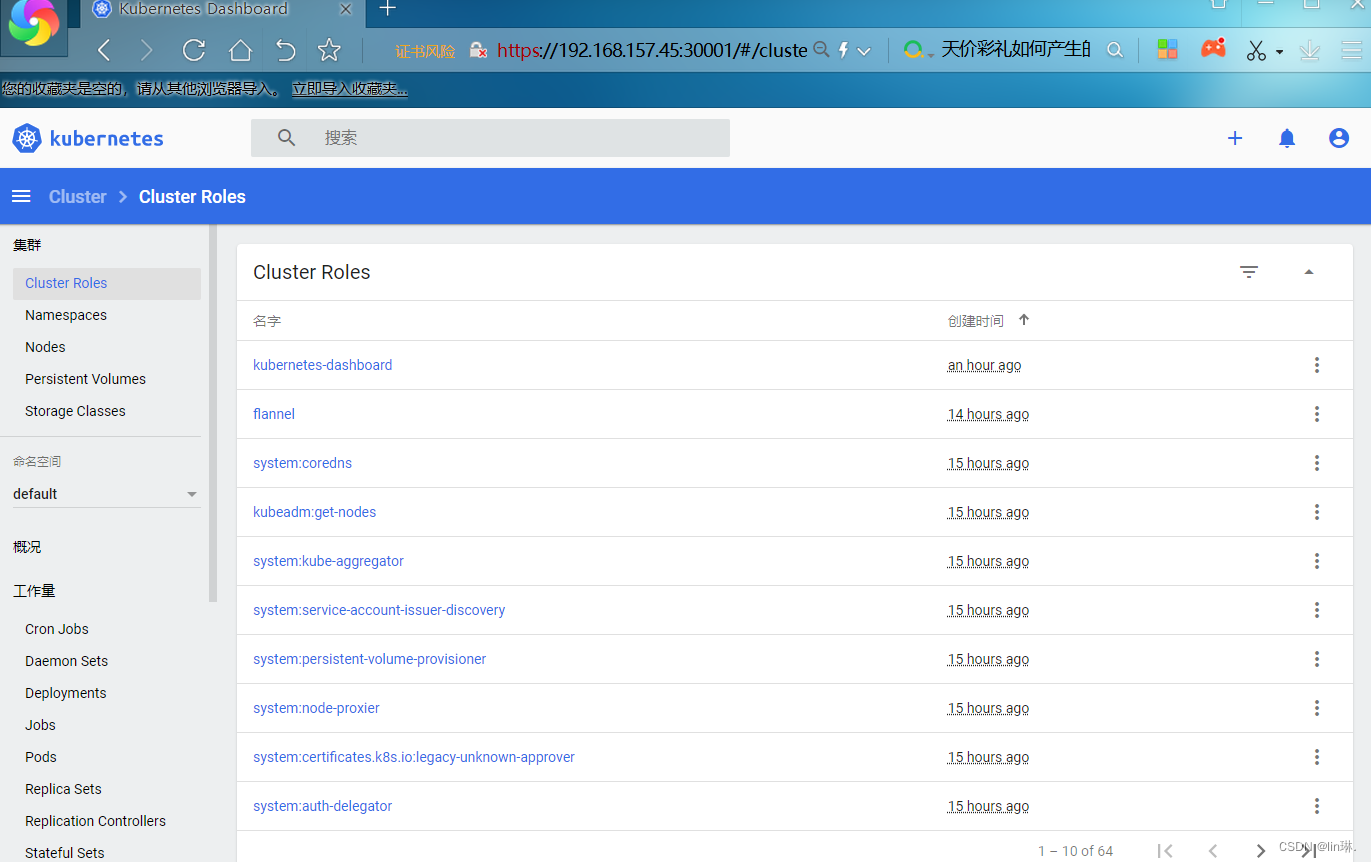

2、测试

七 安装Harbor私有仓库

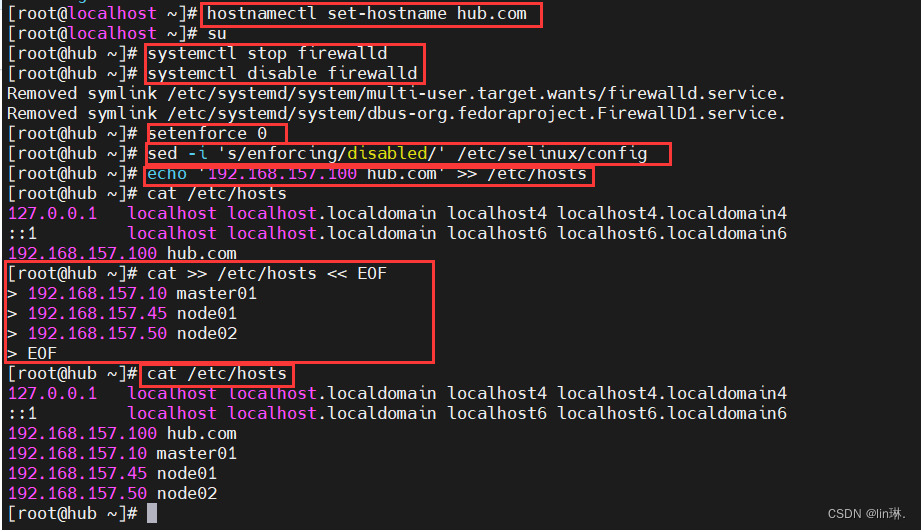

1、harbor 节点环境准备

#修改主机名

hostnamectl set-hostname hub.com#关闭firewalld防火墙和selinux

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config#所有节点加上主机名映射

echo '192.168.157.100 hub.com' >> /etc/hosts

cat >> /etc/hosts << EOF

192.168.157.10 master01

192.168.157.45 node01

192.168.157.50 node02

EOF

#harboe节点安装docker

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.iomkdir /etc/docker

#所有 node 节点都修改 docker 配置文件,加上私有仓库配置

cat > /etc/docker/daemon.json <<EOF

{"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],"exec-opts": ["native.cgroupdriver=systemd"],"log-driver": "json-file","log-opts": {"max-size": "100m"},"insecure-registries": ["https://hub.com"]

}

EOFsystemctl daemon-reload

systemctl restart docker

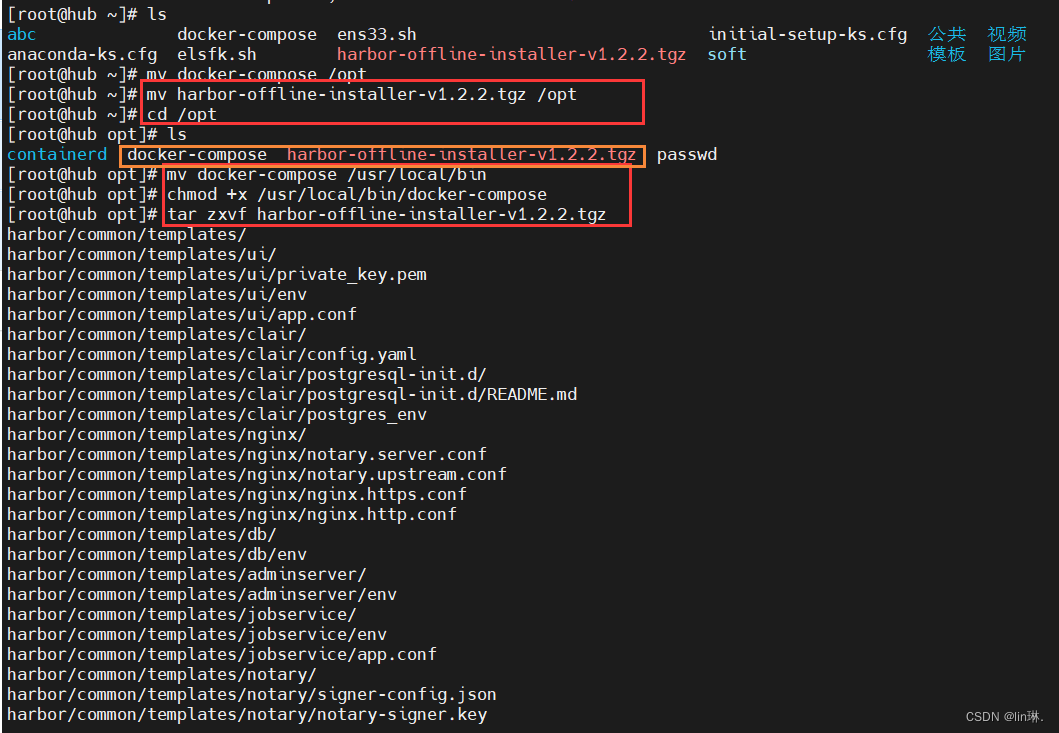

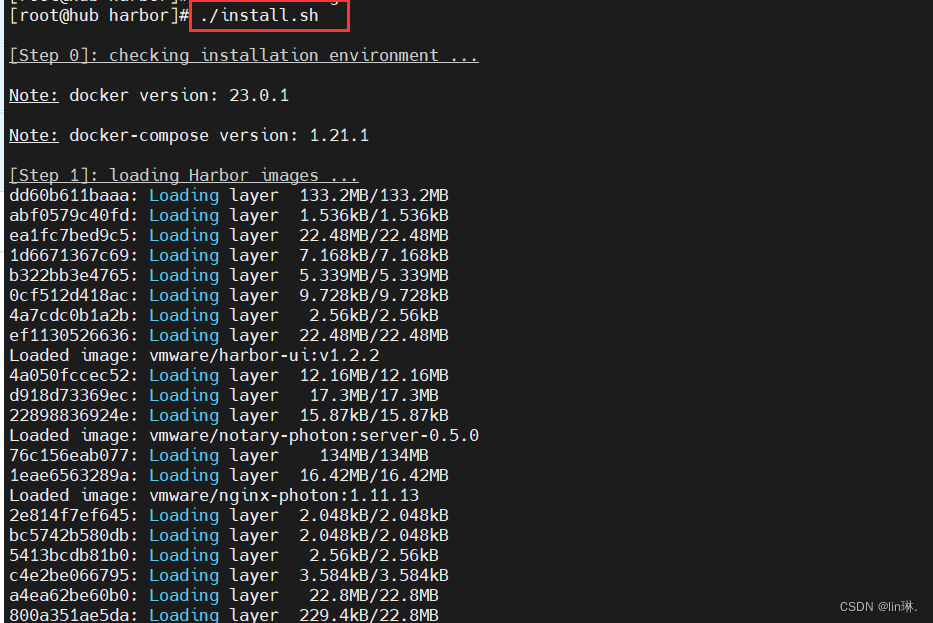

2、安装 Harbor

#上传 harbor-offline-installer-v1.2.2.tgz 和 docker-compose 文件到 /opt 目录

cd /opt

cp docker-compose /usr/local/bin/

chmod +x /usr/local/bin/docker-composetar zxvf harbor-offline-installer-v1.2.2.tgz

cd harbor/

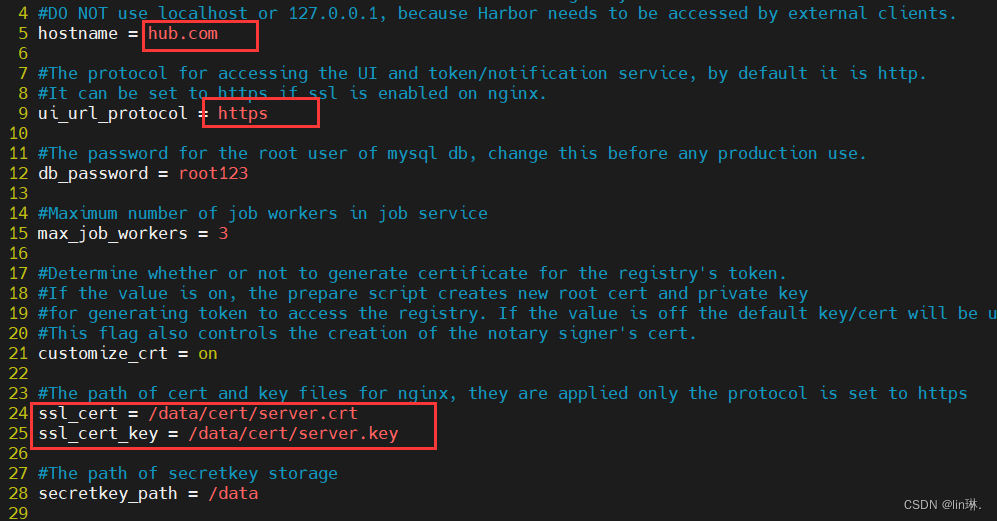

vim harbor.cfg

5// hostname = hub.com

9// ui_url_protocol = https

24// ssl_cert = /data/cert/server.crt

25// ssl_cert_key = /data/cert/server.key

59// harbor_admin_password = Harbor12345

3、生成证书

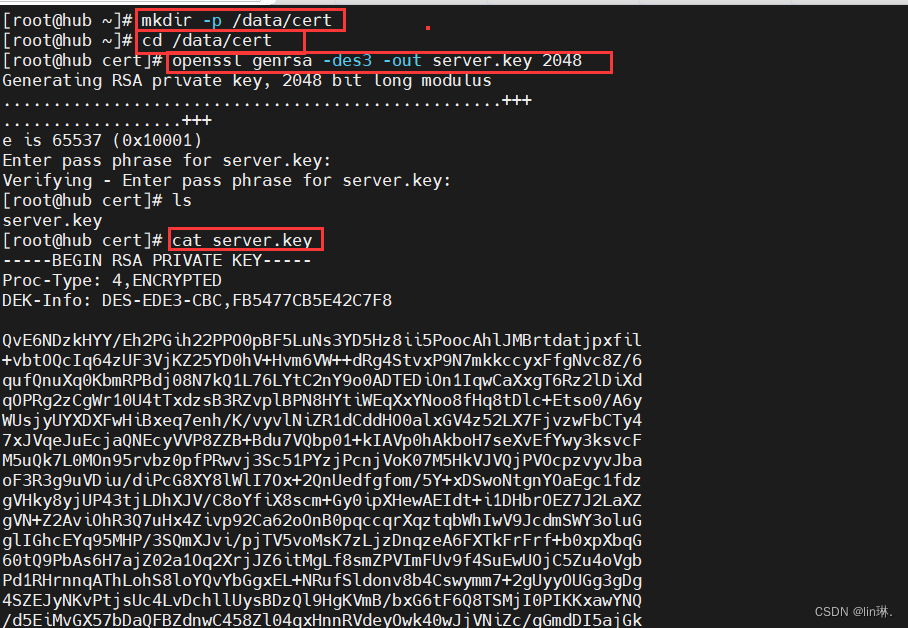

mkdir -p /data/cert

cd /data/cert

#生成私钥

openssl genrsa -des3 -out server.key 2048

输入两遍密码:123456#生成证书签名请求文件

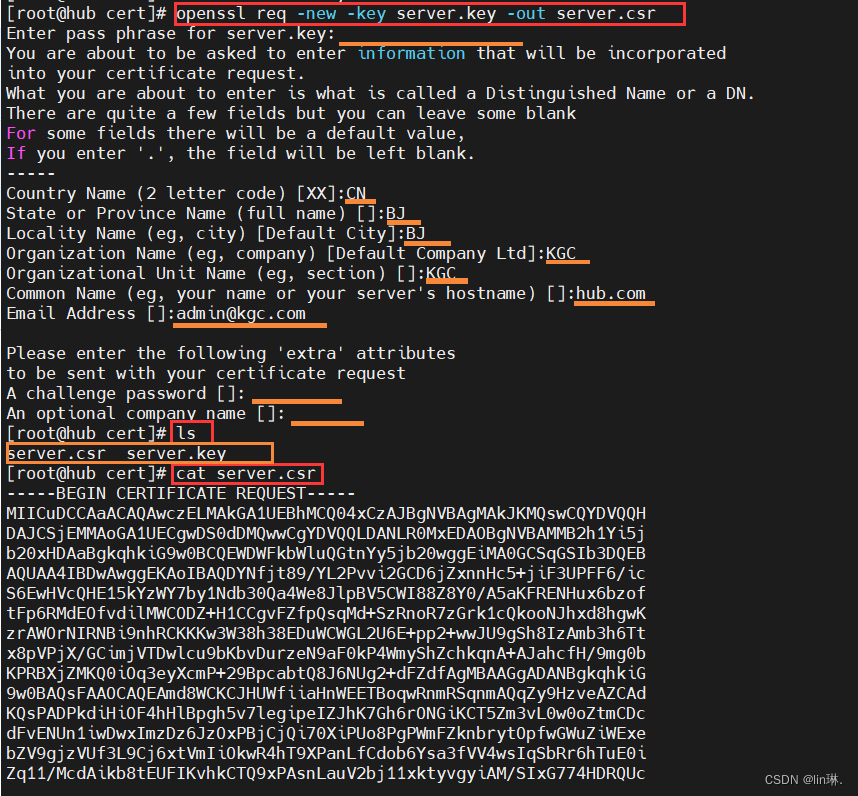

openssl req -new -key server.key -out server.csr

输入私钥密码:123456

输入国家名:CN

输入省名:BJ

输入市名:BJ

输入组织名:KGC

输入机构名:KGC

输入域名:hub.com

输入管理员邮箱:admin@kgc.com

其它全部直接回车#查看证书

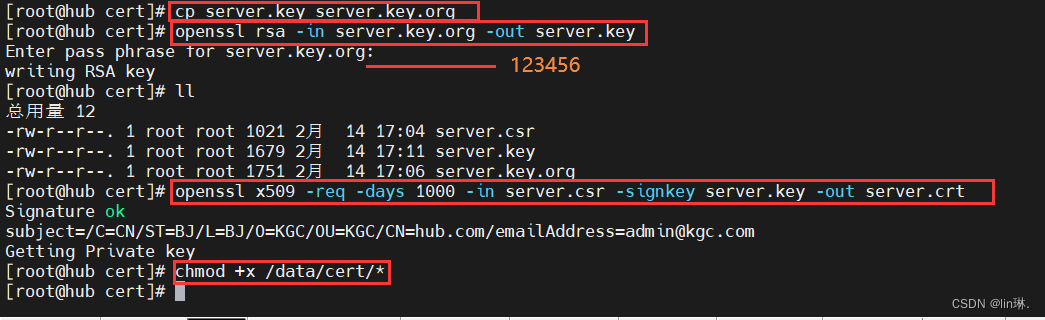

cat server.csr#备份私钥

cp server.key server.key.org#清除私钥密码

openssl rsa -in server.key.org -out server.key

输入私钥密码:123456#签名证书

openssl x509 -req -days 1000 -in server.csr -signkey server.key -out server.crtchmod +x /data/cert/*cd /opt/harbor/

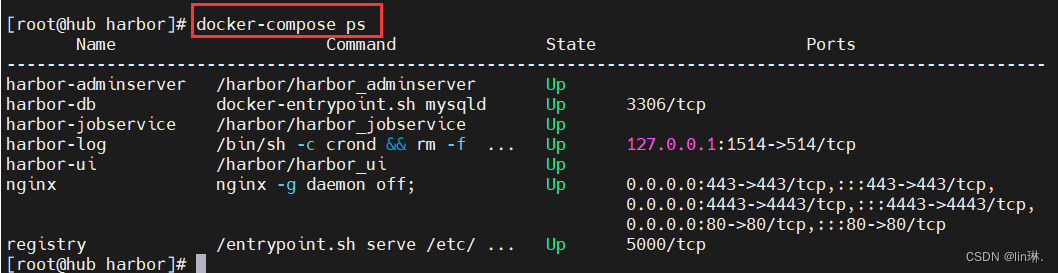

./install.sh

4、登录测试

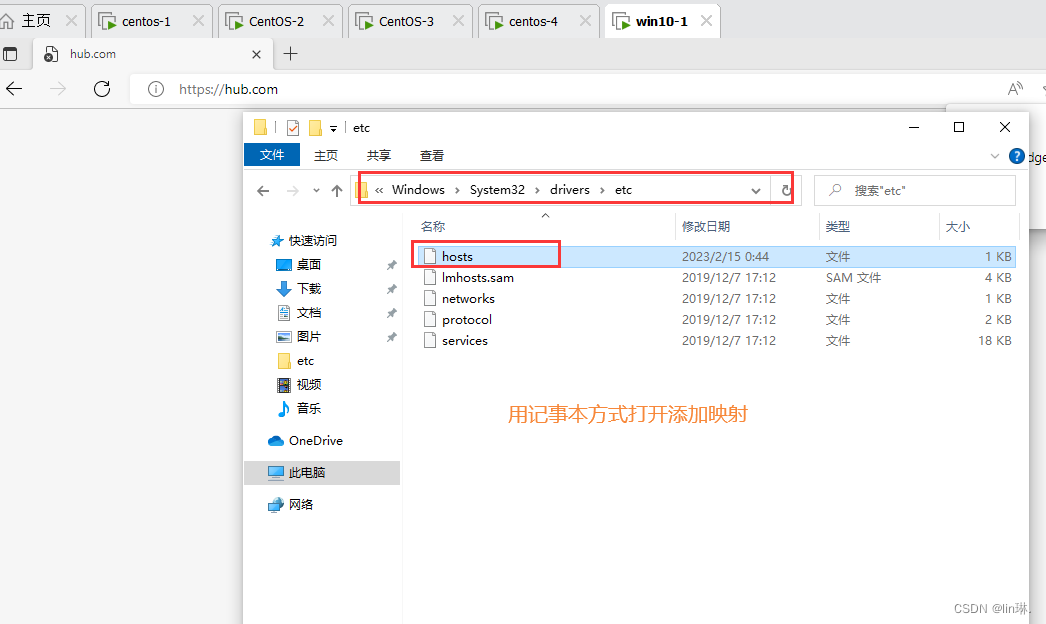

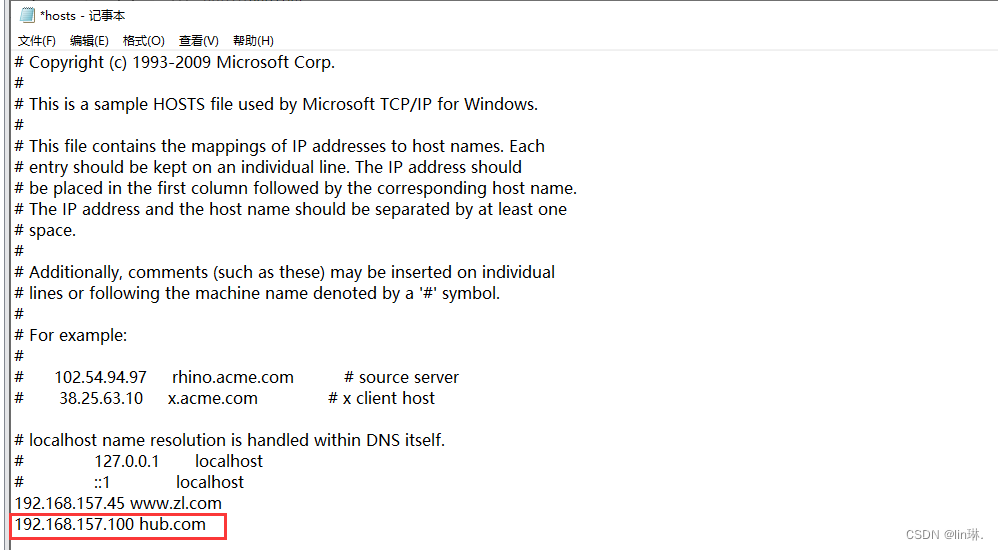

4.1 浏览器登录

浏览器访问:https://hub.com ,或则和https://192.168.23.10

用户名:admin

密码:Harbor12345

4.2 在任意node接点上登录

docker login -u admin -p Harbor12345 https://hub.com

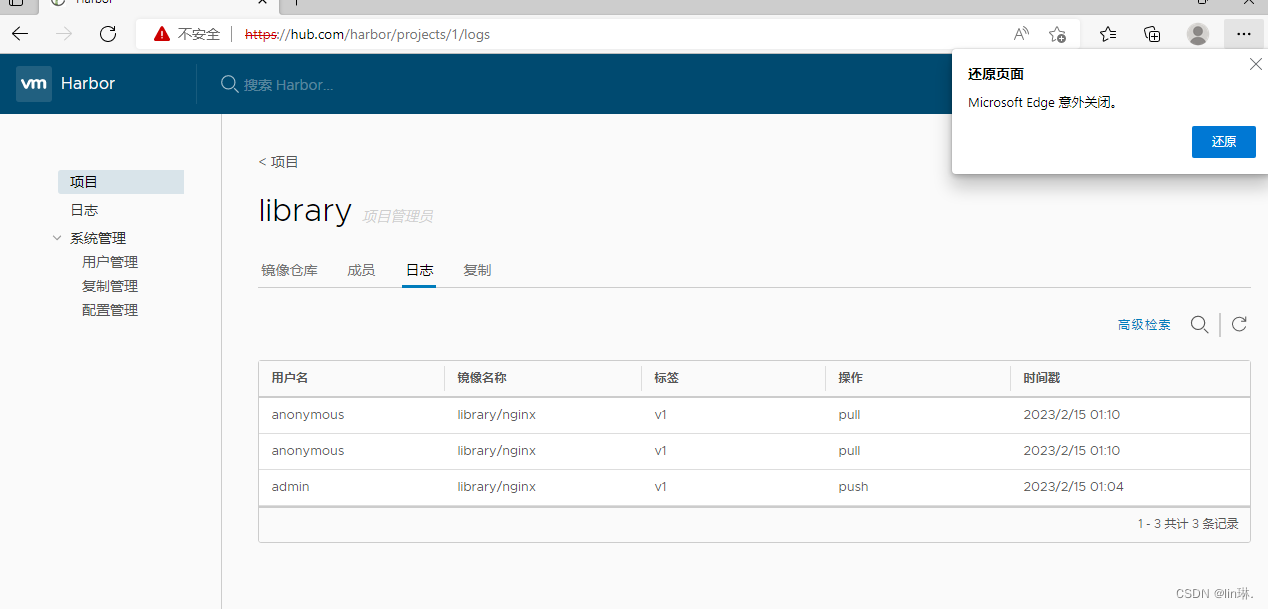

5、上传镜像

docker tag nginx:latest hub.com/library/nginx:v1

docker push hub.com/library/nginx:v1docker tag nginx:latest hub.com/library/test_nginx:test

docker push hub.com/library/test_nginx:test#登录浏览器刷新查看

https://192.168.23.10

6、拉取镜像

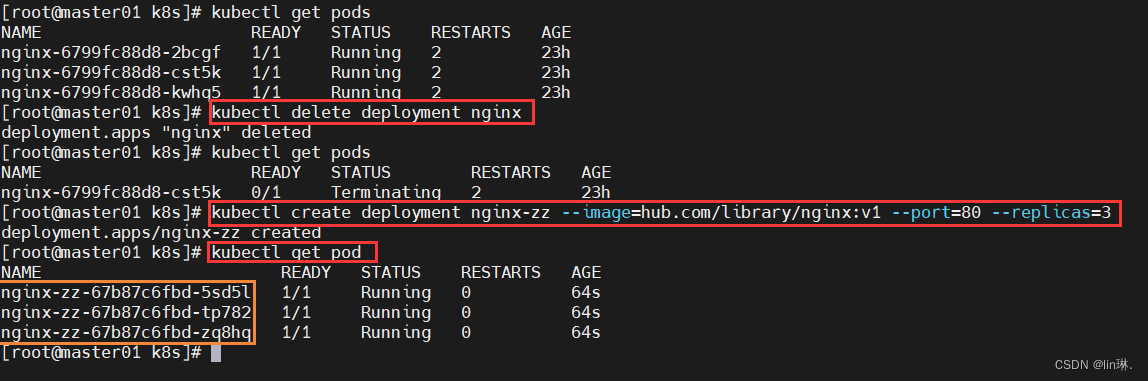

#先在master节点删除创建的nginx资源

kubectl delete deployment nginxkubectl get all

#使用私有仓库里的镜像创建资源

kubectl run nginx-deployment --image=hub.com/library/nginx:v1 --port=80 --replicas=3kubectl get pods##

--image 指定镜像

--port 指定pod的端口号

--replicas 指定副本数量

八、发布服务

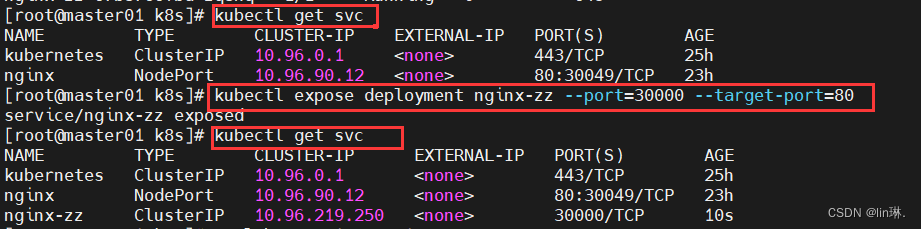

1、发布服务

#先查看资源名kubectl get allkubectl expose deploy nginx-deployment --port=30000 --target-port=80

2、测试

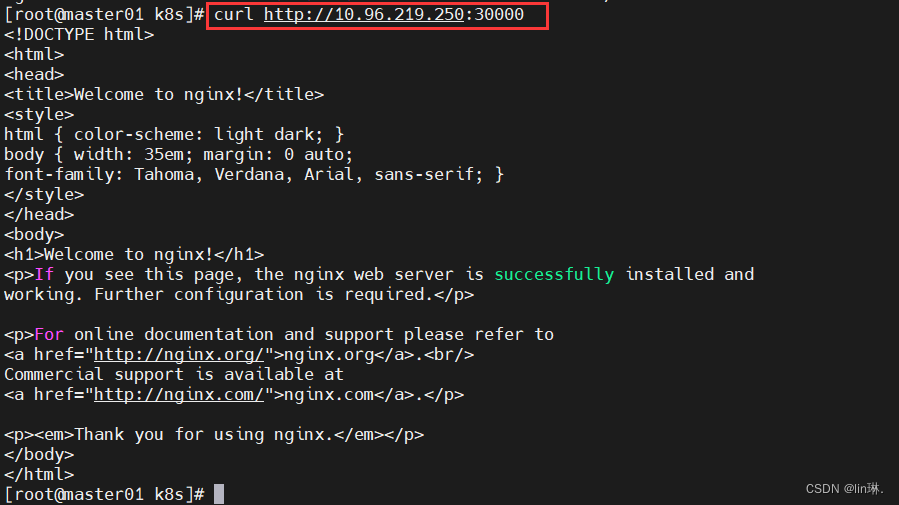

2.1 访问测试

#在命令行访问cluster ip +端口 (多访问几次)

curl http://10.96.219.250:30000

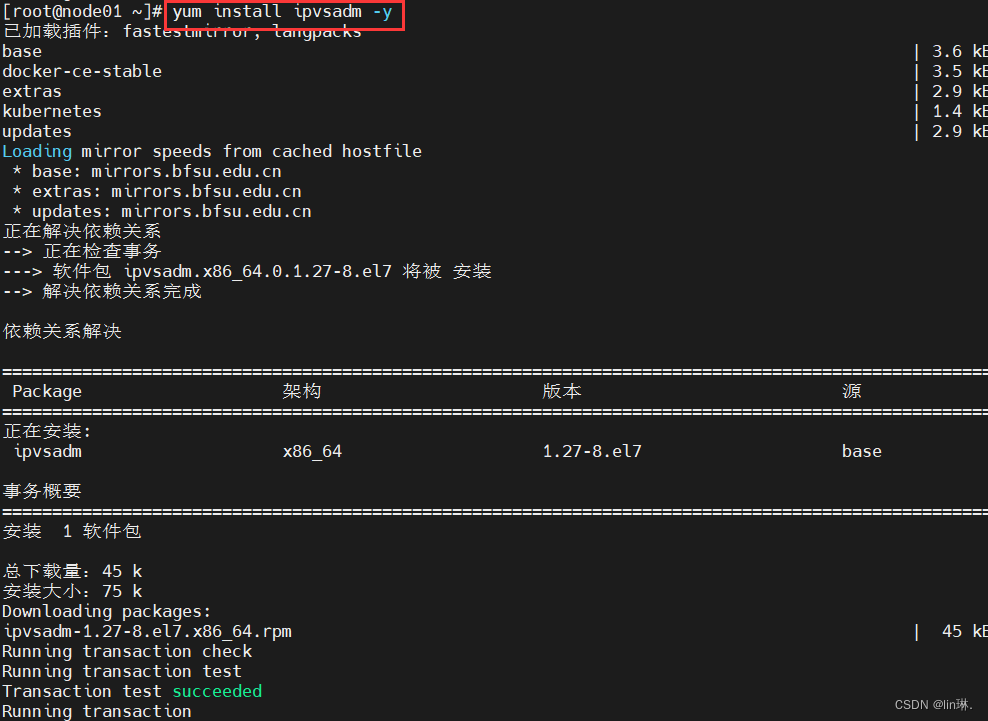

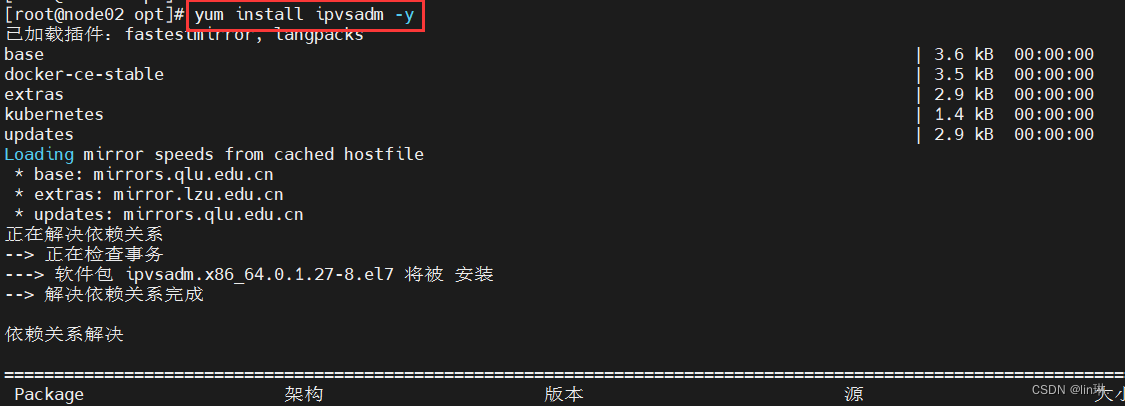

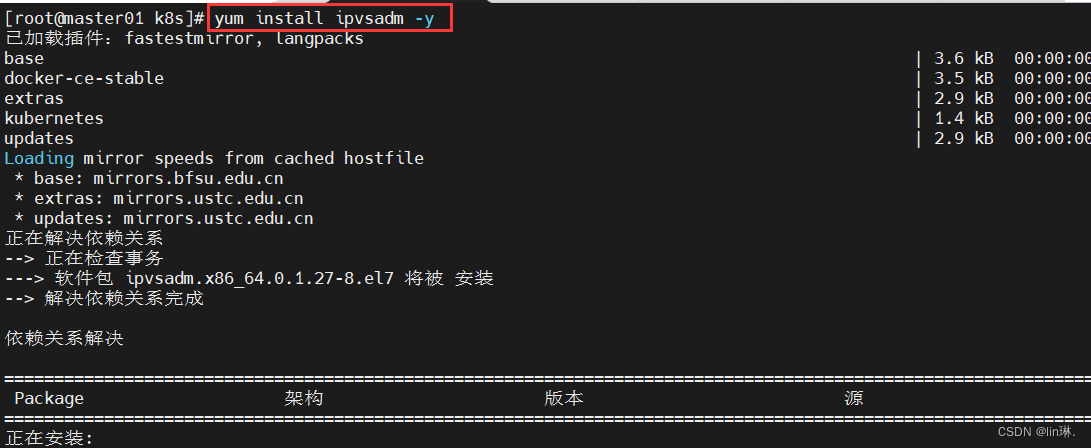

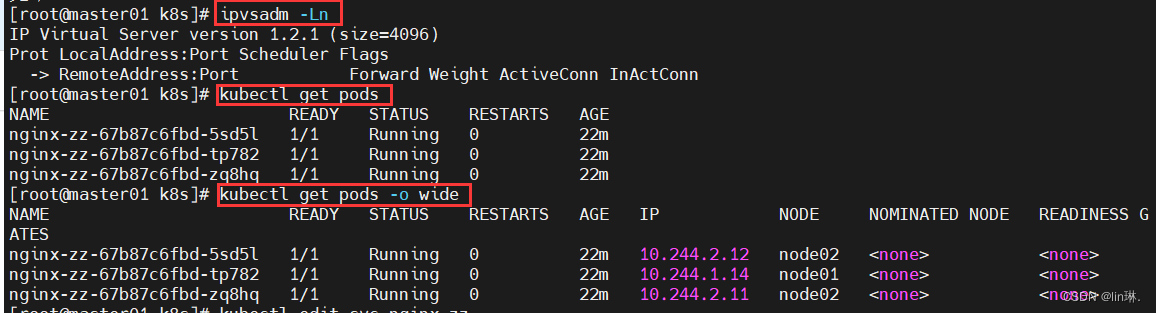

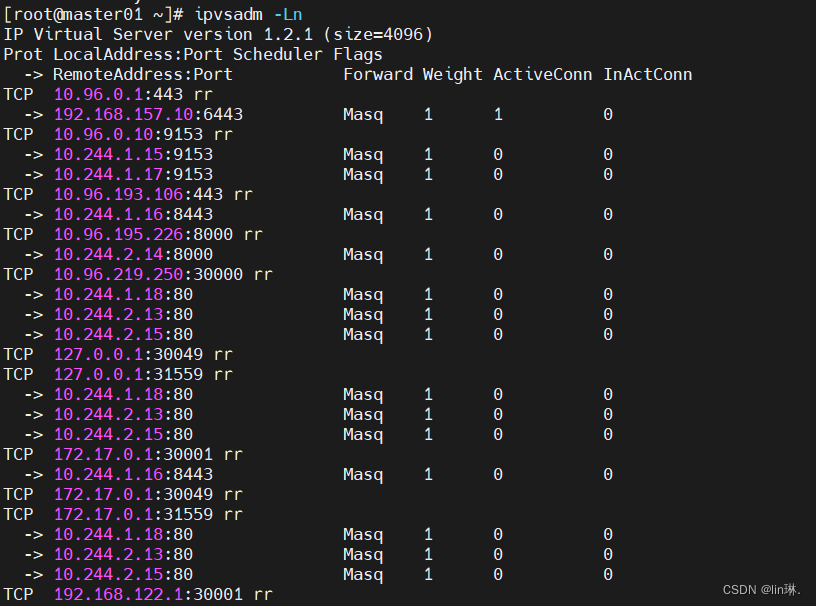

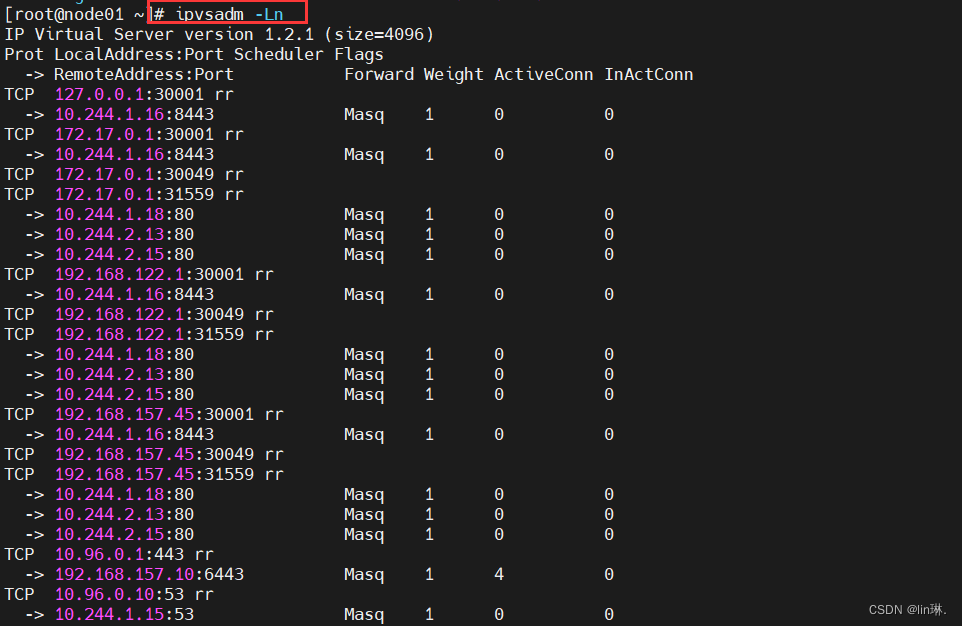

2.2 使用ipvsadm 查看策略

#安装工具

yum install ipvsadm -y#查看策略

ipvsadm -Ln kubectl get pods -o wide

3、在线修改资源配置

3.1 修改配置

#使用kubectl edit 在线膝盖资源配置

kubectl edit svc nginx-deployment# Please edit the object below. Lines beginning with a '#' will be ignored,

# and an empty file will abort the edit. If an error occurs while saving this file will be

# reopened with the relevant failures.

#

apiVersion: v1

kind: Service

metadata:creationTimestamp: "2023-02-14T17:15:42Z"labels:app: nginx-zzname: nginx-zznamespace: defaultresourceVersion: "60554"uid: b92f4b8a-65b1-4548-8196-c9fbf33b5e50

spec:clusterIP: 10.96.219.250clusterIPs:- 10.96.219.250ports:- port: 30000protocol: TCPtargetPort: 80selector:app: nginx-zzsessionAffinity: Nonetype: NodePort

status:loadBalancer: {}

3.2 访问测试

#查看service

kubectl get svc#浏览器使用node ip +30000端口访问

http://192.168.23.12:30000

http://192.168.23.13:30000

九、内核参数优化

cat > /etc/sysctl.d/kubernetes.conf <<EOF

net.bridge.bridge-nf-call-iptables=1

net.bridge.bridge-nf-call-ip6tables=1

net.ipv4.ip_forward=1

net.ipv4.tcp_tw_recycle=0

vm.swappiness=0 #禁止使用 swap 空间,只有当系统内存不足(OOM)时才允许使用它

vm.overcommit_memory=1 #不检查物理内存是否够用

vm.panic_on_oom=0 #开启 OOM

fs.inotify.max_user_instances=8192

fs.inotify.max_user_watches=1048576

fs.file-max=52706963 #指定最大文件句柄数

fs.nr_open=52706963 #仅4.4以上版本支持

net.ipv6.conf.all.disable_ipv6=1

net.netfilter.nf_conntrack_max=2310720

EOF

相关文章:

kubeadmin安装k8s集群

目录 一 、环境部署 1、服务器规划 2、环境准备 二、所有节点安装docker 1、配置yum源,安装docker 2、配置daemon.json文件 三、所有节点安装kubeadm、kubelet 和kubectl 四、部署k8s集群 1、查看初始化需要的镜像 2、导入镜像 3、初始化kubeadm 3.1 方…...

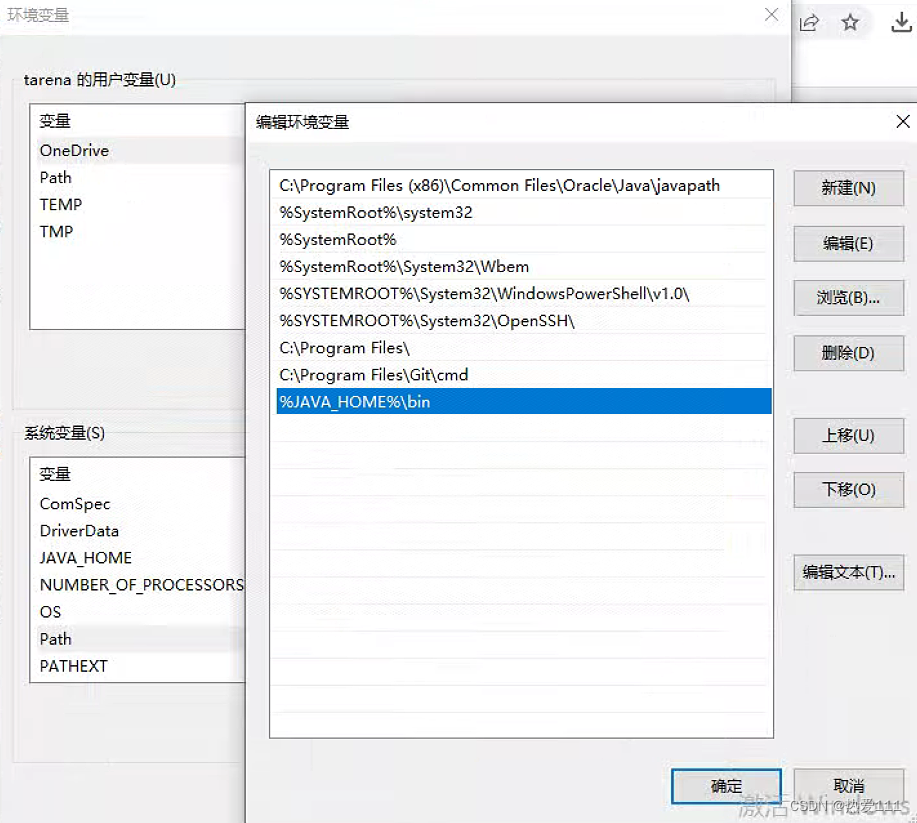

java3月train笔记

java笔记 day01 一、jdk和idea下载及安装(一般不建议装C盘): jdk:java开发环境 idea:开发工具(软件),用来编写代码的 苍老师文档服务器:doc.canglaoshi.org jdk下载&…...

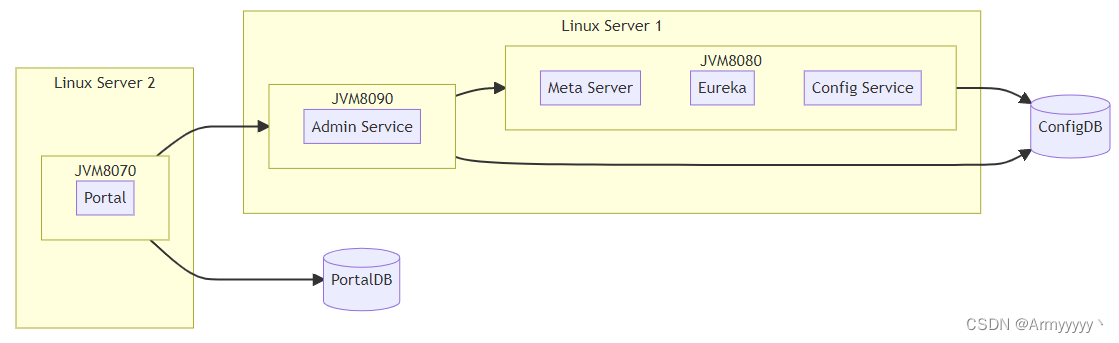

Apollo Config原理浅析

文章目录1. 简介2. 基本功能3. Apollo关键功能实现原理3.1 框架整体原理3.1.1 Apollo角色3.1.2 框架执行原理3.1.3 整体组成3.2 细节实现3.2.1 Eureka和不同角色机器的关系3.2.2 Meta Server的作用3.2.3 ReleaseMessage消息实现原理3.2.4 Client的通信方式1. 简介 apollo是携程…...

Kubernetes二 Kubernetes之实战以及pod详解

Kubernetes入门 一 Kubernetes实战 本章节将介绍如何在kubernetes集群中部署一个nginx服务,并且能够对其进行访问。 1.1 Namespace Namespace是kubernetes系统中的一种非常重要资源,它的主要作用是用来实现多套环境的资源隔离或者多租户的资源隔离。…...

机械革命黑苹果改造计划第四番-外接显示器、win时间不正确问题解决

问题 1.无法外接显示器 最大的问题就是目前无法外接显示器,因为机械革命大多数型号笔记本电脑的HDMI、DP接口都是直接物理接在独显上的,内屏用核显外接显示器接独显,英伟达独显也是黑苹果无法驱动的,而且发现机械革命tpyec接口还…...

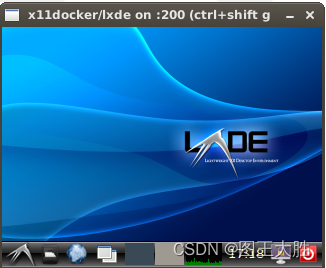

Linux docker(03)可使用GPU渲染的x11docker实战总结

该系列文章的目的旨在之前的章节基础上,使用x11docker构建一个可以使用GPU的docker容器。该容器可以用于3D图形渲染/XR 等使用GPU渲染的程序调试和运行。 0 why docker 为什么非要用x11docker,而不是其他的docker呢? 因为一般的docker是不…...

【Linux操作系统】【综合实验一 Linux操作基础】

文章目录一、实验目的二、实验要求三、实验内容四、实验报告要求一、实验目的 要求掌握Linux基础操作,熟悉Linux行界面,并明白操作的原理以及目的;熟悉Linux系统环境。 二、实验要求 通过这个第一阶段实验,要求掌握以下操作与相…...

关于监控服务器指标、CPU、内存、警报的一些解决方案

文章目录关于监控服务器指标、CPU、内存、警报的一些解决方案Prometheus Grafana 配置 IRIS / Cach 监控服务器Prometheus简介特点架构图Grafana简介特点配置流程自定义Prometheus接口定义配置 Exporter 监控服务器系统资源简介配置流程使用 Alertmanager报警简介配置流程基于…...

)

vue3全家桶技术栈基础(一)

在认识vue3全家桶之前,先简单回顾一下vue2的全家桶 一.在vue2中,全家桶技术栈 技术栈: vue2 vue-cli vuex3vue-router3webpack elementUI 1.vue-cli 脚手架构建vue项目,CLI 服务是构建于 webpack 和 webpack-dev-server构建快速生成一个vue2的开发项…...

群晖-第2章-设置HTTPS访问

群晖-第2章-设置HTTPS访问 本章介绍如何通过HTTPS访问群晖,前置要求是完成群晖-第1章-IPV6的DDNS中的内容,可以是IPV4也可以是IPV6,或者你有公网IP,直接添加DNS解析也可以。只要能通过域名访问到nas就行。 本文参考自群晖添加SS…...

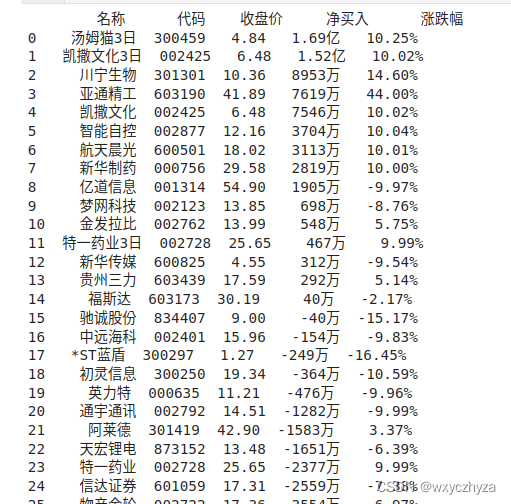

005 利用fidder抓取app的api,获得股票数据

一、下载安装fidder 百度搜索fidder直接下载,按提示安装即可。 二、配置fidder 1. 打开fidder,选择tools——options。 2. 选择HTTPS选项卡,勾选前三项,然后点击右侧【actions】,选择【trust root certificate】&a…...

京东测试进阶之路:初入测试碎碎念篇

1、基本的测试用例设计方法 基本的测试用例设计方法(边界值分析、等价类划分等)。 业务和场景的积累,了解测试需求以及易出现的bug的地方。 多维角度设计测试用例(用户、业务流程、异常场景、代码逻辑)。 2、需求分析 …...

| 机试题+算法思路+考点+代码解析 【2023】)

华为OD机试 - 乘积最大值(JavaScript) | 机试题+算法思路+考点+代码解析 【2023】

乘积最大值 题目 给定一个元素类型为小写字符串的数组 请计算两个没有相同字符的元素长度乘积的最大值 如果没有符合条件的两个元素返回0 输入 输入为一个半角逗号分割的小写字符串数组 2 <= 数组长度 <= 100 0 < 字符串长度 <= 50 输出 两个没有相同字符的元…...

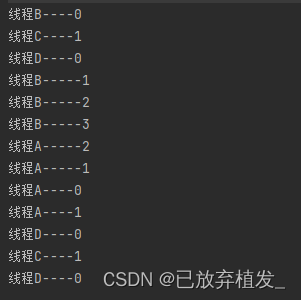

Java并发知识点

文章目录1. start()和run()方法的区别?2. volatile关键字的作用?使用volatile能够保证:防止指令重排3. sleep方法和wait方法有什么区别?sleep()方法4. 如何停止一个正在运行的线程?方法一:方法二࿱…...

前端 ES6 环境下 require 动态引入图片以及问题

前端 ES6 环境下 require 动态引入图片以及问题require 引入图片方式打包体积对比总结ES6 环境中,通过 require 的方式引入图片很方便,一直以来也没有出过什么问题,后来项目中,需要动态引入图片。 require 动态引入也容易实现&am…...

PCL 欧氏聚类分割

文章目录 一、应用背景1、点云分割算法的属性2、点云分割的挑战二、实现过程三、主要函数及代码实现1、主要函数2、核心代码3、效果实现四、参考文献一、应用背景 1、点云分割算法的属性 1)鲁棒性,比如树木是具有与汽车相区别的特征的,当点云数据的特征数量增加时,分割算…...

一台服务器最大能支持多少条TCP连接

一、一台服务器最大能打开的文件数 1、限制参数 我们知道在Linux中一切皆文件,那么一台服务器最大能打开多少个文件呢?Linux上能打开的最大文件数量受三个参数影响,分别是: fs.file-max (系统级别参数)&am…...

Teradata退出中国,您可以相信中国数据库!

继Adobe、Tableau、Salesforce之后,2023年2月15日,数仓软件巨头Teradata宣布将逐步结束在中国的直接运营。数仓界的“黄埔军校”仓皇撤出中国市场给出的理由非常含蓄:Teradata对中国当前和未来商业环境的慎重评估,我们做了一个艰难…...

markdown组合数学公式

markdown组合数学公式 $C_n^m$CnmC_n^mCnm $A_n^m$AnmA_n^mAnm $$\binom{m}{nm1}$$(mnm1)\binom{m}{nm1}(nm1m) $${m\choose nm1}$$(mnm1){m\choose nm1}(nm1m)...

Golang实践录:一个字符串比较示例

本文介绍两个含中文的字符串且针对相同位置字符的比较,给出实现代码。 起因 某工程需将接收的字符串和数据库里的指定字段值对比,该字符串含中文,两者允许个别字符有差异,差异数量3及以下的,认为相同。 字符串默认用…...

OpenLayers 可视化之热力图

注:当前使用的是 ol 5.3.0 版本,天地图使用的key请到天地图官网申请,并替换为自己的key 热力图(Heatmap)又叫热点图,是一种通过特殊高亮显示事物密度分布、变化趋势的数据可视化技术。采用颜色的深浅来显示…...

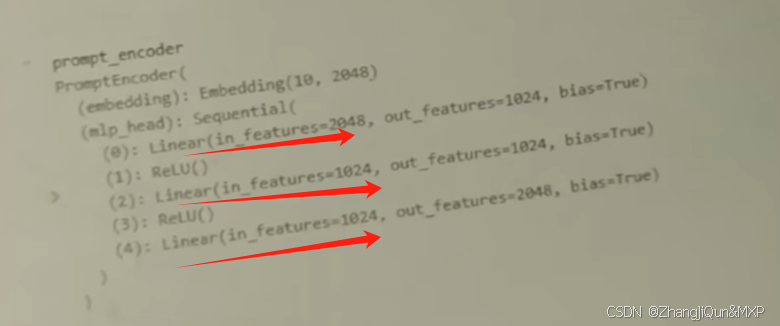

Prompt Tuning、P-Tuning、Prefix Tuning的区别

一、Prompt Tuning、P-Tuning、Prefix Tuning的区别 1. Prompt Tuning(提示调优) 核心思想:固定预训练模型参数,仅学习额外的连续提示向量(通常是嵌入层的一部分)。实现方式:在输入文本前添加可训练的连续向量(软提示),模型只更新这些提示参数。优势:参数量少(仅提…...

)

IGP(Interior Gateway Protocol,内部网关协议)

IGP(Interior Gateway Protocol,内部网关协议) 是一种用于在一个自治系统(AS)内部传递路由信息的路由协议,主要用于在一个组织或机构的内部网络中决定数据包的最佳路径。与用于自治系统之间通信的 EGP&…...

基于Uniapp开发HarmonyOS 5.0旅游应用技术实践

一、技术选型背景 1.跨平台优势 Uniapp采用Vue.js框架,支持"一次开发,多端部署",可同步生成HarmonyOS、iOS、Android等多平台应用。 2.鸿蒙特性融合 HarmonyOS 5.0的分布式能力与原子化服务,为旅游应用带来…...

在 Nginx Stream 层“改写”MQTT ngx_stream_mqtt_filter_module

1、为什么要修改 CONNECT 报文? 多租户隔离:自动为接入设备追加租户前缀,后端按 ClientID 拆分队列。零代码鉴权:将入站用户名替换为 OAuth Access-Token,后端 Broker 统一校验。灰度发布:根据 IP/地理位写…...

linux 错误码总结

1,错误码的概念与作用 在Linux系统中,错误码是系统调用或库函数在执行失败时返回的特定数值,用于指示具体的错误类型。这些错误码通过全局变量errno来存储和传递,errno由操作系统维护,保存最近一次发生的错误信息。值得注意的是,errno的值在每次系统调用或函数调用失败时…...

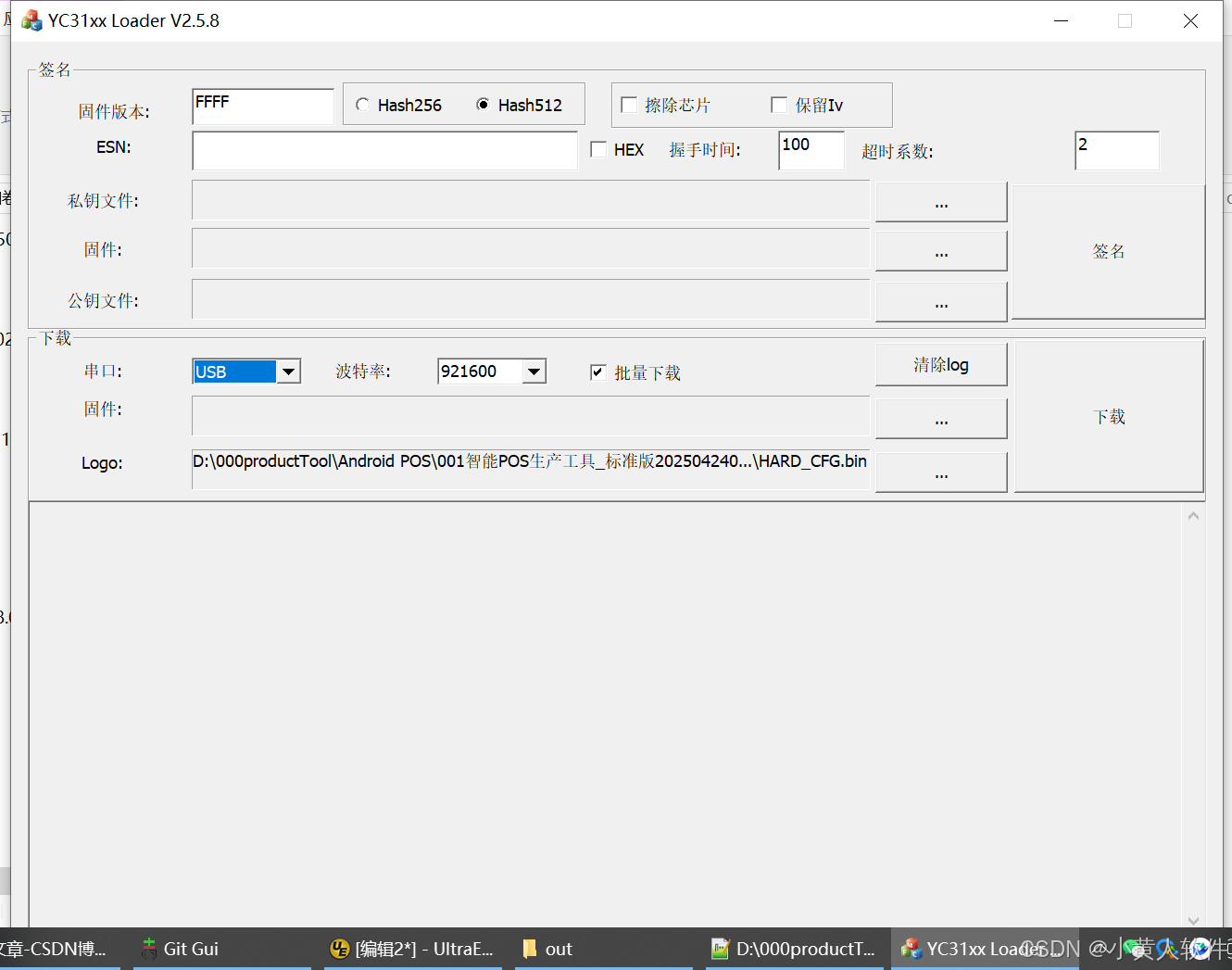

C++ Visual Studio 2017厂商给的源码没有.sln文件 易兆微芯片下载工具加开机动画下载。

1.先用Visual Studio 2017打开Yichip YC31xx loader.vcxproj,再用Visual Studio 2022打开。再保侟就有.sln文件了。 易兆微芯片下载工具加开机动画下载 ExtraDownloadFile1Info.\logo.bin|0|0|10D2000|0 MFC应用兼容CMD 在BOOL CYichipYC31xxloaderDlg::OnIni…...

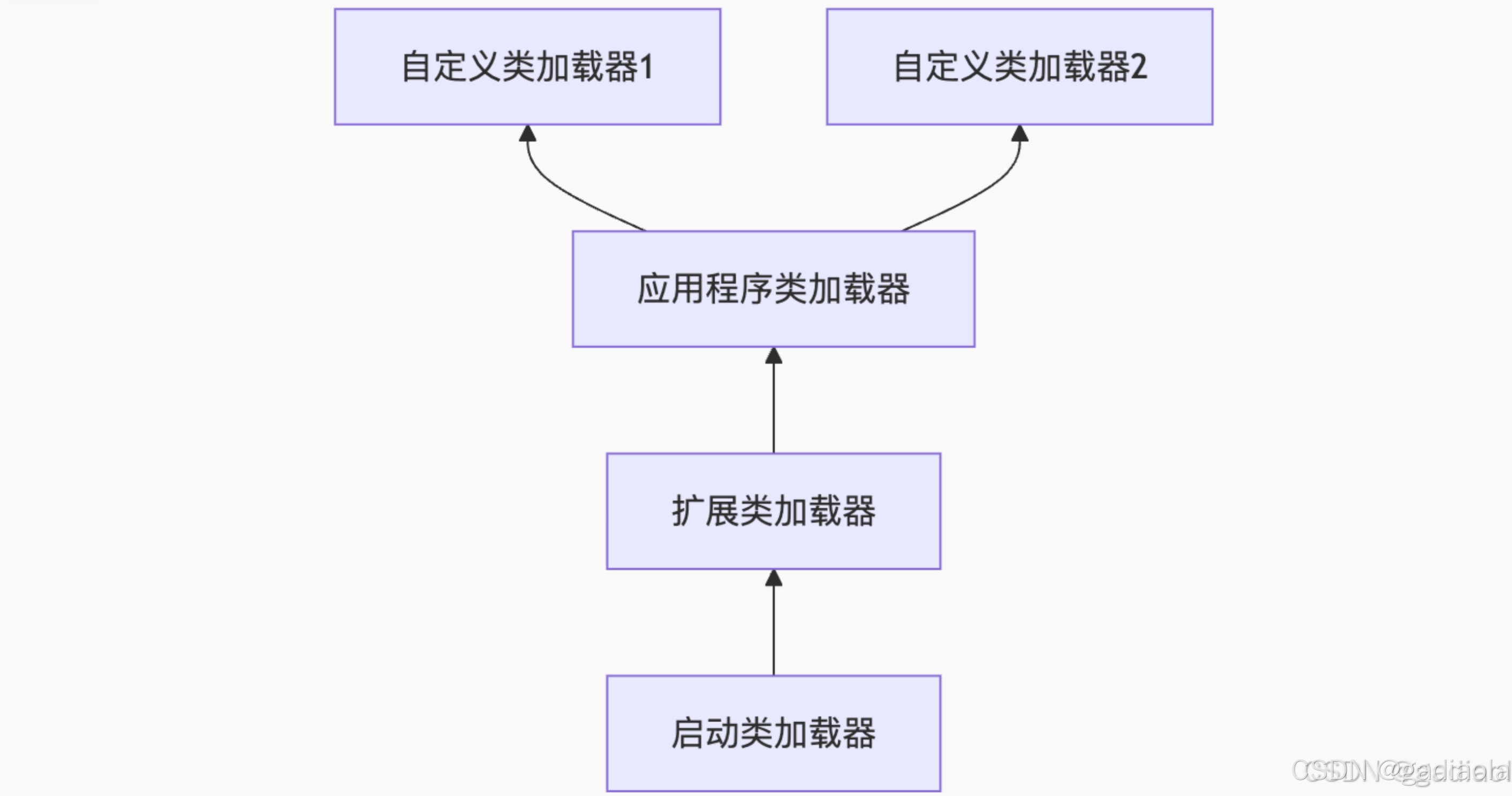

【JVM面试篇】高频八股汇总——类加载和类加载器

目录 1. 讲一下类加载过程? 2. Java创建对象的过程? 3. 对象的生命周期? 4. 类加载器有哪些? 5. 双亲委派模型的作用(好处)? 6. 讲一下类的加载和双亲委派原则? 7. 双亲委派模…...

代码规范和架构【立芯理论一】(2025.06.08)

1、代码规范的目标 代码简洁精炼、美观,可持续性好高效率高复用,可移植性好高内聚,低耦合没有冗余规范性,代码有规可循,可以看出自己当时的思考过程特殊排版,特殊语法,特殊指令,必须…...

适应性Java用于现代 API:REST、GraphQL 和事件驱动

在快速发展的软件开发领域,REST、GraphQL 和事件驱动架构等新的 API 标准对于构建可扩展、高效的系统至关重要。Java 在现代 API 方面以其在企业应用中的稳定性而闻名,不断适应这些现代范式的需求。随着不断发展的生态系统,Java 在现代 API 方…...