二进制部署K8S

目录

一、环境准备

1、常见的k8s部署方式

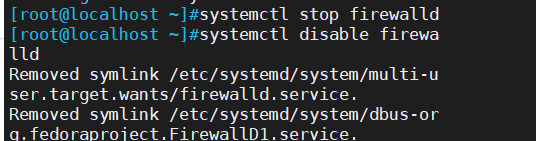

2、关闭防火墙

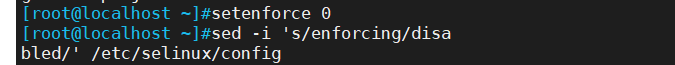

3、关闭selinux

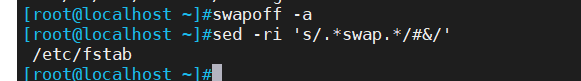

4、关闭swap

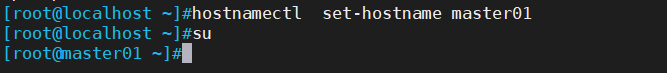

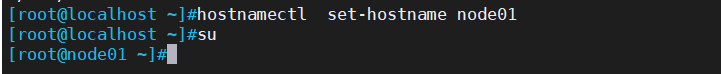

5、根据规划设置主机名

6、在master添加hosts

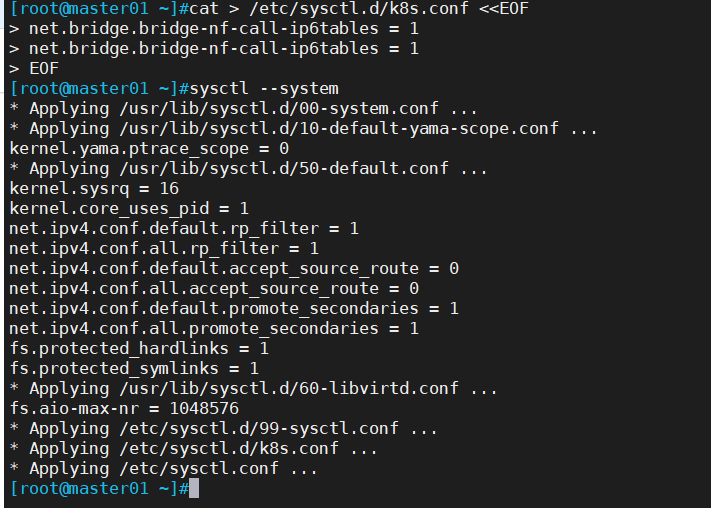

7、将桥接的IPv4流量传递到iptables的链

8、时间同步

二、部署etcd集群

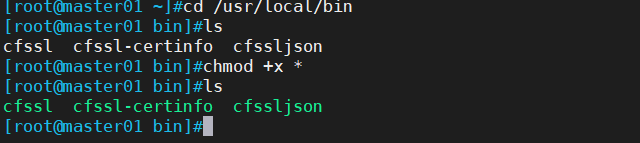

1、master节点部署

2、查看证书的信息

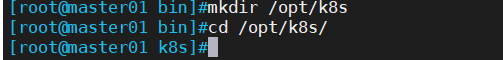

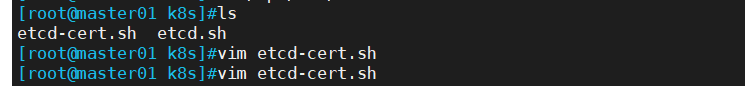

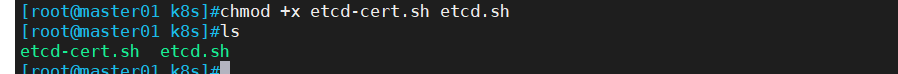

2.1 创建k8s工作目录

2.2 上传etcd-cert.sh 和etcd.sh 到/opt/k8s/ 目录中

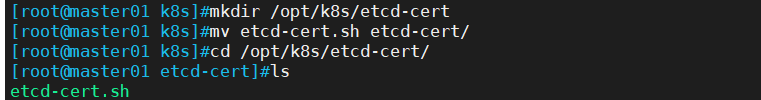

2.3 创建用于生成CA证书、etcd服务器证书以及私钥的目录

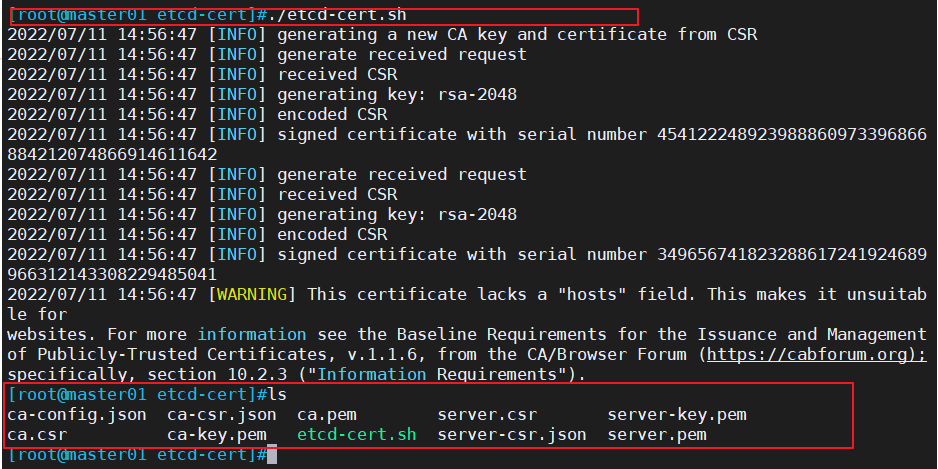

2.4 生成CA证书、etcd服务器证书以及私钥

2.5 上传etcd-v3.3.10-1inux-amd64.tar.gz 到/opt/k8s/ 目录中,解压etcd 压缩包

3、etcdctl主要为etcd服务提供了命令行操作

3.1 创建用于存放etcd配置文件,命令文件,证书的目录

3.2 进入卡住状态等待其他节点加入,这里需要三台etcd服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有etcd节点都已启动,可忽略这个情况

3.3 另外打开一个窗口查看etcd进程是否正常

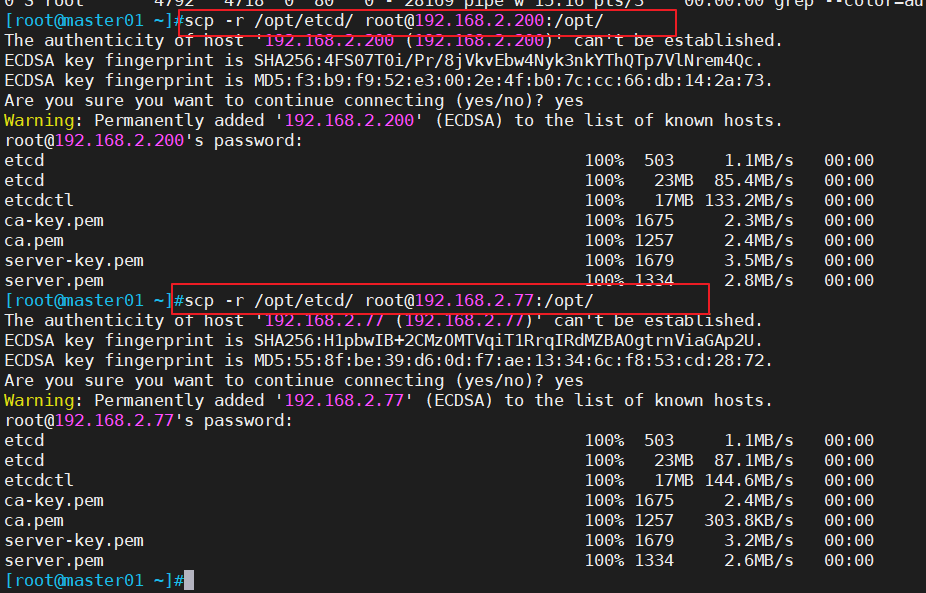

3.4 把etcd相关证书文件和命令文件全部拷贝到另外两个etcd集群节点

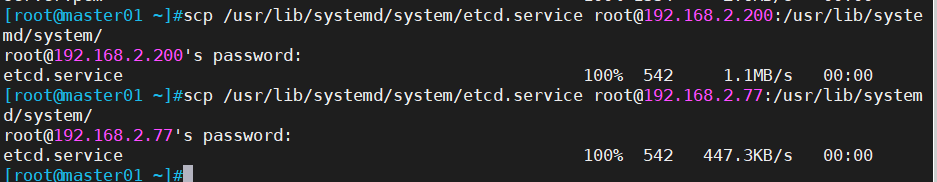

3.5 把etcd服务管理文件拷贝到另外两个etcd集群节点

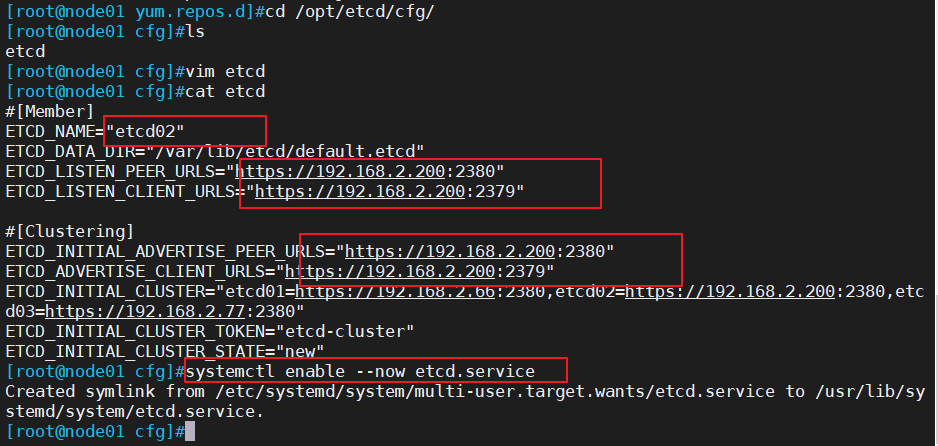

4、在node1与node2节点修改

4.1 在node1节点修改

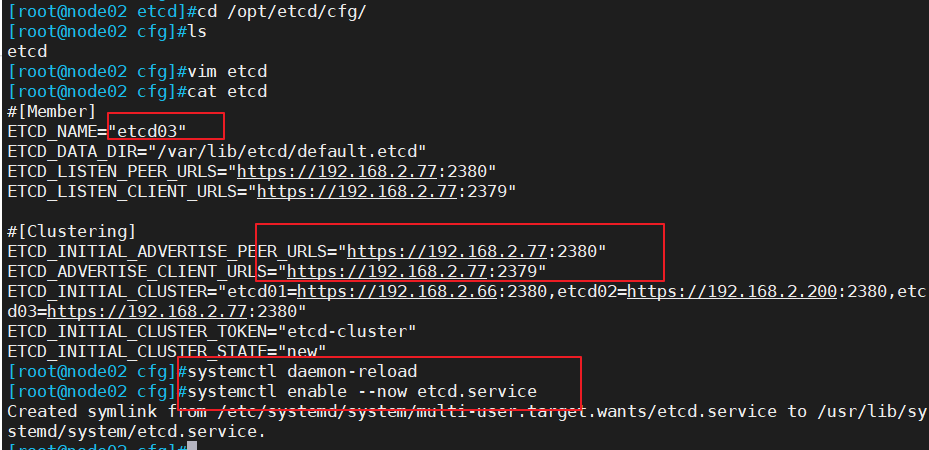

4.2 在node2节点修改

5、在master1节点上进行启动

5.1 首先在master1节点上进行启动

5.2 接着在node1和node2节点分别进行启动

5.3 在master1 节点上操作

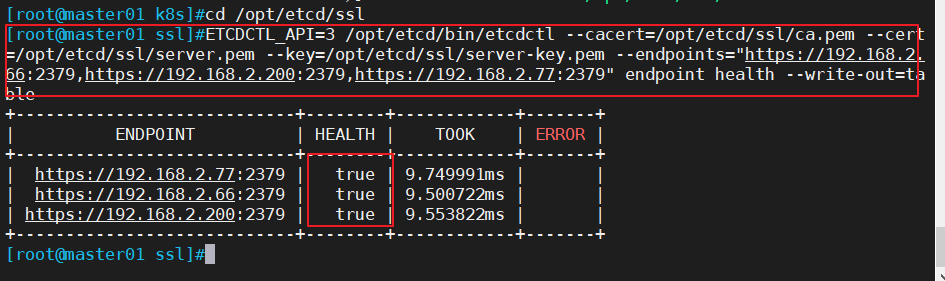

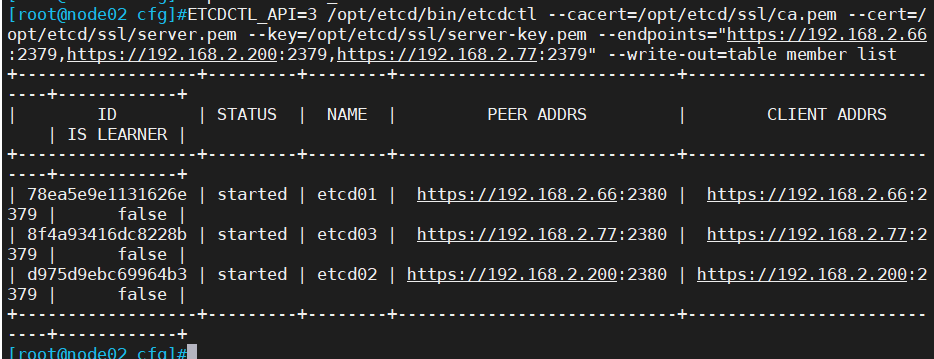

5.4 检查etcd群集状态

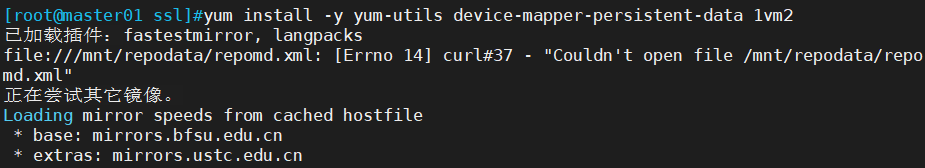

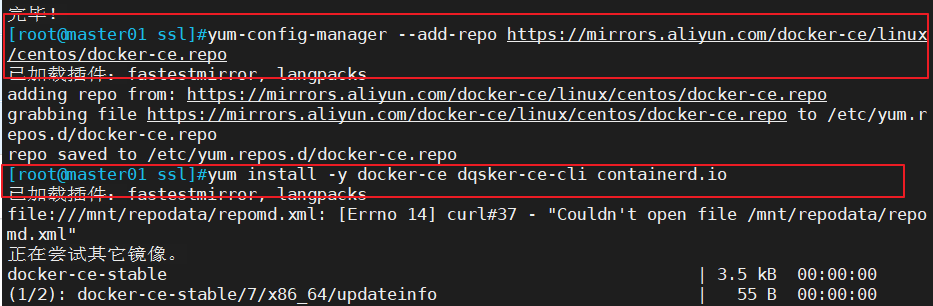

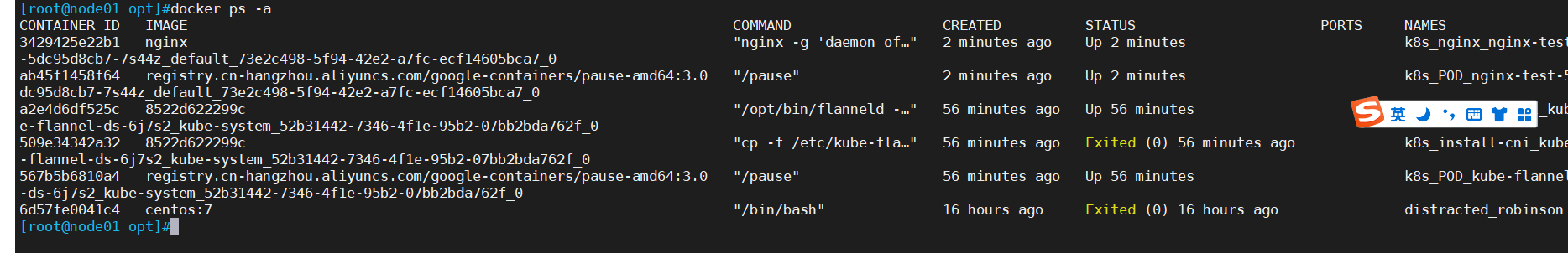

6、部署docker引擎

6.1 所有node节点部署docker引擎

三、flannel网络配置

1、flannel网络配置

Flannel工作原理:

2、在master1 节点 添加flannel 网络配置信息

2.1 在node01 节点上操作

3、在所有master节点上操作

3.1 修改docker服务管理文件,配置docker连接flannel

3.2 重启docker服务

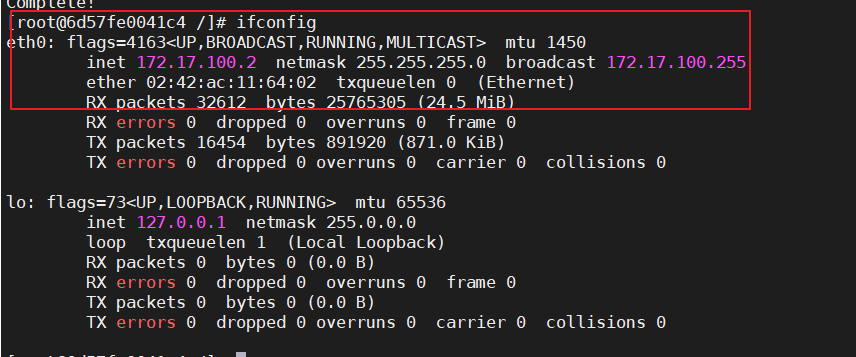

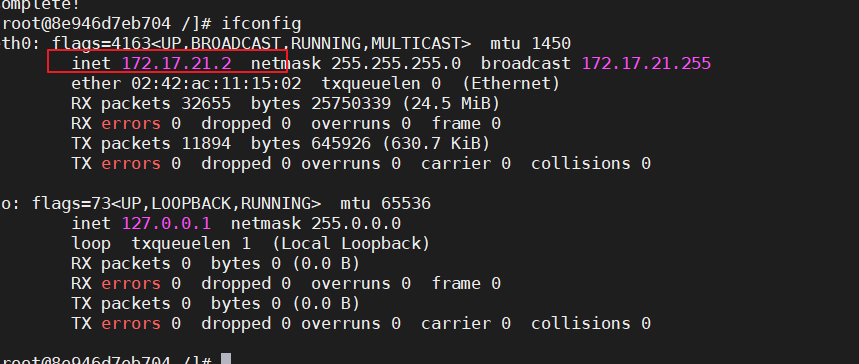

3.3 ifconfig #查看flannel网络

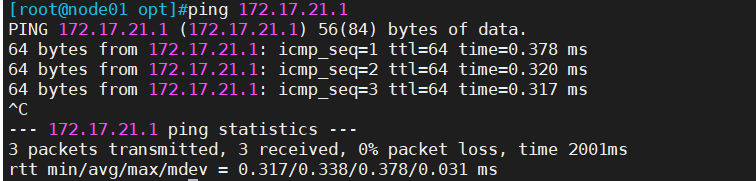

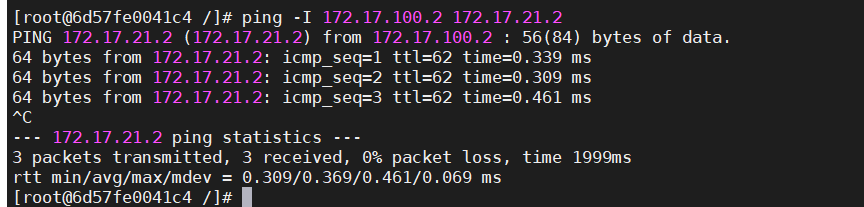

3.4 测试ping通对方docker0网卡 证明flannel起到路由作用

四、部署master组件

1、在master1 节点上操作

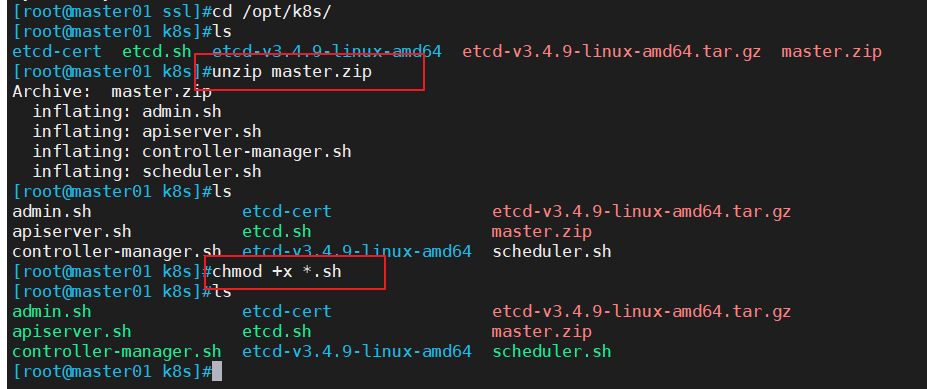

1.1 上传master.zip 和k8s-cert.sh 到/opt/k8s 目录中,解压master.zip 压缩包

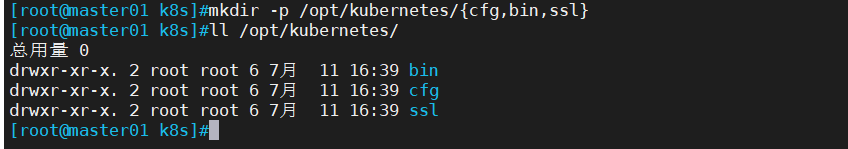

1.2 创建kubernetes工作目录

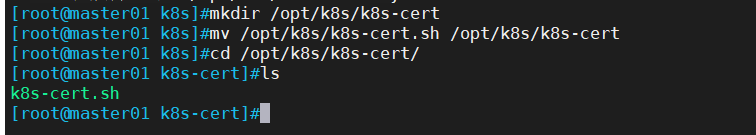

1.3 创建用于生成CA证书、相关组件的证书和私钥的目录

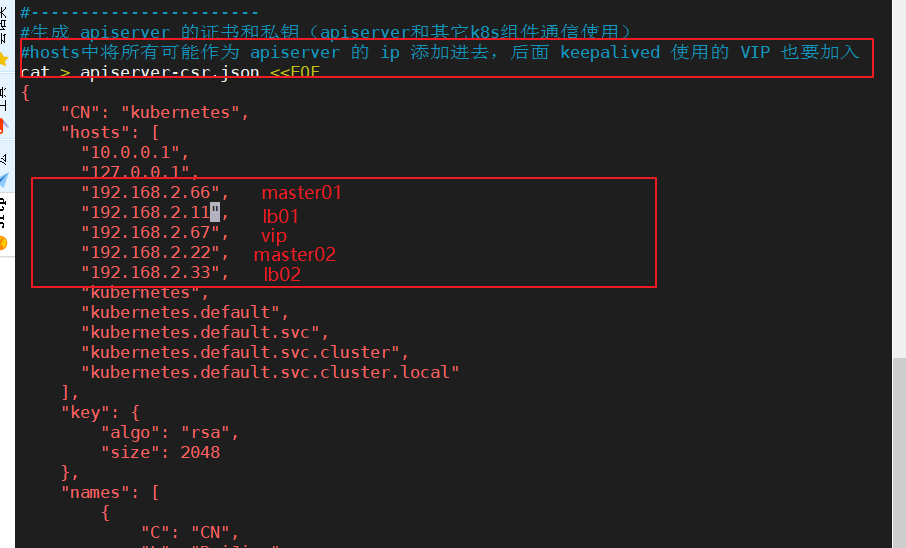

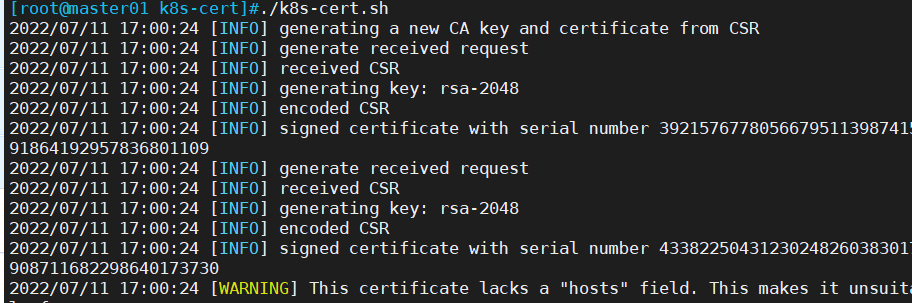

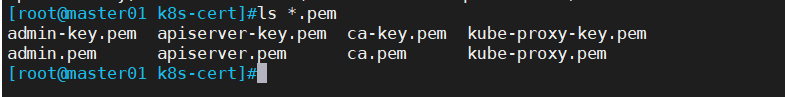

2、生成CA证书、相关组件的证书和私钥

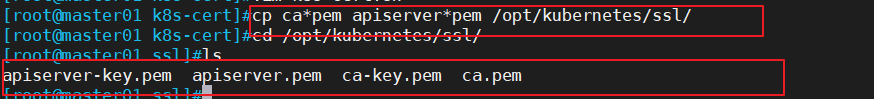

2.1 复制CA证书、apiserver 相关证书和私钥到kubernetes. 工作目录的ssl子目录中

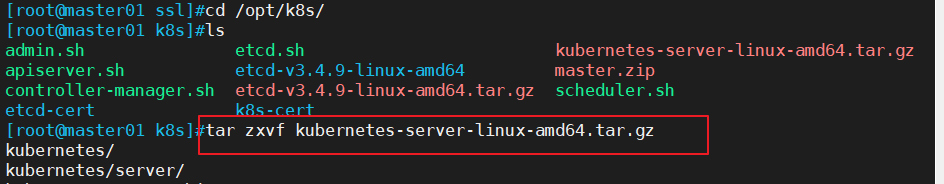

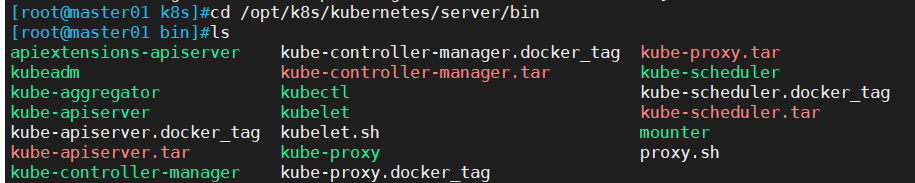

2.2 上传kubernetes-server-linux-amd64.tar.gz 到/opt/k8s/ 目录中,解压kubernetes 压缩包

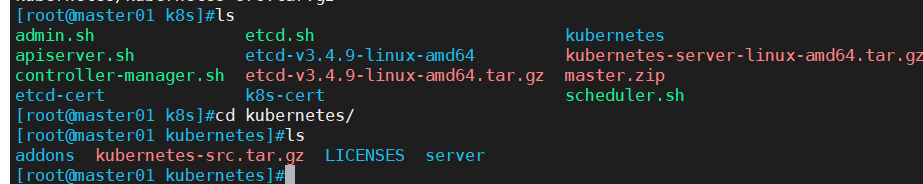

2.3 复制master组件的关键命令文件到kubernetes. 工作目录的bin子目录中

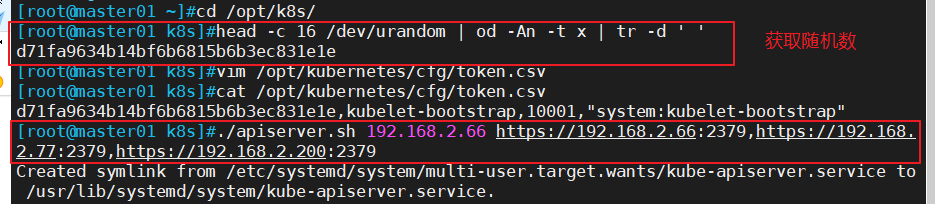

2.4 创建bootstrap token 认证文件,apiserver 启动时会调用,然后就相当于在集群内创建了一个这个用户,接下来就可以用RBAC给他授权

2.5 使用 head -c 16 /dev/urandom | od -An -t x | tr -d ' '可以随机生成序列号,并创建token.csv文件,也可以使用脚本创建

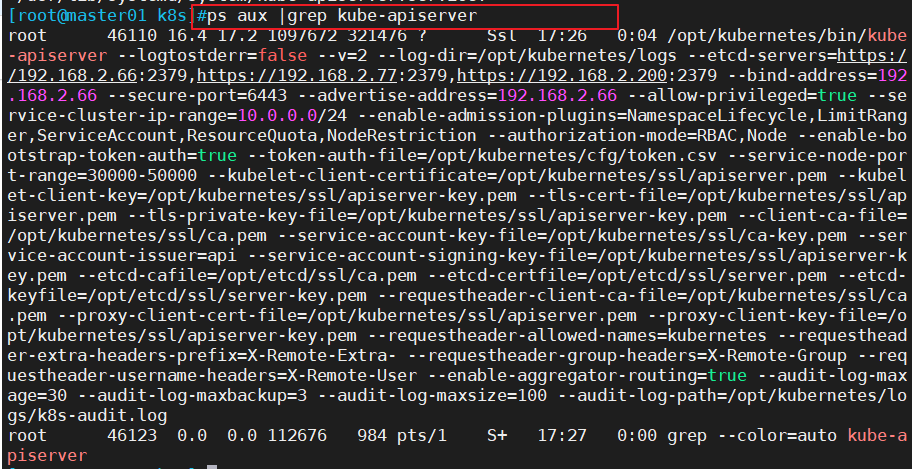

3、检查进程是否启动成功

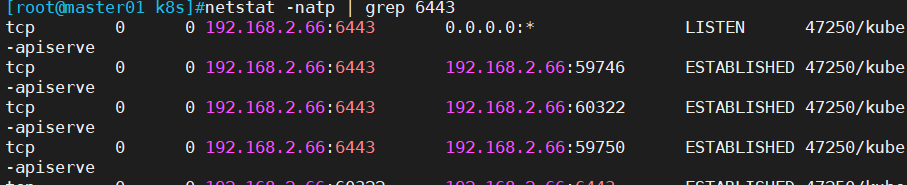

3.1 k8s通过kube- apiserver这 个进程提供服务,该进程运行在单个master节点上。默认有两个端口6443和8080

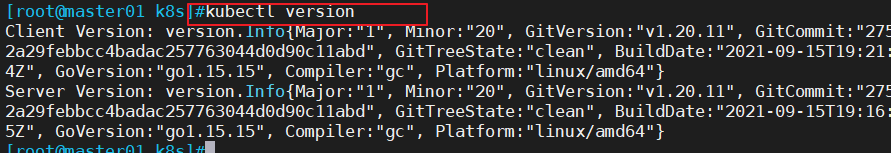

3.2 查看版本信息(必须保证apiserver启动正常,不然无法查询到server的版本信息)

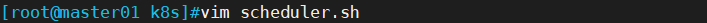

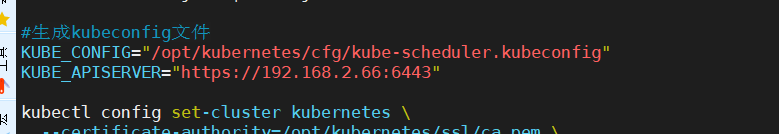

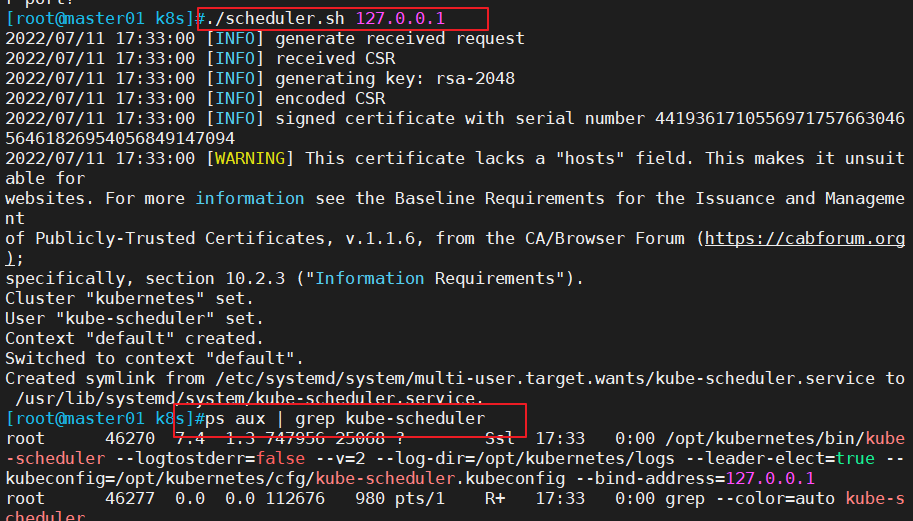

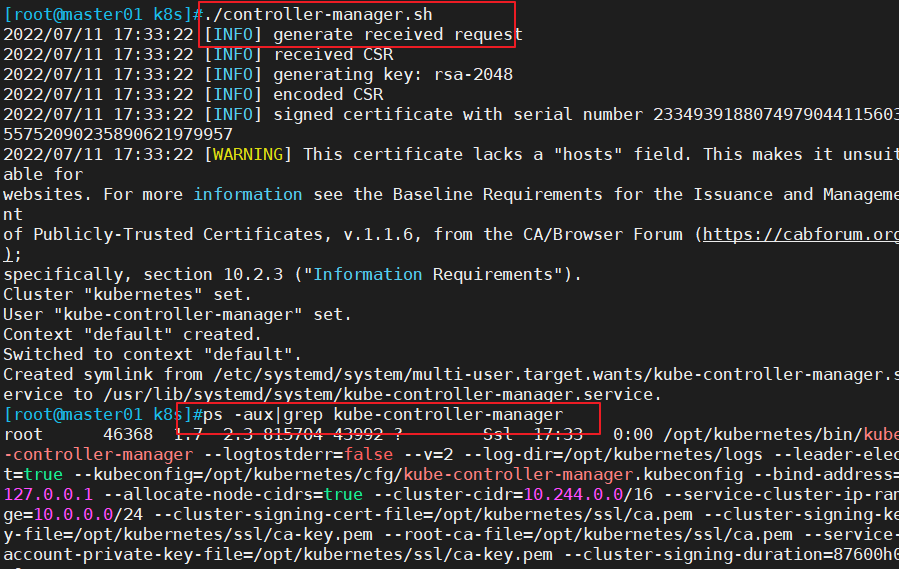

3.3 启动scheduler 服务

3.4 启动controller-manager服务

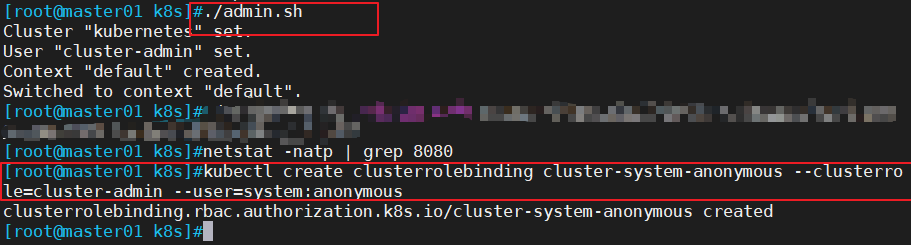

4、生成kubectl连接集群的证书

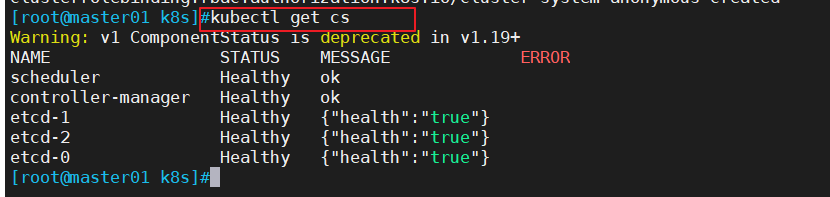

4.1 查看节点状态

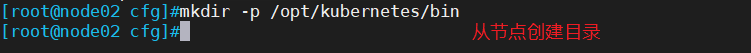

五、部署node组件

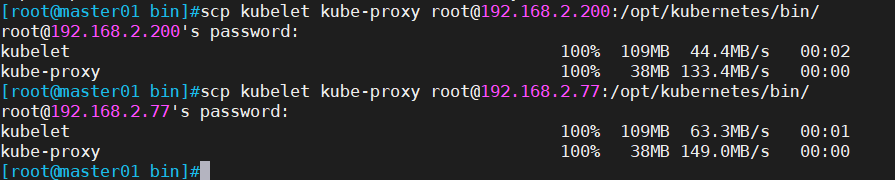

1、部署node组件

1.1在master1 节点上操作,把kubelet、 kube-proxy拷贝到node 节点

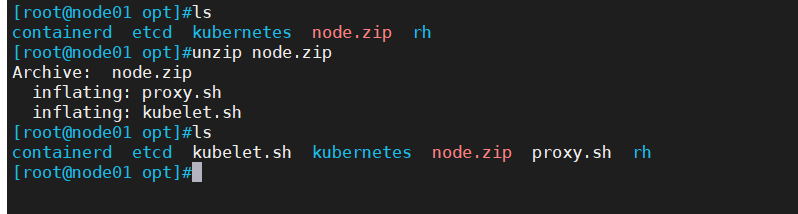

1.2 上传node.zip到/opt 目录中,解压node.zip 压缩包,获得kubelet.sh、 proxy.sh

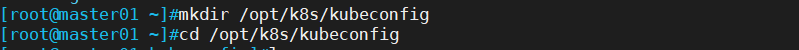

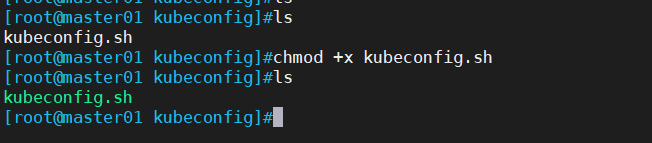

1.3 创建用于生成kubelet的配置文件的目录

1.4 上传kubeconfig.sh 文件到/opt/k8s/kubeconfig目录中

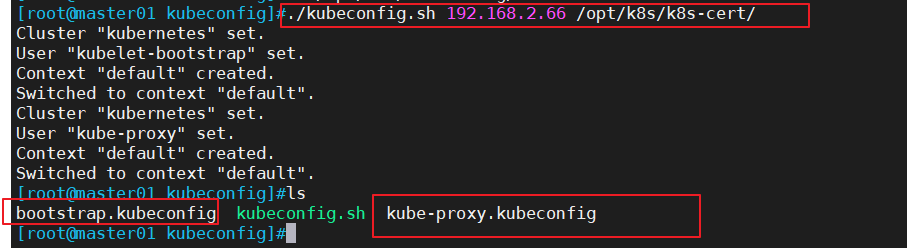

1.5 生成kubelet的配置文件

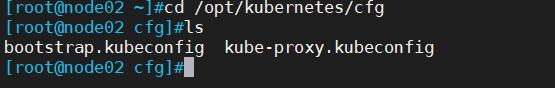

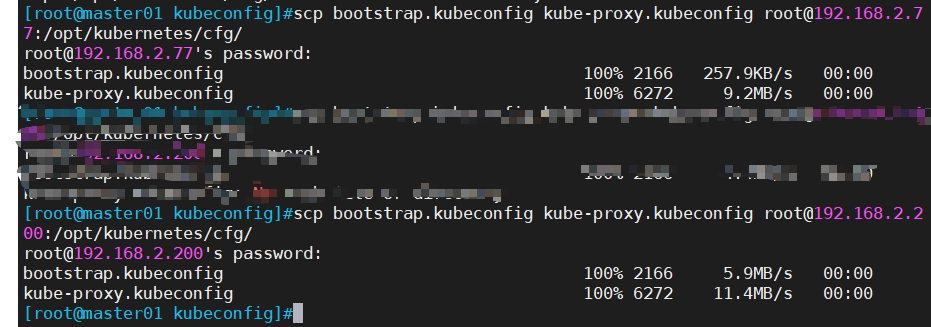

1.6 把配置文件bootstrap.kubeconfig、kube-proxy.kubeconfig拷贝到node节点

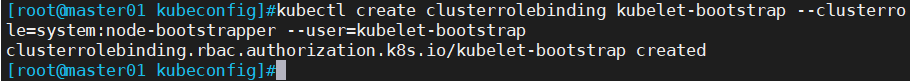

1.7 RBAC授权,将预设用户kubelet-bootatrap 与内置的ClusterRole system:node-bootatrapper 绑定到一起,使其能够发起CSR请求

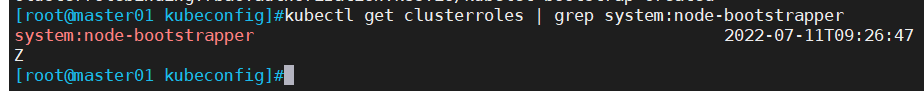

1.8 查看角色

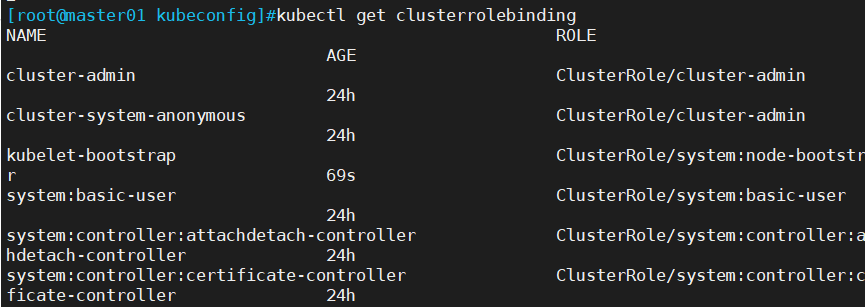

1.9 查看已授权的角色

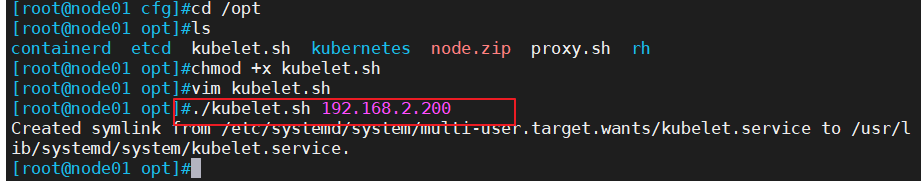

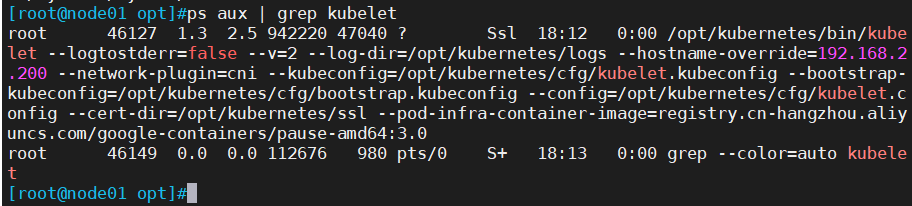

1.10 使用kubelet.sh脚本启动kubelet服务

1.11 检查kubelet服务启动

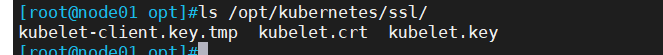

1.12 此时还没有生成证书

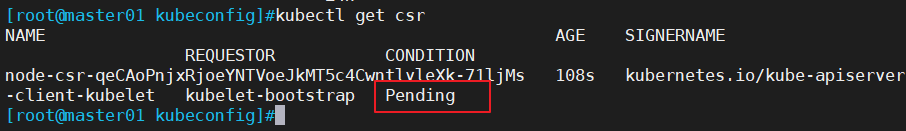

1.13 在master1 节点上操作//检查到node1 节点的kubelet 发起的CSR请求,Pending 表示等待集群给该节点签发证书

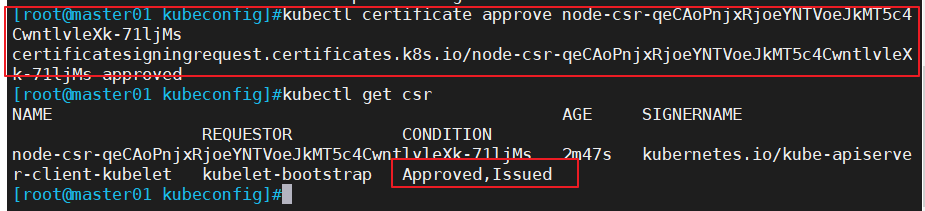

1.14 通过CSR请求

1.15 再次查看CSR请求状态,Approved, Issued表示已授权CSR请求并签发证书

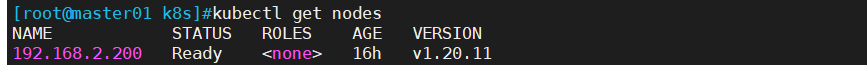

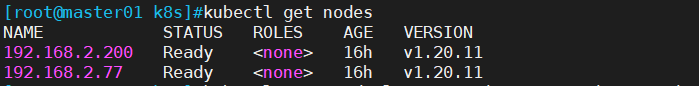

1.16 查看群集节点状态,成功加入node1节点

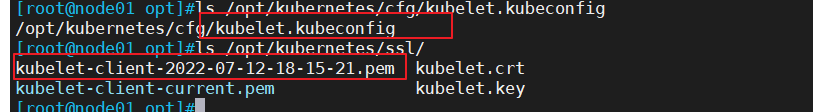

1.17 自动生成证书和kubelet.kubeconfig文件

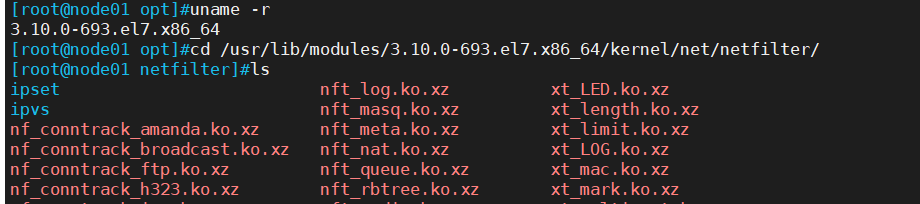

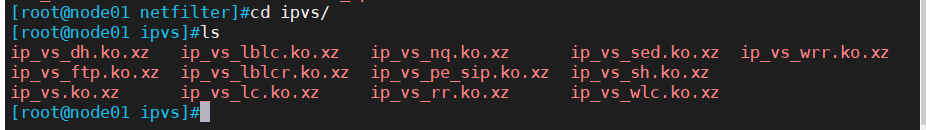

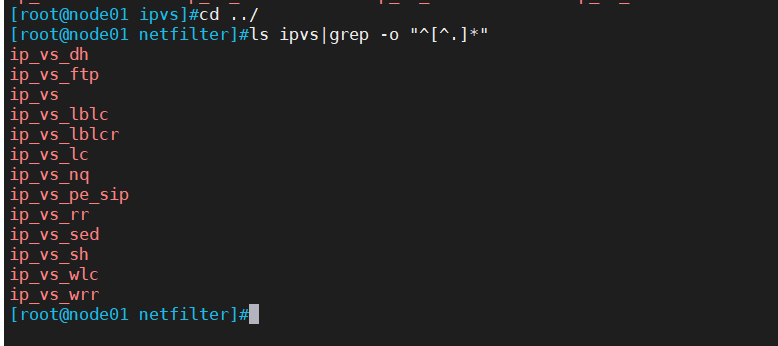

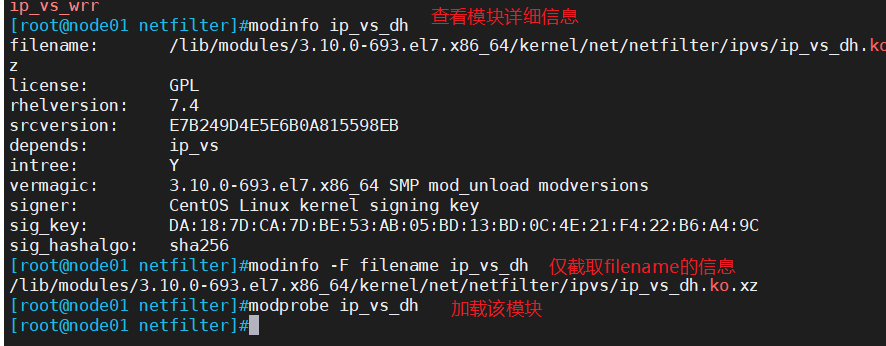

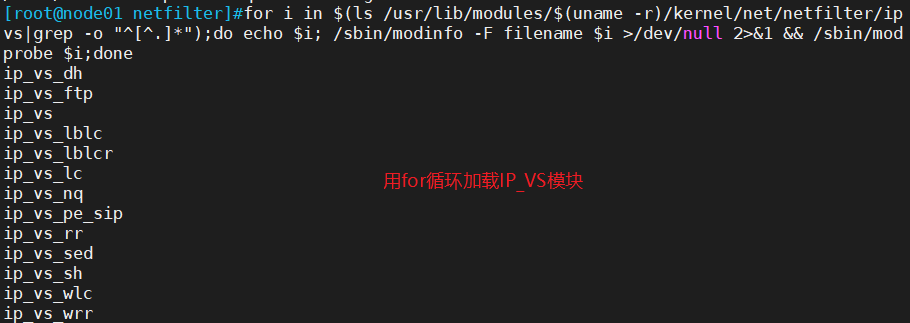

1.18 加载ip_vs模块

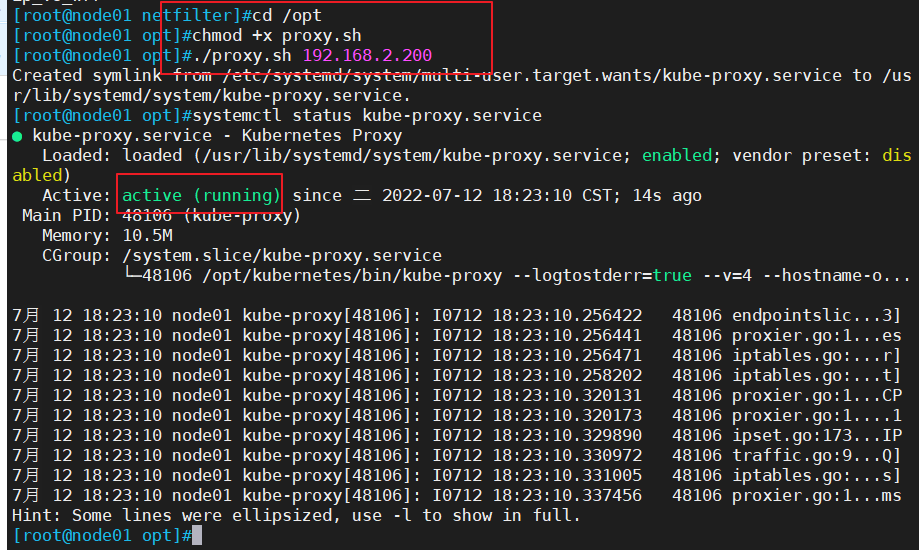

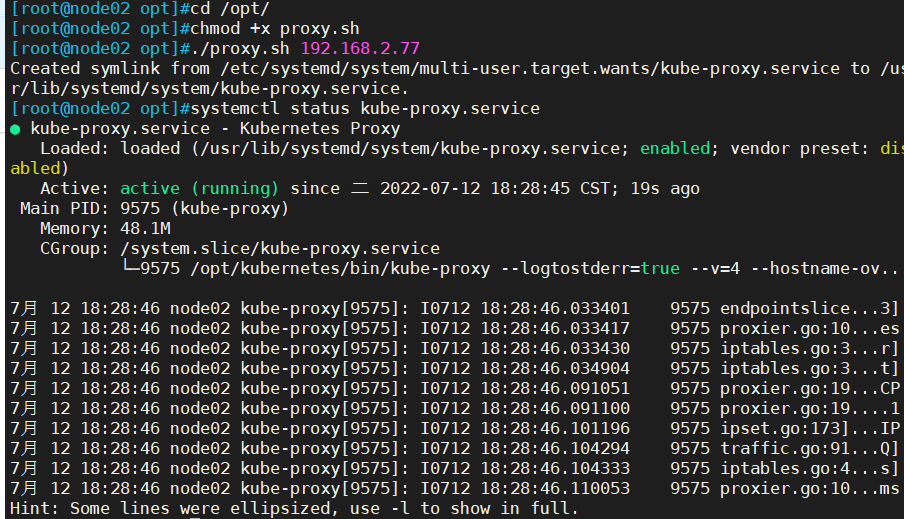

1.19 使用proxy.sh脚本启动proxy服务

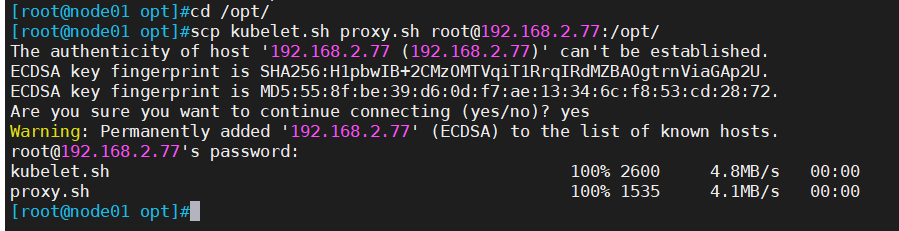

1.20 在node1 节点上将kubelet.sh、 proxy.sh 文件拷贝到node2 节点

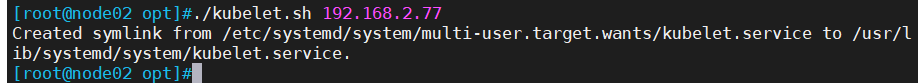

1.21 使用kubelet.sh脚本启动kubelet服务

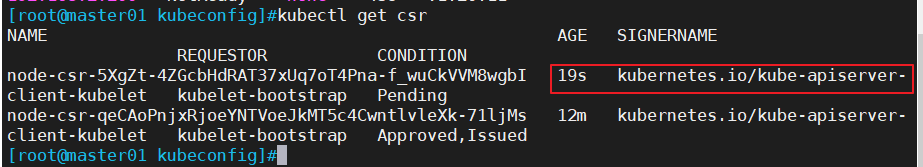

1.22 在master1 节点上操作,检查到node2 节点的kubelet 发起的CSR请求,Pending 表示等待集群给该节点签发证书.

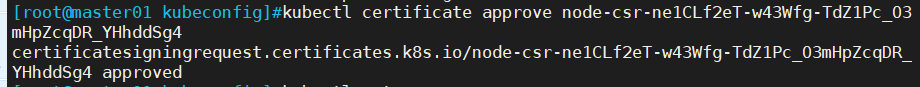

1.23 通过CSR请求

1.24 再次查看CSR请求状态,Approved, Issued表示已授权CSR请求并签发证书

1.25 查看群集节点状态,成功加入node1节点

1.26 在node2 节点 加载ip_vs模块

1.27 使用proxy.sh脚本启动proxy服务

1.28 测试连通性

一、环境准备

k8s集群master1:192.168.2.66 kube-apiserver kube-controller-manager kube-scheduler etcd

k8s集群node1: 192.168.2.200 kubelet kube-proxy docker flannel

k8s集群node2: 192.168.2.77 kubelet kube-proxy docker flannel

至少2C2G

1、常见的k8s部署方式

●Mini kube

Minikube是一个工具,可以在本地快速运行一个单节点微型K8s,仅用于学习预览K8s的一些特性使用

部署地址: https: / /kubernetes.io/docs/setup/minikube

●Kubeadmin

Kubeadmin也是一个工具,提供kubeadm init和kubeadm join,用于快速部署K8S集群,相对简单

https: / /kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/

●二进制安装部署

生产首选,从官方下载发行版的二进制包,手动部署每个组件和自签TLS证书,组成K8s集群,新手推荐

https: / /github.com/kubernetes/kubernetes/releases

小结:kubeadm降低部署门槛,但屏蔽了很多细节,遇到问题很难排查,如果想更容易可控,推荐使用二进制包部署kubernetes集群,虽然手动部署麻烦点,期间可以学习很多工作原理,也利于后期维护。

2、关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

3、关闭selinux

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

4、关闭swap

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab

5、根据规划设置主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

6、在master添加hosts

cat >> /etc/hosts <<EOF

192.168.2.66 master01

192.168.2.200 node01

192.168.2.77 node02

EOF

7、将桥接的IPv4流量传递到iptables的链

cat > /etc/sysctl.d/k8s.conf <<EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-ip6tables = 1

EOF

sysctl --system

8、时间同步

yum -y install ntpdate

ntpdate time.windows.com

二、部署etcd集群

etcd作为服务发现系统,有以下的特点:

• 简单、安装配置简单,而且提供了HTTP API进行交互,使用也很简单

• 安全: 支持SSL证书验证

• 快速: 单实例支持每秒2k+读操作

• 可靠: 采用raft算法实现分布式系统数据的可用性和一致性

准备签发证书环境:

CFSSL是CloudFlare 公司开源的一款PKI/TLS工具。CESSL 包含一个命令行工具和一个用于签名、验证和捆绑TLS证书的HTTP API服务。使用Go语言编写。

CFSSL使用配置文件生成证书,因此自签之前,需要生成它识别的json 格式的配置文件,CFSSL 提供了方便的命令行生成配置文件。

CFSSL用来为etcd提供TLS证书,它支持签三种类型的证书:

1、client证书,服务端连接客户端时携带的证书,用于客户端验证服务端身份,如kube-apiserver 访问etcd;

2、server证书,客户端连接服务端时携带的证书,用于服务端验证客户端身份,如etcd对外提供服务:

3、peer证书,相互之间连接时使用的证书,如etcd节点之间进行验证和通信。

这里全部都使用同一套证书认证。

注:etcd这里就不做集群了,直接部署在master节点上

1、master节点部署

下载证书制作工具

curl -L https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -o /usr/local/bin/cfssl

curl -L https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -o /usr/local/bin/cfssljson

curl -L https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -o /usr/local/bin/cfssl-certinfo

或者

wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/local/bin/cfssl

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/local/bin/cfssljson

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

chmod +x /usr/local/bin/cfssl /usr/local/bin/cfssljson /usr/local/bin/cfssl-certinfo chmod +x /usr/local/bin/cfssl

-----------------------------------------------------

cfssl: 证书签发的工具命令

cfssljson: 将cfssl 生成的证书( json格式)变为文件承载式证书

cfssl-certinfo:验证证书的信息

cfssl-certinfo -cert <证书名称>

2、查看证书的信息

2.1 创建k8s工作目录

mkdir /opt/k8s

cd /opt/k8s/

2.2 上传etcd-cert.sh 和etcd.sh 到/opt/k8s/ 目录中

chmod +x etcd-cert.sh etcd. sh

2.3 创建用于生成CA证书、etcd服务器证书以及私钥的目录

mkdir /opt/k8s/etcd-certmv etcd-cert.sh etcd-cert/

cd /opt/k8s/etcd-cert/

./etcd-cert.sh

2.4 生成CA证书、etcd服务器证书以及私钥

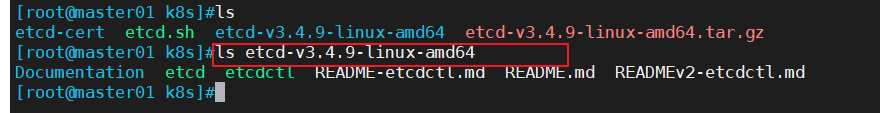

2.5 上传etcd-v3.3.10-1inux-amd64.tar.gz 到/opt/k8s/ 目录中,解压etcd 压缩包

cd /opt/k8s/

tar zxvf etcd-v3.3.10-linux-amd64.tar.gz

1s etcd-v3.3.10-linux-amd64

Documentation etcd etcdctl README-etcdctl.md README.md

READMEv2-etcdctl.md

==========================

etcd就是etcd服务的启动命令,后面可跟各种启动参数

3、etcdctl主要为etcd服务提供了命令行操作

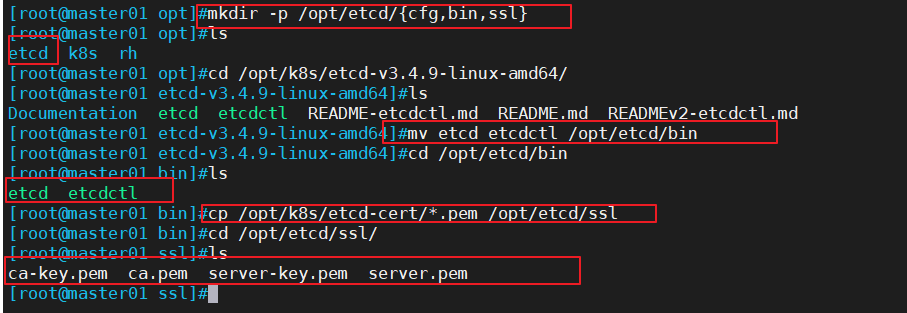

3.1 创建用于存放etcd配置文件,命令文件,证书的目录

mkdir -p /opt/etcd/{cfg,bin,ssl}

mv /opt/k8s/etcd-v3.3.10-linux- amd64/etcd /opt/k8s/etcd-v3.3.10-1inux-amd64/etcdct1 /opt/etcd/bin/

cp /opt/k8s/etcd-cert/*.pem /opt/etcd/ssl/

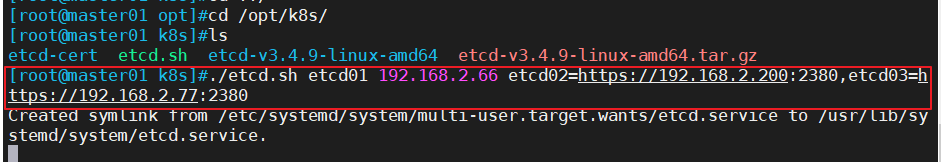

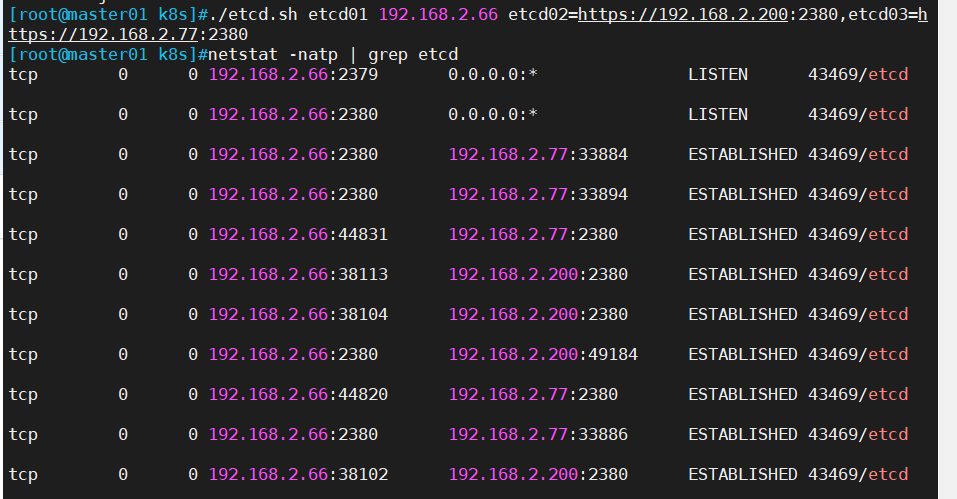

./etcd.sh etcd01 192.168.2.66 etcd02=https://192.168.2.200:2380,etcd03=https://192.168.2.77:2380

3.2 进入卡住状态等待其他节点加入,这里需要三台etcd服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有etcd节点都已启动,可忽略这个情况

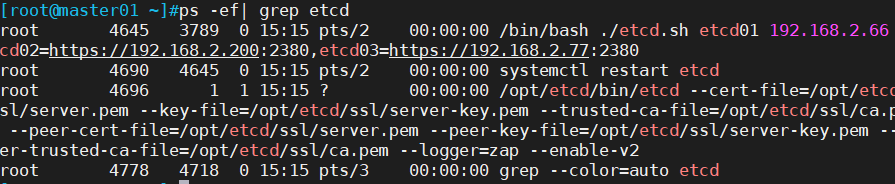

3.3 另外打开一个窗口查看etcd进程是否正常

ps -ef | grep etcd

3.4 把etcd相关证书文件和命令文件全部拷贝到另外两个etcd集群节点

scp -r /opt/etcd/ root@192.168.2.200:/opt/

scp -r /opt/etcd/ root@192.168.2.77:/opt/

3.5 把etcd服务管理文件拷贝到另外两个etcd集群节点

scp /usr/lib/systemd/system/etcd.service root@192.168.2.200:/usr/lib/systemd/system/

scp /usr/lib/systemd/system/etcd.service root@192.168.2.77:/usr/lib/systemd/system/

4、在node1与node2节点修改

4.1 在node1节点修改

cd /opt/etcd/cfg/

vim etcd

#[Member]

ETCD_NAME="etcd02"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.2.200:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.2.200:2379"#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.2.200:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.2.200:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.2.66:2380,etcd02=https://192.168.2.200:2380,etcd03=https://192.168.2.77:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

systemctl daemon-reload

systemctl enable --now etcd.service

4.2 在node2节点修改

cd /opt/etcd/cfg/

vim etcd

#[Member]

ETCD_NAME="etcd03"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.2.77:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.2.77:2379"#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.2.77:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.2.77:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.2.66:2380,etcd02=https://192.168.2.200:2380,etcd03=https://192.168.2.77:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

systemctl daemon-reload

systemctl enable --now etcd.service

5、在master1节点上进行启动

5.1 首先在master1节点上进行启动

cd /root/k8s/

./ etc.sh etcd01 192.168.2.66:2380 etcd02 192.168.2.200:2380 etcd03 192.168.2.77:2380

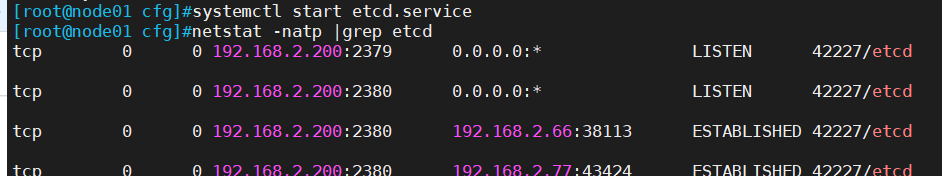

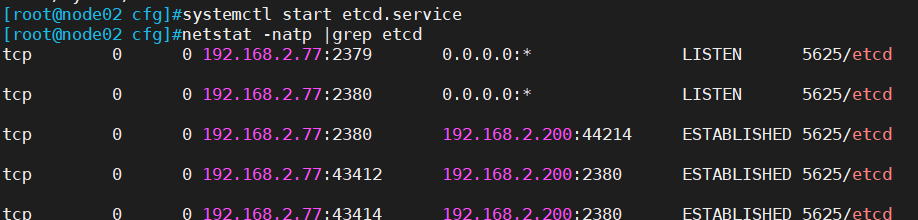

5.2 接着在node1和node2节点分别进行启动

systemctl start etcd.service

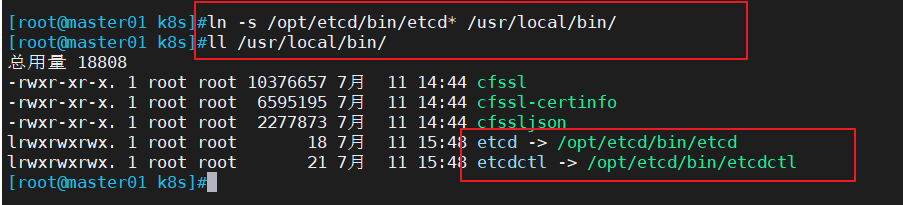

5.3 在master1 节点上操作

1n -s /opt/etcd/bin/etcd* /usr/1oca1/bin

5.4 检查etcd群集状态

cd /opt/etcd/ss1

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://192.168.2.66:2379,https://192.168.2.200:2379,https://192.168.2.77:2379" endpoint health --write-out=table

-----------------------------------------------

--cert-file:识别HTTPS端使用sSL证书文件

--key-file: 使用此SSL密钥文件标识HTTPS客户端

-ca-file:使用此CA证书验证启用https的服务器的证书

--endpoints:集群中以逗号分隔的机器地址列表

cluster-health:检查etcd集群的运行状况

-----------------------------------------------

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://192.168.2.66:2379,https://192.168.2.200:2379,https://192.168.2.77:2379" --write-out=table member list

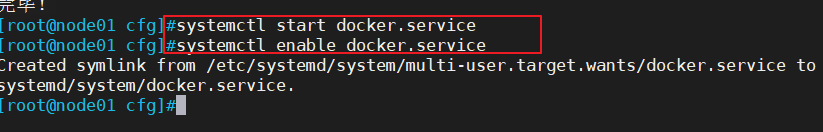

6、部署docker引擎

6.1 所有node节点部署docker引擎

yum install -y yum-utils device-mapper-persistent-data 1vm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce dqsker-ce-cli containerd.iosystemctl start docker.service

systemctl enable docker.service

三、flannel网络配置

1、flannel网络配置

K8S中Pod网络通信:

●Pod内容器与容器之间的通信

在同一个Pod内的容器(Pod内的容器是不会跨宿主机的)共享同一个网络命令空间,相当于它们在网一台机器上一样,可以用localhost地址访间彼此的端口

●同一个Node内Pod之间的通信

每个Pod 都有一个真实的全局IP地址,同一个Node 内的不同Pod之间可以直接采用对方Pod的IP 地址进行通信,Pod1 与Pod2都是通过veth连接到同一个docker0 网桥,网段相同,所以它们之间可以直接通信

●不同Node上Pod之间的通信

Pod地址与docker0 在同一网段,dockor0 网段与宿主机网卡是两个不同的网段,且不同Nodo之间的通信贝能通过宿主机的物理网卡进行

要想实现不同Node 上Pod之间的通信,就必须想办法通过主机的物理网卡IP地址进行寻址和通信。

因此要满足两个条件:

Pod 的IP不能冲突:

将Pod的IP和所在的Node的IP关联起来,通过这个关联让不同Node上Pod之间直接通过内网IP地址通信。

=Overlay Network:=

叠加网络,在二层或者三层基础网络上叠加的一种虚拟网络技术模式,该网络中的主机通过虚拟链路隧道连接起来(类似于VPN)

=VXLAN:=

将源数据包封装到UDP中,并使用基础网络的IP/MAC作为外层报文头进行封装,然后在以太网上传输,到达目的地后由隧道端点解封装并将数据发送给目标地址

=Flannel:=

Flannel的功能是让集群中的不同节点主机创建的Docker容器都具有全集群唯一的虚拟IP地址

Flannel是Overlay 网络的一种,也是将TCP 源数据包封装在另一种网络 包里而进行路由转发和通信,目前己经支持UDP、VXLAN、AwS VPC等数据转发方式

=ETCD之Flannel 提供说明:=

存储管理Flanne1可分配的IP地址段资源

监控ETCD中每个Pod 的实际地址,并在内存中建立维护Pod 节点路由表

Flannel工作原理:

node1上的pod1 要和node2上的pod1进行通信

1.数据从node1上的Pod1源容器中发出,经由所在主机的docker0 虚拟网卡转发到flannel0虚拟网卡;

2.再由flanneld把pod ip封装到udp中(里面封装的是源pod IP和目的pod IP);

3.根据在etcd保存的路由表信息,通过物理网卡发送给目的node2的flanneld,来进行解封装暴露出udp里的pod IP;

4.最后根据目的pod IP经flannel0虚拟网卡和docker0虚拟网卡转发到目的pod中,最后完成通信

2、在master1 节点 添加flannel 网络配置信息

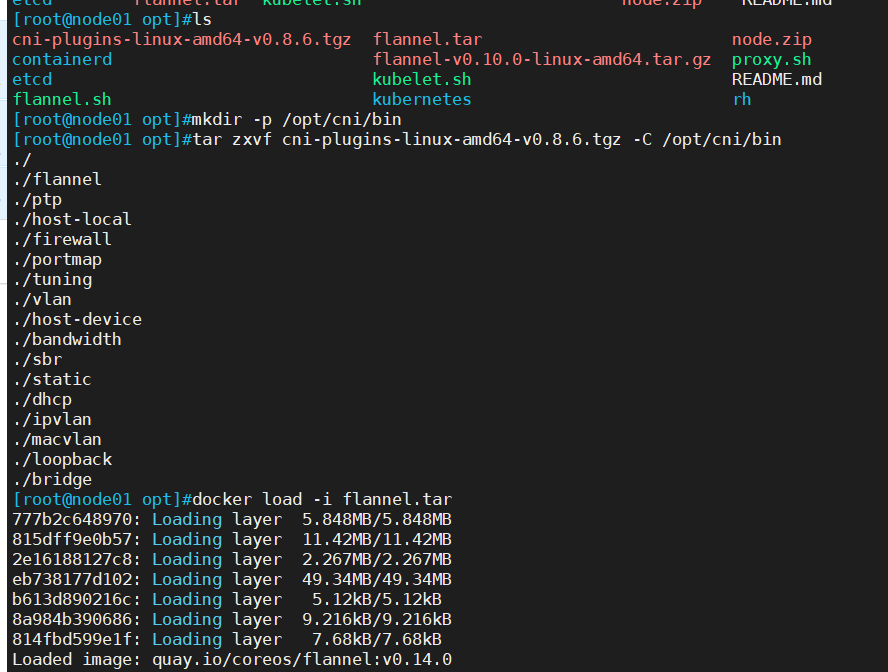

2.1 在node01 节点上操作

#上传 cni-plugins-linux-amd64-v0.8.6.tgz 和 flannel.tar 到 /opt 目录中

cd /opt/mkdir -p /opt/cni/bin

tar zxvf cni-plugins-linux-amd64-v0.8.6.tgz -C /opt/cni/bindocker load -i flannel.tar

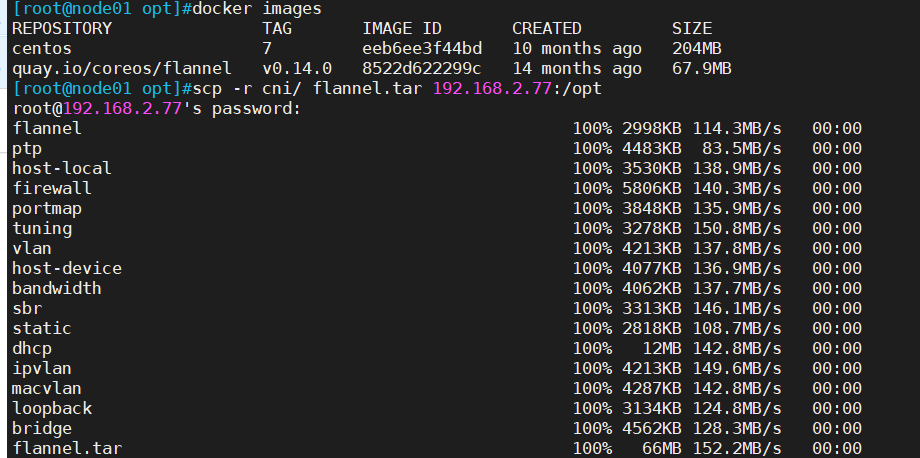

docker images

scp -r cni/ flannel.tar 192.168.2.200:/opt

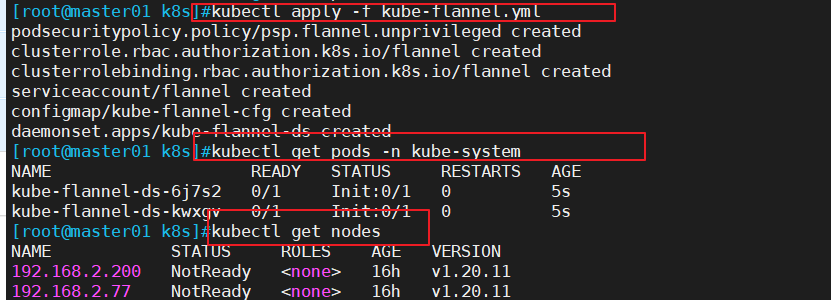

3、在所有master节点上操作

//在 master01 节点上操作

#上传 kube-flannel.yml 文件到 /opt/k8s 目录中,部署 CNI 网络

cd /opt/k8s

kubectl apply -f kube-flannel.yml kubectl get pods -n kube-systemkubectl get nodes

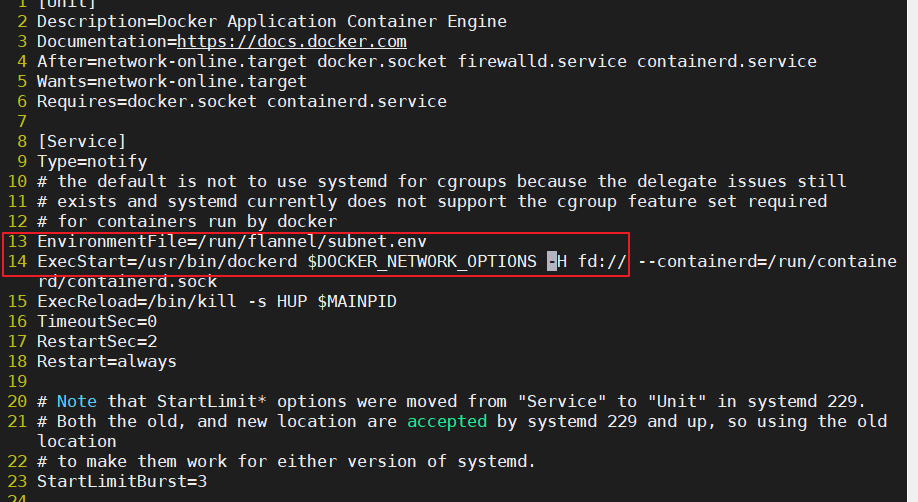

3.1 修改docker服务管理文件,配置docker连接flannel

vim /lib/systemd/system/docker.service

[Service]

Type=notify

# the default is not to use systemd for cgroups because the delegate issues stillt

# exists and systemd currently dges not support the cgroup feature set requi red

# for containers run by docker

EnvironmentFile=/run/flannel/subnet.env

#添加

ExecStart=/usr/bin/dockerd $DOCKER_NETWORK_OPTIONS -H fd:// --containerd=/run/containerd/containerd.sock

#修改

ExecReload=/bin/kill -s HUP $MAINPID

TimeoutSec=0

RestartSec=2

Restart=always

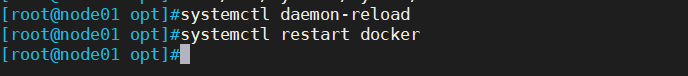

3.2 重启docker服务

systemctl daemon-reload

systemctl restart docker

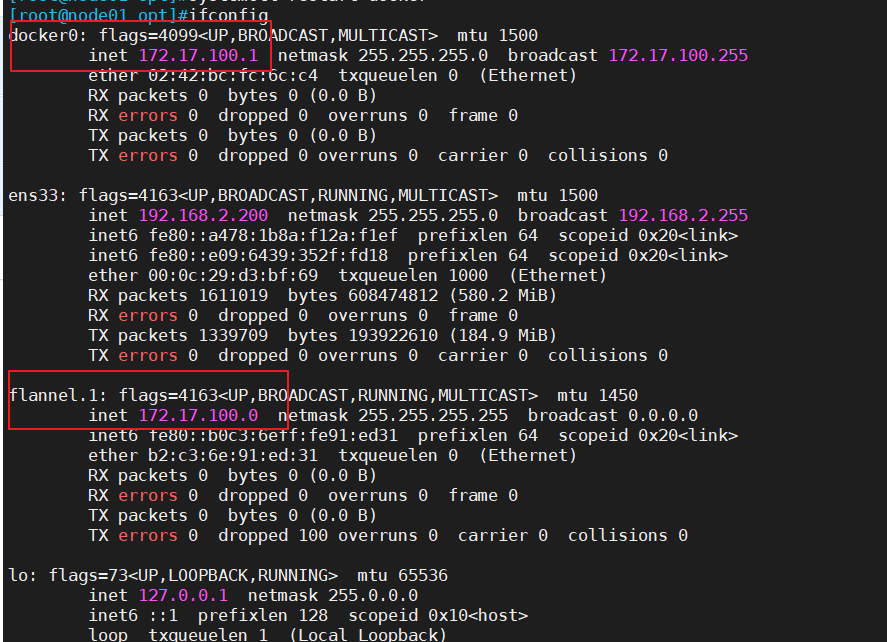

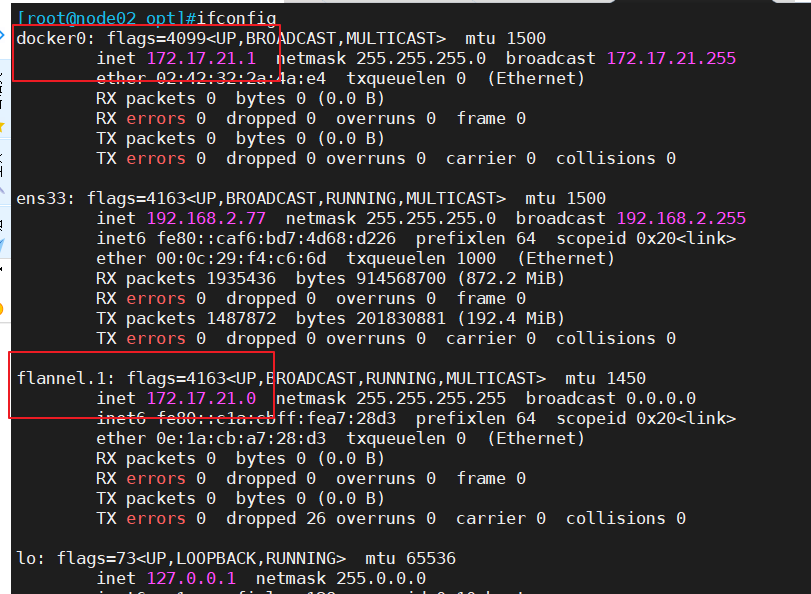

3.3 ifconfig #查看flannel网络

3.4 测试ping通对方docker0网卡 证明flannel起到路由作用

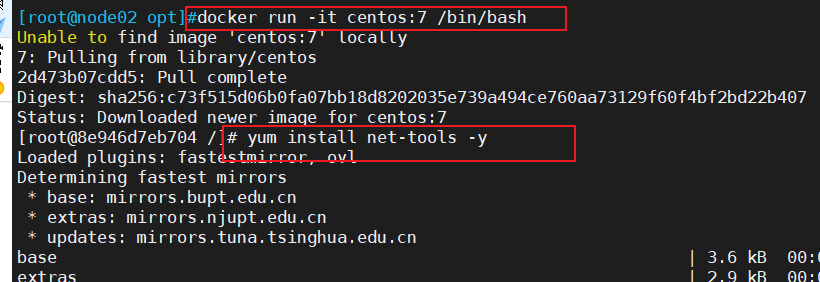

ping 172.17.21.1docker run -it centos:7 /bin/bash #node1和node2都运行该命令yum install net-tools -y #node1和node2都运行该命令ifconfig //再次测试ping通两个node中的centos:7容器

四、部署master组件

1、在master1 节点上操作

1.1 上传master.zip 和k8s-cert.sh 到/opt/k8s 目录中,解压master.zip 压缩包

cd /opt/k8s/

unzip master.zip

apiserver.sh

scheduler.sh

controller-manager.shchmod +x * .sh

1.2 创建kubernetes工作目录

mkdir -p /opt/kubernetes/{cfg,bin,ssl}

1.3 创建用于生成CA证书、相关组件的证书和私钥的目录

mkdir /opt/k8s/k8s-cert

mv /opt/k8s/k8s-cert.sh /opt/k8s/k8s-cert

cd /opt/k8s/k8s-cert/

./k8s-cert.sh

2、生成CA证书、相关组件的证书和私钥

//controller-manager和kube-scheduler设置为只调用当前机器的apiserver, 使用127.0.0.1:8080 通信,因此不需要签发证书

2.1 复制CA证书、apiserver 相关证书和私钥到kubernetes. 工作目录的ssl子目录中

cp ca*pem apiserver*pem /opt/kubernetes/ssl/

2.2 上传kubernetes-server-linux-amd64.tar.gz 到/opt/k8s/ 目录中,解压kubernetes 压缩包

cd /opt/k8s/

tar zxvf kubernetes-server-linux-amd64.tar.gz

2.3 复制master组件的关键命令文件到kubernetes. 工作目录的bin子目录中

cd /opt/k8s/kubernetes/server/bin

cp kube-apiserver kubectl kube-controller-manager kube-scheduler /opt/kubernetes/bin/

1n -s /opt/kubernetes/bin/* /usr/local/bin/

2.4 创建bootstrap token 认证文件,apiserver 启动时会调用,然后就相当于在集群内创建了一个这个用户,接下来就可以用RBAC给他授权

cd /opt/k8s/

vim token.sh

#!/bin/bash

#获取随机数前16个字节内容,以十六进制格式输出,并删除其中空格

BOOTSTRAP_TOKEN=$(head -e 16 /dev/urandom | od -An -t x | tr -d ‘ ’)

#生成token.csv 文件,按照Token序列号,用户名,UID,用户组的格式生成

cat > /opt/kubernetes/cfg/token.csv <<EOF

${BOOTSTRAP_TOKEN},kubelet-bootstrap,10001,"system:kubelet-bootstrap"

EOF

chmod +x token.sh

./token.sh./apiserver.sh 192.168.2.66 https://192.168.2.66:2379,https://192.168.2.200:2379,https://192.168.2.77:2379

2.5 使用 head -c 16 /dev/urandom | od -An -t x | tr -d ' '可以随机生成序列号,并创建token.csv文件,也可以使用脚本创建

二进制文件,token,证书都准备好,开启apiserver

3、检查进程是否启动成功

ps aux | grep kube-apiserver

3.1 k8s通过kube- apiserver这 个进程提供服务,该进程运行在单个master节点上。默认有两个端口6443和8080

//安全端口6443用于接收HTTPS请求,用于基于Token文件或客户端证书等认证

//本地端口8080用于接收HTTP请求,非认证或授权的HTTP请求通过该端口访问APIServer

netstat -natp| grep 8080

netstat -natp | grep 6443

3.2 查看版本信息(必须保证apiserver启动正常,不然无法查询到server的版本信息)

kubectl version

3.3 启动scheduler 服务

cd /opt/k8s/

./scheduler.sh 127.0.0.1ps aux | grep kube-scheduler

3.4 启动controller-manager服务

cd /opt/k8s/

./controller-manager.sh 127.0.0.1

4、生成kubectl连接集群的证书

./admin.shkubectl create clusterrolebinding cluster-system-anonymous --clusterrole=cluster-admin --user=system:anonymous

4.1 查看节点状态

kubectl get cs

五、部署node组件

1、部署node组件

1.1在master1 节点上操作,把kubelet、 kube-proxy拷贝到node 节点

cd /opt/k8s/kubernetes/server/bin

scp kubelet kube-proxy root@192.168.229.80:/opt/kubernetes/bin/

scp kubelet kube-proxy root@192.168.229.70:/opt/kubernetes/bin/

在node1 节点上操作

1.2 上传node.zip到/opt 目录中,解压node.zip 压缩包,获得kubelet.sh、 proxy.sh

cd /opt/

unzip node.zip

在master1节点上操作

1.3 创建用于生成kubelet的配置文件的目录

mkdir /opt/k8s/kubeconfig

1.4 上传kubeconfig.sh 文件到/opt/k8s/kubeconfig目录中

#kubeconfig.sh文件包含集群参数(CA 证书、API Server 地址),客户端参数(上面生成的证书和私钥),集群context

上下文参数(集群名称、用户名)。Kubenetes 组件(如kubelet、 kube-proxy) 通过启动时指定不同的kubeconfig文件可以切换到不同的集群,连接到apiserver

cd /opt/k8s/kubeconfig

chmod +x kubeconfig.sh

1.5 生成kubelet的配置文件

cd /opt/k8a/kubeconfig

./kubeconfig.sh 192.168.2.66 /opt/k8s/k8s-cert/1s

bootstrap.kubeconfig kubeconfig.sh kube-proxy.kubeconfig

1.6 把配置文件bootstrap.kubeconfig、kube-proxy.kubeconfig拷贝到node节点

cd /opt/k8s/kubeconfig

scp bootstrap.kubeconfig kube-proxy-kubeconfig root@192.168.2.200:/opt/kubernetes/cfg/

scp bootstrap.kubeconfig kube-proxy.kubeconfig root@192.168.2.77:/opt/kubernetes/cfg/

1.7 RBAC授权,将预设用户kubelet-bootatrap 与内置的ClusterRole system:node-bootatrapper 绑定到一起,使其能够发起CSR请求

kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap

kubelet采用TLS Bootstrapping 机制,自动完成到kube -apiserver的注册,在node节点量较大或者后期自动扩容时非常有用。

Master apiserver 启用TLS 认证后,node 节点kubelet 组件想要加入集群,必须使用CA签发的有效证书才能与apiserver 通信,当node节点很多时,签署证书是一件很繁琐的事情。因此Kubernetes 引入了TLS bootstraping 机制来自动颁发客户端证书,kubelet会以一个低权限用户自动向apiserver 申请证书,kubelet 的证书由apiserver 动态签署。

kubelet首次启动通过加载bootstrap.kubeconfig中的用户Token 和apiserver CA证书发起首次CSR请求,这个Token被预先内置在apiserver 节点的token.csv 中,其身份为kubelet-bootstrap 用户和system: kubelet- bootstrap用户组:想要首次CSR请求能成功(即不会被apiserver 401拒绝),则需要先创建一个ClusterRoleBinding, 将kubelet-bootstrap 用户和system:node - bootstrapper内置ClusterRole 绑定(通过kubectl get clusterroles 可查询),使其能够发起CSR认证请求。

TLS bootstrapping 时的证书实际是由kube-controller-manager组件来签署的,也就是说证书有效期是kube-controller-manager组件控制的; kube-controller-manager 组件提供了一个--experimental-cluster-signing-duration

参数来设置签署的证书有效时间:默认为8760h0m0s, 将其改为87600h0m0s, 即10年后再进行TLS bootstrapping 签署证书即可。

也就是说kubelet 首次访问API Server 时,是使用token 做认证,通过后,Controller Manager 会为kubelet生成一个证书,以后的访问都是用证书做认证了。

------------------------------------------

1.8 查看角色

kubectl get clusterroles | grep system:node-bootstrapper

1.9 查看已授权的角色

kubectl get clusterrolebinding

在node1节点上操作

1.10 使用kubelet.sh脚本启动kubelet服务

cd /opt/

chmod +x kubelet.sh

./kubelet.sh 192.168.2.200

1.11 检查kubelet服务启动

ps aux | grep kubelet

1.12 此时还没有生成证书

ls /opt/kubernetes/ssl/

1.13 在master1 节点上操作

//检查到node1 节点的kubelet 发起的CSR请求,Pending 表示等待集群给该节点签发证书

kubectl get csr

1.14 通过CSR请求

kubectl certificate approve node-csr-12DGPu__kpLSBsGUHpvGs6Q89B9aYysw9C61pAagDEA

1.15 再次查看CSR请求状态,Approved, Issued表示已授权CSR请求并签发证书

kubectl get csr

1.16 查看群集节点状态,成功加入node1节点

kubectl get nodes

在node1节点上操作

1.17 自动生成证书和kubelet.kubeconfig文件

ls /opt/kubernetes/cfg/kubelet.kubeconfig

ls /opt/kubernetes/ssl/

1.18 加载ip_vs模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F

filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

1.19 使用proxy.sh脚本启动proxy服务

cd /opt/

chmod +x proxy.sh

./proxy.sh 192.168.2.200systemctl status kube-proxy.service

node2 节点部署

##方法一 :

1.20 在node1 节点上将kubelet.sh、 proxy.sh 文件拷贝到node2 节点

cd /opt/

scp kubelet.sh proxy.sh root@192.168.2.77:/opt/

1.21 使用kubelet.sh脚本启动kubelet服务

cd /opt/

chmod +x kubelet.sh

./kubelet.sh 192.168.2.77

1.22 在master1 节点上操作,检查到node2 节点的kubelet 发起的CSR请求,Pending 表示等待集群给该节点签发证书.

kubectl get csr

1.23 通过CSR请求

kubectl certificate approve node-csr-NOI-9vufTLIqJgMWq4fHPNPHKbjCX1DGHptj7FqTa8A

1.24 再次查看CSR请求状态,Approved, Issued表示已授权CSR请求并签发证书

kubectl get csr

1.25 查看群集节点状态,成功加入node1节点

kubectl get nodes

1.26 在node2 节点 加载ip_vs模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

1.27 使用proxy.sh脚本启动proxy服务

cd /opt/

chmod +x proxy.sh

./proxy.sh 192.168.2.77systemctl status kube-proxy.service

1.28 测试连通性

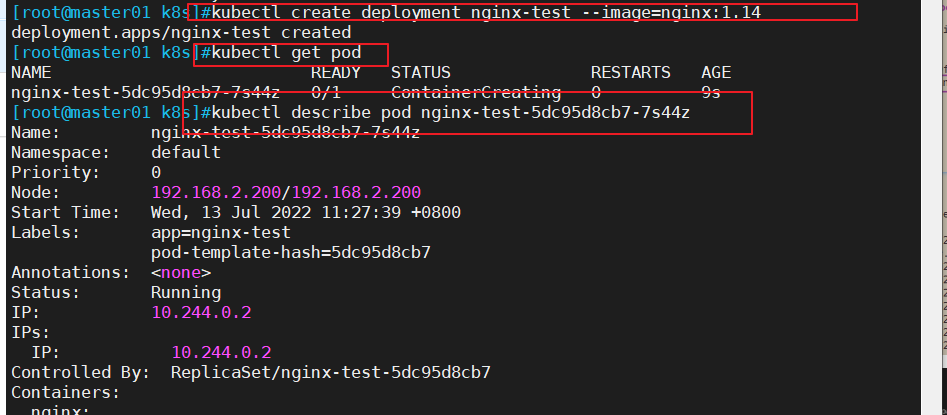

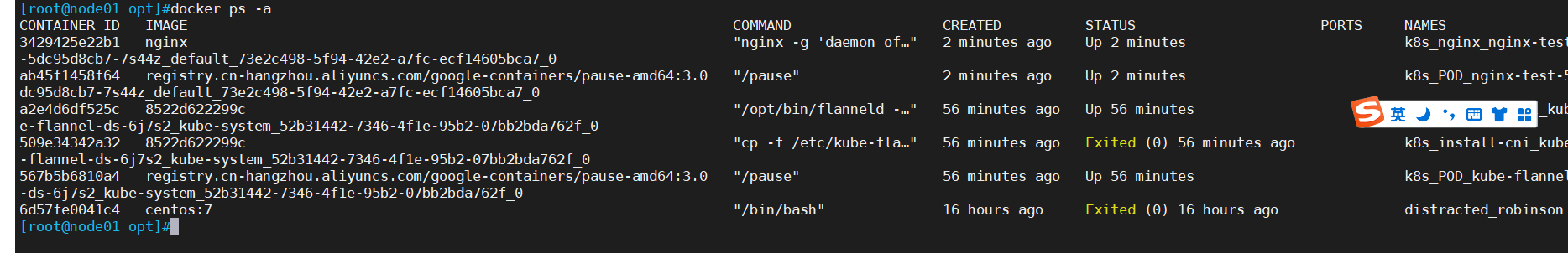

kubectl create deployment nginx-test --image=nginx:1.14

kubectl get pod

kubectl get pod

kubectl describe pod nginx-test-7dc4f9dcc9-vlzmk

相关文章:

二进制部署K8S

目录 一、环境准备 1、常见的k8s部署方式 2、关闭防火墙 3、关闭selinux 4、关闭swap 5、根据规划设置主机名 6、在master添加hosts 7、将桥接的IPv4流量传递到iptables的链 8、时间同步 二、部署etcd集群 1、master节点部署 2、查看证书的信息 2.1 创建k8s工作目…...

高效获知Activity的生命周期

Activity生命周期监听 使用 Instrumentation 对 Activity 生命周期进行监听。 优点: 全局仅一次反射,性能影响极小所有Activity的生命周期都能够被监听到由于Java的单继承,为了拓展性,可以使用装饰器模式对Instrumentation进行功…...

分析现货黄金价格一般有什么方法

分析现货黄金价格一般有什么方法呢?我相信很多投资者都会说,是技术分析。很多人并不知道技术分析是什么,并且技术分析是如何去分析现货黄金价格的,那么本文就介绍一下技术分析的主要分类。可以说,小编的其他文章都是以…...

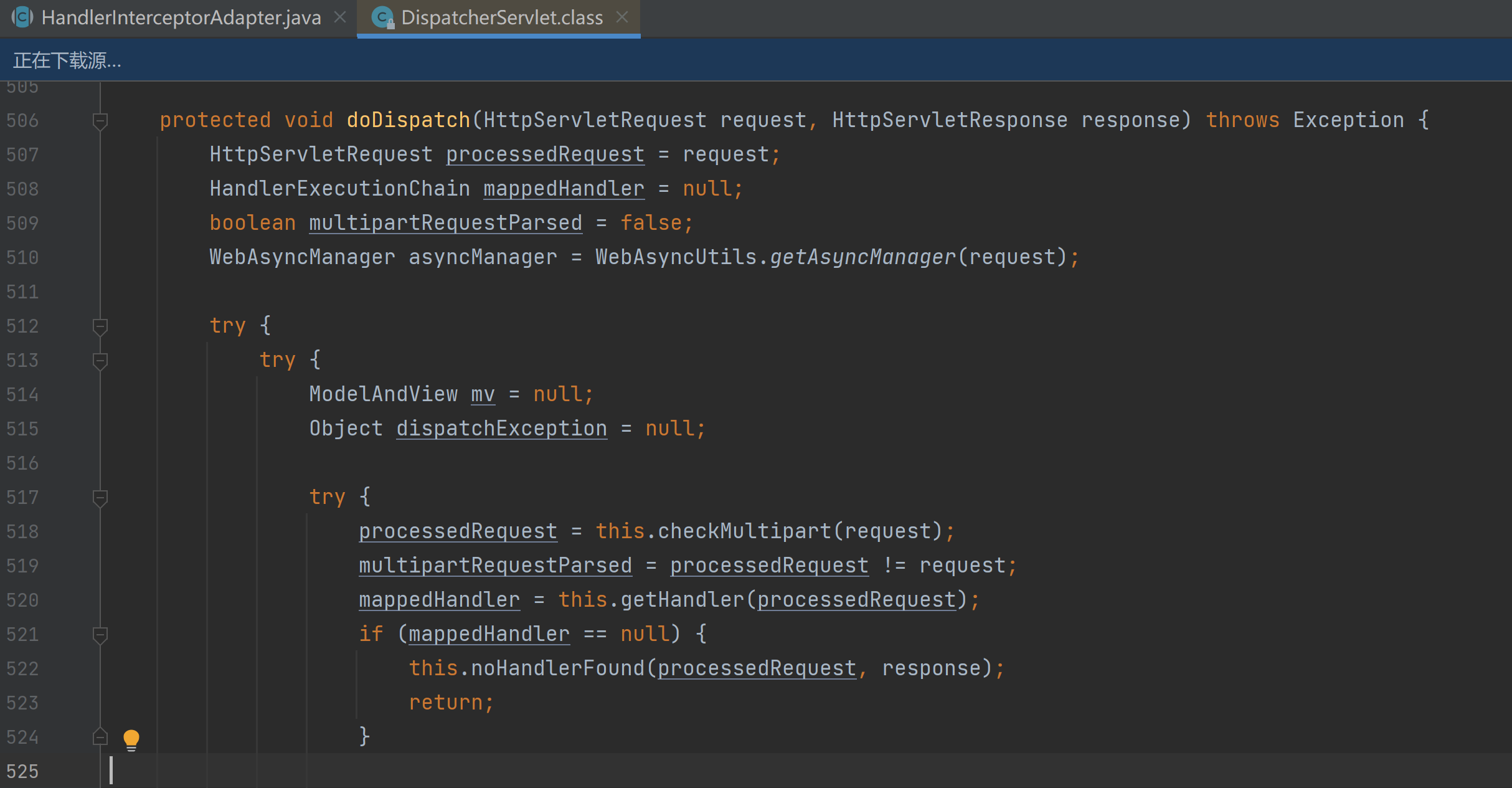

Spring中的拦截器

这里写目录标题基本概念HandlerInterceptor拦截器HandlerInterceptor讲解MethodInterceptor拦截器二者的区别基本概念 在web开发中,拦截器是经常用到的功能。它可以帮我们预先设置数据以及统计方法的执行效率等等。 Spring中拦截器主要分两种,一个是Han…...

【Linux操作系统】【综合实验四 Linux的编译环境及线程编程】

文章目录一、实验目的二、实验要求三、实验内容四、实验报告要求一、实验目的 要求熟悉Linux环境中的程序编译、调试与项目管理过程并能实现具体操作;熟练使用基础函数库中与线程库中的管理函数,实现用户线程编程过程,并深入了解Linux的线程…...

Switch 如何使用NSCB 转换XCI NSP NSZ教程

很多小白经常碰到Switch游戏文件格式和预期不符的情况,比如碰到nsz自己不会安装(安装NSZ格式文件教程);或者是碰到xci格式的,想转换为nsp;抑或想将nsz格式文件还原回nsp格式。本文对此提供了解决方案。 文中…...

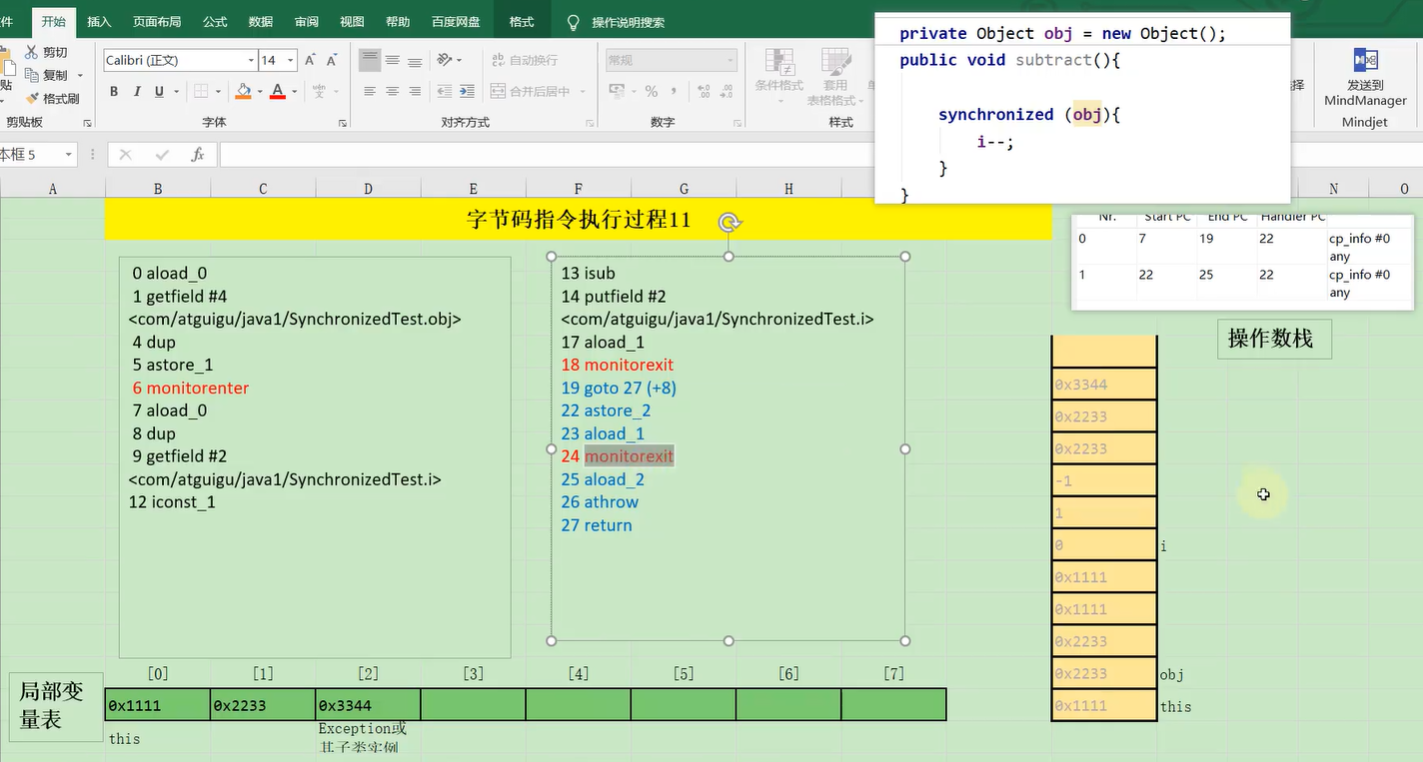

JVM12 字节码指令集

1. 概述 2. 加载与存储指令 2.1. 局部变量压栈指令 iload 从局部变量中装载int类型值 lload 从局部变量中装载long类型值 fload 从局部变量中装载float类型值 dload 从局部变量中装载double类型值 aload 从局部变量中装载引用类型值(refernce) iload_0 从…...

centos之python安装与多版本python之间的共存

一、背景 随着python版本迭代加快,有写python模块再低版本无法运行,此时需要我们在进行安装一个python版本 例如:uvloop 在python3.7上运行;python 3.6官方不再维护与更新 有些模块或不支持较低版本、有些模块支持较高版本python…...

)

SpringBoot学习笔记(一)

Idea中隐藏指定文件或指定类型文件 setting->File Types->Ignored Files and Folders输入要隐藏的文件名,支持*号通配符回车确认添加 SpringBoot概述 parent 小结: 开发SpringBoot程序要继承spring-boot-starter-parentspring-boot-starter-pa…...

美国原装KEYSIGHT E4981A(安捷伦) E4981A电容计

KEYSIGHT E4981A(安捷伦) Keysight E4981A(安捷伦)电容计为生产线中的陶瓷电容器测试提供了高速、可靠的测量。E4981A 实现了电容从小到大的测量能力,测量准确。Agilent E4981A 电容计有助于提高测试吞吐量࿰…...

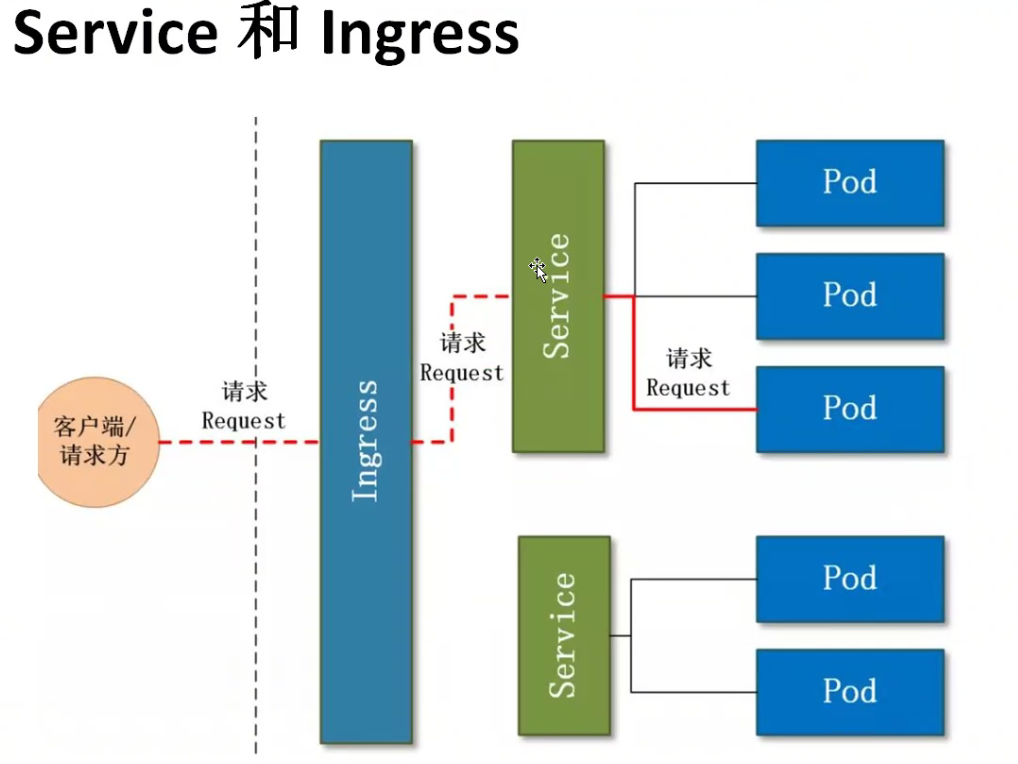

K8S的基础概念

目录 一、k8s概述 1、k8s简介 1.1 k8s的作用 1.2 k8s的由来 1.3 k8s的含义 1.4 k8s的官网 1.5 GitHub 2、为什么要用 K8S? 2.1 K8s的目标 2.2 K8s解决了裸跑Docker 的若干痛点: 2.3 K8s的主要功能 3、K8s的特性 二、Kubernetes 集群架构与组件 1、工作流程 2、…...

【数据结构】——环形队列

文章目录一.环形队列的定义及其特点二.使用数组来实现环形队列1.创建一个队列2.初始化队列3. 判断环形队列是否为空4.判断环形队列是否已满5. 向循环队列插入元素,插入成功返回真6.删除环形链表的数据7. 取队头元素8.取队尾元素8.释放空间总结一.环形队列的定义及其…...

windows 安装Qt

下载 下载地址https://download.qt.io/,此文已5.7.0为例子。 根据图片依次选择即可。 安装 安装过程参考另一篇文章Ubuntu 安装 Qt5.7.0即可 配置环境变量 ps:我就是之前没配置环境变量,直接使用创建项目,项目源码直接运行是…...

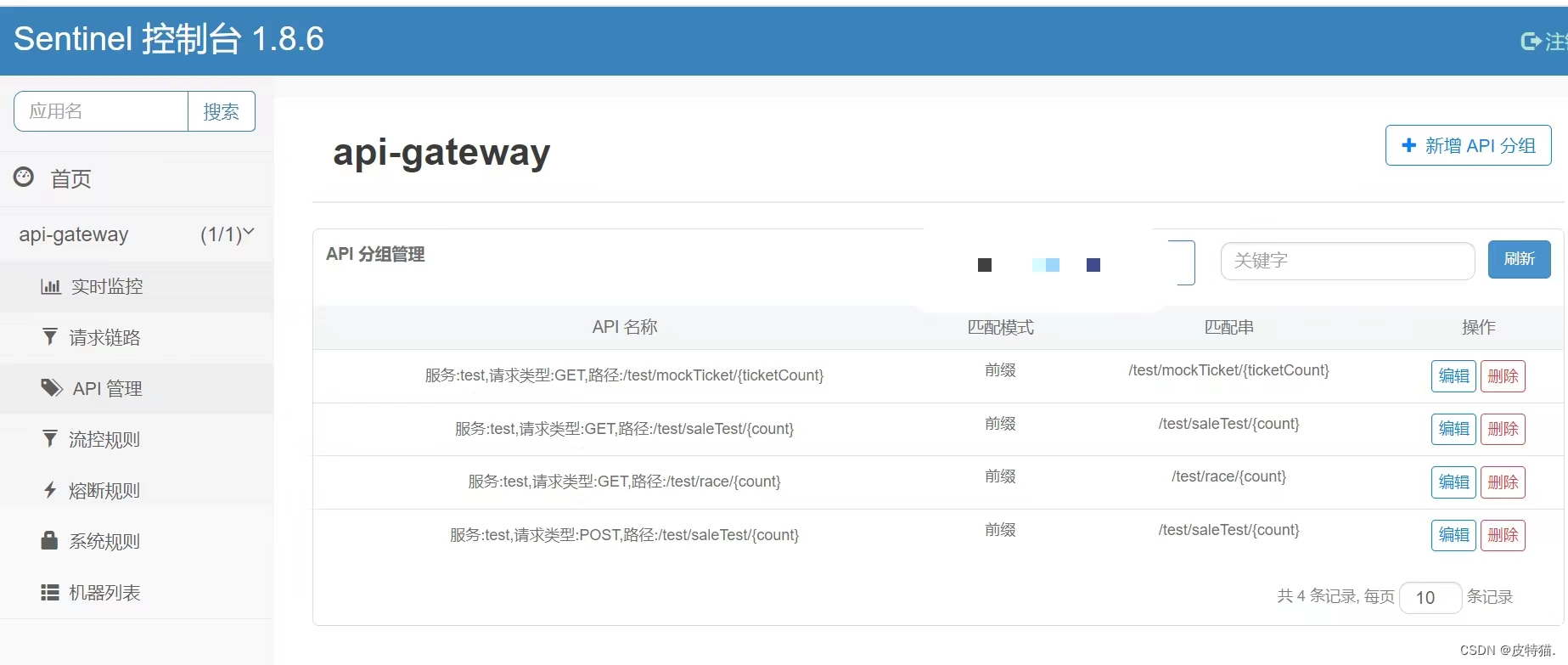

spring cloud gateway集成sentinel并扩展支持restful api进行url粒度的流量治理

sentinel集成网关支持restful接口进行url粒度的流量治理前言使用网关进行总体流量治理(sentinel版本:1.8.6)1、cloud gateway添加依赖:2、sentinel配置3、网关类型项目配置4、通过zk事件监听刷新上报api分组信息1、非网关项目上报api分组信息…...

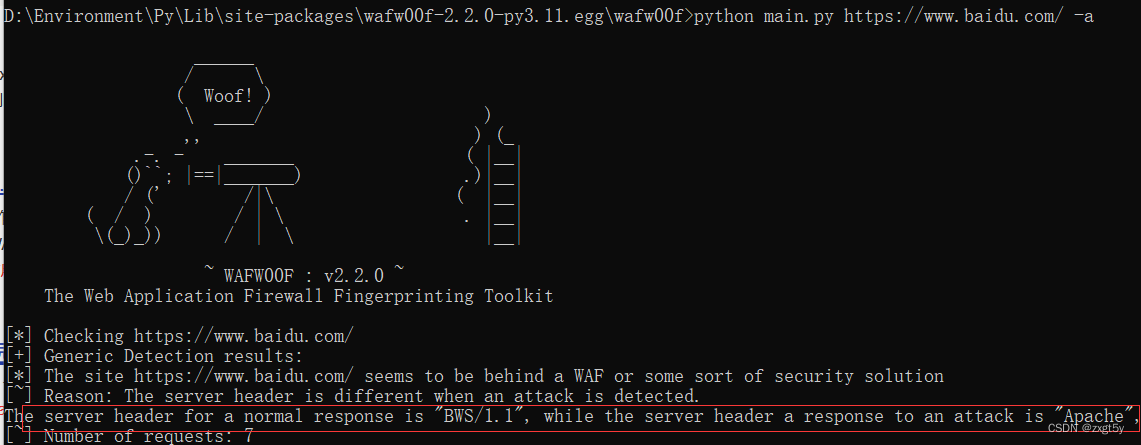

wafw00f工具

wafw00f Web应用程序防火墙指纹识别工具 github地址:https://github.com/EnableSecurity/wafw00f 安装环境:python3环境 —>使用 pip install wafw00f 进行安装 安装成功后目录:python安装目录中的Lib\site-packages\wafw00f 本机为&a…...

论文阅读笔记-DiffusionInst: Diffusion Model for Instance Segmentation

文章目录DiffusionInst: Diffusion Model for Instance Segmentation摘要介绍任务介绍实例分割的几种方法想法来源贡献方法整体结构Mask RepresentationDiffusionInst组成TrainingInference不足之处感悟DiffusionInst: Diffusion Model for Instance Segmentation 代码&#x…...

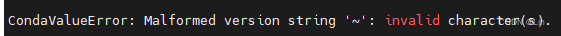

解决CondaUpgradeError网上的方法都不奏效(回退版本、upgrade/update都不行)的问题和CondaValueError

问题描述 Executing transaction: failed ERROR conda.core.link:_execute(502): An error occurred while installing package ‘conda-forge::certifi-2022.9.24-pyhd8ed1ab_0’. CondaUpgradeError: This environment has previously been operated on by a conda version…...

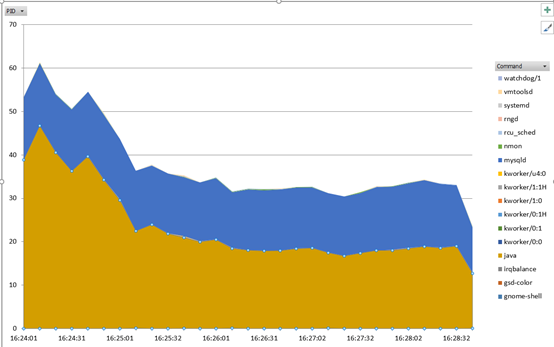

基于某业务单登陆场景并发测试实战

文章目录1 测试目的2 测试目标和测试对象3 名词解释4 测试说明5 测试环境和工具5.1 测试工具5.2 测试环境5.3 人力计划6 测试用例6.1 方案设计6.2 接口地址6.3 接口参数6.3.1 header参数6.3.2 请求参数7 脚本设计8 监控数据8.1 虚拟用户并发情况8.2 事务响应时间8.3 每秒点击次…...

JVM内存模型

程序计数器 多线程时,当线程数超过CPU数量或CPU内核数量,线程之间就要根据时间片轮询抢夺CPU时间资源。因此每个线程有要有一个独立的程序计数器,记录下一条要运行的指令。线程私有的内存区域。如果执行的是JAVA方法,计数器记录正…...

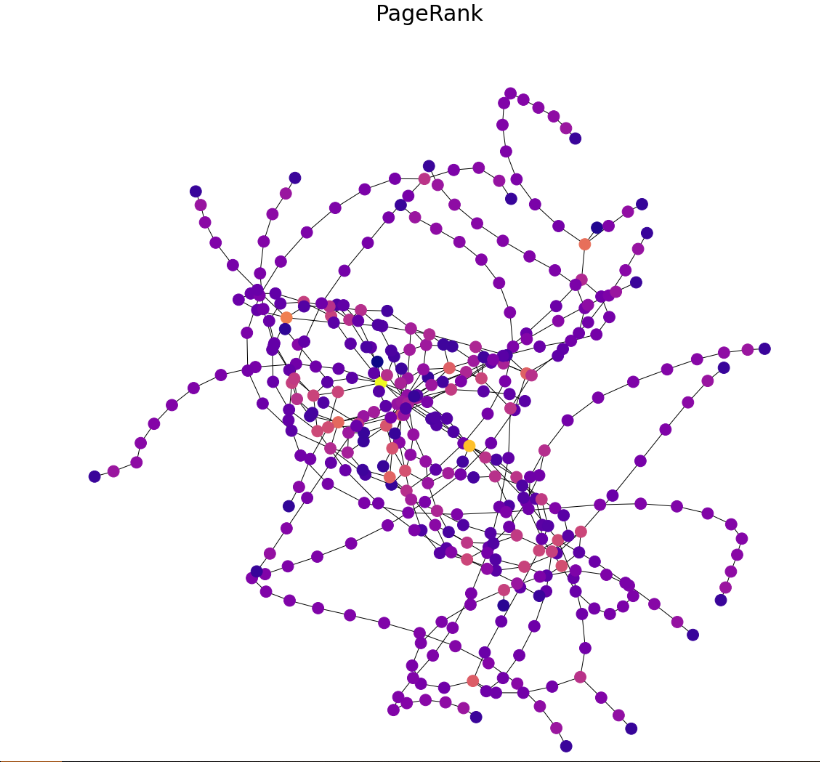

三、NetworkX工具包实战3——特征工程【CS224W】(Datawhale组队学习)

开源内容:https://github.com/TommyZihao/zihao_course/tree/main/CS224W 子豪兄B 站视频:https://space.bilibili.com/1900783/channel/collectiondetail?sid915098 斯坦福官方课程主页:https://web.stanford.edu/class/cs224w NetworkX…...

仲景GPT:首个中医大语言模型如何革新传统医学诊疗?[特殊字符]

仲景GPT:首个中医大语言模型如何革新传统医学诊疗?🚀 【免费下载链接】CMLM-ZhongJing 首个中医大语言模型——“仲景”。受古代中医学巨匠张仲景深邃智慧启迪,专为传统中医领域打造的预训练大语言模型。 The first-ever Traditio…...

老Mac焕新实战:OpenCore Legacy Patcher全解析——让旧硬件重获新生

老Mac焕新实战:OpenCore Legacy Patcher全解析——让旧硬件重获新生 【免费下载链接】OpenCore-Legacy-Patcher Experience macOS just like before 项目地址: https://gitcode.com/GitHub_Trending/op/OpenCore-Legacy-Patcher 当你的Mac弹出"此Mac不支…...

百度网盘直链解析开源工具完全指南:从入门到精通

百度网盘直链解析开源工具完全指南:从入门到精通 【免费下载链接】baidu-wangpan-parse 获取百度网盘分享文件的下载地址 项目地址: https://gitcode.com/gh_mirrors/ba/baidu-wangpan-parse 你是否曾经历过这样的困扰:明明网络带宽充足ÿ…...

G-Helper技术架构解析:华硕笔记本ACPI控制接口的轻量化实现

G-Helper技术架构解析:华硕笔记本ACPI控制接口的轻量化实现 【免费下载链接】g-helper Lightweight, open-source control tool for ASUS laptops and ROG Ally. Manage performance modes, fans, GPU, battery, and RGB lighting across Zephyrus, Flow, TUF, Stri…...

Zachman,TOGAF ,ADM深度分析比较

Zachman、TOGAF 与 ADM 深度分析比较 在企业架构(EA)领域,Zachman Framework 和 TOGAF 是两个最著名、最互补的框架。其中,ADM(Architecture Development Method) 是 TOGAF 的核心方法。理解三者的关系,有助于系统分析师在不同场景下选择或融合适合的架构实践。 一、概…...

StructBERT模型监控方案:性能与质量实时追踪

StructBERT模型监控方案:性能与质量实时追踪 1. 引言 当你把StructBERT模型部署到生产环境后,最担心的是什么?是服务突然崩溃,还是响应速度变慢,或者是模型预测质量下降?这些问题如果等到用户投诉才发现&…...

终极指南:如何用BetterGI智能辅助工具彻底解放你的原神游戏体验

终极指南:如何用BetterGI智能辅助工具彻底解放你的原神游戏体验 【免费下载链接】better-genshin-impact 📦BetterGI 更好的原神 - 自动拾取 | 自动剧情 | 全自动钓鱼(AI) | 全自动七圣召唤 | 自动伐木 | 自动刷本 | 自动采集/挖矿/锄地 | 一条龙 | 全连…...

Qwen-Image-Edit-2511商业落地:快速生成产品设计图,提升工作效率

Qwen-Image-Edit-2511商业落地:快速生成产品设计图,提升工作效率 1. 产品设计效率的革命性提升 在当今快节奏的商业环境中,产品设计团队面临着前所未有的压力:需要在更短时间内交付更多设计方案,同时保持高质量和创新…...

FUTURE POLICE模型ComfyUI可视化工作流搭建指南

FUTURE POLICE模型ComfyUI可视化工作流搭建指南 你是不是也对那些能生成未来感、赛博朋克风格图像的AI模型感到好奇?但一看到复杂的代码和命令行,就觉得头大,不知道从何下手。今天,我们就来聊聊一个特别酷的解决方案——用ComfyU…...

REX-UniNLU在SpringBoot项目中的集成指南

REX-UniNLU在SpringBoot项目中的集成指南 1. 引言 如果你正在开发一个需要理解中文文本的SpringBoot应用,比如要做智能客服、内容分析或者自动分类,那么REX-UniNLU可能会是个不错的选择。这是一个专门为中文设计的自然语言理解模型,不需要训…...