搭建k8s高可用集群—20230225

文章目录

- 多master(高可用)介绍

- 高可用集群使用技术介绍

- 搭建高可用k8s集群步骤

- 1. 准备环境-系统初始化

- 2. 在所有master节点上部署keepalived

- 3.1 安装相关包

- 3.2 配置master节点

- 3.3 部署haproxy

- 错误解决

- 3. 所有节点安装Docker/kubeadm/kubelet

- 4. 部署Kubernetes Master

- 4.1 创建kubreadm配置文件

- *初始化节点*

- 4.2 在master1节点执行

- 5. 安装集群网络

- 6. master2、master3节点加入集群

- 6.1 复制密钥及相关文件

- 6.2 master2和master3加入到集群

- 7. 加入Kubernetes Node

- 报错解决

- 8. 测试kubernetes集群

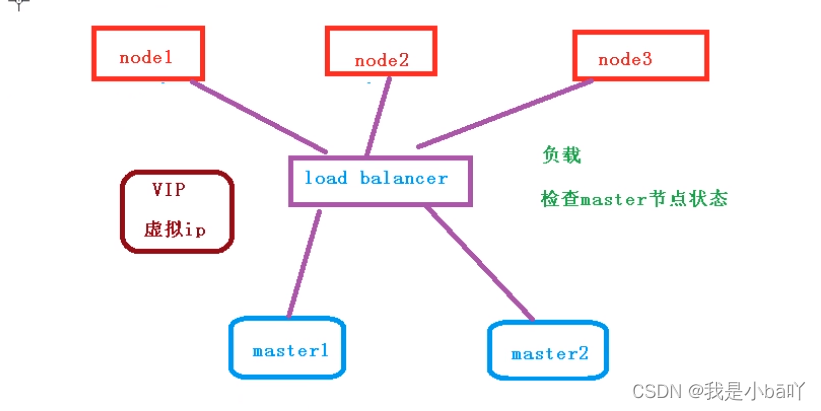

多master(高可用)介绍

假设现在有3个node节点和2个master节点,node1到底是连到master1还是连到master2,需要有人来分配,这个中间人就是load balancer,load balancer起到两个作用,一是负载。二是检查master状态,如果master1异常,就会使node连到master2上,如果master1正常,则正常提供服务。由于节点之间互相访问是通过IP连接,这里也是一样的,只不过是通过VIP(虚拟ip)连接。

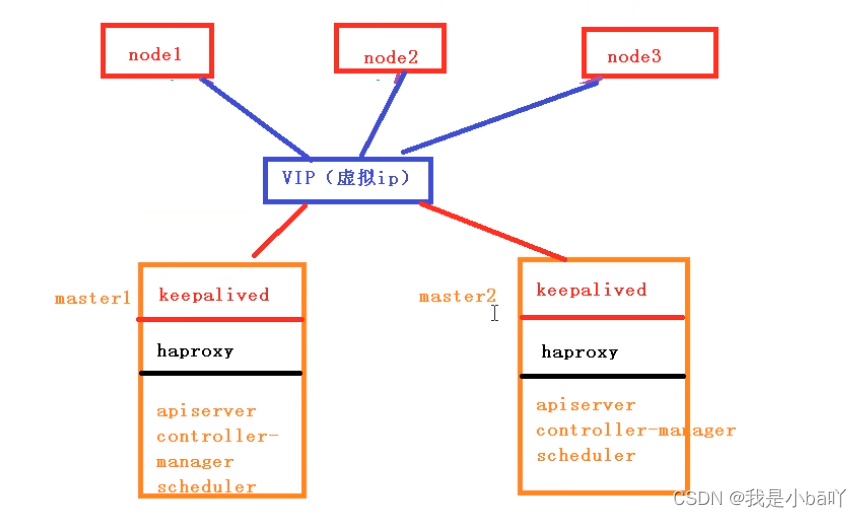

高可用集群使用技术介绍

keepalived:检查master状态,是否正常运行;配置虚拟IP。

haproxy:负载均衡服务器,起到负载作用。

master具体组件:apiserver, controller-manager, scheduler。

搭建高可用k8s集群步骤

前提条件:

①固定四台主机IP,参考文章固定虚拟机IP

②可连外网

| 主机 | IP |

|---|---|

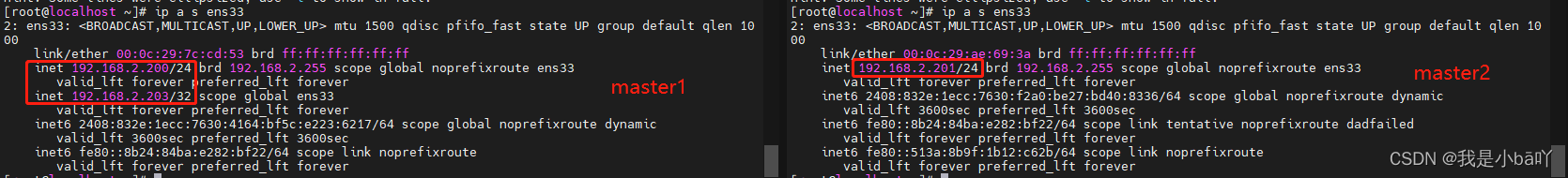

| master1 | 192.168.2.200 |

| master2 | 192.168.2.201 |

| master3 | 192.168.2.204 |

| node1 | 192.168.2.202 |

| 虚拟IP | 192.168.2.203 |

我们以3台master,1台node为例,首先准备好4台服务器,分别在四台服务器上做操作。

1. 准备环境-系统初始化

# 关闭防火墙

systemctl stop fierwalld #临时关闭

systemctl disable fierwalld #永久关闭# 关闭selinux

sed -i 's/enforcing/disabled/' /etc/selinux/config # 永久

setenforce 0 # 临时# 关闭swap分区

swapoff -a #临时

sed -ri 's/.*swap.*/#&/' /etc/fstab #永久# 根据规划设置主机名

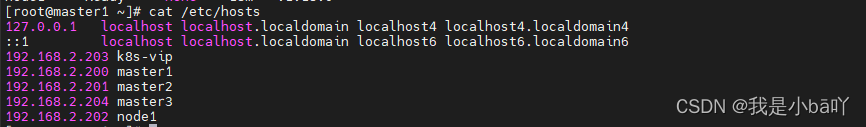

hostnamectl set-hostname <hostname># 在master中添加hosts,每一个master都要执行

cat >> /etc/hosts << EOF

192.168.2.203 k8s-vip

192.168.2.200 master1

192.168.2.201 master2

192.168.2.202 node1

EOF# 将桥接的 IPv4 流量传递到 iptables 的链

cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

sysctl --system # 生效# 时间同步

yum install ntpdate -y

ntpdate time.windows.com

2. 在所有master节点上部署keepalived

3.1 安装相关包

# 安装相关工具

yum install -y conntrack-tools libseccomp libtool-ltdl

# 安装keepalived

yum install -y keepalived

3.2 配置master节点

- master1节点配置:

cat > /etc/keepalived/keepalived.conf <<EOF

! Configuration File for keepalivedglobal_defs {router_id k8s

}vrrp_script check_haproxy {script "killall -0 haproxy"interval 3weight -2fall 10rise 2

}vrrp_instance VI_1 {state MASTER interface ens33 # ens33 为网卡名称virtual_router_id 51priority 250advert_int 1authentication {auth_type PASSauth_pass ceb1b3ec013d66163d6ab}virtual_ipaddress {192.168.2.203 # 虚拟ip}track_script {check_haproxy}}

EOF

- master2、master3节点配置

cat > /etc/keepalived/keepalived.conf <<EOF

! Configuration File for keepalivedglobal_defs {router_id k8s

}vrrp_script check_haproxy {script "killall -0 haproxy"interval 3weight -2fall 10rise 2

}vrrp_instance VI_1 {state BACKUP interface ens33 # ens33 为网卡名称virtual_router_id 51priority 200advert_int 1authentication {auth_type PASSauth_pass ceb1b3ec013d66163d6ab}virtual_ipaddress {192.168.2.203 # 虚拟ip}track_script {check_haproxy}}

EOF

- 启动和检查

三台master节点都执行

# 启动keepalived

systemctl start keepalived.service

# 设置开机启动

systemctl enable keepalived.service

# 查看启动状态

systemctl status keepalived.service

启动后查看master的网卡信息。由于虚拟IP配到了master1上,执行后,master1节点上会多出一个IP,即为虚拟IP;master2和master3上没有,挂上master1后才会出现。

ip a s ens33

3.3 部署haproxy

- 在3个master节点安装 haproxy

# 安装haproxy

yum install -y haproxy

- 配置

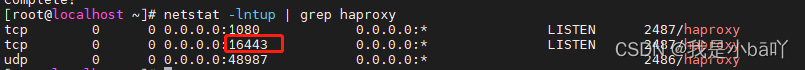

3台master节点的配置均相同,配置中声明了后端代理的3个master节点服务器,指定了haproxy运行的端口为16443等,因此16443端口为集群的入口

cat > /etc/haproxy/haproxy.cfg << EOF

#---------------------------------------------------------------------

# Global settings

#---------------------------------------------------------------------

global# to have these messages end up in /var/log/haproxy.log you will# need to:# 1) configure syslog to accept network log events. This is done# by adding the '-r' option to the SYSLOGD_OPTIONS in# /etc/sysconfig/syslog# 2) configure local2 events to go to the /var/log/haproxy.log# file. A line like the following can be added to# /etc/sysconfig/syslog## local2.* /var/log/haproxy.log#log 127.0.0.1 local2chroot /var/lib/haproxypidfile /var/run/haproxy.pidmaxconn 4000user haproxygroup haproxydaemon # turn on stats unix socketstats socket /var/lib/haproxy/stats

#---------------------------------------------------------------------

# common defaults that all the 'listen' and 'backend' sections will

# use if not designated in their block

#---------------------------------------------------------------------

defaultsmode httplog globaloption httplogoption dontlognulloption http-server-closeoption forwardfor except 127.0.0.0/8option redispatchretries 3timeout http-request 10stimeout queue 1mtimeout connect 10stimeout client 1mtimeout server 1mtimeout http-keep-alive 10stimeout check 10smaxconn 3000

#---------------------------------------------------------------------

# kubernetes apiserver frontend which proxys to the backends

#---------------------------------------------------------------------

frontend kubernetes-apiservermode tcpbind *:16443 #默认监听端口16443option tcplogdefault_backend kubernetes-apiserver

#---------------------------------------------------------------------

# round robin balancing between the various backends

#---------------------------------------------------------------------

backend kubernetes-apiservermode tcpbalance roundrobinserver master01.k8s.io 192.168.2.200:16443 check # 修改IPserver master02.k8s.io 192.168.2.201:16443 check # 修改IPserver master03.k8s.io 192.168.2.204:16443 check # 修改IP

#---------------------------------------------------------------------

# collection haproxy statistics message

#---------------------------------------------------------------------

listen statsbind *:1080stats auth admin:awesomePasswordstats refresh 5sstats realm HAProxy\ Statisticsstats uri /admin?stats

EOF

- 启动和检查

两台master都启动

# 启动 haproxy

systemctl start haproxy

# 设置开启自启

systemctl enable haproxy

# 查看启动状态

systemctl status haproxy

启动后,检查端口,查看对应的端口是否包含 16443

netstat -tunlp | grep haproxy

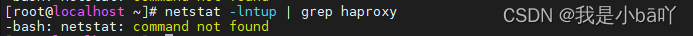

错误解决

报错:

针对这个问题出现的原因,就是Linux缺少对应的包,使用命令安装即可: yum install -y net-tools。再次执行netstat命令即可。

3. 所有节点安装Docker/kubeadm/kubelet

所有节点安装Docker/kubeadm/kubelet ,Kubernetes默认CRI(容器运行时)为Docker,因此先安装Docker。

- 安装之前确保没有其他dockers版本,如果有,需要删除干净后再安装,卸载方式可以参考这篇文章卸载docker。

- 安装Docker,所有master+node都要安装

# 下载镜像

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

# 安装docker

yum -y install docker-ce-18.06.1.ce-3.el7

# 开机自启动并且启动docker

systemctl enable docker && systemctl start docker

# 查看docker状态

systemctl status docker

# 查看docker版本

docker --version

# 设置仓库地址

cat > /etc/docker/daemon.json << EOF

{"registry-mirrors": ["https://b9pmyelo.mirror.aliyuncs.com"]

}

EOF

# 重启docker

systemctl restart docker

- 添加阿里云yum源,所有节点(master+node)

cat >/etc/yum.repos.d/docker.repo<<EOF

[docker-ce-edge]

name=Docker CE Edge - \$basearch

baseurl=https://mirrors.aliyun.com/docker-ce/linux/centos/7/\$basearch/edge

enabled=1

gpgcheck=1

gpgkey=https://mirrors.aliyun.com/docker-ce/linux/centos/gpg

EOF

# 重启docker

systemctl restart docker

- 添加kubernetes软件源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

- 安装kubeadm,kubectl,kubelet

由于版本更新频繁,这里指定版本号部署:

# 安装kubelet、kubeadm、kubectl,同时指定版本

yum install -y kubelet-1.18.0 kubeadm-1.18.0 kubectl-1.18.0

# 设置开机启动

systemctl enable kubelet

4. 部署Kubernetes Master

4.1 创建kubreadm配置文件

在具有vip的master上进行初始化操作,这里为master1

# 创建文件夹

mkdir /usr/local/kubernetes/manifests -p

# 到manifests目录

cd /usr/local/kubernetes/manifests/

# 新建yaml文件

vim kubeadm-config.yaml

下面内容修改IP 后复制进去

apiServer:certSANs:- master1- master2- master3- k8s-vip #虚拟IP的名字,需和/etc/hosts里一致- 192.168.2.203 # 虚拟IP- 192.168.2.200 # master1- 192.168.2.201 # master2- 192.168.2.204 # master3- 127.0.0.1extraArgs:authorization-mode: Node,RBACtimeoutForControlPlane: 4m0s

apiVersion: kubeadm.k8s.io/v1beta1

certificatesDir: /etc/kubernetes/pki

clusterName: kubernetes

controlPlaneEndpoint: "k8s-vip:16443" #虚拟IP:16443

controllerManager: {}

dns:type: CoreDNS

etcd:local:dataDir: /var/lib/etcd

imageRepository: registry.aliyuncs.com/google_containers

kind: ClusterConfiguration

kubernetesVersion: v1.18.0

networking:dnsDomain: cluster.localpodSubnet: 10.244.0.0/16serviceSubnet: 10.1.0.0/16

scheduler: {}

初始化节点

如果上面的yaml文件已经执行过一次,再次执行就会报错,这时,就需要将集群初始化。

步骤:

# 1. 还原由 kubeadm init 或 kubeadm join 所做的更改

kubeadm reset -f

# 2. 删除相关文件

rm -rf /etc/kubernetes/*

rm -rf /var/lib/etcd/*

然后再次执行yaml文件

4.2 在master1节点执行

kubeadm init --config kubeadm-config.yaml

执行完成后,就会在拉取镜像【需要等待…】

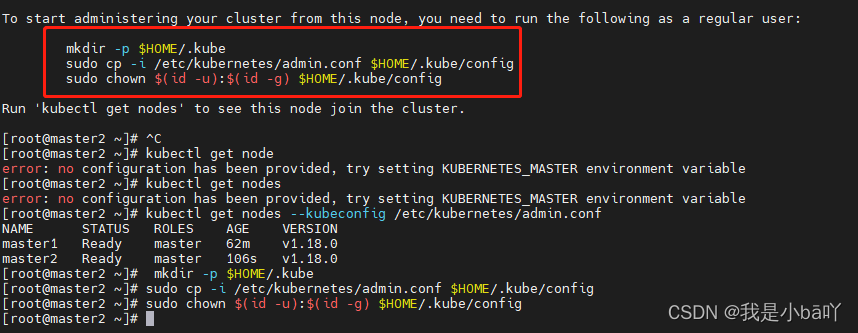

按照提示配置环境变量,使用kubectl工具

# 执行下方命令

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

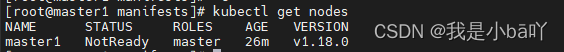

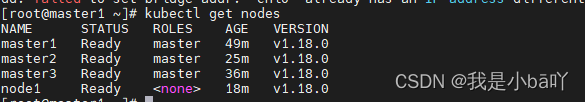

# 查看节点

kubectl get nodes

# 查看pod

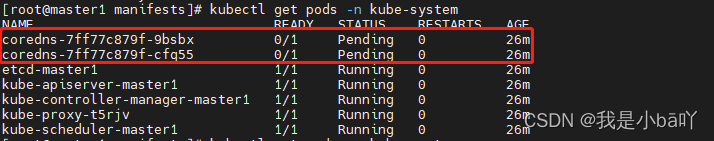

kubectl get pods -n kube-system

由于没有安装网络插件,所以会有pending状态,无妨,继续往下执行就好了。

按照提示保存以下内容,一会要使用

kubeadm join k8s-vip:16443 --token ivcq40.a1bb605g6df4xhdw \--discovery-token-ca-cert-hash sha256:b65dcb57a2934439562ae138f552942600296edc04cdefb7da93031cf23c9a08 \--control-plane

–control-plane : 只有在添加master节点的时候才有

# 查看集群健康状态

kubectl get cs

# 查看pod

kubectl get pods -n kube-system

5. 安装集群网络

从官方地址获取到flannel的yaml,在master1上执行

# 创建文件夹

mkdir flannel

cd flannel

# 下载yaml文件

wget -c https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

安装flannel网络

kubectl apply -f kube-flannel.yml

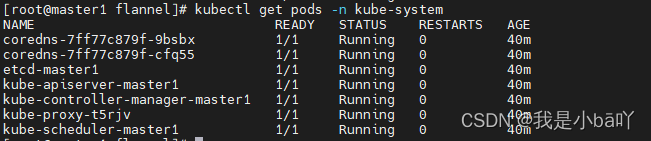

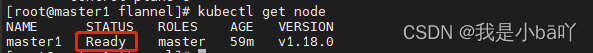

检查,都已经running,且master已经ready

kubectl get pods -n kube-system

6. master2、master3节点加入集群

6.1 复制密钥及相关文件

从master1复制密钥及相关文件到master2

## master1中执行,修改IP,分别改为master2/3的IP执行2遍

# ssh root@192.168.2.201 mkdir -p /etc/kubernetes/pki/etcd # 修改IP;master2\master3的IP,用master1连接master2\master3;输入密码# scp /etc/kubernetes/admin.conf root@192.168.2.201:/etc/kubernetes# scp /etc/kubernetes/pki/{ca.*,sa.*,front-proxy-ca.*} root@192.168.2.201:/etc/kubernetes/pki# scp /etc/kubernetes/pki/etcd/ca.* root@192.168.2.201:/etc/kubernetes/pki/etcd

6.2 master2和master3加入到集群

在master2、master3上执行在master1上init后输出的join命令,需要带上参数–control-plane表示把master控制节点加入集群。

# master2上执行

kubeadm join k8s-vip:16443 --token ivcq40.a1bb605g6df4xhdw \--discovery-token-ca-cert-hash sha256:b65dcb57a2934439562ae138f552942600296edc04cdefb7da93031cf23c9a08 \--control-plane

按照提示执行输出的3行命令

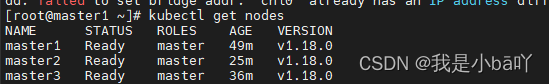

检查状态

kubectl get nodeskubectl get pods --all-namespaces

7. 加入Kubernetes Node

向集群添加新节点,执行在kubeadm init输出的kubeadm join命令,不加参数–control-plane

# 在node1上执行

kubeadm join k8s-vip:16443 --token ivcq40.a1bb605g6df4xhdw \--discovery-token-ca-cert-hash sha256:b65dcb57a2934439562ae138f552942600296edc04cdefb7da93031cf23c9a08

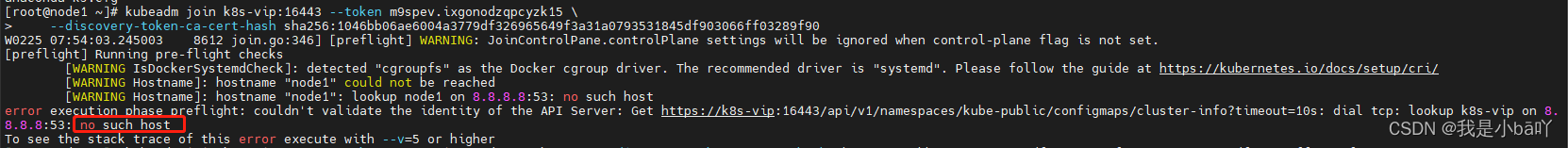

报错解决

执行命令后,报错no such host,如下:

这时候,需要将node1节点里的hosts表里的内容保持与master节点一致,再次执行就可以了。

集群网络重新安装,因为添加了新的node节点

# 在master1节点上执行kubectl apply -f flannel/kube-flannel.yml

检查状态

kubectl get nodes

kubectl get pods --all-namespaces

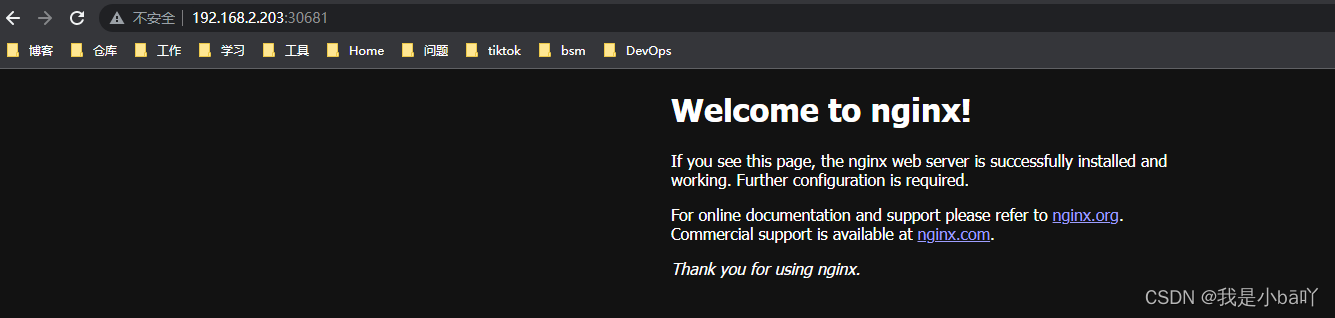

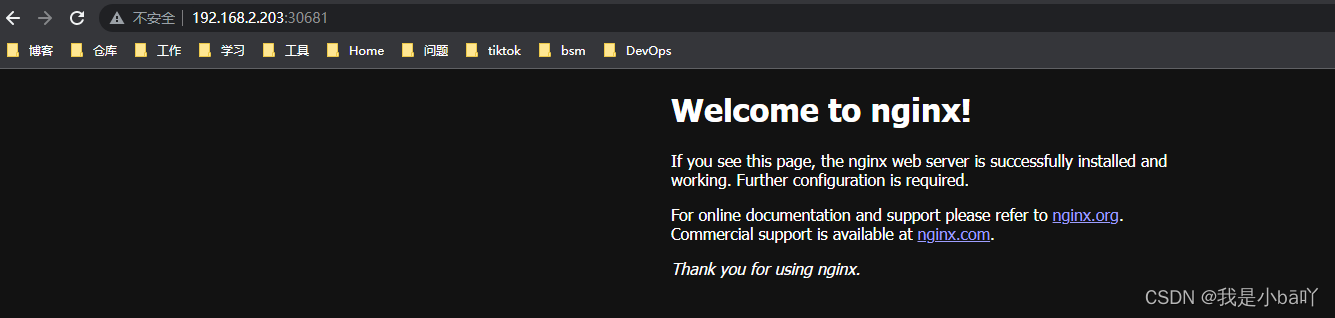

8. 测试kubernetes集群

在Kubernetes集群中创建一个pod,验证是否正常运行:

# 创建nginx deployment

kubectl create deployment nginx --image=nginx

# 暴露端口

kubectl expose deployment nginx --port=80 --target-port=80 --type=NodePort

# 查看状态

kubectl get pod,svc

然后通过任何一个master或node节点或者虚拟IP,都能够访问nginx页面

相关文章:

搭建k8s高可用集群—20230225

文章目录多master(高可用)介绍高可用集群使用技术介绍搭建高可用k8s集群步骤1. 准备环境-系统初始化2. 在所有master节点上部署keepalived3.1 安装相关包3.2 配置master节点3.3 部署haproxy错误解决3. 所有节点安装Docker/kubeadm/kubelet4. 部署Kuberne…...

Java 修饰符和多态

文章目录一、修饰符1. 权限修饰符2. 状态修饰符2.1 final2.2 static二、多态1. 成员访问特点2. 多态中的转型3. 多态案例一、修饰符 1. 权限修饰符 2. 状态修饰符 2.1 final final 关键字是最终的意思,可以修饰成员方法、成员变量及类。 //1.修饰成员变量 publi…...

学了一年Java的我,想转嵌入式了

秋名山码民的主页 🎉欢迎关注🔎点赞👍收藏⭐️留言📝 🙏作者水平有限,如发现错误,还请私信或者评论区留言! 目录前言为啥我想去转行?如果我现在选择转硬件,我…...

【Git】Git冲突与解决方法

目录 一、Git冲突如何产生? 二、解决Git冲突—手动修改冲突 【第一步】在 hot-fix 分支上增加如下代码,并且提交。 【第二步】在master 分支上同样的地方增加如下代码,并且提交。 【第三步】 我们现在在 master 分支上合并 hot-fix 分支&a…...

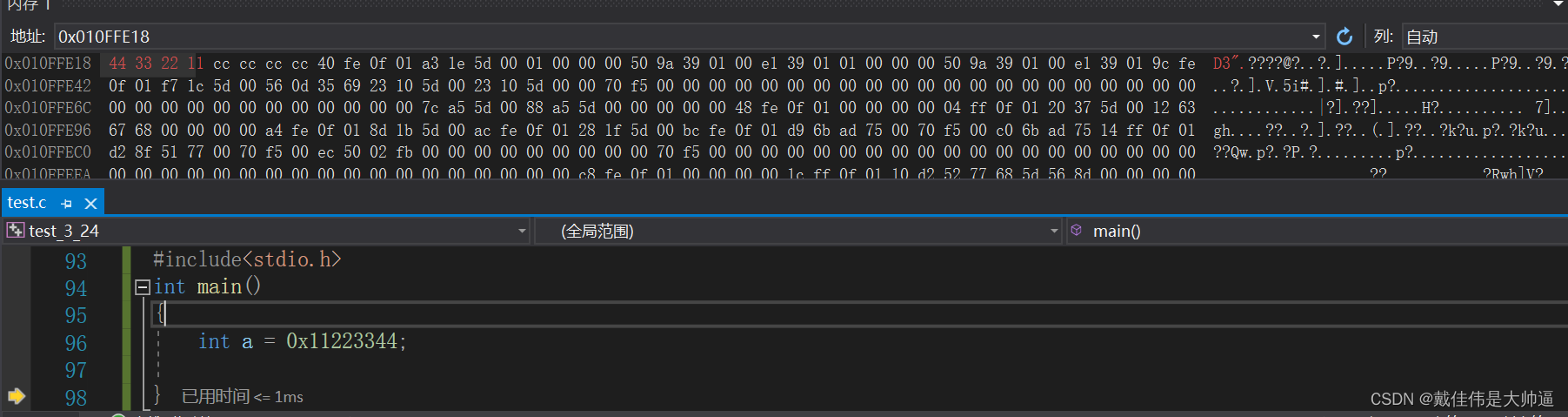

深度剖析数据在内存的存储

目录1.深度剖析数据在内存的存储(前言)数据类型介绍类型的基本归类整形在内存中的存储原码、反码、补码大小端练习总结1.深度剖析数据在内存的存储(前言) 今天就让我戴佳伟给大家讲一下数据在内存中的存储。之中有好多让我们深思的点,大家都拿起笔记本,…...

)

身高排序(绝对值大的排后面,小的排前面)

题目描述 小明今年升学到了小学一年级,来到新班级后,发现其他小朋友身高参差不齐,然后就想基于各小朋友和自己的身高差,对他们进行排序,请帮他实现排序 输入描述 第一行为正整数H和N 0 < H < 200 为小明的身高…...

)

高频前端面试题之HTML篇(三)

11. label的作用是什么?是怎么用的? label元素不会向用户呈现任何特殊效果,但是,它为鼠标用户改进了可用性,当我们在label元素内点击文本时就会触发此控件。也就是说,当用户选择该标签时,浏览器…...

使用DG备份恢复测试库的流程以及可能出现的问题

使用DG备份恢复测试库的流程以及可能出现的问题 评估数据量和服务器存储空间从DG备库备份全库和归档日志清理测试库环境测试库恢复备份(一)从DG主库备份控制文件测试库恢复备份(二)从DG备库备份最新的归档日志测试库恢复备份(三)需要单独备份数据文件的情况思路:从DG备库…...

Springboot注释解析

SpringBootApplication 标注主程序类 说明一个spring boot应用 SpringBootConfiguration 标注为spring boot配置类 EnableAutoConfiguration 开启自动配置功能 AutoConfigurationPackage 自动配置包 Import({Registrar.class}) 导入一个容器到组件 Registrar.class…...

)

C语言之通讯录(动态 存储文件版)

目录 前言 一.基本思路 二.代码的实现 2.1通讯录菜单 2.2通讯录的定义及功能 2.3函数实现 2.3.1初始化通讯录 2.3.2文件信息传递到通讯录里 2.3.3扩容通讯录 2.3.4增加联系人 2.3.5删除联系人 2.3.6查询联系人 2.3.7修改联系人 2.3.8打印通讯录 2.3.9信息保留在文…...

Linux 工具

文章目录一、软件包管理:yum1. 软件的生态环境2. yum 的使用3. yum 源及分类4. 在 centos 7.6 下更新 yum 源到国内镜像5. yum 命令二、编辑器:vim1. 命令模式2. 底行模式3. 插入模式4. 替换模式和视图模式5. vim 配置三、编译器:gcc/g1. C语…...

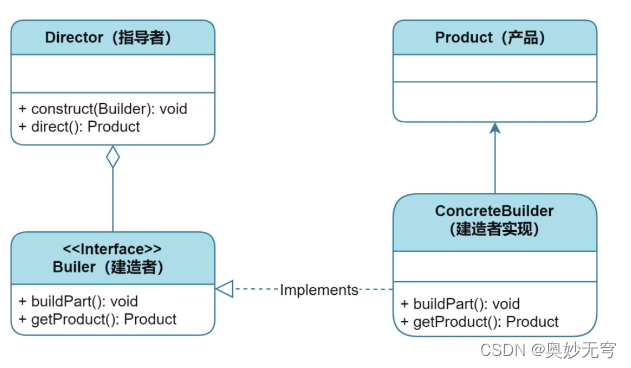

Java知识复习(七)常见的设计模式(装饰、代理、观察、策略、建造)

前言 参考书籍:《秒懂设计模式》 1、装饰器模式(Decorator) 1、装饰器模式:对原始对象动态地进行“包装”,是对类实例“装饰”的结果;类似于继承的效果,但这个过程是动态的,是可设…...

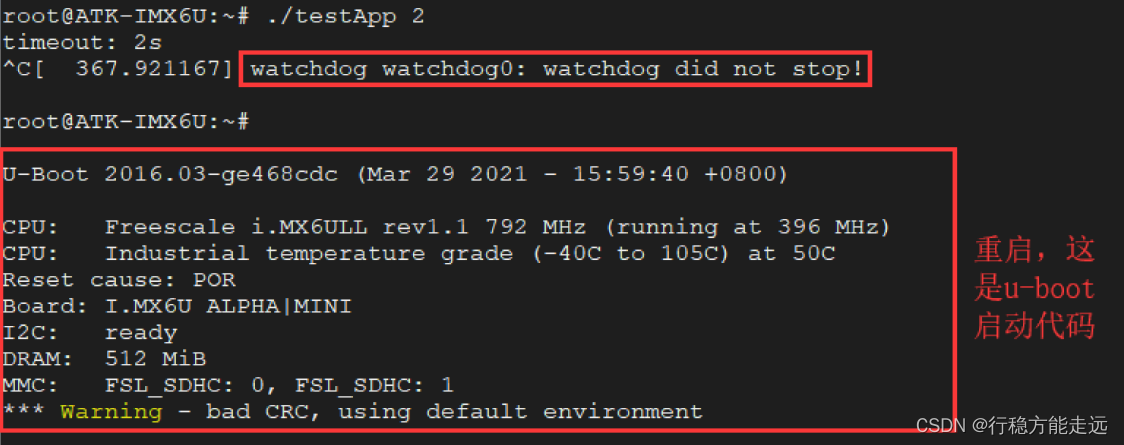

Linux系统看门狗应用编程

目录看门狗应用编程介绍打开设备获取设备支持哪些功能:WDIOC_GETSUPPORT获取/设置超时时间:WDIOC_GETTIMEOUT、WDIOC_SETTIMEOUT开启/关闭看门狗:WDIOC_SETOPTIONS喂狗:WDIOC_KEEPALIVE看门狗应用编程实战在产品化的嵌入式系统中&…...

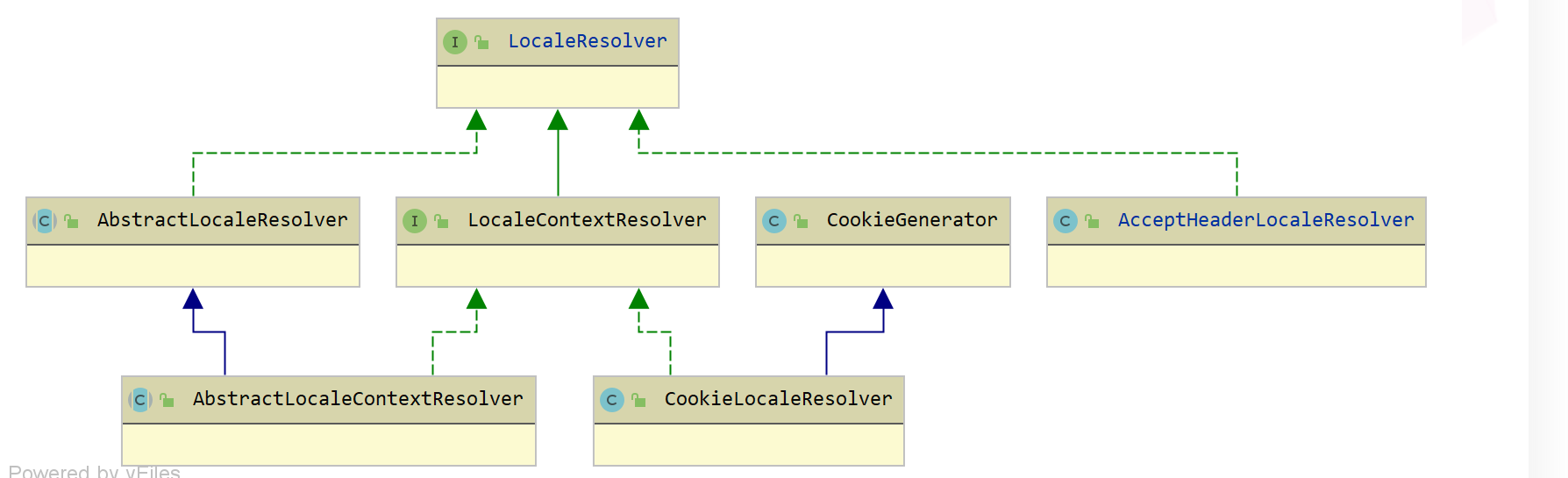

Spring MVC 源码- LocaleResolver 组件

LocaleResolver 组件LocaleResolver 组件,本地化(国际化)解析器,提供国际化支持回顾先来回顾一下在 DispatcherServlet 中处理请求的过程中哪里使用到 LocaleResolver 组件,可以回到《一个请求的旅行过程》中的 Dispat…...

Servlet

Servlet1 简介2 快速入门3 执行流程4 生命周期5 方法介绍6 体系结构7 urlPattern配置8 XML配置1 简介 Servlet是JavaWeb最为核心的内容,它是Java提供的一门动态web资源开发技术。 使用Servlet就可以实现,根据不同的登录用户在页面上动态显示不同内容。 …...

简单的周总结

做一个简单的周总结。 校 OJ 上打了近 7 场比赛,ZR 及其他平台各一两场左右。 头几场打的中规中矩,分数大致在 100-200 左右,与同学分数差别不太大,但也没有很突出。 后面几场比较爆炸,分数一直在 100 以下࿰…...

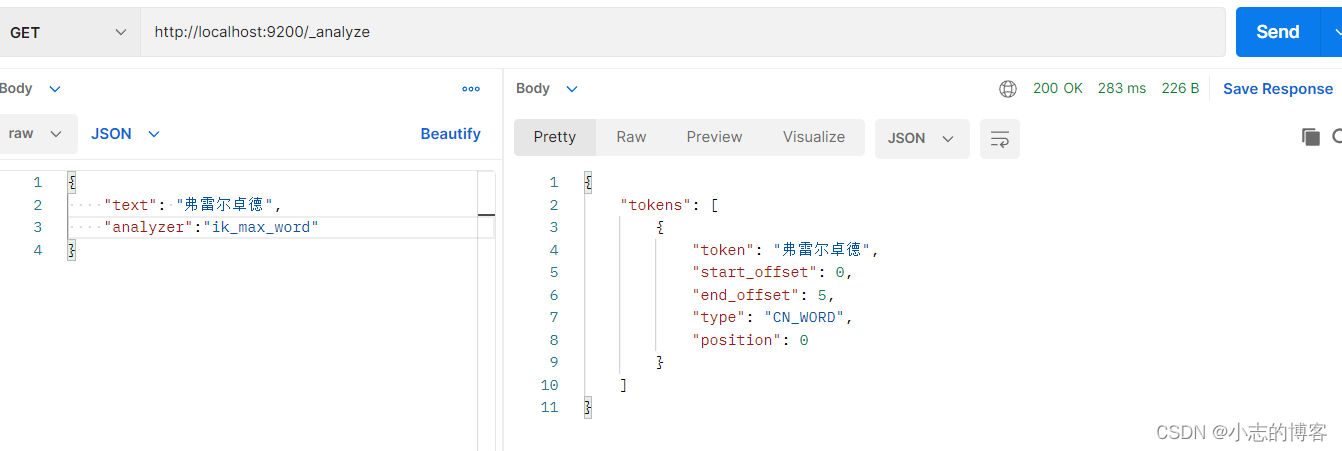

Elasticsearch7.8.0版本进阶——IK中文分词器

目录一、ES 的默认分词器测试示例二、IK 中文分词器2.1、IK 中文分词器下载地址2.2、ES 引入IK 中文分词器2.3、IK 中文分词器测试示例三、ES 扩展词汇测试示例一、ES 的默认分词器测试示例 通过 Postman 发送 GET 请求查询分词效果,在消息体里,指定要分…...

一个阿里P6的说不会接口自动化测试,他不会是自己评的吧...

序 近期和一个阿里的测试工程师交流了一波,他竟然说我不会接口自动化测试,我当场就不服了我说你P6自己评级的吧,今天就带大家好好盘一盘接口自动化,本着以和大家交流如何实现高效的接口测试为出发点,本文包含了我在接…...

)

规则引擎与风控系统04:风控系统实例(下)

上一节把风控实例的基础代码都撸了出来。接下来再来把核心服务代码和规则文件写出来。 因为有了实体类、Dao,所以接来下就可以写服务类了。之前说过这个实例就是要实现两个目的: 1、一分钟内连续访问三次以上,就会被直接封杀; 2、黑名单用户登录会记录可疑事件。 所以服务类…...

我为什么选择Linux mint 21.1 “Vera“ ? Mint安装优化调教指南(分辨率DPI)

前言:为什么是Mint 笔者算是Linux老用户了,作为一个后端开发,尝试了多种不同发行版。 一开始是Manjaro这种Arch系,但是其对于开发而言实在是太过不稳定;每次滚动更新都要解决很多冲突。不适合当生产力(本…...

如何快速掌握自动化脚本录制:Pulover‘s Macro Creator零代码入门指南

如何快速掌握自动化脚本录制:Pulovers Macro Creator零代码入门指南 【免费下载链接】PuloversMacroCreator Automation Utility - Recorder & Script Generator 项目地址: https://gitcode.com/gh_mirrors/pu/PuloversMacroCreator 你是否厌倦了每天重复…...

深度解析AzurLaneAutoScript:基于图像识别与智能调度的自动化引擎架构设计

深度解析AzurLaneAutoScript:基于图像识别与智能调度的自动化引擎架构设计 【免费下载链接】AzurLaneAutoScript Azur Lane bot (CN/EN/JP/TW) 碧蓝航线脚本 | 无缝委托科研,全自动大世界 项目地址: https://gitcode.com/gh_mirrors/az/AzurLaneAutoSc…...

DownKyi终极教程:3步掌握B站视频下载,免费打造个人媒体库

DownKyi终极教程:3步掌握B站视频下载,免费打造个人媒体库 【免费下载链接】downkyi 哔哩下载姬downkyi,哔哩哔哩网站视频下载工具,支持批量下载,支持8K、HDR、杜比视界,提供工具箱(音视频提取、…...

2026年5款专业气象数据可视化软件大盘点

在科技飞速发展的今天,气象可视化作为一种将复杂气象数据转化为直观图像的技术,正发挥着越来越重要的作用。它不仅为气象工作者提供了便捷的数据分析手段,也让普通大众能够轻松理解天气变化。接下来,让我们一起深入了解气象可视化…...

水质在线监测系统嵌入式工控机选型与实战指南

1. 水质在线监测:从传统抽检到智慧物联的必然之路水,是生命之源,也是城市运行的命脉。过去,我们了解水源地的水质状况,主要依赖人工定期采样、送回实验室分析。这种方式周期长、成本高,面对突发性污染事件&…...

别再手动编译库了!一招永久设置Vivado全局Modelsim仿真环境

永久配置Vivado与Modelsim联调环境的终极方案 每次新建FPGA工程都要重新配置仿真工具路径和编译库文件?这种重复劳动不仅浪费时间,还容易因配置不一致导致仿真失败。本文将揭示一种被多数工程师忽略的"一劳永逸"配置方案,通过系统级…...

表面的差分电荷密度图)

保姆级教程:用VASP和VESTA搞定CO吸附在Pt(111)表面的差分电荷密度图

从零开始:CO-Pt(111)体系差分电荷密度计算全流程解析 在催化反应机理研究中,差分电荷密度分析犹如一把精密的手术刀,能够清晰揭示分子与催化剂表面之间的电子"对话"。对于刚踏入计算催化领域的研究者而言,掌握这项技能不…...

为什么你的Windows Phone需要解锁引导加载程序?深度解析WPinternals的3大核心价值

为什么你的Windows Phone需要解锁引导加载程序?深度解析WPinternals的3大核心价值 【免费下载链接】WPinternals Tool to unlock the bootloader and enable Root Access on Windows Phones 项目地址: https://gitcode.com/gh_mirrors/wp/WPinternals 你是否…...

Redis——string类型相关指令

添加键值对SET [key] [value] [EX seconds|PX milliseconds] [NX|XX] //添加一个键值对SETNX [key] [value] //setNX的组合命令,不支持EX/PX选项SETEX [key] [value] //setEX的组合命令,不支持NX/XX选项PSETEX [key] [value] //setPX的组合命令ÿ…...

COMTool图表插件使用教程:实时数据可视化与曲线绘制完整指南

COMTool图表插件使用教程:实时数据可视化与曲线绘制完整指南 【免费下载链接】COMTool Cross platform communicate assistant(Serial/network/terminal tool)( 跨平台 串口调试助手 网络调试助手 终端工具 linux windows mac Raspberry Pi )…...