云原生Kubernetes系列项目实战-k8s集群+高可用负载均衡层+防火墙

一、Kubernetes 区域可采用 Kubeadm 方式进行安装:

| 名称 | 主机 | 部署服务 |

|---|---|---|

| master | 192.168.91.10 | docker、kubeadm、kubelet、kubectl、flannel |

| node01 | 192.168.91.11 | docker、kubeadm、kubelet、kubectl、flannel |

| node02 | 192.168.91.20 | docker、kubeadm、kubelet、kubectl、flannel |

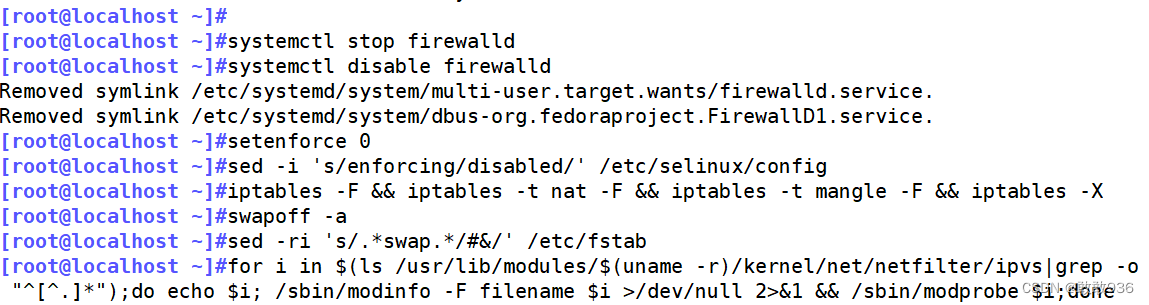

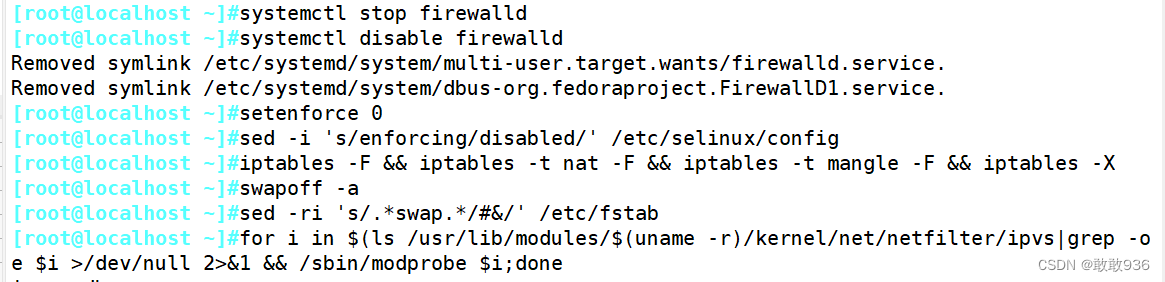

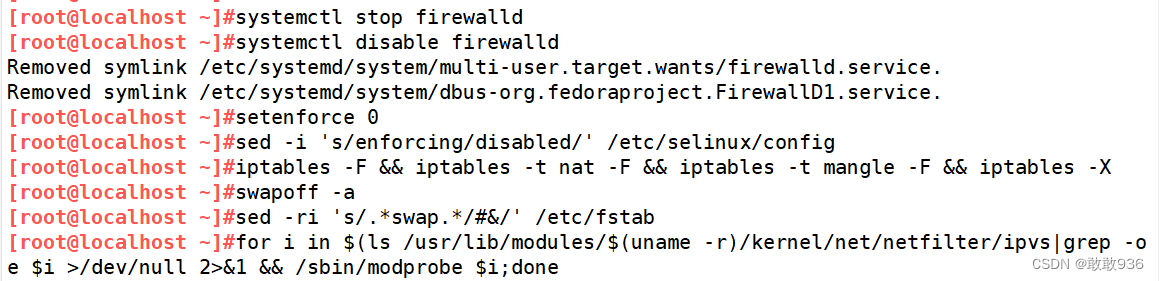

1.系统初始化配置:

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -Xswapoff -a #交换分区必须要关闭

sed -ri 's/.*swap.*/#&/' /etc/fstab #永久关闭swap分区,&符号在sed命令中代表上次匹配的结果#加载 ip_vs 模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

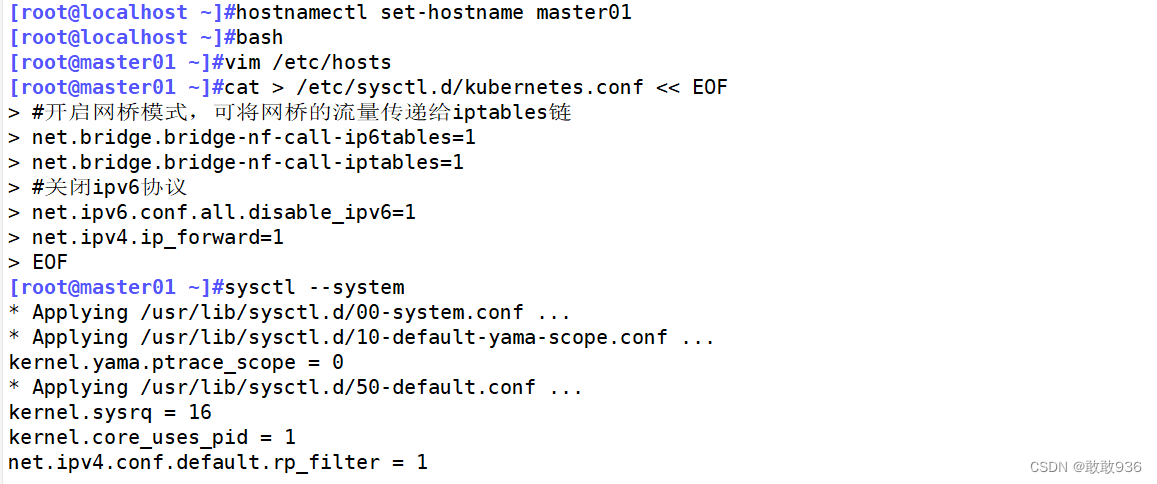

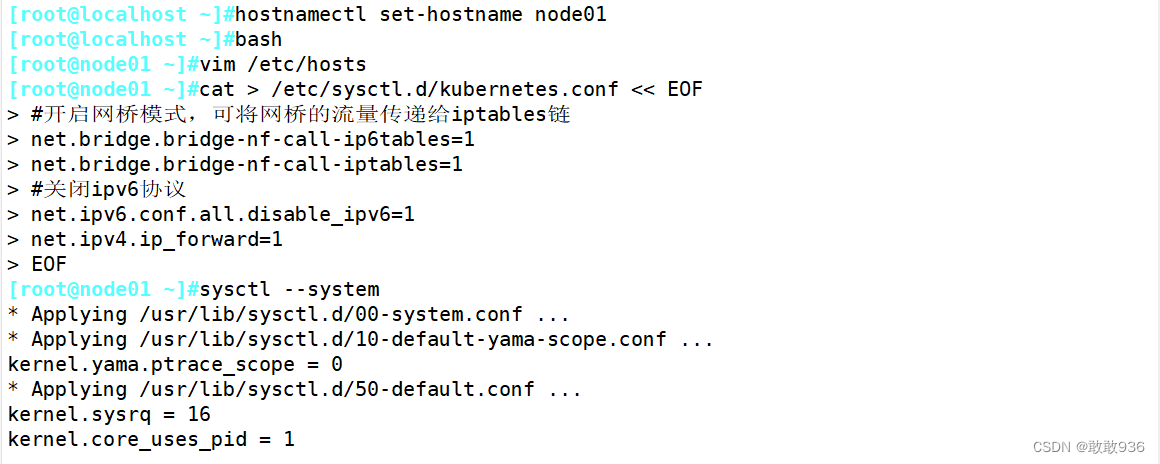

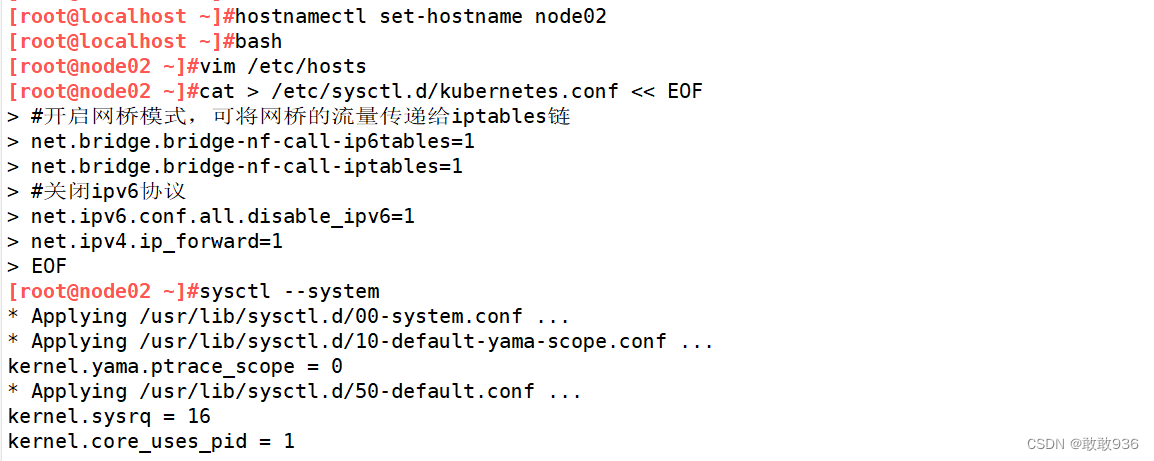

#修改主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

#域名解析

vim /etc/hosts

192.168.91.10 master01

192.168.91.11 node01

192.168.91.20 node02

#调整内核参数

cat > /etc/sysctl.d/kubernetes.conf << EOF

#开启网桥模式,可将网桥的流量传递给iptables链

net.bridge.bridge-nf-call-ip6tables=1

net.bridge.bridge-nf-call-iptables=1

#关闭ipv6协议

net.ipv6.conf.all.disable_ipv6=1

net.ipv4.ip_forward=1

EOF

#生效参数

sysctl --system

2.所有节点部署docker:

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io

mkdir /etc/docker

cat > /etc/docker/daemon.json <<EOF

{"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],"exec-opts": ["native.cgroupdriver=systemd"],"log-driver": "json-file","log-opts": {"max-size": "100m"}

}

EOF

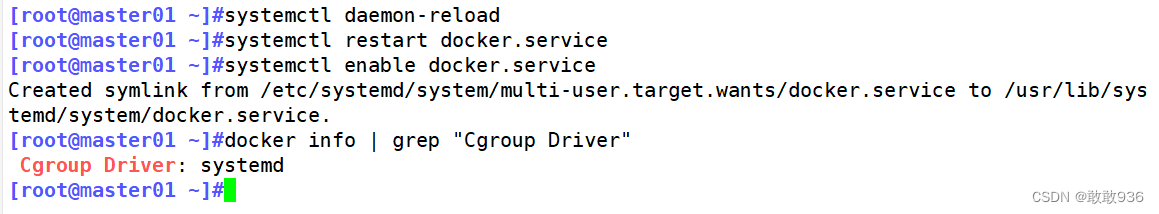

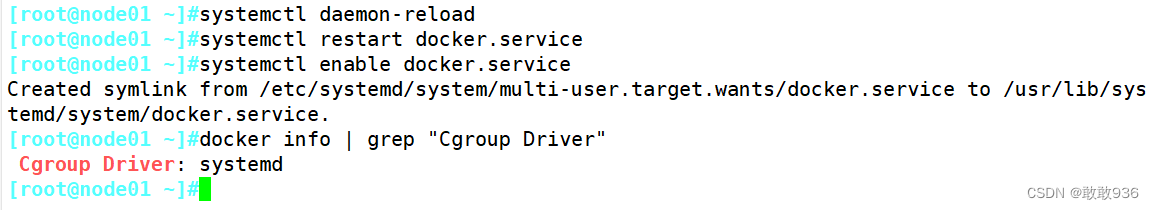

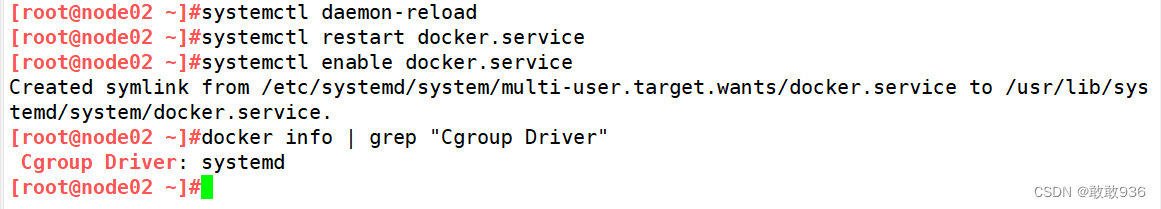

systemctl daemon-reload

systemctl restart docker.service

systemctl enable docker.service

docker info | grep "Cgroup Driver"

Cgroup Driver: systemd

3.所有节点安装kubeadm,kubelet和kubectl :

//定义kubernetes源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

#yum安装组件

yum install -y kubelet-1.20.11 kubeadm-1.20.11 kubectl-1.20.11

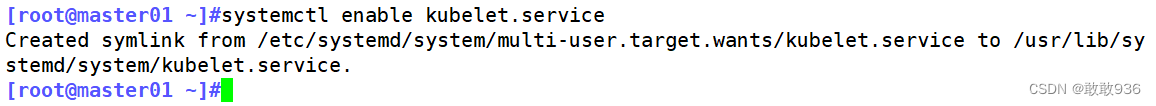

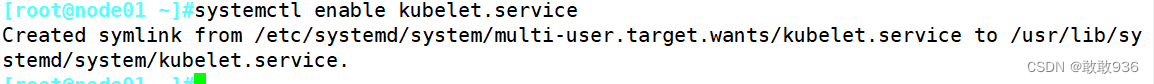

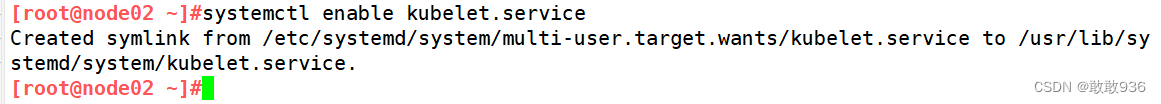

#开机自启kubelet

systemctl enable kubelet.service

#K8S通过kubeadm安装出来以后都是以Pod方式存在,即底层是以容器方式运行,所以kubelet必须设置开机自启

4.部署K8S集群:

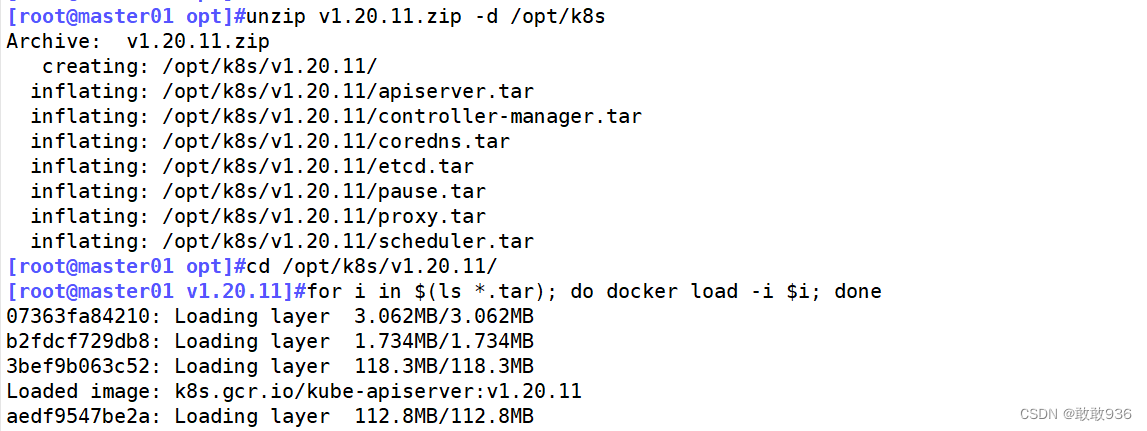

//在 master 节点上传 v1.20.11.zip 压缩包至 /opt 目录

unzip v1.20.11.zip -d /opt/k8s

cd /opt/k8s/v1.20.11

for i in $(ls *.tar); do docker load -i $i; done

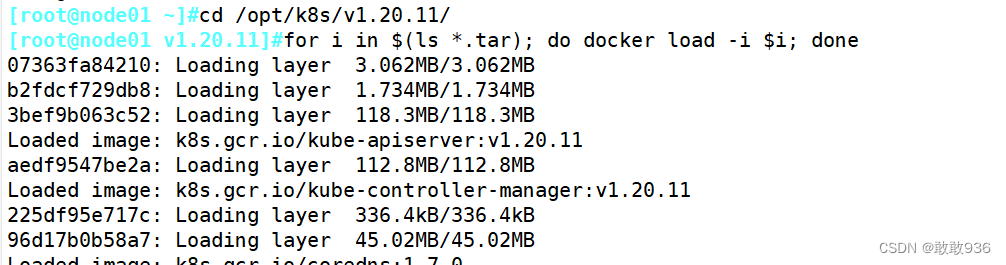

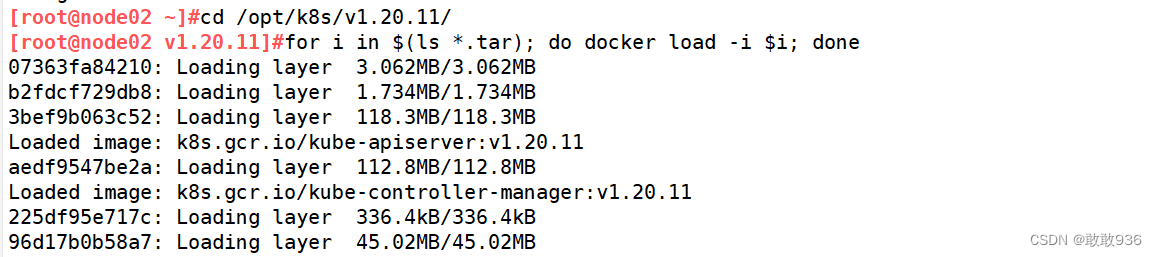

//复制镜像和脚本到 node 节点,并在 node 节点上执行脚本加载镜像文件

scp -r /opt/k8s root@node01:/opt

scp -r /opt/k8s root@node02:/opt#在node节点上执行加载镜像文件

cd /opt/k8s/v1.20.11

for i in $(ls *.tar); do docker load -i $i; done

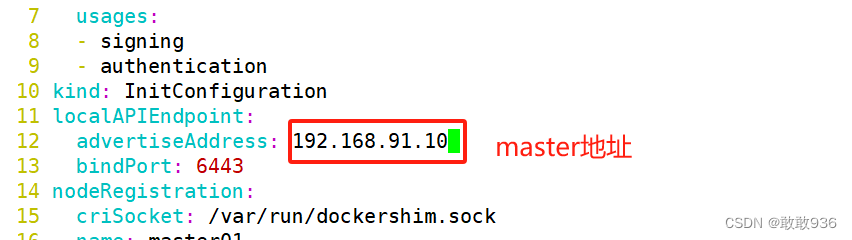

kubeadm config print init-defaults > /opt/kubeadm-config.yaml

cd /opt/

vim kubeadm-config.yaml

......

11 localAPIEndpoint:

12 advertiseAddress: 192.168.91.10 #指定master节点的IP地址

13 bindPort: 6443

......

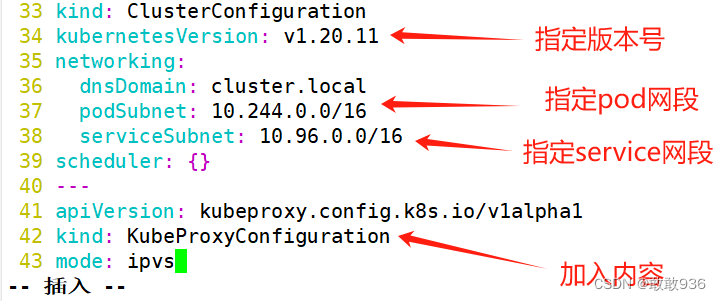

34 kubernetesVersion: v1.20.11 #指定kubernetes版本号

35 networking:

36 dnsDomain: cluster.local

37 podSubnet: "10.244.0.0/16" #指定pod网段,10.244.0.0/16用于匹配flannel默认网段

38 serviceSubnet: 10.96.0.0/16 #指定service网段

39 scheduler: {}

#末尾再添加以下内容

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

mode: ipvs #把默认的kube-proxy调度方式改为ipvs模式

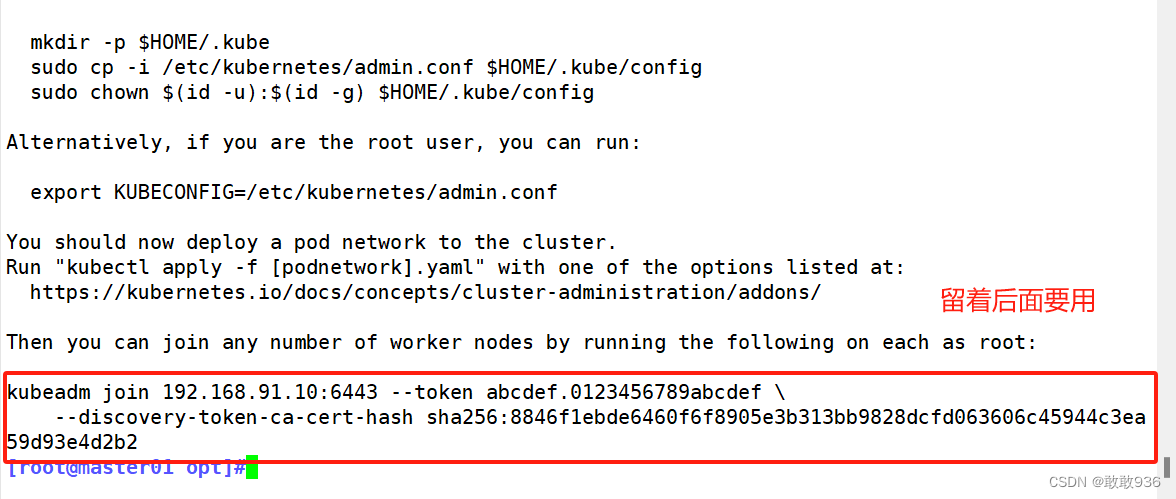

kubeadm init --config=kubeadm-config.yaml --upload-certs | tee kubeadm-init.log

#--experimental-upload-certs 参数可以在后续执行加入节点时自动分发证书文件,K8S V1.16版本开始替换为 --upload-certs

#tee kubeadm-init.log 用以输出日志

//查看 kubeadm-init 日志

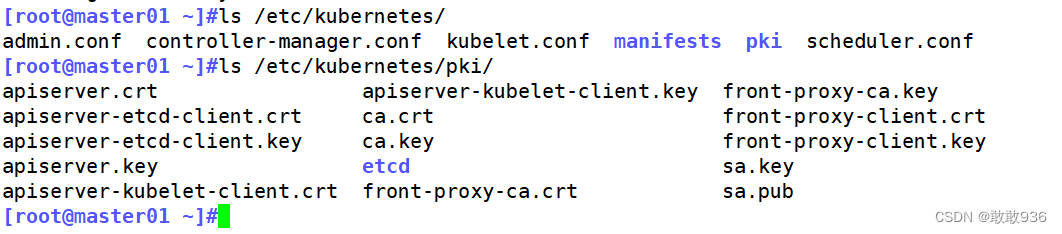

less kubeadm-init.log//kubernetes配置文件目录

ls /etc/kubernetes/

//存放ca等证书和密码的目录

ls /etc/kubernetes/pki

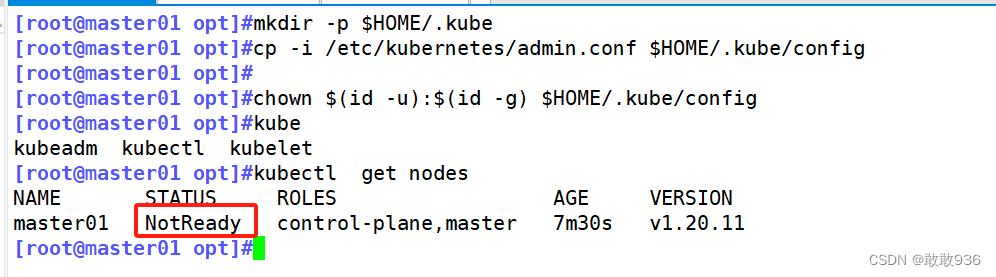

5.设定kubectl:

mkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config

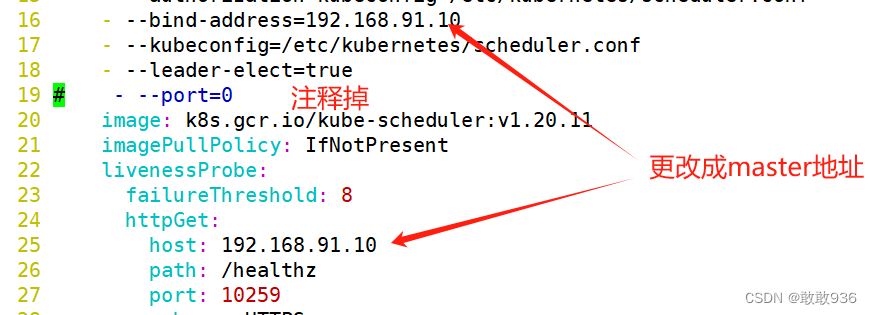

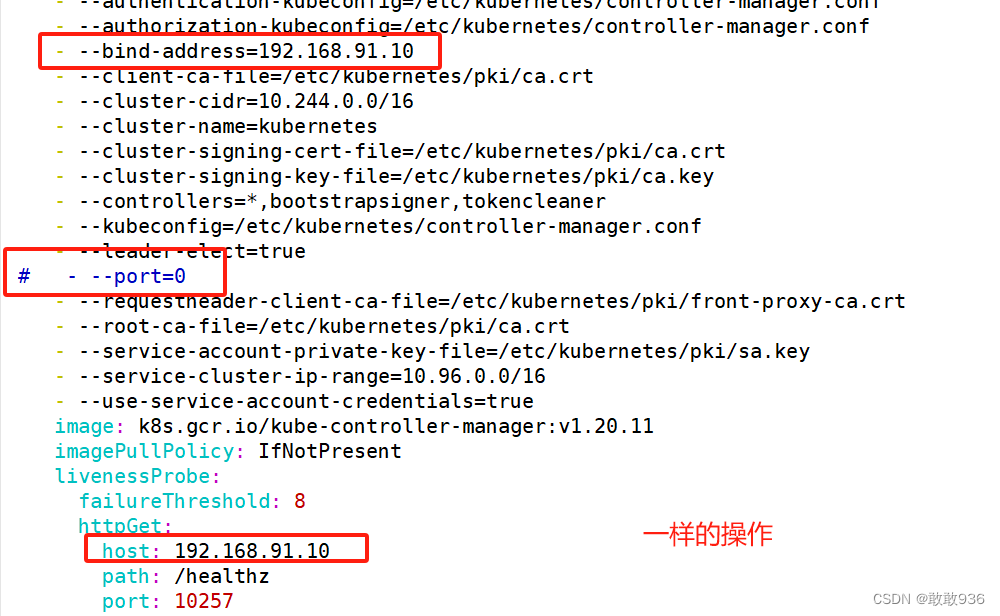

//如果 kubectl get cs 发现集群不健康,更改以下两个文件

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

# 修改如下内容

把--bind-address=127.0.0.1变成--bind-address=192.168.10.19 #修改成k8s的控制节点master01的ip

把httpGet:字段下的hosts由127.0.0.1变成192.168.10.19(有两处)

#- --port=0 # 搜索port=0,把这一行注释掉

systemctl restart kubelet

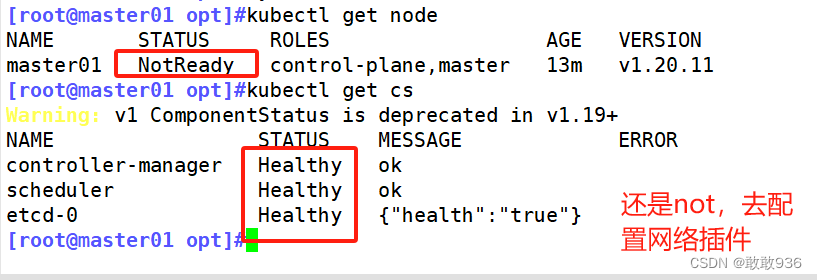

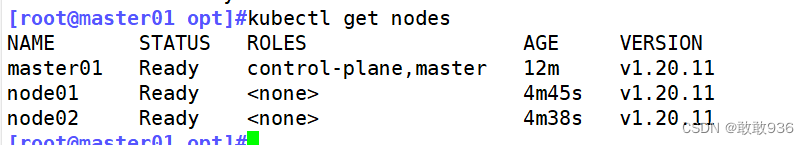

再次查看node节点状态:

6.所有节点部署网络插件flannel:

//所有节点上传flannel-cni-v1.2.0.tar ,flannel-v0.22.2.tar镜像node 到 /opt 目录,master节点上传cni-plugins-linux-amd64-v1.2.0.tgz,(由于版本更新后 不使用这个) flannel-cni-v1.2.0.tar ,flannel-v0.22.2.tar文件

cd /opt

unzip kuadmin.zip

docker load -i flannel-v0.22.2.tar

docker load -i flannel-cni-v1.2.0.tar

#将flannel-cni-v1.2.0.tar flannel-v0.22.2.tar传给node01和node02

scp flannel-cni-v1.2.0.tar flannel-v0.22.2.tar node01:/opt/

scp flannel-cni-v1.2.0.tar flannel-v0.22.2.tar node02:/opt/

docker load -i flannel-v0.22.2.tar

docker load -i flannel-cni-v1.2.0.tar

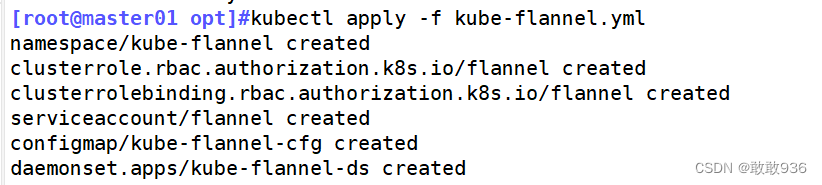

//在 master 节点创建 flannel 资源(将kube-flannel.yml传入/opt )

kubectl apply -f kube-flannel.yml

namespace/kube-flannel created

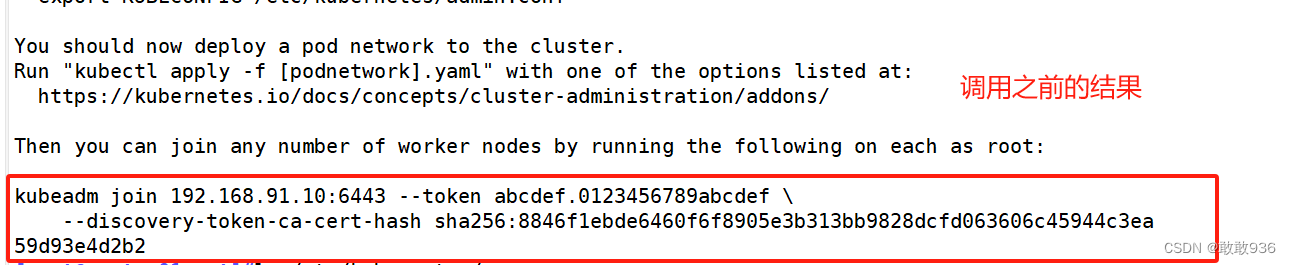

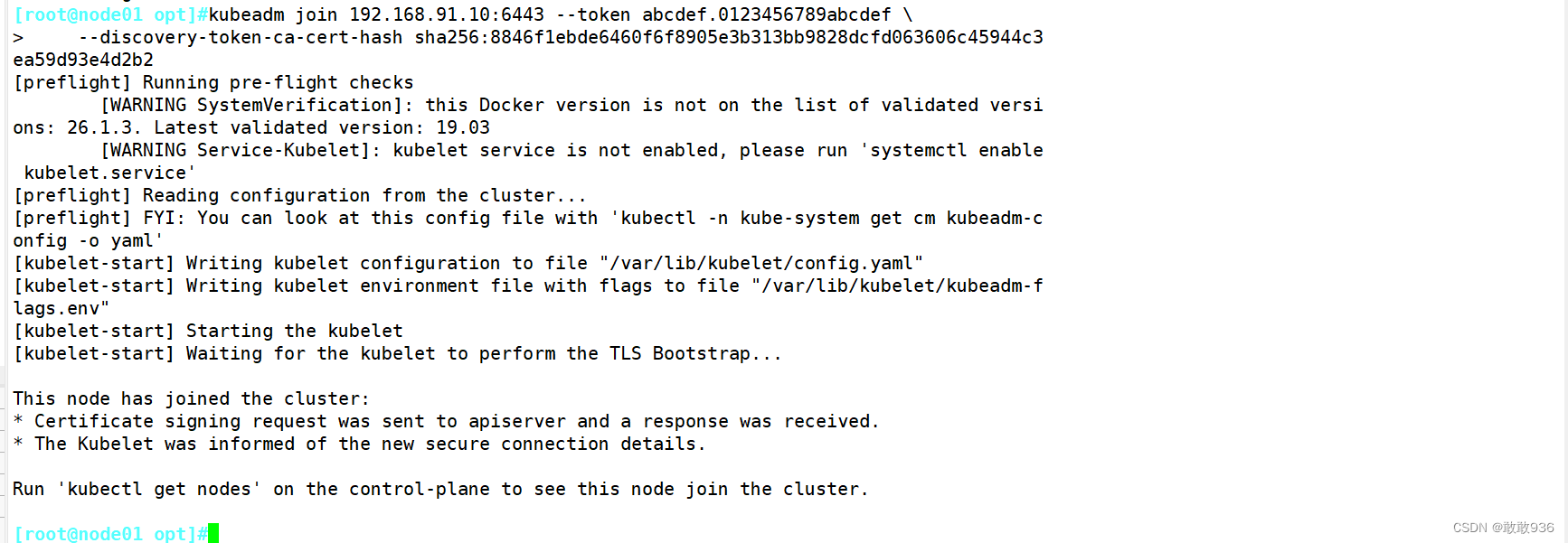

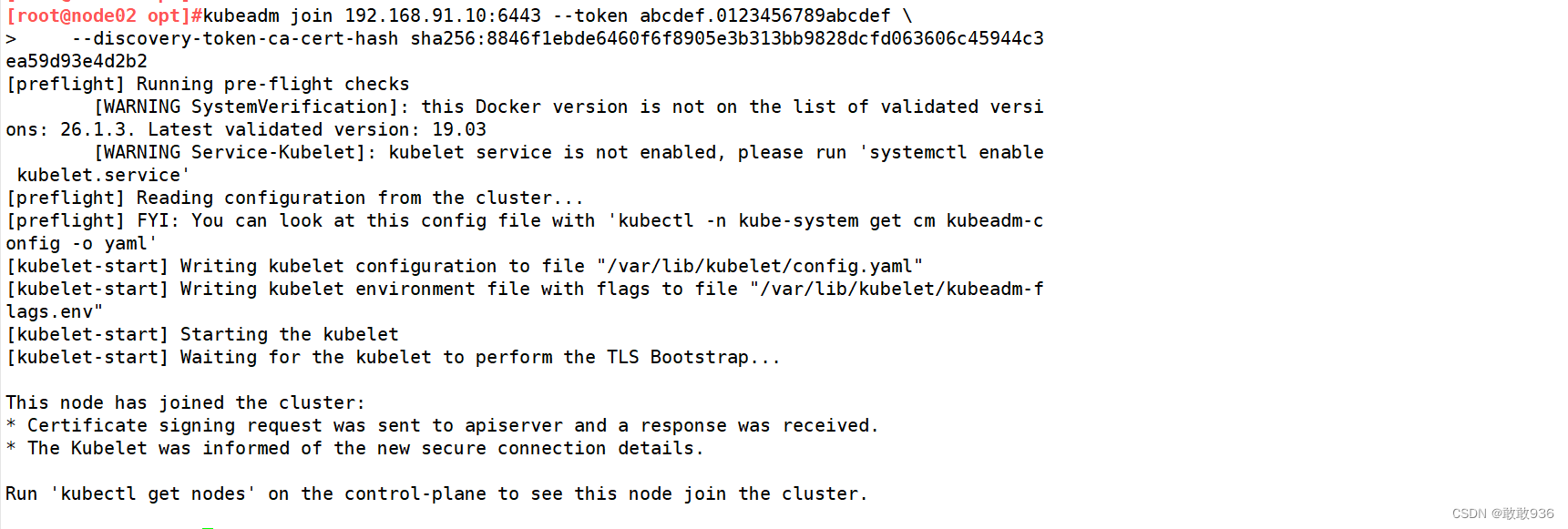

#在 node 节点上执行 kubeadm join 命令加入群集

kubeadm join 192.168.91.10:6443 --token abcdef.0123456789abcdef \--discovery-token-ca-cert-hash sha256:8846f1ebde6460f6f8905e3b313bb9828dcfd063606c45944c3ea59d93e4d2b2

#在master节点查看节点状态

kubectl get nodes

kubectl get pods -n kube-system

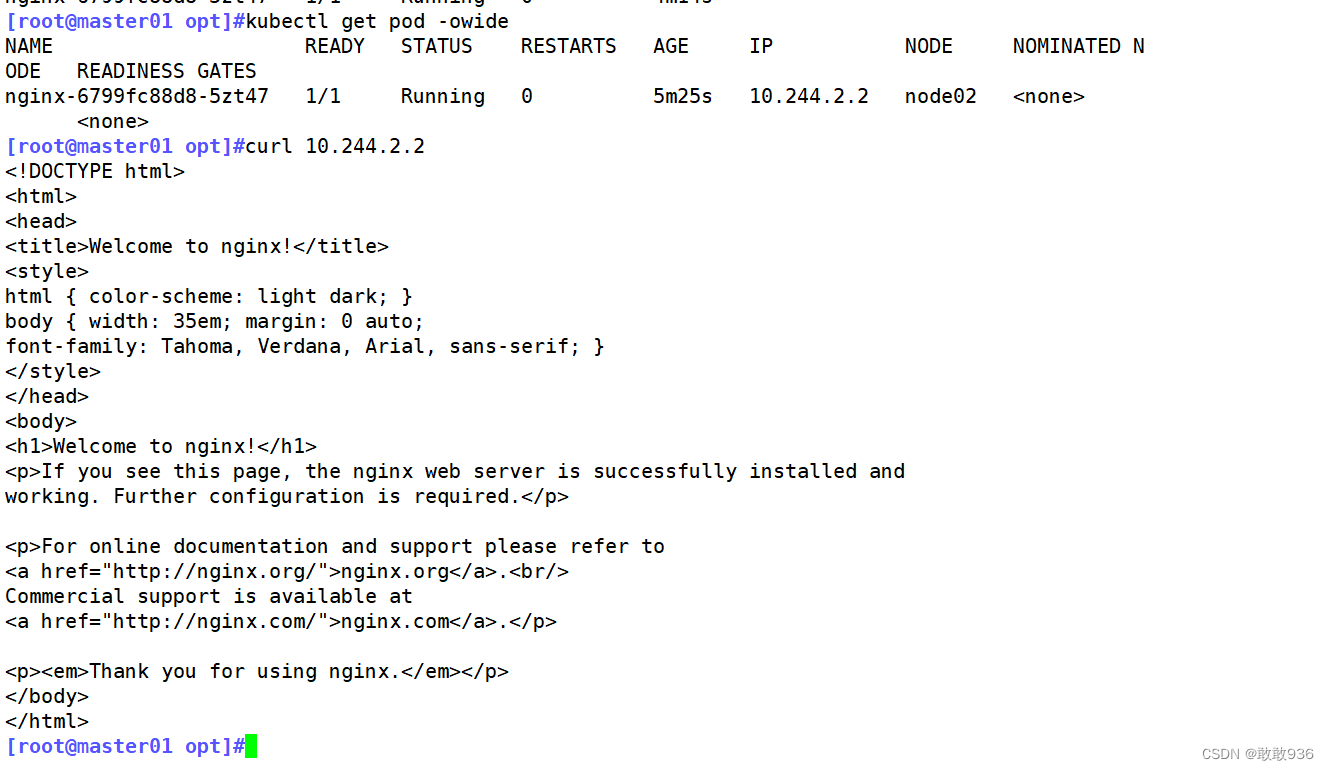

//测试 pod 资源创建

kubectl create deployment nginx --image=nginx

kubectl get pods -o wide

#curl访问测试:

kubectl get pod -owide

curl 10.244.2.2

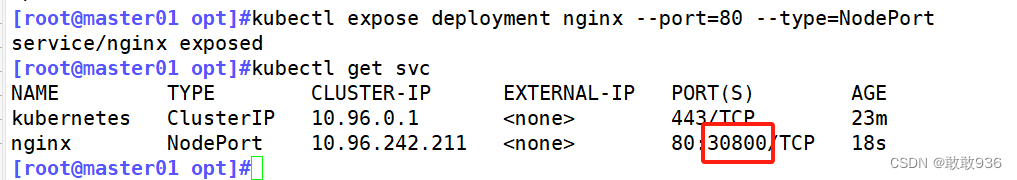

//暴露端口提供服务

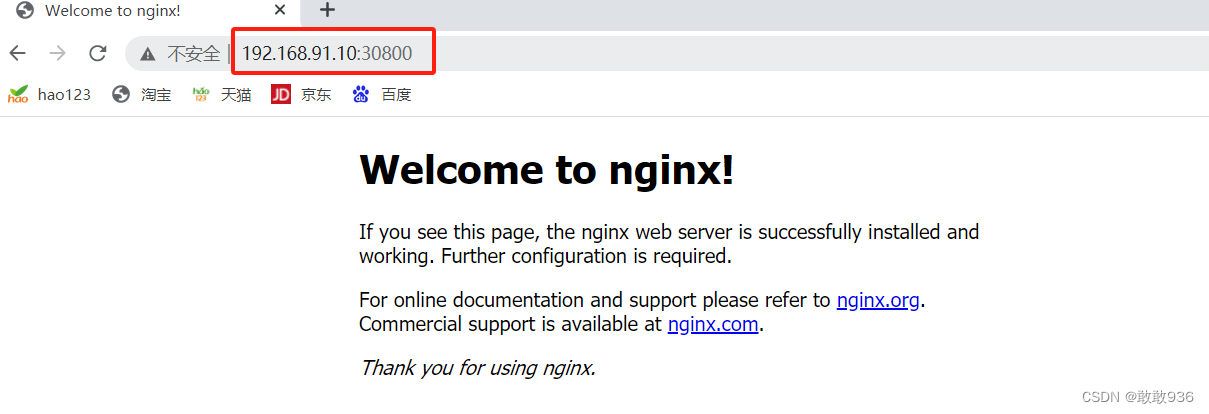

kubectl expose deployment nginx --port=80 --type=NodePort

kubectl get svc

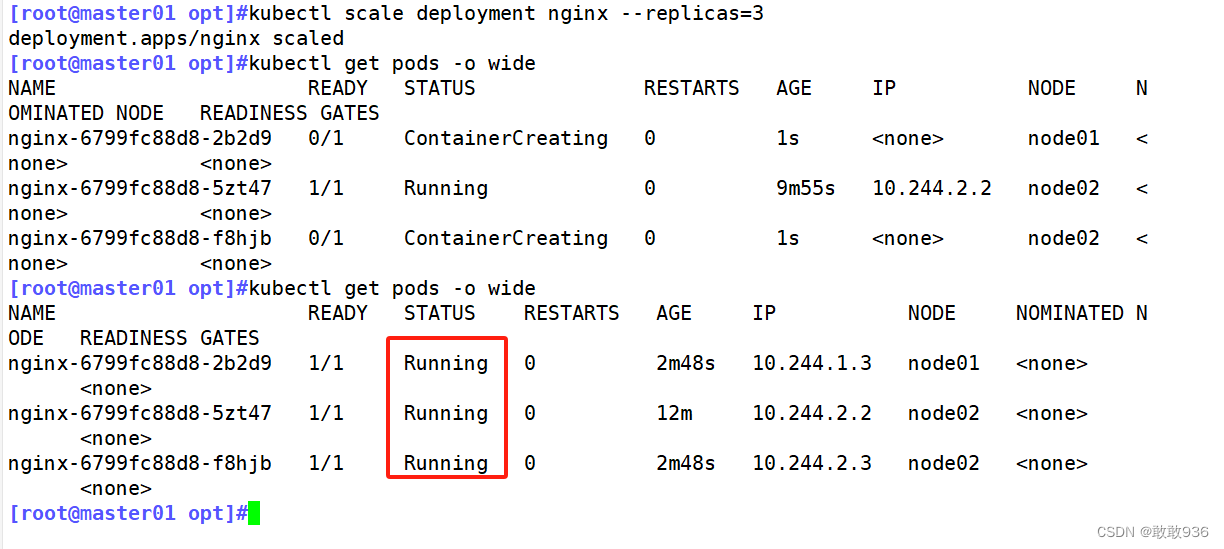

//扩展3个副本

kubectl scale deployment nginx --replicas=3

kubectl get pods -o wide

![]()

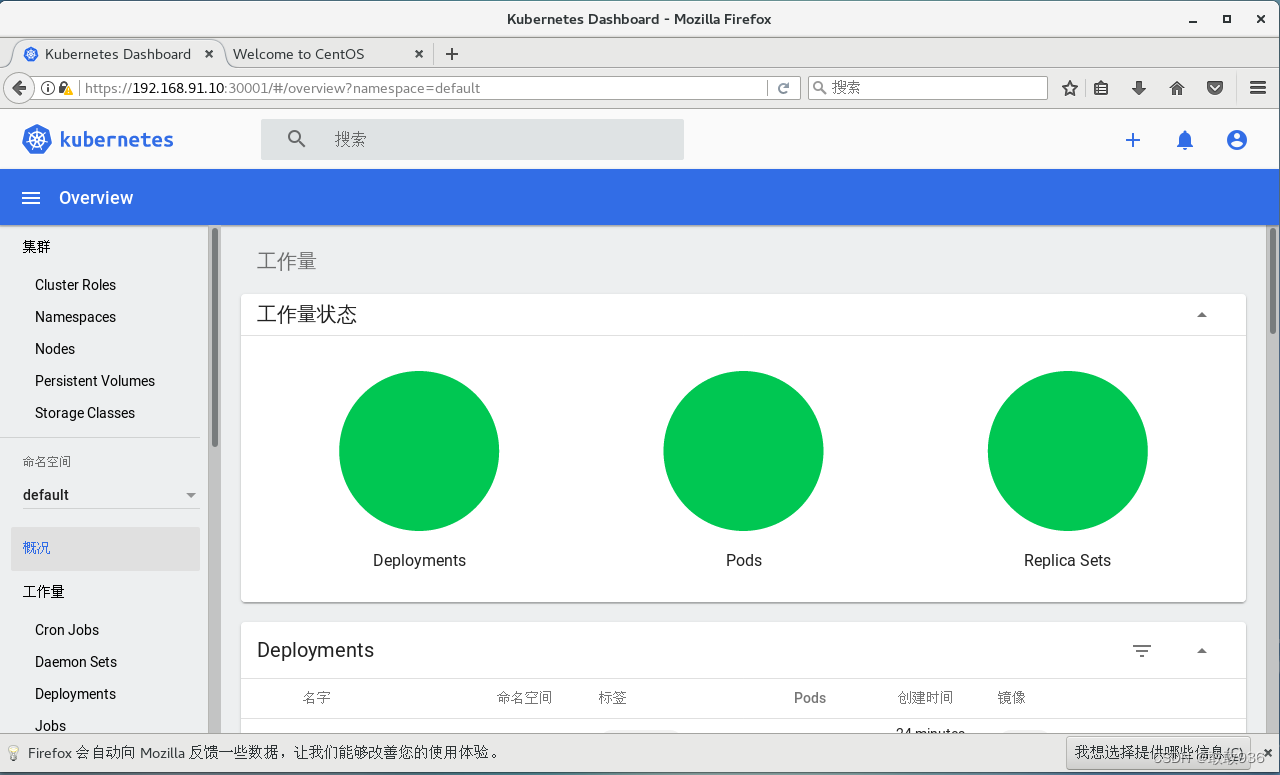

7.部署 Dashboard:

#上传 recommended.yaml 文件到 /opt/k8s 目录中

cd /opt/k8s

vim recommended.yaml

#默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部:

kind: Service

apiVersion: v1

metadata:labels:k8s-app: kubernetes-dashboardname: kubernetes-dashboardnamespace: kubernetes-dashboard

spec:ports:- port: 443targetPort: 8443nodePort: 30001 #添加type: NodePort #添加selector:k8s-app: kubernetes-dashboardkubectl apply -f recommended.yaml

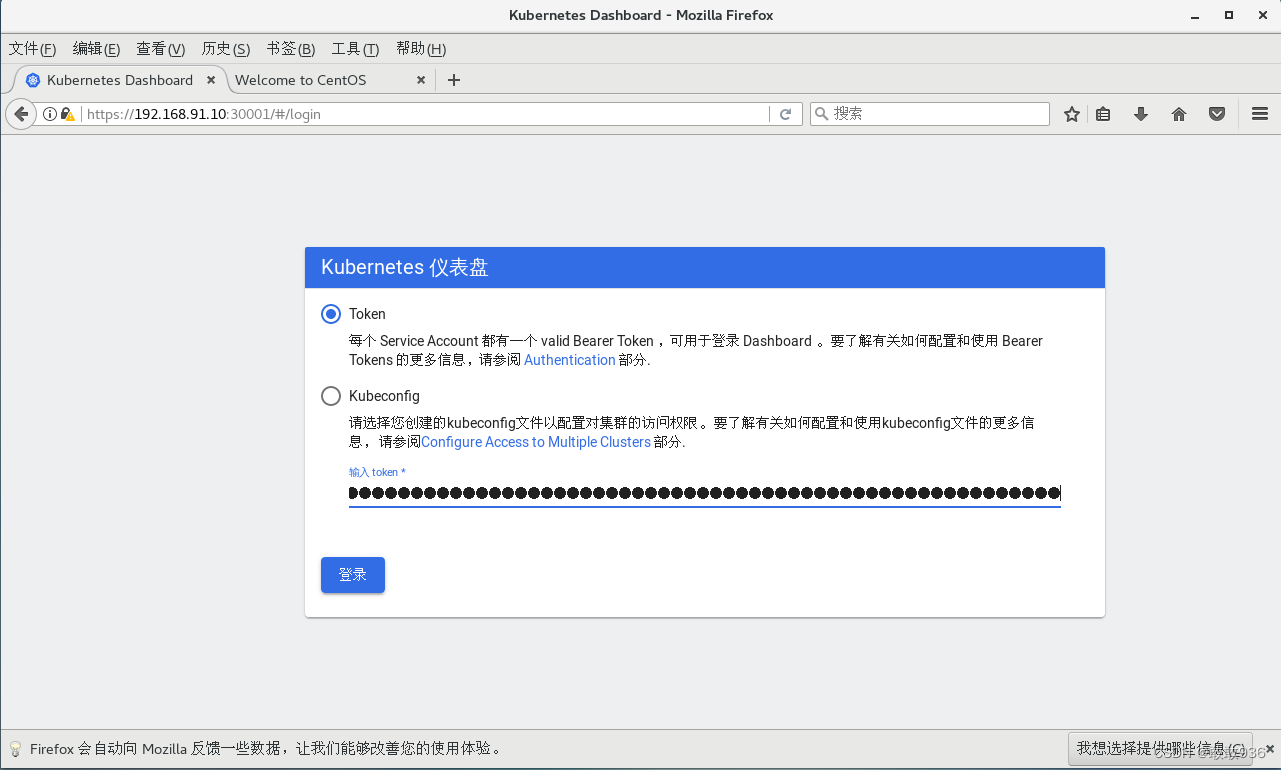

#创建service account并绑定默认cluster-admin管理员集群角色

kubectl create serviceaccount dashboard-admin -n kube-system

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}')

![]()

![]()

![]()

二、要求在 Kubernetes 环境中,通过yaml文件的方式,创建2个Nginx Pod分别放置在两个不同的节点上,Pod使用hostPath类型的存储卷挂载,节点本地目录共享使用 /data,2个Pod副本测试页面二者要不同,以做区分,测试页面可自己定义。

1.生成nginx的pod模板文件

kubectl run mynginx --image=nginx:1.14 --port=80 --dry-run=client -o yaml > nginx-pod.yaml2.修改模板文件:

---

apiVersion: v1

kind: Pod

metadata:labels:run: nginxname: nginx01

spec:nodeName: node01containers:- image: nginxname: nginxports:- containerPort: 80volumeMounts:- name: node1-htmlmountPath: /usr/share/nginx/html/volumes:- name: node1-htmlhostPath:path: /data/type: DirectoryOrCreate

---

apiVersion: v1

kind: Pod

metadata:labels:run: nginxname: nginx02

spec:nodeName: node02containers:- image: nginxname: nginxports:- containerPort: 80volumeMounts:- name: node2-htmlmountPath: /usr/share/nginx/html/volumes:- name: node2-htmlhostPath:path: /data/type: DirectoryOrCreate

3.使用yaml文件创建自主式Pod资源:

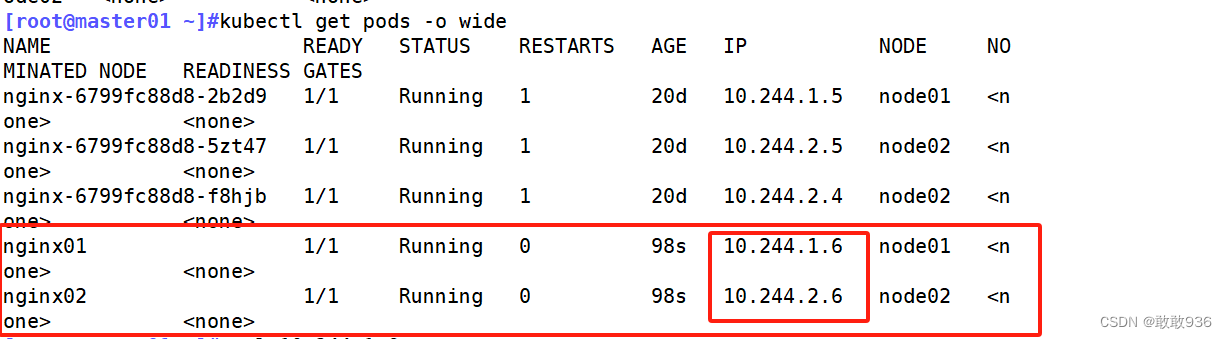

kubectl apply -f nginx-pod.yamlpod/nginx01 createdpod/nginx02 created4.查看创建的两个pod,被调度到了不同的node节点:

kubectl get pods -o wide

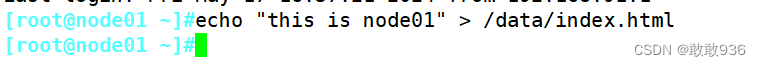

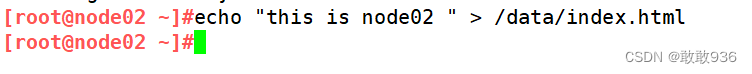

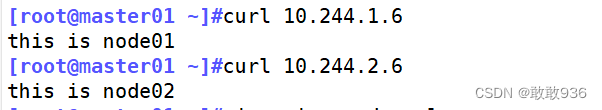

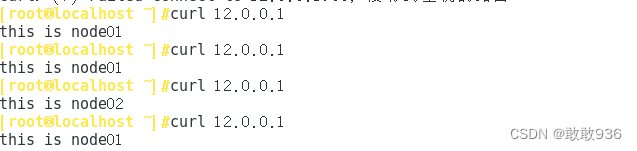

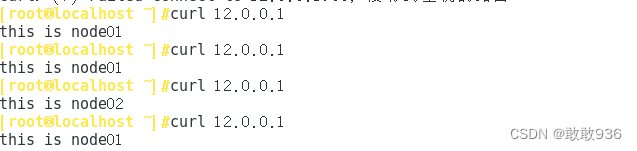

5.两个node节点的存储卷,写入不同的html文件内容,验证访问网页:

#node01节点echo "this is node01" > /data/index.html#node02节点echo "this is node02 " > /data/index.htmlcurl 10.244.1.6 #访问Node01节点的Pod的IPcurl 10.244.2.6 #访问Node02节点的Pod的IP

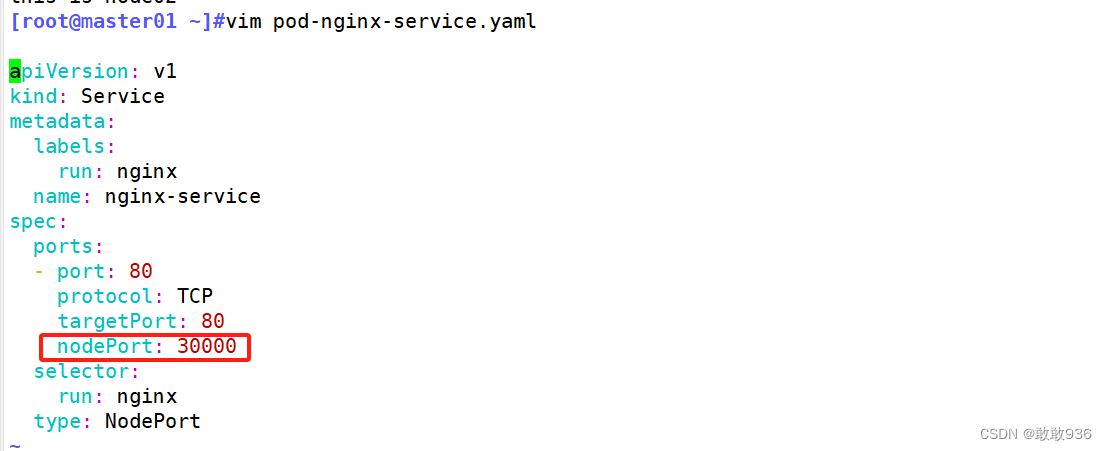

三、编写service对应的yaml文件,使用NodePort类型和TCP 30000端口将Nginx服务发布出去。

1.编写service对应的yaml文件:

apiVersion: v1

kind: Service

metadata:labels:run: nginxname: nginx-service

spec:ports:- port: 80protocol: TCPtargetPort: 80nodePort: 30000selector:run: nginxtype: NodePort

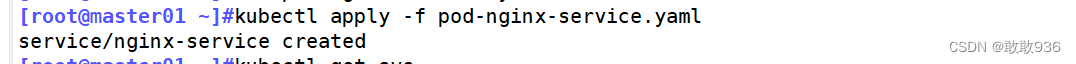

2.执行yaml文件:

[root@master01 ~]#kubectl apply -f pod-nginx-service.yaml

service/nginx-service created

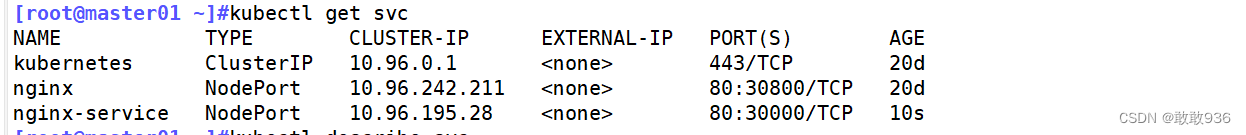

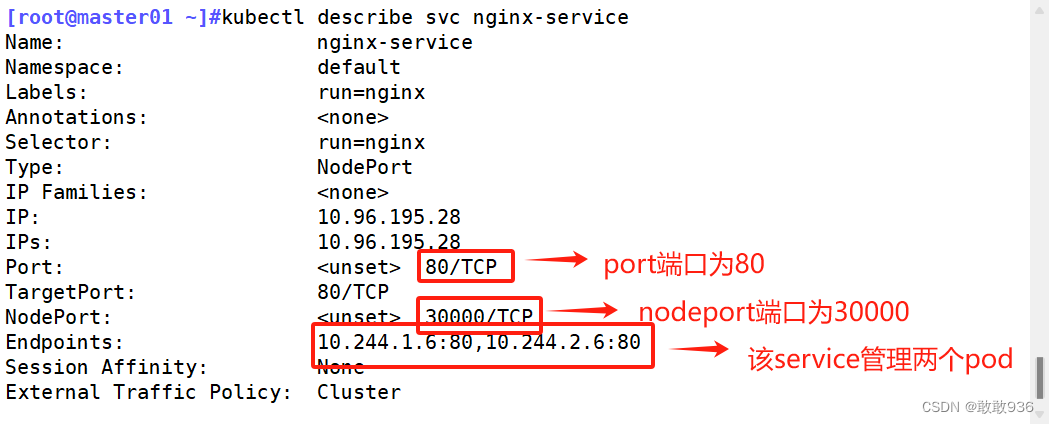

3.查看:

kubectl get svc

kubectl describe svc nginx-service

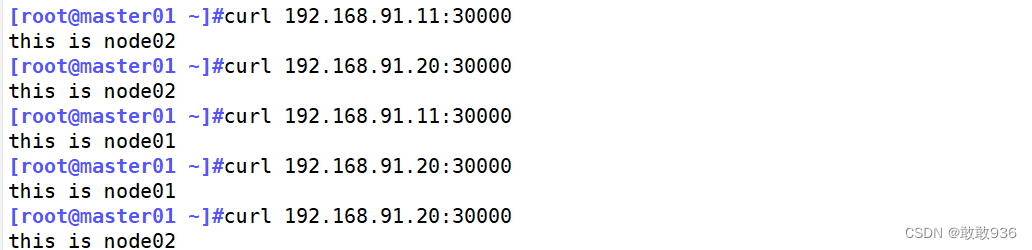

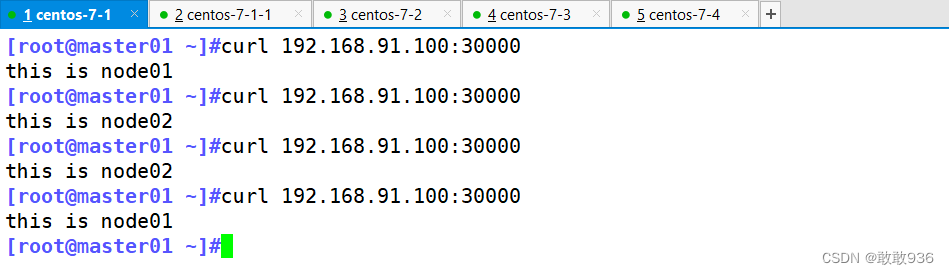

4.访问网页:

[root@master01 ~]#curl 192.168.91.11:30000

[root@master01 ~]#curl 192.168.91.20:30000

四、负载均衡区域配置Keepalived+Nginx,实现负载均衡高可用,通过VIP 192.168.10.100和自定义的端口号即可访问K8S发布出来的服务。

| lb01: | 192.168.91.30 |

|---|---|

| lb02: | 192.168.91.40 |

| VIP: | 192.168.91.100 |

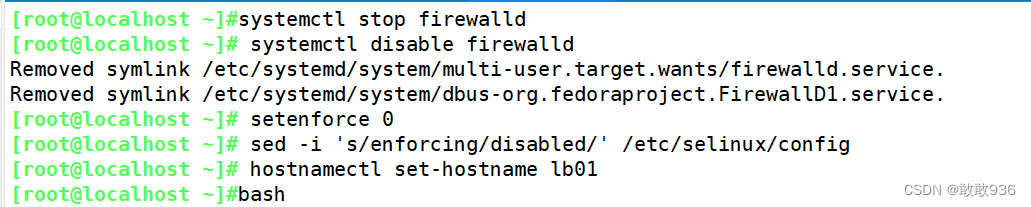

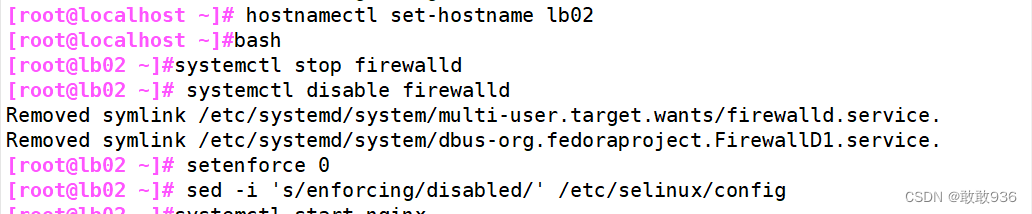

1.初始化设置:

#关闭防火墙和selinuxsystemctl stop firewalldsystemctl disable firewalldsetenforce 0sed -i 's/enforcing/disabled/' /etc/selinux/config#设置主机名hostnamectl set-hostname lb01bashhostnamectl set-hostname lb02bash2.配置nginx的官方在线yum源:

vim /etc/yum.repos.d/nginx.repo

[nginx]

name=nginx repo

baseurl=https://nginx.org/packages/centos/7/$basearch/

gpgcheck=0

yum install nginx -y

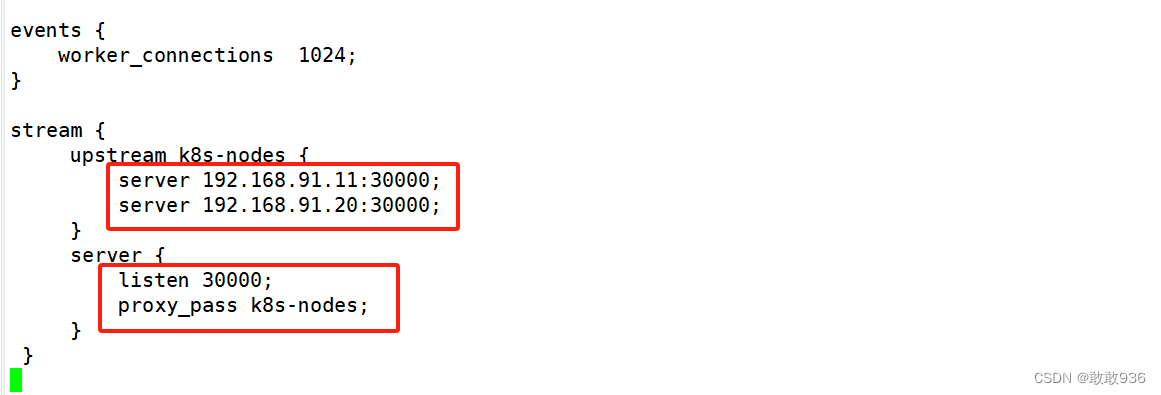

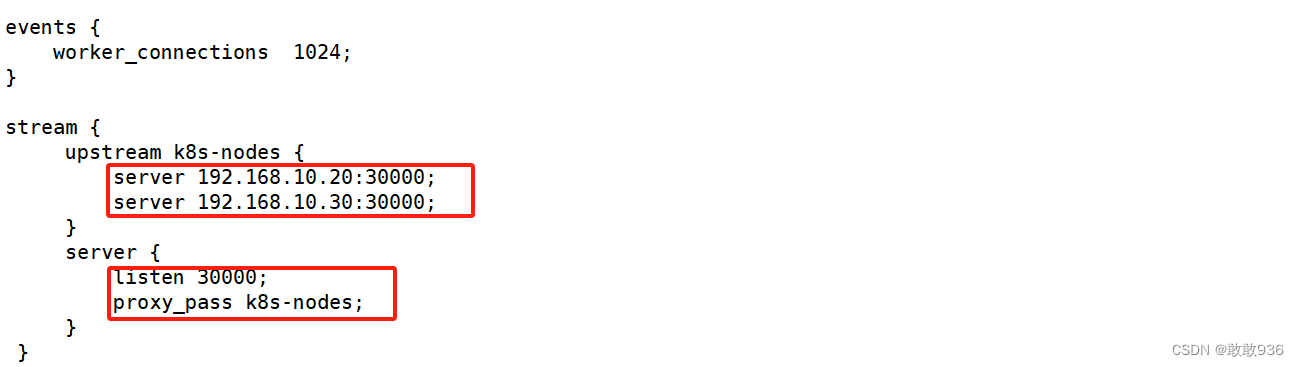

3.修改nginx配置文件,配置四层反向代理负载均衡,指定k8s群集2台node的节点ip和30000端口:

vim /etc/nginx/nginx.confevents {worker_connections 1024;}#在http块上方,添加stream块stream {upstream k8s-nodes {server 192.168.10.20:30000; #node01IP:nodePortserver 192.168.10.30:30000; #node02IP:nodePort}server {listen 30000; #自定义监听端口proxy_pass k8s-nodes;}}http {......#include /etc/nginx/conf.d/*.conf; #建议将这一行注释掉,否则会同时加载/etc/nginx/conf.d/default.conf文件中的内容,nginx会同时监听80端口。}

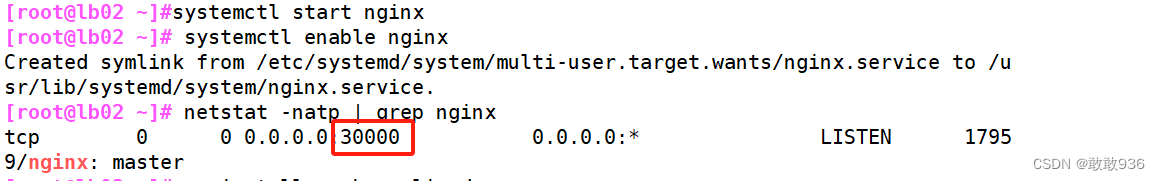

#检查配置文件语法是否正确nginx -t #启动nginx服务,查看到已监听30000端口systemctl start nginxsystemctl enable nginxnetstat -natp | grep nginx

4.两台负载均衡器配置keepalived:

#安装keepalived

yum install -y keepalived

#在/etc/keepalived目录下创建nginx检测脚本

cd /etc/keepalived/

vim check_nginx.sh

#!/bin/bash

#检测nginx是否启动了

A=`ps -C nginx --no-header |wc -l`

if [ $A -eq 0 ];then #如果nginx没有启动就启动nginx systemctl start nginx #重启nginxif [ `ps -C nginx --no-header |wc -l` -eq 0 ];then #nginx重启失败,则停掉keepalived服务,进行VIP转移killall keepalived fi

fi

#给脚本执行权限

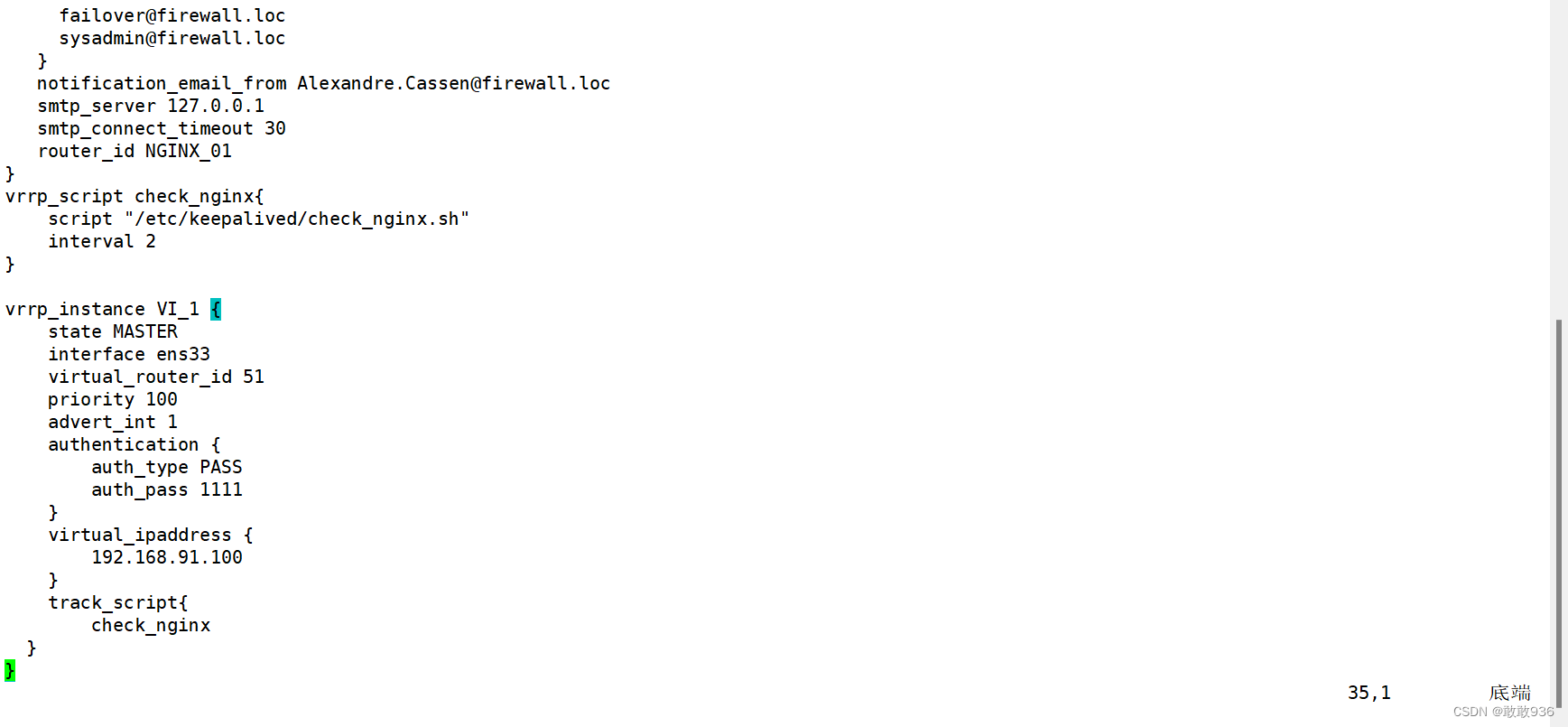

chmod +x check_nginx.sh 5.修改keepalived配置文件:

vim keepalived.conf

! Configuration File for keepalived

global_defs {notification_email {acassen@firewall.locfailover@firewall.locsysadmin@firewall.loc}notification_email_from Alexandre.Cassen@firewall.locsmtp_server 127.0.0.1 #修改邮箱地址smtp_connect_timeout 30router_id NGINX_01 #修改主备id#删掉这里的四行vrrp

}

#加入周期性检测nginx服务脚本的相关配置

vrrp_script check_nginx{script "/etc/keepalived/check_nginx.sh" #心跳执行的脚本,检测nginx是否启动interval 2 #(检测脚本执行的间隔,单位是秒)

}

vrrp_instance VI_1 {state MASTERinterface ens33 #修改网卡名称virtual_router_id 51priority 100 #优先级,主不改,备改成比100小就行advert_int 1authentication {auth_type PASSauth_pass 1111}virtual_ipaddress {192.168.10.100 #修改VIP地址}#添加跟踪(执行脚本)track_script{check_nginx}

}

#重启服务

systemctl restart keepalived.service

systemctl enable keepalived.service

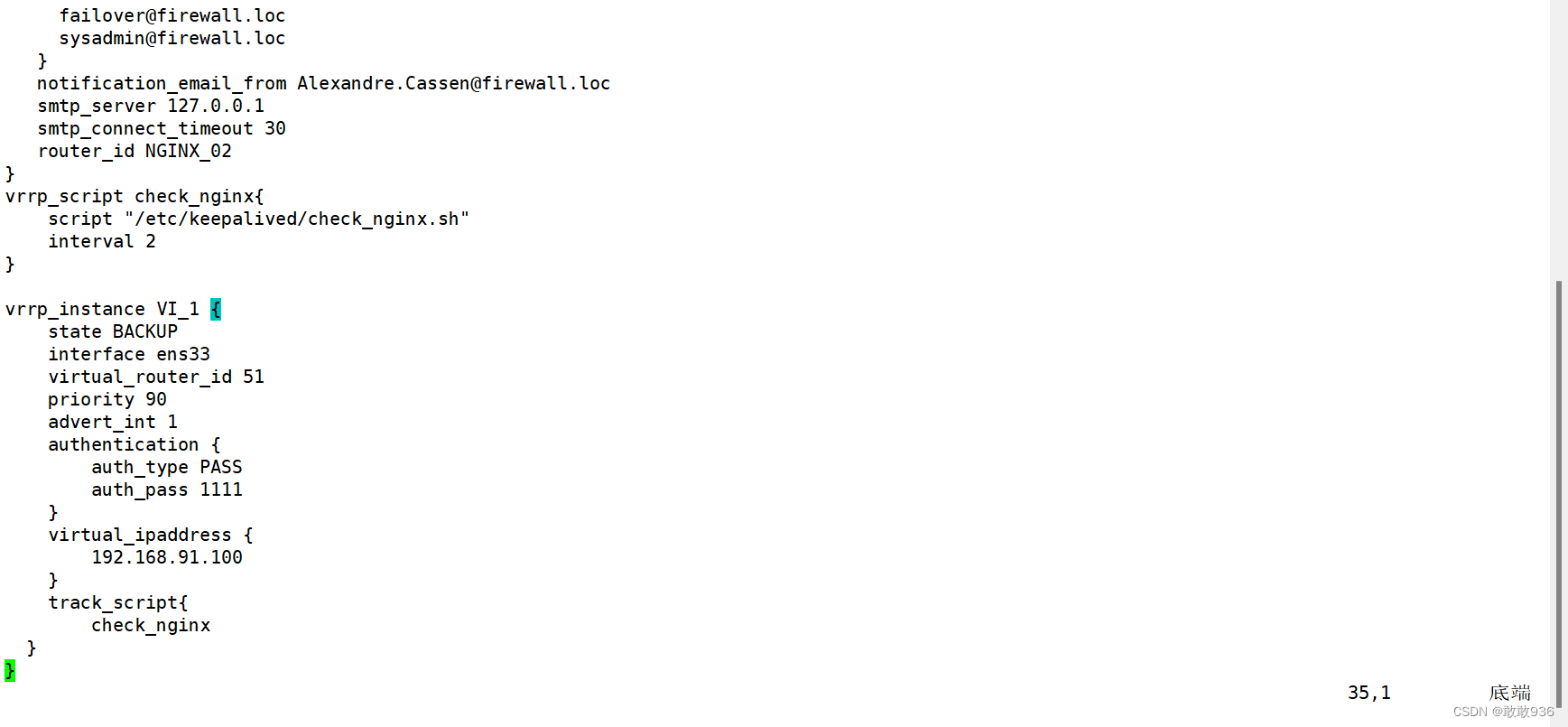

#备服务器下载好keepalived后,在主服务器上将脚本和keepalived配置文件传过去

[root@nginx01 keepalived]# scp * 192.168.10.50:`pwd`

#传过去后修改三处

router_id NGINX_02

state BACKUP

priority 90

#然后重启服务

systemctl restart keepalived.service

systemctl enable keepalived.service

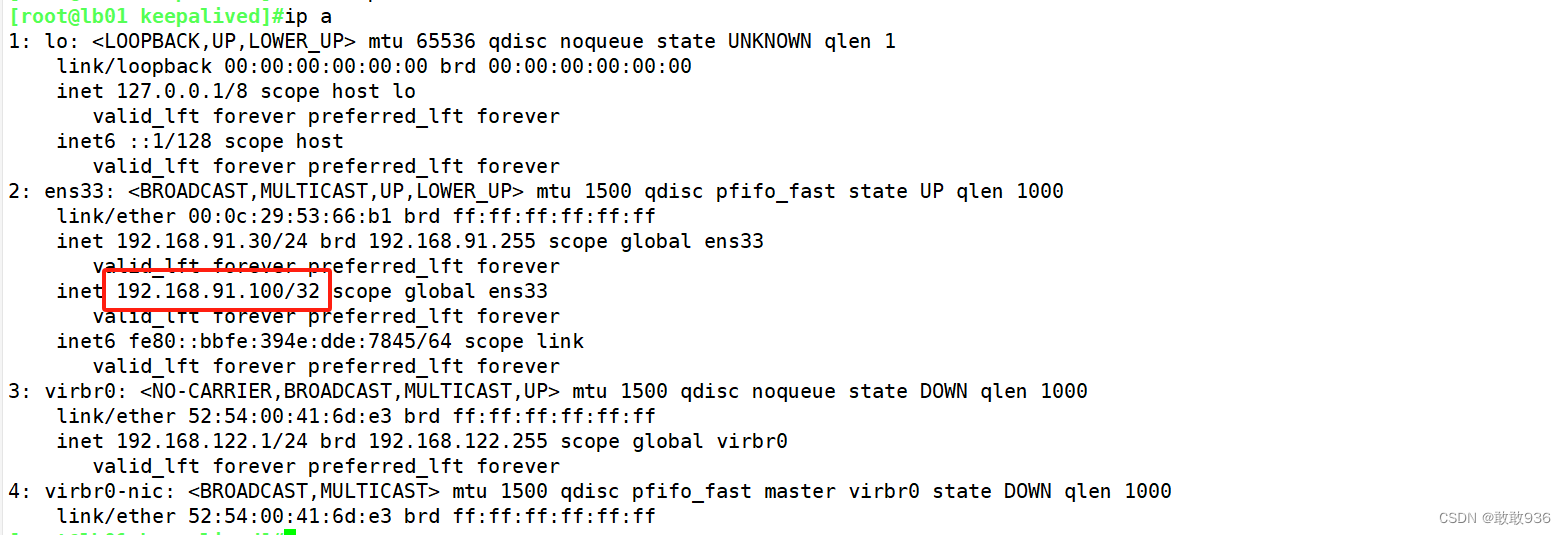

6.在nginx+keepalivd主机上测试查看VIP地址是否生成并测试页面:

五、iptables防火墙服务器,设置双网卡,并且配置SNAT和DNAT转换实现外网客户端可以通过12.0.0.1访问内网的Web服务。

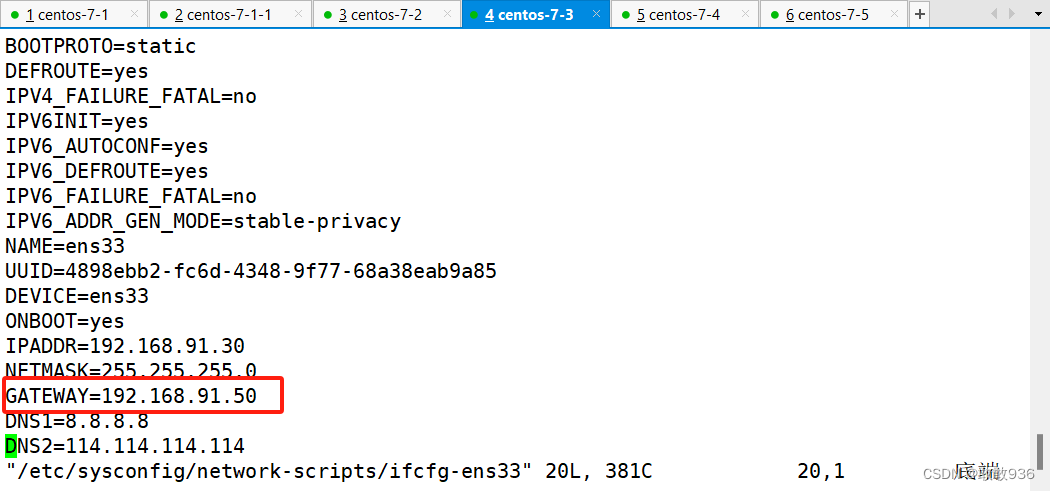

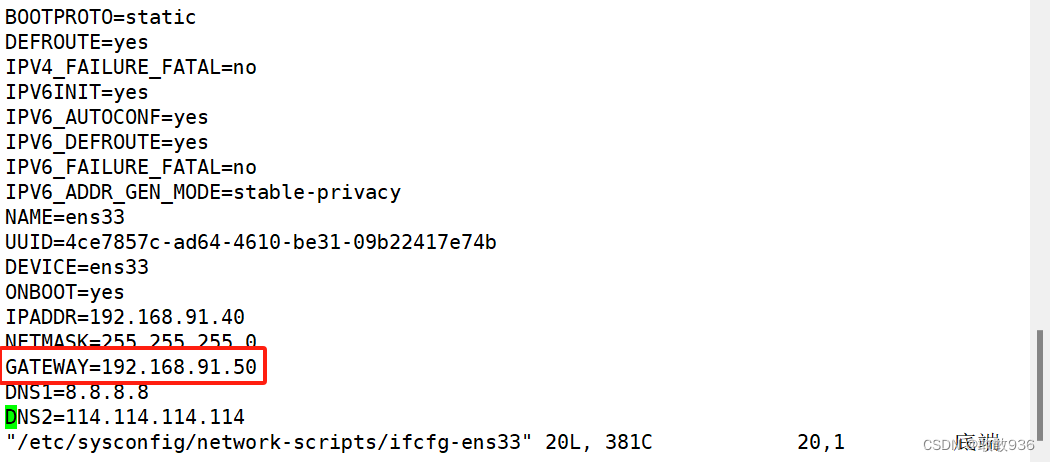

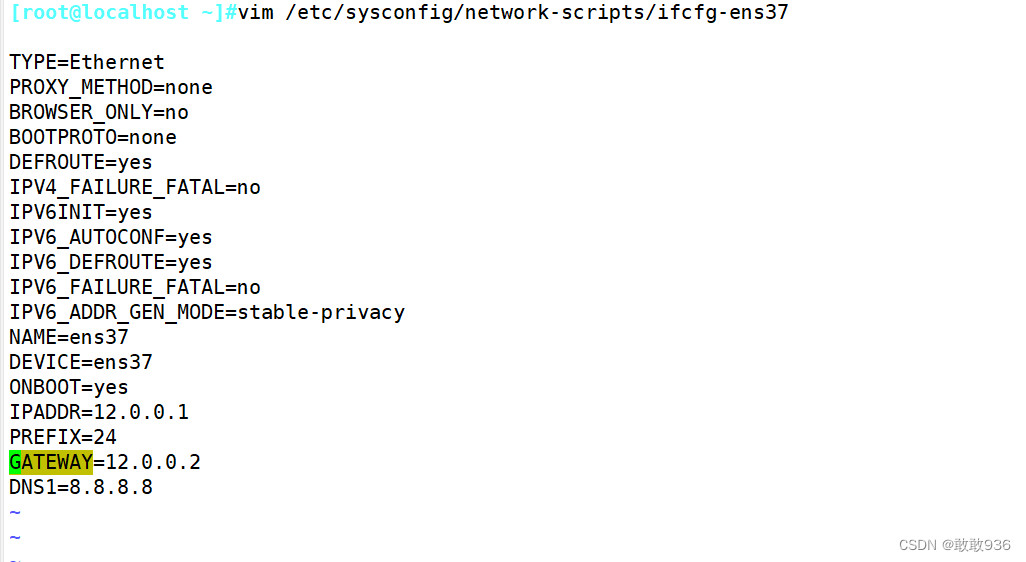

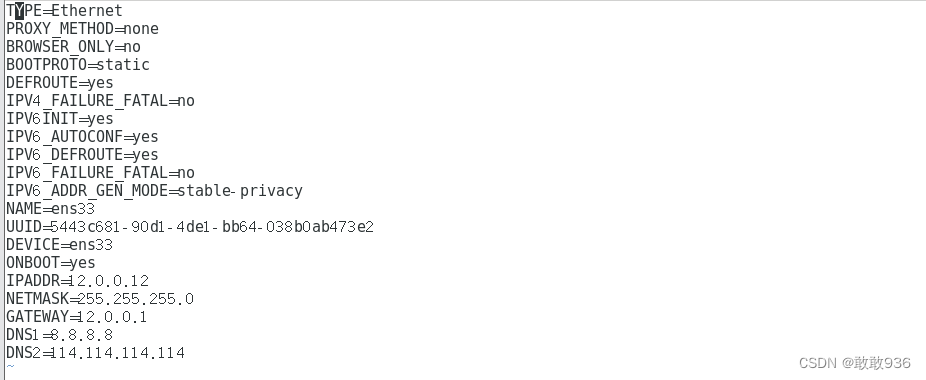

1.两台负载均衡器,将网关地址修改为防火墙服务器的内网IP地址

vim /etc/sysconfig/network-scripts/ifcfg-ens33GATEWAY="192.168.10.1"systemctl restart network #重启网络

2.配置防火墙服务器:

配置两块网卡

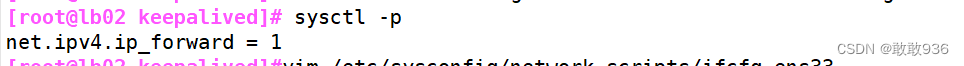

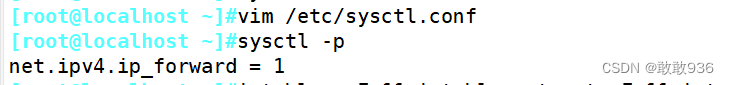

------------开启路由转发功能----------------vim /etc/sysctl.confnet.ipv4.ip_forward = 1 //在文件中增加这一行,开启路由转发功能sysctl -p //加载修改后的配置

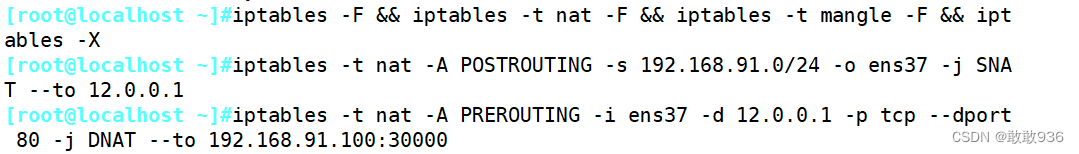

#------------配置iptables策略---------------#先将原有的规则清除iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X#设置SNAT服务,解析源地址。修改nat表中的POSTROUTING链。#将源地址192.168.91.100转换为为12.0.0.1iptables -t nat -A POSTROUTING -s 192.168.91.0/24 -o ens37 -j SNAT --to 12.0.0.1#-t nat //指定nat表#-A POSTROUTING //在POSTROUTING链中添加规则 #-s 192.168.91.100/24 //数据包的源地址#-o ens36 //出站网卡#-j SNAT --to 12.0.0.1 //使用SNAT服务,将源地址转换成公网IP地址。#设置DNAT服务,解析目的地址。修改nat表中的PRETROUTING链。#将目的地址12.0.0.1:3344 转换成 192.168.91.100:3344iptables -t nat -A PREROUTING -i ens37 -d 12.0.0.1 -p tcp --dport 80 -j DNAT --to 192.168.91.100:30000#-A PREROUTING //在PREROUTING链中添加规则 #-i ens37 //入站网卡#-d 12.0.0.254 //数据包的目的地址#-p tcp --dport 3344 //数据包的目的端口#-j DNAT --to 192.168.91.100:3344 //使用DNAT功能,将目的地址和端口转换成192.168.10.100:3344

3.客户端修改网关配置文件,测试访问内网的Web服务:

客户端IP地址:12.0.0.12,将网关地址设置为防火墙服务器的外网网卡地址:12.0.0.1浏览器输入 curl 12.0.0.1 进行访问

相关文章:

云原生Kubernetes系列项目实战-k8s集群+高可用负载均衡层+防火墙

一、Kubernetes 区域可采用 Kubeadm 方式进行安装: 名称主机部署服务master192.168.91.10docker、kubeadm、kubelet、kubectl、flannelnode01192.168.91.11docker、kubeadm、kubelet、kubectl、flannelnode02192.168.91.20docker、kubeadm、kubelet、kubectl、flan…...

MFC为什么说文档在数据的保存和给用户提供数据之间划分了清晰的界限?

MFC MFC(Microsoft Foundation Classes)是微软为Windows应用程序开发提供的一套C类库,它在设计上强调了"文档-视图"(Document-View)架构。这种架构将文档(Document)与用户界面&#…...

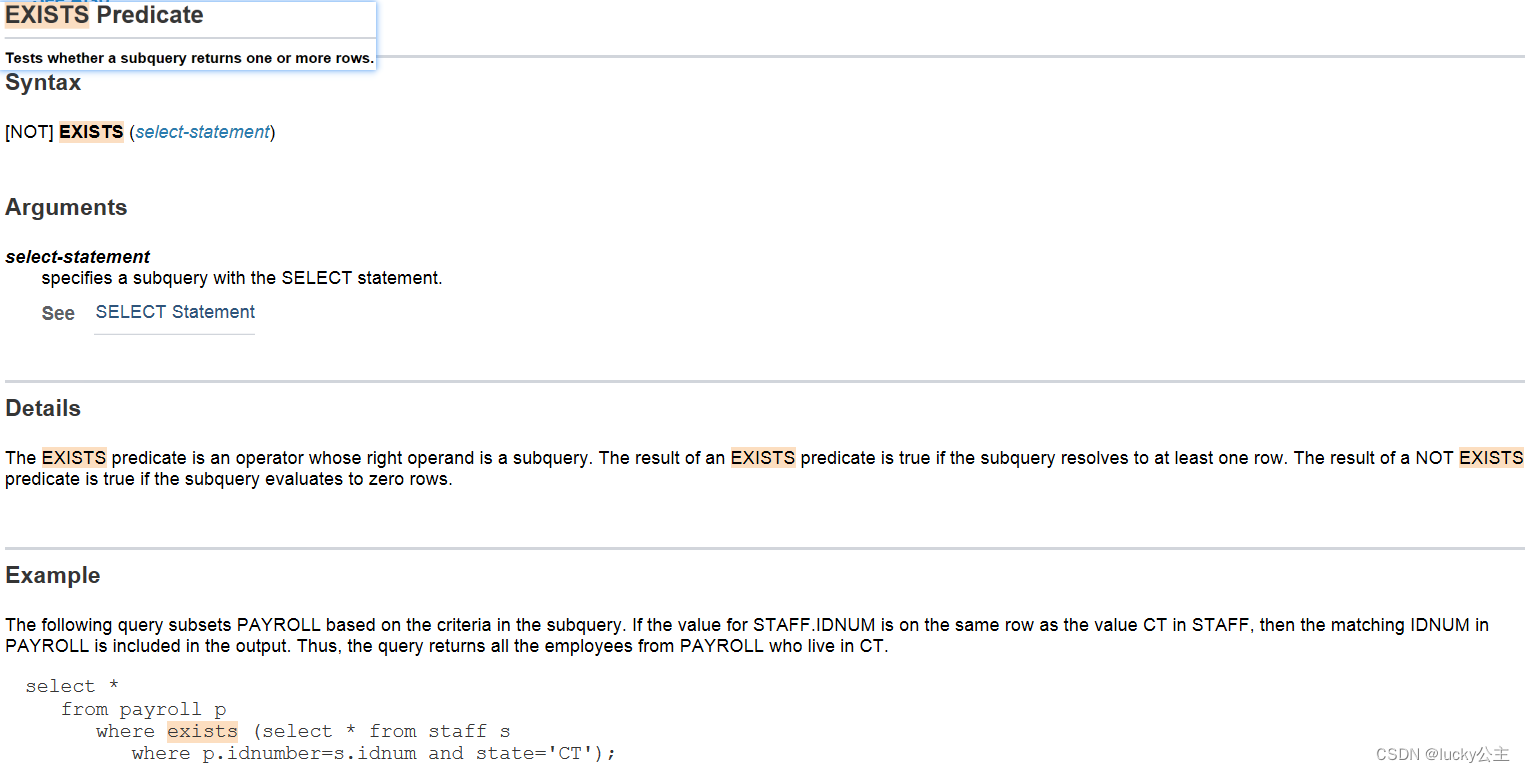

SAS:PROC SQL和ANSI标准

文章来源于SAS HELP PROC SQL 和ANSI SQL 的区别——图表和视图名称的作用域规则不同 例1:匹配数据集相关名称 当PROC SQL匹配数据集相关名称时,会依次进行3个步骤:1、有别名,用别名匹配;2、1匹配失败,在无…...

使用mysql_config_editor可以为特定的MySQL服务器或客户端程序设置登录路径

login_path 介绍 在 MySQL 中,login_path 通常不是 MySQL 服务器配置或 SQL 语句的一部分。但是,它经常与 MySQL 的命令行工具 mysql_config_editor 一起使用,这是一个允许用户安全地存储认证凭据(如用户名、密码和连接参数&…...

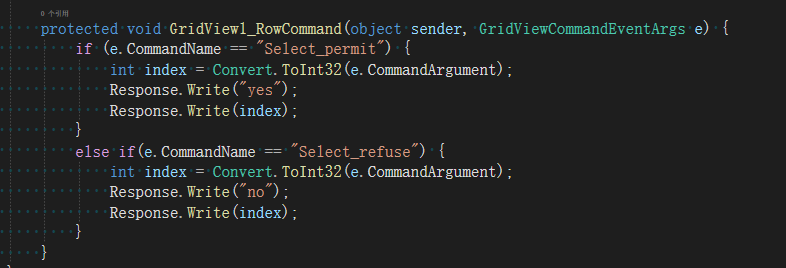

gridview的模板按钮如何判断用户点击的是哪一行

在asp.net的 GridView 控件中,判断用户点击的是哪一行通常可以通过处理 GridView 的 RowCommand 事件来实现。RowCommand 事件会在 GridView 的每个按钮(除非另有指定的CommandName)被点击时触发,并且事件参数中包含了足够的信息来…...

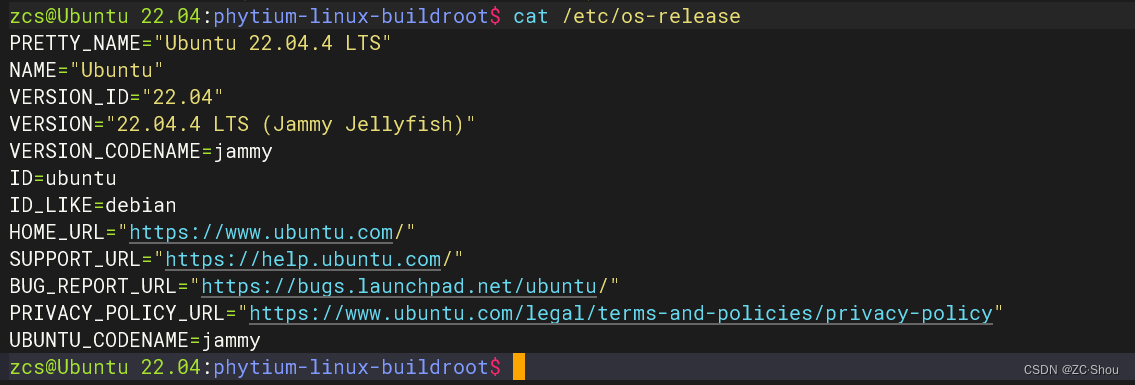

虚拟化 之三 详解 jailhouse(ARM 平台)的构建过程、配置及使用

嵌入式平台下,由于资源的限制,通常不具备通用性的 Linux 发行版,各大主流厂商都会提供自己的 Linux 发行版。这个发行版通常是基于某个 Linux 发行版构建系统来构建的,而不是全部手动构建,目前主流的 Linux 发行版构建系统是 Linux 基金会开发的 Yocto 构建系统。 基本环…...

数据安全:Web3时代的隐私保护新标准

随着数字化时代的到来,我们的生活已经完全依赖于互联网和数据交换。然而,随之而来的是对个人隐私和数据安全的日益关注。在这个信息爆炸的时代,数据泄露、个人隐私侵犯和网络攻击等问题日益突出,而Web3技术的崛起正带来了一种全新…...

STM32串口不定长接收空闲中断

目录 1. 开启串口空闲中断2. 合理开关中断3. 串口发送函数 1. 开启串口空闲中断 最近接触到的 Modbus RTU 项目使用到了串口接收中断和空闲中断。记录一下 初始化可以直接套用正点原子的初始化,只需要添加一行即可 USART_ITConfig(USART1, USART_IT_IDLE, ENABLE)…...

Ubuntu 设置开机启动脚本

在/etc/systemd/system/目录下创建对应的server服务 如:/etc/systemd/system/test-script.service [Unit] DescriptionTest Script Service Afternetwork.target[Service] Typeoneshot ExecStart/path/to/test-script.sh[Install] WantedBymulti-user.target替换/…...

C# Task 包含 await ConfigureAwait CancellationTokenSource

Task以下是 Task 类的一些关键特性和用法:以下是一些使用 Task 的示例:创建并启动一个任务使用 await 等待任务完成处理任务异常使用 Task<TResult> 获取结果取消任务总结 await暂停方法执行:非阻塞调用:任务结果获取&#…...

Python数据分析与建模库-02科学计算库Numpy01-05合集

1、该视频主要讲述了南派(NumPy)的核心操作和数据结构,以及如何使用NumPy库读取和处理数据。 2、该视频主要讲述了在编程中,如何对数组或矩阵中的元素进行判断和操作,以及在单排中如何进行类型转换。 3、该视频主要讲…...

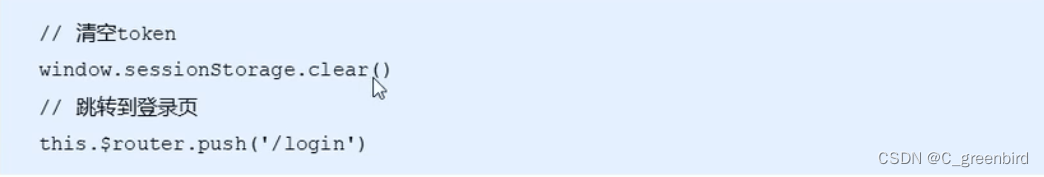

【前端项目笔记】1 登录与登出功能实现

项目笔记 ☆☆代表面试常见题 前后端分离:后端负责写接口,前端负责调接口。 登录/退出功能 登录业务流程 登录页面:用户名密码 调用后台接口进行验证 通过验证,根据后台响应状态跳到项目主页 登录业务相关技术点࿱…...

是字符串定义以及在C语言中字符串是如何表示的

字符串(String)是由零个或多个字符(包括空格)组成的有限序列,常用于文本数据的存储和处理。在编程中,字符串是常见的数据类型。 在C语言中,字符串不是一种内置的数据类型,但C语言提…...

辽宁普通测径仪升级智能测径仪后都有哪些改进?

关键字: 普通测径仪, 智能测径仪, 测径仪升级, 测径仪特点, 智能测径仪优势, 目前多数厂家测径仪的数据处理方式是单片机计算出最终结果,然后传输到工控机后期处理。这样的电路系统对轧钢现场的高温、高粉尘和强电磁干扰的环境适应性很差,使得同一厂家、…...

【微信小程序】事件分类以及阻止事件冒泡

在微信小程序中,事件分为冒泡事件和非冒泡事件两大类,它们的区别在于事件是否能从原始触发组件开始,向父级组件传播(即“冒泡”)。 冒泡事件:当一个组件上的事件被触发后,不仅当前组件会接收到这…...

踩坑!被node-sass折磨的一天

文章目录 被node-sass折磨的一天折磨过程了解原因注意事项 被node-sass折磨的一天 折磨过程 起因是要开发一个老项目,照常拉代码、下依赖、启动三步走 依赖开始下载不对了,以为是node版本问题,寻找node-sass对应的node版本 利用nvm&#…...

App UI 风格打造独特体验

App UI 风格打造独特体验...

【学习笔记8】阅读StyleID论文源码

论文【链接】 源码【链接】 一、DDIM eta ddim_step表示执行几轮去噪迭代,eta表示DDPM和DDIM的插值系数。当eta0时,为DDPM;当eta≠0时,为DDIM。 参考 DDIM 简明讲解与 PyTorch 实现:加速扩散模型采样的通用方法 【s…...

wordpress旅游网站模板

旅行社wordpress主题 简洁实用的旅行社wordpress主题,适用于旅行社建网站的wordpress主题模板。 https://www.jianzhanpress.com/?p4296 旅游WordPress主题 简洁实用的旅游WordPress主题,适合做旅游公司网站的WordPress主题模板。 https://www.jian…...

vs2019 c++20规范 STL 库中头文件 <atomic> 源码注释及探讨几个知识点

(1 探讨一) 模板类 atomic 的继承关系与数据结构如下: (2 探讨二 ) 可见 atomic 的 fetch_xx 函数,返回的都是 atomic 中存储的旧值。测试如下: 谢谢...

API Key认证系统设计:企业级API开放平台实践

API Key认证系统设计:企业级API开放平台实践 摘要:当AI应用从内部工具转向对外开放时,如何确保接口安全、防止滥用并实现精细化权限控制?本文基于一个真实的跑步教练AI项目,详细解析如何构建一套生产级的API Key认证系…...

ARM SMMU-700内存管理单元原理与优化实践

1. MMU-700 SMMU架构概述与典型应用场景内存管理单元(MMU)是现代计算机系统中不可或缺的核心组件,负责处理虚拟地址到物理地址的转换。在ARM架构中,系统级内存管理单元(SMMU)扮演着更为关键的角色ÿ…...

终极Windows虚拟手柄驱动配置指南:5步快速上手ViGEmBus

终极Windows虚拟手柄驱动配置指南:5步快速上手ViGEmBus 【免费下载链接】ViGEmBus Windows kernel-mode driver emulating well-known USB game controllers. 项目地址: https://gitcode.com/gh_mirrors/vi/ViGEmBus 想在Windows系统中轻松实现游戏控制器模拟…...

从Axure原型到智能运营:构建共享充电桩后台管理系统的核心模块与实战场景

1. 从Axure原型到智能运营的完整链路 第一次接触共享充电桩后台管理系统设计时,我和很多产品经理一样,以为画完Axure原型就万事大吉。直到实际开发阶段才发现,原型设计只是万里长征的第一步。真正考验人的是如何把静态的线框图转化为具备智能…...

微信数据库解密全攻略:3步解锁你的数字记忆宝库

微信数据库解密全攻略:3步解锁你的数字记忆宝库 【免费下载链接】WechatDecrypt 微信消息解密工具 项目地址: https://gitcode.com/gh_mirrors/we/WechatDecrypt 微信数据库解密工具WechatDecrypt让你重新掌控被加密的聊天记录,实现个人数据的自主…...

proxy-doctor:自动化诊断与修复开发工具代理配置的利器

1. 项目概述与核心价值最近在折腾一些需要稳定网络连接的项目时,遇到了一个老生常谈但又极其恼人的问题:代理配置。无论是开发环境里的包管理工具,还是日常使用的命令行工具,一旦涉及到网络请求,代理设置不对ÿ…...

用ZYNQ和LWIP搞定8路ADS8681数据采集:从Vivado Block Design到上位机TCP通信的完整流程

ZYNQ与LWIP构建的8通道高速数据采集系统实战指南 在工业自动化、测试测量和科研领域,多通道高精度数据采集系统正变得越来越重要。本文将详细介绍如何利用Xilinx ZYNQ SoC和LWIP协议栈,构建一个支持8路ADS8681同步采集的实时数据传输系统。不同于简单的代…...

从8K游戏到HDR电影:拆解Xilinx HDMI 2.1 IP如何支持VRR、ALLM和动态HDR这些炫酷特性

从8K游戏到HDR电影:Xilinx HDMI 2.1 IP如何重塑视听体验 当PS5玩家在《战神:诸神黄昏》中感受到无撕裂的流畅战斗画面,或是家庭影院爱好者在《沙丘》中看到沙漠场景的每一粒沙粒都呈现出惊人的动态范围时,背后都离不开HDMI 2.1的关…...

5大优势解析:如何高效使用免费离线OCR工具

5大优势解析:如何高效使用免费离线OCR工具 【免费下载链接】Umi-OCR OCR software, free and offline. 开源、免费的离线OCR软件。支持截屏/批量导入图片,PDF文档识别,排除水印/页眉页脚,扫描/生成二维码。内置多国语言库。 项目…...

如何3步免费解锁WeMod专业版:2026年终极增强工具使用指南

如何3步免费解锁WeMod专业版:2026年终极增强工具使用指南 【免费下载链接】Wand-Enhancer Advanced UX and interoperability extension for Wand (WeMod) app 项目地址: https://gitcode.com/gh_mirrors/we/Wand-Enhancer 还在为WeMod专业版的订阅费用而犹豫…...