240908-结合DBGPT与Ollama实现RAG本地知识检索增强

A. 最终效果

B. 背景说明

-

DBGPT在0.5.6版本中开始支持Ollama:v0.5.6 版本更新

-

网友对其Web端及界面端的设置进行了分享:

- feat(model): support ollama as an optional llm & embedding proxy by GITHUBear · Pull Request #1475 · eosphoros-ai/DB-GPT

- DB-GPT+Ollama构建本地智能数据平台_db-gpt ollama-CSDN博客

C. 环境配置

- 参考官网教程完成环境配置

D. 配置文件

- ⚠️:注意下面带⭐️的操作

#*******************************************************************#

#** DB-GPT - GENERAL SETTINGS **#

#*******************************************************************##*******************************************************************#

#** Webserver Port **#

#*******************************************************************#

# DBGPT_WEBSERVER_PORT=5670

## Whether to enable the new web UI, enabled by default,False use old ui

# USE_NEW_WEB_UI=True

#*******************************************************************#

#*** LLM PROVIDER ***#

#*******************************************************************## TEMPERATURE=0#*******************************************************************#

#** LLM MODELS **#

#*******************************************************************#

# ⭐️ 添加Ollama配置

LLM_MODEL=ollama_proxyllm

PROXY_SERVER_URL=http://127.0.0.1:11434

PROXYLLM_BACKEND="qwen2:1.5b"

PROXY_API_KEY=not_used

EMBEDDING_MODEL=proxy_ollama

proxy_ollama_proxy_server_url=http://127.0.0.1:11434

proxy_ollama_proxy_backend="nomic-embed-text:latest"# LLM_MODEL=ollama_proxyllm

# MODEL_SERVER=http://127.0.0.1:11434

# PROXYLLM_BACKEND=llama3.1:8b

# EMBEDDING_MODEL=proxy_ollama

# proxy_ollama_proxy_server_url=http://127.0.0.1:11434

# proxy_ollama_proxy_backend=llama3.1:8b# LLM_MODEL=ollama_proxyllm

# PROXY_SERVER_URL=http://127.0.0.1:11434

# PROXYLLM_BACKEND="qwen:0.5b"

# PROXY_API_KEY=not_used

# EMBEDDING_MODEL=proxy_ollama

# proxy_ollama_proxy_server_url=http://127.0.0.1:11434

# proxy_ollama_proxy_backend="nomic-embed-text:latest" # # LLM_MODEL, see dbgpt/configs/model_config.LLM_MODEL_CONFIG

# LLM_MODEL=glm-4-9b-chat

# ## LLM model path, by default, DB-GPT will read the model path from LLM_MODEL_CONFIG based on the LLM_MODEL.

# ## Of course you can specify your model path according to LLM_MODEL_PATH

# ## In DB-GPT, the priority from high to low to read model path:

# ## 1. environment variable with key: {LLM_MODEL}_MODEL_PATH (Avoid multi-model conflicts)

# ## 2. environment variable with key: MODEL_PATH

# ## 3. environment variable with key: LLM_MODEL_PATH

# ## 4. the config in dbgpt/configs/model_config.LLM_MODEL_CONFIG

# # LLM_MODEL_PATH=/app/models/glm-4-9b-chat

# # LLM_PROMPT_TEMPLATE=vicuna_v1.1

# MODEL_SERVER=http://127.0.0.1:8000

# LIMIT_MODEL_CONCURRENCY=5

# MAX_POSITION_EMBEDDINGS=4096

# QUANTIZE_QLORA=True

# QUANTIZE_8bit=True

# # QUANTIZE_4bit=False

# ## SMART_LLM_MODEL - Smart language model (Default: vicuna-13b)

# ## FAST_LLM_MODEL - Fast language model (Default: chatglm-6b)

# # SMART_LLM_MODEL=vicuna-13b

# # FAST_LLM_MODEL=chatglm-6b

# ## Proxy llm backend, this configuration is only valid when "LLM_MODEL=proxyllm", When we use the rest API provided by deployment frameworks like fastchat as a proxyllm,

# ## "PROXYLLM_BACKEND" is the model they actually deploy. We can use "PROXYLLM_BACKEND" to load the prompt of the corresponding scene.

# # PROXYLLM_BACKEND=# ### You can configure parameters for a specific model with {model name}_{config key}=xxx

# ### See dbgpt/model/parameter.py

# ## prompt template for current model

# # llama_cpp_prompt_template=vicuna_v1.1

# ## llama-2-70b must be 8

# # llama_cpp_n_gqa=8

# ## Model path

# # llama_cpp_model_path=/data/models/TheBloke/vicuna-13B-v1.5-GGUF/vicuna-13b-v1.5.Q4_K_M.gguf# ### LLM cache

# ## Enable Model cache

# # MODEL_CACHE_ENABLE=True

# ## The storage type of model cache, now supports: memory, disk

# # MODEL_CACHE_STORAGE_TYPE=disk

# ## The max cache data in memory, we always store cache data in memory fist for high speed.

# # MODEL_CACHE_MAX_MEMORY_MB=256

# ## The dir to save cache data, this configuration is only valid when MODEL_CACHE_STORAGE_TYPE=disk

# ## The default dir is pilot/data/model_cache

# # MODEL_CACHE_STORAGE_DISK_DIR=#*******************************************************************#

#** EMBEDDING SETTINGS **#

#*******************************************************************#

# ⭐️ 取消非Ollama的Embedding设置

# EMBEDDING_MODEL=text2vec

# #EMBEDDING_MODEL=m3e-large

# #EMBEDDING_MODEL=bge-large-en

# #EMBEDDING_MODEL=bge-large-zh

# KNOWLEDGE_CHUNK_SIZE=500

# KNOWLEDGE_SEARCH_TOP_SIZE=5

# KNOWLEDGE_GRAPH_SEARCH_TOP_SIZE=200

# ## Maximum number of chunks to load at once, if your single document is too large,

# ## you can set this value to a higher value for better performance.

# ## if out of memory when load large document, you can set this value to a lower value.

# # KNOWLEDGE_MAX_CHUNKS_ONCE_LOAD=10

# #KNOWLEDGE_CHUNK_OVERLAP=50

# # Control whether to display the source document of knowledge on the front end.

# KNOWLEDGE_CHAT_SHOW_RELATIONS=False

# # Whether to enable Chat Knowledge Search Rewrite Mode

# KNOWLEDGE_SEARCH_REWRITE=False

# ## EMBEDDING_TOKENIZER - Tokenizer to use for chunking large inputs

# ## EMBEDDING_TOKEN_LIMIT - Chunk size limit for large inputs

# # EMBEDDING_MODEL=all-MiniLM-L6-v2

# # EMBEDDING_TOKENIZER=all-MiniLM-L6-v2

# # EMBEDDING_TOKEN_LIMIT=8191# ## Openai embedding model, See dbgpt/model/parameter.py

# # EMBEDDING_MODEL=proxy_openai

# # proxy_openai_proxy_server_url=https://api.openai.com/v1

# # proxy_openai_proxy_api_key={your-openai-sk}

# # proxy_openai_proxy_backend=text-embedding-ada-002# ## qwen embedding model, See dbgpt/model/parameter.py

# # EMBEDDING_MODEL=proxy_tongyi

# # proxy_tongyi_proxy_backend=text-embedding-v1

# # proxy_tongyi_proxy_api_key={your-api-key}# ## qianfan embedding model, See dbgpt/model/parameter.py

# #EMBEDDING_MODEL=proxy_qianfan

# #proxy_qianfan_proxy_backend=bge-large-zh

# #proxy_qianfan_proxy_api_key={your-api-key}

# #proxy_qianfan_proxy_api_secret={your-secret-key}# ## Common HTTP embedding model

# # EMBEDDING_MODEL=proxy_http_openapi

# # proxy_http_openapi_proxy_server_url=http://localhost:8100/api/v1/embeddings

# # proxy_http_openapi_proxy_api_key=1dce29a6d66b4e2dbfec67044edbb924

# # proxy_http_openapi_proxy_backend=text2vec#*******************************************************************#

#** RERANK SETTINGS **#

#*******************************************************************#

## Rerank model

# RERANK_MODEL=bge-reranker-base

## If you not set RERANK_MODEL_PATH, DB-GPT will read the model path from EMBEDDING_MODEL_CONFIG based on the RERANK_MODEL.

# RERANK_MODEL_PATH=

## The number of rerank results to return

# RERANK_TOP_K=3## Common HTTP rerank model

# RERANK_MODEL=rerank_proxy_http_openapi

# rerank_proxy_http_openapi_proxy_server_url=http://127.0.0.1:8100/api/v1/beta/relevance

# rerank_proxy_http_openapi_proxy_api_key={your-api-key}

# rerank_proxy_http_openapi_proxy_backend=bge-reranker-base#*******************************************************************#

#** DB-GPT METADATA DATABASE SETTINGS **#

#*******************************************************************#

### SQLite database (Current default database)

LOCAL_DB_TYPE=sqlite### MYSQL database

# LOCAL_DB_TYPE=mysql

# LOCAL_DB_USER=root

# LOCAL_DB_PASSWORD={your_password}

# LOCAL_DB_HOST=127.0.0.1

# LOCAL_DB_PORT=3306

# LOCAL_DB_NAME=dbgpt

### This option determines the storage location of conversation records. The default is not configured to the old version of duckdb. It can be optionally db or file (if the value is db, the database configured by LOCAL_DB will be used)

#CHAT_HISTORY_STORE_TYPE=db#*******************************************************************#

#** COMMANDS **#

#*******************************************************************#

EXECUTE_LOCAL_COMMANDS=False#*******************************************************************#

#** VECTOR STORE / KNOWLEDGE GRAPH SETTINGS **#

#*******************************************************************#

VECTOR_STORE_TYPE=Chroma

GRAPH_STORE_TYPE=TuGraph

GRAPH_COMMUNITY_SUMMARY_ENABLED=True

KNOWLEDGE_GRAPH_EXTRACT_SEARCH_TOP_SIZE=5

KNOWLEDGE_GRAPH_EXTRACT_SEARCH_RECALL_SCORE=0.3

KNOWLEDGE_GRAPH_COMMUNITY_SEARCH_TOP_SIZE=20

KNOWLEDGE_GRAPH_COMMUNITY_SEARCH_RECALL_SCORE=0.0### Chroma vector db config

#CHROMA_PERSIST_PATH=/root/DB-GPT/pilot/data### Milvus vector db config

#VECTOR_STORE_TYPE=Milvus

#MILVUS_URL=127.0.0.1

#MILVUS_PORT=19530

#MILVUS_USERNAME

#MILVUS_PASSWORD

#MILVUS_SECURE=### Weaviate vector db config

#VECTOR_STORE_TYPE=Weaviate

#WEAVIATE_URL=https://kt-region-m8hcy0wc.weaviate.network## ElasticSearch vector db config

#VECTOR_STORE_TYPE=ElasticSearch

ElasticSearch_URL=127.0.0.1

ElasticSearch_PORT=9200

ElasticSearch_USERNAME=elastic

ElasticSearch_PASSWORD={your_password}### TuGraph config

#TUGRAPH_HOST=127.0.0.1

#TUGRAPH_PORT=7687

#TUGRAPH_USERNAME=admin

#TUGRAPH_PASSWORD=73@TuGraph

#TUGRAPH_VERTEX_TYPE=entity

#TUGRAPH_EDGE_TYPE=relation

#TUGRAPH_PLUGIN_NAMES=leiden#*******************************************************************#

#** WebServer Language Support **#

#*******************************************************************#

# en, zh, fr, ja, ko, ru

LANGUAGE=en

#LANGUAGE=zh#*******************************************************************#

# ** PROXY_SERVER (openai interface | chatGPT proxy service), use chatGPT as your LLM.

# ⭐️ 注释掉Ollama之外的PROXY_SERVER_URL

# ** if your server can visit openai, please set PROXY_SERVER_URL=https://api.openai.com/v1/chat/completions

# ** else if you have a chatgpt proxy server, you can set PROXY_SERVER_URL={your-proxy-serverip:port/xxx}

#*******************************************************************#

# PROXY_API_KEY={your-openai-sk}

# PROXY_SERVER_URL=https://api.openai.com/v1/chat/completions# # from https://bard.google.com/ f12-> application-> __Secure-1PSID

# BARD_PROXY_API_KEY={your-bard-token}#*******************************************************************#

# ** PROXY_SERVER + **#

#*******************************************************************## Aliyun tongyi

TONGYI_PROXY_API_KEY={your-tongyi-sk}## Baidu wenxin

#WEN_XIN_MODEL_VERSION={version}

#WEN_XIN_API_KEY={your-wenxin-sk}

#WEN_XIN_API_SECRET={your-wenxin-sct}## Zhipu

#ZHIPU_MODEL_VERSION={version}

#ZHIPU_PROXY_API_KEY={your-zhipu-sk}## Baichuan

#BAICHUN_MODEL_NAME={version}

#BAICHUAN_PROXY_API_KEY={your-baichuan-sk}

#BAICHUAN_PROXY_API_SECRET={your-baichuan-sct}# Xunfei Spark

#XUNFEI_SPARK_API_VERSION={version}

#XUNFEI_SPARK_APPID={your_app_id}

#XUNFEI_SPARK_API_KEY={your_api_key}

#XUNFEI_SPARK_API_SECRET={your_api_secret}## Yi Proxyllm, https://platform.lingyiwanwu.com/docs

#YI_MODEL_VERSION=yi-34b-chat-0205

#YI_API_BASE=https://api.lingyiwanwu.com/v1

#YI_API_KEY={your-yi-api-key}## Moonshot Proxyllm, https://platform.moonshot.cn/docs/

# MOONSHOT_MODEL_VERSION=moonshot-v1-8k

# MOONSHOT_API_BASE=https://api.moonshot.cn/v1

# MOONSHOT_API_KEY={your-moonshot-api-key}## Deepseek Proxyllm, https://platform.deepseek.com/api-docs/

# DEEPSEEK_MODEL_VERSION=deepseek-chat

# DEEPSEEK_API_BASE=https://api.deepseek.com/v1

# DEEPSEEK_API_KEY={your-deepseek-api-key}#*******************************************************************#

#** SUMMARY_CONFIG **#

#*******************************************************************#

SUMMARY_CONFIG=FAST#*******************************************************************#

#** MUlti-GPU **#

#*******************************************************************#

## See https://developer.nvidia.com/blog/cuda-pro-tip-control-gpu-visibility-cuda_visible_devices/

## If CUDA_VISIBLE_DEVICES is not configured, all available gpus will be used

# CUDA_VISIBLE_DEVICES=0

## You can configure the maximum memory used by each GPU.

# MAX_GPU_MEMORY=16Gib#*******************************************************************#

#** LOG **#

#*******************************************************************#

# FATAL, ERROR, WARNING, WARNING, INFO, DEBUG, NOTSET

DBGPT_LOG_LEVEL=INFO

# LOG dir, default: ./logs

#DBGPT_LOG_DIR=#*******************************************************************#

#** API_KEYS **#

#*******************************************************************#

# API_KEYS - The list of API keys that are allowed to access the API. Each of the below are an option, separated by commas.

# API_KEYS=dbgpt#*******************************************************************#

#** ENCRYPT **#

#*******************************************************************#

# ENCRYPT KEY - The key used to encrypt and decrypt the data

# ENCRYPT_KEY=your_secret_key#*******************************************************************#

#** File Server **#

#*******************************************************************#

## The local storage path of the file server, the default is pilot/data/file_server

# FILE_SERVER_LOCAL_STORAGE_PATH =#*******************************************************************#

#** Application Config **#

#*******************************************************************#

## Non-streaming scene retries

# DBGPT_APP_SCENE_NON_STREAMING_RETRIES_BASE=1

## Non-streaming scene parallelism

# DBGPT_APP_SCENE_NON_STREAMING_PARALLELISM_BASE=1#*******************************************************************#

#** Observability Config **#

#*******************************************************************#

## Whether to enable DB-GPT send trace to OpenTelemetry

# TRACER_TO_OPEN_TELEMETRY=False

## Following configurations are only valid when TRACER_TO_OPEN_TELEMETRY=True

## More details see https://opentelemetry-python.readthedocs.io/en/latest/exporter/otlp/otlp.html

# OTEL_EXPORTER_OTLP_TRACES_ENDPOINT=http://localhost:4317

# OTEL_EXPORTER_OTLP_TRACES_INSECURE=False

# OTEL_EXPORTER_OTLP_TRACES_CERTIFICATE=

# OTEL_EXPORTER_OTLP_TRACES_HEADERS=

# OTEL_EXPORTER_OTLP_TRACES_TIMEOUT=

# OTEL_EXPORTER_OTLP_TRACES_COMPRESSION=#*******************************************************************#

#** FINANCIAL CHAT Config **#

#*******************************************************************#

# FIN_REPORT_MODEL=/app/models/bge-large-zh

- 错误排查

E. 运行使用

E.1 启动

python dbgpt/app/dbgpt_server.py

E.2 使用

F. 引文出处的设置

在新版本中,引文出处转移到了应用,通过创建应用绑定知识库,然后在应用里面对话后就会显示出处。

F.1 点击创建应用

F.2 绑定知识库

F.3 选择应用

F.4对话引文查看

相关文章:

240908-结合DBGPT与Ollama实现RAG本地知识检索增强

A. 最终效果 B. 背景说明 DBGPT在0.5.6版本中开始支持Ollama:v0.5.6 版本更新 网友对其Web端及界面端的设置进行了分享: feat(model): support ollama as an optional llm & embedding proxy by GITHUBear Pull Request #1475 eosphoros-ai/DB-G…...

AMD ThinkSystem服务器上的 Linux 和 C 状态设置 - Lenovo ThinkSystem

受影响的配置 该系统可以是以下任何Lenovo服务器: ThinkSystem 、SR645( ThinkSystem )ThinkSystem ,SR645 V3( ThinkSystem )ThinkSystem ,SR635 V3( ThinkSystem )Th…...

Redis过期删除和缓存淘汰

1. 过期删除 在 Redis 中,键的过期删除机制主要包括惰性删除(Lazy Deletion)和定期删除(Periodic Deletion)。这两种策略有各自的优缺点,Redis 最终会结合这两种方法来管理过期键。 1.1 惰性删除…...

Golang | Leetcode Golang题解之第401题二进制手表

题目: 题解: func readBinaryWatch(turnedOn int) (ans []string) {for i : 0; i < 1024; i {h, m : i>>6, i&63 // 用位运算取出高 4 位和低 6 位if h < 12 && m < 60 && bits.OnesCount(uint(i)) turnedOn {ans …...

TON智能合约stdlib_ext库:扩展功能一览

TON(TheOpenNetwork)作为一个去中心化的区块链平台,其智能合约功能强大而灵活。在TON智能合约的开发过程中,stdlib.fc库提供了基础的功能支持。然而,对于一些高级或特定的需求,stdlib.fc可能无法满足。为此…...

LabVIEW开发FPGA方法与FIFO数据丢失处理

开发基于NI 7975R FPGA的系统涉及一系列流程,包括驱动安装、LabVIEW项目设置、开发调试、编译和与Windows系统的通信。重点在于FIFO的正确配置,避免数据丢失是关键环节之一,尤其是在使用高速数据流传输时。以下将详细介绍这些过程,…...

Python中的内存池机制

在Python中,内存管理是一个复杂但至关重要的主题,它直接关系到程序的性能和稳定性。Python的内存管理机制包括对象的分配、追踪以及回收,其中内存池(Memory Pool)是这一机制中的一个重要组成部分。内存池机制通过预先分…...

智能家居系统(基于STM32F103C8T6标准库+FreeRTOS+Qt串口开发实现)

视频演示:基于STM32F103C8T6标准库FreeRTOSQt串口开发实现的智能家居项目_哔哩哔哩_bilibili 基于STM32F103C8T6标准库FreeRTOSQt串口开发实现的智能家居项目: https://pan.baidu.com/s/1f41gAfOOnlcQoKoMx3o84A?pwd6j2g 提取码: 6j2g 注:本项目为学习完…...

[数据集][目标检测]脊椎检测数据集VOC+YOLO格式1137张1类别

数据集格式:Pascal VOC格式YOLO格式(不包含分割路径的txt文件,仅仅包含jpg图片以及对应的VOC格式xml文件和yolo格式txt文件) 图片数量(jpg文件个数):1137 标注数量(xml文件个数):1137 标注数量(txt文件个数):1137 标注…...

大受欢迎的游戏却又意外被作者下架的《Flappy Bird》将重返iPhone

据"Flappy Bird 基金会"官网称,标志性的侧卷轴滚动游戏《Flappy Bird》将很快回归 iPhone。《Flappy Bird》于 2013 年发布,很快就获得了数千万次下载。然而,这款游戏在2014 年突然从 App Store 下架,原因是其越南开发者…...

Flutter类

Dart中的对象都继承自 Object 类,单继承(extend关键字)。Dart与Java、kotlin不同的是其无public、private、protected修饰符,默认public ,通过在属性名、方法名前加 _下划线 来定义是否私有。 实现一个简单的类 class…...

深入解析全连接层:PyTorch 中的 nn.Linear、nn.Parameter 及矩阵运算

文章目录 数学概念(全连接层,线性层)nn.Linear()nn.Parameter()Q1. 为什么 self.weight 的权重矩阵 shape 使用 ( out_features , in_features ) (\text{out\_features}, \text{in\_features}) (out_features,in_features)而不是 ( in_featur…...

缓存对象反序列化失败

未定义serialVersionUID,会自动生成序列化号 新增了属性,序列号就变了,导致缓存对象反序列化失败。 所有缓存对象必须指定序列化id! 那我如何找到未添加字段前 对象的序列化号呢?默认的序列化号是如何生成的呢&#…...

F28335的存储器与寄存器

1 存储器及CMD文件的编写 1 F28335的存储器 1.1 F28335存储器的结构 1.2 F28335存储器的映像 存储器本身不具有地址信息,它的地址是由芯片厂商或用户分配,给存储器分配地址的过程称为存储器映射,如果再分配一个地址就叫重映射。 我们将《tms320f28335 数据手册》中“3.1…...

方面的应用探讨)

Python在AOIP(Audio Over IP)方面的应用探讨

Python在AOIP(Audio Over IP)方面的应用探讨 引言 随着网络技术的发展,音频传输逐渐向基于IP的解决方案迁移。音频通过互联网进行传输被称为音频过IP(Audio Over IP,简称AOIP)。这种技术在广播、现场活动…...

C++20标准对线程库的改进:更安全、更高效的并发编程

引言 C20 是 C 语言的一个重要里程碑,它引入了许多新特性,其中就包括对线程库(thread)的重大改进。这些改进不仅增强了语言的并发编程能力,还解决了先前版本中的一些痛点问题。本文将详细介绍 C20 在线程方面的改进&a…...

外包干了三年,快要废了。。。

先简单说一下自己的情况,普通本科,在外包干了3年多的功能测试,这几年因为大环境不好,我整个人心惊胆战的,怕自己卷铺盖走人了,我感觉自己不能够在这样蹉跎下去了,长时间呆在一个舒适的环境真的会…...

微服务网关终极进化:设计模式驱动的性能与可用性优化(四)

时间:2024年09月12日 作者:小蒋聊技术 邮箱:wei_wei10163.com 微信:wei_wei10 希望大家帮个忙!如果大家有工作机会,希望帮小蒋推荐一下,小蒋希望遇到一个认真做事的团队,一起努力…...

Java中的服务端点日志记录:AOP与SLF4J

Java中的服务端点日志记录:AOP与SLF4J 大家好,我是微赚淘客返利系统3.0的小编,是个冬天不穿秋裤,天冷也要风度的程序猿! 在Java后端服务开发中,日志记录是监控和调试应用的关键手段。通过合理使用AOP&…...

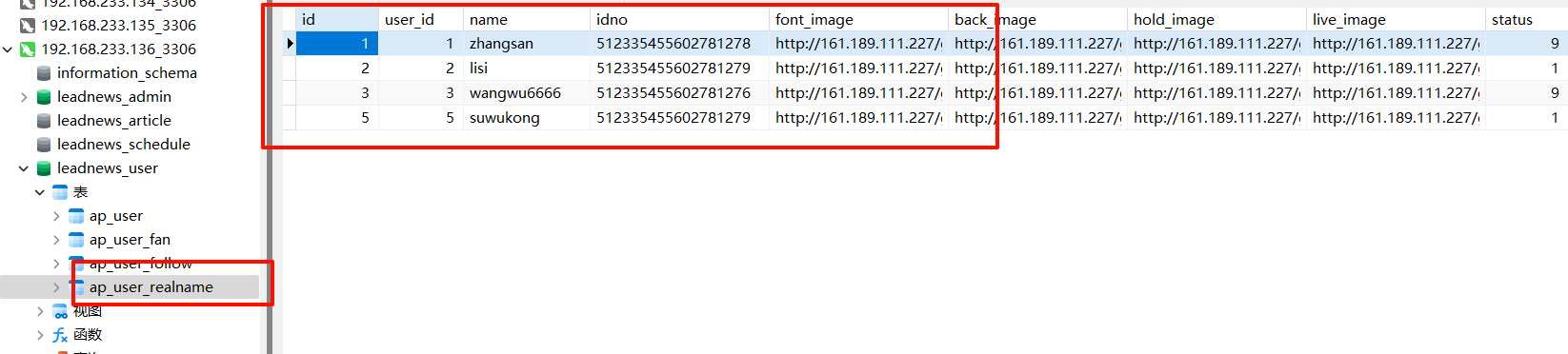

黑马头条第八天实战(上)

D8 1)登录功能需求说明 用户根据用户名和密码登录密码需要手动加盐验证需要返回用户的token和用户信息 2)模块搭建思路步骤 2.1)模块作用 先捋一下之前搭模块干了啥 feign-api 远程调用 自媒体保存时调用远程客户端进行增加文章&#x…...

从Scratch图形化到Python代码:用树莓派给LeArm机械臂做二次开发实战

从Scratch图形化到Python代码:用树莓派给LeArm机械臂做二次开发实战 当Scratch积木块拼接的机械臂动作开始显得单调时,便是时候揭开底层控制的神秘面纱了。本文将带您跨越图形化编程的舒适区,用树莓派的Python环境重新定义LeArm机械臂的智能—…...

一键获取Steam游戏清单:Onekey工具让游戏管理变得如此简单

一键获取Steam游戏清单:Onekey工具让游戏管理变得如此简单 【免费下载链接】Onekey Onekey Steam Depot Manifest Downloader 项目地址: https://gitcode.com/gh_mirrors/one/Onekey 你是否曾为管理Steam游戏文件而烦恼?想备份心爱的游戏却不知从…...

等压雨幕原理在铝合金窗的应用

等压雨幕原理在铝合金窗的应用 摘要: 针对常见的样窗水密气密不达标,首先概述等压雨幕的作用原理,然后介绍其在铝合金门窗应用中的代表性细节。可以看出,控制框扇搭接处的间隙很重要,以及密封胶条合理设计选用的重要性。而且日系推拉采用等压设计的方式很值得借鉴。 关键…...

纯视觉纵深无感管控,落地硐室无人少人化透明值守模式技术白皮书

纯视觉纵深无感管控,落地硐室无人少人化透明值守模式技术白皮书副标题:摒弃井下繁杂传感布设,依靠暗光三维实景重构、深部空间无感感知、盲区跨镜无痕跟踪、身体指纹生物核验,实现井下 24 小时无人值守、全域透明运维前言矿山井下…...

Go语言静态站点生成器Zeuxis:极简架构与高性能构建实践

1. 项目概述:一个轻量级、高性能的静态站点生成器最近在折腾个人博客和文档站点,发现市面上的静态站点生成器虽然多,但要么配置复杂、学习曲线陡峭,要么过于臃肿,启动和构建速度慢得让人抓狂。直到我遇到了bnomei/zeux…...

Rekall:基于时空查询的视频内容智能检索开源框架

1. 项目概述:Rekall,一个面向视频时空查询的开源利器 如果你曾经尝试过从一段长视频里,精准地找出“那个穿红色衣服的人从画面左侧走到右侧的片段”,或者想快速定位“所有出现这只特定宠物狗的镜头”,你就会知道这有多…...

零基础实操:小龙虾 AI OpenClaw 接入 Kimi 详细步骤

前置准备 获取小龙虾open claw一键安装包(www.totom.top)并安装电脑端已成功安装并正常运行OpenClaw客户端,顶部 Gateway 状态保持在线设备网络通畅,可正常访问 Kimi 开放平台拥有可正常登录的 Kimi 月之暗面 Moonshot 账号账号提…...

CircuitPython嵌入式游戏开发:基于TileGrid的迷宫寻蛋与JSON数据持久化实践

1. 项目概述与核心价值如果你和我一样,对嵌入式开发充满热情,同时又对游戏开发抱有好奇心,那么将两者结合——在微控制器上编写一个完整的2D游戏——绝对是一次令人兴奋的挑战。这不仅仅是让LED闪烁或读取传感器数据,而是要在资源…...

Shell脚本加固实战:用shellguard提升脚本健壮性与安全性

1. 项目概述:一个为Shell脚本穿上“防弹衣”的守护者 在运维开发、自动化部署乃至日常的系统管理工作中,Shell脚本是我们最忠实、最高效的伙伴。从简单的日志清理到复杂的CI/CD流水线,Shell脚本无处不在。然而,脚本的安全性、健壮…...

OpenAgentsControl:构建多智能体协同系统的开源框架解析

1. 项目概述:一个面向智能体控制的开放框架最近在折腾AI智能体(Agent)相关的项目,发现一个挺有意思的开源仓库:darrenhinde/OpenAgentsControl。这个项目名字直译过来就是“开放智能体控制”,听起来就很有搞…...