kubernetes中微服务部署

微服务

问:用控制器来完成集群的工作负载,那么应用如何暴漏出去?

答:需要通过微服务暴漏出去后才能被访问

- Service 是一组提供相同服务的Pod对外开放的接口

- 借助Service,应用可以实现服务发现和负载均衡

- Service 默认只支持4层负载均衡能力,没有7层功能,需要借助 Ingress 实现

微服务类型

| 微服务类型 | 作用描述 |

|---|---|

| ClusterIP | 默认值,k8s系统给service自动分配的虚拟IP,只能在集群内部访问 |

| NodePort | 将Service通过指定的Node上的端口暴露给外部,访问任意一个NodeIP:nodePort都将路由到ClusterIP |

| LoadBalancer | 在NodePort的基础上,借助cloud provider创建一个外部的负载均衡器,并将请求转发到 NodeIP:NodePort,此模式只能在云服务器上使用 |

| ExternalName | 将服务通过 DNS CNAME 记录方式转发到指定的域名(通过 spec.externlName 设定 |

用例

[root@k8s-master ~]# kubectl create deployment mini--image myapp:v1 --replicas 2

# 生成控制器文件并建立控制器

[root@k8s-master ~]# kubectl create deployment mini--image myapp:v1 --replicas 2 --dry-run=client -o yaml > mini.yaml

# 生成微服务Yaml追加到已有Yaml中

[root@k8s-master ~]# kubectl expose deployment mini--port 80 --target-port 80 --dry-run=client -o yaml >> mini.yaml

[root@k8s-master ~]# kubectl delete deployments.apps mini

[root@k8s-master ~]# vim mini.yaml

[root@k8s-master ~]# kubectl apply -f mini.yaml

[root@k8s-master ~]# kubectl get service

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 9d

mini ClusterIP 10.104.255.78 <none> 80/TCP 42s

微服务默认使用 iptables 调度

# 可以在火墙中查看到策略信息(一般在底下)

[root@k8s-master ~]# iptables -t nat -nL

...

KUBE-MARK-MASQ 6 -- !10.244.0.0/16 10.104.255.78 /* default/mini cluster IP */ tcp dpt:80

...

IPVS 模式

- Service 是由 kube-proxy 组件,加上 iptables 来共同实现的

- kube-proxy 通过 iptables 处理 Service 的过程,需要在宿主机上设置相当多的 iptables 规则,如果宿主机有大量的Pod,不断刷新iptables规则,会消耗大量的CPU资源

- IPVS模式的service,可以使K8s集群支持更多量级的Pod

IPVS 配置

# 所有节点安装 ipvsadm

dnf install ipvsadm -y

# 修改Master节点的代理配置

[root@k8s-master ~]# kubectl -n kube-system edit cm kube-proxymetricsBindAddress: ""mode: "ipvs"# 设置kube-system使用IPVS模式nftables:

# 当改变配置文件后,已运行的Pod状态不会改变,需要重启Pod

[root@k8s-master ~]# kubectl -n kube-system get pods | awk '/kube-proxy/{system("kubectl -n kube-system delete pods "$1)}'

[root@k8s-master ~]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE

mini-d5496d8f4-75khx 1/1 Running 0 15m 10.244.2.47 k8s-node2.org

mini-d5496d8f4-792mb 1/1 Running 0 15m 10.244.1.70 k8s-node1.org

[root@k8s-master ~]# ipvsadm -Ln

...

TCP 10.104.255.78:80 rr-> 10.244.1.70:80 Masq 1 0 0-> 10.244.2.47:80 Masq 1 0 0

...

切换 IPVS 模式后,kube-proxy会在宿主机上添加一个虚拟网卡:kube-ipvs0,并分配所有service IP

[root@k8s-master ~]# ip a | tail

...inet 10.96.0.10/32 scope global kube-ipvs0valid_lft forever preferred_lft forever

深入微服务类型

ClusterIP

ClusterIP 模式只能在集群内访问,并对集群内的Pod提供健康检测和自动发现功能

ClusterIP 用例

[root@k8s-master ~]# vim mini.yaml

apiVersion: apps/v1

kind: Deployment

metadata:labels:app: mininame: mini

spec:replicas: 2selector:matchLabels:app: minitemplate:metadata:creationTimestamp: nulllabels:app: minispec:containers:- image: myapp:v1name: myapp

---

apiVersion: v1

kind: Service

metadata:labels:app: mininame: mini

spec:ports:- port: 80protocol: TCPtargetPort: 80selector:app: minitype: ClusterIP

# service 创建后 集群DNS 提供解析

[root@k8s-master ~]# dnf install bind-utils -y

[root@k8s-master ~]# dig mini.default.svc.cluster.local @10.96.0.10

...

;; ANSWER SECTION:

mini.default.svc.cluster.local. 30 IN A 10.104.255.78;; Query time: 3 msec

;; SERVER: 10.96.0.10#53(10.96.0.10)

;; WHEN: Wed Oct 09 21:07:57 CST 2024

;; MSG SIZE rcvd: 117

ClusterIP的另一种模式:HeadLess

HeadLess(无头服务)

对于无头 Services 并不会分配 Cluster IP,kube-proxy 不会处理它们, 而且平台也不会为它们进行负载均衡和路由,集群访问通过 DNS 解析直接指向到业务 Pod 上的 IP,所有的调度由 DNS 单独完成

HeadLess 用例

[root@k8s-master ~]# vim mini.yaml

...selector:app: minitype: ClusterIPclusterIP: None

[root@k8s-master ~]# kubectl delete -f mini.yaml

[root@k8s-master ~]# kubectl apply -f mini.yaml

# 测试

[root@k8s-master ~]# kubectl get service mini

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

mini ClusterIP None <none> 80/TCP 18s

[root@k8s-master ~]# dig mini.default.svc.cluster.local @10.96.0.10

# mini.default.svc.cluster.local. 集群DNS

...

;; ANSWER SECTION:

mini.default.svc.cluster.local. 30 IN A 10.244.2.48

# 解析到Pod上

mini.default.svc.cluster.local. 30 IN A 10.244.1.71

...

kubectl get services mini

[root@k8s-master ~]# kubectl run ovo --image busyboxplus -it

/ # nslookup mini

/ # nslookup mini.default.svc.cluster.local.

Server: 10.96.0.10

Address 1: 10.96.0.10 kube-dns.kube-system.svc.cluster.localName: mini.default.svc.cluster.local.

Address 1: 10.244.1.71 10-244-1-71.mini.default.svc.cluster.local

Address 2: 10.244.2.48 10-244-2-48.mini.default.svc.cluster.local

/ # curl mini

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

/ # curl mini/hostname.html

mini-d5496d8f4-228g5

[root@k8s-master ~]# kubectl describe service mini

...

Endpoints: 10.244.1.71:80,10.244.2.48:80

...

NodePort

通过 IPVS 暴漏端口,从而使外部主机通过 Mater 节点的对外 IP:Port 来访问 Pod 业务

访问过程:NodePort ——> ClusterIP ——> Pods

NodePort 用例

[root@k8s-master ~]# vim mini.yaml

...selector:app: minitype: NodePort

[root@k8s-master ~]# kubectl delete -f mini.yaml

[root@k8s-master ~]# kubectl apply -f mini.yaml

[root@k8s-master ~]# kubectl get services mini

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

mini NodePort 10.96.170.18 <none> 80:30835/TCP 3m22s

# nodeport在集群节点上绑定端口,一个端口对应一个服务

[root@k8s-master ~]# kubectl describe service mini

...

NodePort: <unset> 30835/TCP

...

[root@k8s-master ~]# for i in {1..5}

> do

> curl 172.25.254.200:30835/hostname.html

> done

mini-d5496d8f4-cts8s

mini-d5496d8f4-9v24v

mini-d5496d8f4-cts8s

mini-d5496d8f4-9v24v

mini-d5496d8f4-cts8s

NodePort 默认端口是 30000—32767,超出会报错

如果需要使用范围外的端口,就需要特殊设定

vim /etc/kubernetes/manifests/kube-apiserver.yaml

# 需要增加到- command:

- --service-node-port-range=30000-40000

添加 --service-node-port-range= 参数,端口范围可以自定义

修改后 api-server 会自动重启,等 apiserver 正常启动后才能操作集群

集群重启自动完成在修改完参数后,全程不需要人为干预

LoadBalancer

云平台会为我们分配vip并实现访问,如果是裸金属主机那么需要metallb来实现ip的分配

过程:LoadBalancer ——> NodePort ——> ClusterIP ——> Pods

LoadBalancer 用例

[root@k8s-master ~]# vim mini.yaml

...selector:app: minitype: LoadBalancer

[root@k8s-master ~]# kubectl delete -f mini.yaml

[root@k8s-master ~]# kubectl apply -f mini.yaml

# 默认无法分配外部访问IP

[root@k8s-master ~]# kubectl get svc mini

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

mini LoadBalancer 10.102.105.5 <pending> 80:31759/TCP 18s

LoadBalancer 模式适用云平台,裸金属环境需要安装 MetalLB提供支持

MetalLB

官网:https://metallb.universe.tf/installation/

MetalLB功能:为 LoadBalancer 分配 VIP

MetalLB 配置

# 设置 IPVS 模式

[root@k8s-master ~]# kubectl edit cm -n kube-system kube-proxy

...metricsBindAddress: ""mode: "ipvs"ipvs:strictARP: true

...

[root@k8s-master ~]# kubectl -n kube-system get pods | awk '/kube-proxy/{system("kubectl -n kube-system delete pods "$1)}'

# 下载部署文件

[root@k8s-master ~]# dnf install wget -y

[root@k8s-master ~]# wget https://raw.githubusercontent.com/metallb/metallb/v0.13.12/config/manifests/metallb-native.yaml

# 修改文件镜像拉取地址(配置好Docker拉取镜像默认地址)

...

image: metallb/controller:v0.14.8

...

image: metallb/speaker:v0.14.8

...

# 上传镜像到harbor仓库

[root@k8s-master ~]# docker pull quay.io/metallb/controller:v0.14.8

[root@k8s-master ~]# docker pull quay.io/metallb/speaker:v0.14.8

[root@k8s-master ~]# docker tag quay.io/metallb/speaker:v0.14.8 ooovooo.org/metallb/speaker:v0.14.8

[root@k8s-master ~]# docker tag quay.io/metallb/controller:v0.14.8 ooovooo.org/metallb/controller:v0.14.8

[root@k8s-master ~]# docker push ooovooo.org/metallb/speaker:v0.14.8

[root@k8s-master ~]# docker push ooovooo.org/metallb/controller:v0.14.8

# 部署服务

[root@k8s-master ~]# kubectl apply -f metallb-native.yaml

[root@k8s-master ~]# kubectl -n metallb-system get pods

NAME READY STATUS RESTARTS AGE

controller-65957f77c8-c9lrv 1/1 Running 0 23s

speaker-5g4hz 1/1 Running 0 23s

speaker-bw4qh 1/1 Running 0 23s

speaker-t7d7f 1/1 Running 0 23s

# 配置分配地址段

[root@k8s-master ~]# vim configmap.yml

apiVersion: metallb.io/v1beta1

kind: IPAddressPool

metadata:name: name# 地址池名称namespace: metallb-system

spec:addresses:- 172.25.254.25-172.25.254.50# 地址池段

---

# 不同的kind之间使用---分割

apiVersion: metallb.io/v1beta1

kind: L2Advertisement

metadata:name: examplenamespace: metallb-system

spec:ipAddressPools:- name# 使用的地址池

[root@k8s-master ~]# kubectl apply -f configmap.yml

[root@k8s-master ~]# kubectl get services mini

# 自动分配IP

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

mini LoadBalancer 10.102.105.5 172.25.254.25 80:31759/TCP 62m

# 通过分配地址从集群外访问服务

[root@k8s-master ~]# curl 172.25.254.25

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>ExternalName

- 开启 services 后,不会被分配 IP,而是用 DNS 解析 CNAME 固定域名来解决 IP 变化问题

- 一般应用于外部业务和 Pod 沟通或外部业务迁移到 Pod 内时

- 在应用向集群迁移过程中,ExternalName在过度阶段就可以起作用了

- 集群外的资源迁移到集群时,在迁移的过程中 IP 可能会变化,但是 域名+DNS解析 能完美解决此问题

ExternalName 用例

[root@k8s-master ~]# vim mini.yaml

...selector:app: minitype: ExternalNameexternalName: www.mini.org

[root@k8s-master ~]# kubectl delete -f mini.yaml

[root@k8s-master ~]# kubectl apply -f mini.yaml

[root@k8s-master ~]# kubectl get services mini

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

mini ExternalName <none> www.mini.org 80/TCP 5s

Ingress-Nginx

官网:https://kubernetes.github.io/ingress-nginx/deploy/#bare-metal-clusters

Ingress-Nginx 功能

- 一种全局的、为了代理不同后端 Service 而设置的负载均衡服务,支持7层

- Ingress由两部分组成:Ingress controller和Ingress服务

- Ingress Controller 会根据你定义的 Ingress 对象,提供对应的代理能力

部署 Ingress

[root@k8s-master ~]# mkdir ingress

[root@k8s-master ~]# cd ingress/

# 下载部署文件

[root@k8s-master ingress]# wget https://raw.githubusercontent.com/kubernetes/ingress-nginx/controller-v1.11.2/deploy/static/provider/baremetal/deploy.yaml

# 还要下载ingress-nginx的镜像

# 上传镜像到harbor

[root@k8s-master ~]# docker tag reg.harbor.org/ingress-nginx/controller:v1.11.2 ooovooo.org/ingress-nginx/controller:v1.11.2

[root@k8s-master ~]# docker tag reg.harbor.org/ingress-nginx/kube-webhook-certgen:v1.4.3 ooovooo.org/ingress-nginx/kube-webhook-certgen:v1.4.3

[root@k8s-master ~]# docker push ooovooo.org/ingress-nginx/controller:v1.11.2

[root@k8s-master ~]# docker push ooovooo.org/ingress-nginx/kube-webhook-certgen:v1.4.3

# 安装Ingress

[root@k8s-master ~]# vim deploy.yaml

...

image: ingress-nginx/controller:v1.11.2

...

image: ingress-nginx/kube-webhook-certgen:v1.4.3

...

image: ingress-nginx/kube-webhook-certgen:v1.4.3

[root@k8s-master ingress]# kubectl apply -f deploy.yaml

[root@k8s-master ingress]# kubectl -n ingress-nginx get pods

# 一开始可能会有一个error,删掉再加载就好了

NAME READY STATUS RESTARTS AGE

ingress-nginx-admission-create-w6jz9 0/1 Completed 0 14s

ingress-nginx-admission-patch-bbsn6 0/1 Completed 1 14s

ingress-nginx-controller-bb7d8f97c-nx96n 1/1 Running 0 14s

# ingress-nginx-controller 1/1 Running 即运行成功

[root@k8s-master ~]# kubectl -n ingress-nginx get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

ingress-nginx-controller NodePort 10.100.33.214 <none> 80:32416/TCP,443:30320/TCP 30s

ingress-nginx-controller-admission ClusterIP 10.98.75.102 <none> 443/TCP 30s

# 修改微服务为loadbalancer

[root@k8s-master ~]# kubectl -n ingress-nginx edit svc ingress-nginx-controller

...

49 type: LoadBalancer

# 查看修改结果

[root@k8s-master ~]# kubectl -n ingress-nginx get services

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S)

# 需要配置有 MetalLB

ingress-nginx-controller LoadBalancer 10.100.33.214 172.25.254.25 80:32416/TCP,443:30320/TCP

ingress-nginx-controller-admission ClusterIP 10.98.75.102 <none> 443/TCP

在 kubectl -n ingress-nginx get services 中 的 EXTERNAL-IP

即 Ingress 最终对外的 IP

测试 Ingress

[root@k8s-master ingress]# kubectl create deployment myappv1 --image myapp:v1 --dry-run=client -o yaml > myappv1.yml

[root@k8s-master ingress]# kubectl apply -f myappv1.yml

[root@k8s-master ingress]# kubectl expose deployment myappv1 --port 80 --target-port 80 --dry-run=client -o yaml >> myappv1.yml

[root@k8s-master ingress]# vim myappv1.yml

apiVersion: apps/v1

kind: Deployment

metadata:labels:app: myappv1name: myappv1

spec:replicas: 1selector:matchLabels:app: myappv1strategy: {}template:metadata:labels:app: myappv1spec:containers:- image: myapp:v1name: myapp

---

apiVersion: v1

kind: Service

metadata:labels:app: myappv1name: myappv1

spec:ports:- port: 80protocol: TCPtargetPort: 80selector:app: myappv1

kubectl apply -f myappv1.yml

kubectl create ingress webcluster --rule '*/=ooovooo-svc:80' --dry-run=client -o yaml > ingress.yml

[root@k8s-master ingress]# vim ingress.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:name: myappv1

spec:ingressClassName: nginxrules:- http:paths:- backend:service:name: myappv1# 与自己的服务名保持一致port:number: 80path: /pathType: Prefix# Exact(精确匹配)# ImplementationSpecific(特定实现)# Prefix(前缀匹配)# Regular expression(正则表达式匹配)

# 建立Ingress控制器

kubectl apply -f ingress.yml

# 根据kubectl -n ingress-nginx get services中的IP进行访问

[root@k8s-master ingress]# curl 172.25.254.25

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

Ingress 必须和输出的 service 资源处于同一 namespace 中

Ingress 高级用法

基于路径的访问

[root@k8s-master ingress]# vim ingress1.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:nginx.ingress.kubernetes.io/rewrite-target: /name: ingress1

spec:ingressClassName: nginxrules:- host: www.ooovooo.orghttp:paths:- backend:service:name: myappv1port:number: 80path: /v1pathType: Prefix- backend:service:name: myappv2port:number: 80path: /v2pathType: Prefix

[root@k8s-master ingress]# kubectl apply -f ingress1.yml

[root@k8s-master ingress]# echo 172.25.254.25 www.ooovooo.org >> /etc/hosts

[root@k8s-master ingress]# curl www.ooovooo.org/v1

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

[root@k8s-master ingress]# curl www.ooovooo.org/v2

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

[root@k8s-master ingress]# curl www.ooovooo.org/v2/haha

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

[root@k8s-master ingress]# curl www.ooovooo.org/v1/gaga

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

基于域名的访问

[root@k8s-master ingress]# vim ingress2.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:nginx.ingress.kubernetes.io/rewrite-target: /name: ingress2

spec:ingressClassName: nginxrules:- host: myappv1.ooovooo.orghttp:paths:- backend:service:name: myappv1port:number: 80path: /pathType: Prefix- host: myappv2.ooovooo.orghttp:paths:- backend:service:name: myappv2port:number: 80path: /pathType: Prefix

[root@k8s-master ingress]# kubectl apply -f ingress2.yml

[root@k8s-master ingress]# kubectl delete -f ingress1.yml

[root@k8s-master ingress]# kubectl describe ingress ingress2

...Host Path Backends---- ---- --------myappv1.ooovooo.org/ myappv1:80 (10.244.1.89:80)myappv2.ooovooo.org/ myappv2:80 (10.244.1.90:80)

[root@k8s-master ingress]# curl myappv1.ooovooo.org

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

[root@k8s-master ingress]# curl myappv2.ooovooo.org

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

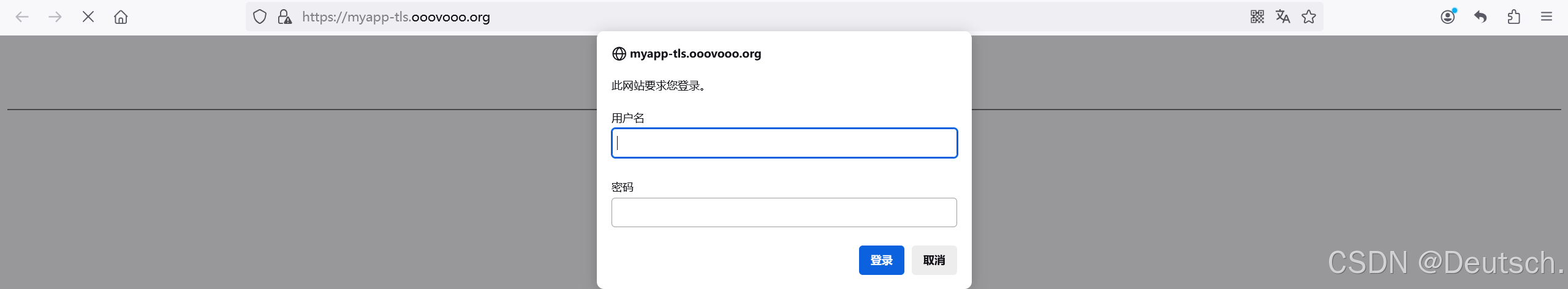

建立 TLS 加密

[root@k8s-master ingress]# openssl req -newkey rsa:2048 -nodes -keyout tls.key -x509 -days 365 -subj "/CN=nginxsvc/O=nginxsvc" -out tls.crt

[root@k8s-master ingress]# kubectl create secret tls web-tls-secret --key tls.key --cert tls.crt

[root@k8s-master ingress]# vim ingress3.yml

[root@k8s-master ingress]# echo 172.25.254.25 myapp-tls.ooovooo.org >> /etc/hosts

[root@k8s-master ingress]# kubectl apply -f ingress3.yml

[root@k8s-master ingress]# kubectl delete -f ingress2.yml

# 在Windows主机添加解析,并进行访问

建立 AUTH 认证

[root@k8s-master ingress]# vim ingress4.yml

[root@k8s-master ingress]# kubectl delete -f ingress3.yml

[root@k8s-master ingress]# kubectl apply -f ingress4.yml

[root@k8s-master ingress]# kubectl describe ingress ingress4

...

TLS:web-tls-secret terminates myapp-tls.ooovooo.org

...myapp-tls.ooovooo.org/ myappv1:80 (10.244.1.89:80)

...

[root@k8s-master ingress]# curl -k https://myapp-tls.ooovooo.org

<html>

<head><title>401 Authorization Required</title></head>

<body>

<center><h1>401 Authorization Required</h1></center>

<hr><center>nginx</center>

</body>

</html>

[root@k8s-master ingress]# curl -k https://myapp-tls.ooovooo.org -u ovo:aaa

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

# Windows主机访问同样需要登录

Rewrite 重定向

# 将指定访问文件重定向到hostname.html上

[root@k8s-master ingress]# vim ingress5.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:nginx.ingress.kubernetes.io/app-root: /hostname.htmlname: ingress5

spec:ingressClassName: nginxrules:- host: myapp-tls.ooovooo.orghttp:paths:- backend:service:name: myappv1port:number: 80path: /# 当访问/时,重定向到hostname.htmlpathType: Prefix

[root@k8s-master ingress]# kubectl delete -f ingress4.yml

[root@k8s-master ingress]# kubectl apply -f ingress5.yml

[root@k8s-master ingress]# curl -Lk https://myapp-tls.ooovooo.org -u ovo:aaa

myappv1-586444467f-w4dxn

[root@k8s-master ingress]# curl -Lk https://myapp-tls.ooovooo.org/haha/hostname.html -u ovo:aaa

<html>

<head><title>404 Not Found</title></head>

<body bgcolor="white">

<center><h1>404 Not Found</h1></center>

<hr><center>nginx/1.12.2</center>

</body>

</html>

# 以上存在一个问题,当有多路径时需要重定向时,需要配置多个,费人力

# 正则解决指定路径问题

[root@k8s-master ingress]# vim ingress6.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:nginx.ingress.kubernetes.io/rewrite-target: /$2nginx.ingress.kubernetes.io/use-regex: "true"name: ingress6

spec:ingressClassName: nginxrules:- host: myapp-tls.ooovooo.orghttp:paths:- backend:service:name: myapp-v1port:number: 80path: /pathType: Prefix- backend:service:name: myappv1port:number: 80path: /haha(/|$)(.*)pathType: ImplementationSpecific

[root@k8s-master ingress]# kubectl delete -f ingress5.yml

[root@k8s-master ingress]# kubectl apply -f ingress6.yml

[root@k8s-master ingress]# curl -Lk https://myapp-tls.ooovooo.org/haha/hostname.html -u ovo:aaa

myappv1-586444467f-w4dxn

Canary 金丝雀发布

金丝雀发布(Canary Release)也称为灰度发布,是一种软件发布策略

主要目的是在将新版本的软件全面推广到生产环境之前,先在一小部分用户或服务器上进行测试和验证,以降低因新版本引入重大问题而对整个系统造成的影响,是一种 Pod 的发布方式

金丝雀发布采取先添加、再删除的方式,保证Pod的总量不低于期望值。并且在更新部分Pod后,暂停更新,当确认新Pod版本运行正常后再进行其他版本的Pod的更新

发布方式

Header > Cookie > Weiht

其中 Header 和 Weiht 中的最多

基于Header (HTTP包头)灰度

- 通过Annotaion扩展

- 创建灰度 Ingress,配置灰度头部 key 以及 value

- 灰度流量验证完毕后,切换正式 Ingress 到新版本

- 之前我们在做升级时可以通过控制器做滚动更新,默认25%利用Header 可以使升级更为平滑,通过 key 和 value 测试新的业务体系是否有问题

# 创建版本v1的ingress

[root@k8s-master ingress]# kubectl delete -f ingress6.yml

[root@k8s-master ingress]# vim ingress7.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:name: myapp-v1-ingress

spec:ingressClassName: nginxrules:- host: myapp-tls.ooovooo.orghttp:paths:- backend:service:name: myappv1port:number: 80path: /pathType: Prefix

[root@k8s-master ingress]# kubectl apply -f ingress7.yml

# 建立基于header的ingress

[root@k8s-master ingress]# vim ingress8.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:nginx.ingress.kubernetes.io/canary: "true"nginx.ingress.kubernetes.io/canary-by-header: "version"nginx.ingress.kubernetes.io/canary-by-header-value: "2"name: myapp-v2-ingress

spec:ingressClassName: nginxrules:- host: myapp-tls.ooovooo.orghttp:paths:- backend:service:name: myappv2port:number: 80path: /pathType: Prefix

[root@k8s-master ingress]# kubectl apply -f ingress8.yml

# 进行测试

[root@k8s-master ingress]# curl myapp-tls.ooovooo.org

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

[root@k8s-master ingress]# curl -H "version: 2" myapp-tls.ooovooo.org

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>基于权重的灰度发布

- 通过 Annotaion 拓展

- 创建灰度 Ingress,配置灰度权重以及总权重

- 灰度流量验证完毕后,切换正式 Ingress 到新版本

[root@k8s-master ingress]# vim ingress9.yml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:annotations:nginx.ingress.kubernetes.io/canary: "true"nginx.ingress.kubernetes.io/canary-weight: "10"# 灰度权重nginx.ingress.kubernetes.io/canary-weight-total: "100"# 总权重name: myapp-v2-ingress

spec:ingressClassName: nginxrules:- host: myapp-tls.ooovooo.orghttp:paths:- backend:service:name: myappv2port:number: 80path: /pathType: Prefix

[root@k8s-master ingress]# kubectl delete -f ingress8.yml

[root@k8s-master ingress]# kubectl apply -f ingress9.yml

[root@k8s-master ingress]# vim check_ingress.sh

#!/bin/bash

v1=0

v2=0for (( i=0; i<100; i++))

doresponse=`curl -s myapp-tls.ooovooo.org |grep -c v1`v1=`expr $v1 + $response`v2=`expr $v2 + 1 - $response`done

echo "v1:$v1, v2:$v2"

[root@k8s-master ingress]# chmod +x check_ingress.sh

[root@k8s-master ingress]# sh check_ingress.sh

v1:89, v2:11

# 根据不同灰度权重而不同

相关文章:

kubernetes中微服务部署

微服务 问:用控制器来完成集群的工作负载,那么应用如何暴漏出去? 答:需要通过微服务暴漏出去后才能被访问 Service 是一组提供相同服务的Pod对外开放的接口借助Service,应用可以实现服务发现和负载均衡Service 默认只…...

基于 Java 的天气预报系统设计与实现

随着互联网的飞速发展,天气预报系统变得越来越重要。它可以帮助用户了解未来几天的天气情况,便于出行、活动安排。本文将介绍如何使用 Java 构建一个简单的天气预报系统,涉及系统架构设计、核心功能开发以及完整的代码实现。 1. 系统架构设计…...

思迅商云8前台打开提示上传日志信息失败

请按照以下步骤核实处理: 1、重启sql服务后测试。 2、请先备份前台安装目录,之后删除安装目录下的log文件和localdate下的log文件,之后重新打开软件,若依旧不行则说明前台文件有损坏,需要重新安装客户端,…...

)

webstorm的缩进设置(过度缩进解释)

在编写前端代码时 缩进规范一般被认为是2个空格 而非默认的4个空格 当我们通过webstorm去编写前端代码时 我们可以通过setting->Code Style->html/css/js指定的界面中去设置tab/indent/continuation indent 具体的话 我们将html/css/js操作界面中的tab/indent设置为2个空…...

与ZoomEye功能类似的搜索引擎还有哪些?(渗透课作业)

与ZoomEye功能类似的搜索引擎有: Shodan:被誉为“物联网的搜索引擎”,专注于扫描和索引连接到互联网的各种设备,如智能家居设备、工业控制系统、摄像头、数据库等。它提供全球互联网设备的可视化视图,帮助用户了解网络…...

Java 计数排序

计数排序(Counting Sort)是一种非比较型排序算法,适用于一定范围内的整数排序。它的基本思想是通过计数输入元素中每个值出现的次数,然后计算每个值的起始位置,最终将元素放到正确的位置上。计数排序的时间复杂度为 O(…...

error: RPC failed; curl 16 Error in the HTTP2 framing layer

yschai@LAPTOP-F2L146JK:~$ git clone https://github.com/Chyusen/yschai.git Cloning into ‘yschai’… error: RPC failed; curl 16 Error in the HTTP2 framing layer fatal: expected flush after ref listing 使用Ubuntu在git clone github上的项目的时候,遇到以上报错…...

Python脚本分类和代码举例

Python是一种强大且灵活的编程语言,被广泛应用于数据分析、Web开发、自动化、人工智能等领域。在不同的应用场景下,Python脚本可以被分类为多种类型。本文将深入分析Python脚本的分类,同时提供相关代码示例,帮助读者理解和应用这些…...

)

【Redis十二】Redis的典型应用(缓存和分布式锁)

目录 Redis作为缓存 1.什么是缓存? 2.缓存的更新策略 3.缓存预热,缓存穿透,缓存雪崩和缓存击穿 Redis作为分布式锁 1.什么是分布式锁? 2.分布式锁的实现过程 Redis是目前后端开发中非常热门的组件之一,本篇文章…...

C++入门基础知识107—【关于C++continue 语句】

成长路上不孤单😊😊😊😊😊😊 【14后😊///C爱好者😊///持续分享所学😊///如有需要欢迎收藏转发///😊】 今日分享关于C continue 语句的相关内容!…...

【AI大模型】《多模态持续学习》最新进展综述

摘要—持续学习(CL)旨在使机器学习模型能够从新数据中不断学习,同时在不遗忘已获得知识的基础上进行扩展。随着机器学习模型从小规模到大规模预训练架构的演变,以及从支持单一模态数据到支持多模态数据,多模态持续学习…...

大厂面试真题-CPU飙升问题怎么定位

CPU使用率飙升是开发者和系统管理员常遇到的问题,定位CPU飙升问题通常涉及以下步骤: 一、使用系统监控工具 查看CPU使用图表:利用任务管理器(Windows系统)或top、htop(Linux系统)等工具&#…...

【每日刷题】Day137

【每日刷题】Day137 🥕个人主页:开敲🍉 🔥所属专栏:每日刷题🍍 🌼文章目录🌼 1. 1576. 替换所有的问号 - 力扣(LeetCode) 2. 495. 提莫攻击 - 力扣…...

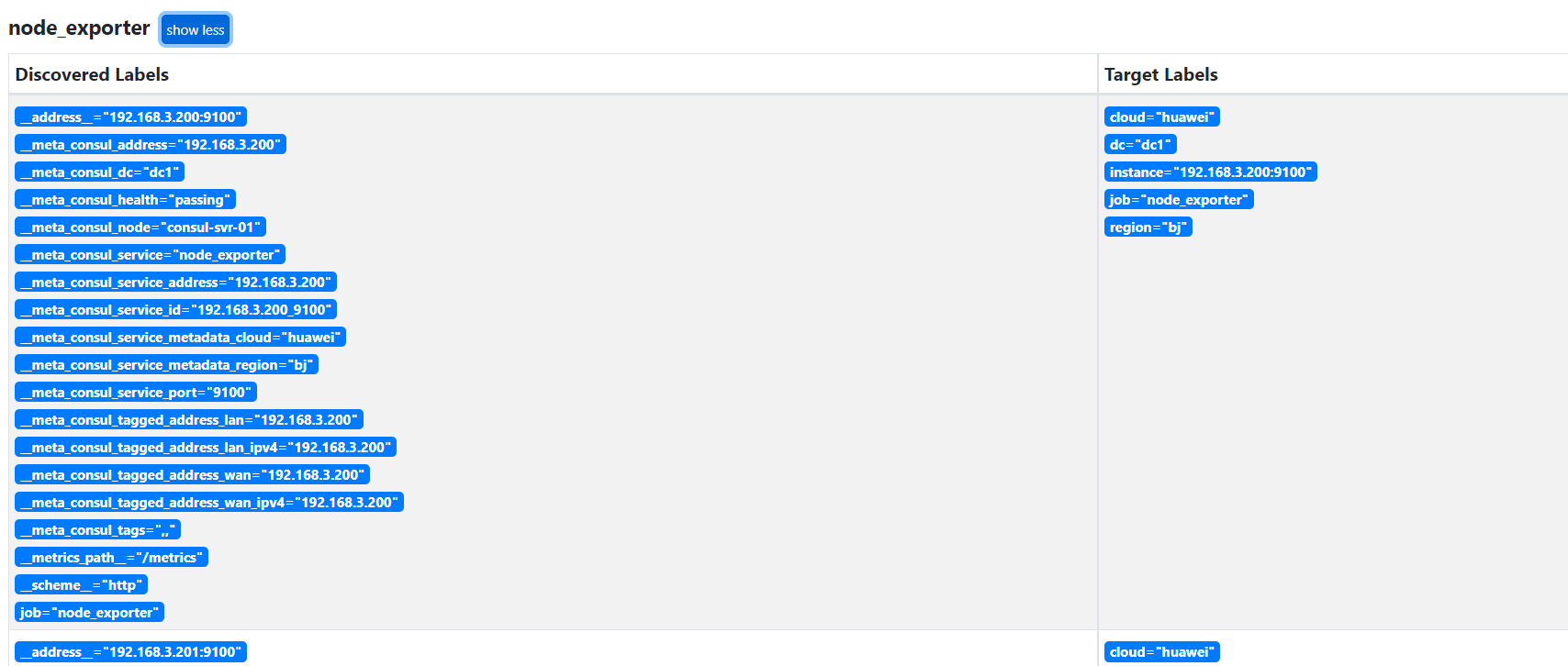

24.4 基于consul服务发现模式

本节重点介绍 : consul 安装consul go代码注册服务,注销服务,获取服务node_exporter改造为consul服务发现在数量比较大时,在注册服务的时候,关闭check,可以降低consul的压力 consul 安装 准备工作 # 下载consul wge…...

[红队apt]快捷方式病毒攻击流程

免责声明:本文整理攻击者操作,帮助了解攻击原理,提高防范能力 前言 欢迎来到我的博客 个人主页:北岭敲键盘的荒漠猫-CSDN博客 本文整理攻击者是如何用快捷方式进行攻击的流程 快捷方式攻击原理 快捷方式可以指向执行某个程序。 我们利用快捷方式攻击的…...

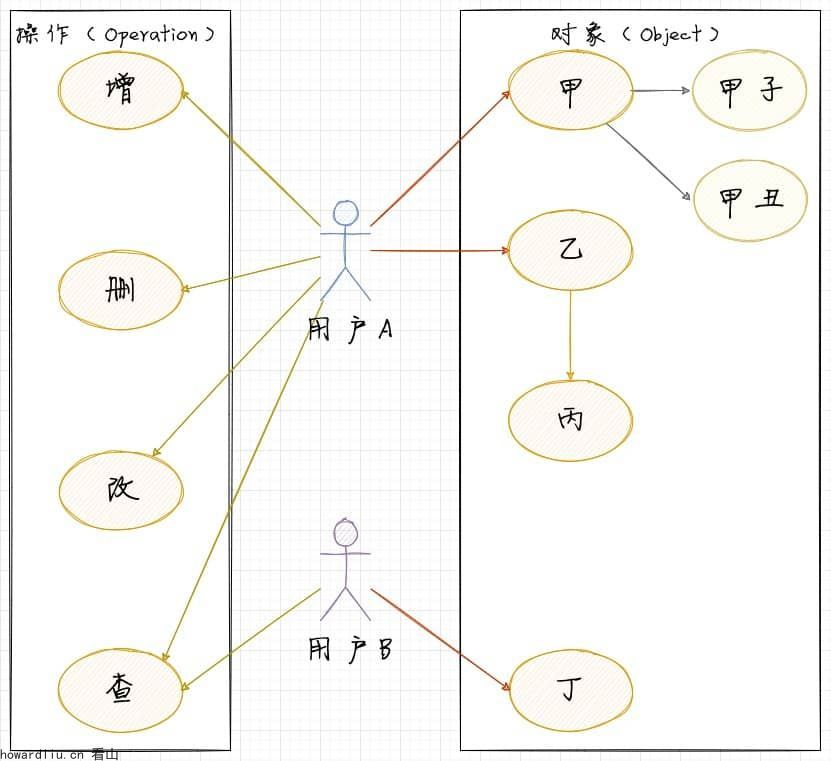

一个架构师的职业素养:四种常用的权限模型

你好,我是看山。 本文收录在《一个架构师的职业素养》专栏。日拱一卒,功不唐捐。 今天咱们一起聊聊权限系统。 以大家熟知的电商场景举例: 用户可以分为普通用户、VIP用户:我们需要控制不同角色用户的访问范围。比如,京东的PLUS会员,可以进入会员专区,而且能够使用礼金…...

说起来很简单,做起来很复杂:解密Chat GPT背后的原理与技术

你或许已经体验过ChatGPT,它能快速回答各种问题,生成文案、编写代码,甚至陪你聊些有趣的话题。看似简单易用,背后却隐藏着强大的技术支持。 输入几句话,ChatGPT仿佛“理解”了你的问题,立即给出准确的回答…...

tcpdump-arm平台移植

准备工作 下载并解压 972 mkdir tcpdump973 cd tcpdump/974 ls975 wget https://www.tcpdump.org/release/tcpdump-4.99.5.tar.xz976 wget https://www.tcpdump.org/release/libpcap-1.10.5.tar.xz977 tar -xvf libpcap-1.10.5.tar.xz978...

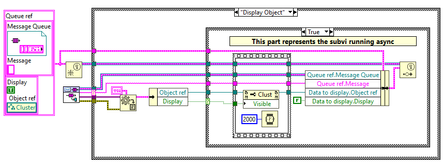

LabVIEW中的非阻塞定时器

在LabVIEW编程中,通常需要在某些任务执行过程中进行非阻塞的延时操作。例如,显示某条信息一段时间,同时继续执行其他任务,并在延时时间结束后停止显示该信息。这类需求通常用于处理优先级不同的信息显示,如错误信息需要…...

MIDIPLUS 50周年丨中国国际乐器展览会首日盛况

10月10日,由中国乐器协会、上海国展展览中心有限公司、法兰克福展览(上海)有限公司共同主办的中国(上海)国际乐器展览会在上海新国际博览中心(上海市浦东新区龙阳路2345号)盛大开幕。 2024上海…...

)

别再手动写代码了!用Coze工作流的Code节点,让AI帮你搞定Python/JS脚本(附IDE调试技巧)

解放双手:用Coze工作流Code节点实现智能编码全攻略 在代码的世界里,我们常常陷入重复劳动的泥潭——那些格式固定的API调用、千篇一律的数据处理、周而复始的脚本编写。有没有一种方式,能让我们从这些机械性编码中解脱出来,把创造…...

从“会响”到“可靠”:给这个经典12V降5V电路加个二极管和电容,稳定性提升不止一点点

从“会响”到“可靠”:经典12V降5V电路的稳定性优化实战 当你在面包板上搭建好那个经典的稳压管NPN降压电路,看着万用表显示稳定的5V输出时,或许会感到一丝成就感。但当你接上负载,发现电压开始波动,或者在电源反接时闻…...

电弧故障检测与定位片上系统【附程序】

✨ 长期致力于电弧故障采集、电弧故障检测、电弧故障定位、片上系统、全数字锁相环、逐次逼近型模数转换器、低功耗、低成本研究工作,擅长数据搜集与处理、建模仿真、程序编写、仿真设计。 ✅ 专业定制毕设、代码 ✅ 如需沟通交流,点击《获取方式》 &…...

别再只用箱线图了!用R语言ggplot2绘制高颜值小提琴图,让你的SCI图表更专业

科研数据可视化进阶:用R语言打造专业级小提琴图 在生物医学领域的科研论文中,数据可视化是展示研究成果的关键环节。许多研究者习惯性地使用箱线图来呈现数据分布,却忽略了这种传统方法可能掩盖的重要信息细节。当面对复杂的数据分布模式时&…...

如何用Path of Building物品制作系统打造终极装备:5个简单步骤

如何用Path of Building物品制作系统打造终极装备:5个简单步骤 【免费下载链接】PathOfBuilding Offline build planner for Path of Exile. 项目地址: https://gitcode.com/gh_mirrors/pat/PathOfBuilding 你是否曾为《流放之路》中装备制作耗费大量通货却得…...

)

Spring AI 快速对接 AI 大模型(开箱即用)

一、项目准备(最简依赖)1. 创建 Spring Boot 项目推荐版本:Spring Boot 3.2.x JDK 版本:172. pom.xml 核心依赖<?xml version"1.0" encoding"UTF-8"?> <project xmlns"http://maven.apache.o…...

电力线路保护原理与整定计算实战解析:从电流、距离到差动保护

1. 项目概述:从“黑匣子”到“透明逻辑”在电力系统这个庞大而精密的网络中,输电线路如同人体的动脉血管,承担着输送能量的核心使命。然而,这条“动脉”时刻面临着雷击、外力破坏、绝缘老化、过负荷等各类风险的威胁。一旦发生故障…...

亚马逊英国站儿童挤压玩具

亚马逊英国站儿童挤压玩具,核心定位为3岁以上儿童设计的感官类玩具,主打触觉反馈与手部精细动作锻炼,是平台上受众较广的儿童玩具品类之一,其核心特点与平台合规要求需重点关注。产品核心特征方面,这类玩具多采用热塑性…...

企业级应用如何通过Taotoken实现API Key的精细化管理与审计

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 企业级应用如何通过Taotoken实现API Key的精细化管理与审计 在构建基于大模型的企业级应用时,API Key的管理与安全审计…...

灰度发布与流量切换

Skeyevss FAQ:灰度发布与流量切换 试用安装包下载 | SMS | 在线演示 项目地址:https://github.com/openskeye/go-vss 1. 目标 新版本 先小流量验证,指标正常再全量;出问题 快速回滚。对 SIP 类系统,还要考虑 会话粘…...