HBase Flink操作

Apache Flink 是一个开源的分布式流处理框架,能够高效地处理和分析实时数据流以及批数据。HBase 是一个分布式、面向列的开源数据库,是 Hadoop 项目的子项目,适合非结构化数据结构的存储,并提供实时读写能力。以下是关于 Flink 对 HBase 的操作原理以及流处理和批处理的示例:

Flink 对 HBase 的操作原理

Flink 通过其丰富的 connectors 生态系统,可以方便地与 HBase 进行集成。操作原理主要基于以下几点:

- 连接器(Connector):Flink 提供了对 HBase 的连接器,允许 Flink 任务直接读写 HBase 表。这些连接器通常封装了 HBase 客户端的复杂性,使得 Flink 任务可以像操作普通数据源一样操作 HBase。

- 数据流模型:Flink 使用数据流模型来处理数据。在读取 HBase 数据时,Flink 会将数据从 HBase 表中拉取到 Flink 任务中,并转换为 Flink 的数据流。在写入 HBase 数据时,Flink 会将处理后的数据流写回到 HBase 表中。

- 并行处理:Flink 支持并行处理,可以处理大量的并发请求。当 Flink 任务与 HBase 进行交互时,可以利用 HBase 的分布式架构和并行处理能力,提高数据处理的吞吐量。

Flink可以通过其强大的数据处理能力,与HBase这样的分布式数据库进行交互。在Flink中,可以通过配置和编写相应的代码,实现对HBase的读写操作。

- 写操作:

- 在Flink中,可以通过创建多个HTable客户端用于写操作,以提高写数据的吞吐量。

- 可以通过设置HTable客户端的写缓存大小和自动刷新(AutoFlush)参数,来优化写性能。例如,关闭自动刷新可以批量写入数据到HBase,而不是每有一条数据就执行一次更新。

- 可以通过调用HTable的put方法,将一个指定的row key记录写入HBase,或者通过调用put(List)方法批量写入多行记录。

- 读操作:

- Flink可以从HBase中读取数据,通常是通过配置相应的Source连接器来实现的。

- 读取的数据可以在Flink的流处理或批处理任务中进行进一步的处理和分析。

流处理示例

以下是一个简单的 Flink 流处理示例,演示如何从 Kafka 读取数据流,经过处理后写入 HBase:

// 引入必要的依赖和包

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaConsumer;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.connector.hbase.FlinkHBaseOutputFormat;

import org.apache.flink.connector.hbase.HBaseConfigurationUtil;

import org.apache.flink.connector.hbase.HBaseConnectionOptions;

import org.apache.flink.connector.hbase.table.HBaseTableSchema;

import org.apache.flink.types.Row;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.client.Put;

import org.apache.hadoop.hbase.util.Bytes;// 配置 Kafka 消费者

Properties properties = new Properties();

properties.setProperty("bootstrap.servers", "localhost:9092");

properties.setProperty("group.id", "flink-consumer-group");

FlinkKafkaConsumer<String> kafkaConsumer = new FlinkKafkaConsumer<>("your-kafka-topic", new SimpleStringSchema(), properties);// 创建 Flink 执行环境

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();// 添加 Kafka 消费者到数据流

DataStream<String> stream = env.addSource(kafkaConsumer);// 对数据流进行处理(例如,解析 JSON 或进行字符串处理)

DataStream<Row> processedStream = stream.map(data -> {// 假设数据是一个 JSON 字符串,这里进行简单的解析// 实际上应该使用 JSON 解析库来解析String[] parts = data.split(",");return Row.of(parts[0], parts[1], parts[2]); // 假设有三个字段

});// 配置 HBase 连接和表信息

Configuration hbaseConf = HBaseConfiguration.create();

hbaseConf.set("hbase.zookeeper.quorum", "localhost");

hbaseConf.set("hbase.zookeeper.property.clientPort", "2181");HBaseConnectionOptions.HBaseConnectionOptionsBuilder connectionOptionsBuilder = new HBaseConnectionOptions.HBaseConnectionOptionsBuilder().withHBaseConfiguration(hbaseConf);HBaseTableSchema hbaseTableSchema = new HBaseTableSchema() {@Overridepublic String tableName() {return "your-hbase-table";}@Overridepublic String rowKeyField() {return "field0"; // 假设第一个字段是 row key}@Overridepublic TypeInformation<?>[] getFieldTypes() {// 返回字段的类型信息,这里应该是 Row 类型中的字段类型return new TypeInformation<?>[]{Types.STRING, Types.STRING, Types.STRING};}@Overridepublic TypeInformation<Row> getRowTypeInfo() {return Types.ROW(Types.STRING, Types.STRING, Types.STRING);}@Overridepublic void addFamilyField(String familyName, String... columnNames) {// 添加列族和列名信息this.addFamilyField("cf", "field1", "field2");}

};// 将处理后的数据流写入 HBase

processedStream.addSink(new FlinkHBaseOutputFormat<>(connectionOptionsBuilder.build(), hbaseTableSchema) {@Overrideprotected void writeRecord(Row row, Context context) throws IOException {Put put = new Put(Bytes.toBytes(row.getField(0).toString())); // 设置 row keyput.addColumn(Bytes.toBytes("cf"), Bytes.toBytes("field1"), Bytes.toBytes(row.getField(1).toString()));put.addColumn(Bytes.toBytes("cf"), Bytes.toBytes("field2"), Bytes.toBytes(row.getField(2).toString()));getBufferedMutator().mutate(put);}

});// 执行 Flink 任务

env.execute("Flink Kafka to HBase Stream Processing");

批处理示例

以下是一个简单的 Flink 批处理示例,演示如何从文件系统读取数据,经过处理后写入 HBase:

// 引入必要的依赖和包

import org.apache.flink.api.common.functions.MapFunction;

import org.apache.flink.api.java.DataSet;

import org.apache.flink.api.java.ExecutionEnvironment;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.connector.hbase.HBaseInputFormat;

import org.apache.flink.connector.hbase.HBaseOutputFormat;

import org.apache.flink.connector.hbase.table.HBaseTableSchema;

import org.apache.flink.types.Row;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.client.Put;

import org.apache.hadoop.hbase.util.Bytes;// 创建 Flink 执行环境

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment();// 配置 HBase 连接和表信息

Configuration hbaseConf = HBaseConfiguration.create();

hbaseConf.set("hbase.zookeeper.quorum", "localhost");

hbaseConf.set("hbase.zookeeper.property.clientPort", "2181");// 从文件系统读取数据(例如 CSV 文件)

DataSet<String> text = env.readTextFile("path/to/your/input.csv");// 对数据进行处理(例如,解析 CSV 并转换为 Row 类型)

DataSet<Row> rows = text.map(new MapFunction<String, Row>() {@Overridepublic Row map(String value) throws Exception {String[] fields = value.split(",");return Row.of(fields[0], fields[1], fields[2]); // 假设有三个字段}

});// 配置 HBase 表的 schema

HBaseTableSchema hbaseTableSchema = new HBaseTableSchema() {@Overridepublic String tableName() {return "your-hbase-table";}@Overridepublic String rowKeyField() {return "field0"; // 假设第一个字段是 row key}@Overridepublic TypeInformation<?>[] getFieldTypes() {return new TypeInformation<?>[]{Types.STRING, Types.STRING, Types.STRING};}@Overridepublic TypeInformation<Row> getRowTypeInfo() {return Types.ROW(Types.STRING, Types.STRING, Types.STRING);}@Overridepublic void addFamilyField(String familyName, String... columnNames) {this.addFamilyField("cf", "field1", "field2");}

};// 将处理后的数据写入 HBase

rows.output(new HBaseOutputFormat<>(hbaseConf, hbaseTableSchema) {@Overrideprotected void writeRecord(Row row) throws IOException {Put put = new Put(Bytes.toBytes(row.getField(0).toString())); // 设置 row keyput.addColumn(Bytes.toBytes("cf"), Bytes.toBytes("field1"), Bytes.toBytes(row.getField(1).toString()));put.addColumn(Bytes.toBytes("cf"), Bytes.toBytes("field2"), Bytes.toBytes(row.getField(2).toString()));getBufferedMutator().mutate(put);}

});// 执行 Flink 任务

env.execute("Flink Batch Processing to HBase");

注意:上述代码仅作为示例,实际使用时可能需要根据具体需求进行调整,包括错误处理、性能优化等方面。同时,Flink 和 HBase 的版本兼容性也需要考虑。

Flink SQL流处理示例

Flink SQL允许用户使用SQL语句来处理和分析数据流。以下是一个简单的Flink SQL流处理示例,它展示了如何从一个Kafka主题中读取数据,通过SQL查询进行处理,然后将结果输出到另一个Kafka主题中。

-- 创建Kafka Source表

CREATE TABLE kafka_source (user_id STRING,item_id STRING,behavior STRING,ts TIMESTAMP(3),WATERMARK FOR ts AS ts - INTERVAL '5' SECOND

) WITH ('connector' = 'kafka','topic' = 'source_topic','properties.bootstrap.servers' = 'localhost:9092','format' = 'json','scan.startup.mode' = 'earliest-offset'

);-- 创建Kafka Sink表

CREATE TABLE kafka_sink (user_id STRING,item_count BIGINT

) WITH ('connector' = 'kafka','topic' = 'sink_topic','properties.bootstrap.servers' = 'localhost:9092','format' = 'json'

);-- 编写SQL查询语句,计算每个用户的点击次数,并将结果写入kafka_sink表

INSERT INTO kafka_sink

SELECT user_id, COUNT(item_id) AS item_count

FROM kafka_source

WHERE behavior = 'click'

GROUP BY user_id;

在这个示例中,首先创建了一个名为kafka_source的Kafka Source表,用于从Kafka主题中读取数据。然后,创建了一个名为kafka_sink的Kafka Sink表,用于将处理后的数据写入另一个Kafka主题中。最后,编写了一个SQL查询语句,用于计算每个用户的点击次数,并将结果写入kafka_sink表中。

Flink SQL批处理示例

除了流处理外,Flink SQL还支持批处理。以下是一个简单的Flink SQL批处理示例,它展示了如何从一个CSV文件中读取数据,通过SQL查询进行处理,然后将结果输出到另一个CSV文件中。

-- 创建Source表,用于从CSV文件中读取数据

CREATE TABLE csv_source (user_id INT,item_id INT,category STRING,sales DOUBLE

) WITH ('connector' = 'filesystem','path' = 'file:///path/to/input.csv','format' = 'csv'

);-- 创建Sink表,用于将处理后的数据写入CSV文件中

CREATE TABLE csv_sink (category STRING,total_sales DOUBLE

) WITH ('connector' = 'filesystem','path' = 'file:///path/to/output.csv','format' = 'csv'

);-- 编写SQL查询语句,计算每个类别的总销售额,并将结果写入csv_sink表

INSERT INTO csv_sink

SELECT category, SUM(sales) AS total_sales

FROM csv_source

GROUP BY category;

在这个示例中,首先创建了一个名为csv_source的Source表,用于从CSV文件中读取数据。然后,创建了一个名为csv_sink的Sink表,用于将处理后的数据写入另一个CSV文件中。最后,编写了一个SQL查询语句,用于计算每个类别的总销售额,并将结果写入csv_sink表中。

相关文章:

HBase Flink操作

Apache Flink 是一个开源的分布式流处理框架,能够高效地处理和分析实时数据流以及批数据。HBase 是一个分布式、面向列的开源数据库,是 Hadoop 项目的子项目,适合非结构化数据结构的存储,并提供实时读写能力。以下是关于 Flink 对…...

C# .Net Core通过StreamLoad向Doris写入CSV数据

以下代码可以只关注StreamLoad具体实现。 1.创建StreamLoad返回值Model public class StreamLoadResponse {public long TxnId { get; set; }public string Label { get; set; }public string Comment { get; set; }public string TwoPhaseCommit { get; set; }public string…...

React-自定义Hook与逻辑共享

#题引:我认为跟着官方文档学习不会走歪路 在 React 中,自定义 Hook 是一种复用逻辑的方式。自定义 Hook 是一个 JavaScript 函数,名称以 use 开头,可以调用其他的 Hook, 可以返回任意值。 创建自定义Hook 假设你正在开发一款重…...

蓝桥杯每日真题 - 第17天

题目:(最大数字) 题目描述(13届 C&C B组D题) 题目分析: 操作规则: 1号操作:将数字加1(如果该数字为9,变为0)。 2号操作:将数字…...

游戏开发实现简易实用的ui框架

游戏开发实现简易实用的ui框架 本文使用cocos引擎实现,框架代码本质上不依赖某一个引擎,稍作修改也能作为其他引擎的实现 1.1 UI管理框架的核心需求剖析 分层与类型管理 对不同类型UI需要进行分层管理。不同层级的UI需要有不同的父节点,保证渲…...

vue3的attr透传属性详解和使用法方式。以及在css样式的伪元素中实现

在 Vue 3 和 TypeScript 中,属性透传(attr pass-through)是指将组件的属性传递到其根元素或某个子元素中。这个概念在开发可复用的组件时非常有用,尤其是当你希望将父组件的属性动态地传递给子组件的某个 DOM 元素时。 在 Vue 3 …...

【仿真建模-MESA】框架简介

1. 简介 Mesa是一个基于Python3的开源项目,旨在提供一个现代、易用的多智能体仿真环境。它借鉴了NetLogo、Repast和MASON等多智能体仿真框架的优点,并结合Python语言的强大功能,为用户提供了丰富的建模和仿真工具。 《官方文档》 2. 核心组件…...

Linux环境基础开发工具的使用(yum、vim、gcc、g++、gdb、make/Makefile)

目录 Linux软件包管理器 - yum Linux下安装软件包的方式 认识yum 查找软件包 安装软件 如何实现本地机器和云服务器之间的文件互传 卸载软件 Linux编辑器 - vim vim的基本概念 vim下各模式的切换 批量化注释 vim的简单配置 Linux编译器 - gcc/g gcc/g的作用 gcc/g语…...

VSCode 间距太小

setting->font family 使用:Consolas, Courier New, monospace 字体...

【K8S系列】imagePullSecrets配置正确,但docker pull仍然失败,进一步排查详细步骤

如果 imagePullSecrets 配置正确,但在执行 docker pull 命令时仍然失败,可能存在以下几种原因。以下是详细的排查步骤和解决方案。 1. 检查 Docker 登录凭证 确保你使用的是与 imagePullSecrets 中相同的凭证进行 Docker 登录: 1.1 直接登录 在命令行中,执行以下命令: …...

【ARM Coresight OpenOCD 系列 5.1 -- OpenOCD 无法识别CPUID 问题: xxx is unrecognized】

请阅读【嵌入式开发学习必备专栏】 文章目录 OpenOCD 无法识别CPUID 问题ARM CPUIDCPUID 特性CPUID 寄存器字段OpenOCD 无法识别CPUID 问题 在使用OpenOCD 进行CPU debug的过程中有时会报出 无法识别CPUID的问题,本文将会介绍如何解决这个问题。首先我们来学习下什么是CPUID,…...

如何实现点击目录跳转到指定位置?【vue】

需求:实现目录点击跳转到指定位置,点击后直接定位到指定模块 效果: 实现方法: (1)a标签跳转 普通使用: <!DOCTYPE html> <html><head><title>a-Demo</title>&l…...

SQL 通配符

SQL 通配符 在SQL中,通配符是一种特殊字符,用于在LIKE子句中搜索数据。它们主要用于模式匹配,允许你搜索符合特定模式的值。SQL中的通配符通常用于SELECT、UPDATE和DELETE语句中,以增加查询的灵活性。本文将详细介绍SQL中常用的通…...

ubuntu显示管理器_显示导航栏

ubuntu文件管理器_显示导航栏 一、原始状态: 二、显示导航栏状态: 三、原始状态--->导航栏状态: 1、打开dconf编辑器,直接在搜索栏搜索 dconf-editor ------如果没有安装,直接按流程安装即可。 2、进入目录:org …...

黑芝麻嵌入式面试题及参考答案

请详细描述二叉树的深度优先搜索(dfs)流程。 深度优先搜索是一种用于遍历二叉树的重要算法,主要有先序遍历、中序遍历和后序遍历三种方式。 先序遍历的流程是,首先访问根节点,然后递归地遍历左子树,最后递归地遍历右子树。这就好比是在探索一个家族树,先拜访家族中的长辈…...

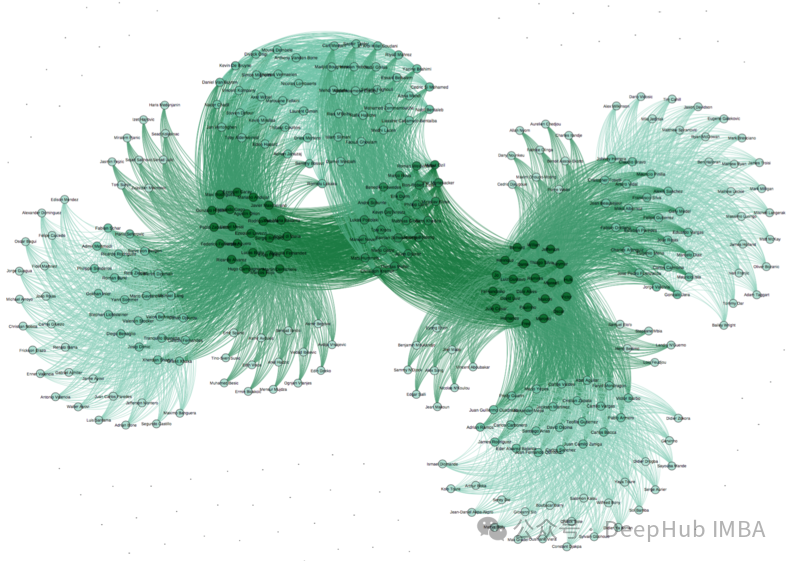

使用 PyTorch-BigGraph 构建和部署大规模图嵌入的完整教程

当涉及到图数据时,复杂性是不可避免的。无论是社交网络中的庞大互联关系、像 Freebase 这样的知识图谱,还是推荐引擎中海量的数据量,处理如此规模的图数据都充满挑战。 尤其是当目标是生成能够准确捕捉这些关系本质的嵌入表示时,…...

系统性能优化方法论详解:从理解系统到验证迭代

在当今的企业级和云计算环境中,系统性能优化已成为提升竞争力的关键因素。本文将对系统优化的步骤进行深入解析,帮助读者系统化地进行性能优化,从而显著提升系统的整体表现。 流程概述: 系统性能优化的流程可以分为以下几个关键步骤&#x…...

使用Tengine 对负载均衡进行状态检查(day028)

本篇文章对于在服务器已经安装了nginx,但却希望使用Tengine 的状态检查或其他功能时使用,不需要卸载服务器上的nginx,思路是使用干净服务器(未安装过nginx)通过编译安装Tengine,通过对./configure的配置,保证安装Tengi…...

网站推广实战案例:杭州翔胜科技有限公司如何为中小企业打开市场大门

以下是以杭州翔胜科技有限公司为例,解析其如何通过网站推广为中小企业打开市场大门的实战案例: 一、一站式网站推广方案 杭州翔胜科技有限公司提供一站式网站推广方案,该方案整合了多种推广手段,如搜索引擎优化(SEO&a…...

视频修复技术和实时在线处理

什么是视频修复? 视频修复技术的目标是填补视频中的缺失部分,使视频内容连贯合理。这项技术在对象移除、视频修复和视频补全等领域有着广泛的应用。传统方法通常需要处理整个视频,导致处理速度慢,难以满足实时处理的需求。 技术发…...

使用 Taotoken CLI 工具一键配置团队开发环境中的大模型端点

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 使用 Taotoken CLI 工具一键配置团队开发环境中的大模型端点 在团队协作开发中,统一管理大模型 API 的接入配置是一个常…...

从Arduino按键消抖到ESP32低功耗唤醒:细说电容充放电在嵌入式里的那些实用门道

从Arduino按键消抖到ESP32低功耗唤醒:细说电容充放电在嵌入式里的那些实用门道 在嵌入式开发中,电容充放电原理的应用远比教科书上的公式计算更加丰富多彩。从最简单的按键消抖到复杂的低功耗系统设计,合理利用RC特性往往能以极低成本解决实际…...

Armv8/v9架构系统寄存器解析:SCXTNUM与SMCR深度剖析

1. AArch64系统寄存器概述 在Armv8/v9架构中,系统寄存器是处理器状态和控制的核心枢纽。与通用寄存器不同,系统寄存器专门用于配置处理器功能、监控运行状态以及实现安全隔离。AArch64架构通过精心设计的寄存器命名规范,使得寄存器的功能和访…...

如何轻松实现U校园智能刷课?这个Python工具让你5分钟搞定

如何轻松实现U校园智能刷课?这个Python工具让你5分钟搞定 【免费下载链接】AutoUnipus U校园脚本,支持全自动答题,百分百正确 2024最新版 项目地址: https://gitcode.com/gh_mirrors/au/AutoUnipus 还在为U校园网课的手动答题烦恼吗?AutoUnipus这…...

ML模型服务化落地实战:从Notebook到高稳定生产环境

1. 项目概述:这不是一次“部署上线”演示,而是一场真实世界的ML交付实战复盘“From Notebook to Production: Running ML in the Real World (Part 4)”——这个标题里藏着三个关键信号:Notebook是起点,不是终点;Produ…...

)

Lovable电商系统从零部署:手把手教你用Vue+Node+MongoDB搭建高转化率商城(含完整源码)

更多请点击: https://kaifayun.com 第一章:Lovable电商系统从零部署:手把手教你用VueNodeMongoDB搭建高转化率商城(含完整源码) Lovable电商系统是一套面向中小企业的轻量级高转化率商城解决方案,采用前后…...

如何在Python中创建测试图像

原文地址:https://medium.com/itberrios6/how-to-make-a-test-image-in-python-1a6c2d41b6ab 学习如何制作测试图像 在计算机视觉和图像处理中,创建测试图像以更好地了解算法或滤波器将如何执行通常是有用的。测试图像是一个基准,可以将多种…...

[智能体-2]:openAI API详解

下面从核心概念→认证→接口→参数→流式→函数调用→计费→国内兼容→最佳实践,把 OpenAI API 讲透。一、OpenAI API 是什么OpenAI API 一套标准化的 RESTful 大模型调用协议,基于 HTTP/JSON,提供:文本对话(GPT-4o/3…...

C++智能指针与内存管理实践

C智能指针与内存管理实践智能指针是C中自动管理动态内存的关键工具。通过RAII机制,智能指针在对象生命周期结束时自动释放内存,避免内存泄漏和悬空指针问题。std::unique_ptr提供独占所有权语义,确保同一时刻只有一个指针拥有资源。它的开销极…...

如何快速掌握Blender 3MF插件:3个高效配置技巧实现CAD到3D打印无缝工作流

如何快速掌握Blender 3MF插件:3个高效配置技巧实现CAD到3D打印无缝工作流 【免费下载链接】Blender3mfFormat Blender add-on to import/export 3MF files 项目地址: https://gitcode.com/gh_mirrors/bl/Blender3mfFormat 你是否在为Blender与3D打印机之间的…...