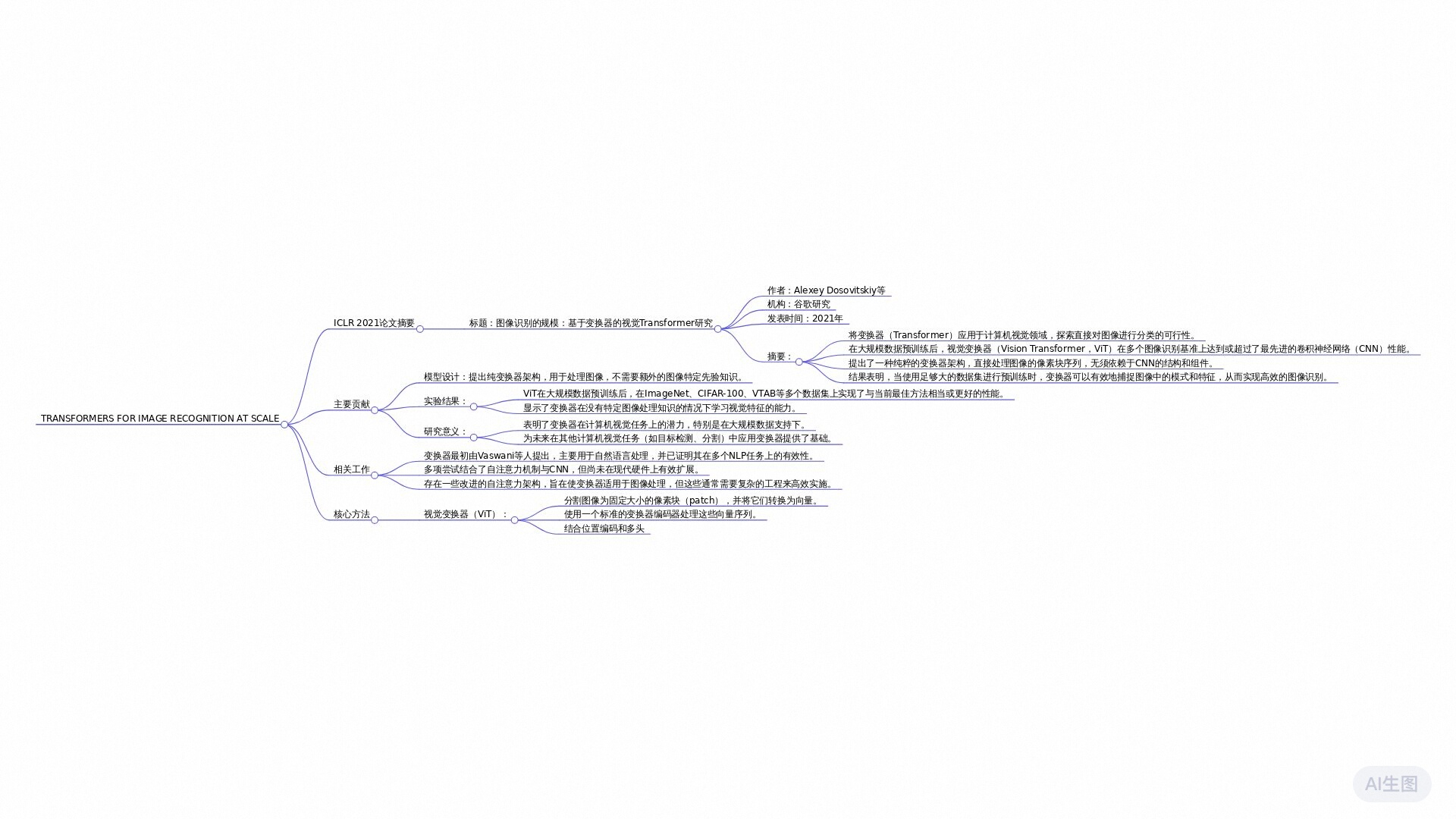

Vision Transformer学习笔记(2020 ICLR)

- 摘要(Abstract):简述了ViT(Vision Transformer)模型的设计和实验结果,展示了其在大规模图像数据集上进行训练时的优越性能。该模型直接采用原始图像块作为输入,而不是传统的卷积神经网络(CNNs),并通过Transformer架构处理这些图像块以实现高效的图像识别。

- 引言(Introduction):强调了传统卷积神经网络在图像识别领域的主导地位及其局限性,尤其是随着数据集规模的增大,CNNs的效率和可扩展性面临挑战。相比之下,基于Transformer的模型显示出强大的潜力,特别是在处理序列数据方面。文章提出,通过适当的调整,Transformer同样可以有效地应用于图像识别任务。

- 方法(Methods):

- 图像分块:首先,图像被分割成固定大小的小块(例如16x16像素),然后每个小块被视为一个“词”。

- 线性嵌入:对每个图像块应用线性变换,将其映射到更高的维度空间。

- 位置嵌入:为了解决图像块的位置信息丢失问题,添加了位置嵌入,使模型能够学习到每个块的空间关系。

- Transformer编码器:利用标准的Transformer编码器结构来处理这些嵌入后的图像块,从中提取特征并进行分类。

- 结果(Results):ViT模型在多个基准数据集上进行了评估,包括ImageNet、CIFAR-100等,结果显示,在大规模数据集上进行预训练后,ViT模型的表现可以与甚至超越最先进的卷积神经网络模型。

- 讨论(Discussion):探讨了ViT模型的有效性和潜在的应用范围,同时也指出了其局限性,如对于较小的数据集可能需要更多的正则化或数据增强技术来避免过拟合。

- 结论(Conclusion):总结了ViT模型的成功之处在于它能够高效地处理大规模图像数据集,并且不需要复杂的卷积操作。这表明Transformer架构具有广泛的适用性,不仅限于NLP领域,也可以成为计算机视觉任务的强大工具。

| 论文标题 | An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale |

|---|---|

| 论文作者 | Dosovitskiy, Alexey; Beyer, Lucas; Kolesnikov, Alexander; Weissenborn, Dirk; Zhai, Xiaohua; Unterthiner, Thomas; Dehghani, Mostafa; Minderer, Matthias; Heigold, Georg; Gelly, Sylvain; Uszkoreit, Jakob; Houlsby, Neil |

| 发表日期 | 2020年01月01日 |

| GB引用 | > Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, et al. An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale.[J]. CoRR, 2020, abs/2010.11929. > [1]Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, et al. An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale[J]. Arxiv E-prints, 2020, arXiv:2010.11929. |

| DOI | https://doi.org/10.48550/arXiv.2010.11929 |

论文PDF地址:https://arxiv.org/pdf/2010.11929

论文架构大纲

摘要

本文介绍了一种名为Vision Transformer (ViT)的新模型,该模型直接将Transformer应用于图像识别任务。不同于以往在计算机视觉中使用自注意力机制时引入特定于图像的归纳偏差,ViT将图像视为一系列补丁,并通过标准Transformer编码器处理这些补丁。实验表明,当在大规模数据集上进行预训练时,ViT在多种图像分类基准上取得了与最先进的卷积神经网络相当甚至更好的结果,同时所需的计算资源更少。ViT在小数据集上的表现受益于其较少的归纳偏差,而在大规模数据集上则通过预训练克服了这一劣势。此外,研究还探讨了ViT的内部表示以及不同模型规模下的性能对比。总体而言,ViT展示了在图像识别任务中的潜力,并为进一步探索提供了方向。

这篇论文提出了一种名为Vision Transformer(ViT)的新型图像识别模型,它直接将Transformer架构应用于图像处理任务。以下是论文的主要内容总结:

- 背景:尽管Transformer在自然语言处理(NLP)领域取得了巨大成功,但在计算机视觉领域的应用仍然有限。现有的方法通常将注意力机制与卷积神经网络(CNN)结合使用,或者完全替换CNN的某些部分。

- 方法:ViT通过将图像分割成小块(patches),然后将这些块线性嵌入到一个固定维度的空间中,并添加位置编码,最后将这些嵌入的序列输入到标准的Transformer编码器中。为了进行分类,ViT在序列中添加了一个额外的可学习的“分类”标记。

- 实验:ViT在多个图像识别基准测试(如ImageNet、CIFAR-100、VTAB等)上进行了评估。在大规模数据集(如ImageNet-21k和JFT-300M)上预训练后,ViT在这些任务上达到了与最先进的CNN模型相媲美的性能,同时在训练过程中需要的计算资源更少。

- 结果:ViT在ImageNet上的准确率达到了88.55%,在CIFAR-100上的准确率达到了94.55%,在VTAB任务上的准确率达到了77.63%。这些结果表明,通过大规模预训练,ViT能够有效地学习图像的表示,并在多种视觉任务上实现优秀的性能。

- 挑战与未来工作:尽管ViT取得了显著的成果,但仍有许多挑战需要解决,包括将ViT应用于其他计算机视觉任务(如检测和分割)、进一步探索自监督预训练方法,以及继续扩大ViT的规模以提高性能。

研究问题

如何在不依赖卷积神经网络(CNN)的情况下,通过直接应用Transformer到图像块序列中,实现高效的图像分类任务?

研究方法

实验研究: 通过在大规模数据集上预训练Vision Transformer,并将其应用于多个图像识别基准任务,验证了该模型的有效性和性能。

调查研究: 对不同大小的数据集进行预训练,观察Vision Transformer在不同规模数据下的表现,从而了解模型的数据需求。

混合方法研究: 结合卷积神经网络(CNN)和Transformer架构,探索不同组合下模型的性能变化,如使用不同的序列长度等。

研究思路

本文通过将图像分割成固定大小的patch,并将这些patch线性嵌入到一个序列中,然后输入到标准的Transformer编码器中进行处理。该方法不引入特定于图像的归纳偏置,除了最初的patch提取步骤外。实验表明,当在大规模数据集上进行预训练时,这种简单且可扩展的策略表现出了很好的效果。

论文通过以下步骤解决了将Transformer架构应用于图像识别任务的问题:

1. 图像分割:首先,将输入图像分割成固定大小的图像块(patches),这些图像块类似于自然语言处理中的单词(tokens)。

2. 线性嵌入:对每个图像块进行线性嵌入,将其映射到一个固定维度的向量空间。这个线性嵌入的过程类似于在NLP中将单词转换为词嵌入。

3. 位置编码:为了保留图像块的空间位置信息,向嵌入的图像块添加可学习的一维位置编码。

4. Transformer编码器:将嵌入后的图像块序列输入到标准的Transformer编码器中。编码器由多头自注意力(Multi-Head Self-Attention, MSA)和多层感知器(MLP)块交替组成。

5. 分类头:在Transformer编码器的输出中,使用一个额外的可学习“分类”标记(token),其状态在编码器输出时作为图像的表示。在预训练阶段,这个标记后面接一个MLP,而在微调(fine-tuning)阶段,使用一个线性层。

6. 大规模预训练:在大规模数据集(如ImageNet-21k或JFT-300M)上进行预训练,然后迁移到较小的数据集上进行微调,以实现在多个图像识别基准测试中的优秀性能。

7. 模型变体:提出了不同大小的Vision Transformer模型(ViT),包括基础(Base)、大型(Large)和巨大(Huge)版本,以适应不同的计算资源和性能需求。

Vision Transformer(ViT)

模型概述如图 1 所示。标准 Transformer 接收一个一维标记嵌入序列作为输入。为了处理二维图像,我们将图像 x ∈ R H × W × C \mathrm{x}\in\mathbb{R}^{H\times W\times C} x∈RH×W×C重塑为一个由展平的二维切片组成的序列 x p ∈ R N × ( P 2 ⋅ C ) \mathbf{x}_p\in\mathbb{R}^{N\times(P^2\cdot C)} xp∈RN×(P2⋅C),其中 ( H , W ) (H,W) (H,W)是原始图像的分辨率, C C

相关文章:

Vision Transformer学习笔记(2020 ICLR)

摘要(Abstract):简述了ViT(Vision Transformer)模型的设计和实验结果,展示了其在大规模图像数据集上进行训练时的优越性能。该模型直接采用原始图像块作为输入,而不是传统的卷积神经网络(CNNs),并通过Transformer架构处理这些图像块以实现高效的图像识别。引言(Introdu…...

一步一步生成音乐类小程序的详细指南,结合AI辅助开发的思路

以下是一步一步生成音乐类小程序的详细指南,结合AI辅助开发的思路: 需求分析阶段核心功能梳理 音乐播放器(播放/暂停/进度条/音量)歌单分类(流行/古典/摇滚等)用户系统(登录/收藏/历史记录)搜索功能(歌曲/歌手/专辑)推荐系统(根据用户偏好推荐)技术选型 前端:微信…...

25/2/8 <机器人基础> 阻抗控制

1. 什么是阻抗控制? 阻抗控制旨在通过调节机器人与环境的相互作用,控制其动态行为。阻抗可以理解为一个力和位移之间的关系,涉及力、速度和位置的协同控制。 2. 阻抗控制的基本概念 力控制:根据感测的外力调节机械手的动作。位置…...

golang 开启HTTP代理认证

内部网路不能直接访问外网接口,可以通过代理发送HTTP请求。 HTTP代理服务需要进行认证。 package cmdimport ("fmt""io/ioutil""log""net/http""net/url""strings" )// 推送CBC07功能 func main() {l…...

详解Nginx no live upstreams while connecting to upstream

网上看到几个相关的文章,觉得很不错,这里整理记录分享一下,供大家参考。 upstream配置分 在分析问题原因之前,我们先来看下关于上面upstream配置一些相关的参数配置说明,参考下面表格 ngx_http_proxy_module 这里重…...

Open3d Qt的环境配置

Open3d Qt的环境配置 一、概述二、操作流程2.1 下载文件2.2 新建文件夹2.3 环境变量设置2.4 qt6 引用3、qt中调用4、资源下载一、概述 目前统一使用qt6配置,open3d中可视化功能目前使用vtk代替,语言为c++。 二、操作流程 2.1 下载文件 访问open3d github链接,进入releas…...

)

5.Python字典和元组:字典的增删改查、字典遍历、访问元组、修改元组、集合(set)

1. 字典(dict) 字典是一个无序的键值对集合,每个键对应一个值。 字典的增、删、改、查: 添加键值对: my_dict {a: 1, b: 2} my_dict[c] 3 # 添加新键c,值为3 print(my_dict) # 输出:{a: 1, b: 2, c: …...

深度学习系列--04.梯度下降以及其他优化器

目录 一.梯度概念 1.一元函数 2.二元函数 3.几何意义上的区别 二.梯度下降 1.原理 2.步骤 3.示例代码(Python) 4.不同类型的梯度下降 5.优缺点 三.动量优化器(Momentum) 适用场景 1.复杂地形的优化问题 2.数据具有噪声的问…...

2022java面试总结,1000道(集合+JVM+并发编程+Spring+Mybatis)的Java高频面试题

1、面试题模块汇总 面试题包括以下十九个模块: Java 基础、容器、多线程、反射、对象拷贝、Java Web 模块、异常、网络、设计模式、Spring/Spring MVC、Spring Boot/Spring Cloud、Hibernate、Mybatis、RabbitMQ、Kafka、Zookeeper、MySql、Redis、JVM 。如下图所示…...

Ubuntu MKL(Intel Math Kernel Library)

Get Intel oneAPI Math Kernel Library wget https://registrationcenter-download.intel.com/akdlm/IRC_NAS/79153e0f-74d7-45af-b8c2-258941adf58a/intel-onemkl-2025.0.0.940_offline.sh sudo sh ./intel-onemkl-2025.0.0.940_offline.sh MKL库的配置和使用-CSDN博客 CMak…...

消费电子产品中的噪声对TPS54202的影响

本文章是笔者整理的备忘笔记。希望在帮助自己温习避免遗忘的同时,也能帮助其他需要参考的朋友。如有谬误,欢迎大家进行指正。 一、概述 在白色家电领域,降压转换器的应用非常广泛,为了实现不同的功能就需要不同的电源轨。TPS542…...

第四十章:职场转折:突破困境,重新出发

从绍兴与岳父岳母温馨相聚归来后,小冷满心都是温暖与幸福,本以为生活与工作会继续平稳前行,然而,命运却悄然为他的职场之路埋下了转折的伏笔。 平静工作下的暗潮涌动 小冷所在的公司是一家专注于地图导航与位置服务的企业…...

c++ 不定参数,不定类型的 max,min 函数

MSVC\14.29.30133\include\utility(33,19): error C2064: 项不会计算为接受 2 个参数的函数 max min #include <iostream> #include <type_traits>// 自定义 min_gd(支持任意类型和数量参数) template <typename... Args> auto min_g…...

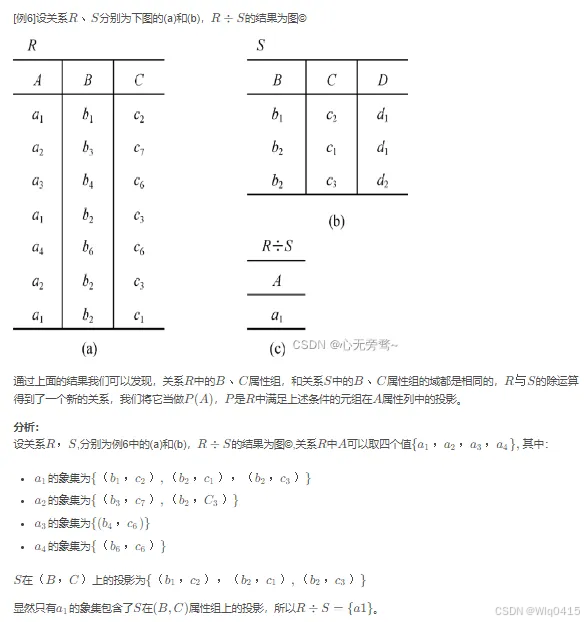

数据库的关系代数

关系就是表 属性(Attribute)是关系中的列.例如,关系 “学生” 中可能有属性 “学号”、“姓名”、“班级”。 元组(Tuple)是关系中的一行数据 1. 基本运算符 选择(Selection) 符号:σ 作用:从关…...

VSCode使用总结

1、VSCode左边资源窗口字体大小设置 方法一(使用,已成功) 进入安装目录Microsoft VS Code\resources\app\out\vs\workbench(如果是下载的压缩包,解压后resources\app\out\vs\workbench) 打开文件 workbench.desktop.main.css 搜…...

关系模型的数据结构及形式化定义

1 关系模型的核心结构 ①单一的数据结构(关系) 现实世界的实体以及实体间的各种联系均用关系来表示 ②逻辑结构(二维表) 从用户角度,关系模型中数据的逻辑结构是一张二维表,行代表元组(记录&a…...

【C++入门讲解】

目录 编辑 --------------------------------------begin---------------------------------------- 一、C简介 二、开发环境搭建 主流开发工具推荐 第一个C程序 三、核心语法精讲 1. 变量与数据类型 2. 运算符大全 3. 流程控制结构 4. 函数深度解析 5. 数组与容…...

数据表中的视图操作

文章目录 一、视图概述二、为什么要使用视图三、创建视图四、查看视图 一、视图概述 小学的时候,每年都会举办一次抽考活动,意思是从每一个班级里面筛选出几个优秀的同学去参加考试,这时候很多班级筛选出来的这些同学就可以临时组成一个班级…...

BFS算法篇——广度优先搜索,探索未知的旅程(上)

文章目录 前言一、BFS的思路二、BFS的C语言实现1. 图的表示2. BFS的实现 三、代码解析四、输出结果五、总结 前言 广度优先搜索(BFS)是一种广泛应用于图论中的算法,常用于寻找最短路径、图的遍历等问题。与深度优先搜索(DFS&…...

mongodb 使用内存过大分析

os 分析 内存使用 ps aux|head -1;ps aux|grep -v PID|sort -rn -k 4|head -10swap 使用 for i in $(ls /proc | grep "^[0-9]" | awk $0>100); do awk /Swap:/{aa$2}END{print "$i",a/1024"M"} /proc/$i/smaps;done| sort -k2nr | headmo…...

开源技能管理工具rei-skills:从零构建个人技术能力图谱

1. 项目概述与核心价值 最近在折腾个人知识库和技能树管理,发现了一个挺有意思的开源项目 rootcastleco/rei-skills 。这项目名字乍一看有点神秘, rei 在日语里是“零”或“灵”的意思,结合 skills ,我理解它想表达的是一种…...

DocX安全特性完全指南:文档保护、密码加密和数字签名终极教程

DocX安全特性完全指南:文档保护、密码加密和数字签名终极教程 【免费下载链接】DocX Fast and easy to use .NET library that creates or modifies Microsoft Word files without installing Word. 项目地址: https://gitcode.com/gh_mirrors/doc/DocX DocX…...

华大HC32F4A0 RS485通信避坑指南:从PCLK时钟疑惑到DMA地址偏移的完整排错记录

HC32F4A0 RS485实战:从时钟配置到DMA接收的工程化实现 调试华大半导体的HC32F4A0芯片进行RS485通信时,时钟配置、USART初始化和DMA接收这三个环节最容易出现隐蔽性问题。本文将结合具体工程案例,分享如何规避PCLK时钟分频陷阱、解决RTOF标志异…...

打破设备界限:用Sunshine开源串流工具打造你的家庭游戏云

打破设备界限:用Sunshine开源串流工具打造你的家庭游戏云 【免费下载链接】Sunshine Self-hosted game stream host for Moonlight. 项目地址: https://gitcode.com/GitHub_Trending/su/Sunshine 你是否曾梦想过在客厅大屏上畅玩PC游戏,或在平板上…...

2026最权威的AI辅助写作方案推荐

Ai论文网站排名(开题报告、文献综述、降aigc率、降重综合对比) TOP1. 千笔AI TOP2. aipasspaper TOP3. 清北论文 TOP4. 豆包 TOP5. kimi TOP6. deepseek 在当下的学术环境里头,知网的AI内容识别机制已然全面实现落地,针对由…...

3步解锁百度网盘下载限速:零成本体验高速下载的完整指南

3步解锁百度网盘下载限速:零成本体验高速下载的完整指南 【免费下载链接】BaiduNetdiskPlugin-macOS For macOS.百度网盘 破解SVIP、下载速度限制~ 项目地址: https://gitcode.com/gh_mirrors/ba/BaiduNetdiskPlugin-macOS 还在为百度网盘的蜗牛速度而苦恼吗…...

5步实现Cursor Pro永久免费:终极破解工具完整指南

5步实现Cursor Pro永久免费:终极破解工具完整指南 【免费下载链接】cursor-free-vip [Support 0.45](Multi Language 多语言)自动注册 Cursor Ai ,自动重置机器ID , 免费升级使用Pro 功能: Youve reached your trial r…...

幸福依赖于抽象的 能力的庖丁解牛

它的本质是:**将幸福的源头从 具体实现类 (Concrete Implementations)(如特定的伴侣、具体的工作、固定的房产)转移到 抽象接口 (Abstract Interfaces)(如爱的能力、创造价值的技能、感知美好的心智)。具体实现是不可控…...

Harness层数据清洗自动化

Harness层数据清洗自动化:解放数据团队生产力的核心方案 开篇引子 上周我帮一家年GMV超20亿的电商客户排查数据故障,他们的数仓团队反馈连续3天的用户订单报表交易额比实际支付金额少了1200万,排查了3个小时才定位到根因:新接入的外卖业务系统的订单状态字段新增了枚举值6…...

服装吊牌变量条码打印机:优质供应商选择策略解析

“选对服装吊牌变量条码打印机供应商,比单纯比价更重要的是匹配柔性生产需求——这是超六成服装从业者反馈的采购核心准则。”中小商家面临小批量吊牌外发成本高、出货慢的困境,大企业则受限于多SKU适配难、数据不同步的痛点,如何找到能覆盖全…...