DeepSeek-V2 论文解读:混合专家架构的新突破

论文链接:DeepSeek-V2: A Strong, Economical, and Efficient Mixture-of-Experts Language Model

目录

- 一、引言

- 二、模型架构

- (一)多头部潜在注意力(MLA):重塑推理效率

- (二)DeepSeekMoE:经济高效的训练架构

- 三、预训练(Pre-Training):夯实模型基础

- (一)实验设置

- (二)评估

- 四、对齐(Alignment):优化模型表现

- (一)监督微调:提升指令响应能力

- (二)强化学习:契合人类偏好

- 五、结论、局限与展望

一、引言

在大语言模型(LLMs)蓬勃发展的浪潮中,DeepSeek-V2 脱颖而出,成为一款兼具强大性能、高效训练与推理能力的混合专家(MoE)语言模型。它拥有 236B 总参数,在处理每个令牌时仅激活 21B 参数,且支持长达 128K 令牌的上下文长度,为自然语言处理领域带来了新的突破。本文将深入探讨 DeepSeek-V2 的技术细节,包括其创新架构、预训练过程、对齐方法以及性能评估,旨在为技术人员提供全面且深入的技术解读。

二、模型架构

(一)多头部潜在注意力(MLA):重塑推理效率

传统 Transformer 模型中的多头注意力(MHA)机制在生成过程中,因庞大的键值(KV)缓存需求,严重制约了推理效率。为攻克这一难题,DeepSeek-V2 引入了 MLA 机制。

MLA 的核心在于低秩键值联合压缩技术。在推理阶段,通过特定的投影矩阵(如 W D K V W^{DKV} WDKV、 W U K W^{UK} WUK、 W U V W^{UV} WUV)将键值压缩为低维潜在向量 c t K V c_{t}^{KV} ctKV,大幅削减了 KV 缓存。与 MHA 相比,MLA 仅需缓存 c t K V c_{t}^{KV} ctKV 及携带旋转位置嵌入(RoPE)的 k t R k_{t}^{R} ktR,缓存元素数量从 2 n h d h l 2n_{h}d_{h}l 2nhdhl 锐减至 ( d c + d h R ) l (d_{c}+d_{h}^{R})l (dc+dhR)l(在 DeepSeek-V2 中, d c d_{c} dc 设为 4 d h 4d_{h} 4dh, d h R d_{h}^{R} dhR 设为 d h 2 \frac{d_{h}}{2} 2dh,其 KV 缓存仅相当于 2.25 组 GQA,但性能更优)。例如,在实际部署中,这使得 DeepSeek-V2 能够处理更大的批处理规模,显著提升了推理效率。

此外,为解决 RoPE 与低秩 KV 压缩的兼容性问题,MLA 采用了去耦 RoPE 策略。通过引入额外的多头查询 q t , i R q_{t,i}^{R} qt,iR 和共享键 k t R k_{t}^{R} ktR 来承载 RoPE,确保了在不影响性能的前提下,有效避免了因 RoPE 应用导致的推理效率下降。

(二)DeepSeekMoE:经济高效的训练架构

在 Feed-Forward Networks(FFNs)方面,DeepSeek-V2 采用了 DeepSeekMoE 架构,该架构在专家分割和共享专家设置上进行了创新优化。

其将专家细粒度分割,并隔离部分共享专家,有效提升了专家专业化程度和知识获取的精准性。在计算 FFN 输出时,依据令牌与专家的亲和力 s i , t s_{i,t} si,t,经 top-K 选择和归一化确定门控值 g i , t g_{i,t} gi,t,从而精准激活路由专家,实现高效计算资源分配。与传统 MoE 架构(如 GShard)相比,DeepSeekMoE 在相同的激活和总专家参数条件下,性能优势显著。

为控制专家并行训练中的通信开销和负载均衡,DeepSeek-V2 设计了一系列有效机制。设备限制路由机制确保每个令牌的目标专家最多分布在 M M M 个设备上(实践中 M ≥ 3 M≥3 M≥3 时性能良好),有效降低了 MoE 相关通信成本。同时,通过设计专家级、设备级和通信平衡损失,从多个层面保障了负载平衡,防止路由崩溃和计算效率降低。此外,还引入了设备级令牌丢弃策略,在训练过程中动态丢弃低亲和力令牌,进一步优化计算资源利用,且在推理时可灵活调整,确保训练与推理的一致性。

三、预训练(Pre-Training):夯实模型基础

(一)实验设置

在数据构建方面,DeepSeek-V2 基于与 DeepSeek 67B 相同的数据处理流程,进行了数据量扩充和质量提升。通过挖掘互联网数据潜力、优化清洗流程,增加了大量数据,尤其是中文数据,并采用改进的质量过滤算法,去除不良数据,提升数据质量,同时过滤掉有争议内容,减轻数据偏差。其分词器基于 Byte-level Byte-Pair Encoding(BBPE)算法,词汇表大小为 100K,预处理后的语料包含 8.1T 令牌,其中中文令牌占比约 12%。

模型超参数设置上,DeepSeek-V2 包含 60 层 Transformer 层,隐藏维度为 5120,所有可学习参数采用标准差为 0.006 的随机初始化。在 MLA 中,设置 128 个注意力头,头维度为 128,KV 压缩维度 d c d_{c} dc 为 512,查询压缩维度 d c ′ d_{c}' dc′ 为 1536,去耦查询和键的头维度 d h R d_{h}^{R} dhR 为 64。除第一层外,其余 FFN 均替换为 MoE 层,每个 MoE 层包含 2 个共享专家和 160 个路由专家,专家中间隐藏维度为 1536,每个令牌激活 6 个专家。为确保训练稳定,在压缩潜在向量后添加 RMS Norm 层,并在宽度瓶颈处乘以缩放因子。

训练超参数方面,采用 AdamW 优化器( β 1 = 0.9 \beta_{1}=0.9 β1=0.9, β 2 = 0.95 \beta_{2}=0.95 β2=0.95,权重衰减为 0.1),学习率采用 warmup-and-step-decay 策略,最大学习率为 2.4 × 1 0 − 4 2.4×10^{-4} 2.4×10−4,梯度裁剪范数为 1.0,批次大小采用动态调度策略。设置最大序列长度为 4K,在 8.1T 令牌上进行训练,利用流水线并行、专家并行和 ZeRO-1 数据并行技术,结合高效的 HAI-LLM 框架,并对 MLA 基于 FlashAttention-2 进行优化,确保训练高效运行。

在长上下文扩展阶段,运用 YaRN 技术将默认上下文窗口从 4K 扩展至 128K,通过特定设置(如设置尺度 s s s 为 40, α \alpha α 为 1, β \beta β 为 32,调整长度缩放因子等),使模型在长上下文任务中表现出色,在 “Needle In A Haystack”(NIAH)测试中,于 128K 上下文长度下性能稳定。

(二)评估

评估基准涵盖了英语和中文的多学科多选、语言理解与推理、闭卷问答、阅读理解、参考消歧、语言建模、中文理解与文化、数学、代码和标准化考试等广泛领域,确保了对模型性能的全面评估。

与 DeepSeek 67B、Qwen1.5 72B、LLaMA3 70B 和 Mixtral 8x22B 等代表性开源模型对比,DeepSeek-V2 表现卓越。尽管仅激活 21B 参数,但在几乎所有基准测试中均显著优于 DeepSeek 67B,在开源模型中跻身前列。与 Qwen1.5 72B 相比,在多数英语、代码和数学基准测试中优势明显,在中文基准测试中除部分多学科多选任务外也表现不俗;与 Mixtral 8x22B 相比,英语性能相当(除部分常识知识相关任务),在 MMLU 上更优,代码和数学性能相近,中文能力则远超;与 LLaMA3 70B 相比,虽英语基础能力略逊,但代码和数学能力相当,在中文基准测试中优势显著。

在训练和推理效率方面,DeepSeek-V2 优势突出。理论上,因其激活参数少、计算量低,训练成本低于 DeepSeek 67B。实际训练中,在 H800 集群上,训练每万亿令牌,DeepSeek 67B 需 300.6K GPU 小时,而 DeepSeek-V2 仅需 172.8K GPU 小时,节省 42.5%成本。在推理阶段,通过参数转换为 FP8 精度及 KV 缓存量化,其 KV 缓存大幅减少,在单节点 8 个 H800 GPU 上,生成吞吐量超 50K 令牌/秒,是 DeepSeek 67B 的 5.76 倍,提示输入吞吐量也超 100K 令牌/秒。

四、对齐(Alignment):优化模型表现

(一)监督微调:提升指令响应能力

基于前期研究,DeepSeek-V2 构建了包含 1.5M 实例(1.2M 有益性实例和 0.3M 安全性实例)的指令调整数据集,通过提升数据质量有效减少幻觉响应并增强写作能力。采用 2 个 epoch 进行微调,学习率设为 5 × 1 0 − 6 5×10^{-6} 5×10−6,评估涵盖生成式基准测试和部分多选任务,并引入 IFEval 进行指令跟随评估,以及使用 LiveCodeBench 特定时间段问题评估聊天模型,同时在多个开放端对话基准测试中与其他模型对比,展现出良好性能。

(二)强化学习:契合人类偏好

采用 Group Relative Policy Optimization(GRPO)算法进行强化学习,该算法摒弃传统等大的评论家模型,基于组分数估计基线,有效降低训练成本。具体而言,对于每个问题 q q q,GRPO 从旧策略 π θ o l d \pi_{\theta_{old}} πθold中采样一组输出 { o 1 , o 2 , ⋯ , o G } \{o_{1}, o_{2}, \cdots, o_{G}\} {o1,o2,⋯,oG},然后通过最大化以下目标来优化策略模型 π θ \pi_{\theta} πθ:

J G R P O ( θ ) = E [ q ∼ P ( Q ) , { o i } i = 1 G ∼ π θ o l d ( O ∣ q ) ] 1 G ∑ i = 1 G ( min ( π θ ( o i ∣ q ) π θ o l d ( o i ∣ q ) A i , clip ( π θ ( o i ∣ q ) π θ o l d ( o i ∣ q ) , 1 − ε , 1 + ε ) A i ) − β D K L ( π θ ∥ π r e f ) ) \begin{aligned} \mathcal{J}_{GRPO}(\theta) &=\mathbb{E}\left[q \sim P(Q),\left\{o_{i}\right\}_{i = 1}^{G} \sim \pi_{\theta_{old}}(O|q)\right] \\ &\frac{1}{G}\sum_{i = 1}^{G}\left(\min\left(\frac{\pi_{\theta}(o_{i}|q)}{\pi_{\theta_{old}}(o_{i}|q)}A_{i}, \text{clip}\left(\frac{\pi_{\theta}(o_{i}|q)}{\pi_{\theta_{old}}(o_{i}|q)}, 1-\varepsilon, 1+\varepsilon\right)A_{i}\right)-\beta\mathbb{D}_{KL}(\pi_{\theta}\|\pi_{ref})\right) \end{aligned} JGRPO(θ)=E[q∼P(Q),{oi}i=1G∼πθold(O∣q)]G1i=1∑G(min(πθold(oi∣q)πθ(oi∣q)Ai,clip(πθold(oi∣q)πθ(oi∣q),1−ε,1+ε)Ai)−βDKL(πθ∥πref))

D K L ( π θ ∥ π r e f ) = π r e f ( o i ∣ q ) π θ ( o i ∣ q ) − log π r e f ( o i ∣ q ) π θ ( o i ∣ q ) − 1 \mathbb{D}_{KL}(\pi_{\theta}\|\pi_{ref})=\frac{\pi_{ref}(o_{i}|q)}{\pi_{\theta}(o_{i}|q)}-\log\frac{\pi_{ref}(o_{i}|q)}{\pi_{\theta}(o_{i}|q)}-1 DKL(πθ∥πref)=πθ(oi∣q)πref(oi∣q)−logπθ(oi∣q)πref(oi∣q)−1

其中 ε \varepsilon ε和 β \beta β是超参数; A i A_{i} Ai是优势,通过与每组内输出相对应的一组奖励 { r 1 , r 2 , ⋯ , r G } \{r_{1}, r_{2}, \cdots, r_{G}\} {r1,r2,⋯,rG}计算得出:

A i = r i − mean ( { r 1 , r 2 , ⋯ , r G } ) std ( { r 1 , r 2 , ⋯ , r G } ) A_{i}=\frac{r_{i}-\text{mean}(\{r_{1}, r_{2}, \cdots, r_{G}\})}{\text{std}(\{r_{1}, r_{2}, \cdots, r_{G}\})} Ai=std({r1,r2,⋯,rG})ri−mean({r1,r2,⋯,rG})

训练过程采用两阶段策略,先进行推理对齐(针对代码和数学推理任务训练奖励模型并优化策略模型),再进行人类偏好对齐(采用多奖励框架融合不同奖励模型反馈)。为获取可靠奖励模型,精心收集偏好数据并严格过滤和调整比例,同时通过多种工程优化(如设计混合引擎、利用 vLLM 加速推理、优化模型卸载和加载策略)提升训练效率,使模型在数学和代码任务性能上进一步提升,在开放端对话生成中表现更优,在不同语言和领域的基准测试中展现出较强竞争力。

五、结论、局限与展望

DeepSeek-V2 凭借 MLA 和 DeepSeekMoE 等创新架构,在性能、训练和推理效率上取得显著成果,成为开源 MoE 语言模型的佼佼者。然而,它也面临着与其他 LLM 类似的局限,如预训练后知识更新困难、可能生成不实信息和幻觉,且因数据主要集中于中英文,在其他语言上表现受限。

未来,DeepSeek 将持续投入开源大模型研发,致力于在保持经济成本的同时进一步扩大 MoE 模型规模,提升性能以追赶 GPT-4;不断优化对齐技术,打造更安全、可靠且契合人类价值观的模型;探索多模态支持,拓展模型应用场景,为人工智能发展注入新动力。

相关文章:

DeepSeek-V2 论文解读:混合专家架构的新突破

论文链接:DeepSeek-V2: A Strong, Economical, and Efficient Mixture-of-Experts Language Model 目录 一、引言二、模型架构(一)多头部潜在注意力(MLA):重塑推理效率(二)DeepSeekM…...

5分钟了解回归测试

1. 什么是回归测试(Regression Testing) 回归测试是一个系统的质量控制过程,用于验证最近对软件的更改或更新是否无意中引入了新错误或对以前的功能方面产生了负面影响(比如你在家中安装了新的空调系统,发现虽然新的空…...

路由器如何进行数据包转发?

路由器进行数据包转发的过程是网络通信的核心之一,主要涉及以下几个步骤: 接收数据包:当一个数据包到达路由器的一个接口时,它首先被暂时存储在该接口的缓冲区中。 解析目标地址:路由器会检查数据包中的目标IP地址。…...

【HarmonyOS之旅】基于ArkTS开发(三) -> 兼容JS的类Web开发(四) -> 常见组件(一)

目录 1 -> List 1.1 -> 创建List组件 1.2 -> 添加滚动条 1.3 -> 添加侧边索引栏 1.4 -> 实现列表折叠和展开 1.5 -> 场景示例 2 -> dialog 2.1 -> 创建Dialog组件 2.2 -> 设置弹窗响应 2.3 -> 场景示例 3 -> form 3.1 -> 创建…...

iOS 自动翻滚广告条(榜单条)实现方案

引言 在直播场景中,榜单信息、活动公告或者广告推广通常需要以醒目的方式展示,但由于屏幕空间有限,一次只能显示一条内容。为了让用户能够持续关注这些信息,我们可以实现一个自动翻滚的广告条(或榜单条)&a…...

TensorFlow深度学习实战(7)——分类任务详解

TensorFlow深度学习实战(7)——分类任务详解 0. 前言1. 分类任务1.1 分类任务简介1.2 分类与回归的区别 2. 逻辑回归3. 使用 TensorFlow 实现逻辑回归小结系列链接 0. 前言 分类任务 (Classification Task) 是机器学习中的一种监督学习问题,…...

动态规划问题——青蛙跳台阶案例分析

问题描述: 一只青蛙要跳上n级台阶,它每次可以跳 1级或者2级。问:青蛙有多少种不同的跳法可以跳完这些台阶? 举个例子: 假设台阶数 n 3 ,我们来看看青蛙有多少种跳法。 可能的跳法: 1. 跳1级…...

element-ui使用el-table,保留字段前的空白

项目名称项目编号1、XXXXX1111111111111111111 1.1 XXXXX11111111111111222222222 如上表格中,实现项目名称字段1.1前空白的效果。 从JAVA返回的数据带有空白,即数据库中插入的数据带有空白。 原先写法: <el-table><el-tabl…...

kamailio中路由模块汇总

功能模块描述请求路由 (request_route)主要处理进入的SIP请求,包含初步检查、NAT检测、CANCEL请求处理、重传处理等。处理通过REQINIT、NATDETECT、RELAY等子模块的调用。CANCEL处理对CANCEL请求进行处理,包括更新对话状态并检查事务。如果事务检查通过&…...

如何使用 DeepSeek 搭建本地知识库

使用 DeepSeek 搭建本地知识库可以帮助您高效管理和检索本地文档、数据或知识资源。以下是详细的步骤指南: 1. 准备工作 (1) 安装 DeepSeek 确保您的系统已安装 Python 3.8 或更高版本。使用 pip 安装 DeepSeek: bash pip install deepseek (2) 准备…...

网络HTTP详细讲解

学习目标 什么是HTTPHTTP的请求和响应常见的HTTP状态码HTTP的安全性 什么是HTTP?HTTP的请求和响应,常见的HTTP状态码,HTTP的安全性 什么是HTTP HTTP(HyperText Transfer Protocol,超文本传输协议)是一种用…...

《Origin画百图》之边际分布曲线图

《Origin画百图》第六集——边际分布曲线图 入门操作可看《30秒,带你入门Origin》 边际分布曲线图,其中包含散点图形,而在图的边际有着分布曲线图。在比较数据以查看多个变量之间是否存在关系时非常有用。 1.数据准备:为多列XY数…...

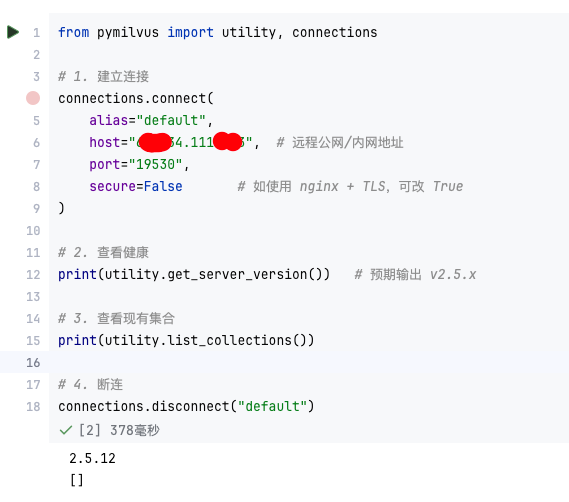

【Milvus】向量数据库pymilvus使用教程

以下是根据 Milvus 官方文档整理的详细 PyMilvus 使用教程,基于 Milvus 2.5.x 版本: PyMilvus 使用教程 目录 安装与环境准备连接 Milvus 服务数据模型基础概念创建集合(Collection)插入数据创建索引向量搜索删除操作完整示例注…...

React 生命周期函数详解

React 组件在其生命周期中有多个阶段,每个阶段都有特定的生命周期函数(Lifecycle Methods)。这些函数允许你在组件的不同阶段执行特定的操作。以下是 React 组件生命周期的主要阶段及其对应的生命周期函数,并结合了 React 16.3 的…...

第 26 场 蓝桥入门赛

2.对联【算法赛】 - 蓝桥云课 问题描述 大年三十,小蓝和爷爷一起贴对联。爷爷拿出了两副对联,每副对联都由 N 个“福”字组成,每个“福”字要么是正的(用 1 表示),要么是倒的(用 0 表示&#…...

)

组合(力扣77)

从这道题开始,我们正式进入回溯算法的学习。之前在二叉树中只是接触到了一丢丢,而这里我们将使用回溯算法解决很多经典问题。 那么这道题是如何使用回溯算法的呢?在讲回溯之前,先说明一下此题是如何递归的。毕竟回溯递归不分家&a…...

网络工程师 (22)网络协议

前言 网络协议是计算机网络中进行数据交换而建立的规则、标准或约定的集合,它规定了通信时信息必须采用的格式和这些格式的意义。 一、基本要素 语法:规定信息格式,包括数据及控制信息的格式、编码及信号电平等。这是协议的基础,确…...

Linux之文件IO前世今生

在 Linux之文件系统前世今生(一) VFS中,我们提到了文件的读写,并给出了简要的读写示意图,本文将分析文件I/O的细节。 一、Buffered I/O(缓存I/O)& Directed I/O(直接I/O&#…...

如何在Windows中配置MySQL?

MySQL是一个广泛使用的开源关系型数据库管理系统,它支持多种操作系统平台,其中包括Windows。无论是开发者进行本地开发,还是管理员为应用程序配置数据库,MySQL都是一个非常流行的选择。本篇文章将详细介绍如何在Windows操作系统中…...

Kafka 入门与实战

一、Kafka 基础 1.1 创建topic kafka-topics.bat --bootstrap-server localhost:9092 --topic test --create 1.2 查看消费者偏移量位置 kafka-consumer-groups.bat --bootstrap-server localhost:9092 --describe --group test 1.3 消息的生产与发送 #生产者 kafka-cons…...

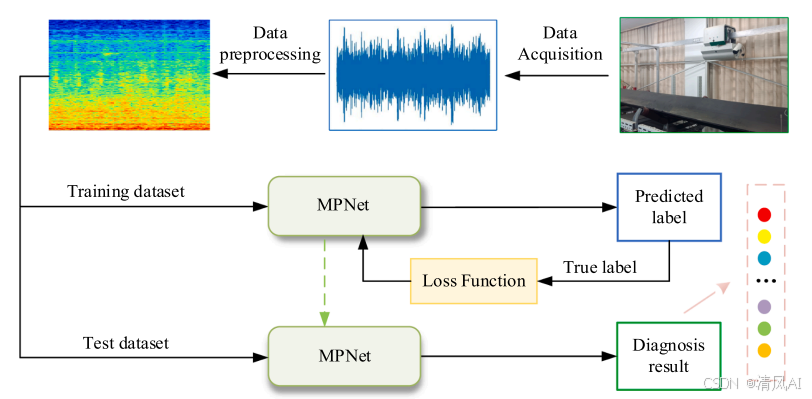

MPNet:旋转机械轻量化故障诊断模型详解python代码复现

目录 一、问题背景与挑战 二、MPNet核心架构 2.1 多分支特征融合模块(MBFM) 2.2 残差注意力金字塔模块(RAPM) 2.2.1 空间金字塔注意力(SPA) 2.2.2 金字塔残差块(PRBlock) 2.3 分类器设计 三、关键技术突破 3.1 多尺度特征融合 3.2 轻量化设计策略 3.3 抗噪声…...

使用rpicam-app通过网络流式传输视频)

树莓派超全系列教程文档--(62)使用rpicam-app通过网络流式传输视频

使用rpicam-app通过网络流式传输视频 使用 rpicam-app 通过网络流式传输视频UDPTCPRTSPlibavGStreamerRTPlibcamerasrc GStreamer 元素 文章来源: http://raspberry.dns8844.cn/documentation 原文网址 使用 rpicam-app 通过网络流式传输视频 本节介绍来自 rpica…...

【大模型RAG】Docker 一键部署 Milvus 完整攻略

本文概要 Milvus 2.5 Stand-alone 版可通过 Docker 在几分钟内完成安装;只需暴露 19530(gRPC)与 9091(HTTP/WebUI)两个端口,即可让本地电脑通过 PyMilvus 或浏览器访问远程 Linux 服务器上的 Milvus。下面…...

基础光照(Basic Lighting))

C++.OpenGL (10/64)基础光照(Basic Lighting)

基础光照(Basic Lighting) 冯氏光照模型(Phong Lighting Model) #mermaid-svg-GLdskXwWINxNGHso {font-family:"trebuchet ms",verdana,arial,sans-serif;font-size:16px;fill:#333;}#mermaid-svg-GLdskXwWINxNGHso .error-icon{fill:#552222;}#mermaid-svg-GLd…...

MySQL用户和授权

开放MySQL白名单 可以通过iptables-save命令确认对应客户端ip是否可以访问MySQL服务: test: # iptables-save | grep 3306 -A mp_srv_whitelist -s 172.16.14.102/32 -p tcp -m tcp --dport 3306 -j ACCEPT -A mp_srv_whitelist -s 172.16.4.16/32 -p tcp -m tcp -…...

Ubuntu Cursor升级成v1.0

0. 当前版本低 使用当前 Cursor v0.50时 GitHub Copilot Chat 打不开,快捷键也不好用,当看到 Cursor 升级后,还是蛮高兴的 1. 下载 Cursor 下载地址:https://www.cursor.com/cn/downloads 点击下载 Linux (x64) ,…...

wpf在image控件上快速显示内存图像

wpf在image控件上快速显示内存图像https://www.cnblogs.com/haodafeng/p/10431387.html 如果你在寻找能够快速在image控件刷新大图像(比如分辨率3000*3000的图像)的办法,尤其是想把内存中的裸数据(只有图像的数据,不包…...

实现跳一跳小游戏)

鸿蒙(HarmonyOS5)实现跳一跳小游戏

下面我将介绍如何使用鸿蒙的ArkUI框架,实现一个简单的跳一跳小游戏。 1. 项目结构 src/main/ets/ ├── MainAbility │ ├── pages │ │ ├── Index.ets // 主页面 │ │ └── GamePage.ets // 游戏页面 │ └── model │ …...

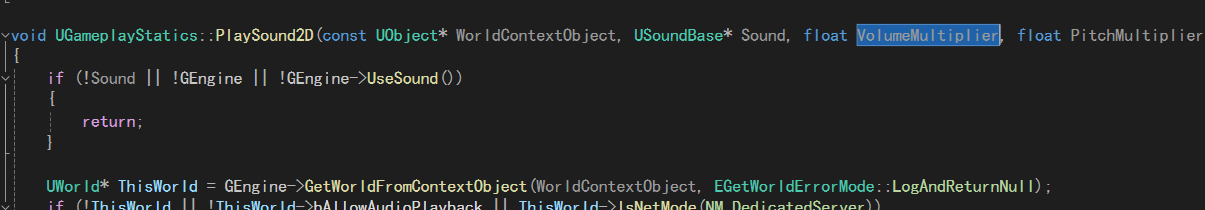

UE5 音效系统

一.音效管理 音乐一般都是WAV,创建一个背景音乐类SoudClass,一个音效类SoundClass。所有的音乐都分为这两个类。再创建一个总音乐类,将上述两个作为它的子类。 接着我们创建一个音乐混合类SoundMix,将上述三个类翻入其中,通过它管理每个音乐…...

SQLSERVER-DB操作记录

在SQL Server中,将查询结果放入一张新表可以通过几种方法实现。 方法1:使用SELECT INTO语句 SELECT INTO 语句可以直接将查询结果作为一个新表创建出来。这个新表的结构(包括列名和数据类型)将与查询结果匹配。 SELECT * INTO 新…...