15个awk的经典实战案例

目录

一、插入几个新字段

二、格式化个空白

三、筛选IPV4地址

命令及结果

第一种查询方式

第二种查询方式

第三种查询方式

四、读取.ini配置文件中的某段

命令及结果

第一种查询方式

第二种查询方式

五、根据某字段去重

命令及结果

第一种方式

第二种方式

六、系数统计

命令及结果

七、统计TCP连接状态数量

命令及结果

第一种查询方式

第二种查询方式

八、统计日志中各IP访问非200状态码的次数

命令及结果

第一种查询方式

第二种查询方式

九、统计独立IP

命令及结果

十、处理字段缺失的数据

命令及结果

十一、处理字段中包含了字段分隔符的数据

命令及结果

十二、取字段中指定字符数量

命令及结果

第一种查询方式

第二种查询方式

十三、行列转换

命令及结果

十四、行列转换2

命令及结果

十五、筛选给定时间范围内的日志

一、插入几个新字段

在"a b c d"的b后面插入3个e f g

[root@www test]# echo "a b c d" | awk '{$2=$2" e f g ";print}'

a b e f g c d[root@www test]# echo "a b c d" | awk '{$2=$2" e f g";print}' #在awk中重新赋值后,awk会重新构建$0,也就是重构后的一行的数据

a b e f g c d二、格式化个空白

移除每行的前缀、后缀空白,并将各部分左对齐

[root@www test]# cat 2.txt #查看2.txt文件中的内容aaaa bbbb ccccbbb aaa ccc

ddd fff eee ggg hhhh iii jjj [root@www test]# awk '{$1=$1;print}' 2.txt #通过$1=$1的方式来进行格式化空白,默认输出的格式为一个空格,因此看到的是每个字段之间都是通过一个空格来进行分隔

aaaa bbbb cccc

bbb aaa ccc

ddd fff eee ggg hhhh iii jjj[root@www test]# awk 'BEGIN{OFS="\t"}{$1=$1;print}' 2.txt #通过将输出字段分隔符修改为制表符\t来进行格式化,因此看到的是每个字段之间都是通过一个制表符来进行分隔

aaaa bbbb cccc

bbb aaa ccc

ddd fff eee ggg hhhh iii jjj

[root@www test]# 三、筛选IPV4地址

从ifcofig命令的结果中筛选出除了lo网卡外的所有IPV4地址

本机的所有网卡的IP地址

[root@www test]# ifconfig

br-4d64a44d0b5a: flags=4099<UP,BROADCAST,MULTICAST> mtu 1500inet 172.18.0.1 netmask 255.255.0.0 broadcast 172.18.255.255ether 02:42:05:3f:6a:7f txqueuelen 0 (Ethernet)RX packets 0 bytes 0 (0.0 B)RX errors 0 dropped 0 overruns 0 frame 0TX packets 0 bytes 0 (0.0 B)TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0docker0: flags=4099<UP,BROADCAST,MULTICAST> mtu 1500inet 172.17.0.1 netmask 255.255.0.0 broadcast 172.17.255.255ether 02:42:64:72:b8:e9 txqueuelen 0 (Ethernet)RX packets 0 bytes 0 (0.0 B)RX errors 0 dropped 0 overruns 0 frame 0TX packets 0 bytes 0 (0.0 B)TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0ens33: flags=4163<UP,BROADCAST,RUNNING,MULTICAST> mtu 1500inet 192.168.75.142 netmask 255.255.255.0 broadcast 192.168.75.255inet6 fe80::e78c:a86e:3457:f77b prefixlen 64 scopeid 0x20<link>ether 00:0c:29:b5:49:c8 txqueuelen 1000 (Ethernet)RX packets 37520 bytes 3100182 (2.9 MiB)RX errors 0 dropped 0 overruns 0 frame 0TX packets 99410 bytes 7526954 (7.1 MiB)TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0lo: flags=73<UP,LOOPBACK,RUNNING> mtu 65536inet 127.0.0.1 netmask 255.0.0.0inet6 ::1 prefixlen 128 scopeid 0x10<host>loop txqueuelen 1000 (Local Loopback)RX packets 2448 bytes 274656 (268.2 KiB)RX errors 0 dropped 0 overruns 0 frame 0TX packets 2448 bytes 274656 (268.2 KiB)TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0virbr0: flags=4099<UP,BROADCAST,MULTICAST> mtu 1500inet 192.168.122.1 netmask 255.255.255.0 broadcast 192.168.122.255ether 52:54:00:f7:4f:47 txqueuelen 1000 (Ethernet)RX packets 0 bytes 0 (0.0 B)RX errors 0 dropped 0 overruns 0 frame 0TX packets 0 bytes 0 (0.0 B)TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

命令及结果

第一种查询方式

[root@www test]# ifconfig | awk '/inet / && !($2 ~ /^127/){print $2}' #通过判断是否有/inet /关键字和匹配第二列不包含127开头的数字来进行匹配,满足前面的两个条件则打印第二列

172.18.0.1

172.17.0.1

192.168.75.142

192.168.122.1第二种查询方式

[root@www test]# ifconfig | awk 'BEGIN{RS=""}!/lo/{print $6}' #RS=""代表是以段落划分,此时每个网卡算是一个整体,也就是以每个段落之间的空行来作为分隔符,因此第6列就是我们需要找的IPV4地址。

172.18.0.1

172.17.0.1

192.168.75.142

192.168.122.1第三种查询方式

[root@www test]# ifconfig | awk 'BEGIN{RS="";FS="\n"}/ens33/{$0=$2;FS=" ";$0=$0;print $2}' #首先,使用RS进行段分隔,然后使用FS对段进行换行分隔。对ens33的第二列赋值给第一列(第二列将整个段落进行替换,现在只剩下第二列),再次对赋值后的第二列进行分割,通过FS为一个空格进行分隔,此时这里出现$0=$0的原因是awk的机制问题,在awk中,如果使用赋值重构,就必须通过重新赋值就是通过$0=$0这种方式进行重新渲染。此时在打印第二列就是我们所想查到的值

192.168.75.142四、读取.ini配置文件中的某段

[base]

name=os_repo

baseurl=https://xxx/centos/$releasever/os/$basearch

gpgcheck=0enable=1[mysql]

name=mysql_repo

baseurl=https://xxx/mysql-repo/yum/mysql-5.7-community/el/$releasever/$basearchgpgcheck=0

enable=1[epel]

name=epel_repo

baseurl=https://xxx/epel/$releasever/$basearch

gpgcheck=0

enable=1

[percona]

name=percona_repo

baseurl = https://xxx/percona/release/$releasever/RPMS/$basearch

enabled = 1

gpgcheck = 0查询配置文件中mysql字段的内容

命令及结果

第一种查询方式

[root@www test]# cat mysql.awk

index($0, "[mysql]"){ #$0是整个文本,找到mysql字段且打印出来。下面是一个判断语句,getline代表的是只要>0就一直往下读,这里是定义了一个变量var,只要var>0就一直往下读,读到出现[.*]的时候就退出,并且打印出var,也就是一直读到的内容printwhile((getline var)>0){if(var ~/\[.*\]/){exit}print var

}

}

# getline返回值:>0表示已经读取到数据;=0表示遇到结尾EOF,没有读到的东西;<0读取错误[root@www test]# awk -f mysql.awk a.txt

[mysql]

name=mysql_repo

baseurl=https://xxx/mysql-repo/yum/mysql-5.7-community/el/$releasever/$basearchgpgcheck=0

enable=1

第二种查询方式

[root@www test]# awk 'BEGIN{RS=""}/\[mysql\]/{print;while((getline)>0){if(/\[.*\]/){exit}print}}' a.txt

[mysql]

name=mysql_repo

baseurl=https://xxx/mysql-repo/yum/mysql-5.7-community/el/$releasever/$basearch

gpgcheck=0

enable=1五、根据某字段去重

去掉uid=xxx重复的行

2019-01-13_12:00_index?uid=123

2019-01-13_13:00_index?uid=123

2019-01-13_14:00_index?uid=333

2019-01-13_15:00_index?uid=9710

2019-01-14_12:00_index?uid=123

2019-01-14_13:00_index?uid=123

2019-01-15_14:00_index?uid=333

2019-01-16_15:00_index?uid=9710首先利用uid去重,我们需要利用?进行划分,然后将uid=xxx保存再数组当中,这是判断重复的依据,然后统计uid出现次数,第一次出现统计,第二次不统计

命令及结果

第一种方式

[root@www test]# awk -F"?" '!arr[$2]++{print}' b.txt

2019-01-13_12:00_index?uid=123

2019-01-13_14:00_index?uid=333

2019-01-13_15:00_index?uid=9710第二种方式

[root@www test]# awk -F"?" '{arr[$2]=arr[$2]+1;if(arr[$2]==1){print}}' b.txt

2019-01-13_12:00_index?uid=123

2019-01-13_14:00_index?uid=333

2019-01-13_15:00_index?uid=9710六、系数统计

portmapper

portmapper

portmapper

portmapper

portmapper

portmapper

status

status

mountd

mountd

mountd

mountd

mountd

mountd

nfs

nfs

nfs_acl

nfs

nfs

nfs_acl

nlockmgr

nlockmgr

nlockmgr

nlockmgr

nlockmgr命令及结果

[root@www test]# awk '{arr[$0]++}END{OFS="\t";for(i in arr){print arr[i], i}}' d.txt

4 nfs

2 status

5 nlockmgr

6 portmapper

2 nfs_acl

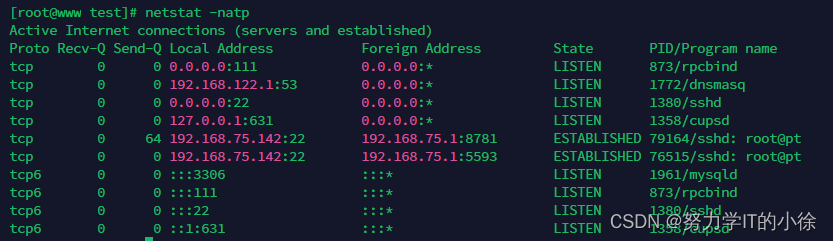

6 mountd七、统计TCP连接状态数量

命令及结果

第一种查询方式

[root@www test]# netstat -antp | awk '/^tcp/{arr[$6]++}END{for(i in arr){print arr[i], i}}'

8 LISTEN

2 ESTABLISHED第二种查询方式

[root@www test]# netstat -antp | grep 'tcp' | awk '{print $6}' | sort | uniq -c2 ESTABLISHED8 LISTEN八、统计日志中各IP访问非200状态码的次数

日志示例数据:

[root@www logs]# cat access.log

192.168.75.1 - - [22/Mar/2023:17:05:21 +0800] "GET / HTTP/1.1" 200 645 "-" "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/110.0.0.0 Safari/537.36" "-"

192.168.75.1 - - [22/Mar/2023:17:05:21 +0800] "GET /favicon.ico HTTP/1.1" 404 555 "http://192.168.75.142/" "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/110.0.0.0 Safari/537.36" "-"

192.168.75.148 - - [22/Mar/2023:17:09:52 +0800] "GET / HTTP/1.1" 200 645 "-" "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36 Edg/108.0.1462.76" "-"

192.168.75.148 - - [22/Mar/2023:17:09:52 +0800] "GET /favicon.ico HTTP/1.1" 404 555 "http://192.168.75.142/" "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36 Edg/108.0.1462.76" "-"统计非200状态码的IP,并且取次数最多的前10个IP

命令及结果

第一种查询方式

[root@www logs]# awk '$8!=200{arr[$1]++}END{for (i in arr){print arr[i],i}}' access.log | sort -k1nr | head -n 10

176 192.168.75.1

2 192.168.75.148第二种查询方式

[root@www logs]# awk '$8!=200{arr[$1]++}END{PROCINFO["sorted_in"]="@val_num_desc";for(i in arr){if(cnt++==10){exit}print arr[i],i}}' access.log

176 192.168.75.1

2 192.168.75.148九、统计独立IP

url 访问IP 访问时间 访问人

a.com.cn|202.109.134.23|2015-11-20 20:34:43|guest

b.com.cn|202.109.134.23|2015-11-20 20:34:48|guest

c.com.cn|202.109.134.24|2015-11-20 20:34:48|guest

a.com.cn|202.109.134.23|2015-11-20 20:34:43|guest

a.com.cn|202.109.134.24|2015-11-20 20:34:43|guest

b.com.cn|202.109.134.25|2015-11-20 20:34:48|guest需求:统计每个URL的独立访问IP有多少个(去重),并且要为每个URL保存一个对应的文件,得到的结果类似:

a.com.cn 2

b.com.cn 2

c.com.cn 1并且有三个对应的文件:

a.com.cn.txt

b.com.cn.txt

c.com.cn.txt命令及结果

BEGIN{ #命令FS="|"

}!arr[$1,$2]++{arr1[$1]++

}END{for(i in arr1){print i,arr1[i] >(i".txt")}

}[root@www test]# cat a.com.cn.txt #查看结果

a.com.cn 2

[root@www test]# cat b.com.cn.txt

b.com.cn 2

[root@www test]# cat c.com.cn.txt

c.com.cn 1十、处理字段缺失的数据

ID name gender age email phone

1 Bob male 28 abc@qq.com 18023394012

2 Alice female 24 def@gmail.com 18084925203

3 Tony male 21 17048792503

4 Kevin male 21 bbb@189.com 17023929033

5 Alex male 18 ccc@xyz.com 18185904230

6 Andy female ddd@139.com 18923902352

7 Jerry female 25 exdsa@189.com 18785234906

8 Peter male 20 bax@qq.com 17729348758

9 Steven 23 bc@sohu.com 15947893212

10 Bruce female 27 bcbd@139.com 13942943905当字段缺失时,直接使用FS划分字段来处理会非常棘手。gawk为了解决这种特殊需求,提供了FIELDWIDTHS变量

FIELDWIDTH可以按照字符数量划分字段

命令及结果

awk '{print $0}' FIELDWIDTHS="2 2:6 2:6 2:3 2:13 2:11" a.txt

1 Bob male 28 abc@qq.com 18023394012

2 Alice female 24 def@gmail.com 18084925203

3 Tony male 21 17048792503

4 Kevin male 21 bbb@189.com 17023929033

5 Alex male 18 ccc@xyz.com 18185904230

6 Andy female ddd@139.com 18923902352

7 Jerry female 25 exdsa@189.com 18785234906

8 Peter male 20 bax@qq.com 17729348758

9 Steven 23 bc@sohu.com 15947893212

10 Bruce female 27 bcbd@139.com 13942943905十一、处理字段中包含了字段分隔符的数据

下面是CSV文件中的一行,该CSV文件以逗号分隔各个字段

Robbins,Arnold,"1234 A Pretty Street, NE",MyTown,MyState,12345-6789,USA需求:取得第三个字段"1234 A Pretty Street,NE"

当字段中包含了字段分隔符时,直接使用FS划分字段来处理会非常棘手。gawk为了解决这种特殊需求,提供了FPAT变量。

FPAT可以收集正则匹配的结果,并将它们保存在各个字段中。(就像grep匹配成功的部分会加颜色显示,而使用FPAT划分字段,则是将匹配成功的部分保存在字段$1 $2 $3...中)

命令及结果

[root@www test]# awk 'BEGIN{FPAT="[^,]+|\".*\""}{print $3}' 6.txt

"1234 A Pretty Street, NE"十二、取字段中指定字符数量

16 001agdcdafasd

16 002agdcxxxxxx

23 001adfadfahoh

23 001fsdadgggggawk字符索引从1开始

命令及结果

第一种查询方式

[root@www test]# awk '{print $1,substr($2,1,3)}' 7.txt

16 001

16 002

23 001

23 001第二种查询方式

awk 'BEGIN{FIELDWIDTHS="2 2:3"}{print $1,$2}' 7.txt

16 001

16 002

23 001

23 001十三、行列转换

文件内容:

name age

alice 21

ryan 30命令及结果

[root@www test]# awk '{for(i=1;i<=NF;i++){if(!(i in arr)){arr[i]=$i}else{arr[i]=arr[i]" "$i}}}END{for(i=1;i<=NF;i++){print arr[i]}}' 8.txt

name alice ryan

age 21 30分析

awk '{for(i=1;i<=NF;i++){ #NF代表这字段数量,所以此时的NF为2,因为只有两列if(!(i in arr)){arr[i]=$i}else{arr[i]=arr[i]" "$i} }}END{for(i=1;i<=NF;i++){print arr[i]}}

' 8.txt十四、行列转换2

文件内容:

74683 1001

74683 1002

74683 1011

74684 1000

74684 1001

74684 1002

74685 1001

74685 1011

74686 1000将文件实现成如下格式

74683 1001 1002 1011

74684 1000 1001 1002命令及结果

[root@www test]# cat 9.awk

{if($1 in arr){arr[$1] = arr[$1]" "$2}else{arr[$1] = $2}

}END{for(i in arr){printf "%s %s\n",i,arr[i]}

}[root@www test]# awk -f 9.awk 9.txt #查看结果

74686 1000

74683 1001 1002 1011

74684 1000 1001 1002

74685 1001 1011十五、筛选给定时间范围内的日志

grep/sed/awk用正则去筛选日志时,如果要精确到小时、分钟、秒,则非常难以实现。

但是awk提供了mktime()函数,它可以将时间转为epoch(1970年到现在)时间值

# 2019-11-10 03:42:40转换成epoch

$ awk 'BEGIN{print mktime("2019 11 10 03 42 40")}'

1573328560借此。可以取得日志中的时间字符串部分,再将它们的年、月、日、时、分、秒都读取出来,然后放入nktim()构建对应的epoch值。因为epoch值是数值,所以可以比较发小、从而决定时间的大小。

下面strptime1()实现的是将10/Nov/2019:23:53:44+08:00格式的字符串转换为epoch值,然后和which_tinme比较大小即可筛选出精确到秒的日志。

BEGIN{#要筛选什么时间的日志,将其时间构造成epoch值which_time = mktime("2023 01 30 17 20 40")

}{#取出日志中的日期哦时间字符串部分match($0,"^.*\\[(.*)\\].*",arr)#将日期时间字符串转换为epoch值tmp_time = strptime2(arr[1])#通过比较epoch值来比较时间大小if(tmp_time > whixh_time){arr1[$1]++

}

}END{PROCINFO["sorted_in"]="@val_num_dexc";for(i in arr1){#设置计数器if(cnt++==10){exit}print arr1[i],i}

}#构建的时间字符串格式为:"10/Nov/2019:23:53:44+08:00"

function strptime2(str,dt_str,arr,Y,M,D,H,m,S){dt_str = gensub("[/:+]"," ","g",str)#gt_str = "10 Nov 2019 23 53 44 08 00"split(dt_str,arr," ")Y=arr[3]M=mon_map(arr[2])D=arr[1]H=arr[4]m=arr[5]S=arr[6]return mktime(sprintf("%s %s %s %s %s %s",Y,M,D,H,m,S))

}function mon_map(str,mons){mons["Jan"]=1mons["Feb"]=2mons["Mar"]=3mons["Apr"]=4mons["May"]=5mons["Jun"]=6mons["Jul"]=7mons["Aug"]=8mons["Sep"]=9mons["Oct"]=10mons["Nov"]=11mons["Dec"]=12return mons[str]

}相关文章:

15个awk的经典实战案例

目录 一、插入几个新字段 二、格式化个空白 三、筛选IPV4地址 命令及结果 第一种查询方式 第二种查询方式 第三种查询方式 四、读取.ini配置文件中的某段 命令及结果 第一种查询方式 第二种查询方式 五、根据某字段去重 命令及结果 第一种方式 第二种方式 六、…...

【JAVA】本地代码获取路径乱码

本地代码获取路径乱码 获取resources下资源乱码 解决方法: 获取路径后把返回值decode下就可以了. 用utf-8编码 String path this.getClass().getResource("").getPath();...

自然机器人最新发布:智能流程助手,与GPT深度融合

ChatGPT自2022年11月上线后就受到现象级地广泛关注,5天时间用户就已经突破百万,仅2个月时间月活用户就突破1亿,成为史上增速最快的消费级应用,远超TikTok、Facebook、Google等全球应用。它展现了类似人类的语言理解和对话交互能力…...

【Mybatis】4—动态SQL

⭐⭐⭐⭐⭐⭐ Github主页👉https://github.com/A-BigTree 笔记链接👉https://github.com/A-BigTree/Code_Learning ⭐⭐⭐⭐⭐⭐ 如果可以,麻烦各位看官顺手点个star~😊 如果文章对你有所帮助,可以点赞👍…...

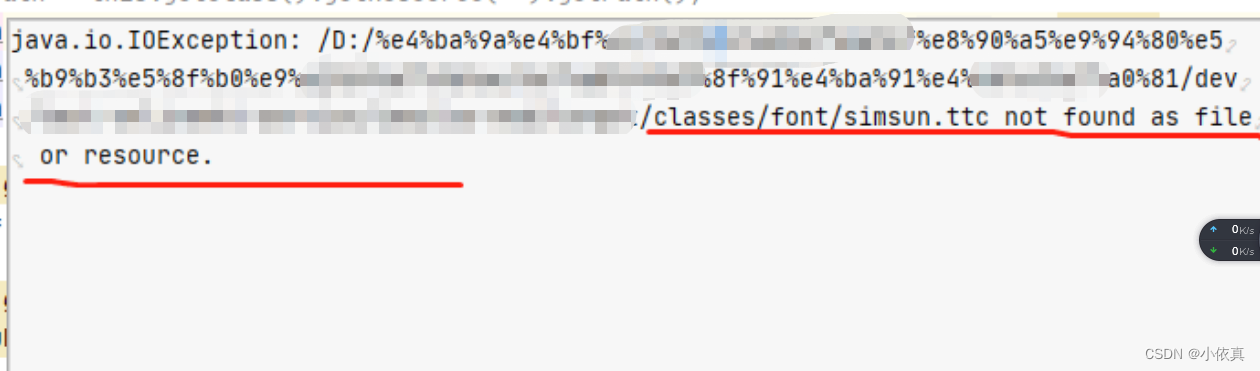

事务传播特性和隔离级别

事务的四大特性 1.原子性(Atomicity):事务不可再分,要么都执行,要么都不执行。 2.一致性(Consistency):事务执行前后,数据的完整性保持一致,即修改前后数据总…...

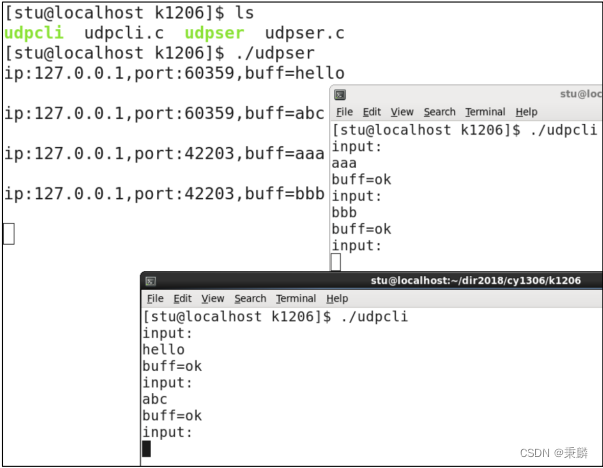

socket网络编程

端口 :主机上一个应用程序的代号(端口不变) 为什么不用PID来表示一个应用 因为PID会变化,而端口是不变的 套接字进程间通信——跨越主机 1、主机字节序列和网络字节序列 主机字节序列分为大端字节序和小端字节序,不同…...

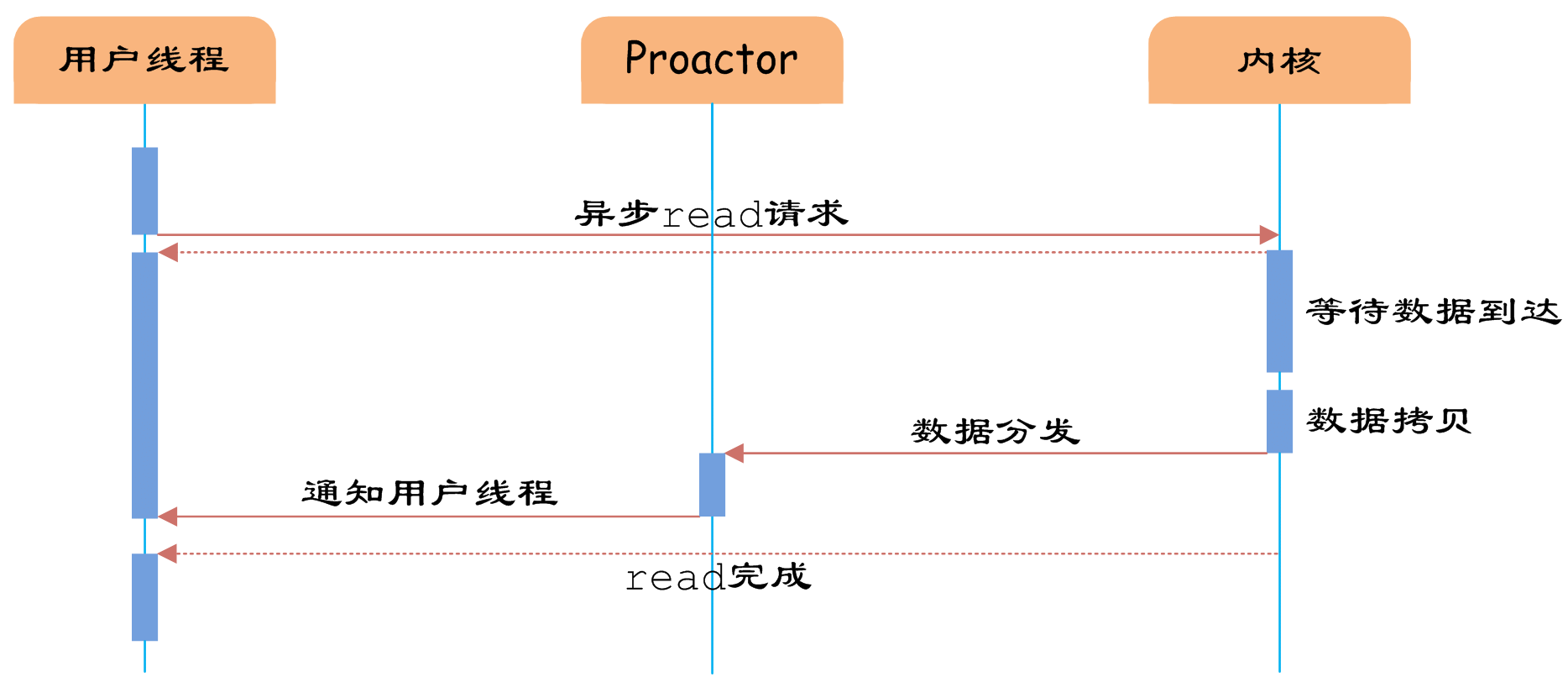

IO多路复用机制详解

高性能IO模型浅析 服务器端编程经常需要构造高性能的IO模型,常见的IO模型有四种: (1)同步阻塞IO(Blocking IO):即传统的IO模型。 (2)同步非阻塞IO(Non-blo…...

选择一款好用的营销项目管理可以更好帮您解决任何问题

营销项目管理软件哪个好用?使用Zoho Projects营销项目管理软件,您可以从营销活动中获得最佳结果,并获得可执行的见解。Zoho Projects的营销项目管理软件可让您和您的团队全面了解您的所有活动。监控您的社交渠道、跟踪结果并在一处进行交流。…...

第三章知识总结(期末复习可用))

计算机网络(第八版)第三章知识总结(期末复习可用)

本笔记来源于博主上课所记笔记整理,可能不全,欢迎大家批评指正,如果觉得有用记得点个赞,给博主点个关注...该笔记将会持续更新...整理不易,希望大家多多点赞。 第一章 第三章 数据链路层 数据链路层属于计算机网络的低…...

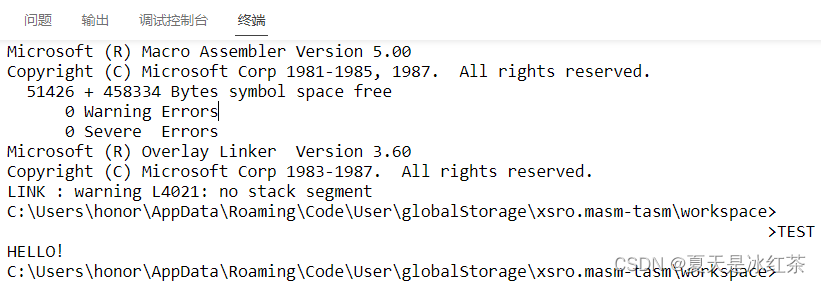

VScode配置8086汇编环境

目录 0、感慨 1、VScode的安装 2、下载MASM/TASM插件 3、测试汇编环境 新建文件 汇编文件配置 汇编代码的运行 0、感慨 搭配一个简单些的环境,对于我们汇编的学习很有帮助,在这里又不得不感叹vscode的强大,使用VScodeMASM/TASM插件就…...

银行数字化转型导师坚鹏:银行同业核心产品与营销策略解读

数字化背景下银行同业核心产品与营销策略解读课程背景: 数字化背景下,很多银行存在以下问题:不清楚银行同业核心产品发展现状?不清楚如何银行同业产品营销策略?不知道如何更好地挖掘他行优质客户? 课…...

在线答题考试小程序源码系统 支持在线刷题+考试二合一+安装部署教程

分享一个在线答题考试小程序源码系统,支持在线刷题考试二合一,程序包含前后端和详细的安装部署教程,可以用来给学生刷题,给员工刷题,给政企员工刷题,万能通用版适合任何行业在线刷题及考试。 系统功能一览&…...

同城跑腿小程序怎么做

随着市场需求越来越大,分工越来明细,很多人看到了跑腿类的商机,特别是学校、小区、商务园等场所。无论是校园跑腿还是社会类跑腿,例中代取快递、代拿包裹、代搬东西上下楼、代排队、帮忙办事、代买东西、代送等等功能都少不了&…...

爬虫逆向学习(五):使用RPC框架serkio解决逆向难题

serkio应用实战前言实战开发多次调用加密方法破解失败如何刷新加密方法同一个浏览器的加密代码如何给不同用户使用注意事项总结前言 最近在工作中遇到了一个反爬虫产品,处于技术能力和新产品迭代更新快的考虑,最后选择使用RPC技术解决问题,因…...

NumPy 秘籍中文第二版:三、掌握常用函数

原文:NumPy Cookbook - Second Edition 协议:CC BY-NC-SA 4.0 译者:飞龙 在本章中,我们将介绍许多常用函数: sqrt(),log(),arange(),astype()和sum()ceil(),modf()&…...

蓝桥杯基础17:BASIC-02试题 序列求和

资源限制 内存限制:256.0MB C/C时间限制:1.0s Java时间限制:3.0s Python时间限制:5.0s 问题描述 求123...n的值。 输入格式 输入包括一个整数n。 输出格式 输出一行,包括一个整数,表示123...n…...

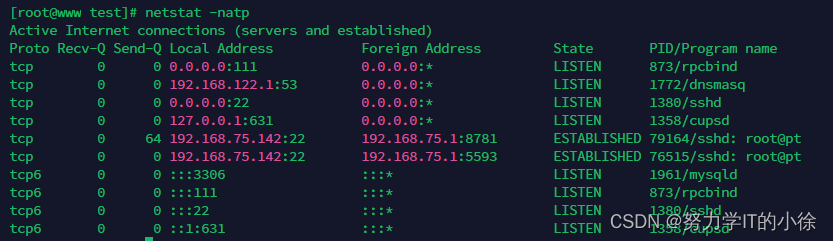

vue移动端实现vue-pdf在线预览与展示,并且解决页面汉字空白的问题

vue移动端实现pdf的页面在线预览展示,CMapReaderFactory可以解决文字不展示、空白问题 //1、安装依赖vue-pdf npm install --save vue-pdf//2、使用组件 <pdf v-for"i in numPages" ref"pdfs" :src"pdfUrl" :key"i" …...

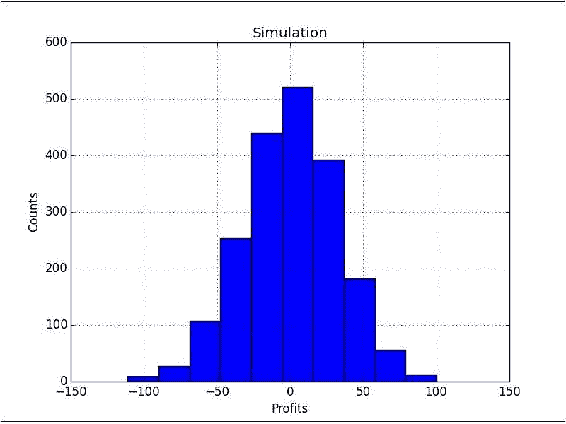

代码随想录算法训练营第四十九天 | 121. 买卖股票的最佳时机、122.买卖股票的最佳时机II

打卡第49天,买卖股票系列了 今日任务 ● 121. 买卖股票的最佳时机 ● 122.买卖股票的最佳时机II 121. 买卖股票的最佳时机 给定一个数组 prices ,它的第 i 个元素 prices[i] 表示一支给定股票第 i 天的价格。 你只能选择 某一天 买入这只股票&#x…...

【职场篇】程序员是否吃青春饭?程序员在35岁之后是否需要转行?

你们好 那么众所周知呢像空姐 还有模特这种职业呢 都是吃青春饭的 那么到了一定年龄呢 他们可能就不做这一行了 那么其实程序员这个职业呢 有的人认为他也是吃青春饭的 普遍人都认为呢 如果程序员做到35岁呢 没有转管理岗位 可能以后就没有什么前途了 可能就要考虑换别的行业了…...

( “树” 之 DFS) 226. 翻转二叉树 ——【Leetcode每日一题】

226. 翻转二叉树 给你一棵二叉树的根节点 root ,翻转这棵二叉树,并返回其根节点。 示例 1: 输入:root [4,2,7,1,3,6,9] 输出:[4,7,2,9,6,3,1] 示例 2: 输入:root [2,1,3] 输出:[…...

终极指南:如何免费解锁Cursor Pro完整功能 - 突破AI编辑器限制的完整方案

终极指南:如何免费解锁Cursor Pro完整功能 - 突破AI编辑器限制的完整方案 【免费下载链接】cursor-free-vip [Support 0.45](Multi Language 多语言)自动注册 Cursor Ai ,自动重置机器ID , 免费升级使用Pro 功能: Youv…...

基于Arduino与TSL2561的光照度测量系统:从硬件连接到软件调试

1. 项目概述:从园艺需求到嵌入式光测量方案最近在折腾一个园艺相关的项目,需要量化评估不同覆盖材料(比如遮阳网、塑料薄膜)对光线透射率的影响。说白了,就是想精确知道,盖上一层材料后,底下还能…...

Scarab空洞骑士模组管理器:2024年最完整的安装与使用指南

Scarab空洞骑士模组管理器:2024年最完整的安装与使用指南 【免费下载链接】Scarab An installer for Hollow Knight mods written with Avalonia. 项目地址: https://gitcode.com/gh_mirrors/sc/Scarab 还在为空洞骑士模组安装的复杂流程而烦恼吗?…...

JetBrains IDE试用期重置终极指南:3种简单方法实现30天无限续杯

JetBrains IDE试用期重置终极指南:3种简单方法实现30天无限续杯 【免费下载链接】ide-eval-resetter 项目地址: https://gitcode.com/gh_mirrors/id/ide-eval-resetter 你是否在使用IntelliJ IDEA、PyCharm、WebStorm等JetBrains IDE时遇到过试用期突然结束…...

AI编程助手CodeBuddy:VS Code扩展的架构、部署与高效使用指南

1. 项目概述:CodeBuddy,你的AI编程伙伴最近在GitHub上看到一个挺有意思的项目,叫codebuddy,作者是olasunkanmi-SE。光看名字就能猜个大概——“代码伙伴”,这显然是一个旨在辅助编程的工具。作为一个在开发一线摸爬滚打…...

AI项目脚手架:标准化与自动化提升工程效率

1. 项目概述:一个为AI项目量身定制的“脚手架”如果你和我一样,在AI领域摸爬滚打多年,从早期的机器学习模型到现在的深度学习、大语言模型应用,肯定经历过无数次从零开始搭建项目的“阵痛”。每次新建一个项目,都要重复…...

开源PCB自动布线神器FreeRouting:5分钟上手,效率提升300%

开源PCB自动布线神器FreeRouting:5分钟上手,效率提升300% 【免费下载链接】freerouting Advanced PCB auto-router 项目地址: https://gitcode.com/gh_mirrors/fr/freerouting FreeRouting是一款功能强大的开源PCB自动布线工具,它能帮…...

工控一体机电脑核心性能特征解析:从选型到部署的实战指南

1. 项目概述:为什么我们需要重新审视工控一体机电脑?在工业自动化、智能制造、智慧零售乃至边缘计算这些听起来高大上的领域里,有一类设备常常是幕后的“无名英雄”,它不像机器人手臂那样引人注目,也不像云端服务器那样…...

如何在Chrome浏览器中快速生成与解析二维码:Chrome QRCode插件终极指南

如何在Chrome浏览器中快速生成与解析二维码:Chrome QRCode插件终极指南 【免费下载链接】chrome-qrcode :zap: A Chrome plugin to Genrate QRCode of URL / Text, or Decode the QRcode in website. 一个Chrome浏览器插件,用于生成当前URL或者选中内容的…...

影刀RPA跨境店群运营架构:基于Python的高并发环境隔离与自动化调度系统设计实战

关于我一个曾经死磕底层算法、痴迷于压榨软硬件性能的资深架构师,最后跑去给跨境工作室写店群底层自动化调度系统这件事。 很多以前在技术圈里混的同行,或者是看着我一路从后端重构做到 ImageTransPro 图像处理软件 5.0.3 这种复杂版本迭代的极客朋友们…...