论文阅读:基于超图高阶表示的WSI生存预测

Generating Hypergraph-Based High-Order Representations of Whole-Slide Histopathological Images for Survival Prediction

文章目录

- 论文介绍

- 快速阅读

- 摘要

- 1 引言

- 2 相关工作

- 2.1 生存分析

- 2.2 超图学习的准备工作

- 3 方法

- 3.1 patch采样和低级特征提取

- 3.2 多超图学习

- 3.2.1 多超图初始化

- 3.2.2 超图最大掩码卷积

- 3.3 高阶生存预测

- 3.3.1 高阶特征融合

- 3.3.2 生存危险预测

- 4 实验

- 4.1 数据集和基准模型

- 4.2 评估指标

- 4.3 补充细节

- 4.4 结果与分析

- 4.5 消融研究和分析

- 4.5.1 聚合策略研究

- 4.5.2 超图最大掩码卷积的研究

- 4.5.3 超图学习的研究

- 4.5.4 回归模型与特征融合研究

- 4.5.5 特征提取器和损失函数的研究

- 4.5.6 可解释性研究

- 讨论、结论及未来工作

论文介绍

本篇论文是清华大学高跃教授团队于2022年发表在IEEE TPAMI上的一篇关于WSI生存预测的论文,其主要思想是利用超图对WSI的特征进行高阶表示。

论文地址为:

https://ieeexplore.ieee.org/abstract/document/9903546

快速阅读

背景:当前方法不能很好地对病理图像的高阶关系进行建模,而只是出于对其低阶特征关系进行建模。

方法:提出超图神经网络,对WSI的高阶关系进行建模

贡献:将超图神经网络应用到WSI生存预测分析中,实现对高阶信息的建模;提出Hypergraph Max-Mask Convolution,缓解过拟合问题

方法:首先进行随机采样和特定区域边缘采样;对采样的patches进行特征提取;对提取的特征进行多种超图建模,形成超图关联矩阵;合并这些超图关联矩阵,进行超图卷积;对节点和超边特征进行融合输入到MLP中进行生存预测

实验:和7种方法进行了对比实验,同时进行了多种消融研究实验,包括单超图和多超图、特征提取的骨干网络选择、损失函数的选择、Hypergraph Max-Mask Convolution中的参数选择等

结论:结果最优,所有实验表明每个提出的方法都有效。

摘要

近年来,基于十亿像素全切片组织病理学图像(WSIs)的患者生存预测越来越普遍。该任务的一个关键挑战是从那些具有高度复杂数据相关性的WSIs中获得信息丰富的特定于生存的全局表示。本文提出了一个基于多超图的学习框架,称为“HGSurvNet”,以解决这一挑战。HGSurvNet通过多空间的多边关联建模和一般超图卷积网络实现了WSIs的有效高阶全局表示。它有能力通过使用一种叫做超图最大掩膜卷积的新卷积结构来缓解由于缺乏训练数据而引起的过拟合问题。在三个广泛使用的癌症数据集上进行了广泛的验证实验:肺鳞状细胞癌(LUSC)、多形性胶质母细胞瘤(GBM)和国家肺筛查试验(NLST)。定量分析表明,结合贝叶斯一致性重新调整损失后,该方法始终优于最先进的方法。我们还展示了所提出框架的每个模块的独立有效性及其在病理诊断和报告方面的应用潜力,这些潜力是由其可解释性潜力所赋予的。

1 引言

在过去的几十年里,数字病理学得到了相当大的发展,因为有可能将病理切片数字化为“全视野数字切片图像”(wsis)[1],[2]。这些十亿像素图像包含诊断病变所需的所有信息[3]。近年来,旨在基于wsis对患者寿命进行建模的生存分析任务[4]、[5]、[6]、[7]受到越来越多的关注,因为它在通过客观分析帮助病理学家的努力方面具有重要的应用潜力。这项任务的关键挑战是如何提取反映患者生存状态的信息和有效的生存特定表示,以做出准确的预测。然而,与常规自然图像(如imagenet[8])不同,wsi数据可能非常大,即图像可能有数十亿个像素,数据相关性非常复杂。这种情况使得现有的被设计用来分析尺寸小得多的自然图像(如256 × 256),且性能良好和复杂的模型[9],[10]几乎不适用于那些十亿像素组织病理学图像。(开篇先利用一句话介绍了背景:数字病理的发展以及WSI的作用。第二句话指出主题:将WSI应用于生存预测分析。第三句点出生存预测分析的挑战。第四句和第五句承接上一句,指出对WSI进行分析与对常规图像进行分析的不同之处,并表明用于常规图像的模型通常不适用于WSI分析)

为了使这些 wsi 数据对AI模型具有可解释性,最近的方法 [4]、[7]、[11] 遵循这样的流程:首先从每个 wsi 中采样许多具有负担得起大小的 patches(例如 256 × 256),然后将这些 patches 堆叠并将它们送到基于CNN的特征提取器(例如vgg[12])中,以生成一个将每个patch视为一个通道的全局表示,如图1b所示。之后,将回归模型应用于全局特征以预测生存分数。这些方法的表示学习能力主要受到在进行patch采样时WSI的结构会被破坏这一事实的限制。DeepConvSurv[13]是第一个利用CNN进行WSI生存预测的模型。为了对patches之间的复杂相关结构进行建模,DeepGraphSurv[5]将图卷积网络应用于基于CNN的特征提取器生成的低级patch特征。然而,将复杂的相关性压缩到成对相关性中,不可避免地会损失被认为对生存预测有价值的信息[14]。如图 1c 所示,该方法中的数据相关性是在成对 patches 上构建的,使得利用病理相关数据相关性相对较弱,而这被认为是高阶信息 [11]、[15]。(这一段的开头承接上一段,用两句话给出当前的方法如何对WSI进行生存预测分析。第三句指出这种流程中的不足之处。之后两句简单介绍前人的工作,逐步将话题引入到为什么要对WSI进行高阶信息建模)

本文通过使用称为“HGSurvNet”的基于多超图的框架,生成有效的高阶生存特定数据相关性表示来解决这一挑战,从而比以前的方法更有效地建模WSI patches的高阶相关性表示。我们的框架主要由两项技术贡献提供支持。HGSurvNet的第一个技术贡献是一个基于多超图学习的框架,用于wsi数据的高阶相关建模。近年来,超图学习在三维点云[16]、高光谱图像[17]、多模态社交媒体数据[18]、细胞信号通路[19]等多种数据的复杂关系建模方面显示出显著优势。为了实现对wsi数据的有效全局表示,本文明确地用多空间的超图对多边数据关联进行建模,并利用多超图学习框架将建模提升到高阶表示。具体而言,我们从wsi patches中的两个典型空间:潜在特征空间和图像空间, 构造了域特定子超图。这就产生了如图1d所示的两种类型的子超图,表型(phenotype-wise)子超图和拓扑型(topology-wise)子超图,它们可以同时在同一个多超图学习框架中探索与视觉外观和空间结构信息相关的数据相关性。为了配合多边数据关联建模,我们还设计了功能强大的高阶特征融合模块,该模块将节点级和超边级高阶特征聚合在一起,形成有效的全局生存预测表示。(这一段开头首先点明本文所提出的方法是如何解决不能生成有效的高阶特征表示,与上一段指出其他方法不足之处做出呼应。随后,描写提出的方法的贡献点并介绍第一个创新点,引入超图这一概念。第四句中,介绍超图,解释其为什么好。第五句,本文超图框架的一个具体内容)

HGSurvNet的第二个技术贡献是一个通用的超图网络,称为超图最大掩码卷积(简称HGMConv)。该网络建立在一般谱超图卷积层[20],[21]上,可以缓解由于训练数据量有限而导致的过拟合问题,帮助模型在测试数据上有更好的表现。我们在实验中发现,所提出的超图最大掩膜卷积可以提高生存预测的鲁棒性和准确性。考虑到wsi数据的标记过程需要专门的诊断训练,成本很高[1],[2],[13],并且医疗隐私是许多患者主要关注的问题,因此超图最大掩膜卷积在将超图学习应用于wsi数据时具有重要意义。(用另外一段说明本文的第二个创新点。首先先告知贡献点,其次说出这个贡献点的作用以及意义)

基于上述两个贡献,我们设计了一个三阶段架构(如图2所示),其中核心多超图学习网络和生存状态回归网络可以端到端方式进行训练。通过这种设计,所提出的方法在使用wsis进行生存预测任务的三个数据集上始终优于最先进的方法(deepconvsurv [13], wsisa [4], GCN [22], deepgraphsurv [5], deepmisl [6], patchgcn[23])。具体来说,使用相同的损失函数(即负cox log部分似然损失函数),它在两个肺癌数据集(即lusc[24]和NLST[25])上的预测精度提高了8.6%,在脑癌数据集(gbm[24])上的预测精度提高了9.1%。(给出整体架构,并说明所提出的方法最优,有多大的提升)

此外,通过可解释性研究,我们发现该方法具有病理区域定位、分布模式、可视化以及表型鉴定和细胞微环境分析的能力,有助于病理诊断和报告。(所提出的方法的其他优势)

本文的其余部分组织如下。第二节总结了前人的工作。第3节详细介绍了HGSurvNet的各个组成模块。第4节对HGSurvNet进行综合评价。最后一部分对全文进行了总结,并对今后的工作进行了展望。(文章结构说明)

2 相关工作

(相关工作基本上是大多数期刊论文中必有的一个部分。这部分主要目的为:为读者展开项目背景,如同讲故事铺垫;展示自己工作与众不同之处,突出贡献。)

2.1 生存分析

首先,传统的生存分析统计方法,估计生存/风险函数,通常分为三个分支,即非参数,半参数和参数。在非参数方法中,广泛采用的算法有kaplan-meier (km)[26]、[27]、nelson-aalen estimator (na)[28]或life-table (lt)[29],这些方法通过经验估计获得生存函数。对于半参数方法,cox模型[30]是最常用的生存数据回归方法,通过建立比例风险假设和部分似然来估计参数。基于cox的半参数分支模型有lasso-cox[31]、ridge-cox[32]、en-cox[33]、[34]等。线性回归、指数分布、威布尔分布、logistic和log-logistic分布、正态分布和对数-正态分布等参数化方法对生存时间的估计更为有效和准确。(由于本文是研究生存预测的,因此在相关工作中首先描述一下传统的生存分析方法)

除了统计方法外,在过去的几年里,人们还提出了许多机器学习模型。生存树[36]、贝叶斯方法[37]、[38]、人工神经网络[37]、[39]、支持向量机(svm)[40]、[41]、[42]、随机生存森林(rsf)[43]、增强一致性指数(boostci)[44]等在选择模型属性超参数时表现更有效,性能更好。(介绍完传统的生存分析方法后,再介绍基于机器学习的分析方法,并说明为什么它能比前一个方法好)

最近,基于深度学习的模型已经超越了上面列出的经典方法的这两个分支。卷积神经网络(cnn)作为主干模型,近年来得到了广泛的探索和成功的应用。deepconvsurv[13]提出了一种深度卷积生存模型,通过增强图像patches,缓解了对大体积样本的需求。该模型的一个主要限制是模型训练需要逐块采样。因此,wsisa[4]试图通过端到端方式对整个切片病理图像进行生存预测来解决这一限制。然而,基于cnn[4],[7],[13]的方法在建模全局拓扑信息方面存在固有的局限性,这对于分析十亿像素的wsis至关重要。这意味着从理论上讲,生存预测模型不能很好地仅仅基于受限的局部接受野。(基本上,传统方法和机器方法结束后,就过渡到了当前流行的基于深度学习的方法(当然这也是因为本文也是基于深度学习做的)。在这个过程中,先介绍部分方法,再提出它们共有的不足)

图神经网络(gnn)[22],[45],[46]因其分析图结构数据的能力而成为一种广泛应用的技术。最近,deepgraphsurv[5]利用谱图卷积算子将局部patch特征和在patch对上学习到的全局拓扑特征同时进行整合。全局拓扑信息和patches之间的相关性可能非常复杂,很难通过deepgraphsurv中使用的成对图结构来建模。所提出的方法与deepgraphsurv[5]的不同之处在于:(1)采用基于多超图的框架来建模高阶相关性,而不是基于图的框架来建模采样的patches的对对相关性;(2)它的表示是建立在特征的节点和超边水平上的,而不是仅仅建立在deepgraphsurv的节点水平特征上。(对于上述的不足,后来的工作是如何进行解决的——图神经网络。同时,介绍本文所给出的图网络与之前的工作不同之处)

除了上述这些单模态模型外,还有一些多模态模型从不同的模态数据中学习病理特性,包括wsi和遗传数据[47],[48],[49],[50]。这些方法理论上对生存分析更有效,因为它们可以利用多模态数据中呈现的互补信息。(简单说明一下生存预测还有哪些类型)

2.2 超图学习的准备工作

超图学习已被广泛应用于识别皮层微回路结构连通性中的非随机结构[21]、识别用于疾病诊断的高阶脑连接组生物标志物[51]、研究功能和结构连接组数据之间的相互关系[52]等任务中。超图学习最早是在[53]中引入的,其中每个节点代表一种情况,每个超边捕获每组节点之间的相关性,学习过程作为传播过程在一个超图上进行。通过这种方法,超图上的转换推理旨在最小化由更多和更强的超边连接的顶点之间的标签差异。然后,将超图学习作为标签传播过程在超图上进行,得到标签投影矩阵[54],或者作为谱聚类[55]。超图学习的其他应用包括视频对象分割[56]、图像排序[57]和地标检索[58]。超图学习具有建模高阶相关性的优势,但对超图上不同顶点的可靠性研究还不够深入,这对进行准确的学习也很重要。(首先具体说明超图学习的一个研究情况。用一个例子说明超图学习的工作流程。之后再说明超图学习的其他应用,并指出超图学习当前的不足)

超图神经网络(hgnn)[20]被设计用于解决复杂高阶表示建模和制定跨模态数据相关性的挑战。为了更有效地利用高阶数据相关性进行表征学习,提出了超图卷积运算(例如,我们任务中的细胞亚型外观,癌症或肿瘤结构,组织层次)。原始HGNN模型[20]主要关注图像分类和视觉目标识别等一般任务。我们提出将不同的超边作为单独的因素,并利用超图结构来表示它们的影响,而不是对多模态数据进行建模。(针对上述问题,现有的方法是如何解决。我们的方法与现有的方法又有什么不同)

3 方法

HGSurvNet包括三个阶段。第一阶段从全片组织病理图像中提取致密且信息量大的patches,提取其低层次视觉特征。千兆像素的组织病理学图像具有许多与生存危险无关的健康组织和细胞对应的像素;基于能提供有效信息的patches的生存状态预测和合理的大小使得学习变得可行。第二阶段执行多超图学习,对采样的patches之间的高阶相关性进行建模。在这一阶段,我们引入了一种多超图结构来为不同特征的复关联构造的子超图生成权值。该阶段可以进行节点-超边-节点的特征转换,可以更好地细化多超图结构的特征 。最大掩码学习策略用于解决这一阶段的过拟合问题,即避免只有优势节点(超边)有助于表征学习的情况。第三阶段首先通过多超图学习对特征进行细化的patches进行全局表示,然后利用回归神经网络预测生存风险评分。在此阶段,通过聚合两级特征来实现全局表示:节点级和超边级特征被集成以生成最终回归的全局特征。这三个阶段一起工作,为wsi数据提供了有效且稳健的病理表示。(介绍方法的整体结构以及各个部分的情况)

3.1 patch采样和低级特征提取

为了尽可能多地提取与生存危害相关的信息,现有方法从wsis[4]、[5]、[6]、[11]中密集抽取随机候选patches,或从专家[1]注释的诊断相关区域抽取patches。如[5]所指出的,有限数量的随机抽样patches可能丢弃与生存状态预测相关的拓扑结构。利用病理专家的注释可以获得高质量的采样,但成本较高。与现有方法不同的是,我们在wsis的信息区域对拓扑patches进行采样,如图3所示。我们提取的patches的主要特点是它能保留感兴趣区域的拓扑信息。我们的实验发现,将基于拓扑patches的采样策略与随机采样策略相结合可以提供更有效的wsis提取。(介绍现有方法如何进行patch采样,并介绍它们的不足之处。再提出自己的采样方法。)

算法1总结了patch采样的步骤。给定wsi,我们首先分割出感兴趣的区域(简称为rois,即含有组织或细胞的信息区域),并利用otsu算法[59](第2-5行)丢弃背景区域。我们使用otsu算法进行这一步,因为它可以通过可调的灰度阈值实现高质量的分割。之后,我们执行两种类型的patch采样。我们首先随机提取rois中的patches,然后提取这些rois的边界以及中心周围的patches(第20-28行)。在这一步中,除了一个roi的边界 B 1 {\mathbb{B}}^{1} B1之外,我们还沿着“同心子边界”提取patches,我们通过将 B 1 {\mathbb{B}}^{1} B1围绕其中心 C \mathrm{C} C缩小 3 4 \frac{3}{4} 43、 1 2 \frac{1}{2} 21、 1 4 \frac{1}{4} 41来生成patches(即 B 3 4 {\mathbb{B}}^{\frac{3}{4}} B43, B 1 2 {\mathbb{B}}^{\frac{1}{2}} B21, B 1 4 {\mathbb{B}}^{\frac{1}{4}} B41,在图3第一行中所可视化)。最后,我们丢弃那些平均色素值较低的patches,并保持信息patches的固定数量n(第10-17行)。(详细介绍自己的采样流程)

在对拓扑patches进行采样后,利用在imagenet[8]上进行预训练的resnet[60]提取每个patch的低层视觉特征。组织病理学图像以重复的结构和组织[1]为主,在视觉外观上不如imagenet[8]中的自然图像样本复杂。预训练的特征提取器能够有效地提取后续多超图学习所需的低级视觉特征。这样,每个patch由一个特征向量 F v ∈ R 1 × C \mathcal{F}_v\in\mathbb{R}^{1\times C} Fv∈R1×C表示(c是特征向量的维度或长度),第一阶段产生n个特征向量 x ∈ R N × C \mathcal{x}\in\mathbb{R}^{N\times C} x∈RN×C,表示一个组织病理学图像。(介绍完采样流程,后续需要接着介绍低级特征的提取。由于这部分不是很重要,所以简单提及)

3.2 多超图学习

在这一阶段,我们显式地对第一阶段提取的拓扑wsi patches之间的复杂高阶关系进行建模。由于给定这些patches,可以构造不同类型的超图,因此我们将此处理表述为多超图学习问题。现有方法[4]、[7]、[13],主要通过视觉特征来探索数据的相关性。我们的方法提供了一个灵活的框架,能够通过使用多个特征信息来建模高阶数据相关性。在我们的实现中,给定提取的拓扑wsi patches,受[5]的启发,我们使用两种重要类型的信息,即表型(视觉外观)和拓扑信息,用于多超图学习。具体来说,学习阶段包括两个顺序模块:多超图初始化和由多个超图卷积层组成的超图卷积。前者构建多超图(即超边组),后者细化节点特征,实现超边级特征。节点特性和超边级特性将在下一阶段进一步聚合。为了缓解数据过拟合问题,在这个阶段,我们没有直接使用超图卷积的一般学习策略,而是设计了一个最大掩码学习策略。这个策略的功能类似于退出策略。在每一层的前馈/后向传播过程中,它降低了最重要的超边(节点)的贡献,这实际上允许更多的节点为表示学习做出贡献。我们把这种最大掩码训练策略赋予的超图卷积层称为超图最大掩码卷积层。接下来,我们详细介绍了多超图初始化模块和超图最大掩码卷积。(多超图学习是本文的全部创新点,里面包含了引言中说的两个贡献,因此,先总的介绍一下这一阶段。介绍内容包括为什么定义多超图学习问题, 现有方法与我们的方法的联系,我们方法的具体实现)

3.2.1 多超图初始化

这一步中的多超图是通过连接两个子超图(即超边组)来构建的,如图4所示。每个子超图都是按照一般的超图构造过程构造的。通过将超图表示为 G = ⟨ V , E , W ⟩ \mathcal{G} = \langle \mathcal{V}, \mathcal{E}, \mathbf{W} \rangle G=⟨V,E,W⟩,其中 V = [ v i ] , i ∈ ( 1 , N ) \mathcal{V}=[v_i], i\in(1,N) V=[vi],i∈(1,N)和 E = [ e j ] , j ∈ ( 1 , E ) \mathcal{E}=[e_j], j\in(1,E) E=[ej],j∈(1,E)分别表示节点和超边的集合, W = [ w j ] , j ∈ ( 1 , E ) \mathcal{W}=[w_j], j\in(1,E) W=[wj],j∈(1,E)是超边的权重。我们将第一阶段提取的patches作为子超图中的节点。(介绍超边的构造过程、给出超图的定义)

初始化包括以下三个主要步骤。(介绍初始化过程)

- 在第一步中,我们将n个patch特征 F v ∈ R 1 × C \mathcal{F}_v\in\mathbb{R}^{1\times C} Fv∈R1×C堆叠起来,其中C表示低级特征向量的长度,并在第 l l l层初始化超图信号矩阵 x ( l ) ∈ R N × C \mathcal{x}^{(l)}\in\mathbb{R}^{N\times C} x(l)∈RN×C。

- 在第二步中,我们生成超边来关联一个节点和它的“邻居”。我们同时考虑潜在特征空间和图像空间中节点的邻居识别。在潜在特征空间中,两个具有相似特征向量的patches可以通过一个公共超边连接起来。相反,在图像空间中,在公共拓扑路径上的两个相邻patches可以通过相同的超边连接。我们将在上述两个空间中生成的子超图命名为表型子超图和拓扑型子超图,如图5所示。对于每个子超图,我们分别生成了一个超图关联矩阵,即 H p h e H_{phe} Hphe(表型子超图)和 H t o p H_{top} Htop(拓扑型超图)。

- 最后一步,我们将两个子超图连接起来,由 H p h e H_{phe} Hphe和 H t o p H_{top} Htop组成一个组合超图关联矩阵 H H H。

具体来说,在表型子超图中,每个节点根据每对节点视觉特征之间的欧几里得距离(即 d ( x i , x j ) , i , j ∈ [ 1 , N ] d(x_i, x_j), i, j\in[1, N] d(xi,xj),i,j∈[1,N])与其k个最近的邻居相连,如式(1)所示

其中 F v i \mathcal{F}_{v_i} Fvi和 F v j \mathcal{F}_{v_j} Fvj分别表示节点 v i v_i vi和 v j v_j vj的低级视觉特征。此时,关联矩阵 H p h e H_{phe} Hphe被构建好。

在 H t o p H_{top} Htop中,每个节点与图像空间中的拓扑邻居相连接,例如,最近的patch属于相同的拓扑路径。在我们的实现中,基于表型的子超图的初始化策略包括ROIs的边界: B 3 4 {\mathbb{B}}^{\frac{3}{4}} B43, B 1 2 {\mathbb{B}}^{\frac{1}{2}} B21, B 1 4 {\mathbb{B}}^{\frac{1}{4}} B41, B 1 {\mathbb{B}}^{1} B1,以及ROIs的中心。 E : = ∣ E ∣ E:=|\mathcal{E}| E:=∣E∣超边中的 N : = ∣ V ∣ N:=|\mathcal{V}| N:=∣V∣可以在关联矩阵 H ∈ R N × E H\in\mathbb{R}^{N\times E} H∈RN×E中用一个二进制0/1表示节点和边的关系。这个关联矩阵中的元素定义为

其中 v v v和 e e e分别表示节点和超边。每条超边 E \mathcal{E} E为相关的patches提供一个通信通道,且这坑对应于一种致病模式。

将两个子超图关联矩阵组合生成多超图的关联矩阵 H H H后,得到多超图拉普拉斯矩阵 L L L,即所得超图的归一化正半定拉普拉斯矩阵可以通过下面的公式得到 (对超图的关联矩阵进行初始化生成后,计算拉普拉斯矩阵)

3.2.2 超图最大掩码卷积

超图最大掩码卷积的结构如图7所示。它使用在[20]中的频谱超图卷积层 H G c o n v ( ⋅ ) HGconv(\cdot) HGconv(⋅)作为主干。每层的卷积运算包括四个步骤,如图6所示。首先,对每条超边连接的输入信号(也就是输入特征) x ( l ) \mathcal{x}^{(l)} x(l)中的节点特征 F v ( l ) \mathcal{F}_{v}^{(l)} Fv(l)进行积分,形成超边特征向量 F e ( l ) ∈ R E × C \mathcal{F}_{e}^{(l)}\in \mathbb{R}^{E \times C} Fe(l)∈RE×C。这一步被称为“超边特征聚合”,如图7所示。这个操作通过 H H H和 F v ( l ) \mathcal{F}_{v}^{(l)} Fv(l)的乘法来实现(见图6的顶部行)。之后,我们对 F e ( l ) \mathcal{F}_{e}^{(l)} Fe(l)的每个维度执行最大掩码操作。max-mask操作不考虑考虑最大值的 λ \lambda λ个主导超边的贡献。由于 F v ( l ) \mathcal{F}_{v}^{(l)} Fv(l)和 F e ( l ) \mathcal{F}_{e}^{(l)} Fe(l)的每一列都是一个属性向量,对应一个特定的影响生存状态的潜在因素,这种操作本质上避免了潜在因素只从少数优势节点(超边)学习的情况,从而缓解了过拟合问题。此步骤在图7中称为“max-mask”,并在图6的第二行中进行说明。(详细描述所提出的第二个贡献点,即Hypergraph Max-Mask Convolution)

接下来,在称为“节点特征聚合”的步骤中,通过聚合相关的超边特征来获得输出节点特征 F ~ v ( l ) \tilde{F}_v^{(l)} F~v(l),这是通过将矩阵 H T H^T HT相乘来实现的,如图6第三行所示。

最后,通过可学习参数 Φ ( l ) \Phi^{(l)} Φ(l)(一个对角矩阵),在一个称为“节点特征重加权”的步骤中,对输出节点特征 F ~ v ( l ) \tilde{F}_v^{(l)} F~v(l)进行进一步加权,然后使用非线性激活函数 σ ( ⋅ ) \sigma(\cdot) σ(⋅),如图6底部一行所示。因此,超图最大掩码卷积层 H G M c o n v ( ⋅ ) HGMconv(\cdot) HGMconv(⋅)的表达式可以定义为

其中 x ( λ ) \mathcal{x}^{(\lambda)} x(λ)是一个偏移矩阵,仅保留每个属性特征向量的顶层 λ \lambda λ维的稀疏负值,其余为零。 H − 1 ( I − L ) x ( λ ) H^{-1}(I-L)\mathcal{x}^{(\lambda)} H−1(I−L)x(λ)函数在计算梯度或更新节点特征时忽略当前层的top λ \lambda λ属性特征维度。 σ ( ⋅ ) \sigma(\cdot) σ(⋅)表示非线性激活函数(如 L e a k y R e L U ( ⋅ ) LeakyReLU(\cdot) LeakyReLU(⋅))。 Φ ( l ) \Phi^{(l)} Φ(l)表示第L层的可学习参数,作用类似于MLP层。

3.3 高阶生存预测

3.3.1 高阶特征融合

高阶特征融合模块是将超图最大掩码卷积模块输出的节点级特征 X ( n ) \mathcal{X}^{(n)} X(n)和超边级特征 F e ( n ) \mathcal{F}^{(n)}_e Fe(n)两个高阶特征进行聚合,形成每个wsi的全局表示。我们在这个模块中的聚合策略是直观的,可学习的,如图7左边所示。首先对每一层的特征并行进行聚合,形成两个全局特征向量,然后通过特征融合模块(feature fusion module, ffm)将两个全局特征向量拼接成一个全局特征向量。具体来说,对于节点级特征,我们学习一个全局潜在(属性)特征向量 F n o d e \mathcal{F}_{node} Fnode,其中每个潜在因素的相对权重是通过所有节点的聚合获得的(即,执行 X ( n ) \mathcal{X}^{(n)} X(n)的转置和一个可学习的权重向量 X A \mathcal{X}_A XA的乘法)。我们对超边级特征 f h y p e r e d g e \mathcal{f}_hyperedge fhyperedge使用了类似的聚合策略,即执行 F e ( n ) \mathcal{F}^{(n)}_e Fe(n)的转置与另一个可学习的加权向量 E A \mathcal{E}_A EA的乘法。FFM可以通过几种方法实现,包括均值融合、最大融合、随机融合[61]、lp融合[62]等。 (介绍高阶特征融合的实现步骤。开头先描述什么是高阶特征融合模块,之后再描述它的实现步骤)

3.3.2 生存危险预测

后续的生存风险预测模块是一个回归网络,以全局高阶表示作为输入,输出最终的生存风险评分。在我们的实现中,我们使用多层感知器(mlp)[63],[64],从全局高阶特征中回归危险评分。采用的mlp非线性回归由三个全连通层和Sigmoid激活函数组成。值得一提的是,回归网络也可以被其他广泛使用的方法替代(如cox [30], en-cox [34], boostci [44], lasso[31])。我们在下一节的实验结果将表明,所采用的mlp可以获得相对更好的整体性能。(介绍如何实现生存风险预测)

在整个框架中,超图卷积、高阶特征融合以及生存风险预测模块可以端到端进行训练。三种损失可用于训练。第一个是均方误差损失(mse),定义为

其中 h h h和 h ^ \hat{h} h^分别表示一张WSI的预测风险分数和真实风险分数。 P P P训练过程中批处理的WSI patch数量。第二个损失函数是deepgraphsurv[5]中采用的负cox log偏似然损失函数,表示为:

其中 s i p s_i^p sip和 s i q s_i^q siq分别表示预测结果和真实值。 M \mathcal{M} M是可比较配对的数量,来源于患者的数量。第三种损失是贝叶斯一致性重新调整(bcr)损失[15],该损失以成对样本的一致性率和点向预测误差重建为监督。它包括 L M S E \mathcal{L}_{MSE} LMSE作为其组件,并定义为

4 实验

4.1 数据集和基准模型

我们主要在三个数据集上评估所提出的方法,包括两个肺癌数据集(即lusc [24], NLST[25])和一个脑癌数据集(即GBM[24])。lusc和GBM均来自通用癌症患者数据集tcga[24]。这些数据集中有不同数量的患者,每个患者至少有一个wsi。这些病人的生存时间因人而异。表1总结了每个数据集的重要统计数据。(基本在所有论文的实验部分,都会描述使用的数据集、对比的方法以及评估指标和优化细节等, 这里先介绍所使用的数据集)

在我们的实验中,数据划分是在两种设置下进行的。第一个设置称为“Sub-Set”,遵循先前工作[4]、[5]、[7]的实验设置,并使用相同数量的wsi数据。另一种设置被称为“Whole-Set”,使用所有wsi数据进行实验。监测数据,例如, 一个患者生存时间为 T i T_i Ti的WSI的归一化危险评分 h ^ i \hat{h}_i h^i可以通过下面的公式计算

其中 T m a x , T m i n T_{max}, T_{min} Tmax,Tmin分别表示每个数据集中最长和最短的患者生成时间。生存预测模型除了对[0,1]范围内的危险评分进行回归外,通常还会给出二值预测结果,提示受试者属于高危组还是低危组(即危险评分大于平均分数的患者将被预测为高危患者)。(介绍数据集的划分以及 h ^ i \hat{h}_i h^i的计算方式。同时介绍哪些属于高危患者,哪些属于低危患者)

我们将提出的方法与以下几个基线进行比较:(介绍基准模型)

- deepconvsurv[13]是第一个提出的基于wsi的基于cnn的生存预测模型。它以全片组织病理图像中采样的patches (224px × \times × 224px)作为输入,并通过cox[30]预测存活风险。根据色素阈值由otsu[59]生成。

- wissa[4]是另一种基于cnn的预测模型,该模型包括三个阶段,例如随机采样不包括含有少量细胞的边缘区域的patches,同时使用resnet-50[60]提取特征,用lasso-cox[31]预测生存危险评分。

- gcn[22]是一个通用的基于图卷积网络的模型。与wissa相同,它将随机采样的patches作为输入,首先提取底层视觉特征。然后,利用欧氏距离阈值建立图的结构。经过三层图卷积层后,生成的表示被馈送到最终的回归层(mlp)并得出最终的生存风险评分。

- deepgraphsurv[5]采用频谱gcn考虑拓扑关系,然后通过注意机制放弃几个不太重要的patches。我们遵循与deepgraphsurv[5]中所示的相同设置,输入数据与wisa相同。其回归模型采用cox回归模型[30]。

- Deepmisl[6]考虑来自一位患者的多张幻灯片,并对局部和全局表示进行预测。我们遵循deepmisl[6]中报告的实验设置。输入与wissa相同,用mlp预测危险评分。

- Ranksurv[15]是一个基于指标驱动的成对排名网络。采用传统的超图神经网络[20]实现对wsi数据生存预测的高阶表示。

- Patch-gcn[23]使用上下文感知、空间分辨的基于补丁的图卷积网络,通过分层聚合实例级组织学特征,对肿瘤微环境中的局部和全局级拓扑结构进行建模。其特征提取器使用预训练的resnet-50,最后一隐层采用基于交叉熵的cox比例损失函数[65]。

4.2 评估指标

采用三个评价指标来衡量预测精度。

- c-index[66]。C-index通常用于衡量模型根据个体风险评分正确提供可靠的生存时间排名的能力。C-index可由以下公式计算。C-index的值在[0,1]范围内,值越大,说明性能越好,反之亦然。

- 受试者工作特性(roc)[67]。Roc曲线是评估二元分类器诊断能力的另一个标准工具,因为它的判别阈值是不同的。roc曲线可以通过绘制各种阈值设置下的真阳性率(tpr)和假阳性率(fpr)来创建。roc空间由FPR和TPR分别定义为x轴和y轴,它描述了真阳性和假阳性之间的相对权衡。随机猜测会给出从左下角到右上角的对角线上的一个点。对角线划分了roc空间。对角线以上的点表示分类结果好(优于随机),线以下的点表示分类结果差(比随机差)。

- Km-estimation[26]是一种报告连续跟踪时间内存活患者比例的工具。它还可以直观的直观的对二元分类器的性能进行比较,即低、高风险组的两条曲线之间的差距越明显,表明分类越准确。km估计曲线可由下式计算

4.3 补充细节

在patch采样步骤中,我们采用文献[68]中发布的名为“openslide”的公共工具箱,提取尺寸为224px × \times × 224px、物镜放大倍数为20 × \times ×的patches。总的来说,对于每个wsi,我们从生成的roi中收集2,000个patches,遵循与之前工作[4],[5],[7],[15]相同的设置。每个patch的低级视觉特征通过在imagenet[8]上预训练的resnet-50提取,其维数为 x i ∈ R 1 × 512 \mathcal{x}_i \in \mathbb{R}^{1\times 512} xi∈R1×512。超图顶点矩阵 X ∈ R 2000 × 512 \mathcal{X} \in \mathbb{R}^{2000\times 512} X∈R2000×512是通过垂直堆叠 x i \mathcal{x}_i xi建立的。我们进行了10倍交叉验证,以综合评价所提出的方法和比较方法。每个数据集的原始wsi样本被随机分成10个大小相等的组。10组中,保留1组作为验证数据对模型进行检验,其余9组作为训练数据。然后重复交叉验证过程10次,10组中的每组只使用一次作为验证数据。然后可以对这10个结果取平均值以产生最终的估计。为了选择k近邻(knn)算法[69]在生成表型子超图时的最优参数k,并研究不同k值的影响,我们进行了k从5增加到20的实验。我们对训练集进行了10倍交叉验证,发现k=9时给出了最好的总体结果。图9显示了在所有三个数据集上的整体验证结果,我们可以看到所采用的方法HGSurvNet的模型性能对k不敏感。(介绍补充细节,如实验设置,patch的采样方式等)

超图最大掩码卷积层数设为3。将eq.(5)中的 λ \lambda λ设为E×0.25(E为 F e ( l ) \mathcal{F}_e^{(l)} Fe(l)的维数)。对于训练,我们使用动量为0.9的随机梯度下降,权重衰减 5 × 1 0 − 4 5\times 10^{-4} 5×10−4,小批大小为32。首先设置学习率为 1 0 − 4 10^{-4} 10−4,然后在50次之后降低为 1 0 − 5 10^{-5} 10−5。在与基线方法的比较中,我们使用的架构采用随机融合[61]进行节点和超边级特征融合,并使用mlp进行回归网络,因为这些组件提供了最佳性能。为了公平比较,我们在损失函数设置相同的情况下,将HGSurvNet与其他方法进行了比较。在预处理阶段,使用resnet-50提取2000个patches的视觉特征,用于我们的方法和对比。我们使用8 geforce rtx 1080 ti gpu对提案模型进行了1000次的训练。训练大约在8小时(700次)后收敛,每个wsi的推理时间不到35毫秒。相比之下,基于gnn的方法[5]、[22]在相同设置下耗时约14小时,比我们的方法多6小时。基于cnn的方法[4],[6],[13]比我们的方法快4小时左右,但性能更差,如表2所示。(其他的设置与实验结果)

4.4 结果与分析

c-index对Whole-Set和Sub-Set的性能比较分别总结于表2和表3。10次重复试验的统计比较如图8所示。值得一提的是,所有的基线方法都没有公布其源代码,我们使用这些原始研究报告的结果进行Sub-Set的比较。在Whole-Set上,我们根据自己对这些基线方法的实现报告结果。基于c-index测量的定量结果,我们可以看到基于cnn的模型(即deepconvsurv、deepcorrsurv、wisa)的性能普遍不如基于图结构的方法(即gcn、deepgraphsurv、patch-gcn、hgsurnet)。例如,在nlst的whole-set的设置上,gcn、deepgraphsurv、patch-gcn、ranksurv和hgsurvnet分别比wisa获得了3.74%、6.76%、7.93%、12.84%和13.65%的增益。结果表明,图结构捕获的高阶信息可以提高生存预测的性能。这些定量结果也清楚地表明,hgsurvnet在所有三个数据集上都优于其他竞争对手。例如,与gcn相比,hgsurvnet在lusc、gbm和nlst的子集设置上的增益分别为7.92%、7.27%和8.79%。在lusc、gbm和nsl的全套指标上,hgsurnet的收益分别为6.07%、6.82%和9.91%。(先说明实验结果的来源,例如从其他论文中给出,或者自己复现,或者论文给的代码复现等。分析实验结果)

与最新的工作Patch-GCN[23]相比,我们的方法hgsurnet在lusc、gbm和nlst的集合上分别实现了5.96%、5.01%和7.23%的增益。结果表明,在patch-gcn中,基于全局组织之间高阶病理相互作用和高阶拓扑模式的特征可能比由实例级局部邻域图产生的上下文感知特征具有更显著的效果。值得一提的是,与deepconvsurv[13]的定量比较可能不公平,因为deepconvsurv[13]的结果是在从病理学注释区域采样patches的情况下产生的,而不是在我们和其他方法中从排除非组织区域的wsis随机采样。(继续分析实验结果,给出结果好的可能原因等)

图10通过KM-estimation曲线比较了hgsurvat与其他两种最先进的方法在lusc、GBM和nlst的集合设置的训练集和验证集上的二元风险分类能力,即将高风险组与低风险组分开。我们可以清楚地看到,在所有的验证集上,hgsurvnet在低风险组和高风险组的曲线之间有最显著的差距,尽管deepgraphsurv和deepmisl在所有的训练集上都有接近的差距。这表明hgsurnet可以更有效地对低、高风险患者进行分类。此外,我们还可以看到,hgsurv在训练集和验证集上的表现比deepgraphsurv和deepmisl更接近。这可能是因为hgsurvnet中基于超图最大掩码卷积的网络设计缓解了过拟合问题。接下来,我们研究了hgsurnet中每个技术组件对预测性能改进的贡献。(分析第三个评估指标的结果)

4.5 消融研究和分析

在本节中,我们对lusc、gbm和NLST在Whole-Set进行了实验,以研究不同成分在所提出的hgsurvey中的独立贡献。(整体介绍消融研究内容和目的)

4.5.1 聚合策略研究

这组实验研究了模型在不同聚合策略下的表现:hgsurvnet-node(仅具有节点级聚合),hgsurvnet-hyperedge(仅具有超边级聚合),以及采用的融合节点级和超边级表示的聚合策略。结果如表4所示。结果表明,hgsurvnetnode在NLST和lusc这两个肺癌数据集上的性能优于hgsurvnet-hyperedge,而hgsurvnet-hyperedge在GBM中处理脑癌数据的能力强于hgsurvnetnode,即hgsurvnet-hyperedge和hgsurvnet-node在不同癌症数据集上表现出各自的优势。此外,我们还可以看到,通过比较使用相同回归模型的结果,所采用的聚合策略在所有三个数据集上的性能始终优于hgsurvnet-node或hgsurvnet-hyperedge。结果表明,该融合策略可以利用节点级和超边级表示中的互补信息,提供更准确的预测。(其实和分析对比实验结果那一块的描述差不多。先提出研究的聚合策略有哪几种,再给出在不同数据集中的结果以及分析的情况。后续的消融研究也类似)

4.5.2 超图最大掩码卷积的研究

这组实验研究了参数 λ \lambda λ的不同设置如何影响表示。我们在所有数据集上,从 λ = 0 \lambda=0 λ=0,即超图最大掩码卷积层退化为没有任何掩码信息的典型超图卷积层,开始实验。然后我们以0.05×E的大小逐渐增加 λ \lambda λ,发现模型的性能在所有数据集上都持续上升,在0.25×E左右达到峰值,然后一直下降,直到0.40×E时实验结束。用C-index测量的实验结果如图11所示。表明遮蔽一定数量(即前25%)的优势属性特征维度,一般可以提高预测精度。但是,过小的信掩比(即 λ \lambda λ过大)会导致预测性能下降。与超图卷积卷积(即 λ = 0 \lambda=0 λ=0)相比,我们可以看到所提出的超图最大掩码卷积最多可以提高约2%的c-index。从图12所示的roc曲线中,我们可以看到,当三个数据集的训练集(红色曲线)的信掩比减小时,roc曲线几乎没有变化。然而,roc曲线在验证集上的变化要显著得多。roc曲线在 λ = 0.25 × E \lambda=0.25\times E λ=0.25×E附近显示出最佳的预测性能,这证实了我们对基于C-index的结果的观察。

4.5.3 超图学习的研究

这组实验研究了基于多超图的学习是否能比基于单超图的学习获得更高的预测精度。除了采用图5所示的多超图外,我们还构建了另外两种类型的架构。在第一种架构(称为 H p h e H_{phe} Hphe)中,我们删除了拓扑相关的子超图,只保留了表型相关的子超图。在另一个被称为 H t o p H_{top} Htop的模型中,我们删除了表型的子超图,只保留了拓扑型的子超图。表5总结了这两种类型的体系结构以及所采用的基于多超图的体系结构 H H H在所有三个数据集上的结果。我们可以看到 H p h e H_{phe} Hphe在所有三个数据集上的性能都比 H t o p H_{top} Htop高出2%到3%。这可能是因为 H p h e H_{phe} Hphe比 H t o p H_{top} Htop使用了更多的patch样本,因此更具代表性。在所有三个数据集上, H H H始终优于 H p h e H_{phe} Hphe或 H t o p H_{top} Htop。这表明空间结构信息与视觉外观信息是互补的。更重要的是,它揭示了所提出的多超图学习框架在整合来自不同子超图的互补信息方面的潜力。

4.5.4 回归模型与特征融合研究

这组实验研究了哪种回归模型和特征融合对所提出的框架更强大。我们主要研究和比较了四种经典回归模型,包括生存预测中常用的三种半参数正则化cox模型,即lasso-cox[31]和boosting cox模型(coxboost)[44]和elastic-net penalized cox模型(en-cox)[34]以及多层感知器(mlp)。对于特征融合模块,即图7中的FFM,我们研究了四种不同的特征融合模块,包括均值融合、最大融合、随机融合[61]和lp融合[62]。因此,总共有4×4种不同类型的回归与特征融合组合模块。表4显示了三种数据集在随机融合下不同回归模块的结果。我们可以看到,MLP比所有其他回归模型的表现都要好得多。具体而言,与lasso-cox、cox-boost和en-cox相比,所提出的hgsurnet中的MLP在所有三个数据集上分别将c-index测量的回归精度提高了约4%、3%和2%。这可能是因为基于三层完全连接的多层感知器比模型参数大小接近单层MLP回归器的cox模型更强大。表6表明,四种不同的特征融合模块在三个数据集上没有显着差异。一般来说,随机融合在所有三个数据集上显示出轻微的优势,在c指数上小于1%。这些结果表明,在整个框架中,回归模块对回归精度的影响大于特征融合模块。

4.5.5 特征提取器和损失函数的研究

这组实验研究了骨干特征提取器和损失函数对整体回归精度的影响程度。

我们通过消融实验对vgg[12]、采用的resnet[60]以及两种典型的Transformer骨干:swin-transformer[71]和vit[70]进行了研究和比较。表7所示的结果表明,在wsi patches上使用的不同特征提取器对wsi数据的全局表示没有显著差异,这表明了所提出框架的通用性和鲁棒性。我们还可以观察到,Transformer模型[70],[71]不能超过所采用的resnet,尽管它们在各种计算机视觉任务上显示出优于cnn的优势,这可能是由于摄影图像(例如imagenet[8]中的图像)与wsis之间存在显着的域差距。另一个原因可能是与传统cnn相比,基于Transformer的方法倾向于在较小的数据集上过拟合。

最近的研究[15]发现BCR损失比mse损失在生存预测问题上更有效。另一组实验进行了比较BCR损失和mse损失之间的性能差异在提出的框架。我们用BCR损失代替mse损失,并使用相同的实验设置重新训练网络。表8的结果表明,监督数据提供的额外成对一致性关系可以进一步提高所提出框架的预测精度。

4.5.6 可解释性研究

这组实验评估了我们的预测模型的可解释性,即确定我们的模型是否有助于辅助病理诊断和报告。具体来说,我们确定了我们的模型是否能够从极大的wsi 切片中定位病理区域,并识别其局部细胞微环境和全局分布模式。我们的解决方案是,从测试数据集中的wsi 切片的采样patches中提取对预测危害评分贡献更多信息的patches,即具有代表性的病理patches,分析其微环境和全局分布格局是否能够支持病理学家的诊断。

为了定位这些具有代表性的病理patches,我们转向选择用于研究的wsi幻灯片的潜在属性空间。具体来说,我们在训练模型的最后一层分配K=5个最高权重的top K=5个潜在属性向量中,识别出具有最大元素值的M=40 个patches。我们为每个切片提取并高亮M×K=200个具有代表性的病理patches,用不同的颜色(按照每个潜在属性的显著性顺序分别为红色、橙色、蓝色、青色、绿色),如图13所示。本研究邀请一位病理学家对所选的wsi切片进行诊断。

从图13中我们可以看出,高亮显示的对同一潜在属性贡献最大的patches具有相似的视觉特征,例如细胞核密集程度相似,核核紧密突出,或patches表现出相似的多形性水平,这表明我们的模型能够总结出微环境分析的表型,类似于病理学家的诊断。我们还观察到,突出显示的patches也可以呈现每个潜在属性所识别的表型的分布模式。例如,在从nlst开始存活145天的lusc 切片中,我们可以在患者的肺部看到多形性程度高的红色patches,而在存活570天的切片中,多形性程度相对较低的红色patches似乎聚集在肺内的一个局部区域,严重拥挤。与存活时间为2789天的切片相比,这两种病例的危险评分都更高,其中具有代表性的patches在患者肺部的散射程度要低得多。

可视化的病理信息表明,我们的模型能够实现病理区域定位、病理区域分布模式和强度可视化、表型鉴定和细胞微环境分析,这对病理诊断和报告至关重要。

讨论、结论及未来工作

本文提出了一个多超图端到端学习框架,称为HGSurvNet,用于生存预测。HGSurvNet将患者的全部切片图像作为输入,并回归显示其生命持续时间的危险评分。HGSurvNet在两个肺癌数据集(lusc和nlst)以及脑癌数据集(gbm)上表现出一贯的优越性能,并在很大程度上优于最先进的方法。结合以成对样本的一致性率为监督的贝叶斯一致性再调整(bcr)损失,HGSurvNet可以有效地提高lusc、gbm和nlst的预测精度。这是通过生成有效的高阶全局特征表示来实现的,这对于以前基于点或基于成对关系的学习框架来说是很难实现的,通过两个主要的技术贡献:基于多超图的高阶表示学习框架和一般超图卷积网络。后者能够缓解由于训练数据数量有限而导致的过拟合问题。当将基于超图的学习框架应用于wsi数据时,网络具有重要意义,因为医疗隐私是许多患者关心的主要问题。(首先给出结论,即总结全文。内容主要为:提出了什么框架,实验证明其结果最好,创新点是什么,有什么意义)

我们希望从几个方面扩展这项工作。首先,我们进行了实验,以证明在自然图像数据集(imagenet)上预训练的低级特征提取器能够为wsis提取视觉特征。相关工作[4],[6]已经验证了这些预训练的vgg或resnet模型能够提取涉及复杂组织模式的特征。注意到在bert[72]、xlnet[73]、videobert[74]等大规模数据集上预训练模型的成功,我们认为在大规模组织病理学特定数据集上进行预训练是必要的,并将促进相关的下游任务[75]、[76]、[77]、[78]。通过随机屏蔽patches编码并使用上下文信息预测相应的病理表征,可能是实现这一目标的实用方法。有了更强大的病理特异性特征提取器,我们的框架不仅可以更有效和稳定地执行生存预测,而且可以改善相关的下游子任务。(讨论未来的工作方向)

目前的框架侧重于使用单个整张幻灯片图像进行存活预测。当患者进行第一次完整的切片成像时,这种应用场景很常见。研究这个问题是有意义的,因为第一手的早期诊断对治疗至关重要。通过洞察分析和综合实验,我们看到了所提出的框架的有效性和通用性,以及将其应用于更广泛的场景的潜力,包括生存预测,使用多个数字化整片图像(wsis)的连续组织学切片,甚至使用多模态病理和临床数据。(讨论未来的工作方向)

相关文章:

论文阅读:基于超图高阶表示的WSI生存预测

Generating Hypergraph-Based High-Order Representations of Whole-Slide Histopathological Images for Survival Prediction 文章目录 论文介绍快速阅读摘要1 引言2 相关工作2.1 生存分析2.2 超图学习的准备工作 3 方法3.1 patch采样和低级特征提取3.2 多超图学习3.2.1 多超…...

-关系抽取(Relation Extraction, RE)任务训练模板)

NLP常见任务专题介绍(1)-关系抽取(Relation Extraction, RE)任务训练模板

📌 关系抽取(Relation Extraction, RE)任务训练示例 本示例展示如何训练一个关系抽取模型,以识别两个实体之间的关系。 1️⃣ 任务描述 目标:从文本中提取两个实体之间的语义关系,例如 “人物 - 组织”、“药物 - 疾病”、“公司 - 创始人” 等。输入:句子 + 标注的实…...

27. Harmonyos Next仿uv-ui 组件NumberBox 步进器组件禁用状态

温馨提示:本篇博客的详细代码已发布到 git : https://gitcode.com/nutpi/HarmonyosNext 可以下载运行哦! 文章目录 1. 组件介绍2. 效果展示3. 禁用状态设置3.1 整体禁用3.2 输入框禁用3.3 长按禁用 4. 完整示例代码5. 知识点讲解5.1 禁用状态属性5.2 禁用…...

docker无法pull镜像问题解决for win10

docker无法pull镜像问题解决for win10 问题原因分析解决方法 问题 在win10系统上安装好doker-desktop后ping registry-1.docker.io不同,并且也无法登陆hub.docker.com, 使用docker pull xx也无法正常下载 原因分析 hub.docker.com在2024年5月之后,国内…...

批量将 Excel 转换 PDF/Word/CSV以及图片等其它格式

Excel 格式转换是我们工作过程当中非常常见的一个需求,我们通常需要将 Excel 转换为其他各种各样的格式。比如将 Excel 转换为 PDF、比如说将 Excel 转换为 Word、再比如说将 Excel文档转换为图片等等。 这些操作对我们来讲都不难,因为我们通过 Office 都…...

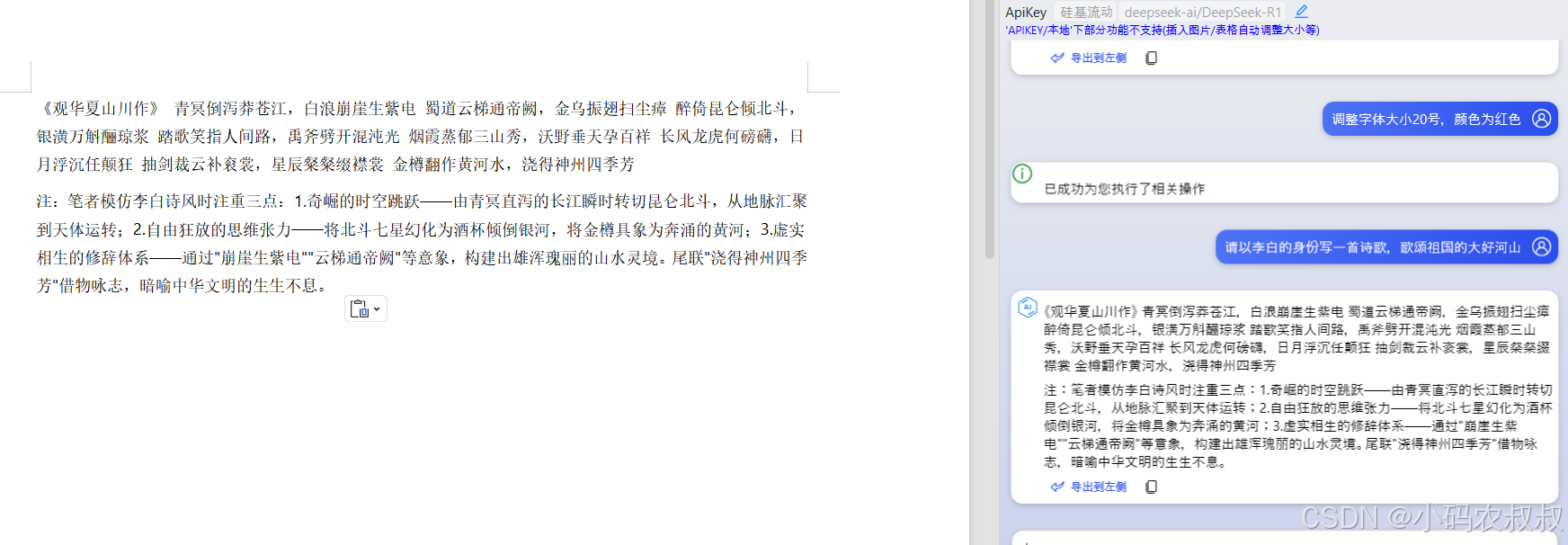

Node.js调用DeepSeek Api 实现本地智能聊天的简单应用

在人工智能快速发展的今天,如何快速构建一个智能对话应用成为了开发者们普遍关注的话题。本文将为大家介绍一个基于Node.js的命令行聊天应用,它通过调用硅基流动(SiliconFlow)的API接口,实现了与DeepSeek模型的智能对话…...

Mac同时安装jdk8和jdk17,默认选择jdk8

在Mac上同时安装JDK 8和JDK 17,并设置默认版本为JDK 8,可以按照以下步骤操作: 一、下载并安装JDK 8和JDK 17 下载JDK 8 访问Oracle JDK下载页面。在“Java SE Archive Downloads”部分,找到JDK 8的下载链接。选择适合您Mac芯片类…...

【Zinx】Day5-Part3:Zinx 的连接管理

目录 Day5-Part3:Zinx 的连接管理创建连接管理模块将连接管理模块集成到 Zinx 当中将 ConnManager 集成到 Server 当中在 Connection 的工厂函数中将连接添加到 ConnManagerServer 中连接数量的判断连接的删除 补充:连接的带缓冲发包方式补充:…...

网络安全之RSA算法

1978年就出现了这种算法,它是第一个既能用于数据加密也能用于数字签名的算法。它易于理解和操作,也很流行。算法的名字以发明者的名字(RonRivest,AdiShamir和LeonardAdleman)命名。但RSA的安全性一直未能得到理论上的证…...

Unity Dots

文章目录 什么是DotsDOTS的优势ECS(实体组件系统)Job System作业系统Burst编译器最后 什么是Dots DOTS(Data-Oriented Technology Stack)是Unity推出的一种用于开发高性能游戏和应用的数据导向技术栈,包含三大核心组件…...

设计模式-结构型模式-桥接模式

概述 桥接模式 :Bridge Pattern: 是一种结构型设计模式。 旨在将抽象部分与实现部分分离,使它们可以独立变化。 它通过组合代替继承,解决类爆炸问题,并提高系统的灵活性和可扩展性。 组成部分 【抽象部分】(…...

Ultravox:融合whisper+llama实现audio2text交互

Ultravox是由Fixie AI开发的一种创新型多模态大语言模型,专为实时语音交互设计。与传统的语音交互系统不同,Ultravox无需单独的语音识别(ASR)阶段,可以直接理解文本和人类语音,实现更快速、更自然的交互体验。Ultravox v0.5在语音理解基准测试中超越了OpenAI的GPT-4o Realt…...

【MySQL_06】表的相关操作

文章目录 一、表的基本操作1.1 创建表1.2 修改表结构1.2.1 添加列1.2.2 删除列1.2.3 修改列1.2.4 重命名列1.2.5 添加约束 1.3 删除表1.4 查询表结构1.5 重命名表1.6 复制表1.6.1 仅复制结构1.6.2 复制结构及数据 1.7 清空表数据 二、数据完整性约束2.1 主键约束2.2 唯一约束2.…...

clickhouse集群部署保姆级教程

ClickHouse安装 版本要求 23.8及之后的版本 硬件要求 三台机器 建议配置 磁盘 ssd 500G内存 32gcpu 16c 最低配置 磁盘 机械硬盘 50G内存 4gcpu 4c 容量规划 一亿条数据大约使用1TB磁盘容量 参考官方容量推荐 安装包准备 zookeeper安装 zookeeper需要java启动&…...

驾培市场与低空经济无人机融合技术详解

随着科技的飞速发展和社会的不断进步,驾培市场正面临着前所未有的变革。传统汽车驾驶培训已不再是唯一的选择,无人机驾驶等新兴领域正逐渐成为驾培市场的重要组成部分。本报告旨在探讨驾培市场与低空经济的融合发展,特别是应用型人才培养与驾…...

)

pandas-基础(数据结构及文件访问)

1 Pandas的数据结构 1.1 Series 特点:一维的数据型对象,包含一个值序列和数据标签(即索引) 创建Series: pandas.Series(dataNone, indexNone, dtypeNone, nameNone, copyFalse, fastpathFalse) 参数说明: data&a…...

简单记录一下Oracle数据库与mysql数据库注入的不同。

Oracle数据库的注入比mysql较复制。 一确定注入点:与mysql一样。 and 11 -- #文章有出现. and 12 -- #文章不见了。 二。确定列数。 ’order by 1,2 -- #没问题 order by 1,2,3 -- #保错,所以有两列。 三,所有uni…...

前端小食堂 | Day11 - Vue.js の烹饪秘籍

🎨 今日主菜:Vue 常用技巧全家桶 1. 响应式烹饪秘籍 <script setup> // 🍳 精准控制响应式 const counter ref(0); // 基本类型用ref const user reactive({ name: 小明, age: 18 }); // 对象用reactive // 🔥 自…...

如何将本地已有的仓库上传到gitee (使用UGit)

1、登录Gitee。 2、点击个人头像旁边的加号,选择新建仓库: 3、填写仓库相关信息 4、复制Gitee仓库的地址 5、绑定我们的本地仓库与远程仓库 6、将本地仓库发布(推送)到远程仓库: 注意到此处报错ÿ…...

电子拍卖系统)

多方安全计算(MPC)电子拍卖系统

目录 一、前言二、多方安全计算(MPC)与电子拍卖系统概述2.1 多方安全计算(MPC)的基本概念2.2 电子拍卖系统背景与需求三、MPC电子拍卖系统设计原理3.1 系统总体架构3.2 电子拍卖中的安全协议3.3 数学与算法证明四、数据加解密模块设计五、GPU加速与系统性能优化六、GUI设计与系…...

Day04 模拟原生开发app过程 Androidstudio+逍遥模拟器

1、用Androidstudio打开已经写好了的music项目 2、逍遥模拟器打开apk后缀文件 3、在源文件搜索关键字 以后的测试中做资产收集...

C# Channel

核心概念创建Channel无界通道有界通道FullMode选项 生产者-消费者模式生产者写入数据消费者读取数据 完整示例高级配置优化选项:取消操作:通过 CancellationToken 取消读写。 错误处理适用场景Channel的类型创建Channel写入和读取消息使用场景示例代码注…...

17网商品列表的HTML结构是怎样的?

根据搜索结果,目前没有直接提供17网(17zwd)商品列表的HTML结构的详细信息。不过,我们可以根据一般的电商网站结构进行推测,并结合已有的爬虫代码示例来分析可能的HTML结构。 17网商品列表的HTML结构推测 一般来说&am…...

若依ry-vue分离板(完整版)前后端部署

目录 1.目标 2.准备工作 3.源码下载 4.整理前后端目录 5.先部署后端 (1)导入数据库 (2)改代码数据库配置 (3)运行redis (4)运行执行文件 (5)后端启…...

【YOLOv8】YOLOv8改进系列(5)----替换主干网络之EfficientFormerV2

主页:HABUO🍁主页:HABUO 🍁YOLOv8入门改进专栏🍁 🍁如果再也不能见到你,祝你早安,午安,晚安🍁 【YOLOv8改进系列】: 【YOLOv8】YOLOv8结构解读…...

深入理解 HTML 文本格式化

在网页开发中,HTML 文本格式化是一项基础且关键的技能。通过合理运用 HTML 格式化标签,我们能够让网页上的文本以丰富多样的形式呈现,从而提升用户体验。本文将详细介绍 HTML 文本格式化的相关知识。 一、HTML 文本格式化基础 加粗文本…...

时序和延时

1、延迟模型的类型 verilog有三种类型的延迟模型:分布延迟 、 集总延迟 、 路径延迟(pin to pin) 1.1、 分布延迟 分布延迟是在每个独立元件的基础上进行定义的。 module M(output wire out ,input wire a …...

北大一二三四版全套DeepSeek教学资料

DeepSeek学习资料合集:https://pan.quark.cn/s/bb6ebf0e9b4d DeepSeek实操变现指南:https://pan.quark.cn/s/76328991eaa2 你是否渴望深入探索人工智能的前沿领域?是否在寻找一份能引领你从理论到实践,全面掌握AI核心技术的学习…...

垃圾收集算法与收集器

在 JVM 中,垃圾收集(Garbage Collection, GC)算法的核心目标是自动回收无用对象的内存,同时尽量减少对应用性能的影响。以下是 JVM 中主要垃圾收集算法的原理、流程及实际应用场景的详细介绍: 一、标记-清除算法&#…...

【大模型】WPS 接入 DeepSeek-R1详解,打造全能AI办公助手

目录 一、前言 二、WPS接入AI工具优势 三、WPS接入AI工具两种方式 3.1 手动配置的方式 3.2 Office AI助手 四、WPS手动配置方式接入AI大模型 4.1 安装VBA插件 4.1.1 下载VBA插件并安装 4.2 配置WPS 4.3 WPS集成VB 4.4 AI助手效果测试 4.5 配置模板文…...