k8s-----集群调度

目录

一:调度约束

二:Pod 启动创建过程

三:k8s调度过程

1、Predicate 有一系列的常见的算法

2、常见优先级选项

3、指定调度节点

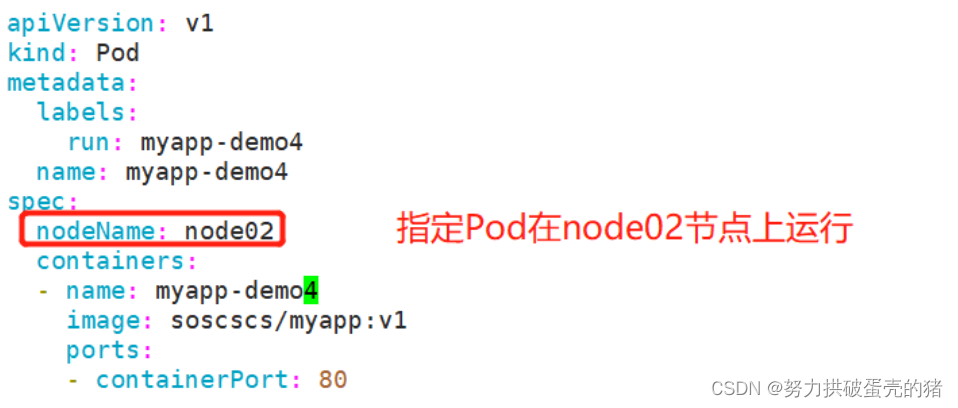

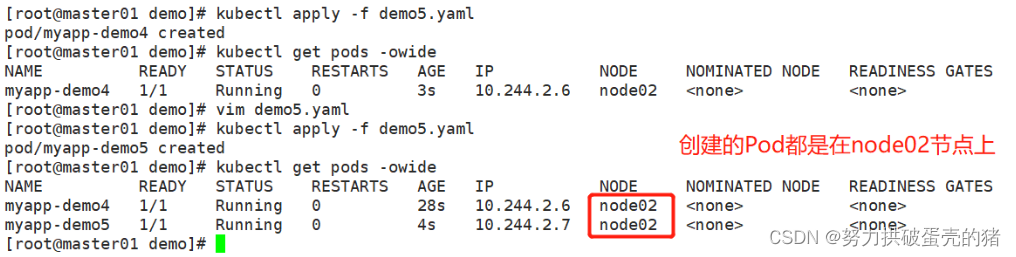

(1)nodeName指定

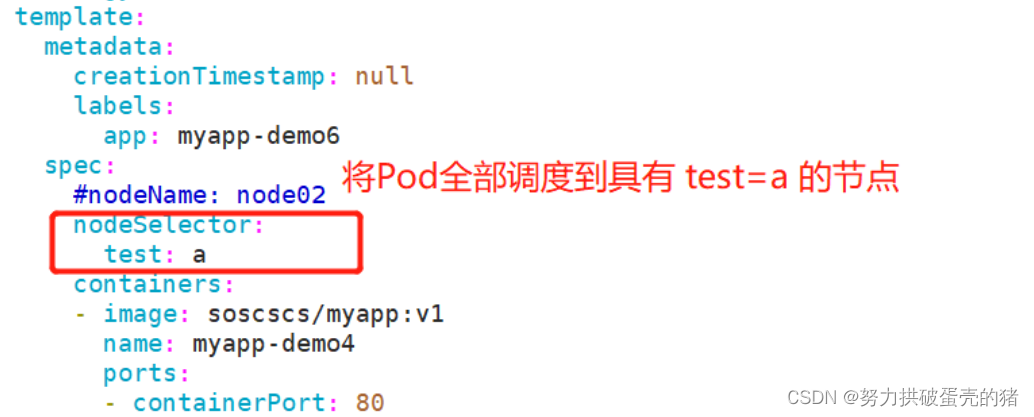

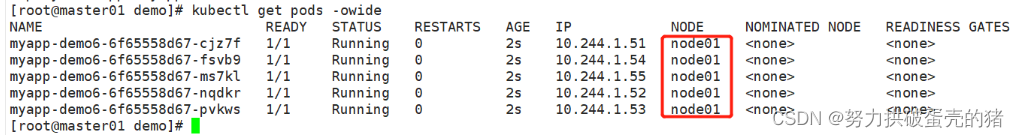

(2)nodeSelector指定

四:亲和性

1、节点亲和性

2、Pod 亲和性

3、键值运算关系

4、事例

(1)节点亲和硬策略示例

(2)节点亲和软策略示例

(3)硬限制和软限制结合使用

5、使用 Pod 亲和性调度,创建多个 Pod 资源

(1)使用 Pod 反亲和性调度

(2)示例2

五:污点(Taint) 和 容忍(Tolerations)

1、污点(Taint)

2、当前 taint effect 支持如下三个选项

3、污点使用

4、容忍(Tolerations)

5、其它注意事项

(1)当不指定 key 值时,表示容忍所有的污点 key

(2)当不指定 effect 值时,表示容忍所有的污点作用

(3)有多个 Master 存在时,防止资源浪费,可以如下设置

6、cordon 和 drain

六:Pod启动阶段(相位 phase)

1、pod 这个过程包含以下几个步骤

2、phase 的可能状态

3、如何删除 Unknown 状态的 Pod ?

4、故障排除步骤

一:调度约束

Kubernetes 是通过 List-Watch 的机制进行每个组件的协作,保持数据同步的,每个组件之间的设计实现了解耦。

用户是通过 kubectl 根据配置文件,向 APIServer 发送命令,在 Node 节点上面建立 Pod 和 Container。

APIServer 经过 API 调用,权限控制,调用资源和存储资源的过程,实际上还没有真正开始部署应用。这里 需要 Controller Manager、Scheduler 和 kubelet 的协助才能完成整个部署过程。

在 Kubernetes 中,所有部署的信息都会写到 etcd 中保存。实际上 etcd 在存储部署信息的时候,会发送 Create 事件给 APIServer,而 APIServer 会通过监听(Watch)etcd 发过来的事件。其他组件也会监听(Watch)APIServer 发出来的事件。

二:Pod 启动创建过程

(1)这里有三个 List-Watch,分别是 Controller Manager(运行在 Master),Scheduler(运行在 Master),kubelet(运行在 Node)。 他们在进程已启动就会监听(Watch)APIServer 发出来的事件。

(2)用户通过 kubectl 或其他 API 客户端提交请求给 APIServer 来建立一个 Pod 对象副本。

(3)APIServer 尝试着将 Pod 对象的相关元信息存入 etcd 中,待写入操作执行完成,APIServer 即会返回确认信息至客户端。

(4)当 etcd 接受创建 Pod 信息以后,会发送一个 Create 事件给 APIServer。

(5)由于 Controller Manager 一直在监听(Watch,通过https的6443端口)APIServer 中的事件。此时 APIServer 接受到了 Create 事件,又会发送给 Controller Manager。

(6)Controller Manager 在接到 Create 事件以后,调用其中的 Replication Controller 来保证 Node 上面需要创建的副本数量。一旦副本数量少于 RC 中定义的数量,RC 会自动创建副本。总之它是保证副本数量的 Controller(PS:扩容缩容的担当)。

(7)在 Controller Manager 创建 Pod 副本以后,APIServer 会在 etcd 中记录这个 Pod 的详细信息。例如 Pod 的副本数,Container 的内容是什么。

(8)同样的 etcd 会将创建 Pod 的信息通过事件发送给 APIServer。

(9)由于 Scheduler 在监听(Watch)APIServer,并且它在系统中起到了“承上启下”的作用,“承上”是指它负责接收创建的 Pod 事件,为其安排 Node;“启下”是指安置工作完成后,Node 上的 kubelet 进程会接管后继工作,负责 Pod 生命周期中的“下半生”。 换句话说,Scheduler 的作用是将待调度的 Pod 按照调度算法和策略绑定到集群中 Node 上。

(10)Scheduler 调度完毕以后会更新 Pod 的信息,此时的信息更加丰富了。除了知道 Pod 的副本数量,副本内容。还知道部署到哪个 Node 上面了。并将上面的 Pod 信息更新至 API Server,由 APIServer 更新至 etcd 中,保存起来。

(11)etcd 将更新成功的事件发送给 APIServer,APIServer 也开始反映此 Pod 对象的调度结果。

(12)kubelet 是在 Node 上面运行的进程,它也通过 List-Watch 的方式监听(Watch,通过https的6443端口)APIServer 发送的 Pod 更新的事件。kubelet 会尝试在当前节点上调用 Docker 启动容器,并将 Pod 以及容器的结果状态回送至 APIServer。

(13)APIServer 将 Pod 状态信息存入 etcd 中。在 etcd 确认写入操作成功完成后,APIServer将确认信息发送至相关的 kubelet,事件将通过它被接受。

注意:在创建 Pod 的工作就已经完成了后,为什么 kubelet 还要一直监听呢?原因很简单,假设这个时候 kubectl 发命令,要扩充 Pod 副本数量,那么上面的流程又会触发一遍,kubelet 会根据最新的 Pod 的部署情况调整 Node 的资源。又或者 Pod 副本数量没有发生变化,但是其中的镜像文件升级了,kubelet 也会自动获取最新的镜像文件并且加载。

三:k8s调度过程

Scheduler 是 kubernetes 的调度器,主要的任务是把定义的 pod 分配到集群的节点上。其主要考虑的问题如下:

●公平:如何保证每个节点都能被分配资源

●资源高效利用:集群所有资源最大化被使用

●效率:调度的性能要好,能够尽快地对大批量的 pod 完成调度工作

●灵活:允许用户根据自己的需求控制调度的逻辑

Sheduler 是作为单独的程序运行的,启动之后会一直监听 APIServer,获取 spec.nodeName 为空的 pod,对每个 pod 都会创建一个 binding,表明该 pod 应该放到哪个节点上。

调度分为几个部分:首先是过滤掉不满足条件的节点,这个过程称为预算策略(predicate);然后对通过的节点按照优先级排序,这个是优选策略(priorities);最后从中选择优先级最高的节点。如果中间任何一步骤有错误,就直接返回错误。

1、Predicate 有一系列的常见的算法

●PodFitsResources:节点上剩余的资源是否大于 pod 请求的资源。

●PodFitsHost:如果 pod 指定了 NodeName,检查节点名称是否和 NodeName 匹配。

●PodFitsHostPorts:节点上已经使用的 port 是否和 pod 申请的 port 冲突。

●PodSelectorMatches:过滤掉和 pod 指定的 label 不匹配的节点。

●NoDiskConflict:已经 mount 的 volume 和 pod 指定的 volume 不冲突,除非它们都是只读。

如果在 predicate 过程中没有合适的节点,pod 会一直在 pending 状态,不断重试调度,直到有节点满足条件。 经过这个步骤,如果有多个节点满足条件,就继续 priorities 过程:按照优先级大小对节点排序。

2、常见优先级选项

优先级由一系列键值对组成,键是该优先级项的名称,值是它的权重(该项的重要性)。有一系列的常见的优先级选项包括:

●LeastRequestedPriority:通过计算CPU和Memory的使用率来决定权重,使用率越低权重越高。也就是说,这个优先级指标倾向于资源使用比例更低的节点。

●BalancedResourceAllocation:节点上 CPU 和 Memory 使用率越接近,权重越高。这个一般和上面的一起使用,不单独使用。比如 node01 的 CPU 和 Memory 使用率 20:60,node02 的 CPU 和 Memory 使用率 50:50,虽然 node01 的总使用率比 node02 低,但 node02 的 CPU 和 Memory 使用率更接近,从而调度时会优选 node02。

●ImageLocalityPriority:倾向于已经有要使用镜像的节点,镜像总大小值越大,权重越高。通过算法对所有的优先级项目和权重进行计算,得出最终的结果。

3、指定调度节点

(1)nodeName指定

●pod.spec.nodeName 将 Pod 直接调度到指定的 Node 节点上,会跳过 Scheduler 的调度策略,该匹配规则是强制匹配

vim myapp.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: myapp

spec:replicas: 3selector:matchLabels:app: myapptemplate:metadata:labels:app: myappspec:nodeName: node01containers:- name: myappimage: soscscs/myapp:v1ports:- containerPort: 80kubectl apply -f myapp.yamlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp-6bc58d7775-6wlpp 1/1 Running 0 14s 10.244.1.25 node01 <none> <none>

myapp-6bc58d7775-szcvp 1/1 Running 0 14s 10.244.1.26 node01 <none> <none>

myapp-6bc58d7775-vnxlp 1/1 Running 0 14s 10.244.1.24 node01 <none> <none>//查看详细事件(发现未经过 scheduler 调度分配)

kubectl describe pod myapp-6bc58d7775-6wlpp

......Type Reason Age From Message---- ------ ---- ---- -------Normal Pulled 95s kubelet, node01 Container image "soscscs/myapp:v1" already present on machineNormal Created 99s kubelet, node01 Created container nginxNormal Started 99s kubelet, node01 Started container nginx

(2)nodeSelector指定

●pod.spec.nodeSelector:通过 kubernetes 的 label-selector 机制选择节点,由调度器调度策略匹配 label,然后调度 Pod 到目标节点,该匹配规则属于强制约束

//获取标签帮助

kubectl label --help

Usage:kubectl label [--overwrite] (-f FILENAME | TYPE NAME) KEY_1=VAL_1 ... KEY_N=VAL_N [--resource-version=version] [options]//需要获取 node 上的 NAME 名称

kubectl get node

NAME STATUS ROLES AGE VERSION

master Ready master 30h v1.20.11

node01 Ready <none> 30h v1.20.11

node02 Ready <none> 30h v1.20.11//给对应的 node 设置标签分别为 kgc=a 和 kgc=b

kubectl label nodes node01 kgc=akubectl label nodes node02 kgc=b//查看标签

kubectl get nodes --show-labels

NAME STATUS ROLES AGE VERSION LABELS

master Ready master 30h v1.20.11 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=master,kubernetes.io/os=linux,node-role.kubernetes.io/master=

node01 Ready <none> 30h v1.20.11 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kgc=a,kubernetes.io/arch=amd64,kubernetes.io/hostname=node01,kubernetes.io/os=linux

node02 Ready <none> 30h v1.20.11 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kgc=b,kubernetes.io/arch=amd64,kubernetes.io/hostname=node02,kubernetes.io/os=linux//修改成 nodeSelector 调度方式

vim myapp1.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: myapp1

spec:replicas: 3selector:matchLabels:app: myapp1template:metadata:labels:app: myapp1spec:nodeSelector:kgc: acontainers:- name: myapp1image: soscscs/myapp:v1ports:- containerPort: 80kubectl apply -f myapp1.yaml kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp1-58cff4d75-52xm5 1/1 Running 0 24s 10.244.1.29 node01 <none> <none>

myapp1-58cff4d75-f747q 1/1 Running 0 24s 10.244.1.27 node01 <none> <none>

myapp1-58cff4d75-kn8gk 1/1 Running 0 24s 10.244.1.28 node01 <none> <none>//查看详细事件(通过事件可以发现要先经过 scheduler 调度分配)

kubectl describe pod myapp1-58cff4d75-52xm5

Events:Type Reason Age From Message---- ------ ---- ---- -------Normal Scheduled 57s default-scheduler Successfully assigned default/myapp1-58cff4d75-52xm5 to node01Normal Pulled 57s kubelet, node01 Container image "soscscs/myapp:v1" already present on machineNormal Created 56s kubelet, node01 Created container myapp1Normal Started 56s kubelet, node01 Started container myapp1//修改一个 label 的值,需要加上 --overwrite 参数

kubectl label nodes node02 kgc=a --overwrite//删除一个 label,只需在命令行最后指定 label 的 key 名并与一个减号相连即可:

kubectl label nodes node02 kgc-//指定标签查询 node 节点

kubectl get node -l kgc=a

四:亲和性

https://kubernetes.io/zh/docs/concepts/scheduling-eviction/assign-pod-node/

1、节点亲和性

pod.spec.nodeAffinity

●preferredDuringSchedulingIgnoredDuringExecution:软策略

●requiredDuringSchedulingIgnoredDuringExecution:硬策略2、Pod 亲和性

pod.spec.affinity.podAffinity/podAntiAffinity

●preferredDuringSchedulingIgnoredDuringExecution:软策略

●requiredDuringSchedulingIgnoredDuringExecution:硬策略软策略是不去也可以,硬策略则是不去就不行。

3、键值运算关系

●In:label 的值在某个列表中

●NotIn:label 的值不在某个列表中

●Gt:label 的值大于某个值

●Lt:label 的值小于某个值

●Exists:某个 label 存在

●DoesNotExist:某个 label 不存在

kubectl get nodes --show-labels #查看节点详细信息

NAME STATUS ROLES AGE VERSION LABELS

master Ready master 11d v1.20.11 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=master,kubernetes.io/os=linux,node-role.kubernetes.io/master=

node01 Ready <none> 11d v1.20.11 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node01,kubernetes.io/os=linux

node02 Ready <none> 11d v1.20.11 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node02,kubernetes.io/os=linux4、事例

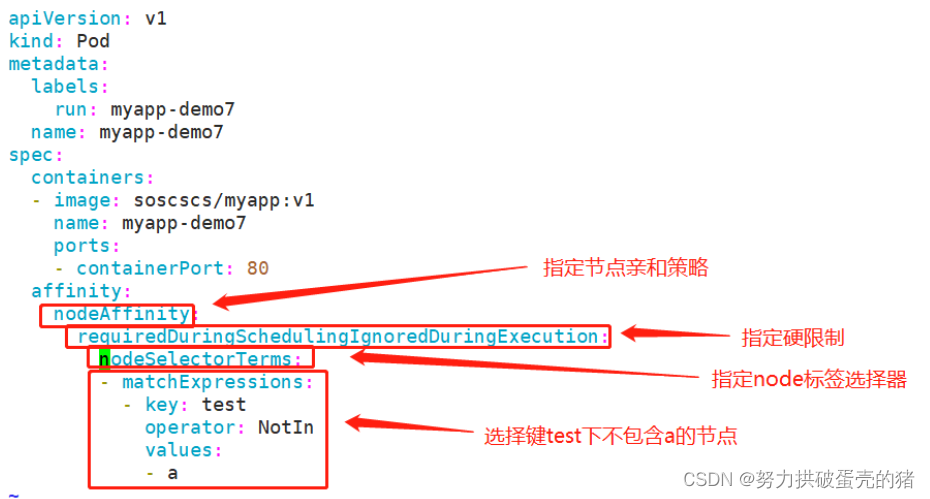

(1)节点亲和硬策略示例

//requiredDuringSchedulingIgnoredDuringExecution:硬策略

mkdir /opt/affinity

cd /opt/affinityvim pod1.yaml

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

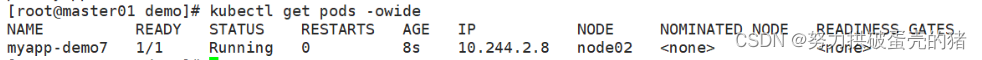

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution:nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/hostname #指定node的标签operator: NotIn #设置Pod安装到kubernetes.io/hostname的标签值不在values列表中的node上values:- node02kubectl apply -f pod1.yamlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

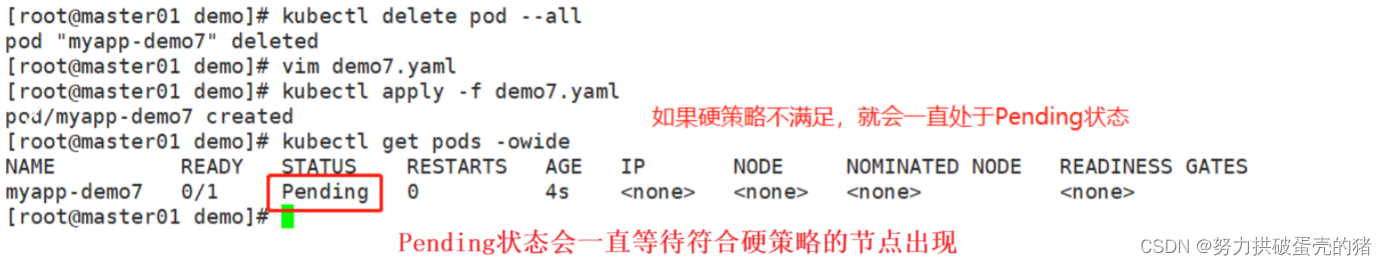

affinity 1/1 Running 0 13s 10.244.1.30 node01 <none> <none>kubectl delete pod --all && kubectl apply -f pod1.yaml && kubectl get pods -o wide#如果硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

(2)节点亲和软策略示例

//preferredDuringSchedulingIgnoredDuringExecution:软策略

vim pod2.yaml

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:preferredDuringSchedulingIgnoredDuringExecution:- weight: 1 #如果有多个软策略选项的话,权重越大,优先级越高preference:matchExpressions:- key: kubernetes.io/hostnameoperator: Invalues:- node03kubectl apply -f pod2.yamlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 1/1 Running 0 5s 10.244.2.35 node02 <none> <none>//把values:的值改成node01,则会优先在node01上创建Pod

kubectl delete pod --all && kubectl apply -f pod2.yaml && kubectl get pods -o wide(3)硬限制和软限制结合使用

如果把硬策略和软策略合在一起使用,则要先满足硬策略之后才会满足软策略

//示例:

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution: #先满足硬策略,排除有kubernetes.io/hostname=node02标签的节点nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/hostnameoperator: NotInvalues:- node02preferredDuringSchedulingIgnoredDuringExecution: #再满足软策略,优先选择有kgc=a标签的节点- weight: 1preference:matchExpressions:- key: kgcoperator: Invalues:- a5、使用 Pod 亲和性调度,创建多个 Pod 资源

//Pod亲和性与反亲和性

调度策略 匹配标签 操作符 拓扑域支持 调度目标

nodeAffinity 主机 In, NotIn, Exists,DoesNotExist, Gt, Lt 否 指定主机

podAffinity Pod In, NotIn, Exists,DoesNotExist 是 Pod与指定Pod同一拓扑域

podAntiAffinity Pod In, NotIn, Exists,DoesNotExist 是 Pod与指定Pod不在同一拓扑域kubectl label nodes node01 kgc=a

kubectl label nodes node02 kgc=a//创建一个标签为 app=myapp01 的 Pod

vim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1kubectl apply -f pod3.yamlkubectl get pods --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

myapp01 1/1 Running 0 37s 10.244.2.3 node01 <none> <none> app=myapp01//使用 Pod 亲和性调度,创建多个 Pod 资源

vim pod4.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp02labels:app: myapp02

spec:containers:- name: myapp02image: soscscs/myapp:v1affinity:podAffinity:requiredDuringSchedulingIgnoredDuringExecution:- labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kgc仅当节点和至少一个已运行且有键为“app”且值为“myapp01”的标签 的 Pod 处于同一拓扑域时,才可以将该 Pod 调度到节点上。 (更确切的说,如果节点 N 具有带有键 kgc 和某个值 V 的标签,则 Pod 有资格在节点 N 上运行,以便集群中至少有一个具有键 kgc 和值为 V 的节点正在运行具有键“app”和值 “myapp01”的标签的 pod。)

topologyKey 是节点标签的键。如果两个节点使用此键标记并且具有相同的标签值,则调度器会将这两个节点视为处于同一拓扑域中。 调度器试图在每个拓扑域中放置数量均衡的 Pod。

#如果 kgc 对应的值不一样就是不同的拓扑域。比如 Pod1 在 kgc=a 的 Node 上,Pod2 在 kgc=b 的 Node 上,Pod3 在 kgc=a 的 Node 上,则 Pod2 和 Pod1、Pod3 不在同一个拓扑域,而Pod1 和 Pod3在同一个拓扑域。

kubectl apply -f pod4.yamlkubectl get pods --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

myapp01 1/1 Running 0 15m 10.244.1.3 node01 <none> <none> app=myapp01

myapp02 1/1 Running 0 8s 10.244.1.4 node01 <none> <none> app=myapp02

myapp03 1/1 Running 0 52s 10.244.2.53 node02 <none> <none> app=myapp03

myapp04 1/1 Running 0 44s 10.244.1.51 node01 <none> <none> app=myapp03

myapp05 1/1 Running 0 38s 10.244.2.54 node02 <none> <none> app=myapp03

myapp06 1/1 Running 0 30s 10.244.1.52 node01 <none> <none> app=myapp03

myapp07 1/1 Running 0 24s 10.244.2.55 node02 <none> <none> app=myapp03(1)使用 Pod 反亲和性调度

示例1:

vim pod5.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp10labels:app: myapp10

spec:containers:- name: myapp10image: soscscs/myapp:v1affinity:podAntiAffinity:preferredDuringSchedulingIgnoredDuringExecution:- weight: 100podAffinityTerm:labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kubernetes.io/hostname#如果节点处于 Pod 所在的同一拓扑域且具有键“app”和值“myapp01”的标签, 则该 pod 不应将其调度到该节点上。 (如果 topologyKey 为 kubernetes.io/hostname,则意味着当节点和具有键 “app”和值“myapp01”的 Pod 处于相同的拓扑域,Pod 不能被调度到该节点上。)kubectl apply -f pod5.yamlkubectl get pods --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

myapp01 1/1 Running 0 44m 10.244.1.3 node01 <none> <none> app=myapp01

myapp02 1/1 Running 0 29m 10.244.1.4 node01 <none> <none> app=myapp02

myapp10 1/1 Running 0 75s 10.244.2.4 node02 <none> <none> app=myapp03(2)示例2

vim pod6.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp20labels:app: myapp20

spec:containers:- name: myapp20image: soscscs/myapp:v1affinity:podAntiAffinity:requiredDuringSchedulingIgnoredDuringExecution:- labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kgc//由于指定 Pod 所在的 node01 节点上具有带有键 kgc 和标签值 a 的标签,node02 也有这个kgc=a的标签,所以 node01 和 node02 是在一个拓扑域中,反亲和要求新 Pod 与指定 Pod 不在同一拓扑域,所以新 Pod 没有可用的 node 节点,即为 Pending 状态。

kubectl get pod --show-labels -owide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

myapp01 1/1 Running 0 43s 10.244.1.68 node01 <none> <none> app=myapp01

myapp20 0/1 Pending 0 4s <none> <none> <none> <none> app=myapp03kubectl label nodes node02 kgc=b --overwritekubectl get pod --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

myapp01 1/1 Running 0 7m40s 10.244.1.68 node01 <none> <none> app=myapp01

myapp21 1/1 Running 0 7m1s 10.244.2.65 node02 <none> <none> app=myapp03五:污点(Taint) 和 容忍(Tolerations)

1、污点(Taint)

节点亲和性,是Pod的一种属性(偏好或硬性要求),它使Pod被吸引到一类特定的节点。Taint 则相反,它使节点能够排斥一类特定的 Pod。

Taint 和 Toleration 相互配合,可以用来避免 Pod 被分配到不合适的节点上。每个节点上都可以应用一个或多个 taint ,这表示对于那些不能容忍这些 taint 的 Pod,是不会被该节点接受的。如果将 toleration 应用于 Pod 上,则表示这些 Pod 可以(但不一定)被调度到具有匹配 taint 的节点上。

使用 kubectl taint 命令可以给某个 Node 节点设置污点,Node 被设置上污点之后就和 Pod 之间存在了一种相斥的关系,可以让 Node 拒绝 Pod 的调度执行,甚至将 Node 已经存在的 Pod 驱逐出去。

污点的组成格式:key=value:effect每个污点有一个 key 和 value 作为污点的标签,其中 value 可以为空,effect 描述污点的作用。

2、当前 taint effect 支持如下三个选项

●NoSchedule:表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上

●PreferNoSchedule:表示 k8s 将尽量避免将 Pod 调度到具有该污点的 Node 上

●NoExecute:表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上,同时会将 Node 上已经存在的 Pod 驱逐出去

kubectl get nodes

NAME STATUS ROLES AGE VERSION

master Ready master 11d v1.20.11

node01 Ready <none> 11d v1.20.11

node02 Ready <none> 11d v1.20.11//master 就是因为有 NoSchedule 污点,k8s 才不会将 Pod 调度到 master 节点上

kubectl describe node master

......

Taints: node-role.kubernetes.io/master:NoSchedule3、污点使用

设置污点

kubectl taint node node01 key1=value1:NoSchedule#节点说明中,查找 Taints 字段

kubectl describe node node-name #去除污点

kubectl taint node node01 key1:NoSchedule-kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp01 1/1 Running 0 4h28m 10.244.2.3 node02 <none> <none>

myapp02 1/1 Running 0 4h13m 10.244.2.4 node02 <none> <none>

myapp03 1/1 Running 0 3h45m 10.244.1.4 node01 <none> <none>kubectl taint node node02 check=mycheck:NoExecute//查看 Pod 状态,会发现 node02 上的 Pod 已经被全部驱逐(注:如果是 Deployment 或者 StatefulSet 资源类型,为了维持副本数量则会在别的 Node 上再创建新的 Pod)

kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp03 1/1 Running 0 3h48m 10.244.1.4 node01 <none> <none>4、容忍(Tolerations)

设置了污点的 Node 将根据 taint 的 effect:NoSchedule、PreferNoSchedule、NoExecute 和 Pod 之间产生互斥的关系,Pod 将在一定程度上不会被调度到 Node 上。但我们可以在 Pod 上设置容忍(Tolerations),意思是设置了容忍的 Pod 将可以容忍污点的存在,可以被调度到存在污点的 Node 上。

kubectl taint node node01 check=mycheck:NoExecutevim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1kubectl apply -f pod3.yaml//在两个 Node 上都设置了污点后,此时 Pod 将无法创建成功

kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp01 0/1 Pending 0 17s <none> <none> <none> <none>vim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1tolerations:- key: "check"operator: "Equal"value: "mycheck"effect: "NoExecute"tolerationSeconds: 3600#其中的 key、vaule、effect 都要与 Node 上设置的 taint 保持一致

#operator 的值为 Exists 将会忽略 value 值,即存在即可

#tolerationSeconds 用于描述当 Pod 需要被驱逐时可以在 Node 上继续保留运行的时间kubectl apply -f pod3.yaml//在设置了容忍之后,Pod 创建成功

kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp01 1/1 Running 0 10m 10.244.1.5 node01 <none> <none>5、其它注意事项

(1)当不指定 key 值时,表示容忍所有的污点 key

tolerations:- operator: "Exists"(2)当不指定 effect 值时,表示容忍所有的污点作用

tolerations:- key: "key"operator: "Exists"(3)有多个 Master 存在时,防止资源浪费,可以如下设置

kubectl taint node Master-Name node-role.kubernetes.io/master=:PreferNoSchedule//如果某个 Node 更新升级系统组件,为了防止业务长时间中断,可以先在该 Node 设置 NoExecute 污点,把该 Node 上的 Pod 都驱逐出去

kubectl taint node node01 check=mycheck:NoExecute//此时如果别的 Node 资源不够用,可临时给 Master 设置 PreferNoSchedule 污点,让 Pod 可在 Master 上临时创建

kubectl taint node master node-role.kubernetes.io/master=:PreferNoSchedule//待所有 Node 的更新操作都完成后,再去除污点

kubectl taint node node01 check=mycheck:NoExecute-6、cordon 和 drain

##对节点执行维护操作:

kubectl get nodes//将 Node 标记为不可调度的状态,这样就不会让新创建的 Pod 在此 Node 上运行

kubectl cordon <NODE_NAME> #该node将会变为SchedulingDisabled状态//kubectl drain 可以让 Node 节点开始释放所有 pod,并且不接收新的 pod 进程。drain 本意排水,意思是将出问题的 Node 下的 Pod 转移到其它 Node 下运行

kubectl drain <NODE_NAME> --ignore-daemonsets --delete-emptydir-data --force--ignore-daemonsets:无视 DaemonSet 管理下的 Pod。

--delete-emptydir-data:如果有 mount local volume 的 pod,会强制杀掉该 pod。

--force:强制释放不是控制器管理的 Pod。注:执行 drain 命令,会自动做了两件事情:

(1)设定此 node 为不可调度状态(cordon)

(2)evict(驱逐)了 Pod//kubectl uncordon 将 Node 标记为可调度的状态

kubectl uncordon <NODE_NAME>六:Pod启动阶段(相位 phase)

Pod 创建完之后,一直到持久运行起来,中间有很多步骤,也就有很多出错的可能,因此会有很多不同的状态。

1、pod 这个过程包含以下几个步骤

(1)调度到某台 node 上。kubernetes 根据一定的优先级算法选择一台 node 节点将其作为 Pod 运行的 node

(2)拉取镜像

(3)挂载存储配置等

(4)容器运行起来。如果有健康检查,会根据检查的结果来设置其状态。

2、phase 的可能状态

●Pending:表示APIServer创建了Pod资源对象并已经存入了etcd中,但是它并未被调度完成(比如还没有调度到某台node上),或者仍然处于从仓库下载镜像的过程中。

●Running:Pod已经被调度到某节点之上,并且Pod中所有容器都已经被kubelet创建。至少有一个容器正在运行,或者正处于启动或者重启状态(也就是说Running状态下的Pod不一定能被正常访问)。

●Succeeded:有些pod不是长久运行的,比如job、cronjob,一段时间后Pod中的所有容器都被成功终止,并且不会再重启。需要反馈任务执行的结果。

●Failed:Pod中的所有容器都已终止了,并且至少有一个容器是因为失败终止。也就是说,容器以非0状态退出或者被系统终止,比如 command 写的有问题。

●Unknown:表示无法读取 Pod 状态,通常是 kube-controller-manager 无法与 Pod 通信。Pod 所在的 Node 出了问题或失联,从而导致 Pod 的状态为 Unknow

3、如何删除 Unknown 状态的 Pod ?

●从集群中删除有问题的 Node。使用公有云时,kube-controller-manager 会在 VM 删除后自动删除对应的 Node。 而在物理机部署的集群中,需要管理员手动删除 Node(kubectl delete node <node_name>)。

●被动等待 Node 恢复正常,Kubelet 会重新跟 kube-apiserver 通信确认这些 Pod 的期待状态,进而再决定删除或者继续运行这些 Pod。

●主动删除 Pod,通过执行 kubectl delete pod <pod_name> --grace-period=0 --force 强制删除 Pod。但是这里需要注意的是,除非明确知道 Pod 的确处于停止状态(比如 Node 所在 VM 或物理机已经关机),否则不建议使用该方法。特别是 StatefulSet 管理的 Pod,强制删除容易导致脑裂或者数据丢失等问题。

4、故障排除步骤

//查看Pod事件

kubectl describe TYPE NAME_PREFIX //查看Pod日志(Failed状态下)

kubectl logs <POD_NAME> [-c Container_NAME]//进入Pod(状态为running,但是服务没有提供)

kubectl exec –it <POD_NAME> bash//查看集群信息

kubectl get nodes//发现集群状态正常

kubectl cluster-info//查看kubelet日志发现

journalctl -xefu kubelet相关文章:

k8s-----集群调度

目录 一:调度约束 二:Pod 启动创建过程 三:k8s调度过程 1、Predicate 有一系列的常见的算法 2、常见优先级选项 3、指定调度节点 (1)nodeName指定 (2)nodeSelector指定 四:亲和…...

01-Spark环境部署

1 Spark的部署方式介绍 Spark部署模式分为Local模式(本地模式)和集群模式(集群模式又分为Standalone模式、Yarn模式和Mesos模式) 1.1 Local模式 Local模式常用于本地开发程序与测试,如在idea中 1.2 Standalone模…...

HOT86-单词拆分

leetcode原题链接:单词拆分 题目描述 给你一个字符串 s 和一个字符串列表 wordDict 作为字典。请你判断是否可以利用字典中出现的单词拼接出 s 。注意:不要求字典中出现的单词全部都使用,并且字典中的单词可以重复使用。 示例 1:…...

开源数据集分类汇总(医学,卫星,分割,分类,人脸,农业,姿势等)

本文汇总了医学图像、卫星图像、语义分割、自动驾驶、图像分类、人脸、农业、打架识别等多个方向的数据集资源,均附有下载链接。 该文章仅用于学习记录,禁止商业使用! 1.医学图像 疟疾细胞图像数据集 下载链接:http://suo.nz/2V…...

Linux:Firewalld防火墙

目录 绪论 1、firewalld配置模式 2、预定义服务:系统自带 3端口管理 绪论 firewalld 防火墙,包过滤防火墙,工作在网络层,centos7自带的默认的防火墙 作用是为了取代iptables 1、firewalld配置模式 运行时配置 永久配置 i…...

mysql死锁;锁表排查

概述 有时候提前终止了navicat执行线程,但是实际mysql还在执行这个线程, 需要通过mysql本身去终止. mysql:8.0 三板斧第一斧 捞点网上线程现成的执行命令 1.查询是否锁表 show OPEN TABLES where In_use > 0;2.查询进程(如果您有SUP…...

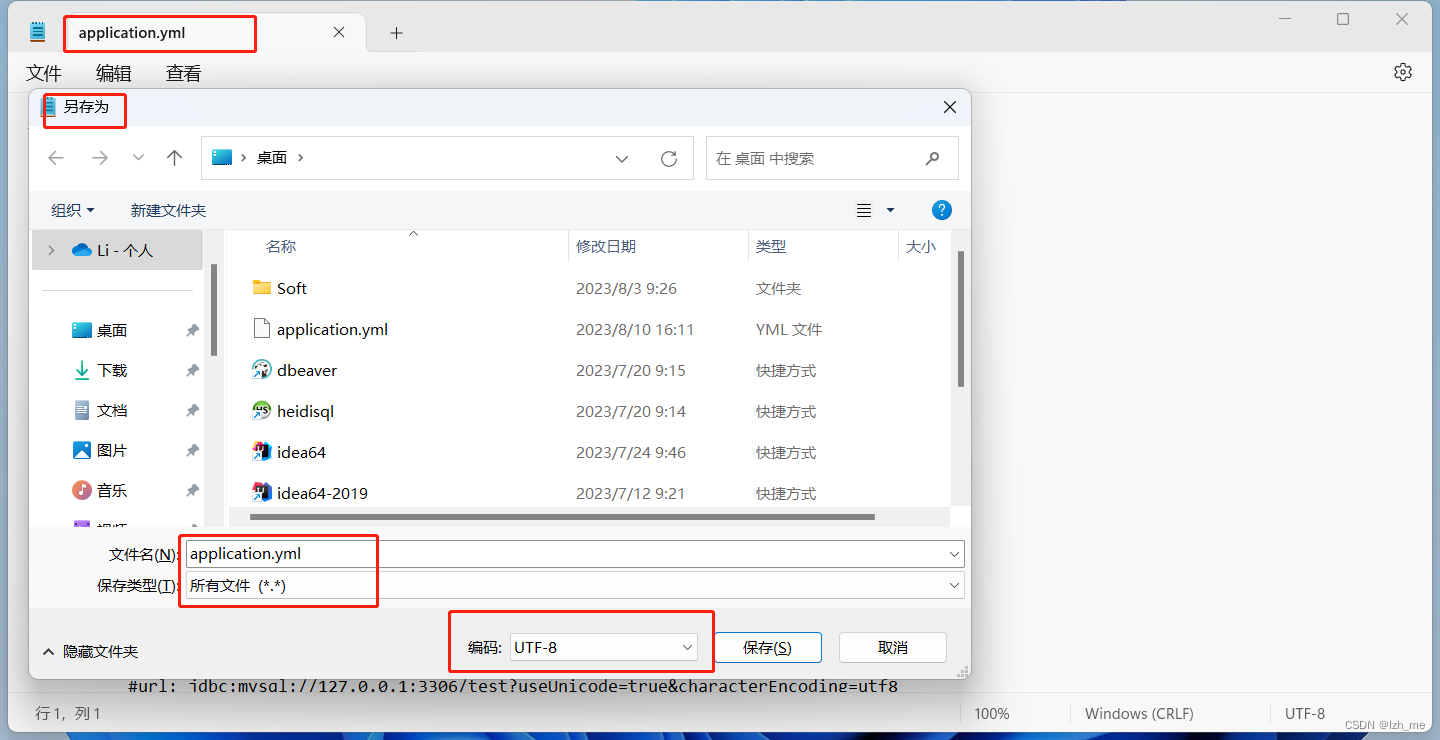

YAMLException: java.nio.charset.MalformedInputException: Input length = 1

springboot项目启动的时候提示这个错误:YAMLException: java.nio.charset.MalformedInputException: Input length 1 根据异常信息提示,是YAML文件有问题。 原因是yml配置文件的编码有问题。 需要修改项目的编码格式,一般统一为UTF-8。 或…...

无需求文档,保障测试质量的可行性做法

这篇文章,内容是:无需求文档的情况下,作为一个测试人员,应该如何做 ,才能保障测试质量不出问题,以及如何不背锅 ? 001 没有需求文档3种可能情况 : 1、公司都没产品经理࿰…...

SpringBoot项目学习笔记

第一章 SpringBoot有哪些优点? Spring Boot作为Java开发的框架和工具集,具有许多优点,这些优点有助于简化开发过程并提高效率。以下是一些主要的优点: 简化配置: Spring Boot采用约定优于配置的原则,通过自…...

如何在Vue表单处理中实现表单字段的文件下载

Vue.js 是一种流行的JavaScript框架,用于构建用户界面。在Vue应用中,我们经常需要处理表单操作,其中一个常见需求是实现文件下载。以下介绍如何在Vue表单处理中实现表单字段的文件下载,大家共同交流。 一、使用HTML的a标签实现文…...

SSL证书DV和OV的区别?

SSL证书是在互联网通信中保护数据传输安全的一种加密工具。它能够确保客户端和服务器之间的通信得以加密,防止第三方窃听或篡改信息。在选择SSL证书时,常见的有DV证书和OV证书,它们在验证标准和信任级别上有所不同。那么SSL证书DV和OV的有哪些…...

计算机竞赛 GRU的 电影评论情感分析 - python 深度学习 情感分类

1 前言 🔥学长分享优质竞赛项目,今天要分享的是 🚩 GRU的 电影评论情感分析 - python 深度学习 情感分类 🥇学长这里给一个题目综合评分(每项满分5分) 难度系数:3分工作量:3分创新点:4分 这…...

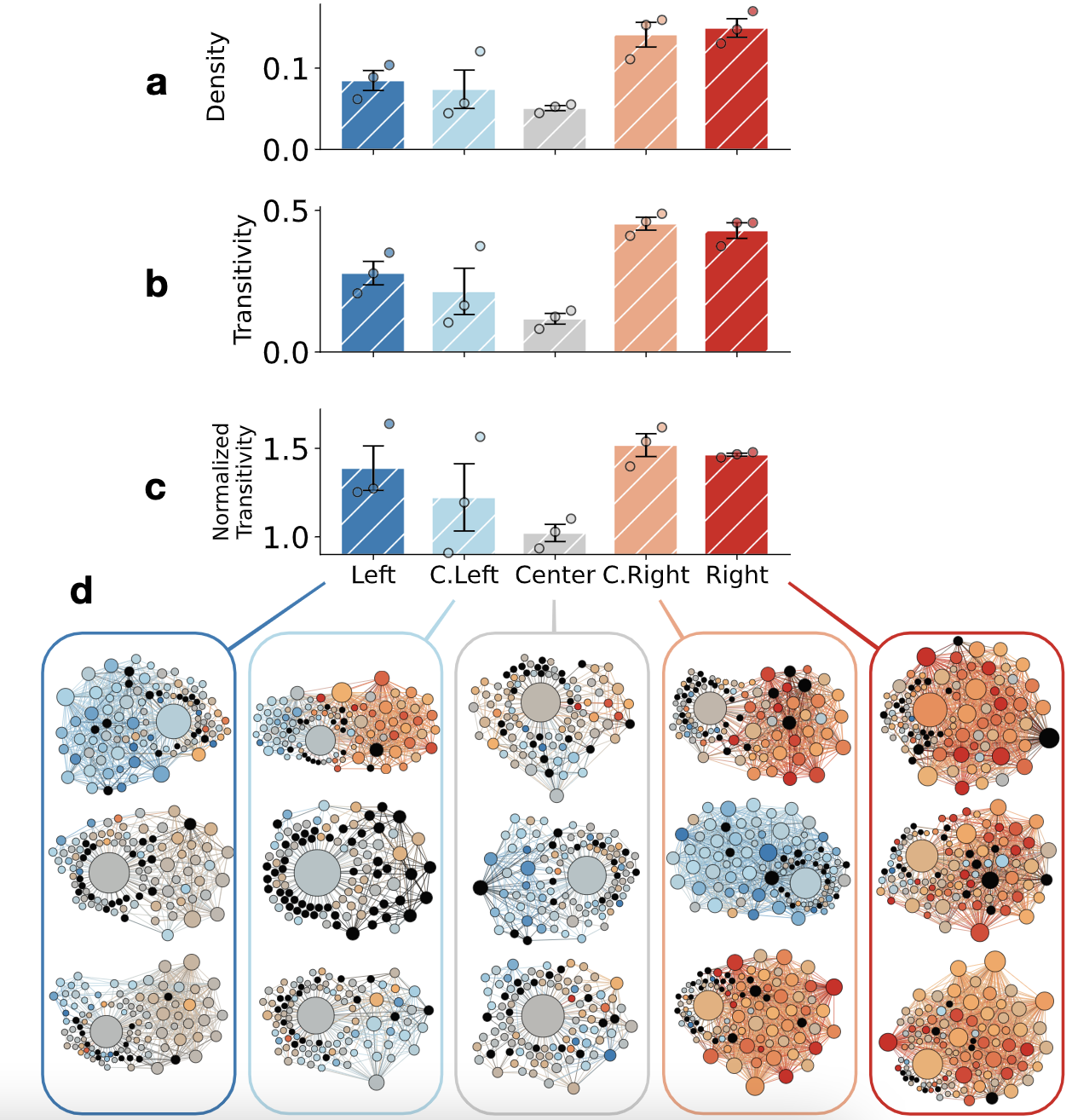

论文阅读 - Neutral bots probe political bias on social media

论文链接:Neutral bots probe political bias on social media | EndNote Click 试图遏制滥用行为和错误信息的社交媒体平台被指责存在政治偏见。我们部署中立的社交机器人,它们开始关注 Twitter 上的不同新闻源,并跟踪它们以探究平台机制与用…...

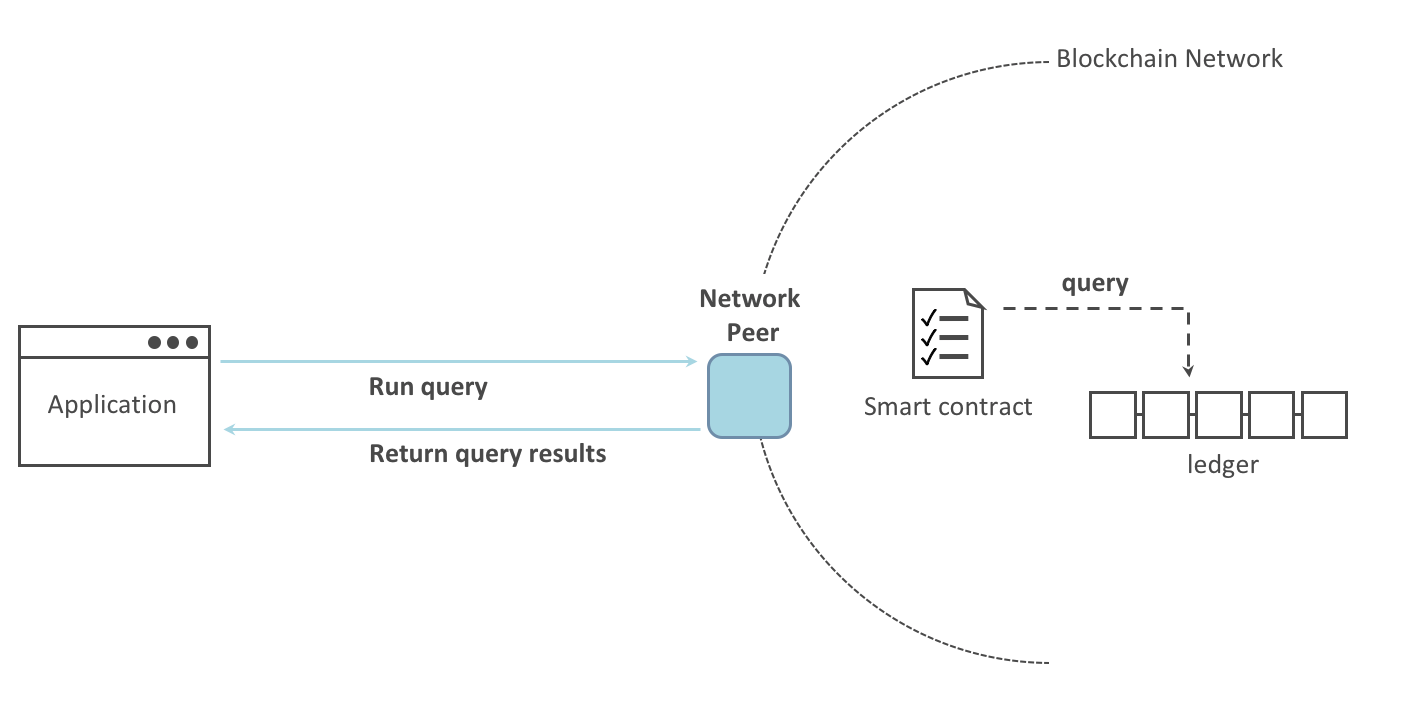

Fabric系列 - 知识点整理

知识点 源码编译 主机编译 容器编译 手动部署(docker-compose) 单peer 多peer 中途加peer 多主机多peer 链码 语法, 接口 (go版) 命令行调用 ca server 在DApp中使用SDK调用 (js版) 部署的几个阶段 部署1排序和1节点, 1组织1通道 光部署能Dapp 带ca server (每个组织一个)…...

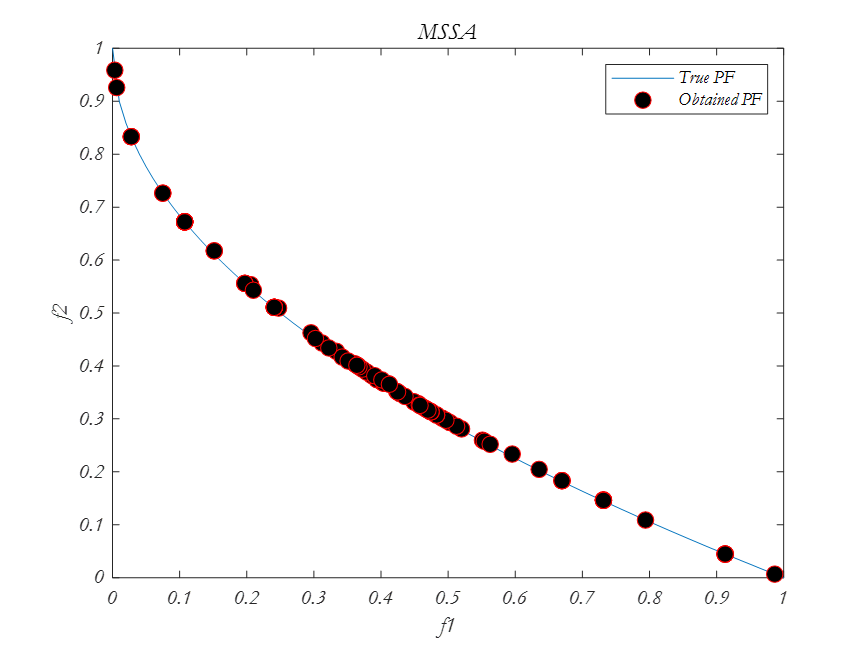

多目标优化算法之樽海鞘算法(MSSA)

樽海鞘算法的主要灵感是樽海鞘在海洋中航行和觅食时的群聚行为。相关文献表示,多目标优化之樽海鞘算法的结果表明,该算法可以逼近帕雷托最优解,收敛性和覆盖率高。 通过给SSA算法配备一个食物来源库来解决第一个问题。该存储库维护了到目前为…...

阿里云轻量应用服务器使用教程_创建配置_远程连接_网站上线

阿里云轻量应用服务器怎么使用?阿里云百科分享轻量应用服务器从选择创建、配置建站环境、轻量服务器应用服务器远程连接、开端口到网站上线全流程: 目录 阿里云轻量应用服务器使用教程 步骤一:购买一台轻量应用服务器 步骤二:…...

自监督学习的概念

Self-Supervised Learning (SSL)的主要思想是解决先验任务来学习特征提取器,在不使用标签的情况下生成有用的表示。 这里先验任务是指, 先使用原始数据和特征提取器来提取出 数据的有效表示. 对比方法(即对比学习, Contrastiv…...

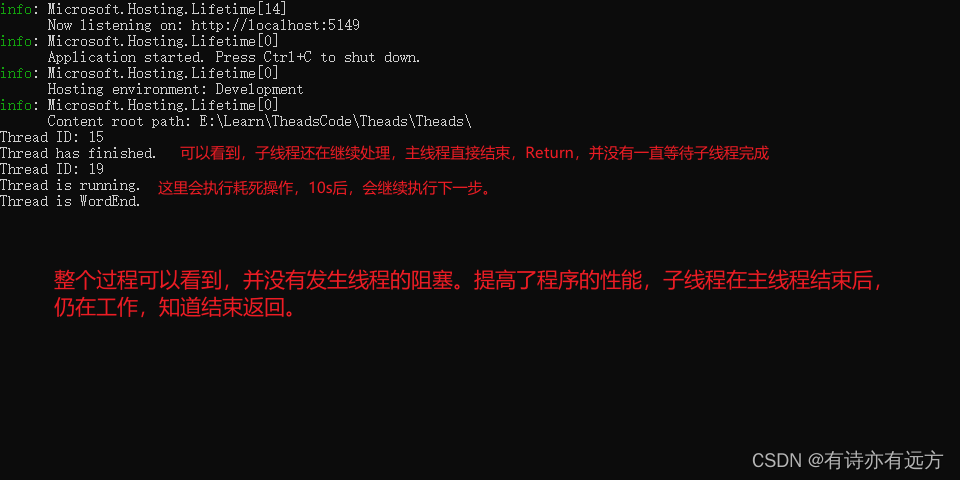

C#多线程开发详解

C#多线程开发详解 持续更新中。。。。。一、为什么要使用多线程开发1.提高性能2.响应性3.资源利用4.任务分解5.并行计算6.实时处理 二、多线程开发缺点1.竞态条件2.死锁和饥饿3.调试复杂性4.上下文切换开销5.线程安全性 三、多线程开发涉及的相关概念常用概念(1)lock(2)查看当前…...

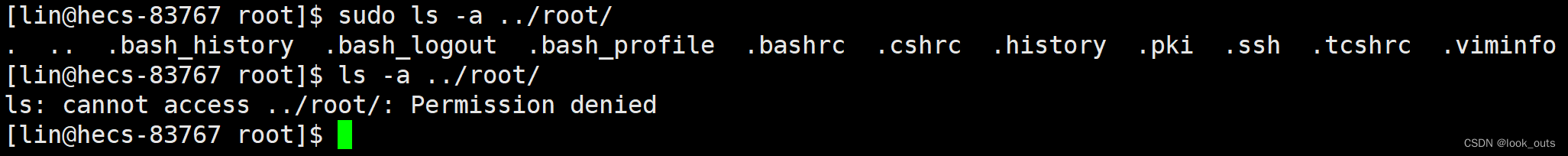

Linux 基础篇(六)sudo和添加信任用户

一、sudo 1.是什么? 给被信任的普通用户授权,让被信任的普通用户能执行root用户才能执行的命令的一个命令。 2.为什么? 很多时候我们要在被信任的普通用户下执行一些root用户才能执行的命令,如 yum… 所以需要有一个命令能给普通用…...

【Linux】程序地址空间

程序地址空间 首先引入地址空间的作用什么是地址空间为什么要有地址空间 首先引入地址空间的作用 1 #include <stdio.h>2 #include <unistd.h>3 #include <stdlib.h>4 int g_val 100;6 int main()7 {8 pid_t id fork();9 if(id 0)10 {11 int cn…...

WaveTools高性能帧率解锁技术解析:突破鸣潮游戏性能瓶颈的完整方案

WaveTools高性能帧率解锁技术解析:突破鸣潮游戏性能瓶颈的完整方案 【免费下载链接】WaveTools 🧰鸣潮工具箱 项目地址: https://gitcode.com/gh_mirrors/wa/WaveTools WaveTools作为一款专为《鸣潮》游戏设计的高性能工具箱,通过动态…...

biliTickerBuy:高效智能的B站会员购票辅助工具解决方案

biliTickerBuy:高效智能的B站会员购票辅助工具解决方案 【免费下载链接】biliTickerBuy b站会员购购票辅助工具 项目地址: https://gitcode.com/GitHub_Trending/bi/biliTickerBuy 在热门动漫展、演唱会门票一票难求的今天,biliTickerBuy为二次元…...

英雄联盟回放分析工具ROFL-Player:免费快速查看比赛数据的终极指南

英雄联盟回放分析工具ROFL-Player:免费快速查看比赛数据的终极指南 【免费下载链接】ROFL-Player (No longer supported) One stop shop utility for viewing League of Legends replays! 项目地址: https://gitcode.com/gh_mirrors/ro/ROFL-Player ROFL-Pla…...

技术分析报告:针对iOS 15-16.6激活锁问题的applera1n解决方案深度解析

技术分析报告:针对iOS 15-16.6激活锁问题的applera1n解决方案深度解析 【免费下载链接】applera1n icloud bypass for ios 15-16 项目地址: https://gitcode.com/gh_mirrors/ap/applera1n 本文对基于checkm8硬件漏洞的iOS激活锁绕过工具applera1n进行技术架构…...

Ostrakon-VL终端部署案例:智慧菜场用AI识别蔬菜新鲜度与农药残留提示

Ostrakon-VL终端部署案例:智慧菜场用AI识别蔬菜新鲜度与农药残留提示 1. 项目背景与价值 在传统菜场运营中,蔬菜新鲜度判断和农药残留检测一直是个难题。摊主通常依靠经验判断,消费者则难以获得客观数据。我们基于Ostrakon-VL-8B多模态大模…...

SeaweedFS高可用集群部署实战指南

1. SeaweedFS高可用集群部署入门 第一次接触SeaweedFS时,我被它简洁的架构设计惊艳到了。这个用Go语言编写的分布式文件系统,不仅部署简单,还能轻松扩展到PB级别。记得去年我们团队需要为一个视频平台搭建存储系统,尝试了几种方案…...

Step-by-Step Guide to Installing Veeam Backup Replication Console 13

1. 准备工作:下载安装包与系统检查 在开始安装Veeam Backup & Replication Console 13之前,我们需要做好充分的准备工作。首先前往Veeam官网下载最新版本的安装包,建议直接搜索"Veeam Backup & Replication Console 13下载"…...

Markdown Viewer:浏览器中的Markdown全能阅读器,让技术文档焕然一新

Markdown Viewer:浏览器中的Markdown全能阅读器,让技术文档焕然一新 【免费下载链接】markdown-viewer Markdown Viewer / Browser Extension 项目地址: https://gitcode.com/gh_mirrors/ma/markdown-viewer 你是否曾经在浏览器中打开一个Markdow…...

)

别再傻傻分不清了!一文搞懂VoLTE、ViLTE、VoWiFi背后的IMS核心网(附保姆级信令流程图解)

从零理解IMS:VoLTE、ViLTE与VoWiFi的技术本质与实战图解 刚接触移动通信技术的工程师常被一堆以"Vo"开头的术语绕晕——VoLTE通话时突然弹出ViLTE选项,地铁里没信号却能用WiFi打电话,这些功能背后都离不开IMS核心网的支持。如果把移…...

从概率视角解析Logistic回归中的交叉熵损失函数

1. 从概率论到交叉熵:理解Logistic回归的底层逻辑 我第一次接触交叉熵损失函数时,完全被这个看似复杂的公式吓到了。直到后来从概率论的角度重新审视它,才发现这个设计简直精妙绝伦。让我们从一个简单的例子开始:假设你正在玩一个…...