Kubeadm - K8S1.20 - 高可用集群部署(博客)

这里写目录标题

- Kubeadm - K8S1.20 - 高可用集群部署

- 一.环境准备

- 1.系统设置

- 二.所有节点安装docker

- 三.所有节点安装kubeadm,kubelet和kubectl

- 1.定义kubernetes源

- 2.高可用组件安装、配置

- 四.部署K8S集群

- 五.问题解决

- 1.加入集群的 Token 过期

- 2.master节点 无法部署非系统Pod

- 3.修改NodePort的默认端口

- 4.外部 etcd 部署配置

Kubeadm - K8S1.20 - 高可用集群部署

一.环境准备

1.系统设置

注意事项:

master节点cpu核心数要求大于2

●最新的版本不一定好,但相对于旧版本,核心功能稳定,但新增功能、接口相对不稳

●学会一个版本的 高可用部署,其他版本操作都差不多

●宿主机尽量升级到CentOS 7.9

●内核kernel升级到 4.19+ 这种稳定的内核

●部署k8s版本时,尽量找 1.xx.5 这种大于5的小版本(这种一般是比较稳定的版本)

//所有节点,关闭防火墙规则,关闭selinux,关闭swap交换

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab//修改主机名

hostnamectl set-hostname master01

hostnamectl set-hostname master02

hostnamectl set-hostname master03

hostnamectl set-hostname node01

hostnamectl set-hostname node02//所有节点修改hosts文件

vim /etc/hosts

192.168.82.100 master01

192.168.82.101 master02

192.168.82.102 master03

192.168.82.103 node01

192.168.82.104 node02//所有节点时间同步

yum -y install ntpdate

ln -sf /usr/share/zoneinfo/Asia/Shanghai /etc/localtime

echo 'Asia/Shanghai' >/etc/timezone

ntpdate time2.aliyun.comsystemctl enable --now crondcrontab -e

*/30 * * * * /usr/sbin/ntpdate time2.aliyun.com//所有节点实现Linux的资源限制

vim /etc/security/limits.conf

* soft nofile 65536

* hard nofile 131072

* soft nproc 65535

* hard nproc 655350

* soft memlock unlimited

* hard memlock unlimited//所有节点升级内核

wget http://193.49.22.109/elrepo/kernel/el7/x86_64/RPMS/kernel-ml-devel-4.19.12-1.el7.elrepo.x86_64.rpm -O /opt/kernel-ml-devel-4.19.12-1.el7.elrepo.x86_64.rpm

wget http://193.49.22.109/elrepo/kernel/el7/x86_64/RPMS/kernel-ml-4.19.12-1.el7.elrepo.x86_64.rpm -O /opt/kernel-ml-4.19.12-1.el7.elrepo.x86_64.rpmcd /opt/

yum localinstall -y kernel-ml*#更改内核启动方式

grub2-set-default 0 && grub2-mkconfig -o /etc/grub2.cfg

grubby --args="user_namespace.enable=1" --update-kernel="$(grubby --default-kernel)"

grubby --default-kernel

reboot//调整内核参数

cat > /etc/sysctl.d/k8s.conf <<EOF

net.ipv4.ip_forward = 1

net.bridge.bridge-nf-call-iptables = 1

net.bridge.bridge-nf-call-ip6tables = 1

fs.may_detach_mounts = 1

vm.overcommit_memory=1

vm.panic_on_oom=0

fs.inotify.max_user_watches=89100

fs.file-max=52706963

fs.nr_open=52706963

net.netfilter.nf_conntrack_max=2310720net.ipv4.tcp_keepalive_time = 600

net.ipv4.tcp_keepalive_probes = 3

net.ipv4.tcp_keepalive_intvl =15

net.ipv4.tcp_max_tw_buckets = 36000

net.ipv4.tcp_tw_reuse = 1

net.ipv4.tcp_max_orphans = 327680

net.ipv4.tcp_orphan_retries = 3

net.ipv4.tcp_syncookies = 1

net.ipv4.tcp_max_syn_backlog = 16384

net.ipv4.ip_conntrack_max = 65536

net.ipv4.tcp_max_syn_backlog = 16384

net.ipv4.tcp_timestamps = 0

net.core.somaxconn = 16384

EOF#生效参数

sysctl --system //加载 ip_vs 模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

二.所有节点安装docker

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.iomkdir /etc/docker

cat > /etc/docker/daemon.json <<EOF

{"registry-mirrors": ["https://xxxxxxx.mirror.aliyuncs.com"],"exec-opts": ["native.cgroupdriver=systemd"],"log-driver": "json-file","log-opts": {"max-size": "500m", "max-file": "3"}

}

EOFsystemctl daemon-reload

systemctl restart docker.service

systemctl enable docker.service docker info | grep "Cgroup Driver"

Cgroup Driver: systemd三.所有节点安装kubeadm,kubelet和kubectl

1.定义kubernetes源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOFyum install -y kubelet-1.20.15 kubeadm-1.20.15 kubectl-1.20.15#配置Kubelet使用阿里云的pause镜像

cat > /etc/sysconfig/kubelet <<EOF

KUBELET_EXTRA_ARGS="--cgroup-driver=systemd --pod-infra-container-image=registry.cn-hangzhou.aliyuncs.com/google_containers/pause-amd64:3.2"

EOF//开机自启kubelet

systemctl enable --now kubelet2.高可用组件安装、配置

//所有 master 节点部署 Haproxy

yum -y install haproxy keepalivedcat > /etc/haproxy/haproxy.cfg << EOF

globallog 127.0.0.1 local0 infolog 127.0.0.1 local1 warningchroot /var/lib/haproxypidfile /var/run/haproxy.pidmaxconn 4000user haproxygroup haproxydaemonstats socket /var/lib/haproxy/statsdefaultsmode tcplog globaloption tcplogoption dontlognulloption redispatchretries 3timeout queue 1mtimeout connect 10stimeout client 1mtimeout server 1mtimeout check 10smaxconn 3000frontend monitor-inbind *:33305mode httpoption httplogmonitor-uri /monitorfrontend k8s-masterbind *:6444 mode tcpoption tcplogdefault_backend k8s-masterbackend k8s-mastermode tcpoption tcplogoption tcp-checkbalance roundrobinserver k8s-master1 192.168.82.100:6443 check inter 10000 fall 2 rise 2 weight 1server k8s-master2 192.168.82.101:6443 check inter 10000 fall 2 rise 2 weight 1server k8s-master3 192.168.82.102:6443 check inter 10000 fall 2 rise 2 weight 1

EOF//所有 master 节点部署 keepalived

yum -y install keepalivedcd /etc/keepalived/

vim keepalived.conf

! Configuration File for keepalived

global_defs {router_id LVS_HA1 #路由标识符,每个节点配置不同

}vrrp_script chk_haproxy {script "/etc/keepalived/check_haproxy.sh"interval 2weight 2

}vrrp_instance VI_1 {state MASTER #本机实例状态,MASTER/BACKUP,备机配置文件中设置BACKUPinterface ens33virtual_router_id 51priority 100 #本机初始权重,备机设置小于主机的值advert_int 1virtual_ipaddress {192.168.82.200 #设置VIP地址}track_script {chk_haproxy}

}vim check_haproxy.sh

#!/bin/bash

if ! killall -0 haproxy; thensystemctl stop keepalived

fisystemctl enable --now haproxy

systemctl enable --now keepalived

四.部署K8S集群

//在 master01 节点上设置集群初始化配置文件

kubeadm config print init-defaults > /opt/kubeadm-config.yamlcd /opt/

vim kubeadm-config.yaml

......

11 localAPIEndpoint:

12 advertiseAddress: 192.168.82.100 #指定当前master节点的IP地址

13 bindPort: 6443 #注意haproxy中的后端端口21 apiServer:

22 certSANs: #在apiServer属性下面添加一个certsSANs的列表,添加所有master节点的IP地址和集群VIP地址

23 - 192.168.82.200

24 - 192.168.82.100

25 - 192.168.82.101

26 - 192.168.82.10230 clusterName: kubernetes

31 controlPlaneEndpoint: "192.168.82.200:6444" #指定集群VIP地址,注意与haproxy的前端访问端口一致

32 controllerManager: {}38 imageRepository: registry.cn-hangzhou.aliyuncs.com/google_containers #指定镜像下载地址

39 kind: ClusterConfiguration

40 kubernetesVersion: v1.20.15 #指定kubernetes版本号

41 networking:

42 dnsDomain: cluster.local

43 podSubnet: "10.244.0.0/16" #指定pod网段,10.244.0.0/16用于匹配flannel默认网段

44 serviceSubnet: 10.96.0.0/16 #指定service网段

45 scheduler: {}

#末尾再添加以下内容

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

mode: ipvs #把默认的kube-proxy调度方式改为ipvs模式#更新集群初始化配置文件

kubeadm config migrate --old-config kubeadm-config.yaml --new-config new.yaml//所有节点拉取镜像

#拷贝yaml配置文件给其他主机,通过配置文件进行拉取镜像

for i in master02 master03 node01 node02; do scp /opt/new.yaml $i:/opt/; donekubeadm config images pull --config /opt/new.yaml//master01 节点进行初始化

kubeadm init --config new.yaml --upload-certs | tee kubeadm-init.log

#提示:

.........

Your Kubernetes control-plane has initialized successfully!To start using your cluster, you need to run the following as a regular user:mkdir -p $HOME/.kubesudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/configsudo chown $(id -u):$(id -g) $HOME/.kube/configAlternatively, if you are the root user, you can run:export KUBECONFIG=/etc/kubernetes/admin.confYou should now deploy a pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:https://kubernetes.io/docs/concepts/cluster-administration/addons/You can now join any number of the control-plane node running the following command on each as root:

#master节点加入使用的命令,记录!kubeadm join 192.168.82.200:6444 --token 7t2weq.bjbawausm0jaxury \--discovery-token-ca-cert-hash sha256:e76e4525ca29a9ccd5c24142a724bdb6ab86512420215242c4313fb830a4eb98 \--control-plane --certificate-key 0f2a7ff2c46ec172f834e237fcca8a02e7c29500746594c25d995b78c92dde96Please note that the certificate-key gives access to cluster sensitive data, keep it secret!

As a safeguard, uploaded-certs will be deleted in two hours; If necessary, you can use

"kubeadm init phase upload-certs --upload-certs" to reload certs afterward.Then you can join any number of worker nodes by running the following on each as root:

#node节点加入使用的命令。记录!

kubeadm join 192.168.82.200:6444 --token 7t2weq.bjbawausm0jaxury \--discovery-token-ca-cert-hash sha256:e76e4525ca29a9ccd5c24142a724bdb6ab86512420215242c4313fb830a4eb98#若初始化失败,进行的操作

kubeadm reset -f

ipvsadm --clear

rm -rf ~/.kube

再次进行初始化//master01 节点进行环境配置

#配置 kubectl

mkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config#修改controller-manager和scheduler配置文件

vim /etc/kubernetes/manifests/kube-scheduler.yaml

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

......#- --port=0 #搜索port=0,把这一行注释掉systemctl restart kubelet#部署网络插件flannel

所有节点上传 flannel 镜像 flannel.tar 和网络插件 cni-plugins-linux-amd64-v0.8.6.tgz 到 /opt 目录,master节点上传 kube-flannel.yml 文件

cd /opt

docker load < flannel.tarmv /opt/cni /opt/cni_bak

mkdir -p /opt/cni/bin

tar zxvf cni-plugins-linux-amd64-v0.8.6.tgz -C /opt/cni/binkubectl apply -f kube-flannel.yml //所有节点加入集群

#master 节点加入集群

kubeadm join 192.168.82.200:6444 --token 7t2weq.bjbawausm0jaxury \--discovery-token-ca-cert-hash sha256:e76e4525ca29a9ccd5c24142a724bdb6ab86512420215242c4313fb830a4eb98 \--control-plane --certificate-key 0f2a7ff2c46ec172f834e237fcca8a02e7c29500746594c25d995b78c92dde96mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config#node 节点加入集群

kubeadm join 192.168.82.200:6444 --token 7t2weq.bjbawausm0jaxury \--discovery-token-ca-cert-hash sha256:e76e4525ca29a9ccd5c24142a724bdb6ab86512420215242c4313fb830a4eb98

#在 master01 查看集群信息

kubectl get nodes

NAME STATUS ROLES AGE VERSION

master01 Ready control-plane,master 2h5m v1.20.15

master02 Ready control-plane,master 2h5m v1.20.15

master03 Ready control-plane,master 2h5m v1.20.15

node01 Ready <none> 2h5m v1.20.15

node02 Ready <none> 2h5m v1.20.15kubectl get pod -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-74ff55c5b-4fg44 1/1 Running 2 2h5m

coredns-74ff55c5b-jsdxz 1/1 Running 0 2h5m

etcd-master01 1/1 Running 1 2h5m

etcd-master02 1/1 Running 1 2h5m

etcd-master03 1/1 Running 1 2h5m

kube-apiserver-master01 1/1 Running 1 2h5m

kube-apiserver-master02 1/1 Running 1 2h5m

kube-apiserver-master03 1/1 Running 1 2h5m

kube-controller-manager-master01 1/1 Running 3 2h5m

kube-controller-manager-master02 1/1 Running 1 2h5m

kube-controller-manager-master03 1/1 Running 2 2h5m

kube-flannel-ds-8qtx6 1/1 Running 2 2h4m

kube-flannel-ds-lmzdz 1/1 Running 0 2h4m

kube-flannel-ds-nb9qx 1/1 Running 1 2h4m

kube-flannel-ds-t4l4x 1/1 Running 1 2h4m

kube-flannel-ds-v592x 1/1 Running 1 2h4m

kube-proxy-6gd5j 1/1 Running 1 2h5m

kube-proxy-f8k96 1/1 Running 3 2h5m

kube-proxy-h7nrf 1/1 Running 1 2h5m

kube-proxy-j96b6 1/1 Running 1 2h5m

kube-proxy-mgmx6 1/1 Running 0 2h5m

kube-scheduler-master01 1/1 Running 1 2h5m

kube-scheduler-master02 1/1 Running 2 2h5m

kube-scheduler-master03 1/1 Running 2 2h5m五.问题解决

1.加入集群的 Token 过期

注意:Token值在集群初始化后,有效期为 24小时 ,过了24小时过期。进行重新生成Token,再次加入集群,新生成的Token为 2小时。1.1、生成Node节点加入集群的 Token

kubeadm token create --print-join-command

kubeadm join 192.168.82.200:16443 --token menw99.1hbsurvl5fiz119n --discovery-token-ca-cert-hash sha256:e76e4525ca29a9ccd5c24142a724bdb6ab865 12420215242c4313fb830a4eb981.2、生成Master节点加入集群的 --certificate-key

kubeadm init phase upload-certs --upload-certs

I1105 12:33:08.201601 93226 version.go:254] remote version is much newer: v1.22.3; falling back to: stable-1.20

[upload-certs] Storing the certificates in Secret "kubeadm-certs" in the "kube-system" Namespace

[upload-certs] Using certificate key:

38dba94af7a38700c3698b8acdf8e23f273be07877f5c86f4977dc023e333deb#master节点加入集群的命令

kubeadm join 192.168.82.200:16443 --token menw99.1hbsurvl5fiz119n --discovery-token-ca-cert-hash sha256:e76e4525ca29a9ccd5c24142a724bdb6ab86512420215242c4313fb830a4eb98 \--control-plane --certificate-key 38dba94af7a38700c3698b8acdf8e23f273be07877f5c86f4977dc023e333deb2.master节点 无法部署非系统Pod

解析:主要是因为master节点被加上污点,污点是不允许部署非系统 Pod,在 测试 环境,可以将污点去除,节省资源,可利用率。2.1、查看污点

kubectl describe node -l node-role.kubernetes.io/master= | grep Taints

Taints: node-role.kubernetes.io/master:NoSchedule

Taints: node-role.kubernetes.io/master:NoSchedule

Taints: node-role.kubernetes.io/master:NoSchedule2.2、取消污点

kubectl taint node -l node-role.kubernetes.io/master node-role.kubernetes.io/master:NoSchedule-

node/master01 untainted

node/master02 untainted

node/master03 untaintedkubectl describe node -l node-role.kubernetes.io/master= | grep Taints

Taints: <none>

Taints: <none>

Taints: <none>

3.修改NodePort的默认端口

原理:默认k8s的使用端口的范围为30000左右,作为对外部提供的端口。我们也可以通过对配置文件的修改去指定默认的对外端口的范围。#报错

The Service "nginx-svc" is invalid: spec.ports[0].nodePort: Invalid value: 80: provided port is not in the valid range. The range of valid ports is 30000-32767[root@k8s-master1 ~]# vim /etc/kubernetes/manifests/kube-apiserver.yaml

- --service-cluster-ip-range=10.96.0.0/16

- --service-node-port-range=1-65535 #找到后进行添加即可#无需重启,k8s会自动生效4.外部 etcd 部署配置

kubeadm config print init-defaults > /opt/kubeadm-config.yamlcd /opt/

vim kubeadm-config.yaml

apiVersion: kubeadm.k8s.io/v1beta2

bootstrapTokens:

- groups:- system:bootstrappers:kubeadm:default-node-tokentoken: abcdef.0123456789abcdefttl: 24h0m0susages:- signing- authentication

kind: InitConfiguration

localAPIEndpoint:advertiseAddress: 192.168.82.104bindPort: 6443

nodeRegistration:criSocket: /var/run/dockershim.sockname: master01taints:- effect: NoSchedulekey: node-role.kubernetes.io/master

---

apiServer:certSANs:- 10.96.0.1- 127.0.0.1- localhost- kubernetes- kubernetes.default- kubernetes.default.svc- kubernetes.default.svc.cluster.local- 192.168.82.200- 192.168.82.100- 192.168.82.101- 192.168.82.102- master01- master02- master03timeoutForControlPlane: 4m0s

apiVersion: kubeadm.k8s.io/v1beta2

certificatesDir: /etc/kubernetes/pki

clusterName: kubernetes

controlPlaneEndpoint: 192.168.82.200:16443

controllerManager: {}

dns:type: CoreDNS

etcd:external: #使用外部etcd的方式endpoints:- https://192.168.82.100:2379- https://192.168.82.101:2379- https://192.168.82.102:2379caFile: /opt/etcd/ssl/ca.pem #需要把etcd的证书都复制到所有master节点上certFile: /opt/etcd/ssl/server.pemkeyFile: /opt/etcd/ssl/server-key.pem

imageRepository: registry.cn-hangzhou.aliyuncs.com/google_containers

kind: ClusterConfiguration

kubernetesVersion: v1.20.15

networking:dnsDomain: cluster.localpodSubnet: "10.244.0.0/16"serviceSubnet: 10.96.0.0/16

scheduler: {}

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

mode: ipvs相关文章:

)

Kubeadm - K8S1.20 - 高可用集群部署(博客)

这里写目录标题 Kubeadm - K8S1.20 - 高可用集群部署一.环境准备1.系统设置 二.所有节点安装docker三.所有节点安装kubeadm,kubelet和kubectl1.定义kubernetes源2.高可用组件安装、配置 四.部署K8S集群五.问题解决1.加入集群的 Token 过期2.master节点 无法部署非系…...

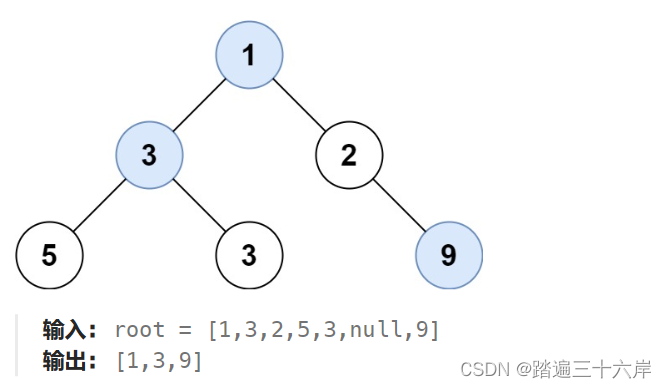

515. 在每个树行中找最大值

描述 : 给定一棵二叉树的根节点 root ,请找出该二叉树中每一层的最大值。 题目 : LeetCode 在每个树行中找最大值 : 515. 在每个树行中找最大值 分析 : 这里其实就是在得到一层之后使用一个变量来记录当前得到的最大值 , 懂了前面的几道这就是小菜 解析 : /…...

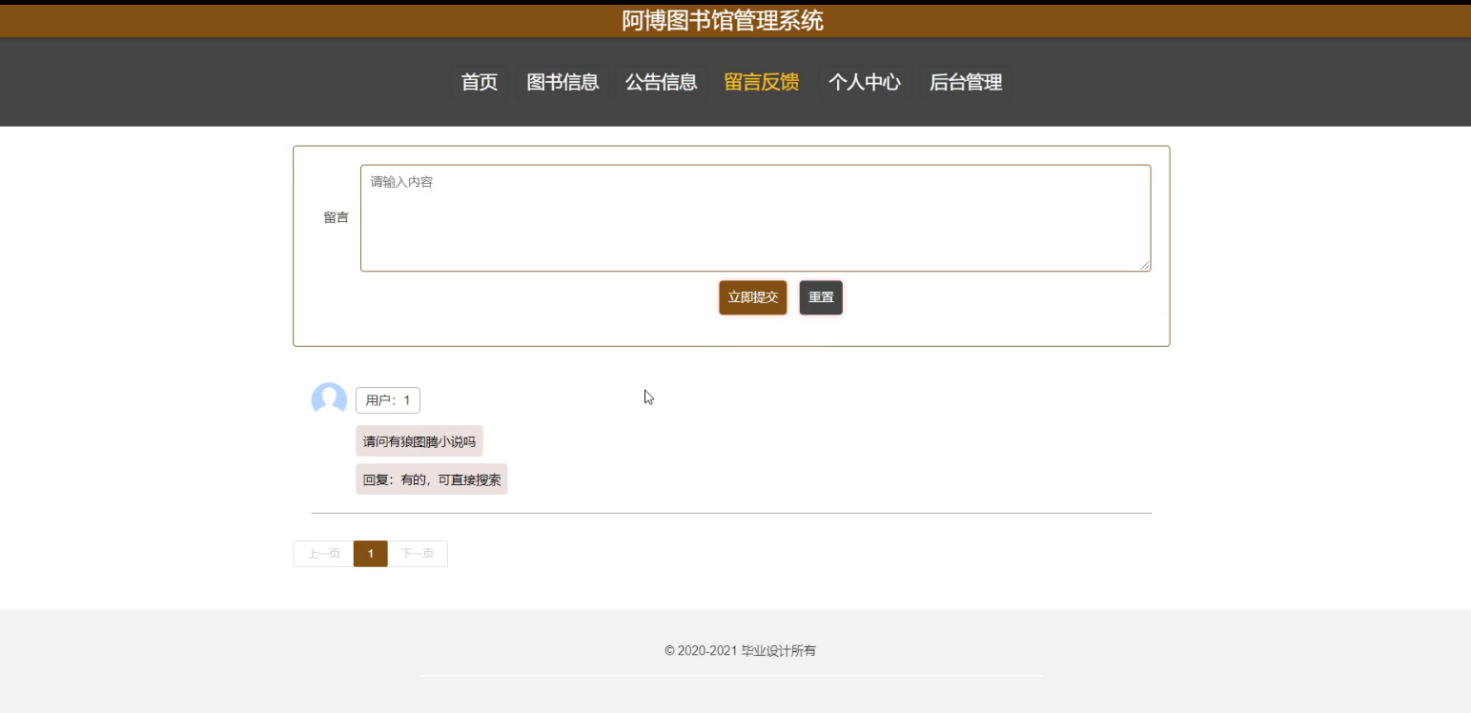

基于springboot+vue的图书馆管理系统

图书馆管理系统 springboot32阿博图书馆管理系统 源码合集: www.yuque.com/mick-hanyi/javaweb 源码下载:博主私 摘 要 随着社会的发展,计算机的优势和普及使得阿博图书馆管理系统的开发成为必需。阿博图书馆管理系统主要是借助计算机&…...

诊断刷写流程中使用到的诊断服务

10 01:诊断刷写完成后让目标ECU重置或让整车网络中其他ECU切换回默认会话 10 02:设置外部编程请求标志位或切换到编程会话(诊断刷写需要在编程会话下进行) 10 03:让目标ECU切换到扩展会话,以便进行其他诊断…...

pytorch 中 nn.Conv2d 解释

1. pytorch nn.Con2d 中填充模式 torch.nn.Conv2d(in_channels, out_channels, kernel_size, stride1, padding0, dilation1, groups1, biasTrue, padding_mode‘zeros’, deviceNone, dtypeNone) 1.1 padding 参数的含义 首先 ,padd N, 代表的是 分别在 上下&…...

漏刻有时百度地图API实战开发(2)文本标签显示和隐藏的切换开关

项目说明 在百度地图开发的过程中,如果遇见大数据量POI标注展示或在最佳视野展示时,没有文本标签,会不清楚具体标注的代表的意义;如果同时显示大量的文本标签,又会导致界面杂乱且无法清晰查看,因此&#x…...

Flink往Starrocks写数据报错:too many filtered rows

Bug信息 Caused by: com.starrocks.data.load.stream.exception.StreamLoadFailException: {"TxnId": 2711690,"Label": "cd528707-8595-4a35-b2bc-39b21087d6ec","Status": "Fail","Message": "too many f…...

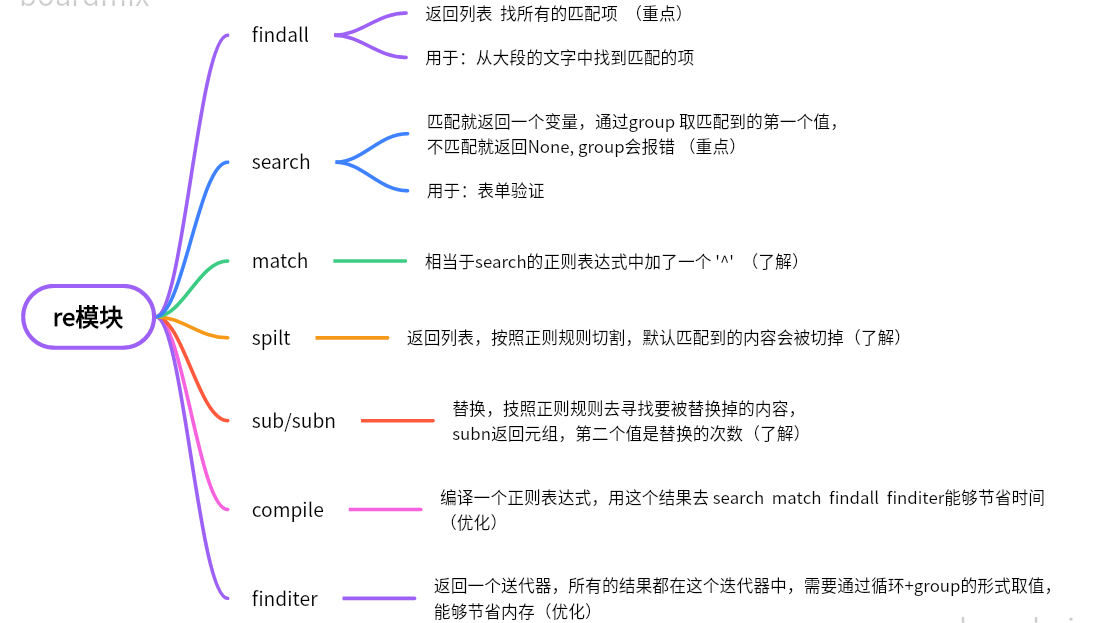

python-re模块

python之正则表达式-基础匹配https://blog.csdn.net/Python_1981/article/details/133777795python之正则表达式-元字符匹配https://blog.csdn.net/Python_1981/article/details/133778805 一、查找 1、findall 2、search 如果没有匹配到,会返回None, 使用group会报…...

SSM之spring注解式缓存redis

🎬 艳艳耶✌️:个人主页 🔥 个人专栏 :《Spring与Mybatis集成整合》《Vue.js使用》 ⛺️ 越努力 ,越幸运。 1.Redis与SSM的整合 1.1.添加Redis依赖 在Maven中添加Redis的依赖 <redis.version>2.9.0</redis.…...

jmeter压测问题分析

1、 目录 1、jmeter压测java.net.BindException: Address already in use: connect问题处理: 2、jmeter压测:java.net.SocketException: Socket closed: : 之前未勾选same user on each iteration中报问题java.net.BindExcept…...

threejs CSS3DRenderer添加标签并设置朝向摄像机

一.由于CSS3DRenderer 是附加组件,必须显式导入 import { CSS3DRenderer, CSS3DObject } from three/examples/jsm/renderers/CSS3DRenderer.js;二.CSS3DRenderer特点 CSS3D不面向摄像机,会跟随场景缩放,不被模型遮挡,通过DOM事…...

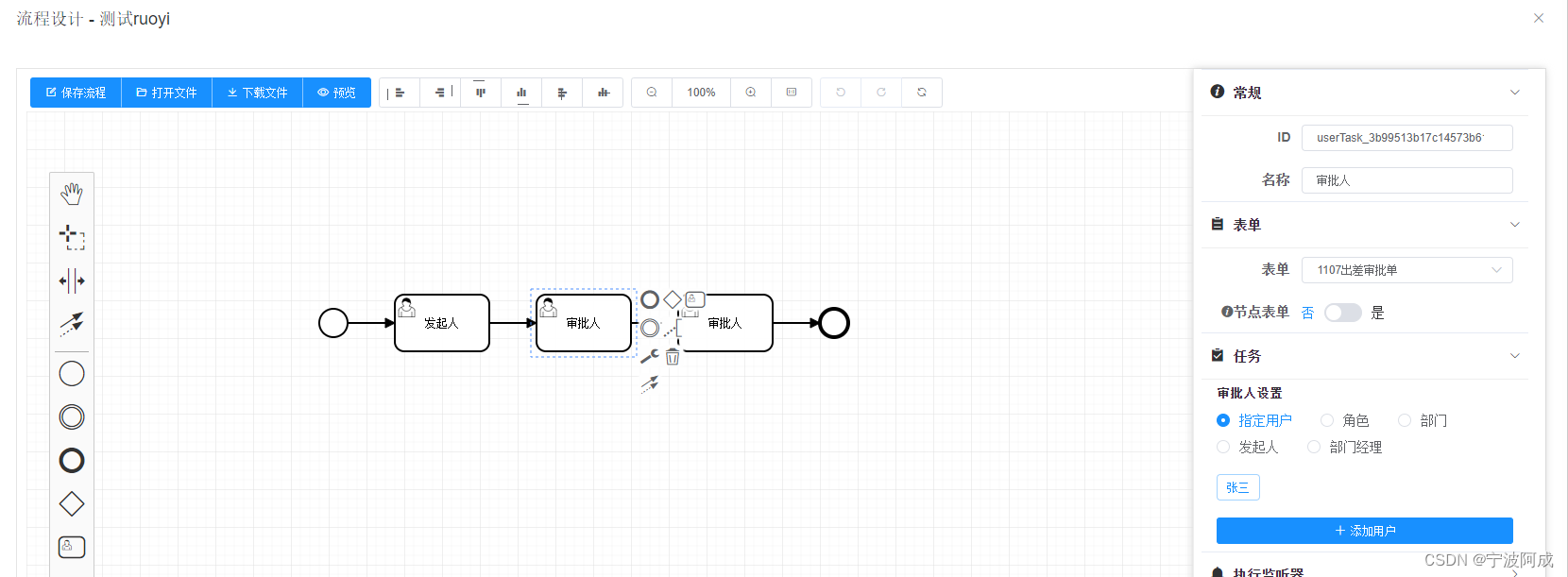

基于若依的ruoyi-nbcio流程管理系统仿钉钉流程json转bpmn的flowable的xml格式(简单支持发起人与审批人的流程)续

更多ruoyi-nbcio功能请看演示系统 gitee源代码地址 前后端代码: https://gitee.com/nbacheng/ruoyi-nbcio 演示地址:RuoYi-Nbcio后台管理系统 之前生产的xml,在bpmn设计里编辑有些内容不正确,包括审批人,关联表单等…...

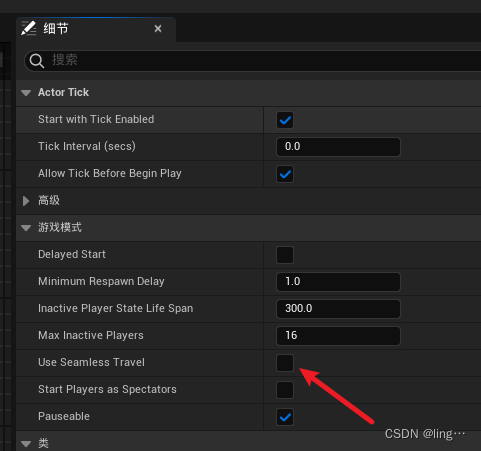

虚幻引擎:如何进行关卡切换?

一丶非无缝切换 在切换的时候会先断开连接,等创建好后才会链接,造成体验差 蓝图中用到的节点是 Execute Console Command 二丶无缝切换 链接的时候不会断开连接,中间不会出现卡顿,携带数据转换地图 1.需要在gamemode里面开启无缝漫游,开启之后使用上面的切换方式就可以做到无缝…...

工具类xxxUtil从application.properties中读取参数

一.原因 编写一个服务类的工具类,想做成一个灵活的配置,各种唯一code想从配置文件中读取,便有了这个坑。 二.使用value获取值为null, 这是因为这个工具类没有交给spring boot 来管理,导致每次都是new 一个新的,所以每…...

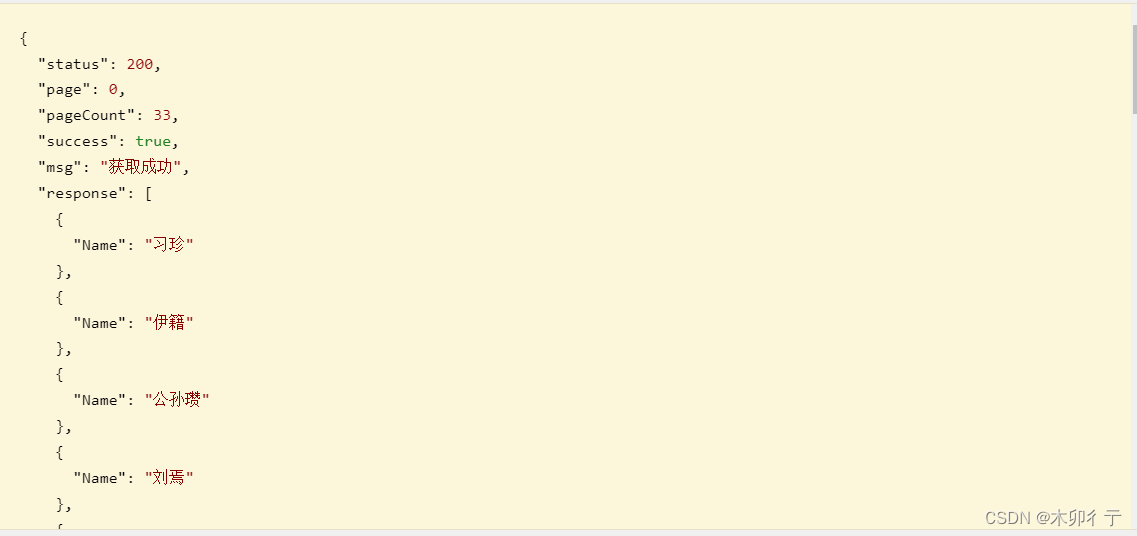

三国志14信息查询小程序(历史武将信息一览)制作更新过程05-后台接口的编写及调用

1,创建ASP.NET Web API项目 生成完毕,项目结构如下: 运行看一下: 2,后台接口编写 (1)在Models文件夹中新建一个sandata.cs文件(就是上篇中武将信息表的model文件) u…...

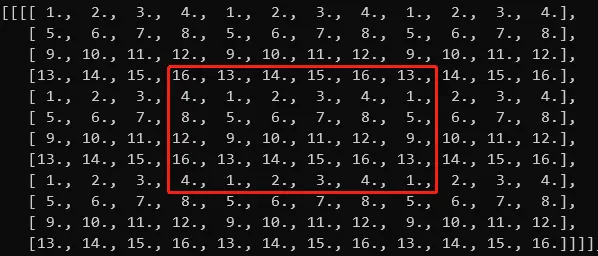

时序预测 | MATLAB实现基于SVM-Adaboost支持向量机结合AdaBoost时间序列预测

时序预测 | MATLAB实现基于SVM-Adaboost支持向量机结合AdaBoost时间序列预测 目录 时序预测 | MATLAB实现基于SVM-Adaboost支持向量机结合AdaBoost时间序列预测预测效果基本介绍模型描述程序设计参考资料 预测效果 基本介绍 1.Matlab实现SVM-Adaboost时间序列预测(风…...

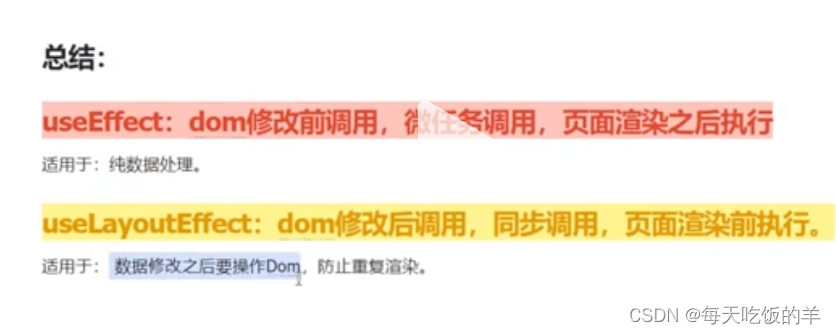

useEffect和useLayoutEffect的区别

烤冷面加辣条的抖音 - 抖音 (douyin.com) 一、看下面的代码,即使调换useLayoutEffect和useEffect的位置依旧是useLayoutEffect先输出。 import { useState, useEffect, useLayoutEffect } from "react"; const Index () > {useLayoutEffect(() >…...

[科研图像处理]用matlab平替image-j,有点麻烦,但很灵活!

做材料与生物相关方向的同学应该对image-j并不陌生,前几天有个师兄拜托我用image-j分析一些图片,但使用过后发现我由于不了解image-j的工作流程而对结果并不确信,而且image-j的功能无法拓展,对有些图片的处理效果并不好࿰…...

Node.js |(五)包管理工具 | 尚硅谷2023版Node.js零基础视频教程

学习视频:尚硅谷2023版Node.js零基础视频教程,nodejs新手到高手 文章目录 📚概念介绍📚npm🐇安装npm🐇基本使用🐇生产依赖与开发依赖🐇npm全局安装🐇npm安装指定包和删除…...

【ES专题】ElasticSearch集群架构剖析

目录 前言阅读对象阅读导航要点笔记正文一、ES集群架构1.1 为什么要使用ES集群架构1.2 ES集群核心概念1.2.1 节点1.2.1.1 Master Node主节点的功能1.2.1.2 Data Node数据节点的功能1.2.1.3 Coordinate Node协调节点的功能1.2.1.4 Ingest Node协调节点的功能1.2.1.5 其他节点功能…...

Windows热键冲突终极排查指南:3分钟快速定位问题应用

Windows热键冲突终极排查指南:3分钟快速定位问题应用 【免费下载链接】hotkey-detective A small program for investigating stolen key combinations under Windows 7 and later. 项目地址: https://gitcode.com/gh_mirrors/ho/hotkey-detective 你是否曾经…...

如何用OpenCore Legacy Patcher让老款Mac焕发新生:终极完整教程

如何用OpenCore Legacy Patcher让老款Mac焕发新生:终极完整教程 【免费下载链接】OpenCore-Legacy-Patcher Experience macOS just like before 项目地址: https://gitcode.com/GitHub_Trending/op/OpenCore-Legacy-Patcher OpenCore Legacy Patcher是一款革…...

Wan2.1 VAE数据预处理实战:Python爬虫采集的训练数据清洗

Wan2.1 VAE数据预处理实战:Python爬虫采集的训练数据清洗 如果你对Wan2.1 VAE模型感兴趣,想用自己的图片集来训练它,那么你很可能已经遇到了第一个,也是最关键的一个难题:数据从哪里来?又该怎么处理&#…...

vLLM推理引擎教程8-CUDA Graph内存池优化

1. CUDA Graph内存池优化原理 在vLLM这类大模型推理引擎中,CUDA Graph技术已经成为提升性能的标配方案。但很多开发者在使用过程中会遇到一个棘手问题:当需要处理不同batch size的请求时,显存碎片和重复分配会导致性能下降。这时候就需要引入…...

别再死记硬背了!用MONAI Transform处理医学图像,这5个实战场景帮你一次搞懂

医学图像处理实战:5个MONAI Transform核心场景解析 医学影像AI开发中最令人头疼的环节,往往不是模型设计,而是数据预处理。我曾见过不少团队花费80%的时间在数据清洗和转换上,却依然难以构建标准化的处理流程。MONAI Transform的出…...

自媒体好帮手:OpenClaw+千问3.5-27B批量生成视频脚本

自媒体好帮手:OpenClaw千问3.5-27B批量生成视频脚本 1. 为什么需要自动化视频脚本生成 作为一个自媒体创作者,我每天最头疼的就是选题和脚本创作。传统流程需要手动搜索热点、分析数据、撰写大纲、拆解分镜,整个过程耗时耗力。直到我发现Op…...

平价头戴式耳机哪个性价比高?揭秘排名前十的平价头戴式耳机品牌

对数码发烧友和爱琢磨音乐的人来说,头戴式耳机早不只是通勤路上、宅家追剧的 “刚需品”,更是能让人一头扎进音乐细节里的 “专属入口”—— 闭上眼就能听清吉他弦的摩擦声、歌手的换气尾音,这种沉浸感没它可不行。2026 年的耳机市场更是卷得…...

【实战技巧】利用rclone高效下载Google Drive共享大数据集

1. 为什么需要rclone下载Google Drive大数据集 做深度学习的朋友们应该都遇到过这样的场景:好不容易找到一个理想的开源数据集,结果发现它存放在Google Drive上,而且体积动辄几十GB甚至上百GB。这时候如果按照传统方法先下载到本地电脑再上传…...

@electron/asar 源码解读:Filesystem类的设计与实现

electron/asar 源码解读:Filesystem类的设计与实现 【免费下载链接】asar Simple extensive tar-like archive format with indexing 项目地址: https://gitcode.com/gh_mirrors/as/asar 在Electron应用开发中,文件打包和管理是至关重要的环节。作…...

Klipper固件全攻略:从配置到优化解决3D打印核心难题

Klipper固件全攻略:从配置到优化解决3D打印核心难题 【免费下载链接】klipper Klipper is a 3d-printer firmware 项目地址: https://gitcode.com/GitHub_Trending/kl/klipper 3D打印技术面临精度不足、振动干扰和配置复杂等挑战,Klipper固件通过…...