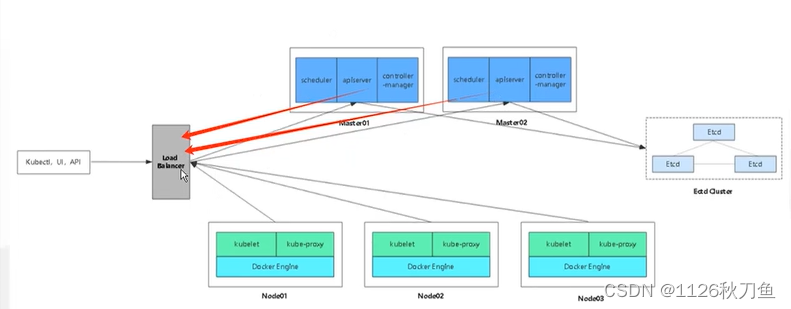

kubernetes多master集群架构

一、完成master02节点的初始化操作

一、完成master02节点的初始化操作

- master02环境准备,详细过程参考上一期博客环境准备

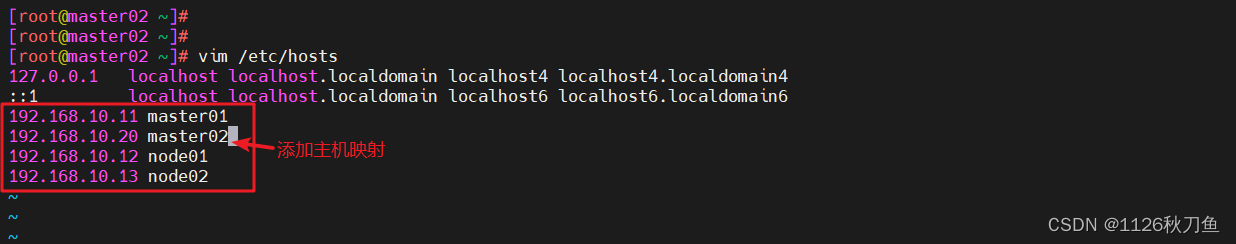

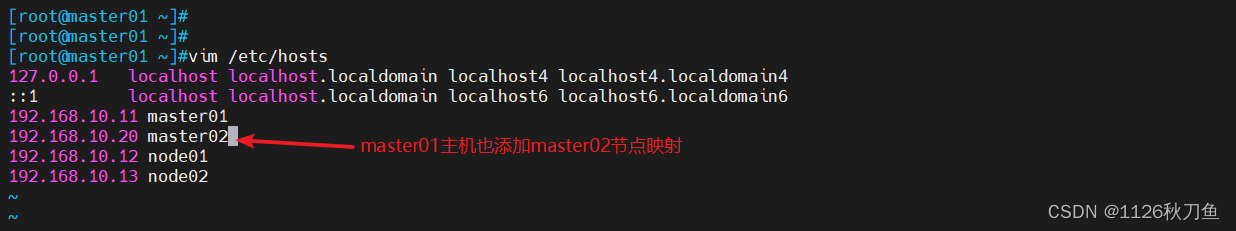

#添加主机映射

vim /etc/hosts

192.168.88.3 master01

192.168.88.8 master02

192.168.88.4 node01

192.168.88.5 node02

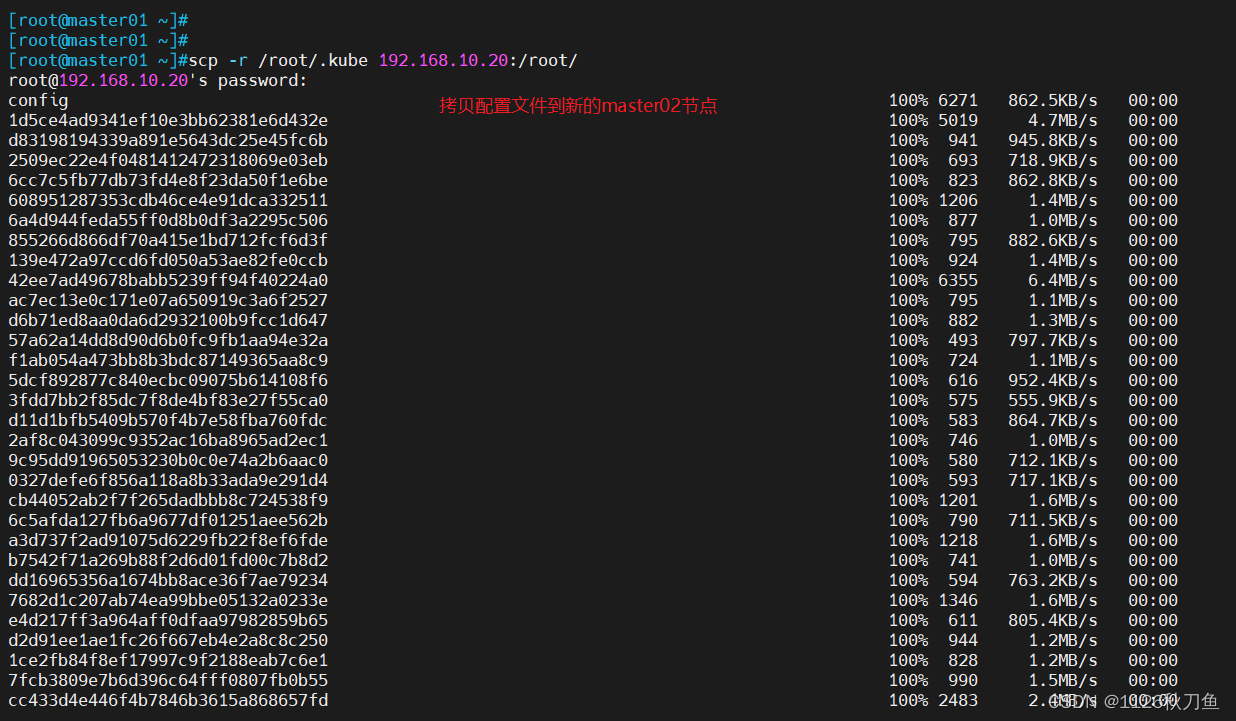

1、准备master02节点需要的文件

- 从 master01 节点上拷贝证书文件、各master组件的配置文件和服务管理文件到 master02 节点

-

scp -r /opt/etcd/ @192.168.10.20:/opt/ #拷贝etcd服务需要的文件到新的master02节点scp -r /opt/kubernetes/ @192.168.10.20:/opt #拷贝kubernetes目录下的文件到新的master02 节点scp -r /root/.kube @192.168.10.20:/root #拷贝当前目录下的文件到新的master02节点scp /usr/lib/systemd/system/{kube-apiserver,kube-controller-manager,kube-scheduler}.service root@192.168.10.20:/usr/lib/systemd/system/ #拷贝master01节点组件的服务管理文件到新的master02节点

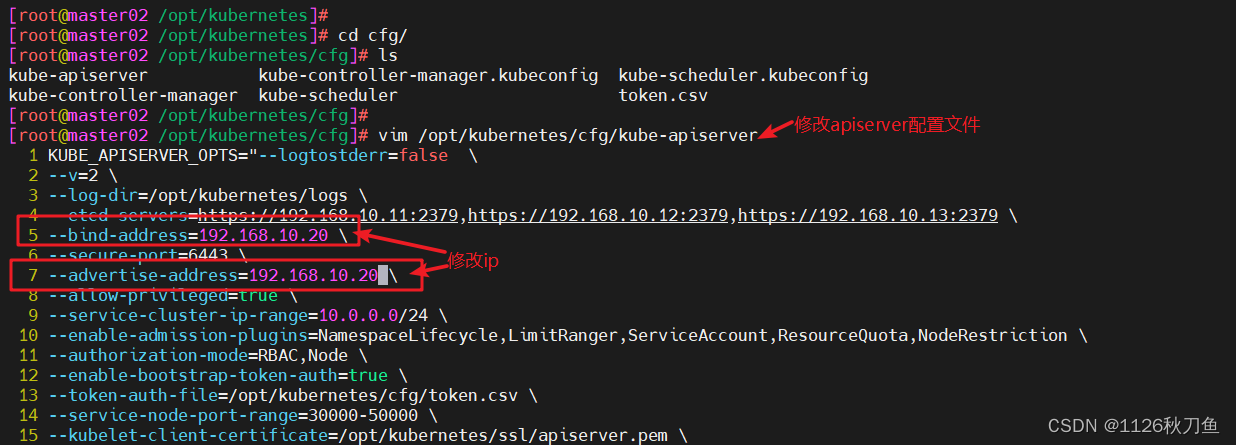

2、修改配置文件kube-apiserver中的IP

- master02节点

-

#修改apiserver配置文件 vim /opt/kubernetes/cfg/kube-apiserver --bind-address=192.168.88.8 \ #第5行,ip修改为本机的地址 --secure-port=6443 \ --advertise-address=192.168.88.8 \ #第7行,ip修改为本机的地址

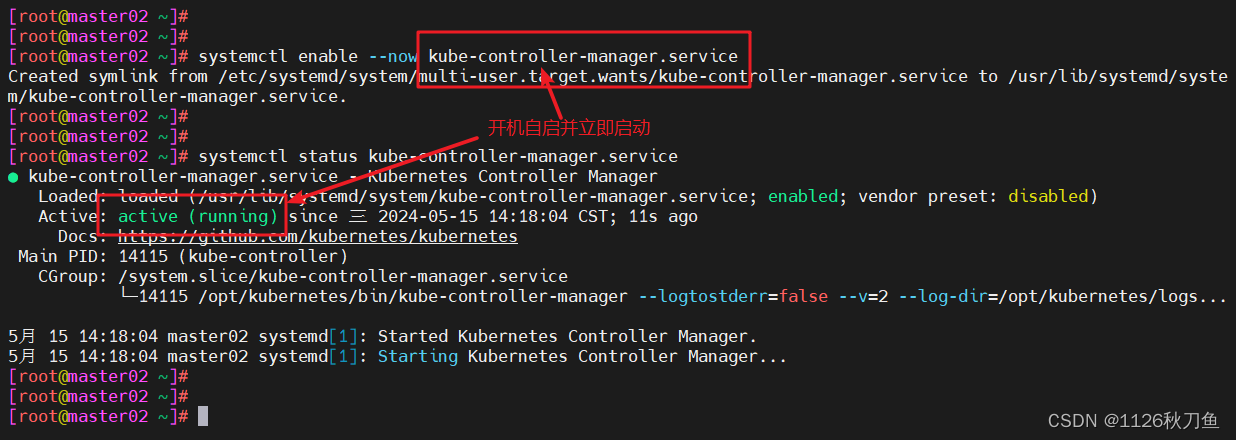

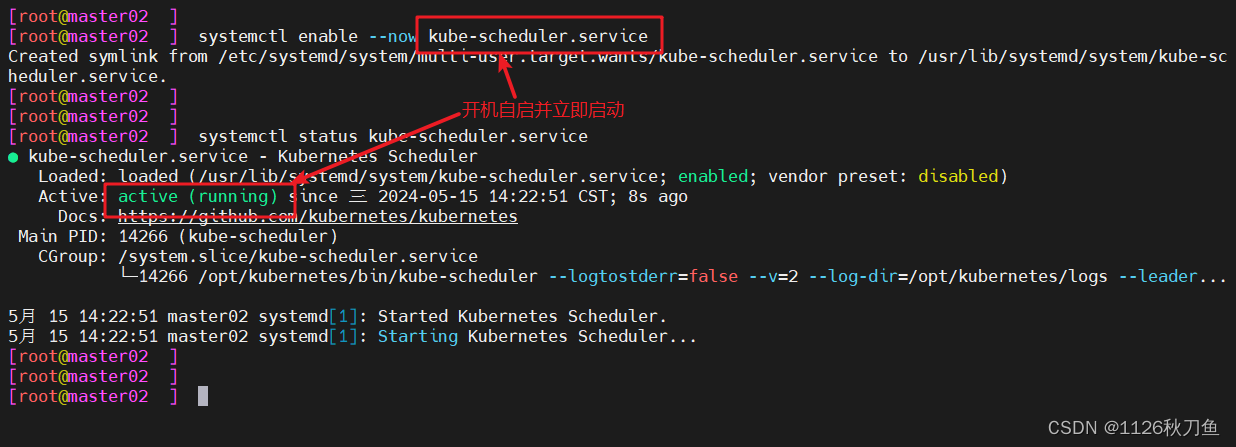

3、启动各服务并设置开机自启

- master02 节点

-

systemctl enable --now kube-apiserver.service #apiserver服务,开机自启并立即启动systemctl status kube-apiserver.service #查看apiserver服务状态systemctl enable --now kube-controller-manager.service #controller-manager服务,开机自启并立即启动systemctl status kube-controller-manager.service #查看服务状态systemctl enable --now kube-scheduler.service #scheduler服务开机自启并立即启动systemctl status kube-scheduler.service #查看服务状态

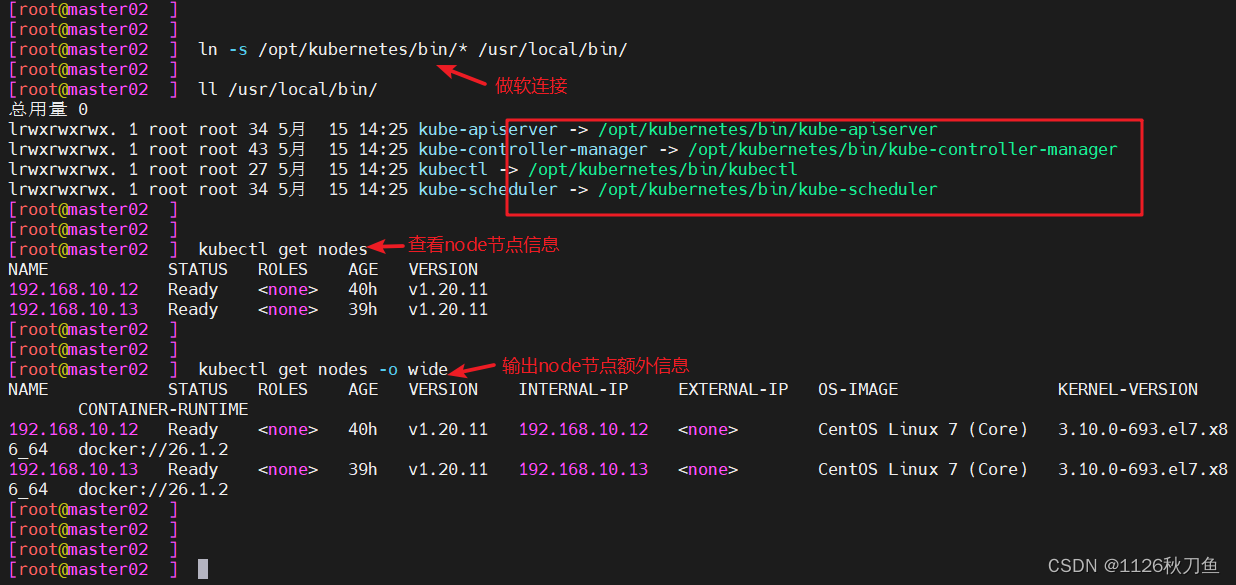

4、查看node节点状态

- master02节点

-

ln -s /opt/kubernetes/bin/* /usr/local/bin/ #做软连接kubectl get nodes #查看node节点信息kubectl get nodes -o wide #查看node节点信息 #-o=wide:输出额外信息;对于Pod,将输出Pod所在的Node名#此时在master02节点查到的node节点状态仅是从etcd查询到的信息,而此时node节点实际上并未与master02节点建立通信连接,因此需要使用一个VIP把node节点与master节点都关联起来

二、负载均衡部署

1、配置load balancer集群双机热备负载均衡

- nginx实现负载均衡,keepalived实现双机热备

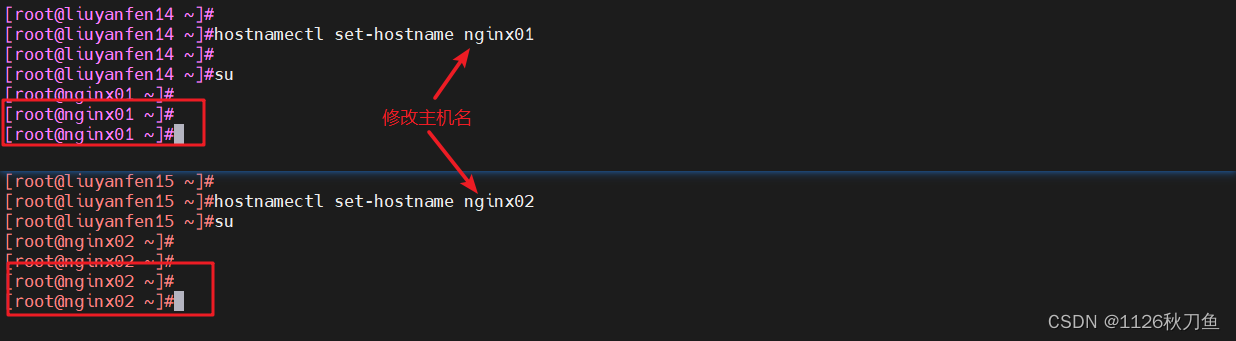

- 在nginx01、nginx02节点上操作

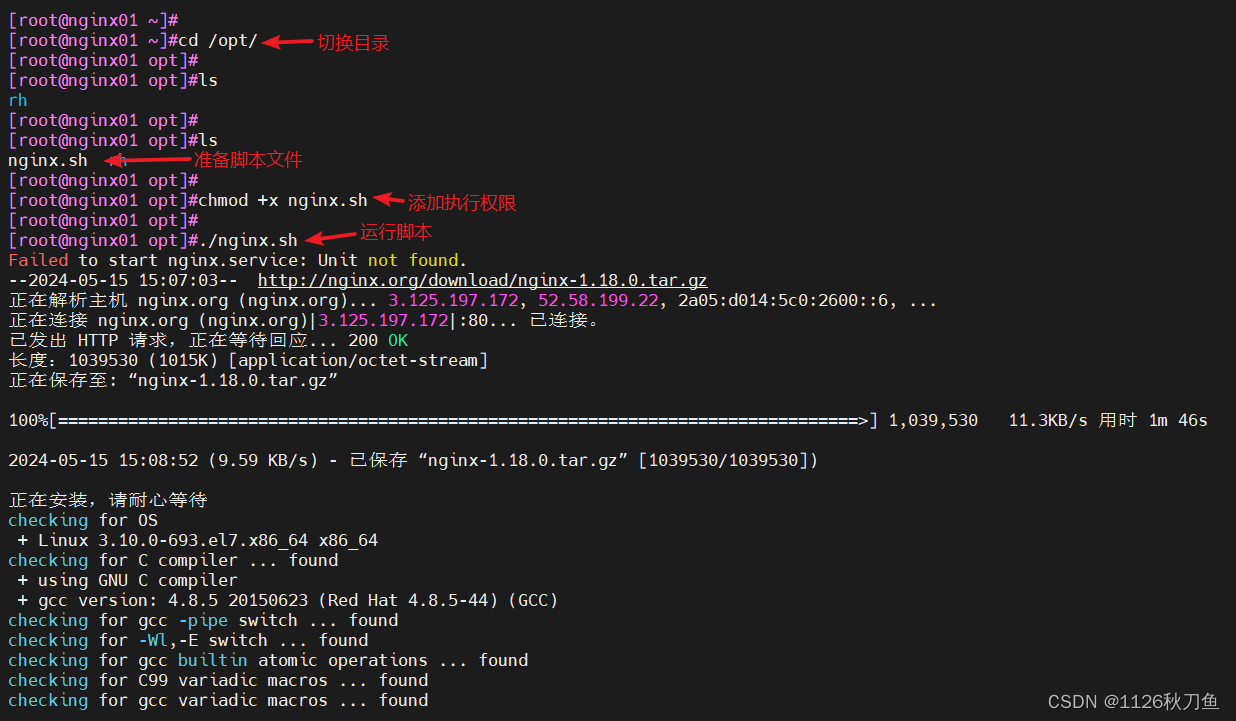

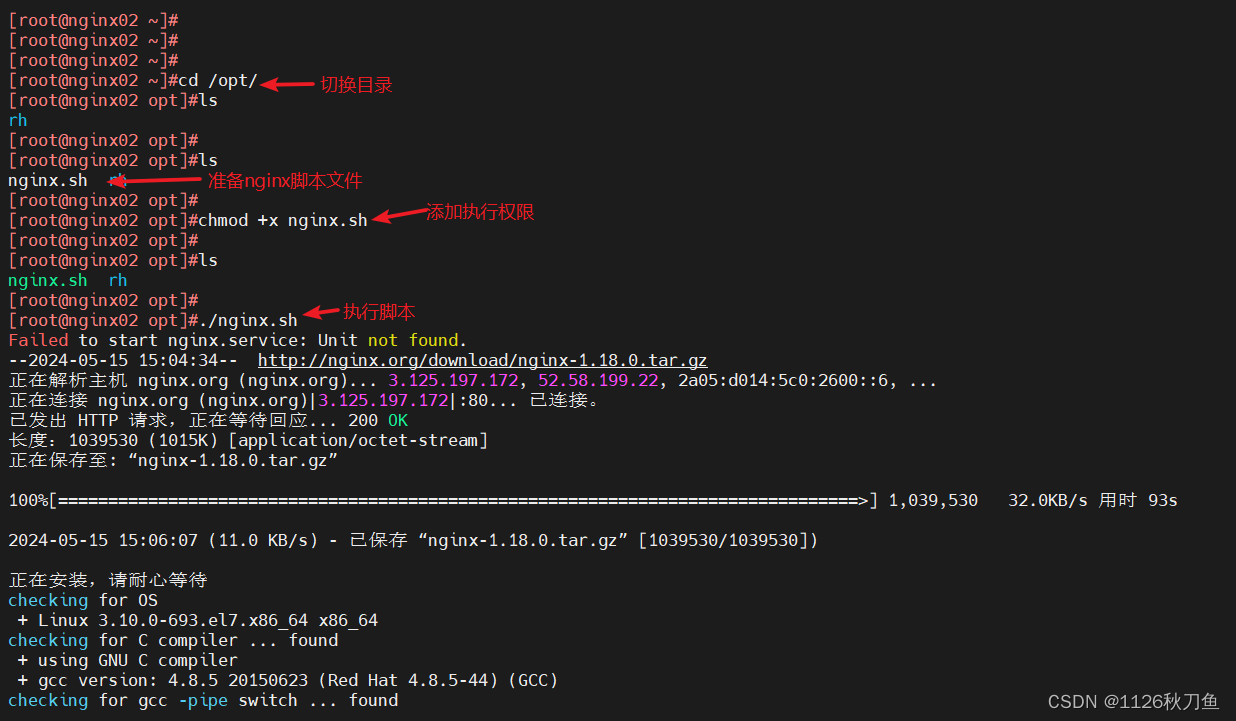

1.1 准备nginx编译安装脚本

#查看nginx编译安装脚本

cat nginx.sh

#/bin/bash

systemctl start nginx >>/dev/null

if [ $? -eq 0 ];then

echo "nginx服务已安装"

else

useradd -M -s /sbin/nologin nginx

cd /opt

wget http://nginx.org/download/nginx-1.18.0.tar.gz >>/dev/null

echo "正在安装,请耐心等待"

tar xf nginx-1.18.0.tar.gz

cd /opt/nginx-1.18.0

yum -y install gcc pcre-devel openssl-devel zlib-devel openssl openssl-devel &>>/dev/null

./configure --prefix=/usr/local/nginx \

--user=nginx \

--group=nginx \

--with-http_ssl_module \

--with-http_v2_module \

--with-http_realip_module \

--with-http_stub_status_module \

--with-http_gzip_static_module \

--with-pcre \

--with-stream \

--with-stream_ssl_module \

--with-stream_realip_module

make -j `lscpu|sed -n '4p'|awk '{print $2}'`&>>/dev/null

make install &>>/dev/null

ln -s /usr/local/nginx/sbin/nginx /usr/local/sbin/

cat > /usr/lib/systemd/system/nginx.service <<EOF

[Unit]

Description=nginx

After=network.target

[Service]

Type=forking

PIDFile=/usr/local/nginx/logs/nginx.pid

ExecStart=/usr/local/nginx/sbin/nginx

ExecReload=/bin/kill -1 $MAINPID

ExecStop=/bin/kill -3 $MAINPID

PrivateTmp=true

[Install]

WantedBy=multi-user.target

EOF

chown -R nginx.nginx /usr/local/nginx

systemctl daemon-reload &>>/dev/null

systemctl enable --now nginx

echo "nginx服务已开启"

fi

cd /opt/

#切换目录#上传nginx.sh脚本文件chmod +x nginx.sh

#添加执行权限./nginx.sh

#执行脚本

- nginx01节点

- nginx02节点

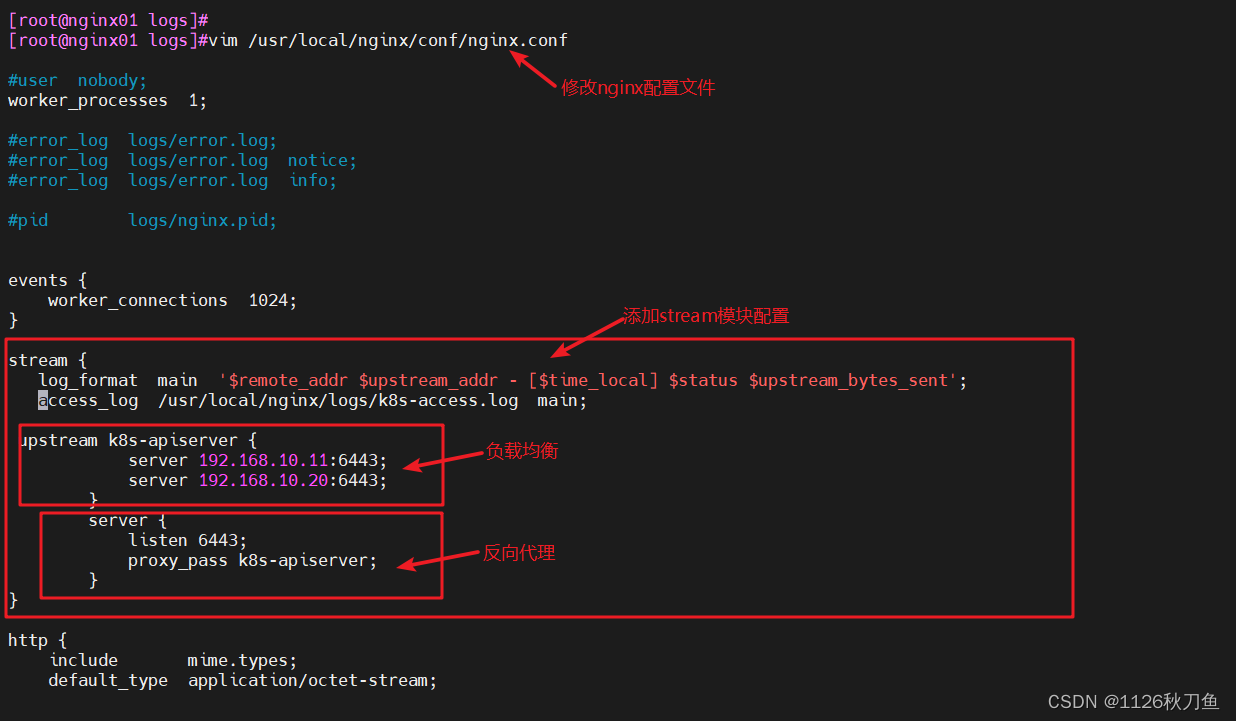

1.2 修改nginx配置文件

- 配置四层反向代理负载均衡,指定k8s群集2台master的节点ip和6443端口

-

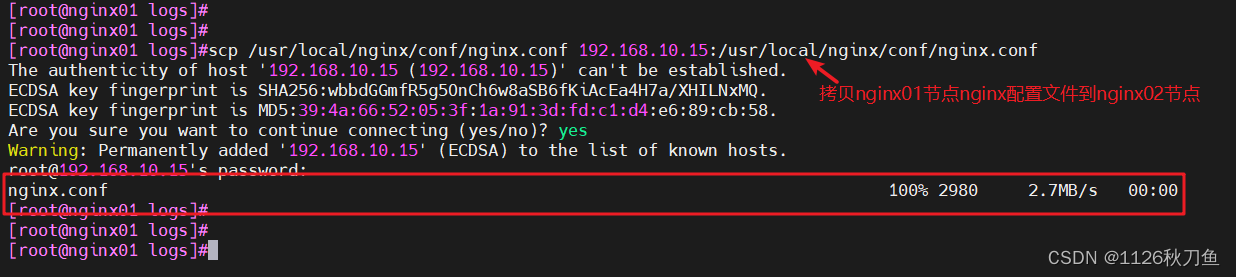

#修改nginx配置文件 vim /usr/local/nginx/conf/nginx.conf #添加stream模块配置 stream {log_format main '$remote_addr $upstream_addr - [$time_local] $status $upstream_bytes_sent';access_log /usr/local/nginx/logs/k8s-access.log main;upstream k8s-apiserver {server 192.168.10.11:6443;server 192.168.10.20:6443;#负载均衡}server {listen 6443;proxy_pass k8s-apiserver;#反向代理} }scp /usr/local/nginx/conf/nginx.conf 192.168.10.15:/usr/local/nginx/conf/nginx.conf #拷贝nginx01节点的nginx配置文件到nginx02节点 - nginx01节点 负载均衡指向master的ip地址

- nginx02节点

1.3 启动nginx服务

nginx -t

#检查配置文件语法systemctl enable --now nginx

#开机自启,立即启动systemctl restart nginx

#重启nginx服务ss -natp | grep nginx

#查看nginx进程

- nginx01

- nginx02

2、部署keepalived服务

- nginx01节点、nginx02节点操作

-

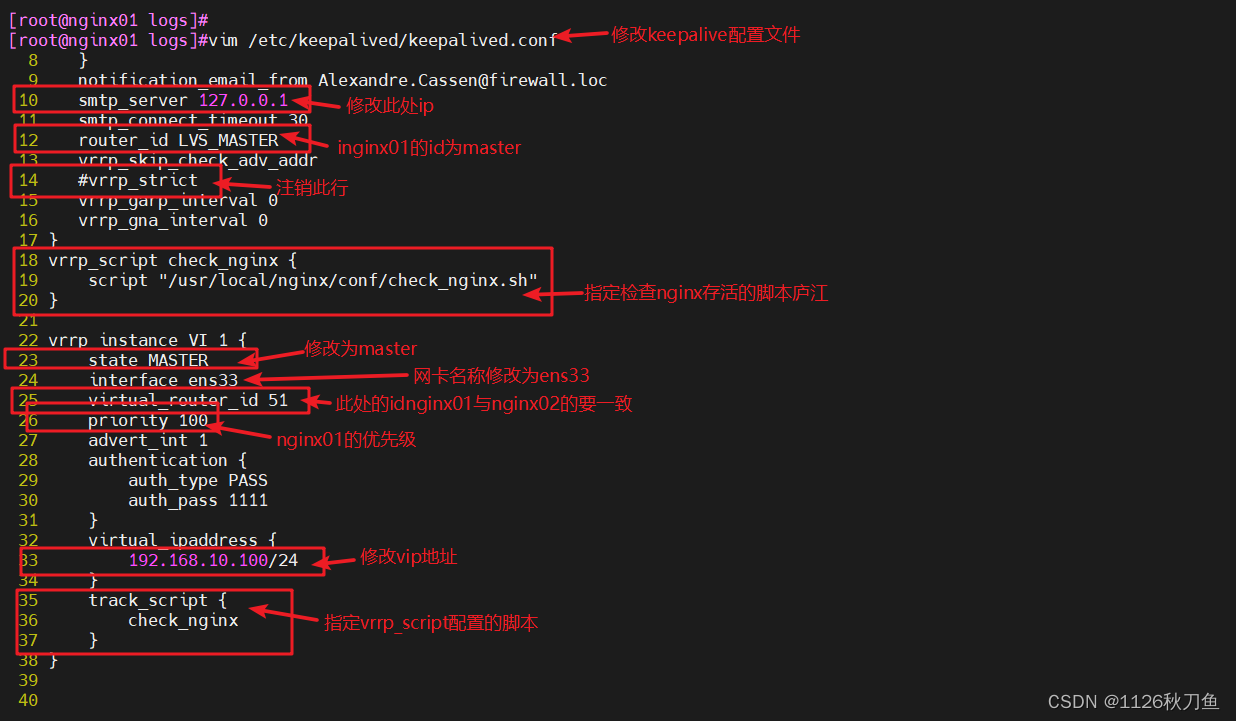

2.1 修改keepalive配置文件

-

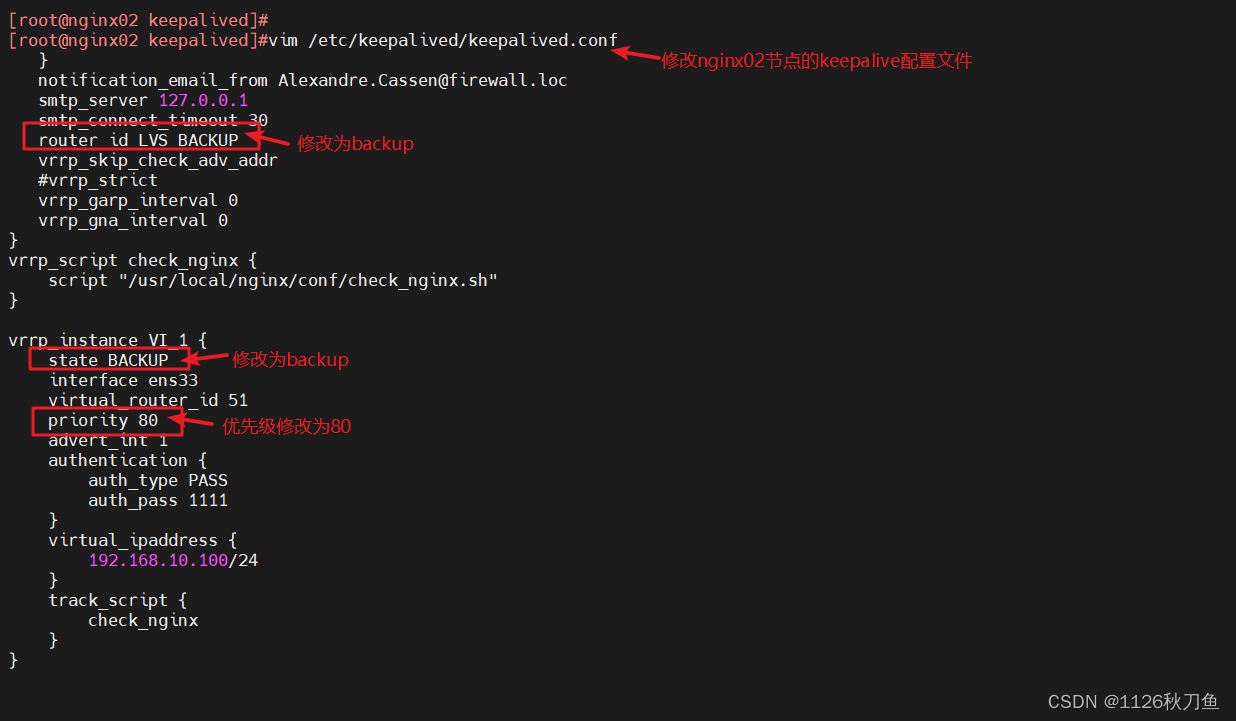

yum install -y keepalived.x86_64 #安装keepalive服务#修改keepalived配置文件 vim /etc/keepalived/keepalived.confsmtp_server 127.0.0.1#修改此处ipsmtp_connect_timeout 30router_id LVS_MASTER#nginx01节点的为MASTER,nginx02节点的为BACKUPvrrp_skip_check_adv_addr#vrrp_strict#注销此行vrrp_garp_interval 0vrrp_gna_interval 0 } vrrp_script check_nginx { #添加一个周期性执行的脚本script "/usr/local/nginx/conf/check_nginx.sh"#指定检查nginx存活的脚本路径 }vrrp_instance VI_1 {state MASTER#nginx01节点的为 MASTER,nginx02节点的为 BACKUPinterface ens33#指定网卡名称 ens33virtual_router_id 51#指定vrid,两个节点要一致priority 100#nginx01节点的优先级为100、nginx02节点的优先级为80advert_int 1authentication {auth_type PASSauth_pass 1111}virtual_ipaddress {192.168.10.100/24#指定 VIP}track_script {check_nginx#指定vrrp_script配置的脚本} } #下面配置部分全部删除即可scp /etc/keepalived/keepalived.conf 192.168.10.15:/etc/keepalived/keepalived.conf #复制nginx01节点的keepalive配置文件到nginx02节点#按照上面说明部分修改nginx02节点keepalive配置文件 -

nginx01节点

-

- nginx02节点

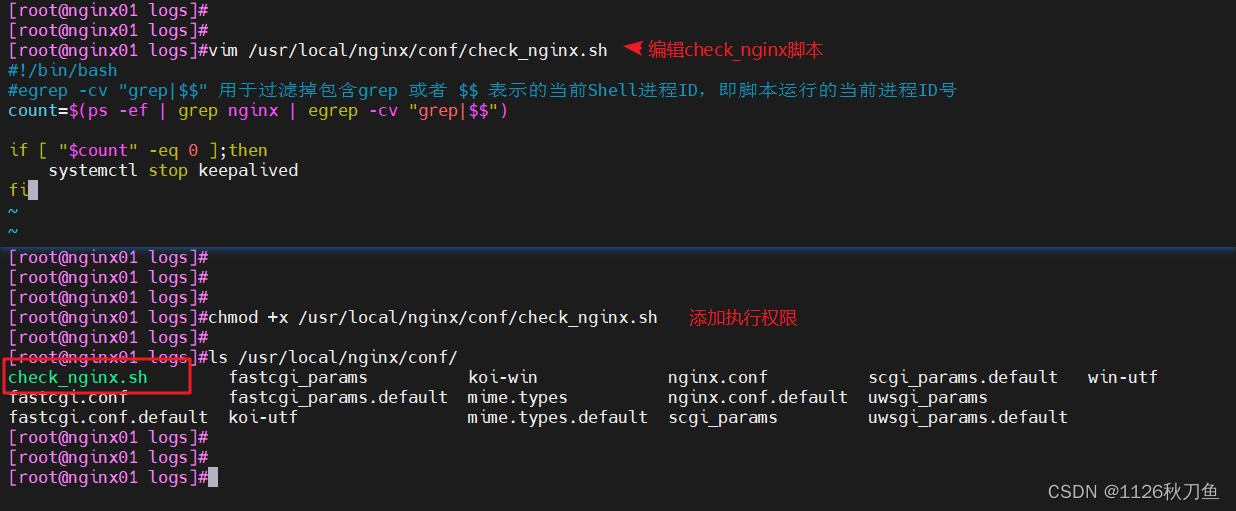

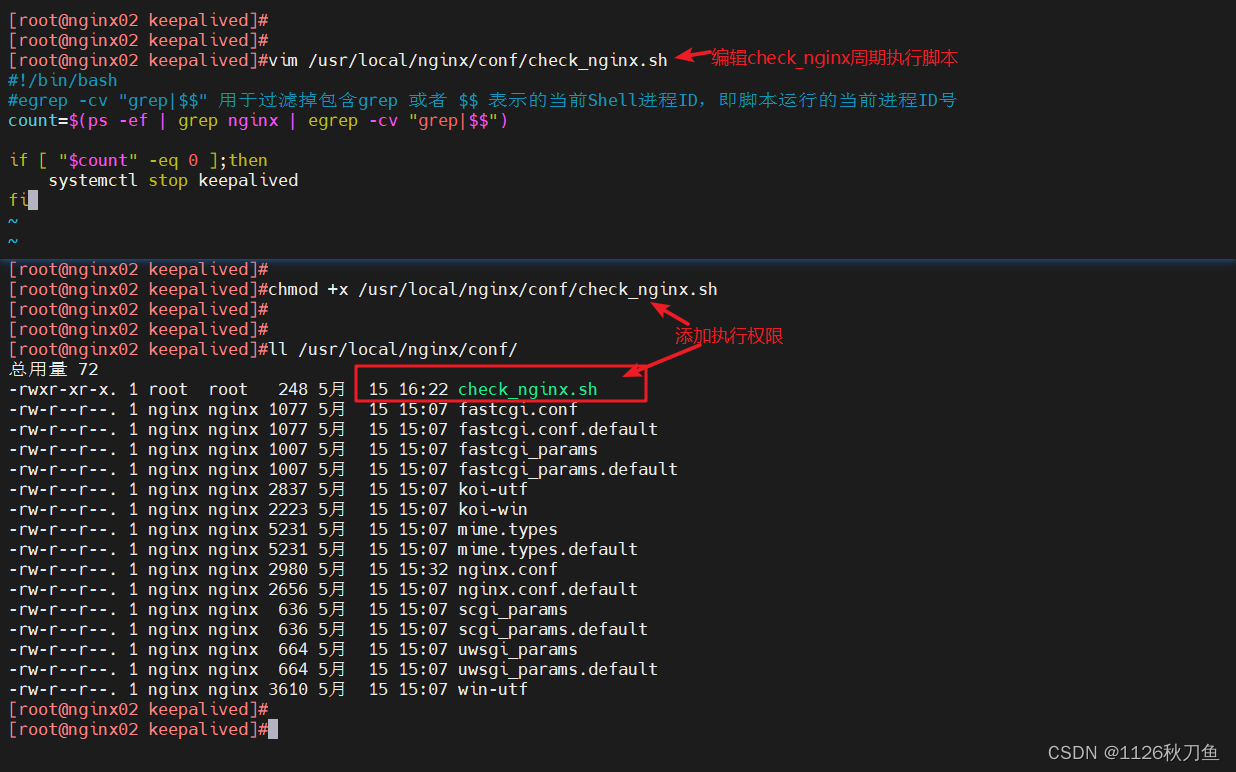

2.2 创建nginx状态检查脚本

#创建nginx状态检查脚本

vim /usr/local/nginx/conf/check_nginx.sh

#!/bin/bash

#egrep -cv "grep|$$" 用于过滤掉包含grep 或者 $$ 表示的当前Shell进程ID,即脚本运行的当前进程ID号

count=$(ps -ef | grep nginx | egrep -cv "grep|$$")if [ "$count" -eq 0 ];thensystemctl stop keepalived

fichmod +x /usr/local/nginx/conf/check_nginx.sh

#添加权限

- nginx01节点

- nginx02节点

2.3 启动keepalive服务

#启动keepalived服务(一定要先启动了nginx服务,再启动keepalived服务)systemctl start keepalived

#开启keepalive服务systemctl enable keepalived

#开机自启systemctl status keepalived.service

#查看服务状态ip a

#查看VIP是否生成

- nginx01节点

- nginx02 节点

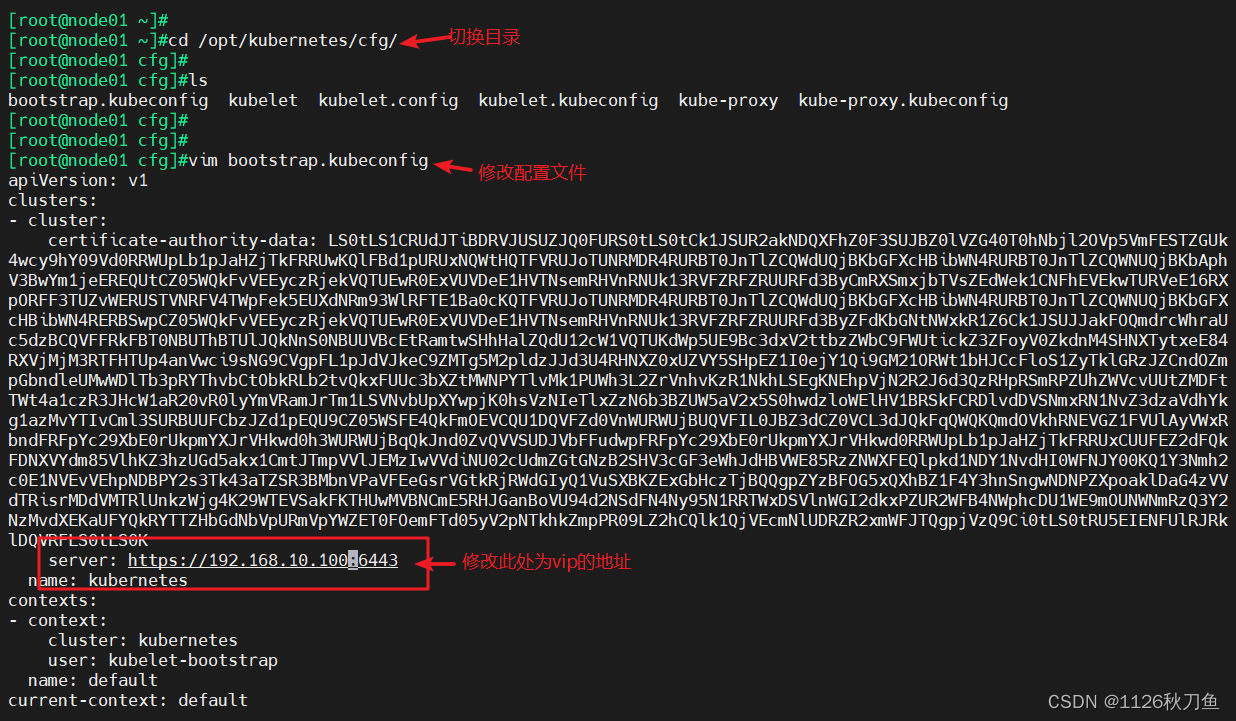

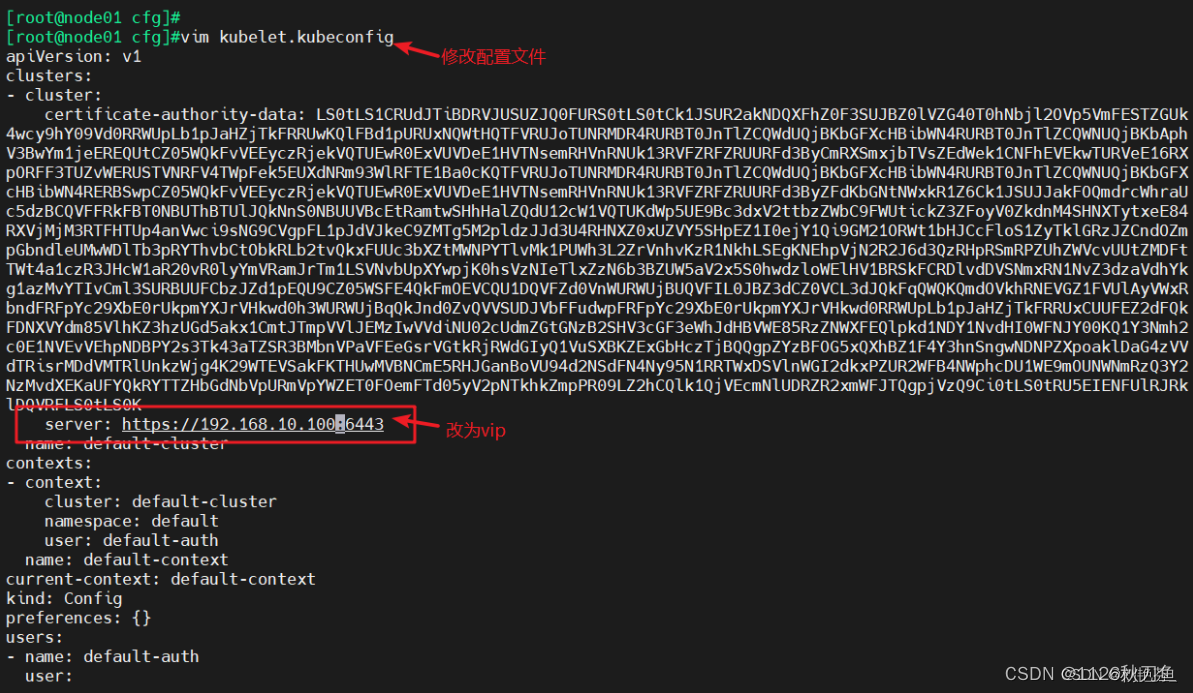

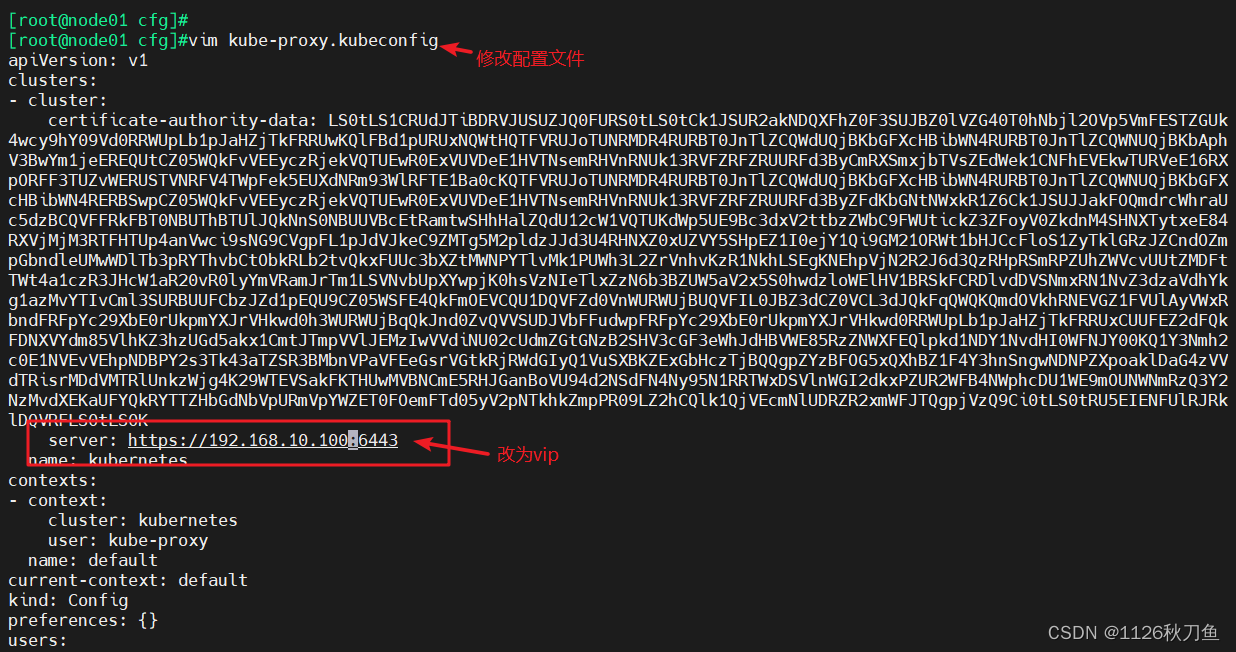

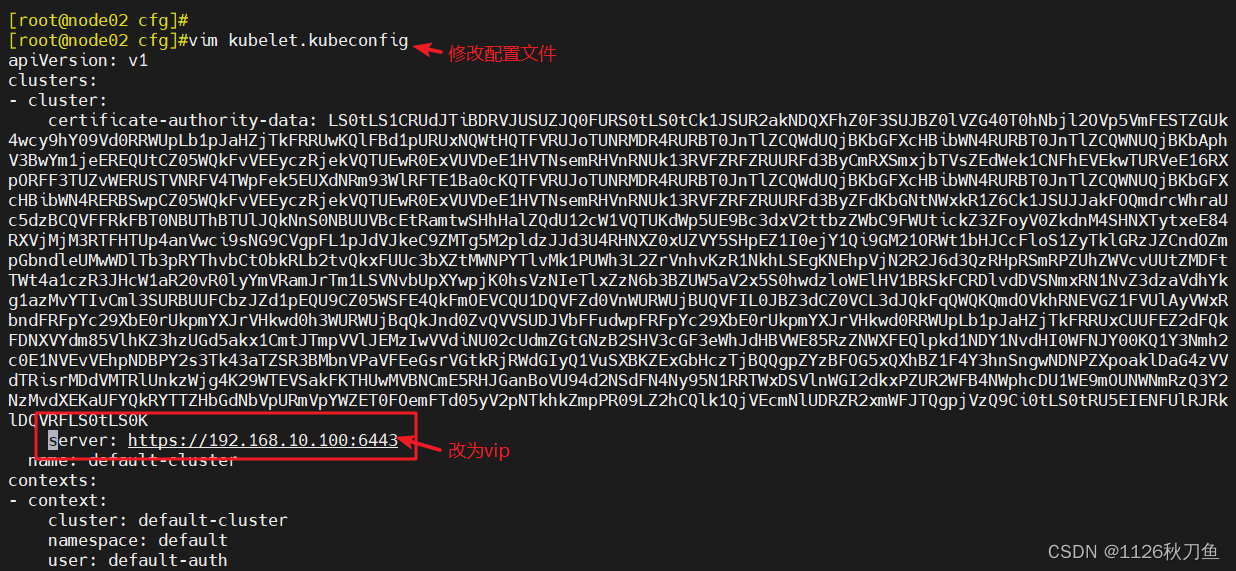

3、修改node节点上的配置文件

- bootstrap.kubeconfig 和 kubelet.kubeconfig配置文件配置vip地址

-

cd /opt/kubernetes/cfg/ #切换目录#修改配置文件 vim bootstrap.kubeconfig server: https://192.168.10.100:6443 #改为vip#修改配置文件 vim kubelet.kubeconfig server: https://192.168.10.100:6443 #改为vip#修改配置文件 vim kube-proxy.kubeconfig server: https://192.168.10.100:6443 #改为vipsystemctl restart kubelet.service systemctl restart kube-proxy.service #重启kubelet和kube-proxy服务

- nginx01节点

- nginx02节点

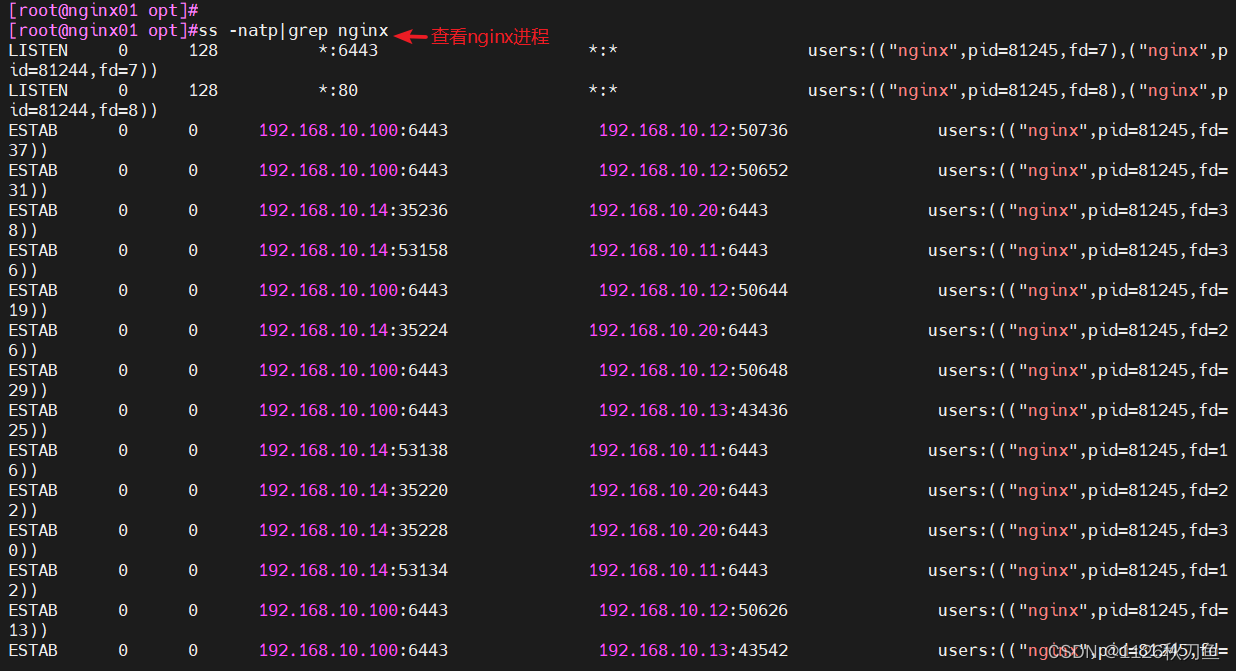

查看连接状态

- 在nginx01节点上查看 nginx 和 node 、 master 节点的连接状态

-

ss -natp|grep nginx #在nginx01节点查看nginx进程

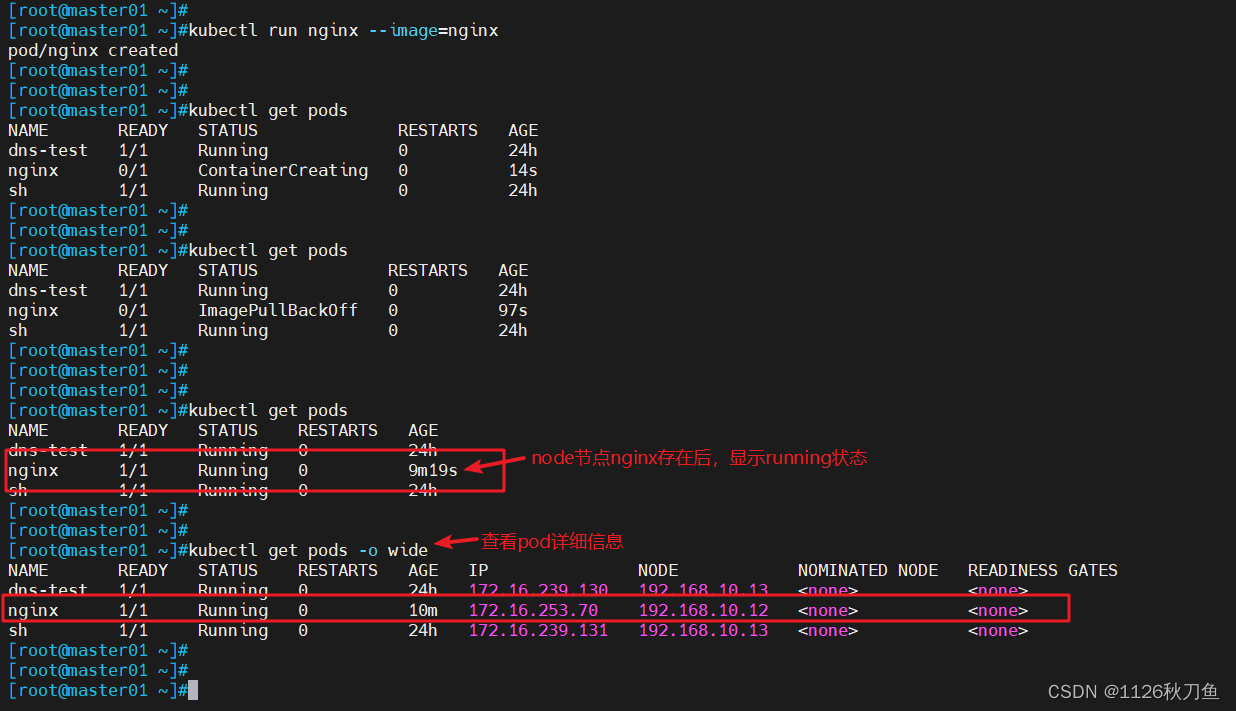

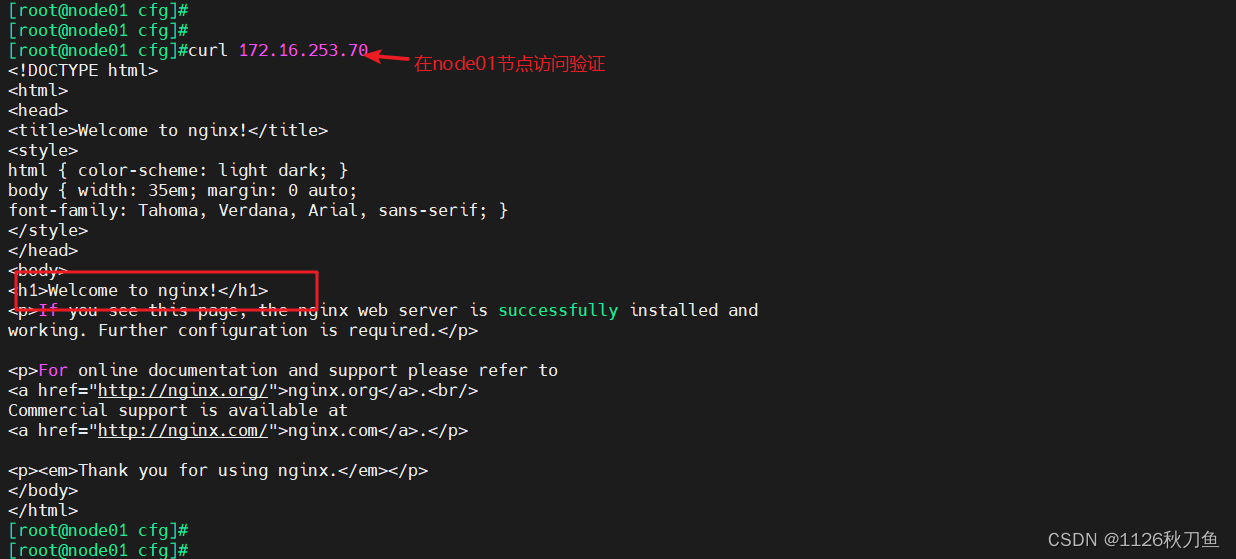

- 在 master01 节点上操作

-

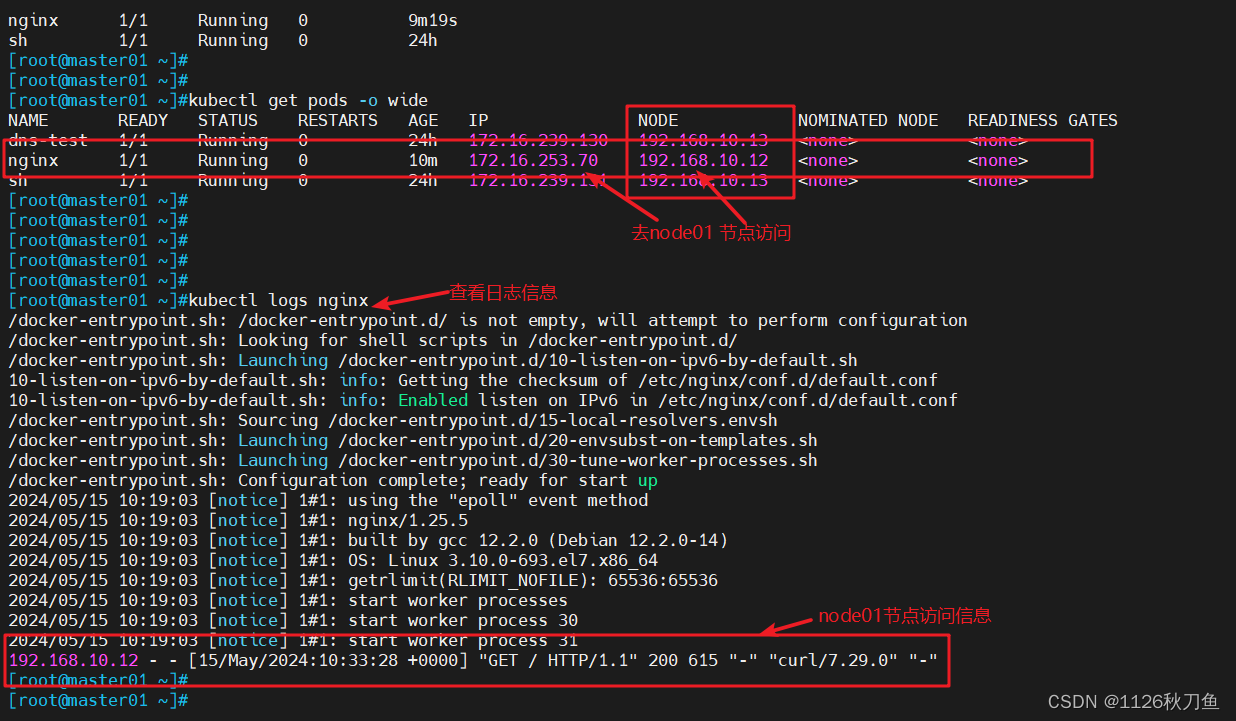

kubectl run nginx --image=nginx #测试创建podkubectl get pods #查看Pod的状态信息--------------------------------------------------------------------------------------------------------------------- ContainerCreating #正在创建中 ImagePullBackOff #表示镜像不存在,需要在node节点拉取镜像信息 Running #创建完成,运行中 ---------------------------------------------------------------------------------------------------------------------kubectl get pods -o wide #显示pod详细信息 #READY为1/1,表示这个Pod中有1个容器[root@node01 cfg]#curl 172.16.253.70 #在对应网段的node节点上操作(此处对应的是node01节点)kubectl logs nginx #这时在master01节点上查看nginx日志

三、部署 Dashboard

1、Dashboard 介绍

仪表板是基于Web的Kubernetes用户界面。您可以使用仪表板将容器化应用程序部署到Kubernetes集群,对容器化应用程序进行故障排除,并管理集群本身及其伴随资源。您可以使用仪表板来概述群集上运行的应用程序,以及创建或修改单个Kubernetes资源(例如deployment,job,daemonset等)。例如,您可以使用部署向导扩展部署,启动滚动更新,重新启动Pod或部署新应用程序。仪表板还提供有关群集中Kubernetes资源状态以及可能发生的任何错误的信息。

2、部署Dashboard

- 在 master01 节点上操作

-

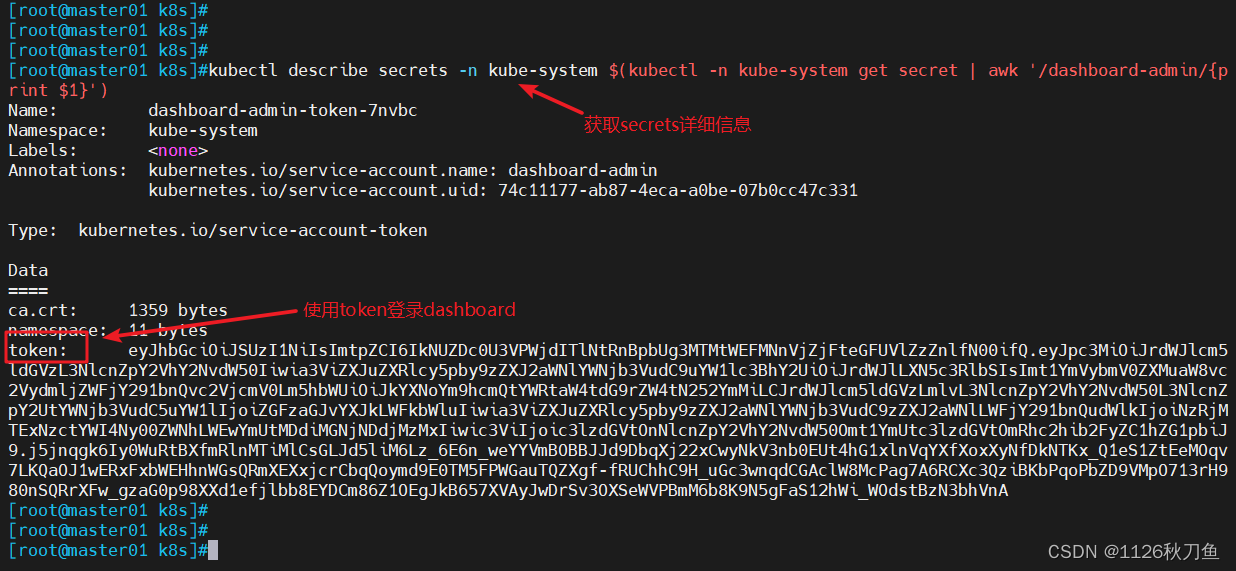

cd /opt/k8s #切换目录#上传 recommended.yaml 文件到 /opt/k8s 目录中-------------------------------------------------------------------------------------------------------- vim recommended.yaml #默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部: kind: Service apiVersion: v1 metadata:labels:k8s-app: kubernetes-das/hboardname: kubernetes-dashboardnamespace: kubernetes-dashboard spec:ports:- port: 443targetPort: 8443nodePort: 30001#添加type: NodePort#添加selector:k8s-app: kubernetes-dashboard --------------------------------------------------------------------------------------------------------kubectl apply -f recommended.yaml #指定yml文件启动recommended服务kubectl create serviceaccount dashboard-admin -n kube-system #创建一个新的serviceaccount,名为 dashboard-adminkubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin #创建service account并绑定默认cluster-admin管理员集群角色kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}') #在 kube-system 命名空间中查找名称中包含 dashboard-admin 的 Secret,并获取并描述这个 Secret 的详细信息。https://NodeIP:30001 #使用输出的token登录Dashboard(此处nodeip使用node01节点或者node02节点都可以)

- 使用浏览器访问登录

部署多master集群架构过程

首先部署master02等其他master节点(master01节点的配置文件(私钥文件、执行文件、服务文件)拷贝到master02 节点)

对master节点搭建nginx/haproxy+keepalive高可用负载均衡器

修改node节点上的kubelet、kube-proxy的kubeconfig配置文件对接vip

kubectl配置文件也要对接vip或者当前的节点

相关文章:

kubernetes多master集群架构

一、完成master02节点的初始化操作 master02环境准备,详细过程参考上一期博客环境准备 #添加主机映射 vim /etc/hosts 192.168.88.3 master01 192.168.88.8 master02 192.168.88.4 node01 192.168.88.5 node021、准备master02节点需要的文件 从 master01 节点上拷…...

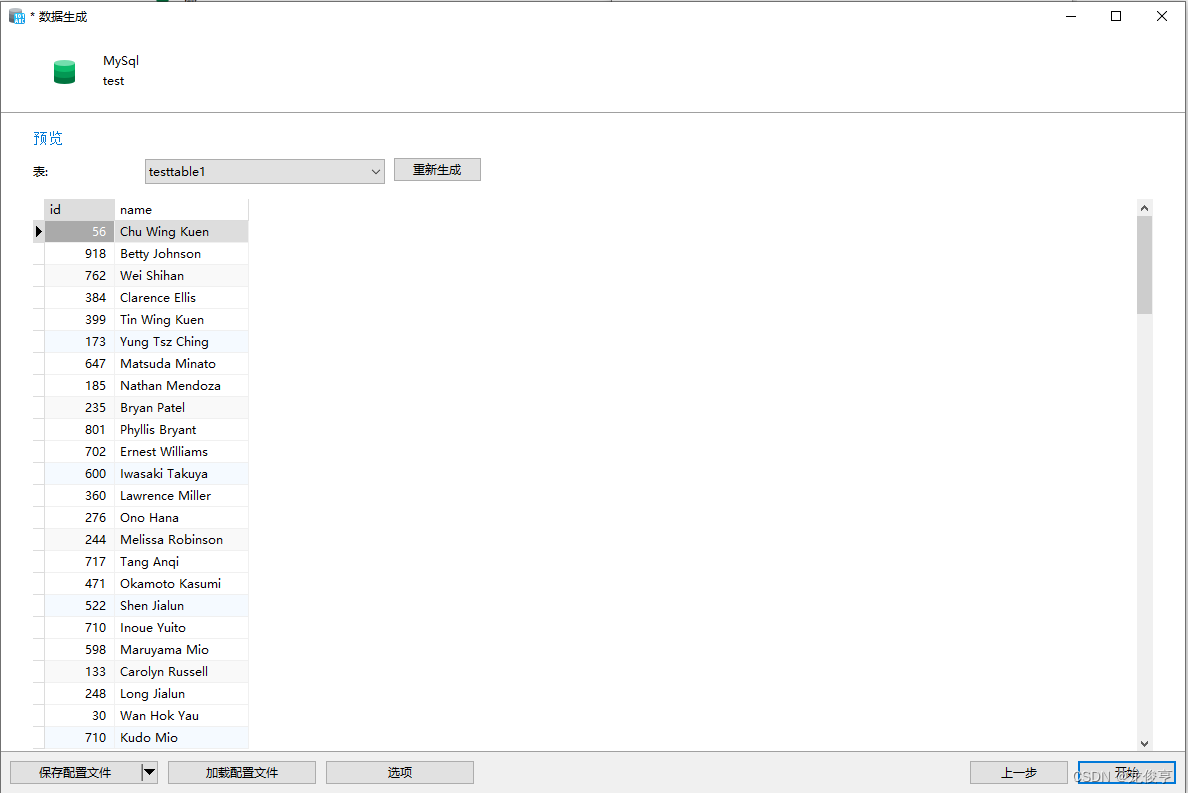

MySQL数据库的初始化(创建库、创建表、向数据库添加测试数据)

MySQL数据库的初始化(创建库、创建表、修改数据库访问密码、向数据库添加测试数据) MySQL数据库简介MySQL创建一个新的数据库修改数据库访问密码 MySQL创建一张新的数据表简单(设置)表复杂(设置)表 填充测试…...

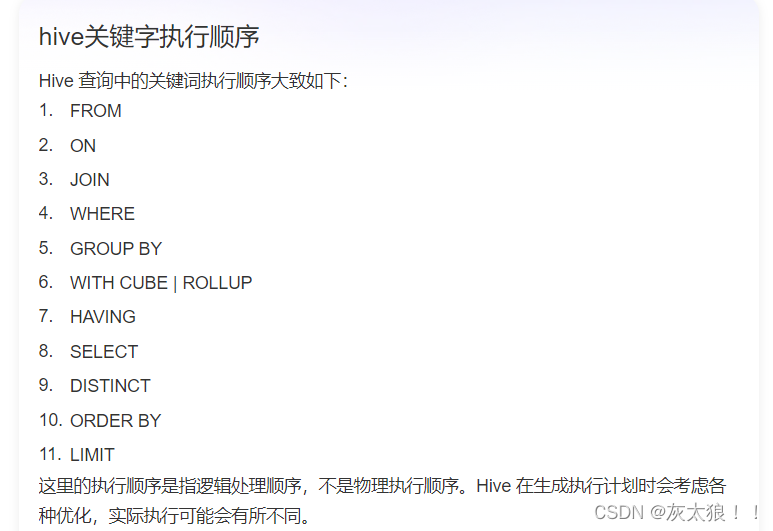

hive动态分区

hive动态分区概念:允许插入数据到分区表时,根据插入的数据内容自动创建相应的分区 1.启用动态分区功能 hive.exec.dynamic.partitiontrue; 2.分区字段设置 在insert语句中, 动态分区的字段必须放在select语句的末尾,hive会根据这个字段的值来创建分区目录 示例: --创建分区表…...

QT状态机10-QKeyEventTransition和QMouseEventTransition的使用

1、QMouseEventTransition的使用 首先明白 QMouseEventTransition 继承自 QEventTransition类。 关于QEventTransition类的使用,可参考 QT状态机9-QEventTransition和QSignalTransition的使用 回顾 QT状态机9-QEventTransition和QSignalTransition的使用 中的状态切换代码,如…...

PDK安装及简介

目录 PDK简介 pdk安装 Standard Cell Library简介 IO Library简介 PDK简介 PDK:全称Process Design Kit,是工艺设计工具包的缩写,是制造和设计之间的沟通桥梁,是模拟电路设计的起始点。 具体来说,PDK是代工厂(FAB…...

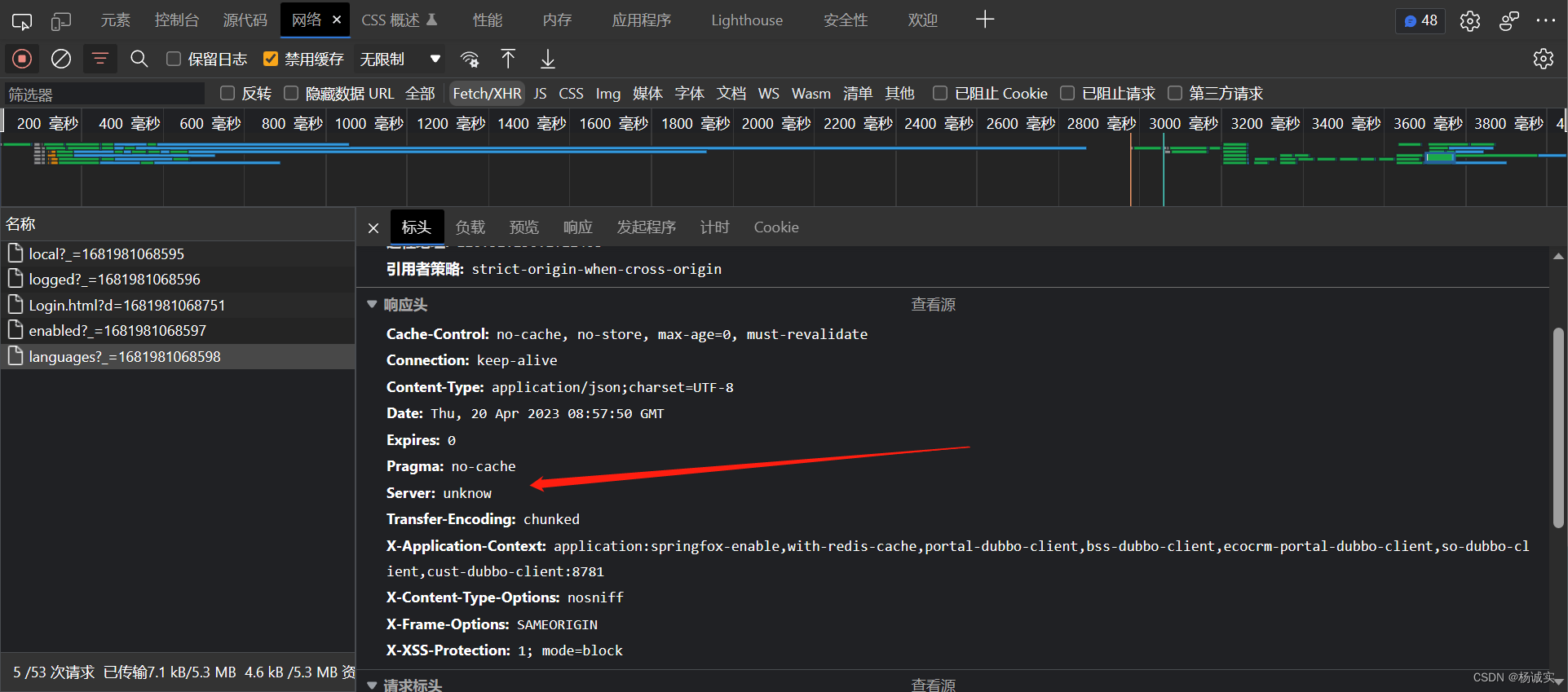

20240511每日运维----聊聊nignx改配置所有的nginx改完unknow

1、改配置所有的nginx改完unknow src/core/nginx.h src/http/ngx_http_header_filter_module.c src/http/ngx_http_special_response.c src/http/v2/ngx_http_v2_filter_module.c 2、make 3、去objs里面把nginx文件替换过去sbin/nginx...

hive日常使用时忘记部分补充(不定时)

1、date_formate、unix_timestamp、from_unixtime用法: 2、lag()、lead()用法: lag()窗口函数返回分区中当前行之前行(可以指定第几行)的值。 如果没有行,则返回null。 lead()窗口…...

android 安全机制 和权限管理 的一点研究

Android 应用权限设置: 在 Android 中,每个应用都必须声明其需要的权限,例如访问相机、读取联系人等。这些权限在应用安装时由用户授予,并且用户可以在应用运行时随时更改这些权限。Android 的权限模型是基于用户授予或拒绝应用对敏感资源的访问。这种模型允许用户在应用级…...

Vue3.0 一些总结 【持续更新】

1. reactive 只适用于对象 (包括数组和内置类型,如 Map 和 Set,它不支持如 string、number 或 boolean 这样的原始类型) import { reactive } from vueconst counter reactive({count: 0 })console.log(counter.count) // 0 counter.count注意…...

C++语法|对象的浅拷贝和深拷贝

背景: 我们手写一个顺序栈,展开接下来的实验: ⭐️ this指针指向的是类在内存中的起始位置 class SeqStack { public:SqeStack(int size 10) {cout << this << "SeqStack()" << endl;pstack_ new int[size_];t…...

行为型模式

模板方法模式 #include<iostream> #include<string> using namespace std;/*案例:写简历内容:最近有个招聘会,可以带上简历去应聘了。但是,其中有一家公司不接受简历,而是给应聘者发了一张简历表…...

AI大模型日报#0515:Google I/O大会、 Ilya官宣离职、腾讯混元文生图大模型开源

导读:欢迎阅读《AI大模型日报》,内容基于Python爬虫和LLM自动生成。目前采用“文心一言”(ERNIE 4.0)、“零一万物”(Yi-34B)生成了今日要点以及每条资讯的摘要。 《AI大模型日报》今日要点:谷歌…...

计算机网络-负载均衡算法

计算机网络中的负载均衡算法是决定如何将请求分发到各个服务器的关键。目前负载均衡算法主要分为静态负载均衡算法和动态负载均衡算法,具体包括以下几种: 静态负载均衡算法: 1.轮询法(Round Robin):按照顺…...

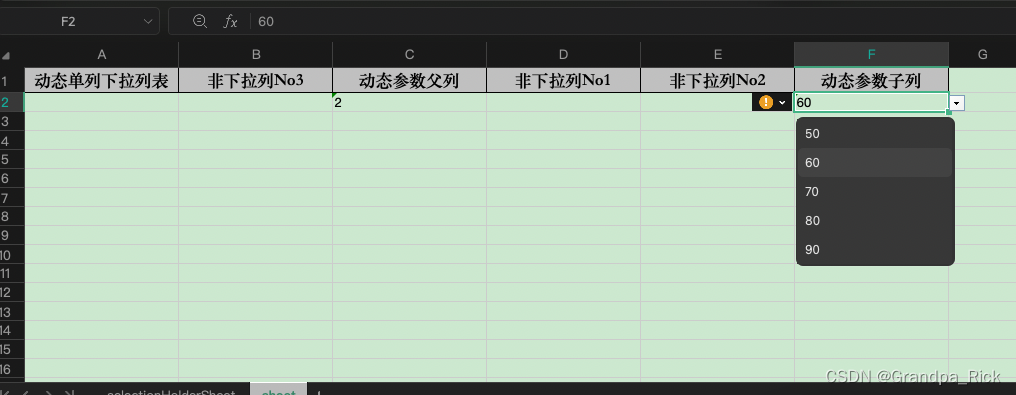

Excel Module: Iteration #1 EasyExcel生成下拉列表模版时传入动态参数查询下拉数据

系列文章 EasyExcel生成带下拉列表或多级级联列表的Excel模版自定义校验导入数据(修订) 目录 系列文章前言仓库一、实现1.1 下拉元数据对象1.2 构建下拉元数据的映射关系1.3 框架方式1.3.1 框架实现1.3.2 框架用例模版类加载下拉业务导出接口 1.4 EasyExcel方式1.4.1 EasyExce…...

【回溯算法】【Python实现】TSP旅行售货员问题

文章目录 [toc]问题描述回溯算法Python实现时间复杂性 问题描述 给定一组城市和它们之间的距离矩阵,找到一条距离最短的路径,使得旅行商从一个城市出发,经过所有城市恰好一次,并最终回到出发城市 回溯算法 旅行售货员问题的解空间…...

Java处理xml

Java处理xml DOM(Document Object Model)读取写入参考文献[Java DOM 教程](https://geek-docs.com/java/java-tutorial/dom.html#ftoc-heading-5) DOM(Document Object Model) Java的DOM(Document Object Model&#…...

软考中级-软件设计师 (十一)标准化和软件知识产权基础知识

一、标准化基础知识 1.1标准的分类 根据适用的范围分类: 国际标准指国际化标准组织(ISO)、国际电工委员会(IEC)所制定的标准,以及ISO所收录的其他国际组织制定的标准。 国家标准:中华人民共和…...

pytest教程-46-钩子函数-pytest_sessionstart

领取资料,咨询答疑,请➕wei: June__Go 上一小节我们学习了pytest_report_testitemFinished钩子函数的使用方法,本小节我们讲解一下pytest_sessionstart钩子函数的使用方法。 pytest_sessionstart 是 Pytest 提供的一个钩子函数,…...

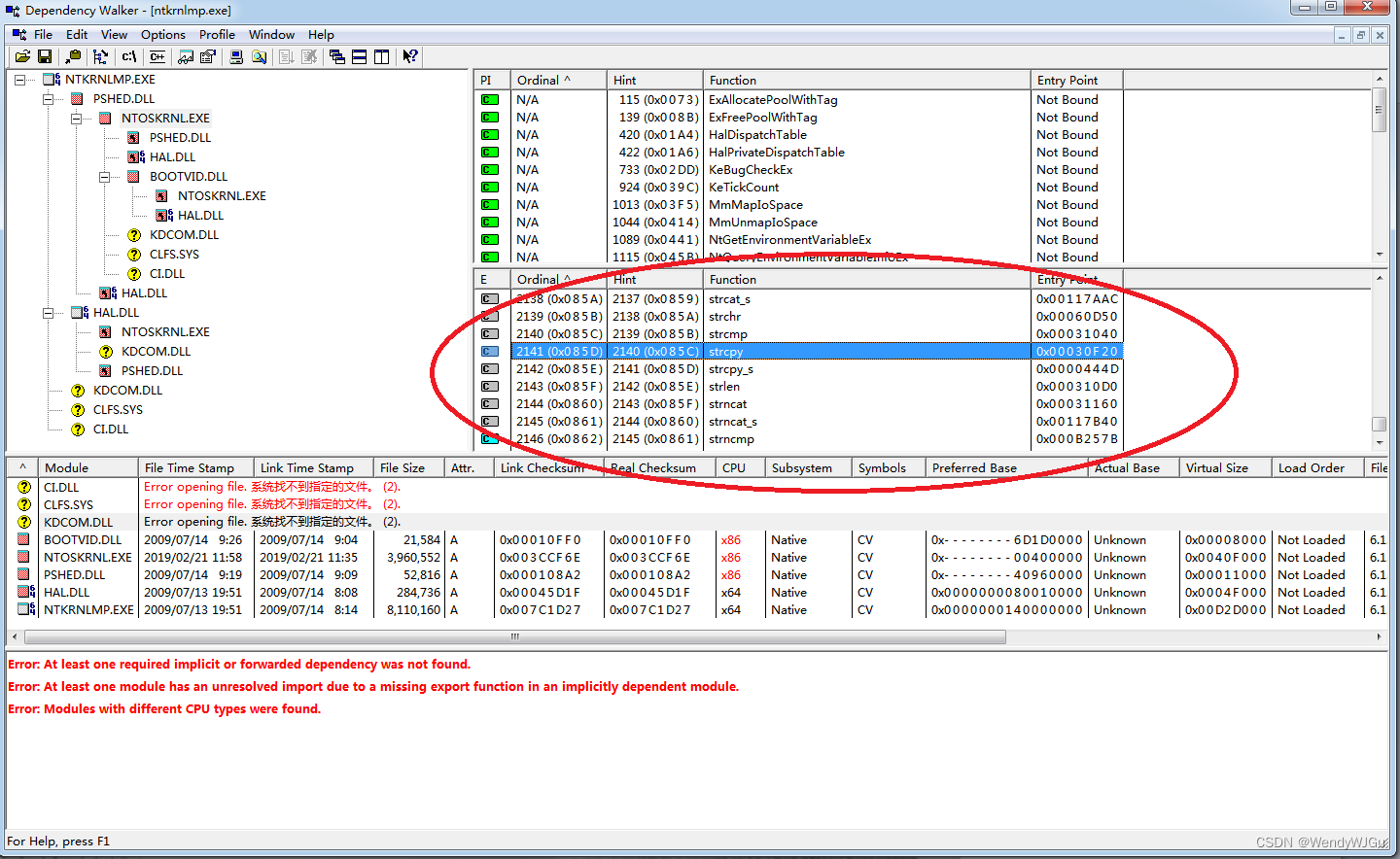

Windows内核函数 - ASCII字符串和宽字符串

本章介绍了Windows内核中字符串处理函数、文件读写函数、注册表读写函数。这些函数是DDK提供的运行时函数,他们比标准C语言的运行时函数功能更丰富。普通的C语言运行时库是不能在内核模式下使用的,必须使用DDK提供的运行时函数。 和应用程序一样…...

从零开始学习MySQL 事务处理

事务处理与ACID特性 事务是数据库操作的基本单元,它确保一组操作要么全部成功,要么全部失败,以此来维护数据库的一致性。这四个字母缩写ACID代表了事务的四大特性: 原子性(Atomicity)**:事务被…...

命令行集成AI代码审查:基于Gemini的Git工作流自动化实践

1. 项目概述:当命令行遇上代码审查在开发者的日常工作中,代码审查是保证代码质量、促进知识共享的关键环节。然而,传统的代码审查流程往往伴随着频繁的上下文切换:你需要离开终端,打开浏览器,登录代码托管平…...

LabVIEW Statechart进阶:从状态机到并发层次状态管理的思维跃迁

1. 项目概述:从状态机到Statechart的思维跃迁在LabVIEW的自动化测试、设备控制或复杂流程编排项目中,状态机(State Machine)几乎是每个工程师都会接触到的经典设计模式。它结构清晰,通过一个While循环、一个Case结构和…...

BilibiliDown:如何轻松实现B站视频批量下载与音频提取的终极指南

BilibiliDown:如何轻松实现B站视频批量下载与音频提取的终极指南 【免费下载链接】BilibiliDown (GUI-多平台支持) B站 哔哩哔哩 视频下载器。支持稍后再看、收藏夹、UP主视频批量下载|Bilibili Video Downloader 😳 项目地址: https://gitcode.com/gh…...

KMS智能激活工具:3个颠覆性技巧告别Windows和Office激活烦恼

KMS智能激活工具:3个颠覆性技巧告别Windows和Office激活烦恼 【免费下载链接】KMS_VL_ALL_AIO Smart Activation Script 项目地址: https://gitcode.com/gh_mirrors/km/KMS_VL_ALL_AIO 你是否曾经在准备重要演示时,Office突然弹出"许可证已过…...

在Windows上安装APK的终极指南:5步掌握APK Installer工具

在Windows上安装APK的终极指南:5步掌握APK Installer工具 【免费下载链接】APK-Installer An Android Application Installer for Windows 项目地址: https://gitcode.com/GitHub_Trending/ap/APK-Installer 你是否曾经想在Windows电脑上直接安装Android应用…...

是否足够)

现有基准任务(如操纵、导航)是否足够

在人工智能与机器人技术飞速迭代的今天,基准任务作为衡量模型与系统能力的核心标尺,贯穿于技术研发、性能评估与落地应用的全流程。操纵、导航作为两类最基础、最核心的基准任务,长期以来支撑着机器人、具身智能等领域的进步,成为…...

长期使用Taotoken Token Plan套餐对项目开发成本的实际影响

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 长期使用Taotoken Token Plan套餐对项目开发成本的实际影响 1. 从按需付费到固定预算的转变 在项目开发中引入大模型能力…...

2025年macOS菜单栏终极管理方案:开源神器Ice让你的工作区重获新生

2025年macOS菜单栏终极管理方案:开源神器Ice让你的工作区重获新生 【免费下载链接】Ice Powerful menu bar manager for macOS 项目地址: https://gitcode.com/GitHub_Trending/ice/Ice macOS菜单栏管理工具Ice是一款完全免费的开源神器,专为现代…...

)

保姆级教程:用Vue3+webrtc-streamer搞定海康/大华监控的Web实时播放(附完整代码)

Vue3与WebRTC-streamer实战:企业级监控视频流集成指南 监控系统在现代企业管理中扮演着重要角色,而将监控视频无缝集成到Web应用中已成为许多开发者的刚需。本文将带你从零开始,使用Vue3和webrtc-streamer实现海康、大华等主流监控设备的实时…...