How do I format markdown chatgpt response in tkinter frame python?

题意:怎样在Tkinter框架中使用Python来格式化Markdown格式的ChatGPT响应?

问题背景:

Chatgpt sometimes responds in markdown language. Sometimes the respond contains ** ** which means the text in between should be bold and ### text ### which means that text is a heading. I want to format this correctly and display it properly in tkinter. If it's bold or a heading, it should be formatted to bold or to a heading in tkintter. How to do this?

ChatGPT有时会以Markdown语言回应。有时回应中包含** **,这表示中间的文本应该是粗体的;而### text ###则表示该文本是一个标题。我想在Tkinter中正确地格式化并显示这些文本。如果它是粗体或标题,则应该在Tkinter中以粗体或标题的形式显示。如何做到这一点?

My code:

import tkinter as tk

from tkinter import ttk

from datetime import datetime

import openai

import json

import requestshistory = []

# Create a function to use ChatGPT 3.5 turbo to answer a question based on the prompt

def get_answer_from_chatgpt(prompt, historyxx):global historyopenai.api_key = "xxxxxxx"append_to_chat_log(message="\n\n\n")append_to_chat_log("Chatgpt")print("Trying")messages = [{"role": "user", "content": prompt}]try:stream = openai.chat.completions.create(model="gpt-3.5-turbo",messages=messages,stream=True,)for chunk in stream:chunk = chunk.choices[0].delta.contentchunk = str(chunk)if chunk != "None":append_to_chat_log(message=chunk)append_to_chat_log(message="\n\n\n")print("Streaming complete")except Exception as e:print(e)return "Sorry, an error occurred while processing your request."# Create a function to use OpenAI to answer a question based on the search resultsdef append_to_chat_log(sender=None, message=None):chat_log.config(state="normal")if sender:chat_log.insert("end", f"{sender}:\n", "sender")if message:chat_log.insert("end", message)chat_log.config(state="disabled")chat_log.see("end")chat_log.update()def send_message(event=None):global historymessage = message_entry.get(1.0, "end-1c") message = message.strip()message_entry.delete(1.0, tk.END)message_entry.update()if not message:pass else:append_to_chat_log("User", message)history.append(("user", message))if len(history) >4:history = history[-4:]print(message)response = get_answer_from_chatgpt(message, history)history.append(("assistant", response))root = tk.Tk()root.title("Chat")# Maximize the window

root.attributes('-zoomed', True)chat_frame = tk.Frame(root)

chat_frame.pack(expand=True, fill=tk.BOTH)chat_log = tk.Text(chat_frame, state='disabled', wrap='word', width=70, height=30, font=('Arial', 12), highlightthickness=0, borderwidth=0)

chat_log.pack(side=tk.LEFT, padx=(500,0), pady=10)message_entry = tk.Text(root, padx=17, insertbackground='white', width=70, height=1, spacing1=20, spacing3=20, font=('Open Sans', 14))

message_entry.pack(side=tk.LEFT, padx=(500, 0), pady=(0, 70)) # Adjust pady to move it slightly above the bottom

message_entry.mark_set("insert", "%d.%d" % (0,0))

message_entry.bind("<Return>", send_message)root.mainloop()问题解决:

I solved my own question 我解决了我自己提出的问题

import tkinter as tk

from datetime import datetime

import openaihistory = []# Create a function to use ChatGPT 3.5 turbo to answer a question based on the prompt

def get_answer_from_chatgpt(prompt, historyxx):global historyopenai.api_key = "xxxx"append_to_chat_log(message="\n\n\n")append_to_chat_log("Chatgpt")print("Trying")messages = [{"role": "user", "content": prompt}]try:stream = openai.chat.completions.create(model="gpt-3.5-turbo",messages=messages,stream=True,)buffer = ""heading = ""bold = Falsewhile True:chunk = next(stream)chunk = chunk.choices[0].delta.contentchunk = str(chunk)if chunk != "None":buffer += chunkif "**" in buffer:while "**" in buffer:pre, _, post = buffer.partition("**")append_to_chat_log(message=pre, bold=bold)bold = not boldbuffer = postif "###" in buffer:while "###" in buffer:pre, _, post = buffer.partition("###")append_to_chat_log(message=pre, bold=heading)heading = not headingbuffer = postelse:append_to_chat_log(message=buffer, bold=bold)buffer = ""append_to_chat_log(message="\n\n\n")print("Streaming complete")except Exception as e:print(e)return "Sorry, an error occurred while processing your request."def append_to_chat_log(sender=None, message=None, bold=False, heading=False):chat_log.config(state="normal")if sender:chat_log.insert("end", f"{sender}:\n", "sender")if message:if bold:chat_log.insert("end", message, "bold")if heading:chat_log.insert("end", message, "heading")else:chat_log.insert("end", message)chat_log.config(state="disabled")chat_log.see("end")chat_log.update()def send_message(event=None):global historymessage = message_entry.get(1.0, "end-1c")message = message.strip()message_entry.delete(1.0, tk.END)message_entry.update()if not message:pass else:append_to_chat_log("User", message)history.append(("user", message))if len(history) > 4:history = history[-4:]print(message)response = get_answer_from_chatgpt(message, history)history.append(("assistant", response))root = tk.Tk()

root.title("Chat")# Maximize the window

root.attributes('-zoomed', True)chat_frame = tk.Frame(root)

chat_frame.pack(expand=True, fill=tk.BOTH)chat_log = tk.Text(chat_frame, state='disabled', wrap='word', width=70, height=30, font=('Arial', 12), highlightthickness=0, borderwidth=0)

chat_log.tag_configure("sender", font=('Arial', 12, 'bold'))

chat_log.tag_configure("bold", font=('Arial', 12, 'bold'))

chat_log.tag_configure("heading", font=('Arial', 16, 'bold'))

chat_log.pack(side=tk.LEFT, padx=(500,0), pady=10)message_entry = tk.Text(root, padx=17, insertbackground='white', width=70, height=1, spacing1=20, spacing3=20, font=('Open Sans', 14))

message_entry.pack(side=tk.LEFT, padx=(500, 0), pady=(0, 70)) # Adjust pady to move it slightly above the bottom

message_entry.mark_set("insert", "%d.%d" % (0,0))

message_entry.bind("<Return>", send_message)root.mainloop()

相关文章:

How do I format markdown chatgpt response in tkinter frame python?

题意:怎样在Tkinter框架中使用Python来格式化Markdown格式的ChatGPT响应? 问题背景: Chatgpt sometimes responds in markdown language. Sometimes the respond contains ** ** which means the text in between should be bold and ### te…...

vs2019 QT无法打开源文件QModbusTcpClient

vs2019无法打开源文件QModbusTcpClient 如果配置的msvc2019,则查找到Include目录 然后包含: #include <QtSerialBus/qmodbustcpclient.h>...

初识c++(命名空间,缺省参数,函数重载)

一、命名空间 1、namespace的意义 在C/C中,变量、函数和后面要学到的类都是大量存在的,这些变量、函数和类的名称将都存在于全 局作用域中,可能会导致很多冲突。使用命名空间的目的是对标识符的名称进行本地化,以避免命名 冲突…...

印尼Facebook直播网络需要达到什么要求?

在全球化浪潮的推动下,海外直播正受到企业、个人和机构的广泛关注和青睐。无论是用于营销、推广还是互动,海外直播为各种组织提供了更多机会和可能性。本文将探讨在进行印尼Facebook直播前,需要满足哪些网络条件以确保直播的质量和用户体验。…...

)

力扣题解(最长回文子串)

5. 最长回文子串 给你一个字符串 s,找到 s 中最长的 回文子串 。思路: 对于第i个字符,可能的回文子串构成方式有两种,一种是以i位置元素为中心元素,向着两边扩展,一种是以i位置和i1位置元素为中心…...

数据湖表格式 Hudi/Iceberg/DeltaLake/Paimon TPCDS 性能对比(Spark 引擎)

当前,业界流行的集中数据湖表格式 Hudi/Iceberg/DeltaLake,和最近出现并且在国内比较火的 Paimon。我们现在看到的很多是针对流处理场景的读写性能测试,那么本篇文章我们将回归到大数据最基础的场景,对海量数据的批处理查询。本文…...

脚本练习-每5分钟执行一次获取当前服务器的基本情况

设计一个shell程序,每5分钟执行一次获取当前服务器的基本情况(内存使用率,CPU负载,I/O,磁盘使用率),保存到120.20.20.20数据库上数据库帐号aaa密码bbb库名test表名host 创建一个名为server_stat…...

技术探索之kotlin浅谈

Kotlin是一种静态类型编程语言,它运行在Java虚拟机(JVM)上,可以与Java代码互操作。Kotlin由JetBrains开发,是一种现代、简洁且安全的编程语言。它在2011年首次亮相,2017年被谷歌宣布为Android官方开发语言。…...

机器学习之常用优化器

机器学习之常用优化器 1、SGD 优化器1.2、 SGD 的优缺点 2、 Adam 优化器2.1、设置 Adam 优化器2.2、使用 Adam 优化器的训练流程2.3、Adam 优化器的优缺点 3. AdamW 优化器3.1、示例3.2、训练过程3.3、AdamW 优化器的优点 1、SGD 优化器 在 PyTorch 中,设置 SGD 优…...

机器学习基本概念,Numpy,matplotlib和张量Tensor知识进一步学习

机器学习一些基本概念: 监督学习 监督学习是机器学习中最常见的形式之一,它涉及到使用带标签的数据集来训练模型。这意味着每条训练数据都包含输入特征和对应的输出标签。目标是让模型学会从输入到输出的映射,这样当给出新的未见过的输入时…...

博客前端项目学习day01

这里写自定义目录标题 登录创建项目配置环境变量,方便使用登录页面验证码登陆表单 在VScode上写前端,采用vue3。 登录 创建项目 检查node版本 node -v 创建一个新的项目 npm init vitelatest blog-front-admin 中间会弹出询问是否要安装包,…...

java Collections.synchronizedCollection方法介绍

Collections.synchronizedCollection 是 Java 中的一个实用方法,用于创建一个线程安全的集合。它通过包装现有的集合对象来实现线程安全,以确保在多线程环境中对集合的访问是安全的。 主要功能 线程安全:通过同步包装现有的集合,使得在多线程环境中对集合的所有访问(包括…...

力扣每日一题:3011. 判断一个数组是否可以变为有序

力扣官网:前往作答!!!! 今日份每日一题: 题目要求: 给你一个下标从 0 开始且全是 正 整数的数组 nums 。 一次 操作 中,如果两个 相邻 元素在二进制下数位为 1 的数目 相同 &…...

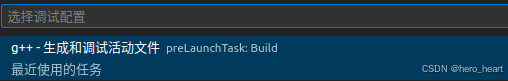

ubuntu 上vscode +cmake的debug调试配置方法

在ubuntu配置pcl点云库以及opencv库的时候,需要在CMakeLists.txt中加入相应的代码。配置完成后,无法调试,与在windows上体验vs studio差别有点大。 找了好多调试debug配置方法,最终能用的有几种,但是有一种特别好用&a…...

使用Redis实现签到功能:Java示例解析

使用Redis实现签到功能:Java示例解析 在本博客中,我们将讨论一个使用Redis实现的签到功能的Java示例。该示例包括两个主要方法:sign()和signCount(),分别用于用户签到和计算用户当月的签到次数。 1. 签到方法:sign()…...

tableau标靶图,甘特图与瀑布图绘制 - 9

标靶图,甘特图与瀑布图 1. 标靶图绘制1.1 筛选器筛选日期1.2 条形图绘制1.3 编辑参考线1.4 设置参考线1.5 设置参考区间1.6 四分位设置1.7 其他标靶图结果显示 2.甘特图绘制2.1 选择列属性2.2 选择列属性2.3 创建新字段2.4 设置天数大小及颜色 3. 瀑布图绘制3.1 she…...

双向链表专题

在之前的单链表专题中,了解的单链表的结构是如何实现的,以及学习了如何实现单链表得各个功能。单链表虽然也能实现数据的增、删、查、改等功能,但是要找到尾节点或者是要找到指定位置之前的节点时,还是需要遍历链表,这…...

SpringCoud组件

一、使用SpringCloudAlibaba <dependencyManagement><dependencies><dependency><groupId>com.alibaba.cloud</groupId><artifactId>spring-cloud-alibaba-dependencies</artifactId><version>2023.0.1.0</version><…...

向量的定义和解释

这是一个向量: 向量具有大小(大小)和方向: 线的长度显示其大小,箭头指向方向。 在这里玩一个: 我们可以通过将它们从头到尾连接来添加两个向量: 无论我们添加它们的顺序如何,我们都…...

IoTDB 集群高效管理:一键启停功能介绍

如何快速启动、停止 IoTDB 集群节点的功能详解! 在部署 IoTDB 集群时,对于基础的单机模式,启动过程相对简单,仅需执行 start-standalone 脚本来启动 1 个 ConfigNode 节点和 1 个 DataNode 节点。然而,对于更高级的分布…...

AI 伪造图像在电信诈骗攻防中的应用与治理研究 —— 以韩国诱捕诈骗快递员案为例

摘要 2026 年 5 月 22 日韩国首尔西部地方法院审理的投资类电信诈骗案件中,受害人在遭遇假冒分析师诱导、虚假证券 APP 欺诈并已损失 1200 万韩元后,面对诈骗团伙以 “提现手续费” 为名进一步索要 1990 万韩元现金的行为,利用 AI 生成伪造现…...

)

为什么92%的团队部署DeepSeek失败?火山引擎vLLM+Triton加速方案(2024最新生产级验证)

更多请点击: https://codechina.net 第一章:为什么92%的团队部署DeepSeek失败?火山引擎vLLMTriton加速方案(2024最新生产级验证) 92%的团队在部署DeepSeek-R1或DeepSeek-V2时遭遇推理延迟超标、OOM崩溃、吞吐骤降等问…...

Informer2020深度解析:基于ProbSparse注意力机制的长序列时间序列预测实战指南

Informer2020深度解析:基于ProbSparse注意力机制的长序列时间序列预测实战指南 【免费下载链接】Informer2020 The GitHub repository for the paper "Informer" accepted by AAAI 2021. 项目地址: https://gitcode.com/gh_mirrors/in/Informer2020 …...

Ubuntu 24.04 SSH密钥登录失效原因与实战修复全指南

1. 为什么24.04的SSH配置不能照搬22.04的经验?Ubuntu 24.04 LTS(Noble Numbat)发布后,我第一时间在三台生产边缘节点上做了迁移测试——结果两台在SSH密钥登录环节直接卡死,ssh -v输出停在debug1: Next authentication…...

告别代码迷宫,拥抱可视化开发:Understand Anything 重塑代码理解新范式

在软件开发领域,代码理解始终是贯穿整个研发流程的核心难题。无论是刚入职的新人面对几十万行的庞大项目,还是资深开发者接手历史悠久的遗留系统,亦或是团队协作中需要快速同步项目架构信息,都会被复杂的代码结构、繁琐的依赖关系…...

解密AliceSoft游戏资源处理:从提取到编辑的完整解决方案

解密AliceSoft游戏资源处理:从提取到编辑的完整解决方案 【免费下载链接】alice-tools Tools for extracting/editing files from AliceSoft games. 项目地址: https://gitcode.com/gh_mirrors/al/alice-tools 你是否曾经想要深入了解AliceSoft游戏的内部结构…...

,已交付27家头部客户验证)

从原始日志到业务洞察只要1次SQL:DeepSeek日志分析方案支持自然语言查询(“查上周支付失败且含Redis超时的订单”),已交付27家头部客户验证

更多请点击: https://intelliparadigm.com 第一章:DeepSeek日志分析方案的核心价值与落地成效 DeepSeek日志分析方案并非通用日志管道的简单复刻,而是面向大模型训练与推理场景深度定制的可观测性基础设施。其核心价值体现在对高吞吐、多模态…...

如何通过SPT-AKI Profile Editor存档编辑器轻松掌控你的塔科夫离线体验

如何通过SPT-AKI Profile Editor存档编辑器轻松掌控你的塔科夫离线体验 【免费下载链接】SPT-AKI-Profile-Editor Программа для редактирования профиля игрока на сервере SPT-AKI 项目地址: https://gitcode.com/gh_mirr…...

)

揭秘ChatGPT脑筋急转弯生成底层逻辑:基于LLM推理链拆解+语义悖论建模,准确率提升67%(实测数据)

更多请点击: https://kaifayun.com 第一章:ChatGPT脑筋急转弯生成的范式跃迁 传统脑筋急转弯生成依赖人工规则库或模板填充,例如预设“谐音梗”“偷换概念”“歧义句式”等分类标签,再通过正则匹配与词性替换组合输出。而以ChatG…...

终极STL到STEP转换指南:从3D扫描到CAD设计的完整解决方案

终极STL到STEP转换指南:从3D扫描到CAD设计的完整解决方案 【免费下载链接】stltostp Convert stl files to STEP brep files 项目地址: https://gitcode.com/gh_mirrors/st/stltostp 前言:跨越3D格式鸿沟的桥梁 在现代制造业和工程设计领域&…...