机器学习:知识蒸馏(Knowledge Distillation,KD)

知识蒸馏(Knowledge Distillation,KD)作为深度学习领域中的一种模型压缩技术,主要用于将大规模、复杂的神经网络模型(即教师模型)压缩为较小的、轻量化的模型(即学生模型)。在实际应用中,这种方法有助于减少模型的计算成本和内存占用,同时保持相对较高的性能和准确率。本文将详细介绍知识蒸馏的原理、C++实现代码、以及其在实际项目中的应用。

一、知识蒸馏的基本概念

1.1 什么是知识蒸馏?

知识蒸馏最初由Hinton等人提出,目的是解决大型模型在部署时的资源消耗问题。其基本思想是通过让一个较小的模型学习较大模型的预测分布来获得类似的表现。蒸馏过程包括两个主要模型:

- 教师模型(Teacher Model):通常是一个大规模的、经过充分训练的模型,拥有复杂的结构和较高的准确率。

- 学生模型(Student Model):一个结构相对简单、参数较少的小型模型,蒸馏过程就是让该模型模仿教师模型的输出。

1.2 知识蒸馏的基本原理

知识蒸馏的核心思想是在训练学生模型时,不仅仅依赖于传统的硬标签(Hard Labels),而是使用教师模型的软标签(Soft Labels)。这些软标签包含了教师模型对输入的概率分布信息,从而帮助学生模型更好地学习知识。

教师模型的输出通常是一个分类任务中的概率分布。例如,对于一个有3个类别的分类问题,教师模型的输出可能是 [0.7, 0.2, 0.1],这代表教师模型对输入属于类别1、类别2和类别3的概率。这种分布通常比硬标签(例如 [1, 0, 0])提供了更多的信息,尤其是对于模棱两可的样本。

通过引入温度参数(Temperature Parameter,T),可以控制教师模型输出的软标签分布。温度越高,概率分布越平滑,从而提供更多的关于各个类别的相对信息。温度较低时,软标签分布更接近硬标签。

二、知识蒸馏的数学公式

在知识蒸馏中,损失函数通常由两部分组成:

-

标准交叉熵损失(Cross-Entropy Loss):学生模型直接拟合训练数据的硬标签,公式如下:

其中,yi是第 i 个样本的真实标签,Pstudent(xi)是学生模型对该样本的预测概率。

-

蒸馏损失(Distillation Loss):学生模型学习教师模型的软标签分布,公式如下:

其中,T是温度参数,qteacher(xi,T)是教师模型在温度 TTT 下的输出概率分布,Pstudent(xi,T)是学生模型在相同温度下的预测。

最后,总损失函数 LLL 是标准交叉熵损失和蒸馏损失的加权和:

其中,α是用于调节两者权重的超参数。

三、知识蒸馏的C++实现

3.1 初始化环境

首先,需要安装并配置libtorch,然后可以开始搭建代码框架。

#include <torch/torch.h>

#include <iostream>// 定义一个简单的教师模型

struct TeacherNet : torch::nn::Module {torch::nn::Linear fc1{nullptr}, fc2{nullptr}, fc3{nullptr};TeacherNet() {fc1 = register_module("fc1", torch::nn::Linear(784, 128));fc2 = register_module("fc2", torch::nn::Linear(128, 64));fc3 = register_module("fc3", torch::nn::Linear(64, 10));}torch::Tensor forward(torch::Tensor x) {x = torch::relu(fc1->forward(x));x = torch::relu(fc2->forward(x));x = torch::log_softmax(fc3->forward(x), /*dim=*/1);return x;}

};// 定义一个学生模型

struct StudentNet : torch::nn::Module {torch::nn::Linear fc1{nullptr}, fc2{nullptr};StudentNet() {fc1 = register_module("fc1", torch::nn::Linear(784, 64));fc2 = register_module("fc2", torch::nn::Linear(64, 10));}torch::Tensor forward(torch::Tensor x) {x = torch::relu(fc1->forward(x));x = torch::log_softmax(fc2->forward(x), /*dim=*/1);return x;}

};int main() {// 初始化模型auto teacher = std::make_shared<TeacherNet>();auto student = std::make_shared<StudentNet>();// 假设我们有一些输入数据torch::Tensor input = torch::randn({64, 784}); // 64个样本,每个样本784维torch::Tensor hard_labels = torch::randint(0, 10, {64}); // 硬标签// 教师模型的输出 (soft labels)torch::Tensor teacher_output = teacher->forward(input);// 学生模型的输出torch::Tensor student_output = student->forward(input);// 定义温度float temperature = 3.0;// 使用softmax调整教师输出的概率分布(加温度)torch::Tensor teacher_soft_labels = torch::softmax(teacher_output / temperature, 1);torch::Tensor student_soft_output = torch::softmax(student_output / temperature, 1);// 定义损失函数auto kd_loss = torch::nn::functional::kl_div(student_soft_output.log(), teacher_soft_labels, {}, Reduction::BatchMean);std::cout << "蒸馏损失: " << kd_loss.item<float>() << std::endl;return 0;

}

3.2 代码解读

在这段代码中,我们首先定义了一个简单的教师模型和一个较小的学生模型,二者都是使用全连接层(Linear)构成的。然后,通过教师模型对输入进行前向传播,生成软标签(概率分布)。学生模型则根据这些软标签进行训练。

关键部分是损失计算:我们使用了KL散度损失(KL-Divergence),并且将教师模型的输出概率通过温度参数调整,使其更加平滑。最后,将学生模型的输出和教师模型的软标签进行对比,以此来训练学生模型。

四、应用场景与优势

知识蒸馏技术广泛应用于各种需要压缩模型的场景,尤其是在资源有限的环境下,例如:

-

移动设备与嵌入式系统:这些设备计算资源有限,但依然需要部署高性能的模型。通过知识蒸馏,原本复杂的模型可以被压缩成小型模型,而不显著牺牲性能。

-

在线推理系统:在需要低延迟的在线推理系统中,模型的推理速度至关重要。知识蒸馏可以帮助减少推理时间。

-

模型集成:在集成学习中,多个模型可以被训练并用作教师模型,学生模型则学习集成后的知识,从而在性能与复杂性之间取得平衡。

-

迁移学习:通过知识蒸馏,可以将不同任务间的知识转移。例如,在多任务学习或领域适应中,教师模型可以提供一种指导,帮助学生模型快速适应新任务或新领域

五、如何优化知识蒸馏效果

一、调节温度参数 TTT

温度参数 TTT 在知识蒸馏中起着重要的作用,它用于控制教师模型输出的软标签分布。较高的温度 TTT 会让教师模型的输出分布变得更平滑,即对每个类别的概率预测更加模糊。这种情况下,学生模型可以学习到更为丰富的信息,包括错误类别的概率分布。

优化温度参数的方法:

- 交叉验证:可以通过实验选择不同的温度参数值,通常 TTT 在 1 到 10 之间取值较为常见。可以尝试不同的 TTT 值,观察学生模型在验证集上的表现。

- 渐变调整温度:可以在训练的不同阶段使用不同的温度值。例如,初期训练时使用较高的温度,使得学生模型学习到更多信息,后期逐渐降低温度,提高模型的精确度。

二、蒸馏损失与真实标签损失的权重调整

在知识蒸馏中,损失函数通常由两部分组成:一个是标准交叉熵损失(用于拟合真实标签),另一个是蒸馏损失(用于学习教师模型的输出分布)。权重参数 α\alphaα 用于调节这两部分损失的影响。

优化策略:

- 权重参数 α\alphaα 的选择:可以通过调节 α\alphaα 的值,来平衡学生模型对真实标签和教师输出的学习。通常 α\alphaα 介于 0.1 到 0.9 之间,通过实验找到最佳值。

- 动态权重调整:可以在训练过程中逐渐改变 α\alphaα,开始时更关注蒸馏损失,随着训练的进行,逐渐提高对真实标签的关注,以保证学生模型最终具备较高的泛化能力。

三、模型架构的改进

教师模型通常是较大的、复杂的网络,而学生模型则是较小的、轻量化的网络。在设计学生模型时,可以考虑以下几点:

- 适当设计学生模型:学生模型不必与教师模型结构相同,可以根据实际应用场景设计更适合的小型网络架构。例如,减少网络层数、调整卷积核尺寸或使用更小的隐藏层维度。

- 预先设计学生模型的能力范围:如果学生模型能力过小,可能无法有效学习教师模型的知识。因此,尽量保持学生模型的表达能力,同时进行模型压缩。

- 模型剪枝与蒸馏结合:可以先使用模型剪枝技术对教师模型进行剪枝,再进行知识蒸馏。剪枝后的教师模型能够提供更有效的指导,同时加速学生模型的训练过程。

四、数据增强

在深度学习中,数据增强可以提高模型的泛化能力。在知识蒸馏过程中,通过数据增强可以让学生模型学习更加多样化的输入模式,增强其对不同数据分布的适应性。

常用的数据增强方法包括:

- 图像数据增强:对于图像任务,可以使用常见的图像增强方法,如随机裁剪、水平翻转、颜色抖动等。

- 多样化输入数据:对于其他类型的数据,可以通过随机噪声、数据变换等方式生成更多样化的输入数据,从而增强模型的鲁棒性。

五、蒸馏中间层的特征

传统的知识蒸馏方法通常只关注模型输出层的蒸馏,即教师模型与学生模型的预测结果之间的蒸馏。然而,在深层神经网络中,中间层的特征也包含了大量有用的信息。通过对中间层的特征进行蒸馏,学生模型可以更好地学习教师模型的表示能力。

优化方法:

- 对齐中间层的特征:可以通过额外的损失函数来对齐教师模型和学生模型的中间层特征。例如,使用欧氏距离或余弦相似度来度量中间层的特征差异。

- 层级蒸馏:选择教师模型中的多个中间层,将这些层的特征传递给学生模型对应的层。这样可以让学生模型不仅学习到最终输出的分布,还能获取丰富的中间表征信息。

六、教师模型的改进

除了学生模型,教师模型本身的设计和训练策略也会影响蒸馏效果。选择一个更强的教师模型,往往可以使学生模型学习到更有用的知识。

优化策略:

- 使用更强的教师模型:可以使用多个预训练的模型作为教师模型,例如集成模型或多任务学习模型。

- 教师模型的正则化:如果教师模型过拟合,学生模型可能会学习到教师模型中的错误模式。通过在教师模型中添加正则化(如Dropout、L2正则化等),可以让教师模型生成更加通用的表示,提升蒸馏效果。

七、教师-学生互学习

在标准的知识蒸馏过程中,教师模型是固定的,学生模型根据教师模型的输出进行学习。但实际上,学生模型也可以反过来影响教师模型的训练,称为互学习(Mutual Learning)。

互学习方法:

- 双向学习:在互学习中,教师模型和学生模型同时进行训练,并相互传递知识。这种方法可以使得学生模型通过学习教师模型的知识获得提升,同时教师模型也可以从学生模型中学习一些新知识。

- 渐进式蒸馏:在训练初期,教师模型起主要指导作用,但随着学生模型逐渐收敛,允许学生模型通过部分反馈反过来影响教师模型。

八、使用对抗蒸馏

对抗蒸馏是知识蒸馏与生成对抗网络(GAN)结合的一种新方法,目标是通过对抗训练,使学生模型在学习教师模型知识的同时能够生成更真实、更接近教师模型的输出。

优化策略:

- 对抗训练:在学生模型的训练过程中,增加一个判别器来区分学生模型和教师模型的输出。通过这种对抗机制,可以促进学生模型生成更逼真的预测。

- 结合GAN的生成能力:对于图像生成任务,可以将生成对抗网络的生成能力融入到蒸馏过程中,使得学生模型在生成效果上更接近教师模型。

九、蒸馏数据选择优化

通常,知识蒸馏使用整个训练集来训练学生模型,但在某些情况下,并非所有数据样本对学生模型的学习同等重要。某些难度较大的样本可能对提高学生模型的泛化能力更有帮助。

优化策略:

- 样本权重调整:可以根据样本的难度为每个样本分配不同的权重,困难样本给予更高的权重,从而提升学生模型对这些样本的学习效果。

- 筛选数据:可以设计一种机制,优先选择那些学生模型难以拟合的数据进行蒸馏,从而提升蒸馏效率。

十、训练过程的优化

在知识蒸馏过程中,优化训练过程可以进一步提升学生模型的性能:

- 自适应学习率:为学生模型设置自适应学习率,以便在训练过程中动态调整。可以使用诸如Adam、RMSprop等优化器。

- 早停策略:为了避免学生模型的过拟合,可以使用早停(Early Stopping)策略,当验证集的性能不再提升时终止训练。

- 学习率预热:在训练初期,逐渐增大学习率(Learning Rate Warm-up),避免模型一开始就过快收敛,从而保证更稳定的训练。

总结

知识蒸馏是一种有效的模型压缩技术,通过优化温度参数、损失函数权重、中间层特征对齐、数据增强等多种手段,可以显著提高学生模型的性能。此外,结合对抗训练、互学习等新技术,还可以进一步提升蒸馏效果。

这些优化策略可以根据实际情况进行组合应用,具体的效果取决于任务的复杂度、数据集的特征以及模型的设计。通过反复实验和调参,可以找到适合特定任务的最佳蒸馏策略。

相关文章:

机器学习:知识蒸馏(Knowledge Distillation,KD)

知识蒸馏(Knowledge Distillation,KD)作为深度学习领域中的一种模型压缩技术,主要用于将大规模、复杂的神经网络模型(即教师模型)压缩为较小的、轻量化的模型(即学生模型)。在实际应…...

【C++入门篇 - 3】:从C到C++第二篇

文章目录 从C到C第二篇new和delete命名空间命名空间的访问 cin和coutstring的基本使用 从C到C第二篇 new和delete 在C中用来向系统申请堆区的内存空间 New的作用相当于C语言中的malloc Delete的作用相当于C语言中的free 注意:在C语言中,如果内存不够…...

YOLOv8模型改进 第七讲 一种新颖的注意力机制 Outlook Attention

随着目标检测技术的不断发展,YOLOv8 作为最新一代的目标检测模型,已经在多个基准数据集上展现了其卓越的性能。然而,在复杂场景中,如何进一步提升模型的检测精度和鲁棒性依然是一个重要挑战。本文将探讨将 Outlook Attention 机制…...

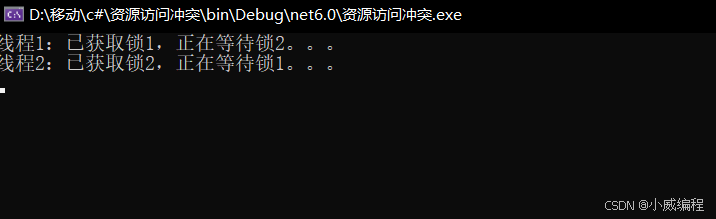

C#多线程基本使用和探讨

线程是并发编程的基础概念之一。在现代应用程序中,我们通常需要执行多个任务并行处理,以提高性能。C# 提供了多种并发编程工具,如Thread、Task、异步编程和Parallel等。 Thread 类 Thread 类是最基本的线程实现方法。使用Thread类࿰…...

PHP DateTime基础用法

PHP DateTime 的用法详解 一、引言 在开发 PHP 应用程序时,处理日期和时间是一个至关重要的任务。PHP 提供了强大的日期和时间处理功能,其中 DateTime 类是最常用的工具之一。DateTime 类提供了丰富的方法来创建、格式化、计算和比较日期时间ÿ…...

一次Fegin CPU占用过高导致的事故

记录一下 一次应用事故分析、排查、处理 背景介绍 9号上午收到CPU告警,同时业务反馈依赖该服务的上游服务接口响应耗时太长 应用告警-CPU使用率 告警变更 【WARNING】项目XXX,集群qd-aliyun,分区bbbb-prod,应用customer,实例customer-6fb6448688-m47jz, POD实例CP…...

【Go初阶】两万字快速入门Go语言

初见golang语法 package mainimport "fmt"func main() {/* 简单的程序 万能的hello world */fmt.Println("Hello Go")} 第一行代码package main定义了包名。你必须在源文件中非注释的第一行指明这个文件属于哪个包,如:package main…...

【React】使用 react hooks 需要遵守的原则

1)只能在顶层调用Hooks 这是指你不能在循环、条件语句或嵌套函数中调用Hooks。确保每次组件渲染时,Hooks的调用顺序保持一致。因此,你应该始终在React函数组件的最顶层调用Hooks。 React依赖于Hooks的调用顺序。如果这些调用在不同的渲染中顺…...

Python编程:创意爱心表白代码集

在寻找一种特别的方式来表达你的爱意吗?使用Python编程,你可以创造出独一无二的爱心图案,为你的表白增添一份特别的浪漫。这里为你精选了六种不同风格的爱心表白代码,让你的创意和情感通过代码展现出来。 话不多说,咱…...

腾讯IM SDK:TUIKit发送多张图片

一、问题描述 在使用腾讯IM DEMO(https://github.com/TencentCloud/chat-uikit-vue.git)时发现其只支持发送一张图片: 二、解决方案 // src\TUIKit\components\TUIChat\message-input-toolbar\image-upload\index.vue<inputref"inp…...

《本地部署开源大模型》在Ubuntu 22.04系统下ChatGLM3-6B高效微调实战

在Ubuntu 22.04系统下ChatGLM3-6B高效微调实战 无论是在单机单卡(一台机器上只有一块GPU)还是单机多卡(一台机器上有多块GPU)的硬件配置上启动ChatGLM3-6B模型,其前置环境配置和项目文件是相同的。如果大家对配置过程还…...

Python 脚本来自动发送每日电子邮件报告

安装必要的库 我们将使用 smtplib 发送邮件,以及 email.mime 来创建电子邮件内容。另外,为了让脚本自动定时运行,可以使用操作系统的计划任务工具(如 Linux 的 cron 或 Windows 的 Task Scheduler)。 创建邮件内容 使…...

大语言模型与ChatGPT:深入探索与应用

文章目录 1. 前言2. 大语言模型的概述2.1 什么是大语言模型?2.2 Transformer架构的核心2.3 预训练与微调 3. ChatGPT的架构与技术背景3.1 GPT模型的演进3.2 ChatGPT的工作原理 4. ChatGPT的实际应用4.1 日常对话助手4.2 内容生成与写作4.3 编程辅助4.4 教育与学习辅…...

【从零开始的LeetCode-算法】3164.优质数对的总数 II

给你两个整数数组 nums1 和 nums2,长度分别为 n 和 m。同时给你一个正整数 k。 如果 nums1[i] 可以被 nums2[j] * k 整除,则称数对 (i, j) 为 优质数对(0 < i < n - 1, 0 < j < m - 1)。 返回 优质数对 的总数。 示…...

FastDFS VS MinIO:文件存储与对象存储的抉择(包含SpringBoot集成FastDFS范例)

FastDFS vs MinIO:文件存储与对象存储的抉择(包含SpringBoot集成FastDFS范例) 我坐在窗边,随着飞机穿过云层,在云层之上滑翔。可以清晰的看到飞机在天空留下的痕迹,不知道那是蔚蓝中的纯白,还是…...

【Redis】缓存预热、雪崩、击穿、穿透、过期删除策略、内存淘汰策略

Redis常见问题总结: Redis常见问题总结Redis缓存预热Redis缓存雪崩Redis缓存击穿Redis缓存穿透 Redis 中 key 的过期删除策略数据删除策略 Redis内存淘汰策略一、Redis对过期数据的处理(一)相关配置(二)内存淘汰流程&a…...

【LeetCode】每日一题 2024_10_15 三角形的最大高度(枚举、模拟)

前言 每天和你一起刷 LeetCode 每日一题~ LeetCode 启动! 题目:三角形的最大高度 代码与解题思路 久违的简单题 这道题读完题目其实不难想到有两条路可以走: 1、题目很明显只有两种情况,枚举是第一个球是红球还是蓝球这两种情…...

2024版最新网络安全工程师入门教程(非常详细)从零基础入门到精通,看完这一篇就够了

前言 想要成为网络安全工程师,却苦于没有方向,不知道从何学起的话,下面这篇 网络安全入门 教程可以帮你实现自己的网络安全工程师梦想,如果想学,可以继续看下去,文章有点长,希望你可以耐心看到…...

的用法)

vue中关于router.beforeEach()的用法

router.beforeEach()是Vue.js中的路由守卫,用于在路由跳转前进行校验、取消、重定向等操作。 基本使用: const router new VueRouter({ ... })router.beforeEach((to, from, next) > {// ... }) to: 即将要进入的目标路由对象 from: 当前导航正要…...

C++模板初阶,只需稍微学习;直接起飞;泛型编程

🤓泛型编程 假设像以前交换两个函数需要,函数写很多个或者要重载很多个;那么有什么办法实现一个通用的函数呢? void Swap(int& x, int& y) {int tmp x;x y;y tmp; } void Swap(double& x, double& y) {doubl…...

UE后期处理材质实战:从黑白蒙版到卡通渲染的进阶应用

1. 黑白蒙版遮罩的底层原理与应用 在UE4后期处理材质中,黑白蒙版遮罩是最基础也最实用的功能之一。我第一次接触这个功能时,被它强大的选择性处理能力惊艳到了——它能像手术刀一样精准地分离出场景中的特定物体。 核心原理其实很简单:通过Sc…...

从磁力线到最小磁阻:手把手拆解一个微型直流电机的内部‘磁路战争’

从磁力线到最小磁阻:手把手拆解一个微型直流电机的内部‘磁路战争’ 拆开一枚硬币大小的玩具电机,你会看到一场无声的物理博弈——磁力线像急于回家的士兵,不断寻找最短路径;而转子则是这场战役的指挥官,通过精确的旋…...

OpenClaw 性能优化:提升响应速度和资源效率

一、引言:OpenClaw 性能挑战与优化价值1.1 为什么需要性能优化OpenClaw 作为运行在用户自有设备上的个人 AI 助手框架,其性能直接影响用户体验:响应延迟:用户发送消息到收到回复的时间资源占用:CPU、内存、磁盘的使用效…...

从Netfilter到IPVS:深入解析Linux内核负载均衡的实现与配置

1. Linux内核网络框架与负载均衡基础 当你打开一个网页或使用手机APP时,后台可能有成百上千台服务器在协同工作。这些服务器如何高效分配流量?这就是负载均衡技术的用武之地。在Linux生态中,从Netfilter到IPVS的技术演进,为我们提…...

因果模型评估完全手册:Python指标与验证方法详解

因果模型评估完全手册:Python指标与验证方法详解 【免费下载链接】python-causality-handbook 项目地址: https://gitcode.com/gh_mirrors/py/python-causality-handbook 在数据分析和决策科学领域,因果推断模型的评估是确保模型可靠性与实用性的…...

动态数据源配置加密终极指南:如何选择最安全的填充模式保护敏感数据 [特殊字符]️

动态数据源配置加密终极指南:如何选择最安全的填充模式保护敏感数据 🛡️ 【免费下载链接】dynamic-datasource dynamic datasource for springboot 多数据源 动态数据源 主从分离 读写分离 分布式事务 项目地址: https://gitcode.com/gh_mirrors/dy/…...

C#安装步骤以及流程易出错提醒修正

C# 开发环境安装步骤 Visual Studio 安装 从 Microsoft 官网 下载 Visual Studio Community(免费版本)。运行安装程序,选择“使用 C# 的桌面开发”工作负载,确保勾选 .NET SDK 和核心组件。 验证安装 打开命令提示符或 PowerShe…...

老旧设备AI赋能:开源方案实现群晖NAS人脸识别功能升级

老旧设备AI赋能:开源方案实现群晖NAS人脸识别功能升级 【免费下载链接】Synology_Photos_Face_Patch Synology Photos Facial Recognition Patch 项目地址: https://gitcode.com/gh_mirrors/sy/Synology_Photos_Face_Patch 在数字化时代,NAS设备已…...

MAX30102传感器寄存器深度解析与实战配置指南

1. MAX30102传感器核心功能解析 MAX30102是一款集成了红光和红外光LED的光学传感器,专门用于非侵入式心率监测和血氧饱和度(SpO2)测量。这个火柴盒大小的芯片内部藏着精密的模拟前端和数字信号处理单元,能够捕捉到人体脉搏带来的微弱光信号变化。 我第一…...

StructBERT在代码仓库管理中的重复代码检测应用

StructBERT在代码仓库管理中的重复代码检测应用 你有没有遇到过这种情况?在代码审查时,总觉得某段代码似曾相识,但又说不清在哪见过。或者,团队里不同成员为了解决类似问题,各自写了一套逻辑相近但细节不同的代码&…...