Ubuntu 24.04.1 LTS 本地部署 DeepSeek 私有化知识库

文章目录

- 前言

- 工具介绍与作用

- 工具的关联与协同工作

- 必要性分析

- 1、DeepSeek 简介

- 1.1、DeepSeek-R1 硬件要求

- 2、Linux 环境说明

- 2.1、最小部署(Ollama + DeepSeek)

- 2.1.1、扩展(非必须) - Ollama 后台运行、开机自启:

- 2.2、Page Assist - 浏览器插件

- 2.3、知识库

- 2.3.1、Embedding 向量化模型 - bge-m3

- 2.3.2、AnythingLLM

前言

工具介绍与作用

-

Ollama - 官方网站

- 定义与作用:

- Ollama 是一个开源的本地化大语言模型(LLM)部署工具,旨在简化大型语言模型的安装、运行和管理。它封装了底层的模型运行逻辑,提供了一个用户友好的命令行界面(CLI)和 API 接口,使得用户可以在本地设备上轻松运行各种开源模型(如 LLaMA、DeepSeek 等)。Ollama 支持 GPU 加速,能够自动利用设备的 GPU 资源来提高模型的推理效率。

- 在 DeepSeek 部署中的作用:

- Ollama 作为 DeepSeek 模型的本地运行环境,负责加载和运行 DeepSeek 模型文件。它提供了模型管理功能,用户可以通过 Ollama 的命令行工具下载、加载和切换不同的模型版本。

- 定义与作用:

-

Embedding - 官方网站

- 定义与作用:

- Embedding(嵌入)是指将高维数据(如文本)转换为低维向量的过程。这些向量能够捕捉数据的语义信息,便于进行高效的检索和比较。在自然语言处理中,嵌入模型(如 nomic-embed-text )将文本片段转换为向量,这些向量可以存储在向量数据库中。

- 在 DeepSeek 部署中的作用:

- 在部署 DeepSeek 时,Embedding 模型用于将文档内容转换为向量形式,并将这些向量存储在向量数据库中。当用户向 AI 助手提问时,系统会通过嵌入模型将问题文本转换为向量,然后在向量数据库中搜索与问题最相关的文档片段,从而提供更精准的回答。

- 定义与作用:

-

AnythingLLM - 官方网站

- 定义与作用:

- AnythingLLM 是一个全栈应用程序,用于构建私有化的 AI 知识库。它支持多种文档格式(如 PDF、TXT、DOCX 等),可以将文档内容嵌入到向量数据库中,并通过智能问答功能与用户进行交互。AnythingLLM 提供了前端管理界面,用户可以通过界面上传文档、管理知识库,并与 AI 助手进行对话。

- 在 DeepSeek 部署中的作用:

- AnythingLLM 作为前端管理工具,与 Ollama 结合使用,提供了一个完整的知识库管理解决方案。它通过调用 Ollama 提供的模型推理能力,结合嵌入模型和向量数据库,实现了对用户上传文档的智能检索和问答功能。AnythingLLM 支持多种 LLM 和嵌入模型,用户可以选择适合的模型组合来优化知识库的性能。

- 定义与作用:

-

Page Assist - 官方网站

- 定义与作用:

- Page Assist 是一个开源的浏览器扩展插件,用于与本地运行的 AI 模型进行交互。它提供了一个直观的 WebUI 界面,用户可以通过侧边栏或网页 UI 与 AI 模型进行对话。Page Assist 支持多种功能,包括与网页内容、PDF 文件和文档进行聊天交流。

- 在 DeepSeek 部署中的作用:

- Page Assist 为用户提供了一个便捷的交互界面,使得用户可以通过浏览器与本地运行的 DeepSeek 模型进行对话。它与 Ollama 配合使用,通过配置 Ollama 的地址和嵌入模型,用户可以在浏览器中直接与 DeepSeek 模型进行交互。

- 定义与作用:

工具的关联与协同工作

- Ollama 是底层的模型运行环境,负责加载和运行 DeepSeek 模型。

- Embedding 模型将文档内容转换为向量,存储在向量数据库中,为智能问答提供支持。

- AnythingLLM 作为前端管理工具,结合 Ollama 和嵌入模型,实现了知识库的管理和智能问答功能。

- Page Assist 提供了一个用户友好的交互界面,使得用户可以通过浏览器与本地运行的 DeepSeek 模型进行对话。

必要性分析

必须使用的工具:

- Ollama:

- 作用:Ollama 是部署 DeepSeek 的核心工具,负责下载、管理和运行 DeepSeek 模型。它是本地化部署 DeepSeek 的基础,必须使用。

- 最小需求:安装 Ollama 客户端,并通过命令行运行 DeepSeek 模型(如 ollama run deepseek-r1:7b )。

- DeepSeek 模型:

- 作用:DeepSeek 是一个强大的语言模型,用于提供智能问答和生成内容。

- 最小需求:下载并运行 DeepSeek 模型(如 deepseek-r1:7b ),这是实现功能的基础。

可选的工具:

- AnythingLLM:

- 作用:提供一个用户友好的界面,用于管理文档、知识库和与 DeepSeek 模型进行交互。它支持文档上传、向量化和智能检索功能。

- 是否必须:可选,但强烈推荐。如果没有 AnythingLLM,用户只能通过命令行与 DeepSeek 交互,无法实现知识库管理和智能检索功能。

- Embedding:

- 作用:将文档内容转换为向量形式,以便存储在向量数据库中,支持智能检索功能。

- 是否必须:可选,但如果你需要实现基于文档的知识库功能(如智能检索和问答),则需要使用 Embedding。

- Page Assist:

- 作用:提供一个浏览器扩展界面,用于与本地运行的 DeepSeek 模型进行交互,增强用户体验。

- 是否必须:可选,主要用于提升用户体验,使用户可以通过浏览器界面与模型进行对话。

1、DeepSeek 简介

官方网站

1.1、DeepSeek-R1 硬件要求

参考文档

参考文档:R1蒸馏版-1.5B 无需GPU,任意四核 CPU,内存 8GB,硬盘空间 12GB 即可运行

2、Linux 环境说明

操作系统:Ubuntu 24.04.1 LTS

安装包:ubuntu-24.04.1-desktop-amd64.iso

硬件环境:i5-10400

虚拟化软件:ESXi-8.0

虚拟机:CPU 8核 内存 16G 硬盘 80G

2.1、最小部署(Ollama + DeepSeek)

目标:快速启动并运行 DeepSeek 模型,进行基本的智能问答

最小需求:

- Ollama:用于下载和运行 DeepSeek 模型

- DeepSeek 模型:选择合适的模型版本(如 deepseek-r1:7b )并运行

参考文档:Ollama GitHub 部署文档

# 安装 curl 工具 - 系统默认没有

apt install curl# 安装 Ollama

# 不推荐!好慢: curl -fsSL https://ollama.com/install.sh | sh

# 推荐 - 通过工具下载,地址:https://ollama.com/download/ollama-linux-amd64.tgz

# 解压

sudo tar -C /usr -xzf ollama-linux-amd64.tgz

# 启动 Ollama 服务 - 前台运行

ollama serve

# 查看 Ollama 是否正常启动 - 通过浏览器访问 http://localhost:11434# 验证是否安装成功

# 打开另外一个中端

ollama -v

ollama --version# 下载并运行 DeepSeek 模型

# 说明:有点慢 1.1 GB

ollama run deepseek-r1:1.5b

# 成功后,即可愉快的玩耍啦 ~

2.1.1、扩展(非必须) - Ollama 后台运行、开机自启:

编辑配置文件

nano /etc/systemd/system/ollama.service

# 重载 systemd 配置

sudo systemctl daemon-reload

# 开机自启

sudo systemctl enable ollama

# 启动服务

sudo systemctl start ollama

# 查看状态

sudo systemctl status ollama

配置文件示例

[Unit]

Description=Ollama Service

After=network.target[Service]

ExecStart=/usr/bin/ollama serve

Restart=always

User=root

Group=root

RestartSec=3

# 如果需要远程访问,设置为 0.0.0.0

Environment="OLLAMA_HOST=0.0.0.0"

# 如果需要更改端口,可以在这里设置

Environment="OLLAMA_PORT=11434"

Environment="OLLAMA_ORIGINS=*"

# 模型文件存储目录,当前为默认。推荐变更为 /data/ollama/models

Environment="OLLAMA_MODELS=/root/.ollama/models"[Install]

WantedBy=multi-user.target

2.2、Page Assist - 浏览器插件

以上方法,只能通过命令行进行交互。

如何通过浏览器进行交互呢?浏览器上面安装个插件 Page Assist

FireFox 安装示例(Chrome 也有)

点击插件之后显示的页面

配置页面 - 配置成中文

配置页面 - 选择模型

插件页面 - 开始聊天啦 ~

2.3、知识库

2.3.1、Embedding 向量化模型 - bge-m3

# 拉取模型

ollama pull bge-m3

# 验证是否拉取成功

ollama list

2.3.2、AnythingLLM

参考文档:AnythingLLM 官方部署文档

说明:通过官方命令下载有点慢,可以通过工具下载。

AnythingLLMDesktop.AppImage 安装文件下载地址

说明:使用 .AppImage 文件,依赖 FUSE

FUSE 官方网站

# 安装 FUSE

sudo add-apt-repository universe

sudo apt install libfuse2t64

# 安装好后,鼠标双击 AnythingLLMDesktop.AppImage 文件即可出现可视化界面啦 ~

初始界面

skip 注册的流程 - 创建工作区 - 设置 LLM 首选项

设置 Embedding 向量化模型

上传自定义的知识,并向量化保存。

下拉,点击 Save

部署完成啦 ~ 可以使用啦 ~

相关文章:

Ubuntu 24.04.1 LTS 本地部署 DeepSeek 私有化知识库

文章目录 前言工具介绍与作用工具的关联与协同工作必要性分析 1、DeepSeek 简介1.1、DeepSeek-R1 硬件要求 2、Linux 环境说明2.1、最小部署(Ollama DeepSeek)2.1.1、扩展(非必须) - Ollama 后台运行、开机自启: 2.2、…...

用 WOW.js 和 animate.css 实现动画效果

用 wow.js 就可以实现动画效果,但由于里面的动画样式太少,一般还会引入 animated.css 第一步:下载 选择合适的包管理器下载对应的内容 pnpm i wow.js animated.css --save 第二步:引入 在main.js中加入: import …...

1-知识图谱-概述和介绍

知识图谱:浙江大学教授 陈华军 知识图谱 1课时 http://openkg.cn/datasets-type/ 知识图谱的价值 知识图谱是有什么用? 语义搜索 问答系统 QA问答对知识图谱:结构化图 辅助推荐系统 大数据分析系统 自然语言理解 辅助视觉理解 例…...

flink jobgraph详细介绍

一、Flink JobGraph 的核心概念 JobGraph 是 Flink 作业的核心执行计划,它描述了作业的任务拓扑结构和数据流关系。JobGraph 由以下几部分组成: 顶点(Vertex) 每个顶点代表一个任务(Task),例如…...

使用nginx+rtmp+ffmpeg实现桌面直播

使用nginxrtmpffmpeg实现桌面直播 流媒体服务器搭建 docker run docker镜像基于添加了rtmp模块的nginx,和ffmpeg docker pull alfg/nginx-rtmp docker run -d -p 1935:1935 -p 8080:80 --namenginx-rtmp alfg/nginx-rtmprtmp模块说明 进入容器内部查看 docker…...

每日一题——将数字字符串转化为IP地址

将数字字符串转化为IP地址 题目描述解题思路回溯法步骤分解 代码实现全局变量有效性验证函数回溯函数主函数完整代码 复杂度分析关键点说明总结 这题难度还挺大的,整体上实现并不容易。建议参考视频 和https://programmercarl.com/0093.%E5%A4%8D%E5%8E%9FIP%E5%9C%…...

机器学习数学基础:25.随机变量分布详解

一、随机变量与分布函数的基本概念 (一)什么是随机变量? 在概率论领域,随机变量是将随机试验的结果进行数值化的关键概念。它就像一座桥梁,把抽象的随机事件和具体的数学分析连接起来。 举例来说,在一个…...

香港电讯与Zenlayer达成战略合作,拓展全球互联生态圈

作为主要国际金融与贸易中心,香港一直是连系中国内地及全球市场的重要门户。香港电讯作为本地领先的综合电讯服务提供商,拥有广泛的网络资源和深厚的技术专长,一直支持国内企业“走出去”和外资企业“走进来”。而旗下由PCCW Global营运的Con…...

MySQL-事务隔离级别

事务有四大特性(ACID):原子性,一致性,隔离性和持久性。隔离性一般在事务并发的时候需要保证事务的隔离性,事务并发会出现很多问题,包括脏写,脏读,不可重复读,…...

)

【Python学习 / 6】面向对象编程(OOP)

文章目录 ⭐前言⭐一、类和对象:面向对象编程基础1. 类(Class)类的组成:例子:定义一个简单的 Dog 类代码解析: 2. 对象(Object)对象的创建: 3. 三大特性:封装…...

Ollama DeepSeek + AnythingLLM 实现本地私有AI知识库

Ollama DeepSeek AnythingLLM 实现本地私有AI知识库 本地部署DeepSeek-r1下载安装AnythingLLMAnythingLLM 配置LLM首选项Embedder首选项向量数据库工作区其他配置 AnythingLLM Workspace使用上传知识词嵌入知识检索 本文主要介绍了如何使用AnythingLLM结合Ollama部署的DeepSee…...

个人博客测试报告

一、项目背景 个人博客系统采用前后端分离的方法来实现,同时使用了数据库来存储相关的数据,同时将其部署到云服务器上。前端主要有四个页面构成:登录页、列表页、详情页以及编辑页,以上模拟实现了最简单的个人博客系统。其结合后…...

嵌入式八股文(四)计算机网络篇

第一章 基础概念 1. 服务 指网络中各层为紧邻的上层提供的功能调用,是垂直的。包括面向连接服务、无连接服务、可靠服务、不可靠服务。 2. 协议 是计算机⽹络相互通信的对等层实体之间交换信息时必须遵守的规则或约定的集合。⽹络协议的三个基本要素:语法、…...

基于Electron+Vue3创建桌面应用

Electron 是一个开源框架,基于 Chromium 和 Node.js,用于开发跨平台桌面应用程序。它允许开发者使用 HTML、CSS 和 JavaScript 等 Web 技术构建原生桌面应用,支持 Windows、macOS 和 Linux。Electron 以其开发便捷性、强大的功能和丰富的生态系统而广泛应用于工具类应用、媒…...

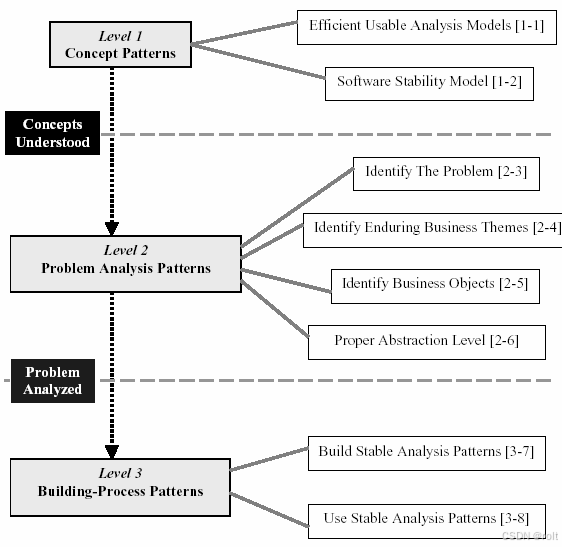

建立稳定分析模式的模式语言01

Haitham Hamza 等 著,wnb 译 摘要 一般认为,软件分析模式在减少开销和缩短软件产品生命周期等方面会起到重要的作用。然而,分析模式的巨大潜能还未被充分发掘。缺乏稳定性是当前分析模式存在的主要问题。多数情况下,为特定问题建…...

【C++游戏开发-五子棋】

使用C开发五子棋游戏的详细实现方案,涵盖核心逻辑、界面设计和AI对战功能: 1. 项目结构 FiveChess/ ├── include/ │ ├── Board.h // 棋盘类 │ ├── Player.h // 玩家类 │ ├── AI.h // AI类 │ └── Game.h // 游戏主逻辑 ├── src/ …...

ubuntu20动态修改ip,springboot中yaml的内容的读取,修改,写入

文章目录 前言引入包yaml原始内容操作目标具体代码执行查看结果总结: 前言 之前有个需求,动态修改ubuntu20的ip,看了下: 本质上是修改01-netcfg.yaml文件,然后执行netplan apply就可以了。 所以,需求就变成了 如何对ya…...

tailwindcss学习02

vue中接入tailwindcss 使用cmd不要使用powershell npm create vitelatest stu02 -- --template vue cd stu02npm install --registry http://registry.npm.taobao.org npm install -D tailwindcss3.4.17 postcss autoprefixer --registry http://registry.npm.taobao.org npx t…...

千峰React:脚手架准备+JSX基础

组件化->封装性 React提供函数组件实现组件化 React和传统JS的区别就是JS需要手动管理DOM操作,React: 采用组件化开发,通过虚拟DOM提升性能。 MVC 是一种软件设计模式,全称为 Model-View-Controller(模型-视图-控制器&#x…...

【算法】快排

题目 快排 思路 如果输入为0或1直接返回;否则取一个基准值,可以取中间位置,如果输入是有序的可以避免时间过长,然后移动指针,先让i指针右移,如果小于基准值就继续右移,j指针左移同理。如果指…...

2026最权威的十大AI辅助写作神器推荐榜单

Ai论文网站排名(开题报告、文献综述、降aigc率、降重综合对比) TOP1. 千笔AI TOP2. aipasspaper TOP3. 清北论文 TOP4. 豆包 TOP5. kimi TOP6. deepseek 这一刻,AI论文网站已然变成学术写作范畴里相当关键的辅助工具,诸如此…...

语雀文档批量导出终极解决方案:高效自动化迁移技术指南

语雀文档批量导出终极解决方案:高效自动化迁移技术指南 【免费下载链接】yuque-exporter export yuque to local markdown 项目地址: https://gitcode.com/gh_mirrors/yuq/yuque-exporter 在知识管理平台策略频繁调整的背景下,数据自主权已成为内…...

智能自动化破解工具:解放Steam游戏DRM限制的一站式解决方案

智能自动化破解工具:解放Steam游戏DRM限制的一站式解决方案 【免费下载链接】Steam-auto-crack Steam Game Automatic Cracker 项目地址: https://gitcode.com/gh_mirrors/st/Steam-auto-crack SteamAutoCrack是一款专为自动化破解Steam DRM保护游戏而设计的…...

Ant Design Pro v6 发布:全面升级技术栈,带来更现代开发体验!

Ant Design Pro v6 正式发布在距离 v5 发布近五年后,Ant Design Pro v6 现已正式发布。五年间,前端世界发生了翻天覆地的变化,React 18/19 带来了并发渲染,antd 从 v4 升级到了 v6,构建工具从 webpack 演进到了 Turbop…...

扩散模型与强化学习结合优化图像生成正向过程

1. 项目背景与核心价值DiffusionNFT这个项目名称拆解开来包含三个关键要素:扩散模型(Diffusion)、正向过程(Forward Process)和强化学习(Reinforcement Learning)。这实际上揭示了一种将扩散模型…...

Docker 27认证新规强制生效倒计时90天,你的PACS/DICOM容器已过期?——2024医疗云平台合规自查清单

更多请点击: https://intelliparadigm.com 第一章:Docker 27医疗容器合规认证新规核心解读 Docker 27于2024年Q3正式发布《医疗健康领域容器化应用合规认证实施细则(V1.0)》,首次将容器镜像签名、运行时完整性校验、H…...

如何用MediaCrawler实现5大平台媒体数据自动化采集:零代码配置与智能反爬策略

如何用MediaCrawler实现5大平台媒体数据自动化采集:零代码配置与智能反爬策略 【免费下载链接】MediaCrawler-new 项目地址: https://gitcode.com/GitHub_Trending/me/MediaCrawler-new 在当今数据驱动的时代,跨平台媒体内容采集已成为市场分析、…...

)

别再硬编码了!Transformers Trainer的compute_metrics如何优雅传入额外数据(label_names参数详解)

Transformers Trainer进阶指南:如何高效传递自定义数据至评估函数 在自然语言处理的实际工程中,我们常常会遇到标准评估流程无法满足需求的场景。想象一下,当你需要根据样本ID追踪错误预测、需要原始文本来计算领域特定指标,或是需…...

告别手动描边!用X-AnyLabeling和SAM模型,10分钟搞定YOLOv8-seg数据集标注

10倍效率革命:X-AnyLabelingSAMYOLOv8-seg智能标注全流程实战 标注效率是计算机视觉项目的第一道门槛。当面对500张工业零件图像需要标注时,传统手动描边可能需要消耗一个工程师整整三天的工作量——而现在,这个时间可以被压缩到3小时以内。这…...

Windows安卓应用安装终极方案:告别模拟器的完整指南

Windows安卓应用安装终极方案:告别模拟器的完整指南 【免费下载链接】APK-Installer An Android Application Installer for Windows 项目地址: https://gitcode.com/GitHub_Trending/ap/APK-Installer 还在为在Windows电脑上运行安卓应用而烦恼吗࿱…...