docker容器网络配置及常用操作

Linux内核实现名称空间的创建

ip netns(网络名称空间)命令

可以借助ip netns命令来完成对 Network Namespace 的各种操作。ip netns命令来自于iproute安装包,一般系统会默认安装,如果没有的话,请自行安装。

注意:ip netns命令修改网络配置时需要 sudo 权限。

可以通过ip netns命令完成对Network Namespace 的相关操作,可以通过ip netns help查看命令帮助信息:

[root@localhost ~]# rpm -qa|grep iproute

iproute-4.11.0-14.el7.x86_64

[root@localhost ~]# ip netns help

Usage: ip netns list // 列出所有的名称空间ip netns add NAME // 添加名称空间ip netns set NAME NETNSIDip [-all] netns delete [NAME]ip netns identify [PID]ip netns pids NAMEip [-all] netns exec [NAME] cmd ...ip netns monitorip netns list-id

默认情况下,Linux系统中是没有任何 Network Namespace的,所以ip netns list命令不会返回任何信息。

创建Network Namespace

通过命令创建一个名为ns0的命名空间:

[root@localhost ~]# ip netns list

[root@localhost ~]# ip netns add ns0

[root@localhost ~]# ip netns list

ns0

通过命令删除一个名为ns0的命名空间:

[root@localhost ~]# ip netns delete ns0

新创建的 Network Namespace 会出现在/var/run/netns/目录下。如果相同名字的 namespace 已经存在,命令会报Cannot create namespace file “/var/run/netns/ns0”: File exists的错误。

[root@localhost ~]# ls /var/run/netns

ns0[root@localhost ~]# ip netns add ns0

Cannot create namespace file "/var/run/netns/ns0": File exists

错误示范:手动创建一个名称空间(名称空间不可以手动去创建)

[root@localhost ~]# touch /var/run/netns/ns1

[root@localhost ~]# ip netns list

RTNETLINK answers: Invalid argument

RTNETLINK answers: Invalid argument

ns1

ns0

对于每个 Network Namespace 来说,它会有自己独立的网卡、路由表、ARP 表、iptables 等和网络相关的资源。

操作Network Namespace

ip命令提供了ip netns exec子命令可以在对应的 Network Namespace 中执行命令。

查看新创建 Network Namespace 的网卡信息

[root@localhost ~]# ip netns exec ns0 ip a // 进入ns0这个名称空间里面去执行ip a这条命令

1: lo: <LOOPBACK> mtu 65536 qdisc noop state DOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

可以看到,新创建的Network Namespace中会默认创建一个lo回环网卡,此时网卡处于关闭状态。此时,尝试去 ping 该lo回环网卡,会提示Network is unreachable

[root@localhost ~]# ip netns exec ns0 ping 127.0.0.1

connect: Network is unreachable

通过下面的命令启用lo回环网卡:

[root@localhost ~]# ip netns exec ns0 ip link set lo up

[root@localhost ~]# ip netns exec ns0 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

[root@localhost ~]# ip netns exec ns0 ping 127.0.0.1

PING 127.0.0.1 (127.0.0.1) 56(84) bytes of data.

64 bytes from 127.0.0.1: icmp_seq=1 ttl=64 time=0.033 ms

64 bytes from 127.0.0.1: icmp_seq=2 ttl=64 time=0.041 ms

64 bytes from 127.0.0.1: icmp_seq=3 ttl=64 time=0.032 ms

转移设备

我们可以在不同的 Network Namespace 之间转移设备(如veth)。由于一个设备只能属于一个 Network Namespace ,所以转移后在这个 Network Namespace 内就看不到这个设备了。

其中,veth设备属于可转移设备,而很多其它设备(如lo、vxlan、ppp、bridge等)是不可以转移的。

// 容器一运行,veth就会自动出现

[root@localhost ~]# docker run -it --rm busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

4: eth0@if5: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever[root@localhost ~]# ip a

........此处省略多行

5: veth693f9a1@if4: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue master docker0 state UP group default link/ether de:b2:5d:2a:ae:f7 brd ff:ff:ff:ff:ff:ff link-netnsid 0inet6 fe80::dcb2:5dff:fe2a:aef7/64 scope link valid_lft forever preferred_lft forever

veth pair

veth pair 全称是 Virtual Ethernet Pair,是一个成对的端口,所有从这对端口一 端进入的数据包都将从另一端出来,反之也是一样。

引入veth pair是为了在不同的 Network Namespace 直接进行通信,利用它可以直接将两个 Network Namespace 连接起来。

创建veth pair

[root@localhost ~]# ip link add type veth

[root@localhost ~]# ip link show

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN mode DEFAULT group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP mode DEFAULT group default qlen 1000link/ether 00:0c:29:a8:8f:68 brd ff:ff:ff:ff:ff:ff

3: docker0: <NO-CARRIER,BROADCAST,MULTICAST,UP> mtu 1500 qdisc noqueue state DOWN mode DEFAULT group default link/ether 02:42:13:af:55:08 brd ff:ff:ff:ff:ff:ff

6: veth0@veth1: <BROADCAST,MULTICAST,M-DOWN> mtu 1500 qdisc noop state DOWN mode DEFAULT group default qlen 1000link/ether c6:a1:94:ea:6e:75 brd ff:ff:ff:ff:ff:ff

7: veth1@veth0: <BROADCAST,MULTICAST,M-DOWN> mtu 1500 qdisc noop state DOWN mode DEFAULT group default qlen 1000link/ether 26:ae:e5:06:62:07 brd ff:ff:ff:ff:ff:ff

可以看到,此时系统中新增了一对veth pair,将veth0和veth1两个虚拟网卡连接了起来,此时这对 veth pair 处于”未启用“状态。

实现Network Namespace间通信

下面我们利用veth pair实现两个不同的 Network Namespace 之间的通信。刚才我们已经创建了一个名为ns0的 Network Namespace,下面再创建一个信息Network Namespace,命名为ns1

[root@localhost ~]# ip netns add ns1

[root@localhost ~]# ip netns list

ns1

ns0

然后我们将veth0加入到ns0,将veth1加入到ns1

[root@localhost ~]# ip link set veth0 netns ns0

[root@localhost ~]# ip netns exec ns0 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

6: veth0@if7: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN group default qlen 1000link/ether c6:a1:94:ea:6e:75 brd ff:ff:ff:ff:ff:ff link-netnsid 0[root@localhost ~]# ip link set veth1 netns ns1

[root@localhost ~]# ip netns exec ns1 ip a

1: lo: <LOOPBACK> mtu 65536 qdisc noop state DOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

7: veth1@if6: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN group default qlen 1000link/ether 26:ae:e5:06:62:07 brd ff:ff:ff:ff:ff:ff link-netnsid 0

然后我们分别为这对veth pair配置上ip地址,并启用它们

[root@localhost ~]# ip netns exec ns0 ip link set veth0 up

[root@localhost ~]# ip netns exec ns0 ip addr add 10.0.0.1/24 dev veth0

[root@localhost ~]# ip netns exec ns1 ip link set lo up

[root@localhost ~]# ip netns exec ns1 ip link set veth1 up

[root@localhost ~]# ip netns exec ns1 ip addr add 10.0.0.2/24 dev veth1

查看这对veth pair的状态

[root@localhost ~]# ip netns exec ns0 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

6: veth0@if7: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000link/ether c6:a1:94:ea:6e:75 brd ff:ff:ff:ff:ff:ff link-netnsid 1inet 10.0.0.1/24 scope global veth0valid_lft forever preferred_lft foreverinet6 fe80::c4a1:94ff:feea:6e75/64 scope link valid_lft forever preferred_lft forever[root@localhost ~]# ip netns exec ns1 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

7: veth1@if6: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000link/ether 26:ae:e5:06:62:07 brd ff:ff:ff:ff:ff:ff link-netnsid 0inet 10.0.0.2/24 scope global veth1valid_lft forever preferred_lft foreverinet6 fe80::24ae:e5ff:fe06:6207/64 scope link valid_lft forever preferred_lft forever

从上面可以看出,我们已经成功启用了这个veth pair,并为每个veth设备分配了对应的ip地址。我们尝试在ns1中访问ns0中的ip地址:

[root@localhost ~]# ip netns exec ns1 ping 10.0.0.1

PING 10.0.0.1 (10.0.0.1) 56(84) bytes of data.

64 bytes from 10.0.0.1: icmp_seq=1 ttl=64 time=0.065 ms

64 bytes from 10.0.0.1: icmp_seq=2 ttl=64 time=0.042 ms

64 bytes from 10.0.0.1: icmp_seq=3 ttl=64 time=0.050 ms

可以看到,veth pair成功实现了两个不同Network Namespace之间的网络交互。

如果跨越空间了,那么所有的属性都会被清掉。

[root@localhost ~]# ip netns add ns2

[root@localhost ~]# ip netns list

ns2

ns1

ns0

[root@localhost ~]# ip netns exec ns2 ip link set lo up

[root@localhost ~]# ip link set veth1 netns ns2

[root@localhost ~]# ip netns exec ns2 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

7: veth1@if6: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000link/ether 56:85:95:f2:cc:11 brd ff:ff:ff:ff:ff:ff link-netnsid 0

veth设备重命名

[root@localhost ~]# ip netns exec ns0 ip link set veth0 down

[root@localhost ~]# ip netns exec ns0 ip link set dev veth0 name eth0

[root@localhost ~]# ip netns exec ns0 ip link set eth0 up

[root@localhost ~]# ip netns exec ns0 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

6: eth0@if7: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000link/ether c6:a1:94:ea:6e:75 brd ff:ff:ff:ff:ff:ff link-netnsid 1inet 10.0.0.1/24 scope global eth0valid_lft forever preferred_lft foreverinet6 fe80::c4a1:94ff:feea:6e75/64 scope link valid_lft forever preferred_lft forever[root@localhost ~]# ip netns exec ns1 ip link set veth1 down

[root@localhost ~]# ip netns exec ns1 ip link set dev veth1 name eth0

[root@localhost ~]# ip netns exec ns1 ip link set eth0 up

[root@localhost ~]# ip netns exec ns1 ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

7: eth0@if6: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000link/ether 26:ae:e5:06:62:07 brd ff:ff:ff:ff:ff:ff link-netnsid 0inet 10.0.0.2/24 scope global eth0valid_lft forever preferred_lft foreverinet6 fe80::24ae:e5ff:fe06:6207/64 scope link valid_lft forever preferred_lft forever[root@localhost ~]# ip netns exec ns1 ping 10.0.0.1

PING 10.0.0.1 (10.0.0.1) 56(84) bytes of data.

64 bytes from 10.0.0.1: icmp_seq=1 ttl=64 time=0.046 ms

64 bytes from 10.0.0.1: icmp_seq=2 ttl=64 time=0.041 ms

64 bytes from 10.0.0.1: icmp_seq=3 ttl=64 time=0.100 ms

四种网络模式配置

bridge模式配置

[root@localhost ~]# docker run -it --rm busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

8: eth0@if9: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

/ # exit

[root@localhost ~]# docker container ls // 查看运行容器# 在创建容器时添加--network bridge与不加--network选项效果是一致的

[root@localhost ~]# docker run -it --rm --network bridge busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

10: eth0@if11: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

/ # exit

none模式配置

不用来通信,只用来做一些简单的操作

[root@localhost ~]# docker run -it --rm --network none busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

/ # exit

container模式配置

启动第一个容器

[root@localhost ~]# docker run -it --rm busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

12: eth0@if13: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

启动第二个容器

[root@localhost ~]# docker run -it --rm busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

14: eth0@if15: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:03 brd ff:ff:ff:ff:ff:ffinet 172.17.0.3/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

可以看到第二个容器的IP地址是172.17.0.3,与第一个容器的IP地址不是一样的,也就是说并没有共享网络,此时如果我们将第二个容器的启动方式改变一下,就可以使第二个容器的IP与第一个容器的IP一致,也即共享IP,但不共享文件系统。

[root@localhost ~]# docker run -it --rm --network container:72ae8bbf0c38 busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

12: eth0@if13: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

/ # hostname

72ae8bbf0c38

此时我们在第一个容器上创建一个目录

/ # mkdir /tmp/data

/ # ls /tmp

data

到第二个容器上检查/tmp目录会发现并没有这个目录,因为文件系统是处于隔离状态,仅仅是共享了网络而已。

/ # ls

bin dev etc home proc root sys tmp usr var

在第二个容器上部署一个站点

/ # ls /var/www/

/ # echo 'test page' > /var/www/index.html

/ # /bin/httpd/ -f -h /var/www/

sh: /bin/httpd/: not found

/ # /bin/httpd -f -h /var/www/[root@localhost ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

356a28d6a9fc busybox "sh" 4 minutes ago Up 4 minutes amazing_lichterman

72ae8bbf0c38 busybox "sh" 9 minutes ago Up 9 minutes serene_wing

[root@localhost ~]# docker exec -it 356a28d6a9fc /bin/sh

/ # netstat -antl

Active Internet connections (servers and established)

Proto Recv-Q Send-Q Local Address Foreign Address State

tcp 0 0 :::80 :::* LISTEN

/ # exit

在第一个容器上用本地地址去访问此站点

/ # wget -O - -q 127.0.0.1

test page

由此可见,container模式下的容器间关系就相当于一台主机上的两个不同进程

host模式配置

启动容器时直接指明模式为host

[root@localhost ~]# docker run -it --rm --network host busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast qlen 1000link/ether 00:0c:29:a8:8f:68 brd ff:ff:ff:ff:ff:ffinet 192.168.35.135/24 brd 192.168.35.255 scope global dynamic noprefixroute ens33valid_lft 1256sec preferred_lft 1256secinet6 fe80::c7db:4c9f:7bcc:55f5/64 scope link noprefixroute valid_lft forever preferred_lft forever

3: docker0: <NO-CARRIER,BROADCAST,MULTICAST,UP> mtu 1500 qdisc noqueue link/ether 02:42:13:af:55:08 brd ff:ff:ff:ff:ff:ffinet 172.17.0.1/16 brd 172.17.255.255 scope global docker0valid_lft forever preferred_lft foreverinet6 fe80::42:13ff:feaf:5508/64 scope link valid_lft forever preferred_lft forever

/ # ip link show

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast qlen 1000link/ether 00:0c:29:a8:8f:68 brd ff:ff:ff:ff:ff:ff

3: docker0: <NO-CARRIER,BROADCAST,MULTICAST,UP> mtu 1500 qdisc noqueue link/ether 02:42:13:af:55:08 brd ff:ff:ff:ff:ff:ff

此时如果我们在这个容器中启动一个http站点,我们就可以直接用宿主机的IP直接在浏览器中访问这个容器中的站点了。

[root@localhost ~]# ss -antl

State Recv-Q Send-Q Local Address:Port Peer Address:Port

LISTEN 0 128 *:22 *:*

LISTEN 0 100 127.0.0.1:25 *:*

LISTEN 0 128 :::22 :::*

LISTEN 0 100 ::1:25 :::* / # echo 'hello world' > /var/www/index.html

/ # /bin/httpd -f -h /var/www/[root@localhost ~]# ss -antl

State Recv-Q Send-Q Local Address:Port Peer Address:Port

LISTEN 0 128 *:22 *:*

LISTEN 0 100 127.0.0.1:25 *:*

LISTEN 0 9 :::80 :::*

LISTEN 0 128 :::22 :::*

LISTEN 0 100 ::1:25 :::*

容器的常用操作

查看容器的主机名

[root@localhost ~]# docker run -it --rm busybox

/ # hostname

68490a8f1c4e

在容器启动时注入主机名

[root@localhost ~]# docker run -it --rm --hostname lry busybox

/ # hostname

lry

/ # cat /etc/hostname

lry

/ # cat /etc/hosts

127.0.0.1 localhost

::1 localhost ip6-localhost ip6-loopback

fe00::0 ip6-localnet

ff00::0 ip6-mcastprefix

ff02::1 ip6-allnodes

ff02::2 ip6-allrouters

172.17.0.2 lry # 注入主机名时会自动创建主机名到IP的映射关系

/ # cat /etc/resolv.conf

# Generated by NetworkManager

search localdomain

nameserver 192.168.35.2 # DNS也会自动配置为宿主机的DNS

/ # ping www.baidu.com

PING www.baidu.com (36.152.44.95): 56 data bytes

64 bytes from 36.152.44.95: seq=0 ttl=127 time=42.348 ms

64 bytes from 36.152.44.95: seq=1 ttl=127 time=44.581 ms

64 bytes from 36.152.44.95: seq=2 ttl=127 time=42.597 ms

手动指定容器要使用的DNS

[root@localhost ~]# docker run -it --rm --hostname lry --dns 114.114.114.114 busybox

/ # hostname

lry

/ # cat /etc/resolv.conf

search localdomain

nameserver 114.114.114.114

/ # nslookup -type=a www.baidu.com

Server: 114.114.114.114

Address: 114.114.114.114:53Non-authoritative answer:

www.baidu.com canonical name = www.a.shifen.com

Name: www.a.shifen.com

Address: 36.152.44.96

Name: www.a.shifen.com

Address: 36.152.44.95

手动往/etc/hosts文件中注入主机名到IP地址的映射

[root@localhost ~]# docker run -it --rm --hostname lry --dns 114.114.114.114 --add-host lry1:172.17.0.3 busybox

/ # cat /etc/hosts

127.0.0.1 localhost

::1 localhost ip6-localhost ip6-loopback

fe00::0 ip6-localnet

ff00::0 ip6-mcastprefix

ff02::1 ip6-allnodes

ff02::2 ip6-allrouters

172.17.0.3 lry1

172.17.0.2 lry

开放容器端口

执行docker run的时候有个-p选项,可以将容器中的应用端口映射到宿主机中,从而实现让外部主机可以通过访问宿主机的某端口来访问容器内应用的目的。

-p选项能够使用多次,其所能够暴露的端口必须是容器确实在监听的端口。

-p选项的使用格式:

-p <containerPort>将指定的容器端口映射至主机所有地址的一个动态端口

-p <hostPort>:<containerPort>将容器端口<containerPort>映射至指定的主机端口<hostPort>

-p <ip>::<containerPort>将指定的容器端口<containerPort>映射至主机指定<ip>的动态端口

-p <ip>:<hostPort>:<containerPort>将指定的容器端口<containerPort>映射至主机指定<ip>的端口<hostPort>

动态端口指的是随机端口,具体的映射结果可使用docker port命令查看。

第一种 - p 的使用方式

[root@localhost ~]# docker run -d --name web --rm -p 80 nginx

Unable to find image 'nginx:latest' locally

latest: Pulling from library/nginx

e5ae68f74026: Pull complete

21e0df283cd6: Pull complete

ed835de16acd: Pull complete

881ff011f1c9: Pull complete

77700c52c969: Pull complete

44be98c0fab6: Pull complete

Digest: sha256:9522864dd661dcadfd9958f9e0de192a1fdda2c162a35668ab6ac42b465f0603

Status: Downloaded newer image for nginx:latest

341c1ee1b9570401c48aab26ffb0cd9e0ac6149099bb9be25019bcc01f2549f9

[root@localhost ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

341c1ee1b957 nginx "/docker-entrypoint.…" 5 seconds ago Up 4 seconds 0.0.0.0:49153->80/tcp, :::49153->80/tcp web

以上命令执行后会一直占用着前端,我们新开一个终端连接来看一下容器的80端口被映射到了宿主机的什么端口上

[root@localhost ~]# docker port web

80/tcp -> 0.0.0.0:49153

80/tcp -> :::49153

由此可见,容器的80端口被暴露到了宿主机的32769端口上,此时我们在宿主机上访问一下这个端口看是否能访问到容器内的站点

[root@localhost ~]# curl http://127.0.0.1:49154

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

<style>

html { color-scheme: light dark; }

body { width: 35em; margin: 0 auto;

font-family: Tahoma, Verdana, Arial, sans-serif; }

</style>

</head>

<body>

<h1>Welcome to nginx!</h1>

<p>If you see this page, the nginx web server is successfully installed and

working. Further configuration is required.</p><p>For online documentation and support please refer to

<a href="http://nginx.org/">nginx.org</a>.<br/>

Commercial support is available at

<a href="http://nginx.com/">nginx.com</a>.</p><p><em>Thank you for using nginx.</em></p>

</body>

</html>

第二种 - p 的方式:

将容器端口映射到宿主机的指定端口

[root@localhost ~]# docker run -d --name web --rm -p 80:80 nginx // 表示把容器里面的80映射到真机里面的80;前面80是真机的,后面80是容器的

5936ad37bb3e08877274991c88be899042eeba03555ea461e4ddda40e3e655b5

在另一个终端上查看端口映射情况

[root@localhost ~]# docker port web

80/tcp -> 0.0.0.0:80

80/tcp -> :::80

iptables防火墙规则将随容器的创建自动生成,随容器的删除自动删除规则。

第三种 - p 的方式:

将容器端口映射到指定IP的随机端口

[root@localhost ~]# docker run --name web --rm -p 192.168.35.135::80 nginx

在另一个终端上查看端口映射情况

[root@localhost ~]# docker port web

80/tcp -> 192.168.35.135:49153

第四种 - p 的方式:

将指定的容器端口映射至主机指定的端口

[root@localhost ~]# docker run -d --name web --rm -p 127.0.0.1:80:80 nginx

879c0985c813727208032f7dd1dd9b1a2570576cebc27ddf398c2df33e4252e0

在另一个终端上查看端口映射情况

[root@localhost ~]# docker port web

80/tcp -> 127.0.0.1:80

自定义docker0桥的网络属性信息

官方文档相关配置https://docs.docker.com/network/bridge/

自定义docker0桥的网络属性信息需要修改/etc/docker/daemon.json配置文件

[root@localhost ~]# vi /etc/docker/daemon.json

{"registry-mirrors": ["https://2bkybiwf.mirror.aliyuncs.com"],"bip": "192.168.1.1/24"

}

[root@localhost ~]# systemctl restart docker[root@localhost ~]# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft foreverinet6 ::1/128 scope host valid_lft forever preferred_lft forever

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000link/ether 00:0c:29:a8:8f:68 brd ff:ff:ff:ff:ff:ffinet 192.168.35.135/24 brd 192.168.35.255 scope global noprefixroute dynamic ens33valid_lft 1169sec preferred_lft 1169secinet6 fe80::c7db:4c9f:7bcc:55f5/64 scope link noprefixroute valid_lft forever preferred_lft forever

3: docker0: <NO-CARRIER,BROADCAST,MULTICAST,UP> mtu 1500 qdisc noqueue state DOWN group default link/ether 02:42:5b:66:73:8e brd ff:ff:ff:ff:ff:ffinet 192.168.1.1/24 brd 192.168.1.255 scope global docker0valid_lft forever preferred_lft foreverinet6 fe80::42:5bff:fe66:738e/64 scope link valid_lft forever preferred_lft forever

核心选项为bip,即bridge ip之意,用于指定docker0桥自身的IP地址;其它选项可通过此地址计算得出。

docker远程连接(不常用)

dockerd守护进程的C/S,其默认仅监听Unix Socket格式的地址(/var/run/docker.sock),如果要使用TCP套接字,则需要修改/etc/docker/daemon.json配置文件

docker创建自定义桥

创建一个额外的自定义桥,区别于docker0

[root@localhost ~]# docker network ls

NETWORK ID NAME DRIVER SCOPE

bfef3a5a370d bridge bridge local

6ceb6009fa51 host host local

722f6ab96f26 none null local

[root@localhost ~]# docker network create -d bridge --subnet "192.168.2.0/24" --gateway "192.168.2.1" br0

a298744eb8b168ee11c122a301dfd44d699c9cca7bfb9177944aae51fa7cef0e

[root@localhost ~]# docker network ls

NETWORK ID NAME DRIVER SCOPE

a298744eb8b1 br0 bridge local

bfef3a5a370d bridge bridge local

6ceb6009fa51 host host local

722f6ab96f26 none null local

使用新创建的自定义桥来创建容器:

[root@localhost ~]# docker run -it --rm --network br0 busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

23: eth0@if24: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:c0:a8:02:02 brd ff:ff:ff:ff:ff:ffinet 192.168.2.2/24 brd 192.168.2.255 scope global eth0valid_lft forever preferred_lft forever

再创建一个容器,使用默认的bridge桥:

[root@localhost ~]# docker run -it --rm busybox

/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

25: eth0@if26: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

试想一下,此时的b2与b1能否互相通信?如果不能该如何实现通信?

/ # hostname

bb1a030ba094[root@localhost ~]# docker network connect br0 bb1a030ba094/ # ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00inet 127.0.0.1/8 scope host lovalid_lft forever preferred_lft forever

25: eth0@if26: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:ac:11:00:02 brd ff:ff:ff:ff:ff:ffinet 172.17.0.2/16 brd 172.17.255.255 scope global eth0valid_lft forever preferred_lft forever

27: eth1@if28: <BROADCAST,MULTICAST,UP,LOWER_UP,M-DOWN> mtu 1500 qdisc noqueue link/ether 02:42:c0:a8:02:03 brd ff:ff:ff:ff:ff:ffinet 192.168.2.3/24 brd 192.168.2.255 scope global eth1valid_lft forever preferred_lft forever

/ # ping 192.168.2.2

PING 192.168.2.2 (192.168.2.2): 56 data bytes

64 bytes from 192.168.2.2: seq=0 ttl=64 time=0.204 ms

64 bytes from 192.168.2.2: seq=1 ttl=64 time=0.069 ms

64 bytes from 192.168.2.2: seq=2 ttl=64 time=0.079 ms

相关文章:

docker容器网络配置及常用操作

Linux内核实现名称空间的创建 ip netns(网络名称空间)命令 可以借助ip netns命令来完成对 Network Namespace 的各种操作。ip netns命令来自于iproute安装包,一般系统会默认安装,如果没有的话,请自行安装。 注意&am…...

Docker 性能优化指南

Docker 提供了强大的容器化功能,能够帮助开发者在不同的环境中构建、测试和部署应用。然而,随着容器化应用的不断增长,Docker 容器可能会面临一些性能瓶颈,影响其运行效率、资源占用和扩展能力。为了确保容器在生产环境中的高效运…...

课程1. 深度学习简介

课程1. 深度学习简介 神经网络结构逻辑回归XOR问题(异或问题) 中间特征的生成全连接神经网络中间网络层的激活函数Sigmoid函数Tanh函数ReLU函数其它激活函数 使用全连接神经网络解决 XOR 问题神经网络用于回归问题训练神经网络 不同类型的神经网络 附加材…...

【cuda学习日记】4.3 结构体数组与数组结构体

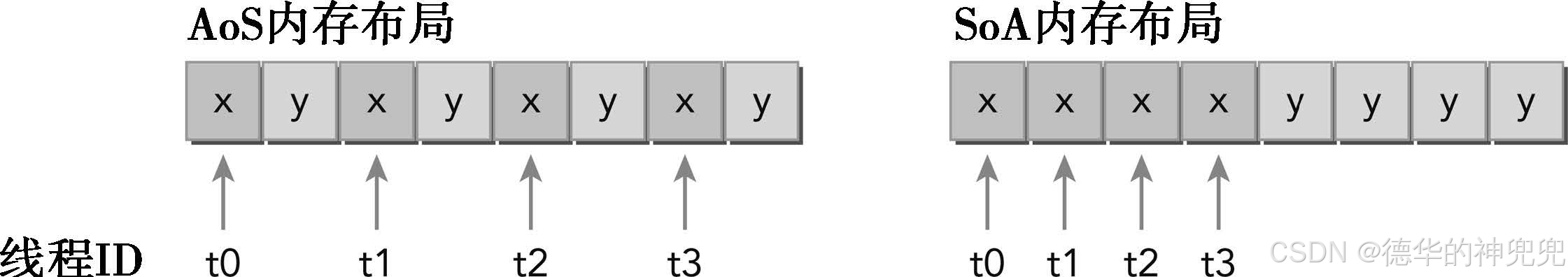

4.3 数组结构体(AoS)和结构体数组(SoA) AoS方法进行存储 struct innerStruct{float x;float y; };struct innerStruct myAOS[N];SoA方法来存储数据 struct innerArray{float x[N];float y[N]; };struct innerArray moa;如图说明…...

2025最新高维多目标优化:基于城市场景下无人机三维路径规划的导航变量的多目标粒子群优化算法(NMOPSO),MATLAB代码

一、基于导航变量的多目标粒子群优化算法(NMOPSO)介绍 基于导航变量的多目标粒子群优化算法(Navigation variable-based multi-objective particle swarm optimization,NMOPSO)是2025年提出的一种用于无人机路径规划的…...

数字IC后端设计实现OCC(On-chip Clock Controller)电路介绍及时钟树综合案例

数字IC后端时钟树综合专题(OCC电路案例分享) 复杂时钟设计时钟树综合(clock tree synthesis)常见20个典型案例 1、什么是OCC? 片上时钟控制器(On-chip Clock Controllers ,OCC),也称为扫描时钟控制器(Scan Clock Con…...

Linux内核,slub分配流程

我们根据上面的流程图,依次看下slub是如何分配的 首先从kmem_cache_cpu中分配,如果没有则从kmem_cache_cpu的partial链表分配,如果还没有则从kmem_cache_node中分配,如果kmem_cache_node中也没有,则需要向伙伴系统申请…...

本地部署DeepSeek-R1(Ollama+Docker+OpenWebUI知识库)

安装Ollama 打开 Ollama官网 https://ollama.com/下载安装 Ollama服务默认只允许本机访问,修改允许其它主机访问 OLLAMA_HOST0.0.0.0 ollama serve也可以添加系统环境变量 都知道模型体积很大,顺便也通过环境变量修改模型存放位置,我这…...

Java 实现快速排序算法:一条快速通道,分而治之

大家好,今天我们来聊聊快速排序(QuickSort)算法,这个经典的排序算法被广泛应用于各种需要高效排序的场景。作为一种分治法(Divide and Conquer)算法,快速排序的效率在平均情况下非常高ÿ…...

20250223下载并制作RTX2080Ti显卡的显存的测试工具mats

20250223下载并制作RTX2080Ti显卡的显存的测试工具mats 2025/2/23 23:23 缘起:我使用X99的主板,使用二手的RTX2080Ti显卡【显存22GB版本,准备学习AI的】 但是半年后发现看大码率的视频容易花屏,最初以为是WIN10经常更换显卡/来回更…...

element-ui的组件使用

1. 安装 Element UI(在文件夹最上面输入cmd进入dos窗口,然后输入安装指令 npm install element-ui --save) 2.在main.js文件全局引入(main.js文件负责 全局注册 ),在该文件注册的所有组件在其他文件都能直接调用,一般…...

医疗AI领域中GPU集群训练的关键技术与实践经验探究(上)

医疗AI领域中GPU集群训练的关键技术与实践经验探究(上) 一、引言 1.1 研究背景与意义 在科技飞速发展的当下,医疗 AI 作为人工智能技术与医疗领域深度融合的产物,正引领着医疗行业的深刻变革。近年来,医疗 AI 在疾病诊断、药物研发、健康管理等诸多方面取得了显著进展,…...

详解Redis淘汰策略

引言 Redis 是一个高性能的内存数据库,广泛应用于缓存系统、消息队列等场景。当 Redis 的内存达到限制时,需要根据一定的策略来淘汰数据,以便腾出空间给新数据。本文将深入解析 Redis 的内存淘汰机制,帮助更好地配置 Redis&#…...

HarmonyOS 5.0应用开发——鸿蒙接入高德地图实现POI搜索

【高心星出品】 文章目录 鸿蒙接入高德地图实现POI搜索运行结果:准备地图编写ArkUI布局来加载HTML地图 鸿蒙接入高德地图实现POI搜索 在当今数字化时代,地图应用已成为移动设备中不可或缺的一部分。随着鸿蒙系统的日益普及,如何在鸿蒙应用中…...

nginx关于配置SSL后启动失败原因分析

在配置SSL后,启动./nginx失败,报错提示如下: nginx: [emerg] the "ssl" parameter requires ngx_http_ssl_module in /usr/local/nginx-1.27.4/conf/nginx.conf:36 这个错误提示表在配置nginx启用SSL时,nginx未启用 ng…...

【自学嵌入式(9)ESP8266网络服务器的使用】

ESP8266网络服务器的使用 ESP8266WiFi 库① WiFiClass② WiFiClient③ WiFiServer④ WiFiUDP ESP8266WiFiMulti 库① WiFiMulti ESP8266WebServer 库① ESP8266WebServer 网络服务器实例在浏览器中控制ESP8266指示灯将开发板引脚状态显示在网页中 在之前的文章中,曾…...

危化品经营单位安全管理人员的职责及注意事项

危化品经营单位安全管理人员肩负着保障经营活动安全的重要责任,以下是其主要职责及注意事项: 职责 1. 安全制度建设与执行:负责组织制定本单位安全生产规章制度、操作规程和生产安全事故应急救援预案,确保这些制度符合国家相关法…...

(5))

项目实战--网页五子棋(匹配模块)(5)

上期我们实现了websocket后端的大部分代码,这期我们实现具体的匹配逻辑 1. 定义Mather类 我们新建一个Matcher类用来实现匹配逻辑 Component public class Matcher {//每个匹配队列代表不同的段位,这里约定每一千分为一个段位private ArrayList<Queue<User…...

mysql 迁移到人大金仓数据库

我是在windows上安装了客户端工具 运行数据库迁移工具 打开 在浏览器输入http://localhost:54523/ 账号密码都是kingbase 添加mysql源数据库连接 添加人大金仓目标数据库 添加好的两个数据库连接 新建迁移任务 选择数据库 全选 迁移中 如果整体迁移不过去可以单个单个或者几个…...

uniapp 网络请求封装(uni.request 与 uView-Plus)

一、背景 在开发项目中,需要经常与后端服务器进行交互;为了提高开发效率和代码维护性,以及降低重复性代码,便对网络请求进行封装统一管理。 二、创建环境文件 2.1、根目录新建utils文件夹,utils文件夹内新建env.js文…...

数字IC面试核心:从MUX基础到Glitch-Free时钟切换电路深度剖析

1. 二选一MUX的基础原理 多路选择器(MUX)是数字电路中最基础的组合逻辑单元之一,它的核心功能就像铁路道岔的扳道工——根据控制信号决定哪条输入通道的数据能够到达输出端。我们先从最简单的二选一MUX入手,这不仅是面试必考题&am…...

如何在Windows上直接安装Android应用:APK Installer完整指南

如何在Windows上直接安装Android应用:APK Installer完整指南 【免费下载链接】APK-Installer An Android Application Installer for Windows 项目地址: https://gitcode.com/GitHub_Trending/ap/APK-Installer 你是否厌倦了在Windows上使用笨重的Android模拟…...

PD协议中的VDM:从握手到模式切换的实战解析

1. VDM基础:从USB PD到厂商自定义消息 第一次接触USB PD协议中的VDM(Vendor Defined Message)时,我完全被各种缩写搞晕了。后来在实际项目中调试一个支持DisplayPort Alt Mode的扩展坞才发现,VDM简直是USB-C设备的&qu…...

算法训练营第六天|反转链表

题目链接: https://leetcode.cn/problems/reverse-linked-list/ 视频链接:https://www.bilibili.com/video/BV1nB4y1i7eL 难点:迭代中如何防止断链以及递归如何实现反转 感想:写的时候容…...

)

手把手教你用Verilog和ModelSim搞定RISC-V单周期CPU的仿真验证(附完整测试代码)

手把手教你用Verilog和ModelSim搞定RISC-V单周期CPU的仿真验证(附完整测试代码) 在数字电路设计的学习过程中,RISC-V单周期处理器的实现是一个重要的里程碑。然而,仅仅完成Verilog代码编写还远远不够,如何验证处理器的…...

抖音视频下载终极指南:douyin-downloader完整使用教程

抖音视频下载终极指南:douyin-downloader完整使用教程 【免费下载链接】douyin-downloader A practical Douyin downloader for both single-item and profile batch downloads, with progress display, retries, SQLite deduplication, and browser fallback suppo…...

蓝桥杯备赛指南:从零构建算法知识体系

1. 蓝桥杯竞赛与算法知识体系概述 参加蓝桥杯竞赛就像玩一款策略游戏,你需要先收集基础装备(语法和API),然后学习各种战斗技巧(算法和数据结构),最后才能挑战大Boss(竞赛题目&#…...

)

手把手教你如何在企业网络中部署SyncE(含芯片选型指南)

手把手教你如何在企业网络中部署SyncE(含芯片选型指南) 在数字化转型浪潮中,企业网络对时钟同步精度的要求正从毫秒级向微秒级跃迁。SyncE(同步以太网)技术凭借其媲美传统SDH的同步性能,正在5G前传、金融交…...

)

图像预处理:腐蚀与膨胀操作(形态学处理入门)

图像预处理:腐蚀与膨胀操作(形态学处理入门)📚 本章学习目标:深入理解腐蚀与膨胀操作(形态学处理入门)的核心概念与实践方法,掌握关键技术要点,了解实际应用场景与最佳实…...

如何零代码高效抓取网页数据:Web Scraper Chrome扩展完全指南

如何零代码高效抓取网页数据:Web Scraper Chrome扩展完全指南 【免费下载链接】web-scraper-chrome-extension Web data extraction tool implemented as chrome extension 项目地址: https://gitcode.com/gh_mirrors/we/web-scraper-chrome-extension Web S…...