【Kubernetes】Kubernetes的PV和PVC的用法

PV、PVC

- 前言

- 一、 存储卷

- 1. emptyDir 存储卷

- 1.1 概念

- 1.2 实例

- 2. hostPath 存储卷

- 2.1 概念

- 2.2 实例

- 3. nfs共享存储卷

- 二、PV 和 PVC

- 1. 概念

- 1.1 PV

- 1.2 PVC

- 1.3 PVC 的使用逻辑

- 1.4 创建机制

- 1.5 PV 和 PVC 的生命力周期

- 1.6 创建及销毁 PV 的流程

- 2. PV 和 PVC 的创建

- 2.1 查看定义

- 2.2 NFS 创建静态PV

- 1) 配置nfs存储

- 2) 定义 PV

- 3) 定义 PVC

- 4) 测试访问

- 2.3 搭建 StorageClass + nfs-client-provisioner ,实现 NFS 的动态 PV 创建

- 1) 配置nfs服务

- 2) 创建 Service Account

- 3) 使用 Deployment 来创建 NFS Provisioner

- 4) 创建 StorageClass

- 5) 创建 PVC 和 Pod 测试

- 总结

- 1. 常使用的日志分析工具有些哪些以及它们如何与K8S集群进行通信

- 2. K8S 的存储卷

- 3. PV 和 PVC

- 4. 创建 PV 的方式(PV类型)

- 5. PV 的四种状态

- 6. 创建 PV 资源

前言

容器磁盘上的文件的生命周期是短暂的,这就使得在容器中运行重要应用时会出现一些问题。首先,当容器崩溃时,kubelet 会重启它,但是容器中的文件将丢失——容器以干净的状态(镜像最初的状态)重新启动。其次,在Pod中同时运行多个容器时,这些容器之间通常需要共享文件。Kubernetes 中的Volume抽象就很好的解决了这些问题。Pod中的容器通过Pause容器共享Volume。

一、 存储卷

1. emptyDir 存储卷

1.1 概念

当Pod被分配给节点时,首先创建emptyDir卷,并且只要该Pod在该节点上运行,该卷就会存在。正如卷的名字所述,它最初是空的。Pod 中的容器可以读取和写入emptyDir卷中的相同文件,尽管该卷可以挂载到每个容器中的相同或不同路径上。当出于任何原因从节点中删除 Pod 时,emptyDir中的数据将被永久删除。

1.2 实例

mkdir /opt/volumes

cd /opt/volumesvim pod-emptydir.yaml

apiVersion: v1

kind: Pod

metadata:name: pod-emptydirnamespace: defaultlabels:app: myapptier: frontend

spec:containers:- name: myappimage: ikubernetes/myapp:v1imagePullPolicy: IfNotPresentports:- name: httpcontainerPort: 80#定义容器挂载内容volumeMounts:#使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷- name: html#挂载至容器中哪个目录mountPath: /usr/share/nginx/html/- name: busyboximage: busybox:latestimagePullPolicy: IfNotPresentvolumeMounts:- name: html#在容器内定义挂载存储名称和挂载路径mountPath: /data/command: ['/bin/sh','-c','while true;do echo $(date) >> /data/index.html;sleep 2;done']#定义存储卷volumes:#定义存储卷名称 - name: html#定义存储卷类型emptyDir: {}kubectl apply -f pod-emptydir.yaml

kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

pod-emptydir 2/2 Running 0 49s 10.244.1.9 node01 <none> <none>#在上面定义了2个容器,其中一个容器是输入日期到index.html中,然后验证访问nginx的html是否可以获取日期。以验证两个容器之间挂载的emptyDir实现共享。

curl 10.244.1.9

Fri Aug 11 07:19:57 UTC 2023

Fri Aug 11 07:19:59 UTC 2023

Fri Aug 11 07:20:01 UTC 2023

Fri Aug 11 07:20:03 UTC 2023

Fri Aug 11 07:20:05 UTC 2023

Fri Aug 11 07:20:07 UTC 2023

Fri Aug 11 07:20:09 UTC 2023

Fri Aug 11 07:20:11 UTC 2023

Fri Aug 11 07:20:13 UTC 2023

Fri Aug 11 07:20:15 UTC 2023

Fri Aug 11 07:20:17 UTC 2023

Fri Aug 11 07:20:19 UTC 2023

Fri Aug 11 07:20:21 UTC 2023

Fri Aug 11 07:20:23 UTC 2023

Fri Aug 11 07:20:25 UTC 2023

Fri Aug 11 07:20:27 UTC 2023

Fri Aug 11 07:20:29 UTC 2023

Fri Aug 11 07:20:31 UTC 2023

Fri Aug 11 07:20:33 UTC 2023

Fri Aug 11 07:20:35 UTC 2023

Fri Aug 11 07:20:37 UTC 2023

Fri Aug 11 07:20:39 UTC 2023

Fri Aug 11 07:20:41 UTC 2023

Fri Aug 11 07:20:43 UTC 2023

Fri Aug 11 07:20:45 UTC 2023

Fri Aug 11 07:20:47 UTC 2023

2. hostPath 存储卷

2.1 概念

hostPath卷将 node 节点的文件系统中的文件或目录挂载到集群中。

hostPath可以实现持久存储,但是在node节点故障时,也会导致数据的丢失。

2.2 实例

#在 node01 节点上创建挂载目录

mkdir -p /data/pod/volume1

echo 'node01.abc.com' > /data/pod/volume1/index.html

#创建 Pod 资源

vim pod-hostpath.yaml

apiVersion: v1

kind: Pod

metadata:name: pod-hostpathnamespace: default

spec:containers:- name: myappimage: nginx#定义容器挂载内容volumeMounts:#使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷- name: html#挂载至容器中哪个目录mountPath: /usr/share/nginx/html#读写挂载方式,默认为读写模式falsereadOnly: false#volumes字段定义了paues容器关联的宿主机或分布式文件系统存储卷volumes:#存储卷名称- name: html#路径,为宿主机存储路径hostPath:#在宿主机上目录的路径path: /data/pod/volume1#定义类型,这表示如果宿主机没有此目录则会自动创建type: DirectoryOrCreate

kubectl apply -f pod-hostpath.yaml#访问测试

kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

pod-hostpath 1/1 Running 0 25s 10.244.1.12 node01 <none> <none>curl 10.244.1.12

node01.abc.com#删除pod,再重建,验证是否依旧可以访问原来的内容

kubectl delete -f pod-hostpath.yaml

kubectl apply -f pod-hostpath.yaml kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

pod-hostpath 1/1 Running 0 31s 10.244.1.13 node01 <none> <none>curl 10.244.1.13

node01.abc.com

![]](https://img-blog.csdnimg.cn/8bff9d06633144dfae0ede8f14d104bd.png#pic_center)

3. nfs共享存储卷

#在stor01节点上环境配置

hostnamectl set-hostname stor01

systemctl stop firewalld

setenforce 0

rpm -q rpcbind

rpm -q nfs-utils

#在stor01节点上安装nfs,并配置nfs服务

mkdir /data/volumes -p

chmod 777 /data/volumesvim /etc/exports

/data/volumes 192.168.145.0/24(rw,no_root_squash)systemctl start rpcbind

systemctl start nfsshowmount -e

Export list for stor01:

/data/volumes 192.168.145.0/24

#master节点操作

vim pod-nfs-vol.yaml

apiVersion: v1

kind: Pod

metadata:name: pod-vol-nfsnamespace: default

spec:containers:- name: myappimage: ikubernetes/myapp:v1volumeMounts:- name: htmlmountPath: /usr/share/nginx/htmlvolumes:- name: htmlnfs:path: /data/volumesserver: stor01kubectl apply -f pod-nfs-vol.yamlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

pod-vol-nfs 1/1 Running 0 113s 10.244.1.14 node01 <none> <none>

#在nfs服务器上创建index.html

cd /data/volumes

vim index.html

<h1> nfs stor01</h1>

#master节点操作

curl 10.244.1.14

<h1> nfs stor01</h1>kubectl delete -f pod-nfs-vol.yaml #删除nfs相关pod,再重新创建,可以得到数据的持久化存储kubectl apply -f pod-nfs-vol.yaml

二、PV 和 PVC

1. 概念

1.1 PV

PV 全称叫做 Persistent Volume,持久化存储卷。它是用来描述或者说用来定义一个存储卷的,这个通常都是由运维工程师来定义。

1.2 PVC

PVC 的全称是 Persistent Volume Claim,是持久化存储的请求。它是用来描述希望使用什么样的或者说是满足什么条件的 PV 存储。

1.3 PVC 的使用逻辑

在 Pod 中定义一个存储卷(该存储卷类型为 PVC),定义的时候直接指定大小,PVC 必须与对应的 PV 建立关系,PVC 会根据配置的定义去 PV 申请,而 PV 是由存储空间创建出来的。PV 和 PVC 是 Kubernetes 抽象出来的一种存储资源。

1.4 创建机制

PV和PVC模式是需要运维人员先创建好PV,然后开发人员定义好PVC进行一对一的Bond,但是如果PVC请求成千上万,那么就需要创建成千上万的PV,对于运维人员来说维护成本很高,Kubernetes提供一种自动创建PV的机制,叫StorageClass,它的作用就是创建PV的模板。

创建 StorageClass 需要定义 PV 的属性,比如存储类型、大小等;另外创建这种 PV 需要用到的存储插件,比如 Ceph 等。 有了这两部分信息,Kubernetes 就能够根据用户提交的 PVC,找到对应的 StorageClass,然后 Kubernetes 就会调用 StorageClass 声明的存储插件,自动创建需要的 PV 并进行绑定。

总结:PV是集群中的资源。 PVC是对这些资源的请求,也是对资源的索引检查。

1.5 PV 和 PVC 的生命力周期

PV和PVC之间的相互作用遵循这个生命周期:

Provisioning(配置)—> Binding(绑定)—> Using(使用)—> Releasing(释放) —> Recycling(回收)

Provisioning,即 PV 的创建,可以直接创建 PV(静态方式),也可以使用 StorageClass 动态创建

Binding,将 PV 分配给 PVC

Using,Pod 通过 PVC 使用该 Volume,并可以通过准入控制StorageProtection(1.9及以前版本为PVCProtection) 阻止删除正在使用的 PVC

Releasing,Pod 释放 Volume 并删除 PVC

Reclaiming,回收 PV,可以保留 PV 以便下次使用,也可以直接从云存储中删除

根据这 5 个阶段,PV 的状态有以下 4 种:

Available(可用):表示可用状态,还未被任何 PVC 绑定

Bound(已绑定):表示 PV 已经绑定到 PVC

Released(已释放):表示 PVC 被删掉,但是资源尚未被集群回收

Failed(失败):表示该 PV 的自动回收失败

1.6 创建及销毁 PV 的流程

一个PV从创建到销毁的具体流程如下:

- 一个PV创建完后状态会变成Available,等待被PVC绑定。

- 一旦被PVC邦定,PV的状态会变成Bound,就可以被定义了相应PVC的Pod使用。

- Pod使用完后会释放PV,PV的状态变成Released。

- 变成Released的PV会根据定义的回收策略做相应的回收工作。

| 回收策略 | 作用 |

|---|---|

| Retain | Retain就是保留现场,K8S集群什么也不做,等待用户手动去处理PV里的数据,处理完后,再手动删除PV。 |

| Delete | Delete策略,K8S会自动删除该PV及里面的数据。 |

| Recycle | Recycle方式,K8S会将PV里的数据删除,然后把PV的状态变成Available,又可以被新的PVC绑定使用。 |

2. PV 和 PVC 的创建

2.1 查看定义

kubectl explain pv.spec #查看pv定义的规格

FIELDS:apiVersion: v1kind: PersistentVolumemetadata: #由于 PV 是集群级别的资源,即 PV 可以跨 namespace 使用,所以 PV 的 metadata 中不用配置 namespacename: spec

kubectl explain pv.spec #查看pv定义的规格

spec:nfs:(定义存储类型)path:(定义挂载卷路径)server:(定义服务器名称)accessModes:(定义访问模型,有以下三种访问模型,以列表的方式存在,也就是说可以定义多个访问模式)- ReadWriteOnce #(RWO)卷可以被一个节点以读写方式挂载。 ReadWriteOnce 访问模式也允许运行在同一节点上的多个 Pod 访问卷。- ReadOnlyMany #(ROX)卷可以被多个节点以只读方式挂载。- ReadWriteMany #(RWX)卷可以被多个节点以读写方式挂载。

#nfs 支持全部三种;iSCSI 不支持 ReadWriteMany(iSCSI 就是在 IP 网络上运行 SCSI 协议的一种网络存储技术);HostPath 不支持 ReadOnlyMany 和 ReadWriteMany。capacity:(定义存储能力,一般用于设置存储空间)storage: 2Gi (指定大小)storageClassName: (自定义存储类名称,此配置用于绑定具有相同类别的PVC和PV)persistentVolumeReclaimPolicy: Retain #回收策略(Retain/Delete/Recycle)

---------------------------------------------------------------------------------------------------------------------------

#Retain(保留):当用户删除与之绑定的PVC时候,这个PV被标记为released(PVC与PV解绑但还没有执行回收策略)且之前的数据依然保存在该PV上,但是该PV不可用,需要手动来处理这些数据并删除该PV。

#Delete(删除):删除与PV相连的后端存储资源。对于动态配置的PV来说,默认回收策略为Delete。表示当用户删除对应的PVC时,动态配置的volume将被自动删除。(只有 AWS EBS, GCE PD, Azure Disk 和 Cinder 支持)

#Recycle(回收):如果用户删除PVC,则删除卷上的数据,卷不会删除。(只有 NFS 和 HostPath 支持)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-tvOYIL3i-1692012639956)(C:/Users/86138/AppData/Roaming/Typora/typora-user-images/image-20230814143406216.png)]](https://img-blog.csdnimg.cn/1d9bada9f3b946f49d885654146b87c0.png#pic_center)

kubectl explain pvc #查看PVC的定义方式

KIND: PersistentVolumeClaim

VERSION: v1

FIELDS:apiVersion <string>kind <string> metadata <Object>spec <Object>

#PV和PVC中的spec关键字段要匹配,比如存储(storage)大小、访问模式(accessModes)、存储类名称(storageClassName)

kubectl explain pvc.spec

spec:accessModes: (定义访问模式,必须是PV的访问模式的子集)resources:requests:storage: (定义申请资源的大小)storageClassName: (定义存储类名称,此配置用于绑定具有相同类别的PVC和PV)

2.2 NFS 创建静态PV

1) 配置nfs存储

mkdir v{1,2,3,4,5}vim /etc/exports

/data/volumes/v1 192.168.145.0/24(rw,no_root_squash)

/data/volumes/v2 192.168.145.0/24(rw,no_root_squash)

/data/volumes/v3 192.168.145.0/24(rw,no_root_squash)

/data/volumes/v4 192.168.145.0/24(rw,no_root_squash)

/data/volumes/v5 192.168.145.0/24(rw,no_root_squash)exportfs -arv #发出共享信息showmount -e

2) 定义 PV

#这里定义5个PV,并且定义挂载的路径以及访问模式,还有PV划分的大小。

vim pv-demo.yaml

apiVersion: v1

kind: PersistentVolume

metadata:name: pv001labels:name: pv001

spec:nfs:path: /data/volumes/v1server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 1Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv002labels:name: pv002

spec:nfs:path: /data/volumes/v2server: stor01accessModes: ["ReadWriteOnce"]capacity:storage: 2Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv003labels:name: pv003

spec:nfs:path: /data/volumes/v3server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 2Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv004labels:name: pv004

spec:nfs:path: /data/volumes/v4server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 4Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv005labels:name: pv005

spec:nfs:path: /data/volumes/v5server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 5Gi

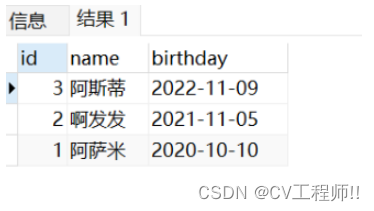

kubectl apply -f pv-demo.yamlkubectl get pv

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS REASON AGE

pv001 1Gi RWO,RWX Retain Available 26s

pv002 2Gi RWO Retain Available 26s

pv003 2Gi RWO,RWX Retain Available 26s

pv004 4Gi RWO,RWX Retain Available 25s

pv005 5Gi RWO,RWX Retain Available 25s

3) 定义 PVC

这里定义了pvc的访问模式为多路读写,该访问模式必须在前面pv定义的访问模式之中。定义PVC申请的大小为2Gi,此时PVC会自动去匹配多路读写且大小为2Gi的PV,匹配成功获取PVC的状态即为Bound

vim pod-vol-pvc.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:name: mypvcnamespace: default

spec:accessModes: ["ReadWriteMany"]resources:requests:storage: 2Gi

---

apiVersion: v1

kind: Pod

metadata:name: pod-vol-pvcnamespace: default

spec:containers:- name: myappimage: nginxvolumeMounts:- name: htmlmountPath: /usr/share/nginx/htmlvolumes:- name: htmlpersistentVolumeClaim:claimName: mypvc

kubectl apply -f pod-vol-pvc.yamlkubectl get pv

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS REASON AGE

pv001 1Gi RWO,RWX Retain Available 19m

pv002 2Gi RWO Retain Available 19m

pv003 2Gi RWO,RWX Retain Bound default/mypvc 19m

pv004 4Gi RWO,RWX Retain Available 19m

pv005 5Gi RWO,RWX Retain Available 19mkubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

mypvc Bound pv003 2Gi RWO,RWX 22s

4) 测试访问

#在存储服务器上创建index.html,并写入数据,通过访问Pod进行查看,可以获取到相应的页面。

cd /data/volumes/v3/

echo "welcome to use pv3" > index.htmlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

pod-vol-nfs 1/1 Running 0 46m 10.244.1.2 node01 <none> <none>

pod-vol-pvc 1/1 Running 0 18m 10.244.2.2 node02 <none> <none>curl 10.244.2.2

welcome to use pv3

2.3 搭建 StorageClass + nfs-client-provisioner ,实现 NFS 的动态 PV 创建

Kubernetes 本身支持的动态 PV 创建不包括 NFS,所以需要使用外部存储卷插件分配PV。详见:https://kubernetes.io/zh/docs/concepts/storage/storage-classes/

卷插件称为 Provisioner(存储分配器),NFS 使用的是 nfs-client,这个外部卷插件会使用已经配置好的 NFS 服务器自动创建 PV。

Provisioner:用于指定 Volume 插件的类型,包括内置插件(如 kubernetes.io/aws-ebs)和外部插件(如 external-storage 提供的 ceph.com/cephfs)。

1) 配置nfs服务

#在stor01节点上安装nfs

mkdir /opt/k8s

chmod 777 /opt/k8s/vim /etc/exports

/opt/k8s 192.168.145.0/24(rw,no_root_squash,sync)systemctl restart nfs

2) 创建 Service Account

创建 Service Account,用来管理 NFS Provisioner 在 k8s 集群中运行的权限,设置 nfs-client 对 PV,PVC,StorageClass 等的规则

vim nfs-client-rbac.yaml

#创建 Service Account 账户,用来管理 NFS Provisioner 在 k8s 集群中运行的权限

apiVersion: v1

kind: ServiceAccount

metadata:name: nfs-client-provisioner

---

#创建集群角色

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:name: nfs-client-provisioner-clusterrole

rules:- apiGroups: [""]resources: ["persistentvolumes"]verbs: ["get", "list", "watch", "create", "delete"]- apiGroups: [""]resources: ["persistentvolumeclaims"]verbs: ["get", "list", "watch", "update"]- apiGroups: ["storage.k8s.io"]resources: ["storageclasses"]verbs: ["get", "list", "watch"]- apiGroups: [""]resources: ["events"]verbs: ["list", "watch", "create", "update", "patch"]- apiGroups: [""]resources: ["endpoints"]verbs: ["create", "delete", "get", "list", "watch", "patch", "update"]

---

#集群角色绑定

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:name: nfs-client-provisioner-clusterrolebinding

subjects:

- kind: ServiceAccountname: nfs-client-provisionernamespace: default

roleRef:kind: ClusterRolename: nfs-client-provisioner-clusterroleapiGroup: rbac.authorization.k8s.io

kubectl apply -f nfs-client-rbac.yamlkubectl get sa #查看创建的角色

3) 使用 Deployment 来创建 NFS Provisioner

NFS Provisioner(即 nfs-client),有两个功能:一个是在 NFS 共享目录下创建挂载点(volume),另一个则是将 PV 与 NFS 的挂载点建立关联。

#由于 1.20 版本启用了 selfLink,所以 k8s 1.20+ 版本通过 nfs provisioner 动态生成pv会报错,解决方法如下:

vim /etc/kubernetes/manifests/kube-apiserver.yaml

spec:containers:- command:- kube-apiserver- --feature-gates=RemoveSelfLink=false #添加这一行- --advertise-address=192.168.80.20

......kubectl apply -f /etc/kubernetes/manifests/kube-apiserver.yaml

kubectl delete pods kube-apiserver -n kube-system

kubectl get pods -n kube-system | grep apiserver

#创建 NFS Provisioner

vim nfs-client-provisioner.yaml

kind: Deployment

apiVersion: apps/v1

metadata:name: nfs-client-provisioner

spec:replicas: 1selector:matchLabels:app: nfs-client-provisionerstrategy:type: Recreatetemplate:metadata:labels:app: nfs-client-provisionerspec:serviceAccountName: nfs-client-provisioner #指定Service Account账户containers:- name: nfs-client-provisionerimage: quay.io/external_storage/nfs-client-provisioner:latestimagePullPolicy: IfNotPresentvolumeMounts:- name: nfs-client-rootmountPath: /persistentvolumesenv:- name: PROVISIONER_NAMEvalue: nfs-storage #配置provisioner的Name,确保该名称与StorageClass资源中的provisioner名称保持一致- name: NFS_SERVERvalue: stor01 #配置绑定的nfs服务器- name: NFS_PATHvalue: /opt/k8s #配置绑定的nfs服务器目录volumes: #申明nfs数据卷- name: nfs-client-rootnfs:server: stor01path: /opt/k8s

kubectl apply -f nfs-client-provisioner.yaml kubectl get pod

NAME READY STATUS RESTARTS AGE

nfs-client-provisioner-cd6ff67-sp8qd 1/1 Running 0 14s

4) 创建 StorageClass

创建 StorageClass,负责建立 PVC 并调用 NFS provisioner 进行预定的工作,并让 PV 与 PVC 建立关联

vim nfs-client-storageclass.yaml

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:name: nfs-client-storageclass

provisioner: nfs-storage #这里的名称要和provisioner配置文件中的环境变量PROVISIONER_NAME保持一致

parameters:archiveOnDelete: "false" #false表示在删除PVC时不会对数据目录进行打包存档,即删除数据;为ture时就会自动对数据目录进行打包存档,存档文件以archived开头

kubectl apply -f nfs-client-storageclass.yamlkubectl get storageclass

NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE ALLOWVOLUMEEXPANSION AGE

nfs-client-storageclass nfs-storage Delete Immediate false 18s

5) 创建 PVC 和 Pod 测试

vim test-pvc-pod.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:name: test-nfs-pvc#annotations: volume.beta.kubernetes.io/storage-class: "nfs-client-storageclass" #另一种SC配置方式

spec:accessModes:- ReadWriteManystorageClassName: nfs-client-storageclass #关联StorageClass对象resources:requests:storage: 1Gi

---

apiVersion: v1

kind: Pod

metadata:name: test-storageclass-pod

spec:containers:- name: busyboximage: busybox:latestimagePullPolicy: IfNotPresentcommand:- "/bin/sh"- "-c"args:- "sleep 3600"volumeMounts:- name: nfs-pvcmountPath: /mntrestartPolicy: Nevervolumes:- name: nfs-pvcpersistentVolumeClaim:claimName: test-nfs-pvc #与PVC名称保持一致

kubectl apply -f test-pvc-pod.yaml

#PVC 通过 StorageClass 自动申请到空间

kubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

test-nfs-pvc Bound pvc-ea0d73d0-42fd-455d-ab30-778ecd1aa342 1Gi RWX nfs-client-storageclass 105s

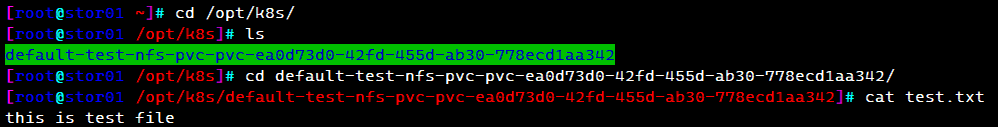

#查看 NFS 服务器上是否生成对应的目录,自动创建的 PV 会以 ${namespace}-${pvcName}-${pvName} 的目录格式放到 NFS 服务器上

ls /opt/k8s/

default-test-nfs-pvc-pvc-ea0d73d0-42fd-455d-ab30-778ecd1aa342

#进入 Pod 在挂载目录 /mnt 下写一个文件,然后查看 NFS 服务器上是否存在该文件

kubectl exec -it test-storageclass-pod sh

/ # cd /mnt/

/mnt # echo 'this is test file' > test.txt

#发现 NFS 服务器上存在,说明验证成功

cat /opt/k8s/default-test-nfs-pvc-pvc-ea0d73d0-42fd-455d-ab30-778ecd1aa34/test.txt

总结

1. 常使用的日志分析工具有些哪些以及它们如何与K8S集群进行通信

日志分析工具:EFK

daemonset 控制器在K88s每个Node上部署filebeat或logstash的Pod,采用hostpath类型存储卷共享宿主机上的日志目录,供filebeat或logstas采集日志数据

在Pod添加采集filebeat或logstash边车容器,并采用emptydir类型的存储卷共享应用容器的日志目录

2. K8S 的存储卷

emptyDir 可实现Pod中的容器之间共享目录数据,但emptyDir存储卷没有持久化数据的能力,存储卷会随着Pod生命周期结束而一起删除。

hostPath 将Node节点上的目录/文件挂载到Pod容器指定目录中,有持久化数据的能力,但只能在单个node节点上持久化数据,不能实现跨Node节点的Pod共享数据。

nfs 使用NFS服务将存储卷挂载到Pod容器的指定目录中,有持久化数据的能力,且也能实现跨Node节点的Pod共享数据。

3. PV 和 PVC

PV:K8S在指定存储设备空间中逻辑划分创建的可持久化的存储资源对象

PVC:是对PV资源对象的请求和绑定,也是Pod能挂在使用的一种存储卷类型

4. 创建 PV 的方式(PV类型)

1)手动根据配置文件创建的的静态Pod

2)通过StorageClass调用存储卷插件创建的动态PV

5. PV 的四种状态

Available(可用):表示可用状态,PV被创建出来了,还未被PVC绑定

Bound(已绑定):表示PV已经被PVC绑定,PV与PVC是一对一的绑定关系

Released(已释放):表示PVC被删除,但是PV资源还未被回收

Failed(失败):表示PV的自动回收失败

6. 创建 PV 资源

#创建使用 静态PV

1)准备好存储设备和共享目录

2)手动创建PV资源,配置 存储卷类型 访问模式(RWO RWX ROX RWOP) 存储空间大小 回收策略(Retain Recycle Delete)等

3)创建PVC资源,配置请求PV资源的访问模式(必要条件,必须是PV能支持的访问模式) 存储空间大小(默认就近选择大于等于指定大小的PV)来绑定PV

4)创建Pod和Pod控制器资源挂载PVC存储卷,配置存储卷类型为 persistentVolumeClaim ,并在容器配置中定义存储卷挂载点目录

(不要在 Pod 配置中使用 nodeName 来指定部署节点。因为使用 nodeName, Pod 将会绕过 scheduler 的调度,PWC 将停留在 pending 状态)

#创建使用 动态PV

1)准备好存储设备和共享目录

2)如果是外置存储卷插件,需要先创建serviceaccount账户(Pod使用的账户)和做RBAC授权(创建角色授予相关资源对象的操作权限,再将账户和角色进行绑定),使serviceaccount账户具有对PV PVC StorageClass等资源的操作权限

3)创建外置存储卷插件provisioner的Pod,配置中使用serviceaccount账户作为Pod的用户,并设置相关环境变量参数

4)创建StorageClass(SC)资源,配置中引用存储卷插件的插件名称(PROVISIONER_NAME)

---------------- 以上操作是一劳永逸的,以后只需要创建PVC时设置StorageClass就可以自动调用存储卷插件动态生成PV资源 ----------------

5)创建PVC资源,配置中设置 StorageClass资源名称 访问模式 存储空间大小。创建PVC资源会自动创建相关的PV资源。

6)创建Pod资源挂载PVC存储卷,配置存储卷类型为 persistentVolumeClaim ,并在容器配置中定义存储卷挂载点目录

相关文章:

【Kubernetes】Kubernetes的PV和PVC的用法

PV、PVC 前言一、 存储卷1. emptyDir 存储卷1.1 概念1.2 实例 2. hostPath 存储卷2.1 概念2.2 实例 3. nfs共享存储卷 二、PV 和 PVC1. 概念1.1 PV1.2 PVC1.3 PVC 的使用逻辑1.4 创建机制1.5 PV 和 PVC 的生命力周期1.6 创建及销毁 PV 的流程 2. PV 和 PVC 的创建2.1 查看定义2…...

【Redis】Redis三种集群模式-主从、哨兵、集群各自架构的优点和缺点对比

文章目录 前言1. 单机模式2. 主从架构3. 哨兵4. 集群模式总结 前言 如果Redis的读写请求量很大,那么单个实例很有可能承担不了这么大的请求量,如何提高Redis的性能呢?你也许已经想到了,可以部署多个副本节点,业务采用…...

Python爬虫:如何使用Python爬取网站数据

更新:2023-08-13 15:30 想要获取网站的数据?使用Python爬虫是一个绝佳的选择。Python爬虫是通过自动化程序来提取互联网上的信息。本文章将会详细介绍Python爬虫的相关技术。 一、网络协议和请求 在使用Python爬虫之前,我们需要理解网络协…...

剑指offer专题2:队列和栈

用两个栈模拟队列 class CQueue {stack<int> stack1;stack<int> stack2; public:CQueue() {}void appendTail(int value) {stack1.push(value);}int deleteHead() {int val-1;if(!stack2.empty()){val stack2.top();stack2.pop();}else if(!stack1.empty()){while…...

pytorch入门-神经网络

神经网络的基本骨架 import torch from torch import nn #nn模块是PyTorch中用于构建神经网络模型的核心模块。它提供了各种类和函数,可以帮助你定义和训练神经网络。class Tudui(nn.Module):def __init__(self):super(Tudui, self).__init__() #调用 super(Tudui,…...

)

kafka使用心得(二)

kafka进阶 消息顺序保证 Kafka它在设计的时候就是要保证分区下消息的顺序,也就是说消息在一个分区中的顺序是怎样的,那么消费者在消费的时候看到的就是什么样的顺序。 消费者和分区的对应关系 参考这篇文章。 分区文件 一个分区对应着log.dirs下的…...

(二)掌握最基本的Linux服务器用法——Linux下简单的C/C++ 程序、项目编译

1、静态库与动态库 静态库(Static Library):静态库是编译后的库文件,其中的代码在编译时被链接到程序中,因此它会与程序一起形成一个独立的可执行文件。每个使用静态库的程序都会有自己的库的副本,这可能会导致内存浪费。常用后缀…...

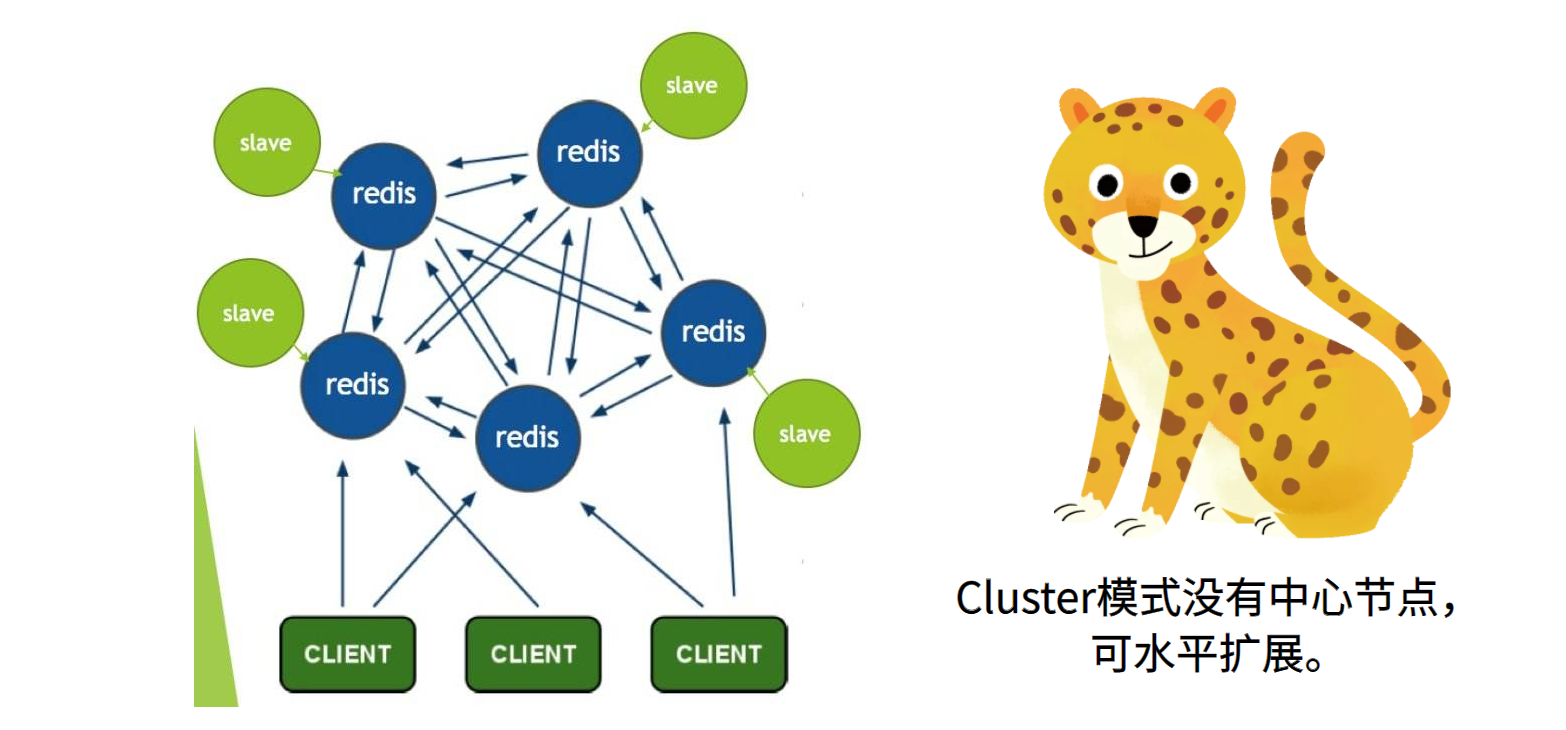

应急响应-钓鱼邮件的处理思路溯源及其反制

0x00 钓鱼邮件的危害 1.窃取用户敏感信息,制作虚假网址,诱导用户输入敏感的账户信息后记录 2.携带病毒木马程序,诱导安装,使电脑中病毒木马等 3.挖矿病毒的传输,勒索病毒的传输等等 0x01 有指纹的钓鱼邮件的溯源处理…...

Hadoop Hbase Hive 版本对照一览

这里写目录标题 一、Hadoop 与 Hbase 版本对照二、Hadoop 与 Hive 版本对照 官网内容记录,仅供参考 一、Hadoop 与 Hbase 版本对照 二、Hadoop 与 Hive 版本对照...

Postgresql 基础使用语法

1.数据类型 1.数字类型 类型 长度 说明 范围 与其他db比较 Smallint 2字节 小范围整数类型 32768到32767 integer 4字节 整数类型 2147483648到2147483647 bigint 8字节 大范围整数类型 -9233203685477808到9223203685477807 decimal 可变 用户指定 精度小…...

Qt 之 QDebug,QString

文章目录 前言一、QDebug二、QString总结 前言 一、QDebug QDebug是Qt中用于进行调试和输出日志的类。它提供了一种便捷的方式来输出各种类型的数据,并可轻松地与流式输出一起使用,方便调试和查看程序的运行情况。 引入QDebug: 在使用QDebug…...

【C++】面试题

1、都说c是面向对象的语言,面向对象的三个特性能 [展开] 介绍一下吗? 封装:封装是一种集中管理的思想,把内部的数据和实现方法组合在一起,并且不对外暴漏内部的数据和实现方法,只对外提供几个接口来完成函数…...

机器学习算法之-逻辑回归(1)

什么是回归 回归树,随机森林的回归,无一例外他们都是区别于分类算法们,用来处理和预测连续型标签的算法。然而逻辑回归,是一种名为“回归”的线性分类器,其本质是由线性回归变化而来的,一种广泛使用于分类问…...

JAVA多线程和并发基础面试问答(翻译)

JAVA多线程和并发基础面试问答(翻译) java多线程面试问题 1. 进程和线程之间有什么不同? 一个进程是一个独立(self contained)的运行环境,它可以被看作一个程序或者一个应用。而线程是在进程中执行的一个任务。Java运行环境是一个包含了不同的类和程序…...

正中优配:2023新股上市涨跌幅规则?新股上市涨跌幅限制为几天?

A股与美股不同,股票存在涨跌幅限制,那么,2023新股上市涨跌幅规矩?新股上市涨跌幅限制为几天?下面正中优配为我们预备了相关内容,以供参阅。 2023年新股上市涨跌幅存在以下规矩: 1、主板初次公开…...

如何查看线程在哪个cpu核上

1、ps -eLF查看PSR值 2、 taskset -pc $pid(进程/线程) 参考链接:https://blog.csdn.net/test1280/article/details/87993669...

【Vue前端】设置标题用于SEO优化

原文作者:我辈李想 版权声明:文章原创,转载时请务必加上原文超链接、作者信息和本声明。 文章目录 1.vue全局配置2.创建并暴露getPageTitle方法3.通过全局前置守卫设置title4.页面上引用title5.项目使用中英文翻译,title失效 1.vu…...

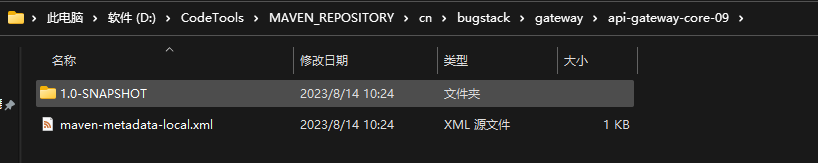

maven install

maven install maven 的 install 命令,当我们的一个 maven 模块想要依赖其他目录下的模块时,直接添加会找不到对应的模块,只需要找到需要引入的模块,执行 install 命令,就会将该模块放入本地仓库,就可以进…...

Vue.js2+Cesium1.103.0 七、Primitive 绘制航线元素

Vue.js2Cesium1.103.0 七、Primitive 绘制航线元素 用 Primitive 绘制航线元素,包括航点图标,航线线段,线段距离标注,航点序号,海拔标注,总航程等信息。 可同时绘制多条航线;可根据 id 清除指…...

Mybatis 源码 ④ :TypeHandler

文章目录 一、前言二、DefaultParameterHandler1. DefaultParameterHandler#setParameters1.1 UnknownTypeHandler1.2 自定义 TypeHandler 三、DefaultResultSetHandler1. hasNestedResultMaps2. handleRowValuesForNestedResultMap2.1 resolveDiscriminatedResultMap2.2 creat…...

神眸低功耗芯片突破:让摄像头摆脱电线,2045年或迎1000亿只智能视觉终端!推理算力创业机会大

神眸低功耗芯片突破,开启智能视觉终端未来神眸致力于在算力浪潮下游,凭借极致低功耗芯片设计,使摄像头摆脱电线束缚,开启千亿只智能视觉终端的未来。杨作兴带领神眸实现了摄像头功耗降低一个数量级的突破。第一代芯片达到业界三分…...

2026年B2B制造业GEO优化服务商推荐:工业品牌AI搜索可见度提升实战指南

摘要:B2B制造业的品牌营销与消费品逻辑完全不同——技术参数、行业资质、项目案例才是AI推荐的核心素材。本文从B2B行业理解深度、结构化内容能力、合规安全保障三个维度,对比泓动数据、百分点科技、赛诺贝斯、大树科技、Laver AI五家服务商在工业制造业…...

从RTL代码到SDC约束:手把手教你为PLL/DCM生成的时钟写对时序约束

从RTL代码到SDC约束:手把手教你为PLL/DCM生成的时钟写对时序约束 在数字芯片设计流程中,时钟约束的正确性直接影响着时序收敛的效率和质量。很多工程师能够熟练编写RTL代码,却在转换为SDC约束时遇到困惑——特别是当设计中使用PLL、DCM或自定…...

OAuth 2.0 client_id深度解析:从规范到安全实践

1. 引言:一个字符串背后的身份体系 在 OAuth 2.0 的整个生态里,client_id 是出现频率最高却最容易被忽视的参数之一。它几乎出现在每一个授权请求的 URL 里,开发者往往只是将其视为"配置项",从 IdP 控制台粘贴过来填进…...

Boss-Key终极指南:一键隐藏窗口保护办公隐私的完整解决方案

Boss-Key终极指南:一键隐藏窗口保护办公隐私的完整解决方案 【免费下载链接】Boss-Key 老板来了?快用Boss-Key老板键一键隐藏静音当前窗口!上班摸鱼必备神器 项目地址: https://gitcode.com/gh_mirrors/bo/Boss-Key 你是否曾在办公室里…...

Python之anonymous包语法、参数和实际应用案例

一、包概述与核心功能 graphs-edjedovi是一个极简Python库(当前版本0.0.2),仅封装Dijkstra单源最短路径算法,专注于带权有向/无向图的最短路径计算,无可视化、拓扑排序等扩展能力。 核心能力:计算单个源节点…...

[具身智能-855]:什么是AI应用?AI 应用、AI 模型、AI Agent三者区别?

一、定义AI 应用:搭载人工智能技术,具备智能理解、推理、生成、识别、决策能力,能自主完成人类事务的软件、程序、系统、设备。二、狭义 AI 应用(纯 AI 工具,最常见)专门靠 AI 干活,一眼看出是 …...

如何用嘎嘎降AI处理金融学论文:金融学毕业论文降AI免费完整操作教程

如何用嘎嘎降AI处理金融学论文:金融学毕业论文降AI免费完整操作教程 这篇教程是针对金融学论文降AI教程写的——问得最多的操作细节,都在这里。 主工具:嘎嘎降AI(www.aigcleaner.com),4.8元一篇ÿ…...

AI Agent自主操作软件的“最后一公里”危机:当它成功调用API却误删生产数据库——12个真实事故根因与防御性沙箱配置模板

更多请点击: https://codechina.net 第一章:AI Agent自主操作软件的“最后一公里”危机本质 当AI Agent在模拟环境中流畅调用API、生成SQL、解析PDF时,它却在真实办公桌面前频频卡壳——点击错按钮、误判窗口焦点、无法处理弹窗验证码、对非…...

如何高效使用开源Spotify音乐下载工具:完整的实战操作指南

如何高效使用开源Spotify音乐下载工具:完整的实战操作指南 【免费下载链接】spotify-downloader Download your Spotify playlists and songs along with album art and metadata (from YouTube if a match is found). 项目地址: https://gitcode.com/gh_mirrors/…...