ccc-pytorch-基础操作(2)

文章目录

- 1.类型判断isinstance

- 2.Dimension实例

- 3.Tensor常用操作

- 4.索引和切片

- 5.Tensor维度变换

- 6.Broadcast自动扩展

- 7.合并与分割

- 8.基本运算

- 9.统计属性

- 10.高阶OP

1.类型判断isinstance

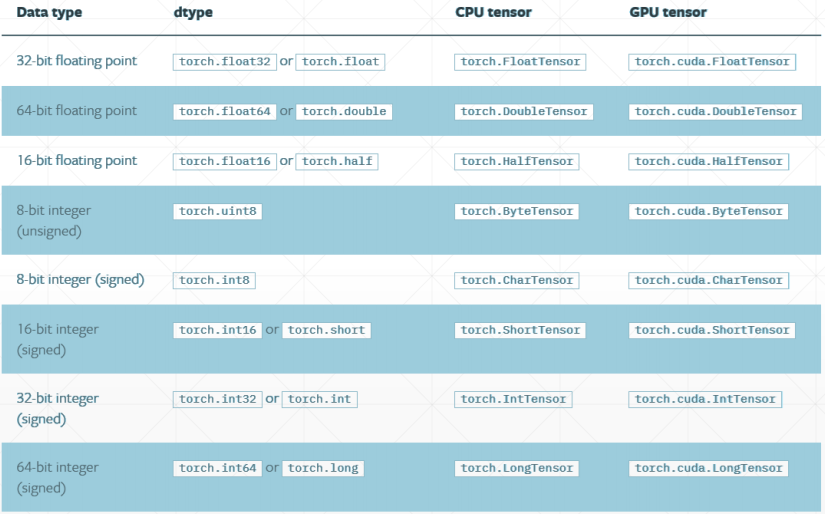

常见类型如下:

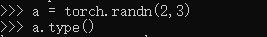

a = torch.randn(2,3)a.type()

data = torch.FloatTensor()

isinstance(data,torch.cuda.FloatTensor)

data = data.cuda()

isinstance(data,torch.cuda.FloatTensor)

2.Dimension实例

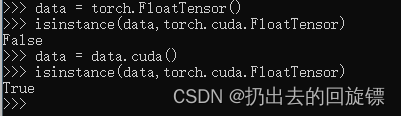

Dim0:Loss

torch.tensor(1.0)

torch.tensor(1.3)

a=torch.tensor(2.2)

a.shape

a.size()

Dim1:bias,linear input

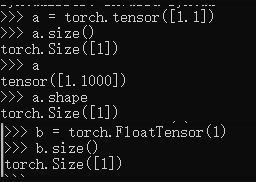

a = torch.tensor([1.1])

a.size()

a

a.shape

b = torch.FloatTensor(1)

b.size()

Dim2:linear input batch

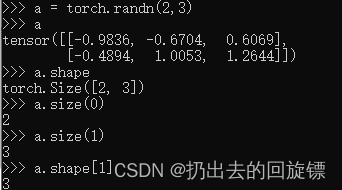

a = torch.randn(2,3)aa.shapea.size(0)a.size(1)a.shape[1]

Dim3:RNN input batch

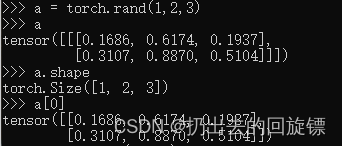

a = toch.rand(1,2,3)

a

a.shape

a[0]

Dim4:图像输入[b, c, h, w]

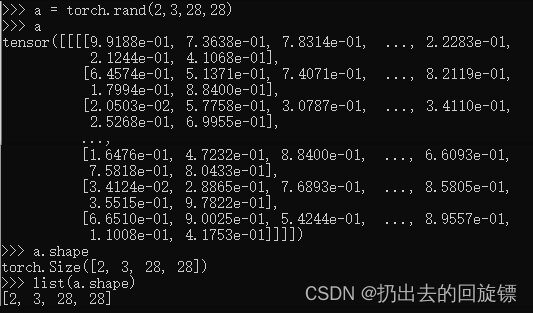

a = torch.rand(2,3,28,28)

a

a.shape

list(a.shape)

Mixed:

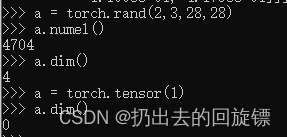

a = torch.rand(2,3,28,28)

a.numel()

a.dim()

a = torch.tensor(1)

a.dim()

3.Tensor常用操作

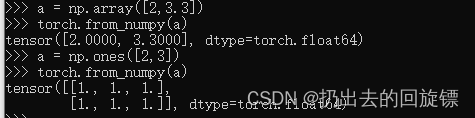

Import from numpy

a = np.array([2,3.3])

torch.from_numpy(a)

a = np.ones([2,3])

torch.from_numpy(a)

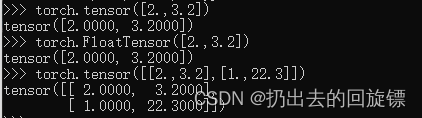

Import from List

torch.tensor([2.,3.2])

torch.FloatTensor([2.,3.2])#不推荐

torch.tensor([[2.,3.2],[1.,22.3]])

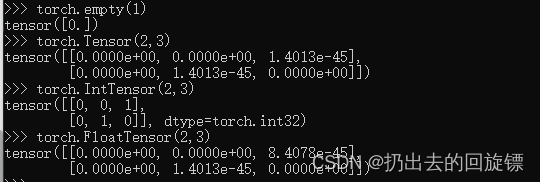

uninitialized

torch.empty(1)

torch.Tensor(2,3)

torch.IntTensor(2,3)

torch.FloatTensor(2,3)

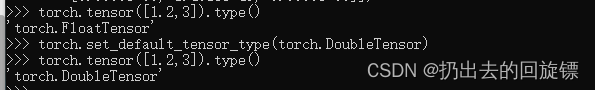

set default type

torch.tensor([1.2,3]).type()

torch.set_default_tensor_type(torch.DoubleTensor)

torch.tensor([1.2,3]).type()

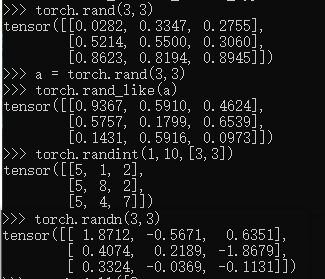

rand/rand_like, randint,randn

torch.rand(3,3)#[0, 1]

a = torch.rand(3,3)

torch.rand_like(a)

torch.randint(1,10,[3,3])#[min, max)

torch.randn(3,3)#N(0,1)

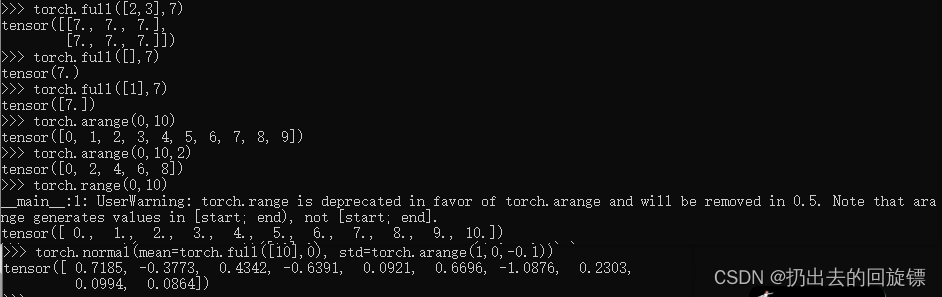

full&arange/range

torch.full([2,3],7)

torch.full([],7)

torch.full([1],7)

torch.arange(0,10)

torch.arange(0,10,2)

torch.range(0,10)#不建议

torch.normal(mean=torch.full([10],0), std=torch.arange(1,0,-0.1))#N(mean,std)

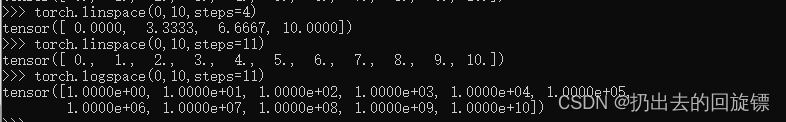

linspace/logspace

torch.linspace(0,10,steps=4)

torch.linspace(0,10,steps=11)

torch.logspace(0,10,steps=4)

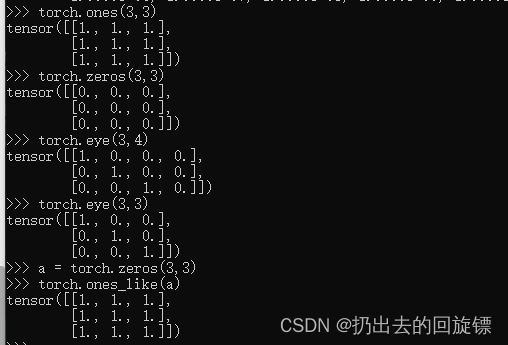

Ones/zeros/eye

torch.ones(3,3)

torch.zeros(3,3)

torch.eys(3,4)

torch.eys(3,3)

#常用快捷操作

a = torch.zeros(3,3)

torch.ones_like(a)

randperm

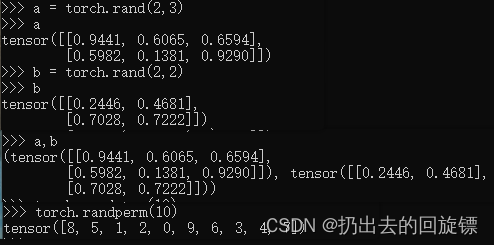

a = torch.rand(2,3)

a

b = torch.rand(2,2)

b

a,b

torch.randperm(10)

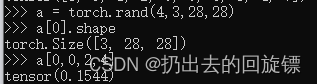

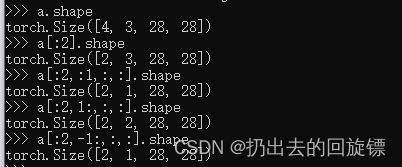

4.索引和切片

Indexing:dim0 优先

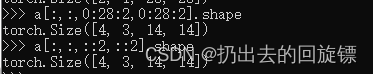

a = torch.rand(4,3,28,28)

a[0].shape

a[0,0,2,4]#取值

select first/last N

a[:2].shape#第一维[0,2)

a[:2,:1,:,:].shape#第一维[0,2),第二维[0,1)

a[:2,1:,:,:].shape#第一维[0,2),第二维[1,_]

a[:2,-1:,:,:].shape#第一维[0,2),第二维(1,_]

select by steps

a[:,:,0:28:2,0:28:2].shape

a[:,:,::2,::2].shape

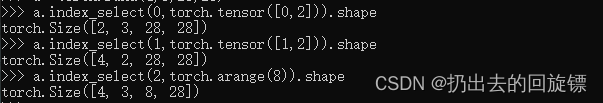

select by specific index

a.index_select(0,torch.tensor([0,2])).shape

a.index_select(1,torch.tensor([1,2]).shape

a.index_select(2,torch.arange(8)).shape

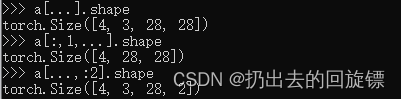

…:表全部

a[...].shape

a[:,1,...].shape

a[...,:2].shape

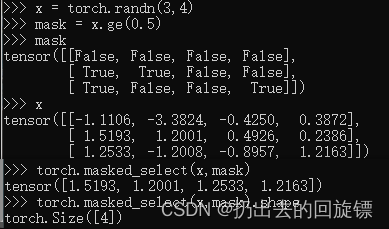

select by mask

x = torch.randn(3,4)

mask = x.ge(0.5)

mask

x

torch.masked_select(x,mask)

torch.masked_select(x,mask).shape

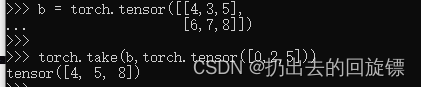

select by flatten index

b = torch.tensor([[4,3,5],[6,7,8]])

torch.take(b,torch.tensor([0,2,5]))#返回展开后的索引

5.Tensor维度变换

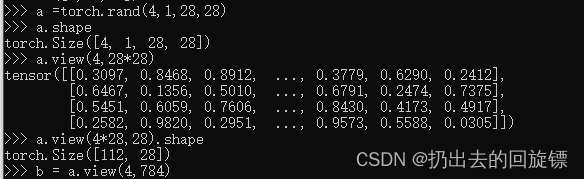

View reshape

a = torch.rand(4,1,28,28)

a.shape

a.view(4,28*28)

a.view(4*28,28).shape

b = a.view(4,784)#不推荐,合并尽量写成连乘帮助记忆原数据各维度作用

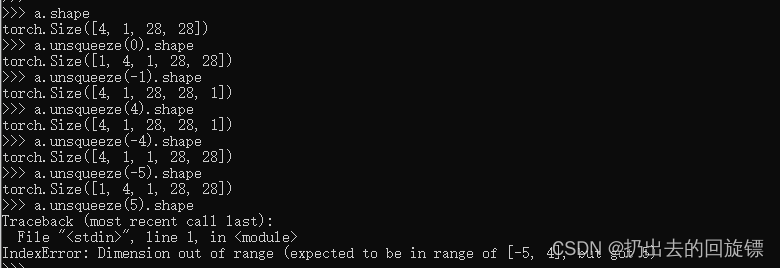

Squeeze v.s. unsqueeze

a.shpae

a.unsqueeze(0).shape#第一个空位

a.unsqueeze(-1).shape#最后一个空位

a.unsqueeze(4).shape#第五个空位

a.unsqueeze(-4).shape#倒数第4个空位

a.unsqueeze(-5).shape#导数第5个空位

a.unsqueeze(5).shape#第6个空位,没有

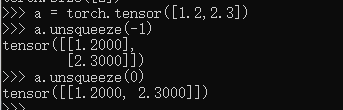

a = torch.tensor([1.2,2.3])

a.unsqueeze(-1)

a.unsqueeze(0)

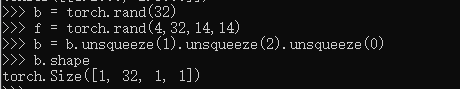

b = torch.rand(32)

f = torch.rand(4,32,14,14)

b = b.unsqueeze(1).unsqueeze(2).unsqueeze(0)#每次处理后重新排序

b.shape

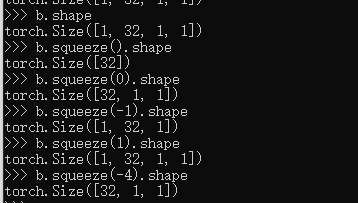

b.squeeze().shape#压缩所有为1

b.squeeze(0).shape

b.squeeze(-1).shape

b.squeeze(1).shape#不是1,所以不变

b.squeeze(-4).shape#导数第四个

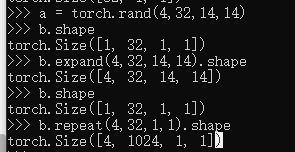

Expand ( broadcasting)/ repeat(memory copied)

a = torch.rand(4,32,14,14)

b.shape

b.expand(4,32,14,14).shape

b.repeat(4,32,1,1).shape

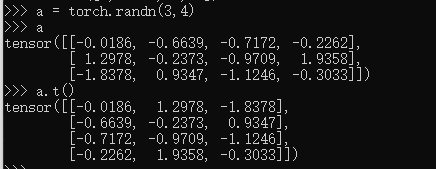

.t:转置

a = torch.randn(3,4)

a

a.t()#注意高维转置不了

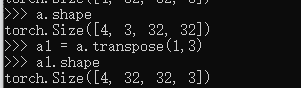

Transpose

a.shape

a1 = a.transpose(1,3)#交换次序

a1.shape

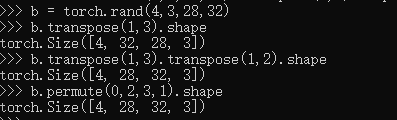

permute

b = torch.rand(4,3,28,32)

b.transpose(1,3).shape

b.transpose(1,3).transpose(1,2).shape

b.permute(0,2,3,1).shape#按索引排列

6.Broadcast自动扩展

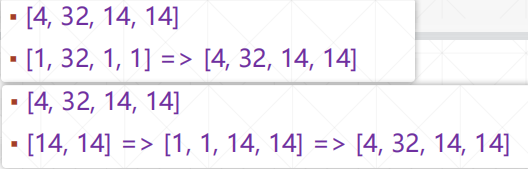

broadcast是不同size的tensor进行加减时自动进行的机制,其主要思想以及特点如下:

- 从最右边的维度开始匹配,前面维度缺失的补1直到维度相同

- 从最右边的维度开始匹配,维度不等但有一个是1则扩展到相同的值,实例如下:

- 节约内存,核心是利用expand,只进行逻辑上的扩展而不会实际拷贝

7.合并与分割

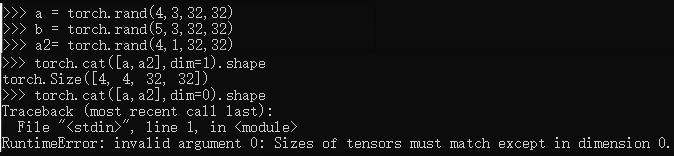

Cat

a = torch.rand(4,3,32,32)

b = torch.rand(5,3,32,32)

a2= torch.rand(4,1,32,32)

torch.cat([a,a2],dim=1).shape

torch.cat([a,a2],dim=0).shape#Error,多个维度不同

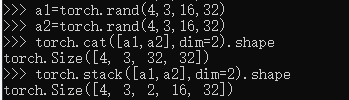

stack

a1=torch.rand(4,3,16,32)

a2=torch.rand(4,3,16,32)

torch.cat([a1,a2],dim=2).shape

torch.stack([a1,a2],dim=2).shape

Cat与stack的区别:前者是合并dim,后者是增加dim;后者要求所有一摸一样

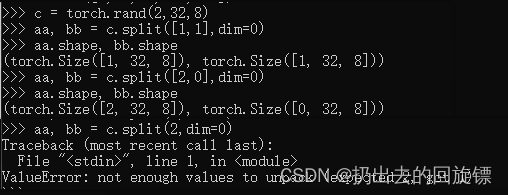

Split: by len

c = torch.rand(2,32,8)

aa, bb = c.split([1,1],dim=0)

aa.shape, bb.shape

aa, bb = c.split([2,0],dim=0)

aa.shape, bb.shape

aa, bb = c.split(1,dim=0)

aa.shape, bb.shape

aa, bb = c.split(2,dim=0)

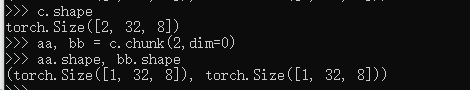

Chunk: by num

c.shape

aa, bb = c.chunk(2,dim=0)

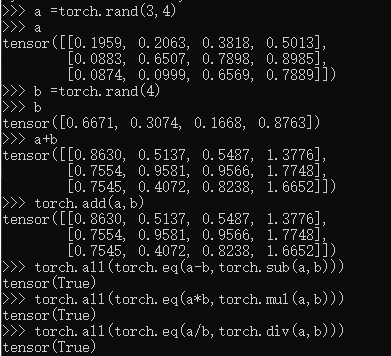

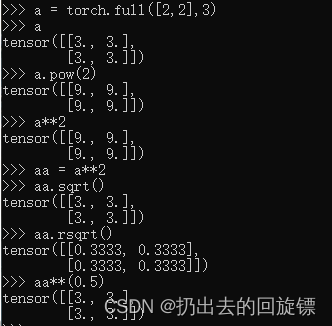

8.基本运算

basic

a =torch.rand(3,4)

a

b =torch.rand(4)

b

a+b

torch.add(a,b)

torch.all(torch.eq(a-b,torch.sub(a,b)))

torch.all(torch.eq(a*b,torch.mul(a,b)))

torch.all(torch.eq(a/b,torch.div(a,b)))

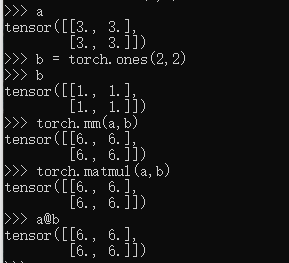

matmul

a

b = torch.ones(2,2)

b

torch.mm(a,b)#only for 2dim

torch.matmul(a,b)

a@b

a = torch.rand(4,784)

x = torch.rand(4,784)

w = torch.rand(512,784)

(x@w.t()).shape

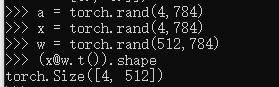

>2d tensor matmul?

a =torch.rand(4,3,28,64)

b =torch.rand(4,3,64,32)

torch.mm(a,b).shape#用不了2D以上

torch.matmul(a,b).shape#只计算最后两维

b = torch.rand(4,1,64,32)

torch.matmul(a,b).shape#触发Broadcast机制

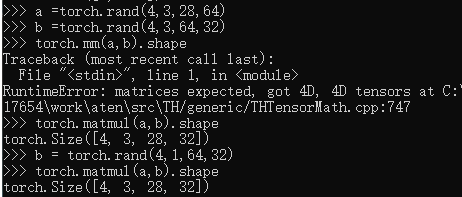

Power

a = torch.full([2,2],3)

a.pow(2)

a**2

aa = a**2

aa.sqrt()

aa.rsqrt()#平方根的倒数

aa**(0.5)

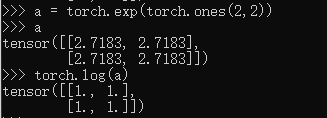

Exp log

a = torch.exp(torch.ones(2,2))

a

torch.log(a)

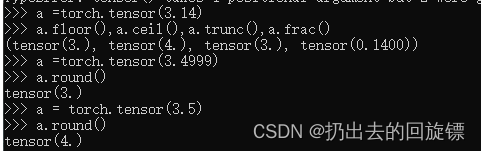

Approximation

a =torch.tensor(3.14)

a.floor(),a.ceil(),a.trunc(),a.frac()#分别是向下取整,向上取整,整数部分,小数部分

a =torch.tensor(3.4999)

a.round()#4舍5入

a = torch.tensor(3.5)

a.round()

clamp

grad = torch.rand(2,3)*15

grad

grad.max()

grad.median()

grad.clamp(10)

grad.clamp(0,10)

简单解释一下:

torch.clamp(input, min=None, max=None, *, out=None)

限定一个范围,input tensor中数值低于min的返回min,高于max的返回max

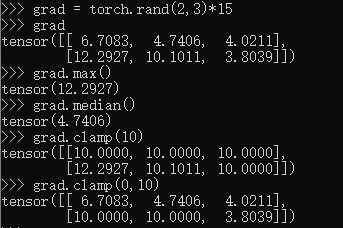

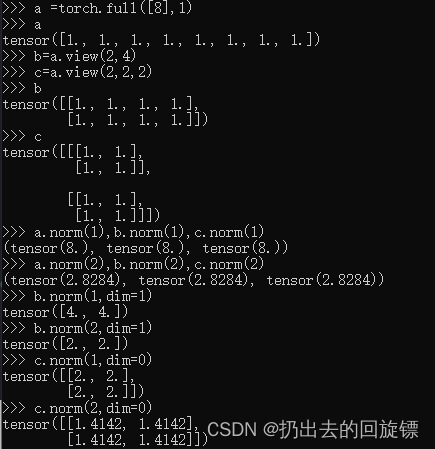

9.统计属性

norm1&norm2

a =torch.full([8],1)

a

b=a.view(2,4)

c=a.view(2,2,2)

b

c

a.norm(1),b.norm(1),c.norm(1)#1范数,绝对值之和

a.norm(2),b.norm(2),c.norm(2)#2范数,欧几里得范数,平方和再开方

b.norm(1,dim=1)

b.norm(2,dim=1)

c.norm(1,dim=0)

c.norm(2,dim=0)

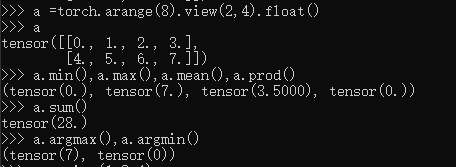

mean, sum, min, max, prod,argmin, argmax

a =torch.arange(8).view(2,4).float()

a

a.min(),a.max(),a.mean(),a.prod()

a.sum()

a.argmax(),a.argmin()#返回索引位置

a=torch.rand(2,3,4)

a

a.argmax()

a=torch.randn(4,10)

a

a.argmax()

a.argmax(dim=1)#相应维度上索引

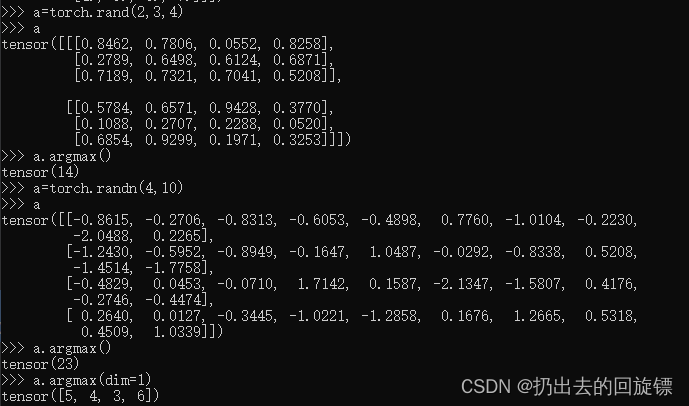

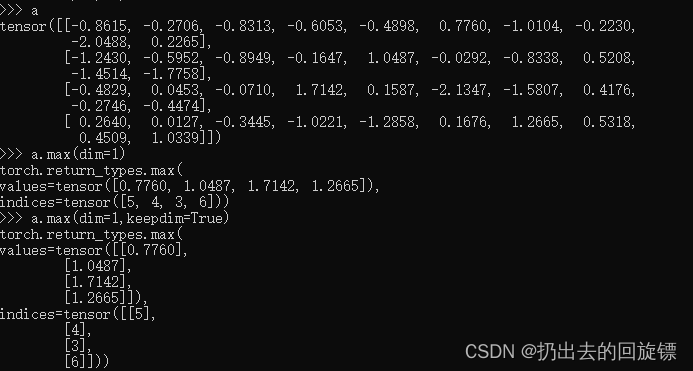

dim, keepdim

a

a.max(dim=1)

a.max(dim=1,keepdim=True)#保持输出的维度

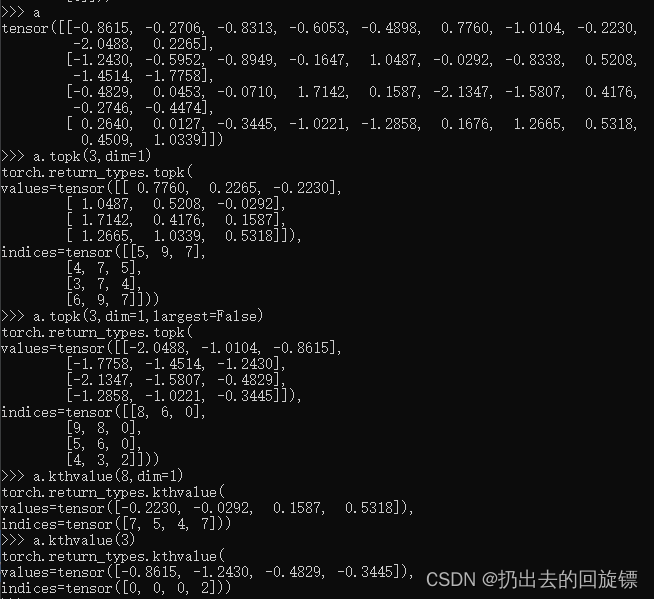

Top-k or k-th

a

a.topk(3,dim=1)

a.topk(3,dim=1,largest=False)#1维最小的前3个

a.kthvalue(8,dim=1)

a.kthvalue(3)#默认选择最后一个维度

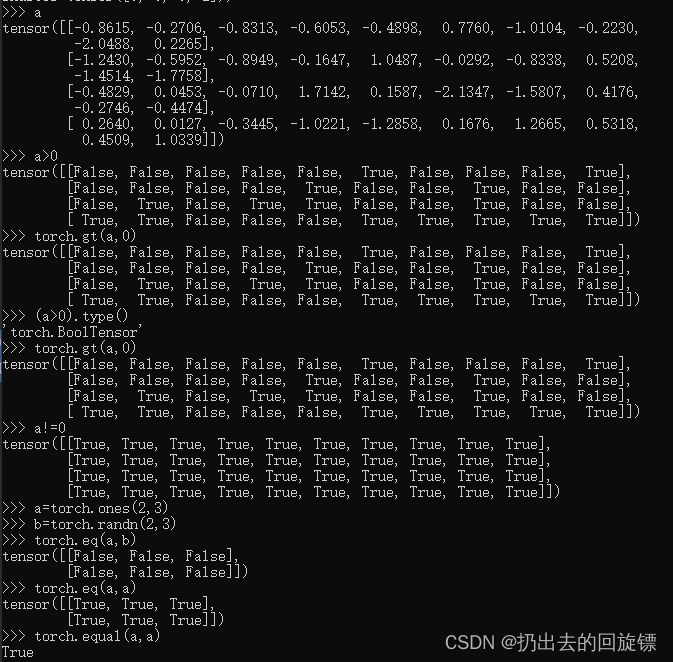

compare

a

a>0

torch.gt(a,0)

(a>0).type()

torch.gt(a,0)

a!=0

a=torch.ones(2,3)

b=torch.randn(2,3)

torch.eq(a,b)

torch.eq(a,a)#逐元素比较

torch.equal(a,a)# 张量比较

10.高阶OP

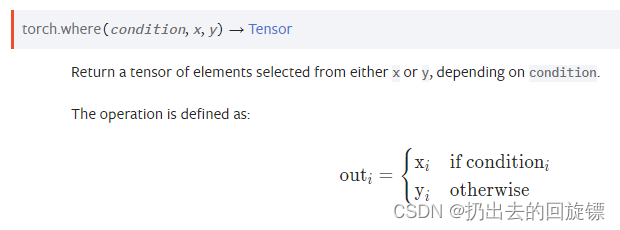

Where

condition成立则填充x否则填充y

cond = torch.rand(2,2)

cond

a =torch.zeros(2,2)

b =torch.ones(2,2)

a,b

torch.where(cond>0.5,a,b)

torch.where(cond<0.5,a,b)

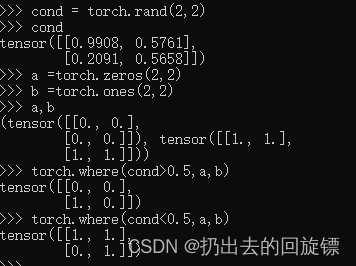

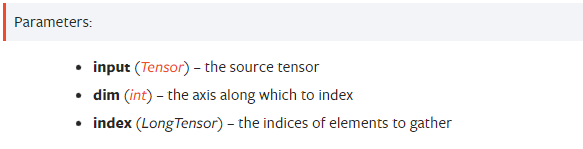

gather

- 输入input和索引index不会Broadcast

- output形状与index相同

- 索引与dim方向相同

- index.size(dim)<=input.size(dim),保证有元素可取

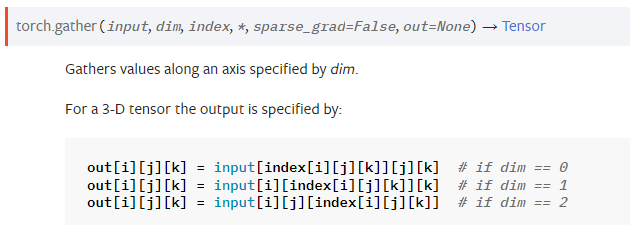

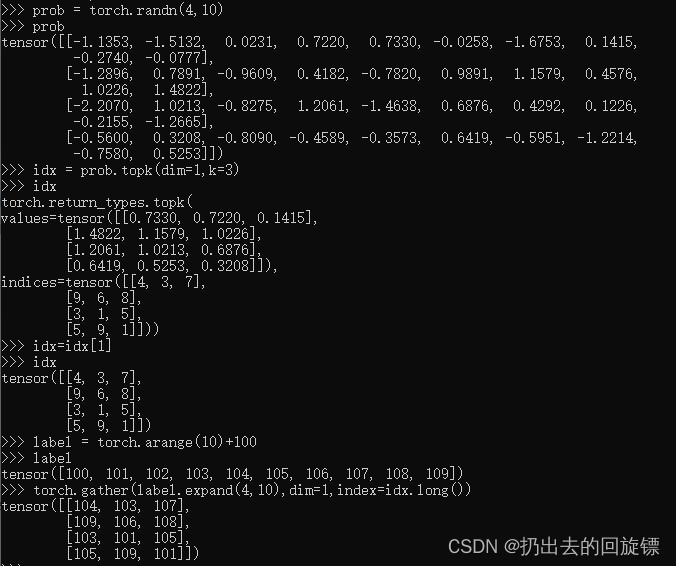

prob = torch.randn(4,10)

prob

idx = prob.topk(dim=1,k=3)

idx

idx=idx[1]

idx

label = torch.arange(10)+100

label

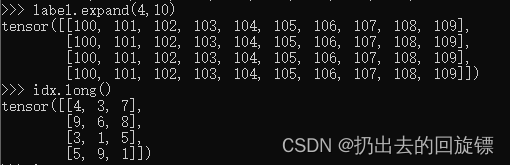

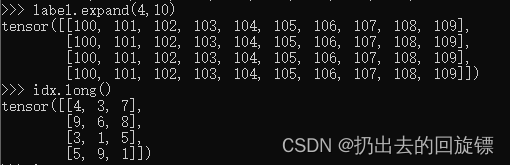

torch.gather(label.expand(4,10),dim=1,index=idx.long())

#其中有

label.expand(4,10)

idx.long()

相关文章:

ccc-pytorch-基础操作(2)

文章目录1.类型判断isinstance2.Dimension实例3.Tensor常用操作4.索引和切片5.Tensor维度变换6.Broadcast自动扩展7.合并与分割8.基本运算9.统计属性10.高阶OP大伙都这么聪明,注释就只写最关键的咯1.类型判断isinstance 常见类型如下: a torch.randn(…...

独居老人一键式报警器

盾王居家养老一键式报警系统,居家养老一键式报警设备 ,一键通紧急呼救设备,一键通紧急呼救系统,一键通紧急呼救器 ,一键通紧急呼救终端,一键通紧急呼救主机终端产品简介: 老人呼叫系统主要应用于…...

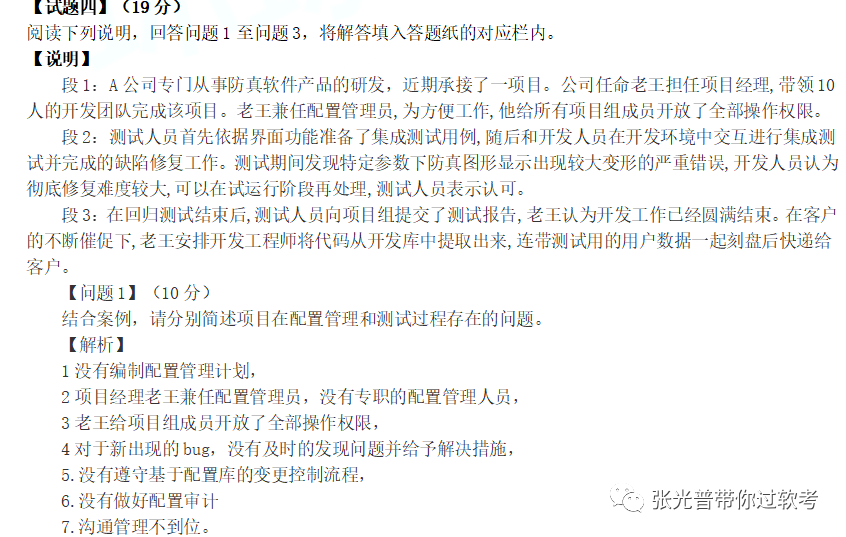

软考案例分析题精选

试题一:阅读下列说明,回答问题1至问题4,将解答填入答题纸的对应栏内。某公司中标了一个软件开发项目,项目经理根据以往的经验估算了开发过程中各项任务需要的工期及预算成本,如下表所示:任务紧前任务工期PV…...

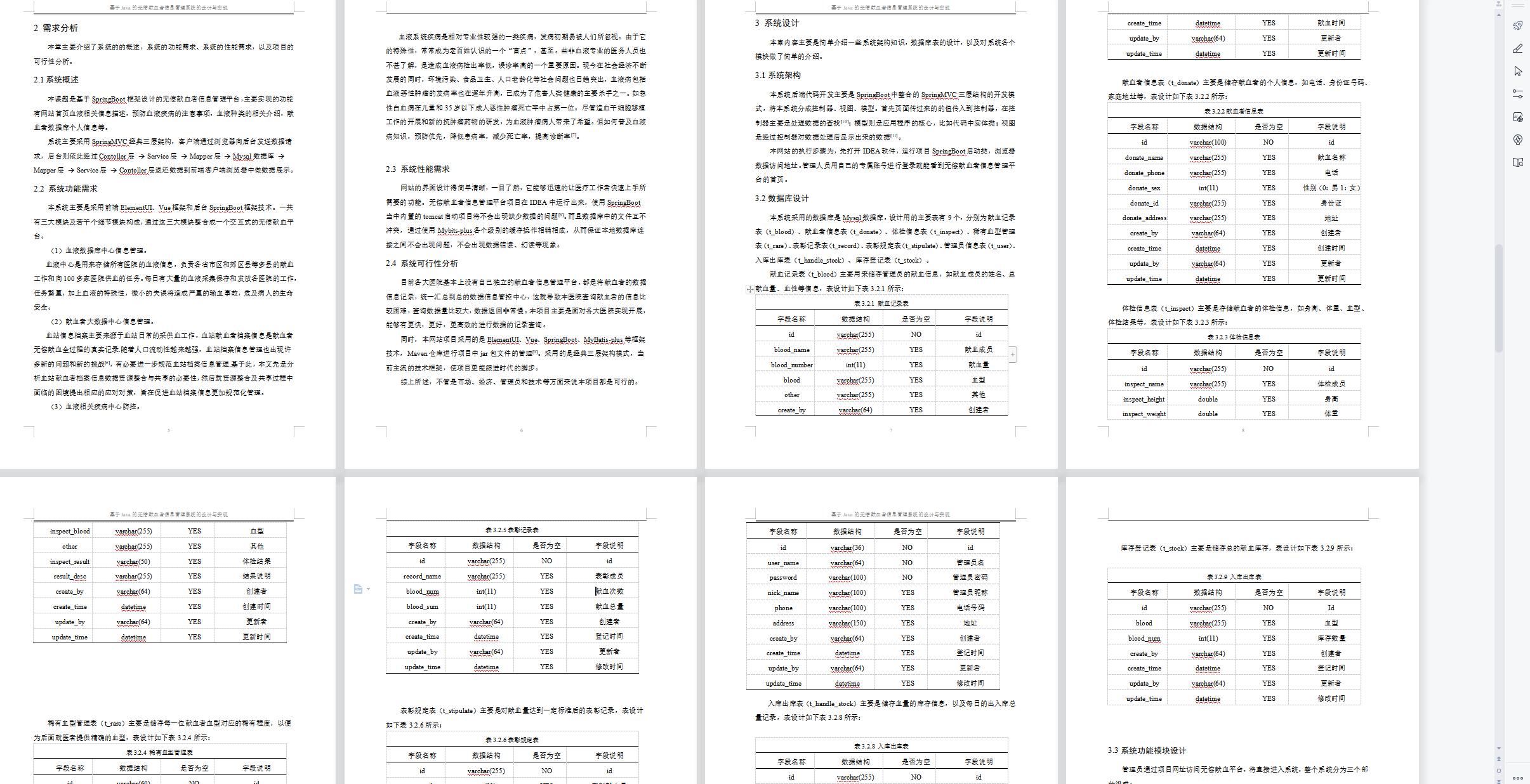

基于SpringBoot+vue的无偿献血后台管理系统

基于SpringBootvue的无偿献血后台管理系统 ✌全网粉丝20W,csdn特邀作者、博客专家、CSDN新星计划导师、java领域优质创作者,博客之星、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和毕业项目实战✌ 🍅文末获取项目下载方式🍅 一、项目背…...

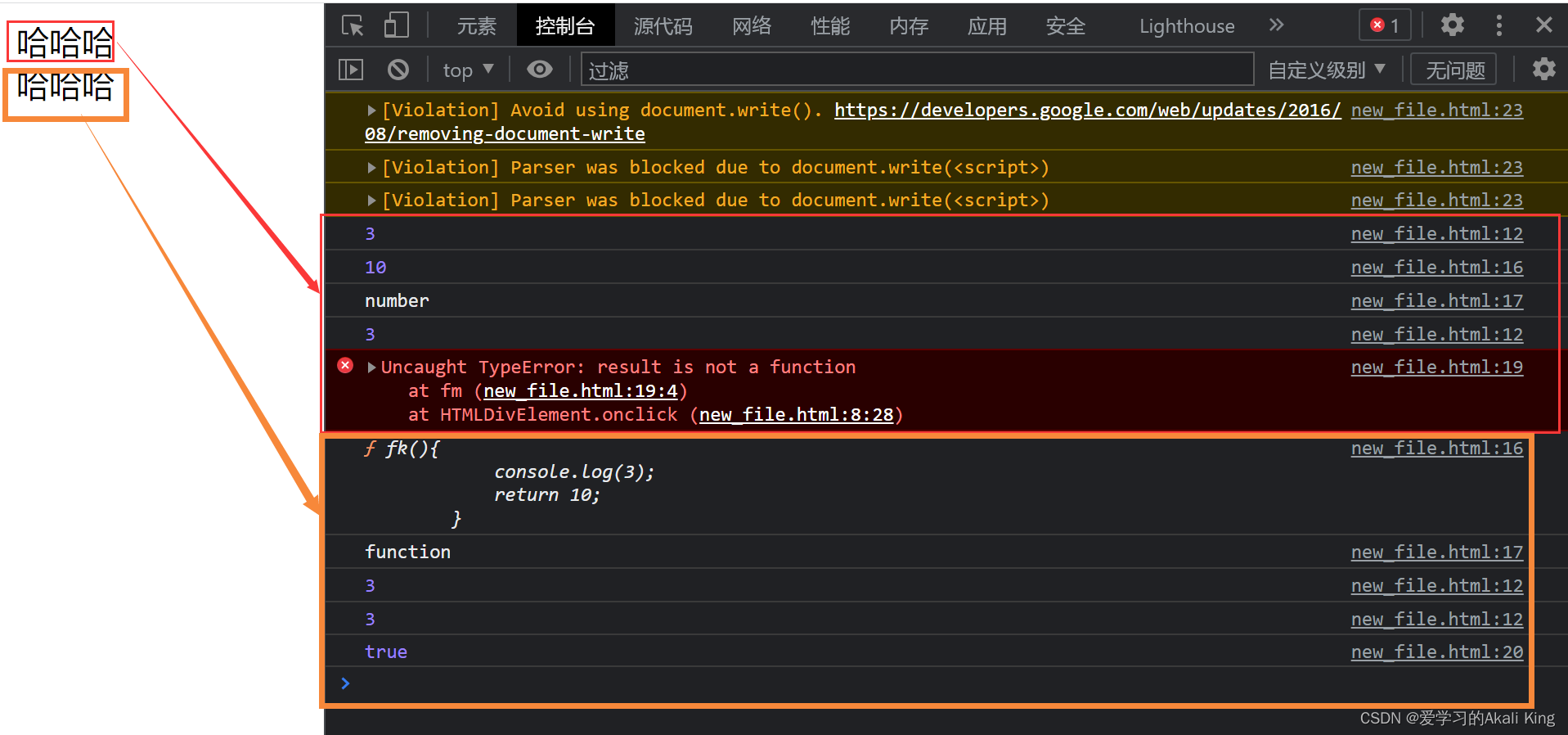

详解js在事件中,如何传递复杂数据类型(数组,对象,函数)

文章目录 前言一、何谓预编译,变量提升?二、复杂数据类型的传递 1.数组2.对象3.函数总结前言 在JavaScript这门编程语言学习中,如何传参,什么是变量提升,js代码预编译等等。要想成为一名优秀的js高手,这些内…...

高并发架构 第一章大型网站数据演化——核心解释与说明。大型网站技术架构——核心原理与案例分析

大型网站架构烟花发展历程1.1.1初始阶段的网站构架1.1.2应用服务和数据服务分离1.1.3使用缓存改善网络性能1.1.4使用应用服务器集群改善网站的并发处理能力1.1.5数据库读写分离1.1.6使用反向代理和cdn加速网站相应1.1.1初始阶段的网站构架 大型网站都是由小型网站一步步发展而…...

VPP接口INPUT节点运行数据

在设置virtio接口接收/发送队列函数的最后,更新接口的运行数据。 void virtio_vring_set_rx_queues (vlib_main_t *vm, virtio_if_t *vif) { ...vnet_hw_if_update_runtime_data (vnm, vif->hw_if_index); } void virtio_vring_set_tx_queues (vlib_main_t *vm,…...

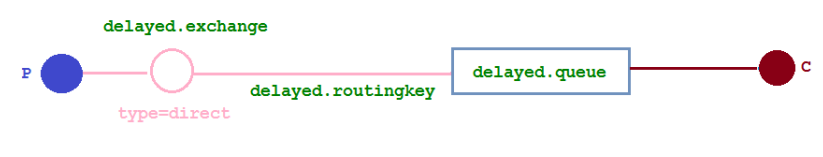

RabbitMQ学习(九):延迟队列

一、延迟队列概念延时队列中,队列内部是有序的,最重要的特性就体现在它的延时属性上,延时队列中的元素是希望 在指定时间到了以后或之前取出和处理。简单来说,延时队列就是用来存放需要在指定时间内被处理的 元素的队列。其实延迟…...

TCP并发服务器(多进程与多线程)

欢迎关注博主 Mindtechnist 或加入【Linux C/C/Python社区】一起探讨和分享Linux C/C/Python/Shell编程、机器人技术、机器学习、机器视觉、嵌入式AI相关领域的知识和技术。 TCP并发服务器(多进程与多线程)1. 多进程并发服务器(1)…...

第1章 Memcached 教程

Memcached是一个自由开源的,高性能,分布式内存对象缓存系统。 Memcached是以LiveJournal旗下Danga Interactive公司的Brad Fitzpatric为首开发的一款软件。现在已成为mixi、hatena、Facebook、Vox、LiveJournal等众多服务中提高Web应用扩展性的重要因素…...

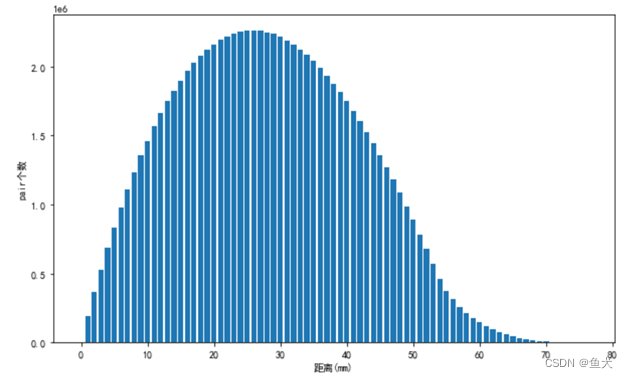

【2022.12.9】Lammps+Python 在计算g6(r)时遇到的问题

目录写在前面绘制g6( r )执行步骤【updated】如何检查图像的正确性:不是编程问题,而是数学问题的一个小bug废稿2则:写在前面 全部log: 【2022.11.16】LammpsPythonMATLAB在绘制维诺图时遇到的问题 绘制g6( r )执行步骤【updated…...

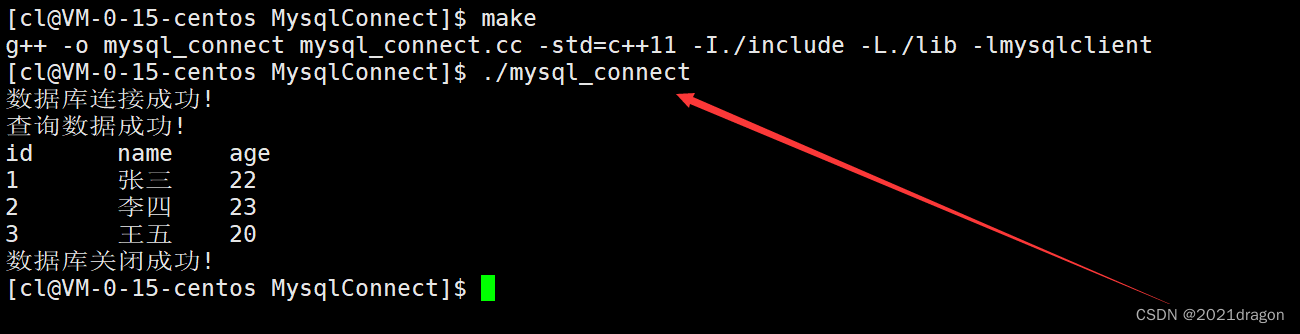

MySQL使用C语言连接

文章目录MySQL使用C语言连接引入库下载库文件在项目中使用库使用库连接数据库下发SQL请求获取查询结果MySQL使用C语言连接 引入库 要使用C语言连接MySQL,需要使用MySQL官网提供的库。 下载库文件 下载库文件 首先,进入MySQL官网,选择DEVEL…...

JavaScript随手笔记---比较两个数组差异

💌 所属专栏:【JavaScript随手笔记】 😀 作 者:我是夜阑的狗🐶 🚀 个人简介:一个正在努力学技术的CV工程师,专注基础和实战分享 ,欢迎咨询! &#…...

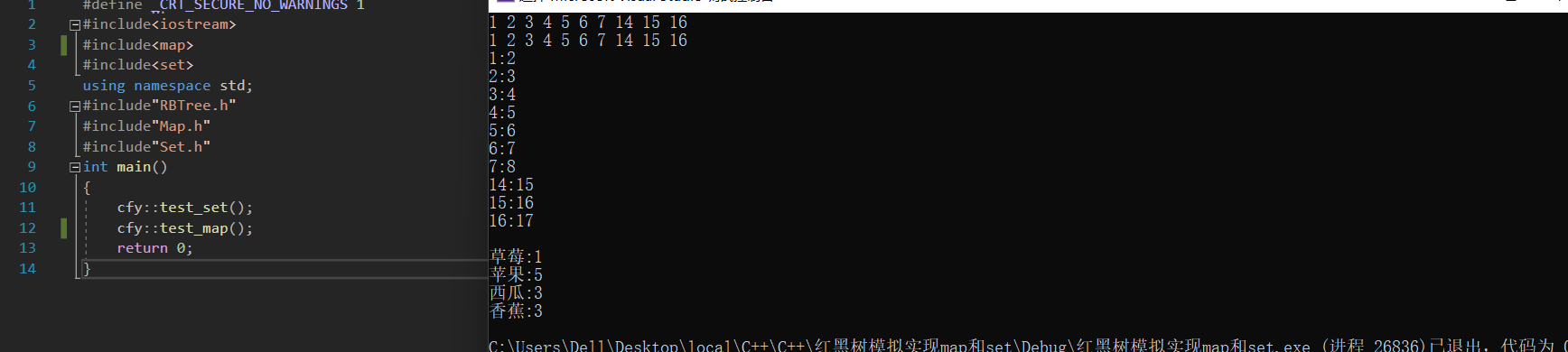

【C++修炼之路】21.红黑树封装map和set

每一个不曾起舞的日子都是对生命的辜负 红黑树封装map和set前言一.改良红黑树的数据域结构1.1 改良后的结点1.2 改良后的类二. 封装的set和map2.1 set.h2.2 map.h三. 迭代器3.1 迭代器封装3.2 const迭代器四.完整代码实现4.1 RBTree.h4.2 set.h4.3 map.h4.4 Test.cpp前言 上一节…...

下载ojdbc14.jar的10.2.0.1.0版本的包

一、首先要有ojdbc14.jar包 没有的可以去下载一个,我的是从这里下载的ojdbc14.jar下载_ojdbc14.jar最新版下载[驱动包软件]-下载之家, 就是无奈关注了一个公众号,有的就不用下了。 二、找到maven的本地仓库的地址 我的地址在这里D:\apach…...

关于欧拉角你需要知道几个点

基础理解,参照:https://www.cnblogs.com/Estranged-Tech/p/16903025.html 欧拉角、万向节死锁(锁死)理解 一、欧拉角理解 举例讲解 欧拉角用三次独立的绕确定的轴旋转角度来表示姿态。如下图所示 经过三次旋转,旋…...

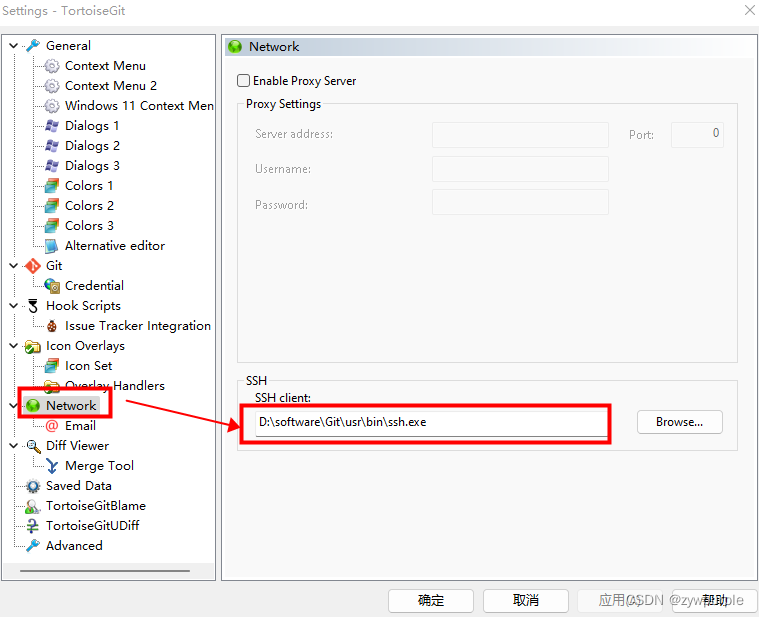

git ssh配置

ssh配置 执行以下命令进行配置 git config --global user.name “这里换上你的用户名” git config --global user.email “这里换上你的邮箱” 执行以下命令生成秘钥: ssh-keygen -t rsa -C “这里换上你的邮箱” 执行命令后需要进行3次或4次确认。直接全部回车就…...

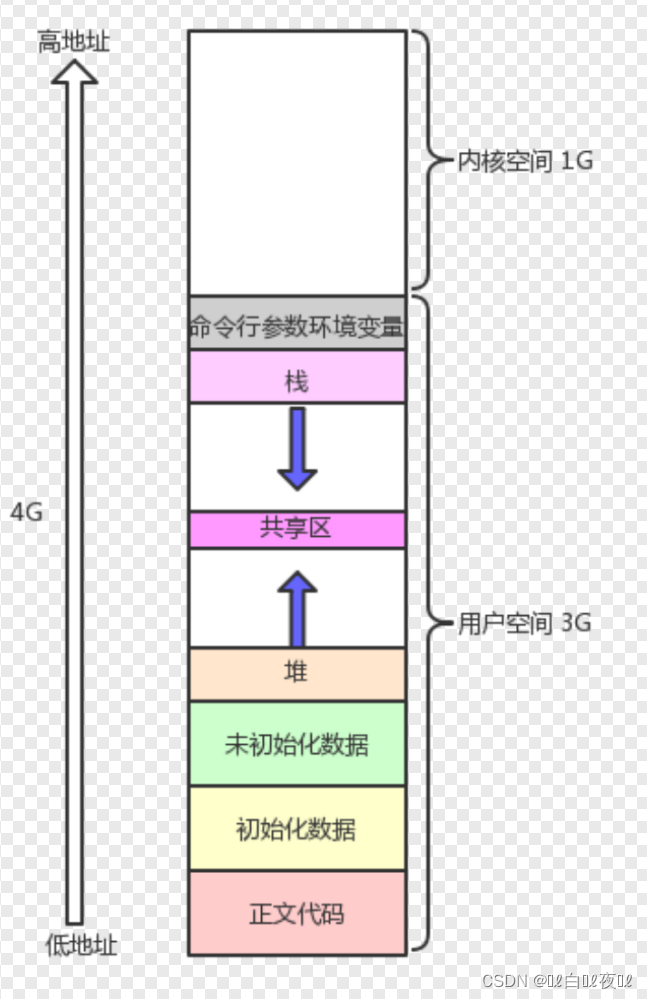

Linux进程概念(三)

环境变量与进程地址空间环境变量什么是环境变量常见环境变量环境变量相关命令环境变量的全局属性PWDmain函数的三个参数进程地址空间什么是进程地址空间进程地址空间,页表,内存的关系为什么存在进程地址空间环境变量 什么是环境变量 我们所有写的程序都…...

新手福利——x64逆向基础

一、x64程序的内存和通用寄存器 随着游戏行业的发展,x32位的程序已经很难满足一些新兴游戏的需求了,因为32位内存的最大值为0xFFFFFFFF,这个值看似足够,但是当游戏对资源需求非常大,那么真正可以分配的内存就显得捉襟…...

)

虚幻c++中的细节之枚举类型(enum)

文章目录前言一、原生c的枚举类型关键字classint8 - 枚举的基础类型(underlying type)二、枚举类型的灵活运用位运算枚举循环遍历三、虚幻风格的枚举类型UENUMUMETATEnumAsByte总结前言 虚幻引擎中的代码部分实现了一套反射机制,为c代码带了…...

SR8201F以太网PHY断连问题排查:从电源到MDIO时序的实战记录

SR8201F以太网PHY断连问题深度排查:从硬件设计到时序优化的完整解决方案 1. 问题现象与初步分析 最近在调试基于SR8201F的以太网接口时,遇到了一个棘手的问题:设备在冷启动约75分钟后首次出现断连,随后断连频率逐渐增加。这种周期…...

工作流自动化革命:用KeymouseGo解放重复操作困境

工作流自动化革命:用KeymouseGo解放重复操作困境 【免费下载链接】KeymouseGo 类似按键精灵的鼠标键盘录制和自动化操作 模拟点击和键入 | automate mouse clicks and keyboard input 项目地址: https://gitcode.com/gh_mirrors/ke/KeymouseGo 你是否每天重复…...

C#的LINQ查询表达式编译原理与性能优化

C#的LINQ查询表达式编译原理与性能优化 LINQ(Language Integrated Query)是C#中强大的数据查询工具,它将查询能力直接集成到语言中,使开发者能够以声明式方式操作数据。理解其编译原理与性能优化技巧,对于编写高效代码…...

C++的std--ranges适配器视图迭代器有效性保证与悬垂引用检测

C20引入的std::ranges库彻底改变了序列操作的范式,其中适配器视图(如filter、transform)通过惰性求值实现了高效的管道式编程。这种延迟执行特性也带来了迭代器有效性风险——视图可能持有悬垂引用或失效迭代器,导致未定义行为。本…...

OOMMF实战避坑指南:从编译报错到高级功能解析

1. OOMMF编译安装常见问题解析 第一次接触OOMMF的开发者,90%的时间都花在了环境配置和编译上。作为一个用C和Tcl混合编写的开源软件,OOMMF的编译过程确实存在不少"坑"。最常见的就是双击oommf.tcl后弹出的各种报错窗口——这往往意味着你需要…...

与 wait():从基础到监视器队列)

深入理解 sleep() 与 wait():从基础到监视器队列

前言看似都是“让线程停下来”,背后的原理却完全不同在 Java 并发编程中,sleep() 和 wait() 是两个经常被拿来比较的方法。很多初学者甚至有一定经验的开发者,也容易混淆它们。今天这篇文章,我们就从基础区别一路深入到监视器锁的…...

CenterPoint实战:基于热力图的3D目标检测与跟踪全解析

1. CenterPoint算法核心思想解析 第一次接触CenterPoint时,最让我惊讶的是它的简洁性。传统3D目标检测就像在游乐场玩"套圈"游戏——需要准备各种尺寸的圆圈(锚框)去匹配不同形状的奖品(物体),而…...

国内网站 SEO 推广需要多长时间见效

国内网站 SEO 推广需要多长时间见效 在当今互联网时代,搜索引擎优化(SEO)已经成为提升国内网站流量和品牌知名度的关键手段。很多人都会问,国内网站 SEO 推广需要多长时间才能见效?答案并不简单,因为这涉及…...

实现原理与生产应用)

AI Agent 时代的分布式闭源众创 AI Coding 云编程平台 (CSCD) 实现原理与生产应用

AI Agent 时代的分布式闭源众创 AI Coding 云编程平台 (CSCD) 实现原理与生产应用 文章目录 AI Agent 时代的分布式闭源众创 AI Coding 云编程平台 (CSCD) 实现原理与生产应用 第 1 章 AI Agent 时代与 CSCD 平台概述 1.1 AI Agent 时代的到来 1.1.1 从传统编程到 AI 辅助编程的…...

3步搞定小红书内容采集:XHS-Downloader免费无水印下载终极指南

3步搞定小红书内容采集:XHS-Downloader免费无水印下载终极指南 【免费下载链接】XHS-Downloader 小红书(XiaoHongShu、RedNote)链接提取/作品采集工具:提取账号发布、收藏、点赞、专辑作品链接;提取搜索结果作品、用户…...