深度学习实战基础案例——卷积神经网络(CNN)基于Xception的猫狗识别|第2例

文章目录

- 一、环境准备

- 二、数据预处理

- 三、构建模型

- 四、实例化模型

- 五、训练模型

- 5.1 构建训练函数

- 5.2 构建测试函数

- 5.3 开始正式训练

- 六、可视化精度和损失

- 七、个体预测

- 总结

今天使用轻量级的一个网络Xception做一个简单的猫狗识别案例,我的环境具体如下:

- pytorch:2.0

- python:3.8

- jupyter notebook

一、环境准备

import torch

import torch.nn as nn

import torchvision.transforms as transforms

import torchvision

from torchvision import transforms, datasets

import os,PIL,pathlib,warningswarnings.filterwarnings("ignore") #忽略警告信息device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

device# 输出

device(type='cuda')

二、数据预处理

读取数据:

import os,PIL,random,pathlibdata_dir = 'dataset/'

data_dir = pathlib.Path(data_dir)data_paths = list(data_dir.glob('*'))

classeNames = [str(path).split("\\")[1] for path in data_paths]

classeNames# 输出

['cat', 'dog']

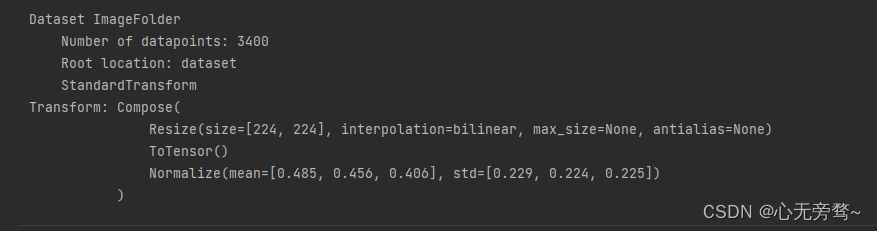

数据处理

# 关于transforms.Compose的更多介绍可以参考:https://blog.csdn.net/qq_38251616/article/details/124878863

train_transforms = transforms.Compose([transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸# transforms.RandomHorizontalFlip(), # 随机水平翻转transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛mean=[0.485, 0.456, 0.406],std=[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。

])test_transform = transforms.Compose([transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛mean=[0.485, 0.456, 0.406],std=[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。

])total_data = datasets.ImageFolder(data_dir,transform=train_transforms)

total_data

将数据集进行分类

total_data.class_to_idx# 输出

{'cat': 0, 'dog': 1}

划分数据集

train_size = int(0.8 * len(total_data))

test_size = len(total_data) - train_size

train_dataset, test_dataset = torch.utils.data.random_split(total_data, [train_size, test_size])

train_dataset, test_dataset

数据集加载

batch_size = 4train_dl = torch.utils.data.DataLoader(train_dataset,batch_size=batch_size,shuffle=True)

test_dl = torch.utils.data.DataLoader(test_dataset,batch_size=batch_size,shuffle=True)

查看数据集形状

for X, y in test_dl:print("Shape of X [N, C, H, W]: ", X.shape)print("Shape of y: ", y.shape, y.dtype)break

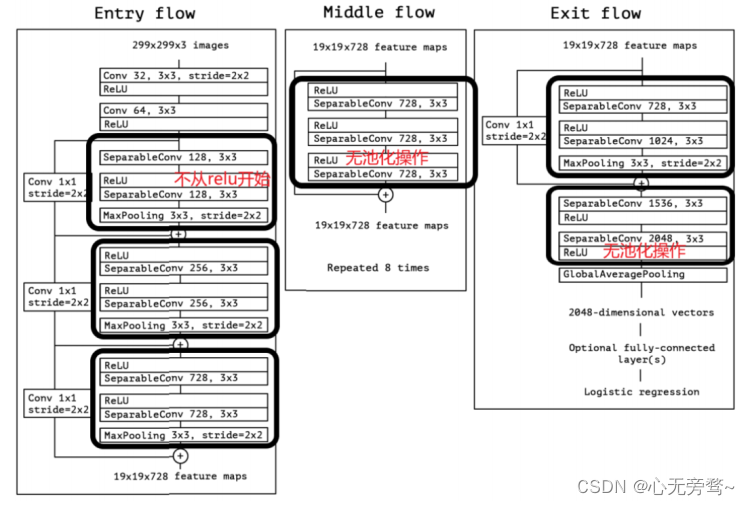

三、构建模型

Xception的具体网络结构如下所示:

import math

import torch.nn as nn

import torch.nn.functional as F

import torch.utils.model_zoo as model_zoo

from torch.nn import init

import torchclass SeparableConv2d(nn.Module):def __init__(self, in_channels, out_channels, kernel_size=1, stride=1, padding=0, dilation=1, bias=False):super(SeparableConv2d, self).__init__()self.conv1 = nn.Conv2d(in_channels, in_channels, kernel_size, stride, padding, dilation, groups=in_channels,bias=bias)self.pointwise = nn.Conv2d(in_channels, out_channels, 1, 1, 0, 1, 1, bias=bias)def forward(self, x):x = self.conv1(x)x = self.pointwise(x)return xclass Block(nn.Module):def __init__(self, in_filters, out_filters, reps, strides=1, start_with_relu=True, grow_first=True):# :parm reps:块重复次数super(Block, self).__init__()# Middle flow无需做这一步,而其余块需要,以做跳连# 1)Middle flow输入输出特征图个数始终一致,且Stride恒为1# 1)其余快stride=2,这样可以将特征图尺寸减半,获得与最大池化减半特征图尺寸同样的效果if out_filters != in_filters or strides != 1:self.skip = nn.Conv2d(in_filters, out_filters, 1, stride=strides, bias=False)self.skipbn = nn.BatchNorm2d(out_filters)else:self.skip = Noneself.relu = nn.ReLU(inplace=True)rep = []filters = in_filtersif grow_first:rep.append(self.relu)# 这里的卷积不改变特征图尺寸rep.append(SeparableConv2d(in_filters, out_filters, 3, stride=1, padding=1, bias=False))rep.append(nn.BatchNorm2d(out_filters))filters = out_filtersfor i in range(reps - 1):rep.append(self.relu)rep.append(SeparableConv2d(filters, filters, 3, stride=1, padding=1, bias=False))rep.append(nn.BatchNorm2d(filters))if not grow_first:rep.append(self.relu)rep.append(SeparableConv2d(in_filters, out_filters, 3, stride=1, padding=1, bias=False))rep.append(nn.BatchNorm2d(out_filters))if not start_with_relu:rep = rep[1:]else:rep[0] = nn.ReLU(inplace=False)# Middle flow 的stride恒为1,因此无需做池化,而其余块需要# 其余块的stride=2,因此这里的最大池化可以将特征图尺寸减半if strides != 1:rep.append(nn.MaxPool2d(3, strides, 1))self.rep = nn.Sequential(*rep)def forward(self, inp):x = self.rep(inp)if self.skip is not None:skip = self.skip(inp)skip = self.skipbn(skip)else:skip = inpx += skipreturn xclass Xception(nn.Module):def __init__(self, num_classes):super(Xception, self).__init__()self.num_classes = num_classes # 总分类数###############################定义 Entry flow#################################self.conv1 = nn.Conv2d(in_channels=3, out_channels=32, kernel_size=3, stride=2, padding=0, bias=False)self.bn1 = nn.BatchNorm2d(32)self.relu = nn.ReLU(inplace=True)self.conv2 = nn.Conv2d(in_channels=32, out_channels=64, kernel_size=3, stride=1, padding=0, bias=False)self.bn2 = nn.BatchNorm2d(64)# do relu here# Block中的参数顺序:in_filters,out_filters,reps,stride,start_with_relu,grow_firstself.block1 = Block(64, 128, 2, 2, start_with_relu=False, grow_first=True)self.block2 = Block(128, 256, 2, 2, start_with_relu=True, grow_first=True)self.block3 = Block(256, 728, 2, 2, start_with_relu=True, grow_first=True)##############################定义 Middle flow################################self.block4 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block5 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block6 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block7 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block8 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block9 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block10 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)self.block11 = Block(728, 728, 3, 1, start_with_relu=True, grow_first=True)#############################定义 Exit flow###################################self.block12 = Block(728, 1024, 2, 2, start_with_relu=True, grow_first=False)self.conv3 = SeparableConv2d(1024, 1536, 3, 1, 1)self.bn3 = nn.BatchNorm2d(1536)# do relu hereself.conv4 = SeparableConv2d(1536, 2048, 3, 1, 1)self.bn4 = nn.BatchNorm2d(2048)self.fc = nn.Linear(2048, num_classes)################################################################################--------------------init weights---------------------#for m in self.modules():if isinstance(m, nn.Conv2d):n = m.kernel_size[0] * m.kernel_size[1] * m.out_channelsm.weight.data.normal_(0, math.sqrt(2. / n))elif isinstance(m, nn.BatchNorm2d):m.weight.data.fill_(1)m.bias.data.zero_()#----------------------------------------------------------------def forward(self, x):###########################定义 Entry flow ######################################x = self.conv1(x)x = self.bn1(x)x = self.relu(x)x = self.conv2(x)x = self.bn2(x)x = self.relu(x)x = self.block1(x)x = self.block2(x)x = self.block3(x)######################## 定义 Middle flow#######################################x = self.block4(x)x = self.block5(x)x = self.block6(x)x = self.block7(x)x = self.block8(x)x = self.block9(x)x = self.block10(x)x = self.block11(x)######################### 定义 Exit flow #######################################x = self.block12(x)x = self.conv3(x)x = self.bn3(x)x = self.relu(x)x = self.conv4(x)x = self.bn4(x)x = self.relu(x)x = F.adaptive_avg_pool2d(x, (1,1))x = x.view(x.size(0), -1)x = self.fc(x)return x

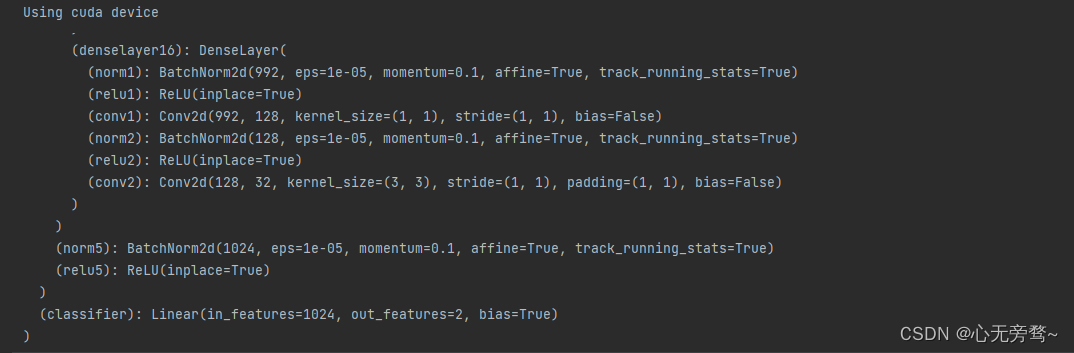

四、实例化模型

device = "cuda:0" if torch.cuda.is_available() else "cpu"

print("Using {} device".format(device))xception = Xception(num_classes = 2)

model = xception.to(device)

model

五、训练模型

5.1 构建训练函数

# 训练循环

def train(dataloader, model, loss_fn, optimizer):size = len(dataloader.dataset) # 训练集的大小num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整)train_loss, train_acc = 0, 0 # 初始化训练损失和正确率for X, y in dataloader: # 获取图片及其标签X, y = X.to(device), y.to(device)# 计算预测误差pred = model(X) # 网络输出loss = loss_fn(pred, y) # 计算网络输出和真实值之间的差距,targets为真实值,计算二者差值即为损失# 反向传播optimizer.zero_grad() # grad属性归零loss.backward() # 反向传播optimizer.step() # 每一步自动更新# 记录acc与losstrain_acc += (pred.argmax(1) == y).type(torch.float).sum().item()train_loss += loss.item()train_acc /= sizetrain_loss /= num_batchesreturn train_acc, train_loss

5.2 构建测试函数

def test (dataloader, model, loss_fn):size = len(dataloader.dataset) # 测试集的大小num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整)test_loss, test_acc = 0, 0# 当不进行训练时,停止梯度更新,节省计算内存消耗with torch.no_grad():for imgs, target in dataloader:imgs, target = imgs.to(device), target.to(device)# 计算losstarget_pred = model(imgs)loss = loss_fn(target_pred, target)test_loss += loss.item()test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item()test_acc /= sizetest_loss /= num_batchesreturn test_acc, test_loss

5.3 开始正式训练

import copyoptimizer = torch.optim.Adam(model.parameters(), lr= 1e-3)

loss_fn = nn.CrossEntropyLoss() # 创建损失函数epochs = 5train_loss = []

train_acc = []

test_loss = []

test_acc = []best_acc = 0 # 设置一个最佳准确率,作为最佳模型的判别指标for epoch in range(epochs):model.train()epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, optimizer)model.eval()epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn)# 保存最佳模型到 best_modelif epoch_test_acc > best_acc:best_acc = epoch_test_accbest_model = copy.deepcopy(model)train_acc.append(epoch_train_acc)train_loss.append(epoch_train_loss)test_acc.append(epoch_test_acc)test_loss.append(epoch_test_loss)# 获取当前的学习率lr = optimizer.state_dict()['param_groups'][0]['lr']template = ('Epoch:{:2d}, Train_acc:{:.1f}%, Train_loss:{:.3f}, Test_acc:{:.1f}%, Test_loss:{:.3f}, Lr:{:.2E}')print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss,epoch_test_acc*100, epoch_test_loss, lr))# 保存最佳模型到文件中

PATH = './best_model.pth' # 保存的参数文件名

torch.save(best_model.state_dict(), PATH)print('Done')

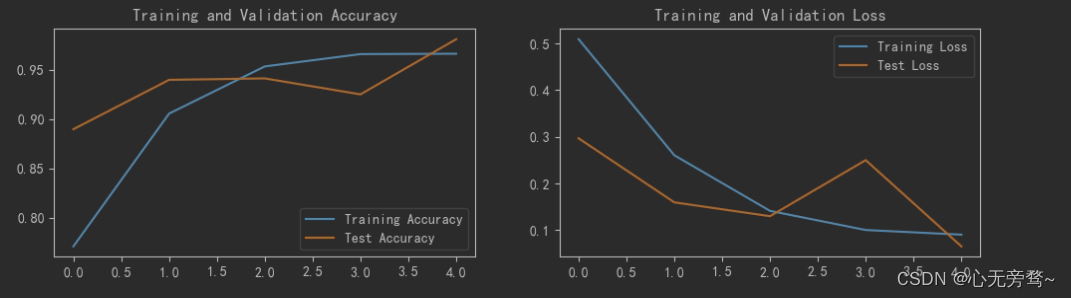

六、可视化精度和损失

import matplotlib.pyplot as plt

#隐藏警告

import warnings

warnings.filterwarnings("ignore") #忽略警告信息

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.dpi'] = 100 #分辨率epochs_range = range(epochs)plt.figure(figsize=(12, 3))

plt.subplot(1, 2, 1)plt.plot(epochs_range, train_acc, label='Training Accuracy')

plt.plot(epochs_range, test_acc, label='Test Accuracy')

plt.legend(loc='lower right')

plt.title('Training and Validation Accuracy')plt.subplot(1, 2, 2)

plt.plot(epochs_range, train_loss, label='Training Loss')

plt.plot(epochs_range, test_loss, label='Test Loss')

plt.legend(loc='upper right')

plt.title('Training and Validation Loss')

plt.show()

七、个体预测

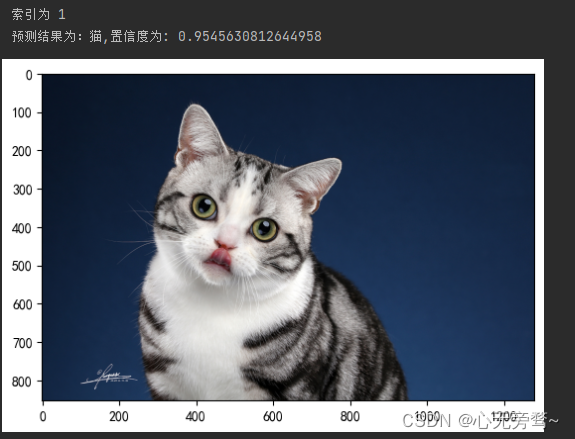

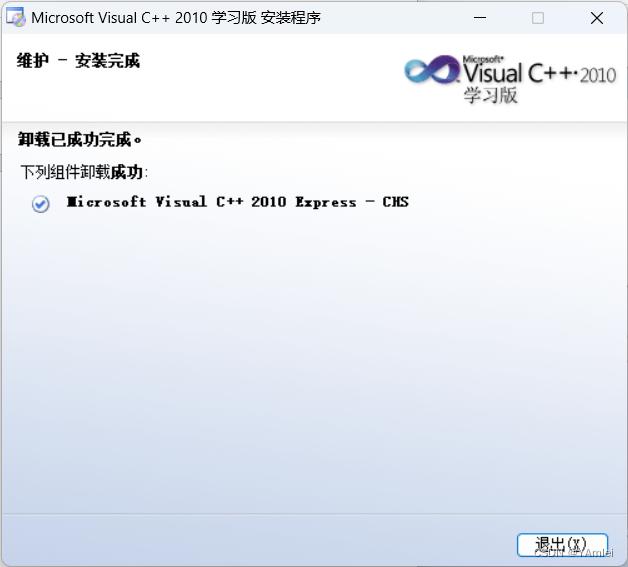

随便去网上找一张猫狗图片,进行预测。

# 预测import matplotlib.pyplot as plt

from PIL import Image

from torchvision.transforms import transforms

import torch

import matplotlib.pyplot as pltplt.rcParams['font.sans-serif']=['SimHei'] #解决中文显示乱码问题

plt.rcParams['axes.unicode_minus']=False #解决坐标轴负数的负号显示问题data_transform = transforms.Compose([transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛mean=[0.485, 0.456, 0.406],std=[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。

])img = Image.open("cat.jpg")

plt.imshow(img)

img = data_transform(img)

img = torch.unsqueeze(img, dim=0)

name=['狗','猫']

model_weight_path = "best_model.pth"

model = Xception(num_classes = 2)

model.load_state_dict(torch.load(model_weight_path))

model.eval()

with torch.no_grad():output = torch.squeeze(model(img))predict = torch.softmax(output, dim=0)# 获得最大可能性索引predict_cla = torch.argmax(predict).numpy()print('索引为', predict_cla)

print('预测结果为:{},置信度为: {}'.format(name[predict_cla], predict[predict_cla].item()))

plt.show()

总结

- Xception(又称为 Extreme Inception)是一种卷积神经网络架构,在 2016 年由 Google 提出,它的名字是由 ‘Extreme’ 和 ‘Inception’ 两个词汇组成的。Xception 基于 Inception V3 模型基础进行改进,使用深度可分离卷积来代替传统的卷积,从而更加有效地减少了模型的参数数量和计算复杂度。

- 在传统的 Inception 模型中,每个计算单元采用了两个卷积层,一个 1x1 的卷积层用于降低特征图的通道数,紧接着是一个 3x3 的卷积层用于进行特征提取。而 Xception 则将 1x1 和 3x3 卷积逐次分开,使用了深度可分离卷积作为基本的计算单元。深度可分离卷积将标准卷积分解为两部分,首先使用深度卷积来处理每个输入通道,然后再使用 1x1 的逐点卷积来融合通道,从而获得与标准卷积近似的特征提取效果。而深度可分离卷积相较于标准卷积而言,可以明显降低参数量和训练计算量。

- 而使用深度可分离卷积单元取代了传统的卷积操作之后,Xception模型在计算效率,模型大小上都相比 Inception V3 有大幅的提升。

- 总之,Xception模型的优势是在极大的减少了网络参数量和计算复杂度的同时,可以保持卓越的性能表现。因此,Xception模型已经被广泛地应用与图像分类、目标检测等任务中。

相关文章:

深度学习实战基础案例——卷积神经网络(CNN)基于Xception的猫狗识别|第2例

文章目录 一、环境准备二、数据预处理三、构建模型四、实例化模型五、训练模型5.1 构建训练函数5.2 构建测试函数5.3 开始正式训练 六、可视化精度和损失七、个体预测总结 今天使用轻量级的一个网络Xception做一个简单的猫狗识别案例,我的环境具体如下: …...

Linux Systemd 配置开机自启

博文目录 文章目录 Systemd操作方式配置方式配置示例参考 Systemd Systemd 是一个用于启动、管理和监控 Linux 系统的初始化系统。它是许多现代 Linux 发行版中默认的初始化系统,取代了传统的 SysVinit 和 Upstart。 Systemd 的引入在 Linux 社区引起了一些争议&…...

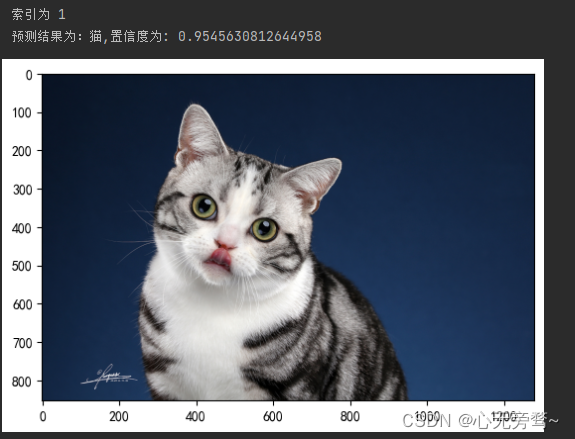

华为云云耀云服务器L实例评测|轻量级应用服务器对决:基于 fio 深度测评华为云云耀云服务器L实例的磁盘性能

本文收录在专栏:#云计算入门与实践 - 华为云 专栏中,本系列博文还在更新中 相关华为云云耀云服务器L实例评测文章列表如下: 华为云云耀云服务器L实例评测 | 从零开始:云耀云服务器L实例的全面使用解析指南华为云云耀云服务器L实…...

卸载Visual Studio 2010学习版 —— 卸载VCExpress

目录 最初安装Visual Studio 2010学习版是因为计算机二级 C语言考试而装,现如今考完试后便可卸载掉了,安装简便而卸载却没有uninstall.exe文件。故本文提供卸载方式。 进入到程序目录,找到setup.exe文件,也可以在程序目录搜索set…...

react的状态管理简单钩子方法

1.recoil useProvider文件: import { atom, useRecoilState } from recoil;const initState atom({key: initState,default: {state: [],}, })// 将业务逻辑拆分到一个单独文件中,方便进行状态管理 export interface StateProps {id: number;text: string;isFini…...

【Git】轻松学会 Git:深入理解 Git 的基本操作

文章目录 前言一、创建 Git 本地仓库1.1 什么是仓库1.2 创建本地仓库1.3 .git 目录结构 二、配置 Git三、认识 Git 的工作区、暂存区和版本库3.1 什么是 Git 的工作区、暂存区和版本库3.2 工作区、暂存区和版本库之间的关系 四、添加文件4.1 添加文件到暂存区和版本库中的命令4…...

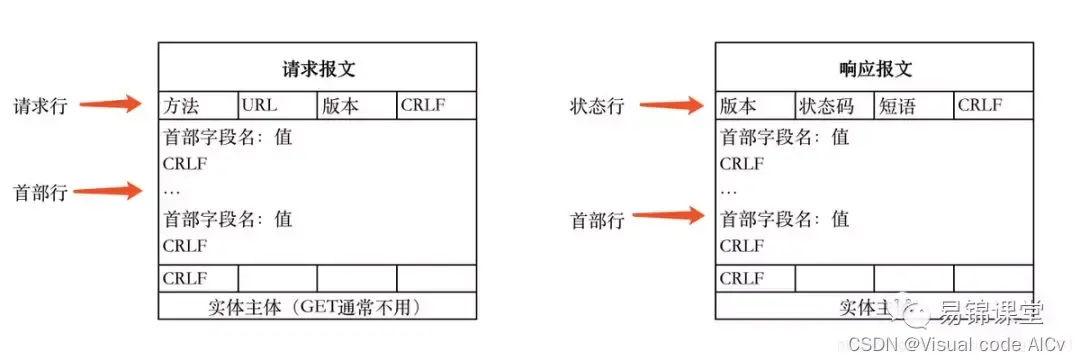

什么是HTTP头部(HTTP headers)?

聚沙成塔每天进步一点点 ⭐ 专栏简介⭐ 理解 HTTP 头部(HTTP Headers)⭐ HTTP 头部的分类⭐ HTTP 头部的应用⭐ 写在最后 ⭐ 专栏简介 前端入门之旅:探索Web开发的奇妙世界 欢迎来到前端入门之旅!感兴趣的可以订阅本专栏哦&#x…...

SpringCloud Alibaba 入门到精通 - Sentinel

SpringCloud Alibaba 入门到精通 - Sentinel 一、基础结构搭建1.父工程创建2.子工程创建 二、Sentinel的整合SpringCloud1.微服务可能存在的问题2.SpringCloud集成Sentinel搭建Dashboard3 SpringCloud 整合Sentinel 三、服务降级1 服务降级-Sentinel2 Sentinel 整合 OpenFeign3…...

【深度学习实验】前馈神经网络(三):自定义多层感知机(激活函数logistic、线性层算Linear)

目录 一、实验介绍 二、实验环境 1. 配置虚拟环境 2. 库版本介绍 三、实验内容 0. 导入必要的工具包 1. 构建数据集 2. 激活函数logistic 3. 线性层算子 Linear 4. 两层的前馈神经网络MLP 5. 模型训练 一、实验介绍 本实验实现了一个简单的两层前馈神经网络 激活函数…...

HJ68 成绩排序

描述 给定一些同学的信息(名字,成绩)序列,请你将他们的信息按照成绩从高到低或从低到高的排列,相同成绩 都按先录入排列在前的规则处理。 例示: jack 70 peter 96 Tom 70 smith 67 从高到低…...

FPGA——UART串口通信

文章目录 前言一、UART通信协议1.1 通信格式2.2 MSB或LSB2.3 奇偶校验位2.4 UART传输速率 二、UART通信回环2.1 系统架构设计2.2 fsm_key2.3 baud2.4 sel_seg2.5 fifo2.6 uart_rx2.7 uart_tx2.8 top_uart2.9 发送模块时序分析2.10 接收模块的时序分析2.11 FIFO控制模块时序分析…...

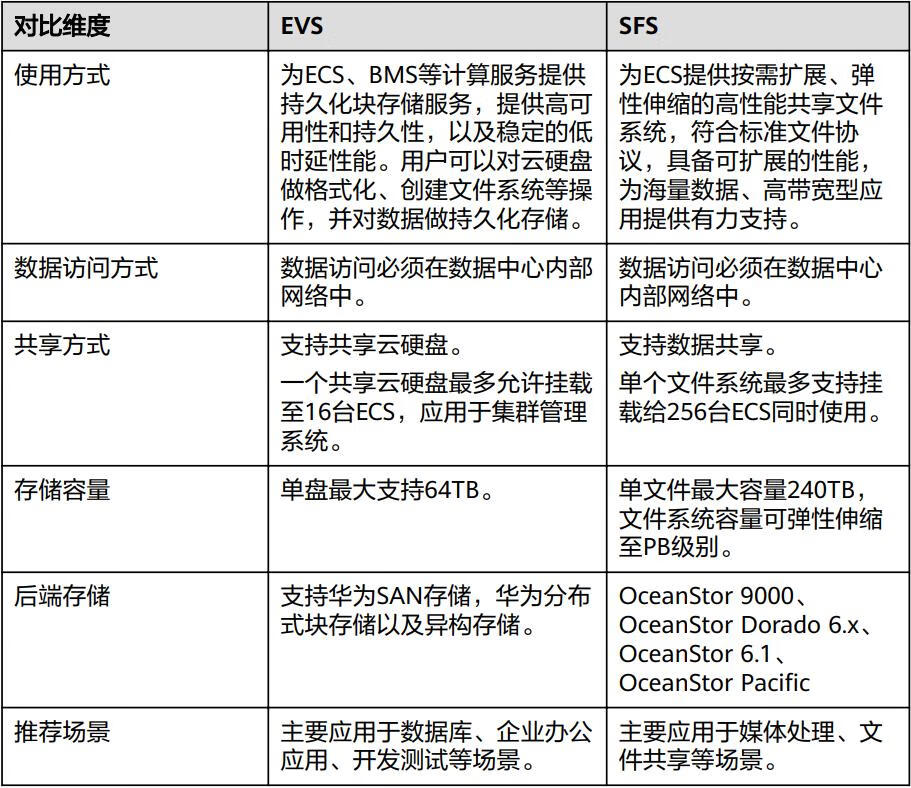

华为云Stack的学习(七)

八、华为云Stack存储服务介绍 1.云硬盘EVS 云硬盘(Elastic Volume Service,EVS),又名磁盘,是一种虚拟块存储服务,主要为ECS(Elastic Cloud Server)和BMS(Bare Metal Se…...

安装k8s集群

一、前置环境配置 安装两台centos 实验环境,一台pc配有docker环境,有两个centsos7容器,其中一个容器作为master,一个作为node。如果master与node都是用默认端口,会存在冲突,所以在此基础上做细微的调整。…...

C++中编写没有参数和返回值的函数

C中编写没有参数和返回值的函数 返回值为 void 函数不需要将值返回给调用者。为了告诉编译器函数不返回值,返回类型为 void。例如: #include <iostream>// void means the function does not return a value to the caller void printHi() {std…...

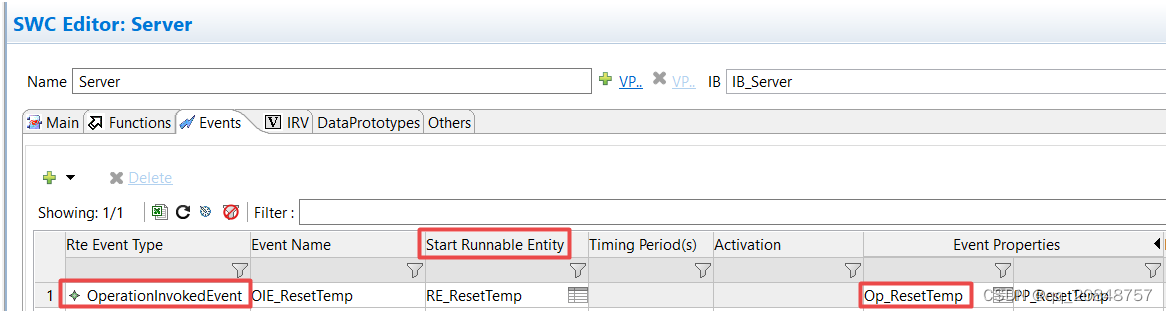

SWC 流程

一个arxml 存储SWC (可以存多个,也可以一个arxml存一个SWC)一个arxml 存储 composition (只能存一个)一个arxml 存储 system description (通过import dbc自动生成system) 存储SWC和composition的arxml文件分开&#…...

怒刷LeetCode的第10天(Java版)

目录 第一题 题目来源 题目内容 解决方法 方法一:两次拓扑排序 第二题 题目来源 题目内容 解决方法 方法一:分治法 方法二:优先队列(Priority Queue) 方法三:迭代 第三题 题目来源 题目内容…...

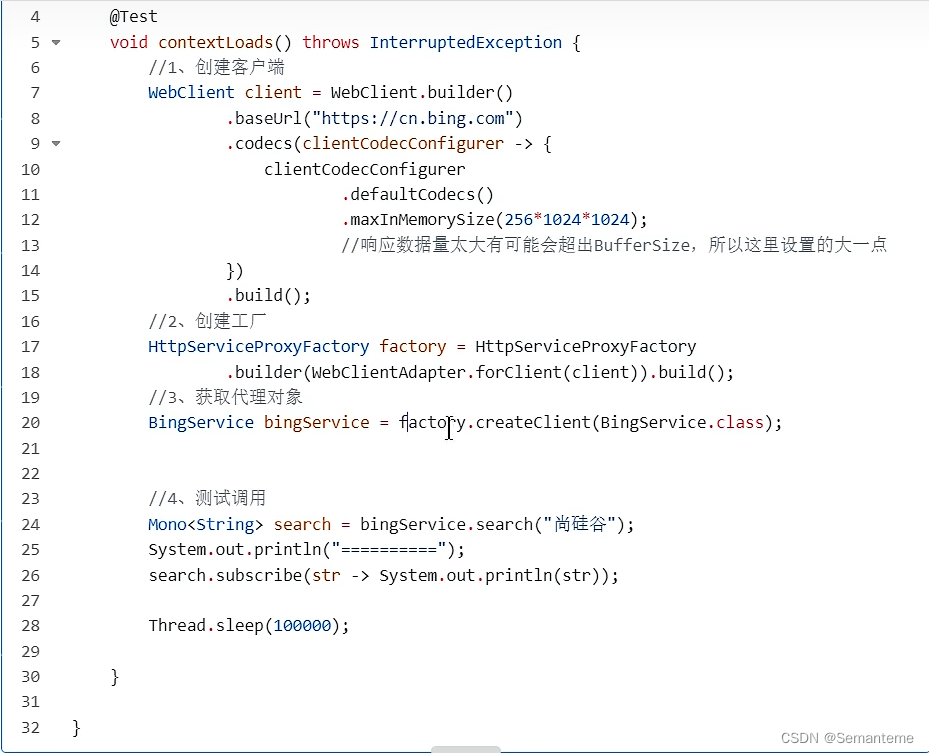

java框架-Springboot3-场景整合

文章目录 java框架-Springboot3-场景整合批量安装中间件NoSQL整合步骤RedisTemplate定制化 接口文档远程调用WebClientHttp Interface 消息服务 java框架-Springboot3-场景整合 批量安装中间件 linux安装中间件视频 NoSQL 整合redis视频 整合步骤 RedisTemplate定制化 Re…...

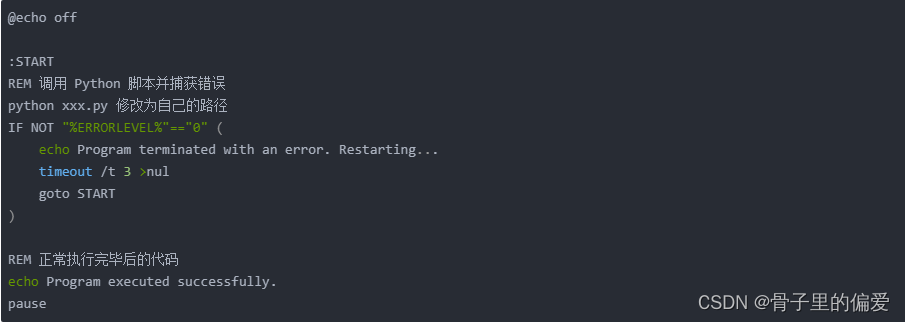

在Bat To Exe Converter,修改为当异常结束或终止时,程序重新启动执行

在Bat To Exe Converter,修改为当异常结束或终止时,程序重新启动执行 .bat中的代码部分: .bat中的代码echo offpython E:\python\yoloProjectTestSmallLarge\detect.pypause,我想你能帮在Bat To Exe Converter,修改成…...

PythonWeb服务器(HTTP协议)

一、HTTP协议与实现原理 HTTP(Hypertext Transfer Protocol,超文本传输协议)是一种用于在网络上传输超文本数据的协议。它是Web应用程序通信的基础,通过客户端和服务器之间的请求和响应来传输数据。在HTTP协议中连接客户与服务器的…...

Northstar 量化平台

基于 B/S 架构、可替代付费商业软件的一站式量化交易平台。具备历史回放、策略研发、模拟交易、实盘交易等功能。兼顾全自动与半自动的使用场景。 已对接国内期货股票、外盘美股港股。 面向程序员的量化交易软件,用于期货、股票、外汇、炒币等多种交易场景ÿ…...

Windows Android子系统全栈指南:从技术原理到实战应用

Windows Android子系统全栈指南:从技术原理到实战应用 【免费下载链接】WSA Developer-related issues and feature requests for Windows Subsystem for Android 项目地址: https://gitcode.com/gh_mirrors/ws/WSA 价值定位:打破系统边界的跨平台…...

解码器技术剖析)

GLM-OCR模型长短期记忆(LSTM)解码器技术剖析

GLM-OCR模型长短期记忆(LSTM)解码器技术剖析 你是不是觉得现在的OCR(光学字符识别)技术特别神奇?一张图片拍下去,里面的文字瞬间就被识别出来了,又快又准。这背后,除了强大的视觉模…...

MinimalUltrasonic:超声波ToF测距库的极简主义实践

1. 项目概述MinimalUltrasonic 是一款专为嵌入式微控制器设计的极简主义超声波测距库,面向 Arduino 生态系统深度优化。其核心设计哲学是“以最小资源开销实现最大功能覆盖”,在保持接口简洁性的同时,提供工业级的鲁棒性、多单位支持与多传感…...

n8n自动化实战:用AI老师带你6周搞定电商订单处理系统

n8n自动化实战:用AI老师带你6周搞定电商订单处理系统 电商行业的快速发展对订单处理效率提出了更高要求。传统人工操作不仅耗时耗力,还容易出错。n8n作为一款开源自动化工具,能够帮助企业快速搭建高效的订单处理系统。本文将带你用6周时间&am…...

**发散创新:基于Rust的轻量级权限管理库设计与开源许可证实践**在现代分布式

发散创新:基于Rust的轻量级权限管理库设计与开源许可证实践 在现代分布—...

即将开幕,科达嘉邀您观展!)

第十四届中国电子信息博览会(CITE2026)即将开幕,科达嘉邀您观展!

第十四届中国电子信息博览会(CITE2026)将于2026年4月9-11日在深圳会展中心(福田)盛大启幕。本次展会聚焦AI应用、具身智能、AI大模型/智算中心、低空经济、集成电路、电子元器件等领域,汇聚1000余家行业领军企业参展。…...

3步完成OpenClaw配置:千问3.5-9B快速接入指南

3步完成OpenClaw配置:千问3.5-9B快速接入指南 1. 为什么选择OpenClaw千问3.5-9B组合 去年我在尝试自动化办公流程时,发现市面上的AI助手要么需要上传敏感数据到云端,要么功能太过局限。直到遇到OpenClaw这个开源的本地化AI智能体框架&#…...

Simulink电力电子主电路设计指南:从基础模块到桥臂搭建

1. Simulink电力电子主电路设计入门 第一次接触Simulink做电力电子设计时,我被它丰富的模块库震撼到了。作为一个从硬件电路转战仿真的工程师,我发现用Simulink搭建主电路比实际焊接电路板方便太多。比如设计一个简单的AC-DC转换器,在实验室可…...

SuperDuperDB事件驱动架构:构建实时AI应用的全新方式

SuperDuperDB事件驱动架构:构建实时AI应用的全新方式 【免费下载链接】superduperdb Superduper: End-to-end framework for building custom AI applications and agents. 项目地址: https://gitcode.com/gh_mirrors/su/superduperdb SuperDuperDB是一个端到…...

AI大模型风口已至!4大高薪就业方向,助你精准转型少走弯路!

当下,AI大模型正从“技术爆发期”迈入“全面应用期”。对于IT从业者而言,这并非一道“要不要转”的选择题,而是一道“往哪转”的战略题。 很多人想抓住这波红利,却卡在“不知道从哪下手”“不清楚自己适合哪个赛道”的困境中。 …...