分布式存储系统Ceph应用详解

Ceph的应用

- 一、Ceph 存储池(Pool)

- 1.1 Ceph存储池的基本概念

- 1.2 原理

- 1.3 一个Pool资源池应该包含多少PG数?

- 1.4 Ceph 存储池相关管理命令

- 1.4.1 创建

- 1.4.2 查看

- 1.4.3 修改

- 1.4.4 删除

- 二、 CephFS文件系统MDS接口

- 三、创建CephFS文件系统MDS接口

- 3.1 服务端操作

- Step1 在管理节点创建 mds 服务

- Step2 查看各个节点的 mds 服务

- Step3 创建存储池,启用 ceph 文件系统

- Step4 查看mds状态

- Step5 创建用户

- 3.2 客户端操作

- Step1 在客户端创建工作目录

- Step2 向客户端拷贝相关文件

- Step3 在客户端安装 ceph 软件包

- Step4 在客户端制作秘钥文件

- Step5 客户端挂载

- 方式一:基于内核

- 方式二:基于 fuse 工具

- 四、Ceph 块存储系统 RBD 接口

- 4.1 RBD接口简介

- 4.2 使用 RBD 的两种方式

- 4.3 镜像管理

- 4.3.1 查看

- 4.3.2 修改镜像大小

- 4.3.3 删除镜像

- 4.3.4 还原镜像

- 4.4 快照管理

- 4.4.1 创建快照

- 4.4.2 删除快照

- 4.4.3 回滚到指定快照

- 4.4.4 限制镜像可创建快照数

- 4.4.4 快照分层(快照克隆)

- 4.4.5 快照展平

- 五、创建 Ceph 块存储系统 RBD 接口

- 5.1 服务端操作

- Step1 创建RBD存储池

- Step2 创建镜像

- Step3 修改RBD镜像特性

- Step4 远程传输相关文件到客户端

- Step5 在线扩容(可选)

- 5.2 客户端操作

- Step1 执行客户端映射

- Step2 挂载

- Step3 刷新设备文件

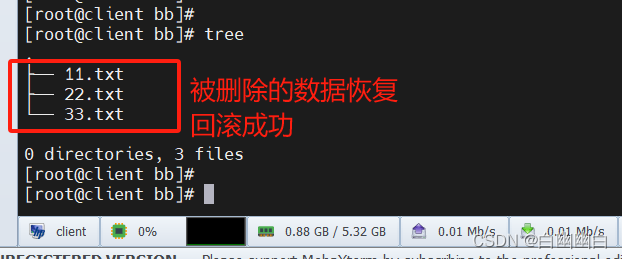

- 5.3 快照功能验证(回滚)

- Step1 在客户端写入测试文件

- Step2 在管理节点对镜像创建快照

- Step3 回滚RBD 镜像到指定的快照

- Step4 观察数据是否恢复

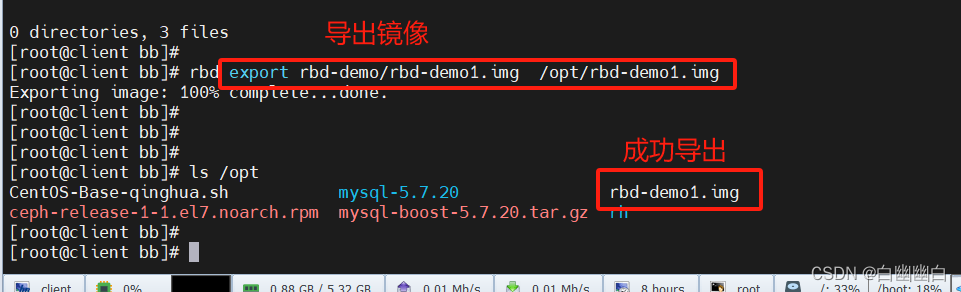

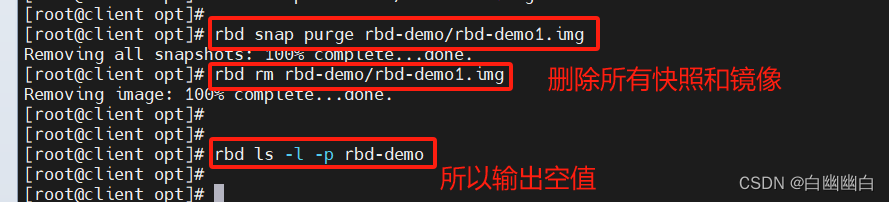

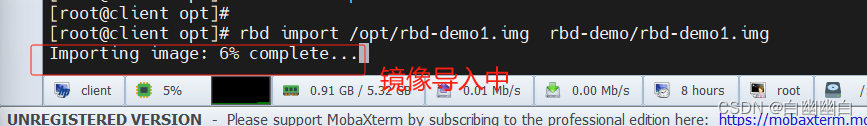

- 5.4 镜像的导出导入

- 5.4.1 导出镜像

- 5.4.2 导入镜像

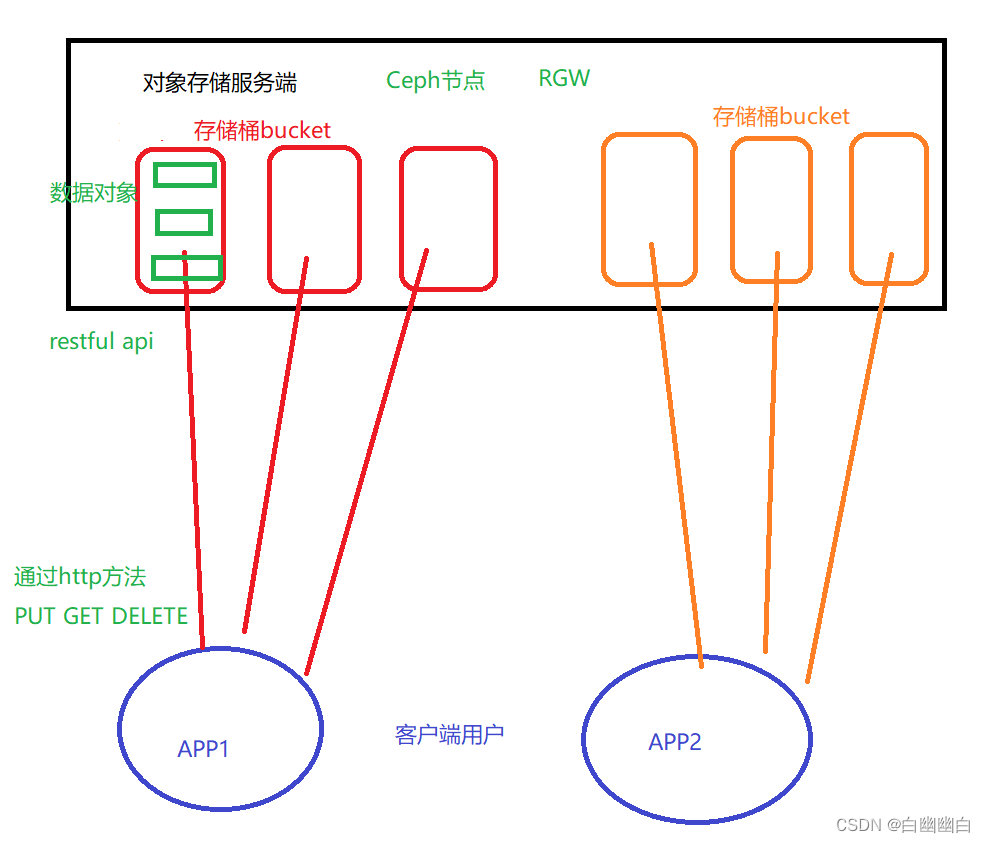

- 六、对象存储RGW接口

- 6.1 对象存储的概念

- 6.2 相关组件

- 6.3 组件之间的关系

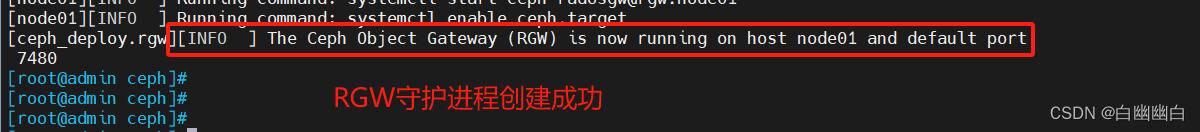

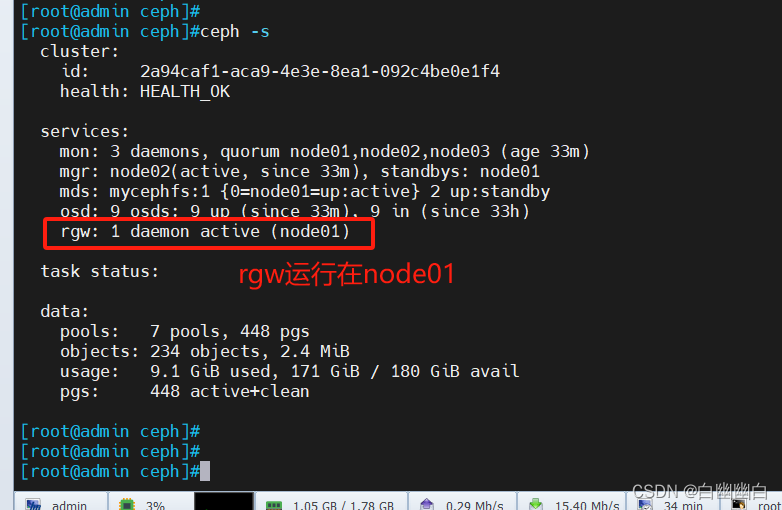

- 七、创建RGW接口

- 7.1 在管理节点创建一个 RGW 守护进程

- 7.2 开启 http+https ,更改监听端口

- Step1 在rgw节点生成证书

- Step2 更改监听端口

- Step3 在客户端访问验证

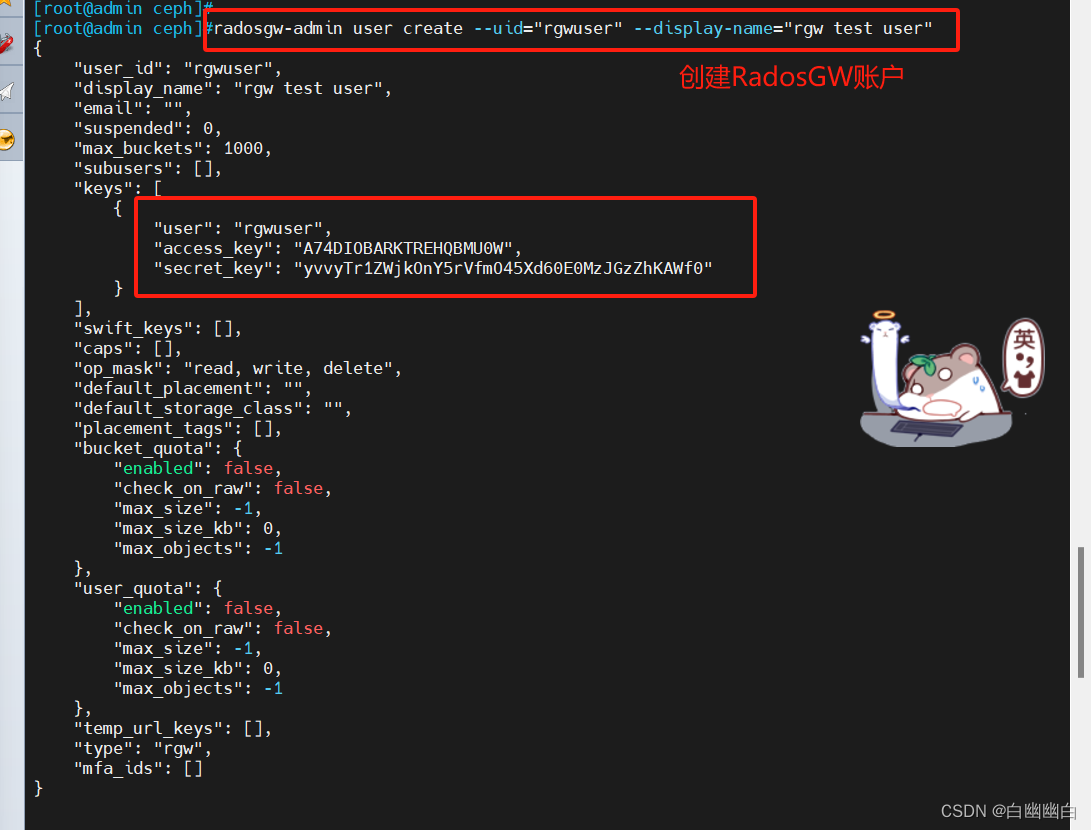

- 7.3 创建 RadosGW 账户

- 7.4 接口访问测试

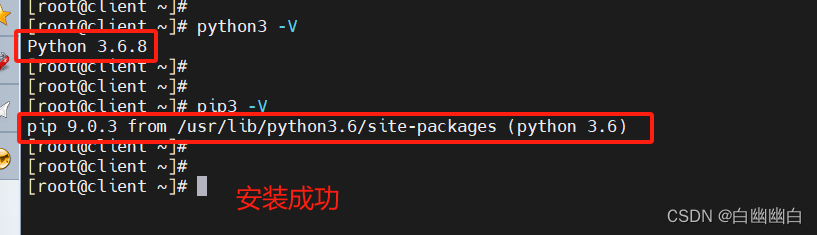

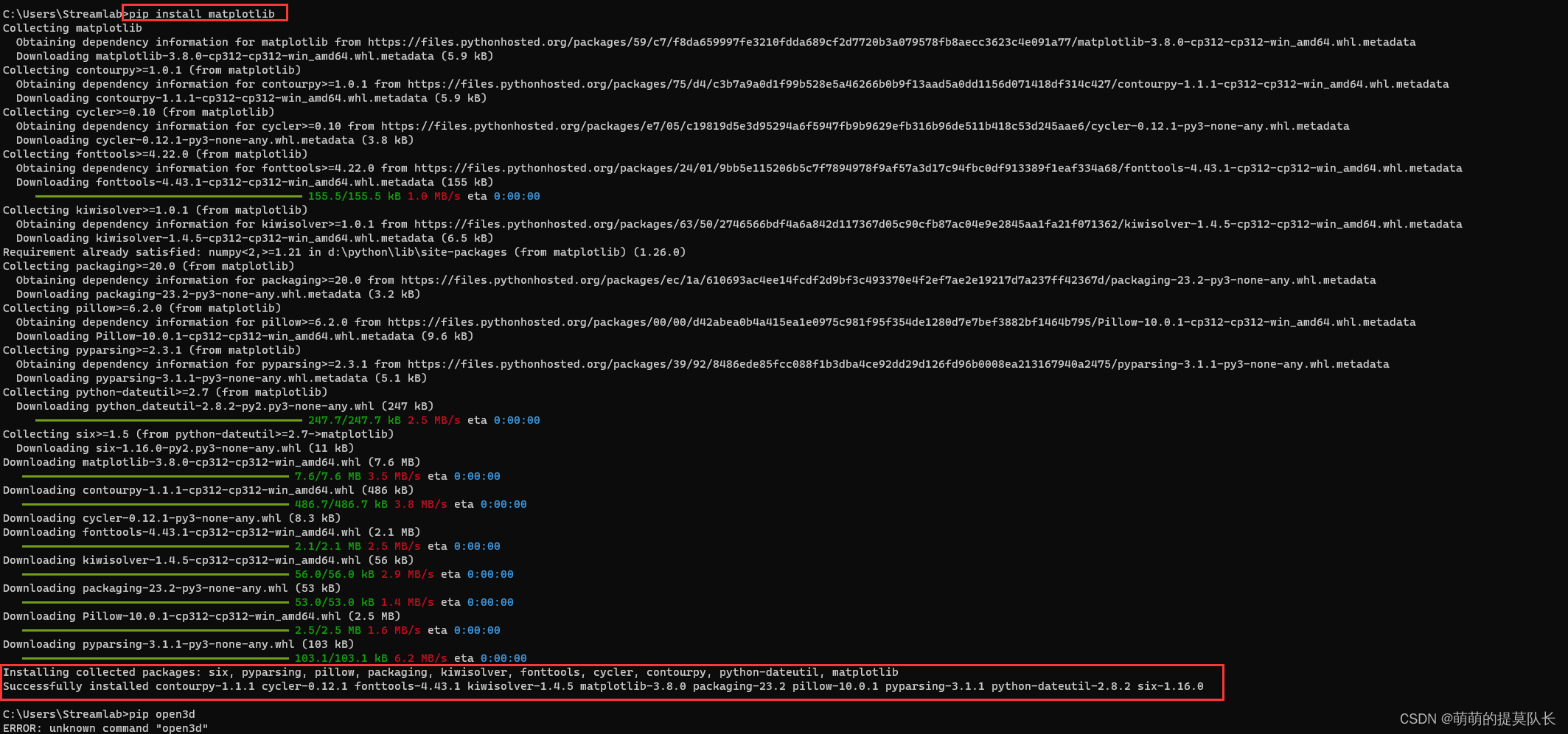

- Step1 在客户端安装 python3、python3-pip

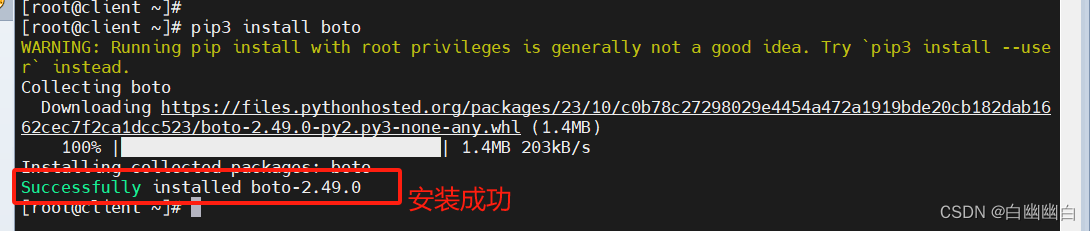

- Step2 安装 boto 模块,用于测试连接 S3

- Step3 编写测试脚本

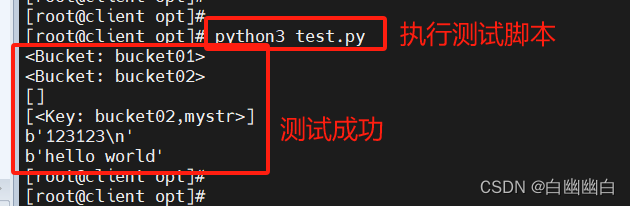

- Step4 执行 python 脚本,测试访问 S3 接口

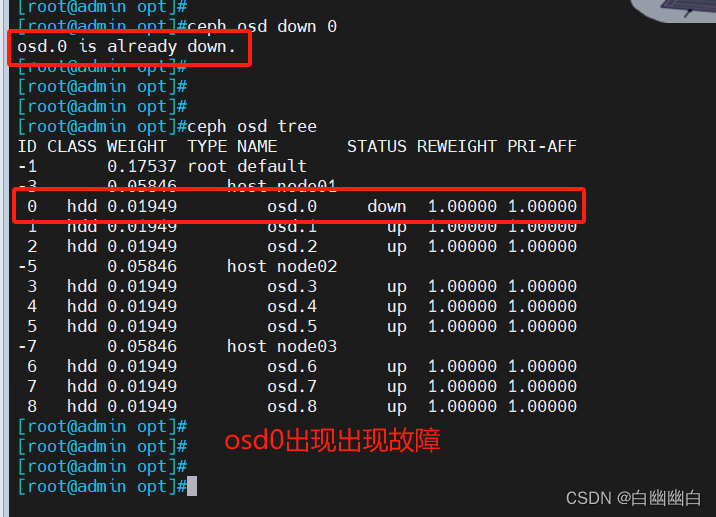

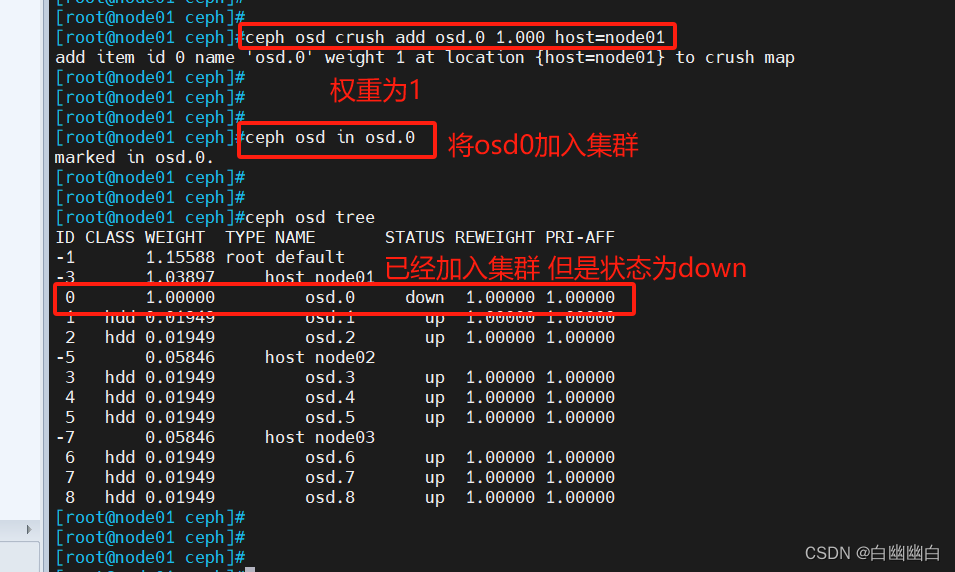

- 八、OSD 故障模拟与恢复

- 8.1 模拟 OSD 故障

- 8.2 故障恢复

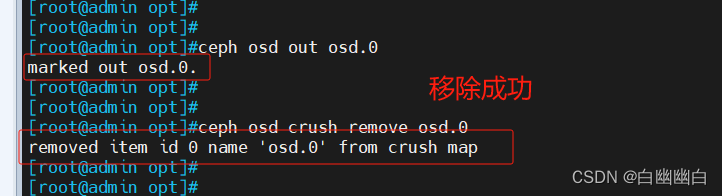

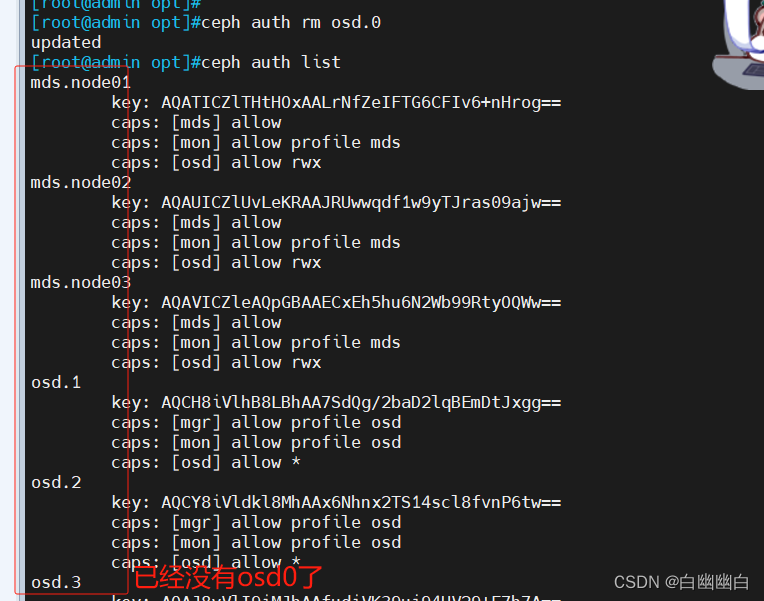

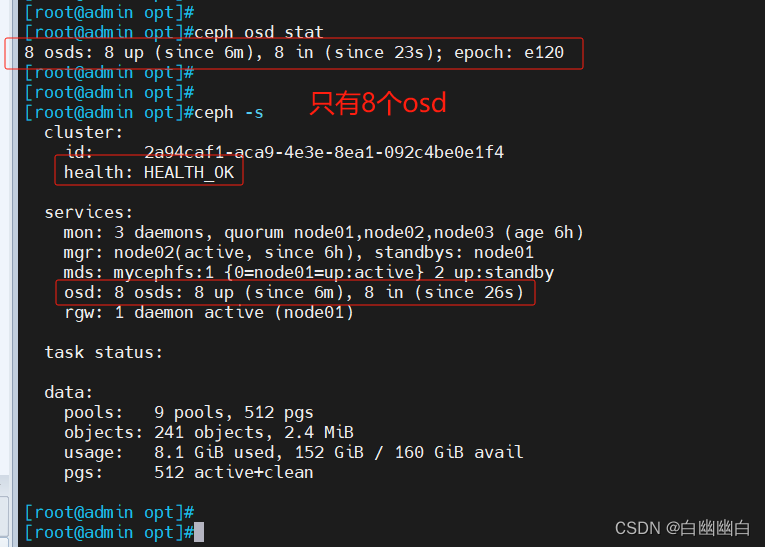

- Step1 将坏掉的 osd 踢出集群

- Step2 把原来坏掉的 osd 修复后重新加入集群

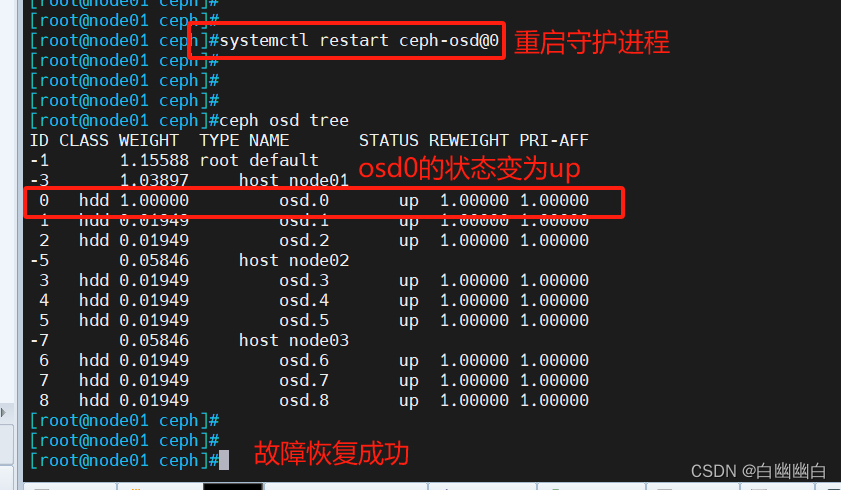

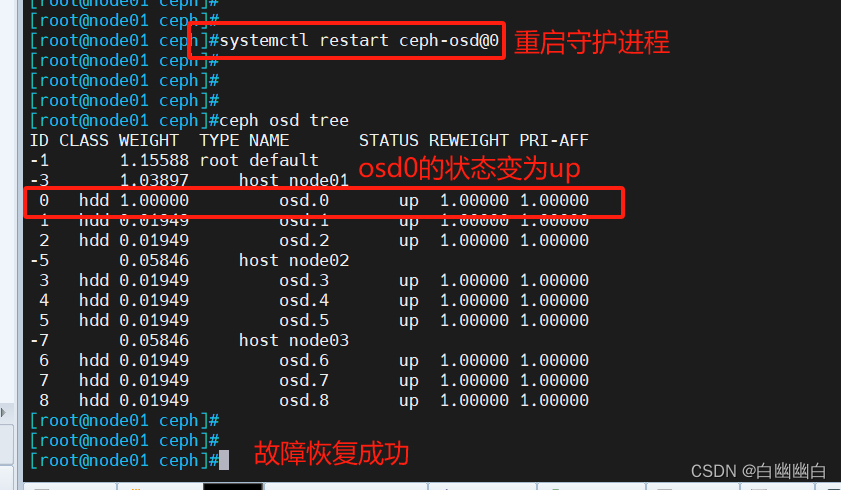

- Step3 重启守护进程,观察故障是否恢复

- Step4 重启失败的解决方案(补充)

一、Ceph 存储池(Pool)

Pool 数据池/资源池/存储池,可理解成一个存放PG的命名空间,一个Pool可以多个PG,不同Pool的PG可以同名

1.1 Ceph存储池的基本概念

完成了 Ceph 集群的部署后,如何向 Ceph 中存储数据呢?

首先我们需要在 Ceph 中定义一个 Pool 资源池。

Pool 是 Ceph 中存储 Object 对象抽象概念。

我们可以将其理解为 Ceph 存储上划分的逻辑分区,Pool 由多个 PG 组成;

而 PG 通过 CRUSH 算法映射到不同的 OSD 上;

同时 Pool 可以设置副本 size 大小,默认副本数量为 3。

1.2 原理

Ceph 客户端向 monitor 请求集群的状态,并向 Pool 中写入数据,数据根据 PGs 的数量,通过 CRUSH 算法将其映射到不同的 OSD 节点上,实现数据的存储。

可以把 Pool 理解为存储 Object 数据的逻辑单元;

1.3 一个Pool资源池应该包含多少PG数?

| OSD总数 | PG数 |

|---|---|

| 小于 5 个 | 推荐为 128 |

| 5~10 个 | 推荐为 512 |

| 10~50 个 | 推荐为 4096 |

| 大于 50 个 | 参考公式 ( Target PGs per OSD ) x ( OSD # ) x ( %Data ) / ( Size ) |

##公式详解##-Target PGs per OSD # 每个OSD对应的PG数(近期不扩容OSD数量设置为100,近期要扩容OSD数量设置为200)

-OSD #OSD总数

-%Data #当前Pool会占用Ceph集群总空间的百分比

-Size #当前Pool的副本数#举个例子

100 * 60 * 50% / 3 = 1000 ->取最接近2的次方值 1024

1.4 Ceph 存储池相关管理命令

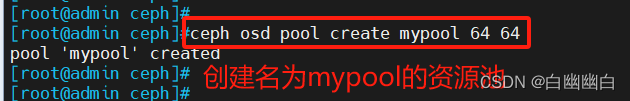

1.4.1 创建

#创建一个 Pool 资源池

#其名字为 mypool

#PGs 数量设置为 64,

#设置 PGs 的同时还需要设置 PGP(通常PGs和PGP的值是相同的):

#PG (Placement Group),pg 是一个虚拟的概念,用于存放 object,PGP(Placement Group for Placement purpose),相当于是 pg 存放的一种 osd 排列组合cd /etc/cephceph osd pool create mypool 64 64

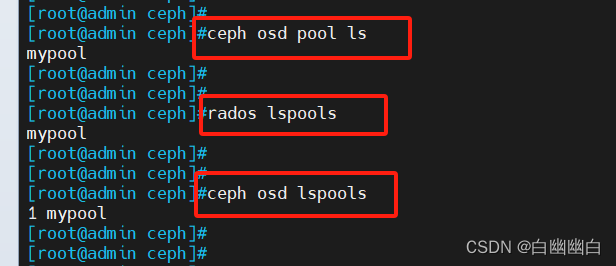

1.4.2 查看

#查看集群 Pool 信息

#方式一

ceph osd pool ls #方式二

rados lspools#方式三

ceph osd lspools

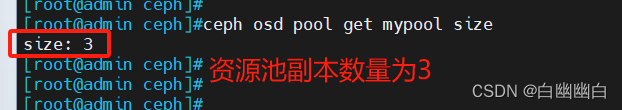

#查看资源池副本的数量

ceph osd pool get mypool size

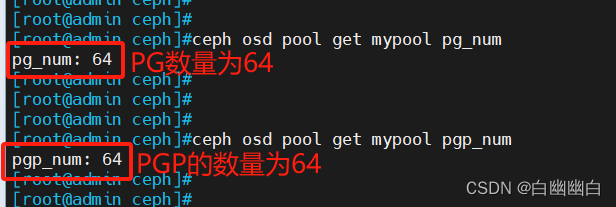

#查看 PG 和 PGP 数量

ceph osd pool get mypool pg_num

ceph osd pool get mypool pgp_num

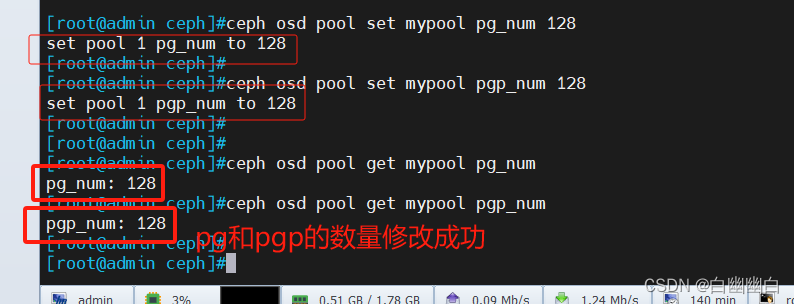

1.4.3 修改

#修改 pg_num 和 pgp_num 的数量为 128

ceph osd pool set mypool pg_num 128

ceph osd pool set mypool pgp_num 128ceph osd pool get mypool pg_num

ceph osd pool get mypool pgp_num

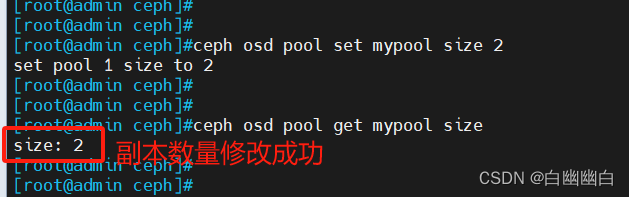

#修改 Pool 副本数量为 2

ceph osd pool set mypool size 2ceph osd pool get mypool size

#修改默认副本数为 2

vim ceph.conf

......

osd_pool_default_size = 2ceph-deploy --overwrite-conf config push node01 node02 node03

1.4.4 删除

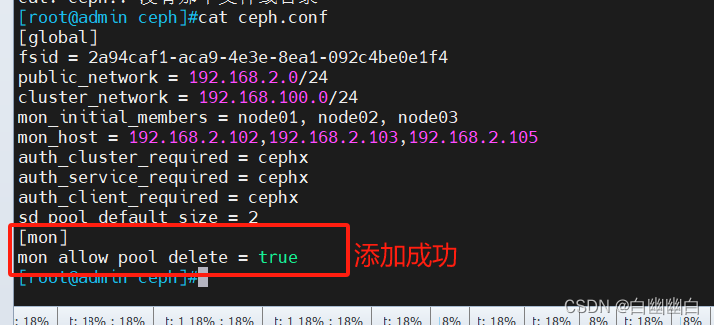

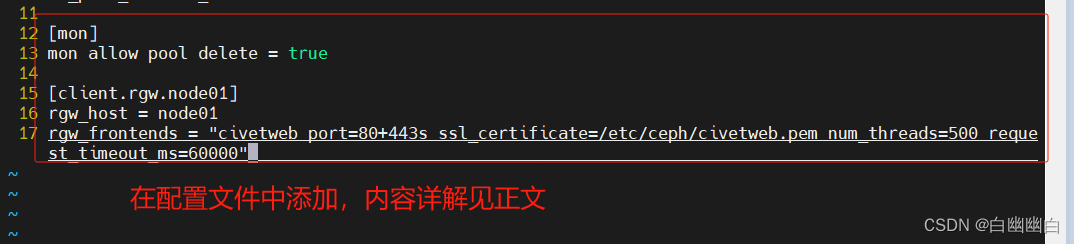

1)修改ceph配置文件,开启删除存储池

删除存储池命令存在数据丢失的风险,Ceph 默认禁止此类操作。

需要管理员在 ceph.conf 配置文件中开启支持删除存储池的操作。

vim ceph.conf

......

[mon]

mon allow pool delete = true

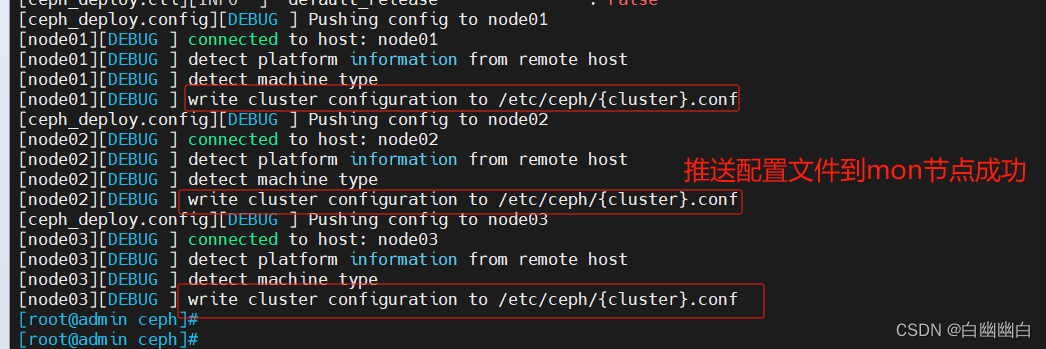

2)推送 ceph.conf 配置文件给所有 mon 节点

ceph-deploy --overwrite-conf config push node01 node02 node03

3)所有 mon 节点重启 ceph-mon 服务

systemctl restart ceph-mon.target

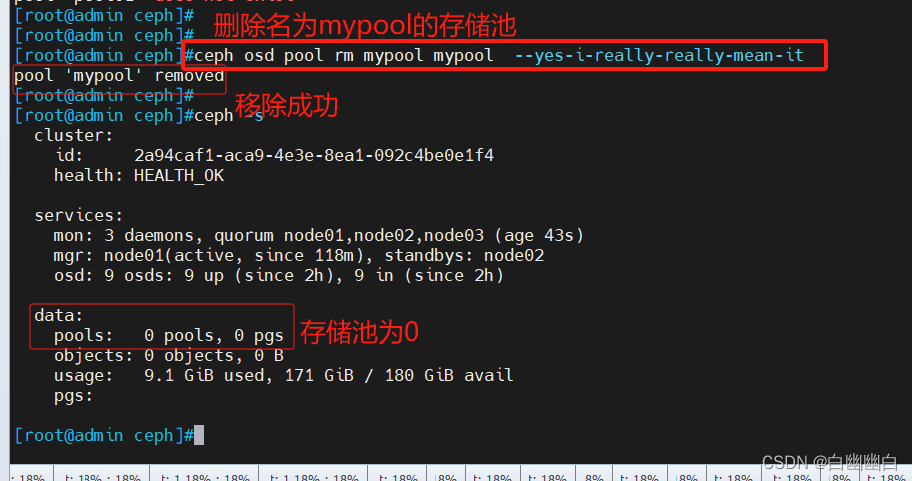

4)执行删除 Pool 命令

ceph osd pool rm pool01 pool01 --yes-i-really-really-mean-it

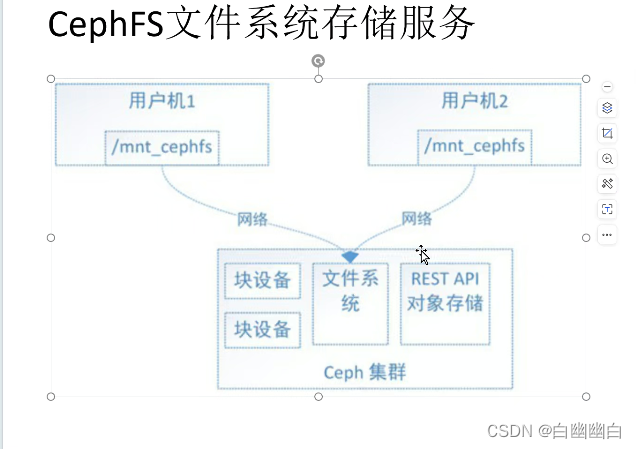

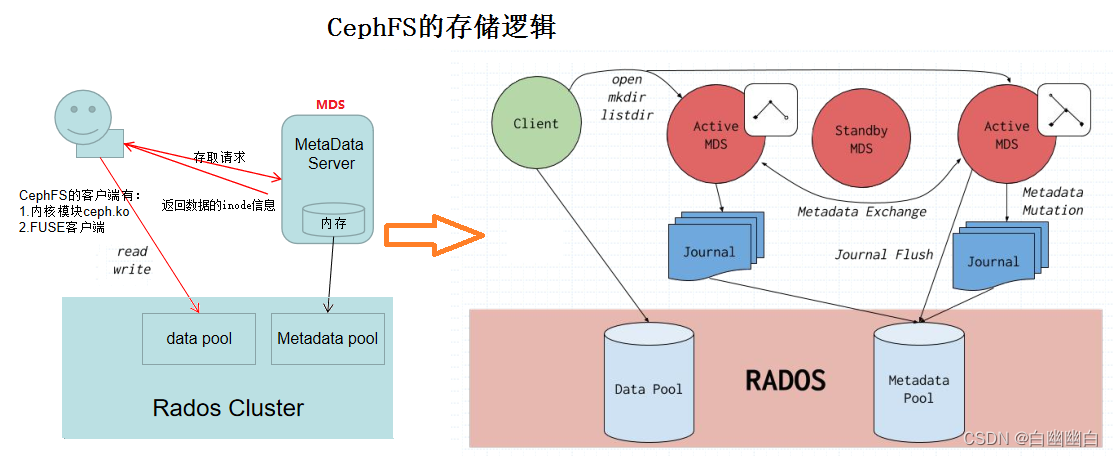

二、 CephFS文件系统MDS接口

CephFS(Ceph文件系统)是Ceph存储集群中用于支持分布式文件存储的组件。

MDS(Metadata Server)是CephFS的元数据服务器,它负责管理文件系统的元数据,包括目录结构、文件属性和权限等信息。

CephFS的MDS接口允许用户通过客户端与MDS服务器进行交互,实现对文件系统的访问和管理。

MDS接口提供了一系列命令和API,用于创建、删除、移动和修改文件和目录、设置权限和ACL、查询文件和目录属性等操作。

通过MDS接口,用户可以以类似于传统文件系统的方式操作CephFS。

用户可以使用标准的文件系统操作命令(比如ls、cp、mv等)或者调用相应的API,通过MDS服务器访问和管理文件系统中的数据。

MDS接口还支持并发访问和多客户端操作,确保数据的一致性和安全性。

总的来说,CephFS的MDS接口提供了用户与Ceph存储集群中的元数据服务器进行交互的方式,实现对分布式文件系统的访问和管理。

通过MDS接口,用户可以实现对文件和目录的增删改查操作,并确保数据的可靠性和一致性。

三、创建CephFS文件系统MDS接口

3.1 服务端操作

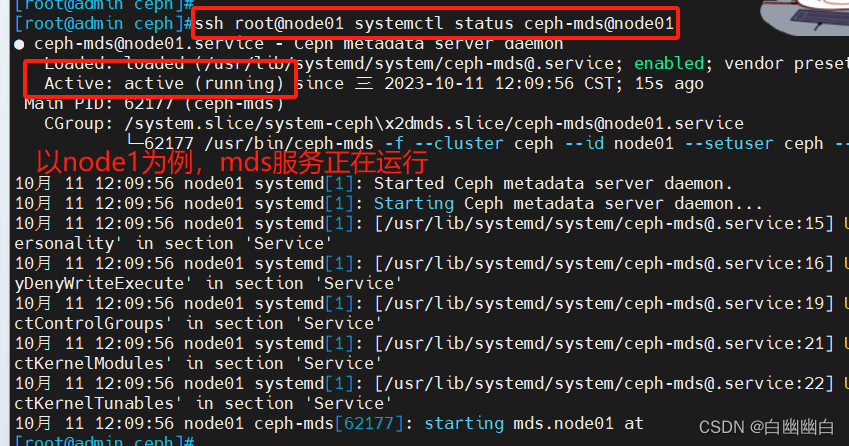

Step1 在管理节点创建 mds 服务

cd /etc/ceph

ceph-deploy mds create node01 node02 node03

Step2 查看各个节点的 mds 服务

ssh root@node01 systemctl status ceph-mds@node01

ssh root@node02 systemctl status ceph-mds@node02

ssh root@node03 systemctl status ceph-mds@node03

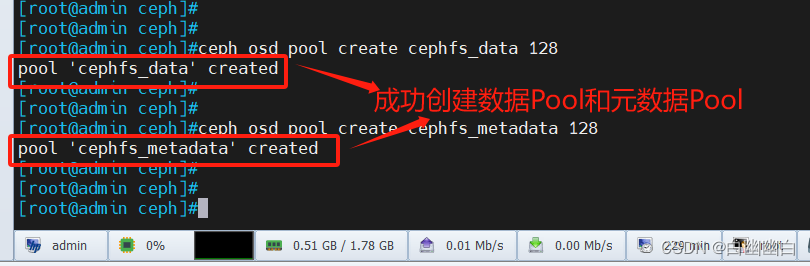

Step3 创建存储池,启用 ceph 文件系统

ceph 文件系统至少需要两个 rados 池,一个用于存储数据,一个用于存储元数据。

此时数据池就类似于文件系统的共享目录。

ceph osd pool create cephfs_data 128 #创建数据Poolceph osd pool create cephfs_metadata 128 #创建元数据Pool

#创建 cephfs

#命令格式:ceph fs new <FS_NAME> <CEPHFS_METADATA_NAME> <CEPHFS_DATA_NAME>ceph fs new mycephfs cephfs_metadata cephfs_data

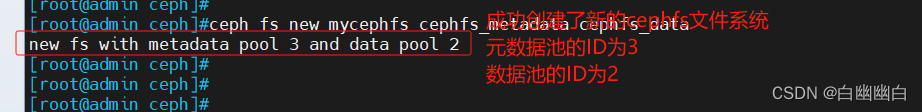

#启用ceph,元数据Pool在前,数据Pool在后创建了一个新的 CephFS 文件系统,并为其分配了两个池(pool)来存储元数据和数据。

元数据池(metadata pool)的 pool ID 是 3,数据池(data pool)的 pool ID 是 2。

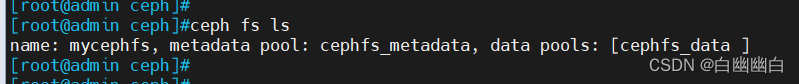

ceph fs ls #查看cephfs

Step4 查看mds状态

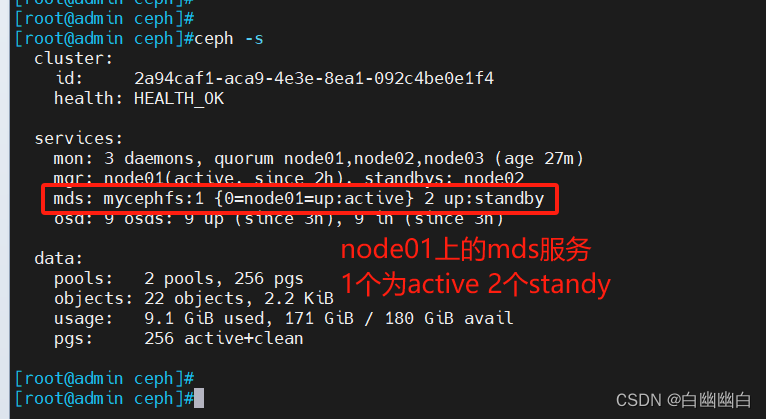

一个up,其余两个待命,目前的工作的是node01上的mds服务

ceph -s

Step5 创建用户

#语法格式

ceph fs authorize <fs_name> client.<client_id> <path-in-cephfs> rw

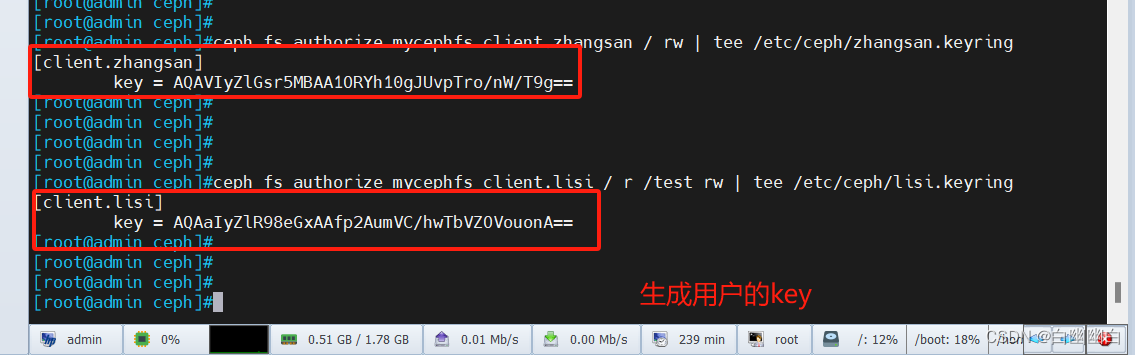

#账户为 client.zhangsan

#用户 name 为 zhangsan

#zhangsan 对ceph文件系统的 / 根目录(注意不是操作系统的根目录)有读写权限

ceph fs authorize mycephfs client.zhangsan / rw | tee /etc/ceph/zhangsan.keyring# 账户为 client.lisi

#用户 name 为 lisi

#lisi 对文件系统的 / 根目录只有读权限,对文件系统的根目录的子目录 /test 有读写权限

ceph fs authorize mycephfs client.lisi / r /test rw | tee /etc/ceph/lisi.keyring

3.2 客户端操作

Step1 在客户端创建工作目录

客户端要在 public 网络内。

mkdir /etc/ceph

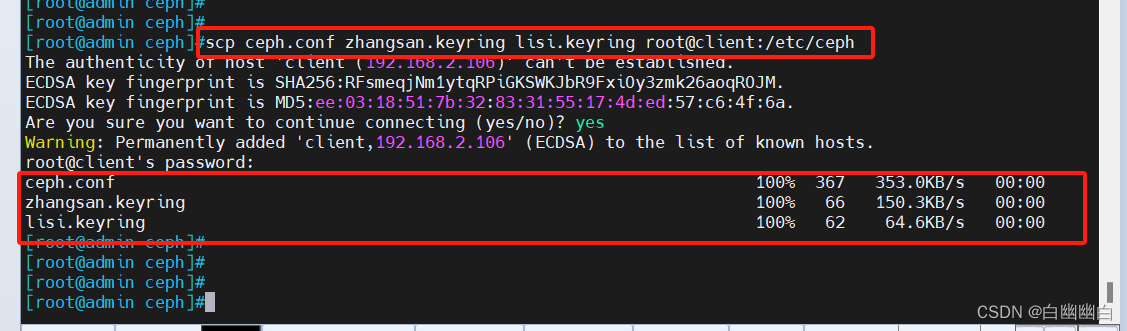

Step2 向客户端拷贝相关文件

在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

scp ceph.conf zhangsan.keyring lisi.keyring root@client:/etc/ceph

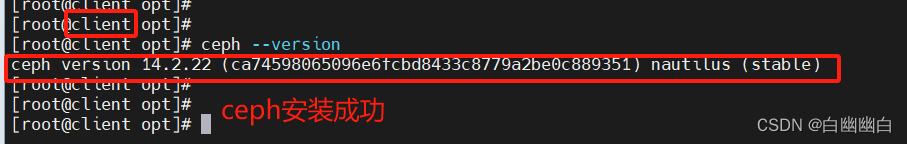

Step3 在客户端安装 ceph 软件包

cd /opt

wget https://download.ceph.com/rpm-nautilus/el7/noarch/ceph-release-1-1.el7.noarch.rpm --no-check-certificaterpm -ivh ceph-release-1-1.el7.noarch.rpmyum install -y ceph

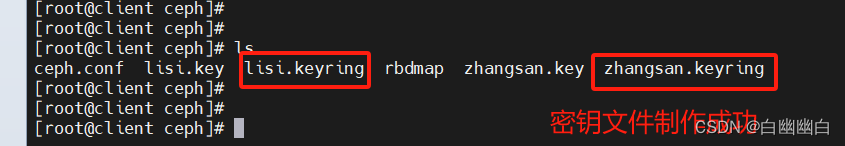

Step4 在客户端制作秘钥文件

cd /etc/ceph

ceph-authtool -n client.zhangsan -p zhangsan.keyring > zhangsan.key #把 zhangsan 用户的秘钥导出到 zhangsan.keylceph-authtool -n client.lisi -p lisi.keyring > lisi.key #把 lisi 用户的秘钥导出到 lisi.key

Step5 客户端挂载

方式一:基于内核

语法格式:

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secret=<秘钥>

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secretfile=<秘钥文件>示例一:

mkdir -p /data/zhangsan

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/zhangsan -o name=zhangsan,secretfile=/etc/ceph/zhangsan.key示例二:

mkdir -p /data/lisi

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/lisi -o name=lisi,secretfile=/etc/ceph/lisi.key#验证用户权限

cd /data/lisi

echo 123 > 2.txt

-bash:2.txt:权限不够echo 123 > test/2.txt

cat test/2.txt

123示例三:

#停掉 node02 上的 mds 服务

ssh root@node02 "systemctl stop ceph-mds@node02"ceph -s#测试客户端的挂载点仍然是可以用的,如果停掉所有的 mds,客户端就不能用了

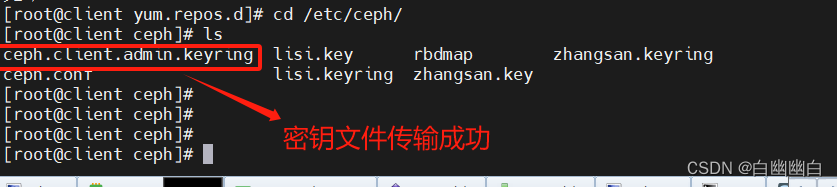

方式二:基于 fuse 工具

1)将管理员密钥文件ceph.client.admin.keyring拷贝给客户端

scp ceph.client.admin.keyring root@client:/etc/ceph

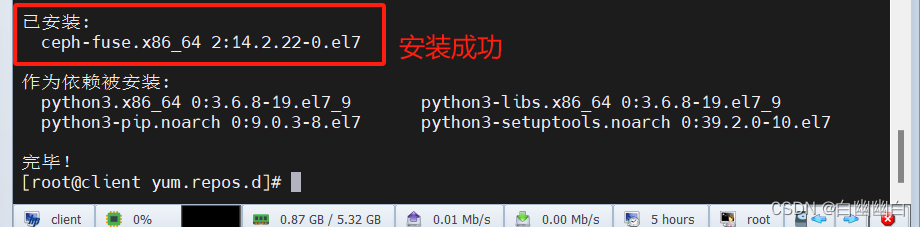

2)在客户端安装 ceph-fuse

yum install -y ceph-fuse

3)客户端挂载

挂载时,如果挂载点不为空会挂载失败,指定 -o nonempty 可以忽略。

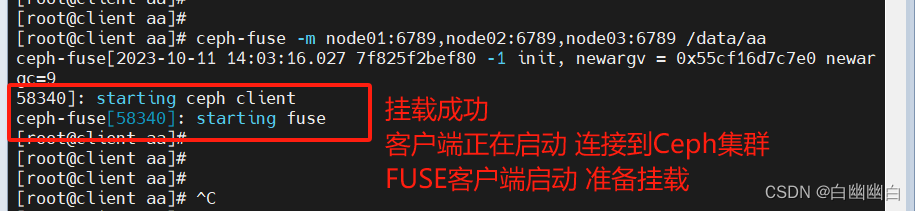

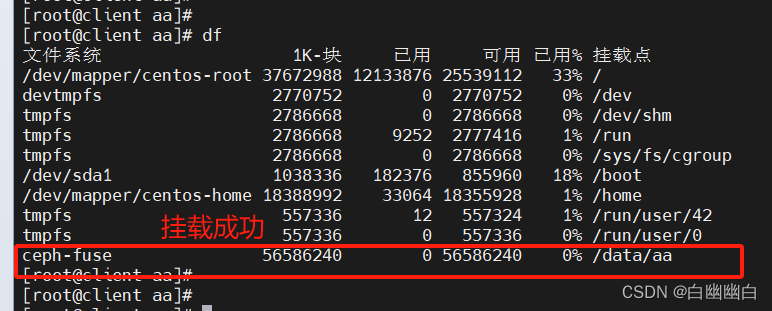

mkdir -p /data/aa cd /data/aaceph-fuse -m node01:6789,node02:6789,node03:6789 /data/aa 本地文件系统访问和llc操作 Ceph 存储集群中的文件和目录#starting ceph client 表示 Ceph 客户端正在启动,即将连接到 Ceph 存储集群。

#starting fuse 表示 FUSE 客户端正在启动,并准备挂载 CephFS

四、Ceph 块存储系统 RBD 接口

4.1 RBD接口简介

Ceph 块存储系统(RBD)提供了一种与Ceph集群交互的接口,使用户可以在分布式存储环境中使用块设备。

RBD接口可以让用户创建、映射、快照、克隆和删除RBD镜像,就像使用本地块设备一样。

通过RBD接口,用户可以将Ceph集群中的存储资源虚拟化为块设备,从而为应用程序提供高性能、高可用性和可扩展性。

用户可以通过RBD接口操作RBD镜像,实现诸如数据备份、迁移和卷管理等功能。

通过这些协议,用户可以通过网络访问和管理RBD镜像,从而实现分布式存储的灵活性和可伸缩性。

4.2 使用 RBD 的两种方式

- 通过

内核模块KRBD将镜像映射为系统本地块设备,通常设置文件一般为:/dev/rbd* - 另一种是通过librbd接口,通常KVM虚拟机使用这种接口。

4.3 镜像管理

4.3.1 查看

#查看存储池下存在哪些镜像

rbd ls -l -p rbd-demo

#查看镜像的详细信息

rbd info -p rbd-demo --image rbd-demo1.img

rbd image 'rbd-demo.img':size 10 GiB in 2560 objects #镜像的大小与被分割成的条带数order 22 (4 MiB objects) #条带的编号,有效范围是12到25,对应4K到32M,而22代表2的22次方,这样刚好是4Msnapshot_count: 0id: 5fc98fe1f304 #镜像的ID标识block_name_prefix: rbd_data.5fc98fe1f304 #名称前缀format: 2 #使用的镜像格式,默认为2features: layering, exclusive-lock, object-map, fast-diff, deep-flatten #当前镜像的功能特性op_features: #可选的功能特性flags:

4.3.2 修改镜像大小

#修改镜像大小rbd resize -p rbd-demo --image rbd-demo1.img --size 20Grbd info -p rbd-demo --image rbd-demo1.img

#使用 resize 调整镜像大小,一般建议只增不减,如果是减少的话需要加选项 --allow-shrink

rbd resize -p rbd-demo --image rbd-demo1.img --size 5G --allow-shrink

4.3.3 删除镜像

#直接删除镜像

rbd rm -p rbd-demo --image rbd-demo2.img

rbd remove rbd-demo/rbd-demo2.img#推荐使用 trash 命令,这个命令删除是将镜像移动至回收站,如果想找回还可以恢复

rbd trash move rbd-demo/rbd-demo1.imgrbd ls -l -p rbd-demorbd trash list -p rbd-demo

5fc98fe1f304 rbd-demo1.img

4.3.4 还原镜像

#还原镜像

rbd trash restore rbd-demo/5fc98fe1f304rbd ls -l -p rbd-demo

4.4 快照管理

对RBD镜像进行快照,可以保留镜像的状态历史,另外还可以利用快照的分层技术,通过将快照克隆为新的镜像使用。

4.4.1 创建快照

rbd snap create --pool rbd-demo --image rbd-demo1.img --snap demo1_snap1#可简写

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap1

4.4.2 删除快照

#删除指定快照:

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap1#删除所有快照:

rbd snap purge rbd-demo/rbd-demo1.img

4.4.3 回滚到指定快照

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1

4.4.4 限制镜像可创建快照数

#限制镜像可创建快照数

rbd snap limit set rbd-demo/rbd-demo1.img --limit 3#解除限制:

rbd snap limit clear rbd-demo/rbd-demo1.img

4.4.4 快照分层(快照克隆)

快照分层支持用快照的克隆生成新镜像,这种镜像与直接创建的镜像几乎完全一样,支持镜像的所有操作。

唯一不同的是克隆镜像引用了一个只读的上游快照,而且此快照必须要设置保护模式。

1)将上游快照设置为保护模式

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap666rbd snap protect rbd-demo/rbd-demo1.img@demo1_snap666

2)克隆快照为新的镜像

rbd clone rbd-demo/rbd-demo1.img@demo1_snap666 --dest rbd-demo/rbd-demo666.imgrbd ls -p rbd-demo

3)命令查看克隆完成后快照的子镜像

rbd children rbd-demo/rbd-demo1.img@demo1_snap666

4.4.5 快照展平

通常情况下通过快照克隆而得到的镜像会保留对父快照的引用,这时候不可以删除该父快照,否则会有影响。

如果要删除快照但想保留其子镜像,必须先展平其子镜像,展平的时间取决于镜像的大小

#直接删除

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

#报错 snapshot 'demo1_snap666' is protected from removal.

1) 展平子镜像

rbd flatten rbd-demo/rbd-demo666.img

2)取消快照保护

rbd snap unprotect rbd-demo/rbd-demo1.img@demo1_snap666

3)删除快照

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666rbd ls -l -p rbd-demo #在删除掉快照后,查看子镜像依然存在

五、创建 Ceph 块存储系统 RBD 接口

5.1 服务端操作

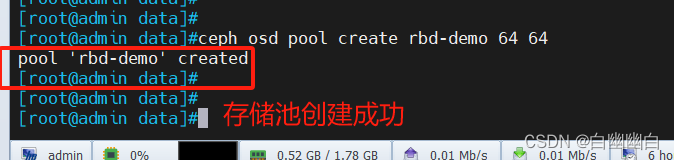

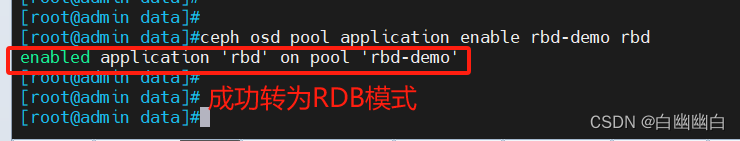

Step1 创建RBD存储池

1)创建一个名为 rbd-demo 的专门用于 RBD 的存储池

ceph osd pool create rbd-demo 64 64

2)将存储池转换为 RBD 模式

ceph osd pool application enable rbd-demo rbd

3)初始化存储池

rbd pool init -p rbd-demo

# -p 等同于 --pool

4)用户授权

#示例,指定用户标识为client.osd-mount,对另对OSD有所有的权限,对Mon有只读的权限

ceph auth get-or-create client.osd-mount osd "allow * pool=rbd-demo" mon "allow r" > /etc/ceph/ceph.client.osd-mount.keyrig

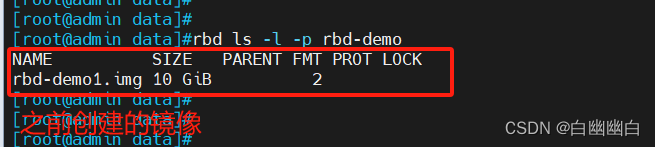

Step2 创建镜像

rbd create -p rbd-demo --image rbd-demo1.img --size 10G#可简写为

rbd create rbd-demo/rbd-demo2.img --size 10G

#查看存储池下存在哪些镜像

rbd ls -l -p rbd-demo

Step3 修改RBD镜像特性

CentOS7默认情况下只支持layering和striping特性,需要将其它的特性关闭。

rbd feature disable rbd-demo/rbd-demo1.img object-map,fast-diff,deep-flatten

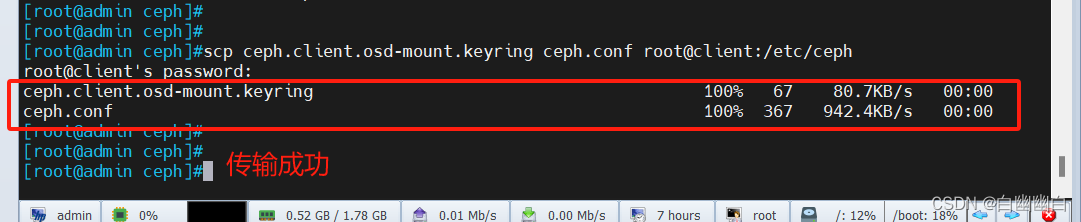

Step4 远程传输相关文件到客户端

将用户的keyring文件和ceph.conf文件发送到客户端的/etc/ceph目录下。

cd /etc/cephscp ceph.client.osd-mount.keyring ceph.conf root@client:/etc/ceph

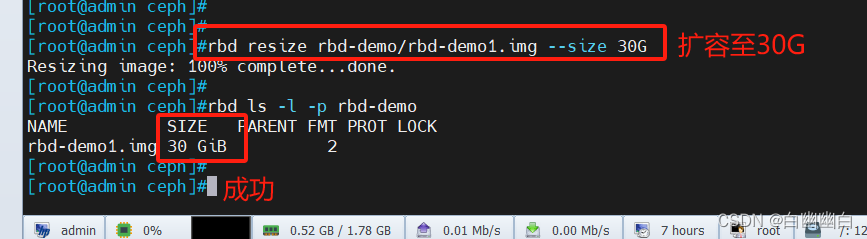

Step5 在线扩容(可选)

#在管理节点调整镜像的大小

rbd resize rbd-demo/rbd-demo1.img --size 30G

5.2 客户端操作

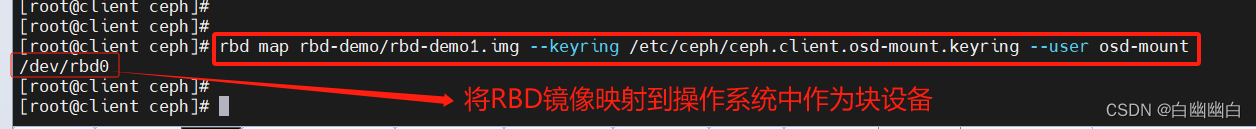

Step1 执行客户端映射

#安装 ceph-common 软件包

yum install -y ceph-common#执行客户端映射

cd /etc/cephrbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

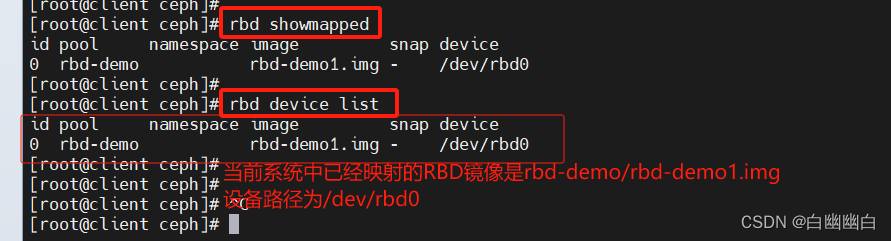

#查看映射

rbd showmappedrbd device list

- `id`: 表示RBD镜像的标识符。在此示例中,标识符为0。

- `pool`: 表示RBD镜像所在的存储池名称。在此示例中,存储池名称为`rbd-demo`。

- `namespace`: 表示RBD镜像所在的命名空间。在此示例中,未设定命名空间。

- `image`: 表示RBD镜像的名称。在此示例中,镜像名称为`rbd-demo1.img`。

- `snap`: 表示RBD镜像的快照名称。在此示例中,未设置快照,所以显示为`-`。

- `device`: 表示RBD镜像在操作系统中映射的设备路径。在此示例中,设备路径为`/dev/rbd0`。

#补充知识,断开映射

rbd unmap rbd-demo/rbd-demo1.img

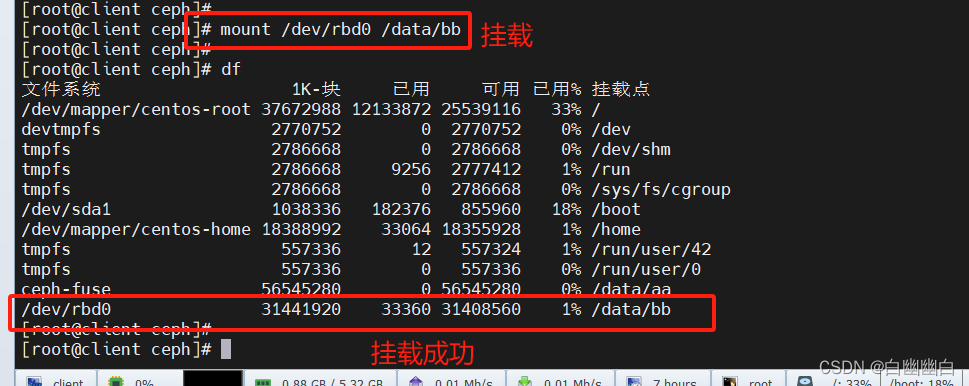

Step2 挂载

#格式化

mkfs.xfs /dev/rbd0#挂载

mkdir -p /data/bb

mount /dev/rbd0 /data/bb

Step3 刷新设备文件

#刷新xfs文件系统容量

xfs_growfs /dev/rbd0 ##补充##

#刷新ext4类型文件系统容量

resize2fs /dev/rbd0

ROB接口创建完成

5.3 快照功能验证(回滚)

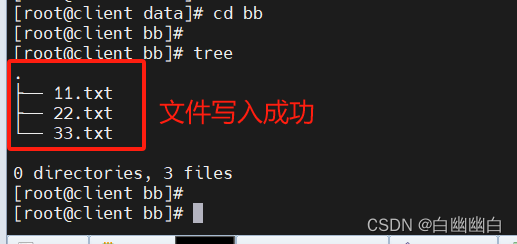

Step1 在客户端写入测试文件

echo 1111 > /data/bb/11.txt

echo 2222 > /data/bb/22.txt

echo 3333 > /data/bb/33.txt

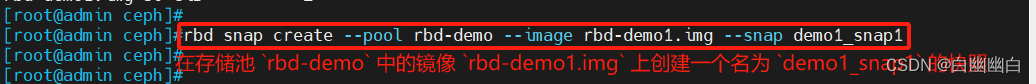

Step2 在管理节点对镜像创建快照

rbd snap create --pool rbd-demo --image rbd-demo1.img --snap demo1_snap1#可简写

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap1##命令详解##

- `rbd snap create`: 这是用于创建RBD镜像快照的命令。

- `--pool rbd-demo`: 这表示指定快照所属的RBD镜像所在的存储池名称为 `rbd-demo`。

- `--image rbd-demo1.img`: 这表示指定要创建快照的RBD镜像名称为 `rbd-demo1.img`。

- `--snap demo1_snap1`: 这表示指定要创建的快照名称为 `demo1_snap1`。在存储池 `rbd-demo` 中的镜像 `rbd-demo1.img` 上创建一个名为 `demo1_snap1` 的快照。

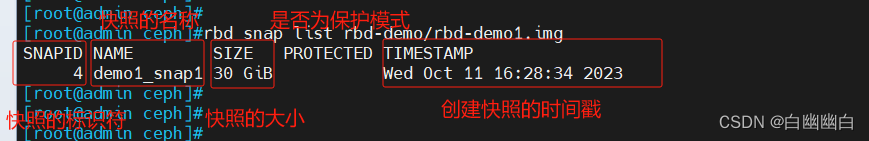

#列出指定镜像所有快照

rbd snap list rbd-demo/rbd-demo1.img##输出信息详解##

- `SNAPID`: 快照的唯一标识符,用于在存储系统中识别和管理快照

- `NAME`: 快照的名称

- `SIZE`: 快照的大小

- `PROTECTED`: 表示快照是否被保护

- `TIMESTAMP`: 快照的创建时间戳

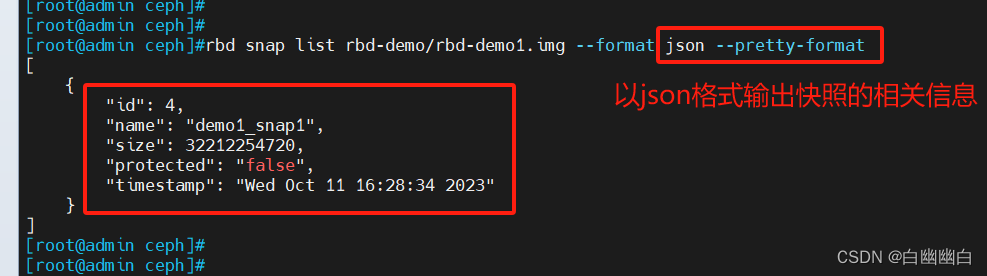

#用json格式输出:

rbd snap list rbd-demo/rbd-demo1.img --format json --pretty-format

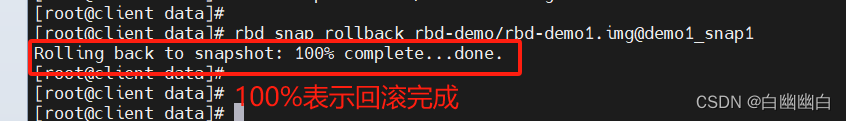

Step3 回滚RBD 镜像到指定的快照

在回滚快照之前,需要将镜像取消镜像的映射,然后再回滚。

1)在客户端解除挂载和映射

#删除写入文件

rm -rf /data/bb/*#解挂载

umount /data/bb#取消映射

rbd unmap rbd-demo/rbd-demo1.img

2)在管理节点回滚RBD镜像

#RBD 镜像恢复到指定的快照状态

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1

3)在客户端重新映射并挂载

#重新映射

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount#挂载

mount /dev/rbd0 /data/bb

Step4 观察数据是否恢复

ls /data/bb

5.4 镜像的导出导入

5.4.1 导出镜像

#导出 RBD 镜像 rbd-demo/rbd-demo1.img 到/opt

rbd export rbd-demo/rbd-demo1.img /opt/rbd-demo1.img

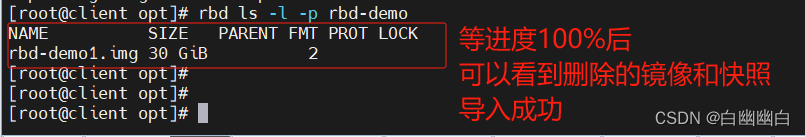

5.4.2 导入镜像

#卸载客户端挂载,并取消映射

umount /data/bbrbd unmap rbd-demo/rbd-demo1.img#清除镜像下的所有快照,并删除镜像

rbd snap purge rbd-demo/rbd-demo1.img

rbd rm rbd-demo/rbd-demo1.imgrbd ls -l -p rbd-demo

#导入镜像

rbd import /opt/rbd-demo1.img rbd-demo/rbd-demo1.imgrbd ls -l -p rbd-demo

六、对象存储RGW接口

6.1 对象存储的概念

对象存储(object storage)是非结构数据的存储方法,对象存储中每一条数据都作为单独的对象存储,拥有唯一的地址来识别数据对象,通常用于云计算环境中。

不同于其他数据存储方法,基于对象的存储不使用目录树。

6.2 相关组件

从客户端的角度来看,分为以下几个逻辑单位

1)Amazon S3

提供了

1、用户(User)

2、存储桶(Bucket)

3、对象(Object)

三者的关系是:

1、User将Object存储到系统上的Bucket;

2、存储桶属于某个用户并可以容纳对象,一个存储桶用于存储多个对象;

3、同一个用户可以拥有多个存储桶,不同用户允许使用相同名称的Bucket,因此User名称即可做为Bucket的名称空间。

2)OpenStack Swift

提供了user、container和object分别对应于用户、存储桶和对象。

不过它还额外为user提供了父级组件account,用于表示一个项目或用户,因此一个account中可以包含一到多个user,它们可共享使用同一组container,并为container提供名称空间

3)RadosGW

提供了user、subuser、bucket和object。

其中的user对应于S3的user,而subuser则对应于Swift的user,不过user和subuser都不支持为bucket提供名称空间,因此不同用户的存储桶不允许同名;

不过,自jewel版本起,RadosGW引入了tenant(租户)用于为user和bucket提供名称空间,但他是个可选组件

6.3 组件之间的关系

1)S3和Swift可基于http或https完成数据交换,由RadosGW内建的Civetweb提供服务;

2)它还可以支持代理服务器包括nginx、haproxy等以代理的形式接收用户请求,再转发至RadosGW进程;

3)RGW 的功能依赖于对象网关守护进程实现,负责向客户端提供 REST API 接口;

4)出于冗余负载均衡的需求,一个 Ceph 集群上通常不止一个 RadosGW 守护进程。

七、创建RGW接口

7.1 在管理节点创建一个 RGW 守护进程

(生产环境下此进程一般需要高可用,后续介绍)

cd /etc/cephceph-deploy rgw create node01

ceph -s

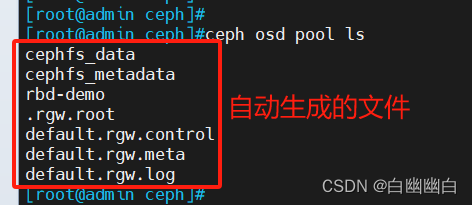

#创建成功后默认情况下会自动创建一系列用于 RGW 的存储池

ceph osd pool lsrgw.root

default.rgw.control #控制器信息

default.rgw.meta #记录元数据

default.rgw.log #日志信息

default.rgw.buckets.index #为 rgw 的 bucket 信息,写入数据后生成

default.rgw.buckets.data #是实际存储的数据信息,写入数据后生成

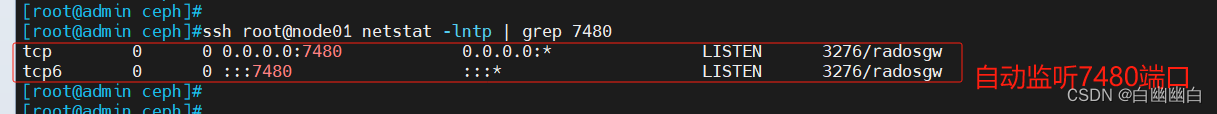

#默认情况下 RGW 监听 7480 号端口

ssh root@node01 netstat -lntp | grep 7480curl node01:7480

7.2 开启 http+https ,更改监听端口

RadosGW 守护进程内部由 Civetweb 实现,通过对 Civetweb 的配置可以完成对 RadosGW 的基本管理。

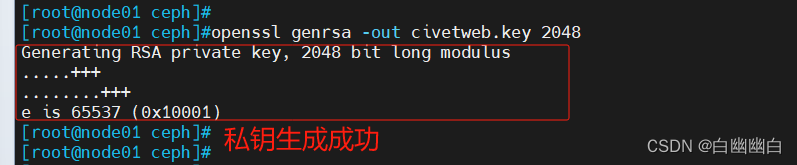

Step1 在rgw节点生成证书

要在 Civetweb 上启用SSL,首先需要一个证书。

1)生成CA证书私钥

#在 rgw 节点生成证书

openssl genrsa -out civetweb.key 2048

2)生成CA证书公钥

openssl req -new -x509 -key civetweb.key -out civetweb.crt -days 3650 -subj "/CN=192.168.2.102"

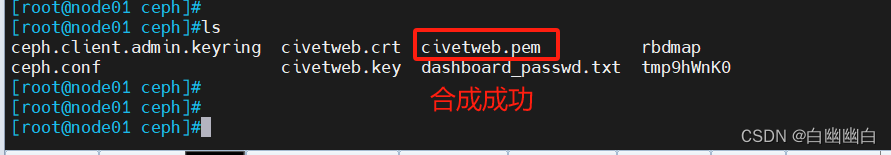

3)将生成的证书合并为pem

cat civetweb.key civetweb.crt > /etc/ceph/civetweb.pem

Step2 更改监听端口

Civetweb 默认监听在 7480 端口并提供 http 协议。

如果需要修改配置需要在管理节点编辑 ceph.conf 配置文件

cd /etc/cephvim ceph.conf

......

[client.rgw.node01]

rgw_host = node01

rgw_frontends = "civetweb port=80+443s ssl_certificate=/etc/ceph/civetweb.pem num_threads=500 request_timeout_ms=60000"------------------------------------------------------------

●rgw_host:对应的RadosGW名称或者IP地址

●rgw_frontends:这里配置监听的端口,是否使用https,以及一些常用配置:

•port:如果是https端口,需要在端口后面加一个s。

•ssl_certificate:指定证书的路径。

•num_threads:最大并发连接数,默认为50,根据需求调整,通常在生产集群环境中此值应该更大

•request_timeout_ms:发送与接收超时时长,以ms为单位,默认为30000

•access_log_file:访问日志路径,默认为空

•error_log_file:错误日志路径,默认为空

------------------------------------------------------------

#修改完 ceph.conf 配置文件后需要重启对应的 RadosGW 服务,再推送配置文件

ceph-deploy --overwrite-conf config push node0{1..3}ssh root@node01 systemctl restart ceph-radosgw.target

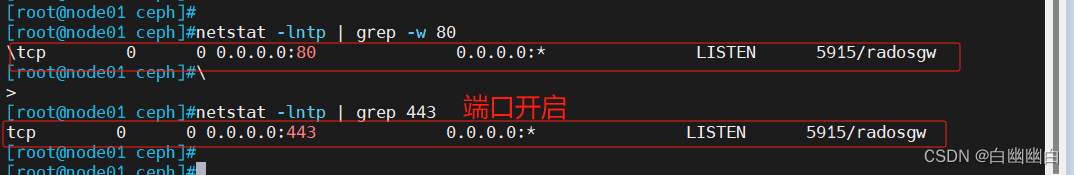

#在 rgw 节点上查看端口

netstat -lntp | grep -w 80

netstat -lntp | grep 443

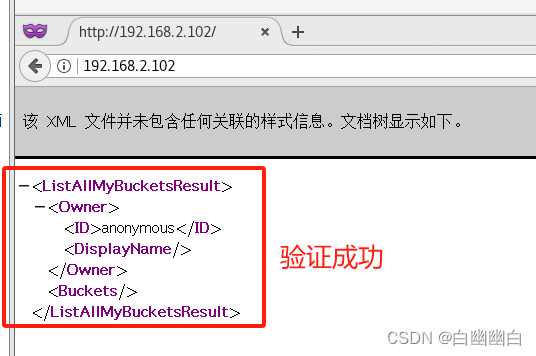

Step3 在客户端访问验证

curl http://192.168.2.102:80

curl -k https://192.168.2.102:443

7.3 创建 RadosGW 账户

在管理节点使用 radosgw-admin 命令创建 RadosGW 账户。

radosgw-admin user create --uid="rgwuser" --display-name="rgw test user"

#创建成功后将输出用户的基本信息,

#其中最重要的两项信息为

#access_key

#secret_key

#用户创建成后功,如果忘记用户信息可以使用下面的命令查看

radosgw-admin user info --uid="rgwuser"

7.4 接口访问测试

Step1 在客户端安装 python3、python3-pip

#安装

yum install -y python3 python3-pip#查看版本

python3 -Vpip3 -V

Step2 安装 boto 模块,用于测试连接 S3

pip3 install boto

Step3 编写测试脚本

echo 123123 > /opt/123.txt

#编写测试脚本vim test.py#coding:utf-8

import ssl

import boto.s3.connection

from boto.s3.key import Key

try:_create_unverified_https_context = ssl._create_unverified_context

except AttributeError:pass

else:ssl._create_default_https_context = _create_unverified_https_context#test用户的keys信息

access_key = "A74DIOBARKTREHQBMU0W" #输入 RadosGW 账户的 access_key

secret_key = "yvvyTr1ZWjkOnY5rVfmO45Xd60E0MzJGzZhKAWf0" #输入 RadosGW 账户的 secret_key#rgw的ip与端口

host = "192.168.2.102" #输入 RGW 接口的 public 网络地址#如果使用443端口,下述链接应设置is_secure=True

port = 443

#如果使用80端口,下述链接应设置is_secure=False

#port = 80

conn = boto.connect_s3(aws_access_key_id=access_key,aws_secret_access_key=secret_key,host=host,port=port,is_secure=True,validate_certs=False,calling_format=boto.s3.connection.OrdinaryCallingFormat()

)#一:创建存储桶

conn.create_bucket(bucket_name='bucket01')

conn.create_bucket(bucket_name='bucket02')#二:判断是否存在,不存在返回None

exists = conn.lookup('bucket01')

print(exists)

#exists = conn.lookup('bucket02')

#print(exists)#三:获得一个存储桶

bucket1 = conn.get_bucket('bucket01')

bucket2 = conn.get_bucket('bucket02')#四:查看一个bucket下的文件

print(list(bucket1.list()))

print(list(bucket2.list()))#五:向s3上存储数据,数据来源可以是file、stream、or string

#5.1、上传文件

bucket1 = conn.get_bucket('bucket01')

# name的值是数据的key

key = Key(bucket=bucket1, name='myfile')

key.set_contents_from_filename('/opt/123.txt')

# 读取 s3 中文件的内容,返回 string 即文件 123.txt 的内容

print(key.get_contents_as_string())#5.2、上传字符串

#如果之前已经获取过对象,此处不需要重复获取

bucket2 = conn.get_bucket('bucket02')

key = Key(bucket=bucket2, name='mystr')

key.set_contents_from_string('hello world')

print(key.get_contents_as_string())#六:删除一个存储桶,在删除存储桶本身时必须删除该存储桶内的所有key

bucket1 = conn.get_bucket('bucket01')

for key in bucket1:key.delete()

bucket1.delete()

Step4 执行 python 脚本,测试访问 S3 接口

python3 test.py

八、OSD 故障模拟与恢复

如果 ceph 集群有上千个 osd,每天坏 2~3 个太正常了,我们可以模拟 down 掉一个 osd。

8.1 模拟 OSD 故障

#如果 osd 守护进程正常运行,down 的 osd 会很快自恢复正常

#所以需要先关闭守护进程

ssh root@node01 systemctl stop ceph-osd@0

#down 掉 osd

ceph osd down 0ceph osd tree

8.2 故障恢复

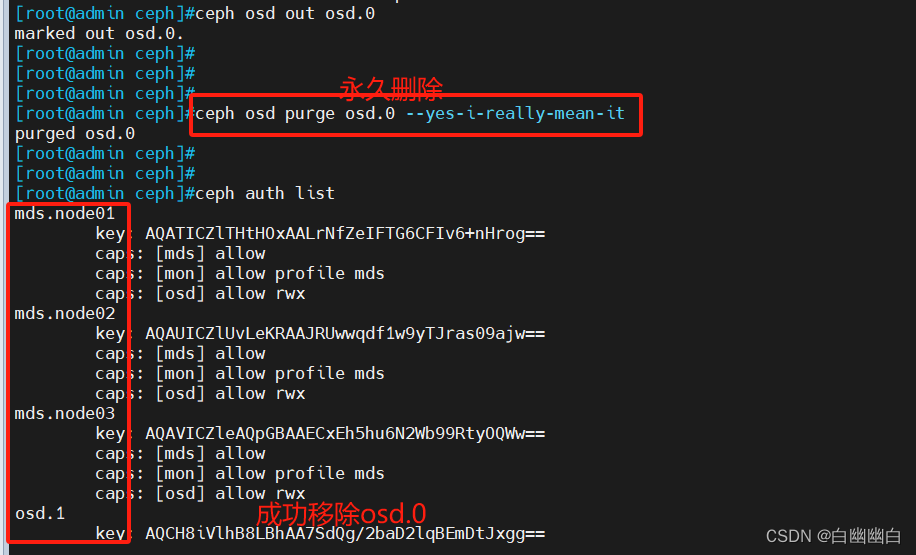

Step1 将坏掉的 osd 踢出集群

方法一

#将 osd.0 移出集群,集群会开始自动同步数据

ceph osd out osd.0#将 osd.0 移除 crushmap

ceph osd crush remove osd.0

#删除守护进程对应的账户信息

ceph auth rm osd.0ceph auth list#删掉 osd.0

ceph osd rm osd.0

ceph osd stat

ceph -s

方法二

#将 osd.0剥离出Ceph集群

ceph osd out osd.0#彻底从 Ceph 存储集群中永久删除 osd.0

ceph osd purge osd.0 --yes-i-really-mean-it

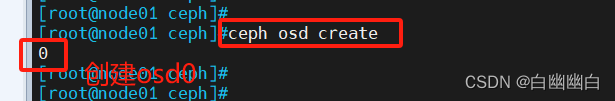

Step2 把原来坏掉的 osd 修复后重新加入集群

#在 osd 节点创建 osd,无需指定名,会按序号自动生成

cd /etc/cephceph osd create

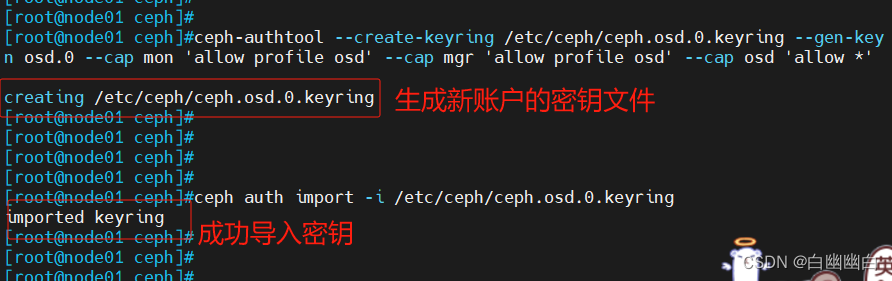

#创建账户

ceph-authtool --create-keyring /etc/ceph/ceph.osd.0.keyring --gen-key -n osd.0 --cap mon 'allow profile osd' --cap mgr 'allow profile osd' --cap osd 'allow *'#导入新的账户秘钥

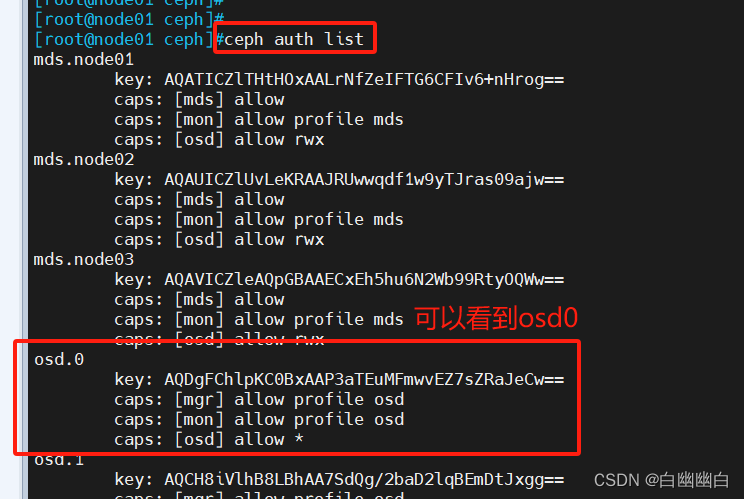

ceph auth import -i /etc/ceph/ceph.osd.0.keyringceph auth list

#更新对应的 osd 文件夹中的密钥环文件

ceph auth get-or-create osd.0 -o /var/lib/ceph/osd/ceph-0/keyring#加入 crushmap

ceph osd crush add osd.0 1.000 host=node01 #1.000 代表权重#加入集群

ceph osd in osd.0ceph osd tree

Step3 重启守护进程,观察故障是否恢复

#重启 osd 守护进程

systemctl restart ceph-osd@0ceph osd tree #稍等片刻后 osd 状态为 up

Step4 重启失败的解决方案(补充)

#报错

Job for ceph-osd@0.service failed because start of the service was attempted too often. See "systemctl status ceph-osd@0.service" and "journalctl -xe" for details.

To force a start use "systemctl reset-failed ceph-osd@0.service" followed by "systemctl start ceph-osd@0.service" again.

#运行

systemctl reset-failed ceph-osd@0.service && systemctl restart ceph-osd@0.service

相关文章:

分布式存储系统Ceph应用详解

Ceph的应用 一、Ceph 存储池(Pool)1.1 Ceph存储池的基本概念1.2 原理1.3 一个Pool资源池应该包含多少PG数?1.4 Ceph 存储池相关管理命令1.4.1 创建1.4.2 查看1.4.3 修改1.4.4 删除 二、 CephFS文件系统MDS接口三、创建CephFS文件系统MDS接口3.1 服务端操作Step1 在管…...

人工智能轨道交通行业周刊-第63期(2023.10.9-10.15)

本期关键词:一体化智慧列车运行系统、车辆数字化运维管理、智能传感器、PHM、LKJ 1 整理涉及公众号名单 1.1 行业类 RT轨道交通人民铁道世界轨道交通资讯网铁路信号技术交流北京铁路轨道交通网上榜铁路视点ITS World轨道交通联盟VSTR铁路与城市轨道交通RailMetro…...

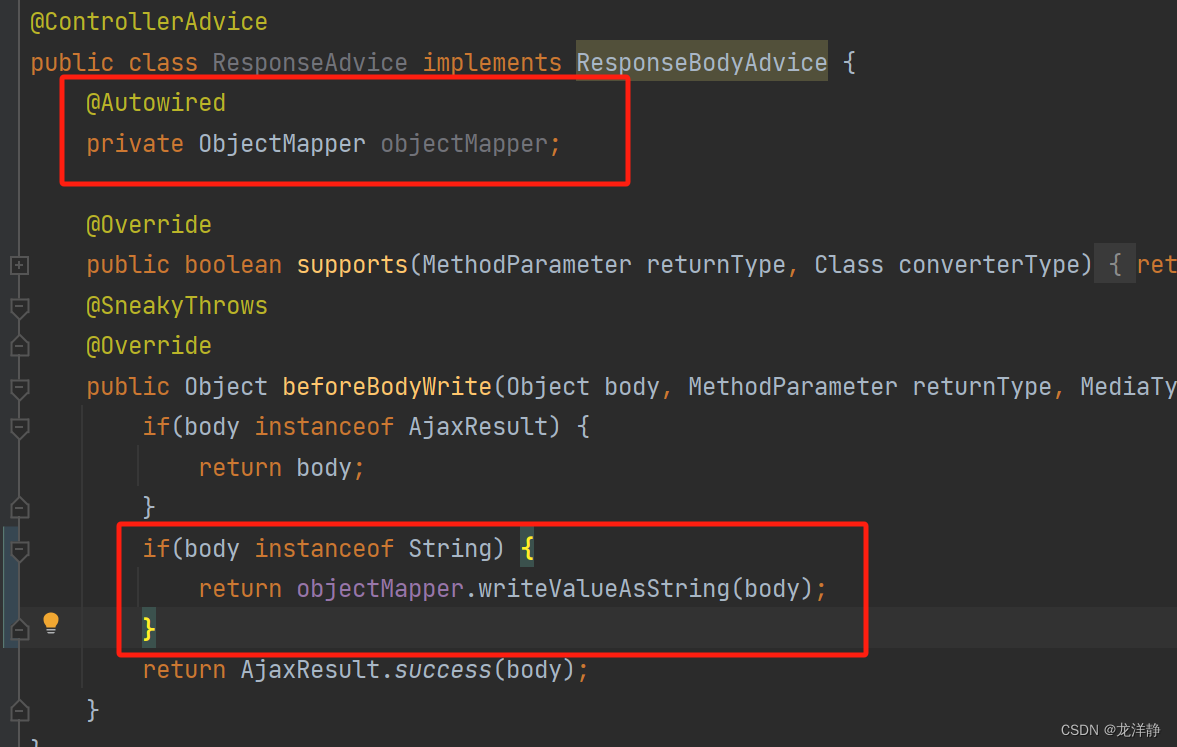

OJ项目——统一数据格式返回,我是如何处理的?

目录 前言 OJ项目中是如何处理的 1、准备一个类,作为统一的数据返回格式 2、准备一个类,实现ResponseBodyAdvice接口 3、我们如何写返回值更好 4、进一步优化返回值 小结 前言 关于SpringBoot的同一功能处理,本博主在这篇博客已经有介…...

Open CV 3D Python 环境搭建

1、安装Windows-Python环境 下载exe 并安装 https://python.p2hp.com/downloads/windows/index.html 安装路径随意, 基本一路默认,下一步、下一步 注意有个钩:添加到环境变量 检测是否成功安装Python 环境 CMD输入python 2、安装OpenCV -Python 包来自清华大学…...

C#中lock 和 ReaderWriterLock 的使用总结

线程锁是多线程并发共享数据,保证一致性的工具。多线程可以同时运行多个任务但是当多个线程同时访问共享数据时,可能导致数据不同步。当有多个线程访问同一对象的加锁方法或代码块时,同一时间只有一个线程在执行,其余线程必须要等…...

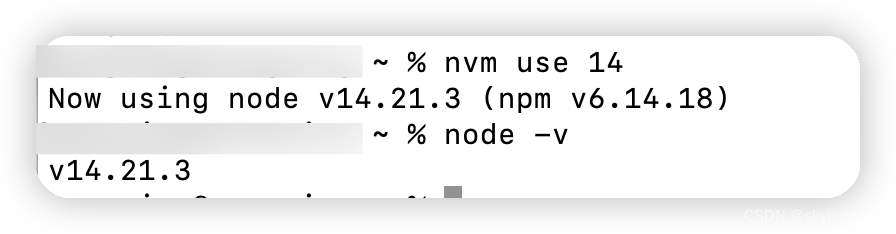

Mac下通过nvm管理node

背景 本地有两个项目,老项目需要用到node 14,新项目需要用node 16,所以只能通过nvm来管理node了 卸载原始的node 我的node是通过官网的.pkg文件安装的,可以通过以下命令进行删除 sudo rm -rf /usr/local/{bin/{node,npm},lib/…...

易点易动固定资产管理系统:RFID出入监控,保障固定资产安全

在企业管理中,固定资产的安全和管理一直是一项重要的任务。企业往往面临着固定资产丢失、盗窃和不当使用等问题,给企业带来巨大的经济损失和管理难题。为了解决这些问题,我们推出了易点易动固定资产管理系统,结合RFID出入监控技术…...

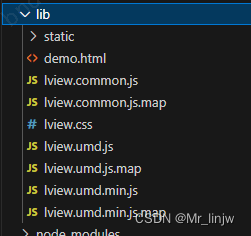

Vue封装组件并发布到npm仓库

1. 环境准备 因为我们此次封装的是Vue组件,所以我们直接在Vue脚手架项目里面进行封装即可。 (1)初始化Vue项目 vue create lin-vue (2)运行项目 npm run serve 2. 组件封装 新建src/components文件夹 因为我们可…...

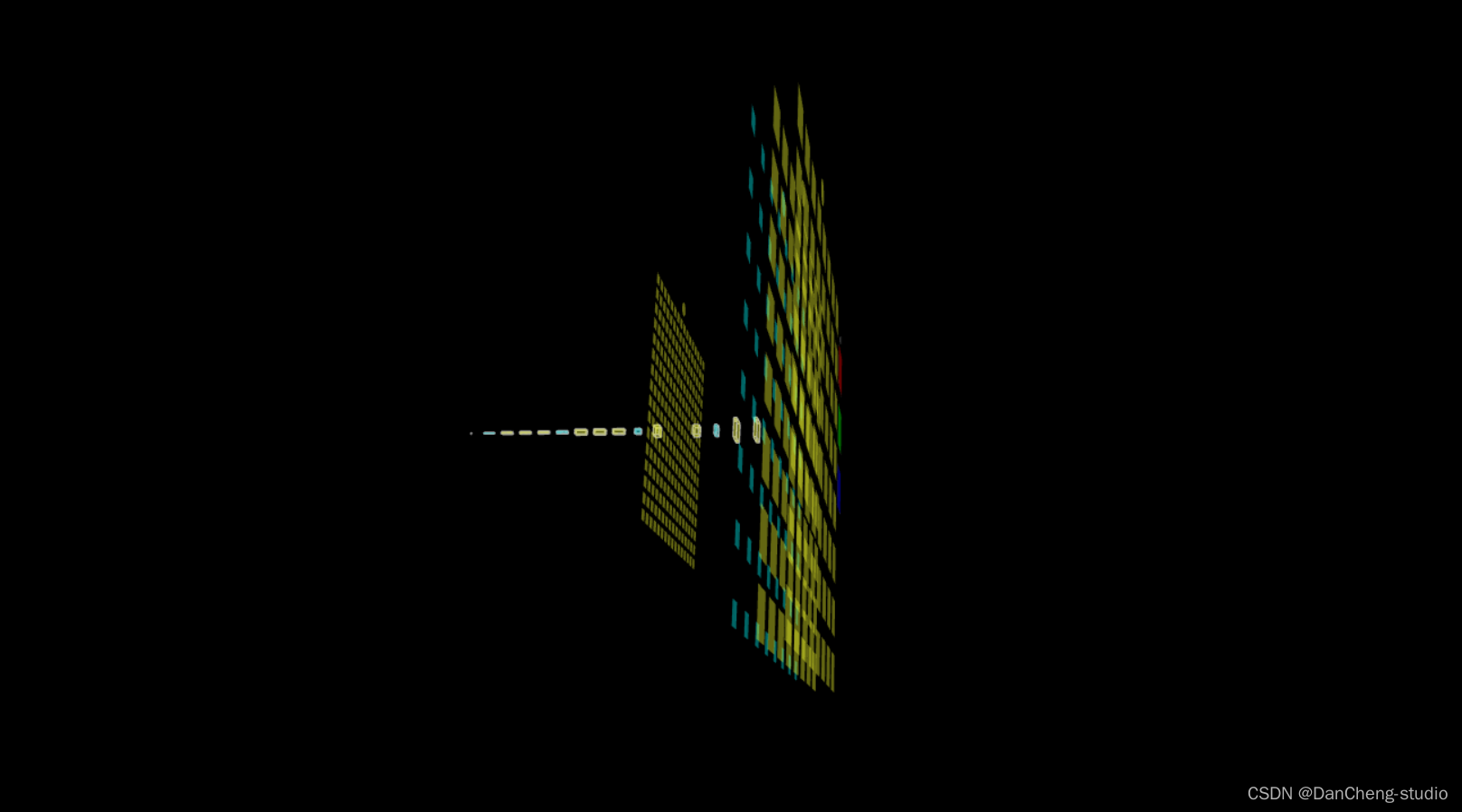

python+深度学习+opencv实现植物识别算法系统 计算机竞赛

0 前言 🔥 优质竞赛项目系列,今天要分享的是 🚩 基于深度学习的植物识别算法研究与实现 🥇学长这里给一个题目综合评分(每项满分5分) 难度系数:4分工作量:4分创新点:4分 🧿 更多…...

基于springboot实现医院急诊平台系统项目【项目源码】

基于springboot实现医院急诊平台系统演示 Spring Boot框架 Spring Boot是Pivotal团队的一个新框架,旨在简化新Spring应用程序的初始设置和开发。该框架使用特定的配置方法,无需开发人员定义样板配置。通过这种方式,Spring Boot旨在成为蓬勃发…...

【02】基础知识:React - jsx语法规则

一、jsx 简介 全称为JavaScript XML,是 react 定义的一种类似于 XML 的 JS 扩展语法 JS XML 本质是 React.createElement(component, props, …children) 方法的语法糖,用来简化创建虚拟 DOM 写法:var ele <h1>Hello JSX!</h1&…...

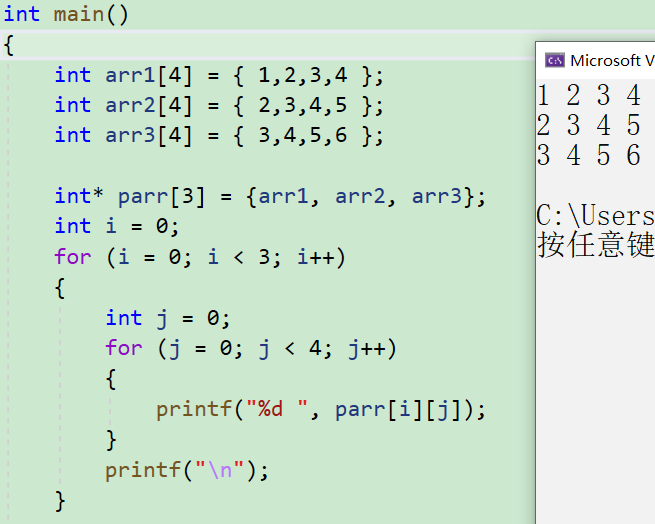

C语言 —— 指针

目录 1. 指针是什么? 2. 指针和指针类型的关系 2.1 指针的解引用 2.2 指针-整数 3. 野指针 3.1 野指针成因 1. 指针未初始化 2. 指针越界访问 3. 指针指向的空间释放 3.2 如何规避野指针 4. 指针运算 4.1 指针-整数 4.2 指针-指针 指针-指针的使用 4.3 指针的关系运…...

淘宝店铺所有商品数据接口,淘宝整店所有商品数据接口,淘宝店铺商品接口,淘宝API接口

淘宝店铺所有商品数据接口可以通过淘宝开放平台获取。以下是具体步骤: 在开放平台注册成为开发者并创建一个应用,获取到所需的 App Key 和 App Secret 等信息。使用获取到的 App Key 和 App Secret 进行签名和认证,获取 Access Token。调用开…...

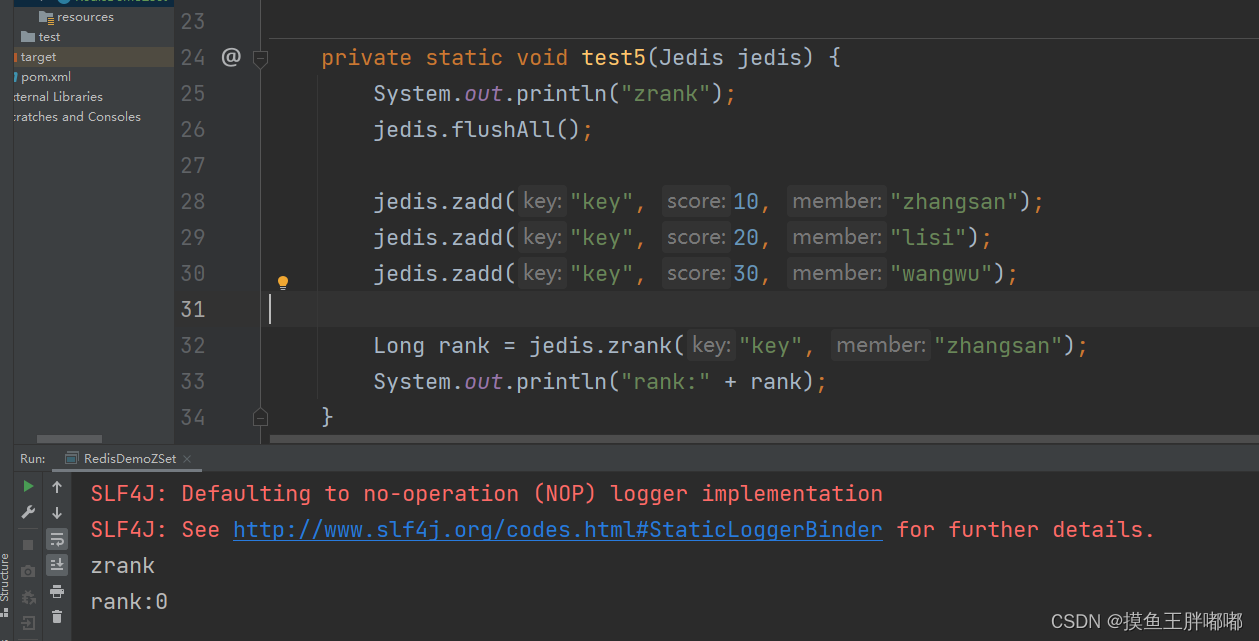

【Redis】Java客户端使用zset命令

zadd/zrange zcard zrem zscore zrank...

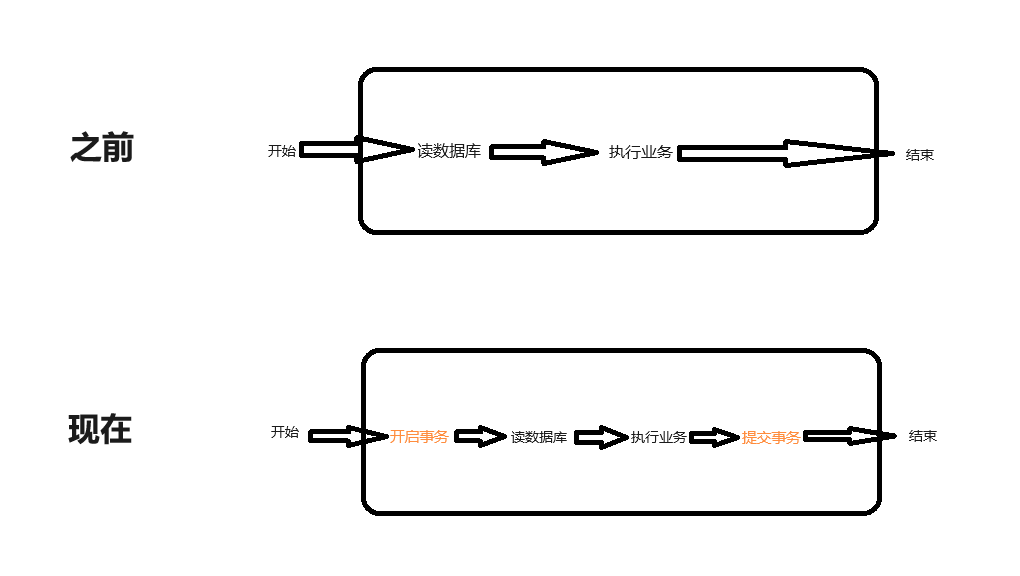

记录一个@Transaction注解引发的bug

记录一个Transactional(readOnly true)注解引发的bug 一、问题代码和报错 1-1 问题代码模拟 引发这个问题的三大要素分别是: 事务注解任意数据库操作数据库操作后执行耗时业务(耗时超过数据库配置的超时时间) //1.这里是问题的核心之一…...

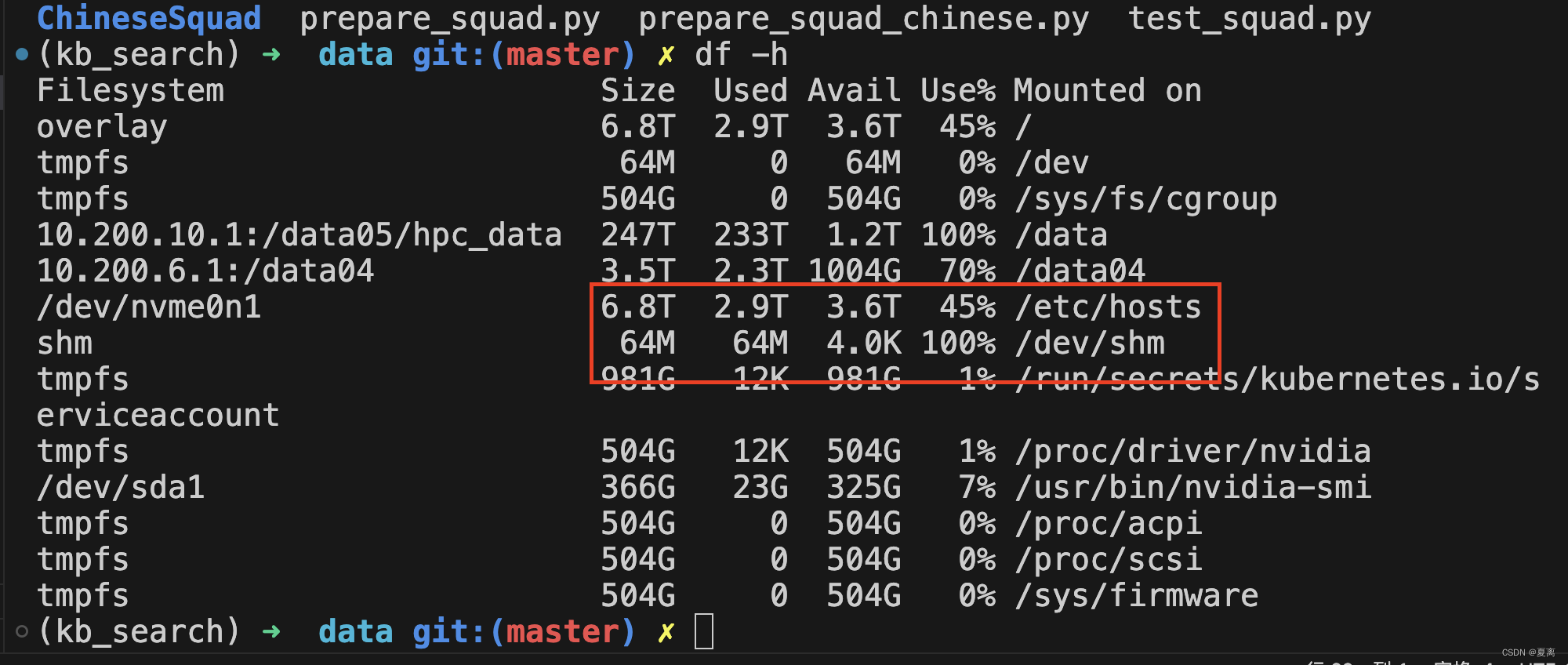

解决docker使用pandarallel报错OSError: [Errno 28] No space left on device

参考:https://github.com/nalepae/pandarallel/issues/127 在使用pandarallel报错OSError: [Errno 28] No space left on device,根据上述issue发现确实默认使用的MEMORY_FS_ROOT为 /dev/shm,而在docker环境下这个目录大小只有64M࿰…...

Javascript自定义页面复制事件

Javascript自定义页面复制事件 – WhiteNights Site 2023年10月13日 文章访问量:90 标签:Javascript 监听copy事件以达到自定义页面复制功能的效果。 写者注 需要注意的是,浏览器的部分拓展插件(如迅雷)会导致本文…...

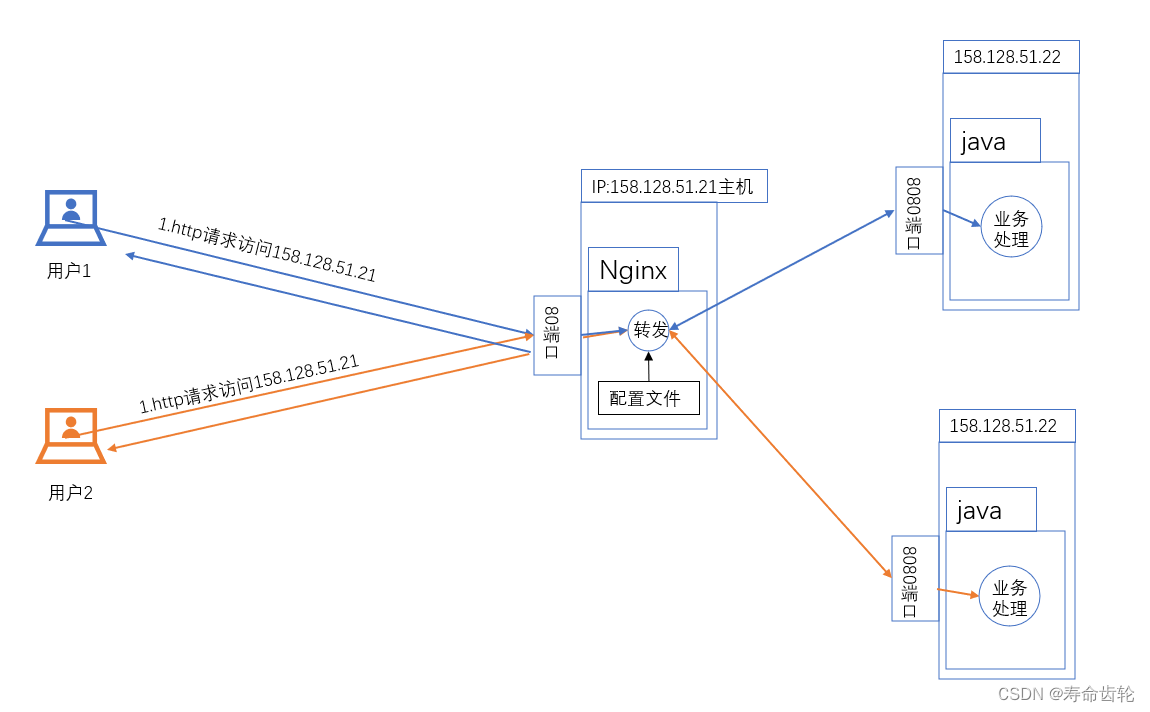

Nginx:反向代理(示意图+配置)

示意图: 反向代理 反向代理(Reverse Proxy)是代理服务器的一种,它代表服务器接收客户端的请求,并将这些请求转发到适当的服务器。当请求在后端服务器完成之后,反向代理搜集请求的响应并将其传输给客户端。…...

macbook笔记本电脑内存怎么清理才能干净流畅?

假如你还在为“你的系统内存不足”的提示所困扰,或者你的Mac电脑突然运行缓慢和卡顿,那么你一般需要认真了解一下macbook内存怎么清理了? MacBook是功能强大的电脑,这点毫无疑问,但是它仍旧会随着时间推移变得运行缓慢。值得庆幸…...

spark 与 mapreduce 对比

Spark 为什么比 MapReduce 快总结 首先澄清几个误区: 1)两者都是基于内存计算的,任何计算框架都肯定是基于内存的,所以说网上所说的 Spark 是基于内存计算所以快,显然是错误的。 2)DAG 计算模型减少的是磁…...

iptables实战指南:从链表关系到规则配置的完整解析

1. iptables基础概念与核心组件 第一次接触iptables时,我盯着那些复杂的规则配置看了整整一个下午。后来才发现,理解iptables的关键在于掌握它的"四表五链"架构。简单来说,iptables就像是一个多层安检系统,数据包要经过…...

ai赋能centos7开发,用快马平台智能生成优化配置和部署流水线

最近在折腾CentOS7的开发环境配置,发现手动搭建Python/Java环境、调试服务编排特别耗时。后来尝试用InsCode(快马)平台的AI辅助功能,效率直接翻倍。分享下我的实践过程: 环境配置方案生成 输入"CentOS7 Python3.9Java11开发环境"后…...

Super IO:Blender文件操作效率革命,实现300%工作流提速

Super IO:Blender文件操作效率革命,实现300%工作流提速 【免费下载链接】super_io blender addon for copy paste import / export 项目地址: https://gitcode.com/gh_mirrors/su/super_io 在3D设计领域,文件导入导出的繁琐操作常常成…...

FLUX.2-klein-base-9b-nvfp4进阶:利用LSTM时序理解优化视频连贯风格转换

FLUX.2-klein-base-9b-nvfp4进阶:利用LSTM时序理解优化视频连贯风格转换 最近在折腾视频风格转换时,发现一个挺让人头疼的问题:用那些单帧处理的模型,出来的视频总是一闪一闪的,风格也忽明忽暗,看着特别不…...

GME多模态向量模型实战部署:华为云ModelArts一键启动图文检索

GME多模态向量模型实战部署:华为云ModelArts一键启动图文检索 1. 引言:多模态检索的实用价值 想象一下,你正在管理一个大型数字资产库,里面有成千上万的图片和文档。当你想找"去年会议上讨论过的那张数据流程图"时&am…...

基于Moondream2的工业质检系统:缺陷检测与分类

基于Moondream2的工业质检系统:缺陷检测与分类 1. 为什么传统质检方式正在被重新思考 产线上的质检员每天要盯着成百上千件产品,眼睛酸涩、注意力下降,漏检率悄悄爬升。一台设备表面划痕只有0.1毫米宽,人眼在连续工作两小时后&a…...

超高压输电线路空载运行时的电压升高现象解析

1. 为什么空载时线路末端电压会升高? 第一次接触超高压输电线路时,很多工程师都会对这个现象感到困惑:明明没有接任何用电设备,为什么线路末端的电压反而比始端更高?这就像往一根长长的水管里注水,结果发现…...

ContextMenuManager:让Windows交互回归高效本质

ContextMenuManager:让Windows交互回归高效本质 【免费下载链接】ContextMenuManager 🖱️ 纯粹的Windows右键菜单管理程序 项目地址: https://gitcode.com/gh_mirrors/co/ContextMenuManager 当你在Windows系统中右键点击文件时,是否…...

Dism++深度解析:Windows系统管理与优化专业指南

Dism深度解析:Windows系统管理与优化专业指南 【免费下载链接】Dism-Multi-language Dism Multi-language Support & BUG Report 项目地址: https://gitcode.com/gh_mirrors/di/Dism-Multi-language Dism作为一款功能强大的开源Windows系统管理工具&…...

无需编程!Qwen3-ASR语音识别服务5分钟快速部署指南

无需编程!Qwen3-ASR语音识别服务5分钟快速部署指南 1. 开篇:语音识别零门槛体验 想象一下,你刚结束一场跨国会议,需要将录音快速转为文字;或者你收集了大量方言访谈,急需整理成文档。传统方法要么费时费力…...