Kubernetes 部署 kubeflow1.6.1

前言

安装前请注意捋清楚版本关系,如kubeflow版本对应的K8S版本及其相关工具版本等等

我们此处使用的是是kubeflow-1.6.1和K8s-v1.22.8

单机部署

部署K8S

初始化Linux

1.关闭selinux

setenforce 0 && sed -i "s/SELINUX=enforcing/SELINUX=disabled/g" /etc/selinux/config

2.关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

3.设置hostname

hostnamectl set-hostname ai-node

4.关闭swap

swapoff -a && sed -i '/ swap / s/^\(.*\)$/#\1/g' /etc/fstab

5.修改内核参数和模块

cat <<EOF > /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

#使内核参数配置生效

sysctl --system

modprobe br_netfilter

lsmod | grep br_netfilter

6.更新系统及内核(可选)

升级centos7及其内核

安装docker

1.安装docker-ce

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum -y install docker-ce

2.替换国内镜像

{"exec-opts": ["native.cgroupdriver=systemd"],"registry-mirrors": ["https://registry.docker-cn.com","http://hub-mirror.c.163.com","https://docker.mirrors.ustc.edu.cn"]

}3.启动docker-ce

systemctl start docker

systemctl enable docker

安装kubernetes

1.配置yum源

cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=1

# repo_gpgcheck要设置为0,如设置为1会导致后面在install kubelet、kubeadm、kubectl的时候报[Errno -1] repomd.xml signature could not be verified for kubernetes Trying other mirror.

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

2.安装kubernetes基础服务

yum install -y kubelet-1.22.8 kubeadm-1.22.8 kubectl-1.22.8

systemctl start kubelet

systemctl enable kubelet.service

3.初始化K8S

# apiserver-advertise-address指定master的interface,版本号与安装的K8S版本要一致,pod-network-cidr指定Pod网络的范围,这里使用flannel网络方案。

# 安装成功之后,会打印kubeadm join的输出,记得要保存下来,后面需要这个命令将各个节点加入集群中

kubeadm init --apiserver-advertise-address=192.168.0.240 --kubernetes-version v1.22.8 --service-cidr=10.96.0.0/12 --pod-network-cidr=10.244.0.0/16## 如果初始化过程中出现错误,就reset之后重新init

# kubeadm reset

# rm -rf $HOME/.kube/config# 查看是否所有的pod都处于running状态

kubectl get pod -n kube-system -o wide

4.初始化kubectl

mkdir -p $HOME/.kubesudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/configsudo chown $(id -u):$(id -g) $HOME/.kube/config

5.设置kubectl自动补充

source <(kubectl completion bash)

可以加入~/.bashrc中以便在新的session中不需要手动加载

6.网络插件

比较常用的时flannel和calico,flannel的功能比较简单,不具备复杂网络的配置能力,calico是比较出色的网络管理插件,单具备复杂网络配置能力的同时,往往意味着本身的配置比较复杂,所以相对而言,比较小而简单的集群使用flannel,考虑到日后扩容,未来网络可能需要加入更多设备,配置更多策略,则使用calico更好

以下网络插件二选一即可

6.1 安装calico网络插件

kubectl apply -f https://docs.projectcalico.org/manifests/calico.yaml

##这个地址现在404了,应该是官方改版了,请参考官方文档

calico应该改版了,新的部署方式参考官方:install-calico

6.2 安装flannel网络插件

For Kubernetes v1.17+

kubectl apply -f https://raw.githubusercontent.com/flannel-io/flannel/master/Documentation/kube-flannel.yml

7.解除master限制

默认k8s的master节点是不能跑pod的业务,需要执行以下命令解除限制

kubectl taint nodes --all node-role.kubernetes.io/master-

部署kubeflow

下载安装脚本

官方仓库地址:https://github.com/kubeflow/manifests

安装kustomize

kustomize 是一个通过 kustomization 文件定制 kubernetes 对象的工具,它可以通过一些资源生成一些新的资源,也可以定制不同的资源的集合。

wget https://github.com/kubernetes-sigs/kustomize/releases/download/v3.2.0/kustomize_3.2.0_linux_amd64

mv kustomize_3.2.0_linux_amd64 kustomize

chmod +x kustomize

mv kustomize /usr/bin/

镜像同步

1.说明

因为kubeflow的镜像存储在google镜像仓库,国内被墙,因此正常安装方式是不会安装成功的,此时提供两种途径

1.使用国内的同步镜像

2.自己从google仓库同步镜像

第一种方式显然比较简单,但是问题也和明显,镜像很多时候同步并不及时,因此很多镜像都是老版本的,如果想用全新版本安装,想要找到一个合适的镜像仓库,还是比较费劲的

第二种方式就一个要求:使用科技上网【不懂的话还是选第一种方式吧】

因为我们当前需要安装的kubeflow-1.6.1是最新版本,国内的同步仓库目前没发现最新版本,因此,我们选择第二种方式

2.同步

2.1 网络问题搞定后【可以科技上网】,将刚才下载的manifests-1.6.1.tar.gz包解压

tar -zxvf manifests-1.6.1.tar.gz

2.2 进入目录

cd manifests-1.6.1

获取gcr镜像,因为我的网络只无法获取gcr.io, quay.io正常,可以根据需求修改

kustomize build example |grep 'image: gcr.io'|awk '$2 != "" { print $2}' |sort -u

检查一下如果有镜像不带tag,说明提取的时候有问题,将awk去掉后仔细看看,gcr.io仓库下载是需要带tag的,换句话说,好像没有latest

2.3 使用脚本将以上获取的镜像同步至指定仓库,可以是dockerhub,也可以是私有镜像仓库

脚本配置,此脚本是网友编写,源码地址:https://github.com/kenwoodjw/sync_gcr

# tree sync_gcr

sync_gcr/

├── images.txt

├── load_image.py

├── README.md

└── sync_image.py将步骤2.2获取的镜像列表放到images.txt中

修改sync_image.py中的镜像仓库及相关登录信息(如果是public仓库,则不需要login)

# coding:utf-8

import subprocess, os

def get_filename():with open("images.txt", "r") as f:lines = f.read().split('\n')# print(lines)return linesdef pull_image():name_list= get_filename()for name in name_list:if 'sha256' in name:print(name)sha256_name = name.split("@")new_name = sha256_name[0].split("/")[-1]tag = sha256_name[-1].split(":")[-1][0:6]#此处为了加载镜像速度,我放在内网的私有镜像仓库中image = "192.168.8.38:9090/grc-io/" + new_name + ":"+ tagcmd = "docker tag {0} {1}".format(name, image)subprocess.call("docker pull {}".format(name), shell=True)subprocess.run(["docker", "tag", name, image])#subprocess.call("docker login -u user -p passwd", shell=True)subprocess.call("docker push {}".format(image), shell=True)else:new_name = "192.168.8.38:9090/grc-io/" + name.split("/")[-1]cmd = "docker tag {0} {1}".format(name, new_name)subprocess.call("docker pull {}".format(name), shell=True)subprocess.run(["docker", "tag", name, new_name])#subprocess.call("docker login -u user -p passwd", shell=True)subprocess.call("docker push {}".format(new_name), shell=True)if __name__ == "__main__":pull_image()2.4 执行脚本

python sync_image.py

这是一个漫长的过程,主要是需要从gcr.io下载镜像,镜像有大有小,数量较多,下载时间完全看个人网速,慢慢等待

在等待的过程中可以同步修改一下安装文件,即2.5

2.5修改部署文件

因为我们将镜像同步到自己的仓库,所以需要修改一下镜像地址

在manifests-1.6.1目录下,打开配置文件

vim example/kustomization.yaml

新增内容【依据版本不同,镜像版本也不同,请不要无脑照抄】

images:

- name: gcr.io/arrikto/istio/pilot:1.14.1-1-g19df463bbnewName: 192.168.8.38:9090/grc-io/pilotnewTag: "1.14.1-1-g19df463bb"

- name: gcr.io/arrikto/kubeflow/oidc-authservice:28c59efnewName: 192.168.8.38:9090/grc-io/oidc-authservicenewTag: "28c59ef"

- name: gcr.io/knative-releases/knative.dev/eventing/cmd/controller@sha256:dc0ac2d8f235edb04ec1290721f389d2bc719ab8b6222ee86f17af8d7d2a160fnewName: 192.168.8.38:9090/grc-io/controllernewTag: "dc0ac2"

- name: gcr.io/knative-releases/knative.dev/eventing/cmd/mtping@sha256:632d9d710d070efed2563f6125a87993e825e8e36562ec3da0366e2a897406c0newName: 192.168.8.38:9090/grc-io/mtpingnewTag: "632d9d"

- name: gcr.io/knative-releases/knative.dev/eventing/cmd/webhook@sha256:b7faf7d253bd256dbe08f1cac084469128989cf39abbe256ecb4e1d4eb085a31newName: 192.168.8.38:9090/grc-io/webhooknewTag: "b7faf7"

- name: gcr.io/knative-releases/knative.dev/net-istio/cmd/controller@sha256:f253b82941c2220181cee80d7488fe1cefce9d49ab30bdb54bcb8c76515f7a26newName: 192.168.8.38:9090/grc-io/controllernewTag: "f253b8"

- name: gcr.io/knative-releases/knative.dev/net-istio/cmd/webhook@sha256:a705c1ea8e9e556f860314fe055082fbe3cde6a924c29291955f98d979f8185enewName: 192.168.8.38:9090/grc-io/webhooknewTag: "a705c1"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/activator@sha256:93ff6e69357785ff97806945b284cbd1d37e50402b876a320645be8877c0d7b7newName: 192.168.8.38:9090/grc-io/activatornewTag: "93ff6e"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/autoscaler@sha256:007820fdb75b60e6fd5a25e65fd6ad9744082a6bf195d72795561c91b425d016newName: 192.168.8.38:9090/grc-io/autoscalernewTag: "007820"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/controller@sha256:75cfdcfa050af9522e798e820ba5483b9093de1ce520207a3fedf112d73a4686newName: 192.168.8.38:9090/grc-io/controllernewTag: "75cfdc"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/domain-mapping@sha256:23baa19322320f25a462568eded1276601ef67194883db9211e1ea24f21a0bebnewName: 192.168.8.38:9090/grc-io/domain-mappingnewTag: "23baa1"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/domain-mapping-webhook@sha256:847bb97e38440c71cb4bcc3e430743e18b328ad1e168b6fca35b10353b9a2c22newName: 192.168.8.38:9090/grc-io/domain-mapping-webhooknewTag: "847bb9"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/queue@sha256:14415b204ea8d0567235143a6c3377f49cbd35f18dc84dfa4baa7695c2a9b53dnewName: 192.168.8.38:9090/grc-io/queuenewTag: "14415b"

- name: gcr.io/knative-releases/knative.dev/serving/cmd/webhook@sha256:9084ea8498eae3c6c4364a397d66516a25e48488f4a9871ef765fa554ba483f0newName: 192.168.8.38:9090/grc-io/webhooknewTag: "9084ea"

- name: gcr.io/kubebuilder/kube-rbac-proxy:v0.8.0newName: 192.168.8.38:9090/grc-io/kube-rbac-proxynewTag: "v0.8.0"

- name: gcr.io/ml-pipeline/api-server:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/api-servernewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/cache-server:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/cache-servernewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/frontend:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/frontendnewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/metadata-writer:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/metadata-writernewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/minio:RELEASE.2019-08-14T20-37-41Z-license-compliancenewName: 192.168.8.38:9090/grc-io/minionewTag: "RELEASE.2019-08-14T20-37-41Z-license-compliance"

- name: gcr.io/ml-pipeline/mysql:5.7-debiannewName: 192.168.8.38:9090/grc-io/mysqlnewTag: "5.7-debian"

- name: gcr.io/ml-pipeline/persistenceagent:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/persistenceagentnewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/scheduledworkflow:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/scheduledworkflownewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/viewer-crd-controller:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/viewer-crd-controllernewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/visualization-server:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/visualization-servernewTag: "2.0.0-alpha.5"

- name: gcr.io/ml-pipeline/workflow-controller:v3.3.8-license-compliancenewName: 192.168.8.38:9090/grc-io/workflow-controllernewTag: "v3.3.8-license-compliance"

- name: gcr.io/tfx-oss-public/ml_metadata_store_server:1.5.0newName: 192.168.8.38:9090/grc-io/ml_metadata_store_servernewTag: "1.5.0"

- name: gcr.io/ml-pipeline/metadata-envoy:2.0.0-alpha.5newName: 192.168.8.38:9090/grc-io/metadata-envoynewTag: "2.0.0-alpha.5"

具体位置

apiVersion: kustomize.config.k8s.io/v1beta1

kind: Kustomizationresources:

# Cert-Manager

- ../common/cert-manager/cert-manager/base

- ../common/cert-manager/kubeflow-issuer/base

# Istio

- ../common/istio-1-14/istio-crds/base

- ../common/istio-1-14/istio-namespace/base

- ../common/istio-1-14/istio-install/base

# OIDC Authservice

- ../common/oidc-authservice/base

# Dex

- ../common/dex/overlays/istio

# KNative

- ../common/knative/knative-serving/overlays/gateways

- ../common/knative/knative-eventing/base

- ../common/istio-1-14/cluster-local-gateway/base

# Kubeflow namespace

- ../common/kubeflow-namespace/base

# Kubeflow Roles

- ../common/kubeflow-roles/base

# Kubeflow Istio Resources

- ../common/istio-1-14/kubeflow-istio-resources/base# Kubeflow Pipelines

- ../apps/pipeline/upstream/env/cert-manager/platform-agnostic-multi-user

# Katib

- ../apps/katib/upstream/installs/katib-with-kubeflow

# Central Dashboard

- ../apps/centraldashboard/upstream/overlays/kserve

# Admission Webhook

- ../apps/admission-webhook/upstream/overlays/cert-manager

# Jupyter Web App

- ../apps/jupyter/jupyter-web-app/upstream/overlays/istio

# Notebook Controller

- ../apps/jupyter/notebook-controller/upstream/overlays/kubeflow

# Profiles + KFAM

- ../apps/profiles/upstream/overlays/kubeflow

# Volumes Web App

- ../apps/volumes-web-app/upstream/overlays/istio

# Tensorboards Controller

- ../apps/tensorboard/tensorboard-controller/upstream/overlays/kubeflow

# Tensorboard Web App

- ../apps/tensorboard/tensorboards-web-app/upstream/overlays/istio

# Training Operator

- ../apps/training-operator/upstream/overlays/kubeflow

# User namespace

- ../common/user-namespace/base# KServe

- ../contrib/kserve/kserve

- ../contrib/kserve/models-web-app/overlays/kubeflow

images:

- name: gcr.io/arrikto/istio/pilot:1.14.1-1-g19df463bbnewName: 192.168.8.38:9090/grc-io/pilotnewTag: "1.14.1-1-g19df463bb"

- name: gcr.io/arrikto/kubeflow/oidc-authservice:28c59efnewName: 192.168.8.38:9090/grc-io/oidc-authservicenewTag: "28c59ef"

- name: gcr.io/knative-releases/knative.dev/eventing/cmd/controller@sha256:dc0ac2d8f235edb04ec1290721f389d2bc719ab8b6222ee86f17af8d7d2a160fnewName: 192.168.8.38:9090/grc-io/controllernewTag: "dc0ac2"

........

2.6 创建PV(可选)

如果你的单机集群没有任何Provisioner,那就需要手动创建pv,如果已经安装了相关的Provisioner和StorageClass,那么这一步可以省略。

2.6.1 手工创建

kubeflow中有四个服务是statefulsets,因此需要挂在卷,因为我们是单机安装,所以直接创建local存储即可,PV大小请自行配置

##创建存储卷目录

mkdir -p /opt/kubeflow/{pv1,pv2,pv3,pv4}

# 创建pv的yaml

cat pv.yaml

apiVersion: v1

kind: PersistentVolume

metadata:name: pv-001

spec:capacity:storage: 80GiaccessModes:- ReadWriteOncehostPath:path: "/opt/kubeflow/pv1"---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv-002

spec:capacity:storage: 80GiaccessModes:- ReadWriteOncehostPath:path: "/opt/kubeflow/pv2"---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv-003

spec:capacity:storage: 80GiaccessModes:- ReadWriteOncehostPath:path: "/opt/kubeflow/pv3"---

apiVersion: v1

kind: PersistentVolume

metadata:name: pv-004

spec:capacity:storage: 80GiaccessModes:- ReadWriteOncehostPath:path: "/opt/kubeflow/pv4"

执行创建

kubectl apply -f pv.yaml

2.6.2 OpenEBS 实现 Local PV 动态持久化存储

OpenEBS(https://openebs.io) 是一种模拟了 AWS 的 EBS、阿里云的云盘等块存储实现的基于容器的存储开源软件。具体描述大家可以访问官网,此处进行一下安装教程(简单)

如果大家选择默认安装,则直接执行

kubectl apply -f https://openebs.github.io/charts/openebs-operator.yaml

如果需要进行一些自定义,则可以直接将yaml文件下载下来,修改后再部署,比如默认pv存储路径是/var/openebs/local,一般系统盘较小,如果有单独数据盘,我们可以修改一下OPENEBS_IO_LOCALPV_HOSTPATH_DIR的参数。

同时要修改的还有openebs-hostpath的- name: BasePath的value值,改成跟OPENEBS_IO_LOCALPV_HOSTPATH_DIR相同即可。

查看pod启动情况

kubectl get pods -n openebs

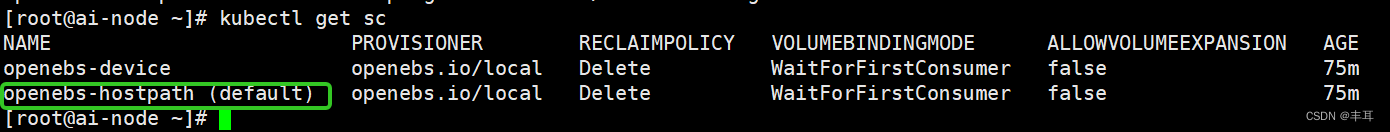

默认情况下 OpenEBS 还会安装一些内置的 StorageClass 对象:

kubectl get sc

设置openebs-hostpath为default sc:

kubectl patch storageclass openebs-hostpath -p '{"metadata": {"annotations":{"storageclass.kubernetes.io/is-default-class":"true"}}}'

使用动态存储的好处是,部署完kubeflow后,使用过程中很多任务都需要pv,比如notebook的创建等。如果还是手工创建pv,那么每次创建新的需要持久化的目标时,就需要手工操作一下pv创建,比较麻烦。动态存储就解决了这些问题

2.7 等镜像全部同步完成后,执行部署

依然在manifests-1.6.1目录下

while ! kustomize build example | kubectl apply -f -; do echo "Retrying to apply resources"; sleep 10; done

查看pod部署情况

kubectl get pods --all-namespaces

[root@ai-node manifests-1.6.1]# kubectl get pods --all-namespaces

NAMESPACE NAME READY STATUS RESTARTS AGE

auth dex-559dbcd758-wmf57 1/1 Running 2 (21h ago) 46h

cert-manager cert-manager-7b8c77d4bd-8jjmd 1/1 Running 2 (21h ago) 46h

cert-manager cert-manager-cainjector-7c744f57b5-vmgws 1/1 Running 2 (21h ago) 46h

cert-manager cert-manager-webhook-fcd445bc4-rspjk 1/1 Running 2 (21h ago) 46h

istio-system authservice-0 1/1 Running 0 5h7m

istio-system cluster-local-gateway-55ff4696f4-ddjzl 1/1 Running 0 5h24m

istio-system istio-ingressgateway-6668f9548d-zh6tp 1/1 Running 0 5h24m

istio-system istiod-64bd848cc4-8ktxh 1/1 Running 0 5h24m

knative-eventing eventing-controller-55c757fbf4-z5z8b 1/1 Running 1 (21h ago) 22h

knative-eventing eventing-webhook-78dccf77d-7xf2c 1/1 Running 1 (21h ago) 22h

knative-serving activator-f6fbdbdd7-kgxjk 2/2 Running 0 21h

knative-serving autoscaler-5c546f654c-w8rmv 2/2 Running 0 21h

knative-serving controller-594bc5bbb9-dn7nx 2/2 Running 0 21h

knative-serving domain-mapping-849f785857-8h9hx 2/2 Running 0 21h

knative-serving domainmapping-webhook-5954cfd85b-hrdcl 2/2 Running 0 21h

knative-serving net-istio-controller-655fd85bc4-gqgrk 2/2 Running 0 21h

knative-serving net-istio-webhook-66c78c9cdb-6lwtl 2/2 Running 0 21h

knative-serving webhook-6895c68dfd-h58l4 2/2 Running 0 21h

kube-system calico-kube-controllers-796cc7f49d-ldvfp 1/1 Running 2 (21h ago) 46h

kube-system calico-node-fdqqp 1/1 Running 2 (21h ago) 46h

kube-system coredns-7f6cbbb7b8-8lwrc 1/1 Running 2 (21h ago) 46h

kube-system coredns-7f6cbbb7b8-cgqkc 1/1 Running 2 (21h ago) 46h

kube-system etcd-ai-node 1/1 Running 2 (21h ago) 46h

kube-system kube-apiserver-ai-node 1/1 Running 2 (21h ago) 46h

kube-system kube-controller-manager-ai-node 1/1 Running 2 (21h ago) 46h

kube-system kube-proxy-4xzxn 1/1 Running 2 (21h ago) 46h

kube-system kube-scheduler-ai-node 1/1 Running 2 (21h ago) 46h

kubeflow-user-example-com ml-pipeline-ui-artifact-69cc696464-mh4pb 2/2 Running 0 3h8m

kubeflow-user-example-com ml-pipeline-visualizationserver-64d797bd94-xn74q 2/2 Running 0 3h9m

kubeflow admission-webhook-deployment-79d6f8c8fb-qkssk 1/1 Running 0 5h24m

kubeflow cache-server-746dd68dd9-qff72 2/2 Running 0 5h23m

kubeflow centraldashboard-f64b457f-6npr2 2/2 Running 0 5h23m

kubeflow jupyter-web-app-deployment-576c56f555-th492 1/1 Running 0 5h23m

kubeflow katib-controller-75b988dccc-d5xsz 1/1 Running 0 5h23m

kubeflow katib-db-manager-5d46869758-9khlf 1/1 Running 0 5h23m

kubeflow katib-mysql-5bf95ddfcc-p55d6 1/1 Running 0 5h23m

kubeflow katib-ui-766d5dc8ff-vngv2 1/1 Running 0 5h24m

kubeflow kserve-controller-manager-0 2/2 Running 0 5h23m

kubeflow kserve-models-web-app-5878544ffd-s8d84 2/2 Running 0 5h23m

kubeflow kubeflow-pipelines-profile-controller-5d98fd7b4f-765x7 1/1 Running 0 5h23m

kubeflow metacontroller-0 1/1 Running 0 5h23m

kubeflow metadata-envoy-deployment-5b96bc6fd6-rfhwj 1/1 Running 0 3h25m

kubeflow metadata-grpc-deployment-59d555db46-gbgn9 2/2 Running 5 (5h22m ago) 5h23m

kubeflow metadata-writer-76bbdb799f-kftpv 2/2 Running 1 (5h22m ago) 5h23m

kubeflow minio-86db59fd6-jv5xv 2/2 Running 0 5h23m

kubeflow ml-pipeline-8587f95f8f-2xl4w 2/2 Running 2 (5h20m ago) 5h24m

kubeflow ml-pipeline-persistenceagent-568f4bddb5-6bqxk 2/2 Running 0 5h24m

kubeflow ml-pipeline-scheduledworkflow-5c74f8dff4-wwpr5 2/2 Running 0 5h24m

kubeflow ml-pipeline-ui-5c684875c-5dm98 2/2 Running 0 5h23m

kubeflow ml-pipeline-viewer-crd-748d77b759-wz5r2 2/2 Running 1 (5h21m ago) 5h23m

kubeflow ml-pipeline-visualizationserver-5b697bd55d-97xwt 2/2 Running 0 3h25m

kubeflow mysql-77578849cc-dtx42 2/2 Running 0 5h23m

kubeflow notebook-controller-deployment-68756676d9-zdbr4 2/2 Running 1 (5h21m ago) 5h23m

kubeflow profiles-deployment-79d49b8648-xd7pg 3/3 Running 1 (5h21m ago) 5h23m

kubeflow tensorboard-controller-deployment-6f879dd7f6-s7mk7 3/3 Running 1 (5h23m ago) 5h23m

kubeflow tensorboards-web-app-deployment-6849d8c9bc-bs52h 1/1 Running 0 5h23m

kubeflow training-operator-6c9f6fd894-qsxcg 1/1 Running 0 5h23m

kubeflow volumes-web-app-deployment-5f56dd78-22jvh 1/1 Running 0 5h23m

kubeflow workflow-controller-686dd58c95-5cmxg 2/2 Running 1 (5h23m ago) 5h23m

等所有容器都起来后,查看80的映射端口是哪个

kubectl -n istio-system get svc istio-ingressgateway

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

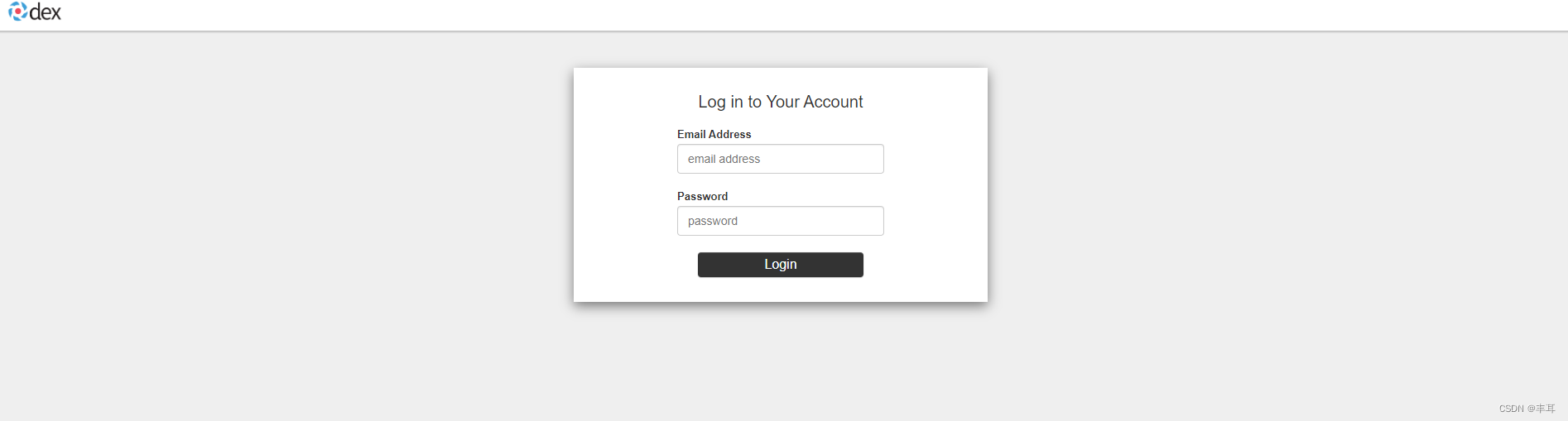

istio-ingressgateway NodePort 10.1.109.168 <none> 15021:30965/TCP,80:31714/TCP,443:30626/TCP,31400:32535/TCP,15443:32221/TCP 46h从输出可以看到80映射的是31714,因此打开kubeflow页面的地址就是http://服务器IP:31714/

登录的账号一般默认是user@example.com,密码:12341234,如果不对,则在dex的configmaps中查看

kubectl -n auth get configmaps dex -o yaml

apiVersion: v1

data:config.yaml: |issuer: http://dex.auth.svc.cluster.local:5556/dexstorage:type: kubernetesconfig:inCluster: trueweb:http: 0.0.0.0:5556logger:level: "debug"format: textoauth2:skipApprovalScreen: trueenablePasswordDB: truestaticPasswords:- email: user@example.comhash: $2y$12$4K/VkmDd1q1Orb3xAt82zu8gk7Ad6ReFR4LCP9UeYE90NLiN9Df72# https://github.com/dexidp/dex/pull/1601/commits# FIXME: Use hashFromEnv insteadusername: useruserID: "15841185641784"staticClients:# https://github.com/dexidp/dex/pull/1664- idEnv: OIDC_CLIENT_IDredirectURIs: ["/login/oidc"]name: 'Dex Login Application'secretEnv: OIDC_CLIENT_SECRET

kind: ConfigMap

metadata:annotations:kubectl.kubernetes.io/last-applied-configuration: |{"apiVersion":"v1","data":{"config.yaml":"issuer: http://dex.auth.svc.cluster.local:5556/dex\nstorage:\n type: kubernetes\n config:\n inCluster: true\nweb:\n http: 0.0.0.0:5556\nlogger:\n level: \"debug\"\n format: text\noauth2:\n skipApprovalScreen: true\nenablePasswordDB: true\nstaticPasswords:\n- email: user@example.com\n hash: $2y$12$4K/VkmDd1q1Orb3xAt82zu8gk7Ad6ReFR4LCP9UeYE90NLiN9Df72\n # https://github.com/dexidp/dex/pull/1601/commits\n # FIXME: Use hashFromEnv instead\n username: user\n userID: \"15841185641784\"\nstaticClients:\n# https://github.com/dexidp/dex/pull/1664\n- idEnv: OIDC_CLIENT_ID\n redirectURIs: [\"/login/oidc\"]\n name: 'Dex Login Application'\n secretEnv: OIDC_CLIENT_SECRET\n"},"kind":"ConfigMap","metadata":{"annotations":{},"name":"dex","namespace":"auth"}}creationTimestamp: "2022-10-25T08:51:08Z"name: dexnamespace: authresourceVersion: "2956"uid: a0716cd6-f259-4a49-bee3-783c1069e8d2staticPasswords.email就是用户名

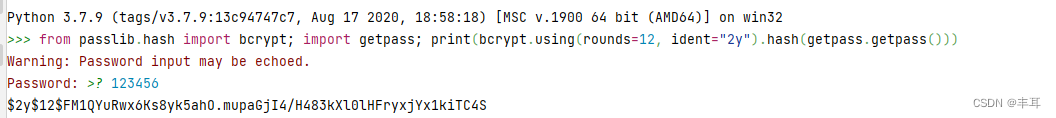

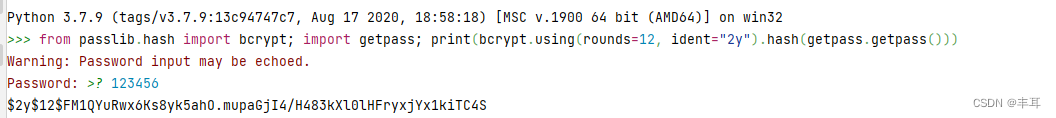

staticPasswords.hash就是密码

生成代码(python):

python console下执行,可生成hash密码

from passlib.hash import bcrypt;import getpass;print(bcrypt.using(rounds=12, ident="2y").hash(getpass.getpass()))

报错修复

1.authservice-0 pod 启动失败

istio-system下的authservice-0启动失败,查看日志返现没有权限操作目录/var/lib/authservice/data.db

authservice-0 pod 启动失败:Error opening bolt store: open /var/lib/authservice/data.db: permission denied

解决方案:

修改common/oidc-authservice/base/statefulset.yaml, 添加以下内容

initContainers:- name: fix-permissionimage: busyboxcommand: ['sh', '-c']args: ['chmod -R 777 /var/lib/authservice;']volumeMounts:- mountPath: /var/lib/authservicename: data

修改后的文件如下vim common/oidc-authservice/base/statefulset.yaml:

apiVersion: apps/v1

kind: StatefulSet

metadata:name: authservice

spec:replicas: 1selector:matchLabels:app: authserviceserviceName: authservicetemplate:metadata:annotations:sidecar.istio.io/inject: "false"labels:app: authservicespec:initContainers:- name: fix-permissionimage: busyboxcommand: ['sh', '-c']args: ['chmod -R 777 /var/lib/authservice;']volumeMounts:- mountPath: /var/lib/authservicename: datacontainers:- name: authserviceimage: gcr.io/arrikto/kubeflow/oidc-authservice:6ac9400imagePullPolicy: Alwaysports:- name: http-apicontainerPort: 8080envFrom:- secretRef:name: oidc-authservice-client- configMapRef:name: oidc-authservice-parametersvolumeMounts:- name: datamountPath: /var/lib/authservicereadinessProbe:httpGet:path: /port: 8081securityContext:fsGroup: 111volumes:- name: datapersistentVolumeClaim:claimName: authservice-pvc

2.kubeflow-user-example-com镜像失败

kubeflow-user-example-com下两个镜像拉取失败

ml-pipeline-ui-artifact、ml-pipeline-visualizationserver

查看后发现拉取的还是gcr.io的镜像,还没来得及分析具体在哪个配置文件中修改,但是镜像跟kubeflow中的是相同的,因此只需要修改两个deploment的镜像地址即可,等有时间再仔细研究下在哪个部署文件修改

集群部署

K8S按照集群部署

kubeflow部署方式不变

相关文章:

Kubernetes 部署 kubeflow1.6.1

前言 安装前请注意捋清楚版本关系,如kubeflow版本对应的K8S版本及其相关工具版本等等 我们此处使用的是是kubeflow-1.6.1和K8s-v1.22.8 单机部署 部署K8S 初始化Linux 1.关闭selinux setenforce 0 && sed -i "s/SELINUXenforcing/SELINUXdisable…...

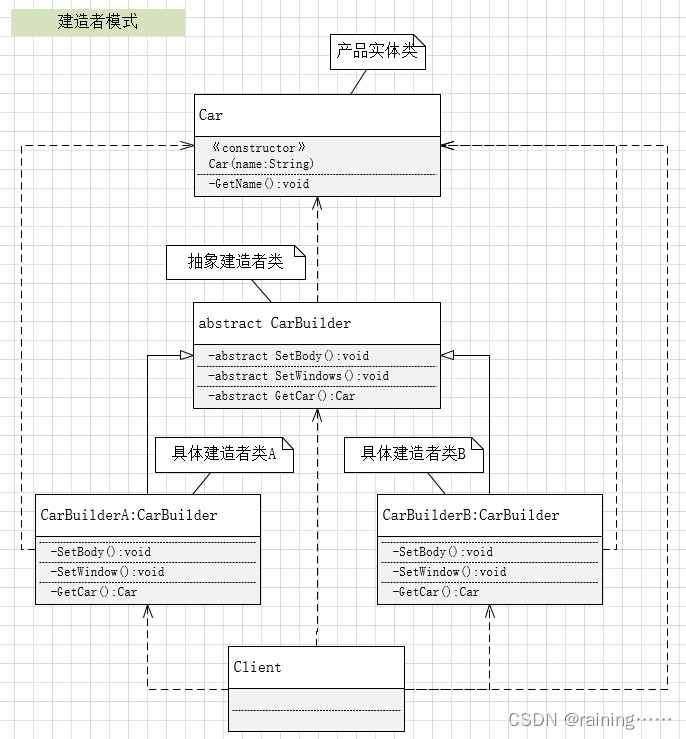

设计模式:建造者模式(C#、JAVA、JavaScript、C++、Python、Go、PHP)

上一篇《策略模式》 下一篇《适配器模式》 简介: 建造者模式,它是一种对象构建模式,它提供了一种构建对象的最佳方式。这种模式适用于当对象的构建过程需要涉及到多个部分ÿ…...

Maxon Cinema 4D 2024:打造独一无二的视觉效果 模拟模块大更新

在视觉效果和3D建模领域,Maxon的Cinema 4D一直以其卓越的性能和创新的功能引领着时代潮流。今天,我们很高兴地宣布推出最新版本——Maxon Cinema 4D 2024(C4D 2024),它将再次提升行业标准,为设计师提供更强…...

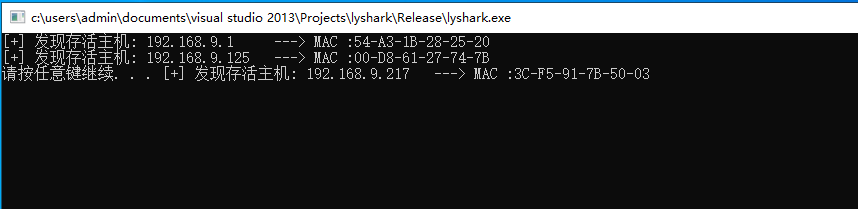

16.2 ARP 主机探测技术

ARP (Address Resolution Protocol,地址解析协议),是一种用于将 IP 地址转换为物理地址(MAC地址)的协议。它在 TCP/IP 协议栈中处于链路层,为了在局域网中能够正确传输数据包而设计,…...

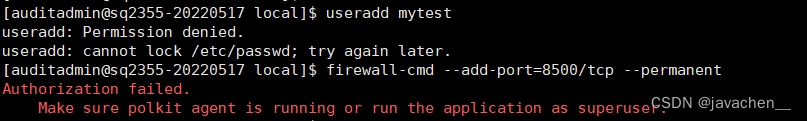

三级等保-linux服务器三权分立设置

安全问题 安全控制点 风险分析 风险等级 标准要求 加固建议 服务器未严格按照系统管理员权限、审计管理员权限、安全管理员权限进行分配管理员账户,未实现管理员用户的最小权限划分。 访问控制 可能存在管理员越权操作的风险 中 d)应授予管理用户所需的最…...

抓取网页的含义和URL基本构成

抓取网页是指通过爬虫程序从互联网上获取网页的内容和数据。抓取网页是爬虫的核心功能之一,通过抓取网页,可以获取到网页中的文本、图片、链接等信息,用于后续的数据分析、挖掘和应用。 URL(Uniform Resource Locator)…...

计算机毕业设计 机器学习深度学习人工智能

视频参考: 计算机毕业设计项目分享_哔哩哔哩_bilibili 基于深度学习的农业病虫害识别基于SpringBootVue的博客系统基于SpringBootVue的仓库管理系统基于卷积网络的花卉图像识别 毕业设计选题: VX:whbwqq123 基于机器学习的大气数据的污染物pm2.5预测基…...

施密特正交化

相信大家在平时的期末考试中一定少不了对某某向量组执行标准正交化类型的题目。今天我们从这个题目入手,说明这个如何执行施密特正交化,以及为什么要进行正交化。 一、例子 例子:设 a 1 [ 1 2 − 1 ] a_1\begin{bmatrix}1\\2\\-1\end{bmat…...

低代码开发:加速应用开发的利器

目录 一、引言 二、低代码开发的定义和原理 三、低代码开发的关键特性和优势 四、低代码开发的应用场景 五、低代码开发平台的市场现状和发展趋势 六、成功案例分析 七、结论 一、引言 随着信息技术的快速发展,企业对于应用开发的需求也日益增长。传统的应用…...

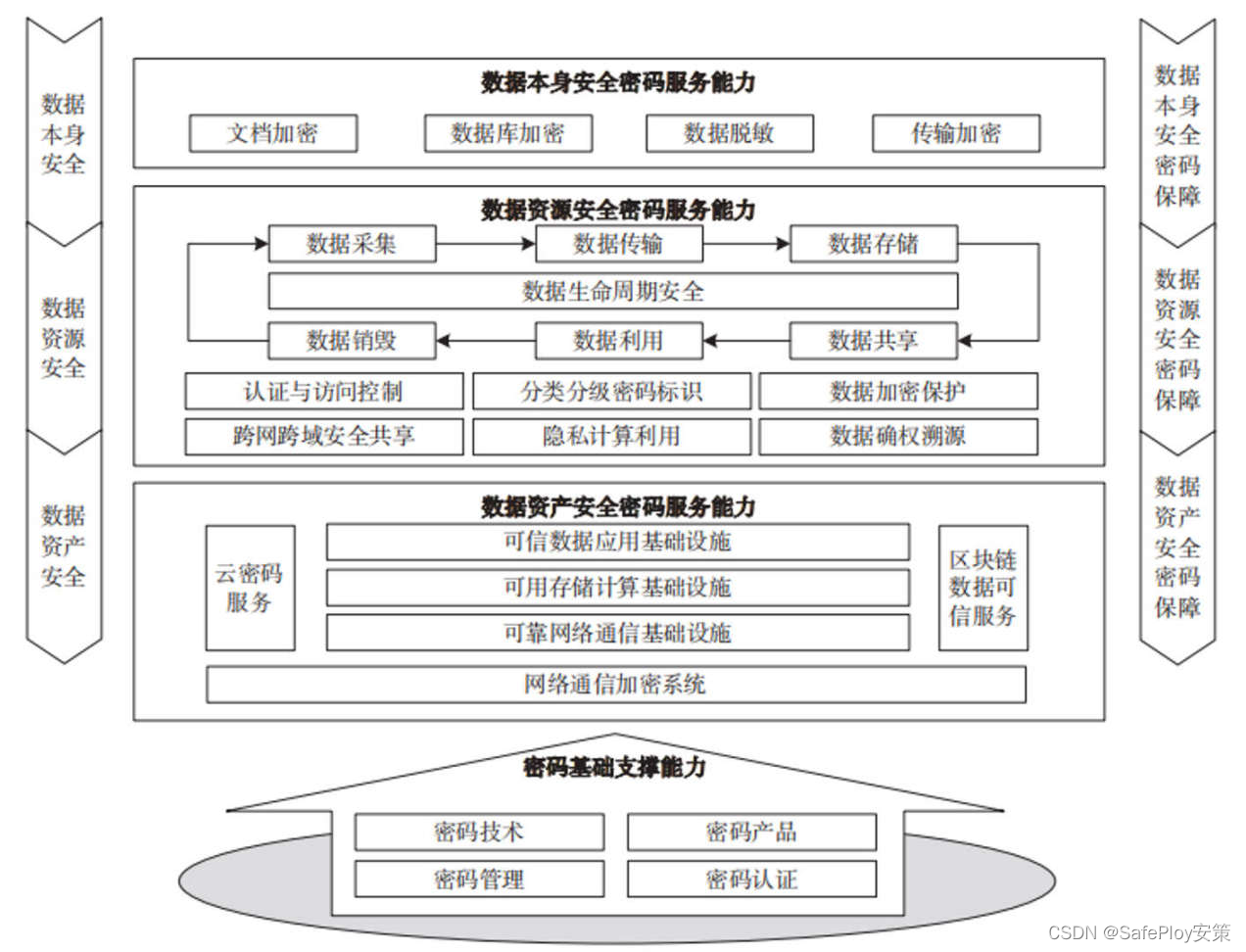

数据安全发展趋势与密码保护技术研究

随着数据跃升为新型生产要素,数据安全的内涵也从数据本身安全、数据资源安全,发展到数据资产安全三个层面提出了不同的要求,本文就是详细探讨数据安全的这三个层面的安全内容进行分析。 通过对数据安全不同发展阶段的安全需求和保障对象进行研…...

368周赛leetcode

1 2题元素和最小的山形三元组 经典动规 题目内容 给你一个下标从 0 开始的整数数组 nums 。 如果下标三元组 (i, j, k) 满足下述全部条件,则认为它是一个 山形三元组 : i < j < k nums[i] < nums[j] 且 nums[k] < nums[j] 请你找出 num…...

Vue 的 nextTick:深入理解异步更新机制

目录 一、前言 二、Vue.js 异步更新机制简述 三、Vue.nextTick原理 四、nextTick 的应用场景 1. 获取更新后的 DOM 元素 2. 在 DOM 更新后执行自定义的回调函数 3. 解决事件监听器中的更新问题 五、Vue.nextTick与其他异步更新方法的比较 六、总结 一、前言 Vue.js&a…...

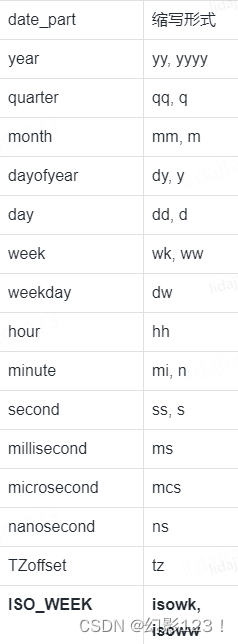

SQL关于日期的计算合集

前言 在SQL Server中,时间和日期是常见的数据类型,也是数据处理中重要的一部分。SQL Server提供了许多内置函数,用于处理时间和日期数据类型。这些函数可以帮助我们执行各种常见的任务,例如从日期中提取特定的部分,计…...

shell_44.Linux使用 getopt 命令

使用 getopt 命令 getopt 命令在处理命令行选项和参数时非常方便。它能够识别命令行参数,简化解析过程 1. 命令格式 getopt 命令可以接受一系列任意形式的命令行选项和参数,并自动将其转换成适当的格式。 getopt 的命令格式如下: getopt opt…...

Linux备份Docker的mysql数据并传输到其他服务器保证数据级容灾

目录 简介什么是容灾 ?容灾的分类容灾和备份有什么连系 ? 数据级容灾备份步骤1、scp命令:用于Linux之间复制文件和目录2、编写备份数据库脚本3、crontab定时任务执行脚本4、测试 应用级容灾业务级容灾 简介 为了防止客户系统的数据丢失&…...

【vue+nestjs】qq第三方授权登录【超详细】

项目场景: 前端使用vue3ts 后端使用nestjs 1.申请appId,appKey 1.进入qq互联官网。创建应用 特别注意 1.在填写网站回调域时,需要你线上真实能访问的。不然审核不通过。我的回调地址是前端路由地址 2.如果你想本地调试,回调到你的线上地址。你可以在本…...

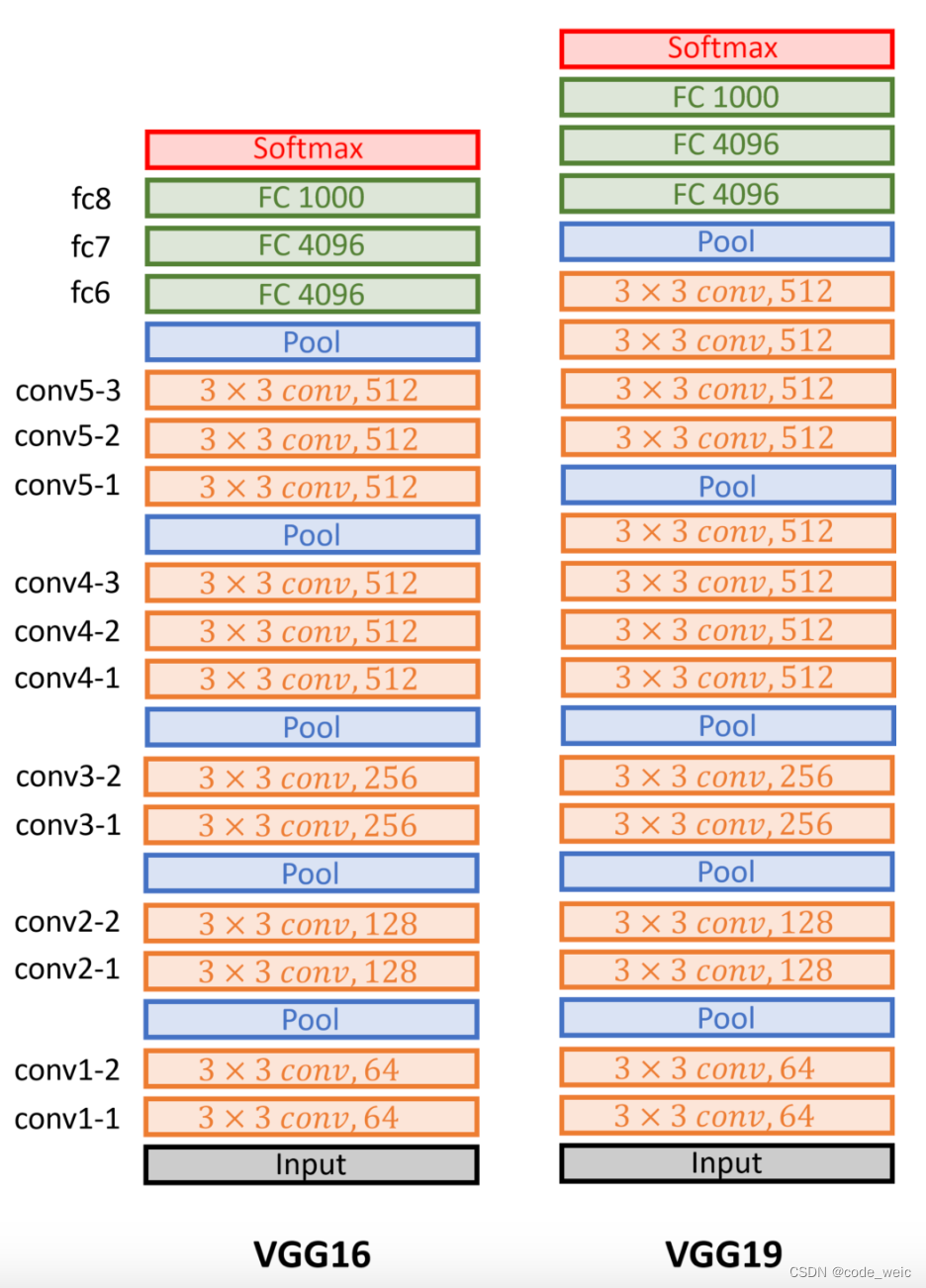

经典卷积神经网络 - VGG

使用块的网络 - VGG。 使用多个 3 3 3\times 3 33的要比使用少个 5 5 5\times 5 55的效果要好。 VGG全称是Visual Geometry Group,因为是由Oxford的Visual Geometry Group提出的。AlexNet问世之后,很多学者通过改进AlexNet的网络结构来提高自己的准确…...

/系统测试(ST)/用户验收测试(UAT))

系统集成测试(SIT)/系统测试(ST)/用户验收测试(UAT)

文章目录 单元测试集成测试系统测试用户验收测试黑盒测试白盒测试压力测试性能测试容量测试安全测试SIT和UAT的区别 单元测试 英文 unit testing,缩写 UT。测试粒度最小,一般由开发小组采用白盒方式来测试,主要测试单元是否符合“设计”。 …...

Android Gradle8.0以上多渠道写法以及针对不同渠道导入包的方式,填坑!

目录 多渠道的写法 针对多渠道引用不同的包 There was a failure while populating the build operation queue: Could not stat file E:\xxxx\xxxx\xxxx\app\src\UAT\libsUAT\xxx-provider(?)-xx.aar 最近升级了Gradle8.3之后,从Groovy 迁移到 Kotlinÿ…...

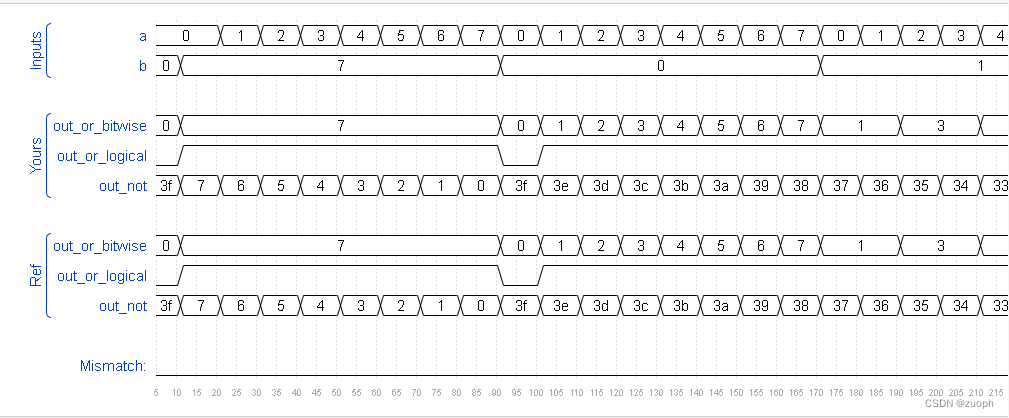

hdlbits系列verilog解答(向量门操作)-14

文章目录 一、问题描述二、verilog源码三、仿真结果 一、问题描述 构建一个具有两个 3 位输入的电路,用于计算两个向量的按位 OR、两个向量的逻辑 OR 以及两个向量的逆 (NOT)。将b反相输出到out_not上半部分,将a 的反相输出到out…...

零基础GDScript编程:3天从游戏小白到开发者的完整指南

零基础GDScript编程:3天从游戏小白到开发者的完整指南 【免费下载链接】learn-gdscript Learn Godots GDScript programming language from zero, right in your browser, for free. 项目地址: https://gitcode.com/gh_mirrors/le/learn-gdscript 想学游戏开…...

Cursor Pro功能解锁技术指南:突破限制与优化使用方案

Cursor Pro功能解锁技术指南:突破限制与优化使用方案 【免费下载链接】cursor-free-vip [Support 0.45](Multi Language 多语言)自动注册 Cursor Ai ,自动重置机器ID , 免费升级使用Pro 功能: Youve reached your tria…...

MySQL8.0大小写敏感坑爹实录:lower_case_table_names从报错到解决的完整过程

MySQL 8.0大小写敏感参数避坑指南:从报错到根治的深度实践 最近在迁移开发环境到Docker时,遇到了一个令人头疼的问题——MySQL 8.0服务无法启动,报错提示Different lower_case_table_names settings for server (2) and data dictionary (0)。…...

5种场景让网易云音乐直链解析API成为开发者必备工具

5种场景让网易云音乐直链解析API成为开发者必备工具 【免费下载链接】netease-cloud-music-api 网易云音乐直链解析 API 项目地址: https://gitcode.com/gh_mirrors/ne/netease-cloud-music-api 你是否曾遇到过分享的音乐链接突然失效的尴尬?作为开发者&…...

MemPalace:构建最强 AI 记忆系统实战指南

👋 你好,我是专注于 AI 工程化落地的技术博主。本文适合正在构建长期记忆型 LLM 应用、苦恼于上下文丢失的开发者阅读。为了验证 MemPalace 的实际效能,我耗时 3 天进行了深度部署与压力测试。本文承诺不翻译文档,只分享经过验证的…...

2026年盘点:谁在引领互联网医疗软件的口碑与运营新风向?

随着2026年的到来,互联网医疗行业已从早期的“跑马圈地”进入“精耕细作”的下半场。单纯的技术堆砌或一张互联网医院牌照,已不再是制胜法宝。市场口碑与持续运营能力,成为检验一家技术服务商价值的核心标尺。那么,究竟是谁在引领…...

别再当‘炼丹师’了!用SHAP值给你的PyTorch模型做个‘CT扫描’,一眼看懂特征在干嘛

用SHAP值透视PyTorch模型:从黑箱到透明决策的工程实践 当你的深度学习模型在测试集上表现优异,却在生产环境中频频失误时,是否曾怀疑过那些隐藏在权重矩阵背后的"暗箱操作"?传统模型评估指标就像体检报告上的数字&#…...

Git-RSCLIP多场景落地:生态环境监测中‘红树林退化’语义识别案例

Git-RSCLIP多场景落地:生态环境监测中"红树林退化"语义识别案例 1. 项目背景与需求 红树林作为重要的海岸带生态系统,具有防风消浪、净化水质、维持生物多样性等重要生态功能。然而近年来,由于人类活动和环境变化,全球…...

005、边缘AI与嵌入式智能:芯片、算法与场景的融合

005、边缘AI与嵌入式智能:芯片、算法与场景的融合 昨天深夜调一个图像分类模型,在PC上精度还有92%,部署到开发板上直接掉到60%不到。板子的推理输出全是乱码,散热片烫得能煎鸡蛋。这种问题在边缘AI项目里太典型了——实验室的算法…...

)

STM32+DHT11温湿度监测实战:从硬件接线到串口调试全流程(附避坑指南)

STM32DHT11温湿度监测实战:从硬件接线到串口调试全流程(附避坑指南) 在物联网和智能硬件快速发展的今天,环境监测已成为许多项目的基础需求。无论是智能家居中的温湿度调控,还是农业大棚中的环境监控,亦或是…...