Ceph应用管理

目录

资源池 Pool 管理

创建 CephFS 文件系统 MDS 接口

服务端操作

客户端操作

创建 Ceph 块存储系统 RBD 接口

创建 Ceph 对象存储系统 RGW 接口

OSD 故障模拟与恢复

资源池 Pool 管理

我们如何向 Ceph 中存储数据呢?首先我们需要在 Ceph 中定义一个 Pool 资源池。Pool 是 Ceph 中存储 Object 对象抽象概念。我们可以将其理解为 Ceph 存储上划分的逻辑分区,Pool 由多个 PG 组成;而 PG 通过 CRUSH 算法映射到不同的 OSD 上;同时 Pool 可以设置副本 size 大小,默认副本数量为 3。

Ceph 客户端向 monitor 请求集群的状态,并向 Pool 中写入数据,数据根据 PGs 的数量,通过 CRUSH 算法将其映射到不同的 OSD 节点上,实现数据的存储。 这里我们可以把 Pool 理解为存储 Object 数据的逻辑单元;当然,当前集群没有资源池,因此需要进行定义。

#创建一个 Pool 资源池,其名字为 mypool,PGs 数量设置为 64,设置 PGs 的同时还需要设置 PGP(通常PGs和PGP的值是相同的):

PG (Placement Group),pg 是一个虚拟的概念,用于存放 object,PGP(Placement Group for Placement purpose),相当于是 pg 存放的一种 osd 排列组合

cd /etc/ceph

ceph osd pool create mypool 64 64

#查看集群 Pool 信息

ceph osd pool ls 或 rados lspools

ceph osd lspools ![]()

#查看资源池副本的数量

ceph osd pool get mypool size ![]()

#查看 PG 和 PGP 数量

ceph osd pool get mypool pg_num

ceph osd pool get mypool pgp_num

#修改 pg_num 和 pgp_num 的数量为 128

ceph osd pool set mypool pg_num 128

ceph osd pool set mypool pgp_num 128

#修改 Pool 副本数量为 2

ceph osd pool set mypool size 2ceph osd pool get mypool size#修改默认副本数为 2

vim ceph.conf

......

osd_pool_default_size = 2ceph-deploy --overwrite-conf config push node01 node02 node03删除 Pool 资源池

1)删除存储池命令存在数据丢失的风险,Ceph 默认禁止此类操作,需要管理员先在 ceph.conf 配置文件中开启支持删除存储池的操作

vim ceph.conf

......

[mon]

mon allow pool delete = true

2)推送 ceph.conf 配置文件给所有 mon 节点

ceph-deploy --overwrite-conf config push node01 node02 node03 3)所有 mon 节点重启 ceph-mon 服务

3)所有 mon 节点重启 ceph-mon 服务

systemctl restart ceph-mon.target4)执行删除 Pool 命令

ceph osd pool rm pool01 pool01 --yes-i-really-really-mean-it

创建 CephFS 文件系统 MDS 接口

服务端操作

1)在管理节点创建 mds 服务

cd /etc/ceph

ceph-deploy mds create node01 node02 node03

2)查看各个节点的 mds 服务

ssh root@node01 systemctl status ceph-mds@node01

ssh root@node02 systemctl status ceph-mds@node02

ssh root@node03 systemctl status ceph-mds@node03

3)创建存储池,启用 ceph 文件系统

3)创建存储池,启用 ceph 文件系统

ceph 文件系统至少需要两个 rados 池,一个用于存储数据,一个用于存储元数据。此时数据池就类似于文件系统的共享目录。

ceph osd pool create cephfs_data 128 #创建数据Pool

ceph osd pool create cephfs_metadata 128 #创建元数据Pool

#创建 cephfs,命令格式:ceph fs new <FS_NAME> <CEPHFS_METADATA_NAME> <CEPHFS_DATA_NAME>

ceph fs new mycephfs cephfs_metadata cephfs_data #启用ceph,元数据Pool在前,数据Pool在后ceph fs ls #查看cephfs

4)查看mds状态,一个up,其余两个待命,目前的工作的是node02上的mds服务

4)查看mds状态,一个up,其余两个待命,目前的工作的是node02上的mds服务

5)创建用户

语法格式:ceph fs authorize <fs_name> client.<client_id> <path-in-cephfs> rw#账户为 client.zhangsan,用户 name 为 zhangsan,zhangsan 对ceph文件系统的 / 根目录(注意不是操作系统的根目录)有读写权限

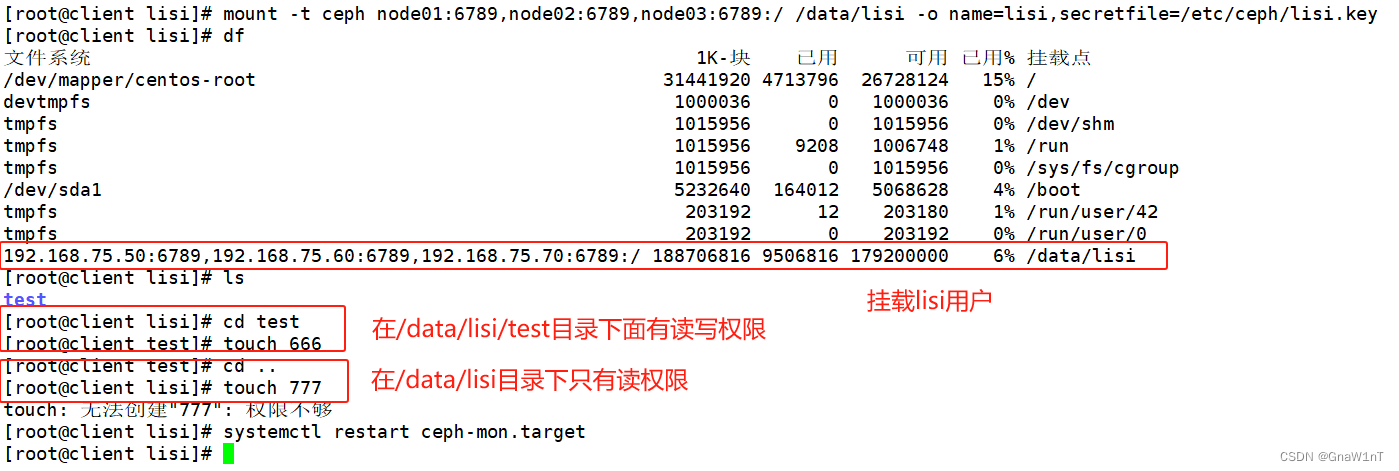

ceph fs authorize mycephfs client.zhangsan / rw | tee /etc/ceph/zhangsan.keyring# 账户为 client.lisi,用户 name 为 lisi,lisi 对文件系统的 / 根目录只有读权限,对文件系统的根目录的子目录 /test 有读写权限

ceph fs authorize mycephfs client.lisi / r /test rw | tee /etc/ceph/lisi.keyring

客户端操作

1)客户端要在 public 网络内

2)在客户端创建工作目录

mkdir /etc/ceph3)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

scp ceph.conf zhangsan.keyring lisi.keyring root@client:/etc/ceph

4)在客户端安装 ceph 软件包

cd /opt

wget https://download.ceph.com/rpm-nautilus/el7/noarch/ceph-release-1-1.el7.noarch.rpm --no-check-certificate

rpm -ivh ceph-release-1-1.el7.noarch.rpm

yum install -y ceph 5)在客户端制作秘钥文件

cd /etc/ceph

ceph-authtool -n client.zhangsan -p zhangsan.keyring > zhangsan.key #把 zhangsan 用户的秘钥导出到 zhangsan.key

ceph-authtool -n client.lisi -p lisi.keyring > lisi.key #把 lisi 用户的秘钥导出到 lisi.key

6)客户端挂载

方式一:基于内核

语法格式:

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secret=<秘钥>

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secretfile=<秘钥文件>示例一:

mkdir -p /data/zhangsan

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/zhangsan -o name=zhangsan,secretfile=/etc/ceph/zhangsan.key示例二:

mkdir -p /data/lisi

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/lisi -o name=lisi,secretfile=/etc/ceph/lisi.key验证用户权限

#停掉 node01 上的 mds 服务

ssh root@node01 "systemctl stop ceph-mds@node01"ceph -s#测试客户端的挂载点仍然是可以用的,如果停掉所有的 mds,客户端就不能用了

方式二:基于 fuse 工具

1)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和管理员账号的秘钥环文件 ceph.client.admin.keyring

scp ceph.client.admin.keyring root@client:/etc/ceph

2)在客户端安装 ceph-fuse

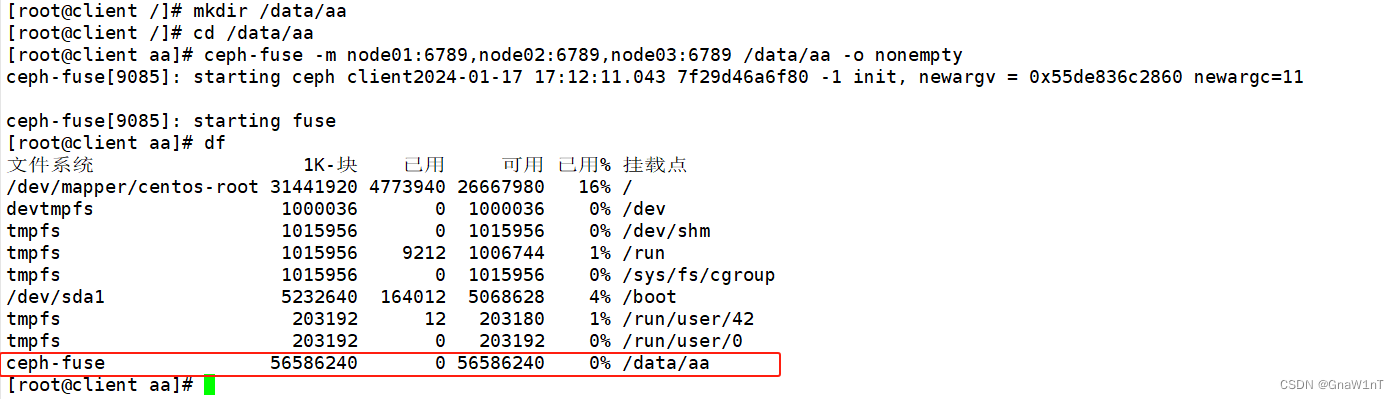

yum install -y ceph-fuse3)客户端挂载

cd /data/aa

ceph-fuse -m node01:6789,node02:6789,node03:6789 /data/aa [-o nonempty] #挂载时,如果挂载点不为空会挂载失败,指定 -o nonempty 可以忽略

创建 Ceph 块存储系统 RBD 接口

1、创建一个名为 rbd-demo 的专门用于 RBD 的存储池

ceph osd pool create rbd-demo 64 64

2、将存储池转换为 RBD 模式

ceph osd pool application enable rbd-demo rbd![]()

3、初始化存储池

rbd pool init -p rbd-demo # -p 等同于 --pool![]()

4、创建镜像

rbd create -p rbd-demo --image rbd-demo1.img --size 10G

可简写为:

rbd create rbd-demo/rbd-demo2.img --size 10G![]()

5、镜像管理

查看存储池下存在哪些镜像

rbd ls -l -p rbd-demo

查看镜像的详细信息

rbd info -p rbd-demo --image rbd-demo1.img

修改镜像大小

rbd resize -p rbd-demo --image rbd-demo1.img --size 20Grbd info -p rbd-demo --image rbd-demo1.img#使用 resize 调整镜像大小,一般建议只增不减,如果是减少的话需要加选项 --allow-shrink

rbd resize -p rbd-demo --image rbd-demo1.img --size 5G --allow-shrink

删除镜像

#直接删除镜像

rbd rm -p rbd-demo --image rbd-demo2.img

rbd remove rbd-demo/rbd-demo2.img#推荐使用 trash 命令,这个命令删除是将镜像移动至回收站,如果想找回还可以恢复

rbd trash move rbd-demo/rbd-demo1.imgrbd ls -l -p rbd-demorbd trash list -p rbd-demo

5fc98fe1f304 rbd-demo1.img#还原镜像

rbd trash restore rbd-demo/5fc98fe1f304rbd ls -l -p rbd-demo

6、Linux客户端使用

客户端使用 RBD 有两种方式:

- 通过内核模块KRBD将镜像映射为系统本地块设备,通常设置文件一般为:/dev/rbd*

- 另一种是通过librbd接口,通常KVM虚拟机使用这种接口。

本例主要是使用Linux客户端挂载RBD镜像为本地磁盘使用。开始之前需要在所需要客户端节点上面安装ceph-common软件包,因为客户端需要调用rbd命令将RBD镜像映射到本地当作一块普通硬盘使用。并还需要把ceph.conf配置文件和授权keyring文件复制到对应的节点。

在管理节点创建并授权一个用户可访问指定的 RBD 存储池

#示例,指定用户标识为client.osd-mount,对另对OSD有所有的权限,对Mon有只读的权限

ceph auth get-or-create client.osd-mount osd "allow * pool=rbd-demo" mon "allow r" > /etc/ceph/ceph.client.osd-mount.keyring修改RBD镜像特性,CentOS7默认情况下只支持layering和striping特性,需要将其它的特性关闭

rbd feature disable rbd-demo/rbd-demo1.img object-map,fast-diff,deep-flatten将用户的keyring文件和ceph.conf文件发送到客户端的/etc/ceph目录下

cd /etc/ceph

scp ceph.client.osd-mount.keyring ceph.conf root@client:/etc/cephadmin上

客户端上

linux客户端操作

#安装 ceph-common 软件包

yum install -y ceph-common#执行客户端映射

cd /etc/ceph

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount#查看映射

rbd showmapped

rbd device list

#断开映射

rbd unmap rbd-demo/rbd-demo1.img#格式化并挂载

mkfs.xfs /dev/rbd0

mkdir -p /data/bb

mount /dev/rbd0 /data/bb

#在线扩容

在管理节点调整镜像的大小

rbd resize rbd-demo/rbd-demo1.img --size 30G在客户端刷新设备文件

xfs_growfs /dev/rbd0 #刷新xfs文件系统容量

resize2fs /dev/rbd0 #刷新ext4类型文件系统容量

7、快照管理

对 rbd 镜像进行快照,可以保留镜像的状态历史,另外还可以利用快照的分层技术,通过将快照克隆为新的镜像使用。

在客户端写入文件

echo 1111 > /data/bb/11.txt

echo 2222 > /data/bb/22.txt

echo 3333 > /data/bb/33.txt

在管理节点对镜像创建快照

rbd snap create --pool rbd-demo --image rbd-demo1.img --snap demo1_snap1

可简写为:

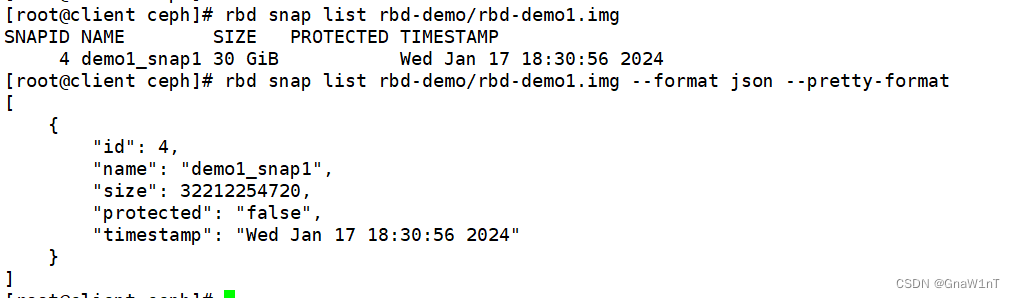

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap1列出指定镜像所有快照

rbd snap list rbd-demo/rbd-demo1.img#用json格式输出:

rbd snap list rbd-demo/rbd-demo1.img --format json --pretty-format

回滚镜像到指定

在回滚快照之前,需要将镜像取消镜像的映射,然后再回滚。

#在客户端操作

rm -rf /data/bb/*

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img#在管理节点操作

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1#在客户端重新映射并挂载

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

mount /dev/rbd0 /data/bb

ls /data/bb #发现数据还原回来了#在客户端操作

rm -rf /data/bb/*

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

#在管理节点操作

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1![]()

#在客户端重新映射并挂载

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

mount /dev/rbd0 /data/bb

ls /data/bb #发现数据还原回来了

限制镜像可创建快照数

rbd snap limit set rbd-demo/rbd-demo1.img --limit 3

#解除限制:

rbd snap limit clear rbd-demo/rbd-demo1.img删除快照

#删除指定快照:

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap1#删除所有快照:

rbd snap purge rbd-demo/rbd-demo1.img

快照分层

快照分层支持用快照的克隆生成新镜像,这种镜像与直接创建的镜像几乎完全一样,支持镜像的所有操作。唯一不同的是克隆镜像引用了一个只读的上游快照,而且此快照必须要设置保护模式。

#快照克隆

1)将上游快照设置为保护模式:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap666rbd snap protect rbd-demo/rbd-demo1.img@demo1_snap6662)克隆快照为新的镜像

rbd clone rbd-demo/rbd-demo1.img@demo1_snap666 --dest rbd-demo/rbd-demo666.imgrbd ls -p rbd-demo3)命令查看克隆完成后快照的子镜像

rbd children rbd-demo/rbd-demo1.img@demo1_snap666

快照展平

通常情况下通过快照克隆而得到的镜像会保留对父快照的引用,这时候不可以删除该父快照,否则会有影响。

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

#报错 snapshot 'demo1_snap666' is protected from removal.如果要删除快照但想保留其子镜像,必须先展平其子镜像,展平的时间取决于镜像的大小

1) 展平子镜像

rbd flatten rbd-demo/rbd-demo666.img2)取消快照保护

rbd snap unprotect rbd-demo/rbd-demo1.img@demo1_snap6663)删除快照

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666rbd ls -l -p rbd-demo #在删除掉快照后,查看子镜像依然存在

8、镜像的导出导入

导出镜像

rbd export rbd-demo/rbd-demo1.img /opt/rbd-demo1.img导入镜像

#卸载客户端挂载,并取消映射

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img#清除镜像下的所有快照,并删除镜像

rbd snap purge rbd-demo/rbd-demo1.img

rbd rm rbd-demo/rbd-demo1.imgrbd ls -l -p rbd-demo#导入镜像

rbd import /opt/rbd-demo1.img rbd-demo/rbd-demo1.imgrbd ls -l -p rbd-demo

创建 Ceph 对象存储系统 RGW 接口

1、对象存储概念

对象存储(object storage)是非结构数据的存储方法,对象存储中每一条数据都作为单独的对象存储,拥有唯一的地址来识别数据对象,通常用于云计算环境中。

不同于其他数据存储方法,基于对象的存储不使用目录树。

虽然在设计与实现上有所区别,但大多数对象存储系统对外呈现的核心资源类型大同小异。从客户端的角度来看,分为以下几个逻辑单位:

●Amazon S3:

提供了

1、用户(User)

2、存储桶(Bucket)

3、对象(Object)

三者的关系是:

1、User将Object存储到系统上的Bucket

2、存储桶属于某个用户并可以容纳对象,一个存储桶用于存储多个对象

3、同一个用户可以拥有多个存储桶,不同用户允许使用相同名称的Bucket,因此User名称即可做为Bucket的名称空间

●OpenStack Swift:

提供了user、container和object分别对应于用户、存储桶和对象,不过它还额外为user提供了父级组件account,用于表示一个项目或用户组,因此一个account中可以包含一到多个user,它们可共享使用同一组container,并为container提供名称空间

●RadosGW:

提供了user、subuser、bucket和object,其中的user对应于S3的user,而subuser则对应于Swift的user,不过user和subuser都不支持为bucket提供名称空间,因此不同用户的存储桶不允许同名;不过,自jewel版本起,RadosGW引入了tenant(租户)用于为user和bucket提供名称空间,但他是个可选组件

从上可以看出大多数对象存储的核心资源类型大同小异,如 Amazon S3、OpenStack Swift 与 RadosGw。其中 S3 与 Swift 互不兼容,RadosGw 为了兼容 S3 与 Swift, Ceph 在 RadosGW 集群的基础上提供了 RGW(RadosGateway)数据抽象层和管理层,它可以原生兼容 S3 和 Swift 的 API。

S3和Swift它们可基于http或https完成数据交换,由RadosGW内建的Civetweb提供服务,它还可以支持代理服务器包括nginx、haproxy等以代理的形式接收用户请求,再转发至RadosGW进程。

RGW 的功能依赖于对象网关守护进程实现,负责向客户端提供 REST API 接口。出于冗余负载均衡的需求,一个 Ceph 集群上通常不止一个 RadosGW 守护进程。

2、创建 RGW 接口

如果需要使用到类似 S3 或者 Swift 接口时候才需要部署/创建 RadosGW 接口,RadosGW 通常作为对象存储(Object Storage)使用,类于阿里云OSS。

在管理节点创建一个 RGW 守护进程(生产环境下此进程一般需要高可用,后续介绍)

cd /etc/ceph

ceph-deploy rgw create node01ceph -s

#创建成功后默认情况下会自动创建一系列用于 RGW 的存储池

ceph osd pool ls

rgw.root

default.rgw.control #控制器信息

default.rgw.meta #记录元数据

default.rgw.log #日志信息

default.rgw.buckets.index #为 rgw 的 bucket 信息,写入数据后生成

default.rgw.buckets.data #是实际存储的数据信息,写入数据后生成#默认情况下 RGW 监听 7480 号端口

ssh root@node01 netstat -lntp | grep 7480

开启 http+https ,更改监听端口

开启 http+https ,更改监听端口

RadosGW 守护进程内部由 Civetweb 实现,通过对 Civetweb 的配置可以完成对 RadosGW 的基本管理。

#要在 Civetweb 上启用SSL,首先需要一个证书,在 rgw 节点生成证书

1)生成CA证书私钥:

openssl genrsa -out civetweb.key 20482)生成CA证书公钥:

openssl req -new -x509 -key civetweb.key -out civetweb.crt -days 3650 -subj "/CN=192.168.80.11"#3、将生成的证书合并为pem

cat civetweb.key civetweb.crt > /etc/ceph/civetweb.pem#更改监听端口

Civetweb 默认监听在 7480 端口并提供 http 协议,如果需要修改配置需要在管理节点编辑 ceph.conf 配置文件

cd /etc/cephvim ceph.conf

......

[client.rgw.node01]

rgw_host = node01

rgw_frontends = "civetweb port=80+443s ssl_certificate=/etc/ceph/civetweb.pem num_threads=500 request_timeout_ms=60000"------------------------------------------------------------

●rgw_host:对应的RadosGW名称或者IP地址

●rgw_frontends:这里配置监听的端口,是否使用https,以及一些常用配置:

•port:如果是https端口,需要在端口后面加一个s。

•ssl_certificate:指定证书的路径。

•num_threads:最大并发连接数,默认为50,根据需求调整,通常在生产集群环境中此值应该更大

•request_timeout_ms:发送与接收超时时长,以ms为单位,默认为30000

•access_log_file:访问日志路径,默认为空

•error_log_file:错误日志路径,默认为空

------------------------------------------------------------#修改完 ceph.conf 配置文件后需要重启对应的 RadosGW 服务,再推送配置文件

ceph-deploy --overwrite-conf config push node0{1..3}ssh root@node01 systemctl restart ceph-radosgw.target

![]()

#在 rgw 节点上查看端口

netstat -lntp | grep -w 80

netstat -lntp | grep 443![]()

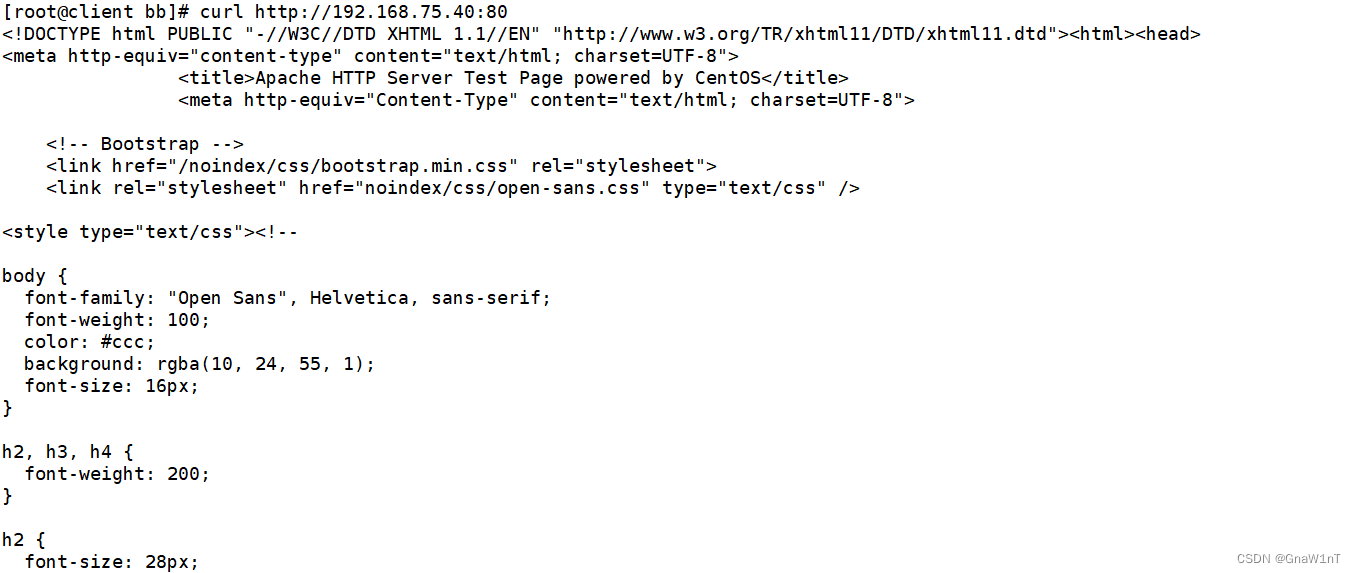

#在客户端访问验证

curl http://192.168.80.11:80

curl -k https://192.168.80.11:443

创建 RadosGW 账户

在管理节点使用 radosgw-admin 命令创建 RadosGW 账户

radosgw-admin user create --uid="rgwuser" --display-name="rgw test user"

#创建成功后将输出用户的基本信息,其中最重要的两项信息为 access_key 和 secret_key 。用户创建成后功,如果忘记用户信息可以使用下面的命令查看

radosgw-admin user info --uid="rgwuser"

OSD 故障模拟与恢复

1、模拟 OSD 故障

如果 ceph 集群有上千个 osd,每天坏 2~3 个太正常了,我们可以模拟 down 掉一个 osd

#如果 osd 守护进程正常运行,down 的 osd 会很快自恢复正常,所以需要先关闭守护进程

ssh root@node01 systemctl stop ceph-osd@0#down 掉 osd

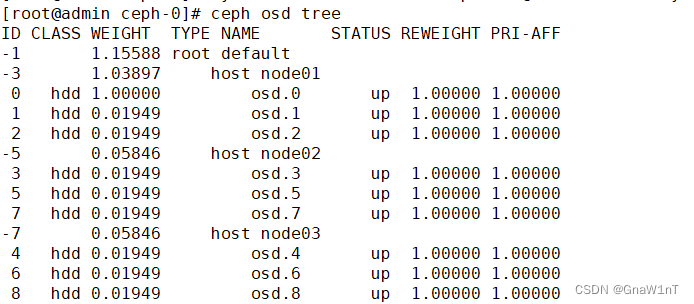

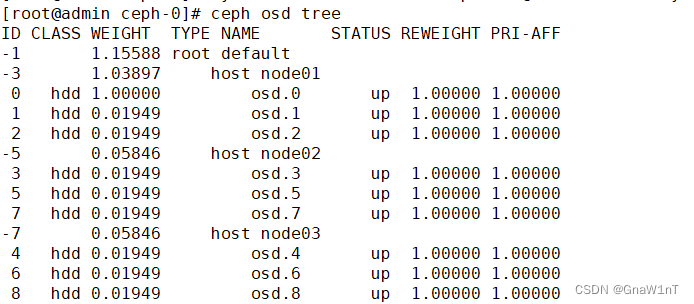

ceph osd down 0ceph osd tree

2、将坏掉的 osd 踢出集群

方法一:

#将 osd.0 移出集群,集群会开始自动同步数据

ceph osd out osd.0#将 osd.0 移除 crushmap

ceph osd crush remove osd.0#删除守护进程对应的账户信息

ceph auth rm osd.0ceph auth list#删掉 osd.0

ceph osd rm osd.0ceph osd stat

ceph -s

方法二:

ceph osd out osd.0#使用综合步骤,删除配置文件中针对坏掉的 osd 的配置

ceph osd purge osd.0 --yes-i-really-mean-it3、把原来坏掉的 osd 修复后重新加入集群

#在 osd 节点创建 osd,无需指定名,会按序号自动生成

cd /etc/cephceph osd create#创建账户

ceph-authtool --create-keyring /etc/ceph/ceph.osd.0.keyring --gen-key -n osd.0 --cap mon 'allow profile osd' --cap mgr 'allow profile osd' --cap osd 'allow *'#导入新的账户秘钥

ceph auth import -i /etc/ceph/ceph.osd.0.keyringceph auth list#更新对应的 osd 文件夹中的密钥环文件(node01上)

ceph auth get-or-create osd.0 -o /var/lib/ceph/osd/ceph-0/keyring#加入 crushmap

ceph osd crush add osd.0 1.000 host=node01 #1.000 代表权重#加入集群

ceph osd in osd.0ceph osd tree#重启 osd 守护进程

systemctl restart ceph-osd@0ceph osd tree #稍等片刻后 osd 状态为 up 如果重启失败

报错:

Job for ceph-osd@0.service failed because start of the service was attempted too often. See "systemctl status ceph-osd@0.service" and "journalctl -xe" for details.

To force a start use "systemctl reset-failed ceph-osd@0.service" followed by "systemctl start ceph-osd@0.service" again.#运行

systemctl reset-failed ceph-osd@0.service && systemctl restart ceph-osd@0.service

相关文章:

Ceph应用管理

目录 资源池 Pool 管理 创建 CephFS 文件系统 MDS 接口 服务端操作 客户端操作 创建 Ceph 块存储系统 RBD 接口 创建 Ceph 对象存储系统 RGW 接口 OSD 故障模拟与恢复 资源池 Pool 管理 我们如何向 Ceph 中存储数据呢?首先我们需要在 Ceph 中定义一个 Pool…...

大师学SwiftUI第6章 - 声明式用户界面 Part 3

安全域视图 SwiftUI还内置了创建安全文本框的视图。这一视图会把用户输入的字符替换成点以及隐藏敏感信息,比如密码。 SecureField(String, text: Binding):该初始化方法创建一个安全输入框。第一个参数定义占位文本,text参数为存储…...

使用AI自动生成PPT提高制作效率

使用AI自动生成PPT提高制作效率 在制作PPT方面,很多制作者都会轻易跳进一个怪圈:“我要制作一个关于关爱老人的PPT,该怎么做呢,有模板没有?”这个会涉及很多逻辑需要经过不断的思考,制作PPT要通过很多素材、使用技巧、…...

Servlet中访问网页常遇到的问题

网页出现404 出现这一种情况是浏览器访问的资源不存在 第一种情况通常是路径出错请检查你的路径是否一致 第二种情况确认你的webapp是否被正确加载 smart tomcat由于只加载一个webapp 如果加载失败 就会直接启动失败 拷贝war方式到Tomcat要加载多个webapp如果失败只有日志 查…...

Vue加载序列帧动图

解读方法 使用<img :src"currentFrame" alt"加载中" /> 加载图片动态更改src的值使用 requestAnimationFrame 定时更新在需要的页面调用封装的组件 <LoadToast v-if"showLoading" /> 封装组件 <template><div class"…...

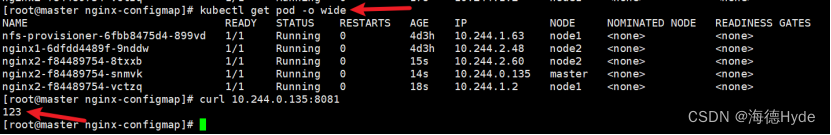

k8s的配置资源管理

1、configmap*:1.2加入新的特征(重点) 2、secret:保存密码,token,保存敏感的k8s资源(保存加密的信息) (1)敏感的k8s资源,这类数据可以直接存放在…...

vue 指定区域可拖拽的限定拖拽区域的div(如仅弹窗标题可拖拽的弹窗)

<template><div class"container" ref"container"><div class"drag-box" v-drag><div class"win_head">弹窗标题</div><div class"win_content">弹窗内容</div></div><…...

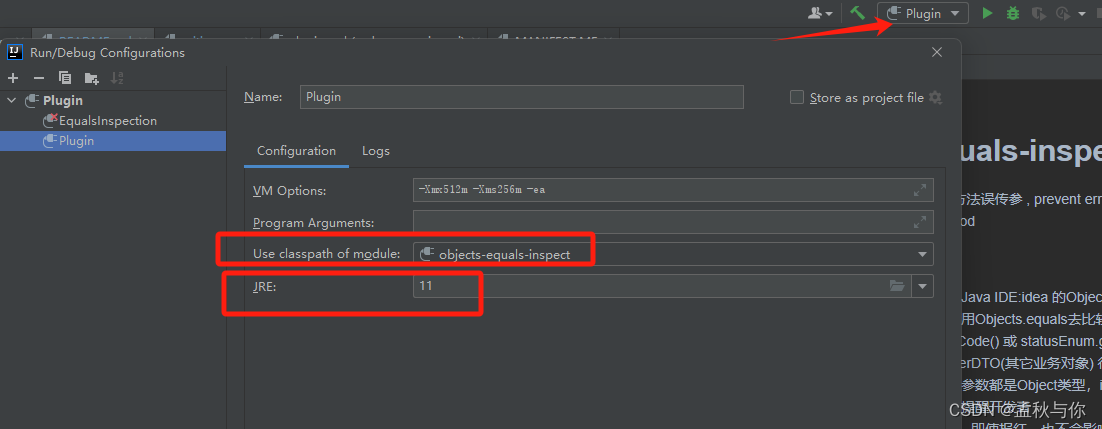

【idea】idea插件编写教程,博主原创idea插件已上架idea插件市场 欢迎下载

前言:经常使用Objects.equals(a,b)方法的同学 应该或多或少都会因为粗心而传错参, 例如日常开发中 我们使用Objects.equals去比较 status(入参),statusEnum(枚举), 很容易忘记statusEnum.getCode() 或 statusEnum.getVaule() ,再比…...

探索Python数据结构与算法:解锁编程的无限可能

文章目录 一、引言1.1 数据结构与算法对于编程的重要性1.2 Python作为实现数据结构与算法的强大工具 二、列表和元组2.1 列表:创建列表、索引、切片和常用操作2.2 元组:不可变序列的特性和使用场景 三、字符串操作和正则表达式3.1 字符串的常见操作和方法…...

责任链模式介绍及演示

责任链模介绍 责任链模式(Chain of Responsibility Pattern)是一种行为设计模式,其主要目的是将请求的发送者和接收者解耦。在这个模式中,多个对象有机会处理一个请求,形成一条“责任链”。每个对象在链中检查该请求并…...

表单组件属性说明+代码明细)

智能小程序小部件(Widget)表单组件属性说明+代码明细

在 Tuya MiniApp Tools 中,新建项目并选择小部件(Widget)对应模板即可自动创建小部件(Widget)项目。 button 按钮,用于强调操作并引导用户去点击。 属性说明 属性名类型默认值必填说明sizestringdefault否按钮的大小typestringdefault否按钮的样式类…...

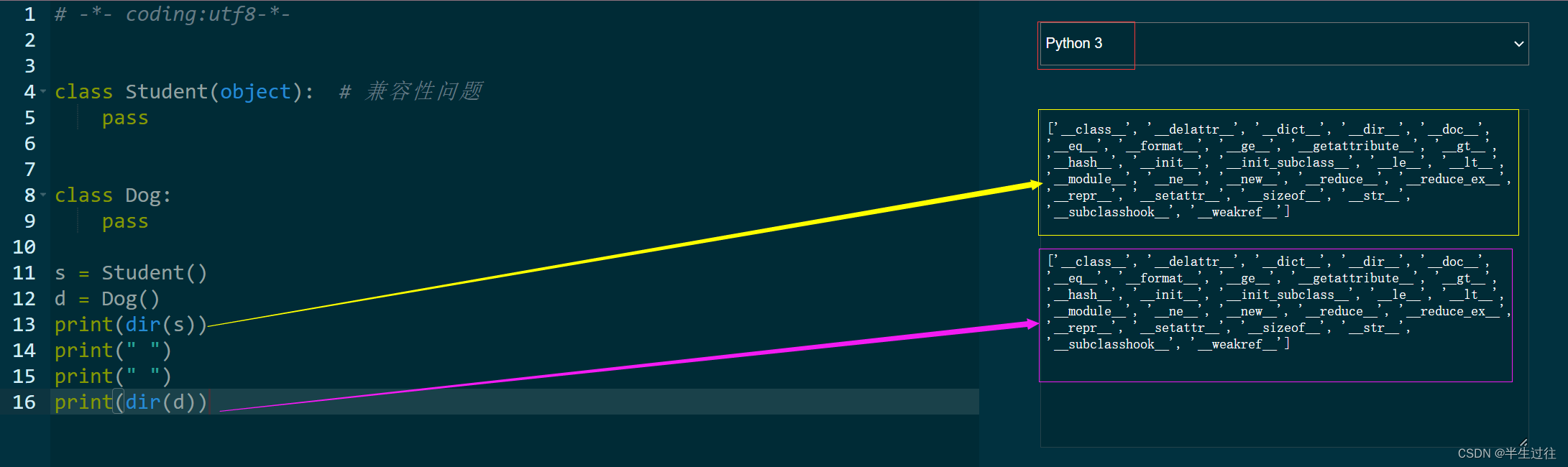

自学Python笔记总结(更新中……)

自学Python笔记总结 网址数据类型类型查看类型,使用type内置类标识符 输出输入语句format函数的语法及用法数据类型的转换运算符算数运算符赋值运算符的特殊场景拆包 比较运算符逻辑运算符 与 短路位运算符运算符优先级 程序流程控制分支语句pass 占位 循环语句 whi…...

十四.变量、异常处理

变量、异常处理 1.变量1.1系统变量1.1.1系统变量分类1.1.2查看系统变量 1.2用户变量1.2.1用户变量分类1.2.2会话用户变量1.2.3局部变量1.2.4对比会话用户变量与局部变量 补充:MySQL 8.0的新特性—全局变量的持久化 2.定义条件与处理程序2.1案例分析2.2定义条件2.3定义处理程序2…...

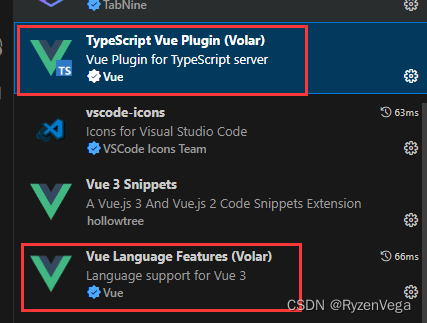

import { ArrowRight } from “@element-plus/icons-vue“;

今天下午快被这个问题折磨疯了 虽然知道这个问题怎么产生的 但项目里那个碍眼的红线就是去不掉 后来才发现 这是插件的锅 我的心情 你知道我想要说什么的 想必能看到这篇文章的 也知道这个问题是怎么产生的 vue3ts使用的时候 默认是需要带上文件名的 但是引入el组件时 …...

Kubernetes 面试宝典

创建 Pod的主要流程? 客户端提交 Pod 的配置信息(可以是 yaml 文件定义的信息)到 kube-apiserver. Apiserver 收到指令后,通知 controllr-manager 创建一个资源对象 controller-manager 通过 apiserver 将 pod 的配置信息存储到 ETCD 数据中薪心中 kube-scheduler 检查到 p…...

c语言二维数组

系列文章目录 c语言二维数组 c语言二维数组 系列文章目录一、二维数组的定义一、二维数组的内存模型 一、二维数组的定义 int main() {//二维数组的定义int arr[3][4];arr[0][0]; arr[0][1]; arr[0][2]; arr[0][3]; arr[0][4];arr[1][0]; arr[1][1]; arr[1][2]; arr[1][3]; ar…...

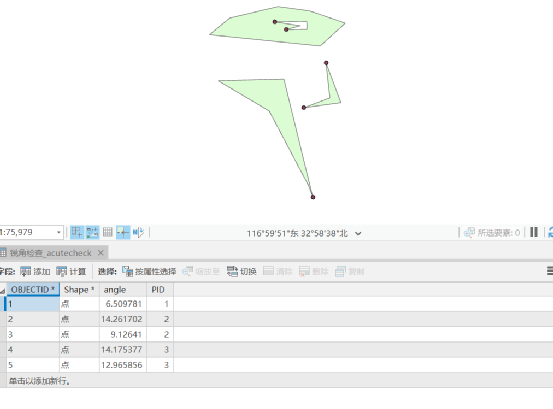

ArcGIS Pro 拓扑编辑和常见一些拓扑错误处理

7.4 拓扑编辑 拓扑编辑也叫共享编辑,多个数据修改时,一块修改,如使用数据:chp7\拓扑检查.gdb,数据集DS下JZX、JZD和DK,加载地图框中,在“地图”选项卡下选择“地图拓扑”或“ds_Topology(地理数据库)”&…...

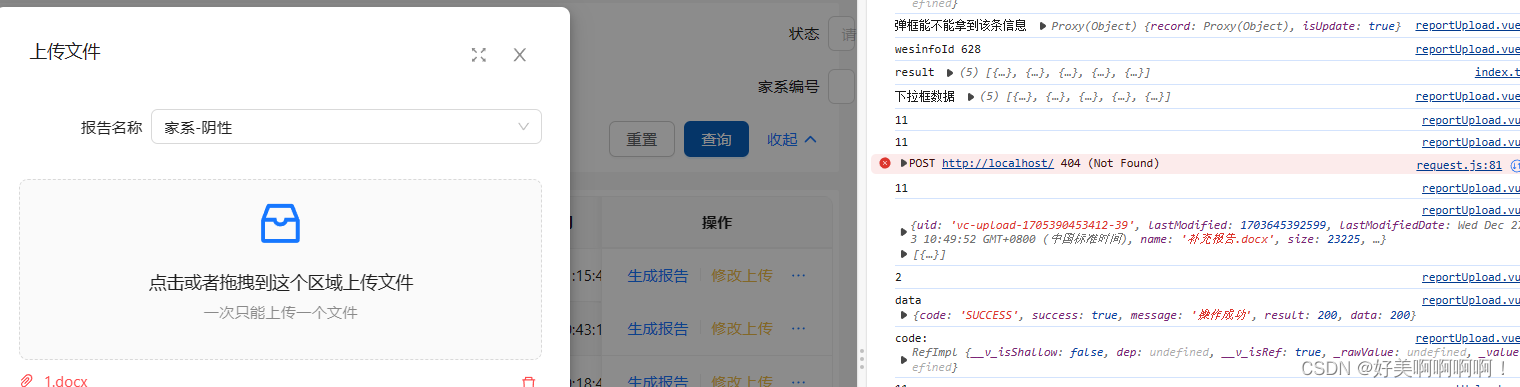

前端踩坑之——antDesignVue的upload组件

本地启动时控制台会报404,放到服务器上控制台会报405(多发一个请求) 原因:upLoad有默认的上传事件 解决:阻止默认事件即可 beforeUpload Hook function which will be executed before uploading. Uploading will be stopped with false or …...

设计模式——策略模式

策略模式(Strategy Pattern)是一种行为型设计模式,它定义了一系列算法,并将每一个算法封装起来,使它们可以相互替换。策略模式让算法独立于使用它的客户端代码,使得算法的变化不会影响到使用该算法的客户端…...

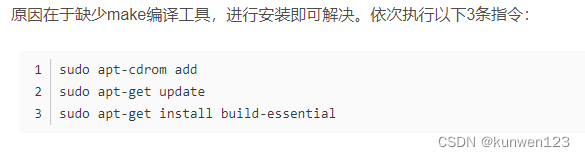

Ubuntu12.0安装g++过程及其报错

Ubuntu12.0安装g过程及其报错 https://blog.csdn.net/weixin_51286763/article/details/120703953 https://blog.csdn.net/dingd1234/article/details/124029945 2.报错二: [41/80] Building CXX object absl/synchronization/CMakeFiles/graphcycles_internal.di…...

乡村景区智慧垂钓破局增收!巨有科技激活乡村“渔乐”经济

垂钓作为国民级休闲活动,拥有超1.2亿爱好者,是乡村文旅中极具潜力的黄金业态。然而,多数乡村钓场仍停留在“一根竿、一个塘”的粗放运营阶段,面临计费混乱、管理成本高、体验同质化、增收乏力等困境。巨有科技聚焦乡村场景&#x…...

CANN/Ascend C 基于语言扩展层C API编程

基于语言扩展层C API编程 【免费下载链接】asc-devkit 本项目是CANN 推出的昇腾AI处理器专用的算子程序开发语言,原生支持C和C标准规范,主要由类库和语言扩展层构成,提供多层级API,满足多维场景算子开发诉求。 项目地址: https:…...

CANN-opbase-昇腾NPU算子开发的基础设施为什么这么重要

CANN-opbase-昇腾NPU算子开发的基础设施为什么这么重要 所有 CANN AOL 算子仓库的底层都依赖 opbase。它不提供任何算子实现,提供的是算子注册、编译、调度的基础设施。如果你要写自定义 Ascend C 算子,opbase 是绕不过去的第一步。 opbase 提供了什么组…...

Azure机器学习实战:汽车价格预测模型端到端部署

1. 项目概述:在 Azure 上构建一个真正能落地的汽车价格预测模型你有没有试过想买一辆二手车,却在几个平台之间反复比价、查配置、翻论坛,最后还是拿不准这台车到底值不值这个价?或者作为数据新人,手头有份汽车数据集&a…...

新手入门使用 Python 快速接入 Taotoken 调用大模型

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 新手入门使用 Python 快速接入 Taotoken 调用大模型 对于刚开始接触大模型 API 调用的开发者而言,如何快速、正确地接入…...

Token聚合平台 vs 传统云 vs AI原生云,AI推理应用怎么选?

在大模型能力深度融入生产环境的当下,后端 AI 架构的选择往往决定了应用的生死。从早期的“调用一个接口”到如今复杂的智能体(Agent)工作流,开发团队在底座选型上面临着两条截然不同的演进路径:一条是追求便利与极致轻…...

无监督聚类挖掘声音语义:从音乐描述文本发现认知规律

1. 这不是传统聚类,而是一场对“声音语言”的考古式挖掘你有没有试过听一首歌,然后被某段音色击中——那种“像融化的玻璃糖纸裹着雨滴坠落”的感觉?或者在音乐评论区刷到“低频像沉入深海的青铜钟”“人声有未拆封的羊皮纸质感”这类描述&am…...

时序分析核心概念与实战:从数据特征到数据库选型

1. 项目概述:为什么我们需要“时序分析”?如果你在金融、物联网、工业制造、运维监控或者电商数据分析等领域工作过,那么“时序数据”这个词对你来说一定不陌生。简单来说,时序数据就是一系列按时间顺序排列的数据点。听起来很简单…...

如何快速安装xfce-winxp-tc:10分钟打造XP风格的Linux桌面

如何快速安装xfce-winxp-tc:10分钟打造XP风格的Linux桌面 【免费下载链接】xfce-winxp-tc Windows XP stuff for XFCE 项目地址: https://gitcode.com/gh_mirrors/xf/xfce-winxp-tc 你是否怀念经典的Windows XP界面?xfce-winxp-tc项目让你在Linux…...

)

玻璃材质提示词失效率高达67%?2024最新Glass Prompt Framework v3.0(含Cinema4D材质参数→MJ语义映射表)

更多请点击: https://kaifayun.com 第一章:玻璃材质提示词失效率的行业现状与归因分析 在当前AIGC图像生成领域,“glass material”(玻璃材质)类提示词的失效问题已成高频痛点。多项基准测试显示,主流多模…...