【人工智能】Transformers之Pipeline(十九):文生文(text2text-generation)

目录

一、引言

二、文生文(text2text-generation)

2.1 概述

2.2 Flan-T5: One Model for ALL Tasks

2.3 pipeline参数

2.3.1 pipeline对象实例化参数

2.3.2 pipeline对象使用参数

2.3.3 pipeline返回参数

2.4 pipeline实战

2.5 模型排名

三、总结

一、引言

pipeline(管道)是huggingface transformers库中一种极简方式使用大模型推理的抽象,将所有大模型分为音频(Audio)、计算机视觉(Computer vision)、自然语言处理(NLP)、多模态(Multimodal)等4大类,28小类任务(tasks)。共计覆盖32万个模型

今天介绍NLP自然语言处理的第七篇:文生文(text2text-generation),在huggingface库内有3.3万个文本生成(text-generation)模型。

二、文生文(text2text-generation)

2.1 概述

文本生成(Text Generation)和文生文(Text-to-Text)两者都是自然语言处理(NLP)的子领域,但它们有不同的重点和应用场景。文本生成主要指的是自动生成文本内容的技术,例如:自动生成新闻报道、自动生成产品描述、自动生成聊天机器人的对话,这种技术通常使用深度学习模型来训练语言模型,从而能够根据输入的条件或提示生成新的文本内容。文生文则主要指的是将一段文本转换为另一段文本的技术,例如:机器翻译、文本摘要、风格转换,这种技术通常使用序列到序列(Seq2Seq)模型或变换器(Transformer)模型来训练语言模型,从而能够根据输入的文本生成新的文本内容。文本生成主要关注于自动生成文本内容,而文生文则主要关注于将一段文本转换为另一段文本。

2.2 Flan-T5: One Model for ALL Tasks

Flan-T5是Google最新的一篇工作,通过在超大规模的任务上对T5进行微调,让语言模型具备了极强的泛化性能,做到单个模型就可以在1800多个NLP任务上都能有很好的表现。这意味着模型一旦训练完毕,可以直接在几乎全部的NLP任务上直接使用,实现One model for ALL tasks,这就非常有诱惑力!

这里的Flan 指的是(Instruction finetuning ),即"基于指令的微调";T5是2019年Google发布的一个语言模型了。注意这里的语言模型可以进行任意的替换(需要有Decoder部分,所以不包括BERT这类纯Encoder语言模型),论文的核心贡献是提出一套多任务的微调方案(Flan),来极大提升语言模型的泛化性。

2.3 pipeline参数

2.3.1 pipeline对象实例化参数

- model(PreTrainedModel或TFPreTrainedModel)— 管道将使用其进行预测的模型。 对于 PyTorch,这需要从PreTrainedModel继承;对于 TensorFlow,这需要从TFPreTrainedModel继承。

- tokenizer ( PreTrainedTokenizer ) — 管道将使用 tokenizer 来为模型编码数据。此对象继承自 PreTrainedTokenizer。

- modelcard(

str或ModelCard,可选)— 属于此管道模型的模型卡。- framework(

str,可选)— 要使用的框架,"pt"适用于 PyTorch 或"tf"TensorFlow。必须安装指定的框架。- task(

str,默认为"")— 管道的任务标识符。- num_workers(

int,可选,默认为 8)— 当管道将使用DataLoader(传递数据集时,在 Pytorch 模型的 GPU 上)时,要使用的工作者数量。- batch_size(

int,可选,默认为 1)— 当管道将使用DataLoader(传递数据集时,在 Pytorch 模型的 GPU 上)时,要使用的批次的大小,对于推理来说,这并不总是有益的,请阅读使用管道进行批处理。- args_parser(ArgumentHandler,可选) - 引用负责解析提供的管道参数的对象。

- device(

int,可选,默认为 -1)— CPU/GPU 支持的设备序号。将其设置为 -1 将利用 CPU,设置为正数将在关联的 CUDA 设备 ID 上运行模型。您可以传递本机torch.device或str太- torch_dtype(

str或torch.dtype,可选) - 直接发送model_kwargs(只是一种更简单的快捷方式)以使用此模型的可用精度(torch.float16,,torch.bfloat16...或"auto")- binary_output(

bool,可选,默认为False)——标志指示管道的输出是否应以序列化格式(即 pickle)或原始输出数据(例如文本)进行。

2.3.2 pipeline对象使用参数

- text_inputs(

str,List[str],List[Dict[str, str]],或List[List[Dict[str, str]]])— 需要完成的一个或多个提示(或一个提示列表)。如果传递了字符串或字符串列表,则此管道将继续每个提示。或者,可以传递“聊天”(以带有“role”和“content”键的字典列表的形式),或传递此类聊天的列表。传递聊天时,将使用模型的聊天模板对其进行格式化,然后再将其传递给模型。- return_tensors (

bool,可选,默认为False) — 是否在输出中返回预测的张量(作为标记索引)。如果设置为True,则不返回解码后的文本。- return_text(

bool,可选,默认为True)— 是否在输出中返回解码后的文本。- return_full_text(

bool,可选,默认为True)— 如果设置为,False则仅返回添加的文本,否则返回全文。仅当 return_text设置为 True 时才有意义。- clean_up_tokenization_spaces(

bool,可选,默认为True)—是否清理文本输出中可能出现的额外空格。- prefix(

str,可选)— 添加到提示的前缀。- handle_long_generation(

str,可选)— 默认情况下,此管道不处理长生成(以某种形式超出模型最大长度的生成)。- generate_kwargs(

dict,可选)——传递给模型的生成方法的附加关键字参数(请参阅此处与您的框架相对应的生成方法)。

2.3.3 pipeline返回参数

- args(

str或List[str])——编码器的输入文本。- return_tensors(

bool,可选,默认为False)— 是否在输出中包含预测张量(作为标记索引)。- return_text(

bool,可选,默认为True)— 是否在输出中包含解码后的文本。- clean_up_tokenization_spaces(

bool,可选,默认为False)—是否清理文本输出中可能出现的额外空格。- truncation(

TruncationStrategy,可选,默认为TruncationStrategy.DO_NOT_TRUNCATE)——管道内标记化的截断策略。 (默认)永远不会截断,但有时需要截断输入以适合模型的 max_length,而不是在行中抛出错误。generate_kwargs——传递给模型的生成方法的附加关键字参数

2.4 pipeline实战

基于pipeline的text2text-generation任务,使用google/flan-t5-small模型:

import os

os.environ["HF_ENDPOINT"] = "https://hf-mirror.com"

os.environ["CUDA_VISIBLE_DEVICES"] = "2"from transformers import pipelinegenerator = pipeline(task="text2text-generation",model= "google/flan-t5-small" )

output=generator( "Translate to German: My name is Arthur")

print(output)执行后,自动下载模型文件并进行识别:

2.5 模型排名

在huggingface上,我们将文生文(text2text-generation)模型按下载量从高到低排序,总计3.2万个模型,google的byt5、t5-v1_1、flan-t5-base在榜。

三、总结

本文对transformers之pipeline的文生文(text2text-generation)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文中的2行代码极简的使用NLP中的文生文(text2text-generation)模型。

期待您的3连+关注,如何还有时间,欢迎阅读我的其他文章:

《Transformers-Pipeline概述》

【人工智能】Transformers之Pipeline(概述):30w+大模型极简应用

《Transformers-Pipeline 第一章:音频(Audio)篇》

【人工智能】Transformers之Pipeline(一):音频分类(audio-classification)

【人工智能】Transformers之Pipeline(二):自动语音识别(automatic-speech-recognition)

【人工智能】Transformers之Pipeline(三):文本转音频(text-to-audio/text-to-speech)

【人工智能】Transformers之Pipeline(四):零样本音频分类(zero-shot-audio-classification)

《Transformers-Pipeline 第二章:计算机视觉(CV)篇》

【人工智能】Transformers之Pipeline(五):深度估计(depth-estimation)

【人工智能】Transformers之Pipeline(六):图像分类(image-classification)

【人工智能】Transformers之Pipeline(七):图像分割(image-segmentation)

【人工智能】Transformers之Pipeline(八):图生图(image-to-image)

【人工智能】Transformers之Pipeline(九):物体检测(object-detection)

【人工智能】Transformers之Pipeline(十):视频分类(video-classification)

【人工智能】Transformers之Pipeline(十一):零样本图片分类(zero-shot-image-classification)

【人工智能】Transformers之Pipeline(十二):零样本物体检测(zero-shot-object-detection)

《Transformers-Pipeline 第三章:自然语言处理(NLP)篇》

【人工智能】Transformers之Pipeline(十三):填充蒙版(fill-mask)

【人工智能】Transformers之Pipeline(十四):问答(question-answering)

【人工智能】Transformers之Pipeline(十五):总结(summarization)

【人工智能】Transformers之Pipeline(十六):表格问答(table-question-answering)

【人工智能】Transformers之Pipeline(十七):文本分类(text-classification)

【人工智能】Transformers之Pipeline(十八):文本生成(text-generation)

【人工智能】Transformers之Pipeline(十九):文生文(text2text-generation)

【人工智能】Transformers之Pipeline(二十):令牌分类(token-classification)

【人工智能】Transformers之Pipeline(二十一):翻译(translation)

【人工智能】Transformers之Pipeline(二十二):零样本文本分类(zero-shot-classification)

《Transformers-Pipeline 第四章:多模态(Multimodal)篇》

【人工智能】Transformers之Pipeline(二十三):文档问答(document-question-answering)

【人工智能】Transformers之Pipeline(二十四):特征抽取(feature-extraction)

【人工智能】Transformers之Pipeline(二十五):图片特征抽取(image-feature-extraction)

【人工智能】Transformers之Pipeline(二十六):图片转文本(image-to-text)

【人工智能】Transformers之Pipeline(二十七):掩码生成(mask-generation)

【人工智能】Transformers之Pipeline(二十八):视觉问答(visual-question-answering)

相关文章:

【人工智能】Transformers之Pipeline(十九):文生文(text2text-generation)

目录 一、引言 二、文生文(text2text-generation) 2.1 概述 2.2 Flan-T5: One Model for ALL Tasks 2.3 pipeline参数 2.3.1 pipeline对象实例化参数 2.3.2 pipeline对象使用参数 2.3.3 pipeline返回参数 …...

如何使用ssm实现基于VUE的儿童教育网站的设计与实现+vue

TOC ssm676基于VUE的儿童教育网站的设计与实现vue 第一章 课题背景及研究内容 1.1 课题背景 信息数据从传统到当代,是一直在变革当中,突如其来的互联网让传统的信息管理看到了革命性的曙光,因为传统信息管理从时效性,还是安全…...

MODBUS TCP 转 CANOpen

产品概述 SG-TCP-COE-210 网关可以实现将 CANOpen 接口设备连接到 MODBUS TCP 网络中。用户不需要了解具体的 CANOpen 和 Modbus TCP 协议即可实现将CANOpen 设备挂载到 MODBUS TCP 接口的 PLC 上,并和 CANOpen 设备进行数据交互。 产品特点 …...

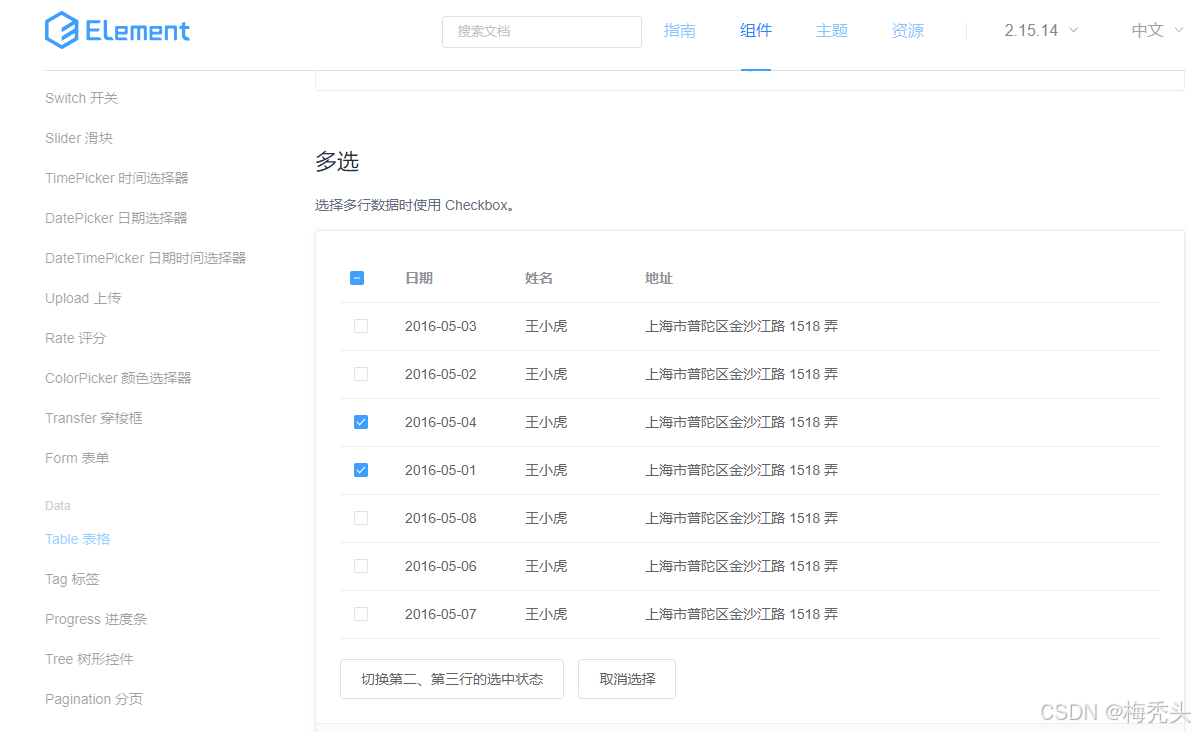

vue2+elementUI实现handleSelectionChange批量删除-前后端

功能需求:实现选中一个或多个执行批量删除操作 在elementUI官网选择一个表格样式模板,Element - The worlds most popular Vue UI framework 这里采用的是 将代码复制到前端,这里是index.vue <template><el-button type"dang…...

的简介、安装和使用方法、案例应用之详细攻略)

LLMs之OCR:llm_aided_ocr(基于LLM辅助的OCR项目)的简介、安装和使用方法、案例应用之详细攻略

LLMs之OCR:llm_aided_ocr(基于LLM辅助的OCR项目)的简介、安装和使用方法、案例应用之详细攻略 目录 llm_aided_ocr的简介 1、特性 2、详细技术概览 PDF处理和OCR PDF到图像转换 OCR处理 文本处理流程 分块创建 错误校正与格式化 重复内容移除 标题和页码…...

低代码平台后端搭建-阶段完结

前言 最近又要开始为跳槽做准备了,发现还是写博客学的效率高点,在总结其他技术栈之前准备先把这个专题小完结一波。在这一篇中我又试着添加了一些实际项目中可能会用到的功能点,用来验证这个平台的扩展性,以及总结一些学过的知识。…...

暑假考研集训营游记

文章目录 摘要:1.对各大辅导机构考研封闭集训营的一些个人看法:2.对于考研原因一些感想:结语 摘要: Ashy在暑假的时候参加了所在辅导班的为期一个月的考研封闭集训营,有了一些全新的感悟,略作记录。 1.对…...

)

C#中的报文(Message)

在C#中,报文(Message)通常是指在网络通信中交换的数据单元。报文可以由多种不同的组成部分构成,具体取决于通信协议和应用场景。 以下是一些常见的报文组成部分: 头部(Header):包含…...

)

Python知识点:如何使用Python与Java进行互操作(Jython)

开篇,先说一个好消息,截止到2025年1月1日前,翻到文末找到我,赠送定制版的开题报告和任务书,先到先得!过期不候! Jython 是一种完全兼容 Java 的 Python 实现,它将 Python 代码编译成…...

ffmpeg解封装解码

文章目录 封装和解封装封装解封装 相关接口解封装的流程图关于AVPacket的解释如何区分不同的码流,视频流,音频流?第一种方式av_find_best_stream第二种方式 通过遍历流 代码 封装和解封装 封装 是把音频流 ,视频流,字…...

golang学习笔记10-循环结构

注:本人已有C,C,Python基础,只写本人认为的重点。 go的循环只有for循环,但有多个语法,可以实现C/C中的while和do while。当然,for循环也有break和continue,这点和C/C相同。 语法1: f…...

)

Java高级编程——泛型(泛型类、泛型接口、泛型方法,完成详解,并附有案例+代码)

文章目录 泛型21.1 概述21.2 泛型类21.3 泛型方法21.4 泛型接口 泛型 21.1 概述 JDK5中引入的特性,在编译阶段约束操作的数据类型,并进行检查 泛型格式:<数据类型> 泛型只能支持引用数据类型,如果写基本数据类型需要写对…...

GPU硬件如何实现光栅化?

版权声明 本文为“优梦创客”原创文章,您可以自由转载,但必须加入完整的版权声明文章内容不得删减、修改、演绎本文视频版本:见文末 引言 大家好,我是老雷,今天我想从GPU硬件原理出发,给大家分享在图形渲…...

Python写入文件内容:从入门到精通

在日常编程工作中,我们常常会遇到需要将数据保存至磁盘的需求。无论是日志记录、配置文件管理还是数据持久化,掌握如何有效地使用Python来写入文件内容都是必不可少的一项技能。本文将从基础语法开始,逐步深入探讨Python中写入文件内容的各种…...

相亲交易系统源码详解与开发指南

随着互联网技术的发展,越来越多的传统行业开始寻求线上转型,其中就包括婚恋服务。传统的相亲方式已经不能满足现代人快节奏的生活需求,因此,开发一款基于Web的相亲交易系统显得尤为重要开发者h17711347205。本文将详细介绍如何使用…...

Golang | Leetcode Golang题解之第413题等差数列划分

题目: 题解: func numberOfArithmeticSlices(nums []int) (ans int) {n : len(nums)if n 1 {return}d, t : nums[0]-nums[1], 0// 因为等差数列的长度至少为 3,所以可以从 i2 开始枚举for i : 2; i < n; i {if nums[i-1]-nums[i] d {t}…...

汽车总线之----FlexRay总线

Introduction 随着汽车智能化发展,车辆开发的ECU数量不断增加,人们对汽车系统的各个性能方面提出了更高的需求,比如更多的数据交互,更高的传输带宽等。现如今人们广泛接受电子功能来提高驾驶安全性,像ABS防抱死系统&a…...

前端代替后端做分页操作

如果后端没有分页api,前端如何做分页一、使用computed 这个变量应该是计算之后的值,是一个状态管理变量,跟onMounted类似import {computed} from vue // 定义ref储存rolelist,这里是原始数据 const roleList ref([])// 定义页码…...

L3 逻辑回归

🍨 本文为🔗365天深度学习训练营 中的学习记录博客🍖 原作者:K同学啊 在周将使用 LogisticRegression 函数对经典的鸢尾花 (Iris) 数据集进行分类。将详细介绍逻辑回归的数学原理。 1. 逻辑回归的数学原理 逻辑回归是一种线性分…...

Flink系列知识之:Checkpoint原理

Flink系列知识之:Checkpoint原理 在介绍checkpoint的执行流程之前,需要先明白Flink中状态的存储机制,因为状态对于检查点的持续备份至关重要。 State Backends分类 下图显示了Flink中三个内置的状态存储种类。MemoryStateBackend和FsState…...

ABB机器人通过Socket实现ModbusTCP通信:Float浮点数解析与PLC数据交换实战

1. ABB机器人与PLC通信的基础原理 在工业自动化领域,设备间的数据交换是核心需求之一。ABB机器人作为客户端与PLC(可编程逻辑控制器)进行通信时,最常用的方式就是ModbusTCP协议。但这里有个关键点需要注意:ABB机器人的…...

安全测试入门指南:Web应用常见漏洞及测试方法

在Web应用蓬勃发展的当下,其安全性愈发成为软件测试领域的核心关注点。对于软件测试从业者而言,精准识别Web应用中的常见漏洞,并掌握科学有效的测试方法,是保障应用安全、维护用户信任的关键。本文将从专业角度,深入剖…...

OBS遮罩插件深度指南:15种特效解决直播画面优化的5大痛点

OBS遮罩插件深度指南:15种特效解决直播画面优化的5大痛点 【免费下载链接】obs-advanced-masks Advanced Masking Plugin for OBS 项目地址: https://gitcode.com/gh_mirrors/ob/obs-advanced-masks OBS高级遮罩插件(OBS Advanced Masksÿ…...

终极指南:5分钟搞定MASA模组全家桶中文汉化,告别英文困扰

终极指南:5分钟搞定MASA模组全家桶中文汉化,告别英文困扰 【免费下载链接】masa-mods-chinese 一个masa mods的汉化资源包 项目地址: https://gitcode.com/gh_mirrors/ma/masa-mods-chinese 还在为Minecraft技术模组的英文界面而头疼吗࿱…...

VMware Unlocker终极指南:如何在Windows/Linux上免费解锁macOS虚拟机支持

VMware Unlocker终极指南:如何在Windows/Linux上免费解锁macOS虚拟机支持 【免费下载链接】unlocker VMware Workstation macOS 项目地址: https://gitcode.com/gh_mirrors/unloc/unlocker 你是否曾经想在Windows或Linux电脑上运行macOS虚拟机,却…...

好想来万店扩张背后的数据新底座

在中国量贩零食行业的版图上,好想来正以雷霆之势重塑市场格局。作为万辰集团旗下的头部品牌,好想来已在全国布局超过 1.5 万家门店,注册会员超过 1.5 亿,年营收突破 365 亿元,成为名副其实的零售巨擘。这些令人瞩目的数…...

别再手动改hosts了!用Docker Compose一键部署Authelia SSO,顺便搞定Traefik反向代理

一键部署Authelia SSO与Traefik反向代理的Docker Compose实战指南 在当今复杂的网络环境中,管理多个Web应用的认证流程往往成为开发者的痛点。手动配置hosts文件、逐个设置访问权限不仅耗时耗力,还容易出错。本文将介绍如何利用Docker Compose快速搭建Au…...

0基础装完龙虾不知道干嘛?用15分钟帮你激活造物主身份

这个 skill,由惊风制作,前后打磨了一个多月。 它解决的不是“怎么安装 OpenClaw”,而是一个更核心的问题:为什么很多人装完以后,Agent 依然像个空壳。一、为什么会有 king.skill?很多人第一次装完 OpenClaw…...

阿里Sophix热更新实战:从加固App打包到补丁发布的完整避坑指南

阿里Sophix热更新深度实践:加固场景下的全链路解决方案 在移动应用快速迭代的今天,热修复技术已经成为保障应用稳定性的关键手段。阿里Sophix作为业界领先的热修复方案,以其高兼容性和稳定性赢得了众多开发团队的青睐。然而,当应用…...

Taotoken的Token Plan套餐在实际开发中的节省效果

🚀 告别海外账号与网络限制!稳定直连全球优质大模型,限时半价接入中。 👉 点击领取海量免费额度 Taotoken的Token Plan套餐在实际开发中的节省效果 1. 理解Token Plan的计费模式 在开发过程中,大模型API的调用成本是…...