sparkRDD教程之必会的题目

1.前期准备

(1)看看上一期的博客,最好跟着上一期的博客把sparkRDD的基本命令给熟练掌握后,再来做这篇文章的任务。

上一期的博客:sparkRDD教程之基本命令-CSDN博客

(2)新建文件task6.scala

package com.itheimaimport org.apache.spark.sql.SparkSessionobject task6 {def main(args: Array[String]): Unit = {val spark = SparkSession.builder.appName("task6").master("local").getOrCreate()val sc = spark.sparkContext//代码在这里写spark.stop()}}

(3)在开始写代码之前先熟悉一下这2个文件

result_bigdata.txt(学号,科目为大数据,成绩),注意了这里的分隔符为"\t"

1001 大数据基础 90

1002 大数据基础 94

1003 大数据基础 100

1004 大数据基础 99

1005 大数据基础 90

1006 大数据基础 94

1007 大数据基础 100

1008 大数据基础 93

1009 大数据基础 89

1010 大数据基础 78

1011 大数据基础 91

1012 大数据基础 84

result_math.txt(学号,科目为数学,成绩),注意了这里的分隔符为"\t"

1001 应用数学 96

1002 应用数学 94

1003 应用数学 100

1004 应用数学 100

1005 应用数学 94

1006 应用数学 80

1007 应用数学 90

1008 应用数学 94

1009 应用数学 84

1010 应用数学 86

1011 应用数学 79

1012 应用数学 91

2.任务1:(十分简单)

(1)取出大数据成绩排名前5的学生成绩信息并且在控制台打印出来,

代码1

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))println(math1.collect().mkString("\n"))截图1

代码2(最终代码)

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))var rdd1 = math1.sortBy(x => x._3, false)println(rdd1.take(5).mkString("\n"))截图2

(2)取出数学成绩排名前5的学生成绩信息并且在控制台打印出来

代码1

var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))println(bigdata1.collect().mkString("\n"))截图1

代码2(最终代码)

var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))var rdd2=bigdata1.sortBy(x=>x._3,false)println(rdd2.take(5).mkString("\n"))截图2

3.任务2:获取单科成绩为100的学生id

代码1

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd1 = math1.sortBy(x => x._3, false)

// println(rdd1.take(5).mkString("\n"))var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd2=bigdata1.sortBy(x=>x._3,false)

// println(rdd2.take(5).mkString("\n"))var total1 = math1.union(bigdata1)println(total1.collect().mkString("\n"))截图1

代码2(最终代码)

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd1 = math1.sortBy(x => x._3, false)

// println(rdd1.take(5).mkString("\n"))var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd2=bigdata1.sortBy(x=>x._3,false)

// println(rdd2.take(5).mkString("\n"))var total1 = math1.union(bigdata1)val scoreIs100_id=total1.filter(x=>x._3==100).map(x=>x._1).distinct()

// println(total1.collect().mkString("\n"))println(scoreIs100_id.collect().mkString("\n"))截图2

4.任务3:

(1)求每个学生的总成绩(即大数据成绩+数学成绩)

代码1

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd1 = math1.sortBy(x => x._3, false)

// println(rdd1.take(5).mkString("\n"))var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd2=bigdata1.sortBy(x=>x._3,false)

// println(rdd2.take(5).mkString("\n"))var math2=math1.map(x=>(x._1,x._3))var bigdata2=bigdata1.map(x=>(x._1,x._3))var total2=math2.union(bigdata2)println(total2.collect().mkString("\n"))截图1

代码2

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd1 = math1.sortBy(x => x._3, false)

// println(rdd1.take(5).mkString("\n"))var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd2=bigdata1.sortBy(x=>x._3,false)

// println(rdd2.take(5).mkString("\n"))var math2 = math1.map(x => (x._1, x._3))var bigdata2 = bigdata1.map(x => (x._1, x._3))var total2=math2.union(bigdata2)var total_score=total2.reduceByKey((y1,y2)=>(y1+y2))println(total_score.collect().mkString("\n"))截图2

代码3(最终代码)

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd1 = math1.sortBy(x => x._3, false)

// println(rdd1.take(5).mkString("\n"))var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd2=bigdata1.sortBy(x=>x._3,false)

// println(rdd2.take(5).mkString("\n"))var math2 = math1.map(x => (x._1, x._3))var bigdata2 = bigdata1.map(x => (x._1, x._3))var total2=math2.union(bigdata2)var total_score=total2.reduceByKey((y1,y2)=>(y1+y2)).map(x=>(x._1,"总成绩",x._2)).sortBy(x=>x._1)println(total_score.collect().mkString("\n"))截图3

(2)求每个学生的平均成绩(即总成绩/科目总数)

代码1

var math_path = "src\\main\\resources\\result_math.txt"var math_data = sc.textFile(math_path)var math1 = math_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd1 = math1.sortBy(x => x._3, false)

// println(rdd1.take(5).mkString("\n"))var bigdata_path = "src\\main\\resources\\result_bigdata.txt"var bigdata_data = sc.textFile(bigdata_path)var bigdata1 = bigdata_data.map(x => x.split("\t")).map(x => (x(0), x(1), x(2).toInt))

// var rdd2=bigdata1.sortBy(x=>x._3,false)

// println(rdd2.take(5).mkString("\n"))var total0 = math1.union(bigdata1)//求科目总数var subjectNum=total0.map(x=>x._2).distinct().count().toIntvar aver1_score=total0.map(x=>(x._1,x._3)).reduceByKey((y1,y2)=>(y1+y2)).map(x=>(x._1,"平均成绩",x._2/subjectNum)).sortBy(x=>x._1)println(aver1_score.collect().mkString("\n"))截图1

5.任务4:

(1)求全班大数据单科平均分

代码1

//求数学单科平均分var math_stuCount = math1.count().toIntvar math_oneSubjectAver = math1.map(x => (x._2, x._3)).reduceByKey((y1, y2) => (y1 + y2)).map(x => ("数学单科平均分", x._2 / math_stuCount))println(math_oneSubjectAver.collect().mkString(", "))截图1

(2)求全班数学单科平均分

代码1

//求大数据单科平均分var bigdata_stuCount = bigdata1.count().toIntvar bigdata_oneSubjectAver = bigdata1.map(x => (x._2, x._3)).reduceByKey((y1, y2) => (y1 + y2)).map(x => ("大数据单科平均分", x._2 / bigdata_stuCount))println(bigdata_oneSubjectAver.collect().mkString(","))截图1

6.其他

(1)sparkRDD是什么和sparkSQL是什么关系

在Apache Spark中,`RDD`(Resilient Distributed Dataset)和`SparkSQL`是两个不同的概念,它们分别代表了Spark中的核心数据结构和处理框架,但它们之间是有关系的。

### 1. **RDD(Resilient Distributed Dataset)**

- **定义**:RDD是Spark的核心抽象,是一个不可变的分布式数据集,支持并行处理。它是Spark计算模型的基础,所有的数据都可以通过RDD进行处理。

- **特性**:

- **弹性(Resilient)**:即使某些数据分区丢失,RDD也能够自动从其他地方恢复数据。

- **分布式(Distributed)**:RDD的元素存储在集群中的多个节点上,因此可以进行并行处理。

- **不可变(Immutable)**:RDD一旦创建,就无法更改。如果需要修改RDD的内容,必须创建一个新的RDD。

- **使用场景**:RDD通常用于处理低级的并行计算任务,它提供了丰富的操作,如`map`、`filter`、`reduce`等。

### 2. **SparkSQL**

- **定义**:SparkSQL是一个用于结构化数据查询的组件,它允许使用SQL查询、DataFrame和Dataset API对数据进行处理。SparkSQL支持从多种数据源加载数据,如Hive、Parquet、JSON等。

- **特性**:

- 支持通过SQL语法直接查询数据,使用SQL与RDD不同的高层次抽象(如DataFrame和Dataset)。

- 提供了对结构化数据的优化查询执行引擎,可以有效地优化查询计划。

- 可以通过SQL执行复杂的操作,如联接、分组、排序等。

- **使用场景**:SparkSQL适用于需要使用SQL查询的结构化数据处理场景,并且能比直接使用RDD更方便和高效地执行复杂查询。

### **RDD与SparkSQL的关系**

- **底层实现**:SparkSQL的核心实现是建立在RDD之上的。虽然用户可以使用SQL或者DataFrame API进行高层次操作,但底层的计算仍然通过RDD来实现。

- **转换关系**:

- `DataFrame`和`Dataset`(SparkSQL的两种高层次API)都是基于RDD构建的。你可以通过将RDD转换为DataFrame或Dataset来利用SparkSQL提供的优化和功能。

- 例如,`DataFrame`是一个分布式的数据集,类似于数据库中的表格,它是在RDD的基础上进一步封装的,提供了更高效的查询和处理功能。

- **性能优化**:SparkSQL通过Catalyst查询优化器对SQL查询进行优化,生成更高效的执行计划。这个优化过程是通过RDD操作的进一步封装和调整来实现的,确保SparkSQL在处理数据时尽可能高效。

### 总结

- **RDD** 是Spark的基础抽象,代表分布式、不可变的数据集。

- **SparkSQL** 是一个高层次的接口,用于进行结构化数据的查询和分析,支持SQL语法和更高级的DataFrame、Dataset API。它建立在RDD的基础上,但提供了更优化和简便的查询方式。

(2)spark-shell是什么

`spark-shell` 是 Apache Spark 提供的一个交互式命令行工具,用于与 Spark 集群进行交互并执行 Spark 作业。它提供了一个基于 Scala 的 REPL(Read-Eval-Print Loop)环境,允许用户以编程方式直接在 Spark 集群上运行代码、执行数据分析操作和调试任务。

具体来说,`spark-shell` 的功能包括:

1. **交互式编程**:通过 Scala 命令行,用户可以直接在 Spark 集群上运行代码,而无需编写完整的 Spark 应用程序。

2. **集群管理**:它自动设置 Spark 集群的连接和资源管理,帮助用户方便地运行分布式计算任务。

3. **调试和测试**:适用于开发和调试阶段,可以快速验证代码段或算法的执行结果。

4. **支持 RDD 和 DataFrame 操作**:用户可以利用 `spark-shell` 进行 Spark 核心功能的操作,如 RDD 和 DataFrame 的创建与转换。

### 使用方式

在安装了 Spark 的机器上,可以通过命令行启动 `spark-shell`:

```bash

./bin/spark-shell

```

这将启动一个 Scala REPL 环境,允许用户通过 Scala 编写并执行 Spark 代码。

### 示例

启动 `spark-shell` 后,可以执行如下操作:

```scala

val data = sc.parallelize(1 to 100)

val result = data.filter(_ % 2 == 0).collect()

println(result.mkString(", "))

```

以上代码会在 Spark 集群上并行地处理数据,筛选出偶数并返回结果。

总的来说,`spark-shell` 是一个非常有用的工具,适合用于快速原型开发、调试以及测试 Spark 程序。

相关文章:

sparkRDD教程之必会的题目

1.前期准备 (1)看看上一期的博客,最好跟着上一期的博客把sparkRDD的基本命令给熟练掌握后,再来做这篇文章的任务。 上一期的博客:sparkRDD教程之基本命令-CSDN博客 (2)新建文件task6.scala …...

Unity 2d描边基于SpriteRender,高性能的描边解决方案

目标 以Unity默认渲染管线为例,打造不需要图片内边距,描边平滑,高性能的描边解决方案 前言 在2d游戏中经常需要给2d对象添加描边,来突出强调2d对象 当你去网上查找2d描边shader,移植到项目里面,大概率会…...

信凯科技业绩波动明显:毛利率远弱行业,资产负债率偏高

《港湾商业观察》施子夫 1月8日,深交所官网显示,浙江信凯科技集团股份有限公司(以下简称“信凯科技”)主板IPO提交注册。 自2022年递交上市申请,信凯科技的IPO之路已走过两年光景,尽管提交注册࿰…...

js基础---var与let的区别以及const的使用

js基础—var与let的区别以及const的使用 var与let的区别 在较旧的JavaScript,使用关键字var来声明变量,而不是let。var现在开发中一般不再使用它,只是我们可能再老版程序中看到它。let的出现为了解决var的一些问题。 var 声明存在以下三种问…...

用css和html制作太极图

目录 css相关参数介绍 边距 边框 伪元素选择器 太极图案例实现、 代码 效果 css相关参数介绍 边距 <!DOCTYPE html> <html><head><meta charset"utf-8"><title></title><style>*{margin: 0;padding: 0;}div{width: …...

OJ12:160. 相交链表

目录 题目思路分析代码展示 题目 给你两个单链表的头节点 headA 和 headB ,请你找出并返回两个单链表相交的起始节点。如果两个链表不存在相交节点,返回 null 。 示例 1: 输入:intersectVal 8, listA [4,1,8,4,5], listB [5,…...

软件工程和项目管理领域 - CMMI 极简理解

CMMI 概述 CMMI 全称为 Capability Maturity Model Integration,即能力成熟度模型集成 CMMI 是由美国卡内基梅隆大学软件工程研究所(SEI)开发的一套综合性管理模型 CMMI 是一种用于评估和改进组织在软件开发和维护方面过程能力的国际标准 …...

C# 线程基础之 线程同步

线程同步的手段很多 lock 是通过内存索引块 0 1 切换 进行互斥的实现 互斥量 信号量 事件消息 其实意思就是 一个 标记量 通过这个标记 来进行类似的互斥手段 具体方式的分析 代码在后 1.互斥量 Mutex 作用 非常类似lock 一个Mutex 名称来代替 lock的引用对象 2.信号量 Semaph…...

[c语言日寄]c语言也有“回”字的多种写法——整数交换的三种方式

大家好啊,在今天的快乐刷题中,我们遇到了这样一道题目: 题目 写出 三种不同方式的 交换两个整数变量的 函数 交换变量的三种解法 常规方式 想要交换两个变量很简单,第一种方式就是新建一个临时变量,具体流程如下&…...

RocketMQ 知识速览

文章目录 一、消息队列对比二、RocketMQ 基础1. 消息模型2. 技术架构3. 消息类型4. 消费者类型5. 消费者分组和生产者分组 三、RocketMQ 高级1. 如何解决顺序消费和重复消费2. 如何实现分布式事务3. 如何解决消息堆积问题4. 如何保证高性能读写5. 刷盘机制 (topic 模…...

优化 Azure Synapse Dedicated SQL Pool中的 SQL 执行性能的经验方法

在 Azure Synapse Dedicated SQL Pool中优化 SQL 执行涉及了解底层体系结构(例如分布和分区)、查询优化(例如避免不必要的子查询和联接),以及利用具体化视图和 PolyBase 等工具进行高效数据加载。 1.有效使用分布和分…...

)

详解英语单词“pro bono”:公益服务的表达(中英双语)

中文版 详解英语单词“pro bono”:公益服务的表达 一、词义解释 “Pro bono” 是一个源自拉丁语的短语,完整表达为 “pro bono publico”,意思是“为了公众利益”(for the public good)。在现代英语中,它…...

16. C语言 字符串详解

本章目录: 前言C 字符串的基础概念字符串的定义字符串的内存表示 常见的字符串操作函数示例代码 深入探讨字符串长度计算strlen 与 sizeof 的区别 字符串操作的注意事项**1. 字符数组的大小**2. 字符数组和字符指针的区别3. 使用安全函数 字符串的遍历与格式化输出**遍历字符串…...

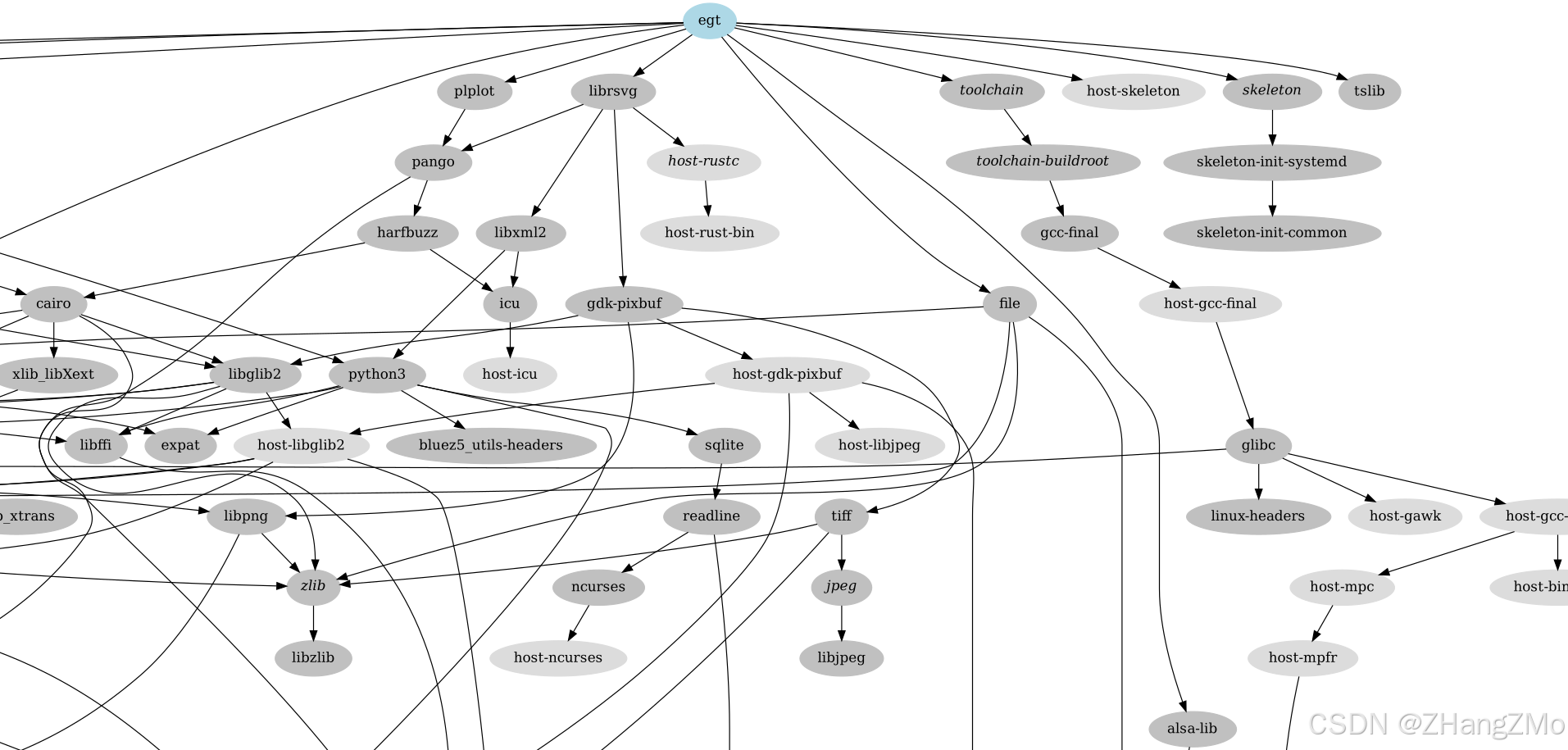

使用Buildroot开始嵌入式Linux系统之旅-3

文章目录 at91bootstrap操作教程修改at91bootstrap具体配置重新编译at91bootstrap U-Boot操作教程修改U-Boot具体配置重新编译U-Boot Linux Kernel操作教程修改Linux Kernel具体配置重新编译Linux Kernel buildroot操作进阶生成图形化软件模块依赖关系查看具体软件模块依赖关系…...

[免费]SpringBoot+Vue新能源汽车充电桩管理系统【论文+源码+SQL脚本】

大家好,我是java1234_小锋老师,看到一个不错的SpringBootVue新能源汽车充电桩管理系统,分享下哈。 项目视频演示 【免费】SpringBootVue新能源汽车充电桩管理系统 Java毕业设计_哔哩哔哩_bilibili 项目介绍 随着信息化时代的到来࿰…...

【已解决】【记录】2AI大模型web UI使用tips 本地

docker desktop使用 互动 如果需要发送网页链接,就在链接上加上【#】号 如果要上传文件就点击这个➕号 中文回复 命令它只用中文回复,在右上角打开【对话高级设置】 输入提示词(提示词使用英文会更好) Must reply to the us…...

44.ComboBox的数据绑定 C#例子 WPF例子

固定最简步骤,包括 XAML: 题头里引入命名空间 标题下面引入类 combobox绑定资源属性和选择属性,block则绑定和combobox一样的选择属性 C#: 通知的类,及对应固定的任务 引入字段 引入属性 其中资源是只读的 选…...

物联网之传感器技术

引言 在数字化浪潮席卷全球的今天,物联网(IoT)已成为推动各行各业变革的重要力量。而物联网传感器,作为物联网感知层的核心技术,更是扮演着不可或缺的角色。它们如同人类的五官,能够感知物理世界中的各种信…...

QTreeWidget QTreeWidgetItem

QTreeWidgetItem 是 Qt 框架中用于在 QTreeWidget 中表示树形结构中每个节点的类。它是 QTreeWidget 的一部分,允许您创建和管理层次结构的数据展示。 QTreeWidgetItem 用于表示树形结构中的单个节点。 添加子节点: 可以通过 addChild() 方法向节点添加…...

torch.einsum计算张量的外积

torch.einsum 是一种强大的张量操作工具,可以通过爱因斯坦求和约定(Einstein summation convention)来简洁地表示复杂的张量运算。通过它,我们可以高效地计算矩阵乘法、转置、点积、外积等操作。 以下是关于如何使用 torch.einsum 计算两个四维张量在第三维度上的外积的解…...

AI智能体架构设计:从成本黑洞到价值引擎的解耦之道

1. 从成本黑洞到价值引擎:为什么你的AI智能体架构正在吞噬预算又到了季度技术复盘会,财务那边递过来的云账单和工程人力成本,是不是又让你倒吸一口凉气?你看着报表上那个名为“AI智能体平台”的项目,它的资源消耗曲线几…...

3个关键功能解析:USBToolBox如何简化macOS与Windows的USB端口映射难题

3个关键功能解析:USBToolBox如何简化macOS与Windows的USB端口映射难题 【免费下载链接】tool the USBToolBox tool 项目地址: https://gitcode.com/gh_mirrors/too/tool 在Hackintosh和跨平台开发领域,USB端口映射一直是个令人头疼的技术难题。US…...

DeepSeek代码质量评估实战手册:7步完成从混沌到可度量的质变跃迁

更多请点击: https://kaifayun.com 第一章:DeepSeek代码质量评估的底层逻辑与核心价值 DeepSeek代码质量评估并非简单地统计行数或检测语法错误,而是基于多维语义理解构建的推理系统。其底层逻辑融合了静态分析、符号执行与大语言模型生成式…...

Unity动态自然系统:Forest Environment-Dynamic Nature深度解析

1. 这不是“贴图堆砌”,而是自然系统级建模:Forest Environment-Dynamic Nature 的真实定位你有没有试过在Unity里拖进几棵树、铺点草、加个天空盒,然后发现场景像一张静止的风景明信片——风不动、叶不摇、雨不落、雾不散?我做过…...

LangGraph状态机工程:构建复杂AI工作流的完整指南

传统RAG(检索增强生成)在处理简单的"单跳"问题时表现良好——“文章里提到了什么” “这个概念是什么意思”——但当问题涉及多个实体之间的关系、需要跨多个文档推理时,传统RAG就显得力不从心。GraphRAG(Graph-based R…...

PCL 法向量夹角剔除错误匹配点对【2026最新版】

目录 一、 算法简介 1、主要函数 2、参考文献 二、 代码实现 三、 结果展示 四、 参考链接 博客长期更新,本文最新更新时间为:2026年5月24日。代码在PCL1.15.1中测试通过 一、 算法简介 在三维点云配准中,对应点(correspondence)的准确性直接决定了配准算法的精度和鲁棒性…...

flameshow性能优化技巧:如何快速定位Go程序中的CPU热点

flameshow性能优化技巧:如何快速定位Go程序中的CPU热点 【免费下载链接】flameshow A terminal Flamegraph viewer. 项目地址: https://gitcode.com/gh_mirrors/fl/flameshow 🔥 想要快速定位Go程序中的性能瓶颈吗?flameshow是一个强大…...

Gazebo Sim多旋翼控制:四轴飞行器动力学建模与PID调参

Gazebo Sim多旋翼控制:四轴飞行器动力学建模与PID调参 【免费下载链接】gz-sim Open source robotics simulator. The latest version of Gazebo. 项目地址: https://gitcode.com/gh_mirrors/gz/gz-sim Gazebo Sim是一款功能强大的开源机器人模拟器ÿ…...

OpenRASP原理与实战:Java应用层实时防护技术详解

1. 为什么我宁愿花三天部署OpenRASP,也不愿再写第五个自定义WAF过滤器去年冬天,我在给一家做在线教育SaaS平台做安全加固时,连续踩了三个坑:第一次用NginxLua写了套SQL注入规则,结果学生提交的“SELECT * FROM courses…...

ComfyUI-WD14-Tagger:3分钟实现AI智能图像标签提取,效率提升10倍

ComfyUI-WD14-Tagger:3分钟实现AI智能图像标签提取,效率提升10倍 【免费下载链接】ComfyUI-WD14-Tagger A ComfyUI extension allowing for the interrogation of booru tags from images. 项目地址: https://gitcode.com/gh_mirrors/co/ComfyUI-WD14-…...