对音频切分成小音频(机器学习用)

我是把so-vits中小工具,分析源码然后提取出来了。以后可以写在自己的程序里。

-------流程(这是我做的流程,你可以不用看)

从开源代码中快速获取自己需要的东西

如果有界面f12看他里面的接口,然后在源码中全局搜索,没有接口比如socket,看他的消息字段,然后推测。然后提取补齐代码就行了

-------

你需要看的

提取出来有3个类

run.py是我自己写的

其他是我提取的源码,首先你得install一些包

numpy,librosa,soundfile

slicer2.py

import numpy as np# This function is obtained from librosa.

def get_rms(y,*,frame_length=2048,hop_length=512,pad_mode="constant",

):padding = (int(frame_length // 2), int(frame_length // 2))y = np.pad(y, padding, mode=pad_mode)axis = -1# put our new within-frame axis at the end for nowout_strides = y.strides + tuple([y.strides[axis]])# Reduce the shape on the framing axisx_shape_trimmed = list(y.shape)x_shape_trimmed[axis] -= frame_length - 1out_shape = tuple(x_shape_trimmed) + tuple([frame_length])xw = np.lib.stride_tricks.as_strided(y, shape=out_shape, strides=out_strides)if axis < 0:target_axis = axis - 1else:target_axis = axis + 1xw = np.moveaxis(xw, -1, target_axis)# Downsample along the target axisslices = [slice(None)] * xw.ndimslices[axis] = slice(0, None, hop_length)x = xw[tuple(slices)]# Calculate powerpower = np.mean(np.abs(x) ** 2, axis=-2, keepdims=True)return np.sqrt(power)class Slicer:def __init__(self,sr: int,threshold: float = -40.,min_length: int = 5000,min_interval: int = 300,hop_size: int = 20,max_sil_kept: int = 5000):if not min_length >= min_interval >= hop_size:raise ValueError('The following condition must be satisfied: min_length >= min_interval >= hop_size')if not max_sil_kept >= hop_size:raise ValueError('The following condition must be satisfied: max_sil_kept >= hop_size')min_interval = sr * min_interval / 1000self.threshold = 10 ** (threshold / 20.)self.hop_size = round(sr * hop_size / 1000)self.win_size = min(round(min_interval), 4 * self.hop_size)self.min_length = round(sr * min_length / 1000 / self.hop_size)self.min_interval = round(min_interval / self.hop_size)self.max_sil_kept = round(sr * max_sil_kept / 1000 / self.hop_size)def _apply_slice(self, waveform, begin, end):if len(waveform.shape) > 1:return waveform[:, begin * self.hop_size: min(waveform.shape[1], end * self.hop_size)]else:return waveform[begin * self.hop_size: min(waveform.shape[0], end * self.hop_size)]# @timeitdef slice(self, waveform):if len(waveform.shape) > 1:samples = waveform.mean(axis=0)else:samples = waveformif samples.shape[0] <= self.min_length:return [waveform]rms_list = get_rms(y=samples, frame_length=self.win_size, hop_length=self.hop_size).squeeze(0)sil_tags = []silence_start = Noneclip_start = 0for i, rms in enumerate(rms_list):# Keep looping while frame is silent.if rms < self.threshold:# Record start of silent frames.if silence_start is None:silence_start = icontinue# Keep looping while frame is not silent and silence start has not been recorded.if silence_start is None:continue# Clear recorded silence start if interval is not enough or clip is too shortis_leading_silence = silence_start == 0 and i > self.max_sil_keptneed_slice_middle = i - silence_start >= self.min_interval and i - clip_start >= self.min_lengthif not is_leading_silence and not need_slice_middle:silence_start = Nonecontinue# Need slicing. Record the range of silent frames to be removed.if i - silence_start <= self.max_sil_kept:pos = rms_list[silence_start: i + 1].argmin() + silence_startif silence_start == 0:sil_tags.append((0, pos))else:sil_tags.append((pos, pos))clip_start = poselif i - silence_start <= self.max_sil_kept * 2:pos = rms_list[i - self.max_sil_kept: silence_start + self.max_sil_kept + 1].argmin()pos += i - self.max_sil_keptpos_l = rms_list[silence_start: silence_start + self.max_sil_kept + 1].argmin() + silence_startpos_r = rms_list[i - self.max_sil_kept: i + 1].argmin() + i - self.max_sil_keptif silence_start == 0:sil_tags.append((0, pos_r))clip_start = pos_relse:sil_tags.append((min(pos_l, pos), max(pos_r, pos)))clip_start = max(pos_r, pos)else:pos_l = rms_list[silence_start: silence_start + self.max_sil_kept + 1].argmin() + silence_startpos_r = rms_list[i - self.max_sil_kept: i + 1].argmin() + i - self.max_sil_keptif silence_start == 0:sil_tags.append((0, pos_r))else:sil_tags.append((pos_l, pos_r))clip_start = pos_rsilence_start = None# Deal with trailing silence.total_frames = rms_list.shape[0]if silence_start is not None and total_frames - silence_start >= self.min_interval:silence_end = min(total_frames, silence_start + self.max_sil_kept)pos = rms_list[silence_start: silence_end + 1].argmin() + silence_startsil_tags.append((pos, total_frames + 1))# Apply and return slices.if len(sil_tags) == 0:return [waveform]else:chunks = []if sil_tags[0][0] > 0:chunks.append(self._apply_slice(waveform, 0, sil_tags[0][0]))for i in range(len(sil_tags) - 1):chunks.append(self._apply_slice(waveform, sil_tags[i][1], sil_tags[i + 1][0]))if sil_tags[-1][1] < total_frames:chunks.append(self._apply_slice(waveform, sil_tags[-1][1], total_frames))return chunksdef main():import os.pathfrom argparse import ArgumentParserimport librosaimport soundfileparser = ArgumentParser()parser.add_argument('audio', type=str, help='The audio to be sliced')parser.add_argument('--out', type=str, help='Output directory of the sliced audio clips')parser.add_argument('--db_thresh', type=float, required=False, default=-40,help='The dB threshold for silence detection')parser.add_argument('--min_length', type=int, required=False, default=5000,help='The minimum milliseconds required for each sliced audio clip')parser.add_argument('--min_interval', type=int, required=False, default=300,help='The minimum milliseconds for a silence part to be sliced')parser.add_argument('--hop_size', type=int, required=False, default=10,help='Frame length in milliseconds')parser.add_argument('--max_sil_kept', type=int, required=False, default=500,help='The maximum silence length kept around the sliced clip, presented in milliseconds')args = parser.parse_args()out = args.outif out is None:out = os.path.dirname(os.path.abspath(args.audio))audio, sr = librosa.load(args.audio, sr=None, mono=False)slicer = Slicer(sr=sr,threshold=args.db_thresh,min_length=args.min_length,min_interval=args.min_interval,hop_size=args.hop_size,max_sil_kept=args.max_sil_kept)chunks = slicer.slice(audio)if not os.path.exists(out):os.makedirs(out)for i, chunk in enumerate(chunks):if len(chunk.shape) > 1:chunk = chunk.Tsoundfile.write(os.path.join(out, f'%s_%d.wav' % (os.path.basename(args.audio).rsplit('.', maxsplit=1)[0], i)), chunk, sr)if __name__ == '__main__':main()

auto_slicer.py

import os

import numpy as np

import librosa

import soundfile as sf

from slicer2 import Slicerclass AutoSlicer:def __init__(self):self.slicer_params = {"threshold": -40,"min_length": 5000,"min_interval": 300,"hop_size": 10,"max_sil_kept": 500,}self.original_min_interval = self.slicer_params["min_interval"]def auto_slice(self, filename, input_dir, output_dir, max_sec):audio, sr = librosa.load(os.path.join(input_dir, filename), sr=None, mono=False)slicer = Slicer(sr=sr, **self.slicer_params)chunks = slicer.slice(audio)files_to_delete = []for i, chunk in enumerate(chunks):if len(chunk.shape) > 1:chunk = chunk.Toutput_filename = f"{os.path.splitext(filename)[0]}_{i}"output_filename = "".join(c for c in output_filename if c.isascii() or c == "_") + ".wav"output_filepath = os.path.join(output_dir, output_filename)sf.write(output_filepath, chunk, sr)#Check and re-slice audio that more than max_sec.while True:new_audio, sr = librosa.load(output_filepath, sr=None, mono=False)if librosa.get_duration(y=new_audio, sr=sr) <= max_sec:breakself.slicer_params["min_interval"] = self.slicer_params["min_interval"] // 2if self.slicer_params["min_interval"] >= self.slicer_params["hop_size"]:new_chunks = Slicer(sr=sr, **self.slicer_params).slice(new_audio)for j, new_chunk in enumerate(new_chunks):if len(new_chunk.shape) > 1:new_chunk = new_chunk.Tnew_output_filename = f"{os.path.splitext(output_filename)[0]}_{j}.wav"sf.write(os.path.join(output_dir, new_output_filename), new_chunk, sr)files_to_delete.append(output_filepath)else:breakself.slicer_params["min_interval"] = self.original_min_intervalfor file_path in files_to_delete:if os.path.exists(file_path):os.remove(file_path)def merge_short(self, output_dir, max_sec, min_sec):short_files = []for filename in os.listdir(output_dir):filepath = os.path.join(output_dir, filename)if filename.endswith(".wav"):audio, sr = librosa.load(filepath, sr=None, mono=False)duration = librosa.get_duration(y=audio, sr=sr)if duration < min_sec:short_files.append((filepath, audio, duration))short_files.sort(key=lambda x: x[2], reverse=True)merged_audio = []current_duration = 0for filepath, audio, duration in short_files:if current_duration + duration <= max_sec:merged_audio.append(audio)current_duration += durationos.remove(filepath)else:if merged_audio:output_audio = np.concatenate(merged_audio, axis=-1)if len(output_audio.shape) > 1:output_audio = output_audio.Toutput_filename = f"merged_{len(os.listdir(output_dir))}.wav"sf.write(os.path.join(output_dir, output_filename), output_audio, sr)merged_audio = [audio]current_duration = durationos.remove(filepath)if merged_audio and current_duration >= min_sec:output_audio = np.concatenate(merged_audio, axis=-1)if len(output_audio.shape) > 1:output_audio = output_audio.Toutput_filename = f"merged_{len(os.listdir(output_dir))}.wav"sf.write(os.path.join(output_dir, output_filename), output_audio, sr)def slice_count(self, input_dir, output_dir):orig_duration = final_duration = 0for file in os.listdir(input_dir):if file.endswith(".wav"):_audio, _sr = librosa.load(os.path.join(input_dir, file), sr=None, mono=False)orig_duration += librosa.get_duration(y=_audio, sr=_sr)wav_files = [file for file in os.listdir(output_dir) if file.endswith(".wav")]num_files = len(wav_files)max_duration = -1min_duration = float("inf")for file in wav_files:file_path = os.path.join(output_dir, file)audio, sr = librosa.load(file_path, sr=None, mono=False)duration = librosa.get_duration(y=audio, sr=sr)final_duration += float(duration)if duration > max_duration:max_duration = float(duration)if duration < min_duration:min_duration = float(duration)return num_files, max_duration, min_duration, orig_duration, final_durationrun.py

import os

from auto_slicer import AutoSlicer

import librosa

def slicer_fn(input_dir, output_dir, process_method, max_sec, min_sec):if output_dir == "":return "请先选择输出的文件夹"if output_dir == input_dir:return "输出目录不能和输入目录相同"slicer = AutoSlicer()if os.path.exists(output_dir) is not True:os.makedirs(output_dir)for filename in os.listdir(input_dir):if filename.lower().endswith(".wav"):slicer.auto_slice(filename, input_dir, output_dir, max_sec)if process_method == "丢弃":for filename in os.listdir(output_dir):if filename.endswith(".wav"):filepath = os.path.join(output_dir, filename)audio, sr = librosa.load(filepath, sr=None, mono=False)if librosa.get_duration(y=audio, sr=sr) < min_sec:os.remove(filepath)elif process_method == "将过短音频整合为长音频":slicer.merge_short(output_dir, max_sec, min_sec)file_count, max_duration, min_duration, orig_duration, final_duration = slicer.slice_count(input_dir, output_dir)hrs = int(final_duration / 3600)mins = int((final_duration % 3600) / 60)sec = format(float(final_duration % 60), '.2f')rate = format(100 * (final_duration / orig_duration), '.2f') if orig_duration != 0 else 0rate_msg = f"为原始音频时长的{rate}%" if rate != 0 else "因未知问题,无法计算切片时长的占比"return f"成功将音频切分为{file_count}条片段,其中最长{max_duration}秒,最短{min_duration}秒,切片后的音频总时长{hrs:02d}小时{mins:02d}分{sec}秒,{rate_msg}"input_dir="F:\sliper\input"#输入文件夹(这里面可以放多个wav)

output_dir="F:\sliper\output"#输出文件夹

process_method="丢弃"#如果音频小于3就丢弃

max_sec=15#音频最长为15

min_sec=3#音频最小为3

slicer_fn(input_dir,output_dir,process_method,max_sec,min_sec)测试输入

得到

相关文章:

对音频切分成小音频(机器学习用)

我是把so-vits中小工具,分析源码然后提取出来了。以后可以写在自己的程序里。 -------流程(这是我做的流程,你可以不用看) 从开源代码中快速获取自己需要的东西 如果有界面f12看他里面的接口,然后在源码中全局搜索&…...

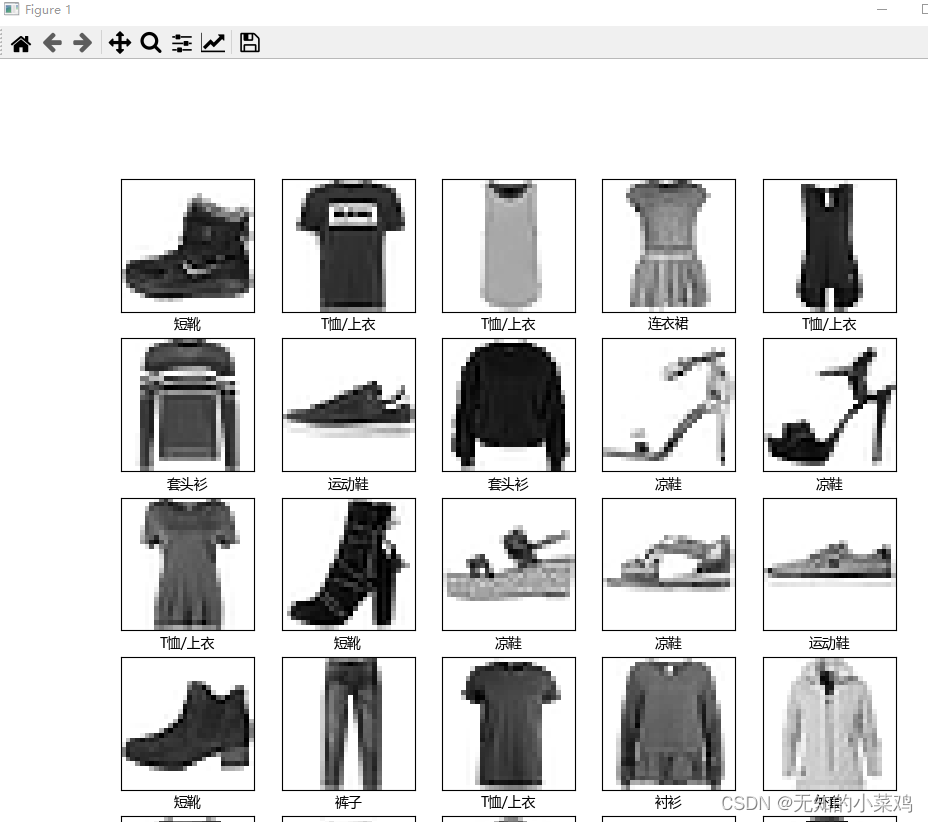

TensorFlow案例学习:对服装图像进行分类

前言 官方为我们提供了一个 对服装图像进行分类 的案例,方便我们快速学习 学习 预处理数据 案例中有下面这段代码 # 预处理数据,检查训练集中的第一个图像可以看到像素值处于0~255之间 plt.figure() # 创建图像窗口 plt.imshow(train_images[0]) # …...

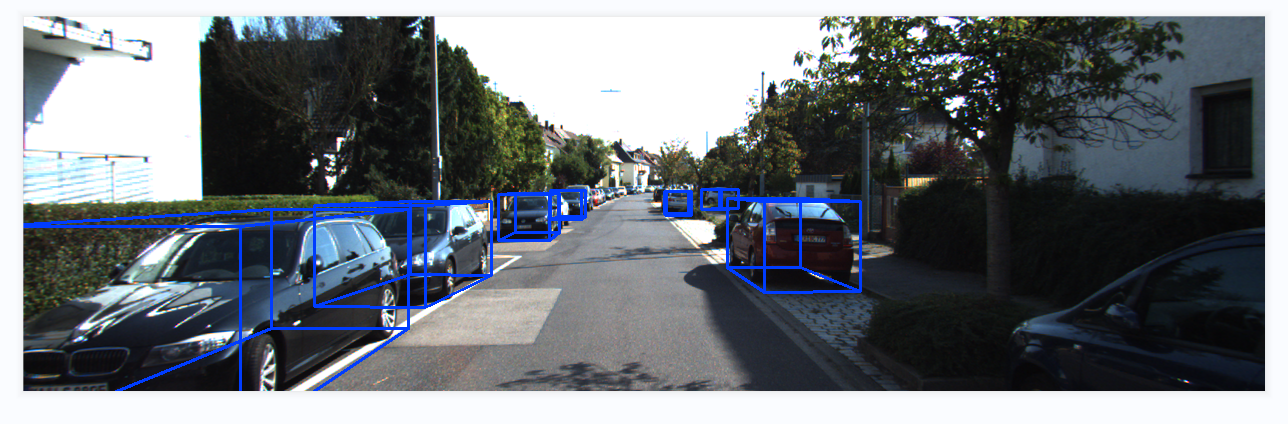

单目3D目标检测——SMOKE 模型推理 | 可视化结果

本文分享SMOKE的模型推理,和可视化结果。以kitti数据集为例子,对训练完的模型进行推理,并可视化3D框的结果,画到图像中。 关于模型原理、搭建开发环境、模型训练,可以参考之前的博客: 【论文解读】SMOKE …...

C++智能指针shared_ptr使用详解

shared_ptr 是一个共享所有权的智能指针,允许多个指针指向同一个对象。 shared_ptr使用引用计数,每一个shared_ptr的拷贝都指向相同的内存。每使用它一次,内部的引用计数加1,每析构一次,内部的引用计数减1,减为0时,释放所指向的堆内存。shared_ptr内部的引用计数是…...

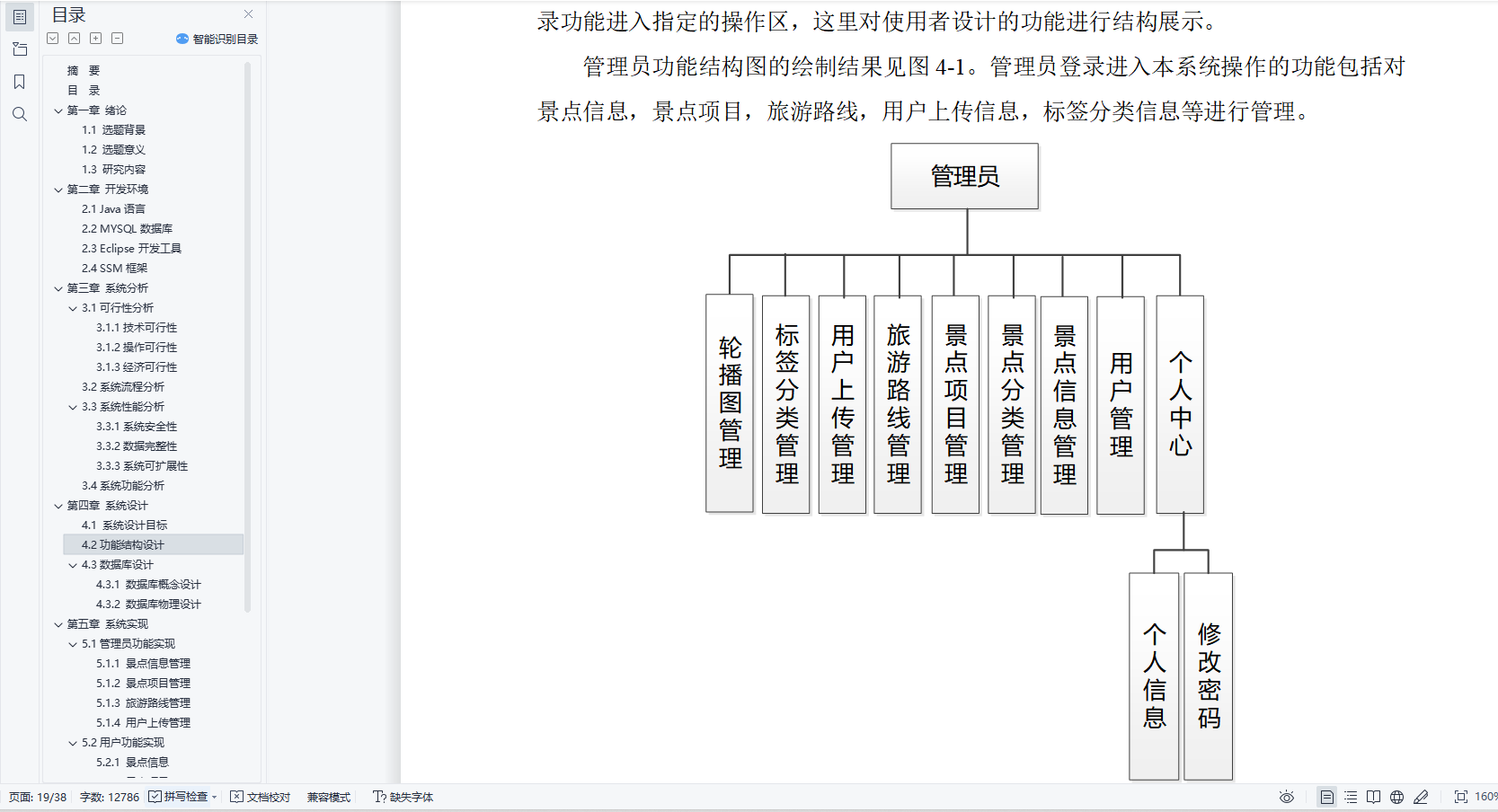

基于Java的个性化旅游攻略系统设计与实现(源码+lw+ppt+部署文档+视频讲解等)

文章目录 前言具体实现截图论文参考详细视频演示代码参考源码获取 前言 💗博主介绍:✌全网粉丝10W,CSDN特邀作者、博客专家、CSDN新星计划导师、全栈领域优质创作者,博客之星、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java、小程序技…...

中国替代方案探索:替代谷歌企业邮箱的选择

“谷歌企业邮箱在中国有哪些替代方案?在中国市场上表现出色的企业邮箱有腾讯企业邮箱、网易企业邮箱、阿里企业邮箱以及适合外贸的Zoho Mail企业邮箱。” 在中国由于各种原因,包括网络安全、数据隐私保护以及与GFW(防火长城)等,谷歌企业邮箱并…...

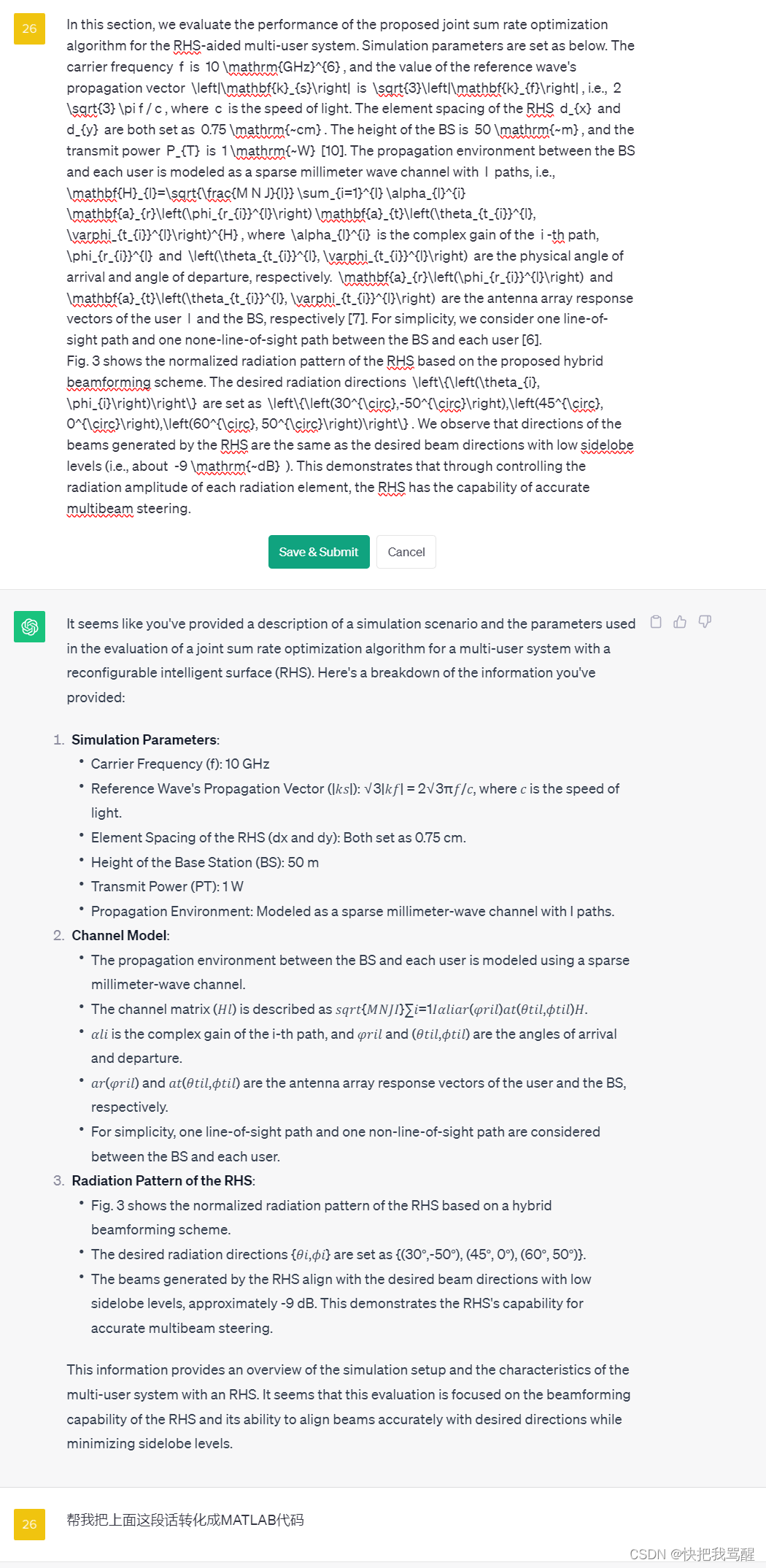

Holographic MIMO Surfaces (HMIMOS)以及Reconfigurable Holographic Surface(RHS)仿真

这里写目录标题 Simulation setupchatgpt帮我总结代码总结:chatgpt生成的代码还是不靠谱:考虑把之前看的RHS中对于多用户的改成单用户全系MIMO与普通MIMO或者说RIS的区别到底是啥? Holographic MIMO Surfaces (HMIMOS)…...

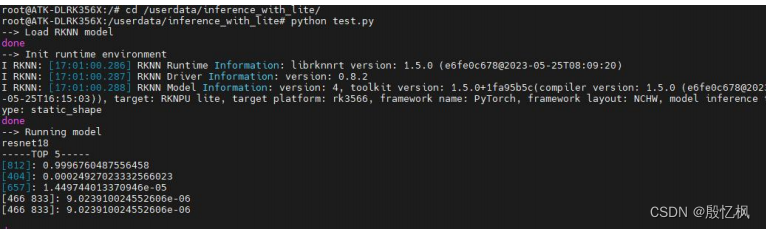

RK3568笔记一:RKNN开发环境搭建

若该文为原创文章,转载请注明原文出处。 由于对AI的好奇,想要学习如何部署AI,所以从RV1126到RK3568中过渡。 一、介绍 RK3568开发板使用的是正点原子新出的ATK-DLRK3568 开发板,主要是学习从训练到部署的全过程,并记…...

设计模式 - 行为型模式:策略模式(概述 | 案例实现 | 优缺点 | 使用场景)

目录 一、行为型模式 1.1、策略模式 1.1.1、概论 1.1.2、案例实现 1.1.3、优缺点 1.1.4、使用场景 一、行为型模式 1.1、策略模式 1.1.1、概论 策略模式设计的每一个算法都封装了起来,使他们可以相互替换,通过一个对象委派不同的算法给相应的客户…...

rancher部署pv、pvc、离线部署nfs

(1)NFS离线安装 使用nfs配置两台机器共享目录 假设两台机器188.188.30.32(服务端)、188.188.30.31(客户端)配置nfs 1.在可以联网的机器上下载rpm安装包 yum -y install nfs-utils --downloadonly --dow…...

视频拍摄教程分享

(1)新片场:静物美食视频拍摄(22.76GB) 链接:https://pan.baidu.com/s/1uj6wcPXGw-ztLQ1cdyogTA 提取码:929z(永久有效) (2)新片场:《孙晓迪分镜头脚本》掌握10种类型商业广告创作思…...

IP组成,分类,子网划分

一、基本概念 IP地址是指互联网协议地址,IP地址是IP协议提供的一种统一的地址格式,他为互联网上的每一个网络和每一台主机分配了一个逻辑地址,以此来屏蔽物理地址的差异,每个ip地址由网络地址和主机地址两个部分组成,网…...

Python视频剪辑-Moviepy视频内容变换技术

在视频编辑中,内容变换是个不能忽视的环节。这不仅仅是关于视频的方向、颜色或者大小,更多的是关于如何让视频内容更具创造性和吸引力。接下来将深入探讨如何使用MoviePy库进行高级的视频内容变换。 文章目录 视频内容变换函数剪辑逆时针旋转指定的角度或弧度像素的RGB值各取…...

OceanBase 数据库入门知识

🙈作者简介:练习时长两年半的Java up主 🙉个人主页:程序员老茶 🙊 ps:点赞👍是免费的,却可以让写博客的作者开兴好久好久😎 📚系列专栏:Java全栈,…...

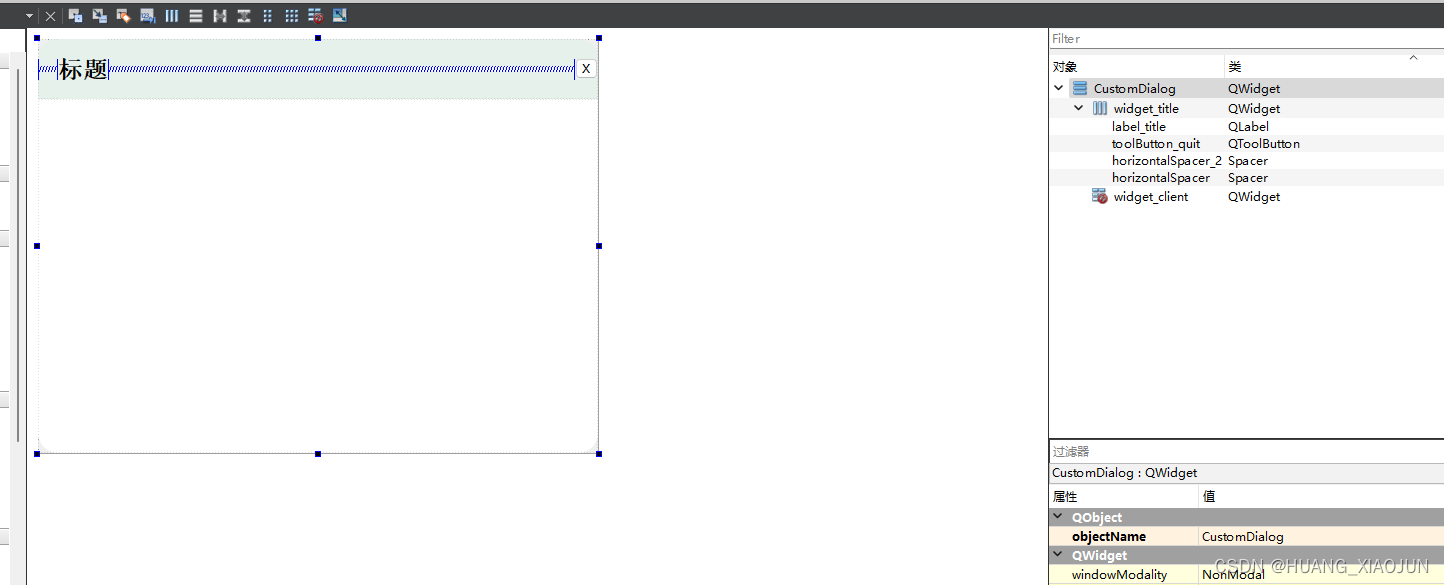

自定义无边框窗口

效果: 可拖动拉伸 ui:设计如下 样式表:在ui CustomDialog 里设置的 #widget_title{background: #E6F1EB;border-top-left-radius: 20px;border-top-right-radius: 20px;}#widget_client{background-color: rgb(255, 255, 255);border-bottom…...

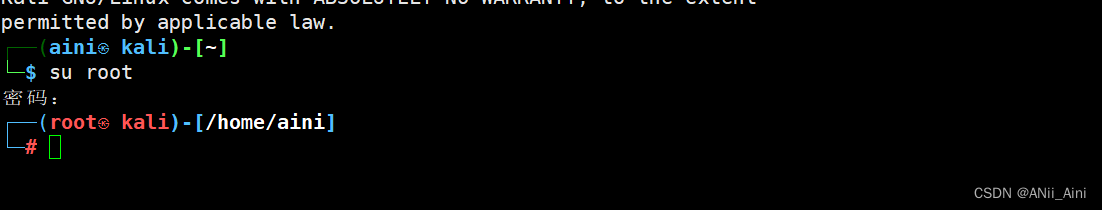

【网络安全 --- kali2023安装】超详细的kali2023安装教程(提供镜像资源)

如果你还没有安装vmware 虚拟机,请参考下面博客安装 【网络安全 --- 工具安装】VMware 16.0 详细安装过程(提供资源)-CSDN博客【网络安全 --- 工具安装】VMware 16.0 详细安装过程(提供资源)https://blog.csdn.net/m0…...

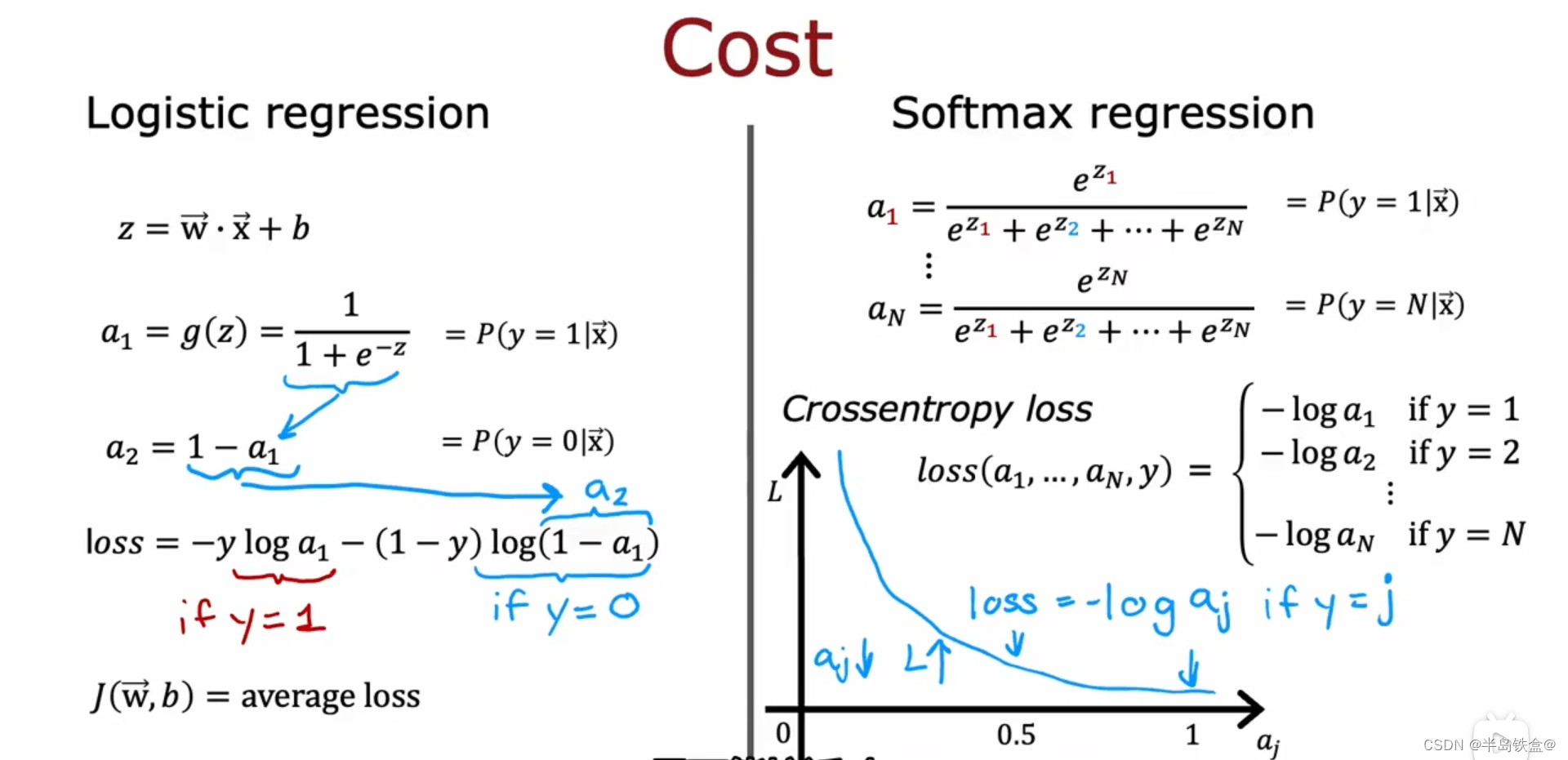

机器学习笔记(二)

过拟合 如下图左边,模型出现了过拟合现象 为了解决过拟合现象, 其中一个做法是多收集数据,如右图。 第二种做法是减少模型的特征数量,即x 第三种做法是正则化 正则化就是减少x前面的参数 w的数值, 不用消除x 正则化的梯度下降如下, 因为只是缩小了w的值,而 b的值保持不变 …...

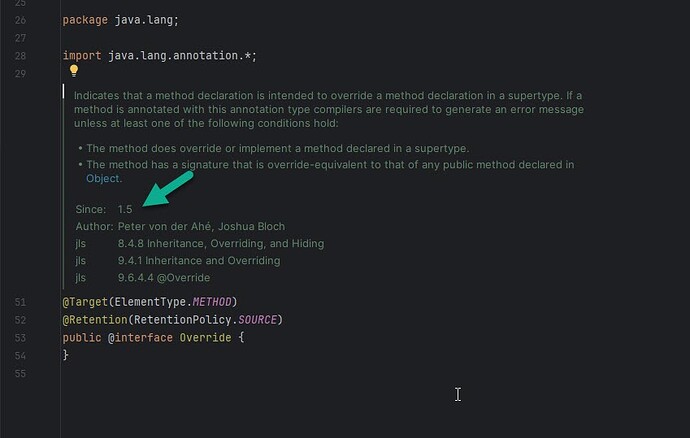

Java @Override 注解

在代码中,你可能会看到大量的 Override 注解。 这个注解简单来说就是让编译器去读的,能够避免你在写代码的时候犯一些低级的拼写错误。 Java Override 注解用来指定方法重写(Override),只能修饰方法并且只能用于方法…...

用rabbitMq 怎么处理“延迟消息队列”?

延迟消息队列是一种允许消息在发送后等待一段时间,然后再被消费的机制。这种机制通常用于需要延迟处理的应用场景,如定时任务、消息重试、消息调度等。在 RabbitMQ 中,实现延迟消息队列需要使用一些额外的组件和技术,因为 RabbitM…...

不常见的JS加密分析

前言 今天发现一个很少见的JS加密代码,他由一段十分少见的环境检测逻辑,修改一个字符都会被检测到,十分神奇,今天献上。 源代码 let hiJsJiami;!function(){const Zg3GArray.prototype.slice.call(arguments);return eval(&…...

轻量级爬虫框架slacrawl:基于规则驱动的模块化数据采集实践

1. 项目概述:一个轻量级、模块化的网页爬虫框架最近在做一个需要从多个网站定时抓取结构化数据的小项目,找了一圈现成的工具,要么太重(像Scrapy,学起来成本高),要么太死板(很多脚本只…...

基于LLM的长文本摘要工具SumGPT:从原理到本地化部署实战

1. 项目概述:一个为长文本摘要而生的智能工具最近在折腾一些文档处理的工作流,发现一个挺普遍但很烦人的痛点:面对动辄几十页的PDF报告、冗长的会议纪要或是海量的研究论文,想要快速抓住核心要点,简直像大海捞针。手动…...

DriveBench:面向真实驾驶场景的长序列多智能体交互基准测试框架

1. 项目概述:从“世界基准”到“驾驶基准”的演进如果你在自动驾驶或者计算机视觉领域摸爬滚打过几年,一定对“基准测试”(Benchmark)这个词又爱又恨。爱的是,它提供了一个相对公平的擂台,让不同算法、不同…...

基于PIR传感器与LIFX智能灯泡的物联网运动感应照明系统实战

1. 项目概述与核心价值如果你对智能家居自动化感兴趣,并且想亲手打造一个既实用又有趣的照明项目,那么这个基于Adafruit FunHouse和LIFX智能灯泡的运动感应照明系统,绝对是一个绝佳的起点。它不仅仅是一个“开灯关灯”的简单触发器࿰…...

AI驱动命令行工具:用自然语言自动化开发任务

1. 项目概述:一个为开发者“下厨”的AI助手如果你是一名开发者,每天在终端里敲打命令,构建、部署、调试,那么你肯定对重复性的命令行操作感到厌倦。比如,每次启动一个新项目,都要手动创建目录结构、初始化G…...

Apache Burr:用状态机模式构建Python流式应用

1. 项目概述:一个用于构建流式应用的Python框架最近在折腾一些实时数据处理和模型推理的项目,从简单的日志分析到复杂的在线推荐,总感觉现有的工具链要么太重,要么太散。想要一个既能处理流式数据,又能轻松集成机器学习…...

从零打造会“看”的电子眼:Teensy与OLED的嵌入式图形与传感器实践

1. 项目概述:打造一个会“看”的电子生命体几年前,我第一次在创客社区看到“Uncanny Eyes”项目时就被深深吸引了。一个微小的OLED屏幕,在代码驱动下,竟然能呈现出如此逼真、灵动的眼球运动,那种介于生命与机械之间的诡…...

开源AI图像生成工具Dream-Creator:本地部署与Stable Diffusion实战指南

1. 项目概述:一个开源的AI图像生成与创作工具 最近在GitHub上闲逛,发现了一个挺有意思的项目叫“Dream-Creator”。光看名字,你可能会联想到一些AI绘画或者创意生成工具。没错,这确实是一个围绕AI图像生成的开源项目。作为一个在…...

基于Docker构建标准化开发环境:原理、实践与VSCode集成指南

1. 项目概述:一个面向开发者的“开箱即用”环境在软件开发这条路上,我踩过最多的坑,往往不是来自复杂的业务逻辑,而是来自那句“在我机器上好好的”。环境配置,这个看似基础却又无比磨人的环节,消耗了无数开…...

AI智能体操作安卓设备:基于agent-droid-bridge的自动化实践

1. 项目概述:连接AI与安卓设备的桥梁 最近在折腾AI智能体(Agent)和自动化流程时,遇到了一个挺有意思的需求:如何让运行在服务器上的AI程序,直接去操作一台真实的安卓手机或模拟器,完成一些复杂的…...