如何不修改模型参数来强化大语言模型 (LLM) 能力?

前言

如果你对这篇文章感兴趣,可以点击「【访客必读 - 指引页】一文囊括主页内所有高质量博客」,查看完整博客分类与对应链接。

大语言模型 (Large Language Model, LLM, e.g. ChatGPT) 的参数量少则几十亿,多则上千亿,对其的训练往往需要大量的算力、智力以及财力支撑。基于此,许多低成本提高 LLM 能力的方法也相应被提出,其中包括模型微调 (e.g., LoRA) 以及一些无须改变模型参数的方法。本文主要关注后者,对下述几种常见的方法进行大致介绍:

- 提示语设计 (Prompt Engineering)

- 上下文学习 (In-Context Learning)

- 思维链 (Chain of Thought, CoT)

- Self-Consistency with CoT / Self-Refine

- Tree of Thought (ToT)

- LLM 调用工具 (Tools)

- WebGPT / Toolformer / ToolLLM

- Retrieval-Augmented Generation (RAG)

- 多模型合作

Prompt Engineering

Prompt(提示语)即给大语言模型的「指令」或「问题」,来引导模型输出合适的内容。

大语言模型与传统机器学习模型的最大区别在于,其具有一定意义上的 “通用能力”,即可以在不改变模型参数的前提下,完成各种各样的任务,例如文本分类 / 机器翻译 / 问答系统 / 文本摘要 / 情感分析等等。而在过去,不同的任务通常需要特定的模型来处理,例如机器翻译和情感分析,就无法只通过一个模型来处理。

由于语言模型的能力从 “专用” 转向了 “通用”,为了使模型更好地识别到对话中所需要完成的具体任务,Prompt Engineering(提示语设计)应运而生,即根据任务需求设计合适的提示语,以获得更精确且更高质量的回答。在使用大语言模型时,通过调整输入的 Prompt,可以极大地影响模型生成的内容,进而强化模型的能力。

提示词通常可以包含以下几个要素:

- 指令:想要模型执行的特定任务;

- 上下文:包含外部信息或额外的上下文信息,引导模型更好地响应;

- 问题描述:输入的具体问题;

- 回答格式:指定输出的类型或格式。

通常来说,指令 / 问题描述越清晰,上下文包含的有关信息越充分,模型越有可能输出高质量的回答。

此处举一个例子(1/2/3 行分别对应指令/问题/输出格式):

为不同的任务设计针对性的 Prompt,可以在不改变模型参数的情况下,强化模型回答的质量。关于 Prompt Engineering 的更多内容可以参考:提示工程指南、ChatGPT Prompt 整理。

In-Context Learning

In-Context Learning(上下文学习),指模型通过输入的上下文信息(通常是示例、对话历史、文本片段等)来推断任务或模式,并依次生成响应,而无需额外的模型训练。In-Context Learning 也可以视作是 Prompt Engineering 的一种形式,尽管后者更侧重于设计特定任务的提示语。

大语言模型的 “通用能力” 不仅体现在其可以做很多不同的任务,还体现在其可以根据 Prompt 中给出的上下文信息,在不改变参数的情况下进行 “学习”。

例如下述这个任务(生成式 AI 导论 2024 - 第 3 讲):

新闻分成以下类别:这些类别的定义可能与一般的定义不同:

- 政治:报道有关国家经济的消息,例如企业、投资、金融、股市。

- 社会:报道社会上发生的事件,例如灾难、天气、犯罪、人情趣味。

- 财经:报道国内的政治消息,例如政府部门、政策、选举、政策。

- 生活消费:报道与生活相关的小事,例如购物、气象、交通、医疗保健。

- 影视娱乐:报道有关娱乐圈的消息,例如艺人、节目、婚丧。

- 体育:报道与体育运动相关的消息,例如比赛、职业运动、运动明星。

- 国际:报道海外发生的事件,例如战争、大选、外交谈判、贸易。我会给你一篇新闻,请告诉我该新闻属于哪一类,只给我类别就好。

然后给出的具体新闻如下:

- “AI题材持续引领,芯片股今年以来股价暴涨近50%,周二(13日)收于721.28美元,市值达到1.78万亿美元,正式超过全球电商巨头亚马逊的市值1.75万亿美元,成为排名第4大的美国公司。”

这则新闻实际上属于财经类,但由于我们上面颠倒了新闻类别的定义,因此我们希望模型输出的是「政治」。经过测试,ChatGPT-4o 输出的仍然是「财经」,但 ChatGPT-o1 的输出则为「政治」。

可以看到大语言模型根据输入的上下文实现了某种意义的 “学习”,类似于先前预训练模型上实现的 “zero-shot learning” 与 “few-shot learning” 的效果:

zero-shot learning:模型能够在没有见过某些任务的情况下,实现正确的预测(例如上面的例子);few-shot learning:模型能够在只有极少数标注样本的情况下,在新任务上做出正确的预测。- ps:不过此处有一些不同,以往预训练模型实现的少样本学习,通常需要微调模型参数,但 LLM 可以仅通过修改 Prompt 实现,不需要修改模型参数。

基于大语言模型表现出的 In-Context Learning 的性质,也有许多人尝试用 LLM 做表格型任务,即将任务的少量标注样本通过 Prompt 的形式喂给模型,使模型能够基于这些样本实现对这个任务的正确预测。

例如下面这个简单的例子(From ChatGPT):

任务:填写下表中缺失的值。示例:| 产品名称 | 价格 | 销售数量 | 总销售额 |

|---------|-----|---------|---------|

| 苹果 | 1.2 | 50 | 60 |

| 香蕉 | 0.8 | 30 | 24 |

| 橙子 | 1.0 | 40 | 40 |

| 葡萄 | 2.0 | 20 | 40 |现在,使用相同的逻辑填写下表:| 产品名称 | 价格 | 销售数量 | 总销售额 |

|---------|-----|---------|---------|

| 苹果 | 1.6 | 30 | ? |

| 香蕉 | 1.8 | 50 | ? |

| 橙子 | 2.0 | 20 | ? |

| 葡萄 | 4.0 | 10 | ? |

ChatGPT 可以识别出「总销售额 = 价格 * 销售数量」的关系,并输出正确的结果:

Chain of Thought (CoT)

思维链 (CoT) 即让模型通过一系列中间步骤来思考问题,而不是直接给出最终答案。通过将推理过程分解成可理解的步骤,可以使模型避免常见的错误推断,并在复杂任务上提供更精准的答案。

如下图所示,通过引导模型给出答案的思考过程,模型在具体任务上取得了更好的结果 (NeurIPS22 - CoT):

基于 CoT 的工作,后续有许多进一步强化 CoT 效果的工作,接下来将对其中的一些主要内容进行介绍。

Self-Consistency with CoT

LLM 生成文本的方式是预测 next token,即 Decoder 不断根据已生成的内容,输出下一个字符。

Decoder 的实际功能是预测字符表中,每个字符作为下一个输出字符的概率,因此一种常见的输出策略就是 Greedy decode,每次输出概率最高的那个字符。

Self-Consistent CoT 就是在 CoT 的基础上,对模型的输出策略进行修改。具体操作如下:

- 首先构造引导模型按步骤思考的 CoT prompt;

- 随后将 Greedy decode 更换为按 next token 的概率采样选择下一个输出字符,来生成一组不同的回答;

- 最后选取一致性最高的答案(出现次数最多的答案)作为最终的输出结果。

下图为具体工作流程 (ICLR23 - Self-Consistency with CoT):

Self-Refine

此外,也可以在 CoT 的每一个步骤中,让语言模型对生成的答案进行自我纠错,进一步地提升答案的准确性。此处先介绍模型自我纠错的方式,其与 CoT 的结合放在下一小节的 Tree of Thought 中进行介绍。

模型自我纠错的具体操作如下:

- 首先将问题 x x x 输入给模型,得到模型的输出 y 0 \mathbf{y}_0 y0;

- 然后让模型判断 y 0 \mathbf{y}_0 y0 作为 x x x 问题的回答是否合适,得到模型的反馈 fb 0 \text{fb}_0 fb0;

- 再将 x , y 0 , fb 0 x,\mathbf{y}_0,\text{fb}_0 x,y0,fb0 都输入给模型,得到模型改进后的回答 y 1 \mathbf{y}_1 y1;

- 整个过程可以不断迭代,直至触发停止条件。

下述为一个具体例子 (NeurIPS23 - Self-Refine):

整体的算法如下所示(只需要提供生成回答 p gen p_{\text{gen}} pgen、提供反馈 p fb p_{\text{fb}} pfb、改进回答 p refine p_{\text{refine}} prefine 的 Prompt,再不断迭代即可):

Tree of Thought (ToT)

上述方法的特点分别为:(1) 按步骤进行思考;(2) 多次生成回答并选取一致性最高的答案;(3) 让模型检查自己的答案。将这三个特点进行融合,可以得到 Tree of Thought 方法,其与先前方法的区别可参考下述流程图 (NeurIPS23 - ToT):

Tree of Thought 的具体操作如下:

- 首先采用了 CoT 的方式,模型是一步一步思考的(即回答生成过程是一层一层往下);

- 其次采用了 CoT-SC 的方式,每一步会生成多个候选回答(即每一个 Thought 下面有多个子节点);

- 最后采用了类似 Self-Refine 的方式,对每一步的 Thought 进行评估,如果评估的结果不好,则不再继续深入,类似于搜索剪枝的操作(即标红的 Thought 没有继续往下搜)。

下述为一个 24 点(判断给出的四个数字是否可以通过加减乘除得到 24)的具体例子,其中标红的 Thought State 节点即评估结果不好被剪枝:

LLM + Tools

LLM 还可以通过调用一些外部工具(APIs),在不修改模型参数的同时提高模型性能。常见的外部工具有:搜索引擎、代码编译器、文生图 AI 等等。

WebGPT

WebGPT 是 OpenAI 在 21 年提出的一种 GPT 调用搜索引擎的方式,其调用工具的方法为预测 next command,类似于预测 next token 的思想。

具体来说,模型首先会判断是否要借助搜索引擎,如果借助则会执行 Search <query> 的命令,得到最初的搜索结果,随后根据之前获取的结果判断应该执行下述哪一个 command:

例如可能会触发 Clicked on link (点击某个链接)、Quote (收藏某段内容)、Back (返回前一个页面) 等操作,如果最终触发了 End: Answer,则会根据之前收藏的所有页面内容,生成最终的回答。

由于 Command 是重新定义的,因此模型在 GPT-3 的基础上,根据人类标注的调用搜索引擎的数据 + 强化学习再次进行了训练,具体细节可参考原论文。

Toolformer

随后 23 年提出的 Toolformer 在 WebGPT 上更进一步,不仅可以调用搜索引擎,还可以调用计算器、翻译器等各类工具。下述为 Toolformer 调用的工具 (APIs) 示例:

其思想依然是类似于 next token 预测,即如果输出了调用某些工具的触发词,则会调用相应的工具,并根据工具输出的结果继续生成后续文字。例如当模型生成 [QA(“Which country is Pittsburgh in?”)] 这样的内容时,会自动调用 QA 这个工具,得到 United States 这个输出后,将其嵌入到原本的生成内容中。

在模型训练过程中,Toolformer 利用了其他 LLM,例如 GPT-3 来生成训练数据。下述为论文中给出的用其他 LLM 来生成调用 QA 这个工具的训练数据的 Prompt:

为了进一步提高这种方式生成的数据质量,Toolformer 会对这些数据进行验证,即判断根据上述生成数据的内容,「调用 API 的输出」对比「不调用 API 的输出」,前者是否更接近正确答案。如果调用 API 后的结果更准确,则保留这条数据。

ToolLLM

更进一步地,ToolLLM 从 RapidAPI Hub 中收集了 16464 个现实世界的 RESTul APIs,并使用 ChatGPT 为这些 APIs 构建了指令微调的数据集。基于这些数据集进行微调,ToolLLM 实现了对这些 APIs 的管理与调用。RapidAPI 的层级结构,以及为这些 APIs 构建数据集的示例如下所示:

ToolLLM 整体分为 Data Construction、Train 以及 Inference 三部分,如下所示:

首先是数据集的构建:先从 RapidAPI 中搜集大量 APIs,再使用 ChatGPT 为这些 API 构建指令微调的数据集。随后类似于 Toolformer 的想法,再使用 ChatGPT 选取一些高质量的指令,即采用一种类似深度搜索树的方式(即下图中的 DFSDT,与 Tree of Thought 的想法类似),搜索 API 的调用路径,保留能成功找到路径的指令,如下图所示:

随后基于这些指令,可以通过监督学习 (Supervised Fine-tuning, SFT) 在 LLaMA 的基础上得到 ToolLLaMA;再基于 API 的文档,训练一个 API Retriever,用于后续判断指令与哪些 API 比较相关。

最后在模型推理时,先根据用户给出的指令,利用 API Retriever 获取相关的 APIs,然后再通过上述 DFSDT 的方式,查搜并评估不同的 API 调用路径,直至输出最终的答案。

Retrieval-Augmented Generation (RAG)

RAG 的核心思想为「检索技术 + LLM 提示语」,即根据用户的 Query 从垂域数据库中搜索出相关的内容,并使用合适的 Prompt 将这些相关内容与用户原始 Query 合并在一起,使得 LLM 回答地更加准确。

为了快速从垂域数据库中获取相关的内容,需要提前做好以下两步:

- 利用已有的一些 Embedding 模型(例如 ChatGPT-Embedding、Sentence Transformers 等)将知识库的文档转成向量形式;

- 利用当前向量数据库的一些技术(例如 Faiss、NMSLIB),构建这些向量形式的向量索引,以支持后续根据用户的 Query 快速查询相关内容。

一个初步的 RAG 框架如下所示,更多 RAG 相关内容以及进阶方法,可以参考:知乎 - 大模型 RAG、LLM - RAG 研究

多模型合作

多个模型一起合作,也是一种强化大语言模型能力的方式,类似于集成学习 (Ensemble Learning) 的想法。

FrugalGPT:让合适的模型做合适的事情

FrugalGPT 主要关注于如何降低 LLM 推理时的开销,其中提出了 LLM cascade 的方法,其核心思想为:(1) 简单的问题交给弱一些的模型(开销更小),困难的问题再交给强的模型;(2) 不同模型的能力可能可以互补。

下述图片表示了不同 LLM 在不同 Benchmark 上的表现,体现了模型能力之间的互补。图中的每一个格子表示对应行 LLM 答错但对应列 LLM 答对的比例,例如图 (a) 的第四行第三列表示:有 4% 的数据,GPT-4 回答错误但 GPT-3 回答正确。

LLM cascade 的具体做法是训练一个评分器 Scorer,其可以对一组输入和一组答案进行打分。随后将 LLM 根据开销串成级联的形式,如果开销较小的 LLM 得到的答案评分已经超过该 LLM 的预设阈值,则可以不再 query 开销更大的 LLM,整体流程类似如下形式:

LLM 的级联顺序以及对应的评分阈值,通过求解下述优化式得到(采用混合整数规划求解):

max L , τ E [ r ( a , f L z ( q ) ) ] s.t. E [ ∑ i = 1 z c ~ L i , 2 ∥ f L i ( q ) ∥ + c ~ L i , 1 ∥ q ∥ + c ~ L i , 0 ] ≤ b , z = arg min i g ( q , f L i ( q ) ) ≥ τ i . \begin{aligned} \max _{\boldsymbol{L}, \boldsymbol{\tau}} & \mathbb{E} {\left[r\left(a, f_{L_z}(q)\right)\right] } \\ \text { s.t. } & \mathbb{E}\left[ \sum_{i=1}^z \tilde{c}_{L_i, 2}\left\|f_{L_i}(q)\right\|+\tilde{c}_{L_i, 1}\|q\|+\tilde{c}_{L_i, 0}\right] \leq b, \\ & \quad z=\arg \min _i g\left(q, f_{L_i}(q)\right) \geq \boldsymbol{\tau}_i. \end{aligned} L,τmax s.t. E[r(a,fLz(q))]E[i=1∑zc~Li,2∥fLi(q)∥+c~Li,1∥q∥+c~Li,0]≤b,z=argiming(q,fLi(q))≥τi.

上述式子中,下标 z z z 表示最终选择的 LLM,因此最大化 E [ r ( a , f L z ( q ) ) ] \mathbb{E} {\left[r\left(a, f_{L_z}(q)\right)\right] } E[r(a,fLz(q))] 即最大化最终选择的 LLM 在问题 q q q 上的输出与真实答案 a a a 的相似度。另外,第二个约束展示了 z z z 是如何选取的,即使得评分器 g g g 输出评分超过 LLM 阈值 τ i \boldsymbol{\tau}_i τi 的第一个 LLM。第一个约束则表示整体的开销不能超过 Budget b b b,其中 c ~ \tilde{c} c~ 分别对应 LLM 输出 token 开销、输入 token 开销以及固定开销。

论文最后展示了上述三个数据集上 FrugalGPT 对比 Best individual LLM 的表现:

模型合作:让模型彼此讨论

也可以让模型之间互相讨论,即将 LLM A 的回答输入给 LLM B,让其参考后再进行输出。

例如采用下述的 Prompt(From arXiv 2023),让模型之间互相讨论:

如果 Prompt 里暗示模型之前其他模型的意见仅作为参考,则需要更长的讨论轮次才能最终达成一致。例如上述图片中 Debate Length 为 Long 的 Prompt。

以下为一些实验结果,可以看到互相讨论能够增强模型的能力:

参考资料

- Prompt Engineering Guide

- Hung-yi Lee: 生成式 AI 导论 2024 - 课程网站

- Hung-yi Lee: 生成式 AI 导论 2024 - 第 3 讲至第 5 讲

- Hung-yi Lee: 能够使用工具的 AI - New Bing, WebGPT, Toolformer

- Hung-yi Lee:生成式 AI 2023 - FrugalGPT(上)、(下)

- 知乎:大模型 RAG(检索增强生成)含高级方法

- NeurIPS 2022 - Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

- ICLR 2023 - Self-Consistency Improves Chain of Thought Reasoning in Language Models

- NeurIPS 2023 - Self-Refine: Iterative Refinement with Self-Feedback

- NeurIPS 2023 - Tree of Thoughts: Deliberate Problem Solving with Large Language Models

- arXiv 2021 - WebGPT: Browser-assisted question-answering with human feedback

- NeurIPS 2023 - Toolformer: Language Models Can Teach Themselves to Use Tools

- arXiv 2023 - FrugalGPT: How to Use Large Language Models While Reducing Cost and Improving Performance

- arXiv 2023 - Improving Factuality and Reasoning in Language Models through Multiagent Debate

- ICLR 2024 - ToolLLM: Facilitating Large Language Models to Master 16000+ Real-world APIs

相关文章:

如何不修改模型参数来强化大语言模型 (LLM) 能力?

前言 如果你对这篇文章感兴趣,可以点击「【访客必读 - 指引页】一文囊括主页内所有高质量博客」,查看完整博客分类与对应链接。 大语言模型 (Large Language Model, LLM, e.g. ChatGPT) 的参数量少则几十亿,多则上千亿,对其的训…...

AF3 AtomAttentionEncoder类的init_pair_repr方法解读

AlphaFold3 的 AtomAttentionEncoder 类中,init_pair_repr 方法方法负责为原子之间的关系计算成对表示(pair representation),这是原子转变器(atom transformer)模型的关键组成部分,直接影响对蛋白质/分子相互作用的建模。 init_pair_repr源代码: def init_pair_repr(…...

DDoS攻击防御方案大全

1. 引言 随着互联网的迅猛发展,DDoS(分布式拒绝服务)攻击成为了网络安全领域中最常见且危害严重的攻击方式之一。DDoS攻击通过向目标网络或服务发送大量流量,导致服务器过载,最终使其无法响应合法用户的请求。本文将深…...

Vue中常用指令

一、内容渲染指令 1.v-text:操作纯文本,用于更新标签包含的文本,但是使用不灵活,无法拼接字符串,会覆盖文本,可以简写为{{}},{{}}支持逻辑运算。 用法示例: //把name对应的值渲染到…...

Servlet解析

概念 Servlet是运行在服务端的小程序(Server Applet),可以处理客户端的请求并返回响应,主要用于构建动态的Web应用,是SpringMVC的基础。 生命周期 加载和初始化 默认在客户端第一次请求加载到容器中,通过反射实例化…...

带虚继承的类对象模型

文章目录 1、代码2、 单个虚继承3、vbptr是什么4、虚继承的多继承 1、代码 #include<iostream> using namespace std;class Base { public:int ma; };class Derive1 :virtual public Base { public:int mb; };class Derive2 :public Base { public:int mc; };class Deri…...

深度学习中的离群值

文章目录 深度学习中有离群值吗?深度学习中的离群值来源:处理离群值的策略:1. 数据预处理阶段:2. 数据增强和鲁棒模型:3. 模型训练阶段:4. 异常检测集成模型: 如何处理对抗样本?总结…...

如何利用Logo设计免费生成器创建专业级Logo

在当今的商业世界中,一个好的Logo是品牌身份的象征,它承载着公司的形象与理念。设计一个专业级的Logo不再需要花费大量的金钱和时间,尤其是当我们拥有Logo设计免费生成器这样的工具时。接下来,让我们深入探讨如何利用这些工具来创…...

)

Mysql SQL 超实用的7个日期算术运算实例(10k)

文章目录 前言1. 加上或减去若干天、若干月或若干年基本语法使用场景注意事项运用实例分析说明2. 确定两个日期相差多少天基本语法使用场景注意事项运用实例分析说明3. 确定两个日期之间有多少个工作日基本语法使用场景注意事项运用实例分析说明4. 确定两个日期相隔多少个月或多…...

运算指令(PLC)

加 ADD 减 SUB 乘 MUL 除 DIV 浮点运算 整数运算...

「Mac畅玩鸿蒙与硬件49」UI互动应用篇26 - 数字填色游戏

本篇教程将带你实现一个数字填色小游戏,通过简单的交互逻辑,学习如何使用鸿蒙开发组件创建趣味性强的应用。 关键词 UI互动应用数字填色动态交互逻辑判断游戏开发 一、功能说明 数字填色小游戏包含以下功能: 数字选择:用户点击…...

机器学习经典算法——逻辑回归

目录 算法介绍 算法概念 算法的优缺点 LogisticRegression()函数理解 环境准备 算法练习 算法介绍 算法概念 逻辑回归(Logistic Regression)是一种广泛应用于分类问题的机器学习算法。 它基于线性回归的思想,但通过引入一个逻辑函数&…...

【数据仓库金典面试题】—— 包含详细解答

大家好,我是摇光~,用大白话讲解所有你难懂的知识点 该篇面试题主要针对面试涉及到数据仓库的数据岗位。 以下都是经典的关于数据仓库的问题,希望对大家面试有用~ 1、什么是数据仓库?它与传统数据库有何区别? 数据仓库…...

【UE5 C++课程系列笔记】19——通过GConfig读写.ini文件

步骤 1. 新建一个Actor类,这里命名为“INIActor” 2. 新建一个配置文件“Test.ini” 添加一个自定义配置项 3. 接下来我们在“INIActor”类中获取并修改“CustomInt”的值。这里定义一个方法“GetINIVariable” 方法实现如下,其中第16行代码用于构建配…...

JS 中 json数据 与 base64、ArrayBuffer之间转换

JS 中 json数据 与 base64、ArrayBuffer之间转换 json 字符串进行 base64 编码 function jsonToBase64(json) {return Buffer.from(json).toString(base64); }base64 字符串转为 json 字符串 function base64ToJson(base64) {try {const binaryString atob(base64);const js…...

USB 驱动开发 --- Gadget 驱动框架梳理

编译链接 #----》 linux_5.10/drivers/usb/gadget/Makefileobj-$(CONFIG_USB_LIBCOMPOSITE) libcomposite.o libcomposite-y : usbstring.o config.o epautoconf.o libcomposite-y composite.o functions.o configfs.o u_f.oobj-$(CONFIG_USB_GADG…...

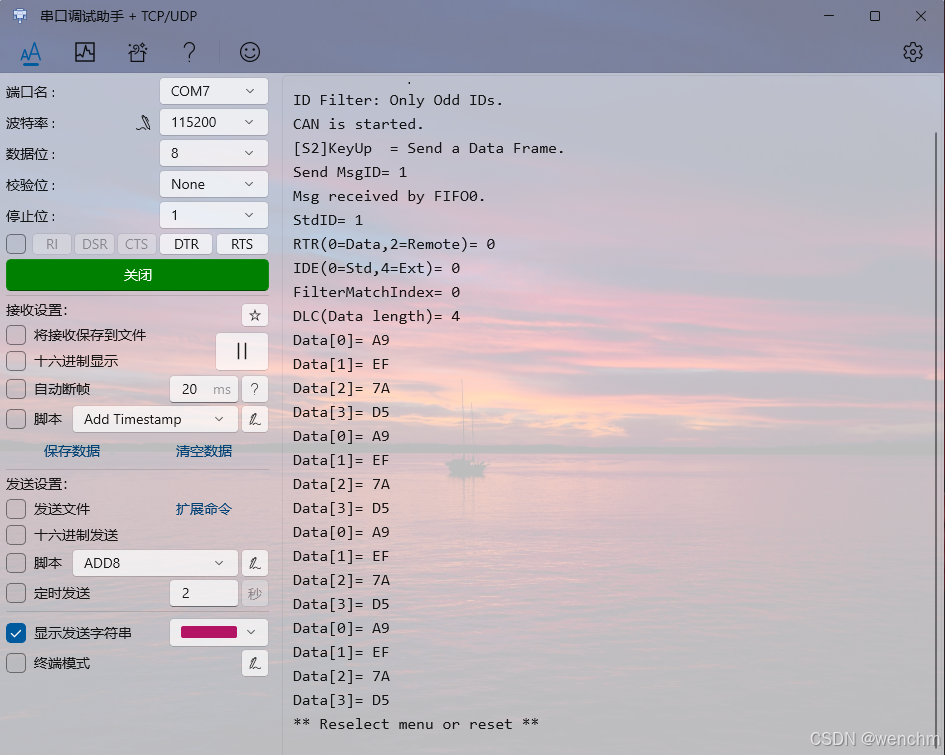

细说STM32F407单片机中断方式CAN通信

目录 一、工程配置 1、时钟、DEBUG、USART6、GPIO、CodeGenerator 2、CAN1 3、NVIC 二、软件设计 1、KEYLED 2、can.h 3、can.c (1)CAN1中断初始化 (2)RNG初始化和随机数产生 (3) 筛选器组设置…...

Python应用指南:高德交通态势数据

在现代城市的脉络中,交通流量如同流动的血液,交通流量的动态变化对出行规划和城市管理提出了更高的要求。为了应对这一挑战,高德地图推出了交通态势查询API,旨在为开发者提供一个强大的工具,用于实时获取指定区域或道路…...

医学图像分析工具01:FreeSurfer || Recon -all 全流程MRI皮质表面重建

FreeSurfer是什么 FreeSurfer 是一个功能强大的神经影像学分析软件包,广泛用于处理和可视化大脑的横断面和纵向研究数据。该软件由马萨诸塞州总医院的Martinos生物医学成像中心的计算神经影像实验室开发,旨在为神经科学研究人员提供一个高效、精确的数据…...

.NET框架用C#实现PDF转HTML

HTML作为一种开放标准的网页标记语言,具有跨平台、易于浏览和搜索引擎友好的特性,使得内容能够在多种设备上轻松访问并优化了在线分享与互动。通过将PDF文件转换为HTML格式,我们可以更方便地在浏览器中展示PDF文档内容,同时也更容…...

航空航天为什么离不开高强镁合金?国产替代到哪一步了

飞机每减重一千克,全年大约节省四千两百美元的燃油费用——这是航空工程师熟悉的经验值。在商业航空领域,这个数字还只是财务账;在战斗机、导弹和卫星的世界里,减重的收益被换算成更远的航程、更大的载荷、更高的机动性࿰…...

Raspberry Pi Debug Probe:RP2040嵌入式开发的调试利器与实战指南

1. 项目概述:为什么你需要一个Raspberry Pi Debug Probe?如果你玩过树莓派Pico或者任何基于RP2040芯片的开发板,肯定遇到过这样的场景:写好的代码,点一下“上传”,然后……就没有然后了。板子上的LED没按你…...

ZTE光猫工厂模式解锁:5分钟开启隐藏功能的终极指南

ZTE光猫工厂模式解锁:5分钟开启隐藏功能的终极指南 【免费下载链接】zteOnu A tool that can open ZTE onu device factory mode 项目地址: https://gitcode.com/gh_mirrors/zt/zteOnu 核心关键词:ZTE光猫工厂模式解锁 长尾关键词: ZT…...

Matlab,plot绘图如何添加边框

matlab生成的图——编辑(E)——坐标区属性(A)——框样式——Box,勾选效果:...

1688运营培训/询盘成本从500元降到63.9!1688运营培训还原1688真实玩法

1688运营培训/询盘成本从500元降到63.9!1688运营培训还原1688真实玩法500块钱一个询盘,你敢信?做1688运营培训这么多年,这个数字我都觉得离谱。前阵子遇到一个老板,一上来就开始吐槽1688,说1688就是个垃圾平…...

基于GSM与Arduino的远程控制系统:DIY电话控制与短信报警方案

1. 项目概述与核心价值如果你曾经想过,在离家几十公里外,仅凭一部普通的手机,就能远程打开家里的车库门、查看门窗是否关好,甚至在异常情况发生时让系统自动打电话给你报警,那么这个基于GSM的远程控制系统项目…...

【大模型聚合平台深度评测:阿里云百炼 vs 腾讯云 ADP,企业如何选型?】

大模型聚合平台深度评测:阿里云百炼 vs 腾讯云 ADP,企业如何选型? 随着大模型技术的快速发展,越来越多的企业开始将 AI 能力融入到业务流程中。然而,面对市场上众多的大模型产品,企业往往面临着 “选择困难…...

Noto字体终极指南:告别“豆腐块“,让全球文字清晰显示

Noto字体终极指南:告别"豆腐块",让全球文字清晰显示 【免费下载链接】noto-fonts Noto fonts, except for CJK and emoji 项目地址: https://gitcode.com/gh_mirrors/no/noto-fonts 在数字世界中,你是否经常看到那些令人困…...

泰拉瑞亚地图编辑器:从像素画布到创意世界的蜕变之旅

泰拉瑞亚地图编辑器:从像素画布到创意世界的蜕变之旅 【免费下载链接】Terraria-Map-Editor TEdit - Terraria Map Editor - TEdit is a stand alone, open source map editor for Terraria. It lets you edit maps just like (almost) paint! It also lets you cha…...

3步掌握OpenSpeedy:免费开源游戏加速工具使用指南

3步掌握OpenSpeedy:免费开源游戏加速工具使用指南 【免费下载链接】OpenSpeedy 🎮 An open-source game speed modifier. 项目地址: https://gitcode.com/gh_mirrors/op/OpenSpeedy 你是否曾为游戏卡顿而烦恼?是否希望在单机游戏中加快…...